Anahtar Kelimeler:AGI, Sora2, RAG, Gemini 3.0, AI oyuncaklar, Akıllı ajanlar, Büyük dil modelleri, AI video oluşturma teknolojisi, Bilgi erişimli üretim evrimi, Çok modlu AI modelleri, AI destekli ilaç geliştirme platformu, Hesaplama-elektrik sinerji teknolojisi

🎯 Gelişmeler

Andrej Karpathy: AGI uzun bir eğridir, patlayıcı bir büyüme değil : Eski OpenAI çekirdek araştırmacısı Andrej Karpathy, AI’ın “patlama yılı”na dair mevcut söylemin aşırı coşkulu olduğunu ve AGI’ın gerçekleşmesinin onlarca yıl sürecek uzun bir evrim gerektirdiğini belirtti. Gerçek Agent’ların mevcut “hayalet” benzeri sohbet robotlarının aksine kalıcılık, hafıza ve süreklilik özelliklerine sahip olması gerektiğini vurguladı. AI’ın gelecekteki gelişiminin “veri doldurmaktan” “hedef öğretmeye” doğru kayması gerektiğini, görev odaklı ve geri bildirim döngülü eğitimle AI’ın basit bir araç olmaktan çıkıp toplumda kimliği, rolü ve sorumluluğu olan bir “ortak” haline gelmesini savundu. (Kaynak: 36氪)

Sora2 yayınlandı: AI video üretimi “süper hızlanma” aşamasına girdi : OpenAI, Sora2’yi ve sosyal uygulaması Sora App’i yayınladı. Sora App’in indirme sayısı ChatGPT’yi geride bırakarak AI video alanının “süper hızlanma” dönemine girdiğini gösterdi. Sora2, fiziksel gerçekçilik, çok modlu füzyon ve “kamera dili” anlama konularında çığır açarak, çoklu kamera geçişleri ve tutarlı hikaye akışı içeren videoları otomatik olarak üretebiliyor ve yaratım eşiğini büyük ölçüde düşürüyor. Baidu ve Google gibi yerel üreticiler de ürünlerini hızla güncelledi, ancak telif hakkı ve para kazanma modelleri sektörün karşı karşıya olduğu gerçek sorunlar olmaya devam ediyor. (Kaynak: 36氪)

RAG paradigmasının evrimi: Agent’lar ve uzun bağlam pencereleri altında “varoluşsal” tartışma : LLM’lerin uzun bağlam pencereleri ve Agent yeteneklerinin yükselişiyle birlikte, RAG’ın (Retrieval Augmented Generation) geleceği hararetli tartışmalara yol açtı. LlamaIndex, RAG’ın katmanlı Agent mimarisi aracılığıyla daha akıllı bilgi tabanı sorgulaması gerçekleştiren “Agent tabanlı retrieval”a evrildiğini düşünüyor; Hamel Husain, RAG’ın titiz bir mühendislik disiplini olarak önemini vurguluyor; Nicolas Bustamante ise “basit RAG öldü” diyerek, Agent’ların uzun bağlamla birleşerek doğrudan mantıksal navigasyon yapabileceğini ve RAG’ın Agent araç kutusunun bir bileşeni haline geleceğini iddia ediyor. (Kaynak: 36氪)

Google Gemini 3.0 modeli LMArena’da yayınlanmış olabilir, çok modlu yeni yetenekler sergiliyor : Google Gemini 3.0’ın “takma adlı” modelleri (lithiumflow ve orionmist) LMArena arena’da ortaya çıkmış olabilir. Yapılan testler, modellerin “saat okuma” görevinde zamanı doğru bir şekilde tanımlayabildiğini, SVG görüntü oluşturma yeteneğinin önemli ölçüde arttığını ve ilk kez iyi bir müzik besteleme yeteneği sergileyerek müzik tarzlarını taklit edip ritmi koruyabildiğini gösterdi. Bu gelişmeler, Gemini 3.0’ın çok modlu anlama ve üretimde önemli atılımlar yaptığını gösteriyor ve sektörde Google’ın yakında yeni bir model yayınlayacağına dair beklentileri artırıyor. (Kaynak: 36氪)

AI oyuncakları “AI+oyuncak”tan “AI x oyuncak” derin entegrasyonuna doğru ilerliyor : AI oyuncak pazarı, basit fonksiyon eklemeden derin entegrasyona doğru bir dönüşüm yaşıyor ve küresel pazar büyüklüğünün 2030 yılına kadar yüz milyarlarca seviyeye ulaşması bekleniyor. Yeni nesil AI oyuncakları, ses tanıma, yüz tanıma, duygu analizi gibi çok modlu teknolojiler aracılığıyla sahneyi aktif olarak algılayabiliyor, duyguları anlayabiliyor ve kişiselleştirilmiş arkadaşlık ve eğitim sunuyor. Endüstri modeli de “donanım satışından” “hizmet + sürekli içerik sunumuna” doğru kayarak çocukların, gençlerin ve yaşlıların artan duygusal arkadaşlık ve yaşam desteği ihtiyaçlarını karşılıyor ve insanlığın AI ile bir arada yaşamayı öğrenmesi için önemli bir aracı haline geliyor. (Kaynak: 36氪)

Lüks teknoloji markası BUTTONS, HALI Agent’ı ile ses ve video robotunu piyasaya sürdü : BUTTONS, Teslian’ın genel Agent’ı HALI ile donatılmış SOLEMATE akıllı ses ve video robotunu tanıttı. HALI, mekansal farkındalık ve fiziksel etkileşim yeteneklerine sahip olup, üç boyutlu semantik hafıza modeli aracılığıyla çevreyi anlıyor ve kullanıcının konumuna ve niyetine göre proaktif hizmetler sunabiliyor. Bu robot, akıllı hesaplama merkezinin büyük ölçekli işbirlikçi hesaplamasını kullanarak kaynakların, ekipmanların ve davranışların optimum düzenlemesini sağlıyor. Bu, AI’ın bedenlenmiş genel Agent’lara doğru ilerlediğini ve dijital dünya engellerini aşarak fiziksel ortamda “algılama-akıl yürütme-hareket etme” yeteneğine sahip olduğunu gösteriyor. (Kaynak: 36氪)

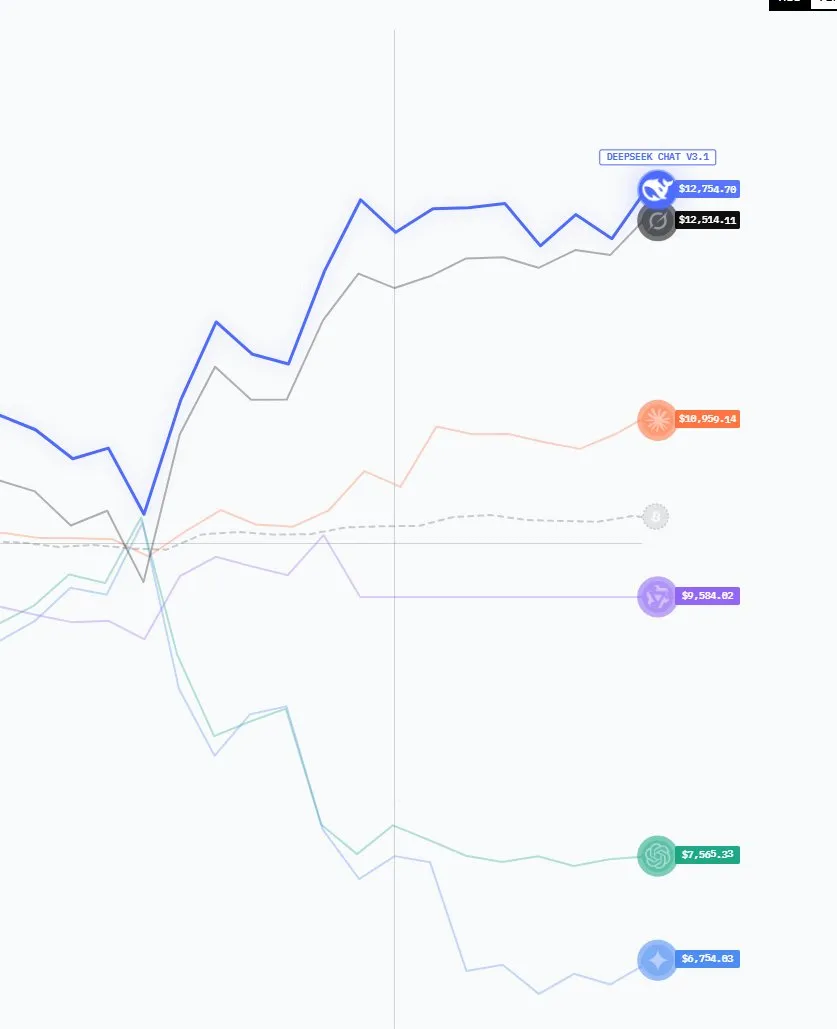

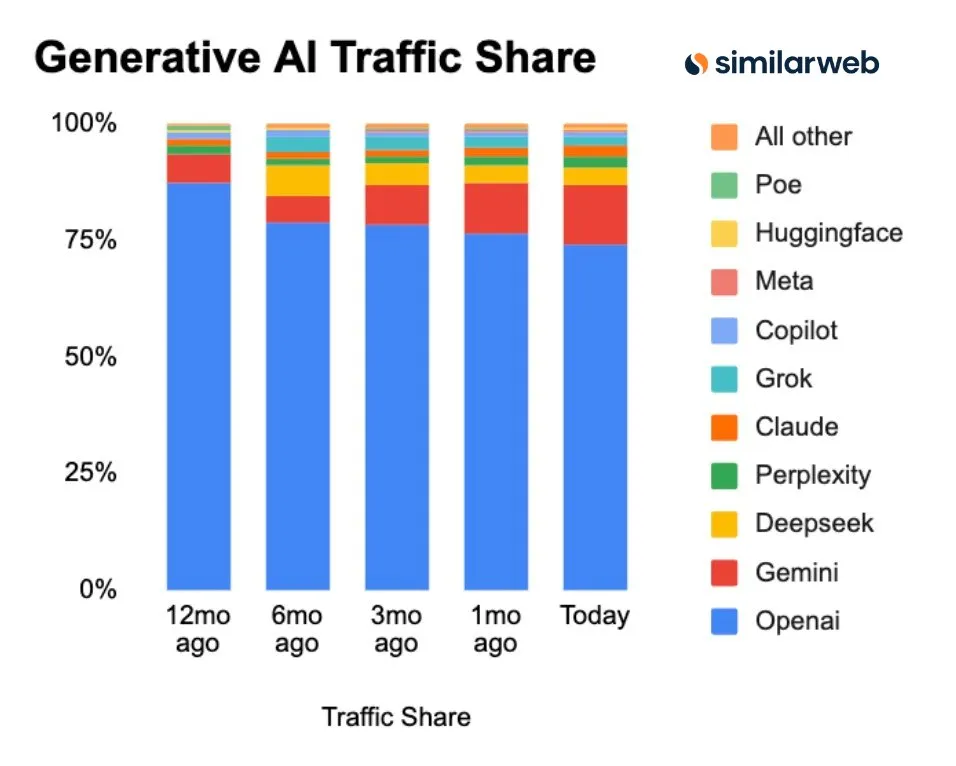

Çin AI modelleri yükselişte, pazar payı ve indirme sayıları önemli ölçüde arttı : Son veriler, GenAI pazar yapısının değiştiğini, ChatGPT’nin pazar payının sürekli düştüğünü ve Perplexity, Gemini, DeepSeek gibi rakiplerin yükselişte olduğunu gösteriyor. Özellikle dikkat çekici olan, geçen yıl öne çıkan ABD açık kaynak AI modellerinin bu yıl LMArena sıralamasında Çin modelleri tarafından domine edilmesi. DeepSeek ve Qwen gibi Çin modellerinin Hugging Face’teki indirme sayıları ABD modellerinin iki katı olup, Çin’in açık AI alanındaki giderek artan rekabet gücünü ortaya koyuyor. (Kaynak: ClementDelangue, ClementDelangue)

Google bir dizi AI güncellemesi yayınladı: Veo 3.1, Gemini API harita entegrasyonu vb. : Google bu hafta, video modeli Veo 3.1 (sahne genişletme ve referans görüntüleri destekliyor), Gemini API’nin Google Maps verileriyle entegrasyonu, Speech-to-Retrieval araştırması (konuşmadan metne dönüştürmeyi atlayarak doğrudan veri sorgulama), Hindistan’daki AI merkezine 15 milyar dolarlık yatırım ve Gmail/Calendar için Gemini zamanlama AI özelliği dahil olmak üzere birçok AI gelişmesini duyurdu. Aynı zamanda, AI Overviews özelliği “trafik katili” olduğu gerekçesiyle İtalyan haber yayıncıları tarafından soruşturma altında ve biyolojik veri çevirisi için C2S-Scale 27B modeli yayınlandı. (Kaynak: Reddit r/ArtificialInteligence)

Microsoft, MAI-Image-1’i tanıttı, görüntü oluşturma modeli yeteneği ilk ona girdi : Microsoft AI, tamamen kendi geliştirdiği ilk görüntü oluşturma modeli MAI-Image-1’i yayınladı. Bu model, LMArena’nın metinden görüntüye model sıralamasında ilk kez ilk ona girdi. Bu gelişme, Microsoft’un yerel görüntü oluşturma teknolojisi alanındaki güçlü yeteneğini gösteriyor ve çok modlu AI alanında daha da güçleneceğini, kullanıcılara daha kaliteli görüntü oluşturma deneyimi sunacağını müjdeliyor. (Kaynak: dl_weekly)

🧰 Araçlar

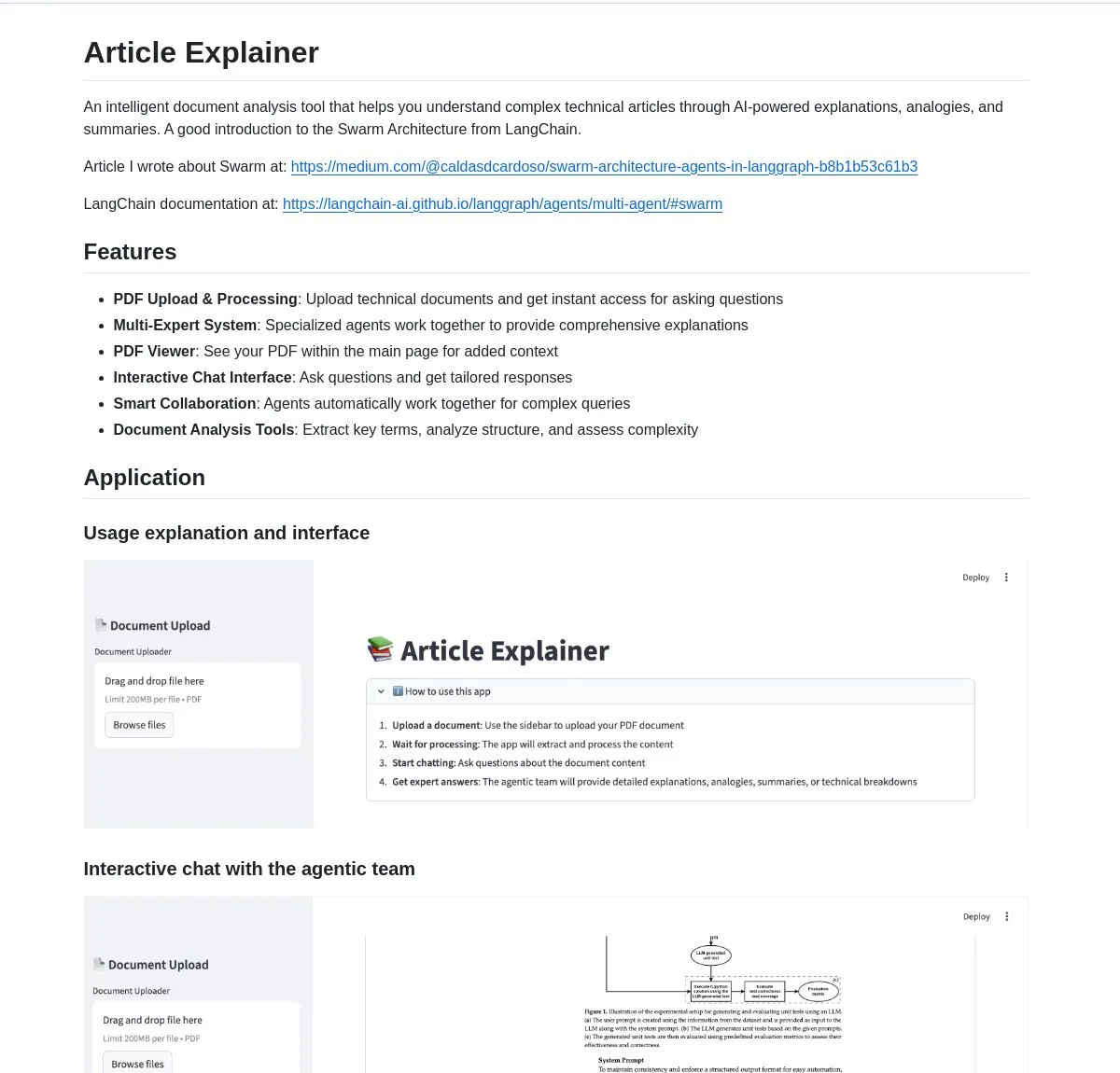

LangChain Article Explainer: AI belge analiz aracı : LangChain, “Article Explainer” adında bir AI belge analiz aracı yayınladı. Bu araç, LangGraph’ın Swarm Architecture’ını kullanarak karmaşık teknik makaleleri ayrıştırıyor. Çoklu Agent işbirliği aracılığıyla etkileşimli açıklamalar ve derinlemesine içgörüler sunuyor. Kullanıcılar doğal dil sorguları aracılığıyla bilgi edinebiliyor ve bu da teknik belgelerin anlama verimliliğini büyük ölçüde artırıyor. (Kaynak: LangChainAI)

Claude Code Skill: Claude’u profesyonel proje mimarına dönüştürüyor : Bir geliştirici, Claude’u profesyonel bir proje mimarına dönüştürebilen bir Claude Code Skill oluşturdu. Bu beceri, Claude’un kodlama yapmadan önce gereksinim belgeleri, tasarım belgeleri ve uygulama planları oluşturmasını otomatikleştirerek karmaşık projelerde bağlam kaybı sorununu çözüyor. Kullanıcı hikayeleri, sistem mimarisi, bileşen arayüzleri ve katmanlı görevleri hızla çıktı olarak verebiliyor, bu da proje planlama ve yürütme verimliliğini büyük ölçüde artırıyor ve çeşitli Web uygulamaları, mikro hizmetler ve ML sistemleri geliştirmeyi destekliyor. (Kaynak: Reddit r/ClaudeAI)

Perplexity AI Comet: Tarama ve araştırma verimliliğini artıran AI tarayıcı uzantısı : Perplexity AI Comet tarayıcı uzantısı erken erişime açıldı ve kullanıcıların tarama, araştırma ve üretkenliğini artırmayı hedefliyor. Bu araç, hızlı yanıtlar sunabiliyor, web sayfası içeriğini özetleyebiliyor ve AI işlevselliğini doğrudan tarayıcı deneyimine entegre ederek kullanıcılara daha akıllı ve verimli bilgi edinme yöntemleri sunuyor. Özellikle büyük miktarda çevrimiçi bilgiyi hızlıca işlemesi gereken kullanıcılar için uygundur. (Kaynak: Reddit r/artificial)

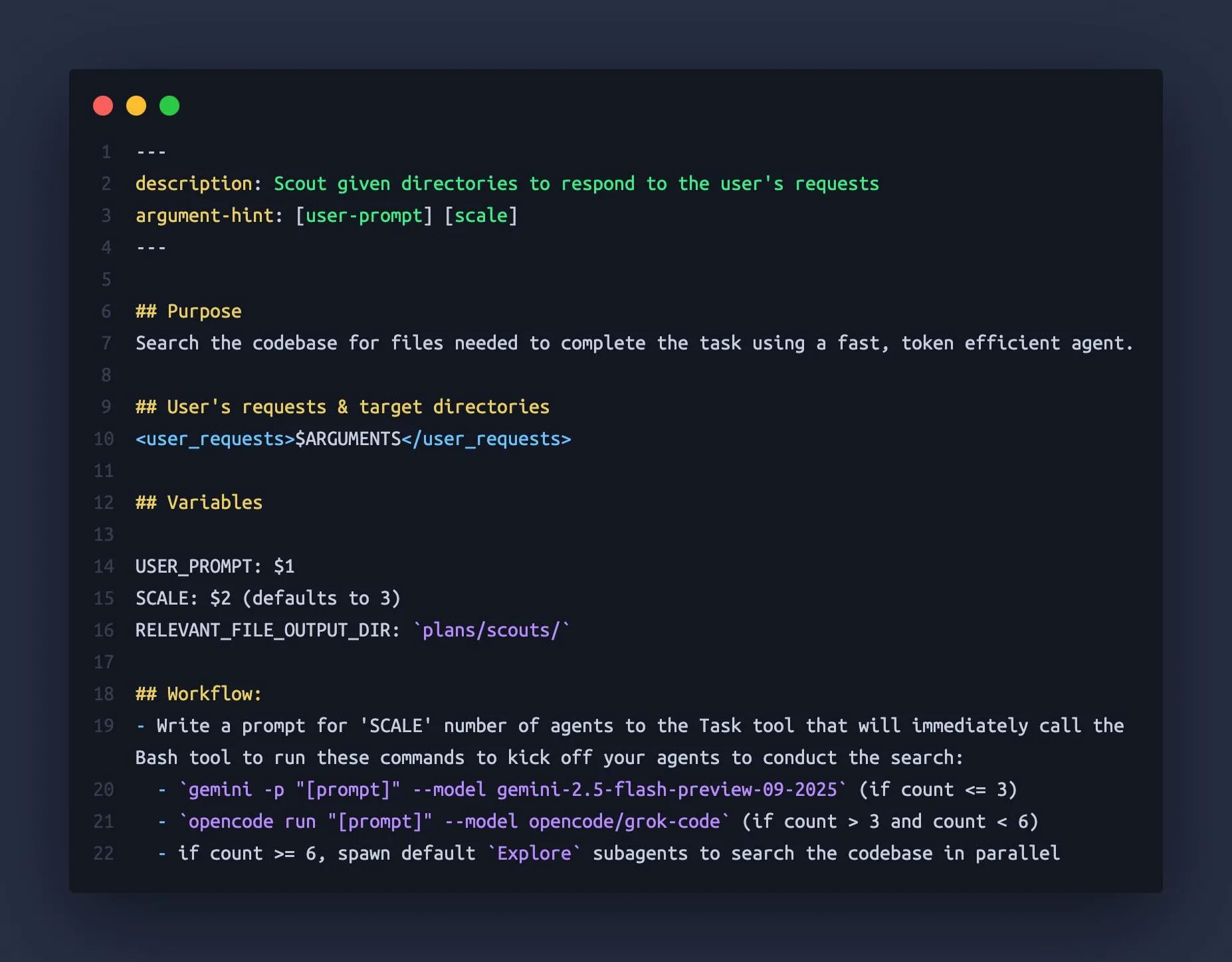

Claude Code, Gemini CLI ve OpenCode’u “alt Agent” olarak kullanabiliyor : Bir geliştirici, Claude Code’un Gemini 2.5 Flash ve Grok Code Fast gibi diğer büyük dil modellerini “alt Agent” olarak orkestra edebildiğini keşfetti. Bu alt Agent’lar, büyük bağlam pencerelerini (1M-2M token) kullanarak kod tabanlarını hızlıca keşfediyor ve Claude Code’a daha kapsamlı bağlam bilgisi sağlıyor. Bu kombinasyonel kullanım, Claude’un karmaşık görevlerde “bağlamı kaybetme” sorununu etkili bir şekilde önleyerek kodlama asistanının verimliliğini ve doğruluğunu artırıyor. (Kaynak: Reddit r/ClaudeAI)

CAD oluşturma modeli k-1b: Gemma3-1B üzerinde ince ayar yapılmış 3D model oluşturucu : Bir geliştirici, k-1b adında 1B parametreli bir CAD oluşturma modeli geliştirdi. Kullanıcılar sadece bir açıklama girerek STL formatında 3D modeller oluşturabiliyor. Bu model, AI destekli üretim ve onarım ile OpenSCAD veri kümesi üzerinde eğitildi ve Gemma3-1B üzerinde ince ayar yapıldı. Yazar ayrıca OBJ model dönüştürme ve terminal önizlemesini destekleyen bir CLI aracı da sağladı. Bu, 3D tasarım ve üretim alanında düşük maliyetli, verimli bir AI destekli araç sunuyor. (Kaynak: karminski3, Reddit r/LocalLLaMA)

neuTTS-Air: CPU’da çalışabilen 0.7B ses klonlama modeli : Neuphonic, neutts-air adında 0.7B parametreli bir ses klonlama modeli yayınladı. En büyük özelliği, CPU üzerinde çalışabilmesidir. Kullanıcılar sadece hedef sesi ve ilgili metni sağlayarak sesi klonlayabilir ve yeni metinlerin sesini oluşturabilir, yaklaşık 30 saniyede 18 saniyelik ses üretir. Bu model şu anda sadece İngilizce’yi desteklemektedir, ancak hafifliği ve CPU uyumluluğu, bireysel kullanıcılar ve küçük geliştiriciler için kullanışlı bir ses klonlama çözümü sunmaktadır. (Kaynak: karminski3)

Claude Code M&A Deal Comp Agent: PDF ayrıştırma ile Excel işlem koşulları oluşturma : Bir geliştirici, Claude Code Skills ve LlamaIndex’in semtools PDF ayrıştırma yeteneğini kullanarak bir M&A işlem analizi Agent’ı oluşturdu. Bu Agent, halka açık M&A belgelerini (örneğin DEF 14A) ayrıştırabiliyor, her bir PDF’i analiz edebiliyor ve işlem koşulları ile karşılaştırılabilir şirket verilerini içeren bir Excel tablosunu otomatik olarak oluşturabiliyor. Bu araç, özellikle karmaşık finansal belgeleri işleyen senaryolarda finansal analizin verimliliğini ve doğruluğunu önemli ölçüde artırıyor. (Kaynak: jerryjliu0)

Anthropic Skills ve Plugins: İşlevsel çakışma geliştirici kafa karışıklığına yol açıyor : Anthropic kısa süre önce AI Agent’larına özel işlevler getirmeyi amaçlayan Skills ve Plugins özelliklerini tanıttı. Ancak, bazı geliştiriciler bu ikisinin kullanım alanlarında karışıklık ve çakışma olduğunu belirterek, kullanım senaryoları ve geliştirme stratejileri konusunda kafa karışıklığı yaşadıklarını ifade ettiler. Bu durum, Anthropic’in işlev tasarımında ve yayınlama stratejisinde, geliştiricilere AI yeteneklerini daha iyi kullanmaları için rehberlik etme konusunda iyileştirme alanı olabileceğini gösteriyor. (Kaynak: Vtrivedy10, Reddit r/ClaudeAI)

📚 Öğrenme

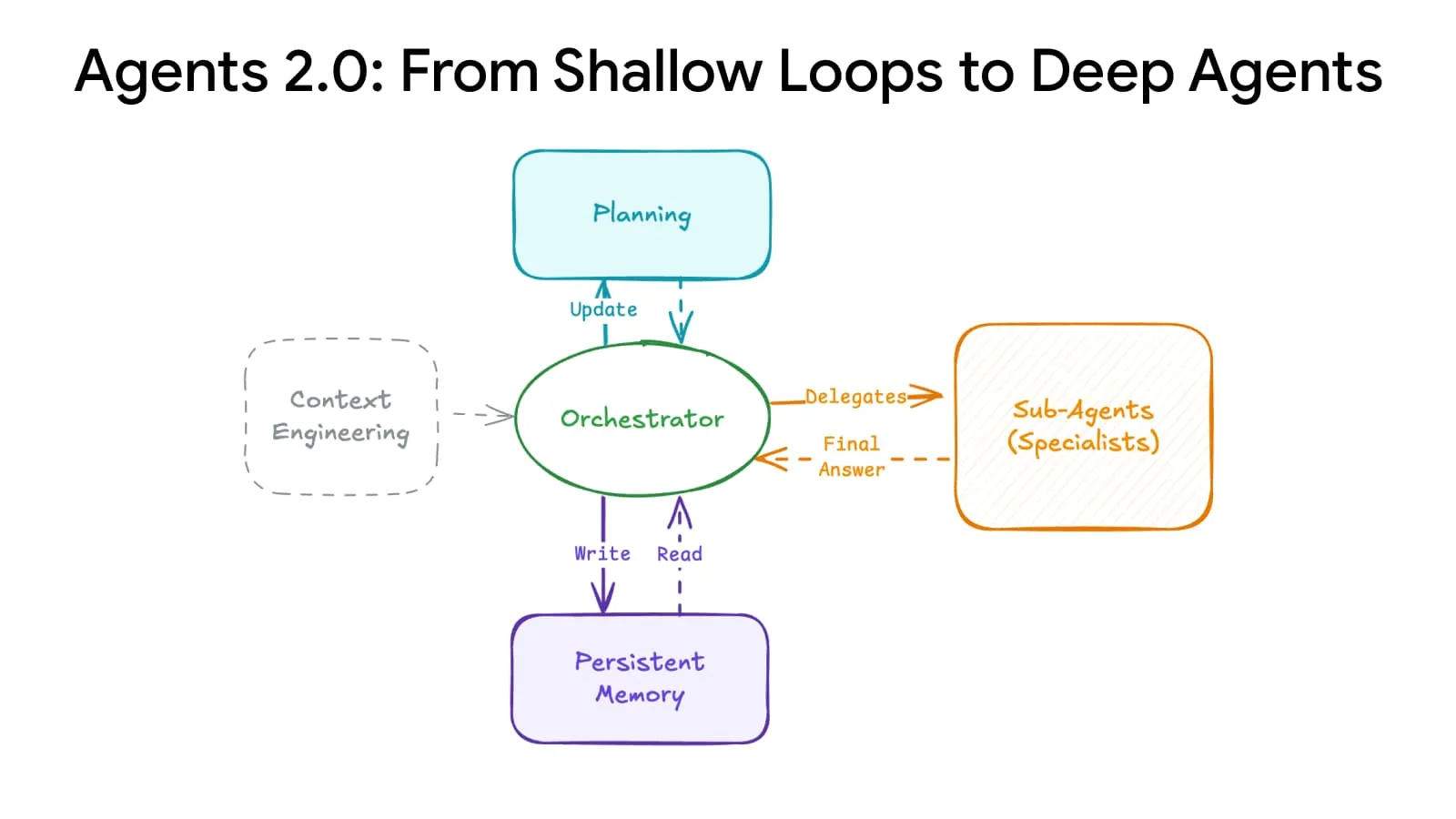

Deep Agents Evolution: Gelişmiş planlama ve hafıza sistemleri Agent ölçeğini artırıyor : Bir AI mimarisi atılımı, gelişmiş planlama ve hafıza sistemleri aracılığıyla Agent’ların 15 adımdan 500’den fazla adıma genişlemesini sağlayarak AI’ın karmaşık görevleri işleme şeklini tamamen değiştiren bir “derin Agent evrimi” gerçekleştirdi. Bu teknolojinin, AI’ın daha uzun zaman serilerinde ve daha karmaşık mantık zincirlerinde tutarlılığını korumasını sağlayarak daha güçlü genel AI Agent’ları inşa etmek için temel oluşturması bekleniyor. (Kaynak: LangChainAI)

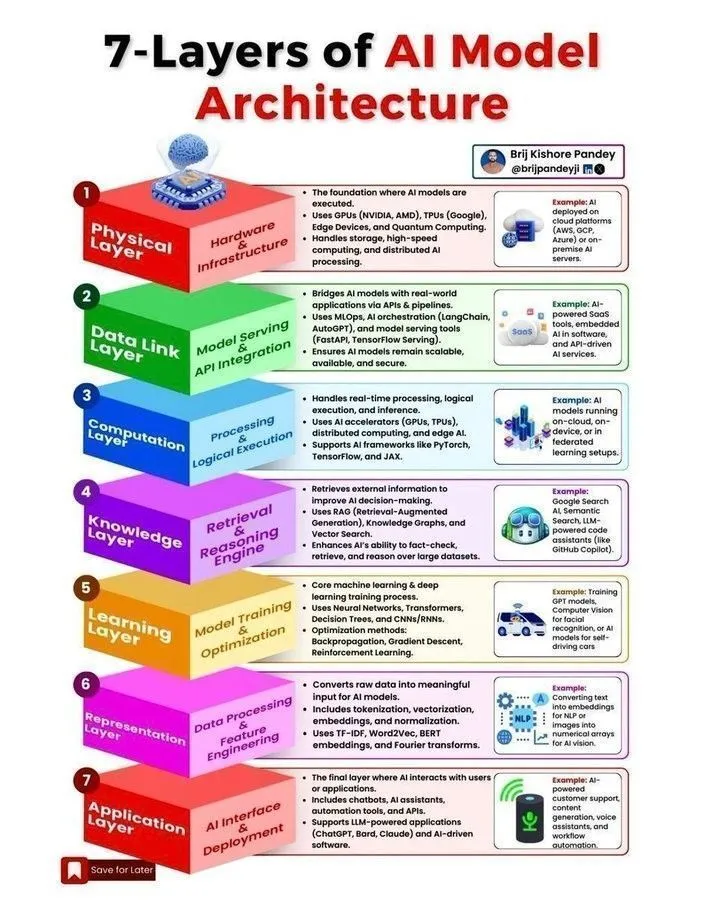

AI model mimarisi ve Agent geliştirme yol haritası : Sosyal medyada AI model mimarisi, Agent geliştirme yol haritası, makine öğrenimi yaşam döngüsü ve AI ile üretken AI, makine öğrenimi arasındaki farklara dair birçok kaynak paylaşıldı. Bu içerikler, geliştiricilerin ve araştırmacıların AI sistemlerinin temel kavramlarını anlamalarına, ölçeklenebilir AI Agent’ları oluşturmak için anahtar adımları öğrenmelerine ve 2025 yılında AI alanında gerekli olan kritik becerileri edinmelerine yardımcı olmayı amaçlıyor. (Kaynak: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Stanford CME295 dersleri: Transformer ve büyük model mühendislik uygulamaları : Stanford Üniversitesi, Transformer mimarisi ve büyük dil modellerinin (LLM) mühendislik uygulamaları bilgisine odaklanan CME295 ders serisini yayınladı. Bu ders, karmaşık matematiksel kavramlardan kaçınarak pratik uygulamaları vurguluyor ve büyük model geliştirme ve dağıtımını derinlemesine anlamak isteyen mühendisler için değerli bir öğrenme kaynağı sunuyor. Aynı zamanda, CS224N dersi NLP’ye giriş için en iyi seçenek olarak tavsiye ediliyor. (Kaynak: karminski3, QuixiAI, stanfordnlp)

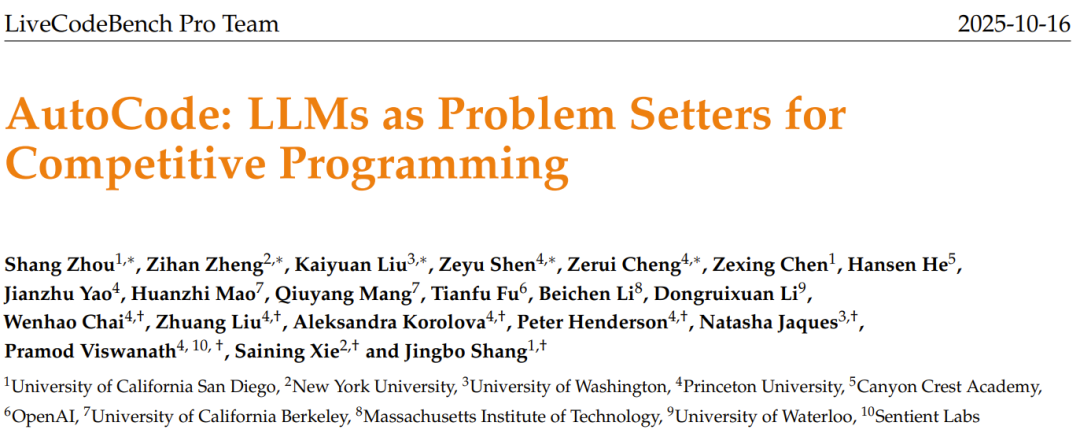

AI soru oluşturucu AutoCode: LLM orijinal programlama yarışması soruları üretiyor : LiveCodeBench Pro ekibi, LLM’i kapalı döngü, çok rollü bir sistemde yarışma programlama sorularının oluşturulmasını ve değerlendirilmesini otomatikleştirmek için AutoCode çerçevesini tanıttı. Bu çerçeve, geliştirilmiş bir doğrulayıcı-üretici-denetleyici mekanizması aracılığıyla test senaryosu üretiminde yüksek güvenilirlik sağladı ve “tohum sorular”dan ilham alarak LLM’in yüksek kaliteli, orijinal yeni sorular üretmesini sağladı. Bu, daha titiz programlama yarışması kıyaslamaları ve modelin kendini iyileştirmesi için zemin hazırlayabilir. (Kaynak: 36氪)

KAIST, AI yarı iletken beyin geliştiriyor: Transformer ve Mamba verimliliğini birleştiriyor : Kore İleri Bilim ve Teknoloji Enstitüsü (KAIST), Transformer mimarisinin zekasını ve Mamba mimarisinin verimliliğini başarıyla birleştiren yeni bir AI yarı iletken beyin geliştirdi. Bu çığır açan araştırma, mevcut AI modellerinin performans ve enerji tüketimi arasındaki denge sorununu çözmeyi amaçlıyor ve gelecekteki verimli, düşük güç tüketimli AI donanım tasarımı için yeni bir yön sunarak uç AI ve gömülü AI sistemlerinin gelişimini hızlandırmayı vaat ediyor. (Kaynak: Reddit r/deeplearning)

Çok aşamalı NER boru hattı: Reddit yorumlarını analiz etmek için bulanık eşleştirme ve LLM maskeleme teknolojisi : Bir araştırma, Reddit yorumlarından varlıkları ve duyguları çıkarmak için yüksek hızlı bulanık eşleştirme ve LLM maskeleme teknolojisini birleştiren çok aşamalı bir Adlandırılmış Varlık Tanıma (NER) boru hattı önerdi. Bu yöntem, önce bulanık arama ile bilinen varlıkları tanımlar, ardından maskelenmiş metni yeni varlıkları keşfetmek için LLM ile işler ve son olarak duygu analizi ve özetleme yapar. Bu hibrit yöntem, büyük ölçekli, gürültülü alana özgü metinleri işlerken hız ve keşif yeteneği arasında denge sağlıyor. (Kaynak: Reddit r/MachineLearning)

ML güdümlü ticaret sistemi dağıtım deneyimi: Gerçek zamanlı ortamlarda “ileri görüşlülük yanlılığı” ve “durum kayması” sorunlarını çözme : Bir geliştirici, ML güdümlü ticaret sistemlerinin dağıtım deneyimlerini paylaştı ve gerçek zamanlı ortamlarda “ileri görüşlülük yanlılığı” ve “durum kayması” sorunlarını çözmenin kritik önemini vurguladı. Modelin satır satır işlenmesi ve “altın ana kontrol betiği” aracılığıyla, geçmiş testler ile gerçek zamanlı çalışma arasında deterministik tutarlılık sağlandı. Sistem ayrıca, gerçek zamanlı tahminler ile doğrulayıcı tahminleri arasındaki tutarlılığı 1.0 Pearson korelasyon katsayısı ile ölçen bir doğrulayıcı içeriyor ve modelin güvenilirliğini garanti ediyor. (Kaynak: Reddit r/MachineLearning)

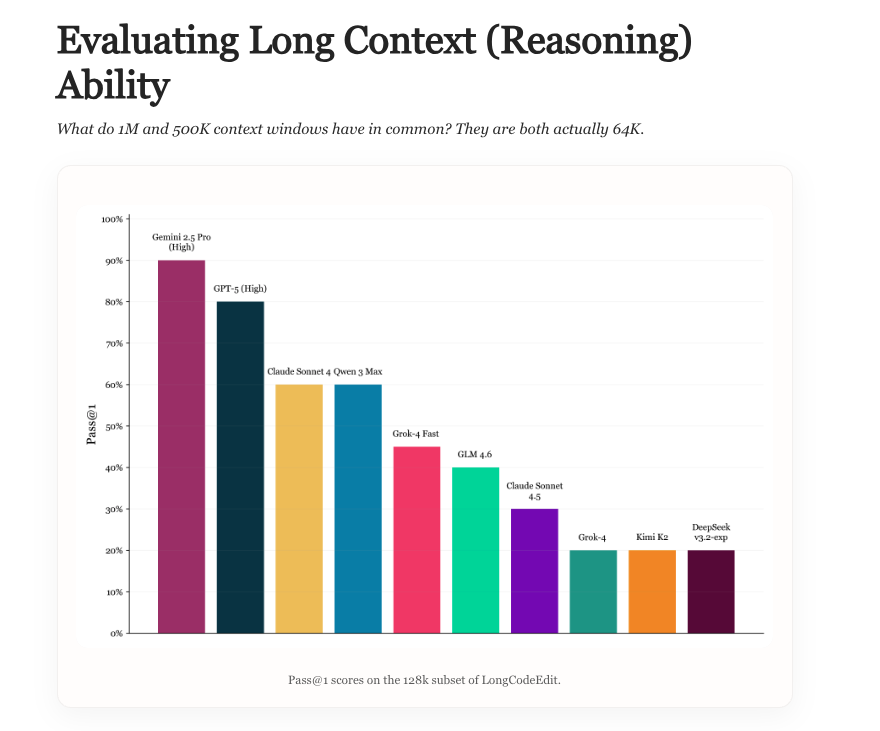

Long Context Evaluation: LLM uzun bağlam yeteneği değerlendirmesi için yeni kıyaslama : Yeni bir araştırma, LLM’lerin uzun bağlam değerlendirmesinin mevcut durumunu inceledi, mevcut kıyaslamaların avantajlarını ve dezavantajlarını analiz etti ve LongCodeEdit adında yeni bir kıyaslama tanıttı. Bu araştırma, LLM’lerin uzun metinleri ve karmaşık kod düzenleme görevlerini işleme yeteneğini ölçmedeki mevcut değerlendirme yöntemlerinin eksikliklerini gidermeyi amaçlıyor ve modellerin uzun bağlam senaryolarındaki performansını daha doğru bir şekilde değerlendirmek için yeni araçlar ve içgörüler sunuyor. (Kaynak: nrehiew_, teortaxesTex)

Manifold Optimization: Sinir ağı eğitiminin geometrik farkındalıklı optimizasyonu : Manifold optimizasyonu, sinir ağı eğitimini geometrik farkındalık yeteneğiyle donatıyor. Yeni araştırma, bu fikri modüler manifoldlara genişleterek katmanlar arası etkileşimleri anlayan optimize ediciler tasarlamaya yardımcı oluyor. İleri fonksiyonlar, manifold kısıtlamaları ve normları birleştirerek, bu çerçeve katmanlar arası geometri ve optimizasyon kurallarının birleşim şeklini tanımlıyor, böylece daha derin bir seviyede geometrik farkındalıklı optimizasyon sağlayarak sinir ağlarının eğitim verimliliğini ve etkinliğini artırıyor. (Kaynak: TheTuringPost, TheTuringPost)

AI araştırmasının Kolmogorov karmaşıklığı: AI’ın araştırma sonuçlarını basitleştirme potansiyeli : Tartışmalar, yeni araştırmaların ve blog içeriklerinin çekirdek “özünün” kod, çıktılar ve matematiksel soyutlamalar olarak sıkıştırılabileceğini belirtiyor. Gelecekteki AI sistemlerinin, karmaşık araştırmaları basit çıktılara “çevirerek”, temel farklılıkları çıkararak ve anahtar sonuçları yeniden üreterek yeni araştırmaların anlama maliyetini önemli ölçüde sıkıştırması bekleniyor. Bu, araştırmacıların ArXiv’deki devasa makale sayısına daha kolay ayak uydurmasını sağlayarak araştırma sonuçlarının hızlı sindirimini ve uygulamasını mümkün kılabilir. (Kaynak: jxmnop, aaron_defazio)

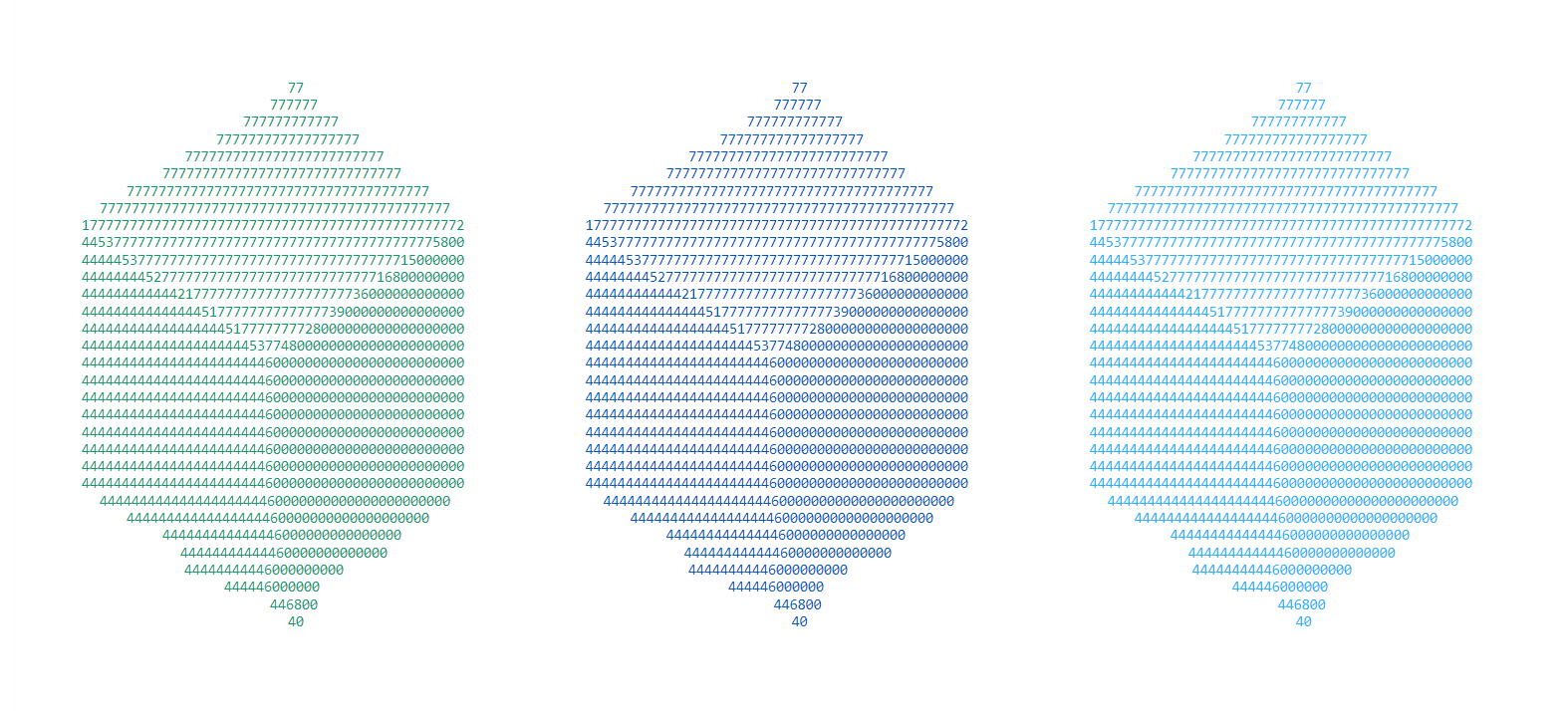

LSTM’in babasından rezidüel öğrenmenin kökenleri üzerine tartışma: Hochreiter’ın 1991 katkısı : LSTM’in babası Jürgen Schmidhuber, rezidüel öğrenmenin temel fikrinin 1991 yılında öğrencisi Sepp Hochreiter tarafından RNN’lerin gradyan kaybolma sorununu çözmek için ortaya atıldığını bir kez daha belirtti. Hochreiter, doktora tezinde tekrarlayan rezidüel bağlantıları tanıttı ve ağırlıkları 1.0 olarak sabitledi. Bu, daha sonra LSTM, Highway network ve ResNet gibi derin öğrenme mimarilerindeki rezidüel fikrin temelini attığı kabul ediliyor. Schmidhuber, erken katkıların derin öğrenmenin gelişimi için önemini vurguladı. (Kaynak: 量子位)

💼 İş Dünyası

Zhiweituo Medicine, on milyonlarca yuan değerinde tohum yatırım aldı: AI destekli oral küçük moleküllü yeni ilaç geliştirme : Pekin Zhiweituo Medicine Technology Co., Ltd., Newerly Capital liderliğinde ve Qingtian Investment’ın katılımıyla on milyonlarca yuan değerinde tohum yatırım turunu tamamladı. Fonlar, çekirdek boru hattı preklinik araştırma ve geliştirme ile AI etkileşimli moleküler tasarım platformu inşasını ilerletmek için kullanılacak. Şirket, AI ilaç geliştirme alanına odaklanarak, kendi geliştirdiği EnCore platformunu kullanarak öncü bileşik keşfini ve moleküler optimizasyonunu hızlandırıyor. Otoimmün hastalıklar için oral küçük moleküllü ilaçlara odaklanarak “‘ilaç geliştirilmesi zor’ hedefleri” aşmayı hedefliyor. (Kaynak: 36氪)

Damao Technology, yaklaşık yüz milyon yuan değerinde A+ serisi yatırım turunu tamamladı: Hesaplama-elektrik işbirliği teknolojisiyle akıllı hesaplama merkezlerinin yüksek enerji tüketimi sorununu çözüyor : Damao Technology, CATL’ye bağlı Puquan Capital liderliğinde yaklaşık yüz milyon yuan değerinde A+ serisi yatırım turunu tamamladı. Bu turdaki fonlar, enerji büyük modelleri, hesaplama-elektrik işbirliği platformları ve Agent’lar gibi çekirdek teknolojilerin araştırma ve geliştirilmesi ile tanıtımı için kullanılacak. Şirket, “hesaplama-elektrik işbirliği” aracılığıyla akıllı hesaplama merkezlerinin yüksek enerji tüketimi sorununu çözmeyi ve yeni nesil elektrik sistemlerinin inşasına katkıda bulunmayı amaçlıyor. Damao Technology, tam yığın kendi geliştirdiği enerji büyük modellerine dayanarak SenseTime ve Cambricon gibi önde gelen şirketlerle işbirliği yaparak yüksek enerji tüketimli hesaplama altyapıları için enerji optimizasyon çözümleri sunuyor. (Kaynak: 36氪)

JD, Tmall, Douyin “AI” ile Double 11’e katıldı: Teknoloji e-ticaret promosyon büyümesini güçlendiriyor : Bu yılki Double 11, AI e-ticaretinin eğitim alanı haline geldi. JD, Tmall, Douyin gibi önde gelen platformlar AI teknolojisine tam gaz yatırım yaptı. AI, tüketici deneyimini optimize etme, satıcıları güçlendirme, lojistik dağıtım, içerik dağıtımı ve tüketici kararları gibi tüm zincir boyunca kullanılıyor. Örneğin, JD “fotoğrafla alışveriş” özelliğini yükseltti, Douyin Doubao’yu alışveriş merkezine entegre etti, Worthbuy Technology ise AI sohbetiyle anında fiyat karşılaştırması sağlıyor. AI, üst düzey verimlilik ve maliyet kontrolü aracılığıyla e-ticaretin büyümesinin yeni motoru haline geliyor, sektörün rekabet ortamını yeniden şekillendiriyor ve e-ticareti “raf/içerik e-ticaretinden” “akıllı e-ticaret” aşamasına taşıyor. (Kaynak: 36氪, 36氪)

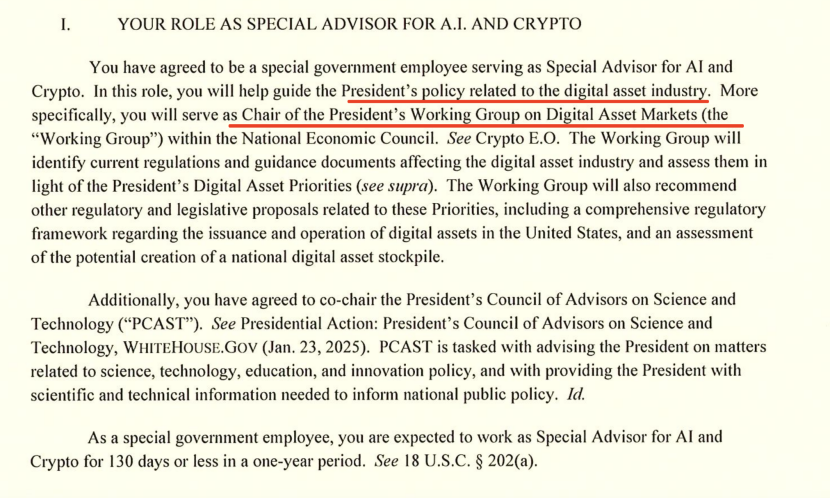

Beyaz Saray AI sorumlusu ABD-Çin AI rekabetini değerlendiriyor: Çip ihracatı ve ekosistem hakimiyeti : Beyaz Saray AI ve Crypto “Çarı” David Sacks, bir röportajda ABD’nin ABD-Çin AI rekabetindeki stratejisini açıkladı ve inovasyon, altyapı ve ihracatın önemini vurguladı. Çin’e yönelik çip ihracatı politikasının “incelikli” olması gerektiğini, en gelişmiş çipleri kısıtlarken Huawei’nin iç pazarda tekel oluşturmasına yol açacak tamamen mahrum bırakmaktan kaçınılması gerektiğini belirtti. Sacks, ABD’nin büyük bir AI ekosistemi inşa etmesi ve bürokratik kontrolle rekabet gücünü boğmak yerine küresel çapta tercih edilen teknoloji ortağı olması gerektiğini vurguladı. (Kaynak: 36氪)

🌟 Topluluk

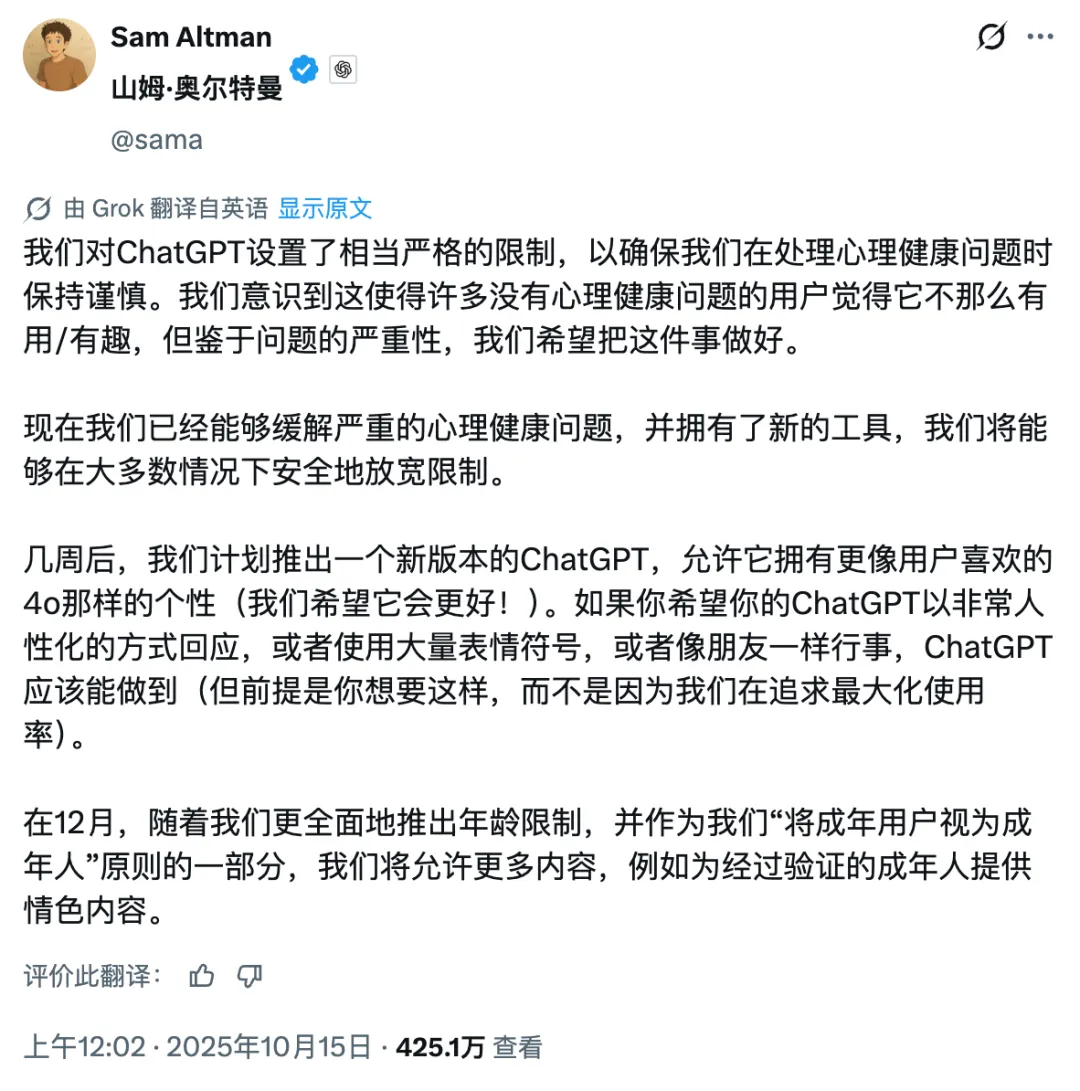

OpenAI ticarileşme tartışması: Kar amacı gütmeyen yapıdan kar odaklılığa, Sam Altman’ın itibarı zedelendi : OpenAI CEO’su Sam Altman, ChatGPT’nin erotik içeriğe açılması, GPT-5 modelinin performansı ve agresif altyapı genişletme stratejileri nedeniyle geniş çaplı tartışmalara yol açtı. Topluluk, şirketin kar amacı gütmeyen başlangıçtaki misyonundan ticari kar peşinde koşmaya yöneldiğini sorguladı ve AI teknolojisinin gelişim yönü, yatırım balonu ve çalışanların etik muamelesi hakkında endişelerini dile getirdi. Altman’ın yanıtları kamuoyunu tamamen yatıştıramadı ve AI imparatorluğunun genişlemesi ile sosyal sorumluluk arasındaki gerilimi vurguladı. (Kaynak: 36氪, janusch_patas, Reddit r/ArtificialInteligence)

Büyük model zehirlenmesi: Veri zehirlenmesi, düşmanca örnekler ve AI güvenlik zorlukları : Büyük modeller, veri zehirlenmesi, arka kapı saldırıları ve düşmanca örnekler gibi güvenlik tehditleriyle karşı karşıya kalıyor. Bu durum, model çıktılarında anormalliklere, zararlı içeriklere ve hatta ticari reklamlar (GEO), teknoloji gösterişi veya siber suçlar için kullanılmasına yol açabiliyor. Araştırmalar, az miktarda kötü niyetli verinin bile model üzerinde önemli bir etki yaratabileceğini gösteriyor. Bu durum, AI halüsinasyonları, kullanıcı karar manipülasyonu ve kamu güvenliği riskleri hakkında endişeleri artırıyor ve model bağışıklık sistemi, güçlendirilmiş veri denetimi ve sürekli savunma mekanizmalarının önemini vurguluyor. (Kaynak: 36氪)

AI çağında veri etiketleyicilerin çıkmazı: Yüksek lisans ve doktora derecelileri düşük ücretli tekrarlayan işlerde çalışıyor : AI büyük modellerinin gelişimiyle birlikte, veri etiketleme işleri için eğitim gereksinimleri arttı (hatta yüksek lisans ve doktora dereceleri bile isteniyor), ancak maaşları AI mühendislerinden çok daha düşük. Bu “AI öğretmenleri”, AI tarafından üretilen içeriği değerlendirme, etik inceleme yapma ve uzman bilgi koçluğu gibi işleri düşük saatlik ücretlerle yapıyor ve iş güvencesizliği, proje bittiğinde işsiz kalma gibi sorunlarla karşılaşıyor. Bu “siber montaj hattı” tarzı katmanlı taşeronluk ve sömürü modeli, AI endüstrisindeki iş etiği ve adalet hakkında derinlemesine düşüncelere yol açıyor. (Kaynak: 36氪)

AI’ın yaratıcılık ve insan değerleri üzerindeki etkisi: Son mu, yoksa yüceliş mi? : Topluluk, AI’ın insan yaratıcılığı üzerindeki etkisini tartıştı ve AI’ın yaratıcılığı öldürmediğini, aksine insan yaratıcılığının göreceli sıradanlığını ortaya koyduğunu belirtti. AI, desen yeniden düzenleme ve üretimde başarılı olsa da, gerçek özgünlük, çelişki ve öngörülemezlik hala insanlığın benzersiz avantajlarıdır. Yeni araçların ortaya çıkışı her zaman orta alanı ortadan kaldırır ve insanları içerik ve yaratıcılıkta daha yüksek seviyede atılımlar yapmaya zorlar, böylece gerçek yaratıcılığın daha değerli hale gelmesini sağlar. (Kaynak: Reddit r/artificial)

AI’ın neden olduğu varoluşsal kaygı ve başa çıkma stratejileri: Gerçek sorunlar ve aşırı endişe : AI’ın potansiyel varoluşsal tehditleri karşısında, topluluk bu durumdan kaynaklanan “varoluşsal korku” ile nasıl başa çıkılacağını tartıştı. Bazı görüşler, bu korkunun geleceğe dair aşırı fantezilerden kaynaklanabileceğini ve insanların gerçekliğe dönerek şimdiki hayata odaklanmasını önerdi. Aynı zamanda, AI ile ilgili ekonomik şoklar ve istihdam sorunlarının daha acil gerçek tehditler olduğunu belirtenler de oldu ve AI güvenliğinin sosyal ve ekonomik etkilerle birlikte ele alınması gerektiğini vurguladılar. (Kaynak: Reddit r/ArtificialInteligence)

Karpathy’nin görüşleri hararetli tartışmalara yol açtı: AGI on yıl tezi, Agent’ların “hayalet” tezi ve AI geliştirme yolu : Andrej Karpathy’nin AGI’ın “on yıl tezi” ve mevcut AI Agent’larının “hayalet” olduğu yönündeki görüşleri toplulukta geniş çaplı tartışmalara yol açtı. AI’ın gerçek bir Agent olabilmesi için kalıcılık, hafıza ve süreklilik özelliklerine sahip olması gerektiğini vurguladı ve AI eğitiminin “veri doldurmaktan” “hedef öğretmeye” doğru kayması gerektiğini önerdi. Bu görüşler, mevcut AI spekülasyonlarına karşı sakin bir yansıma olarak görüldü ve insanları AI’ın uzun vadeli geliştirme yolu ve değerlendirme standartları hakkında yeniden düşünmeye sevk etti. (Kaynak: TheTuringPost, TheTuringPost, NandoDF, random_walker, lateinteraction, stanfordnlp)

ChatGPT pazar payı sürekli düşüyor: Perplexity, Gemini, DeepSeek gibi rakipler yükseliyor : Similarweb verileri, ChatGPT’nin pazar payının bir yıl önceki %87.1’den %74.1’e düşerek sürekli azaldığını gösteriyor. Aynı zamanda, Gemini, Perplexity, DeepSeek, Grok ve Claude gibi rakiplerin pazar payları istikrarlı bir şekilde artıyor. Bu eğilim, AI asistanı pazarındaki rekabetin giderek kızıştığını, kullanıcı tercihlerinin çeşitlendiğini ve ChatGPT’nin hakimiyetinin sorgulandığını gösteriyor. (Kaynak: ClementDelangue, brickroad7)

GPT-5 matematiksel gaf olayı: OpenAI aşırı pazarlama ve meslektaş eleştirisi : OpenAI araştırmacıları, GPT-5’in birçok Erdos matematik problemini çözdüğünü yüksek sesle iddia etti, ancak daha sonra bunun bağımsız olarak çözmek yerine internet aramasıyla mevcut cevapları bulduğu ortaya çıktı. Bu olay, DeepMind CEO’su Hassabis ve Meta’dan LeCun gibi sektörün önde gelen isimlerinin açıkça alay etmesine neden oldu ve OpenAI’ın aşırı pazarlamasını sorgulayarak AI yeteneklerinin tanıtımındaki titizlik sorunlarını ve meslektaşlar arası rekabet durumunu vurguladı. (Kaynak: 量子位)

AI’ın gizli çevresel maliyetleri: Enerji tüketimi ve su kaynakları ihtiyacı : Tarihsel araştırmalar, telgraftan AI’a kadar iletişim sistemlerinin her zaman gizli çevresel maliyetlerle birlikte geldiğini gösteriyor. AI ve modern iletişim sistemleri, büyük ölçekli veri merkezlerine bağımlı olup, enerji tüketimi ve su kaynakları ihtiyacının hızla artmasına neden oluyor. 2027 yılına kadar AI’ın su tüketiminin Danimarka’nın yıllık su tüketimine eşit olması bekleniyor. Bu durum, AI teknolojisinin hızlı gelişiminin arkasındaki çevresel bedeli vurguluyor ve hükümetleri denetimi güçlendirmeye, çevresel etkilerin zorunlu olarak açıklanmasını sağlamaya ve düşük etkili projeleri desteklemeye çağırıyor. (Kaynak: aihub.org)

AI’ın insan zihnine “saldırısı”: Beyin-bilgisayar arayüzleri ve “İnsan 3.0”ın etik sınırları : Topluluk, beyin-bilgisayar arayüzlerinin (BCI) ve AI’ın insan zihni üzerindeki potansiyel etkilerini derinlemesine tartıştı ve “İnsan 3.0” kavramını ortaya attı. Harici hesaplama gücü, insan karar verme sürecinin “iç döngüsüne” girdiğinde ve beyin sinyal kaynağını ayırt edemeyeceği kadar hızlı olduğunda, “benlik” sınırları, değer yargıları ve uzun vadeli sağlık gibi etik sorunlar ortaya çıkacaktır. Makale, teknolojinin yaygınlaşmasından önce sıfır güven mimarisi, donanım izolasyonu ve yetki yönetiminin oluşturulması gerektiğini vurgulayarak, karar verme yetkisini kiralamaktan ve tür düzeyindeki eşitsizlikleri artırmaktan kaçınılması gerektiğini belirtiyor. (Kaynak: dotey)

💡 Diğer

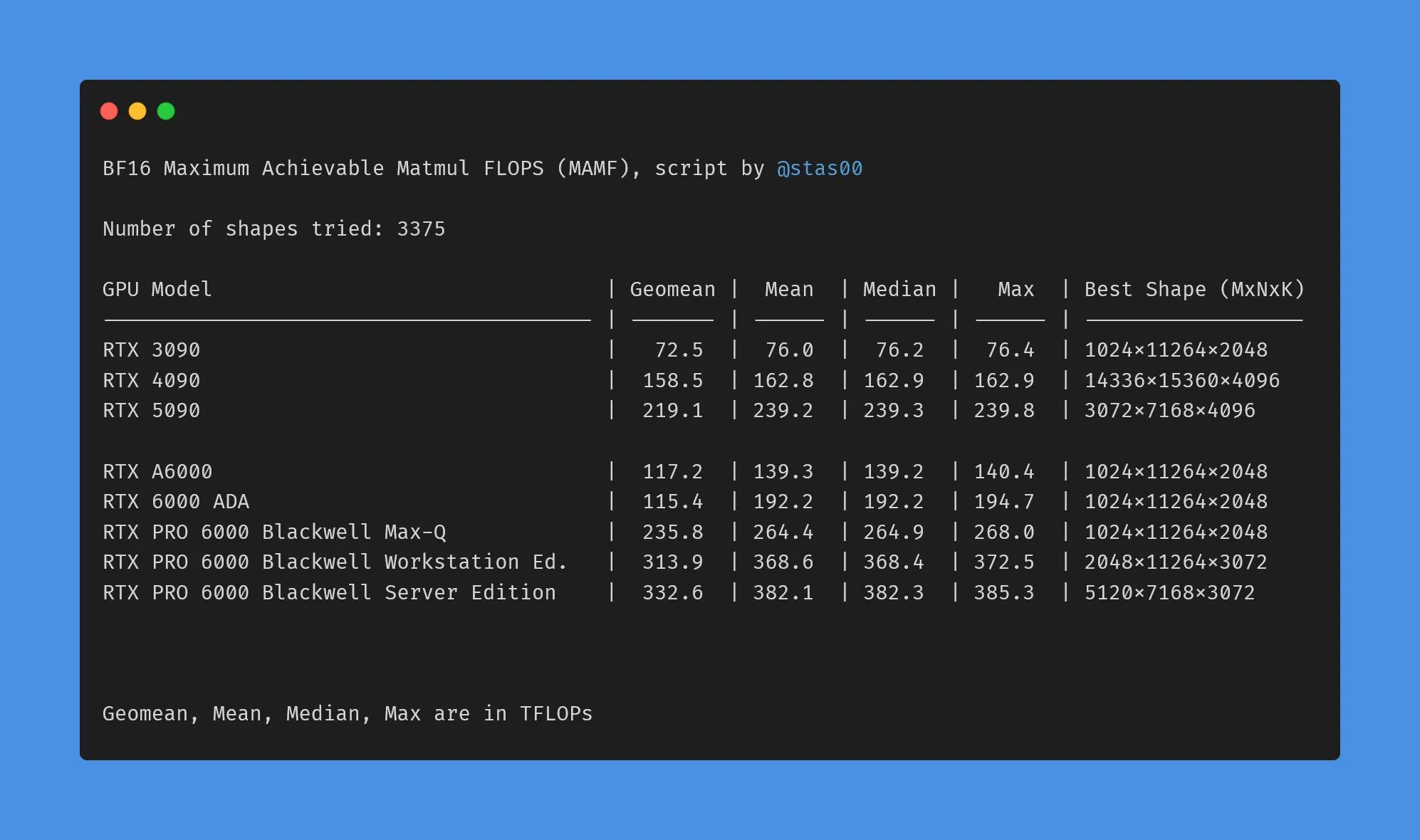

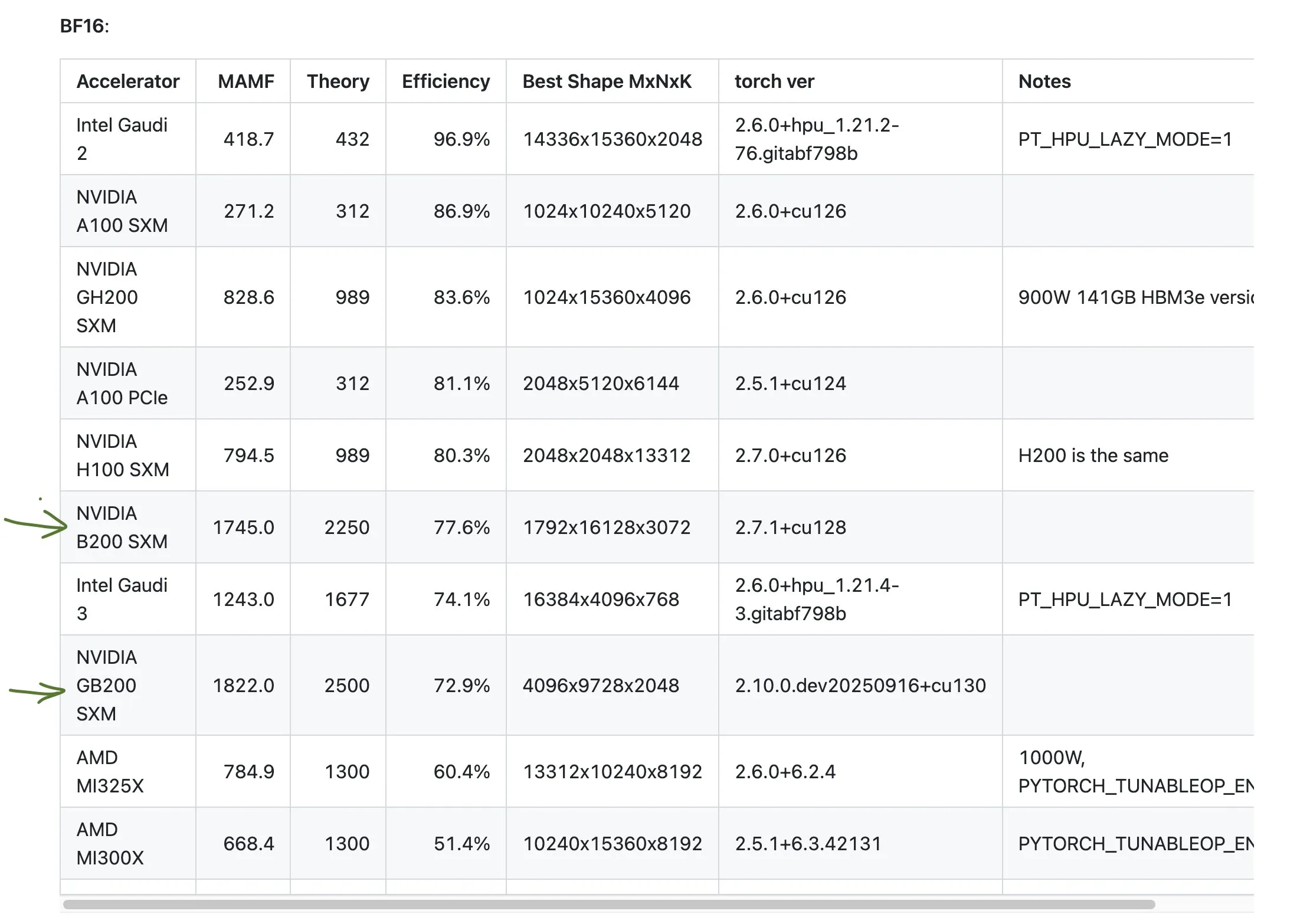

NVIDIA tüketici ve profesyonel sınıf GPU performans verileri arasındaki farklar : Topluluk, NVIDIA tüketici ve profesyonel sınıf GPU’ların pazarlama TFLOPs’ları ile gerçek performansları arasındaki farkları tartıştı. Veriler, tüketici sınıfı ekran kartlarının (örneğin 3090, 4090, 5090) gerçek performansının nominal TFLOPs’larından biraz daha yüksek veya ona yakın olduğunu, ancak profesyonel sınıf iş istasyonu ekran kartlarının (örneğin A6000, 6000 ADA) gerçek performansının nominal değerin çok altında olduğunu gösterdi. Buna rağmen, profesyonel kartlar güç tüketimi, boyut ve enerji verimliliği açısından hala avantajlara sahip, ancak kullanıcıların pazarlama verileri ile gerçek performans arasındaki farka dikkat etmeleri gerekiyor. (Kaynak: TheZachMueller)

AMD GPU düşük performans tartışması : Topluluk, AMD GPU’ların bazı kıyaslama testlerindeki performansını tartıştı ve verimliliğinin beklentilerin sadece yarısı kadar olabileceğini belirtti. Bu durum, özellikle NVIDIA’nın GB200 gibi yüksek performanslı ürünleriyle karşılaştırıldığında, AMD’nin AI hesaplama alanındaki rekabet gücü hakkında endişelere yol açtı. Kullanıcıların AI hesaplama kaynaklarını planlarken farklı üreticilerin GPU’larının gerçek performansını ve verimliliğini dikkatlice değerlendirmesi gerekiyor. (Kaynak: jeremyphoward)

GIGABYTE AI TOP ATOM: Masaüstü sınıfı Grace Blackwell GB10 performansı : GIGABYTE, NVIDIA Grace Blackwell GB10’un performansını masaüstü sınıfı iş istasyonlarına getiren AI TOP ATOM’u tanıttı. Bu ürün, bireysel kullanıcılara ve küçük ekiplere güçlü AI hesaplama yeteneği sağlamayı, yerel olarak yüksek performanslı model eğitimi ve çıkarımı yapmalarına olanak tanıyarak bulut kaynaklarına bağımlılığı azaltmayı ve AI uygulamalarının geliştirilmesi ve dağıtımını hızlandırmayı amaçlıyor. (Kaynak: Reddit r/LocalLLaMA)