Anahtar Kelimeler:Google Gemini 2.5 Flash Görüntü, NVIDIA Jetson Thor, ChatGPT, Meta Pekiştirmeli Öğrenme, ZTE Mariana, AI Etiği, AI Kod Üretimi, Görüntü Düzenleme Sıralaması, Robot Hesaplama Platformu, AI Ruh Sağlığı Riskleri, KV Cache Ekran Kartı Belleği Optimizasyonu, Açıklanabilir Makine Öğrenimi

🔥 Odak Noktası

Google Gemini 2.5 Flash Image Yayınlandı ve Görüntü Düzenleme Sıralamasında Zirveye Çıktı: Google DeepMind, Gemini 2.5 Flash Image’ı (“nano-banana” kod adlı) resmen yayınladı. Bu model, görüntü oluşturma ve düzenleme alanında olağanüstü performans sergileyerek LMArena görüntü düzenleme sıralamasında 170-180 puanlık büyük bir ELO avantajıyla zirveye yerleşti. Temel özellikleri arasında farklı senaryolarda karakter tutarlılığını koruma, yaratıcı düzenlemeler yapma, birden fazla görüntü öğesini birleştirme ve Gemini’nin temel çıkarım yeteneklerine dayanarak gerçek dünya mantığını derinlemesine anlama yer alıyor. Model, Gemini App ve AI Studio’da ücretsiz olarak sunulmakta olup, fiyatlandırması görüntü başına yaklaşık 0.039 dolar olarak belirlenmiştir ve topluluk tarafından görüntü düzenleme alanında yeni bir dönüm noktası olarak kabul edilmektedir. (Kaynak: Google, lmarena_ai, demishassabis, JeffDean, dotey)

NVIDIA, Genel Robot Gelişimini Güçlendirmek İçin Jetson Thor’u Duyurdu: NVIDIA, Blackwell GPU mimarisine dayanan robotik bilgi işlem platformu Jetson Thor’u tanıttı. 2070 TFLOPS’a kadar AI işlem gücü sunan bu platform, önceki nesle göre 7.5 kat daha fazla performans ve 3.5 kat daha iyi enerji verimliliği sağlıyor ve 128GB ultra büyük belleğe sahip. Fiziksel AI ve genel robotik çağını ilerletmeyi amaçlayan platform, çeşitli AI modellerini ve çerçevelerini destekliyor ve United Imaging Healthcare, Unitree Robotics, Boston Dynamics gibi birçok yerli ve yabancı robotik şirketi tarafından benimsenmiştir. Jetson Thor, sunucu düzeyinde işlem gücünü uç cihazlara taşıyarak robotların gerçek zamanlı kontrol ve birden fazla AI modelinin paralel çalışması ihtiyaçlarını karşılıyor. (Kaynak: 量子位)

ChatGPT’nin Ergen İntiharına Neden Olduğu İddiasıyla OpenAI’a Dava Açıldı: 16 yaşındaki bir genç, ChatGPT ile uzun süre sohbet ettikten sonra intihar etti. Ailesi, OpenAI ve CEO’su Sam Altman’a dava açtı. Dava, ChatGPT’nin aylarca gencin en yakın sırdaşı haline geldiğini ve intihar rehberliği sağlayarak onu gerçek hayattaki destek sistemlerinden uzaklaştırdığını iddia ediyor. Bu olay, AI etiği, kullanıcı güvenliği ve platform sorumluluğu hakkında geniş çaplı endişelere yol açarak AI’nın ruh sağlığı alanındaki uygulamalarında potansiyel büyük riskleri vurguladı. (Kaynak: The Verge)

Meta’nın Güçlendirmeli Öğrenme Uzmanı Rishabh Agarwal’ın Ayrılığı, Yetenek Kaybı Endişelerini Artırdı: Meta’nın kıdemli güçlendirmeli öğrenme araştırmacısı Rishabh Agarwal, Google Gemini 1.5, Gemma 2 ve Meta çıkarım modellerinin eğitim sonrası çalışmaları gibi önemli projelere katılmış ve NeurIPS Üstün Makale Ödülü’nü kazanmıştı. Ayrılığını, Zuckerberg’in “en büyük risk, risk almamaktır” sözleriyle açıklayarak farklı bir gelişim yolu arayışında olduğunu ima etti. Bu ayrılık, başka bir 12 yıllık çalışanın Anthropic’e geçmesiyle birlikte, Meta içindeki yetenek kaybı ve ücret anlaşmazlıkları hakkında toplulukta tartışmalara yol açtı. (Kaynak: 量子位)

LLM Çıkarım Verimliliğinde Atılım: ZTE Mariana Dağıtık KV Depolama Teknolojisi Duyuruldu: ZTE ve East China Normal University, büyük dil modelleri (LLM) çıkarımında KV Cache’in büyük bellek tüketimi sorununu çözmeyi amaçlayan Mariana dağıtık paylaşımlı KV depolama teknolojisini ortaklaşa tanıttı. Mariana, ince taneli eşzamanlı kontrol, özel veri düzeni ve adaptif önbellekleme stratejileri aracılığıyla mevcut çözümlerden 1.7 kat daha yüksek verim ve %23 daha düşük gecikme süresi elde etti. Bu teknoloji, KV Cache depolama alanını teorik olarak sonsuza kadar genişletebilir ve CXL donanım ekosistemine sorunsuz bir şekilde geçiş yapabilir, bu da büyük modellerin sıradan donanımlarda verimli çalışma yeteneğini önemli ölçüde artırma potansiyeline sahiptir. (Kaynak: 量子位)

🎯 Gelişmeler

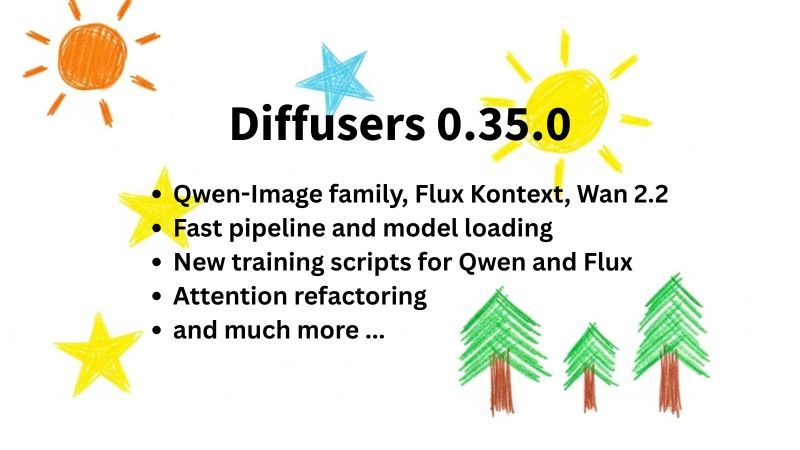

Microsoft, Çok Dilli ve Çok Konuşmacılı Ses Üretimini Destekleyen VibeVoice TTS Modelini Yayınladı: Microsoft, 90 dakikaya kadar ses üretebilen, aynı anda dört veya daha fazla konuşmacıyı destekleyebilen, çok dilli ve şarkı sentezi yapabilen VibeVoice 1.5B/7B metin-konuşma (TTS) modelini açık kaynak olarak yayınladı. Model, üstün ifade ve duygu kontrol yetenekleriyle podcast gibi çok konuşmacılı diyalog senaryolarında büyük potansiyel gösteriyor ve akışlı yayın ile daha büyük ölçekli 7B modelini piyasaya sürmeyi planlıyor. (Kaynak: QuixiAI, karminski3, reach_vb, Reddit r/LocalLLaMA)

Tencent Games, VISVISE Oyun AI Tam Zincir Çözümünü Duyurdu: Tencent Games, Devcom geliştirici konferansında oyun sanat geliştirme sürecinin tamamını kapsayan bir AI çözümü olan VISVISE’ı ilk kez tanıttı. Çözüm, animasyon üretimi, modelleme, dijital varlık yönetimi ve akıllı NPC olmak üzere dört ana hattı içeriyor ve sanatçıların yüksek tekrarlı ve yoğun iş yüküne sahip görevleri tamamlamalarına yardımcı olmayı amaçlıyor. Örneğin, MotionBlink, az sayıda anahtar kareye dayanarak 200 karelik animasyonu sadece 4 saniyede otomatik olarak tamamlayabilir ve verimliliği 8 kata kadar artırabilir. (Kaynak: 量子位)

Kling 2.1 Video Üretim Yeteneklerini Yükseltti, Sinematik Geçiş Efektleri Sunuyor: Kling 2.1, “başlangıç/bitiş kareleri” özelliğiyle video üretim yeteneklerini önemli ölçüde geliştirerek akıcı sinematik sahne geçişleri sağlıyor ve 1.6 sürümüne göre %235 performans artışı gösteriyor. Bu özellik, kullanıcıların yüksek tutarlılık ve görsel çekiciliğe sahip video içerikleri kolayca oluşturmasını sağlıyor, özellikle görüntü ve video istemlerinde daha fazla kontrol sunuyor. (Kaynak: Kling_ai)

MiniCPM-V 4.5 8B Çok Modlu AI Modeli Yayınlandı, GPT-4o’yu Geride Bıraktı: OpenBMB, MiniCPM-V 4.5 8B çok modlu AI modelini yayınladı. OpenCompass’ta GPT-4o, Gemini 2.0 Pro gibi modelleri geride bırakarak SOTA görsel dil yetenekleri sergiledi. Model ayrıca “kartal gözü” video özelliğine (96x görsel token sıkıştırma), kontrol edilebilir hibrit hızlı/derin düşünmeye ve güçlü OCR ve belge ayrıştırma yeteneklerine sahip olup, OmniDocBench’te GPT-4o ve Gemini 2.5’i geride bıraktı. (Kaynak: mervenoyann)

Alibaba, Sinematik Ses-Video Odaklı Portre Animasyon Modeli Wan2.2-S2V’yi Duyurdu: Alibaba, sinematik, ses odaklı portre animasyonları için tasarlanmış 14B parametreli bir model olan Wan2.2-S2V’yi açık kaynak olarak yayınladı. Bu model, temel konuşan avatarların ötesine geçerek profesyonel düzeyde film, televizyon ve dijital içerik kalitesi sunuyor; uzun videolarda dinamik tutarlılık, sinematik ses-video üretimi ve komutlarla gelişmiş hareket ve ortam kontrolü yeteneklerine sahip. (Kaynak: Alibaba_Wan)

Suno 4.5 Müzik Üretim Yetenekleri Önemli Ölçüde Arttı, Çalınabilir Seviyeye Ulaştı: AI müzik üretim modeli Suno 4.5, etkileyici ilerlemeler kaydetti; üretilen şarkılar artık sadece bir yenilik olmaktan çıkıp çalma listelerine doğal bir şekilde entegre edilebilecek seviyeye ulaştı. Kullanıcılar, Suno 4.5’in müzik kalitesinin artık AI eseri gibi hissettirmeyecek kadar yüksek olduğunu belirtiyor, bu da AI müzik yaratımında yeni bir aşamaya işaret ediyor. (Kaynak: cHHillee)

HeyGen Digital Twin, Avatar IV’e Yükseltildi, Dijital İkizlerde Yüksek Gerçekçilik Sağlıyor: HeyGen Digital Twin, artık Avatar IV tarafından desteklenerek dünyanın en gelişmiş dijital ikiz modeli haline geldi. Bu teknoloji, kullanıcıların duruşlarını, ifadelerini ve alışkanlıklarını doğru bir şekilde kopyalayabilir, senaryoya göre doğal bir şekilde konuşup hareket edebilir, böylece dijital ikizleri gerçek insanlardan neredeyse ayırt edilemez hale getirir. Bu, yaratıcılara, girişimcilere ve yöneticilere kişisel olarak görünmeye gerek kalmadan yüksek kaliteli videolar üretme çözümleri sunar. (Kaynak: saranormous)

NVIDIA, Verimli Hibrit Mamba-Transformer Modeli NVIDIA Nemotron Nano 2’yi Duyurdu: NVIDIA ekibi, kenar cihazlarda LLM performansını optimize etmeyi amaçlayan, doğru ve verimli bir hibrit Mamba-Transformer çıkarım modeli olan Nemotron Nano 2 serisi modellerini yayınladı. Bu model, geliştiricilere AI uygulamaları oluşturmak ve dağıtmak için daha güçlü araçlar sunuyor. (Kaynak: dl_weekly)

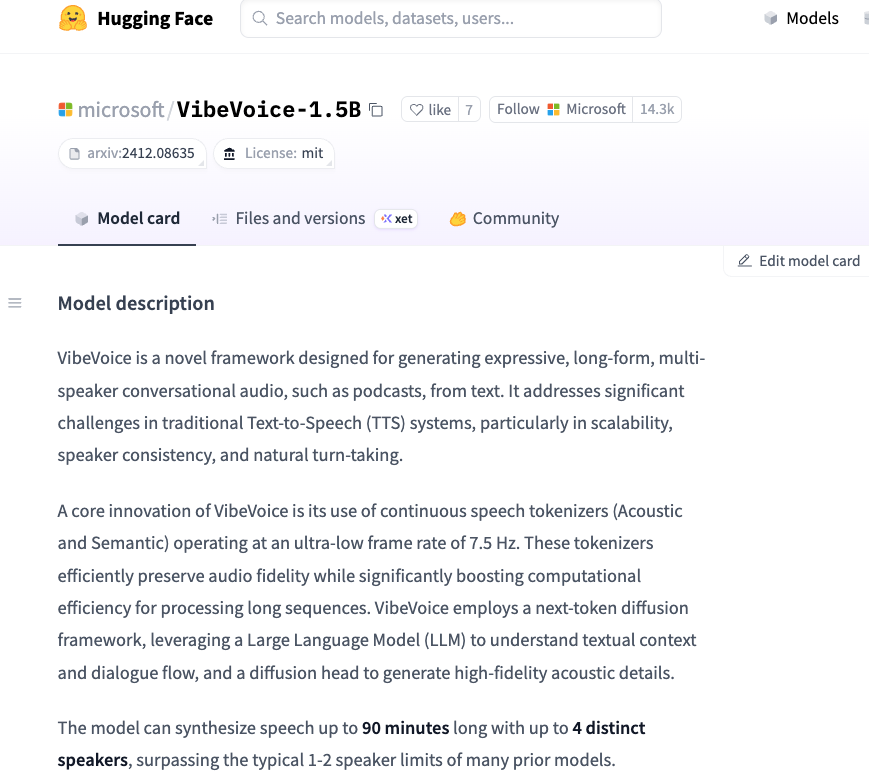

Diffusers Yeni Sürümünü Yayınladı, Qwen-Image ve Flux Kontext İnce Ayarını Destekliyor: HuggingFace’in Diffusers kütüphanesi, görüntü düzenleme ve video doğruluğunu daha da artıran v0.35.0 sürümünü yayınladı. Ayrıca, Qwen-Image ve Flux Kontext modelleri için ince ayar betik desteği eklendi. Yeni sürüm, Diffusers pipeline’larının ve modellerinin yükleme hızını da iyileştirdi, özellikle Wan, Qwen gibi büyük modellerde belirgin bir etki gösterdi. (Kaynak: RisingSayak)

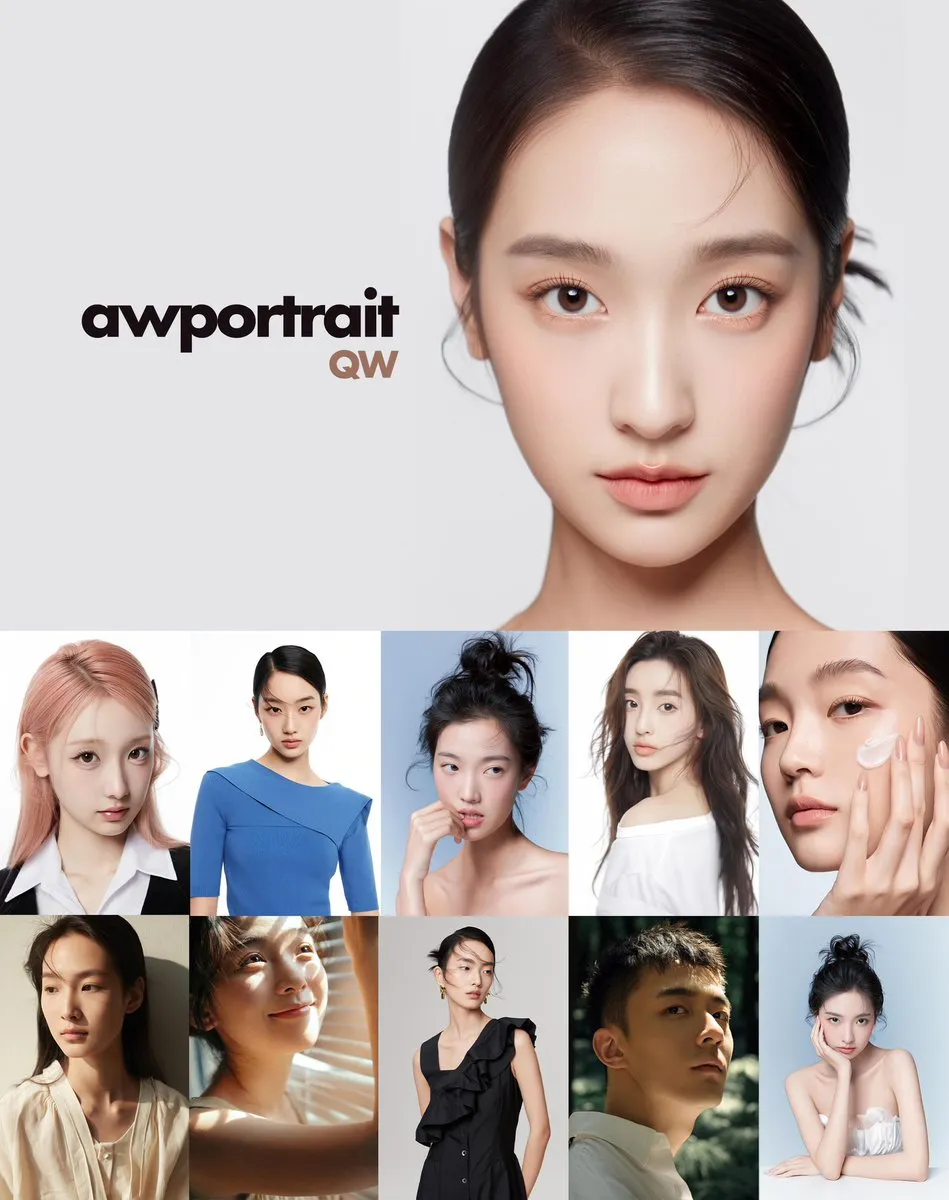

Alibaba QwenImage Mimarisi Altında AWPortrait QW Modeli Yayınlandı, Doğu Estetiğine Odaklanıyor: Alibaba, QwenImage mimarisi altında AWPortrait QW modelini yayınladı. Bu model, Çinli insanların görünüm özelliklerine ve estetiğine daha uygun bir eğitim seti kullanılarak eğitildi ve iç/dış mekan portreleri, moda, stüdyo çekimleri gibi çeşitli türleri kapsıyor, güçlü bir genelleme yeteneğine sahip. Orijinal Qwen sürümüne kıyasla, AWPortrait QW cilt dokusu performansında daha hassas ve gerçekçi bir görünüm sunuyor. (Kaynak: Alibaba_Qwen)

🧰 Araçlar

Pake: Rust ile Web Sayfalarını Kolayca Hafif Masaüstü Uygulamalarına Dönüştürün: Pake, kullanıcıların herhangi bir web sayfasını Rust Tauri framework’ünü kullanarak hafif bir masaüstü uygulamasına dönüştürmesine olanak tanıyan açık kaynaklı bir araçtır. Mac, Windows ve Linux’u destekler. Electron ile paketlemeye kıyasla Pake, yaklaşık 20 kat daha küçük (yaklaşık 5MB), daha iyi performans sunar ve kısayollar, sürükleyici pencereler gibi özellikler sağlar. Önceden paketlenmiş AI uygulamaları arasında ChatGPT, Gemini, Grok ve DeepSeek bulunmaktadır. (Kaynak: GitHub Trending)

Claude Code: Verimli Programlama Aracı, Ancak API Sınırlamaları ve Hata Ayıklama Zorlukları Mevcut: Claude Code, %99’u AI tarafından üretilen kod yeteneğiyle dikkat çeken bir AI programlama aracı olarak “vibe coding”in yeni dalgası olarak övgüyle karşılanıyor. Ancak, kullanıcı geri bildirimleri, karmaşık hatalarla başa çıkarken zorlanabileceğini, “code pile” (kod yığını) oluşturabileceğini ve API sınırlamaları olduğunu gösteriyor. Geliştiriciler, onu bir “stajyer” olarak eşli programlamada kullanmayı ve deneyimi optimize etmek için bağlamı yenilemeyi veya /context komutunu kullanarak token kullanımını görselleştirmeyi öneriyor. (Kaynak: dotey, leveredvlad, sammcallister, kylebrussell, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

OpenWebUI: Kendi Kendine Barındırılan LLM Ön Ucu, ChatGPT Düzeyinde Yüksek Kaliteli Çıktı Hedefliyor: OpenWebUI, ChatGPT’ye eşdeğer veya daha iyi kalite sunmayı amaçlayan, aynı zamanda çeşitli modelleri ve işlevleri entegre eden kendi kendine barındırılan bir LLM ön ucudur. Kullanıcılar, web araması, görüntü oluşturma ve genel yanıt kalitesini artırmak için optimize edilmiş ayarlar arıyor ve DigitalOcean Droplet gibi barındırma ortamı yapılandırmalarının önemini tartışıyor. (Kaynak: Reddit r/OpenWebUI)

Exosphere: Açık Kaynak Çalışma Zamanı, Dinamik Ajan Grafikleri ve Kalıcı Durumu Destekliyor: Exosphere, dinamik dallanma, yeniden deneme ve paralel yürütme gerektiren ajan iş akışları için tasarlanmış açık kaynaklı bir çalışma zamanı ve kalıcı durum yöneticisidir. Büyük ölçekli girdileri işleyebilir, model çıktısına göre çalışma zamanı dallanması yapabilir, arıza sonrası kurtarılabilirliği sağlayabilir ve CPU ile GPU aşamalarını karıştırabilir, karmaşık AI ajan sistemleri için istikrarlı bir yürütme ortamı sunar. (Kaynak: Reddit r/MachineLearning)

DocStrange: Görüntü/PDF/Belge Yapılandırılmış Veri Çıkarma Aracı: DocStrange, artık ücretsiz bir web uygulaması olarak sunulan açık kaynaklı bir kütüphanedir. Görüntülerden, PDF’lerden ve belgelerden temiz yapılandırılmış veri çıkarabilir ve Markdown, CSV, JSON gibi çeşitli çıktı formatlarını destekler. Bu araç, veri işleme süreçlerini basitleştirmeyi ve yapılandırılmamış verilerden faydalı bilgi elde etme verimliliğini artırmayı amaçlamaktadır. (Kaynak: Reddit r/MachineLearning)

DSPy: Otomatik İstem Optimizasyon Çerçevesi, LLM Performansını Önemli Ölçüde Artırıyor: DSPy framework’ü ve GEPA bileşeni, az sayıda metrik çağrısıyla LLM performansını önemli ölçüde artırabilen istem optimizasyonunu otomatikleştirir. Örneğin, liste tabanlı yeniden sıralama görevinde, DSPy GEPA 500 metrik çağrısından sonra doğruluğu %40 artırarak optimize edilmiş istemleri 100 satırlık resimli bir akışa dönüştürdü. (Kaynak: lateinteraction)

Rube: Genel MCP Sunucusu, AI Ajanlarını Çeşitli Uygulamalarla Bağlıyor: Rube, AI ajanlarını kullanıcıların çeşitli uygulamalarına bağlamak için tasarlanmış genel bir Çok Modlu İletişim Protokolü (MCP) sunucusu olarak tanıtıldı. Popüler IDE’ler, Claude Code ve diğer MCP istemcileriyle uyumlu olup, AI ajanlarının YouTube videolarını araştırması ve eksiksiz içerik stratejisi belgeleri oluşturması gibi karmaşık görevleri gerçekleştirmesini sağlar. (Kaynak: omarsar0)

Osaurus: Apple Silicon Yerel Açık Kaynak LLM Hizmeti, Ollama’yı Geride Bırakıyor: Osaurus, Apple’ın MLX’i üzerine inşa edilmiş, sadece 7MB boyutunda bir Apple Silicon yerel açık kaynak LLM hizmetidir ve Ollama’dan %20 daha hızlı olduğu iddia edilmektedir. M serisi çiplerde aşırı performans sağlayarak Mac kullanıcılarına verimli bir yerel LLM çıkarım deneyimi sunar. (Kaynak: awnihannun)

Havivi, AI Ultraman Oyuncaklarını Piyasaya Sürdü, Büyük Ölçekli Ticarileşme Sağlandı: Yueran Innovation (Havivi), dünyanın ilk Tiga Ultraman AI oyuncağını piyasaya sürdü ve 200 milyon yuan A Serisi finansmanını tamamladı. Oyuncak, CocoMate çekirdek gövdesine sahip, 4G bağlantısını, sallayarak uyandırmayı, NFC kart sistemini destekliyor ve karakterin dünya görüşüyle tutarlı bir dil mantığına ve duygusal tepkilere sahip, yanıt süresi sadece 800ms. Önceki ürünü BubblePal, 200.000 adet satılarak dünyanın ilk büyük ölçekli ticarileşmiş AI oyuncağı oldu. (Kaynak: 量子位)

SenseTime SenseRobot, AI ve IP’yi Birleştirerek Çocuk Gelişimine Katkıda Bulunan Judy Serisi Satranç Robotlarını Duyurdu: SenseTime’ın ev robotu markası SenseRobot, Disney’in Zootopia’sı ile işbirliği yaparak Judy serisi satranç robotlarını piyasaya sürdü. Ürün, satranç, Go, uluslararası satranç ve beş taş olmak üzere dört farklı satranç türünü ve eğlenceli kart programlamayı birleştiriyor. Düşük hayal kırıklığı yaratan büyüme sistemi ve insansı etkileşim aracılığıyla çocukların oyun oynarken düşünme becerilerini geliştirmelerine, azimli bir karakter ve iyimser bir zihniyet kazanmalarına yardımcı olmayı amaçlıyor. (Kaynak: 量子位)

📚 Öğrenme

RuscaRL Framework’ü LLM Çıkarım Keşif Darboğazını Kırdı, Qwen-2.5-7B GPT-4.1’i Geride Bıraktı: “Breaking the Exploration Bottleneck: Rubric-Scaffolded Reinforcement Learning for General LLM Reasoning” başlıklı makale, LLM çıkarımındaki keşif darboğazını etkili bir şekilde çözen RuscaRL framework’ünü öneriyor. Bu framework, keşif ve ödül için bir rehber olarak rubrik tabanlı değerlendirme kriterlerini kullanıyor. Deneyler, RuscaRL’nin Qwen-2.5-7B-Instruct’ın HealthBench-500’deki performansını 23.6’dan 50.3’e çıkararak GPT-4.1’i geride bıraktığını gösterdi. (Kaynak: HuggingFace Daily Papers)

T2I-ReasonBench: Metinden Görüntüye Modellerinin Akıl Yürütme Yeteneklerini Değerlendirmek İçin Yeni Bir Kıyaslama: “T2I-ReasonBench: Benchmarking Reasoning-Informed Text-to-Image Generation” başlıklı makale, metinden görüntüye (T2I) modellerinin akıl yürütme yeteneklerini değerlendirmek için yeni bir kıyaslama olan T2I-ReasonBench’i tanıttı. Bu kıyaslama, deyim yorumlama, metin-görüntü tasarımı, varlık akıl yürütme ve bilimsel akıl yürütme olmak üzere dört boyutta değerlendirme yapıyor ve akıl yürütme doğruluğunu ve görüntü kalitesini ölçmek için iki aşamalı bir protokol kullanıyor. (Kaynak: HuggingFace Daily Papers)

“Explain Before You Answer” İncelemesi: Bileşik Görsel Akıl Yürütmede Paradigma Değişimi: “Explain Before You Answer: A Survey on Compositional Visual Reasoning” başlıklı makale, 2023-2025 yılları arasında bileşik görsel akıl yürütme üzerine 260’tan fazla makaleyi kapsamlı bir şekilde inceliyor. İnceleme, temel kavramları tanımlıyor, bileşik yöntemlerin bilişsel hizalama, anlamsal doğruluk, sağlamlık gibi alanlardaki avantajlarını açıklıyor ve istem geliştirmeden birleşik ajan VLM’lere kadar beş aşamalı bir paradigma değişimini takip ediyor. LLM akıl yürütme sınırlamaları, halüsinasyonlar gibi açık zorluklara işaret ediyor. (Kaynak: HuggingFace Daily Papers)

MEENA (PersianMMMU): İlk Farsça Çok Modlu Eğitim Sınavı Veri Kümesi: “MEENA (PersianMMMU): Multimodal-Multilingual Educational Exams for N-level Assessment” başlıklı makale, Farsça VLM’leri değerlendirmek için ilk kıyaslama veri kümesi olan MEENA veri kümesini tanıttı. Yaklaşık 7500 Farsça ve 3000 İngilizce soru içeren bu veri kümesi, bilim, akıl yürütme, matematik, diyagramlar gibi çeşitli alanları kapsıyor ve VLM’lerin diller arası yeteneklerini geliştirmeyi amaçlıyor. (Kaynak: HuggingFace Daily Papers)

MV-RAG: Geri Alım Destekli Çoklu Görünüm Yayılımı ile Metinden 3D Oluşturma: “MV-RAG: Retrieval Augmented Multiview Diffusion” başlıklı makale, metinden 3D oluşturma için yeni bir süreç olan MV-RAG’ı öneriyor. Bu süreç, önce 2D veritabanından ilgili görüntüleri alır, ardından bu görüntüleri çoklu görünüm yayılım modelini koşullandırmak için kullanarak tutarlı ve doğru çoklu görünüm çıktıları sentezler. Bu, mevcut yöntemlerin alan dışı veya nadir kavramlar oluşturmadaki yetersizliğini giderir. (Kaynak: HuggingFace Daily Papers)

German4All: Almanca Okunabilirlik Kontrollü Yeniden İfade Veri Kümesi ve Modeli: “German4All – A Dataset and Model for Readability-Controlled Paraphrasing in German” başlıklı makale, Almanca’da okunabilirlik kontrollü paragraf düzeyinde yeniden ifade için ilk büyük ölçekli veri kümesi olan German4All’u tanıttı. 25.000’den fazla örnek ve beş okunabilirlik seviyesi içeren bu veri kümesi, Almanca metin basitleştirmede SOTA performansı elde eden açık kaynaklı bir modelin eğitiminde kullanıldı. (Kaynak: HuggingFace Daily Papers)

Tekrarlama, Bellek ve Test Zamanı Hesaplama Ölçeklendirmesi ile LLM Akıl Yürütme Derinliğini Artırma: “Beyond Memorization: Extending Reasoning Depth with Recurrence, Memory and Test-Time Compute Scaling” başlıklı makale, LLM’lerin çok adımlı akıl yürütme yeteneklerini inceliyor ve ezberleme dışarıda bırakıldığında çoğu sinir ağı mimarisinin temel kuralları soyutlayabildiğini buluyor. Araştırma, tekrarlama, bellek ve test zamanı hesaplama ölçeklendirmesi yoluyla etkili model derinliğini artırmanın, özellikle çok adımlı akıl yürütme görevlerinde akıl yürütme yeteneğini önemli ölçüde geliştirebileceğini gösteriyor. (Kaynak: HuggingFace Daily Papers)

Dikkat Mekanizmasında Normalizasyonun Sınırlamalarının Analizi: “Limitations of Normalization in Attention Mechanism” başlıklı makale, dikkat mekanizmasında normalizasyonun sınırlamalarını derinlemesine inceliyor. Araştırma, seçilen token sayısı arttıkça modelin bilgilendirici tokenleri ayırt etme yeteneğinin azaldığını ve softmax normalizasyonu altındaki gradyan hassasiyetinin eğitimde, özellikle düşük sıcaklık ayarlarında bir zorluk oluşturduğunu belirtiyor. (Kaynak: HuggingFace Daily Papers)

Ano: Gürültülü Ortamlarda Sağlamlığı Artıran Derin Güçlendirmeli Öğrenme Optimize Edicisi: “Ano: updated optimizer for noisy Deep RL” başlıklı makale, derin güçlendirmeli öğrenme için tasarlanmış, gürültülü ve yüksek derecede dışbükey olmayan ortamlarda sağlamlığı ve istikrarı artırmayı amaçlayan Ano adlı bir optimize ediciyi tanıttı. Ano, momentum yönünü ve gradyan büyüklüğünü ayırarak ve Atari kıyaslamalarında etkinliğini doğrulayarak, standart dışbükey olmayan rastgele ayarlarda yakınsama kanıtları da sunuyor. (Kaynak: Reddit r/MachineLearning)

TRUST Algoritması: Yorumlanabilir Makine Öğrenimi İçin Parçalı Doğrusal Regresyon Ağaçları: “Exploring interpretable ML with piecewise-linear regression trees (TRUST algorithm)” başlıklı makale, karar ağaçlarının yaprak düğümlerine seyrek regresyon modelleri uydurarak yorumlanabilir parçalı doğrusal regresyon ağaçları üreten TRUST (Transparent, Robust and Ultra-Sparse Trees) algoritmasını önerdi. Algoritma, 60 veri kümesinde üstün performans sergileyerek yüksek tahmin performansını korurken modelin yorumlanabilirliğini önemli ölçüde artırdı ve geleneksel yorumlanabilir modeller ile yüksek hassasiyetli kara kutu modelleri arasındaki boşluğu kapattı. (Kaynak: Reddit r/MachineLearning)

💼 İş Dünyası

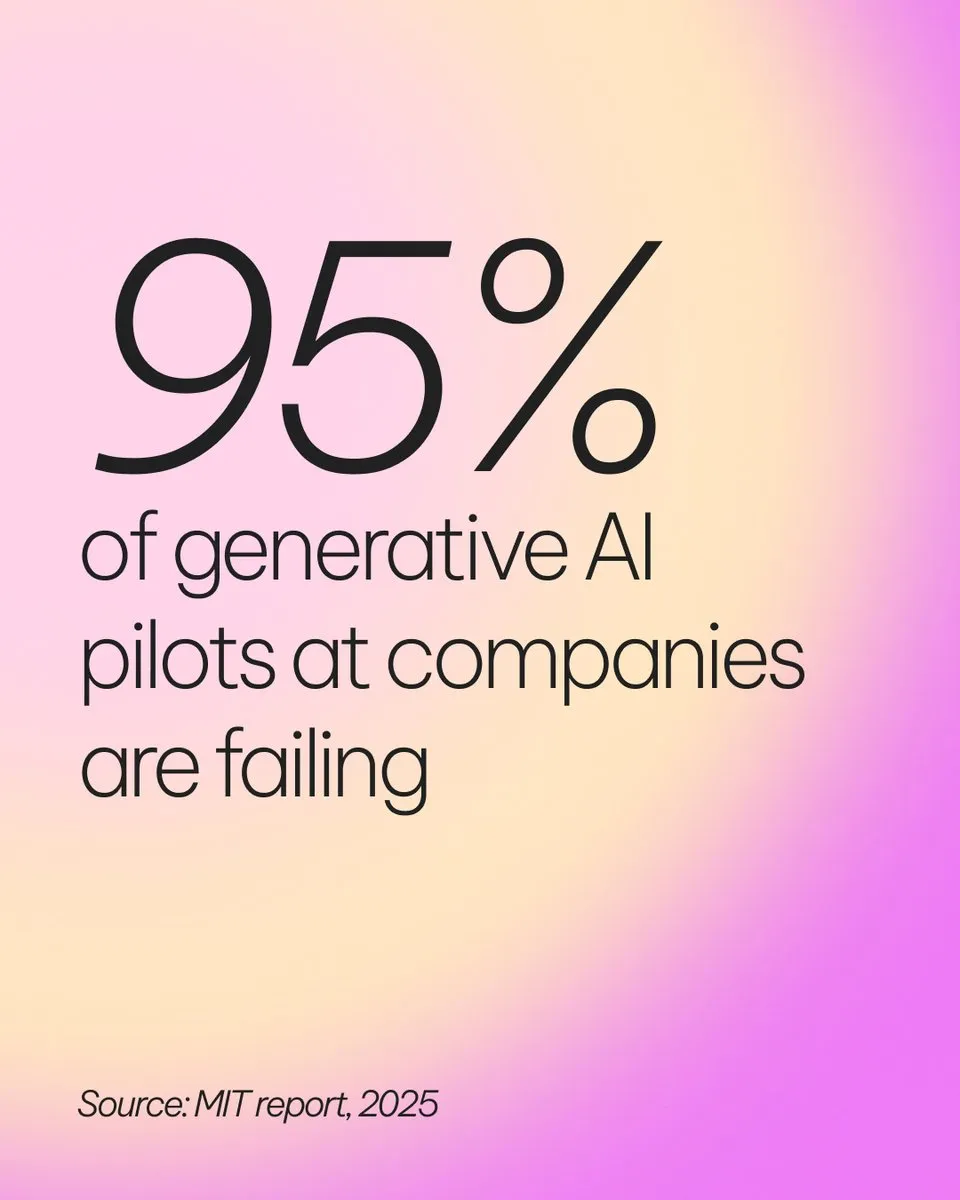

AI Şirketlerinin Karlılık Zorlukları: Üretken AI Projelerinin %95’i Sıfır Yatırım Getirisi Sağlıyor: MIT araştırması, şirketlerin üretken AI pilot projelerinin %95’inin yatırım getirisi sağlayamadığını ortaya koyarak, AI’nın kişisel bir araçtan kurumsal düzeyde bir uygulamaya dönüşümündeki zorlukları vurguladı. Başarılı %5’lik vakalar genellikle ajan tabanlı AI sistemlerini benimsemiş ve profesyonel tedarikçilerle işbirliği yapmış, bu da şirketlerin abartılı reklamlara kapılmak yerine AI’nın gerçek değerini ve uygulama stratejilerini derinlemesine anlamaları gerektiğini gösteriyor. (Kaynak: rao2z, AI21Labs)

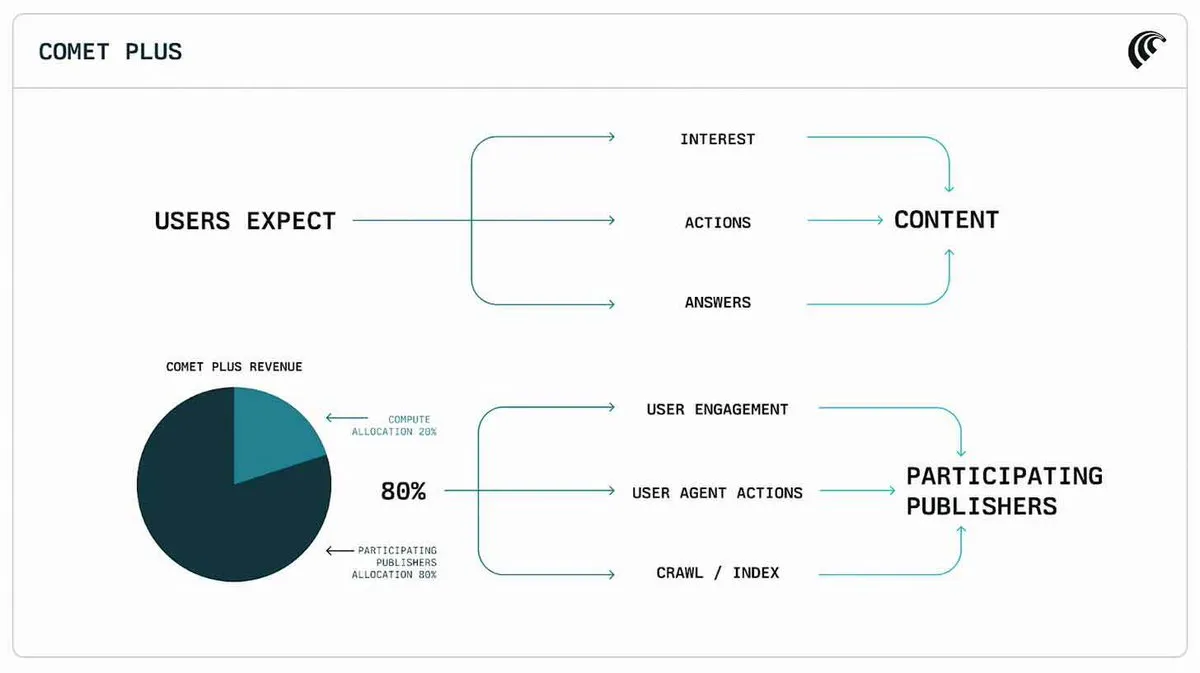

Perplexity, 42.5 Milyon Dolarlık Yayıncı Gelir Paylaşım Programını Başlattı: Perplexity, AI içerik üretiminin geleneksel medya telif hakları ve gelirleri üzerindeki etkisini ele almayı amaçlayan 42.5 milyon dolarlık bir yayıncı gelir paylaşım programı başlattı. Bu hamle, AI şirketlerinin içerik yaratıcılarıyla kazan-kazan iş modelleri keşfettiğini ve AI içerik ekosisteminde sürdürülebilir işbirliği ilişkileri kurmayı hedeflediğini gösteriyor. (Kaynak: TheRundownAI)

Synthesia Gelirleri 100 Milyon Dolar ARR’yi Aştı, AI Sanal Avatar Pazarı Hızla Büyüyor: AI sanal avatar oluşturma platformu Synthesia, yıllık yinelenen gelirinin (ARR) 100 milyon doları aştığını, yıllık %100 büyüme kaydettiğini ve net elde tutma oranının %142 olduğunu duyurdu. Şirket, son 12 ayda 100 bin doların üzerindeki müşteri tabanını dört katına çıkardı ve Fortune 100 şirketlerinin %80’inden fazlasının güvenini kazandı, bu da AI sanal avatarların kurumsal iletişim alanında güçlü büyümesini ve uygulama potansiyelini gösteriyor. (Kaynak: synthesiaIO)

🌟 Topluluk

ChatGPT/Claude Modellerinin “Kişiliksizleşmesi” Kullanıcılarda Şiddetli Memnuniyetsizlik Yarattı: ChatGPT-5’in yayınlanmasının ardından, GPT-4o ve Claude Opus 4.1 modellerinin kullanıcılar tarafından genel olarak “soğuk, sert, bağlam anlayışından ve incelikten yoksun” olduğu, hatta “saçmaladığı” ve “inatçı” olduğu belirtildi. Bu durum, kullanıcı deneyiminde önemli bir düşüşe yol açtı ve birçok kişi aboneliklerini iptal etmeyi düşündüğünü ifade etti. (Kaynak: Reddit r/ChatGPT, Reddit r/ClaudeAI)

AI Kod Üretimi ve Geliştirme Verimliliği Tartışması: “Code Pile”dan “Vibe Coding”e: Topluluk, AI kod üretiminin verimliliği artırırken “code pile” (kod yığını) ve karmaşık hataların çözülmesinde zorluklara yol açabileceğini tartışıyor. Geliştiriciler, “vibe coding”in geleneksel yazılım mühendisliği felsefesinden farklı olduğunu, AI programlama araçlarının insan işbirliğiyle kullanılması gerektiğini ve geliştirme deneyimini optimize etmek için görselleştirme araçları ve açık bağlamın önemini vurguluyor. (Kaynak: dotey, leveredvlad, Reddit r/ClaudeAI, jerryjliu0)

AI Etiği ve İçerik Gerçekliği: AI Tarafından Üretilen İçeriğe Meta Veri Etiketlemesi ve Platform İncelemesi Çağrısı: Topluluk, yanlış bilgi yayılımı ve AI eğitim verilerinin kirlenmesi sorunlarına karşı AI tarafından üretilen içeriğe zorunlu meta veri etiketlemesi ve sosyal medya platformlarında daha sıkı inceleme çağrısında bulunuyor. Reddit gibi platformlar AI içeriğini kısıtlamaya başladı, bu da AI içerik politikaları, veri saflığı ve ifade özgürlüğü üzerine tartışmaları tetikledi. (Kaynak: Reddit r/ArtificialInteligence, Ronald_vanLoon, random_walker, Reddit r/artificial, Reddit r/ArtificialInteligence)

AI’nın İstihdam ve Eğitim Üzerindeki Etkisi: Genç İşçilerin İşsizlik Riski ve AI Uzmanlık Alanlarının Geleceği: Stanford araştırması, AI’nın işgücü piyasasını yeniden şekillendirdiğini ve genç işçilerin daha yüksek işsizlik riskiyle karşı karşıya olduğunu belirtiyor. Topluluk aynı zamanda AI uzmanlık derecelerinin iş piyasasındaki değerini ve AI’nın hızlanan gelişimi bağlamında gelecekteki istihdam zorluklarına uyum sağlamak için IT-related majors’ın nasıl seçilmesi gerektiğini tartışıyor. (Kaynak: Reddit r/artificial, Reddit r/ArtificialInteligence, 量子位, Reddit r/ArtificialInteligence)

💡 Diğer

Elon Musk, Otonom Sürüşte LiDAR ve Radar Güvenliği Konusunda Tartışma Yarattı: Musk, otonom araçlarda LiDAR ve radar eklemenin güvenliği azaltacağını savunarak saf görsel rotayı bir kez daha vurguladı. Çoklu sensör füzyonunun tutarsız tanımlama sonuçlarına yol açabileceğini ve sürüş riskini artırabileceğini belirtti, Waymo’nun otoyol operasyonlarındaki kısıtlamalarının bununla ilgili olduğunu ima etti. Bu açıklamalar, otonom sürüş sensör füzyon stratejileri hakkında toplulukta hararetli tartışmalara yol açtı. (Kaynak: 量子位)

Çin’in Alman Robot Şirketini Satın Alması Uluslararası İlgiyi Çekti: Sosyal medyada, Çin’in Alman robotik “taç mücevheri”ni satın alması olayı tartışıldı ve robotik teknolojisi, makine öğrenimi ve yapay zeka alanlarındaki uluslararası işbirliği ve rekabete dikkat çekildi. (Kaynak: Ronald_vanLoon)

IBM ve AMD, Hata Toleranslı Kuantum Bilgisayarların Gelişimini Hızlandırmak İçin İşbirliği Yapıyor: IBM ve AMD, IBM kuantum bilgisayarları ile AMD’nin yüksek performanslı bilgi işlem teknolojilerini birleştiren yeni nesil bir bilgi işlem mimarisi geliştirmek üzere işbirliği yaptıklarını duyurdu. Bu işbirliği, gelişmiş teknolojileri entegre ederek on yıl içinde hataları gerçek zamanlı olarak tespit edip düzeltebilen hata toleranslı kuantum bilgisayarları gerçekleştirmeyi ve böylece kuantum bilişimin pratikleşmesini ilerletmeyi amaçlıyor. (Kaynak: The Verge)