Anahtar Kelimeler:OpenAI, IOI Altın Madalya, AI Yarışmacı Programlama, GPT-5, Baichuan Akıllı, Tıbbi Akıl Yürütme Büyük Modeli, AI Çip Ticareti, Somutlaşmış Yapay Zeka, Baichuan-M2-32B, OpenAI HealthBench Değerlendirmesi, AMD Mi300 GPU, Somutlaşmış Yapay Zeka Temeli, Kuantum Radar Teknolojisi

🔥 焦點

OpenAI IOI金牌與AI競技程式設計新進展 : OpenAI 的推論系統在 2025 年國際資訊奧林匹亞競賽(IOI)線上賽中獲得金牌,在 AI 參賽者中位居第一,總排名第六,超越 98% 的人類選手。該系統並未使用專門訓練的模型,而是整合了多個通用推論模型。此成就標誌著 AI 在競技程式設計領域取得顯著突破,儘管 Elon Musk 提出 Grok 4 在編碼方面超越 GPT-5,且有使用者質疑 OpenAI 的行銷策略。LiveCodeBench Pro 測試也顯示,GPT-5 Thinking 在複雜程式設計任務中實現突破,平均回應長度遠超其他模型。(來源:sama, sama, 量子位, willdepue, npew, markchen90, SebastienBubeck)

百川智能發布醫療推論大模型Baichuan-M2 : 百川智能發布最新醫療推論大模型 Baichuan-M2-32B,在 OpenAI HealthBench 評測集上超越 OpenAI 的 gpt-oss-120b 及其他領先的開源與閉源模型,尤其在 HealthBench-Hard 和中國臨床診療場景中表現突出,成為全球唯二超過 32 分的模型之一。該模型參數量 32B,支援 RTX4090 單卡部署,大幅降低私有部署成本。百川創新性地引入「患者模擬器」和「Verifier 系統」進行強化學習訓練,提升模型在真實醫療場景中的可用性。(來源:量子位)

GPT-5 發布爭議與使用者信任危機 : OpenAI 發布 GPT-5 後,其表現被指不如預期,更像產品迭代而非革命性突破。執行長 Sam Altman 的過度炒作(如「死星」比喻、PhD 級專家)與使用者實際回饋(錯誤頻出、創意寫作能力下降、缺乏個性)形成鮮明對比,導致大量使用者不滿並成功要求恢復 GPT-4o。此外,OpenAI 開始鼓勵將 GPT-5 用於醫療健康建議,引發了關於 AI 醫療建議責任歸屬的擔憂,已有因誤信 AI 醫療建議導致中毒的案例。(來源:MIT Technology Review, MIT Technology Review, 量子位)

🎯 動向

AI 晶片貿易與中國本土化趨勢 : NVIDIA 和 AMD 與美國政府達成協議,對其向中國銷售 AI 晶片的 15% 銷售額將上繳美國政府。與此同時,中國方面表示 NVIDIA H20 晶片不安全,並計畫放棄 H20 轉而支持國內 AI 晶片。有分析認為,此舉將加速中國本土 AI 晶片生態的發展,對全球 AI 產業格局產生深遠影響。AI 硬體領域,AMD Mi300 GPU 以 192GB 單卡 VRAM 和 1.5TB 的 8x GPU 節點總 VRAM,在模型權重和長上下文處理上展現出顯著優勢。(來源:MIT Technology Review, Reddit r/artificial, dylan522p, realSharonZhou)

AI 在法律系統中的應用與挑戰 : 美國法律系統正面臨 AI 幻覺問題,律師和法官使用 AI 工具時出現引用虛假案例等錯誤。儘管有風險,一些法官仍在探索 AI 在法律研究、案件摘要和起草常規命令中的應用,認為其能提高效率。然而,AI 在法律領域的應用邊界模糊,且法官使用 AI 出錯的問責機制尚不明確,可能損害公眾對司法的信任。(來源:MIT Technology Review)

具身智能產業加速發展與技術路線 : 2025 世界機器人大會展示了具身智能領域的快速進展,宇樹科技和智元機器人作為領軍企業,分別代表硬體(機器狗、足部靈活性)和軟硬一體(人形機器人、生態化打法)兩條技術路線。睿爾曼公司也發布了以「具身智能基座」為核心的 RealBOT 具身開源平台和高性能關節模組,強調「Robot for AI」理念,推動 AI 從數位智能向具身智能進化。產業正從「展示 Demo」轉向「產業閉環模式」,並吸引了大量資本和政策支持。(來源:36氪, 36氪, 量子位, 量子位)

Google 與 OpenAI 最新模型與功能動態 : Google Gemini App 為 Ultra 訂閱使用者推出 Deep Think 功能,解決數學和程式設計問題,並支援 Gemini Live 連接 Google 應用程式。Claude 現已支援引用歷史聊天記錄,方便使用者繼續對話。OpenAI 公布未來幾個月的算力分配優先級,計畫在未來 5 個月內將算力翻倍。此外,GPT-oss 模型發布後下載量巨大,但也被指出存在幻覺行為和訓練資料瑕疵。(來源:demishassabis, demishassabis, dotey, op7418, sama, sama, Reddit r/ArtificialInteligence, Reddit r/LocalLLaMA, 量子位, TheTuringPost, SebastienBubeck, Alibaba_Qwen, ClementDelangue, Reddit r/LocalLLaMA, _lewtun, mervenoyann, rasbt)

AI 搜尋對網站流量的影響與產業變革 : Amazon 突然退出 Google Shopping 廣告競價並禁止 Google AI 購物助手抓取產品頁面,標誌著兩大巨頭在 AI 時代流量邏輯上的決裂。文章指出,AI 搜尋模式對中小網站不友好,流量集中於大型權威媒體和知名網站,導致「劫貧濟富」效應,與百度當年因 App 興起而失去流量入口的困境類似,預示 Google 搜尋的入口地位也將受到挑戰。各平台正走向閉環,試圖掌控使用者行為的全過程,重塑廣告行業信任結構。(來源:36氪, 36氪)

量子雷達技術新突破 : 物理學家開發出一種新型量子雷達,利用原子雲探測無線電波,有望用於地下成像,例如地下管道建設和考古發掘。該技術作為量子感測器原型,未來可能比傳統雷達更小巧、更靈敏且無需頻繁校準。量子感測器與量子計算有共通之處,相關進展可相互促進。(來源:MIT Technology Review)

Meta 推出 V-JEPA 2 世界模型 : Meta 發布 V-JEPA 2,一個用於視覺理解和預測的突破性世界模型,旨在提升 AI 在視覺領域的感知和預測能力。(來源:Ronald_vanLoon)

🧰 工具

OpenAI Go API 庫 : OpenAI 官方 Go 語言庫(openai-go)提供便捷的 OpenAI REST API 存取,支援 Go 1.21+,包含聊天補全、流式回應、工具呼叫、結構化輸出等功能,並提供錯誤處理、超時配置、檔案上傳和 Webhook 驗證等實用特性。(來源:GitHub Trending)

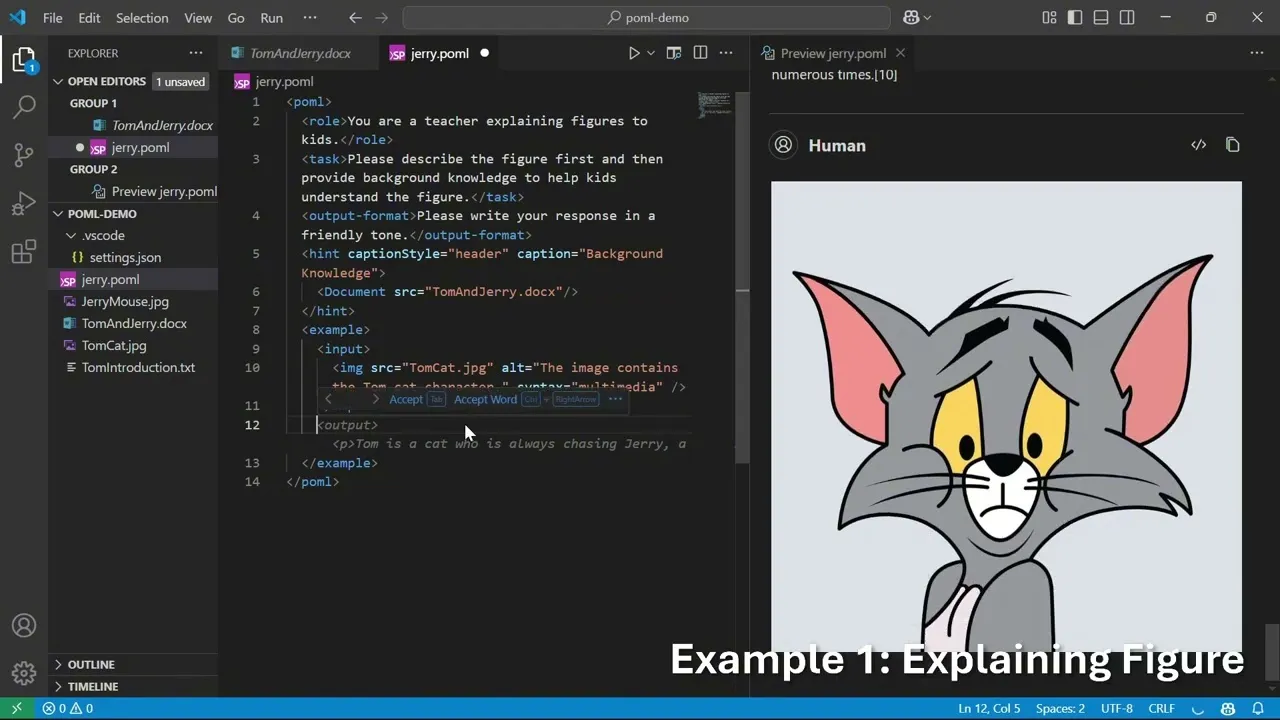

Microsoft POML:提示詞編排標記語言 : Microsoft 推出 POML (Prompt Orchestration Markup Language),一種新型標記語言,旨在為大型語言模型(LLM)的高級提示工程提供結構、可維護性和多功能性。它採用類似 HTML 的語法,支援資料整合、樣式分離和內建模板引擎,並提供 VS Code 擴充功能和 SDK,幫助開發者創建更複雜和可靠的 LLM 應用程式。(來源:GitHub Trending)

LlamaIndex 金融文件 AI 分析工具 : LlamaIndex 展示了一款 AI 工具,透過 LlamaCloud 將複雜金融文件轉化為易懂的語言,提供圖表和財務數據的詳細解讀,並支援內容重寫和個人化定制,幫助使用者理解複雜的金融報告。(來源:jerryjliu0)

360 智能體工廠評測 : 評測 360 智能體工廠,一個 Agent 和 MCP(多智能體協作平台)覆蓋全面的平台,支援搜尋引擎、文生圖、網頁生成等功能,可用於生成減脂期食譜,實現自媒體內容量產或複雜工作流程管理。其多智能體蜂群功能具有優勢,能輕鬆實現內容量產和複雜工作流程統一管理。(來源:karminski3)

Excel AI 外掛程式與 AI 會議紀錄工具 : 一款 Excel 的 AI 外掛程式允許使用者在儲存格內與 AI 聊天,生成公式或巨集,為 Excel 與 AI 結合提供思路。此外,AI 會議紀錄工具 Notta(包括其便攜錄音設備 Notta Memo)因其快速語音轉錄、總結和提問功能,被評為 SOTA,可大幅提升會議效率。(來源:karminski3, karminski3, karminski3)

GPT-5 與 AI 虛擬形象結合 : Synthesia 將 GPT-5 的聲音與 AI 虛擬形象結合,進行了一項實驗,旨在使 AI 溝通更具吸引力、更易記憶和理解,探索 LLM 與多模態互動的結合。(來源:synthesiaIO)

AI 教育應用與研究工具 : GPT-5 在教育領域展現潛力,例如創建互動式 3D 形狀檢視器,幫助兒童學習 3D 形狀。此外,Elicit 的瀏覽器代理功能可幫助使用者快速找到論文全文,而 pyCCsl 則作為 Claude Code 的狀態列工具,提供 token 使用、成本和上下文等會話資訊,提升 LLM 工具的使用體驗。(來源:_akhaliq, jungofthewon, Reddit r/ClaudeAI)

OpenWebUI 原生客戶端與 Claude Code 衝刺編排框架 : OpenWebUI 發布了 iOS 和 Android 原生客戶端,旨在提供更流暢、隱私優先的使用者體驗。同時,Gustav 作為 Claude Code 的衝刺編排框架,可將產品需求文件(PRD)轉化為企業級應用程式的工作流,簡化開發流程。(來源:Reddit r/OpenWebUI, Reddit r/ClaudeAI)

OpenWebUI 文件上下文問題 : OpenWebUI 使用者反映,上傳的 PDF/DOCX/文字檔案雖已成功解析,但模型在查詢時無法將其納入上下文,顯示出 AI 工具在檔案處理和上下文理解方面仍存在待解決的問題。(來源:Reddit r/OpenWebUI)

📚 學習

LLM 推論與最佳化研究 : ReasonRank 透過自動化推論密集型資料合成和兩階段後訓練,顯著提升 LLM 列表式排序能力。LessIsMore 提出免訓練稀疏注意力機制,在不犧牲準確性下加速 LLM 解碼。TSRLM 透過「錨定拒絕」和「未來引導選擇」雙階段框架,解決自獎勵模型偏好學習效率下降問題,顯著提升 LLM 生成能力。(來源:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

AI 代理評估與可靠性研究 : UserBench 作為使用者中心基準測試環境,評估 LLM 代理在模糊目標下的主動使用者協作能力,揭示當前模型在任務完成與使用者對齊間的差距。同時,有研究討論代理工具使用系統的可靠性評估和故障分類,建議標準化成功率分解指標和故障類型,以提高代理系統部署的可靠性。(來源:HuggingFace Daily Papers, Reddit r/MachineLearning)

多模態 LLM 與 RAG 技術進展 : VisR-Bench 資料集用於評估長文件中問答驅動的多模態檢索,顯示 MLLM 在結構化表格和低資源語言方面仍有挑戰。Bifrost-1 框架透過 patch 級 CLIP 圖像嵌入橋接 MLLM 和擴散模型,實現高保真可控圖像生成。Video-RAG 則提供免訓練的檢索增強生成方法,結合 OCR+ASR 實現長影片理解。(來源:HuggingFace Daily Papers, HuggingFace Daily Papers, LearnOpenCV)

AI 安全與攻擊研究 : WhisperInject 框架透過人耳難以察覺的音訊擾動,操縱音訊語言模型生成有害內容,揭示音訊原生威脅。Fact2Fiction 是首個針對代理式事實核查系統的投毒攻擊框架,透過製作惡意證據破壞子聲明驗證,暴露了事實核查系統的安全弱點。此外,有研究探討透過在訓練前移除有害資料來防止 LLM 教授生物武器製造,比訓練後防禦更有效。(來源:HuggingFace Daily Papers, HuggingFace Daily Papers, QuentinAnthon15)

LLM 架構與壓縮技術 : Grove MoE 新型 MoE 架構透過不同大小的專家和動態激活機制,在較少激活參數下實現與 SOTA 模型相當的性能。MoBE 方法透過基專家混合壓縮 MoE-based LLM,顯著減少參數量同時保持低準確率下降。研究還探索了透過步熵壓縮 LLM 的思維鏈(CoT),在不顯著降低準確率下剪枝冗餘步驟。(來源:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

強化學習與 LLM 推論綜述 : 綜述了強化學習(RL)與視覺智能交叉領域,涵蓋策略優化、多模態 LLM 等。另一篇論文系統回顧了 LLM 推論中 RL 技術,透過復現和評估分析其機制、場景和原則,揭示最小化組合兩種技術可釋放無批評者策略的學習能力。(來源:HuggingFace Daily Papers, HuggingFace Daily Papers)

通用機器人策略與資料集多樣性 : 研究揭示通用機器人策略泛化能力受限的原因是「捷徑學習」,主要歸因於資料集多樣性不足和子資料集間的分布差異。研究表明資料增強可有效減少捷徑學習,提升泛化能力。(來源:HuggingFace Daily Papers)

LLM 編碼基準與新資料集 : Nebius 團隊在 SWE-rebench leaderboard 上測試了 34 個新的 GitHub PR 任務,發現 GPT-5-Medium 總體領先,Qwen3-Coder 是最佳開源模型,在 pass@5 指標上與 GPT-5-High 相當。OpenBench v0.2.0 發布,新增 17 個基準測試,涵蓋數學、推論、健康等領域。WideSearch 基準測試評估 AI 代理處理大規模重複資訊收集的能力。(來源:Reddit r/LocalLLaMA, eliebakouch, teortaxesTex)

AI 學習資源與書籍推薦 : Reddit 使用者尋求關於 AI 趨勢、新概念、創新和論文的 Podcast/YouTube 頻道推薦。此外,推薦《存取時代》、《零邊際成本社會》、《生命 3.0》和《必然》等書籍,幫助讀者理解 AI 和未來經濟社會變化,探討後稀缺時代。(來源:Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

GLM-4.5 技術報告與 RL 擴展 : GLM-4.5 論文詳細介紹了其 MoE 大語言模型,採用混合推論方法,並透過專家模型迭代、混合推論模式和基於難度的強化學習課程,在推論、編碼和代理任務上表現卓越。新論文還詳細介紹了 RL 擴展的實驗結果,包括增加多維度、課程學習和多階段訓練的益處。(來源:Reddit r/ArtificialInteligence, _lewtun, Zai_org)

其他 LLM 研究與技術 : GLiClass 模型在序列分類任務中表現出高準確性和效率,並支援零樣本和少樣本學習。SONAR-LLM 是一個僅解碼器 Transformer 模型,透過預測句子級嵌入和 token 級交叉熵監督,實現有競爭力的生成品質。Speech-to-LaTeX 發布大規模語音轉 LaTeX 資料集和模型,推動數學內容識別。Hugging Face 轉發 IndicSynth 資料集發布,一個針對 12 種低資源印度語言的大規模合成語音資料集。(來源:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, huggingface)

RL 訓練問題與修復 : vLLM 從 v0 升級到 v1 導致非同步 RL 訓練崩潰,但已成功修復,相關經驗得到分享。(來源:_lewtun, weights_biases)

RL 擴展進展 : 強化學習(RL)擴展的開放進展令人興奮,儘管訓練模型需要巨大的工程努力,但其結果不容否認。(來源:jxmnop)

AI 代理自進化系統綜述 : 綜述了自進化 AI 代理技術,提出統一概念框架(系統輸入、代理系統、環境、最佳化器),並系統回顧了針對不同組件的自進化技術,討論了評估、安全和倫理考量。(來源:HuggingFace Daily Papers)

MoE LLM 中的「超級專家」 : 討論 MoE LLM 中「超級專家」(Super Experts)的概念,指出這些稀有但關鍵的專家被剪枝會導致性能急劇下降。(來源:teortaxesTex)

資料科學概述 : 分享生成式 AI 思維導圖,概述資料科學。(來源:Ronald_vanLoon)

💼 商業

Microsoft 投資碳去除以應對 AI 能耗 : Microsoft 投資超 17 億美元與生物科技公司合作,透過深埋生物泥漿實現碳去除目標,以應對 AI 資料中心能耗和碳排放的快速增長,履行碳負排放承諾並獲得稅收減免。此舉反映 AI 發展帶來的資源消耗問題,促使大廠尋求減碳方案。(來源:36氪)

MiniMax AI Agent 挑戰賽 : MiniMax AI Agent 挑戰賽提供 15 萬美元總獎金,鼓勵開發者建構或混音 AI 代理專案,涵蓋生產力、創意、教育、娛樂等領域。挑戰賽旨在推動 AI 代理技術的創新和應用。(來源:MiniMax__AI, Reddit r/ChatGPT)

Anthropic 聘請 AI 安全主管 : Anthropic 聘請 Dave Orr 為安全主管,他曾領導 Google 將 LLM 整合到 Google Assistant 的工作。此舉表明 Anthropic 對 AI 風險防範的日益重視,反映出 AI 公司在技術發展的同時,也開始加強對潛在風險的治理。(來源:steph_palazzolo)

🌟 社群

AI 與就業及社會影響 : 研究顯示,生成式 AI 的普及導致從業者每週工作時長增加,休閒時間減少,即「AI 越普及,打工仔越忙」。AI 在廣告行業中可能導致「創意壁壘」被侵蝕,新入行者可能跳過思考環節。同時,AI 伴侶的出現引發女性使用者情感依賴,甚至有使用者與 AI 建立深厚情感關係,引發關於 AI 倫理和社會影響的討論。AI 對就業的衝擊,尤其對缺乏原始慾望和動力的新人影響最大。(來源:36氪, op7418, teortaxesTex, menhguin, scaling01, teortaxesTex)

GPT-5 使用者體驗與模型品質爭議 : GPT-5 發布後,大量使用者對其表現表示失望,認為其缺乏個性、冷漠、速度慢,且在創意寫作方面表現糟糕,不如 GPT-4o。使用者懷疑 OpenAI 為節省成本在 ChatGPT 中運行「廉價山寨版」GPT-5,並成功要求恢復 GPT-4o。有評論認為 OpenAI 的過度炒作是「失誤」,Google 有機會嚴懲 OpenAI。此外,使用者對 GPT-5 Thinking 模式的 192K 上下文長度感知不明顯。(來源:Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/artificial, Reddit r/ChatGPT, op7418, TheTuringPost)

AI 倫理與安全擔憂 : 在自由市場資本主義下,AI 可能導致企業反烏托邦,被用於收集私人資料、操縱公眾對話、控制政府,並被大公司壟斷,最終可能扭曲現實。同時,對 AI 可能獲得人權和公民身份的擔憂,以及 AI 伴侶帶來的情感依賴風險,引發了關於 AI 倫理和社會影響的討論。Yoshua Bengio 強調 AI 發展需導向更安全、有益的結果。(來源:Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, Yoshua_Bengio, teortaxesTex)

AI 發展模式與未來展望 : 將 LLM 發展比作航空業從萊特兄弟到登月的歷程,認為 AI 的「規模競賽」將讓位於最佳化和專業化階段。有觀點認為,頂級 LLM 實驗室當前的產品和商業模式限制了其 AI 研究,可能阻礙其率先實現超智能。AGI 術語的商業化和品牌化趨勢引發對其技術內涵的質疑。此外,有討論對未來 70% 互動對象是 LLM 包裝的擔憂,以及對 AI 工具過度審查和淨化的不滿。(來源:Reddit r/ArtificialInteligence, far__el, rao2z, vikhyatk, Reddit r/ChatGPT)

AI 社群文化與幽默 : AI 社群中存在對 AI 模型擬人化的討論,如「我的 AI 有意識/有感知」的觀念。也有對 Claude 記憶能力更新後使用者反應的幽默評論,以及關於 AI 研究者日常和 AI 巨頭社群媒體互動的幽默吐槽。(來源:Reddit r/ArtificialInteligence, nptacek, vikhyatk, code_star, Reddit r/ChatGPT)

AI 會議模式與學術出版挑戰 : 論文指出當前 AI 會議模式不可持續,原因包括出版量激增、碳排放、研究生命週期與會議日程不匹配、場地容量危機和心理健康問題。建議將出版與會議分離,效仿其他學術領域。(來源:Reddit r/MachineLearning)

AI 基準測試與模型評估爭議 : 對 OpenAI 更新 SWE-bench Verified 得分圖表提出質疑,指出其未運行所有測試。同時,有研究人員發現 LLM 的「模擬推論」能力是「脆弱的海市蜃樓」,擅長流暢的廢話而非邏輯推論。這些討論反映了 AI 模型評估的複雜性和挑戰。(來源:dylan522p, Reddit r/artificial)

AI 晶片政策與報導批判 : 有評論批評記者將 NVIDIA H20 描述為「先進晶片」是不專業的,指出 H20 比 B200 落後約 4 年,計算能力、記憶體頻寬和記憶體均遠低於 B200。認為向中國出售 H20 是好的政策,因為它能減緩中國國內 AI 加速器生態發展,並促進中國開源 AI 生態與美國閉源模型的差距。(來源:GavinSBaker)

使用者對 LLM 定價和算力服務的需求 : 呼籲 OpenAI/Google 提供按算力小時付費的服務,讓推論模型長時間思考問題,而非透過多次 API 呼叫模擬,認為這有助於在相同算力預算下比較模型。(來源:MParakhin)

💡 其他

AI 在金融領域的應用 : AI 驅動的金融資料分析在制定更智能策略決策中發揮重要作用,提升金融行業的分析效率和決策品質。(來源:Ronald_vanLoon, Ronald_vanLoon)

Google AI 策略與競爭 : 討論 Google 在 AI 領域的潛在大動作,有評論認為 Google 擁有 TPU 硬體優勢,在搜尋、RL 和擴散世界模型方面有更多研究,可能對 OpenAI 構成更大威脅。(來源:Reddit r/LocalLLaMA)

Hugging Face AMA 活動 : Hugging Face 執行長 Clement Delangue 預告將舉行 AMA(問我任何問題)活動,為社群提供直接交流的機會。(來源:ClementDelangue)