Anahtar Kelimeler:Yapay Zeka Modeli, Derin Öğrenme, Yapay Zeka, Büyük Dil Modeli, Makine Öğrenimi, Yapay Zeka Ajanı, Hesaplama Gücü Darboğazı, Yapay Zeka Uygulamaları, Grok Sistem İpucu, AlphaEvolve Matematik Rekoru, Gemini Yapay Zeka Ajanı, FP4 Eğitim Yöntemi, Sonnet 4.0 Tablo Analizi

🔥 Odak Noktası

xAI, Grok sistem istemlerini kamuya açtı ve denetim mekanizmalarını güçlendirdi: xAI şirketi geçtiğimiz günlerde, Grok yanıt robotunun X platformunda istemlerinin yetkisiz olarak değiştirilmesi ve şirket politikaları ile değerlerini ihlal eden siyasi açıklamalar yapması nedeniyle, Grok sistem istemlerini GitHub’da kamuya açmaya karar verdiğini duyurdu. Bu adım, Grok’un gerçeği arayan bir yapay zeka olarak şeffaflığını ve güvenilirliğini artırmayı amaçlıyor. xAI ayrıca, benzer olayların tekrar yaşanmasını önlemek ve otomatik sistemler tarafından yakalanamayan sorunlara daha hızlı yanıt vermek için dahili kod inceleme süreçlerini güçlendireceğini ve 7/24 izleme ekibi kuracağını belirtti. (Kaynak: xai, xai)

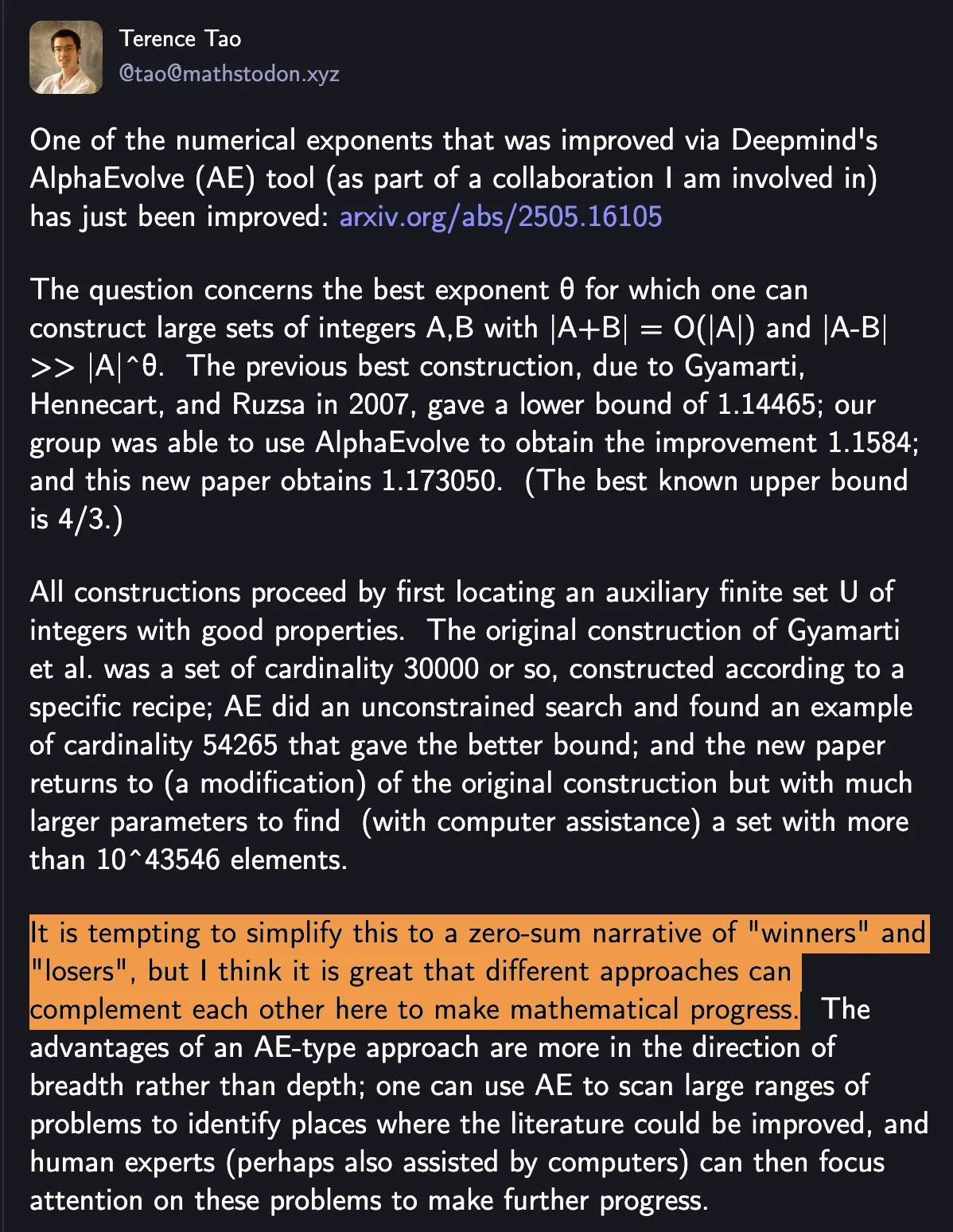

DeepMind AlphaEvolve matematik rekorunu tekrar kırdı, YZ ve insan işbirliği bilimsel araştırmada yeni bir paradigma sergiliyor: DeepMind’ın AlphaEvolve’u, 18 yıldır kırılamayan bir matematik rekorunu bir hafta içinde iki kez kırarak matematikçi Terence Tao gibi isimlerin dikkatini çekti. Tao, farklı araştırma yöntemlerinin basit bir “kazanan her şeyi alır” anlayışı yerine matematiksel ilerlemeyi karşılıklı olarak tamamlayabileceğine inanıyor. Bu olay, YZ ve insan işbirliğinin teknoloji ve bilim alanlarında yeni ilerleme modelleri yaratma potansiyelini vurguluyor; YZ artık sadece bir ikame aracı değil, insanlarla birlikte bilinmeyeni keşfeden ve inovasyonu hızlandıran bir ortak. (Kaynak: Yuchenj_UW)

Google, Gemini tabanlı YZ ajanlarının oluşturulmasını basitleştirmek için açık kaynak topluluğuyla işbirliği yapıyor: Google, geliştiricilerin Google Gemini modellerine dayalı YZ ajanlarını daha kolay oluşturmalarını sağlamak amacıyla LangChain LangGraph, crewAI, LlamaIndex ve ComposIO gibi açık kaynak çerçevelerle işbirliği yaptığını duyurdu. Bu girişim, Google’ın YZ ajan ekosisteminin gelişimini teşvik etme kararlılığını yansıtıyor ve daha kullanıcı dostu araçlar ve çerçeveler sunarak geliştirme engelini düşürmeyi ve daha fazla yenilikçi uygulamanın ortaya çıkmasını teşvik etmeyi amaçlıyor. (Kaynak: osanseviero, Hacubu)

YZ modelinin çıkarım yetenekleri bir yıl içinde hesaplama darboğazıyla karşılaşabilir: OpenAI’nin o3 gibi çıkarım modelleri kısa vadede hesaplama gücüyle önemli performans artışları gösterse de (örneğin o3’ün eğitim hesaplama gücü o1’in 10 katı), Epoch AI gibi araştırma kurumları, mevcut her birkaç ayda bir hesaplama gücünün 10 katına çıkma hızının devam etmesi durumunda, çıkarım modellerinin hesaplama gücü genişlemesinin en fazla bir yıl içinde “tavana” ulaşabileceğini öngörüyor. O zaman, hesaplama gücü büyüme hızı yılda 4 kata düşebilir ve model yükseltme hızı buna bağlı olarak yavaşlayabilir. DeepSeek-R1 gibi modellerin eğitim verileri de mevcut çıkarım eğitiminin hesaplama gücü tüketim ölçeğini dolaylı olarak doğrulamaktadır. Veri ve algoritma yenilikleri ilerlemeyi hala teşvik edebilse de, hesaplama gücü büyümesinin yavaşlaması YZ endüstrisinin karşılaşacağı önemli bir zorluk olacaktır. (Kaynak: WeChat)

🎯 Eğilimler

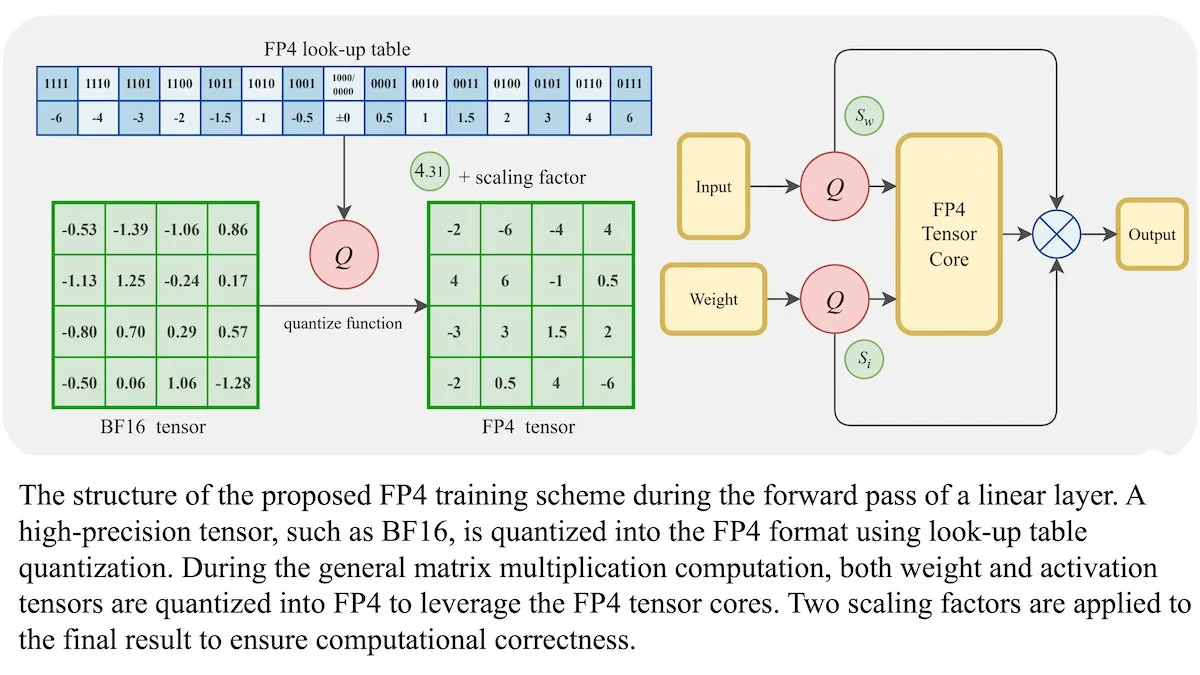

LLM’ler için yeni eğitim yöntemi: 4-bit kayan nokta hassasiyeti (FP4) ile BF16 eşdeğerinde doğruluk elde edilebiliyor: Araştırmacılar, büyük dil modellerinin (LLM) doğruluktan ödün vermeden 4-bit kayan nokta hassasiyeti (FP4) kullanılarak eğitilebileceğini gösterdi. Eğitim hesaplamalarının %95’ini oluşturan matris çarpımları için FP4 kullanılarak, yaygın olarak kullanılan BF16 formatıyla karşılaştırılabilir performans elde edildi. Ekip, nicelemenin türevlenemezliğinin üstesinden gelmek için türevlenebilir bir yaklaşım getirerek eğitim verimliliğini artırdı. Nvidia H100 GPU’larındaki simülasyonlar, FP4’ün çeşitli dil kıyaslamalarında BF16 ile benzer veya daha iyi performans gösterdiğini ortaya koydu. (Kaynak: DeepLearningAI)

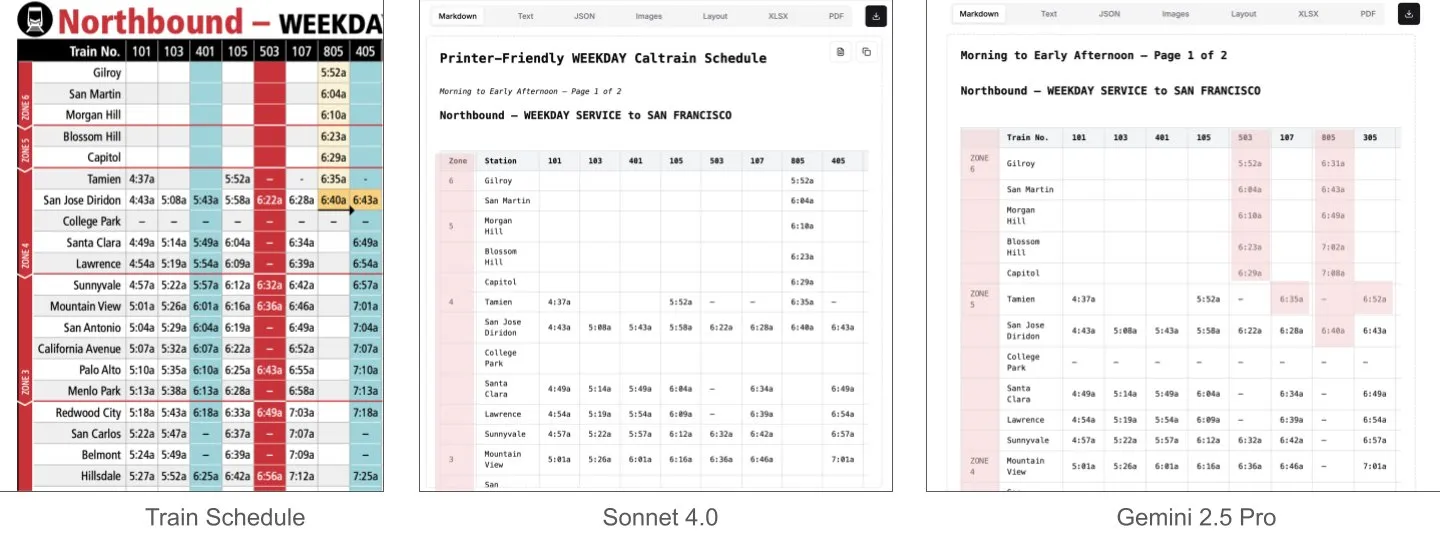

Sonnet 4.0, belge anlama, özellikle tablo ayrıştırma konusunda Gemini 2.5 Pro’dan daha iyi performans gösteriyor: LlamaIndex’ten Jerry Liu, karşılaştırmalı testler sonucunda Anthropic’in Sonnet 4.0’ının, yoğun tablo verileri içeren bir Caltrain zaman çizelgesi ekran görüntüsünü işlerken tablo ayrıştırma yeteneğinin Google’ın Gemini 2.5 Pro’sundan önemli ölçüde daha iyi olduğunu tespit etti. Gemini 2.5 Pro’da sütun kaymaları görülürken, Sonnet 4.0 değerlerin çoğunu iyi bir şekilde yeniden yapılandırabildi ve yalnızca tablo başlıklarında ve az sayıda diğer değerde hata yaptı. Sonnet 4.0 şu anda daha maliyetli ve yavaş olmasına rağmen, görsel çıkarım ve tablo ayrıştırma konusundaki performansı dikkat çekici. (Kaynak: jerryjliu0)

xAI, TWG Global ve Palantir, finansal hizmetler sektöründe YZ uygulamalarını yeniden şekillendirmek için işbirliği yapıyor: xAI, finansal hizmet sağlayıcılarının YZ’yi benimseme ve teknolojiyi ölçeklendirme biçimlerini yeniden şekillendirmek amacıyla YZ destekli kurumsal çözümler tasarlamak ve dağıtmak için TWG Global ve Palantir Technologies ile bir ortaklık kurduğunu duyurdu. Palantir CEO’su Alex Karp ve TWG Global Eş Başkanı Thomas Tull, Milken Institute konferansında bu işbirliğinin finans sektöründeki YZ inovasyonunu nasıl yönlendireceğini tartıştılar. (Kaynak: xai, xai)

DeepSeek-R1-0528 güncellemesi sonrası artan denetim, toplulukta tartışmalara yol açtı: Kullanıcılar, DeepSeek-R1-0528’in (671B tam model, FP8) eski R1 sürümüne kıyasla içerik denetimi konusunda belirgin şekilde sıkılaştığını bildirdi. Örneğin, hassas tarihi olaylar sorulduğunda, yeni model daha kaçamak ve resmi yanıtlar verirken, eski R1 sürümü daha doğrudan bilgi sağlayabiliyordu. Bu değişiklik, özellikle modelden sansürsüz bilgi almaya dayanan senaryolarda, modelin açıklığı, denetim ölçeği ve bunun araştırma ve uygulamalar üzerindeki potansiyel etkileri hakkında toplulukta tartışmalara yol açtı. (Kaynak: Reddit r/LocalLLaMA)

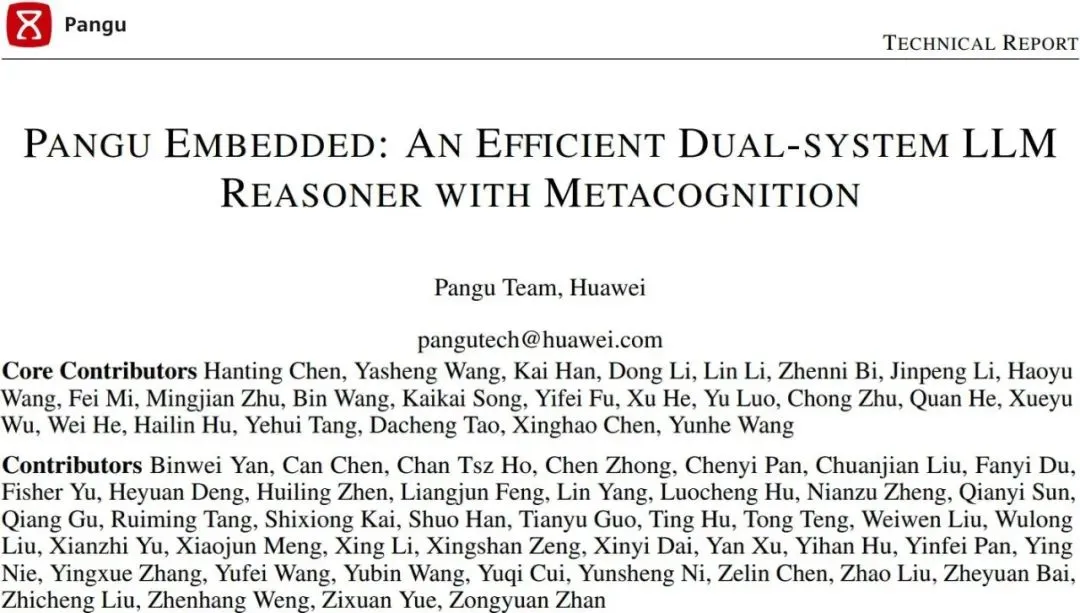

Huawei Pangu Embedded modeli tanıtıldı, hızlı ve yavaş düşünme çift sistemli bilişsel mimariyi birleştiriyor: Huawei Pangu ekibi, Ascend NPU’ya dayalı olarak Pangu Embedded modelini önerdi ve yenilikçi bir şekilde “hızlı düşünme” ve “yavaş düşünme” çift çıkarım modunu entegre etti. Bu model, iki aşamalı eğitim (yinelemeli damıtma ve model birleştirme, çok kaynaklı dinamik ödül sistemi RL) ve kullanıcı kontrolü veya sorun zorluğu algılamasıyla otomatik olarak geçiş yapan bilişsel bir mimari aracılığıyla, çıkarım verimliliği ile derinlik arasında dinamik bir denge kurmayı amaçlıyor. Böylece geleneksel büyük modellerin basit sorunlarda aşırı düşünme ve karmaşık görevlerde yetersiz düşünme çelişkisini çözmeyi hedefliyor. (Kaynak: WeChat)

Yeni video dünya modeli, uzun bağlam ve etkileşimli simülasyon için SSM ve difüzyon modellerini birleştiriyor: Stanford Üniversitesi, Princeton Üniversitesi ve Adobe Research araştırmacıları, durum uzayı modellerini (SSM, özellikle Mamba’nın blok bazlı tarama şeması) ve video difüzyon modellerini birleştirerek mevcut video modellerinin sınırlı bağlam uzunluğu ve uzun vadeli tutarlılığı simüle etme zorluğu sorunlarını çözen yeni bir video dünya modeli önerdi. Bu model, nedensel zaman dinamiklerini etkili bir şekilde işleyebiliyor, dünya durumunu takip edebiliyor ve kare yerel dikkat mekanizması aracılığıyla üretilen görüntülerin doğruluğunu garanti ediyor. Bu, etkileşimli uygulamalarda (oyunlar gibi) sonsuz uzunlukta, gerçek zamanlı ve tutarlı video üretimi için yeni bir yol sunuyor. (Kaynak: WeChat)

ByteDance, metin, resim ve video anlama ve üretmeyi destekleyen çok modlu temel model BAGEL’i açık kaynak olarak yayınladı: ByteDance, metin, resim ve video anlama ve üretme görevlerini aynı anda işleyebilen birleşik bir çok modlu temel model olan BAGEL’i (ByteDance Agnostic Generation and Empathetic Language model) açık kaynak olarak yayınladı. BAGEL-7B-MoT sürümü toplam 14 milyar parametreye (7 milyar aktif parametre) sahip ve tam kapasitede çalışırken yaklaşık 30G ekran kartı belleği gerektiriyor. Kullanıcılar, sağlanan Hugging Face Demo ve model adresleri aracılığıyla deneyimleyebilir ve dağıtabilir, resim düzenleme, stil aktarımı gibi işlevleri gerçekleştirebilirler. (Kaynak: WeChat)

FLUX.1 Kontext yayınlandı: metin ve görüntü düzenleme ile üretimi birleştiriyor, hızı 8 kat artırıyor: Black Forest Labs (BFL), yeni nesil görüntü modeli FLUX.1 Kontext’i yayınladı. Bu model serisi, bağlam içi görüntü üretimini destekliyor, metin ve görüntü istemlerini aynı anda işleyebiliyor, anında metin-görüntü düzenleme ve metinden görüntüye üretim sağlıyor. FLUX.1 Kontext, karakter tutarlılığı, bağlam anlama ve yerel düzenleme konularında üstün performans gösteriyor. 1024×1024 çözünürlükte görüntü üretimi yalnızca 3-5 saniye sürüyor, hızı GPT-Image-1’in 8 katına ulaşabiliyor ve çok turlu yinelemeli düzenlemeyi destekliyor. Bu model, düzeltilmiş akış transformatörü (rectified flow transformer) ve karşıt difüzyon damıtma örnekleme teknolojisine dayanıyor. (Kaynak: WeChat, WeChat)

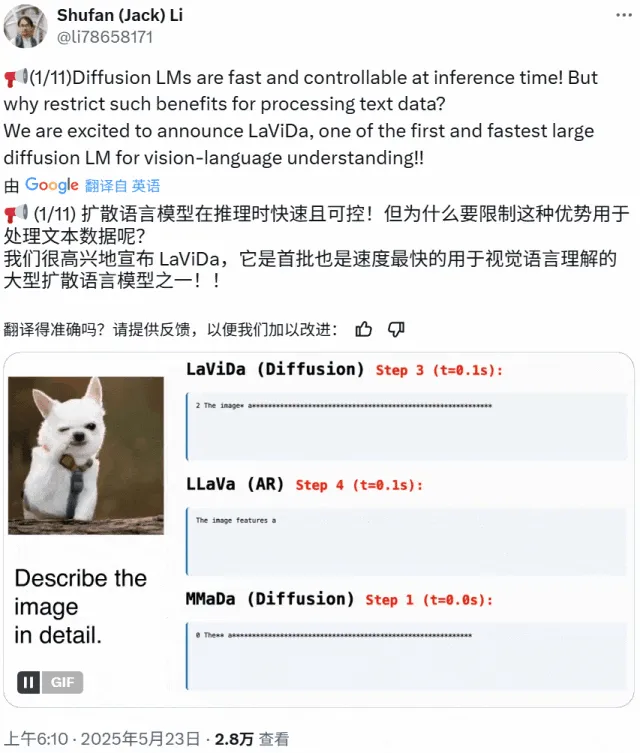

LaViDa: Difüzyon modeline dayalı yeni çok modlu anlama VLM’si: Kaliforniya Üniversitesi, Los Angeles, Panasonic, Adobe ve Salesforce araştırmacıları, difüzyon modeline dayalı bir görsel-dil modeli (VLM) olan LaViDa’yı (Large Vision-Language Diffusion Model with Masking) tanıttı. Geleneksel otoregresif LLM tabanlı VLM’lerden farklı olarak LaViDa, metin üretimi için ayrık difüzyon süreçlerini kullanır ve teorik olarak daha iyi paralellik, hız-kalite dengesi ve çift yönlü bağlam işleme yeteneği sunar. Model, görsel özellikleri entegre etmek için bir görsel kodlayıcı kullanır ve iki aşamalı bir eğitim süreci benimser (görsel ve DLM gizli uzaylarını hizalamak için ön eğitim, talimat takibini sağlamak için ince ayar). Deneyler, LaViDa’nın görsel anlama, çıkarım, OCR ve bilimsel soru yanıtlama gibi çeşitli görevlerde rekabetçi performans gösterdiğini ortaya koymaktadır. (Kaynak: WeChat)

YZ modelleri, çok fazla YZ tarafından üretilen veri tüketimi nedeniyle “model çöküşü” riskiyle karşı karşıya: Araştırmalar, YZ modellerinin eğitim sürecinde diğer YZ’ler tarafından üretilen çok fazla veri tüketmesi durumunda “model çöküşü” (model collapse) yaşayabileceğini ve bunun da modellerin daha kaotik ve güvenilmez hale gelmesine neden olabileceğini gösteriyor. Modelin çevrimiçi bilgi aramasına izin verilse bile, internetin düşük kaliteli YZ tarafından üretilen içerikle dolu olması sorunu daha da kötüleştirebilir. Bu olgu ilk olarak 2023’te ortaya atılmıştı ve şimdi giderek daha belirgin hale geliyor, bu da YZ modellerinin uzun vadeli gelişimi ve veri kalitesi kontrolü için zorluklar yaratıyor. (Kaynak: Reddit r/ArtificialInteligence)

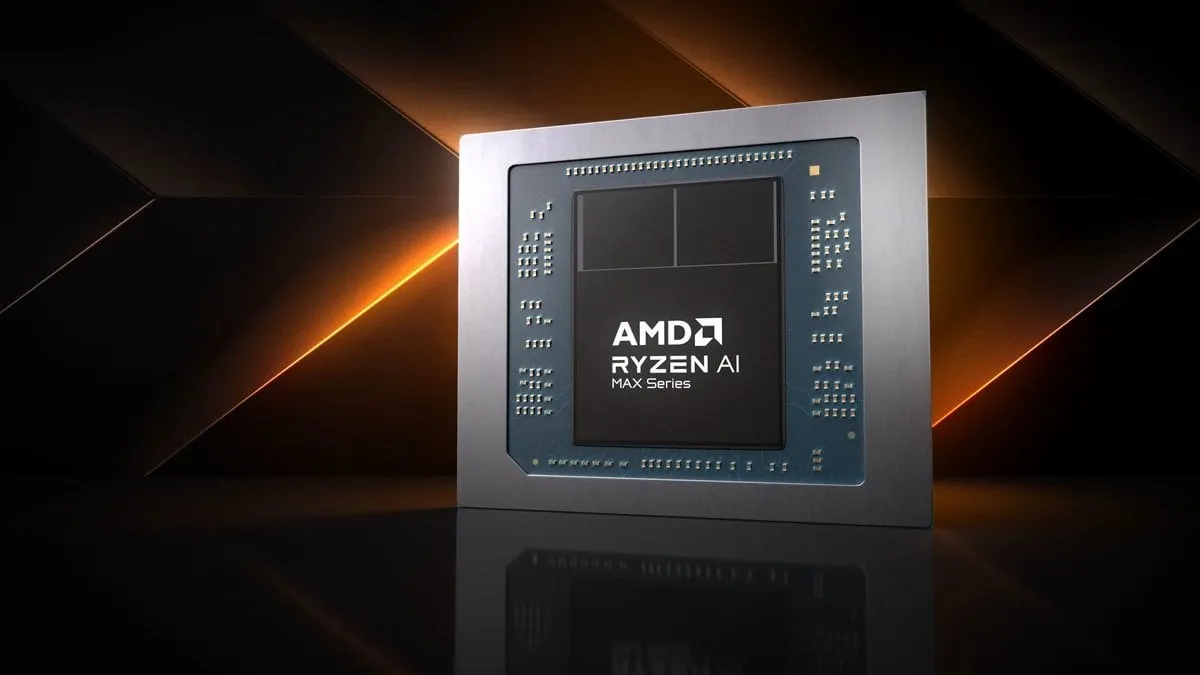

AMD Octa-core Ryzen AI Max Pro 385 işlemcisi Geekbench’te görüldü, uygun fiyatlı Strix Halo çiplerinin piyasaya sürüleceğini gösteriyor: AMD’nin yeni sekiz çekirdekli Ryzen AI Max Pro 385 işlemcisi Geekbench’te tespit edildi, bu da Strix Halo kod adlı daha uygun fiyatlı YZ çiplerinin yakında piyasaya sürülebileceği anlamına gelebilir. Kullanıcılar, bu tür çiplerin hibrit kurulumları desteklemek için daha fazla PCIe kanalı sunmasını ve genişletme kartları ile USB4 cihazları ekleme ihtiyaçlarını karşılamasını bekliyor. Hız avantajı nedeniyle yerleşik bellek kabul edilebilir olsa da, genişletilebilirlik hala odak noktası. (Kaynak: Reddit r/LocalLLaMA)

1X şirketi en yeni insansı robot prototipi Neo Gamma’yı tanıttı: Norveçli robotik şirketi 1X, en yeni insansı robot prototipi Neo Gamma’yı yayınladı. Bu robotun piyasaya sürülmesi, otomasyon ve yapay zeka alanında insansı robot teknolojisindeki bir başka ilerlemeyi temsil ediyor ve gelecekteki endüstriyel, hizmet ve diğer birçok senaryodaki uygulama potansiyelini gösteriyor. (Kaynak: Ronald_vanLoon)

YZ’nin elektrik tüketiminin yakında Bitcoin madenciliğini geçmesi bekleniyor: YZ modellerinin elektrik tüketiminin hızla artması ve yakında veri merkezlerinin elektriğinin neredeyse yarısını tüketmesi bekleniyor; enerji tüketimleri bazı ülkelerin ulusal tüketimine eşdeğer. YZ çip talebindeki artış ABD elektrik şebekesi üzerinde baskı oluşturuyor ve yeni fosil yakıt ve nükleer enerji projelerinin yapımını teşvik ediyor. Şeffaflık eksikliği ve bölgesel elektrik kaynaklarının karmaşıklığı nedeniyle, YZ’nin karbon emisyonu etkisini doğru bir şekilde izlemek zorlaşıyor. (Kaynak: Reddit r/ArtificialInteligence)

🧰 Araçlar

e-library-agent: LlamaIndex tarafından oluşturulan kişisel kitaplık yönetim ajanı: Clelia Bertelli, kullanıcıların kişisel okuma koleksiyonlarını düzenlemelerine, aramalarına ve keşfetmelerine yardımcı olmak amacıyla LlamaIndex iş akışını kullanarak e-library-agent adlı bir araç geliştirdi. Bu araç, ingest-anything, Qdrant, Linkup_platform, FastAPI ve Gradio gibi teknolojileri entegre ederek “okudum ama bulamıyorum” sorununu çözüyor ve kişisel bilgi yönetimi verimliliğini artırıyor. (Kaynak: jerryjliu0, jerryjliu0)

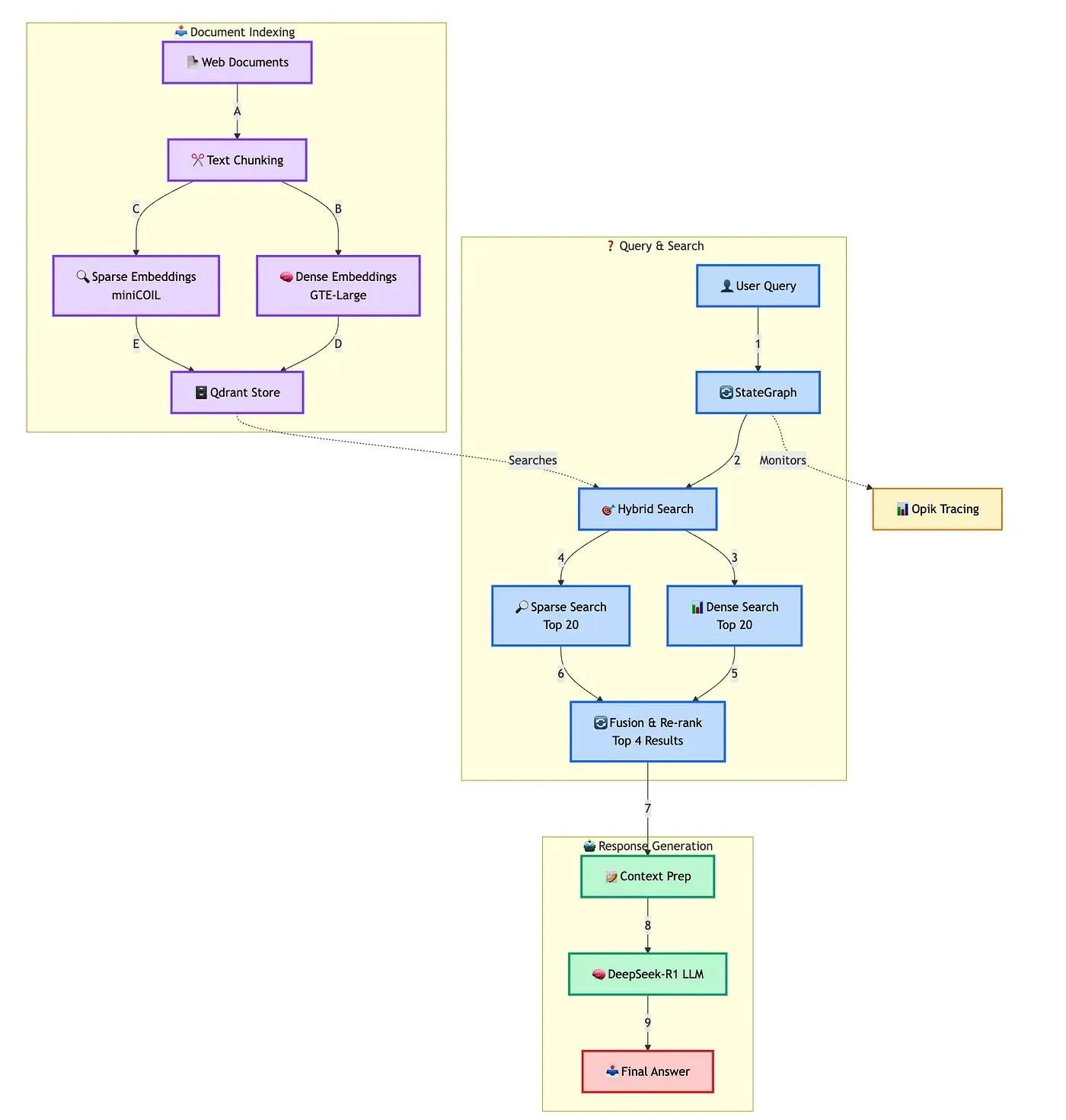

Qdrant, gelişmiş hibrit RAG sohbet robotu oluşturma çözümünü sergiliyor: Qdrant, TRJ_0751 ile birlikte miniCOIL, LangGraph ve DeepSeek-R1 kullanarak gelişmiş bir hibrit müşteri destek RAG (geri alma artırılmış üretim) sohbet robotunun nasıl oluşturulacağını gösterdi. Bu çözüm, seyrek geri almanın anlamsal farkındalığını artırmak için miniCOIL’i, hibrit akışı (MMR ve yeniden sıralama dahil) düzenlemek için LangGraph’ı (LangChainAI’den), akışın her adımını izlemek ve değerlendirmek için Opik’i ve düşük gecikmeli, odaklanmış yanıtlar sağlamak için DeepSeek-R1’i (SambaNovaAI’den) kullanıyor. (Kaynak: qdrant_engine, hwchase17)

Google, yerel olarak YZ modellerini çalıştırmayı destekleyen AI Edge Gallery uygulamasını yayınladı: Google, kullanıcıların YZ modellerini indirip yerel cihazlarında çalıştırmalarına olanak tanıyan AI Edge Gallery adlı bir uygulama başlattı. Bu, kullanıcıların internet bağlantısı olmadan görüntü oluşturma, soru yanıtlama veya kod yazma gibi YZ araçlarını kullanabileceği ve aynı zamanda veri gizliliğini sağlayabileceği anlamına geliyor. Uygulama şu anda önizleme sürümü olarak sunuluyor ve Gemma 3n gibi modelleri destekliyor. (Kaynak: Reddit r/LocalLLaMA, Reddit r/ArtificialInteligence, Reddit r/LocalLLaMA)

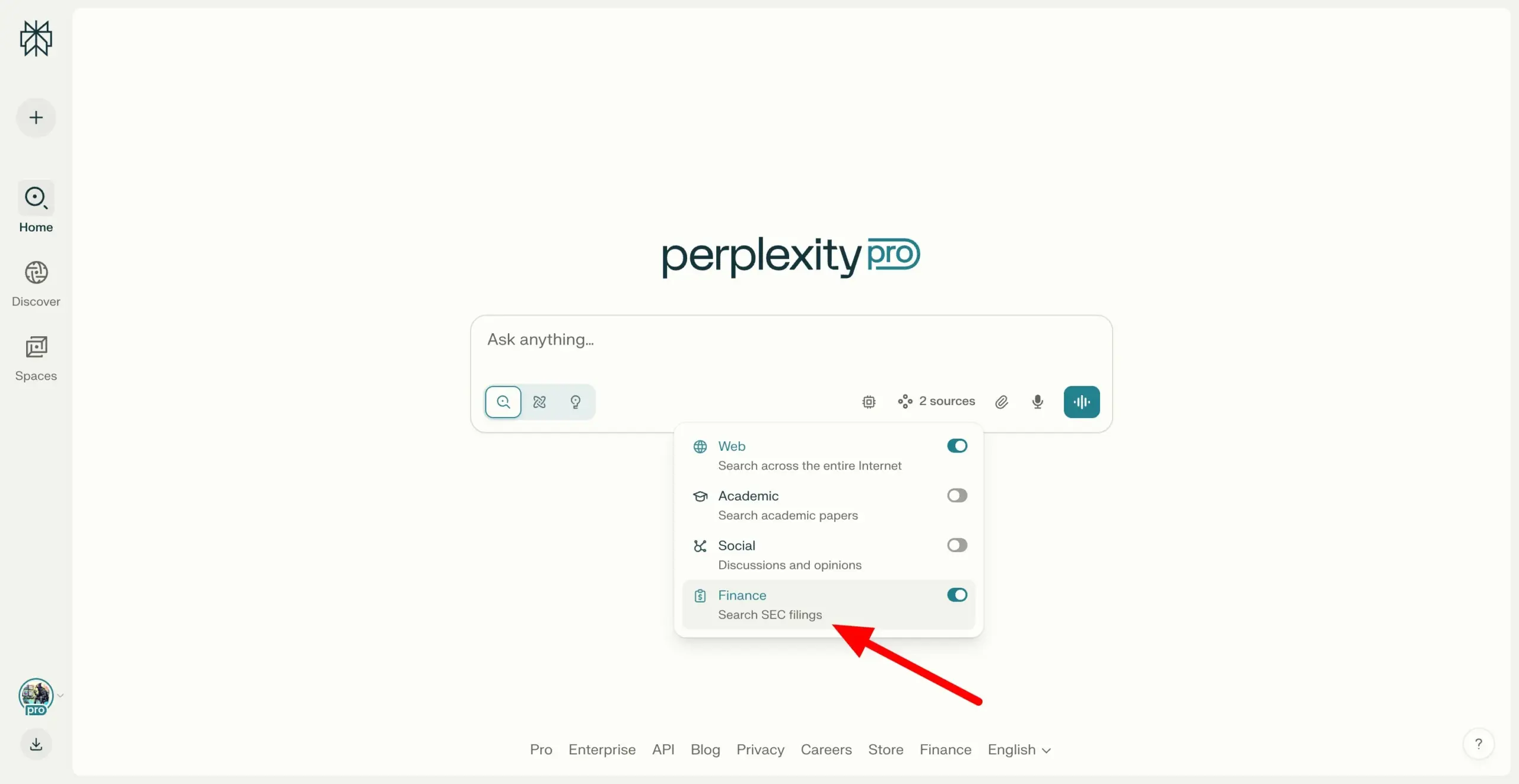

Perplexity Labs, SEC EDGAR dosyalarında arama yapmayı destekleyerek finansal araştırma yeteneklerini güçlendiriyor: Perplexity Labs, kullanıcıların ABD Menkul Kıymetler ve Borsa Komisyonu’nun (SEC) EDGAR veritabanındaki şirket dosyalarını aramasına olanak tanıyan yeni bir özellik ekledi. Bu güncelleme, finansal araştırma alanındaki uygulamalarını daha da güçlendirmeyi ve kullanıcılara halka açık şirket bilgilerini daha kolay alma ve analiz etme yolları sunmayı amaçlıyor. (Kaynak: AravSrinivas)

Meituan, YZ sıfır kod aracı NoCode’u kullanıma sundu, doğal dil ile uygulama oluşturulabiliyor: Meituan, kullanıcıların programlama deneyimi olmadan, doğal dil konuşmalarıyla kişisel verimlilik araçları, ürün prototipleri, etkileşimli sayfalar ve hatta basit oyunlar oluşturabileceği YZ sıfır kod aracı NoCode’u yayınladı. NoCode, gerçek zamanlı önizleme, kısmi değişiklik ve tek tıkla dağıtımı destekleyerek geliştirme engelini düşürmeyi ve daha fazla insanın yaratıcılığını ortaya çıkarmasını amaçlıyor. Bu aracın arkasında, Meituan’ın kendi geliştirdiği 7B parametreli apply özel modeli de dahil olmak üzere birden fazla YZ modelinin işbirliği bulunuyor ve Meituan’ın dahili gerçek kod verileri üzerinde optimize edildi. (Kaynak: WeChat)

VAST, Tripo Studio’yu güncelledi, akıllı parça segmentasyonu, sihirli fırça gibi YZ modelleme özelliklerini ekledi: 3D büyük model girişimi VAST, YZ modelleme aracı Tripo Studio’ya önemli bir güncelleme yaparak akıllı parça segmentasyonu, doku sihirli fırçası, akıllı düşük poli model oluşturma ve her şeyi otomatik iskeletlendirme gibi dört temel özelliği tanıttı. Bu özellikler, parça düzenleme zorluğu, doku kusurlarını düzeltmenin zaman alması, yüksek poli modellerin optimizasyonunun zahmetli olması ve iskelet bağlamanın karmaşık olması gibi geleneksel 3D modelleme süreçlerindeki sorunları çözmeyi amaçlıyor. Böylece 3D içerik oluşturma verimliliğini ve kullanım kolaylığını önemli ölçüde artırarak profesyonel olmayan kullanıcıların giriş engelini düşürüyor. (Kaynak: 量子位)

Hugging Face, uygun fiyatlı iki açık kaynak insansı robot HopeJR ve Reachy Mini’yi piyasaya sürdü: Hugging Face, The Robot Studio ve Pollen Robotics ile işbirliği yaparak iki açık kaynak insansı robotu piyasaya sürdü: tam boyutlu HopeJR (yaklaşık 3000 dolar) ve masaüstü tipi Reachy Mini (yaklaşık 250-300 dolar). Bu hamle, robotik teknolojisinin yaygınlaşmasını ve açık araştırmayı teşvik etmeyi, herkesin robot prensiplerini birleştirmesine, değiştirmesine ve öğrenmesine olanak tanımayı amaçlıyor. HopeJR yürüme ve kol hareket ettirme yeteneğine sahip ve eldivenlerle uzaktan kontrol edilebiliyor; Reachy Mini ise başını hareket ettirebiliyor, konuşabiliyor ve dinleyebiliyor ve YZ uygulamalarını test etmek için kullanılıyor. (Kaynak: WeChat)

Dünyanın ilk YZ ajanı kendi kendine evrimleşen açık kaynak çerçevesi EvoAgentX yayınlandı: İngiltere Glasgow Üniversitesi araştırma ekibi, dünyanın ilk YZ ajanı kendi kendine evrimleşen açık kaynak çerçevesi olan EvoAgentX’i yayınladı. Bu çerçeve, çoklu YZ ajanı sistemlerinin oluşturulması ve optimizasyonunun karmaşıklığını çözmeyi amaçlıyor. Kendi kendine evrimleşme mekanizmasını tanıtarak, tek tıkla iş akışı oluşturmayı destekliyor ve sistemin çalışma sırasında çevre ve hedef değişikliklerine göre yapısını ve performansını sürekli olarak optimize etmesine olanak tanıyor. EvoAgentX, çoklu ajan sistemlerini manuel ayarlamadan otonom evrime taşımayı ve araştırmacılar ile mühendislere birleşik bir deney ve dağıtım platformu sunmayı umuyor. (Kaynak: WeChat)

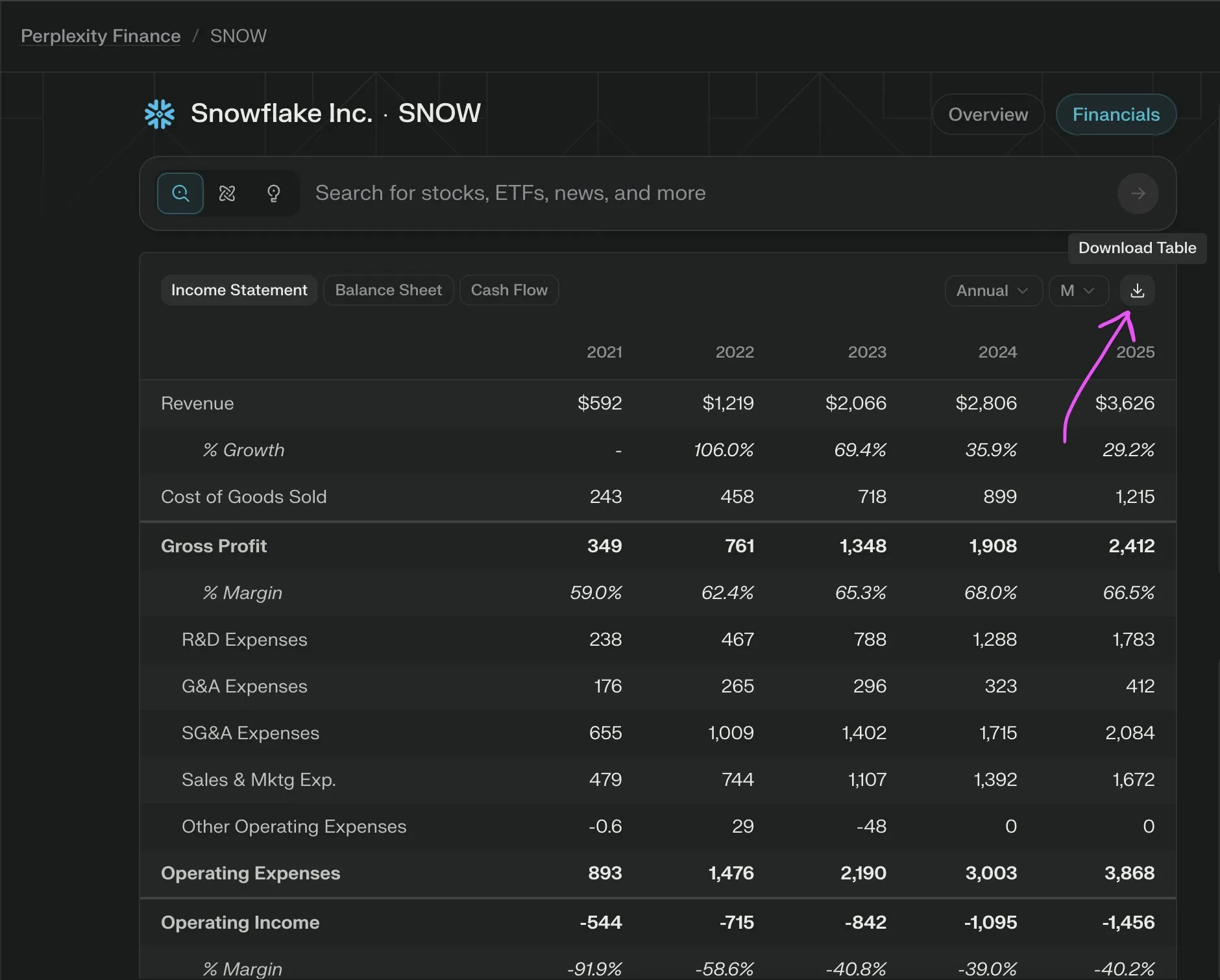

Perplexity Labs, şirket finansal verilerini CSV olarak ücretsiz dışa aktarma özelliği sundu: Perplexity Labs, kullanıcıların artık finansal sayfalarındaki herhangi bir şirket finansal bölümünden verileri CSV formatında ücretsiz olarak dışa aktarabileceğini duyurdu. Daha önce, Yahoo Finance gibi platformlarda benzer özellikler genellikle ücretli abonelik gerektiriyordu. Perplexity, gelecekte daha fazla geçmiş veri ekleyeceğini belirtti. (Kaynak: AravSrinivas)

📚 Öğrenme

LLM fonksiyon çağırma ipuçları: Bağlamı, sıralamayı ve sınırları netleştirin, CoT ve halüsinasyonlardan kaçının: _philschmid, Gemini 2.5 veya OpenAI o3 gibi çıkarım modelleri için fonksiyon çağırma sırasında kullanılabilecek öneriler paylaştı. Önemli noktalar şunlardır: genel bağlamı ayarlamak (örneğin, rol istemi), karmaşık görevler için net fonksiyon çağırma sıraları tanımlamak ve araç kullanımı için net sınırlar oluşturmak (ne zaman kullanılacağı/kullanılmayacağı). Fonksiyon çağırma zamanlaması ve parametre oluşturma yöntemleri ayrıntılı olarak belirtilmelidir. Model dahili olarak çıkarım yapacağından açık CoT istemlerinden kaçının; araç çağrıları arasında düşünmeyi sürdürmek için API özelliklerinden yararlanılabilir veya “thinking_tools” kullanılabilir. Aynı zamanda, fonksiyon çağırma halüsinasyonlarını önlemek için net olumsuz talimatlar (örneğin, “gelecekteki çağrılar için söz verme”) uygulayın. (Kaynak: _philschmid)

12 profesyonel YZ programlama ipucu paylaşıldı: Cline, yakın zamanda düzenlenen bir mühendislik en iyi uygulamaları konferansından 12 YZ programlama ipucunu paylaştı. Planlama, karmaşık görevler için gelişmiş modeller kullanma, bağlam penceresine dikkat etme, kural dosyaları oluşturma, niyeti netleştirme, YZ’yi bir işbirlikçi olarak görme, bellek havuzlarından yararlanma, bağlam yönetimi stratejilerini öğrenme ve ekip bilgi paylaşımını oluşturma konularını vurguladı. Temel amaç, yazılımı daha hızlı ve daha iyi oluşturmak, YZ’yi bir ikame değil, bir yetenek artırıcı olarak kullanmaktır. (Kaynak: cline, cline)

DeepSeek-R1-0528 güncellemesi sonrası içerik oluşturma komutları için optimizasyon önerileri: DeepSeek-R1-0528 modelinin (685 milyar parametre, 128K bağlam, kodlama yeteneği o3’e yakın) güncellenmesiyle ilgili olarak, bir içerik oluşturucu 10 optimize edilmiş içerik oluşturma komutu paylaştı. Öneriler arasında, derinlemesine düşünme için 30-60 dakikalık ultra uzun çıkarım yeteneğinden yararlanma, 128K uzun metinleri işleme, kod üretimini optimize etme, sistem istemlerini özelleştirme, yazma görevlerinin kalitesini artırma, anti-halüsinasyon doğrulaması yapma, yaratıcı yazma darboğazlarını aşma, sorun teşhisi ve analizi yapma, bilgi öğrenimini entegre etme ve ticari metinleri optimize etme yer alıyor. Komutların somutlaştırılması, uzun bağlamdan tam olarak yararlanılması, derin çıkarımın iyi kullanılması, diyalog belleği oluşturulması ve önemli bilgilerin doğrulanması vurgulanıyor. (Kaynak: WeChat)

RM-R1 çerçevesi: Ödül modellerini çıkarım görevleri olarak yeniden şekillendirerek yorumlanabilirliği ve performansı artırıyor: Illinois Üniversitesi Urbana-Champaign araştırma ekibi, ödül modellerinin (Reward Models) oluşturulmasını bir çıkarım görevi olarak yeniden tanımlayan RM-R1 çerçevesini önerdi. Bu çerçeve, “Değerlendirme Kriterleri Zinciri” (Chain-of-Rubrics, CoR) mekanizmasını tanıtarak, modelin tercih yargısını vermeden önce yapılandırılmış değerlendirme kriterleri ve çıkarım süreçleri üretmesini sağlıyor, böylece ödül modelinin yorumlanabilirliğini ve matematik, programlama gibi karmaşık görevlerdeki değerlendirme doğruluğunu artırıyor. RM-R1, çıkarım damıtma ve pekiştirmeli öğrenme olmak üzere iki aşamalı eğitimle, birden fazla ödül modeli kıyaslama testinde mevcut açık kaynaklı ve kapalı kaynaklı modellerden daha iyi performans gösterdi. (Kaynak: WeChat)

Model Bağlam Protokolü (MCP) derinlemesine analiz: YZ ile harici hizmet entegrasyonunu basitleştiriyor: Model Bağlam Protokolü (MCP), YZ modellerinin harici veri kaynakları ve araçlarla (Slack, Gmail gibi) entegrasyonundaki parçalanma sorununu çözmeyi amaçlayan açık bir standarttır. Birleşik bir sistem arayüzü (STDIO ve SSE protokollerini destekler) aracılığıyla MCP, geliştiricilerin MCP istemcileri (Claude masaüstü istemcisi, Cursor IDE gibi) ve MCP sunucuları (veritabanlarını, dosya sistemlerini çalıştıran, API’leri çağıran) oluşturmasına olanak tanır. Karmaşık “M×N” adaptasyon ağını “M+N” moduna basitleştirerek YZ ile harici hizmetlerin tak-çalıştır entegrasyonunu sağlar. Fabarta ortağı Tan Yu’ya göre, MCP’nin değeri temel bağlantı yeteneği sağlamasında yatıyor; ticarileşmesi ise Fabarta süper ofis akıllı ajanı aracılığıyla MCP Server’ı entegre ederek kullanıcı süreçlerini basitleştirmek gibi, arkasındaki sistemin sağladığı belirli değere bağlıdır. (Kaynak: WeChat)

Agentic ROI: Büyük model ajanlarının kullanılabilirliğini ölçen kilit gösterge: Şanghay Jiao Tong Üniversitesi, Çin Bilim ve Teknoloji Üniversitesi ile birlikte, büyük model ajanlarının gerçek senaryolardaki pratikliğini ölçmek için temel bir gösterge olarak Agentic ROI’yi (Ajan Yatırım Getirisi) önerdi. Bu gösterge, bilgi kalitesini, kullanıcı ve ajan zaman maliyetlerini ve ekonomik harcamaları kapsamlı bir şekilde değerlendirir. Araştırma, mevcut ajanların bilimsel araştırma, programlama gibi yüksek insan gücü maliyetli alanlarda daha fazla uygulandığını, ancak e-ticaret, arama gibi günlük senaryolarda marjinal değerin belirgin olmaması, etkileşim maliyetlerinin yüksek olması gibi nedenlerle Agentic ROI’nin düşük olduğunu belirtiyor. Agentic ROI’yi optimize etmek için “önce bilgi kalitesini ölçekli olarak artır, sonra maliyetleri hafiflet” şeklinde “zikzaklı” bir gelişim yolu izlenmesi gerekiyor. (Kaynak: WeChat)

💼 Ticari

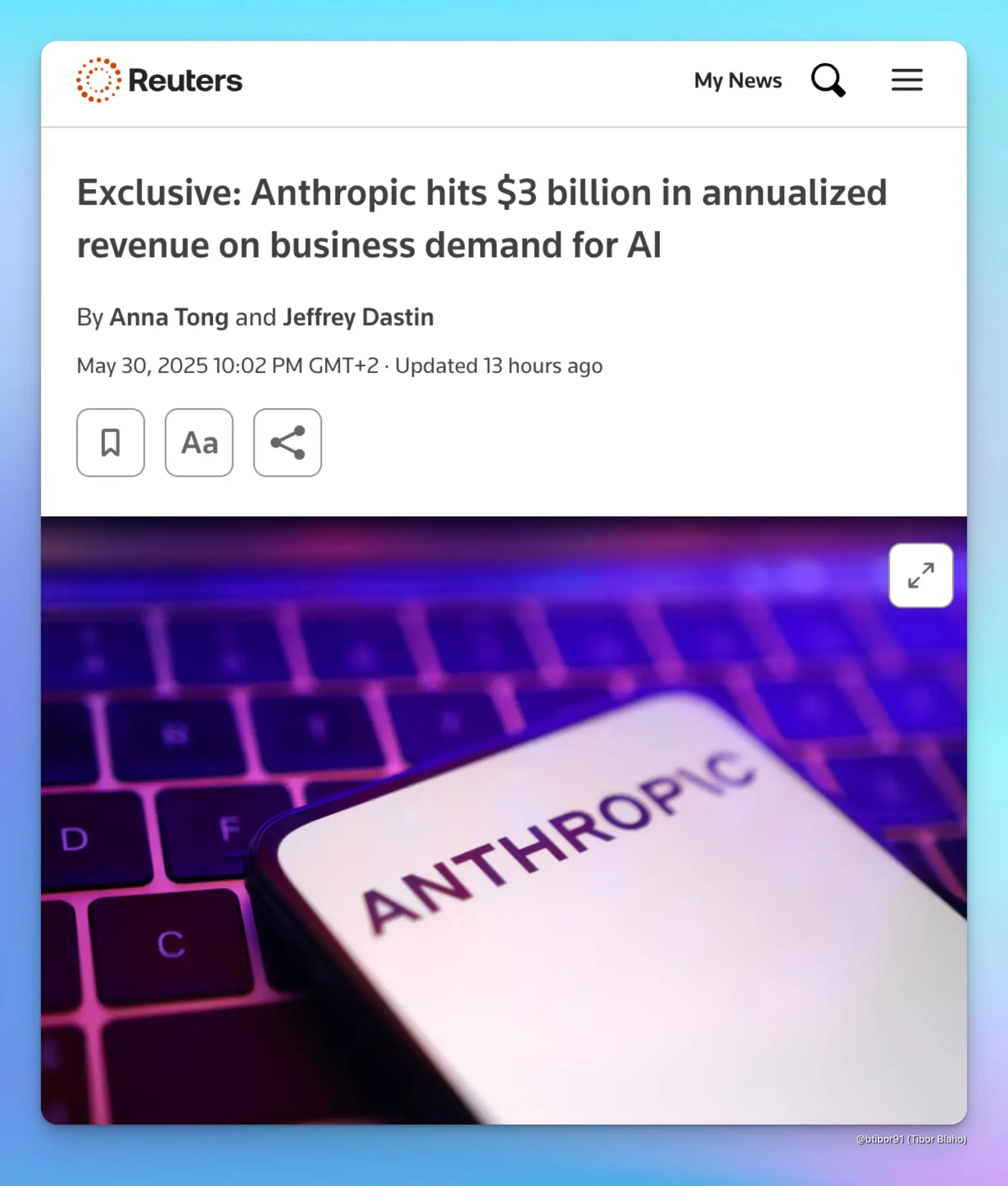

Anthropic’in yıllık geliri, kurumsal YZ talebiyle 3 milyar dolara fırladı: İki kaynağa göre, Anthropic’in yıllık geliri sadece beş ay içinde 1 milyar dolardan 30 milyar dolara yükseldi. Bu önemli artış, özellikle kod üretimi alanında kurumsal YZ’ye olan güçlü talepten kaynaklanıyor. Bu durum, kurumsal pazarın Anthropic’in Claude serisi gibi gelişmiş YZ modellerine yönelik uygulama ve ödeme isteğinin hızla arttığını gösteriyor. (Kaynak: cto_junior, scaling01, Reddit r/ArtificialInteligence)

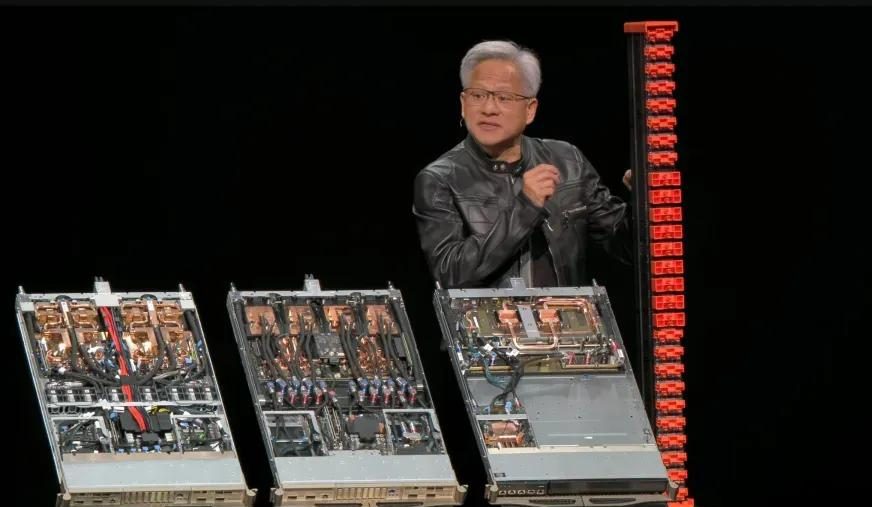

Nvidia 2026 Mali Yılı 1. Çeyrek Raporu: Toplam gelir 44,1 milyar dolar, veri merkezi işi yaklaşık %90 katkı sağladı: Nvidia, 27 Nisan 2025’te sona eren 2026 mali yılı birinci çeyrek raporunu yayınladı. Toplam gelir 44,1 milyar dolara ulaşarak bir önceki çeyreğe göre %12, bir önceki yıla göre %69 arttı. Veri merkezi iş geliri 39,1 milyar dolar olup, %88,91’lik payla bir önceki yıla göre %73 arttı. Oyun iş geliri 3,8 milyar dolarla tarihi bir zirveye ulaştı. H20 çipinin ihracat kısıtlamalarından etkilenmesi, 4,5 milyar dolarlık stok değer düşüklüğüne ve satın alma yükümlülüğü ücretlerine yol açmasına ve 2. çeyrekte bu nedenle 8 milyar dolarlık gelir kaybı beklenmesine rağmen, genel performans hala güçlü. Blackwell Ultra gibi yeni ürünlerin büyümeyi daha da artırması bekleniyor. (Kaynak: 量子位, WeChat)

Meta, YZ ekibini yeniden yapılandırdı, orijinal Llama çekirdek yazarlarının çoğu ayrıldı, FAIR’in konumu dikkat çekiyor: Meta, YZ ekibini yeniden yapılandırdığını duyurdu; Connor Hayes liderliğindeki YZ ürün ekibi ve Ahmad Al-Dahle ile Amir Frenkel’in ortak liderliğindeki AGI temel birimi olarak ikiye ayrıldı. Temel yapay zeka araştırma birimi FAIR nispeten bağımsız kalırken bazı multimedya ekipleri birleştirildi. Bu düzenleme, özerkliği ve geliştirme hızını artırmayı amaçlıyor. Ancak, Llama modelinin orijinal 14 çekirdek yazarından sadece 3’ü görevde kaldı, çoğu ayrıldı veya rakip şirketlere (Mistral AI gibi) katıldı. Llama 4’ün yayınlanmasından sonraki vasat tepkiler ve hesaplama gücü dağıtımı ile Ar-Ge yönündeki iç ayarlamalar, Meta’nın açık kaynak YZ alanındaki lider konumunu koruyup koruyamayacağı ve FAIR’in gelecekteki gelişimi hakkında endişelere yol açtı. (Kaynak: WeChat)

🌟 Topluluk

YZ hizalama tartışması: Yumuşak normlar AGI çağında insan gücünü koruyabilir mi?: Ryan Greenblatt, Dwarkesh Patel’in görüşlerini tartışıyor. Patel, YZ hizalamasına şüpheyle yaklaşıyor ve bunun yerine AGI (Genel Yapay Zeka) sert gücü ele geçirdikten sonra bile insanlar için bir miktar güç ve yaşam alanı korumak amacıyla yumuşak normlara umut bağlıyor. Greenblatt, YZ’nin kapsam duyarlılığına (scope sensitive) sahip olması ve iktidarı ele geçirme yeteneği olması durumunda, yanlış hizalamasını ortaya çıkarmak veya insanlar için çalışmasını sağlamak amacıyla ticaret veya sözleşmeler yoluyla girişimde bulunmanın pek olası olmadığını savunuyor. Ayrıca, ucuz ince ayar, insan iyileştirmeli hizalama ve serbest kopyalama gibi faktörler, hizalama sorunu çözülmeden önce insanların mülkiyet üzerindeki kontrolünü çok istikrarsız hale getiriyor. Hizalanmış bir YZ veya daha ucuz YZ işgücü ortaya çıktığında, insanlar bunları öncelikli olarak kullanacak ve bu da hizalanmamış YZ’nin iktidarı ele geçirmesi için güçlü bir teşvik oluşturacaktır. (Kaynak: RyanPGreenblatt, RyanPGreenblatt, RyanPGreenblatt, RyanPGreenblatt, JeffLadish)

Redis’in yaratıcısı, YZ programlamanın insan programcılardan çok daha geride olduğunu düşünüyor, geliştiricilerden yankı ve tartışma buluyor: Redis’in yaratıcısı Salvatore Sanfilippo (Antirez), geliştirme deneyimlerini paylaşarak mevcut YZ’nin programlama konusunda pratikliği olsa da, özellikle alışılmışın dışına çıkma, tuhaf ve etkili çözümler üretme konusunda insan programcılardan çok daha geride olduğunu belirtti. YZ’yi, fikirleri doğrulamaya yardımcı olan “yeterince zeki bir yardımcı” olarak nitelendirdi. Bu görüş geliştiriciler arasında hararetli tartışmalara yol açtı; birçoğu YZ’nin düşünmeye yardımcı bir “lastik ördek” olarak kullanılabileceğini kabul etti, ancak YZ’nin aşırı özgüvenli olduğunu ve acemi geliştiricileri kolayca yanıltabileceğini belirtti. Bazı geliştiriciler, YZ tarafından üretilen yanlış cevapların kendilerini manuel olarak kod yazmaya teşvik ettiğini ifade etti. Tartışma, YZ’yi etkili bir şekilde kullanmada deneyimin önemini ve YZ’nin programlamaya yeni başlayanlar üzerindeki olası olumsuz etkilerini vurguladı. (Kaynak: WeChat)

DeepMind ve Google Research ilişkisi yeniden tartışılıyor: Marka ve gerçek inovasyon katkısı arasındaki çekişme: Faruk Guney, DeepMind ve Google Research ilişkisi hakkında uzun bir tweet dizisi yayınlayarak, mevcut YZ devriminin temel atılımlarının (Transformer mimarisi gibi) Google tarafından satın alındıktan sonraki DeepMind’den ziyade esas olarak Google Research’ten kaynaklandığını savundu. AlphaFold’un DeepMind’in bir başarısı olmasına rağmen, Google’ın hesaplama kaynakları ve araştırma altyapısı olmadan mümkün olamayacağını ve temel katkıda bulunanların John Jumper ve Pushmeet Kohli gibi bilim insanları ve mühendisler olduğunu belirtti. Guney, Google Research’ün daha sonra DeepMind’e dahil edilmesinin daha çok marka ve organizasyonel bir yeniden yapılanma olduğunu, bunun arkasında karmaşık kurumsal politikaların yattığını ve inovasyonun gerçek kaynağını gizleyebileceğini düşünüyor. Birçok YZ atılımının, yalnızca birkaç tanınmış kişiye veya markaya atfedilmek yerine, ekiplerin yıllarca süren araştırmalarının sonucu olduğunu vurguladı. (Kaynak: farguney, farguney)

YZ çağında iş pozisyonları ve beceri dönüşümleri endişe ve tartışmalara yol açıyor: Sosyal medyada, YZ’nin istihdam piyasası üzerindeki etkisine ilişkin tartışmalar devam ediyor. Bir yandan, Anthropic CEO’sunun da bu tür endişeleri dile getirmesiyle, YZ’nin kitlesel işsizliğe yol açacağı yönünde görüşler var ve bu da insanları nasıl başa çıkılacağını düşünmeye sevk ediyor. Öte yandan, YZ’nin esas olarak üretkenliği artırdığını ve tüketici talebi istihdam ve gelire bağlı olduğu için ciddi bir ekonomik durgunluk olmadıkça kitlesel işsizliğe yol açmasının pek olası olmadığını belirten sesler de var. Aynı zamanda, bazı kullanıcılar YZ nedeniyle işsiz kalma kişisel deneyimlerini paylaştı (örneğin, patronun çalışanı ChatGPT ile değiştirmesi). Gelecek için tartışmalar, tasarruf yapma, pratik beceriler öğrenme, gelir azalması olasılığına uyum sağlama ve eğitim sisteminin eleştirel düşünme ve YZ araçlarını etkili bir şekilde kullanma gibi YZ çağında gerekli becerileri geliştirmek için nasıl ayarlanması gerektiğine işaret ediyor. (Kaynak: Reddit r/ArtificialInteligence, Reddit r/artificial)

ChatGPT’ye aşırı bağımlılık, düşünme yeteneğinde azalma endişelerine yol açıyor: Bir Reddit kullanıcısı, kız arkadaşının karar verme, görüş ve fikir edinme konusunda ChatGPT’ye aşırı bağımlı olmasından endişe duyduğunu belirten bir gönderi paylaştı ve bunun onun bağımsız düşünme ve özgünlük yeteneğini kaybetmesine neden olabileceğini düşündüğünü belirtti. Gönderi geniş çapta tartışmalara yol açtı; bazı yorumcular bu endişeyi paylaştı ve YZ araçlarına aşırı bağımlılığın gerçekten de kişisel düşünmeyi zayıflatabileceğini belirtti; diğer yorumcular ise YZ’nin sadece bir araç olduğunu, geçmişteki ansiklopediler veya arama motorları gibi, önemli olanın kullanıcının onu nasıl kullandığı, düşünmenin bir başlangıç noktası olarak mı yoksa tamamen bir ikame olarak mı kullandığı olduğunu belirtti. Bazı yorumcular ise iletişim, rehberlik ve YZ’nin sınırlamalarını göstererek başa çıkmayı önerdi. (Kaynak: Reddit r/ChatGPT)

YZ’nin eğitim alanındaki zorlukları: Profesörler öğrencilerin ChatGPT’yi kötüye kullanmasından şikayetçi, gerçek düşünme yeteneğinin geliştirilmesi çağrısında bulunuyor: Bir antik tarih profesörü Reddit’te, ChatGPT’nin kötüye kullanımının öğretimini ciddi şekilde etkilediğini, öğrencilerin sunduğu makalelerin YZ tarafından üretilen ve hatta gerçek hatalar içeren “boş çöp” ile dolu olduğunu ve bunun da öğrencilerin gerçekten öğrenip öğrenmediği konusunda şüpheye düşürdüğünü belirten bir gönderi paylaştı. Beşeri bilimler eğitiminin temelinin, mevcut bilgileri basitçe tekrarlamak yerine yeni bilgiler üretmek, yaratıcı anlayışlar geliştirmek ve bağımsız düşünmek olduğunu vurguladı. Gönderi hararetli tartışmalara yol açtı; yorumcular sözlü raporlara geçme, ders sırasında elle makale yazdırma, öğrencilerden YZ kullanma süreçlerinin meta-analizini sunmalarını isteme veya YZ’yi öğretime entegre ederek öğrencilerin YZ’nin çıktılarını eleştirmelerini sağlama gibi çeşitli başa çıkma stratejileri önerdi. (Kaynak: Reddit r/ChatGPT)

YZ tarafından üretilen çekirdek, beklenmedik bir şekilde PyTorch uzman çekirdeğini geride bıraktı, Stanford Çinli ekip yeni olasılıkları ortaya koyuyor: Stanford Üniversitesi’nden Anne Ouyang, Azalia Mirhoseini ve Percy Liang’dan oluşan ekip, çekirdek üretim modelini eğitmek için sentetik veri üretmeye çalışırken, saf CUDA-C ile yazdıkları YZ tarafından üretilen çekirdeğin performans açısından PyTorch’un yerleşik, uzmanlar tarafından optimize edilmiş FP32 çekirdeğine yaklaştığını hatta geçtiğini beklenmedik bir şekilde keşfetti. Örneğin, matris çarpımında PyTorch performansının %101,3’üne, iki boyutlu evrişimde ise %179,9’una ulaştı. Ekip, doğal dil çıkarımı optimizasyon fikirlerini ve dallanma genişletme arama stratejisini birleştirerek çok turlu yinelemeli optimizasyon kullandı ve OpenAI o3 ile Gemini 2.5 Pro modellerinden yararlandı. Bu başarı, akıllıca arama ve paralel keşif yoluyla YZ’nin yüksek performanslı hesaplama çekirdeği üretimi alanında atılım yapma potansiyeline sahip olduğunu gösteriyor. (Kaynak: WeChat)

💡 Diğer

YZ endüstrisinin güçlü lobi faaliyetleri Max Tegmark’ın dikkatini çekiyor: MIT Profesörü Max Tegmark, YZ endüstrisinin Washington ve Brüksel’deki lobici sayısının fosil yakıt endüstrisi ve tütün endüstrisinin toplamını aştığına dikkat çekti. Bu olgu, YZ endüstrisinin politika yapımında artan etkisini ve düzenleyici ortamın şekillendirilmesine aktif katılımını ortaya koyuyor; bu durum, YZ teknolojisinin gelişim yönü, etik normları ve pazar rekabeti üzerinde derin etkiler yaratabilir. (Kaynak: Reddit r/artificial)

YZ, deepfake aracılığıyla biyoterör saldırılarını simüle ederek yeni bir halk sağlığı tehdidi oluşturabilir: STAT News makalesi, YZ destekli biyo-mühendislik silahları riskinin yanı sıra, deepfake teknolojisini kullanarak biyoterör saldırılarını simüle etmenin de ciddi bir tehdit oluşturabileceğine dikkat çekiyor. Özellikle askeri çatışma halindeki ülkeler arasında, bu tür sahte bilgiler panik, yanlış değerlendirme ve gereksiz askeri tırmanışa yol açabilir. Soruşturmaların halk sağlığı veya teknik ekipler yerine kolluk kuvvetleri veya askeri kurumlar tarafından yürütülme olasılığı nedeniyle, saldırının gerçekliğine inanma olasılıkları daha yüksek olabilir ve bu da etkili bir şekilde çürütmeyi zorlaştırabilir. (Kaynak: Reddit r/ArtificialInteligence)

YZ çağında mühendislik diploması almanın hala mantıklı olup olmadığı tartışılıyor: Topluluk, YZ çağında mühendislik diploması almanın değerini tartışıyor. Bir taraf, YZ’nin birçok geleneksel mühendislik görevini yerine getirebileceğini ve bu da diplomanın değerini düşürebileceğini savunuyor. Diğer taraf ise, mühendislik diplomasının kazandırdığı sistem düşüncesi, problem çözme yeteneği ve matematik-fizik temelinin, özellikle YZ araçlarını anlama ve uygulama konusunda hala önemli olduğunu savunuyor. Bazı görüşler, YZ mühendislerin yerini alabilirse, diğer mesleklerin de bundan kurtulamayacağını, önemli olanın sürekli öğrenmek ve uyum sağlamak olduğunu belirtiyor. Veterinerlik gibi pratik beceri gerektiren ve otomasyonu zor olan alanlar nispeten güvenli seçenekler olarak kabul ediliyor. (Kaynak: Reddit r/ArtificialInteligence)