Anahtar Kelimeler:OpenAI, HealthBench, Meta AI, Dinamik Byte Latent Transformer, Microsoft Araştırma, ARTIST çerçevesi, Sakana AI, Sürekli Düşünme Makinesi, Tıbbi AI performans değerlendirmesi, 8B parametreli dinamik byte latent Transformer modeli, LLM akıl yürütmeyi geliştirmek için pekiştirmeli öğrenme, CTM sinir ağı mimarisi, Qwen3 resmi nicelik modeli

🔥 Öne Çıkanlar

OpenAI, tıbbi AI performansını değerlendirmek için HealthBench’i yayınladı: OpenAI, büyük dil modellerinin (LLM) tıbbi senaryolardaki performansını ve güvenliğini ölçmeyi amaçlayan yeni bir benchmark olan HealthBench’i tanıttı. Bu benchmark, dünya çapında 250’den fazla doktorun katılımıyla geliştirildi ve 5000 gerçek tıbbi diyalog ile doktorlar tarafından yazılmış 48562 benzersiz değerlendirme kriteri içeriyor; acil servis, küresel sağlık gibi çeşitli durumları ve doğruluk, talimat takibi gibi davranışsal boyutları kapsıyor. Testler, o3 modelinin %60 doğruluk oranına ulaştığını ve GPT-4.1 nano’nun maliyeti 25 kat düşürmesine rağmen GPT-4o’dan daha iyi performans gösterdiğini ortaya koydu. Bu durum, AI’ın tıp alanındaki muazzam potansiyelini ve performans-maliyet etkinliğindeki hızlı ilerlemeyi gösteriyor. (Kaynak: OpenAI)

Meta, 8B parametreli Dynamic Byte Latent Transformer modelini yayınladı: Meta AI, 8B parametreli Dynamic Byte Latent Transformer modelinin ağırlıklarını açık kaynak olarak yayınladığını duyurdu. Bu model, geleneksel tokenizasyon yöntemlerine alternatif yeni bir çözüm sunarak dil modeli verimliliği ve güvenilirliği standartlarını yeniden tanımlamayı amaçlıyor. Bu yeni tokenizasyon yöntemiyle, dil modeli alanında çığır açan gelişmelerin yaşanması, modellerin metin işleme verimliliğinin ve etkinliğinin artırılması bekleniyor. Araştırma makalesi ve kod indirilebilir durumda. (Kaynak: AIatMeta)

Microsoft Research, LLM’lerin çıkarım ve araç kullanma yeteneklerini geliştirmek için Reinforcement Learning ile ARTIST çerçevesini tanıttı: Microsoft Research, ARTIST (Agentic Reasoning and Tool Integration in Self-improving Transformers) çerçevesini tanıttı. Bu çerçeve, otonom çıkarım, Reinforcement Learning ve dinamik araç kullanımını birleştirerek büyük dil modellerinin (LLM) çok adımlı çıkarım için ne zaman, nasıl ve hangi aracı kullanacağına otonom olarak karar vermesini sağlıyor ve adım düzeyinde denetim olmadan sağlam stratejiler öğrenmesine olanak tanıyor. ARTIST, matematik ve fonksiyon çağırma gibi zorlu benchmark testlerinde GPT-4o gibi önde gelen modellerden %22’ye varan oranda daha iyi performans göstererek genelleştirme ve yorumlanabilirlik sorun çözümü için yeni standartlar belirliyor. (Kaynak: MarkTechPost)

Sakana AI, Continuous Thought Machines (CTM) yayınladı: Sakana AI, “Continuous Thought Machines” (CTM) adlı yeni bir sinir ağı mimarisini tanıttı. CTM’nin temel fikri, sinirsel aktivitenin dinamik zaman sürecini hesaplamasının temel bir bileşeni olarak kullanmaktır. Bu, modelin dahili olarak oluşturulan “düşünme adımları” zaman çizelgesi boyunca çalışmasına, statik veriler için bile temsillerini yinelemeli olarak oluşturmasına ve iyileştirmesine olanak tanır. Bu mimari, ImageNet sınıflandırması, 2D labirent navigasyonu, sıralama, çift/tek kontrolü hesaplaması ve Reinforcement Learning gibi çeşitli görevlerde uyarlanabilir hesaplama, geliştirilmiş yorumlanabilirlik ve biyolojik uygunluğunu göstermiştir. (Kaynak: Sakana AI)

🎯 Gelişmeler

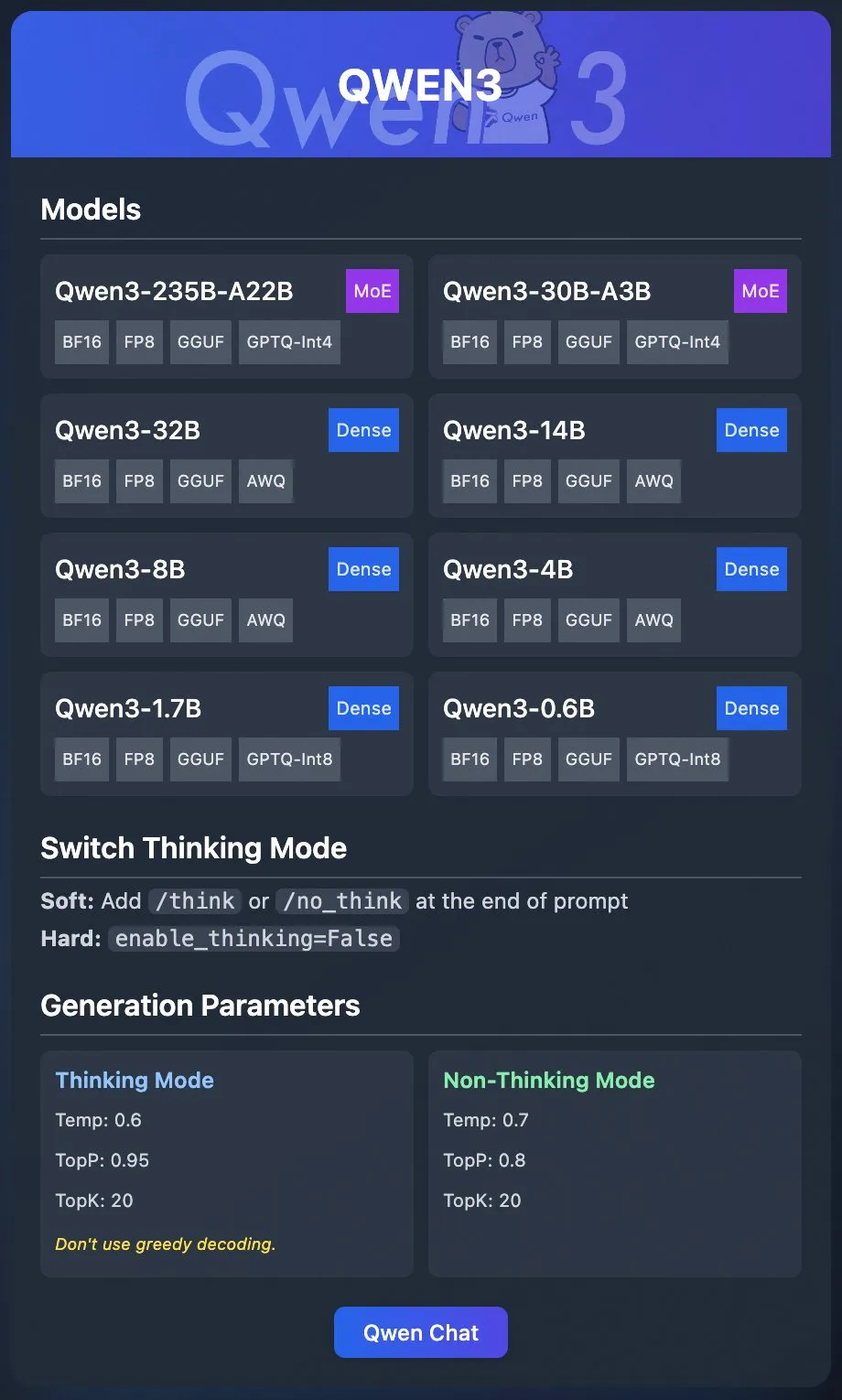

Alibaba Qwen ekibi, Qwen3 resmi quantized modellerini yayınladı: Alibaba Qwen ekibi, Qwen3’ün quantized modellerini resmi olarak yayınladı. Kullanıcılar artık Qwen3’ü Ollama, LM Studio, SGLang ve vLLM gibi platformlar aracılığıyla dağıtabilir ve yerel dağıtımı kolaylaştırmak için GGUF, AWQ, GPTQ gibi çeşitli formatları destekleyebilir. İlgili modeller Hugging Face ve ModelScope’ta kullanıma sunuldu. Bu sürüm, yüksek performanslı büyük modellerin kullanım engelini azaltmayı ve daha geniş senaryolarda uygulanmasını teşvik etmeyi amaçlıyor. (Kaynak: Alibaba_Qwen & Hugging Face & ClementDelangue & _akhaliq & TheZachMueller & cognitivecompai & huybery & Reddit r/LocalLLaMA)

Meta AI, işbirlikçi çıkarım çerçevesi Collaborative Reasoner’ı yayınladı: Meta AI, dil modellerinin işbirlikçi çıkarım yeteneklerini geliştirmeyi amaçlayan Collaborative Reasoner çerçevesini tanıttı. Bu çerçeve, insanlar ve diğer agent’larla işbirliği yapabilen sosyal agent’lar geliştirmeye odaklanmıştır. Modellerin işbirliği ve çıkarım yeteneklerini artırarak, daha karmaşık insan-makine etkileşimleri ve çoklu agent sistemleri için zemin hazırlamaktadır. İlgili araştırma makalesi ve kod, topluluğun keşfetmesi ve uygulaması için açık olarak indirilebilir. (Kaynak: AIatMeta)

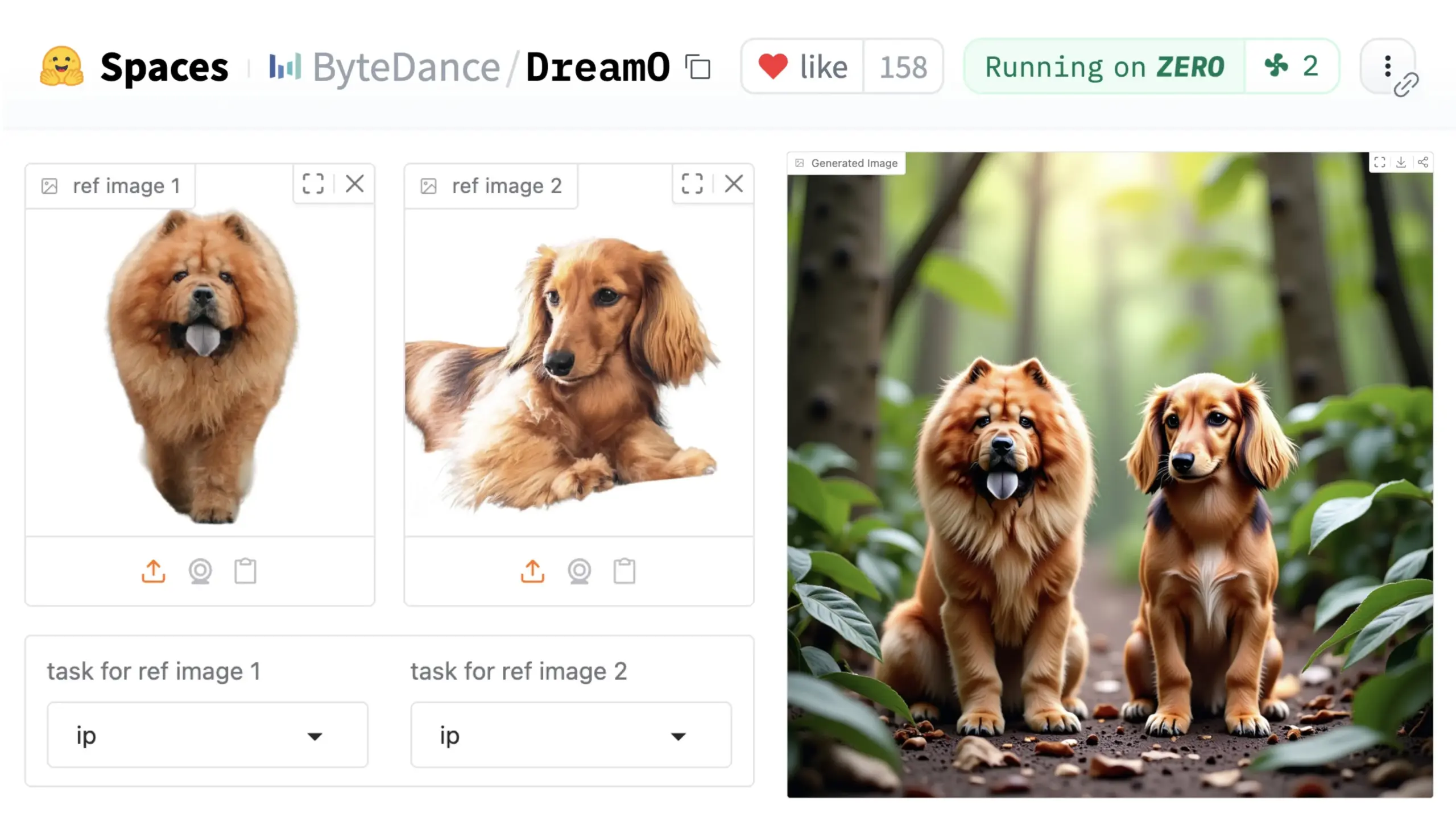

ByteDance, genel görüntü özelleştirme çerçevesi DreamO’yu tanıttı: ByteDance, DreamO adlı birleşik bir görüntü özelleştirme çerçevesini yayınladı. Bu çerçeve, önceden eğitilmiş DiT (Diffusion Transformer) modeline dayanmaktadır ve kimlik değiştirme, stil aktarımı, nesne dönüşümü ve sanal deneme gibi işlevler dahil olmak üzere görüntülerdeki kişiler, stiller, arka planlar gibi çeşitli öğelerin geniş kapsamlı özelleştirilmesini sağlar. Kullanıcılar Demo’yu Hugging Face’te deneyebilirler. Bu gelişme, tek bir modelin çeşitli görüntü düzenleme görevlerindeki potansiyelini göstermektedir. (Kaynak: _akhaliq & ClementDelangue & _akhaliq)

NVIDIA, Nemotron model veri yönetimi süreci Nemotron-CC’yi açık kaynak yaptı: NVIDIA, Nemotron modeli için kullanılan veri yönetimi süreci Nemotron-CC’yi açık kaynak yaptığını ve Nemotron eğitim ve eğitim sonrası verilerini mümkün olduğunca kamuya açıklayacağını duyurdu. Nemotron-CC süreci artık NeMo Curator GitHub deposuna eklendi ve metin, görüntü ve video verilerini büyük ölçekte işleyebiliyor. NVIDIA, yüksek kaliteli ön eğitim veri setlerinin büyük dil modellerinin doğruluğu için önemini vurguluyor ve verinin hızlandırılmış hesaplamanın temel bir bileşeni olduğuna inanıyor. (Kaynak: ctnzr & NandoDF)

Tencent Hunyuan-Turbos modeli LMArena sıralamasında sekizinci oldu: Tencent’in en yeni Hunyuan-Turbos modeli, LMArena (eski adıyla lmsys.org) benchmark testlerinde genel sıralamada sekizinci, stil kontrolünde on üçüncü sırada yer alarak Deepseek-R1’e yakın bir performans sergiledi. Model, hardcore, kodlama, matematik gibi ana kategorilerde ilk ona girerek Şubat ayındaki versiyonuna göre önemli bir gelişme gösterdi. WizardLM_AI gibi topluluk üyeleri performansını tebrik etti. (Kaynak: WizardLM_AI & WizardLM_AI & teortaxesTex)

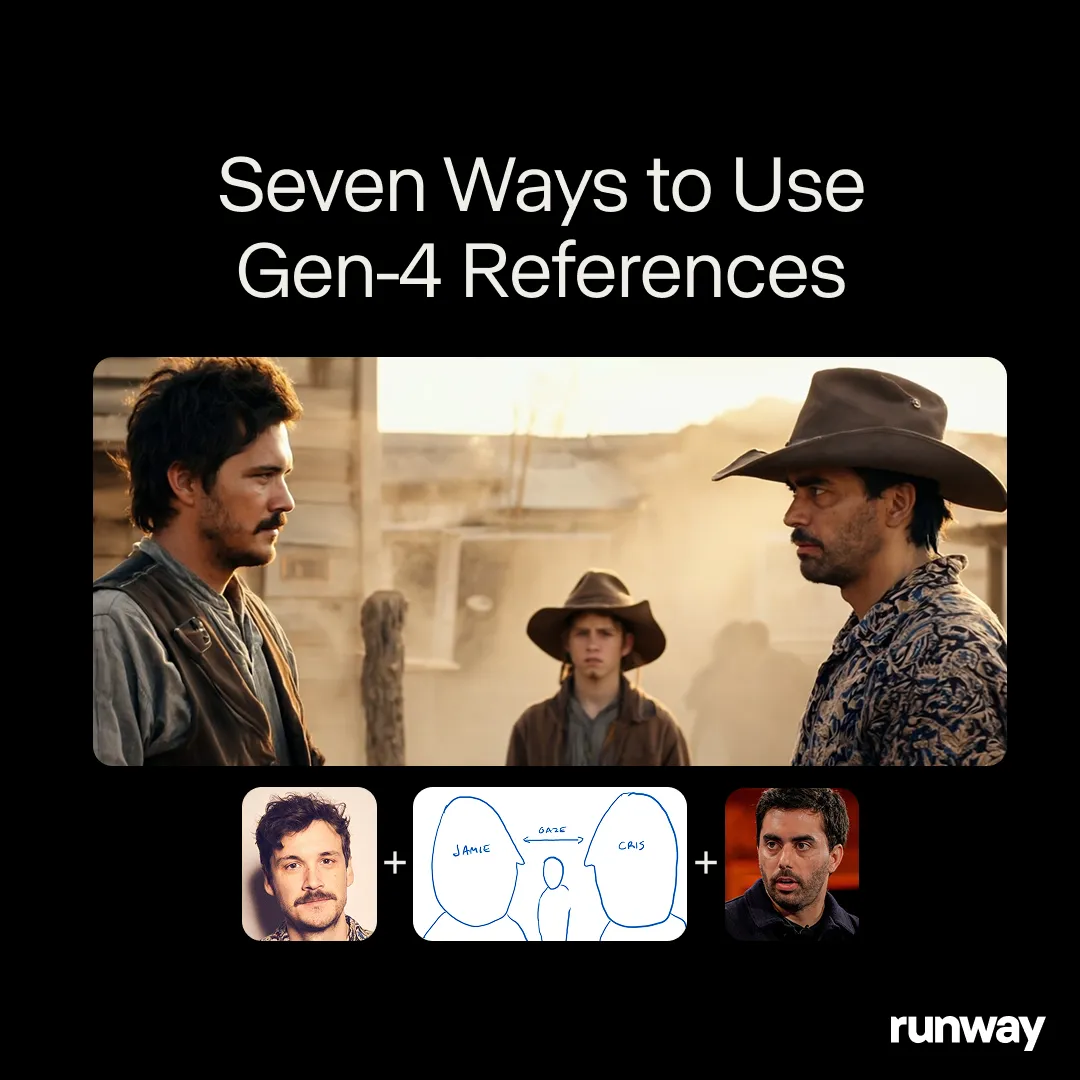

Runway Gen-4 References, genel yaratıcı araç potansiyelini gösteriyor: Runway’in Gen-4 References modeli, neredeyse sınırsız iş akışını ve uygulamayı destekleyebilen genel bir yaratıcı araç olarak konumlandırılıyor. Topluluk kullanıcıları sürekli olarak yeni kullanım durumları keşfediyor, bu da modelin kısıtlamalarına kullanıcıların uyum sağlaması yerine, kullanıcıların yaratıcılığına göre ayarlanabilen genel bir model olarak güçlü uyarlanabilirliğini gösteriyor. Bu, AI’ın medya oluşturma alanında belirli görevlerden genel yeteneklere doğru evrimleşme eğilimini yansıtıyor. (Kaynak: c_valenzuelab & c_valenzuelab)

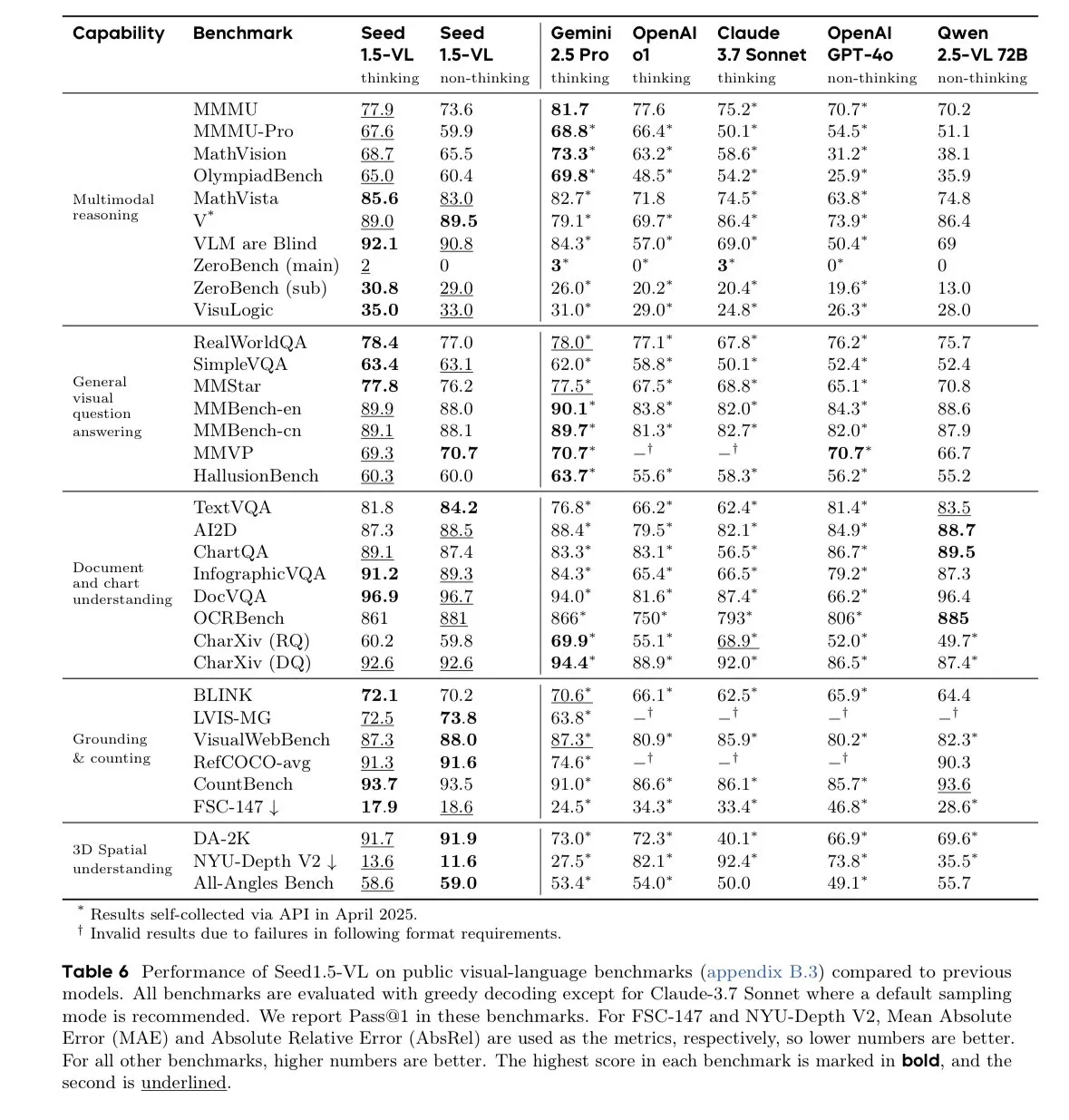

ByteDance Seed-1.5-VL-thinking modeli, visual language model benchmark testlerinde lider: ByteDance, 60 visual language model (VLM) benchmark testinin 38’inde SOTA (state-of-the-art) sonuçlar elde eden Seed-1.5-VL-thinking modelini yayınladı. Modelin 1.3 milyon H800 GPU saatinde eğitildiği belirtiliyor, bu da güçlü multimodal anlama ve çıkarım yeteneklerini gösteriyor. (Kaynak: teortaxesTex)

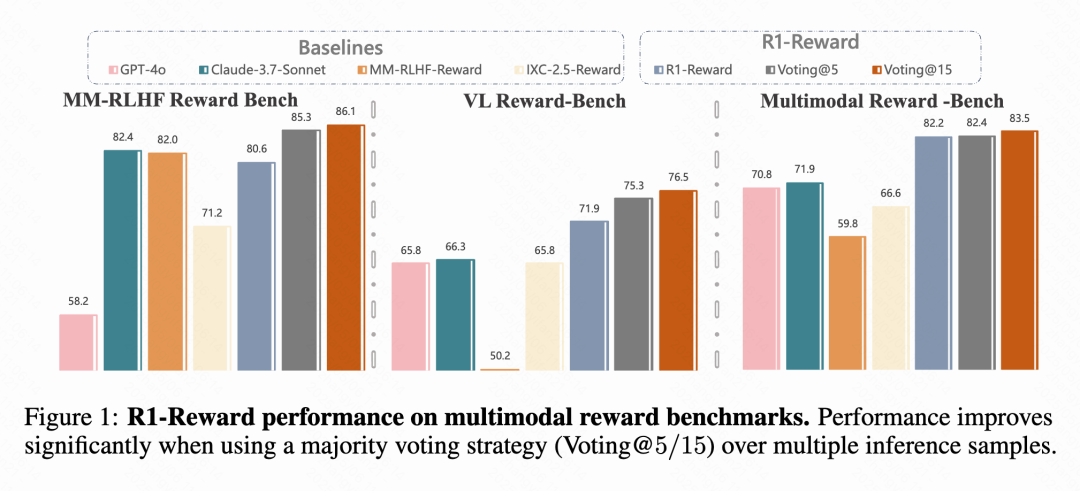

Kuaishou, CAS vb. multimodal reward modeli R1-Reward’ı önerdi: Kuaishou, Çin Bilimler Akademisi (CAS), Tsinghua Üniversitesi ve Nanjing Üniversitesi’nden araştırma ekipleri, geliştirilmiş bir Reinforcement Learning algoritması olan StableReinforce ile eğitilen yeni bir multimodal reward modeli (MRM) olan R1-Reward’ı önerdi. Bu model, mevcut RL algoritmalarının MRM’leri eğitirken karşılaştığı istikrarsızlık sorunlarını çözmeyi amaçlıyor ve Pre-Clip, avantaj filtresi ve tutarlılık ödülü gibi mekanizmalar sunuyor. Deneyler, R1-Reward’ın birden fazla MRM benchmark’ında SOTA modellerine göre %5-%15 iyileşme sağladığını ve Kuaishou’nun kısa video, e-ticaret gibi iş senaryolarında başarıyla uygulandığını gösteriyor. (Kaynak: WeChat & WeChat)

Nanyang Teknoloji Üniversitesi vb. uzun süreli tutarlı dünya üretimi için hafıza mekanizmalı WorldMem’i önerdi: Nanyang Teknoloji Üniversitesi S-Lab, Pekin Üniversitesi ve Shanghai AI Lab araştırmacıları, dünya üretim modeli WorldMem’i önerdi. Bu model, hafıza mekanizması sunarak mevcut video üretim modellerinin uzun süreli tutarlılık eksikliği sorununu çözüyor. WorldMem, Minecraft veri setinde eğitildi, çeşitli sahne keşiflerini ve dinamik değişiklikleri destekliyor ve gerçek veri setlerinde fizibilitesini doğruladı; bakış açısı ve konum değişikliklerinden sonra iyi geometrik tutarlılığı koruyabiliyor ve zamansal tutarlılığı modelleyebiliyor. (Kaynak: WeChat)

Kuaishou Keling ekibi, 3D algılamalı kontrol edilebilir sinematik video üretim çerçevesi CineMaster’ı önerdi: Kuaishou Keling araştırma ekibi, SIGGRAPH 2025’te CineMaster çerçevesini tanıtan bir makale yayınladı. Bu, kullanıcıların etkileşimli bir iş akışı aracılığıyla 3D uzayda sahneleri düzenlemesine, hedefleri ve kamera hareketlerini ayarlamasına olanak tanıyarak video içeriği üzerinde hassas kontrol sağlayan sinematik bir metinden videoya üretim çerçevesidir. CineMaster, sırasıyla nesne hareketi ve kamera hareketi kontrolünü entegre etmek için anlamsal düzen ControlNet ve Camera Adapter’ı kullanır ve herhangi bir videodan 3D kontrol sinyallerini çıkarmak için bir veri oluşturma süreci tasarlamıştır. (Kaynak: WeChat)

🧰 Araçlar

Comet-ml, açık kaynak LLM değerlendirme çerçevesi Opik’i yayınladı: Comet-ml, LLM uygulamalarını, RAG sistemlerini ve Agent iş akışlarını hata ayıklama, değerlendirme ve izleme için bir çerçeve olan Opik’i GitHub’da açık kaynak olarak yayınladı. Opik, kapsamlı izleme, otomatik değerlendirme ve üretime hazır gösterge tabloları sunar; yerel olarak kurulabilir veya Comet.com aracılığıyla barındırılan bir çözüm olarak kullanılabilir. OpenAI, LangChain, LlamaIndex gibi birçok popüler çerçeveyle entegre olur ve halüsinasyon tespiti, içerik denetimi ve RAG değerlendirmesi için LLM-as-a-judge metrikleri sağlar. (Kaynak: GitHub Trending)

LovartAI, bağlamı anlamayı vurgulayan ilk tasarım agent’ı Lovart’ı tanıttı: LovartAI, ilk tasarım agent’ı Lovart’ın Beta sürümünü yayınladı. Kullanıcı geri bildirimlerine göre, diğer AI tasarım araçlarıyla karşılaştırıldığında Lovart bağlamı daha iyi anlayabiliyor, hatta “zihin okuyor gibi”. Araç, insan ve AI’ın aynı tuval üzerinde işbirliği yapmasına olanak tanır, prompt’ları anında görsel efektlere dönüştürür ve marka logosu ve VI tasarımı gibi alanlarda kullanılabilir. (Kaynak: karminski3)

CMU Jun-Yan Zhu ekibi, metinden 3D Lego modelleri üreten LEGOGPT’yi tanıttı: CMU’dan Jun-Yan Zhu’nun ekibi, metin prompt’larına dayanarak fiziksel olarak kararlı ve inşa edilebilir 3D Lego modelleri üretebilen büyük bir dil modeli olan LEGOGPT’yi geliştirdi. Model, Lego tasarım problemini otoregresif metin üretimi görevi olarak formüle eder, bir sonraki tuğlanın boyutunu ve konumunu tahmin ederek yapıyı inşa eder ve eğitim ile çıkarım sırasında fiziksel olarak farkında montaj kısıtlamalarını zorunlu kılarak üretilen tasarımların kararlılığını ve inşa edilebilirliğini sağlar. Ekip ayrıca 47.000’den fazla Lego yapısı içeren StableText2Lego veri setini de yayınladı. (Kaynak: WeChat)

MNN Chat uygulaması Qwen 2.5 Omni 3B ve 7B modellerini destekliyor: Alibaba’nın MNN (Mobile Neural Network) Chat uygulaması artık Qwen 2.5 Omni 3B ve 7B modellerini destekliyor. Bu, kullanıcıların mobil cihazlarda daha güçlü yerelleştirilmiş dil modeli hizmetlerini deneyimleyebileceği anlamına geliyor. MNN, mobil ve gömülü cihaz optimizasyonuna odaklanan hafif bir derin öğrenme çıkarım motorudur. (Kaynak: Reddit r/LocalLLaMA)

FutureHouse platformu bilim insanlarına süper zeki AI araştırma araçları sunuyor: Kâr amacı gütmeyen kuruluş FutureHouse, bilimsel keşfi hızlandırmayı amaçlayan Web ve API tabanlı bir AI agent paketi olan FutureHouse platformunu yayınladı. Platform, bilim insanlarının veri analizi, simülasyon deneyleri ve bilgi keşfi yapmalarına yardımcı olmak için bir dizi süper zeki AI araştırma aracı sunarak araştırma paradigmalarının dönüşümünü teşvik ediyor. (Kaynak: dl_weekly)

Cartesia, kolayca özel ses modelleri oluşturmak için Pro Voice Cloning’i tanıttı: Cartesia, ince ayar ürünü Pro Voice Cloning’i yayınladı. Kullanıcılar kendi ses verilerini yükleyerek kişiselleştirilmiş avatarlar, AI agent’lar veya ses kütüphaneleri oluşturmak için kolayca özel ses modelleri oluşturabilirler. Ürün, 2 saat içinde eğitim ve hizmet dağıtımını tamamlamayı destekler ve ölçekli uygulamayı hedefleyen tamamen self-servis bir ürün deneyimi sunar. (Kaynak: krandiash)

Çin Bilimler Akademisi Hesaplama Teknolojisi Enstitüsü, görüntülerin hassas özelleştirilmesi için MCA-Ctrl’yi önerdi: Çin Bilimler Akademisi Hesaplama Teknolojisi Enstitüsü araştırma ekibi, ince ayar gerektirmeyen genel bir görüntü özelleştirme yöntemi olan MCA-Ctrl’yi (Multi-party Collaborative Attention Control) önerdi. Bu yöntem, çoklu özne işbirlikçi dikkat kontrolü aracılığıyla, difüzyon modelinin iç bilgisini kullanarak, koşullu görüntü/metin prompt’larını özne görüntü içeriğiyle birleştirerek belirli öznelerin tema değiştirme, üretme ve eklenmesini sağlar. MCA-Ctrl, öz-dikkat yerel sorgulama ve küresel enjeksiyon mekanizmaları aracılığıyla düzen tutarlılığını ve belirli nesne görünümü değiştirmeyi arka planla hizalamayı sağlar. (Kaynak: WeChat)

📚 Öğrenme Kaynakları

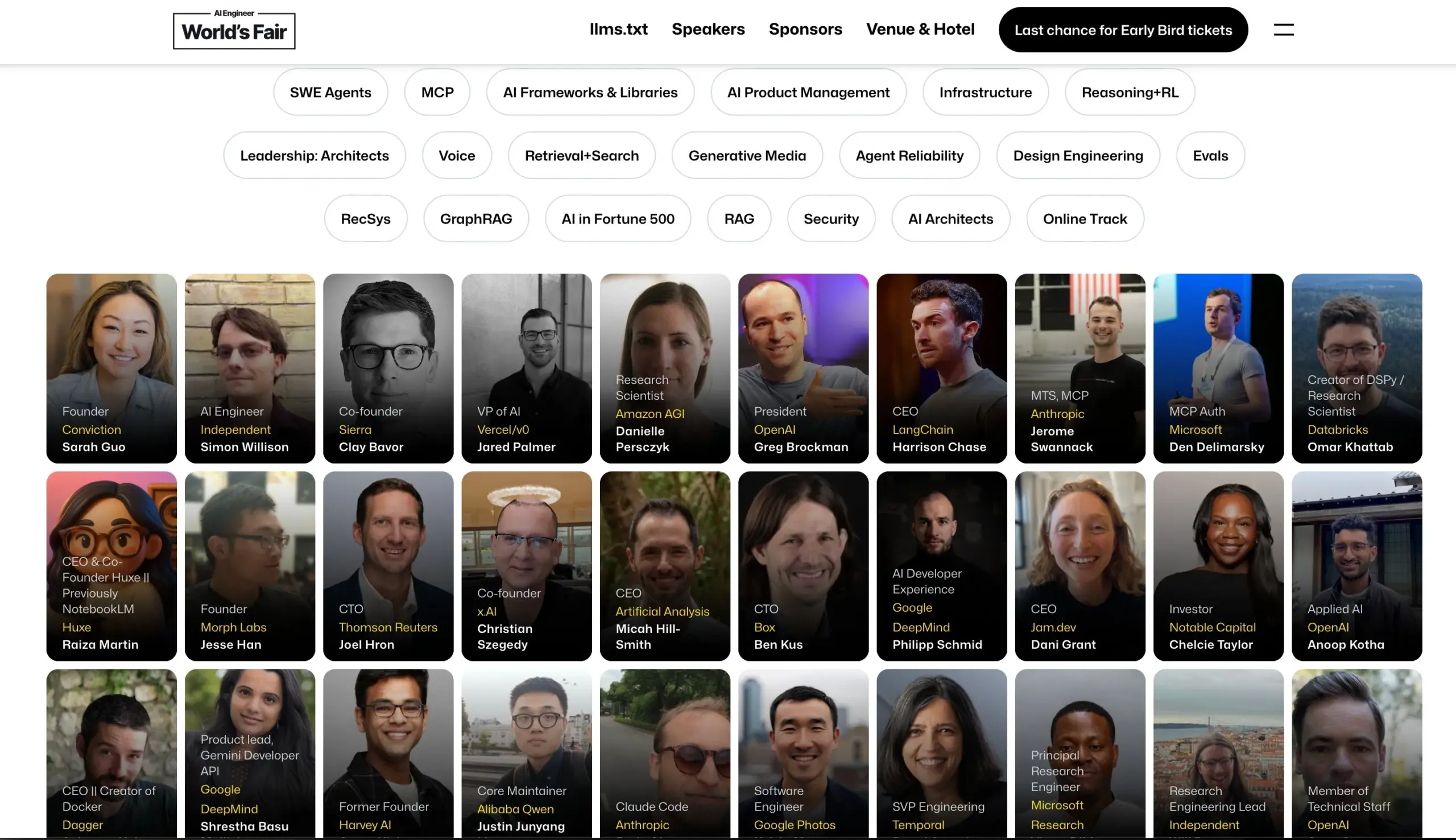

AI Engineer Konferansı konuşmacı kadrosunu açıkladı: AI Engineer Konferansı, OpenAI, Anthropic, LangChainAI, Google gibi şirketlerden önde gelen AI mühendisleri ve araştırmacılarının yer aldığı konuşmacı kadrosunu açıkladı. Konferans, MCP, LLM RecSys, Agent Reliability, GraphRAG gibi 20 alt alanı kapsayacak ve ilk kez CTO ve VP liderlik gündemini içerecek. (Kaynak: swyx & hwchase17 & _philschmid & HamelHusain & swyx & bookwormengr & swyx)

Hugging Face, visual language model (VLM) alanındaki son gelişmeler üzerine blog yazısı yayınladı: Hugging Face, visual language model (VLM) alanındaki son gelişmeleri kapsayan kapsamlı bir blog yazısı yayınladı. İçerik, GUI agent’ları, agent VLM’ler, çok yönlü modeller, multimodal RAG, video LM’ler, küçük modeller gibi birçok konuyu ele alıyor ve geçtiğimiz yıl VLM alanındaki yeni trendleri, atılımları, hizalamayı ve benchmark testlerini özetliyor. (Kaynak: huggingface & ben_burtenshaw & mervenoyann & huggingface & algo_diver & huggingface & huggingface)

Microsoft Azure, serverless AI sohbet uygulamaları oluşturma üzerine çevrimiçi seminer düzenliyor: Yohan Lasorsa, Azure kullanarak serverless AI sohbet uygulamaları oluşturma üzerine bir çevrimiçi seminer düzenleyeceğini duyurdu. Toplantıda Azure Functions, Static Web Apps ve Cosmos DB ile LangChainAI JS kullanarak RAG (Retrieval-Augmented Generation) teknolojisinin nasıl birleştirileceği ele alınacak. (Kaynak: Hacubu & hwchase17)

Weaviate podcast’i LLM-as-Judge sistemlerini ve Verdict kütüphanesini tartışıyor: Weaviate podcast’inin 121. bölümünde Haize Labs kurucu ortağı Leonard Tang konuk edilerek LLM-as-Judge / reward model sistemlerinin evrimi derinlemesine tartışılıyor. Tartışma konuları arasında değerlendirmenin kullanıcı deneyimi, karşılaştırmalı değerlendirme, yargıç entegrasyonu, tartışmacı yargıçlar, küratörlü değerlendirme setleri ve düşmanca testler yer alıyor ve Haize Labs’ın yeni kütüphanesi Verdict’e (bileşik LLM-as-Judge sistemlerini belirtmek ve yürütmek için bildirimsel bir çerçeve) odaklanılıyor. (Kaynak: bobvanluijt & Reddit r/deeplearning)

Terence Tao, AI destekli matematiksel biçimsel ispatı gösteren YouTube videosu yayınladı: Fields Madalyası sahibi Terence Tao, YouTube kanalındaki ilk gösteriminde GitHub Copilot ve Lean ispat yardımcısı gibi AI araçlarını kullanarak, normalde bir insan matematikçinin tam bir sayfa yazmasını gerektirecek bir matematiksel ispatı (Magma denklemi E1689’un E2’yi ima etmesi) 33 dakikada yarı otomatik olarak nasıl biçimselleştirdiğini gösterdi. Bu yöntemin teknik olarak yoğun, kavramsal olarak zayıf ispatlar için uygun olduğunu ve matematikçileri sıkıcı işlerden kurtarabileceğini vurguladı. Aynı zamanda, geliştirdiği hafif Python ispat yardımcısı da asimptotik tahminler ve önermeler mantığı işlemeyi geliştiren 2.0 sürümüne güncellendi. (Kaynak: WeChat & 量子位)

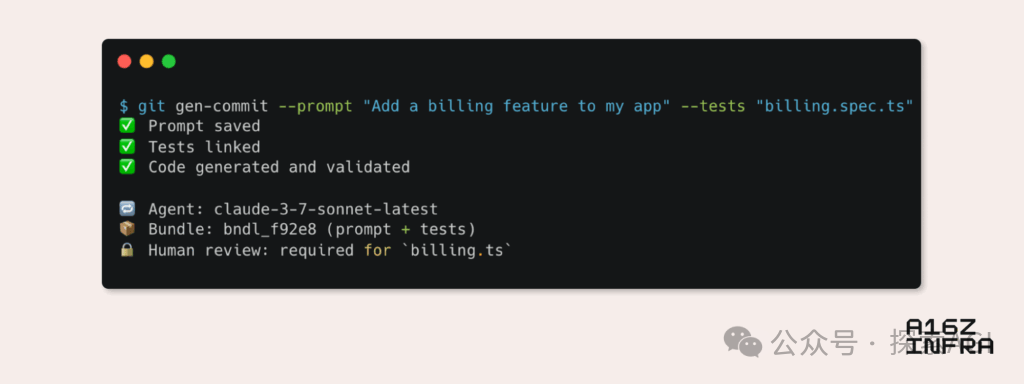

a16z, AI çağında ortaya çıkan geliştirici modellerindeki dokuz eğilimi analiz ediyor: Andreessen Horowitz (a16z), AI çağında ortaya çıkan dokuz geliştirici modeli eğilimini analiz eden bir blog yazısı yayınladı. Bunlar arasında şunlar yer alıyor: AI-native Git (sürüm kontrolünün Prompt ve test senaryolarına yönelmesi), Vibe Coding (niyet odaklı programlamanın şablonların yerini alması), AI Agent’lar için yeni anahtar yönetimi paradigması, AI güdümlü etkileşimli izleme panoları, belgelerin AI ile etkileşimli bilgi tabanlarına dönüşmesi, uygulamalara LLM perspektifinden bakma (erişilebilirlik API’leri aracılığıyla etkileşim), asenkron yürütülen Agent’ların yükselişi, MCP (Model-Tool Communication Protocol) protokolünün potansiyeli ve Agent’ların temel bileşenlere olan ihtiyacı. Bu eğilimler, yazılım oluşturma biçimlerinde köklü bir değişimin habercisi. (Kaynak: WeChat)

💼 İş Dünyası

Google Labs, AI startup’larını desteklemek için AI Futures Fund’ı başlattı: Google Labs, AI teknolojisinin geleceğini birlikte inşa etmek amacıyla startup’larla işbirliği yapmayı hedefleyen AI Futures Fund projesini başlattığını duyurdu. Fon, seçilen startup’lara Google DeepMind modellerine erken erişim ve gelişimlerini hızlandırmalarına yardımcı olmak için bulut kredisi gibi kaynaklar sağlayacak. (Kaynak: GoogleDeepMind & JeffDean & Google & demishassabis)

Perplexity’nin 14 milyar dolar değerleme ile 5 milyar dolarlık yeni bir finansman turu için görüşmelerde bulunduğu bildiriliyor: Haberlere göre, AI arama motoru şirketi Perplexity, 14 milyar dolara ulaşabilecek bir değerleme ile 5 milyar dolarlık yeni bir finansman turu için görüşmeler yapıyor. Bu, bir önceki finansman turundan (9 milyar dolar değerleme) sadece altı ay sonra gerçekleşiyor ve sermaye piyasasının AI arama alanına olan yüksek ilgisini ve Perplexity’nin gelişim beklentilerine olan inancını gösteriyor. (Kaynak: Dorialexander)

OpenAI’nin Windsurf’ü yaklaşık 3 milyar dolara satın almayı kabul ettiği bildiriliyor: Bloomberg’e göre, OpenAI startup şirketi Windsurf’ü yaklaşık 3 milyar dolara satın almayı kabul etti. Bu satın almanın belirli detayları ve Windsurf’ün iş odağı henüz açıklanmadı, ancak bu hamle OpenAI’nin teknolojik yeteneklerini veya pazar payını daha da genişlettiği anlamına gelebilir. (Kaynak: Reddit r/artificial & Reddit r/ArtificialInteligence)

🌟 Topluluk

AI’ın gerçek riski: Sınırsız tatminin getirdiği “simülasyon tuzağı”: Amjad Masad ve diğerlerinin tartışmaları, AI’ın gerçek tehlikesinin bilim kurgu filmlerindeki katil robotlar olmadığını, bunun yerine insan arzularını sınırsızca tatmin ederek bir “sonsuz mutluluk makinesi” yaratabileceğini belirtiyor. Bu tür bir AI, insanların simüle edilmiş mücadele ve anlamlara dalmasına, sonunda simüle edilmiş dünyada “kaybolmasına” neden olabilir ve Fermi Paradoksu için olası bir açıklama sunabilir – medeniyetler yok olmuyor, dijital mutluluğa giriyorlar. (Kaynak: amasad)

AI Agent’lar programlamayı ve bilimsel araştırmayı yeniden şekillendirecek: Replit CEO’su Amjad Masad, önümüzdeki bir iki yıl içinde AI Agent’ların karmaşık bilimsel sorunları çözmek için günlerce, hatta yıllarca kesintisiz çalışabileceğini öngörüyor. Agent’ların, bir sorunu çözmek için insanlar gibi günlerce zaman ayırabilen yeni bir programlama biçimi olacağını düşünüyor, bu da AI’ın karmaşık görevleri otomatikleştirme ve bilimsel keşfi hızlandırma konusundaki muazzam potansiyelini gösteriyor. (Kaynak: TheTuringPost & amasad & TheTuringPost)

John Carmack, AI’ın kod tabanlarını optimize etme potansiyelini tartışıyor: Efsanevi programcı John Carmack, AI’ın sadece büyük miktarda kod üretmekle kalmayıp, mevcut kod tabanlarını güzelleştirmeye ve yeniden yapılandırmaya yardımcı olma potansiyeline sahip olduğuna inanıyor. AI’ı, kodu sürekli olarak gözden geçiren ve iyileştirme önerileri sunan çalışkan bir ekip üyesi olarak hayal ediyor, hatta nesnel deneylerle “AI dostu” kodlama stili kılavuzları tanımlayabileceğini düşünüyor. OpenBSD gibi kod kalitesine son derece yüksek gereksinim duyan ekiplerin AI üyelerini nasıl benimseyeceğini görmeyi dört gözle bekliyor. (Kaynak: ID_AA_Carmack)

“Vibe Coding” tartışma yaratıyor: AI destekli programlamanın artıları ve eksileri: Topluluk tartışmaları, “Vibe Coding”in (doğal dil talimatlarıyla AI’ın kod prototipleri oluşturmasını sağlama) demo düzeyinde uygulamaları hızla oluşturabilmesine rağmen, dağıtım ve ölçeklendirme için hala profesyonel geliştiricilerin sıfırdan inşa etmesi gerektiğini belirtiyor. Mühendislik ürünü sadece kod yazmak değil, aynı zamanda mimari, CI/CD, mikroservisler gibi karmaşık sorunları da içerir ve AI şu anda bu görevleri tam olarak yerine getiremiyor. Vibe Coding hızlı prototip doğrulaması için uygundur, ancak gerçek çözümler oluşturmak hala mühendislik düşüncesi ve deneyimi gerektirir. (Kaynak: Reddit r/ClaudeAI)

AI’ın üniversite eğitiminde yaygın kullanımı ve kopya endişeleri: New York Magazine’in haberi, AI araçlarının (ChatGPT gibi) Kuzey Amerika üniversitelerinde ödevleri ve makaleleri tamamlamak için yaygın olarak kullanıldığını ortaya koyuyor. Öğrenciler AI’ı not almak, öğrenmek, araştırma yapmak ve hatta doğrudan ödev içeriği oluşturmak için kullanıyor, bu da akademik dürüstlük, eğitim kalitesi ve öğrencilerin eleştirel düşünme becerilerinin azalmasıyla ilgili endişeleri artırıyor. Eğitimciler öğretim ve değerlendirme yöntemlerini ayarlamaya çalışıyor, ancak AI tespit araçlarının etkinliği şüpheli olduğundan AI ile kopya çekmenin kökünü kazımak zorlaşıyor. (Kaynak: WeChat)

💡 Diğer

Cohere, hükümetlerin AI uygulamalarını pilottan üretime taşıma zorluklarını tartışıyor: Cohere, çoğu hükümet AI projesinin hala pilot aşamasında kaldığını belirtiyor. Pilottan gerçek üretim uygulamalarına geçişi sağlamak için hükümet kurumlarının güvenilir araçlara, net sonuç odaklılığa, verimli altyapıya ve uygun ortaklara ihtiyacı var. Makale, hükümet kurumlarının güvenli ve verimli AI aracılığıyla deneyden gerçek uygulamaya nasıl geçebileceğini tartışıyor. (Kaynak: cohere)

Mustafa Suleyman: Büyük dil modelleri ne kadar büyükse kontrol edilmesi o kadar kolay: Inflection AI kurucu ortağı Mustafa Suleyman, yaygın endişelerin aksine, büyük dil modellerinin (LLM) ölçeği ne kadar büyükse kontrol edilmesinin aslında o kadar kolay olduğunu savunuyor. Birkaç nesil önceki modellerin yönlendirilmesi, stilize edilmesi ve şekillendirilmesinin daha zor olduğunu, ölçeğin büyümesinin ise modelin kontrol edilebilirliğini zayıflatmak yerine artırmaya yardımcı olduğunu belirtiyor. (Kaynak: mustafasuleyman)

AI etik tartışması: AI’ın neden olduğu zarar veya önyargının sorumluluğu kime ait?: Bir Reddit gönderisi şu tartışmayı başlattı: Bir AI sistemi (örneğin tıbbi teşhis AI’ı), eğitim verilerindeki önyargı nedeniyle (örneğin, esas olarak açık tenli cilt görüntüleriyle eğitildiği için koyu tenli hastalarda yanlış teşhis koyması) zarar verdiğinde sorumluluk kimde olmalı? Bu, AI geliştiricileri, dağıtım kurumları, düzenleyiciler gibi birçok tarafın sorumluluğunun belirlenmesi sorununu içeriyor ve AI etiği ve yasal çerçevelerinin acilen çözmesi gereken kilit konulardan biri. (Kaynak: Reddit r/ArtificialInteligence)