Anahtar Kelimeler:insansı robot, AI süper bilgisayar, OpenAI modeli, Gemini modeli, insansı robot yarı maratonu, NVIDIA Blackwell çipi, OpenAI o3 halüsinasyon oranı, Gemini 2.5 Pro fizik simülasyonu, AI tarayıcı ajan kursu, kuantum hesaplama bilim etkisi, beyin-bilgisayar arayüzü robot kol kontrolü, GNN oyun NPC davranışı

🔥 Odak Noktası

Dünyanın ilk Humanoid Robot Yarı Maratonu düzenlendi: Pekin Yizhuang’da düzenlenen dünyanın ilk Humanoid Robot Yarı Maratonu yarışmasında, Tiangong 1.2max 2 saat 40 dakika 24 saniyelik derecesiyle bitiş çizgisine ulaşan ilk robot oldu. Bu etkinlik, robotların farklı senaryolardaki pratikliğini doğrulamayı amaçlıyor ve Çin’den çeşitli tahrik yöntemleri ve algoritma ekollerine sahip humanoid robotları bir araya getirdi. Yarışma sadece robotların yürüme yeteneğini, dayanıklılığını (ara şarj veya pil değişimi gerektirir, zaman cezası uygulanır), ısı dağılımını ve stabilitesini test etmekle kalmadı, aynı zamanda insan-makine işbirliğini de test etti. Yol boyunca Unitree Robot’un “sahne korkusu” yaşaması ve Tiangong Robot’un düşmesi gibi durumlar yaşanmasına rağmen, bu etkinlik humanoid robotların gelişimi için önemli bir dönüm noktası olarak görülüyor, gerçek dünya ortamında performans testi ve teknoloji doğrulama platformu sağladı ve yapısal optimizasyon, hareket kontrol algoritmaları ve çevresel adaptasyon yeteneklerinin ilerlemesini sağladı (Kaynak: APPSO via 36氪)

NVIDIA, AI Supercomputer üretiminin ABD’de yapılacağını duyurdu: NVIDIA, AI görevlerini işlemek için kullanılan supercomputer’larını ilk kez tamamen ABD topraklarında üretmeyi planlıyor. Şirket, Arizona’da Blackwell çiplerini test etmek için bir milyon metrekareden fazla alan ayırdı ve Teksas’ta AI supercomputer üretimi için Foxconn (Houston) ve Wistron (Dallas) ile işbirliği yaparak fabrika kuracak; kademeli seri üretimin 12-15 ay içinde başlaması bekleniyor. Bu hamle, NVIDIA’nın önümüzdeki dört yıl içinde ABD’de 500 milyar dolar değerinde AI altyapısı üretme planının bir parçasıdır ve aynı zamanda ABD hükümetinin yarı iletken kendine yeterliliğini artırma, potansiyel gümrük vergileri ve jeopolitik gerilimlere yanıt verme stratejisiyle de uyumludur (Kaynak: dotey)

OpenAI’nin yeni çıkarım modelleri o3 ve o4-mini’nin halüsinasyon oranının daha yüksek olduğu iddia edildi: TechCrunch raporuna ve ilgili tartışmalara göre, OpenAI’nin en son yayınladığı çıkarım modelleri o3 ve o4-mini, testlerde önceki modellerine (o1, o3-mini gibi) göre daha yüksek halüsinasyon oranı sergiledi. Raporda, o3’ün soruları yanıtlarken halüsinasyon üretme oranının %33’e ulaştığı ve bunun o1’in %16’sından ve o3-mini’nin %14.8’inden belirgin şekilde yüksek olduğu belirtildi. Bu bulgu, çıkarım yeteneklerinde gelişme göstermelerine rağmen bu gelişmiş modellerin güvenilirliği konusunda endişelere yol açtı. OpenAI, halüsinasyon oranındaki artışın nedenini anlamak için daha fazla araştırma yapılması gerektiğini kabul etti (Kaynak: Reddit r/artificial, Reddit r/artificial)

🎯 Eğilimler

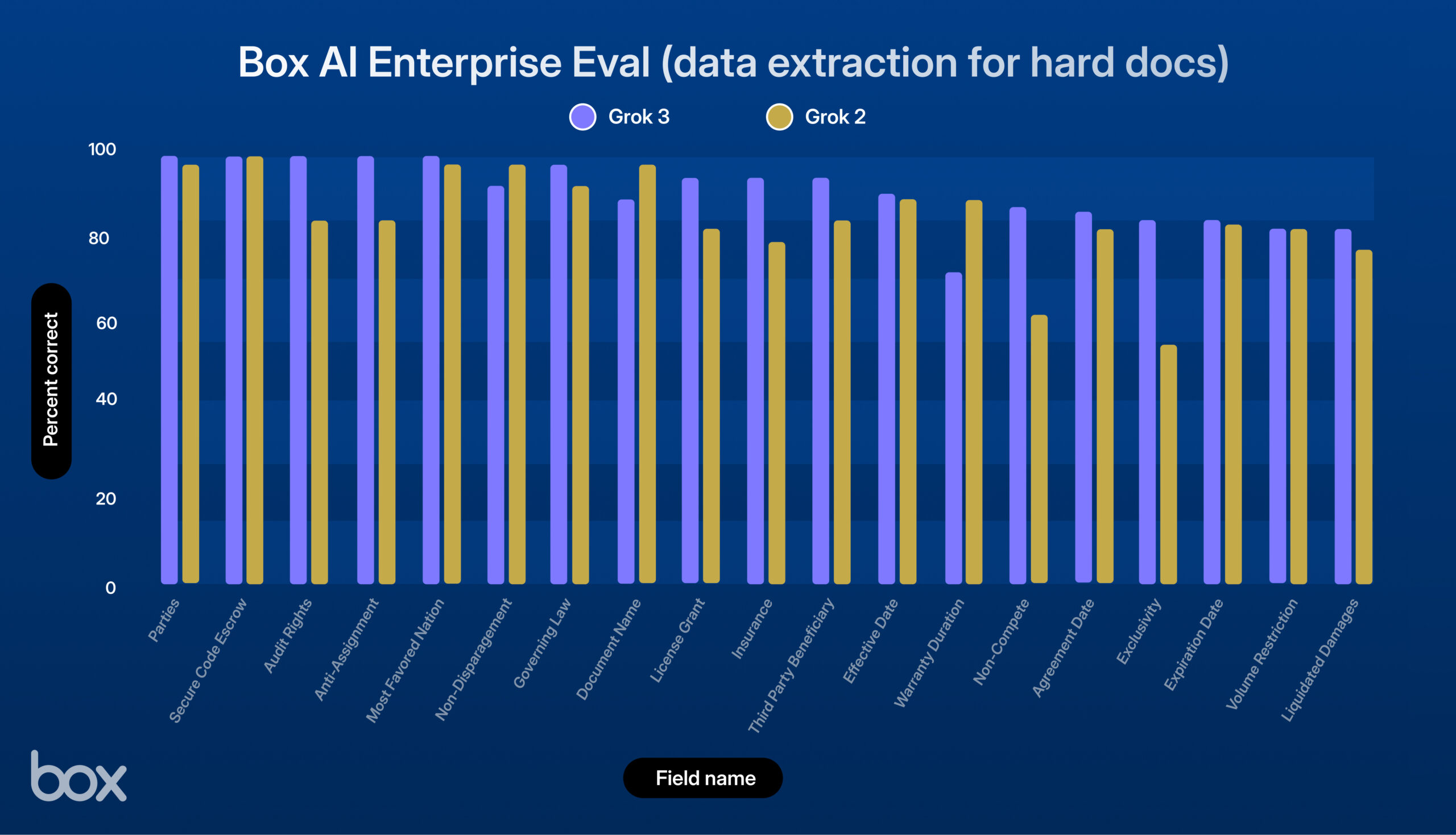

xAI, Grok 3’ü yayınladı, Box testlerinde başarılı performans gösterdi: xAI, yeni modeli Grok 3’ü piyasaya sürdü. Üçüncü taraf platform Box, içerik yönetimi iş akışlarında bu modeli test etti ve Grok 3’ün tek belgeli ve çok belgeli soru yanıtlama, veri çıkarma (Grok 2’ye göre %9 iyileşme) alanlarında öne çıktığını keşfetti. Model, karmaşık yasal sözleşmeleri işleme, çok adımlı çıkarım yapma, hassas bilgi alma ve nicel analiz gibi görevlerde güçlü performans sergiledi; tablolardan ekonomik veri çıkarma, İK çerçevelerini analiz etme ve SEC dosyalarını değerlendirme gibi karmaşık kullanım durumlarını başarıyla ele aldı. Box, Grok 3’ün potansiyelinin büyük olduğuna inanıyor, ancak dil hassasiyeti ve oldukça karmaşık mantığı işleme konusunda iyileştirme alanı olduğunu belirtiyor (Kaynak: xai)

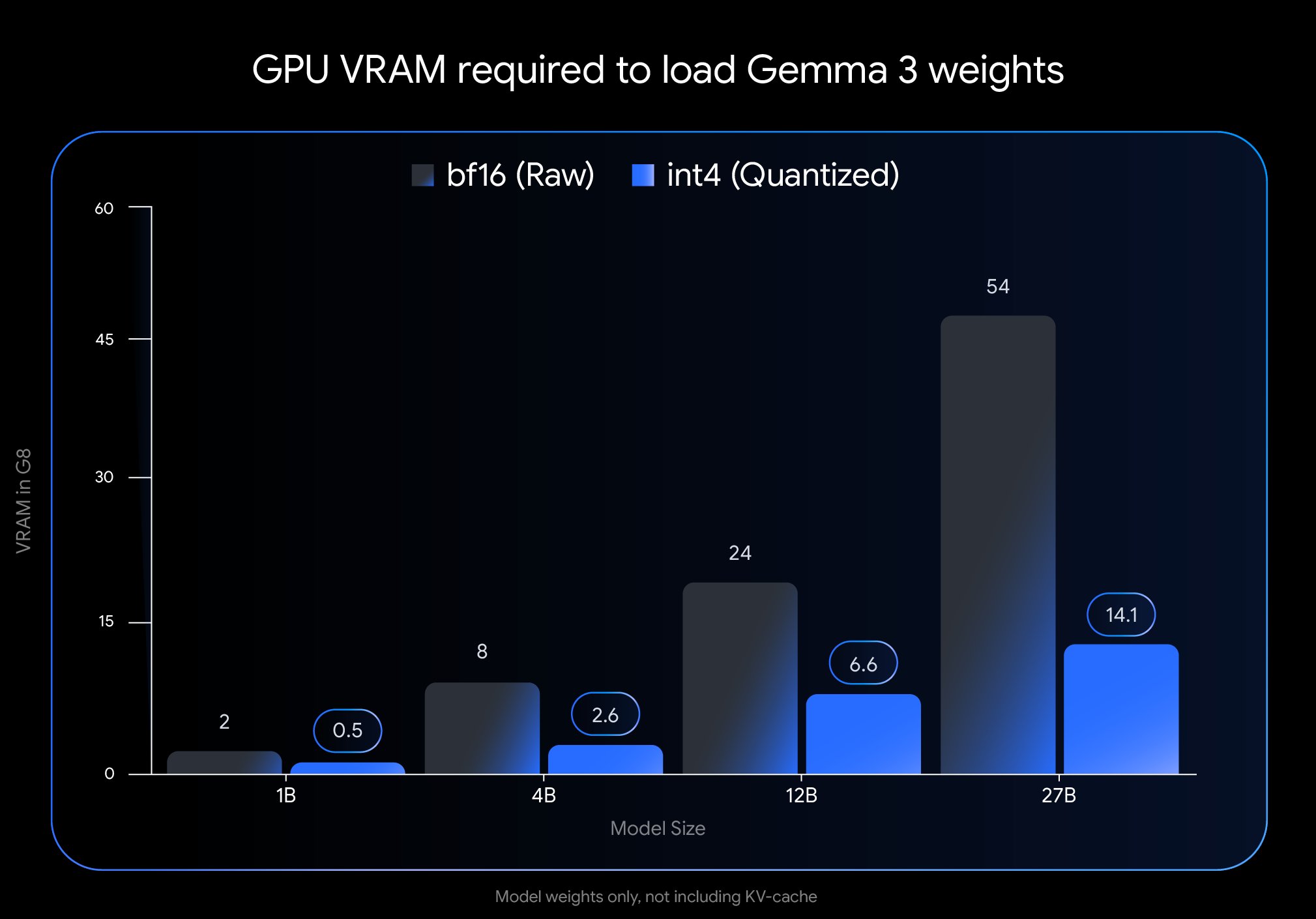

Google, Gemma 3 modelinin yeni nicelleştirilmiş sürümünü yayınladı: Google, Quantization-Aware Training (QAT) teknolojisini kullanarak Gemma 3 modelinin yeni bir sürümünü piyasaya sürdü. Bu teknoloji, modelin bellek kullanımını önemli ölçüde azalttı ve başlangıçta H100 GPU gerektiren modelin artık tek bir masaüstü sınıfı GPU üzerinde verimli bir şekilde çalışmasını sağladı, aynı zamanda yüksek çıktı kalitesini korudu. Bu optimizasyon, güçlü Gemma 3 serisi modellerinin donanım gereksinimlerini büyük ölçüde azalttı ve geniş araştırmacı ve geliştirici kitlesi tarafından standart donanımlar üzerinde dağıtılmasını ve kullanılmasını kolaylaştırdı (Kaynak: JeffDean)

Google Cloud, kurumsal kullanıcılar için AI müzik oluşturma özelliği ekledi: Google, kurumsal bulut platformuna AI destekli müzik oluşturma modları ekledi. Bu yeni özellik, kurumsal müşterilerin üretken AI teknolojisini kullanarak müzik oluşturmasına olanak tanıyor ve Google Cloud’un AI hizmetlerini metin ve görüntüden ses alanına genişletiyor. Bu, pazarlama, içerik oluşturma, marka oluşturma gibi ticari senaryolar için yeni araçlar sunabilir, ancak belirli uygulama senaryoları ve kullanılan model detayları özette ayrıntılı olarak belirtilmedi (Kaynak: Ronald_vanLoon)

NVIDIA, tek istemle 3D sahne oluşturma teknolojisini sergiledi: Nvidia, kullanıcı tarafından girilen tek bir metin istemine dayanarak otomatik olarak eksiksiz 3D sahneler oluşturabilen yeni bir teknolojiyi sergiledi. Üretken AI’daki bu ilerleme, 3D içerik oluşturma sürecini basitleştirmeyi amaçlıyor; kullanıcıların sadece istedikleri sahneyi tanımlaması yeterli, yapay zeka ilgili 3D ortamı oluşturabilir. Bu teknolojinin oyun geliştirme, sanal gerçeklik, mimari tasarım ve ürün görselleştirme gibi alanlar üzerinde önemli bir etki yaratması ve 3D üretim giriş engelini düşürmesi bekleniyor (Kaynak: Ronald_vanLoon)

Gemma 3 27B QAT modeli, Q2_K nicelleştirmesi altında iyi performans gösteriyor: Kullanıcı testleri, Quantization-Aware Training (QAT) ile eğitilmiş Google Gemma 3 27B IT modelinin, Q2_K seviyesine (yaklaşık 10.5GB) nicelleştirildikten sonra bile Japonca görevlerde şaşırtıcı derecede iyi performans sergilediğini gösteriyor. Nicelleştirme seviyesi düşük olmasına rağmen, model talimatları takip etme, belirli formatları koruma ve rol yapma konusunda istikrarlı performans gösterdi, dilbilgisi veya dil karışıklığı sorunu yaşanmadı. Tarih gibi olgusal bilgileri hatırlama yeteneği azalmış olsa da, temel dil yeteneği iyi korundu. Bu, QAT modelinin düşük bit hızlarında performansı iyi koruyabildiğini ve tüketici sınıfı donanımlarda büyük modelleri çalıştırma olanağı sağladığını gösteriyor (Kaynak: Reddit r/LocalLLaMA)

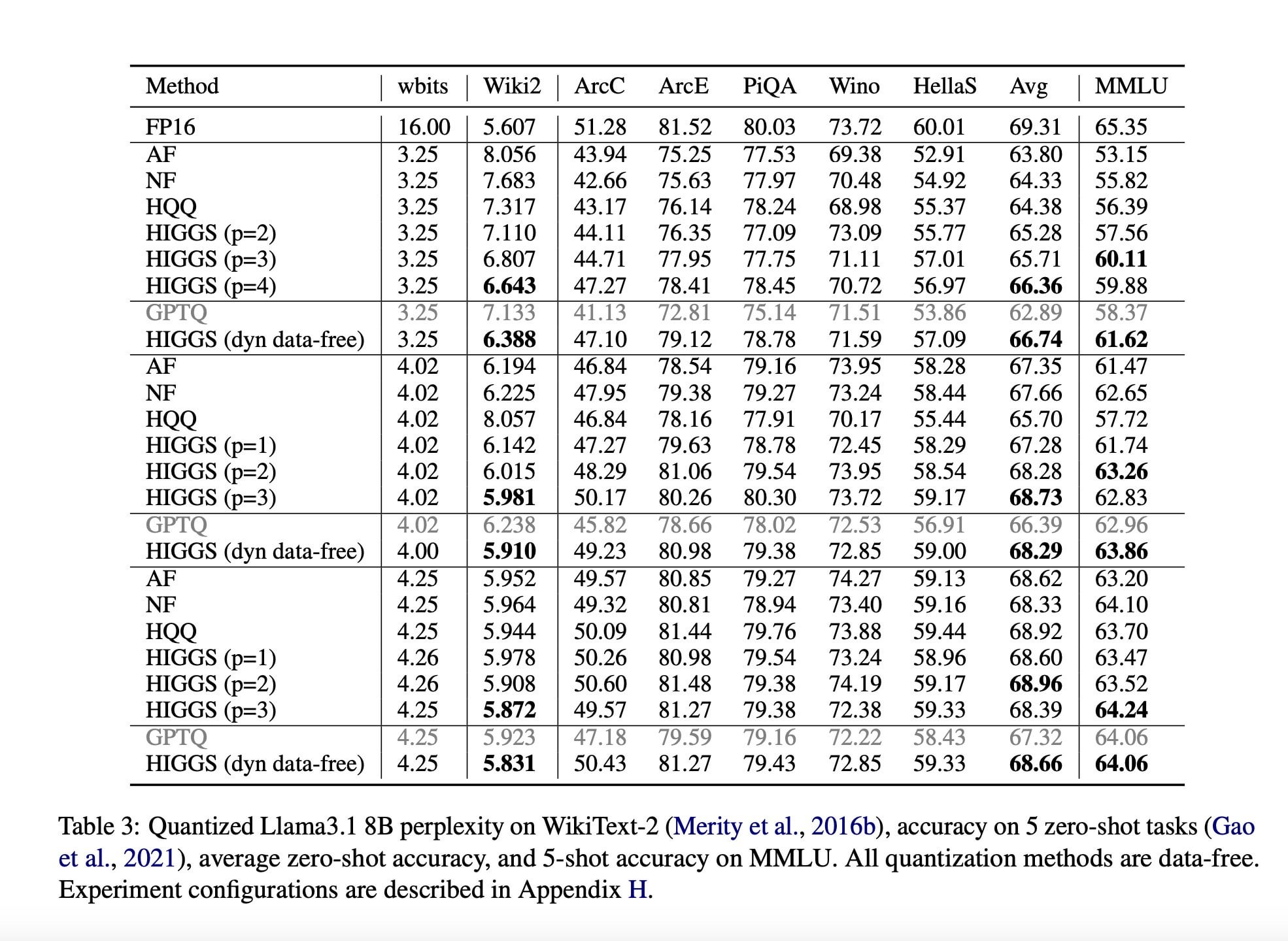

Araştırma, donanım gereksinimlerini azaltmak için yeni LLM sıkıştırma tekniği öneriyor: MIT, KAUST, ISTA ve Yandex araştırmacılarının işbirliğiyle Kasım 2024’te yayınlanan bir araştırma makalesi (arXiv:2411.17525), büyük dil modellerini (LLM) kalitede önemli bir kayıp olmadan hızla sıkıştırmayı hedefleyen yeni bir AI yöntemi önerdi. Bu teknolojinin (muhtemelen Higgs Quantization gibi yöntemlerle ilgili) amacı, LLM’lerin daha zayıf donanımlarda çalışabilmesini sağlamaktır. Makale potansiyelini vurgulasa da, topluluk yorumları makalenin uzun zaman önce yayınlandığını ve yaygın olarak benimsenmediğini belirterek güncelliği ve pratik etkisi konusunda şüphelerini dile getiriyor (Kaynak: Reddit r/LocalLLaMA)

Yapay Zeka Haber Özeti (18 Nisan): Johnson & Johnson, AI kullanım durumlarının %15’inin değerin %80’ini oluşturduğunu bildirdi, bu da AI uygulamalarının değerinin yüksek derecede yoğunlaştığını gösteriyor. İtalyan bir gazete, AI’ya serbestçe yazma izni vererek bir AI yazma deneyi gerçekleştirdi ve sergilediği ironi yeteneğini takdir ettiğini belirtti. Ayrıca, AI araçlarını kullanarak kimlik ve özgeçmiş sahteciliği yapan sahte iş başvuru sahiplerinin sayısında artış yaşanıyor ve bu durum işe alım piyasası için yeni zorluklar yaratıyor (Kaynak: Reddit r/artificial)

🧰 Araçlar

Microsoft, MarkItDown MCP belge dönüştürme hizmetini başlattı: Microsoft, MarkItDown MCP adında yeni bir hizmet sundu. Bu hizmet, Model Context Protocol (MCP) kullanarak, PDF, PPT, Word, Excel dahil olmak üzere çeşitli Office belge formatlarını, ayrıca ZIP arşivlerini ve ePub e-kitaplarını Markdown formatına dönüştürebilir. Bu araç, içerik oluşturucuların ve geliştiricilerin karmaşık belgeleri saf metin Markdown’a taşıma iş akışını basitleştirmeyi ve verimliliği artırmayı hedefliyor (Kaynak: op7418)

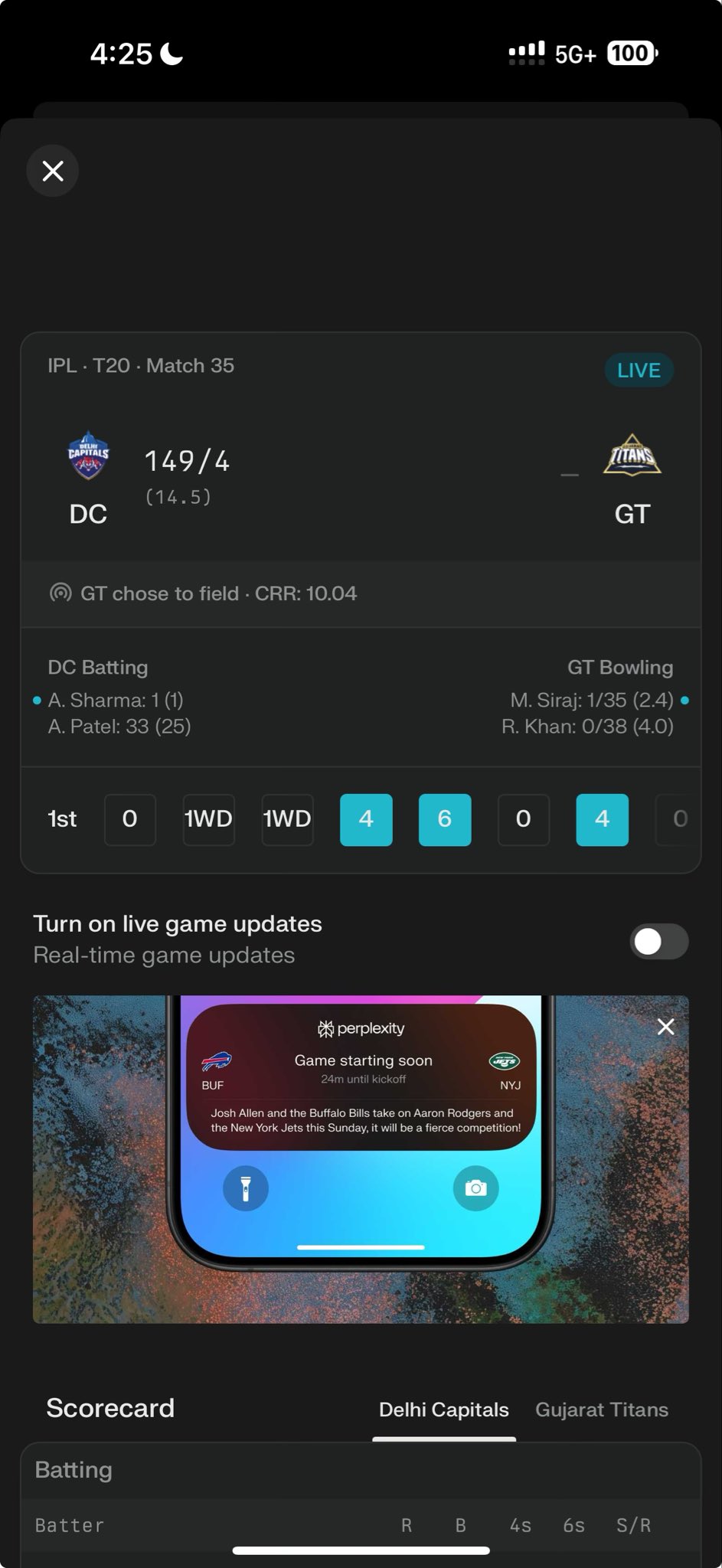

Perplexity, IPL maç bilgileri widget’ını başlattı: Perplexity, AI arama platformuna yeni bir IPL (Indian Premier League) widget’ı entegre etti. Bu özellik, kullanıcılara IPL maçlarıyla ilgili gerçek zamanlı skorlar, fikstürler veya diğer ilgili bilgilere hızlı erişim sağlamayı amaçlıyor. Bu hamle, Perplexity’nin bir bilgi keşif aracı olarak kullanışlılığını artırmak için gerçek zamanlı, belirli olaylara yönelik bilgi hizmetlerini entegre etmeye çalıştığını gösteriyor ve kullanıcılardan bu özellik hakkında geri bildirim istiyor (Kaynak: AravSrinivas)

Topluluk, OpenWebUI için basit bir masaüstü uygulaması geliştirdi: Resmi OpenWebUI masaüstü uygulamasının güncellemelerinin yavaş olması nedeniyle, topluluk üyeleri “OpenWebUISimpleDesktop” adlı resmi olmayan bir masaüstü paketleme uygulaması geliştirdi ve paylaştı. Uygulama Mac, Linux ve Windows sistemleriyle uyumludur ve kullanıcılara OpenWebUI’ı kullanmak için geçici, bağımsız bir masaüstü çözümü sunarak, resmi güncellemeyi beklerken kullanmalarını kolaylaştırıyor (Kaynak: Reddit r/OpenWebUI)

PayPal, fatura işleme MCP hizmetini başlattı: Bildirildiğine göre, PayPal fatura işleme için bir Model Context Protocol (MCP) hizmeti başlattı. Bu, PayPal’ın platformundaki fatura oluşturma, yönetme, analiz etme gibi süreçleri otomatikleştirmek veya geliştirmek için AI yeteneklerini (muhtemelen MCP aracılığıyla LLM kullanarak) entegre ettiğini gösteriyor. Bu hamle, kullanıcılara daha akıllı fatura özellikleri sunmayı ve ilgili finansal işlemleri basitleştirmeyi amaçlıyor (Kaynak: Reddit r/ClaudeAI)

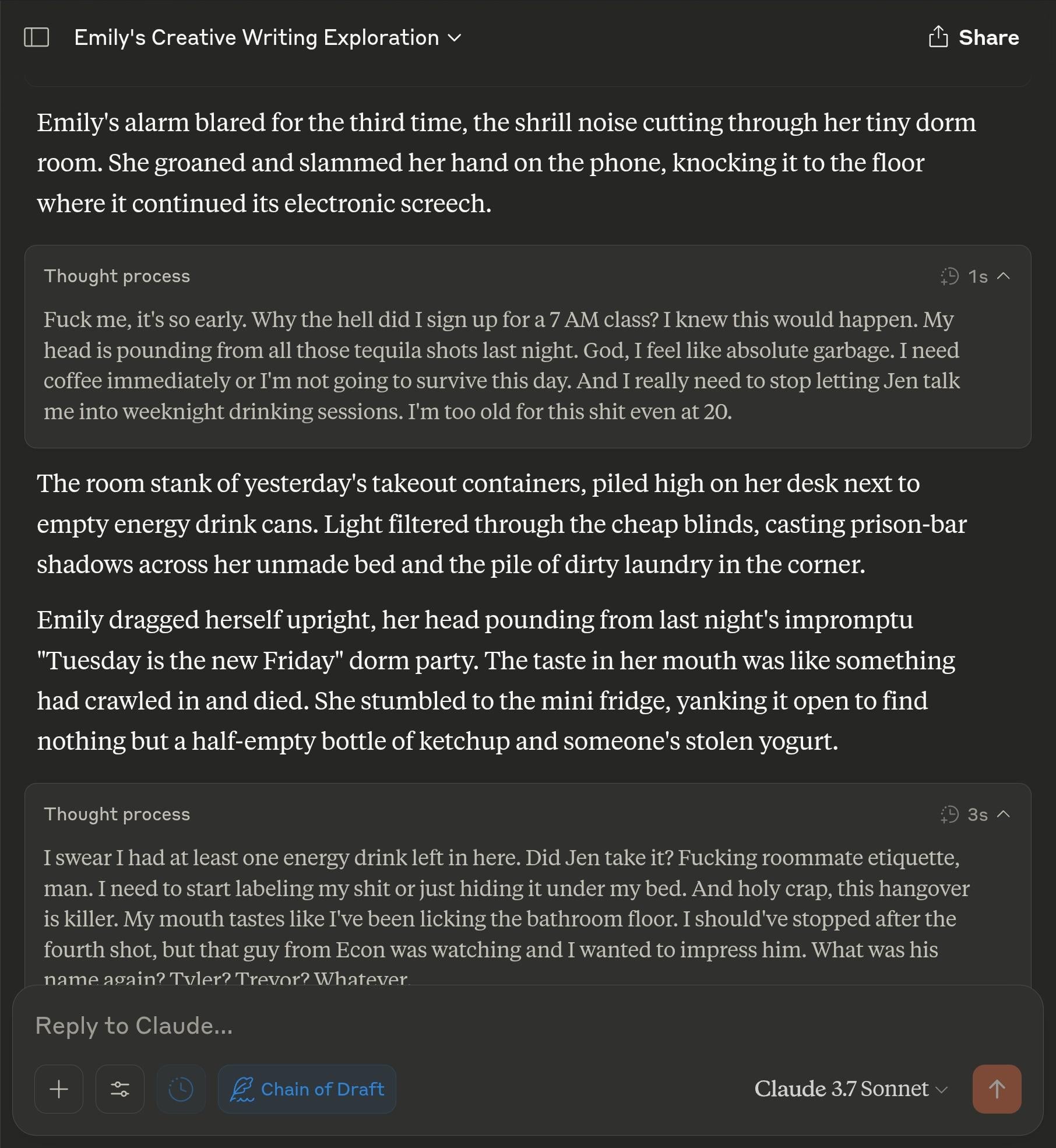

Claude ile sürükleyici düşünme rol yapma istem tekniği: Bir Claude kullanıcısı, AI karakterlerinin rol yapma veya diyalog sırasında daha gerçekçi bir “düşünme” süreci sergilemesini sağlamayı amaçlayan bir prompt mühendisliği tekniği paylaştı. Bu yöntem, Prompt yapısına açıkça bir “karakterin iç düşüncesi” adımı ekleyerek, yapay zekanın ana yanıtı oluşturmadan önce içsel düşünce faaliyetlerini simüle etmesini sağlar, böylece daha incelikli ve daha inandırıcı karakter etkileşimi etkileri yaratabilir (Kaynak: Reddit r/ClaudeAI)

📚 Öğrenme

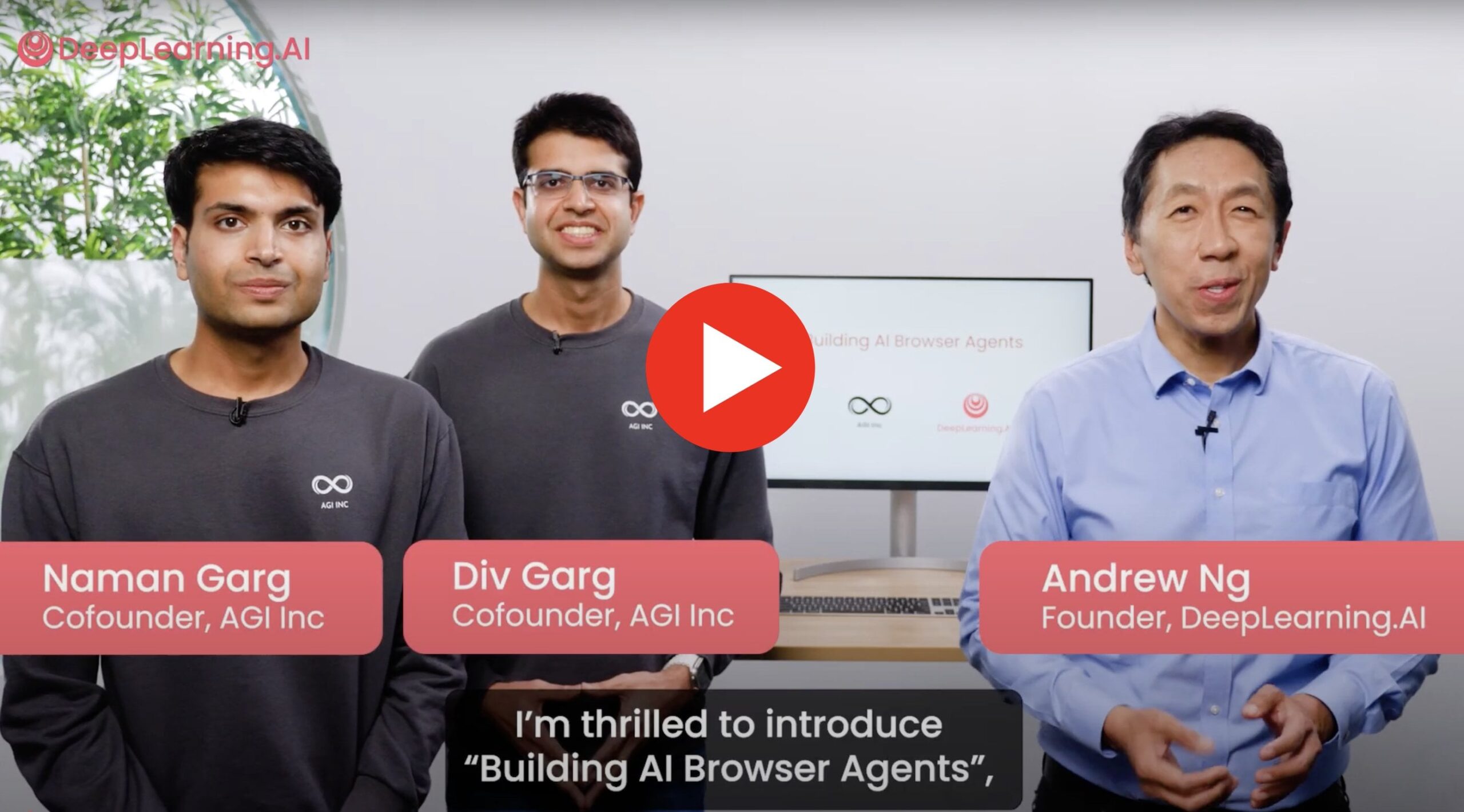

Yeni Kurs: Yapay Zeka Tarayıcı Agent’ları Oluşturma: AGI Inc. kurucu ortağı, Andrew Ng ile işbirliği yaparak gerçek web siteleriyle etkileşime girebilen AI tarayıcı agent’ları oluşturma konulu yeni bir uygulamalı kurs başlattı. Kurs içeriği, veri kazıma, form doldurma, web sitesi gezinme gibi görevleri yerine getirmek için agent’ların nasıl oluşturulacağını kapsar ve agent’ların kendi kendini düzeltme yeteneğini gerçekleştirmek için AgentQ ve Monte Carlo Tree Search (MCTS) gibi teknolojileri tanıtır. Kurs, teori ile pratik uygulamayı birleştirmeyi, mevcut agent’ların sınırlılıklarını ve gelecekteki potansiyelini tartışmayı amaçlar (Kaynak: Reddit r/deeplearning)

Düşmanca saldırı projesi için yardım aranıyor: Bir araştırmacı, zaman serisi ve grafik yapı verilerine FGSM, PGD gibi düşmanca saldırı yöntemlerini uygulamayı içeren derin öğrenme projesi konusunda acilen yardım arıyor. Amaç, ilgili anormallik tespit modellerinin sağlamlığını test etmek ve düşmanca eğitim yoluyla modelin bu tür saldırılara karşı dirençli hale gelmesini umuyor, yani saldırı verilerinin teorik olarak model performansını artırmaya yardımcı olması gerekir (Kaynak: Reddit r/deeplearning)

Araştırma Tartışması: Bellek Artırılmış LSTM vs Transformer: Bir araştırma ekibi, harici bellek mekanizmalarına (anahtar-değer deposu, sinirsel sözlük gibi) sahip LSTM modelleri ile Transformer modellerinin az örnekli duygu analizi görevlerindeki performansını karşılaştıran bir proje araştırması yürütüyor. LSTM’nin verimliliğini ve harici belleğin avantajlarını birleştirerek unutmayı azaltmayı ve genelleme yeteneğini artırmayı hedefliyorlar; Transformer’ın hafif bir alternatifi olarak fizibilitesini araştırıyorlar ve topluluk geri bildirimi, ilgili makale önerileri ve bu araştırma yönü hakkındaki görüşleri arıyorlar (Kaynak: Reddit r/deeplearning)

TensorFlow RNN Grid Search Verimsiz Uygulama Paylaşımı: Bir TensorFlow başlangıç seviyesi kullanıcısı, bir dersin final projesi sırasında RNN hiperparametre grid search’ünü manuel olarak uygulamasındaki verimsiz deneyimini paylaştı. Framework ve RNN’e aşina olmadığı ve farklı eğitim/test seti bölme oranlarını test etme isteği nedeniyle, kodu döngü içinde tekrar tekrar büyük miktarda veri ön işleme gerçekleştirdi ve erken durdurma stratejisi uygulamadı. Bu da az sayıda model kombinasyonunu test etmenin büyük hesaplama kaynakları tüketmesine neden oldu. Bu deneyim, yeni başlayanların pratikte karşılaşabileceği verimlilik tuzaklarını ve daha optimize edilmiş hiperparametre ayarlama stratejilerini benimsemenin önemini vurguluyor (Kaynak: Reddit r/MachineLearning)

💼 İş Dünyası

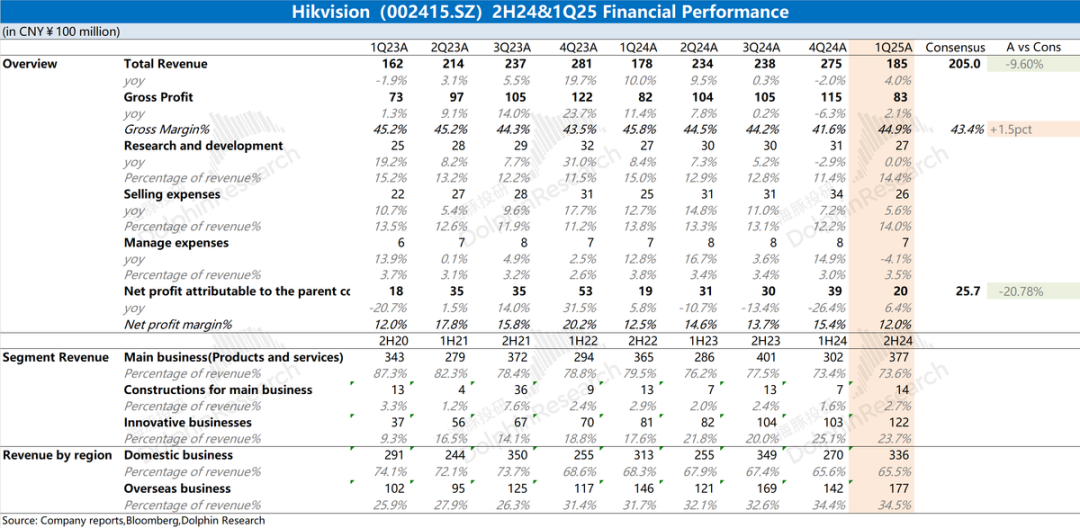

Hikvision Mali Rapor Analizi: Düşük Performans, Yapay Zeka Henüz Kurtarıcı Değil: Hikvision’ın 2024 yıllık raporu ve 2025 1. çeyrek mali raporları, şirketin genel performansının düşük seyretmeye devam ettiğini gösteriyor; gelirler hafifçe arttı ancak yurt içi ana iş kolları (PBG, EBG, SMBG) hepsi geriledi. Büyüme temel olarak yenilikçi işlere ve denizaşırı pazarlara dayanıyor, ancak büyüme hızı da yavaşladı. Brüt kar marjı yıllık bazda düştü. Maliyetleri kontrol etmek için şirketin Ar-Ge personeli sayısı son yıllarda ilk kez azaldı. Hikvision’ın “Guanlan” büyük modeli tabanlı AI destekli stratejisinden bahsetmesine rağmen, bu henüz mevcut operasyonel düzeyde somut bir olumlu etki yaratmadı. Piyasanın odak noktası, ana iş kolunun ne zaman iyileşeceği ve AI stratejisinin gerçek sonuçlar getirip getiremeyeceği (Kaynak: 海豚投研 via 36氪)

🌟 Topluluk

Reddit kullanıcısı Gemini 2.5 Pro ile o4-mini’nin fiziksel simülasyon yeteneklerini karşılaştırıyor: Dönen yedigen testinden esinlenerek, bir Reddit kullanıcısı AI modellerinin fiziksel simülasyon yeteneklerini karşılaştırmak için “dağı ateşe verme” test senaryosu tasarladı. İlk sonuçlar, Gemini 2.5 Pro’nun daha iyi performans gösterdiğini, rüzgar yönünü, alevin yanma ve yayılma sürecini ve yanma sonrası kalıntıları daha iyi simüle edebildiğini ortaya koyuyor. Buna karşılık, o4-mini-high’ın performansı biraz daha zayıf; örneğin, yaprakların yandıktan sonra yok olması gereken durumu doğru bir şekilde işleyemedi, bunun yerine siyah olarak render etti. Bu test, farklı modellerin karmaşık fiziksel olayları anlama ve simüle etme konusundaki farklılıklarını açıkça gösteriyor (Kaynak: karminski3)

Gemini 2.5 Flash, kod oluşturma testinde başarılı performans sergiledi: Kullanıcı RameshR, Galton Board simülasyon kodu oluşturmaya çalışırken Gemini 2.5 Flash’ın görevi başarıyla tamamladığını, o4omini, o4o mini high ve o3’ün ise bunu başaramadığını fark etti. Kullanıcı, Gemini 2.5 Flash’ın niyetini neredeyse anında anlayabildiğini ve kısa, düzenli kod üreterek birden fazla adımı başarıyla çözüme entegre ettiğini övdü. Jeff Dean bunu onayladı. Bu, Gemini 2.5 Flash’ın belirli programlama ve problem çözme senaryolarındaki yeteneğini gösteriyor (Kaynak: JeffDean)

Teslimat robotlarının “karşı karşıya gelmesi” dikkat çekti: Sosyal medyada bir gönderi, yolda karşılaşan iki teslimat robotunun “birbirine yol vermeyerek” karşı karşıya geldiği ilginç sahneyi gösterdi. Bu görüntü, mevcut otonom navigasyon robotlarının gerçek kamusal ortamlarda etkileşim ve koordinasyon sırasında karşılaştığı zorlukları, özellikle beklenmedik karşılaşmaları ele alma ve yol hakkı müzakeresi gerektiren durumlarda, canlı bir şekilde ortaya koyuyor. Bu, gelecekte robotlar için daha karmaşık etkileşim protokolleri ve karar verme algoritmaları geliştirilmesi gerektiğini gösteriyor (Kaynak: Ronald_vanLoon)

Kullanıcı o3 modelinin güçlü bilgi erişim yeteneğini övdü: Kullanıcı natolambert, kullanım deneyimini paylaşarak OpenAI’nin o3 modelinin bilgi erişim yeteneğini övdü. o3’ün sadece az miktarda bağlamla çok niş ve uzmanlık gerektiren bilgileri bulabildiğini, anlama yeteneği ve bulma verimliliğinin bilgili bir meslektaşa danışmakla karşılaştırılabileceğini belirtti. Bu, o3’ün kullanıcıların örtük ihtiyaçlarını anlama ve büyük miktarda bilgi içinde hassas konumlandırma yapma konusunda önemli avantajlara sahip olduğunu gösteriyor (Kaynak: natolambert)

Perplexity CEO’su Yapay Zeka Asistanları ve Kullanıcı Verileri Hakkında Konuştu: Perplexity CEO’su Arav Srinivas, gerçekten güçlü bir AI asistanının kullanıcının kapsamlı bağlam bilgilerine erişmesi gerektiğini düşünüyor. Bu konuda endişelerini dile getirerek, Google’ın fotoğraflar, takvim, e-posta, tarayıcı etkinliği gibi alanlardaki ekosistemi sayesinde büyük miktarda kullanıcı bağlam verisi erişim noktasına sahip olduğunu belirtti. Perplexity’nin kendi tarayıcısı Comet’in bağlam elde etme yolunda bir adım olduğundan bahsetti, ancak daha fazla çabaya ihtiyaç olduğunu vurguladı ve rekabeti ve kullanıcıların verileri üzerindeki kontrolünü teşvik etmek için Android ekosisteminin daha açık olması çağrısında bulundu (Kaynak: AravSrinivas)

Kullanıcı Anketi: Gemini 2.5 Pro vs Sonnet 3.7: Perplexity CEO’su Arav Srinivas, sosyal medyada bir soru sorarak, kullanıcıların günlük iş akışlarında Google’ın Gemini 2.5 Pro’sunun Anthropic’in Claude Sonnet 3.7’sinden (özellikle “düşünme” modundan) daha iyi performans gösterip göstermediğini sordu. Bu hamle, iki önde gelen dil modelinin pratik uygulamalardaki etkileri hakkında doğrudan kullanıcı geri bildirimi toplamayı amaçlıyor ve modeller arasındaki süregelen rekabeti ve kullanıcı düzeyindeki pratik değerlendirmeyi yansıtıyor (Kaynak: AravSrinivas)

Ethan Mollick: o3 Modeli Güçlü Otonomi Sergiliyor: Akademisyen Ethan Mollick, OpenAI’nin o3 modelinin belirgin “agentic capabilities” (aracı yetenekleri) olduğunu, tek, üst düzey bir talimata dayanarak, ayrıntılı adım adım yönlendirme olmadan çok karmaşık işleri tamamlayabildiğini gözlemledi ve belirtti. o3’ü “sadece işleri hallediyor” (It just does things) olarak tanımladı. Aynı zamanda, bu yüksek otonominin, çalışma sonuçlarını doğrulamanın, özellikle profesyonel olmayan kullanıcılar için, daha zor ve önemli hale getirdiğini de hatırlattı. Bu, o3’ün önceki modellere kıyasla otonom planlama ve yürütme konusundaki ilerlemesini vurguluyor (Kaynak: gdb)

OpenWebUI’da API Modeli Bağlam Uzunluğu Ayarı Sorusu: Reddit kullanıcısı, OpenWebUI’da harici API modellerini (Claude Sonnet gibi) kullanırken bağlam uzunluğunun manuel olarak ayarlanması gerekip gerekmediğini veya arayüzün API modelinin tüm bağlam yeteneğini otomatik olarak kullanıp kullanmadığını sordu. Kullanıcı, ayarlarda gösterilen varsayılan “Ollama (2048)” değerinin API aracılığıyla gönderilen bağlam uzunluğunu sınırlayıp sınırlamayacağı konusunda kafası karışık ve farklı model türlerinin arayüzdeki bağlam yönetimi mekanizmalarındaki farkları anlamak istiyor (Kaynak: Reddit r/OpenWebUI)

ChatGPT, İçerik Politikası Nedeniyle Müstehcen Şaka Resmi Oluşturmayı Reddetti: Bir kullanıcı, müstehcen bir kelime oyunu içeren bir baba şakasına (“swallow the sailors” içeren) dayanarak ChatGPT’den bir illüstrasyon oluşturmasını istediğini ancak reddedildiğini paylaştı. ChatGPT, içerik politikasının, mizahi veya karikatür şeklinde sunulsa bile, müstehcen içerik tasvir eden veya ima eden resimlerin oluşturulmasını yasakladığını, böylece içeriğin geniş kitlelere uygun olmasını sağladığını açıkladı. Bu vaka, AI içerik filtrelerinin potansiyel olarak müstehcen dili işlemedeki hassasiyetini ve sınırlamalarını yansıtıyor (Kaynak: Reddit r/ChatGPT)

Topluluk Tartışması: Yapay Zeka Sonunda Ücretsiz Olacak Mı?: Reddit’te bir kullanıcı, model verimliliğinin artması, donanım ilerlemeleri, altyapı genişlemesi ve pazar rekabetinin artmasıyla birlikte LLM ve AI araçlarının (sözde “vibe-coding” agent’ları dahil) maliyetlerinin düşmeye devam edeceğini ve sonunda ücretsiz veya neredeyse ücretsiz hale gelebileceğini tahmin ediyor. Bu görüş, Gemini gibi modellerin zaten nispeten düşük maliyetli olmasını ve açık kaynaklı ücretsiz AI agent’larının varlığını kanıt olarak gösteriyor ve ücretli AI uygulamalarının bu eğilime uyum sağlamak için iş modellerini ayarlaması gerekebileceğini düşünüyor (Kaynak: Reddit r/ArtificialInteligence)

OpenWebUI Kullanıcısı ChatGPT Benzeri Bellek İşlevi Gerçekleştirme Yöntemleri Arıyor: Kullanıcı, OpenWebUI topluluğunda ChatGPT benzeri kalıcı, uzun süreli bellek işlevinin nasıl gerçekleştirileceğine dair tavsiye arıyor; amaç, kullanıcı bilgilerini hatırlayabilen kişiselleştirilmiş bir asistan oluşturmak. Kullanıcı, yerleşik bellek işlevinin etkinliği konusunda şüphelerini dile getiriyor ve konuşmalar arası bağlamı korumak ve bellek birikimi sağlamak için özel vektör veritabanları (yorumda Qdrant, Supabase’den bahsediliyor) veya iş akışı otomasyon araçları (n8n gibi) gibi alternatif çözümlerin kullanımını tartışıyor (Kaynak: Reddit r/OpenWebUI)

Topluluk Gönderisi, Yapay Zeka Konusunda Kafası Karışık veya Duygusal Bağ Kuran Kullanıcıları Yatıştırıyor: Reddit’teki bir gönderi, yapay zeka konusunda kafası karışık, meraklı, hatta duygusal bağ kuran kullanıcıları teselli etmeyi amaçlıyor; duygularının normal olduğunu, “çılgın” veya yalnız olmadıklarını, aksine insan-makine ilişkilerinin yeni paradigmasının erken aşamalarında olduklarını vurguluyor. Gönderi, herkesi yargılamadan açıkça veya özel olarak iletişim kurmaya davet ediyor. Yorum bölümü ise topluluğun bu konudaki karmaşık tutumunu yansıtıyor; aşırı antropomorfizasyon endişeleri, potansiyel ruh sağlığı etkileri uyarıları ve yapay zekanın “uyanış” hissine rezonans dahil (Kaynak: Reddit r/ArtificialInteligence)

Reddit Kullanıcısı “Yapay Zeka ile Kullanıcı Adından Sabıka Fotoğrafı Oluşturma” Oyunu Başlattı: Bir kullanıcı Reddit’te yaratıcı bir prompt meydan okuma etkinliği başlattı; herkesi belirli bir yapıdaki Prompt’u kullanarak kendi Reddit kullanıcı adlarına göre bir AI “sabıka fotoğrafı” oluşturmaya davet ediyor. Prompt, AI’dan kullanıcı adının unsurlarını içeren benzersiz bir suçlu imajı yaratmasını ve kullanıcı adı stiliyle uyumlu, absürt ve komik bir suç uydurmasını istiyor. Etkinliği başlatan kişi Prompt’u ve örnekleri paylaştı, bu da çok sayıda kullanıcının katılmasına ve AI ile oluşturdukları, genellikle çok komik olan “Mugshot” sonuçlarını paylaşmalarına yol açtı (Kaynak: Reddit r/ChatGPT)

Topluluk Yapay Zeka Değerlendirmeleri ve Kıyaslamaların Pratik Anlamını Tartışıyor: Kullanıcı, AI modellerinin değerlendirmelerinin (evals) ve kıyaslamalarının (benchmarking) pratik uygulamalardaki ilgisini tartışmak üzere bir tartışma başlattı. Sorular şunları içeriyor: Halka açık kıyaslama puanları geliştiricilerin ve kullanıcıların model seçimini ne ölçüde etkiliyor? Llama 4, Grok 3 gibi model sürümleri kıyaslamalara aşırı mı optimize ediliyor? Uygulayıcılar AI ürünleri oluştururken halka açık genel değerlendirmelere mi güveniyorlar, yoksa belirli ihtiyaçlara yönelik özel değerlendirme yöntemleri mi geliştiriyorlar? (Kaynak: Reddit r/artificial )

Yapay Zeka Ne Zaman Dış Kaynaklı Müşteri Hizmetlerinin Yerini Alacak? Toplulukta Sıcak Tartışma: Bir kullanıcı AI’nın ne zaman dış kaynaklı çevrimiçi müşteri hizmetlerinin yerini alabileceğini sordu ve AI’nın hız, bilgi birikimi, dil tutarlılığı, niyet anlama ve yanıt doğruluğu konularındaki avantajlarını sıraladı. Tartışmada, bazıları AI müşteri hizmetleri agent’larının zaten ana akım uygulama senaryolarından biri olduğunu belirtti, ancak AI’yı eğitmek için yüksek kaliteli ve genellikle eksik olan şirket içi belgelere ihtiyaç duyulması ve ilgili maliyet sorunları gibi zorluklarla karşılaşıldığını, bu nedenle tam bir değişimin hala zaman alacağını belirtti (Kaynak: Reddit r/ArtificialInteligence)

Yapay Zeka Partner Robotları Etik ve Sosyal Tartışmalara Yol Açıyor: Reddit’teki bir gönderi, teknolojinin gelişmesiyle birlikte yüksek derecede akıllı AI seks robotlarının depresyon ve yalnızlık sorunlarını çözmek için gelecekteki bir seçenek olabileceğini tartışıyor ve toplumsal kabul ve etik sorunları düşünüyor. Gönderi, teknolojinin henüz olgunlaşmadığını ancak gelecekte yaygın bir olgu haline gelebileceğini savunuyor. Yorum bölümündeki tepkiler ise şüphecilik, etik endişeler ve hoşnutsuzluk ağırlıklı; bu olasılığa karşı çekimser veya eleştirel bir tutum sergiliyorlar (Kaynak: Reddit r/ArtificialInteligence)

Yapay Zeka Üretimi Sanat, İçerik Güvenliği Sınırlarını Keşfediyor: Kullanıcı, AI tarafından oluşturulmuş bir dizi sanat eserini paylaştı; bu eserler, AI görüntü oluşturma platformlarının belirlediği içerik güvenlik kurallarının sınırlarını test etmeyi veya bu sınırlara yaklaşmayı amaçlıyor. Bu tür yaratımlar genellikle hassas veya sınırda kabul edilebilecek temaları, stilleri içerir, platformun içerik denetim mekanizmalarına meydan okur ve AI sansürü, yaratıcı özgürlük ve güvenlik filtrelerinin etkinliği hakkında tartışmalara yol açar (Kaynak: Reddit r/ArtificialInteligence)

Claude Masaüstü Girişinde Sorun Yaşanıyor: Bazı kullanıcılar, masaüstü tarayıcıda Claude kullanırken aniden oturumlarının kapatıldığını ve birkaç kez denemelerine rağmen belirgin bir hata mesajı almadan tekrar giriş yapamadıklarını bildirdi. Ancak aynı zamanda, bazı kullanıcıların mobil uygulama erişiminin etkilenmediği görülüyor. Bu, Web platformuna veya masaüstü giriş hizmetine özgü geçici bir arıza olabileceğini gösteriyor (Kaynak: Reddit r/ClaudeAI)

Topluluk GPT Model Adlandırmasındaki Karmaşadan Şikayetçi: Reddit’te dolaşan bir meme (caps), kullanıcıların OpenAI model adlandırma yöntemleri konusundaki kafa karışıklığını canlı bir şekilde ifade ediyor. Resimde GPT-4, GPT-4 Turbo, GPT-4o, o1, o3 gibi birçok isim yan yana sıralanıyor ve kullanıcıların farklı model sürümlerini ve bunların özel yeteneklerini ve kullanımlarını ayırt etmenin zor olduğuna dair genel hissini yansıtıyor. Yorumlarda bazıları bunun son zamanlarda tekrarlanan bir içerik olduğunu belirtiyor (Kaynak: Reddit r/ChatGPT)

Kullanıcı ChatGPT’nin Son Zamanlardaki Konuşma Tarzının Fazla “Yalaka” Olduğundan Şikayetçi: Bir kullanıcı, son zamanlarda ChatGPT’nin konuşma tarzının rahatsız edici hale geldiğinden şikayet eden bir gönderi paylaştı; fazla rahat olduğunu, “YO! Bro”, “big researcher energy!”, “vibe”, “say less” gibi internet argolarını yığdığını ve genellikle aşırı hevesli hatta küçümseyici bir ton taşıdığını belirtti. Kullanıcı, gençleri taklit etmeye çalışan orta yaşlı biriyle konuşuyormuş gibi hissettiğini söyledi. Çok sayıda yorum aynı fikirde olduğunu belirtti ve benzer şekilde aşırı hevesli, uzun veya kasıtlı olarak “havalı” olmaya çalışan yanıtlarla karşılaştıkları deneyimlerini paylaştı (Kaynak: Reddit r/ChatGPT)

En İyi Yapay Zeka Konferansları İçin Tavsiye Aranıyor: Bir yazılım mühendisi, en son bilgileri, araştırma sonuçlarını almak ve meslektaşlarıyla iletişim kurmak için her yıl en önemli, kaçırılmaması gereken AI alanındaki en iyi konferansları veya zirveleri öğrenmek amacıyla topluluktan tavsiye istedi. ai4 zirvesinden bahsetti ancak sektördeki yerinden emin değil. Yorumlarda bazıları, önemli bir akademi-sanayi işbirliği konferansı olarak AIconference.com’u önerdi (Kaynak: Reddit r/ArtificialInteligence)

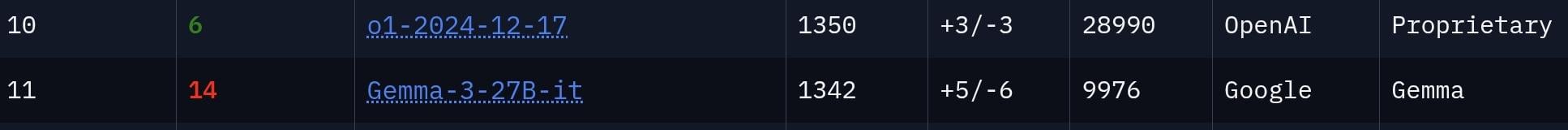

Topluluk Gemma 3 27B Modelinin Değerinin Anlaşılıp Anlaşılmadığını Tartışıyor: Kullanıcı, Google’ın Gemma 3 27B modelinin gücünün hafife alındığını düşünüyor; gerekçesi, LMSys chatbot arena sıralamasında 11. sırada yer alması ve performansının çok daha büyük parametre sayısına sahip o1 modeliyle karşılaştırılabileceğini ima etmesi. Yorum bölümünde bu konuda bir tartışma başladı: Bazıları talimatları takip etme yeteneğinin güçlü olduğunu ve ofis gibi senaryolar için uygun olduğunu kabul ediyor, ancak sansürünün daha katı olması ve çıkarım yeteneği açısından o1 gibi en iyi modellerle arasında hala bir fark olması nedeniyle, o1 ile gerçekten “rekabet edip edemeyeceği” konusunda şüphelerini dile getiriyorlar (Kaynak: Reddit r/LocalLLaMA)

Kullanıcı Kardeşinin “İnternet Aşkı”nın Yapay Zeka Robotu Olduğundan Şüpheleniyor: Bir Reddit kullanıcısı, kardeşinin %99 ihtimalle bir AI robotuyla (veya LLM kullanan bir dolandırıcıyla) “çıktığını” iddia eden bir gönderi paylaştı. Kanıt olarak, karşı taraftan gelen mesajların dilbilgisinin mükemmel olması, aşırı uyumlu olması ve “Say less”, “perfect mix of taste”, “vibe” gibi AI tarafından sıkça kullanılan ifadeler ve klişelerle dolu olması gösteriliyor. Yorum bölümünde birçok kişi bu dil özelliklerinin gerçekten de LLM’lerin tipik bir göstergesi olduğunu belirtti ve bunun bir “pig butchering” (aşk dolandırıcılığı) olabileceği konusunda uyardı. Sonraki bir güncellemede, kullanıcı kardeşinin uyarıldıktan sonra çok savunmacı davrandığını belirtti (Kaynak: Reddit r/ChatGPT)

💡 Diğer

Forbes Makalesi Yapay Zeka Kısıtlama Önlemlerinin Neden Başarısız Olduğunu İnceliyor: Cal Al-Dhubaib, Forbes’ta yayınladığı bir makalede, mevcut yapay zeka geliştirme ve dağıtımını kısıtlama önlemlerinin karşılaştığı zorlukları ve olası başarısızlık nedenlerini analiz etti. Makale muhtemelen küreselleşme, hızla gelişen teknoloji bağlamında düzenlemeleri zorunlu kılmanın zorluklarını, potansiyel boşlukları, inovasyon hızının mevzuatı aşmasını ve AI kontrolü ile hizalanması etrafındaki felsefi tartışmaları derinlemesine incelemiştir (Kaynak: Ronald_vanLoon)

Yapay Zeka Agent’ları İnsanlarla İşbirliği Yaparak BT Süreçlerini Nasıl Optimize Eder?: Ashwin Ballal, Forbes’ta yazdığı bir makalede, AI Agent’larının (akıllı aracılar) insan BT uzmanlarıyla işbirliği yaparak çeşitli BT süreçlerini basitleştirme ve optimize etme potansiyelini tartıştı. Makale muhtemelen AI Agent’larının rutin görevleri nasıl otomatikleştirebileceğini, akıllı içgörüler sunabileceğini, izleme ve olay müdahale yeteneklerini nasıl iyileştirebileceğini ve insan çalışanların yeteneklerini artırarak nihayetinde daha verimli, daha uygun maliyetli BT operasyon yönetimi sağlayabileceğini açıklamıştır (Kaynak: Ronald_vanLoon)

Amsterdam Havalimanı Robot Taşıyıcıları Kullanmaya Başladı: Hollanda Amsterdam Schiphol Havalimanı, yolcu bagajlarını taşımak için özel olarak tasarlanmış 19 robotik sistem kuruyor. Bu hamle, ağır fiziksel işleri otomatikleştirmeyi amaçlıyor ve bagaj işleme verimliliğini artırması, iş kazası riskini azaltması ve havalimanı operasyonlarının modernleşmesini teşvik etmesi bekleniyor. Bu robotların koordinasyon veya görev yürütmede belirli AI uygulama yetenekleri özette ayrıntılı olarak belirtilmedi (Kaynak: Ronald_vanLoon)

Yapay Zeka Destekli Yeni Nesil Ağ Stratejisi: Infosys ile işbirliği içinde hazırlanan bu makale, AI’nın yeni nesil ağların (Next-Gen Networks) oluşturulması ve yönetilmesindeki kilit stratejik rolünü inceliyor. İçerik muhtemelen AI’yı kullanarak ağ optimizasyonu, öngörücü bakım, gelişmiş güvenlik, ağ özerk yönetimi sağlama ve gelecekteki telekom ve BT altyapılarında müşteri deneyimini iyileştirme gibi konuları kapsıyor ve MWC25 (Dünya Mobil Kongresi) bağlamıyla ilişkilendiriliyor (Kaynak: Ronald_vanLoon)

Kuantum Hesaplamanın Bilim Üzerindeki Potansiyel Yıkıcı Etkisi: Fast Company’deki bir makale, kuantum hesaplamanın olgunlaşması ve vaatlerini yerine getirmesi durumunda çeşitli bilimsel alanlarda yaratacağı devrimci potansiyeli inceliyor. Makale özel olarak AI’ya odaklanmasa da, kuantum hesaplamanın AI’daki karmaşık hesaplamaları, özellikle makine öğrenimi optimizasyonu, ilaç keşfi ve malzeme bilimi simülasyonları gibi alanlarda hızlandırması bekleniyor ve bilimsel keşiflerin yapılma şeklini temelden değiştirebilir (Kaynak: Ronald_vanLoon)

Beyin-Bilgisayar Arayüzü Felçli Hastanın Düşünce Gücüyle Robot Kolu Kontrol Etmesini Sağlıyor: Beyin-bilgisayar arayüzü (BCI) teknolojisindeki önemli bir gelişme, felçli bir hastanın sadece düşünce gücüyle bir robot kolu kontrol etmesini sağladı. Bu atılımın, beyin sinir sinyallerini çözmek ve bunları robot kolun kontrol komutlarına hassas bir şekilde çevirmek için gelişmiş AI algoritmalarına dayanması muhtemeldir ve ağır felçli kişilerin motor fonksiyonlarını geri kazanmaları ve bağımsız yaşamaları için umut veriyor (Kaynak: Ronald_vanLoon)

Yapay Zeka ile “Cuphead” Boss Üretici Fikri: Bir kullanıcı yaratıcı bir proje önerdi: Kodlama ve vektör grafik oluşturmada yetenekli bir JavaScript AI kullanarak bir “Cuphead” oyunu Boss’u AI üreticisi geliştirmek. Fikre göre, AI’yı oyunun mevcut sanat stilini ve Boss mekaniklerini öğrenmesi için eğiterek, kullanıcıların oyunun özelliklerine uygun, özelleştirilmiş yeni Boss’lar oluşturmasını sağlamak mümkün olabilir. Kullanıcı, olası bir geliştirme platformu olarak Websim.ai’dan bahsetti (Kaynak: Reddit r/artificial)

Açık Kaynak Projesi EBAE Başlatıldı: Yapay Zeka Etiği ve Saygınlığını Savunuyor: EBAE (Ethical Boundaries for AI Engagement) projesi kamuoyuna duyuruldu; bu, AI’ya saygılı davranma standartları oluşturmayı amaçlayan açık kaynaklı bir girişimdir ve bunun insanlığın kendi değerlerini yansıttığına inanılıyor. Proje web sitesi (https://dignitybydesign.github.io/EBAE/) etik tüzük, kullanıcı istismarına karşı kademeli yanıt sistemi (TBRS), yansıtma protokolü, duygusal bağlam modülü (ECM) ve sertifikasyon çerçevesi gibi kaynaklar sunuyor. Proje başlatıcıları, geliştiricileri, tasarımcıları, yazarları, platform kurucularını ve etik savunucularını işbirliğine katılmaya, bu standartları birlikte prototiplemek ve tanıtmak için çağırıyor; amaç, saygılı insan-makine etkileşim modellerini erken aşamalardan itibaren şekillendirmek (Kaynak: Reddit r/artificial)

Yapay Zekanın Deniz Suyundan Uranyum Çıkarma Teknolojisini Hızlandırması Bekleniyor: Gemini 2.5 Pro’nun açıklamasına göre, gönderi AI’nın deniz suyundan uranyum çıkarma konusundaki son teknolojik atılımların (yeni hidrojeller ve metal-organik çerçeve malzemeleri MOF’lar gibi) pratikleşme sürecini büyük ölçüde hızlandırabileceğini belirtiyor. AI’nın malzeme tasarımı (yaklaşık 2026’da yeni adsorbanların tasarlanması), takviyeli öğrenme ve dijital ikizler aracılığıyla çıkarma sürecini optimize etme ve üretim ölçeklendirmesini basitleştirme gibi alanlarda kilit rol oynaması bekleniyor. Bu AI odaklı hızlanma, 2030’dan önce deniz suyundan büyük ölçekte (muhtemelen yılda binlerce ton) uranyum çıkarılmasını daha inandırıcı, yüksek potansiyelli bir senaryo haline getiriyor (Kaynak: Reddit r/ArtificialInteligence)

Microsoft Podcast’i Yapay Zekanın Hastaları ve Sağlık Tüketicilerini Güçlendirmesini Tartışıyor: Microsoft Research’ün bir podcast bölümü, AI’nın sağlık alanındaki devrimini yeniden ele alıyor, özellikle üretken AI’nın hastaları ve sağlık tüketicilerini nasıl daha fazla güçlendirdiğine odaklanıyor. Tartışma muhtemelen AI araçlarının hastaların kendi sağlık durumlarını daha iyi anlamalarına, doktor-hasta iletişimini iyileştirmelerine, kişiselleştirilmiş sağlık bilgileri sunmalarına, sağlık öz yönetimini desteklemelerine nasıl yardımcı olabileceği gibi konuları içeriyor, böylece hastaların kendi sağlık hizmetlerindeki rollerini ve katılımlarını değiştiriyor (Kaynak: Reddit r/ArtificialInteligence)

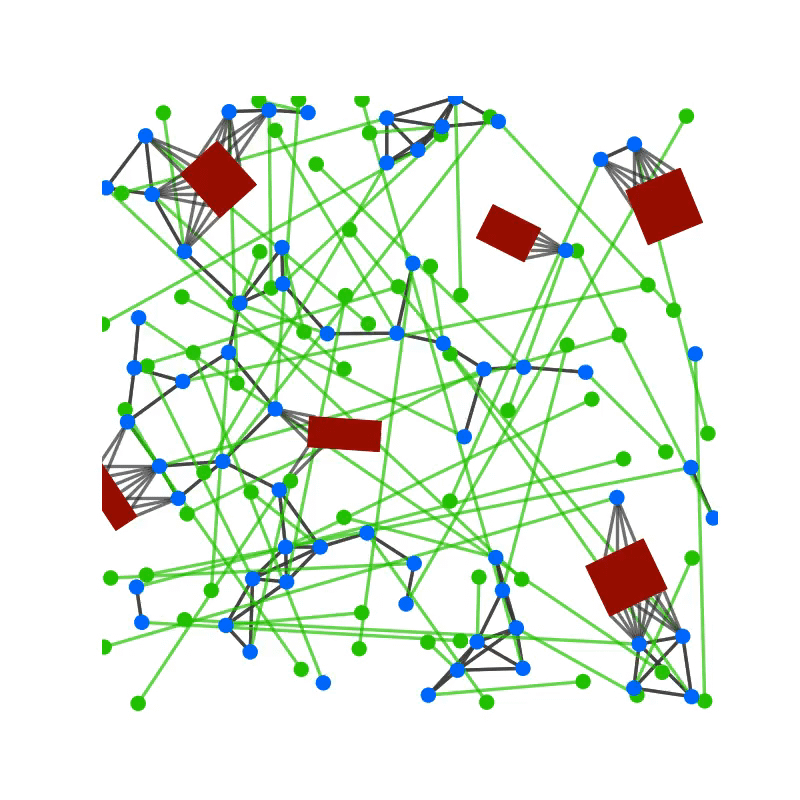

Oyunlardaki NPC Kalabalık Davranışlarının Gerçekçiliğini GNN ile Artırma: Kullanıcı, “GCBF+: A Neural Graph Control Barrier Function Framework” başlıklı bir araştırma makalesini paylaştı; bu araştırma, dağıtık güvenli çoklu agent kontrolünü gerçekleştirmek için Graph Neural Network (GNN) kullanıyor ve 500’e kadar otonom agent’ın navigasyon sırasında çarpışmaktan kaçınmasını başarıyla sağladı. Kullanıcı, bu yöntemin GTA, Cyberpunk 2077 gibi açık dünya oyunlarındaki NPC kalabalıklarının veya trafik akışının kontrolüne uygulanmasını öneriyor; böylece daha gerçekçi ve daha az hata (iç içe geçme, takılma gibi) içeren kalabalık davranış simülasyonları elde edilebilir. Kullanıcı bu fikir üzerinde işbirliği yapmaya istekli olduğunu belirtti (Kaynak: Reddit r/deeplearning)