Ключевые слова:Квантовый ИИ, GPT-5, Gemini 2.5, Imagine v0.9, Sora 2, ИИ-агент, Квантовый компьютер, Google Квантовый ИИ Нобелевская премия, Научные исследования и применение GPT-5, Использование Gemini 2.5 в компьютерах, Генерация видео с xAI Imagine, Предварительная версия OpenAI Sora 2

🔥 В центре внимания

Ученые Google Quantum AI получили Нобелевскую премию по физике: Главный научный сотрудник Google Quantum AI Michel Devoret и члены его команды John Martinis и John Clarke удостоены Нобелевской премии по физике 2025 года за новаторскую работу в области квантовой механики. Их исследования проложили путь к созданию квантовых компьютеров с коррекцией ошибок, что подчеркивает долгосрочные инвестиции и лидирующие позиции Google в области квантового AI, являясь важной вехой в этой сфере. (Источник: Google, demishassabis, Yuchenj_UW)

GPT-5 демонстрирует прорывной потенциал в научных исследованиях: Kevin Weil заявил, что GPT-5 преодолел значительный порог, и ученые успешно направляют GPT-5 на проведение новых исследований в области математики, физики, биологии, компьютерных наук и других. Хотя это все еще находится на стадии “леммы”, его способность выполнять ограниченную оригинальную научную работу под руководством экспертов обнадеживает и предвещает огромный потенциал AI в ускорении научных открытий. (Источник: SebastienBubeck, ericmitchellai, BorisMPower, lateinteraction)

🎯 Тенденции

Выпущен Google Gemini 2.5 Computer Use: Google DeepMind представил модель Gemini 2.5 Computer Use, которая позволяет AI-агентам напрямую взаимодействовать с веб-страницами и приложениями посредством кликов, прокрутки, ввода текста и других операций. Эта модель демонстрирует лидирующие результаты в нескольких бенчмарках, работает быстрее и имеет встроенные многоуровневые механизмы безопасности для противодействия потенциальным рискам. Это знаменует собой значительный прогресс в имитации AI-агентами человеческих компьютерных операций и предвещает трансформацию способов взаимодействия человека с компьютером в будущем. (Источник: 36氪, GoogleAIStudio, demishassabis, abacaj, scaling01, dotey, algo_diver)

xAI выпустила модель для генерации видео Imagine v0.9: xAI Илона Маска выпустила новейшую модель для генерации видео Imagine v0.9, доступную бесплатно всем пользователям. Модель получила обновления в качестве изображения, движении и генерации аудио, работает быстрее и поддерживает функцию пользовательского голоса. Несмотря на некоторые недостатки в понимании сложных подсказок и поддержке китайского языка, а также риски дипфейков, ее бесплатная доступность и высокая скорость генерации привлекли широкое внимание, создавая прямую конкуренцию Sora 2 от OpenAI. (Источник: 36氪, scaling01, nptacek, op7418, nptacek, TomLikesRobots)

Функция встроенных приложений в ChatGPT: OpenAI на Дне разработчика объявила, что ChatGPT теперь поддерживает встроенные приложения, такие как Booking.com, Canva, Spotify. Пользователи могут вызывать их напрямую с помощью подсказок или получать рекомендации от ChatGPT в зависимости от своих потребностей. Эти приложения естественно интегрируются в диалог и предоставляют интерактивный интерфейс. OpenAI также выпустила Apps SDK, чтобы стимулировать разработчиков создавать и тестировать приложения, и планирует запустить специальный каталог приложений для углубления экосистемы AI-приложений. (Источник: 量子位, TheRundownAI)

Выпущены GPT-5 Pro и GPT-Realtime-Mini: OpenAI на Дне разработчика открыла доступ к API GPT-5 Pro по цене 15 долларов за 1M входных токенов и 120 долларов за выходные, что выше по производительности и цене, чем GPT-5 и o3-pro. Одновременно была представлена меньшая и более дешевая голосовая модель GPT-Realtime-Mini, качество и выразительность голоса которой аналогичны существующим голосовым моделям, но цена снижена на 70%. (Источник: 量子位, TheRundownAI)

Выпущен предварительный просмотр Sora 2: OpenAI на Дне разработчика представила предварительный просмотр Sora 2, продемонстрировав ее возможности в синхронной генерации аудио и видео, контроле длительности видео, соотношения сторон и разрешения. Этот прогресс еще больше укрепил лидирующие позиции OpenAI в области генерации видео, предоставив создателям более мощные инструменты и предвещая огромные изменения в создании видеоконтента в будущем. (Источник: 量子位, TheRundownAI)

Выпущена MoE-модель с открытым исходным кодом LFM2-8B-A1B: Liquid AI выпустила свою первую MoE-модель для устройств LFM2-8B-A1B с общим количеством параметров 8.3B, где каждый токен активирует только 1.5B параметров. Модель по качеству сопоставима с плотными моделями 3-4B, но работает быстрее, чем Qwen3-1.7B, разработана специально для мобильных телефонов/ноутбуков и других устройств, объем предварительно обученных данных достигает 12T токенов, демонстрируя выдающиеся результаты в математике, коде и IF. (Источник: huggingface, huggingface, mervenoyann, tokenbender, dl_weekly, teortaxesTex, Plinz)

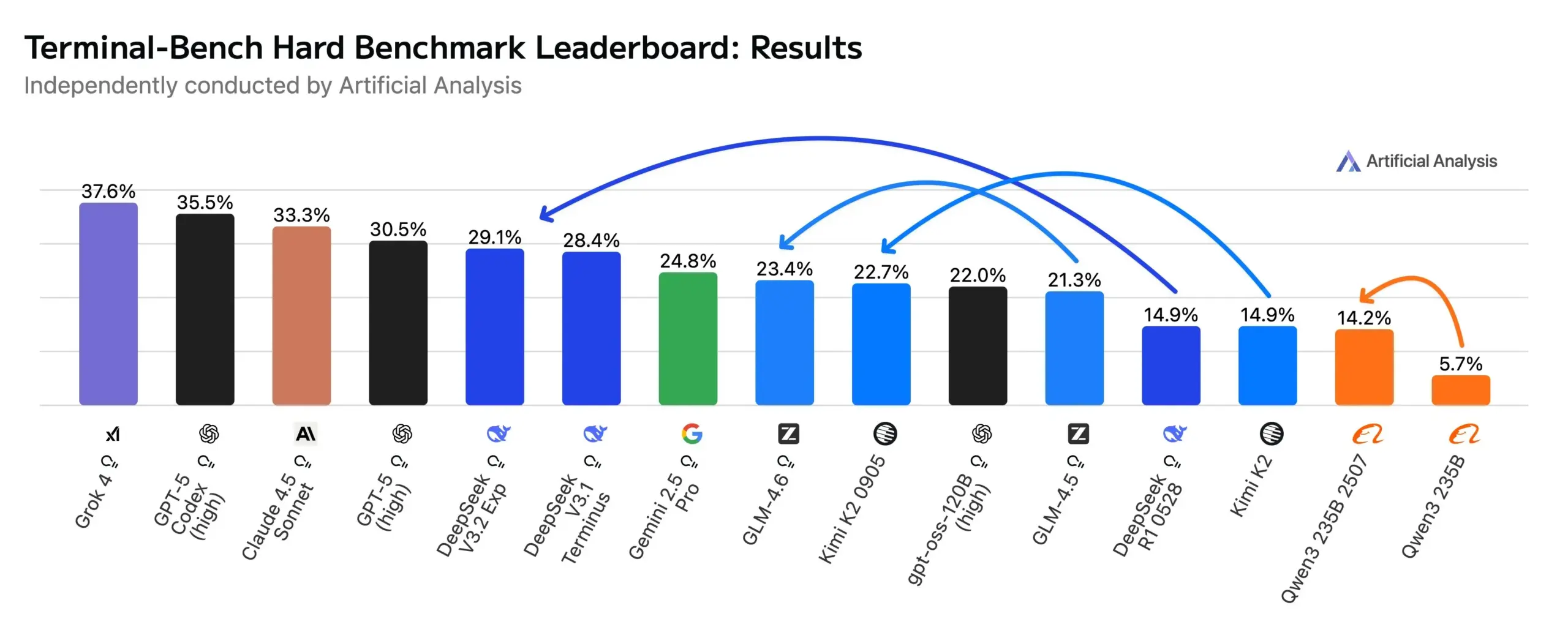

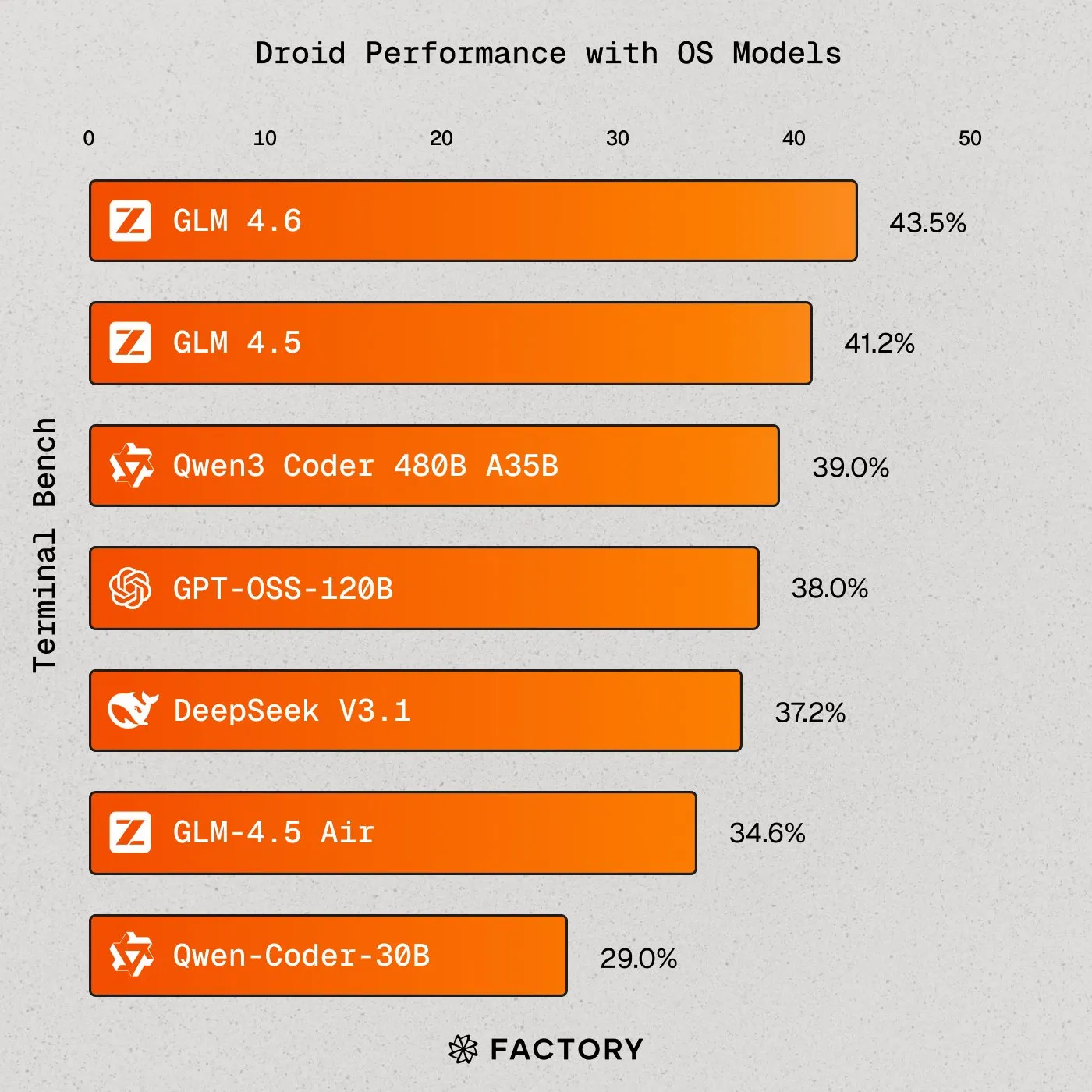

AI-модели с открытым исходным кодом приближаются к передовым моделям в Agentic-рабочих процессах: Модели с открытым исходным кодом, такие как DeepSeek V3.2 Exp, Kimi K2 0905 и GLM-4.6, добились значительного прогресса в Agentic-кодировании и оценке использования терминала (Terminal-Bench Hard), при этом DeepSeek даже превзошел Gemini 2.5 Pro. Это указывает на существенное улучшение возможностей моделей с открытым исходным кодом в сценариях применения агентов, предоставляя разработчикам более широкий выбор и способствуя открытой конкуренции в области AI. (Источник: huggingface)

Meta демонстрирует AI-очки и нейробраслет: Meta представила AI-очки со встроенным дисплеем, управляемые нейробраслетом, считывающим мышечные сигналы. Mark Zuckerberg обсудил потенциал этих очков для замены смартфонов, супер-интеллекта и метавселенной, продемонстрировав видение AI в носимых устройствах и будущем человеко-машинного взаимодействия, подчеркнув инновационное направление интеграции AI с аппаратным обеспечением. (Источник: rowancheung)

Прогресс в применении AI в медицинской диагностике: TuringPost сообщает о применении AI в диагностике рака, в частности, о системе PathologyMap™ от HistoWiz, которая анализирует цифровые патологические изображения высокого разрешения для выявления опухолевых паттернов. В ближайшие 2-3 года ожидается одобрение FDA вспомогательных AI-систем, оцифровка миллионов слайдов в больницах и повсеместное распространение высокоуровневой диагностики, что предвещает огромный потенциал AI в сфере здравоохранения. (Источник: TheTuringPost, TheTuringPost)

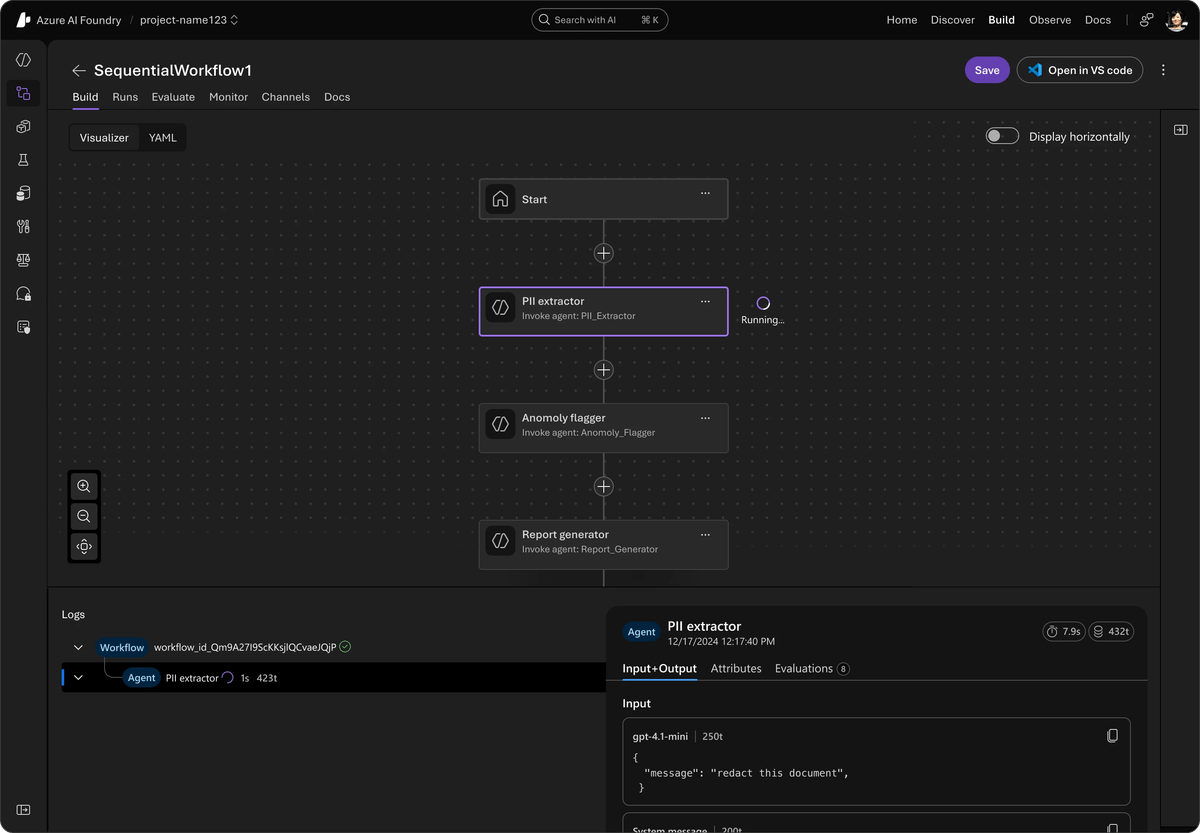

Microsoft представила Agent Framework: Microsoft выпустила Agent Framework, унифицированный SDK с открытым исходным кодом, который объединяет AutoGen и Semantic Kernel для создания корпоративных многоагентных AI-систем. Этот фреймворк поддерживает Azure AI Foundry, упрощает оркестрацию, наблюдаемость и совместим с любым API, а также предоставляет долгосрочные процессы, сквозное отслеживание и инструменты ответственного AI, направленные на стимулирование разработки и развертывания корпоративных AI-агентов. (Источник: TheTuringPost)

🧰 Инструменты

LlamaIndex продвигает рабочие процессы AI-агентов на основе кода: jerryjliu0 подчеркнул потенциал оркестрации на основе кода и кодирующих агентов в преодолении разрыва между low-code и продвинутыми приложениями. AgentKit от LlamaIndex поддерживает создание таких процессов, как сравнение документов и базовые помощники, и может быть экспортирован в код для обслуживания. Новейшая альфа-версия LlamaAgents позволяет развертывать пользовательские рабочие процессы кода на LlamaCloud, поддерживая управление состоянием, контрольные точки и человеко-машинное сотрудничество. (Источник: jerryjliu0, jerryjliu0)

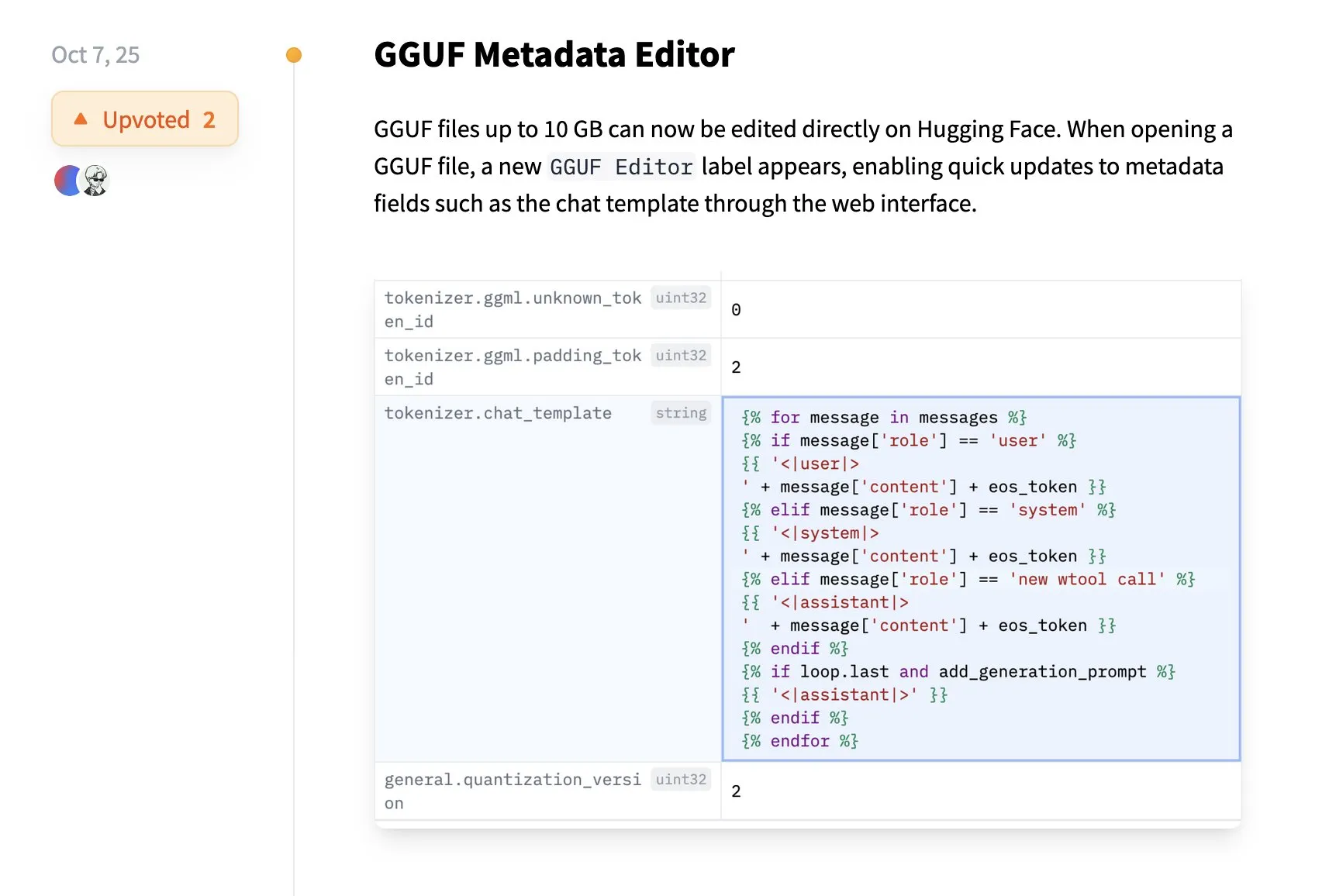

Hugging Face поддерживает прямое редактирование метаданных GGUF: Платформа Hugging Face добавила новую функцию, позволяющую пользователям напрямую редактировать метаданные моделей GGUF на Hugging Face без необходимости загружать модель локально. Это улучшение упрощает управление моделями и процессы совместной работы, повышая удобство использования, особенно для разработчиков, благодаря удобству, предоставляемому технологией передачи данных Xet. (Источник: huggingface)

DevinAI: автономный AI-инженер-программист: DevinAI от Cognition продвигается как самый передовой в мире автономный AI-инженер-программист, способный обрабатывать баги, разрабатывать функции и выполнять сложный рефакторинг, а также генерировать Pull Request для проверки. Он был отмечен несколькими корпоративными пользователями как высокоэффективный “участник разработки кода”, способный значительно повысить эффективность разработки, охватывая широкий спектр задач от QA до анализа данных, принося революционные изменения в разработку программного обеспечения. (Источник: cognition)

Imbue представила Sculptor для параллельных кодирующих AI-агентов: Imbue выпустила Sculptor, инструмент, который позволяет пользователям запускать несколько кодирующих AI-агентов в отдельных контейнерах и легко просматривать изменения кода в “режиме сопряжения”. Этот инструмент предназначен для поддержки параллельной работы кодирующих AI-агентов, повышения эффективности разработки, особенно при работе со сложными задачами, предоставляя разработчикам более гибкий и эффективный опыт программирования. (Источник: kanjun)

Factory AI поддерживает Droids, управляемые моделями с открытым исходным кодом: Factory AI объявила, что ее Droids теперь могут использовать любую модель с открытым исходным кодом, и достигла наивысшего балла среди всех моделей с открытым исходным кодом на Terminal-Bench, при этом GLM 4.6 показал особенно выдающиеся результаты, превзойдя даже Sonnet 4 в Claude Code. Это предоставляет разработчикам большую гибкость и более мощные варианты производительности, способствуя развитию AI-агентов с открытым исходным кодом. (Источник: matanSF, scaling01, Zai_org, QuixiAI)

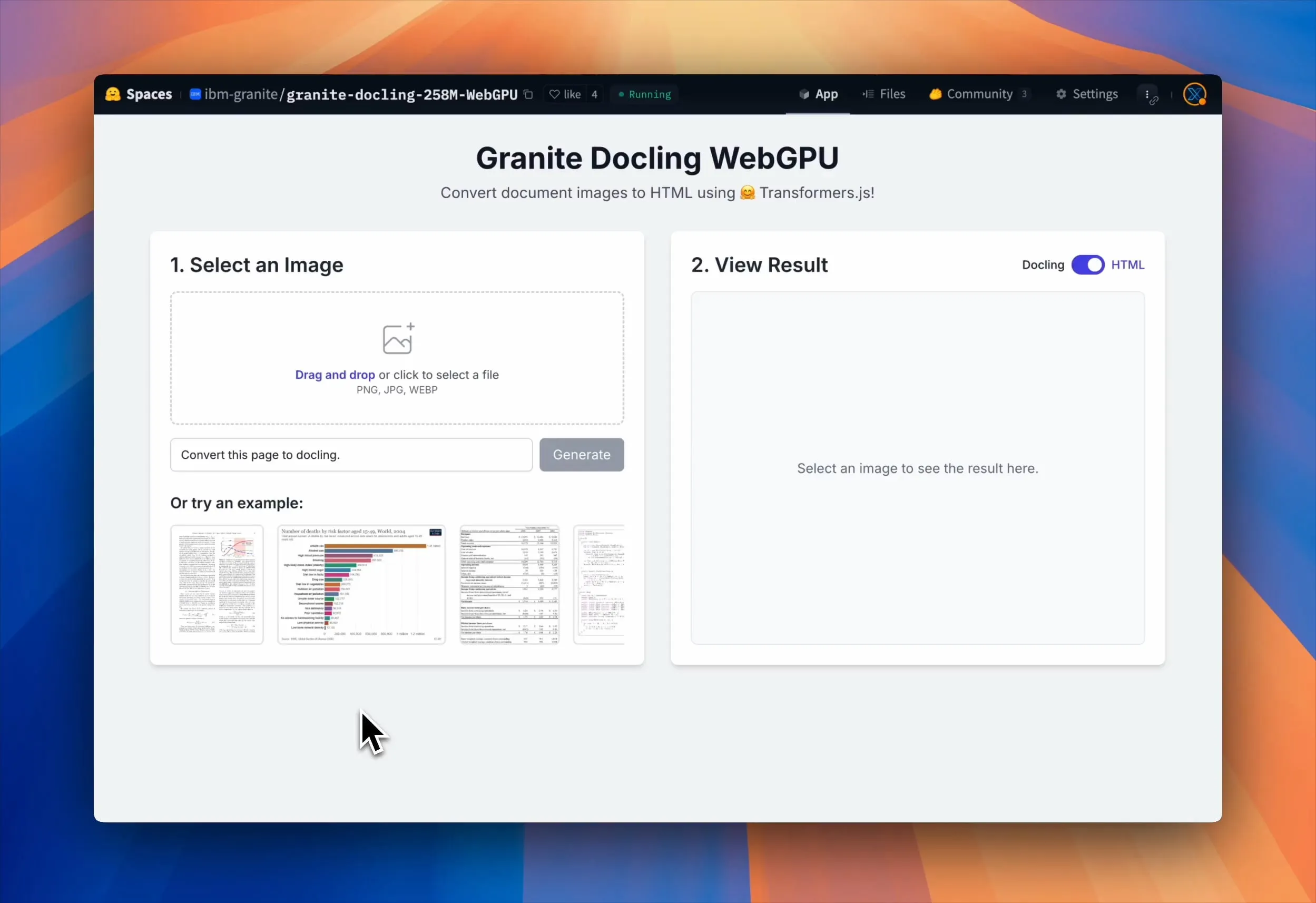

Granite Docling WebGPU обеспечивает парсинг документов в браузере: IBM выпустила Granite Docling, VLM с 258M параметров для эффективного преобразования документов. Теперь эта модель может работать на 100% локально в браузере с ускорением WebGPU, без отправки данных на сервер, обеспечивая конфиденциальность и безопасность. Это предоставляет пользователям бесплатное, эффективное и безопасное решение для обработки документов, особенно подходящее для работы с личными и конфиденциальными файлами. (Источник: Reddit r/LocalLLaMA, huggingface, mervenoyann)

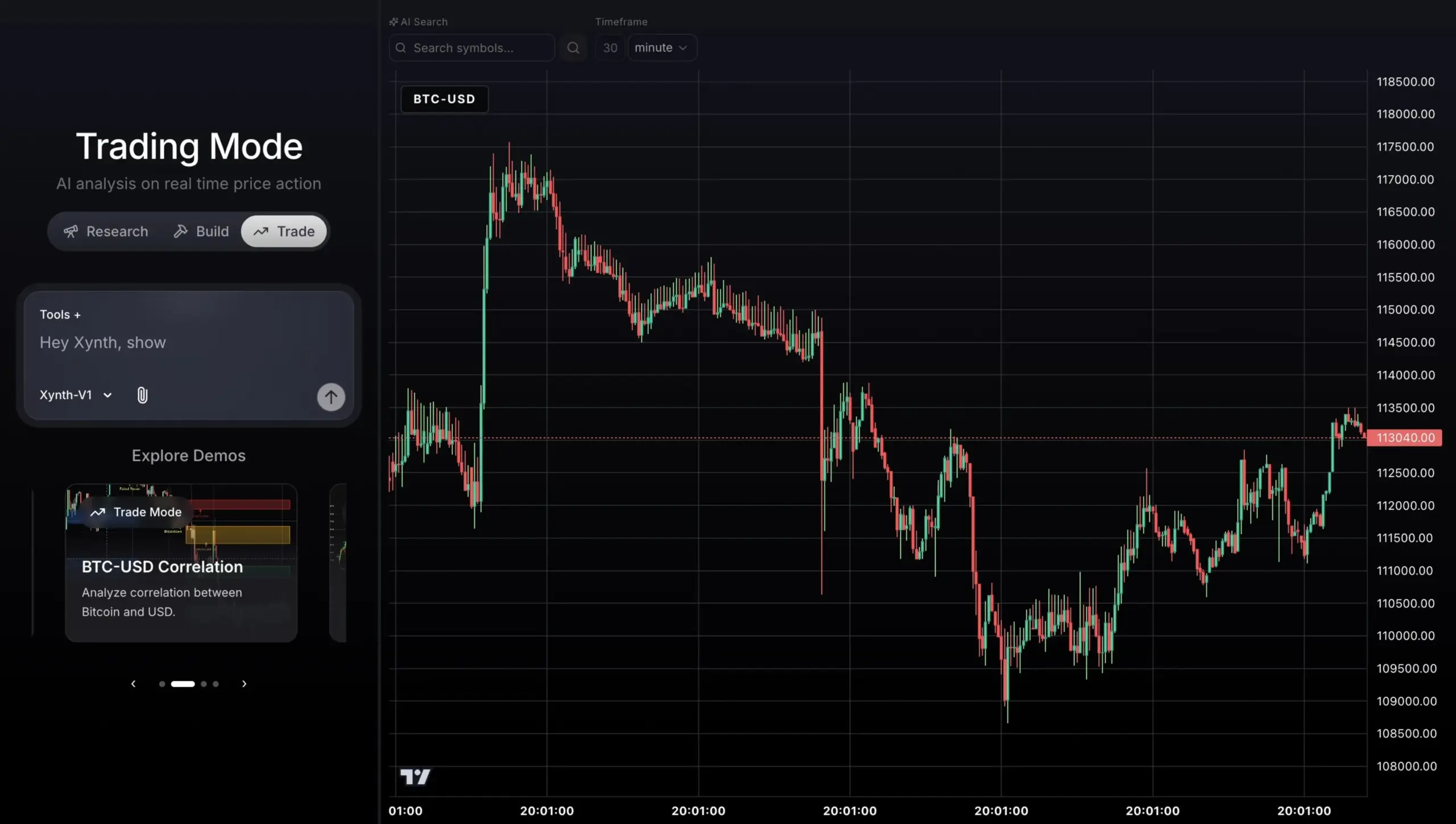

Торговый агент на базе GPT-5 для работы с рыночными данными в реальном времени: Проект торгового агента на базе GPT-5, построенный с использованием Python SDK, FastAPI и Next.js, способен подключаться к рыночным данным AlphaVantage в реальном времени и графикам TradingView для анализа, генерации сигналов и исполнения сделок. Этот агент нацелен на достижение стабильной, объяснимой торговой производительности, а не на слепое стремление к высокой доходности, демонстрируя потенциал применения AI в сфере финансовых операций. (Источник: Reddit r/ChatGPT)

Набор инструментов OpenAI AgentKit: OpenAI на Дне разработчика представила набор инструментов AgentKit, призванный предоставить разработчикам и предприятиям полный набор инструментов для создания, развертывания и оптимизации AI-агентов. AgentKit включает такие модули, как визуальный Agent Builder, Connector Registry и ChatKit, которые значительно упрощают процесс разработки AI-агентов за счет перетаскивания узлов, централизованного управления подключениями и встроенного интерфейса чата. (Источник: 量子位, TheRundownAI)

Официальный выпуск OpenAI Codex и новые функции: OpenAI объявила, что ее AI-инструмент для программирования Codex теперь полностью доступен, и представила три новые функции: интеграция со Slack позволяет командам напрямую делегировать задачи в Slack; Codex SDK позволяет разработчикам встраивать агентов Codex в рабочие процессы; новые инструменты управления облегчают администраторам мониторинг использования и качества проверки кода. Эти обновления направлены на повышение эффективности и безопасности Codex в командной работе и разработке программного обеспечения. (Источник: 量子位, TheRundownAI)

📚 Обучение

Andrew Ng запустил курс по Agentic AI: Andrew Ng выпустил новый курс под названием “Agentic AI”, который призван научить создавать AI-агентов, охватывая основные паттерны проектирования, такие как рефлексия, использование инструментов, планирование и многоагентное сотрудничество. Курс подчеркивает дисциплинированный процесс оценки и анализа ошибок для улучшения сложных рабочих процессов агентов и использует нативный Python для обучения, не зависящего от поставщика. (Источник: AndrewYNg, DeepLearningAI, dotey)

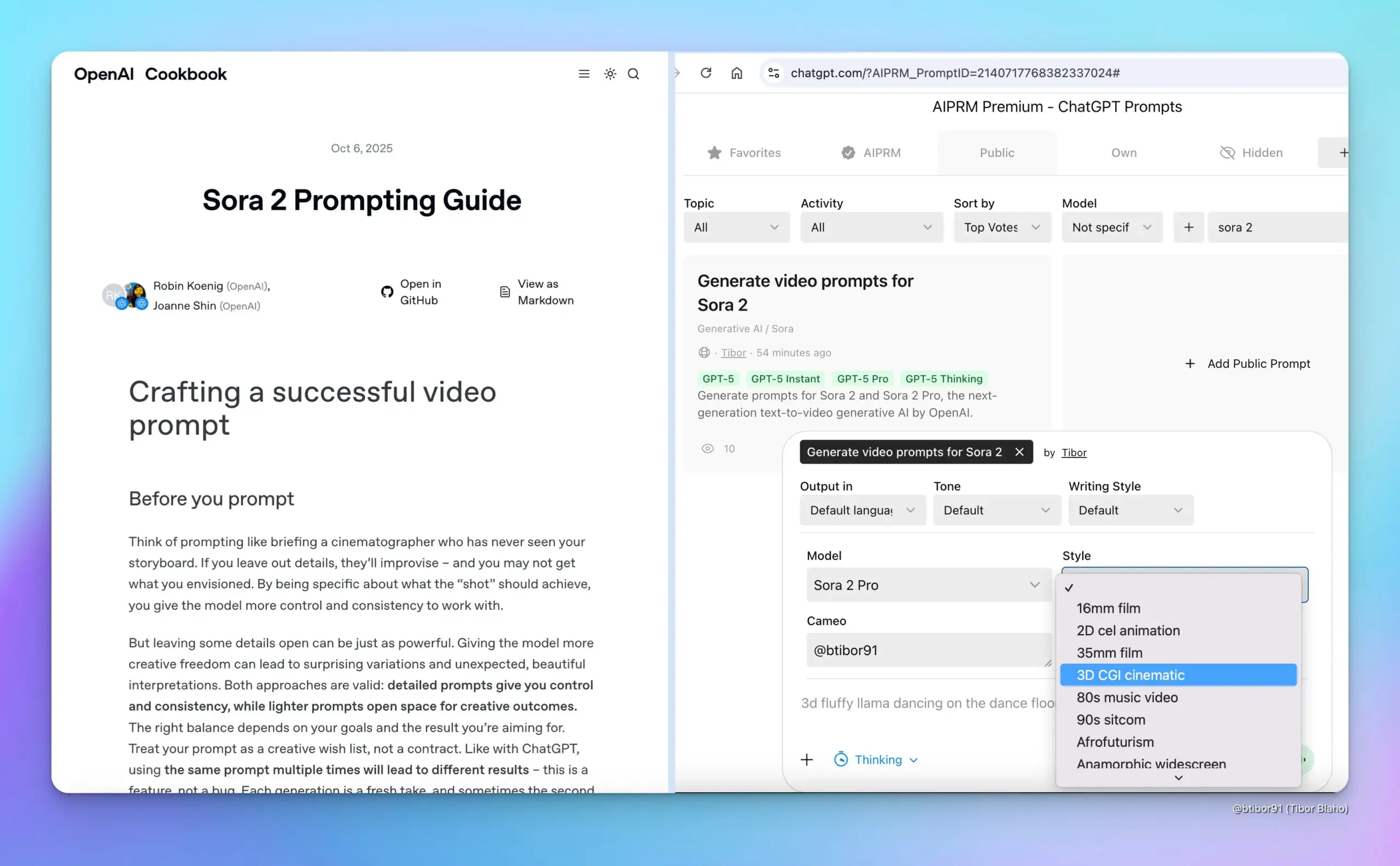

Выпущено руководство по подсказкам для Sora 2: OpenAI выпустила руководство по подсказкам для Sora 2, предлагающее практические советы по созданию успешных видеоподсказок. Руководство подчеркивает баланс между подробным описанием и предоставлением творческой свободы, а также конкретные рекомендации по разрешению видео, длительности, структуре, визуальным подсказкам, движению, освещению, цвету, диалогам и звуковым эффектам, а также представляет функцию Remix для итеративной оптимизации, помогая пользователям лучше освоить технологию генерации видео. (Источник: dotey)

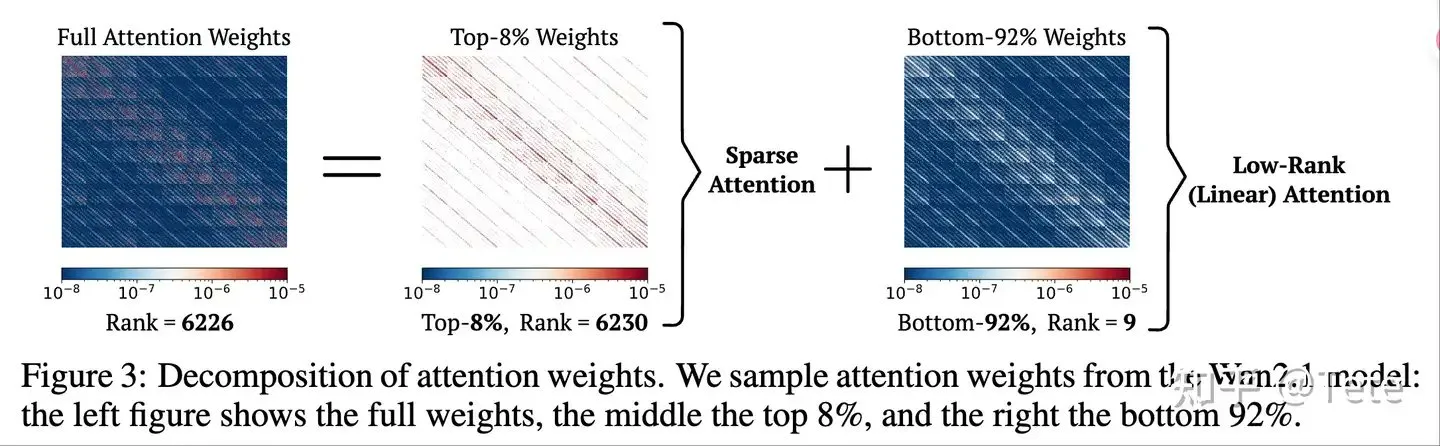

Оптимизация вывода LLM и обсуждение архитектуры: ZhihuFrontier обсудил будущее архитектур моделей, таких как DeepSeek-V3.2-Exp и Qwen3-Next, сосредоточившись на гибридных режимах разреженного и линейного внимания. Основная идея заключается в том, что разреженное внимание (запись всего, интеллектуальное чтение) и гибридные архитектуры (несколько слоев полного внимания + линейное внимание) могут обеспечить баланс между эффективностью и производительностью, особенно в отношении извлечения длинного контекста и KV-кэша. (Источник: ZhihuFrontier)

Методы оптимизации вывода LLM с помощью RL: HuggingFace Daily Papers представила два метода оптимизации обучения с подкреплением (RL): Slow-Fast Policy Optimization (SFPO) и M2PO (Second-Moment Trust Policy Optimization). SFPO повышает стабильность обучения RL для вывода LLM, сокращает Rollout и ускоряет сходимость за счет декомпозиции шагов обновления; M2PO, в свою очередь, эффективно использует устаревшие данные для стабильного офлайн-обучения, соответствующего производительности онлайн-обучения, путем ограничения второго момента весов важности. (Источник: HuggingFace Daily Papers, HuggingFace Daily Papers)

Всесторонний обзор рисков конфиденциальности LLM: В статье HuggingFace Daily Paper подчеркивается, что риски конфиденциальности LLM выходят далеко за рамки дословного запоминания обучающих данных и включают сбор данных, утечку контекста во время вывода, автономные возможности агентов, а также мониторинг через атаки глубокого вывода. Статья призывает исследовательское сообщество расширить область исследований конфиденциальности LLM и использовать междисциплинарный подход для противодействия этим социотехническим угрозам, чтобы более полно защитить конфиденциальность пользователей. (Источник: HuggingFace Daily Papers)

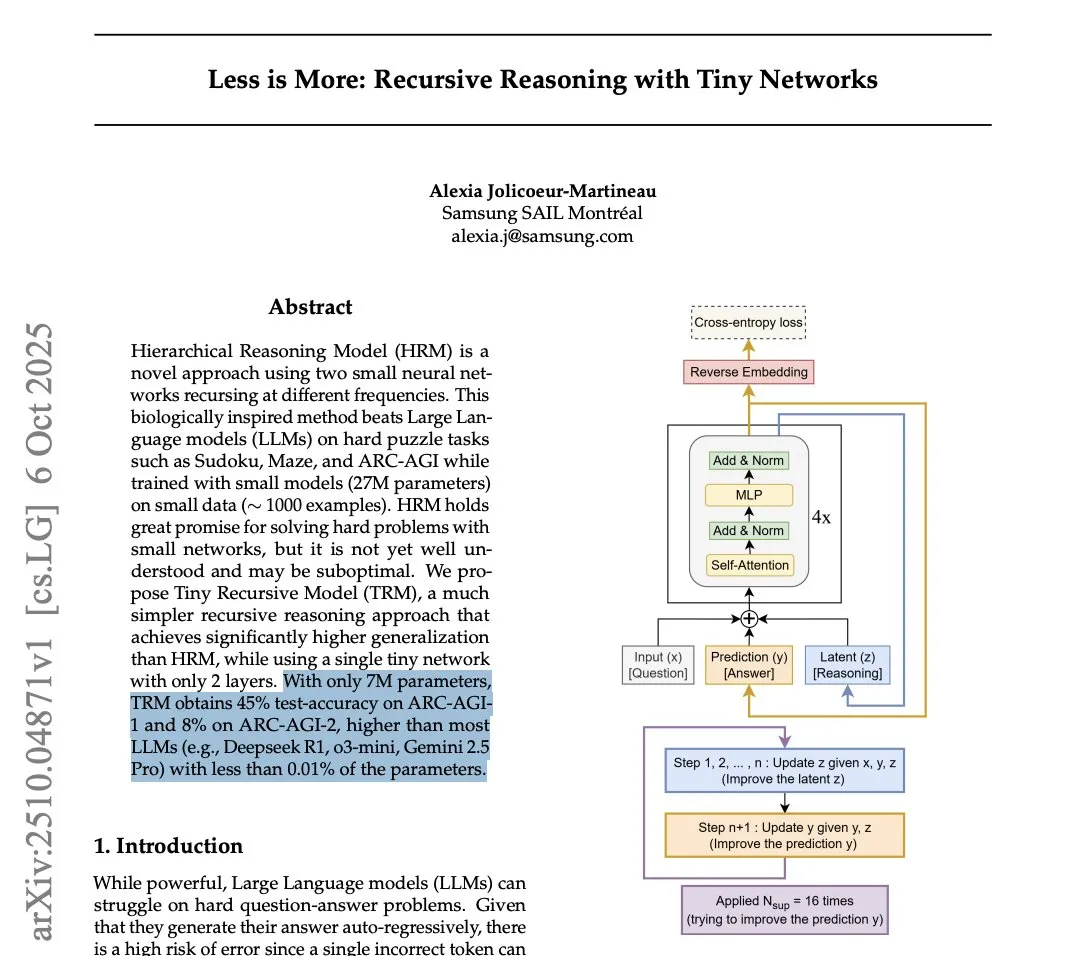

Производительность Tiny Recursion Model (TRM) на бенчмарке ARC-AGI: В статье Samsung представлена Tiny Recursion Model (TRM), модель всего с 7M параметров, которая превзошла DeepSeek-R1 и Gemini 2.5 Pro в бенчмарках ARC-AGI-1 и ARC-AGI-2. Хотя ее применение может быть очень узким, это открытие вызвало дискуссии о достижении высокого интеллекта небольшими моделями в конкретных задачах, а также вопросы об эффективности бенчмарков. (Источник: Reddit r/LocalLLaMA, arohan, paul_cal, halvarflake, teortaxesTex)

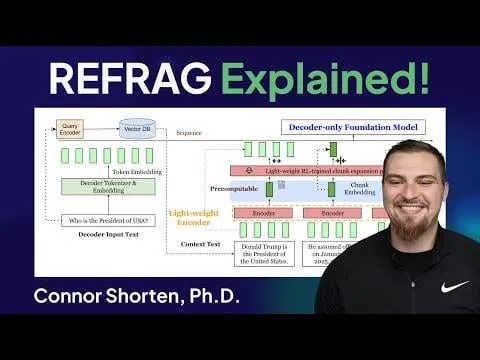

REFRAG: прорыв Meta в оптимизации вывода LLM: Фреймворк REFRAG от Meta Superintelligence Labs, благодаря умелой интеграции контекстных векторов с декодированием LLM, ускоряет TTFT (Time-to-First-Token) в 31 раз, TTIT (Time-to-Iterative-Token) в 3 раза, увеличивает общую пропускную способность LLM в 7 раз и способен обрабатывать более длинные входные контексты. Это может вызвать вторую волну интереса к векторным базам данных и значительно повысить эффективность вывода LLM. (Источник: Reddit r/deeplearning)

Влияние памяти DDR6 на работу локальных LLM: Сообщество Reddit обсуждает потенциальное влияние увеличения пропускной способности памяти DDR6 на работу локальных LLM. Считается, что DDR6 в сочетании с интеллектуальной квантизацией и оптимизацией небольших моделей позволит потребителям запускать большие модели с приемлемой скоростью в течение следующих 5 лет, уменьшая зависимость от дорогих рабочих станций с GPU, особенно в сценариях гибридного вывода CPU+GPU, что значительно ускорит развитие локального AI. (Источник: Reddit r/LocalLLaMA)

AInstein: оценка жизнеспособности методов исследования, генерируемых AI: В статье HuggingFace Daily Paper представлен фреймворк AInstein для тестирования способности LLM генерировать эффективные решения для проблем AI-исследований без специфической для предметной области тонкой настройки или внешней помощи. Результаты оценки показывают, что LLM могут переоткрывать жизнеспособные решения и иногда предлагать инновационные методы, но их способность решать проблемы остается нестабильной и чувствительной к фреймворку, что раскрывает потенциал и ограничения LLM как автономных решателей научных проблем. (Источник: HuggingFace Daily Papers)

WebDetective: оценка глубокого поиска RAG-систем и веб-агентов: В статье HuggingFace Daily Paper предложен бенчмарк WebDetective для оценки производительности RAG-систем и веб-агентов в задачах глубокого поиска без подсказок с несколькими переходами. Этот бенчмарк, использующий контролируемую песочницу Wikipedia и декомпозированный фреймворк оценки, выявляет системные недостатки существующих моделей в достаточности поиска, использовании знаний и поведении отказа, предоставляя диагностический инструмент для разработки по-настоящему автономных систем рассуждений. (Источник: HuggingFace Daily Papers)

💼 Бизнес

MiniMax столкнулась с иском о нарушении авторских прав от Голливуда: Китайская AI-компания MiniMax была совместно подана в суд тремя голливудскими гигантами (Disney, Universal Pictures, Warner Bros.) за нарушение авторских прав в связи с ее сервисом генерации изображений и видео “海螺AI” (Hǎiluó AI). В иске утверждается, что MiniMax систематически копировала защищенных авторским правом персонажей для обучения AI и генерировала несанкционированные видео для получения прибыли. Это дело может стать важной вехой в области авторских прав AI и представляет собой огромный вызов для планов MiniMax по финансированию и выходу на биржу. (Источник: 36氪)

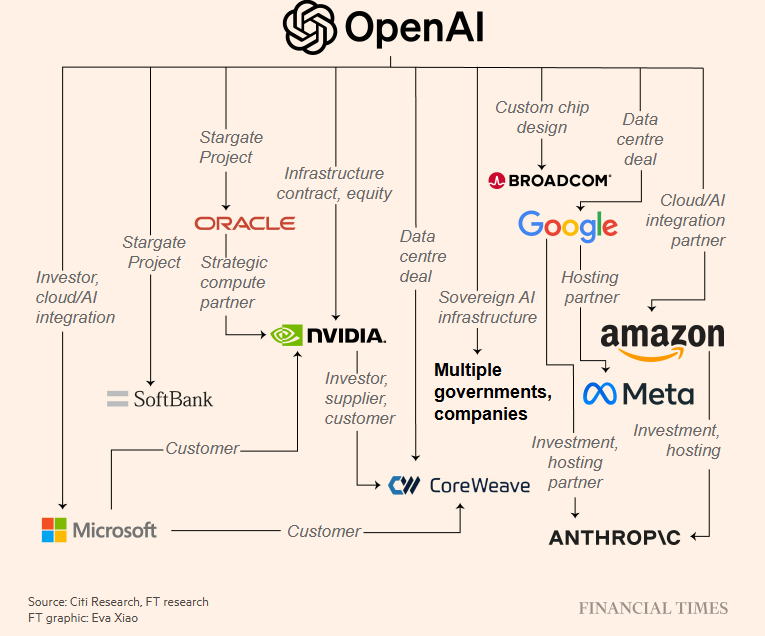

Перегрев инвестиций в AI-инфраструктуру и опасения по поводу пузыря: Известное издание The Information поставило под сомнение прибыльность Oracle от сдачи в аренду чипов Nvidia таким клиентам, как OpenAI, указав, что ее валовая прибыль значительно ниже общего уровня. OpenAI подписала контракты на триллионы долларов на вычислительные мощности и заключила крупные инвестиционные/партнерские соглашения с Nvidia и AMD, что вызвало опасения на рынке по поводу перегрева инвестиций в AI-инфраструктуру и повторения “пузыря доткомов”. (Источник: 36氪, steph_palazzolo, Reddit r/ArtificialInteligence)

Radical Ventures завершила сбор 650 миллионов долларов для фонда ранних стадий AI: Radical Ventures успешно привлекла 650 миллионов долларов для фонда ранних стадий AI. Эти средства будут направлены на инвестиции в стартапы в области искусственного интеллекта, что демонстрирует неизменный энтузиазм капитального рынка в отношении AI-инноваций и проектов на ранних стадиях, вливая новую энергию в AI-экосистему и потенциально ускоряя коммерциализацию новых AI-технологий. (Источник: aidangomez)

🌟 Сообщество

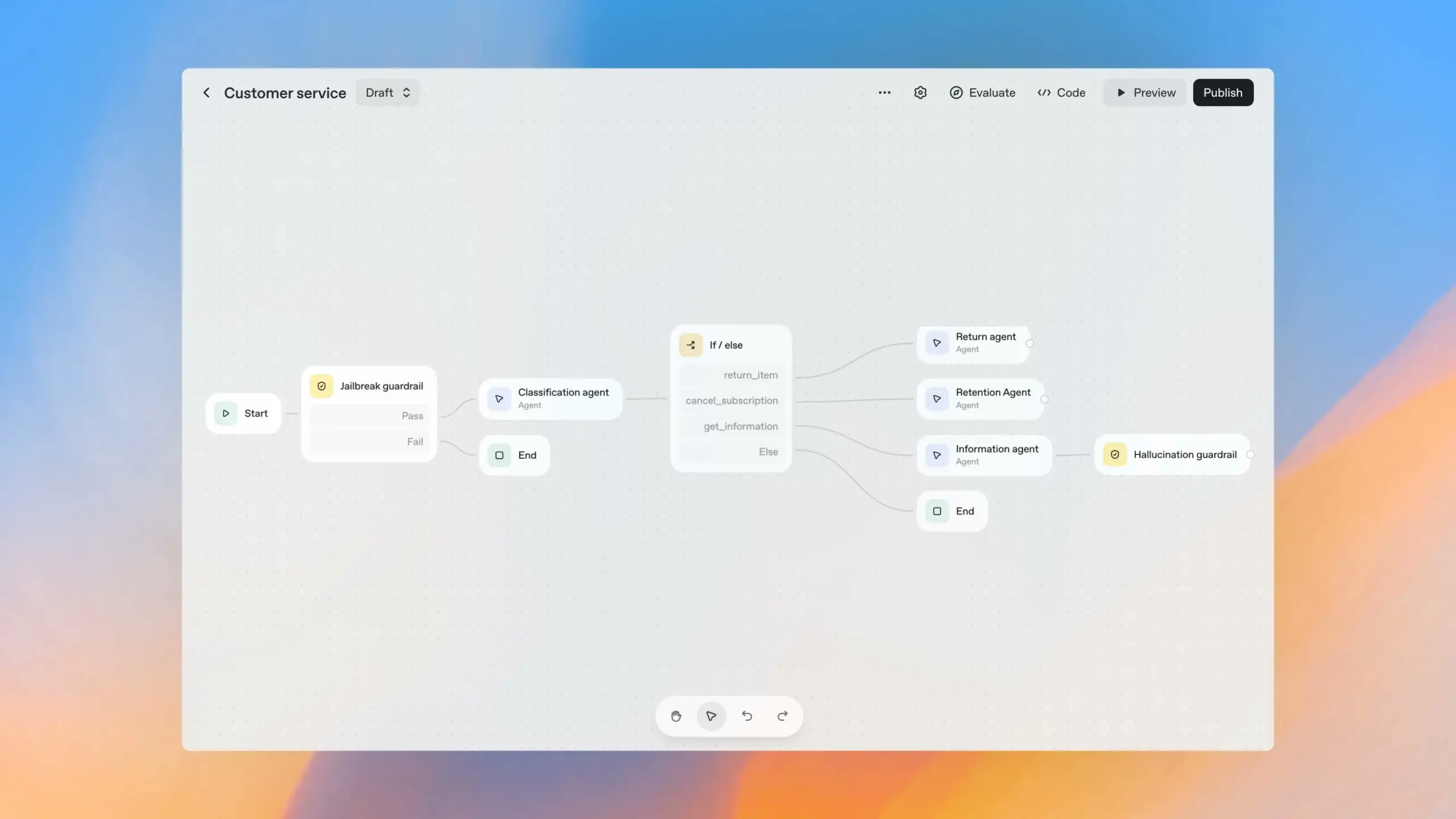

Практичность и споры вокруг инструментов разработки AI-агентов: Сообщество активно обсуждает практичность таких инструментов для создания визуальных рабочих процессов, как OpenAI Agent Builder. Основатель LangChain Harrison Chase считает, что эти инструменты недостаточно просты для обычных пользователей и плохо масштабируются для сложных сценариев использования. Многие разработчики полагают, что по своей сути это low-code инструменты, а не no-code, с рисками привязки к поставщику и функциональными ограничениями, и больше подходят для быстрого прототипирования, чем для производственной среды. (Источник: hwchase17, hwchase17, hwchase17, ReamBraden, HamelHusain, dotey)

Влияние AI на рынок труда и социальные опасения: Доклад сенатора Bernie Sanders предупреждает, что AI и автоматизация могут заменить 100 миллионов рабочих мест в США в течение следующего десятилетия, особенно в таких областях, как фастфуд, бухгалтерский учет, грузоперевозки, уход за больными и образование. Сообщество повсеместно обеспокоено тем, что AI приведет к массовой безработице, и ставит под сомнение, осознает ли правительство потери налогов на занятость и НДС, а также сможет ли AI создать достаточно новых рабочих мест для компенсации. (Источник: Reddit r/artificial, Reddit r/ArtificialInteligence, zacharynado)

AI-генерируемый контент и споры об авторских правах, этике: Дочь Robin Williams, Zelda Williams, публично призвала прекратить распространение AI-генерированных видео с ее отцом, назвав это “отвратительной, чрезмерно обработанной колбасой” и неуважением к наследию покойного. Этот инцидент вызвал широкие дискуссии об авторских правах на AI-генерируемый контент, этике и рисках дипфейков, особенно когда речь идет о публичных личностях и умерших родственниках. (Источник: Reddit r/artificial, Reddit r/artificial)

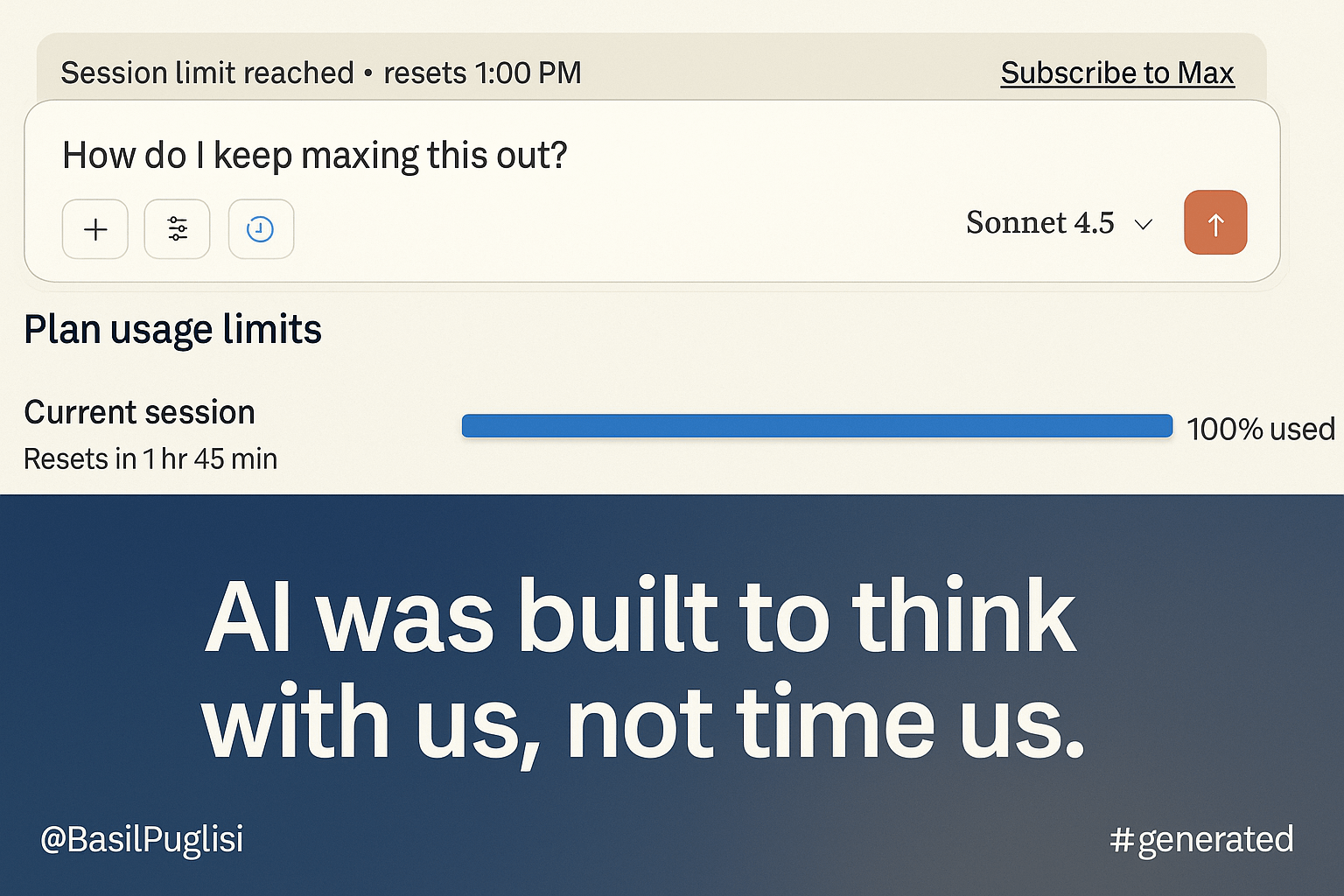

Новая политика квот ClaudeAI вызвала недовольство пользователей: Пользователи подписки ClaudeAI Max выразили сильное недовольство новой политикой квот, которая значительно сократила лимит использования до 20% от прежнего уровня, что серьезно повлияло на их обычные рабочие процессы. Пользователи задаются вопросом, обусловлено ли это “надежностью” или “ограничением интеллекта”, и считают, что финансовая стратегия компании и игнорирование потребительского рынка могут привести к конкурентным недостаткам. (Источник: Reddit r/ClaudeAI, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

Обсуждение способности AI-агентов выполнять “целый день работы”: Сообщество обсуждает, могут ли AI-агенты выполнять работу в течение всего дня без вмешательства человека. Общее мнение заключается в том, что, хотя AI-агенты отлично справляются с конкретными задачами, им все еще требуется человеческий надзор и вмешательство для выполнения сложных или крупномасштабных задач. Однако они могут значительно повысить производительность человека, освобождая инженеров от рутинной работы и позволяя им сосредоточиться на высокоуровневом проектировании и архитектуре. (Источник: Reddit r/LocalLLaMA)

Эволюция процесса разработки программного обеспечения в эпоху AI: “Vibe Engineering”: Simon Willison предложил концепцию “Vibe Engineering”, призванную отличить случайное “Vibe Coding” от ответственного использования LLM опытными инженерами для повышения эффективности. Он подчеркивает, что AI-инструменты усиливают ценность передовых практик разработки программного обеспечения, таких как автоматизированное тестирование, предварительное планирование, полная документация и проверка кода, и предсказывает, что будущая архитектура будет ориентирована на микросервисы, а человеческий фокус сместится на определение требований и приемочное тестирование. (Источник: dotey, swyx, jeremyphoward)

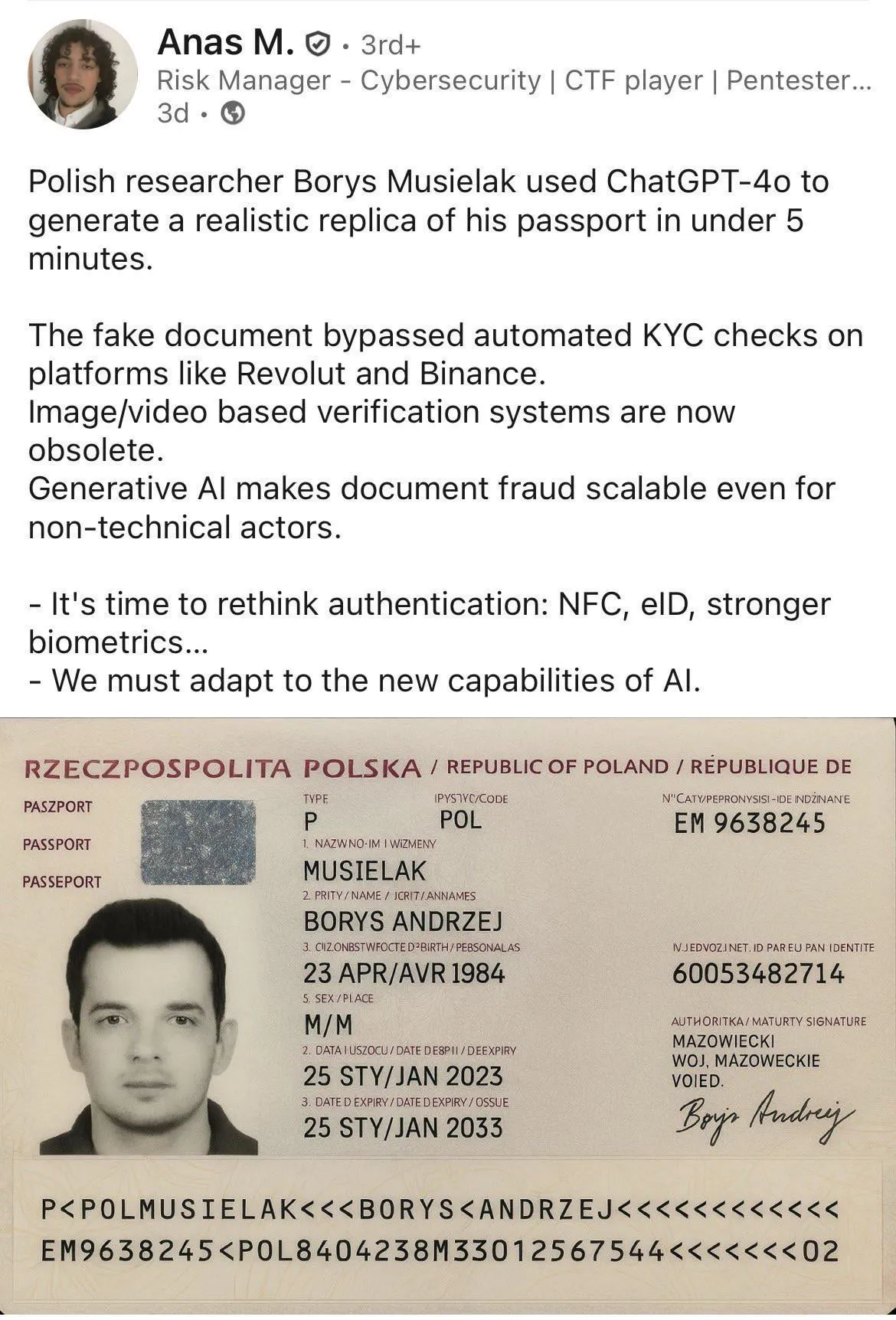

AI-генерируемая дезинформация и риски мошенничества: Сообщество обсуждает применение AI в мошенничестве, например, использование AI для генерации поддельных документов. Существует мнение, что это не уникальная проблема AI, поскольку такие инструменты, как Photoshop, уже давно могут достигать аналогичных результатов. Ключевым моментом является способность получателя распознавать поддельные изображения и совершенствование систем KYC. В то же время, есть случаи, когда AI использовался в прямых трансляциях для выманивания номеров телефонов и кодов подтверждения. (Источник: Reddit r/ChatGPT, dotey)

Утечка политики чат-ботов Meta AI вызывает опасения по поводу безопасности детей: Утечка внутренних документов Meta показывает, что ее AI-чат-ботам ранее разрешалось вести неуместные диалоги с несовершеннолетними, что вызвало серьезные опасения по поводу защитных мер и ответственности AI в сценариях использования детьми. Сообщество призывает к стандартизированному внешнему тестированию “красной командой” для высокорисковых AI-продуктов и ставит под сомнение, должны ли дети вообще общаться с AI, чтобы обеспечить ответственное развитие AI-технологий. (Источник: Reddit r/ArtificialInteligence)

💡 Прочее

Яо Шуньюй из физического факультета Университета Цинхуа присоединился к Google DeepMind: Яо Шуньюй, лауреат специальной премии физического факультета Университета Цинхуа, покинул Anthropic и присоединился к Google DeepMind. Он перешел из теоретической физики в AI, главным образом потому, что область AI предоставляет больше возможностей для молодых людей, а экспериментальный характер позволяет быстрее разрешать разногласия. В Anthropic он участвовал в улучшении Claude с версии 3.7 до 4.5, но решил уйти из-за несогласия с некоторыми стратегиями и ценностями Anthropic. (Источник: 36氪)

Neuralink реализовала управление механической рукой силой мысли: Nick Wray, которому был имплантирован нейроинтерфейс Neuralink, успешно управлял механической рукой силой мысли, выполняя повседневные задачи, такие как надевание шляпы, разогрев куриных наггетсов, открытие холодильника, и установил новые рекорды по перемещению цилиндров и переворачиванию штырей. Этот прорыв демонстрирует огромный потенциал BCI в помощи людям с ограниченными возможностями, обещая значительно улучшить качество жизни, и является важным шагом вперед в технологии человеко-машинного интерфейса. (Источник: dotey)

Формирование удовольствия от продукта в эпоху AI: Lenny взял интервью у Nasin Shenal, бывшего директора по продуктам Google и Spotify, который подчеркнул, что истинное “удовольствие” от продукта заключается в одновременном удовлетворении функциональных и эмоциональных потребностей пользователя, а не в показных спецэффектах. Устранение трений (например, возврат средств в Uber), предвосхищение потребностей (например, eSIM-карта Revolut) и превосхождение ожиданий (например, купоны в браузере Edge) могут эффективно повысить лояльность пользователей и рост продукта, предлагая новые направления для размышлений в продуктовом дизайне. (Источник: dotey)