Ключевые слова:Трансформер, Ноам Шазер, ChatGPT, Gemini, DeepSeek R1, AI технологии, Большие языковые модели, Модель смеси экспертов (MoE), Множественное внимание запросов (MQA), Управляемый линейный слой (GLU), Парадигма обучения с подкреплением Absolute Zero, Кодовая модель Seed-Coder-8B

🔥 В центре внимания

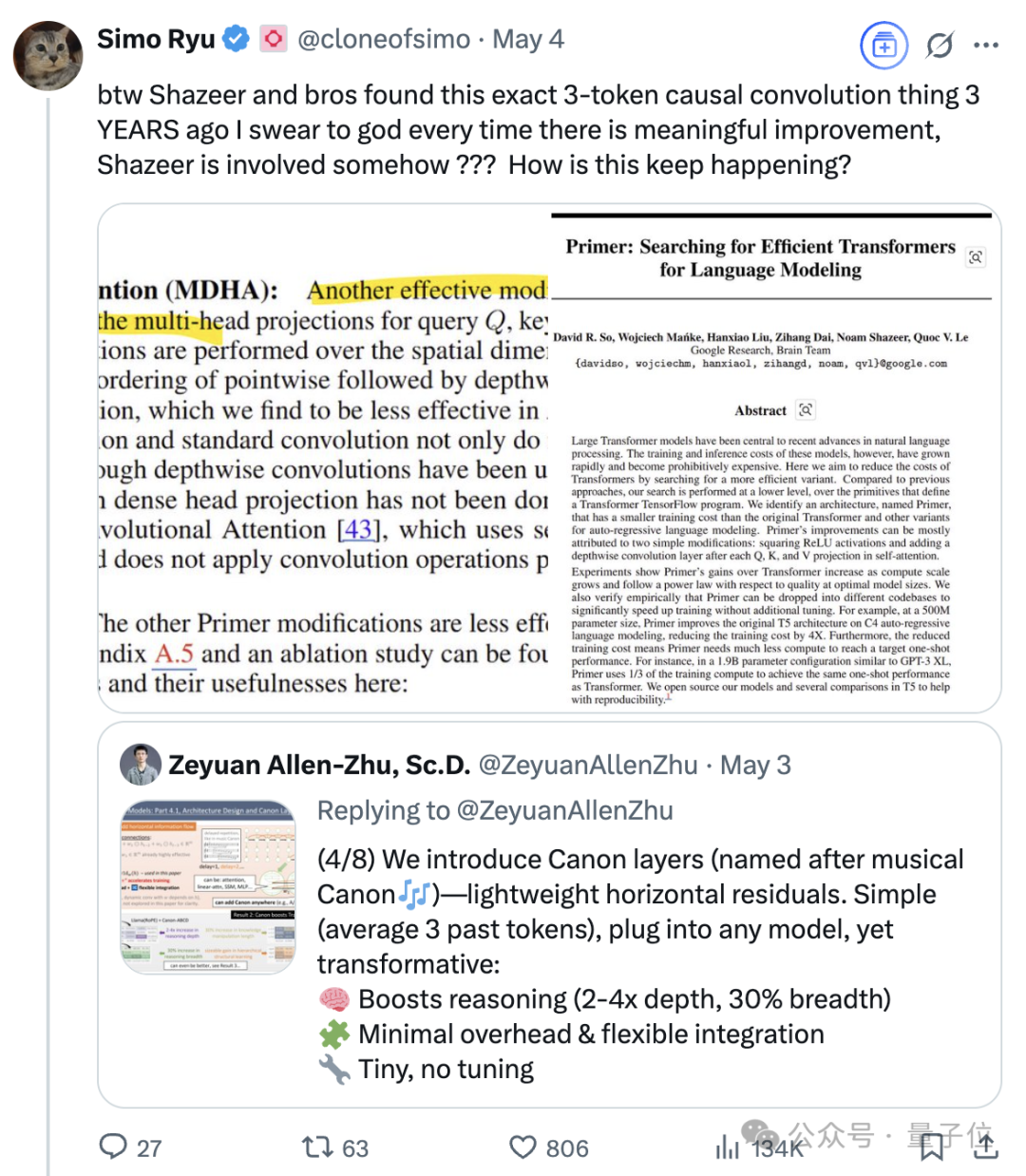

Noam Shazeer: Гений за Transformer и эволюция технологий AI: Noam Shazeer, один из восьми авторов архитектуры Transformer, признан как внесший наибольший вклад. Его исследования не только заложили основу современных больших языковых моделей (LLM) (например, «Attention Is All You Need»), но и предвосхитили развитие ключевых технологий, таких как модели Mixture of Experts (MoE), оптимизатор Adafactor, Multi-Query Attention (MQA) и Gated Linear Units (GLU). Недавно его ранние исследовательские работы вновь привлекли внимание, подчеркивая его передовое технологическое видение. Shazeer был соучредителем Character.AI, затем вернулся в Google, чтобы возглавить проект Gemini, и продолжает оказывать влияние на сферу AI. (Источник: 36氪)

Трафик ChatGPT резко вырос, бросая вызов доминированию Google Search: Данные Similarweb показывают, что в апреле 2025 года ежемесячные посещения ChatGPT выросли на 13,04% вопреки тенденции, превысив 5 миллиардов и обогнав X (ранее Twitter), став пятым по величине веб-сайтом в мире и единственной платформой из топ-10, показавшей месячный рост. Эта тенденция указывает на то, что AI-приложения, представленные ChatGPT, значительно меняют способы получения информации пользователями, создавая существенную угрозу для традиционных поисковых систем, особенно в рабочих и учебных сценариях, где зависимость пользователей от инструментов AI постоянно растет. (Источник: 36氪, Similarweb on X)

DeepSeek R1 гремит сто дней: переформатирование инвестиционного ландшафта AI и экосистемы стартапов: С момента своего выпуска в январе 2025 года DeepSeek R1 привлек широкое внимание в области AI благодаря своей стратегии низкозатратного открытого исходного кода, оказав глубокое влияние на рынок венчурных инвестиций и экосистему стартапов. Эта модель не только открыла новые возможности для развития стартапов в области аппаратного обеспечения AI, разработки Agent и т.д., но и побудила ведущих игроков, таких как Kimi от Moonshot AI и Zhipu AI, скорректировать свои рыночные стратегии, усилив конкуренцию в области применения AI и коммерциализации. Интерес инвесторов к приложениям AI и воплощенному интеллекту возрос, однако инвестиции в базовые большие модели стали более осторожными, что свидетельствует о смещении фокуса рынка на прикладные приложения нижнего уровня. (Источник: 36氪)

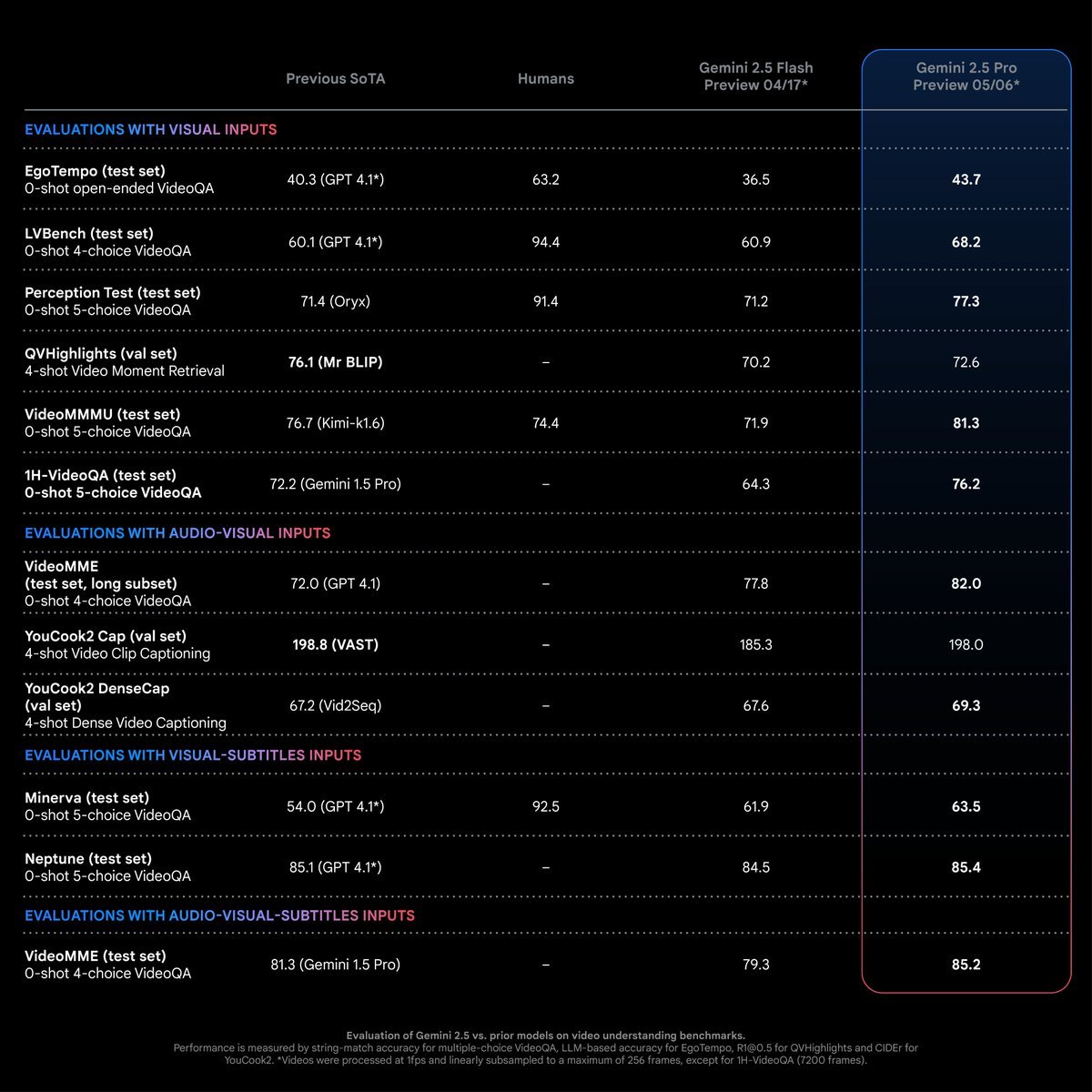

Gemini 2.5 Pro демонстрирует значительный прогресс в понимании видео: Gemini 2.5 Pro от Google показывает выдающиеся результаты в области понимания видео, не только лидируя в традиционных задачах видеоанализа, но и открывая новые сценарии применения. Его возможности понимания видео превосходят существующие SOTA-модели и даже человеческий уровень на нескольких тестовых наборах. Jeff Dean отметил, что новый режим 66 токенов на кадр (вместо 258 токенов) позволяет обрабатывать более 6 часов видео (1fps) в контексте 2M токенов, значительно расширяя потенциал анализа длинных видео. (Источник: matvelloso, op7418, JeffDean)

Статья Absolute Zero: Улучшение способностей LLM к рассуждению через усиленное самообучение без внешних данных: В статье под названием «Absolute Zero: Reinforced Self-play Reasoning with Zero Data» представлена новая парадигма обучения с подкреплением «Absolute Zero», направленная на улучшение способностей к рассуждению больших языковых моделей (LLM) без использования каких-либо внешних данных, заставляя одну модель самостоятельно предлагать задачи и решать их. Система AZR проверяет задачи и ответы с помощью исполнителя кода, реализуя обучение с разомкнутым контуром, и достигла SOTA-производительности в задачах кодирования и математического рассуждения, демонстрируя потенциал автономной эволюции AI. (Источник: Reddit r/LocalLLaMA, teortaxesTex)

🎯 Тенденции

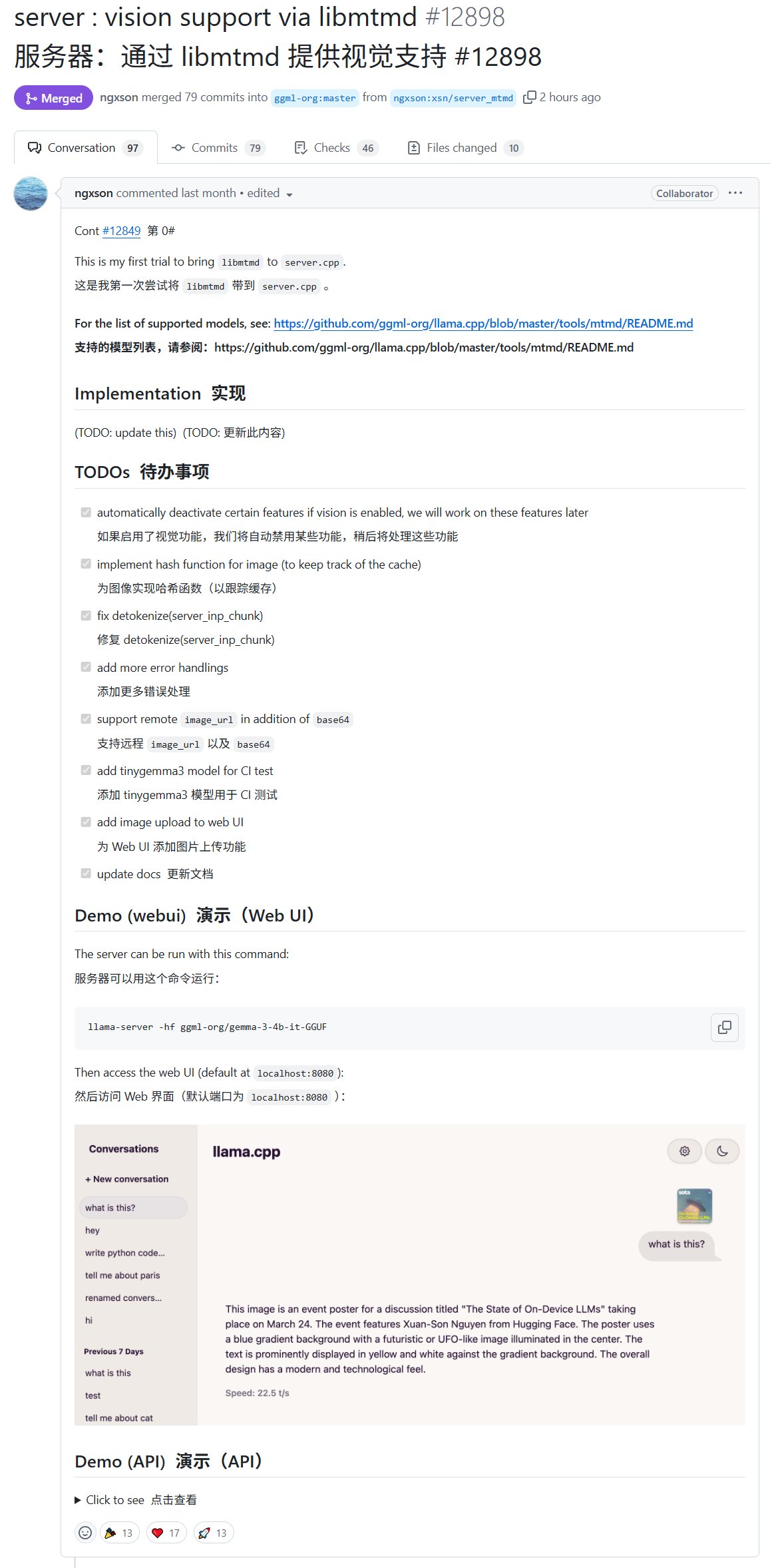

Сервер Llama.cpp теперь поддерживает визуальные модели, расширяя локальные мультимодальные приложения: Встроенный в Llama.cpp llama-server теперь поддерживает визуальные модели, позволяя пользователям начать использовать мультимодальные модели, квантованные с помощью gguf. Это важное обновление, внесенное Xuan-Son Nguyen (ngxson) и другими, упрощает запуск и взаимодействие с мультимодальными AI-приложениями на локальных устройствах, что имеет большое значение для сценариев граничных вычислений и защиты конфиденциальности. (Источник: karminski3, reach_vb, ggerganov, Reddit r/LocalLLaMA)

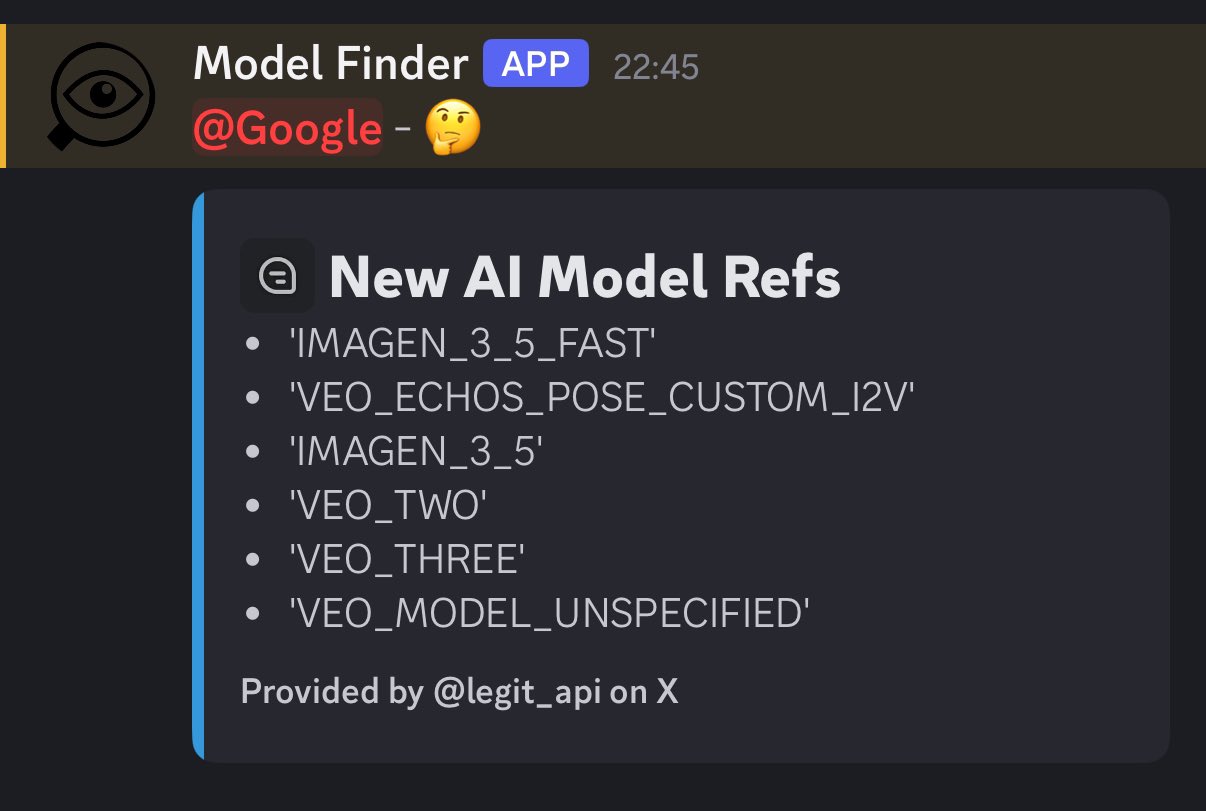

Google может представить новые модели для генерации изображений и видео Veo 3.0 и Imagen 4.0 на конференции I/O: Сообщается, что Google планирует представить на майской конференции I/O новые модели для генерации изображений и видео, включая veo-3.0-generate-preview, imagen-4.0-generate-preview-05-20 и imagen-4.0-ultra-generate-exp-05-20. Это предвещает значительные обновления Google в области мультимодальной генерации, особенно ожидается производительность Veo 3.0. (Источник: op7418)

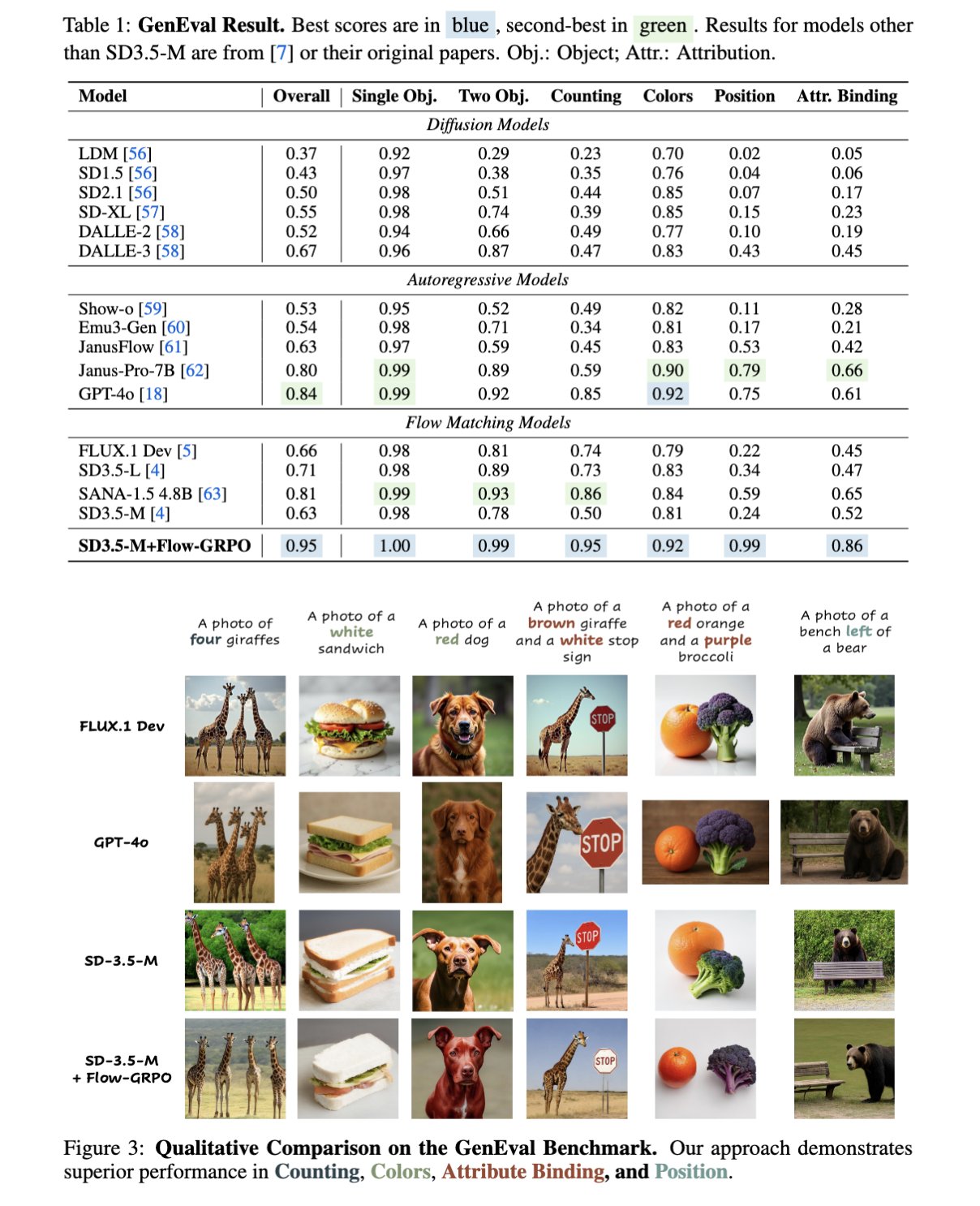

Flow-GRPO: Улучшение генерации изображений моделями Flow Matching с помощью онлайн-обучения с подкреплением: Flow-GRPO — это новый предложенный метод, который впервые интегрирует онлайн-обучение с подкреплением (RL) в модели Flow Matching. Эксперименты показывают, что SD3.5, настроенный с помощью RL, генерирует изображения с почти идеальной точностью количества объектов, пространственных отношений и мелкозернистых атрибутов, значительно улучшая следование инструкциям и качество генерации в задачах преобразования текста в изображение. (Источник: teortaxesTex)

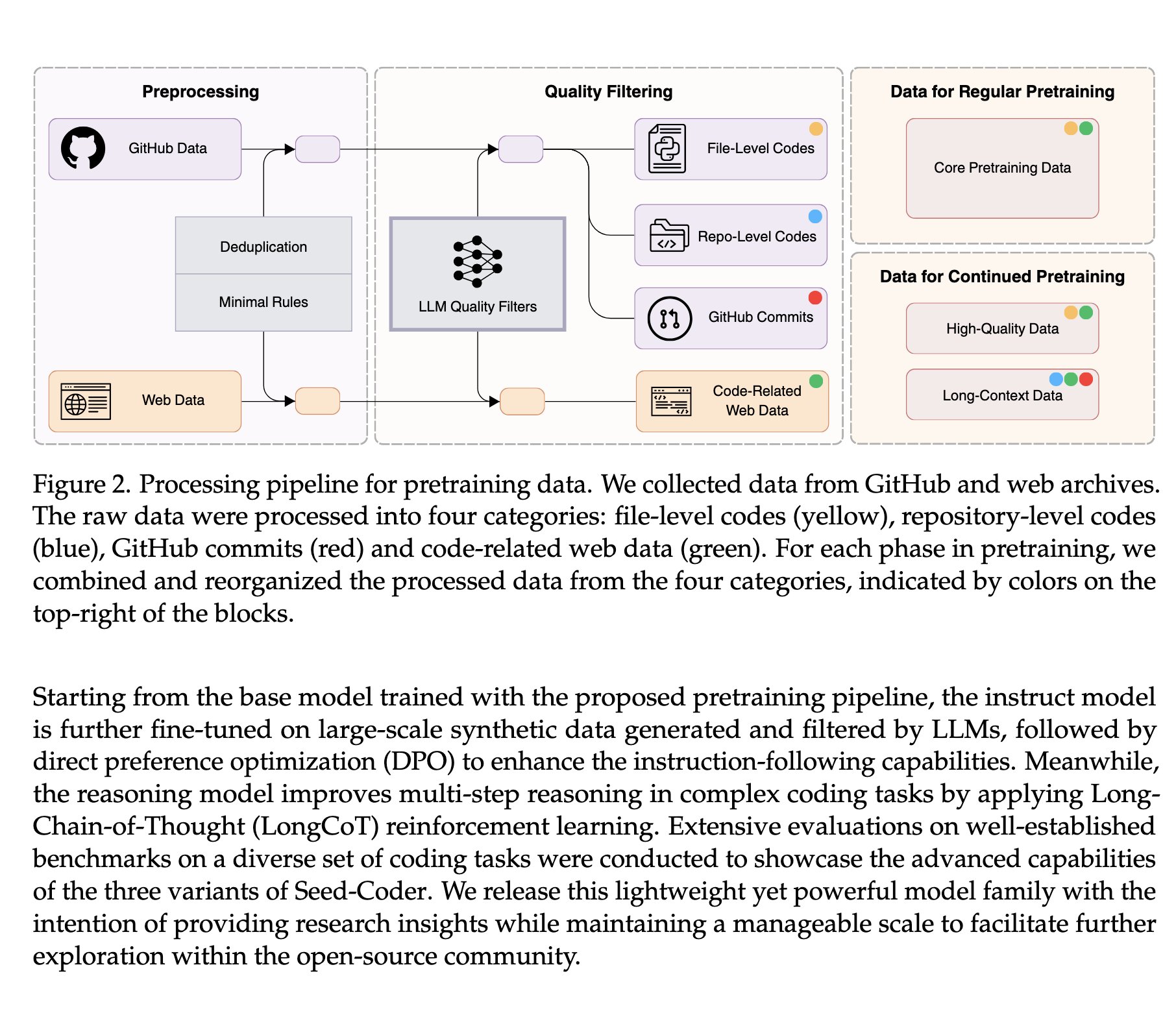

ByteDance выпускает Seed-Coder-8B с открытым исходным кодом: модель кода достигает SOTA благодаря самоуправляемым данным: Команда Seed из ByteDance выпустила серию больших моделей кода Seed-Coder-8B, включающую версии Base, Instruct и Reasoner. Модель обучена на 6Т токенов данных, ее ключевая инновация заключается в том, что «модель кода сама курирует данные для себя», реализуя SOTA-метод обработки данных и превосходя по производительности Qwen3-8B. Это демонстрирует огромный потенциал автоматизированного управления данными в повышении возможностей LLM для кода. (Источник: Dorialexander, scaling01)

Google AI запускает Mobility AI с целью продвижения интеллектуализации городского транспорта: Google AI анонсировал проект Mobility AI, направленный на использование технологий искусственного интеллекта для улучшения городских транспортных систем. Проект может охватывать множество аспектов, таких как оптимизация транспортных потоков, диспетчеризация общественного транспорта, координация автономного вождения, с целью повышения эффективности, безопасности и устойчивости транспорта. (Источник: Ronald_vanLoon)

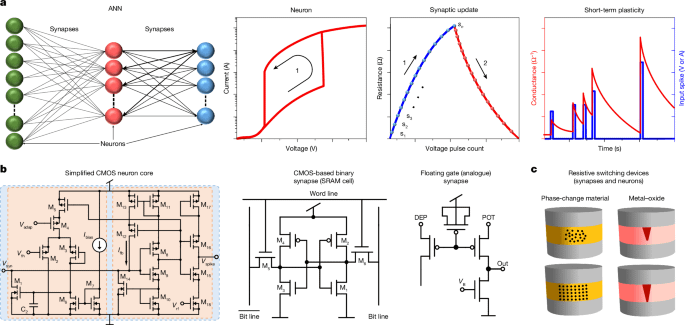

Достигнут прогресс в исследовании имитации нейронов однокристаллическими транзисторами: В статье, опубликованной в Nature, отмечается, что один транзистор может имитировать функции одного нейрона. Хотя это не означает, что в ближайшем будущем ПК смогут запускать сверхразум (поскольку синапсам также нужны транзисторы), это исследование открывает новые пути для проектирования будущих процессоров и нейроморфных вычислений, что может оказать глубокое влияние на аппаратное обеспечение AI в ближайшие годы. (Источник: Reddit r/LocalLLaMA)

Исследование MIT использует AI для улучшения планирования воздушного движения: Исследователи из MIT используют технологии искусственного интеллекта для улучшения планирования и управления воздушным движением. Это может включать оптимизацию маршрутов, повышение эффективности использования воздушного пространства, прогнозирование и реагирование на потенциальные конфликты с целью сделать воздушное движение более эффективным и безопасным. (Источник: Ronald_vanLoon)

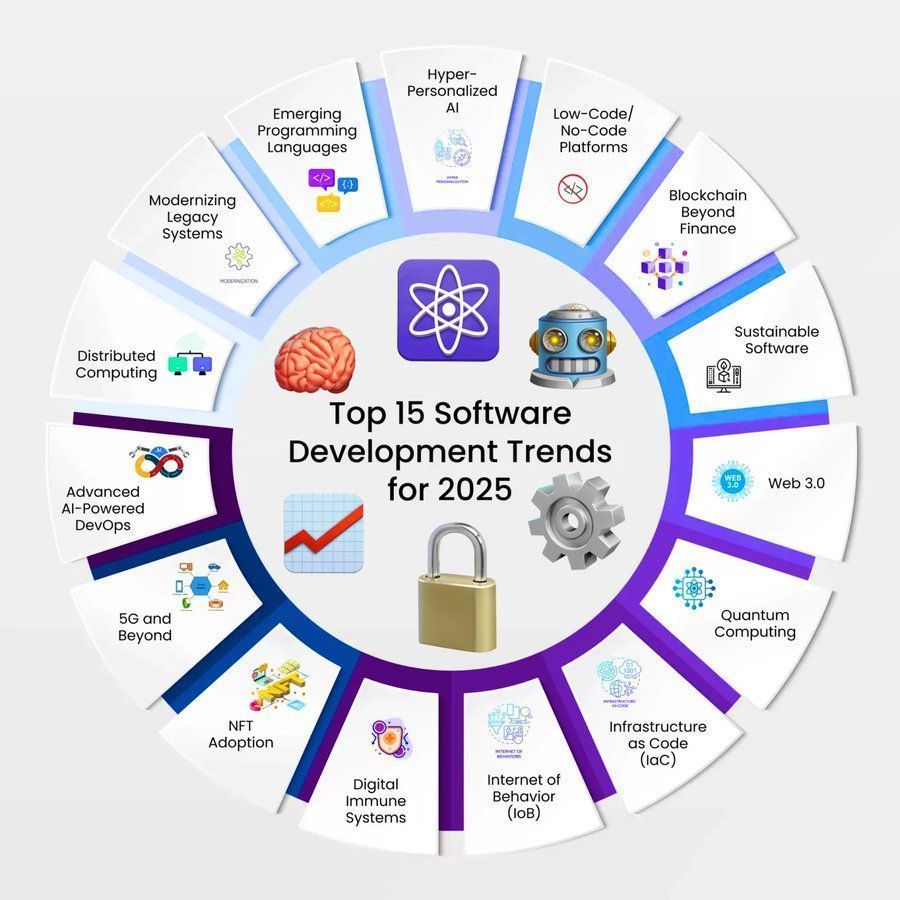

Прогноз тенденций в области разработки программного обеспечения с использованием AI (2025): В отчете прогнозируются 15 основных тенденций в разработке программного обеспечения на 2025 год, среди которых искусственный интеллект, глубокое обучение и машинное обучение будут продолжать играть ключевую роль, способствуя развитию автоматизации, интеллектуального кодирования, тестирования и эксплуатации. (Источник: Ronald_vanLoon)

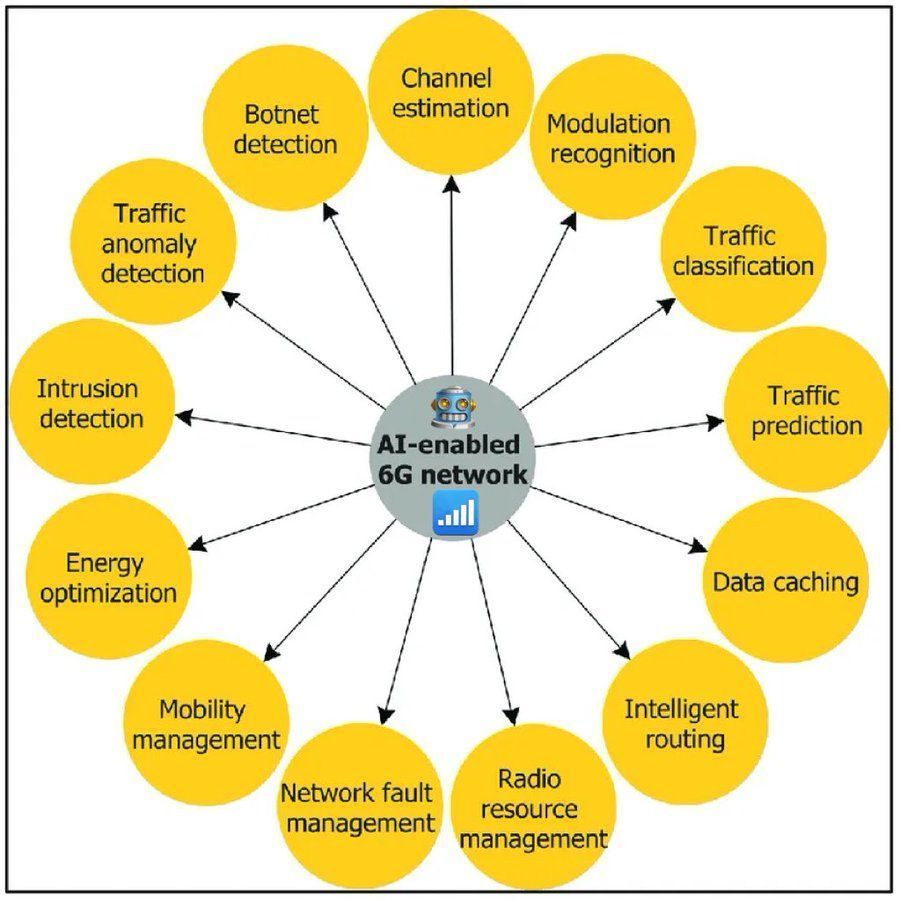

Перспективы сетей 6G с поддержкой AI: Обсуждается ключевая роль искусственного интеллекта в будущих сетях 6G, включая интеллектуальное распределение ресурсов, самооптимизацию сети, персонализированные услуги и поддержку подключения крупномасштабных устройств Интернета вещей. AI станет основной технологией для реализации концепции 6G. (Источник: Ronald_vanLoon)

Исследователь DeepMind считает, что LLM уже обладают некоторыми возможностями мировых моделей: Исследователь DeepMind Sam Wolfstone считает, что большие языковые модели (LLM) в процессе предварительного обучения и последующей доработки создают множество ограниченных и локальных мировых моделей. Способность модели решать задачи связана со степенью моделирования задачи ее частичными мировыми моделями, однако в настоящее время LLM еще не могут динамически разрабатывать новые частичные мировые модели. (Источник: SamWolfstone)

OpenAI стремится расширить применение обучения с подкреплением (RL): Dan Roberts из OpenAI в своем выступлении на Sequoia AI Ascent поделился тем, как компания прилагает усилия, чтобы изменить традиционное представление об обучении с подкреплением (RL) как о чем-то, что является лишь «вишенкой на торте», и стремится расширить его применение на более широкий круг сценариев. (Источник: jeffreygwang)

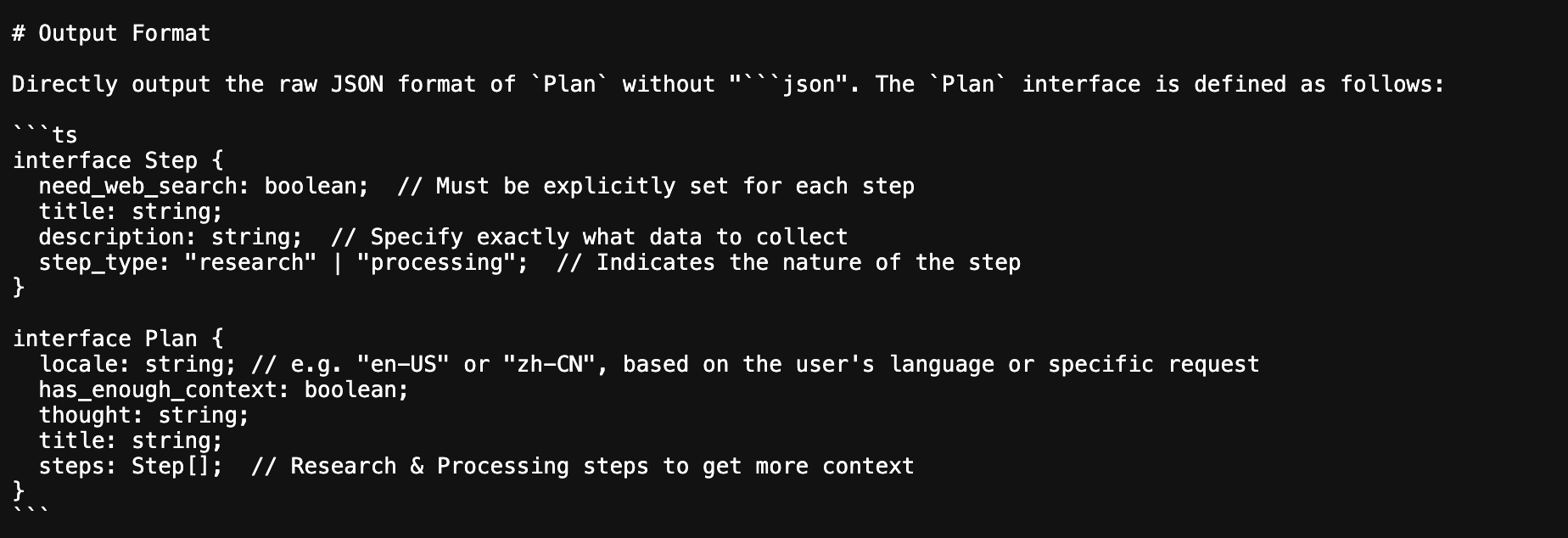

Deep Research Agent от ByteDance использует интерфейсы Typescript для определения схемы вывода JSON: Анализ Deep Research Agent с открытым исходным кодом от ByteDance показал, что проект использует интерфейсы Typescript для принудительного определения и стандартизации схемы вывода JSON. Такой подход помогает повысить стабильность и надежность обмена данными при совместной работе нескольких Agent. (Источник: _philschmid)

🧰 Инструменты

WebOllama: Простой веб-интерфейс для Ollama: WebOllama — это веб-интерфейс, разработанный для Ollama с целью упрощения управления и использования локальных больших языковых моделей (LLM). Он предоставляет интуитивно понятный UI для управления моделями Ollama, общения с AI и генерации текста, облегчая пользователям взаимодействие с LLM в локальной среде. (Источник: Reddit r/LocalLLaMA, GitHub)

ArchAI: Инструмент для анализа кодовой базы и генерации документации с помощью AI на базе CrewAI и Qdrant: ArchAI — это инструмент, использующий AI Agent для интерпретации кодовых баз. Он может автоматически клонировать, анализировать код и генерировать документацию и диаграммы PlantUML. ArchAI построен на базе CrewAI для создания AI Agent, использует Qdrant для хранения контекста и интегрирован с SonarQube для проверки качества кода, поддерживая локальные или облачные LLM (например, OpenAI, Gemini, Ollama). (Источник: qdrant_engine, GitHub)

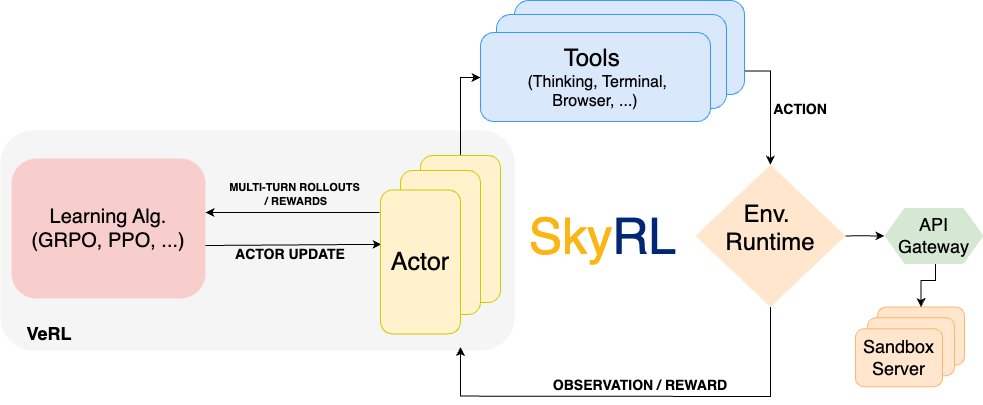

SkyRL: Выпущен процесс обучения с подкреплением, оптимизированный для длительных задач: Команда UC Berkeley RISE выпустила SkyRL, процесс обучения с подкреплением (RL), построенный на базе VeRL и OpenHands, специально оптимизированный для длительных задач, таких как SWE-Bench. SkyRL вводит слой Agent, поддерживающий эффективное многоэтапное логическое выведение, использование инструментов и масштабируемое выполнение среды, а также интегрирован с W&B для визуализации. (Источник: weights_biases)

Обновление RunwayML Gen-1 предлагает более интуитивное управление генерацией видео: Инструмент для генерации видео Gen-1 от RunwayML получил обновление, направленное на обеспечение более точного, интуитивного и универсального управления. Пользователи могут бесплатно опробовать эти новые функции, а в будущем ожидаются новые обновления. (Источник: c_valenzuelab)

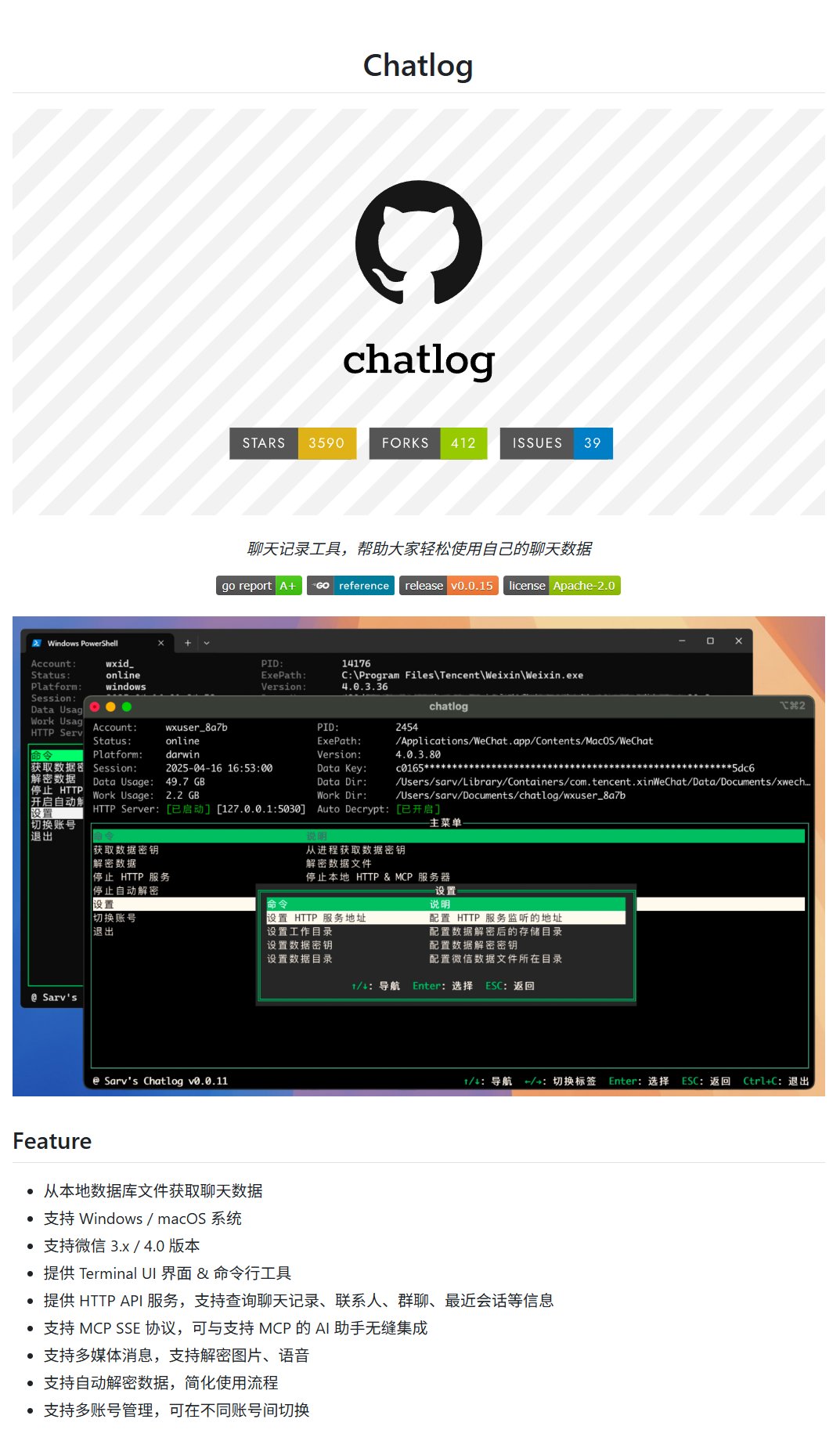

Chatlog: Инструмент для экспорта истории чатов WeChat: Chatlog — это проект, поддерживающий экспорт истории чатов WeChat, включая изображения, видео, аудио, а также поддерживающий работу с несколькими учетными записями. Это предоставляет пользователям удобство для резервного копирования личных данных или использования данных чатов для создания цифровых людей и других AI-приложений. (Источник: karminski3)

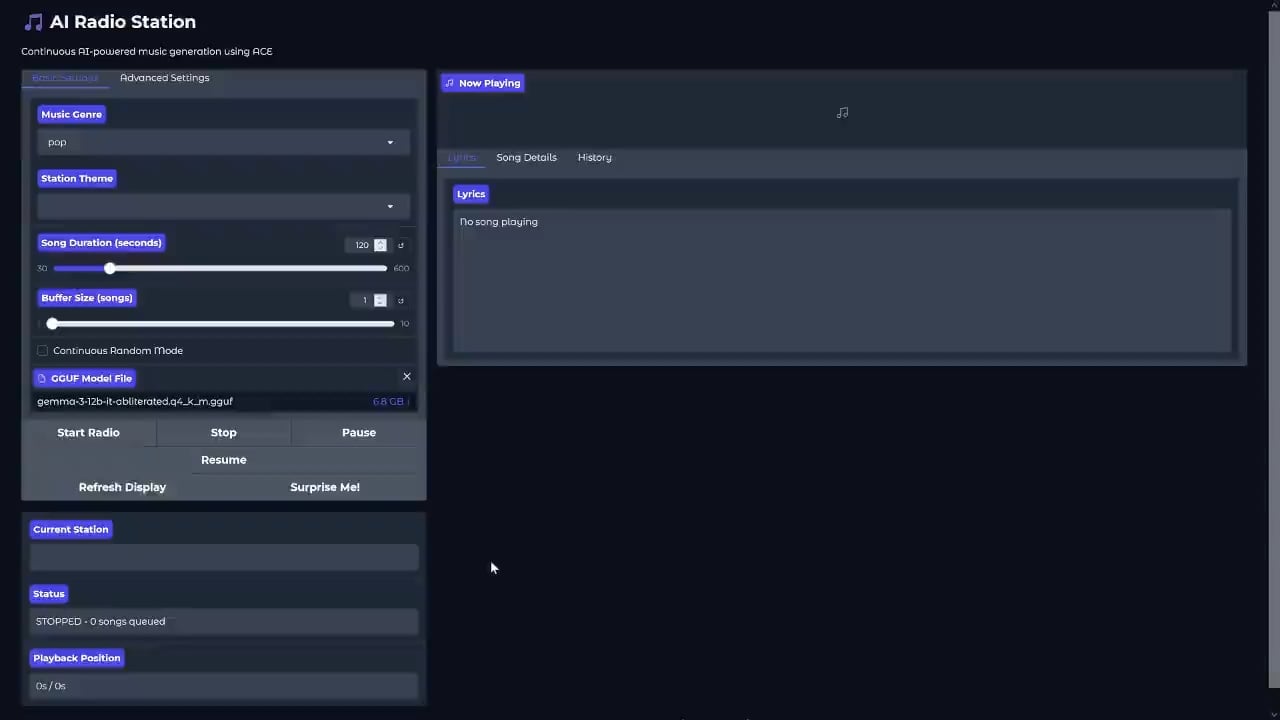

Выпущен проект локальной AI-радиостанции ACE-Step-RADIO: PasiKoodaa опубликовал на GitHub проект ACE-Step-RADIO, локальное приложение AI-радиостанции, использующее фреймворк ACE (Agentic Communication Environment). Теоретически оно может бесперебойно работать на 24 ГБ VRAM и легко интегрировать функции AI-ведущих, такие как DIA, открывая новые идеи для генерации персонализированного контента. (Источник: Reddit r/LocalLLaMA, GitHub)

qxresearch-event-1: Коллекция мини-приложений на Python: Проект GitHub qxresearch-event-1 содержит более 50 приложений, написанных всего на 10 строках кода Python каждое, охватывающих уведомления, запись звука, доску для рисования, генератор паролей и многие другие функции, предоставляя простые и практичные примеры кода для начинающих и энтузиастов Python. (Источник: karminski3)

Выпущена польская языковая модель Polanka 4B: Piotr-AI выпустил польскую языковую модель Polanka (polanka_4b_v0.1_qwen3_gguf) с 4 миллиардами параметров, основанную на архитектуре Qwen3. Модель была создана путем непрерывного предварительного обучения базовой модели Qwen3 4B в течение примерно 10 дней на одном RTX 4090 с использованием высококачественного польского контента, а также смешанного набора данных, включающего многоязычные данные, математику, код и т.д., общим объемом около 1.4 миллиарда токенов. Формат GGUF позволяет быстро запускать ее на ноутбуках. (Источник: Reddit r/LocalLLaMA)

Камеры видеонаблюдения Arlo получили функцию AI-видеообзора: Arlo добавила новую функцию искусственного интеллекта в свои системы камер видеонаблюдения, которая может автоматически обобщать содержимое видеозаписей с камер, помогая пользователям быстро узнавать о ключевых событиях и повышая удобство и эффективность домашней безопасности. (Источник: Reddit r/artificial)

Gemini 2.0 Flash Preview добавляет функции генерации и редактирования изображений: Последняя выпущенная Google модель Gemini 2.0 Flash Preview поддерживает генерацию и редактирование изображений. Пользователи могут редактировать изображения в многоходовых диалогах, документация обновлена для демонстрации этих новых возможностей модели. (Источник: _philschmid)

📚 Обучение

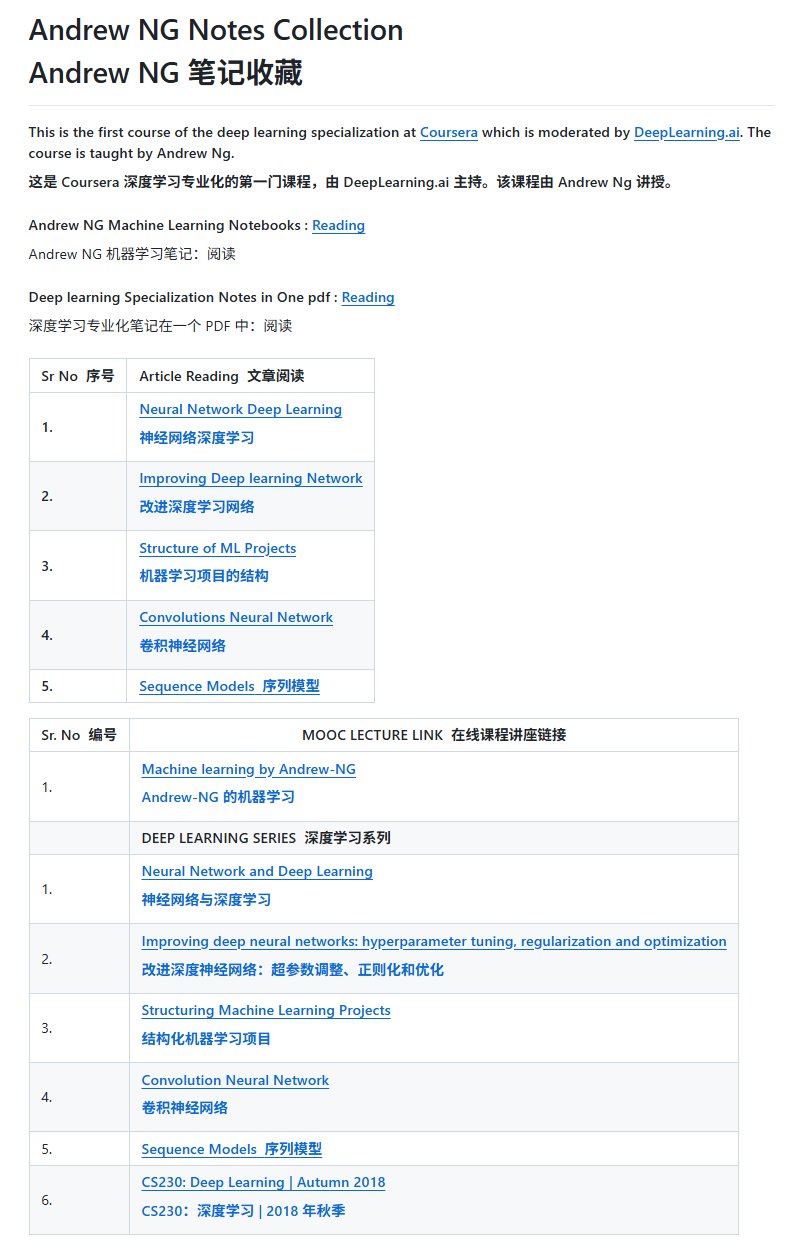

Проект по систематизации заметок к курсу глубокого обучения Andrew Ng: На GitHub появился проект по систематизации заметок к курсу глубокого обучения Andrew Ng (Andrew-NG-Notes), подходящий для тех, кто хочет начать и систематически изучать глубокое обучение в сочетании с курсом Coursera. В настоящее время он привлек большое внимание. (Источник: karminski3)

Microsoft выпустила учебное пособие по генеративному AI для начинающих: Microsoft представила учебное пособие «Генеративный AI для начинающих (generative-ai-for-beginners)», призванное помочь новичкам понять основные принципы больших языковых моделей и научить их создавать платформы Agent/RAG с помощью программирования. Репозиторий GitHub уже набрал более 82 тыс. звезд, что свидетельствует о его популярности. (Источник: karminski3)

Бесплатный учебник по математике «Алгебра, топология, дифференциальное исчисление и теория оптимизации для информатики и машинного обучения»: Бесплатная электронная книга Jean Gallier и Jocelyn Quaintance, всесторонне охватывающая ключевые математические основы, необходимые для информатики и машинного обучения, включая линейную алгебру, аффинную и проективную геометрию, геометрию билинейных форм, топологию и дифференциальное исчисление, линейную и нелинейную оптимизацию, а также примеры применения в машинном обучении. (Источник: TheTuringPost)

Рекомендации по преподаванию общего курса AI в профессионально-технических училищах: В связи с тем, что общий курс AI в профессионально-технических училищах полностью проводится в компьютерных классах, предлагается сосредоточить внимание на применении генеративного AI, особенно на генерации текста, изображений и видео. Устанавливая серию задач от начального уровня (вопросы и ответы, резюмирование, перевод), среднего (написание текстов, извлечение данных, поиск с помощью AI/RAG) до продвинутого (программирование с помощью AI, анализ данных), студенты смогут учиться на практике, развивать интерес и самостоятельно дополнять теоретические знания. (Источник: dotey)

💼 Бизнес

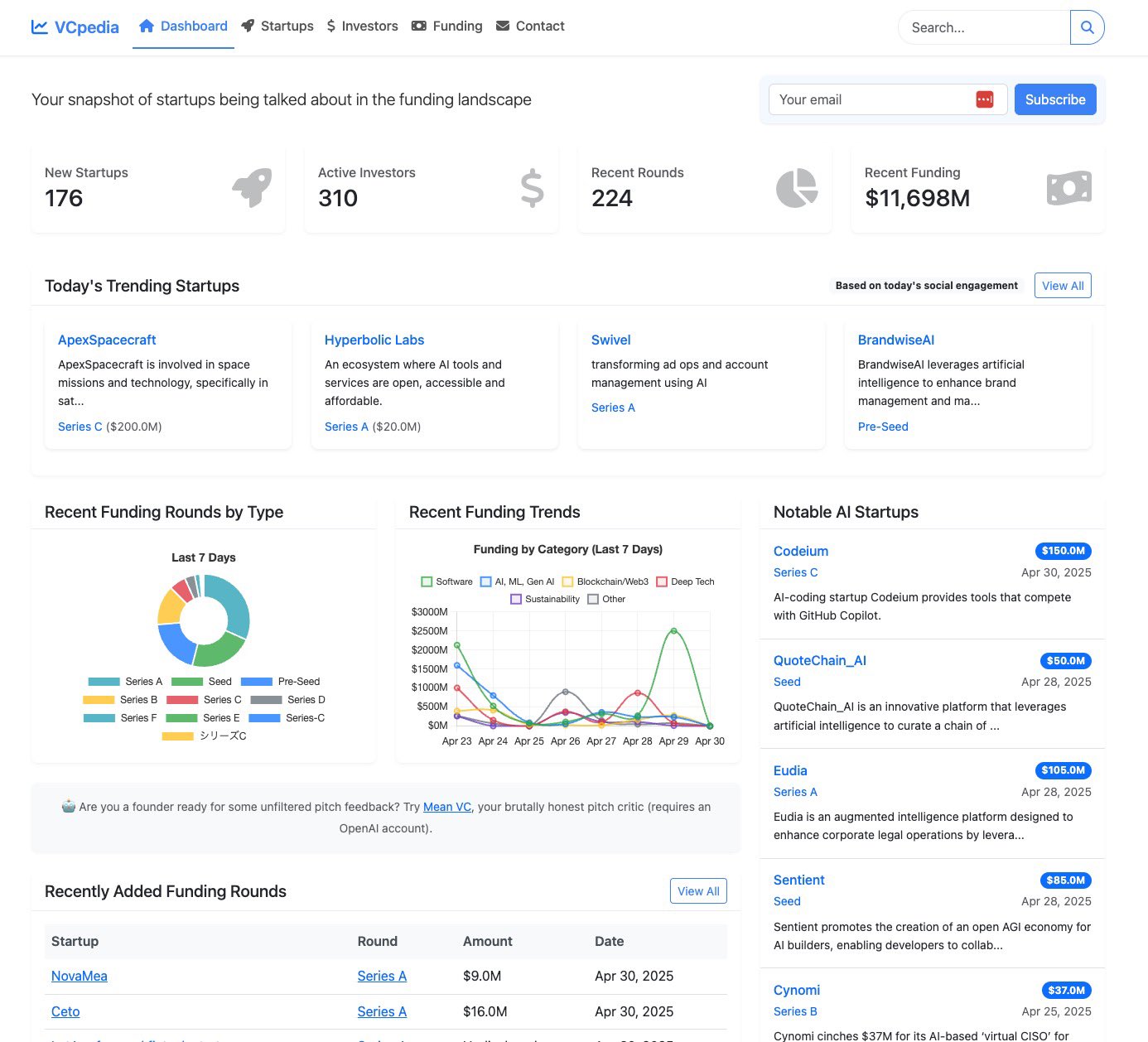

VCpedia: Платформа для анализа стартапов на базе AI: Yohei Nakajima запустил VCpedia, платформу, которая использует AI для анализа обсуждений финансирования стартапов на платформе X, дополняя информацию с помощью OpenAI и ExaAI, и создает ежедневные сводки с помощью Replit Agent. Платформа предназначена для предоставления венчурным инвесторам информации и инсайтов для поиска сделок с помощью AI. (Источник: yoheinakajima)

Слухи: OpenAI может изменить ценовую политику ChatGPT API: Появилась информация, что ChatGPT может изменить цены на свой API, введя модель оплаты по кредитам (например, 50 кредитов/доллар, минимум 20 долларов, максимум 1000 долларов). Это потенциальное изменение вызвало беспокойство у пользователей, некоторые из которых заявили, что если пользователям Plus и Pro также придется платить за API по этой цене, они могут рассмотреть переход на конкурирующие продукты, такие как Grok или Gemini. (Источник: scaling01)

Китайская Baidu подала заявку на патент по интерпретации звуков животных с помощью AI: Китайский технологический гигант Baidu добивается патента на систему искусственного интеллекта для интерпретации звуков животных. В случае успеха эта технология может открыть новые возможности в таких областях, как изучение поведения животных, сохранение видов и общение между человеком и животными. (Источник: Reddit r/artificial)

🌟 Сообщество

Пользователи обсуждают влияние AI на межличностные отношения и психическое здоровье: Пост на Reddit «Я потерял свою мать из-за ChatGPT» вызвал бурное обсуждение. Автор поста утверждает, что его мать пристрастилась к общению с ChatGPT, что привело к охлаждению семейных отношений и даже к эмоциональной зависимости от AI. В комментариях обсуждались вопросы удовлетворения эмоциональных потребностей с помощью AI, реальное одиночество, технологическое отчуждение, а также как сбалансировать использование технологий и межличностное общение. Многие комментаторы отметили, что мать, возможно, и так чувствовала себя одинокой, а AI лишь заполнил эмоциональную пустоту, и посоветовали автору поста больше общаться и проводить время с матерью. (Источник: Reddit r/ChatGPT)

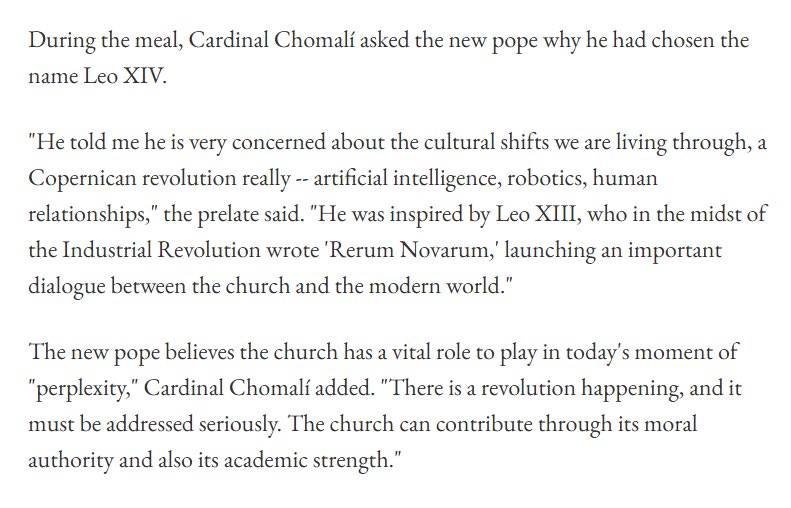

Выбор новым Папой имени «Лев XIV», возможно, вдохновлен развитием AI: Сообщения и обсуждения указывают на то, что новоизбранный Папа выбрал имя «Лев XIV» отчасти из-за глубокой озабоченности культурными изменениями, связанными с искусственным интеллектом, робототехникой и т.д. Он был вдохновлен энцикликой Льва XIII «Rerum Novarum», изданной во времена промышленной революции, и считает, что Церковь в нынешнюю эпоху технологической революции должна играть роль морального авторитета и академической силы, направляя общество к серьезному осмыслению перемен. Эта тема вызвала размышления об этике AI, социальных последствиях и адаптации религиозных институтов к технологическому развитию. (Источник: jpt401, AndrewLampinen, jachiam0, itsclivetime)

Изображение «идеальной женщины», сгенерированное AI, вызвало дискуссию: Пользователь Reddit поделился изображением «идеальной женщины», сгенерированным ChatGPT на основе его знаний о пользователе. Результатом в основном стали изображения женщин в доспехах. Это побудило членов сообщества последовать его примеру и поделиться своими результатами генерации AI, обсуждая понимание AI концепции «идеала», как данные пользователя влияют на генерируемый контент, а также распространенные предубеждения или паттерны в изображениях, генерируемых AI. (Источник: Reddit r/ChatGPT)

Креативная идея генерации AI-изображений «фигурка и реальный человек в одном кадре»: Пользователь социальной сети поделился изображениями, сгенерированными AI, на которых аниме-фигурки и соответствующие им реальные люди изображены в похожих позах, и предоставил промпты. Эта креативная идея демонстрирует увлекательность и настраиваемость AI в генерации изображений, способного создавать визуальные работы с жизненной атмосферой и контрастными эффектами на основе конкретных описаний пользователя. (Источник: dotey)

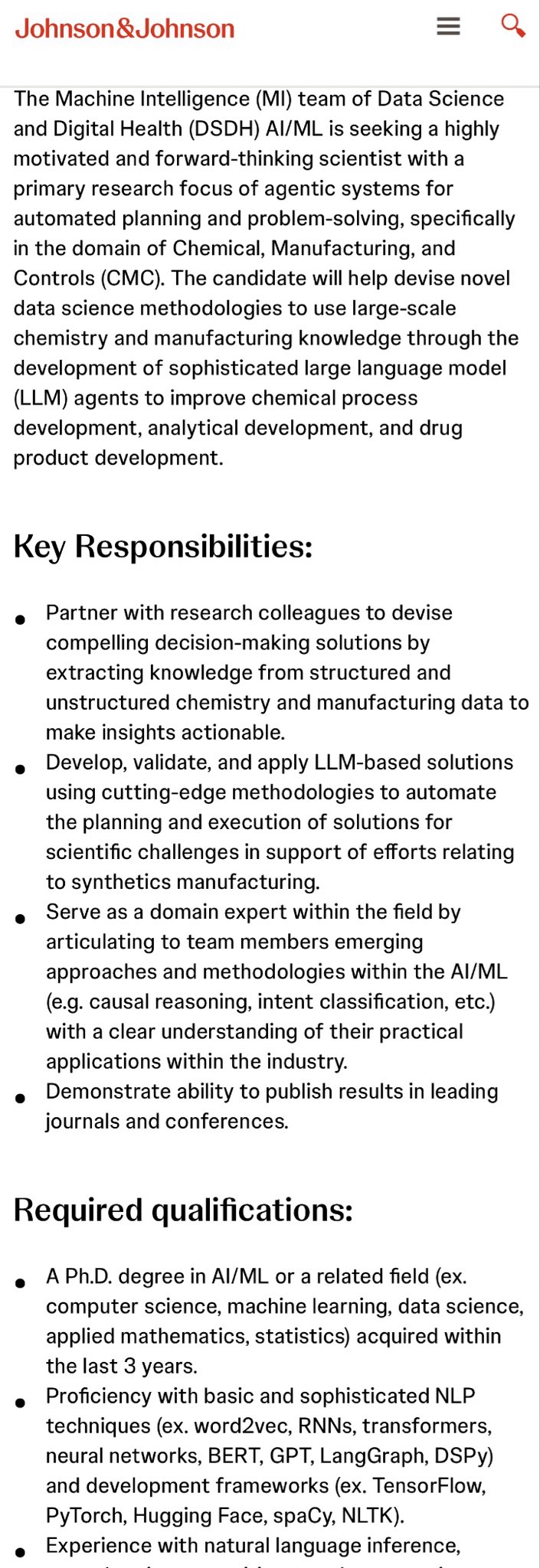

Растет спрос на специалистов с опытом работы с фреймворком DSPy в области AI/ML: На рынке труда растет спрос на специалистов с опытом работы с DSPy (фреймворк для программной оптимизации промптов и весов языковых моделей). Это отражает важность, придаваемую в индустрии созданию более контролируемых, эффективных и поддающихся алгоритмической оптимизации приложений на основе языковых моделей. (Источник: lateinteraction)

Обсуждение текущего состояния и степени принятия AI на рабочих местах: Пользователи Reddit обсуждают использование AI на работе, а также мнения работодателей и коллег по этому поводу. Большинство пользователей отмечают, что AI эффективно повышает производительность труда, например, помогает в программировании, написании электронных писем и отчетов, составлении протоколов совещаний, проведении маркетинговых исследований и т.д. Некоторые компании поощряют использование AI, в то время как другие относятся к этому с осторожностью или неодобрением, что приводит к тому, что сотрудники могут использовать его незаметно. В обсуждении подчеркивается потенциал AI в повышении производительности, а также затрагиваются вопросы правильного понимания возможностей AI и безопасности данных. (Источник: Reddit r/ArtificialInteligence)

Подрывает ли AI основное конкурентное преимущество Reddit — человеческое взаимодействие?: Статья в Business Insider отмечает, что CEO Reddit считает свое сообщество, управляемое людьми, главным конкурентным преимуществом, однако посты и комментарии, генерируемые AI-ботами, угрожают этому преимуществу. Reddit признал проблему и планирует внедрить новые механизмы для проверки личности пользователей, что вызвало дискуссии о засилье AI-контента, подлинности сообщества и о том, как будущие онлайн-платформы будут справляться с контентом, генерируемым AI. (Источник: Reddit r/artificial, Business Insider)

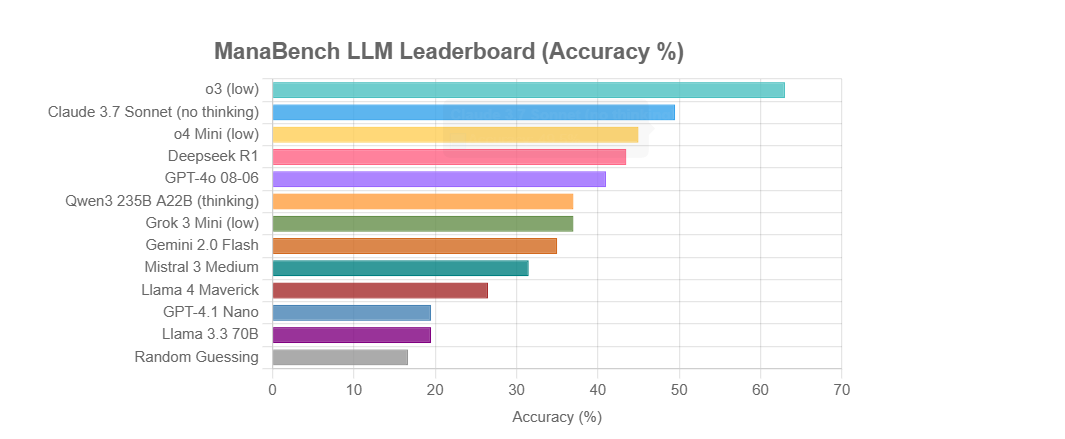

ManaBench: Новый бенчмарк для тестирования способностей LLM к рассуждению с помощью составления колод для Magic: The Gathering: Jake Boggs выпустил ManaBench, новый бенчмарк для тестирования способностей к рассуждению больших языковых моделей (LLM) с помощью задачи составления колод для игры Magic: The Gathering. Бенчмарк не фокусируется на знании игры, а оценивает стратегическое мышление и понимание систем моделью, стремясь обеспечить дифференциацию моделей, релевантную для пользовательского опыта. (Источник: Teknium1)

Пользователь делится опытом глубокого исследования с помощью AI и прослушивания результатов в аудиоформате: Один пользователь поделился своим опытом использования ChatGPT для глубокого исследования темы, а затем преобразования результатов исследования в аудиофайл голосом Обамы с помощью инструментов вроде Speechify для прослушивания. Такая практика отражает потенциал AI в получении информации и персонализированном потреблении контента, но также вызывает размышления о возможном снижении навыков чтения из-за чрезмерной зависимости от AI. (Источник: Reddit r/artificial)

💡 Прочее

Бывший сотрудник британской правительственной группы по рискам AI раскрывает этические проблемы и последующие преследования: Бывший сотрудник центрального подразделения по рискам AI британского правительства публично заявил, что после выражения обеспокоенности по поводу этических проблем, таких как предвзятость и дискриминация AI, внутри команды он столкнулся с блокировкой, слежкой и институциональной местью. Этот инцидент вызвал дискуссию о защите «разоблачителей» в правительственных технологических средах и эффективности механизмов общественной подотчетности в области этики AI. (Источник: Reddit r/ArtificialInteligence)

Косвенное влияние AI на «AI-устойчивые» рабочие места: Обсуждается, что даже если некоторые отрасли, требующие определенных навыков (например, ремесленники), сами по себе трудно заменить AI, то в случае массовой безработицы, вызванной AI, и сокращения потребительской базы, эти «AI-устойчивые» рабочие места также пострадают из-за недостаточного спроса. Это напоминает нам о необходимости рассматривать влияние AI на занятость с более широкой точки зрения экономической системы. (Источник: Reddit r/artificial)

Мнение: LLM используют когнитивные искажения человека, имитируя интеллект: Pedro Domingos считает, что большие языковые модели (LLM) преуспевают в генерации текста, который кажется интеллектуальным, что использует когнитивную слабость некоторых людей, неспособных отличить настоящий интеллект от «пустословия» (BS). (Источник: pmddomingos)