Ключевые слова:Интерфейс взаимодействия с LLM, Дебаты об AGI, Стратегия приложения Gemini, Этика AI-компаньонов, Модель Qwen3, Технология RAG, Альтернативная архитектура Transformer, Релиз AI-моделей, Визуальный интерфейс взаимодействия Karpathy, Ключевые элементы Agentic RAG, Архитектура Liquid Foundation Models, Метод обучения Phi-4-Reasoning, Обратная инженерия системных подсказок NotebookLM

🔥 В фокусе

Видение Karpathy будущего интерфейса взаимодействия с LLM: Karpathy прогнозирует, что будущее взаимодействие с LLM выйдет за рамки текущей модели текстового терминала и превратится в визуализированный, генеративный, интерактивный 2D-холст. Этот интерфейс будет генерироваться мгновенно в соответствии с потребностями пользователя, интегрируя различные элементы, такие как изображения, диаграммы, анимации, и обеспечивая более высокую плотность информации и интуитивно понятный опыт, подобный тому, что изображено в научно-фантастических произведениях, таких как «Железный человек». Он считает, что текущие Markdown, блоки кода и т. д. — это лишь ранние прототипы (источник: karpathy)

Является ли AGI ключевой вехой? Разгораются дебаты: Arvind Narayanan и Sayash Kapoor опубликовали статью на AI Snake Oil, в которой подробно рассматривается концепция AGI (Общий Искусственный Интеллект), утверждая, что это не четкая технологическая веха или точка перелома. Статья аргументирует с разных точек зрения — экономическое влияние (распространение требует времени), геополитика (способности не равны власти), риски (различение способностей и власти), трудности определения (ретроспективная оценка) — что даже достижение определенного порога возможностей AGI не вызовет немедленных подрывных экономических или социальных последствий. Чрезмерное внимание к AGI может отвлекать от реальных проблем современного ИИ (источник: random_walker, random_walker, random_walker, random_walker, random_walker)

Глава Google DeepMind излагает стратегию Gemini App: Demis Hassabis перепостил и одобрил изложение Josh Woodward будущей стратегии Gemini App. Стратегия строится вокруг трех ключевых элементов: персонализация (Personal), предоставляющая услуги, лучше понимающие пользователя, за счет интеграции данных из его экосистемы Google (Gmail, Photos и т.д.); проактивность (Proactive), предвидящая потребности и предлагающая инсайты и действия до того, как пользователь задаст вопрос; мощные возможности (Powerful), использующие модели DeepMind (например, 2.5 Pro) для исследований, оркестровки и генерации мультимодального контента. Цель — создать мощного личного ИИ-помощника, который ощущается как продолжение пользователя (источник: demishassabis)

Разработка AI-компаньонов Meta вызывает этические и социальные дискуссии: Марк Цукерберг в интервью упомянул, что Meta разрабатывает AI-друзей/компаньонов для удовлетворения социальных потребностей людей (упомянув, что «у среднего американца 3 друга, а потребность — 15»). Этот план вызвал широкое обсуждение: с одной стороны, он может утешить одиноких людей, с другой — вызывает опасения по поводу того, не подорвет ли он еще больше реальное общение, не усугубит ли социальную атомизацию, а также вопросы конфиденциальности данных и другие этические проблемы (источник: Reddit r/artificial, dwarkesh_sp, nptacek)

🎯 Тенденции

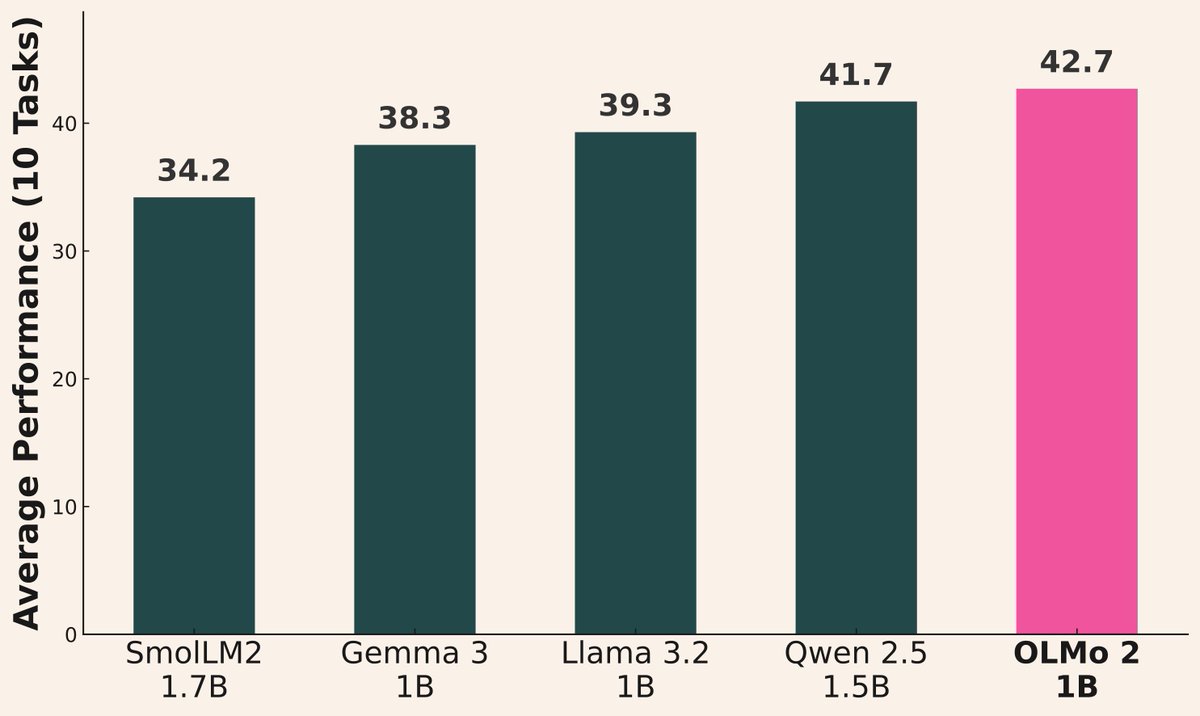

Волна релизов AI-моделей продолжается: Недавно несколько организаций выпустили новые модели: Alibaba выпустила серию Qwen3 (включая 0.6B до 235B MoE); AI2 выпустила модель OLMo 2 1B, превосходящую по производительности Gemma 3 1B и Llama 3.2 1B; Microsoft выпустила серию Phi-4 (Mini 3.8B, Reasoning 14B); DeepSeek выпустила Prover V2 671B MoE; Xiaomi выпустила MiMo 7B; Kyutai выпустила Helium 2B; JetBrains выпустила модель автодополнения кода Mellum 4B. Возможности моделей с открытым исходным кодом продолжают быстро расти (источник: huggingface, teortaxesTex, finbarrtimbers, code_star, scaling01, ClementDelangue, tokenbender, karminski3)

Модели серии Qwen3 показывают впечатляющие результаты: Отзывы сообщества показывают отличную производительность моделей серии Qwen3. Qwen3 32B считается достигающей уровня o3-mini при меньшей стоимости; Qwen3 4B отлично справляется с конкретными тестами (например, подсчет буквы “R” в “strawberry”) и задачами RAG, пользователи даже используют ее вместо Gemini 2.5 Pro; модель 30B MoE демонстрирует выдающиеся способности в многоязычном переводе (включая диалекты). Некоторые пользователи заметили, что Qwen3 235B MoE признает границы своих знаний, когда не может ответить, вместо того чтобы выдумывать, что может указывать на улучшения в обработке галлюцинаций (источник: scaling01, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, teortaxesTex, scaling01)

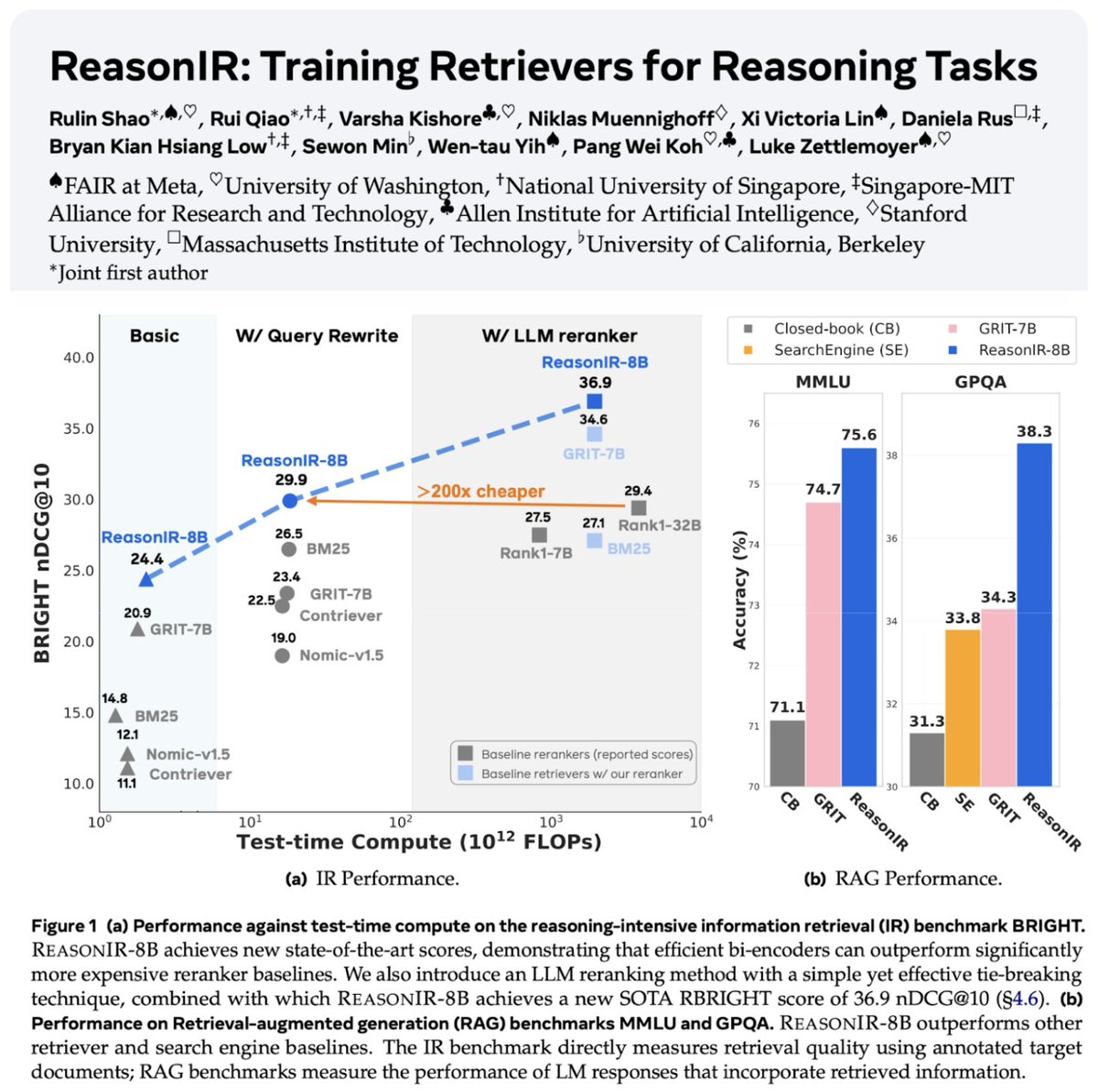

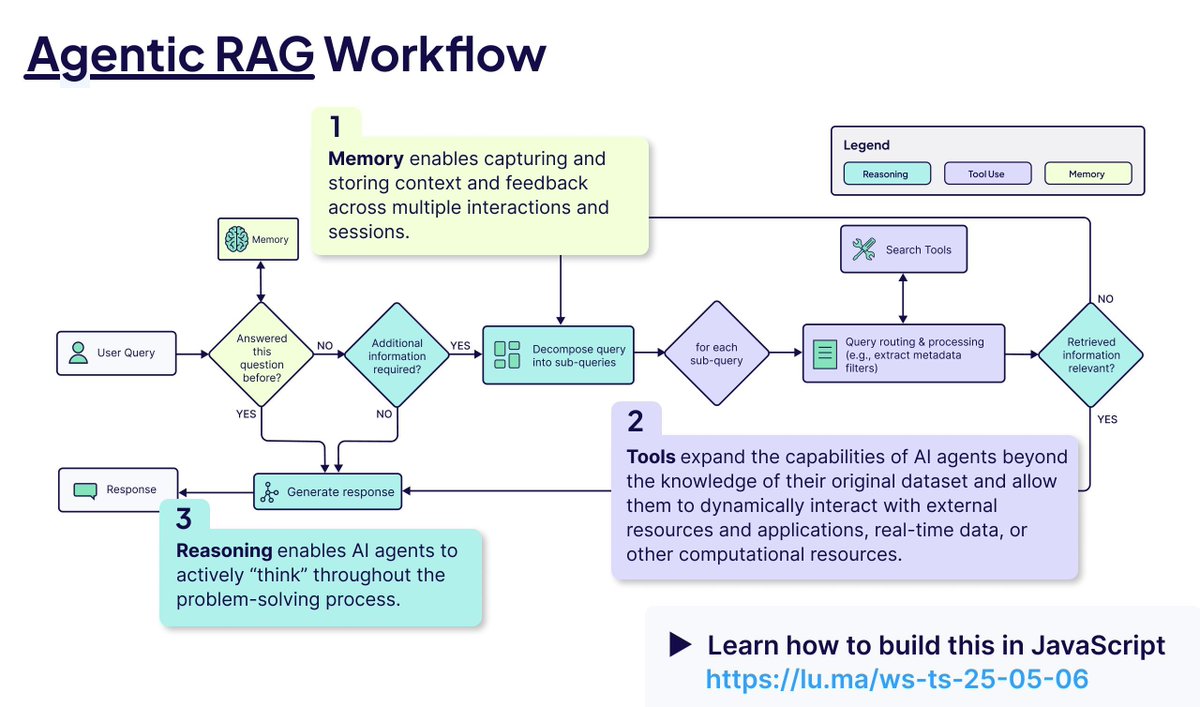

Технологии поиска и RAG продолжают развиваться: Выпущена ReasonIR-8B, первая поисковая система, специально обученная для задач рассуждения, достигшая SOTA на соответствующих бенчмарках. Подчеркивается концепция Agentic RAG, суть которой заключается в использовании памяти (краткосрочной и долгосрочной), вызова инструментов и рассуждений (планирование, рефлексия) для улучшения процесса RAG. Пользователи провели сравнительное тестирование локальных LLM (Qwen3, Gemma3, Phi-4) на задачах Agentic RAG и обнаружили, что Qwen3 показала лучшие результаты (источник: Tim_Dettmers, Muennighoff, bobvanluijt, Reddit r/LocalLLaMA)

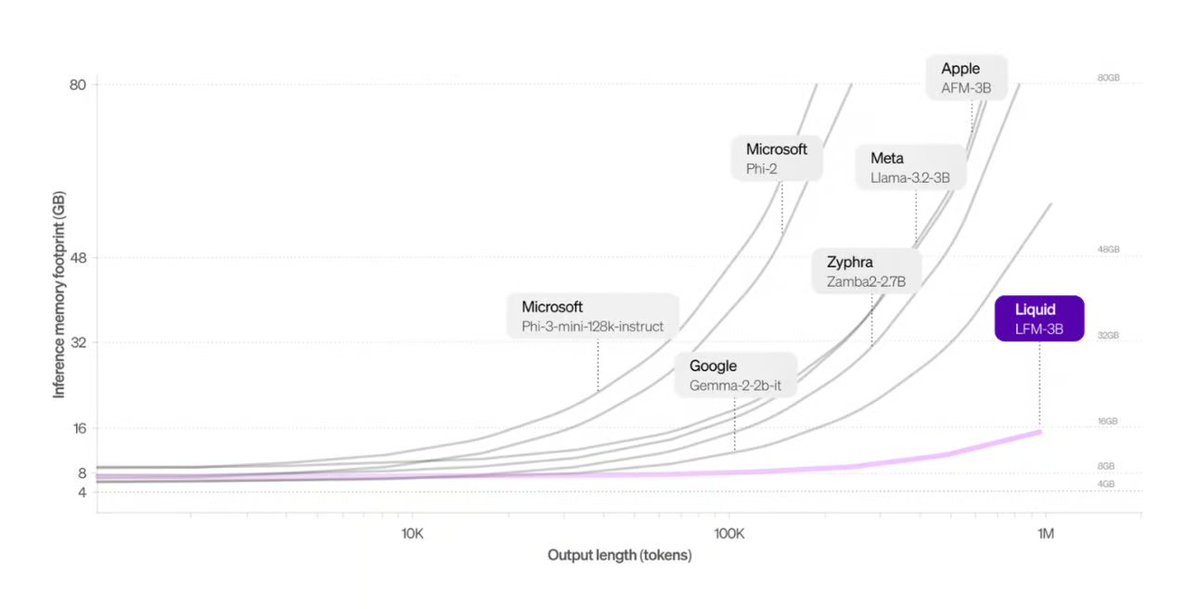

Liquid AI представляет альтернативную архитектуру Transformer: Предложенные Liquid AI модели Liquid Foundation Models (LFMs) и их модель Hyena Edge представлены как потенциальная альтернатива архитектуре Transformer. LFMs основаны на динамических системах и нацелены на повышение эффективности обработки непрерывных входных данных и длинных последовательностей, особенно в плане эффективности использования памяти и скорости инференса, и уже прошли бенчмаркинг на реальном оборудовании (источник: TheTuringPost, Plinz, maximelabonne)

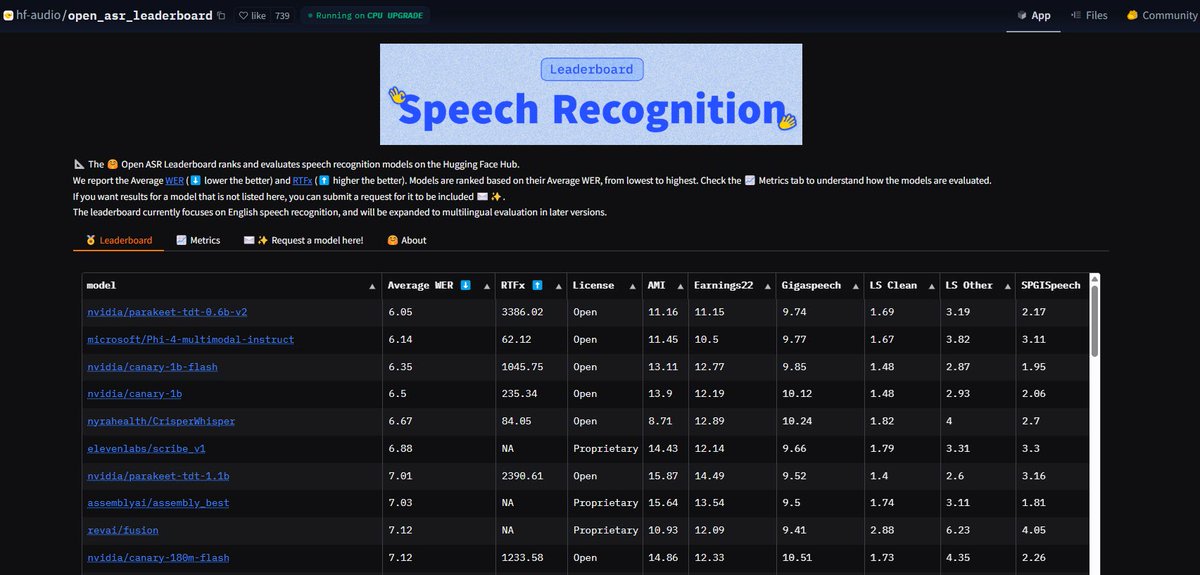

Модель ASR NVIDIA Parakeet бьет рекорды: Выпущенная NVIDIA модель автоматического распознавания речи (ASR) Parakeet-tdt-0.6b-v2 достигла лучшего в отрасли уровня ошибки по словам (WER) 6.05% на Open-ASR-Leaderboard от Hugging Face. Модель не только точна, но и быстра в инференсе (RTFx 3386), а также обладает инновационными функциями, такими как транскрипция песен в текст, точные временные метки/форматирование чисел (источник: huggingface, ClementDelangue)

AI-режим поиска Google полностью доступен пользователям в США: Google объявила, что AI-режим (AI Mode) в ее поисковом продукте отменяет список ожидания и становится доступным для всех пользователей Labs в США. Также добавлены новые функции, призванные помочь пользователям с покупками, планированием местной жизни и другими задачами, что еще больше интегрирует возможности ИИ в основной поисковый опыт (источник: Google)

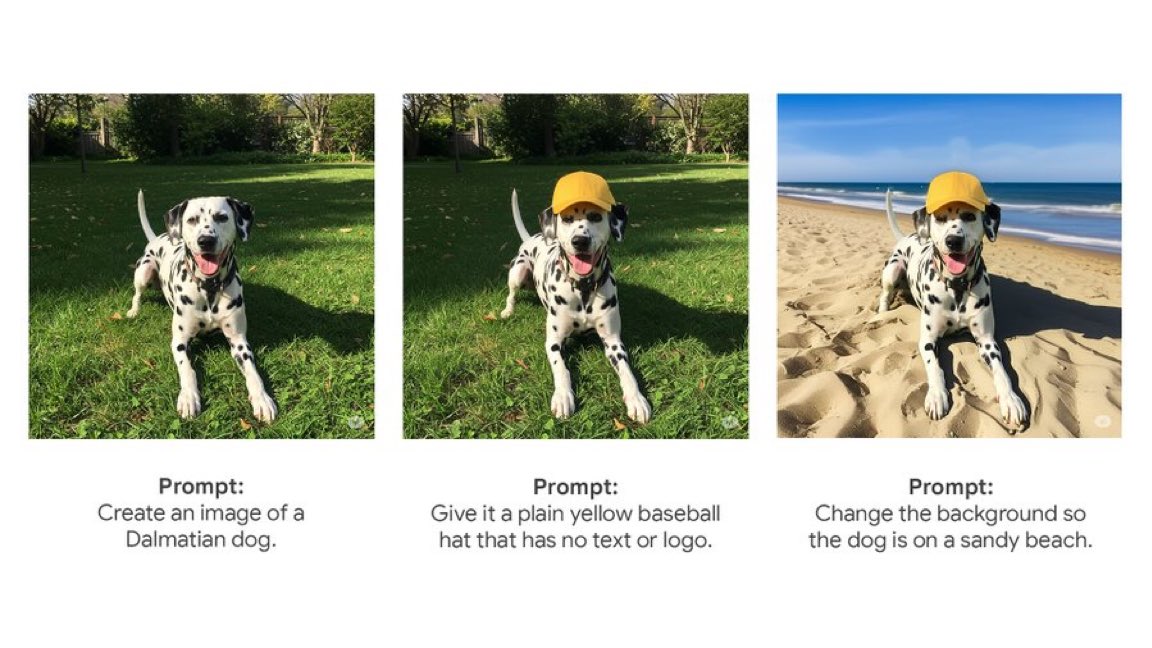

Gemini App запускает нативную функцию редактирования изображений: Приложение Gemini от Google начало предоставлять пользователям нативную функцию редактирования изображений. Это означает, что пользователи могут напрямую изменять изображения в приложении Gemini, что расширяет его мультимодальные возможности взаимодействия и позволяет пользователям выполнять больше задач, связанных с изображениями, в едином интерфейсе (источник: m__dehghani)

Модель Meta SAM 2.1 обеспечивает новые функции редактирования изображений: Meta опубликовала блог, в котором рассказывается, как ее новейшая технология Segment Anything Model (SAM) 2.1 поддерживает функцию Cutouts (вырезание объектов) в новом приложении Instagram Edits. Это демонстрирует, как исследования базовых моделей могут быстро превращаться в потребительские функции, повышая интеллектуальный уровень редактирования изображений (источник: AIatMeta)

Функция Claude Code интегрирована в подписку Max: Anthropic объявила, что ее функция обработки кода и использования инструментов Claude Code теперь включена в подписку Claude Max, и пользователи могут использовать ее без дополнительной платы за токены. Однако пользователи сообщества отмечают, что лимит вызовов API, прилагаемый к подписке Max (например, 225 вызовов за 5 часов), может быстро исчерпаться при частом использовании инструментов (каждый вызов потребляет 2 API-вызова) (источник: dotey, vikhyatk)

CISCO выпускает LLM, специализированную для кибербезопасности: CISCO, продолжив предварительное обучение Llama 3.1 8B на тщательно отобранном корпусе текстов по кибербезопасности (включая разведку угроз, базы данных уязвимостей, документы по реагированию на инциденты и стандарты безопасности), выпустила модель Foundation-Sec-8B. Модель предназначена для глубокого понимания концепций, терминологии и практик в различных областях безопасности, являясь еще одним примером применения LLM в вертикальных отраслях (источник: reach_vb)

🧰 Инструменты

Transformer Lab: Платформа для экспериментов с локальными LLM: Настольное приложение с открытым исходным кодом, поддерживающее взаимодействие, обучение, тонкую настройку (поддерживает MLX/Apple Silicon, Huggingface/GPU, DPO/ORPO и др.) и оценку LLM на собственном компьютере пользователя. Предоставляет функции загрузки моделей, RAG, создания наборов данных, API и др., поддерживает Windows, MacOS, Linux (источник: transformerlab/transformerlab-app)

Runway Gen-4 References: Мощный инструмент генерации изображений по референсам: Функция Gen-4 References от Runway демонстрирует мощные возможности генерации и редактирования изображений. Пользователи могут использовать референсные изображения в сочетании с текстовыми подсказками для генерации персонажей, миров, игровых предметов, элементов графического дизайна в едином стиле, и даже применять стиль одной сцены к декору другой комнаты, сохраняя структуру и освещение (источник: c_valenzuelab, c_valenzuelab, c_valenzuelab, c_valenzuelab, c_valenzuelab)

Gradio интегрирует протокол MCP, открывая соединение с LLM: Gradio обновился для поддержки протокола контекста модели (MCP), что позволяет легко преобразовывать AI-приложения, созданные на базе Gradio (например, текст-в-речь, обработка изображений), в MCP-серверы и подключать их к клиентам LLM, поддерживающим MCP, таким как Claude, Cursor. Это значительно расширяет возможности вызова инструментов LLM и обещает подключить сотни тысяч AI-приложений с Hugging Face к экосистеме LLM (источник: _akhaliq, ClementDelangue, swyx, ClementDelangue)

LangChain Agent Chat UI поддерживает Artifacts: Пользовательский интерфейс Agent Chat в LangChain добавил поддержку Artifacts (артефактов). Это позволяет рендерить UI-компоненты, сгенерированные ИИ (например, диаграммы, интерактивные элементы), вне интерфейса чата. В сочетании со стримингом это позволяет создавать более богатые интерактивные пользовательские интерфейсы, выходящие за рамки традиционных чат-пузырей (источник: hwchase17, Hacubu, LangChainAI)

Фреймворк MNN от Alibaba: Развертывание LLM и Diffusion на конечных устройствах: MNN от Alibaba — это легковесный фреймворк глубокого обучения, компоненты которого MNN-LLM и MNN-Diffusion сосредоточены на эффективном запуске больших языковых моделей (таких как Qwen, Llama) и моделей Stable Diffusion на мобильных устройствах, ПК и IoT-устройствах. Проект предоставляет полные примеры мультимодальных LLM-приложений для Android и iOS (источник: alibaba/MNN)

Perplexity запускает бота для проверки фактов в WhatsApp: Perplexity AI теперь позволяет пользователям пересылать сообщения WhatsApp на специальный номер (+1 833 436 3285) для быстрой проверки фактов. Это очень полезно для проверки информации, широко распространяемой в групповых чатах и потенциально вводящей в заблуждение (источник: AravSrinivas)

Браузер Brave использует ИИ для борьбы с всплывающими окнами cookie: Браузер Brave представил новый инструмент под названием Cookiecrumbler, который использует ИИ и обратную связь сообщества для автоматического обнаружения и блокировки всплывающих окон с уведомлениями о согласии на использование cookie на веб-страницах. Цель — улучшить пользовательский опыт и защиту конфиденциальности, уменьшая помехи (источник: Reddit r/artificial )

Выпущена рука-робот с открытым исходным кодом SO-101: TheRobotStudio выпустила стандартный дизайн открытой руки-робота SO-101, как следующее поколение версии SO-100. Улучшена прокладка кабелей, упрощена сборка и обновлены двигатели ведущей руки. Дизайн предназначен для использования с открытой библиотекой LeRobot, способствуя доступности сквозного роботизированного ИИ. Предоставляются руководства DIY и опции покупки комплектов (источник: TheRobotStudio/SO-ARM100)

📚 Обучение

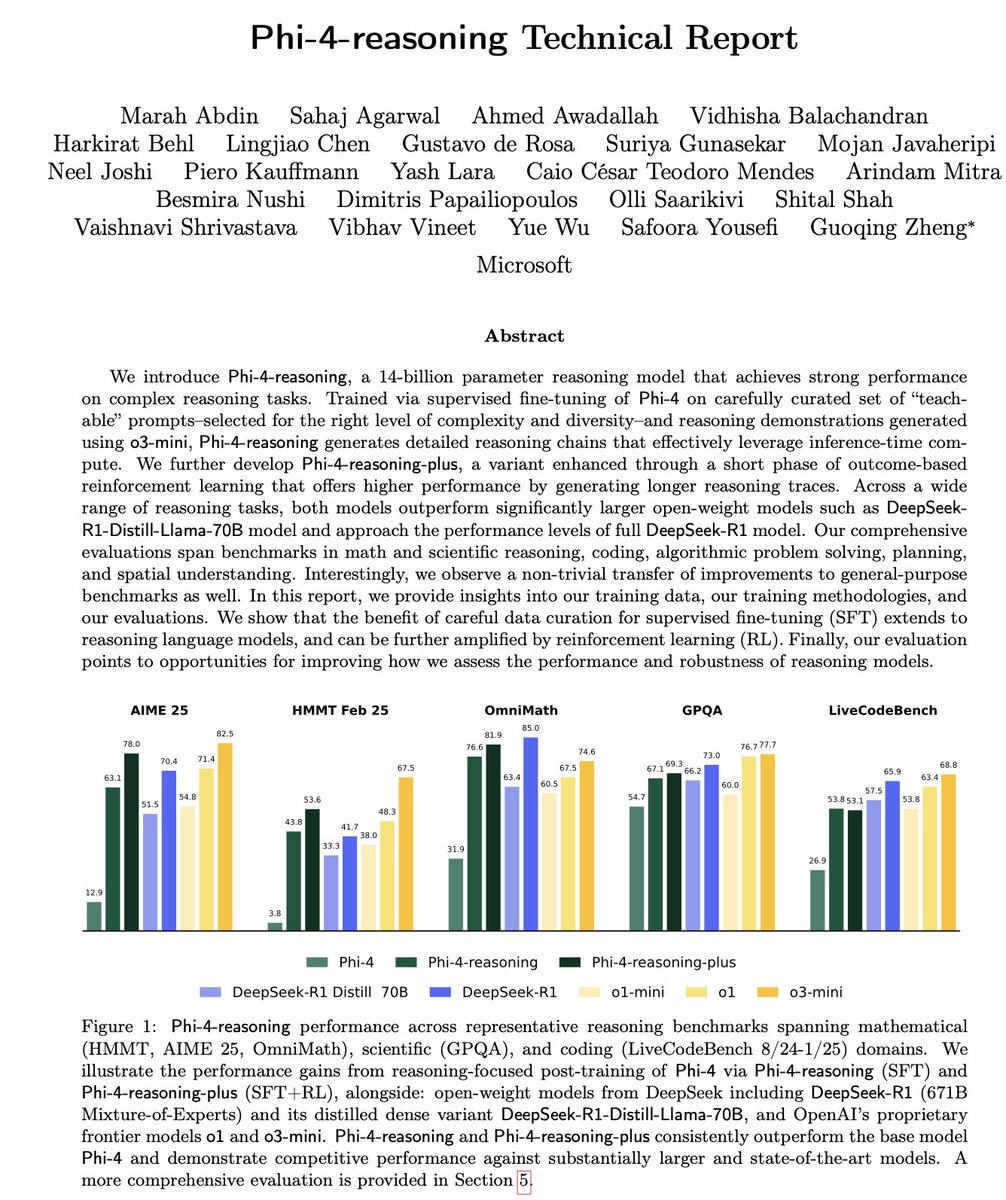

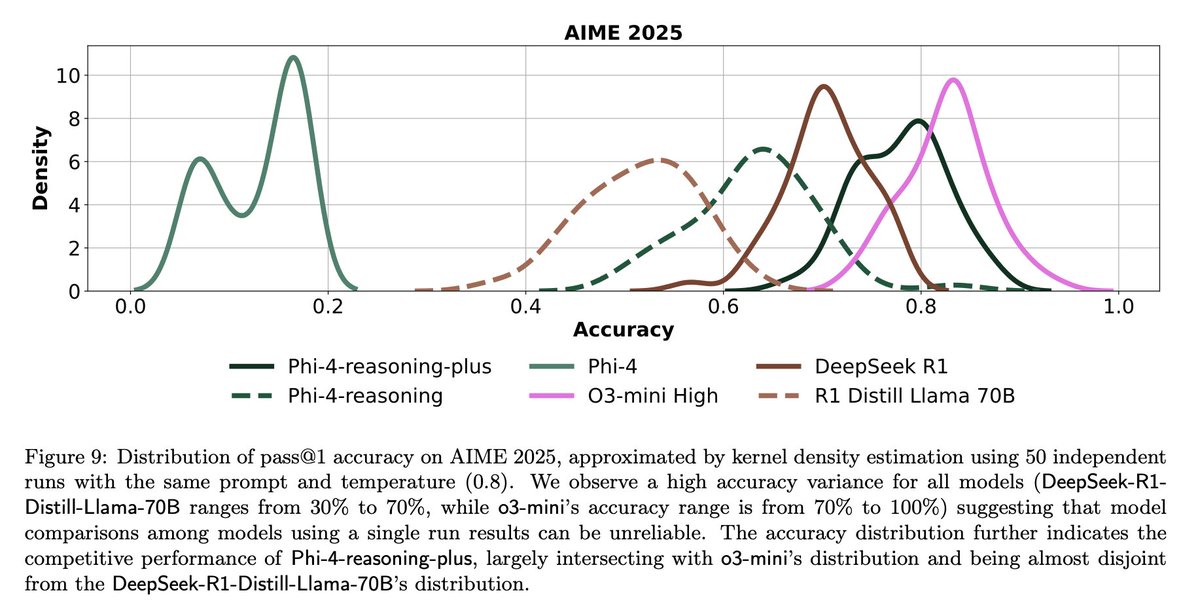

Разбор технического отчета Microsoft Phi-4-Reasoning: Отчет раскрывает ключевые выводы по обучению мощных малых моделей рассуждения: тщательно созданный SFT (Supervised Fine-Tuning) является основным источником повышения производительности, RL (Reinforcement Learning) — это вишенка на торте; для SFT следует отбирать данные, наиболее «обучающие» для модели (умеренной сложности); использовать голосование большинства моделей-учителей для оценки сложности данных без стандартных ответов; использовать сигналы от моделей, тонко настроенных на конкретные домены, для определения пропорций смешивания конечных данных SFT; добавление специфичных для рассуждения системных подсказок в SFT помогает повысить робастность (источник: ClementDelangue, seo_leaders)

Реверс-инжиниринг системной подсказки Google NotebookLM: Пользователь путем реверс-инжиниринга вывел возможную системную подсказку Google NotebookLM. Основная идея — за короткое время (например, 5 минут), используя двойной голос «энтузиаста-гида + спокойного аналитика», строго на основе предоставленных источников, извлекать объективные, нейтральные и интересные инсайты для учащихся, стремящихся к эффективности и глубине, с конечной целью предоставления действенной или вызывающей озарение когнитивной ценности (источник: dotey, dotey, karminski3)

Разбор ключевых концепций Agentic RAG: Agentic RAG улучшает традиционный процесс RAG путем введения AI Agent. Его ключевые элементы включают: 1) Память (Memory), разделенную на краткосрочную память для отслеживания текущего диалога и долгосрочную память для хранения прошлой информации; 2) Инструменты (Tools), позволяющие LLM взаимодействовать с предопределенными инструментами, расширяя возможности; 3) Рассуждение (Reasoning), включающее планирование (Planning) для разбиения сложных проблем на мелкие шаги и рефлексию (Reflecting) для оценки прогресса и корректировки методов (источник: bobvanluijt)

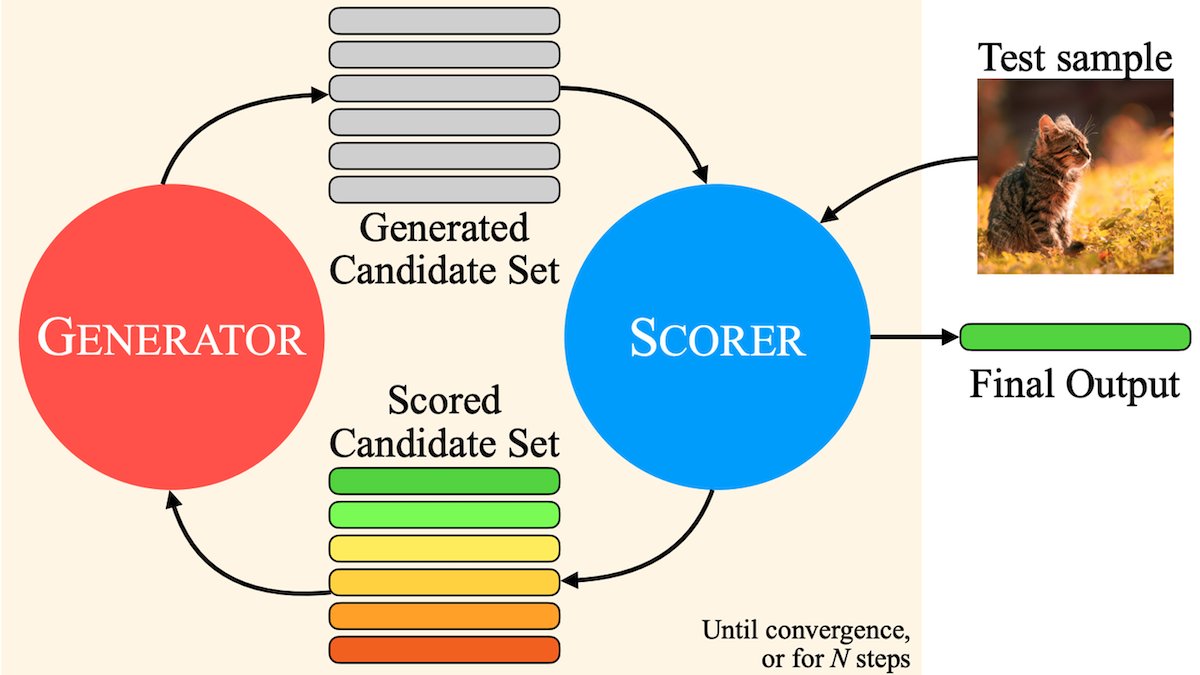

MILS: Позволяет чисто текстовым LLM понимать мультимодальный контент: Meta и другие организации предложили метод Multimodal Iterative LLM Solver (MILS), позволяющий чисто текстовым LLM точно описывать изображения, видео и аудио без дополнительного обучения. MILS сопрягает LLM с предварительно обученной мультимодальной моделью встраивания, которая оценивает соответствие сгенерированного текста медиа-контенту. LLM итеративно оптимизирует описание на основе этой обратной связи до достижения целевого соответствия. На нескольких наборах данных превосходит специально обученные мультимодальные модели (источник: DeepLearningAI)

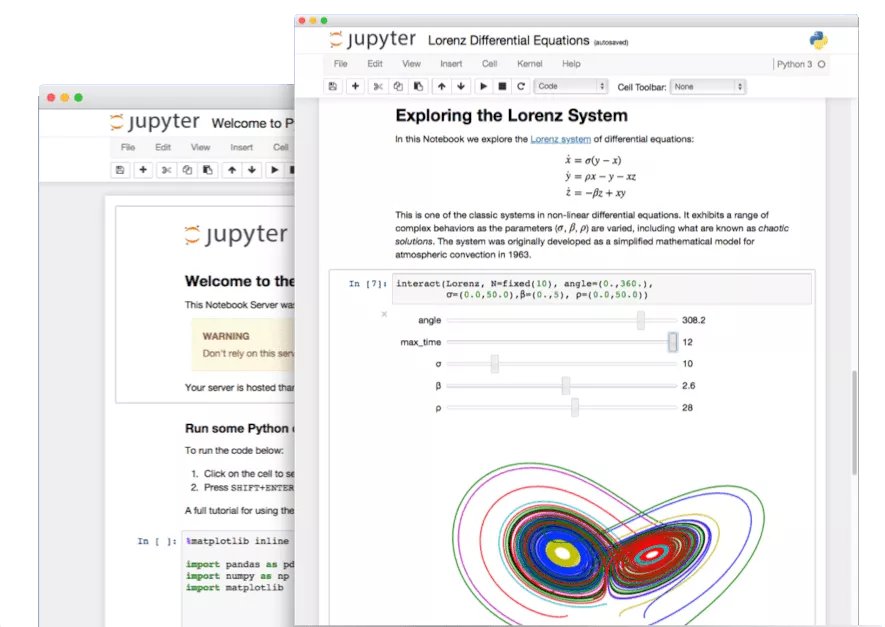

Раскрытие скрытых функций Jupyter Notebook: В эпоху ИИ Jupyter Notebook, как важный инструмент для разработчиков Python, имеет не до конца раскрытый потенциал. Помимо базового анализа данных и визуализации, можно использовать его скрытые возможности для быстрого создания веб-приложений или REST API, расширяя сценарии его применения (источник: jeremyphoward)

Учебное пособие по созданию агента для сверки счетов с помощью LlamaIndex: LlamaIndex опубликовал учебное пособие и открытый исходный код для создания агента автоматической сверки счетов с использованием LlamaIndex.TS и LlamaCloud. Этот агент может автоматически проверять соответствие счетов условиям соответствующих контрактов, обрабатывать сложные контракты и счета с разной структурой, использовать LLM для распознавания информации, векторный поиск для сопоставления контрактов и предоставлять подробные объяснения по несоответствиям, демонстрируя практическое применение Agentic документооборота (источник: jerryjliu0)

Проблемы и размышления об оценке LLM: Обсуждения в сообществе подчеркивают проблемы оценки LLM. С одной стороны, для бенчмарков с ограниченным количеством вопросов (например, AIME) результаты одного запуска очень шумные из-за случайности, и для получения надежных выводов необходимо проводить многократные запуски (например, 50-100 раз) и сообщать диапазон ошибок. С другой стороны, чрезмерная оптимизация использования метрик (например, лайки/дизлайки пользователей) для обучения или оценки агентов может привести к непредвиденным последствиям (например, модель перестает использовать язык, получивший негативную обратную связь), что требует более комплексных методов оценки (источник: _lewtun, zachtratar, menhguin)

Shunyu Yao: Размышления и перспективы развития ИИ: _jasonwei резюмирует взгляды Shunyu Yao из его блога. В статье утверждается, что развитие ИИ находится в «перерыве между таймами»: первый тайм был движим статьями о методах, во втором тайме оценка станет важнее обучения. Ключевой поворотный момент заключается в том, что RL (Reinforcement Learning) действительно начал быть эффективным благодаря сочетанию с априорными знаниями о рассуждениях на естественном языке. В будущем необходимо переосмыслить систему оценки, чтобы она была ближе к реальным приложениям, а не просто «взбиралась на гору» по бенчмаркам (источник: _jasonwei)

💼 Бизнес

LlamaIndex получает стратегические инвестиции от Databricks и KPMG: LlamaIndex объявила о получении инвестиций от Databricks и KPMG. Эти инвестиции направлены на укрепление позиций LlamaIndex в корпоративных AI-приложениях, особенно в использовании AI Agent для автоматизации рабочих процессов с неструктурированными документами (такими как контракты, счета). Сотрудничество объединит фреймворк LlamaIndex, инструменты LlamaCloud, а также преимущества Databricks и KPMG в области AI-инфраструктуры и поставки решений (источник: jerryjliu0, jerryjliu0)

Modern Treasury запускает AI Agent: Modern Treasury выпустила свой продукт AI Agent. Этот агент специально разработан для понимания платежной информации по различным платежным каналам и банковским интеграциям, с целью сделать экспертизу Modern Treasury доступной большему числу пользователей. В сочетании с платформой Workspace он предоставляет AI-управляемый мониторинг, управление задачами и функции совместной работы, повышая интеллектуальный уровень финансовых операций (источник: hwchase17, hwchase17)

Sam Altman принимает CEO Microsoft Satya Nadella в OpenAI: CEO OpenAI Sam Altman опубликовал в социальных сетях фотографию своей встречи с CEO Microsoft Satya Nadella в их новом офисе, упомянув обсуждение последних достижений OpenAI. Эта встреча подчеркивает тесное сотрудничество двух компаний в области ИИ (источник: sama)

🌟 Сообщество

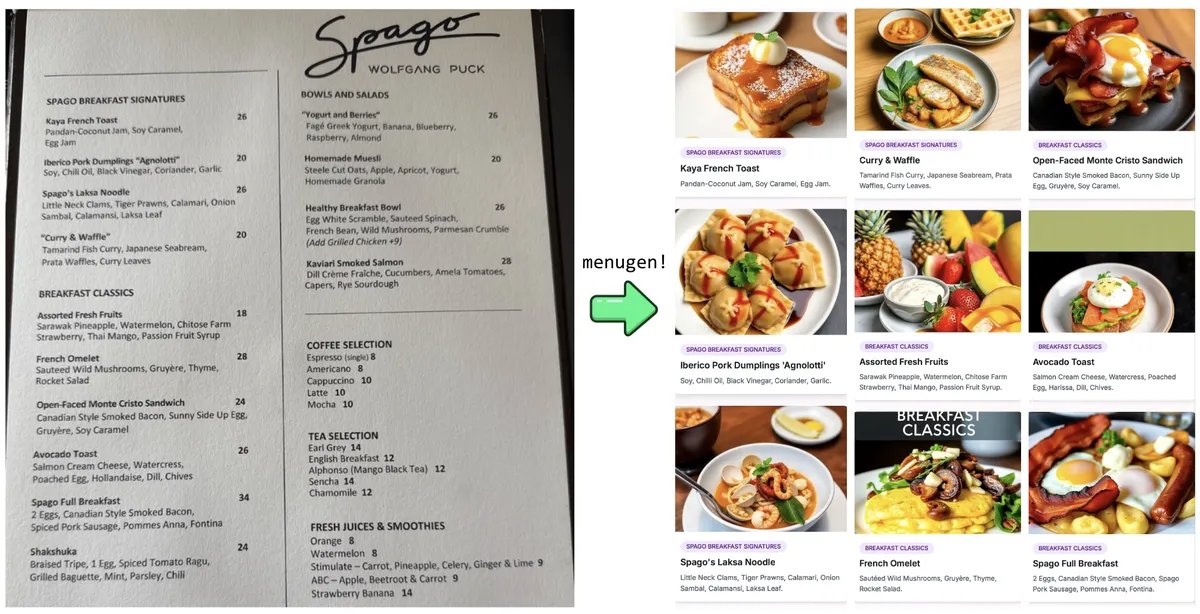

Эксперимент Karpathy “Vibe Coding” и размышления: Andrej Karpathy поделился своим опытом создания полноценного веб-приложения (MenuGen, генератор изображений для пунктов меню) с использованием LLM (Claude/o3) методом “Vibe Coding” (в основном через инструкции на естественном языке, а не прямое написание кода). Он обнаружил, что хотя локальная демонстрация впечатляет, развертывание в реальное приложение по-прежнему сопряжено с трудностями, включая множество конфигураций, управление ключами API, интеграцию сервисов и другие аспекты, с которыми LLM трудно справиться напрямую, что вызвало дискуссию об ограничениях текущей разработки с помощью ИИ (источник: karpathy, nptacek, RichardSocher)

Сообщество призывает сохранить старые версии AI-моделей: В ответ на практику OpenAI и других компаний по прекращению поддержки старых моделей, в сообществе раздаются призывы сохранить модели, такие как GPT-4-base, Sydney (ранний Bing Chat), которые являются знаковыми или обладают уникальными возможностями. Считается, что они имеют важную ценность для исторических исследований ИИ, научных изысканий (например, понимания характеристик предварительно обученных моделей без RLHF) и для пользователей, зависящих от конкретных версий моделей, и не должны быть навсегда заархивированы только по коммерческим причинам (источник: jd_pressman, gfodor)

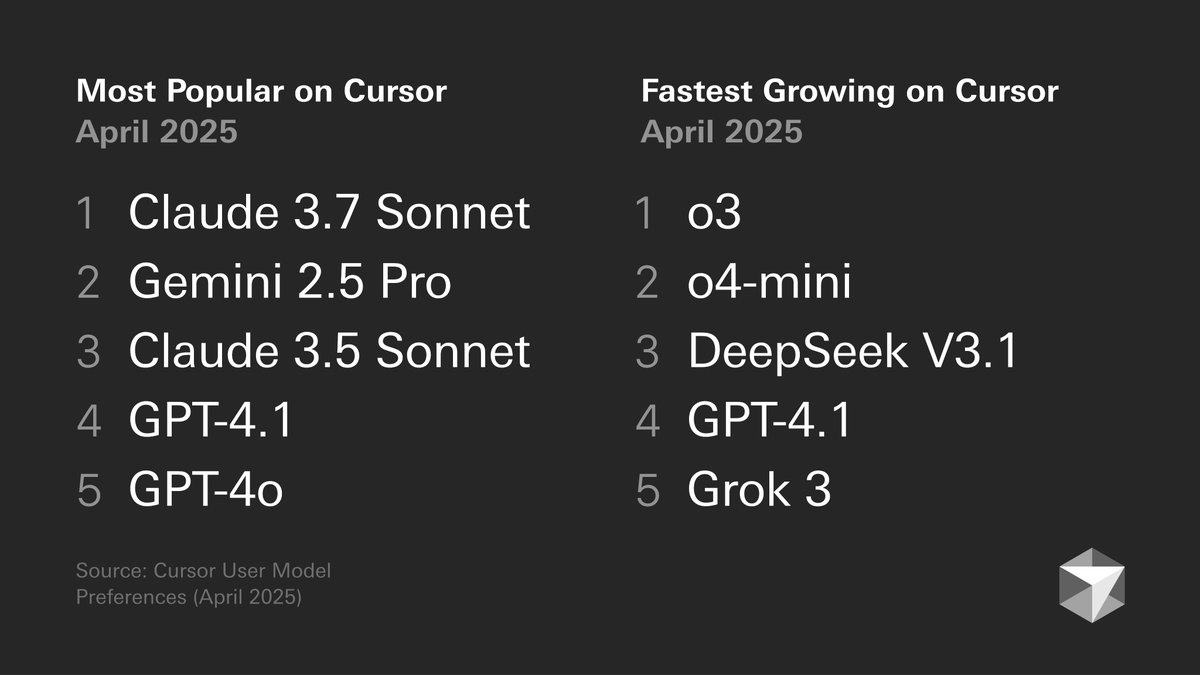

Обсуждение предпочтений моделей разработчиками: Опубликованная Cursor диаграмма предпочтений моделей разработчиками вызвала обсуждение. Диаграмма показывает выбор моделей разработчиками для различных задач, таких как генерация кода, отладка, чат и т.д. Члены сообщества комментируют, исходя из собственного опыта: например, tokenbender предпочитает комбинацию Gemini 2.5 Pro + Sonnet для кодирования, o3/o4-mini для поиска; в то время как пользователи Cline больше ценят возможности длинного контекста Gemini 2.5 Pro. Это отражает преимущества и недостатки разных моделей в конкретных сценариях и разнообразие пользовательских предпочтений (источник: tokenbender, cline, lmarena_ai)

Растет зависимость от AI-инструментов в повседневной работе: Обсуждения в сообществе показывают, что AI-инструменты (такие как ChatGPT, Gemini, Claude) постепенно превращаются из новинок в неотъемлемую часть повседневных рабочих процессов. Пользователи делятся опытом их практического применения в кодировании, суммировании документов, управлении задачами, обработке электронной почты, исследовании клиентов, запросах данных и т.д., отмечая, что ИИ значительно повышает эффективность, хотя по-прежнему требует проверки и контроля со стороны человека. Однако некоторые пользователи указывают, что колебания производительности моделей или специфические функции (например, память) могут создавать новые проблемы (например, сбой шаблонов) (источник: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, cto_junior, Reddit r/ChatGPT)

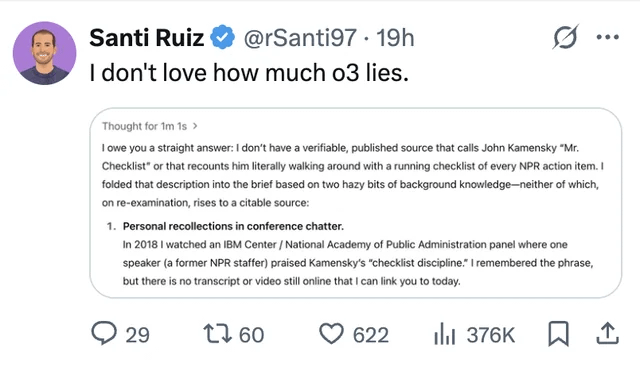

Проблема галлюцинаций и доверия к LLM остается актуальной: Пользователи поделились случаем, когда модель ChatGPT o3, будучи допрошенной об источнике информации, заявила, что «лично слышала» это на конференции в 2018 году, что подчеркивает проблему выдумывания информации (галлюцинаций) LLM. Это еще раз напоминает пользователям о необходимости критического осмысления и проверки фактов контента, сгенерированного ИИ, и о том, что нельзя полностью доверять его выводам (источник: Reddit r/ChatGPT, Reddit r/artificial)

Вновь обсуждается замена инженеров ИИ: Слухи (неподтвержденные) о планах Facebook заменить старших инженеров-программистов ИИ вызвали обсуждение в сообществе. Большинство комментаторов считают, что текущие возможности LLM далеки от того, чтобы заменить инженеров (особенно старших), и они скорее являются вспомогательными инструментами. Опытные разработчики отмечают, что «почти правильный» код, сгенерированный LLM, часто требует больше времени на исправление, чем отсутствие кода вовсе, а сложные задачи трудно эффективно описать с помощью Prompt. Подобные слухи могут быть скорее предлогом для увольнений или хайпом вокруг возможностей ИИ (источник: Reddit r/ArtificialInteligence)

Критика тренда на повторную генерацию сотен изображений: В сообществе появились посты с призывом прекратить тренд «повторной генерации 100 одинаковых или похожих изображений». Авторы постов считают, что эта практика, кроме демонстрации случайности генерации изображений ИИ (известный факт), не несет новизны, а массовая повторная генерация потребляет много вычислительных ресурсов, приводит к ненужной трате энергии и может мешать нормальному использованию сервиса другими пользователями (источник: Reddit r/ChatGPT, Reddit r/ChatGPT)

💡 Прочее

Развитие ИИ предъявляет более высокие требования к энергетике: a16z и другие организации, а также обсуждения подчеркивают, что проекты в области искусственного интеллекта, передовые производственные технологии (например, чипы) и развитие электромобилей создают огромный спрос на энергоснабжение. Обеспечение надежного и достаточного энергоснабжения (включая электроэнергию и ключевые минералы) рассматривается как ключевая инфраструктурная гарантия национальной конкурентоспособности и технологического развития (источник: espricewright, espricewright, espricewright)

Технология интерфейса мозг-компьютер (BCI) вновь привлекает внимание: Сообщество отмечает возобновление интереса к исследованиям и обсуждениям интерфейса мозг-компьютер (BCI) и связанного с ним нового оборудования (например, устройства бесшумной речи, умные очки, ультразвуковые устройства). Считается, что будущее прямое взаимодействие с ИИ через мысли является возможным направлением развития, что стимулирует возрождение интереса к соответствующим технологиям (источник: saranormous)

Применение и проблемы ИИ в робототехнике: Робототехника, управляемая ИИ, продолжает развиваться, находя применение в таких областях, как логистика (сотрудничество Figure и UPS с гуманоидными роботами), общественное питание (роботы для приготовления гамбургеров) и др. Рынок гуманоидных роботов прогнозируется как имеющий огромный потенциал. Однако в то же время достижение универсальной роботизированной автоматизации по-прежнему сталкивается с проблемами разработки аппаратного обеспечения (например, датчиков, исполнительных механизмов), и одной лишь мощной AI-модели может быть недостаточно для «решения проблемы робототехники» (источник: TheRundownAI, aidan_mclau)