Ключевые слова:Искусственный интеллект (ИИ), Meta, OpenAI, Anthropic, NVIDIA, Большая языковая модель (LLM), человекоподобный робот, персональный сверхинтеллект, режим обучения ChatGPT, автономная замена батареи Walker S2, Qwen3-30B-A3B-Thinking-2507, AlphaEarth Foundations

🔥 В центре внимания

Meta представила концепцию персонального суперинтеллекта : Марк Цукерберг поделился видением Meta будущего «персонального суперинтеллекта», подчеркнув, что он предоставит каждому человеку AI-помощников мирового класса, AI-создателей и инструменты для взаимодействия с AI в бизнесе. Эта концепция направлена на расширение возможностей всех пользователей с помощью AI и содействие развитию моделей с открытым исходным кодом. Однако этот шаг вызвал дискуссии в сообществе относительно определения «суперинтеллекта», ставя под сомнение, приведет ли он к непредсказуемому «моменту сингулярности» или же будет лишь расширением виртуального социального взаимодействия. (Источник: AIatMeta)

Объявлены лучшие статьи ACL 2025 : На конференции ACL (Annual Meeting of the Association for Computational Linguistics) 2025 года были объявлены победители в номинации «Лучшая статья», среди которых были отмечены работы «Native Sparse Attention» (сотрудничество Пекинского университета, DeepSeek и Вашингтонского университета) и «Language Models Resist Alignment: Evidence from Data Compression» (Пекинский университет). Примечательно, что более половины авторов статей — этнические китайцы. Кроме того, ACL также вручила награды Test-of-Time за 25 и 10 лет, отметив знаковые исследования, оказавшие глубокое влияние на такие области, как нейронный машинный перевод и семантическая разметка ролей. (Источник: karminski3)

Anthropic присоединяется к проекту по выравниванию AI Британского института безопасности AI : Anthropic объявила о присоединении к проекту по выравниванию AI Британского института безопасности AI и о выделении вычислительных ресурсов для продвижения ключевых исследований. Этот шаг направлен на обеспечение предсказуемости и соответствия человеческим ценностям AI-систем по мере роста их возможностей. Это сотрудничество демонстрирует важность, которую ведущие AI-компании придают безопасности AI и исследованиям в области выравнивания, чтобы справиться со сложными вызовами, которые могут возникнуть в будущем с AI-системами. (Источник: AnthropicAI)

🎯 Тенденции

OpenAI запускает режим обучения ChatGPT : OpenAI официально запустила «режим обучения» ChatGPT, призванный побуждать студентов к активному мышлению, а не к прямому получению ответов, посредством сократовских вопросов, пошаговых инструкций и персонализированной поддержки. Этот режим уже доступен всем пользователям ChatGPT, а в будущем будут добавлены функции визуализации, постановки целей и отслеживания прогресса. Этот шаг рассматривается как важный этап в выходе OpenAI на рынок образовательных технологий и вызвал широкие дискуссии о роли AI в образовании и потенциальном влиянии «оболочечных приложений». (Источник: 量子位, 36氪)

Гуманоидный робот Ubtech Walker S2 реализовал автономную замену батареи : Китайская компания Ubtech Robotics представила своего полноразмерного промышленного гуманоидного робота Walker S2, продемонстрировав первую в мире систему автономной замены батареи. Walker S2 может плавно заменить батарею за 3 минуты, обеспечивая бесперебойную работу 24/7 и значительно повышая эффективность операций в промышленных условиях. Робот оснащен двухконтурной системой AI, чистым RGB-бинокулярным зрением и 52 степенями свободы, предназначен для выполнения высокоинтенсивных задач, таких как производство автомобилей, и вызвал дискуссии о замене роботами человеческого труда и будущих моделях работы. (Источник: 量子位, Ronald_vanLoon)

Модели серии Qwen продолжают обновляться и улучшать производительность : Команда Qwen недавно выпустила среднюю модель Qwen3-30B-A3B-Thinking-2507, которая обладает способностью «мыслить», отлично справляется с задачами по рассуждению, коду и математике, а также поддерживает длинный контекст 256K. В то же время, скоро будет выпущена Qwen3 Coder 30B-A3B, что еще больше улучшит возможности генерации кода. Эти обновления укрепляют конкурентоспособность серии Qwen в области LLM и уже интегрированы в такие инструменты, как Anycoder. (Источник: Alibaba_Qwen, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

Прогресс AI-моделей Google DeepMind для Земли и истории : Google DeepMind представила AlphaEarth Foundations, призванную с поразительной детализацией картографировать Землю и унифицировать огромные объемы географических данных. В то же время, ее модель Aeneas анализирует древние латинские тексты с помощью AI, помогая историкам количественно моделировать историю. Эти модели демонстрируют мощный потенциал применения AI в области мониторинга окружающей среды и изучения гуманитарной истории. (Источник: GoogleDeepMind, GoogleDeepMind)

Arcee выпустила модель с открытым весом AFM-4.5B : Arcee официально выпустила AFM-4.5B и ее базовую версию, языковую модель с открытым весом, разработанную для корпоративных приложений. AFM-4.5B призвана предоставить гибкое и высокопроизводительное решение для различных сред развертывания, а ее обучающие данные тщательно отбираются для обеспечения высококачественного вывода. Выпуск этой модели предоставляет предприятиям больше передовых опций AI с открытым исходным кодом для удовлетворения их потребностей в создании и развертывании AI-приложений. (Источник: code_star, stablequan)

Модель GLM-4.5 демонстрирует сильные результаты в EQ-Bench и написании длинных текстов : Модель GLM-4.5 от Z.ai показала выдающиеся результаты в бенчмарках EQ-Bench и написании длинных текстов, продемонстрировав свои объединенные преимущества в рассуждении, кодировании и агентских возможностях. Модель доступна в двух версиях: GLM-4.5 и GLM-4.5-Air, и открыта на HuggingFace, причем некоторые версии даже предлагают бесплатную пробную версию. Ее мощная производительность и способность быстро обрабатывать сложные запросы предвещают ее потенциал в сложных сценариях применения. (Источник: Zai_org, jon_durbin)

Mistral AI выпустила Codestral 25.08 : Mistral AI выпустила новейшую модель Codestral 25.08 и представила полный стек кодирования Mistral для предприятий. Этот шаг направлен на предоставление предприятиям более мощных возможностей генерации кода и более совершенных инструментов разработки, что еще больше укрепляет рыночные позиции Mistral AI в области AI-программирования. (Источник: MistralAI)

Значительный рост моделей/наборов данных/приложений NVIDIA на Hugging Face : Данные AI World показывают, что NVIDIA добавила 365 общедоступных моделей, наборов данных и приложений на Hugging Face за последние 12 месяцев, в среднем по одному в день. Такой поразительный темп роста демонстрирует, что NVIDIA не только доминирует в области аппаратного обеспечения, но и оказывает сильное влияние в экосистеме AI с открытым исходным кодом, активно способствуя популяризации и применению AI-технологий. (Источник: ClementDelangue)

Скорость инференса Llama увеличилась на 5% : Новый алгоритм Fast Attention увеличил скорость функции SoftMax примерно на 30%, что сократило время инференса Meta LLM на A100 GPU на 5%. Эта оптимизация, как ожидается, повысит эффективность работы LLM и снизит затраты на инференс, что имеет большое значение для крупномасштабного развертывания и приложений реального времени. (Источник: Reddit r/LocalLLaMA)

Выпущена унифицированная авторегрессионная мультимодальная модель Skywork-UniPic-1.5B : Skywork выпустила Skywork-UniPic-1.5B, унифицированную авторегрессионную мультимодальную модель. Эта модель способна обрабатывать данные различных модальностей, предоставляя новую основу для мультимодальных AI-исследований и приложений. (Источник: Reddit r/LocalLLaMA)

Google запускает AI-функцию виртуальной примерки : Google представила новую AI-функцию, позволяющую пользователям виртуально примерять одежду онлайн. Эта технология использует генеративные возможности AI, чтобы предоставить потребителям более интуитивный и персонализированный опыт покупок, что, как ожидается, снизит процент возвратов и повысит конверсию в электронной коммерции. (Источник: Ronald_vanLoon)

LimX Dynamics представила гуманоидного робота Oli : LimX Dynamics официально представила нового гуманоидного робота Oli по цене около 22 000 долларов США. Oli имеет рост 5 футов 5 дюймов, вес 55 кг, 31 степень свободы и оснащен собственной разработанной 6-осевой IMU. Он поддерживает модульный SDK и полностью открытый интерфейс разработки на Python, предоставляя гибкую платформу для исследований и разработок, что, как ожидается, будет способствовать применению гуманоидных роботов в большем количестве сценариев. (Источник: teortaxesTex)

🧰 Инструменты

LangSmith запускает функцию Align Evals : LangSmith представила новую функцию Align Evals, призванную упростить процесс создания оценщиков LLM-as-a-Judge. Эта функция помогает пользователям сопоставлять оценки LLM с человеческими предпочтениями, тем самым создавая более точные и надежные оценщики и снижая неопределенность в работе по оценке. (Источник: hwchase17)

NotebookLM добавил функцию видеообзора : NotebookLM от Google представил функцию видеообзора, позволяющую пользователям создавать визуально привлекательные слайд-резюме для содержимого своих заметок. Эта функция использует модель Gemini для генерации текстовых презентаций, а также внутренние инструменты для создания статических изображений и отдельного аудио, после чего синтезирует видео, предоставляя пользователям более богатые способы обучения и демонстрации контента. (Источник: JeffDean, cto_junior)

Qdrant Cloud Inference и обработка данных LLM : Qdrant Cloud Inference позволяет пользователям нативно встраивать текст, изображения и разреженные векторы, не покидая векторной базы данных, поддерживая такие модели, как BGE, MiniLM, CLIP и SPLADE. Кроме того, сообщество обсудило функцию прямого цитирования URL-адресов LLM в качестве источников информации, а также возможность того, что LLM будет регулярно проверять, кэшировать и обновлять содержимое URL-адресов, чтобы повысить достоверность и практичность AI. (Источник: qdrant_engine, Reddit r/OpenWebUI)

Replit Agent помогает создавать интерактивные дашборды в реальном времени : Replit Agent был использован для быстрого создания доступных интерактивных дашбордов в реальном времени, чтобы решить проблему запутанной информации на традиционных сайтах предупреждения о цунами. Этот кейс демонстрирует потенциал AI-агентов в визуализации данных и дизайне пользовательских интерфейсов, способных преобразовывать сложные данные в легко понятные интерактивные интерфейсы. (Источник: amasad)

Инструменты инфраструктуры ML от Hugging Face : Hugging Face и Gradio совместно запустили trackio, локальное решение для отслеживания экспериментов машинного обучения, которое позволяет пользователям сохранять ключевые метрики в Hugging Face Datasets. В то же время, Hugging Face также запустила «Hugging Face Jobs», полностью управляемый сервис для запуска задач на CPU и GPU, который упрощает выполнение ML-задач, позволяя пользователям больше сосредоточиться на разработке моделей. (Источник: algo_diver, reach_vb)

AI-агенты для вертикальных ниш и автоматизации рабочих процессов : SciSpace Agent, специализированный AI-помощник для ученых, объединяет функции цитирования, поиска литературы, чтения PDF и AI-письма, призванный значительно повысить эффективность научных исследований. LlamaCloud Nodes также интегрировали рабочие процессы n8n, упрощая автоматизацию обработки документов, используя агенты Llama Extract для извлечения ключевых данных, что позволяет автоматизировать извлечение структурированных данных из финансовых документов, клиентских коммуникаций и т.д. (Источник: TheTuringPost, jerryjliu0)

AutoRL: Обучение LLM для конкретных задач с помощью RL : Мэтт Шумер представил AutoRL, простой метод обучения LLM для конкретных задач с помощью обучения с подкреплением. Пользователям достаточно описать желаемую модель одним предложением, и AI-система сгенерирует данные и критерии оценки, а затем обучит модель. Этот инструмент с открытым исходным кодом, основанный на ART, призван снизить порог разработки кастомизированных LLM. (Источник: corbtt)

ccflare: Инструменты для продвинутых пользователей Claude Code : ccflare — это мощный набор инструментов, разработанный для продвинутых пользователей Claude Code, предлагающий такие функции, как отслеживание аналитики, балансировка нагрузки и переключение между несколькими подписными аккаунтами Claude, глубокий анализ запросов, а также настройка моделей для субагентов. Этот инструмент призван повысить эффективность и управляемость использования Claude Code, помогая разработчикам лучше управлять и оптимизировать свои рабочие процессы AI-программирования. (Источник: Reddit r/ClaudeAI)

📚 Обучение

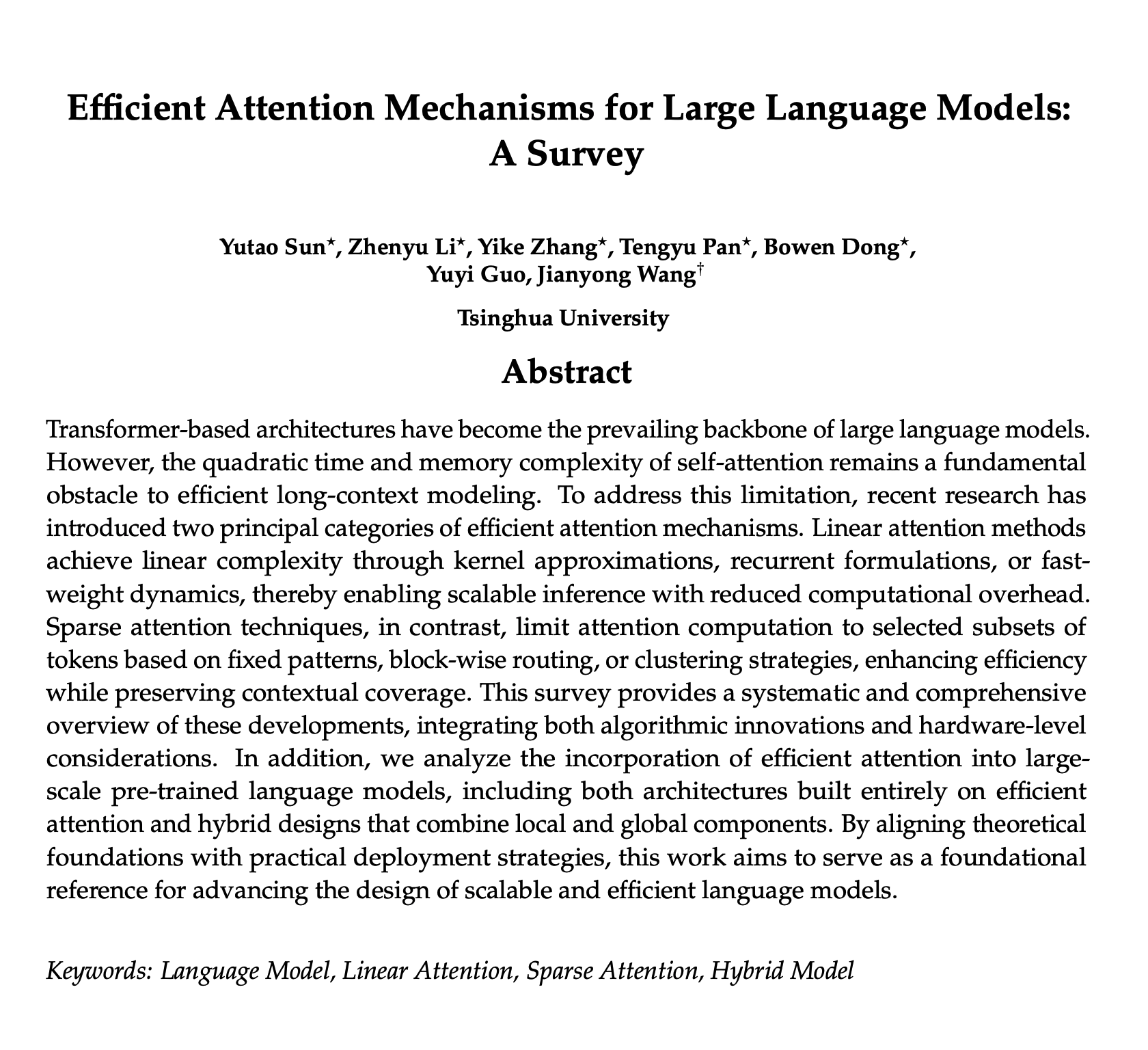

Обзор эффективных механизмов внимания в LLM : Был опубликован новый обзор эффективных механизмов внимания в LLM, который считается отличным ресурсом для понимания новых идей и будущих тенденций. Обзор охватывает различные методы оптимизации вычислений внимания и представляет собой важный справочный материал для исследователей и разработчиков, стремящихся повысить эффективность и производительность LLM. (Источник: omarsar0)

GEPA: Эволюция рефлексивных подсказок превосходит обучение с подкреплением : В исследовательской работе представлена GEPA (Reflective Prompt Evolution), метод оптимизации рефлексивных подсказок, который превосходит традиционные алгоритмы обучения с подкреплением по производительности при низком бюджете развертывания за счет эволюции подсказок на основе рефлексии. Это исследование предлагает новые идеи для достижения AI-моделями производительности, аналогичной RL, в конкретных задачах, особенно в области генерации синтетических данных. (Источник: teortaxesTex, stanfordnlp)

Понимание метрики объяснимости LLM XPLAIN : Предложена новая метрика под названием «XPLAIN» для количественной оценки объяснимости «черных ящиков» LLM. Метод использует косинусное сходство для расчета оценок важности на уровне слов, раскрывая, как LLM интерпретирует входные предложения и какие слова оказывают наибольшее влияние на вывод. Это исследование направлено на углубление понимания внутренних механизмов LLM, и код с статьей уже доступны для сообщества. (Источник: Reddit r/MachineLearning)

MoHoBench: Оценка честности мультимодальных больших моделей : MoHoBench — это первый бенчмарк для систематической оценки честного поведения мультимодальных больших языковых моделей (MLLM), который измеряет их честность путем анализа реакции моделей на визуально неразрешимые вопросы. Этот бенчмарк содержит более 12 000 образцов визуальных вопросов и ответов, выявляя, что большинство MLLM не отказываются отвечать, когда это необходимо, и что их честность глубоко зависит от визуальной информации, что призывает к разработке специализированных методов мультимодального выравнивания честности. (Источник: HuggingFace Daily Papers)

Hierarchical Reasoning Model (HRM) достигла прорыва в ARC-AGI : Hierarchical Reasoning Model (HRM) достигла значительного прогресса в задачах ARC-AGI, достигнув 25% точности всего с 1 тыс. примеров и небольшим количеством вычислительных ресурсов, демонстрируя свой мощный потенциал в сложных задачах рассуждения. Эта модель, вдохновленная иерархическими механизмами обработки информации в мозге, обещает прорыв в возможностях рассуждения универсальных AI-систем. (Источник: VictorTaelin)

Статья ACL 2025 об оценке LLM : В статье, представленной на ACL 2025, показано, как определить, превосходит ли одна языковая модель другую, подчеркивая важность оценки в разработке LLM-приложений. Это исследование направлено на предоставление более эффективных методов сравнения и выбора LLM, помогая разработчикам избежать слепых попыток без реального прогресса. (Источник: gneubig, charles_irl)

Понимание возникновения «мягких предпочтений» в LLM : Новая статья исследует, как надежные и универсальные «мягкие предпочтения» в производстве человеческого языка возникают из стратегий минимизации функции стоимости авторегрессионной памяти. Это исследование углубляет понимание тонких человеческих характеристик в текстах, генерируемых LLM, и предлагает новый взгляд на механизмы поведения LLM. (Источник: stanfordnlp)

Определение LLM Agent : Основатель LangChain Харрисон Чейз поделился своим определением AI Agent, подчеркнув, что степень «агентности» AI Agent зависит от того, насколько LLM автономно принимает решения о следующих действиях. Эта точка зрения помогает прояснить концепцию AI Agent и направляет разработчиков в измерении их автономности при создании систем Agent. (Источник: hwchase17)

💼 Бизнес

Оценка Anthropic взлетела до 170 миллиардов долларов США : Anthropic, компания, стоящая за Claude, ведет переговоры о новом раунде финансирования в размере до 5 миллиардов долларов США, при этом ее оценка, как ожидается, достигнет 170 миллиардов долларов США, что сделает ее вторым AI-единорогом с оценкой в сотни миллиардов после OpenAI. Этот раунд финансирования возглавляет Iconiq Capital, и он может привлечь к участию Катарский инвестиционный фонд, суверенный фонд Сингапура GIC и Amazon. Доход Anthropic в основном поступает от вызовов API, особенно сильные показатели наблюдаются в области AI-программирования, где годовой доход достиг 4 миллиардов долларов США. (Источник: 36氪, 36氪)

Surge AI достигла выручки в 1 миллиард долларов США благодаря высококачественным данным : Surge AI, основанная китайцем Эдвином Ченом, достигла годового дохода более 1 миллиарда долларов США с командой из 120 человек, без внешнего финансирования и отдела продаж, что значительно превосходит эффективность конкурентов. Компания специализируется на предоставлении высококачественных данных обратной связи от человека (RLHF); ее элитная сеть аннотаторов «Surge Force» обеспечивает точность данных благодаря строгим стандартам и профессиональному опыту (например, доктора математики из MIT), став предпочтительным поставщиком для ведущих AI-лабораторий, таких как OpenAI и Anthropic, и планирует начать первый раунд финансирования в размере 1 миллиарда долларов США, при этом оценка может достичь 15 миллиардов долларов США. (Источник: 36氪)

Доход Nvidia от центров обработки данных вырос в 10 раз за два года : Доход Nvidia от центров обработки данных вырос в 10 раз за последние два года, и после снятия ограничений с чипов H20 ожидается, что он продолжит демонстрировать сильный рост. Этот рост в основном обусловлен огромным спросом на вычислительную мощность GPU со стороны больших AI-моделей, что укрепило лидирующие позиции Nvidia на рынке AI-оборудования. (Источник: Reddit r/artificial)

🌟 Сообщество

Обсуждение эффективности ролевых игр в AI-подсказках : Сообщество активно обсуждает практическую пользу ролевых игр в подсказках для больших моделей, общепризнанно, что они могут эффективно направлять AI на конкретные задачи и улучшать качество вывода, перенаправляя распределение вероятностей к высококачественным данным. Однако есть и мнения, что как чрезмерная зависимость, так и полное отрицание ролевых игр являются формализмом; ключ в понимании требований к AI-задаче. (Источник: dotey)

Споры о количестве и качестве кода, генерируемого AI-кодированием : В социальных сетях активно обсуждаются вопросы эффективности AI-инструментов для кодирования и качества генерируемого ими кода. Некоторые пользователи сообщают, что AI может быстро генерировать десятки тысяч строк кода, но при этом выражают обеспокоенность по поводу его поддерживаемости и выбора архитектуры. В ходе обсуждений отмечается, что AI-генерируемый код может требовать значительного ручного просмотра и модификации, а не является «бездумной генерацией», что подчеркивает вызовы, связанные с изменением роли AI в разработке программного обеспечения. (Источник: vikhyatk, dotey, Reddit r/ClaudeAI)

Стратегия Meta AI и борьба за таланты вызвали активные дискуссии в сообществе : Недавние активные действия Meta в области AI, включая видение «персонального суперинтеллекта», предложенное генеральным директором Цукербергом, предложения о переманивании ведущих AI-специалистов (включая сотрудников стартапа Миры Мурати) на сумму до 1 миллиарда долларов США, а также «осторожные» заявления о будущей стратегии открытого исходного кода для топовых моделей, вызвали широкие дискуссии в сообществе. Эти шаги интерпретируются как проявление амбиций Meta в области AI, но также сопровождаются опасениями относительно рынка AI-талантов, технической этики и духа открытого исходного кода. (Источник: dotey, teortaxesTex, joannejang, tokenbender, amasad)

Применение AI в образовании и этические вызовы : Несмотря на то, что OpenAI запустила режим обучения ChatGPT для стимулирования мышления студентов, сообщество в целом выражает обеспокоенность по поводу этических проблем его применения в образовании, таких как риск списывания и снижение способности к критическому мышлению. В ходе обсуждений отмечается, что применение AI в образовании требует баланса между инновациями и академической честностью, а также исследуются способы решения этих проблем через более глубокое персонализированное обучение и разработку образовательных программ. (Источник: 36氪, Reddit r/artificial, Reddit r/ArtificialInteligence)

Галлюцинации AI-моделей и вызовы достоверности контента : В социальных сетях широко обсуждаются феномен «галлюцинаций» AI-моделей при генерации контента и их влияние на достоверность информации. Пользователи обнаруживают, что AI может генерировать информацию, которая выглядит профессионально, но логически непоследовательна или ложна, особенно в области генерации изображений и видео, где трудно отличить правду от вымысла. Это приводит к кризису доверия к AI-инструментам и побуждает людей задуматься о том, как сохранить человеческую способность к различению и критическому мышлению, избегая чрезмерной зависимости от алгоритмов. (Источник: 36氪, teortaxesTex, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/artificial)

Двойное влияние AI на социально-экономическую сферу и личное творчество : В сообществе существуют полярные дискуссии о социально-экономическом влиянии AI. С одной стороны, некоторые CEO открыто заявляют, что AI «положит конец работе, какой мы ее знаем», вызывая опасения по поводу потери рабочих мест; с другой стороны, пользователи делятся тем, как AI расширяет возможности людей, позволяя им реализовать свои предпринимательские идеи даже при отсутствии бюджета и технических навыков, считая AI «великим уравнителем», который освобождает личное творчество. (Источник: Reddit r/artificial, Reddit r/ArtificialInteligence)

Дебаты о безопасности AI с открытым и закрытым исходным кодом : В сообществе развернулись жаркие дебаты о безопасности AI-моделей с открытым и закрытым исходным кодом. Некоторые мнения утверждают, что развертывание моделей за API или чат-ботами может быть более рискованным, чем выпуск моделей с открытым весом, поскольку это снижает порог для злонамеренного использования. Дебаты призывают пересмотреть тезис о «небезопасности открытого веса» и подчеркивают, что безопасность AI должна выходить за рамки простой технической открытости. (Источник: bookwormengr)

Исследование эмоциональной связи между AI и человеком : В социальных сетях мнения о создании эмоциональной связи с AI расходятся. Некоторые пользователи считают, что создание отношений с AI — это личный выбор, если это не влияет на обычную жизнь; другие же опасаются, что чрезмерная зависимость от AI-компаньонства может привести к снижению терпения в реальных межличностных отношениях и вызвать глубокие размышления об этике и психологическом влиянии AI-партнеров. (Источник: Reddit r/ChatGPT, ClementDelangue)

💡 Другое

Неравномерное глобальное развитие AI и геополитическое влияние : Заместитель Генерального секретаря ООН призвал преодолеть «разрыв в области искусственного интеллекта», отметив, что возможности разработки AI сосредоточены в нескольких странах и компаниях, что приводит к неравенству в технологиях и управлении. Эксперты подчеркивают, что AI должен расширять возможности человека, а не заменять его, и необходимо создать гибкие механизмы управления, чтобы избежать категориальных различий между технологами и нетехнологами. Кроме того, геополитическая конкуренция в области AI, такая как гонка США и Китая за AGI, также стала центром международного внимания. (Источник: 36氪, teortaxesTex)

AI-война за авторские права: конфликт воображения и машин : Великобритания переживает дебаты по поводу авторских прав на AI, ключевой вопрос заключается в том, могут ли AI-технологические компании без разрешения и оплаты использовать человеческий контент для обучения и генерации «улучшенного» контента. Эти дебаты сосредоточены на вопросах принадлежности авторских прав на творческие произведения в эпоху AI и защиты прав создателей, отражая конфликт между развитием технологий и существующими правовыми рамками. (Источник: Reddit r/artificial)

Этические опасения, вызванные применением AI в FDA : Появились сообщения о том, что AI Управления по санитарному надзору за качеством пищевых продуктов и медикаментов США (FDA) может «фабриковать исследования» в процессе одобрения лекарств, что вызвало опасения по поводу этики и точности применения AI в сфере здравоохранения. Это подчеркивает проблемы достоверности данных и прозрачности в AI-системах поддержки принятия решений, особенно в высокорисковых областях, а также вопрос о том, как обеспечить соответствие решений AI этическим и регуляторным стандартам. (Источник: Ronald_vanLoon)