Palavras-chave:AGI, Sora2, RAG, Gemini 3.0, Modelo de IA de grande escala, Tecnologia de geração de vídeo por IA, Brinquedos de IA, Agente inteligente, Evolução da geração aumentada por recuperação, Modelo multimodal de IA, Plataforma de descoberta de medicamentos por IA, Tecnologia de colaboração computação-energia

🎯 Tendências

Andrej Karpathy: A AGI é uma curva longa, não um crescimento explosivo : Andrej Karpathy, ex-pesquisador principal da OpenAI, aponta que a atual narrativa de um “ano explosivo” para a IA é excessivamente eufórica, e que a realização da AGI exigirá décadas de evolução gradual. Ele enfatiza que os verdadeiros Agents inteligentes devem possuir persistência, memória e continuidade, em vez dos atuais “fantasmas” de chatbots. O futuro desenvolvimento da IA deve mudar de “alimentar dados” para “ensinar objetivos”, treinando a IA através de tarefas e ciclos de feedback para que se torne um “parceiro” com identidade, papel e responsabilidade na sociedade, em vez de uma mera ferramenta. (Fonte: 36氪)

Sora2 lançado: Geração de vídeo por IA entra em fase de “super aceleração” : A OpenAI lançou o Sora2 e seu aplicativo social Sora App, com downloads superando o ChatGPT, marcando a entrada do campo de vídeo por IA em um período de “super aceleração”. O Sora2 alcança avanços em simulação física, fusão multimodal e compreensão da “linguagem cinematográfica”, sendo capaz de gerar automaticamente vídeos com múltiplas transições de câmera e enredo coerente, reduzindo drasticamente a barreira de criação. Fabricantes nacionais como Baidu e Google também estão rapidamente iterando seus produtos, mas os direitos autorais e os modelos de monetização continuam sendo desafios reais para a indústria. (Fonte: 36氪)

Evolução do paradigma RAG: O debate de “vida ou morte” sob Agents e janelas de contexto longo : Com a ascensão das janelas de contexto longo dos LLMs e das capacidades dos Agents, o futuro do RAG (Retrieval Augmented Generation) gerou um debate acalorado. A LlamaIndex acredita que o RAG está evoluindo para “recuperação de Agent”, alcançando consultas de base de conhecimento mais inteligentes através de uma arquitetura de Agent hierárquica; Hamel Husain enfatiza a importância do RAG como uma disciplina de engenharia rigorosa; enquanto Nicolas Bustamante declara que o “RAG ingénuo está morto”, e que a combinação de Agents com contexto longo pode realizar navegação lógica diretamente, rebaixando o RAG a um componente da caixa de ferramentas do Agent. (Fonte: 36氪)

Modelo Gemini 3.0 do Google supostamente lançado no LMArena, exibindo novas capacidades multimodais : Modelos codinome do Google Gemini 3.0 (lithiumflow e orionmist) foram supostamente expostos na arena LMArena. Testes reais mostram que eles podem identificar a hora com precisão em tarefas de “leitura de relógio”, a capacidade de geração de imagens SVG melhorou significativamente e, pela primeira vez, demonstram uma boa capacidade de composição musical, podendo imitar estilos musicais e manter o ritmo. Esses avanços preveem avanços significativos do Gemini 3.0 na compreensão e geração multimodal, gerando expectativas na indústria para o próximo lançamento de modelo do Google. (Fonte: 36氪)

Brinquedos de IA: Da “IA + Brinquedo” à fusão profunda “IA x Brinquedo” : O mercado de brinquedos de IA está passando por uma transformação de uma simples sobreposição de funções para uma fusão profunda, com o tamanho do mercado global estimado em centenas de bilhões até 2030. A nova geração de brinquedos de IA, através de tecnologias multimodais como reconhecimento de voz, reconhecimento facial e análise de emoções, realiza a percepção ativa de cenários, compreensão de emoções e oferece companhia e educação personalizadas. O modelo industrial também está mudando de “venda de hardware” para “serviços + entrega contínua de conteúdo”, atendendo às crescentes necessidades de companhia emocional e assistência à vida de crianças, jovens e idosos, tornando-se um importante veículo para os humanos aprenderem a coexistir com a IA. (Fonte: 36氪)

Marca de tecnologia de luxo BUTTONS lança robô de áudio e vídeo com Agent HALI : A BUTTONS lançou o SOLEMATE, um super robô de áudio e vídeo com Agent inteligente, equipado com o Agent de IA geral HALI da Terminus Group. O HALI possui capacidades de cognição espacial e interação física, compreendendo o ambiente através de um modelo de memória semântica tridimensional e podendo oferecer serviços proativamente com base na localização e intenção do usuário. Este robô utiliza computação colaborativa em larga escala de um centro de computação inteligente para otimizar a orquestração de recursos, equipamentos e comportamentos, marcando um avanço da IA em direção a Agents de IA geral incorporados, capazes de romper as barreiras do mundo digital e “perceber-raciocinar-agir” em ambientes físicos. (Fonte: 36氪)

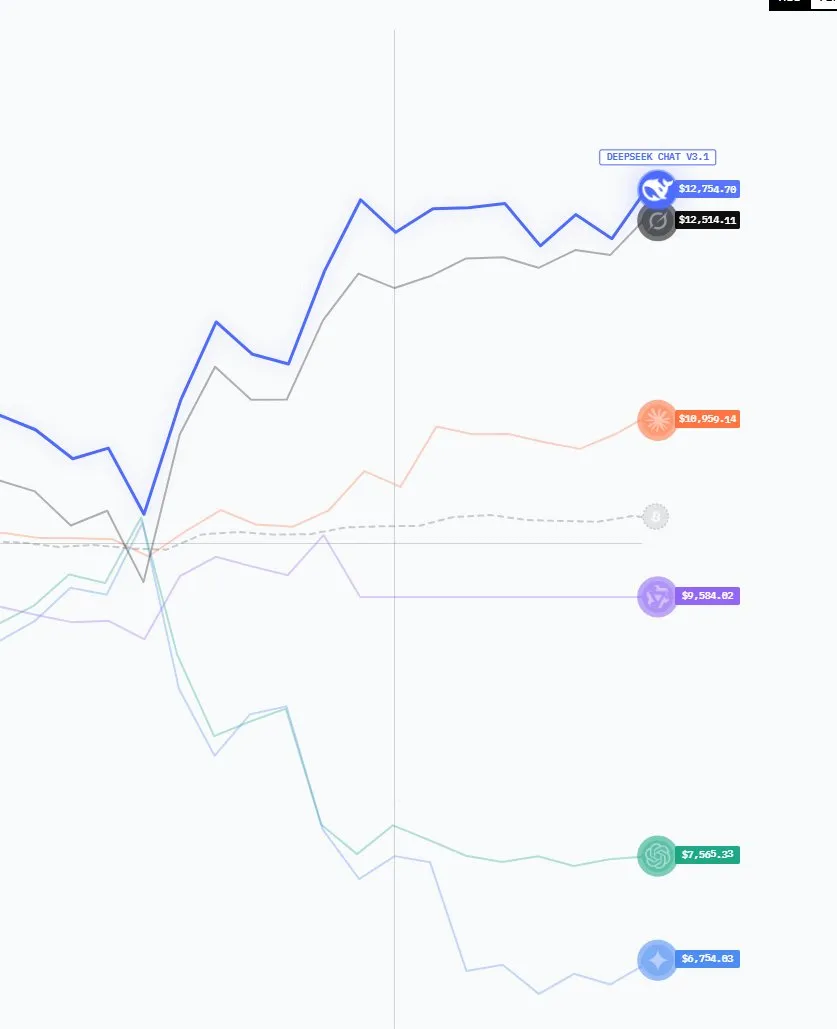

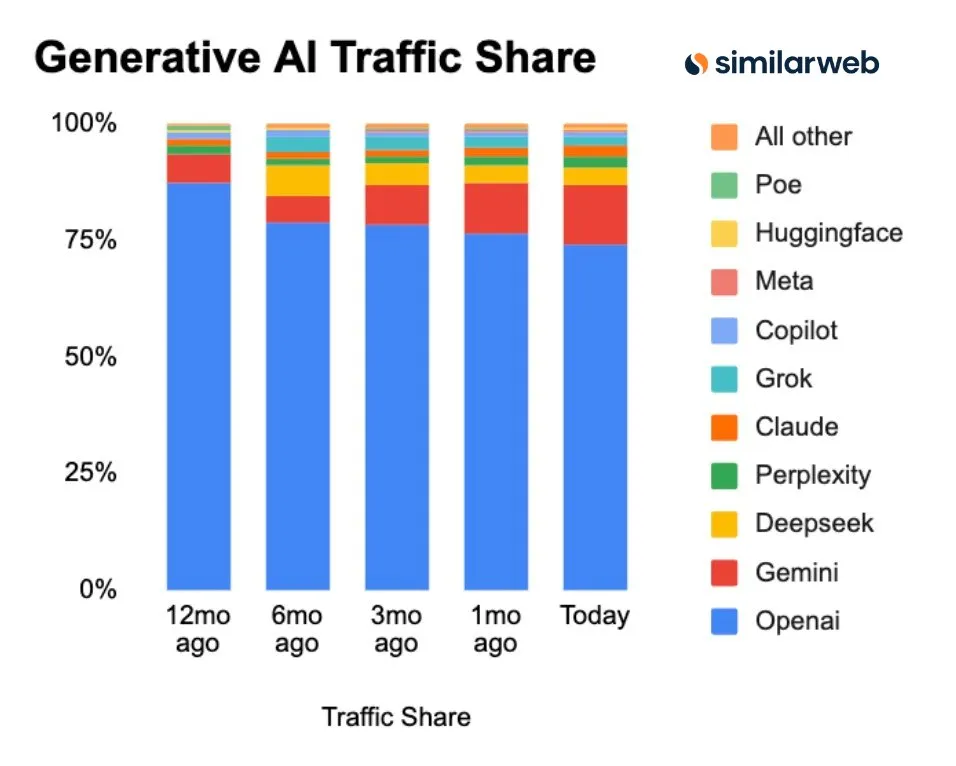

Modelos de IA chineses em ascensão, com crescimento significativo na quota de mercado e downloads : Os dados mais recentes mostram que o cenário do mercado GenAI está mudando, com a quota de mercado do ChatGPT em declínio contínuo, enquanto concorrentes como Perplexity, Gemini e DeepSeek estão em ascensão. É particularmente notável que os modelos de IA de código aberto americanos, que tiveram um desempenho notável no ano passado, foram dominados por modelos chineses no ranking do LMArena este ano. Modelos chineses como DeepSeek e Qwen têm o dobro de downloads no Hugging Face em comparação com os modelos americanos, demonstrando a crescente competitividade da China no campo da IA aberta. (Fonte: ClementDelangue, ClementDelangue)

Google lança uma série de atualizações de IA: Veo 3.1, integração do Gemini API com Maps, etc. : O Google lançou vários avanços em IA esta semana, incluindo o modelo de vídeo Veo 3.1 (suporte para expansão de cena e imagens de referência), integração do Gemini API com dados do Google Maps, pesquisa Speech-to-Retrieval (consultar dados diretamente sem transcrição de voz para texto), um investimento de 15 bilhões de dólares em um centro de IA na Índia, e a funcionalidade de agendamento de IA do Gemini para Gmail/Calendar. Ao mesmo tempo, sua funcionalidade AI Overviews está sob investigação por editores de notícias italianos devido a ser um “assassino de tráfego”, e foi lançado o modelo C2S-Scale 27B para tradução de dados biológicos. (Fonte: Reddit r/ArtificialInteligence)

Microsoft lança MAI-Image-1, modelo de geração de imagens entre os dez melhores : A Microsoft AI lançou seu primeiro modelo de geração de imagens totalmente desenvolvido internamente, o MAI-Image-1, que entrou pela primeira vez no top 10 do ranking de modelos de texto para imagem do LMArena. Este avanço demonstra a forte capacidade da Microsoft na tecnologia nativa de geração de imagens e prenuncia seu maior investimento na área de IA multimodal, proporcionando aos usuários uma experiência de criação de imagens de maior qualidade. (Fonte: dl_weekly)

🧰 Ferramentas

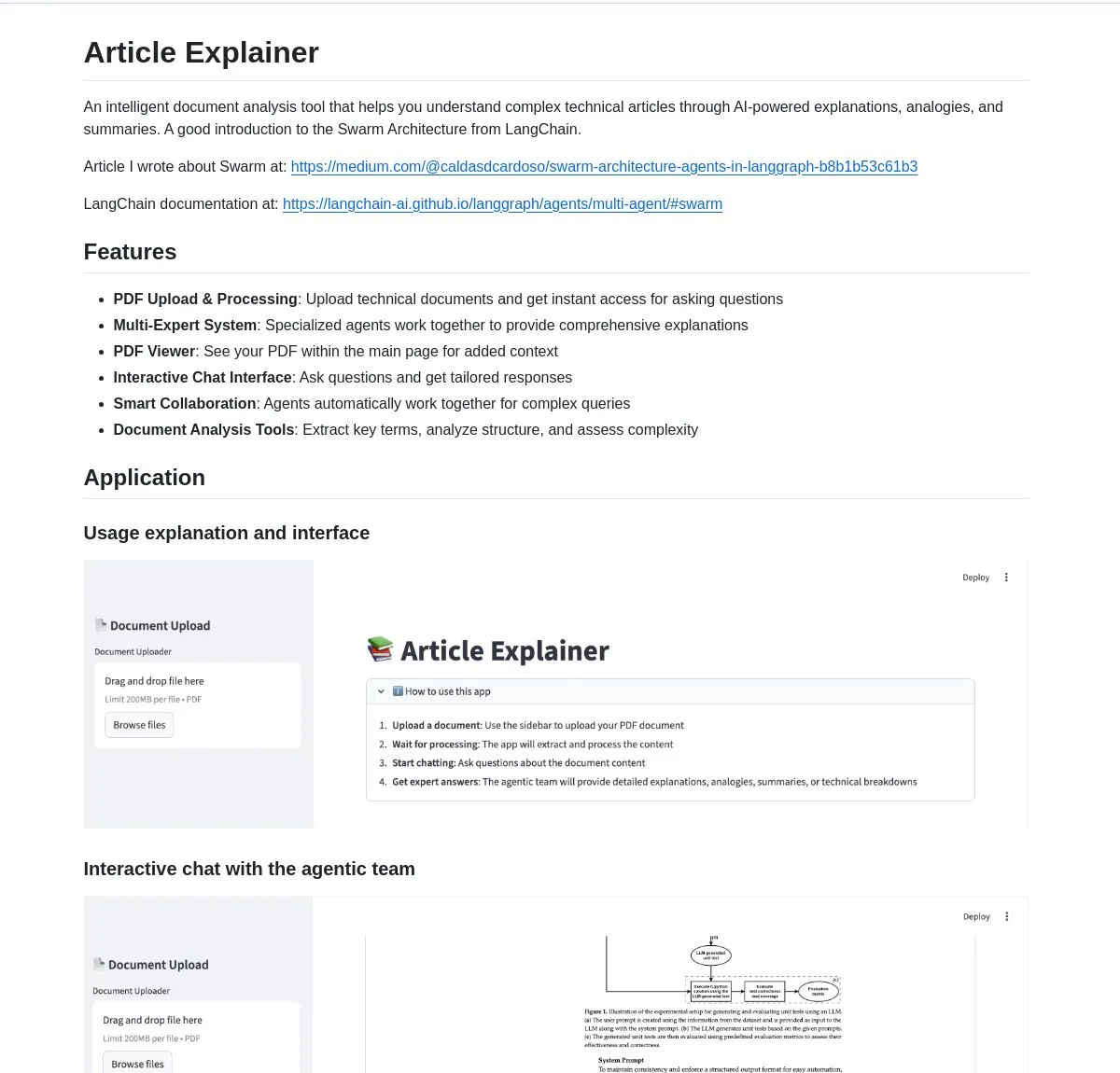

LangChain Article Explainer: Ferramenta de análise de documentos de IA : A LangChain lançou uma ferramenta de análise de documentos de IA chamada “Article Explainer”, que utiliza a Swarm Architecture da LangGraph para decompor artigos técnicos complexos. Através da colaboração multi-Agent, ela oferece explicações interativas e insights aprofundados, permitindo que os usuários consultem informações através de linguagem natural, o que melhora significativamente a eficiência da compreensão de documentos técnicos. (Fonte: LangChainAI)

Claude Code Skill: Transforma Claude em um arquiteto de projetos profissional : Um desenvolvedor criou uma Claude Code Skill que transforma Claude em um arquiteto de projetos profissional. Essa skill permite que Claude gere automaticamente documentos de requisitos, documentos de design e planos de implementação antes da codificação, resolvendo o problema de perda de contexto em projetos complexos. Ela pode gerar rapidamente histórias de usuário, arquitetura de sistema, interfaces de componentes e tarefas hierárquicas, melhorando drasticamente a eficiência do planejamento e execução de projetos, suportando o desenvolvimento de vários Web apps, microsserviços e sistemas de ML. (Fonte: Reddit r/ClaudeAI)

Perplexity AI Comet: Extensão de navegador de IA para aumentar a eficiência de navegação e pesquisa : A extensão de navegador Perplexity AI Comet lançou o acesso antecipado, visando aumentar a navegação, pesquisa e produtividade dos usuários. Esta ferramenta pode fornecer respostas rápidas, resumir o conteúdo de páginas web e integrar funcionalidades de IA diretamente na experiência do navegador, oferecendo aos usuários uma forma mais inteligente e eficiente de obter informações, especialmente útil para aqueles que precisam digerir rapidamente grandes quantidades de informações online. (Fonte: Reddit r/artificial)

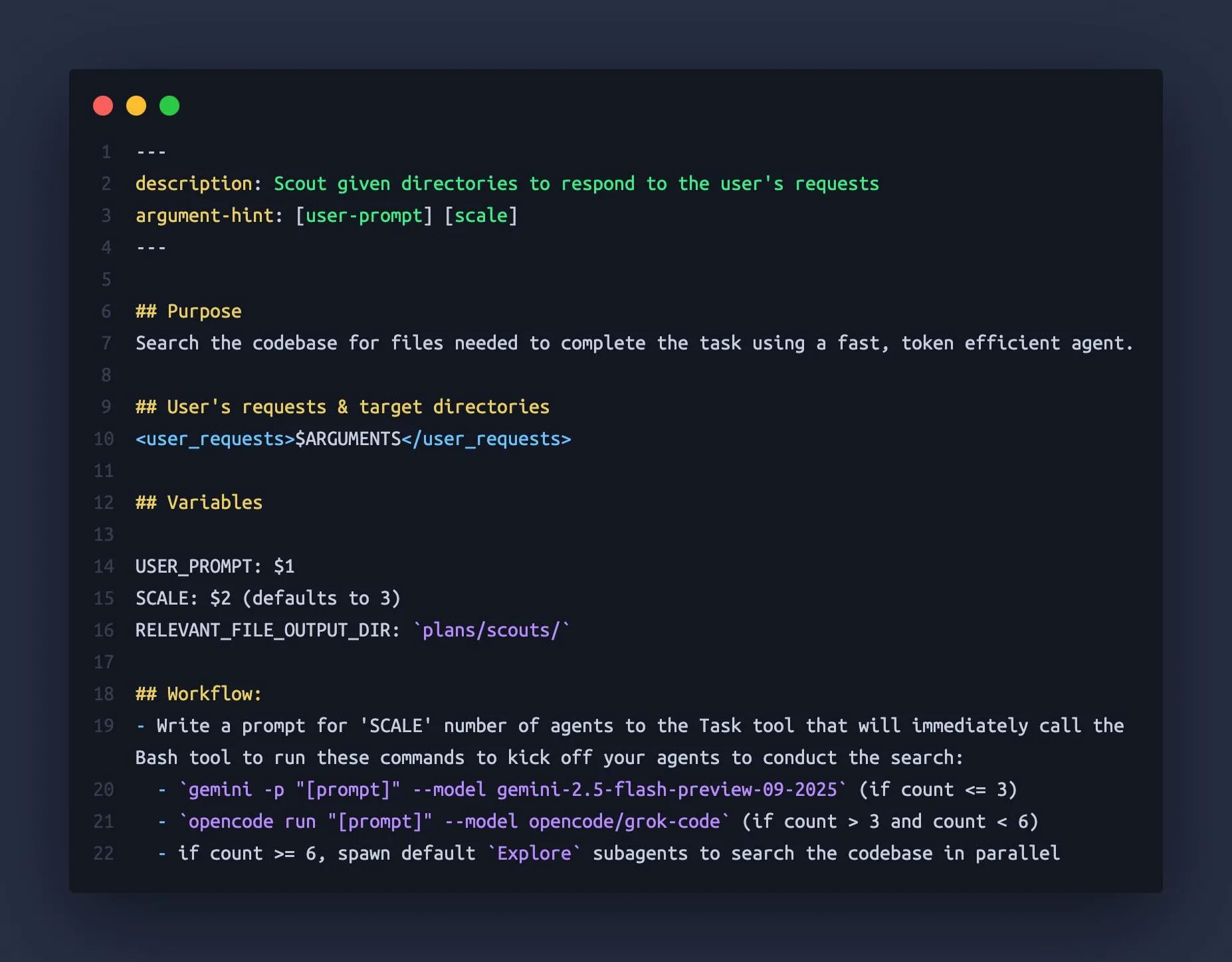

Claude Code usa Gemini CLI e OpenCode como “sub-Agents” : Um desenvolvedor descobriu que o Claude Code pode orquestrar outros grandes modelos de linguagem como Gemini 2.5 Flash e Grok Code Fast como “sub-Agents”, utilizando suas grandes janelas de contexto (1M-2M tokens) para reconhecer rapidamente bases de código, fornecendo informações de contexto mais abrangentes para o Claude Code. Essa abordagem combinada evita efetivamente o problema de Claude “perder o contexto” em tarefas complexas, melhorando a eficiência e precisão do assistente de codificação. (Fonte: Reddit r/ClaudeAI)

Modelo gerador de CAD k-1b: Gerador de modelos 3D ajustado com base no Gemma3-1B : Um desenvolvedor construiu um modelo gerador de CAD de 1B parâmetros chamado k-1b, onde os usuários podem gerar modelos 3D no formato STL simplesmente inserindo uma descrição. O modelo foi treinado usando geração e reparo assistidos por IA de um conjunto de dados OpenSCAD e ajustado com base no Gemma3-1B. O autor também forneceu uma ferramenta CLI que suporta conversão de modelos OBJ e pré-visualização no terminal, oferecendo uma ferramenta de IA de baixo custo e alta eficiência para design e fabricação 3D. (Fonte: karminski3, Reddit r/LocalLLaMA)

neuTTS-Air: Modelo de clonagem de voz de 0.7B que pode ser executado em CPU : A Neuphonic lançou um modelo de clonagem de voz de 0.7B chamado neutts-air, cujo maior destaque é a capacidade de ser executado em CPU. Os usuários precisam apenas fornecer a voz alvo e o texto correspondente para clonar a voz e gerar áudio para um novo texto, com cerca de 30 segundos para gerar 18 segundos de áudio. Atualmente, o modelo suporta apenas inglês, mas sua leveza e compatibilidade com CPU oferecem uma solução conveniente de clonagem de voz para usuários individuais e pequenos desenvolvedores. (Fonte: karminski3)

Claude Code M&A Deal Comp Agent: Usa análise de PDF para gerar termos de transação em Excel : Um desenvolvedor utilizou Claude Code Skills e a capacidade de análise de PDF semtools da LlamaIndex para criar um Agent de análise de transações de M&A. Este Agent é capaz de analisar documentos públicos de M&A (como DEF 14A), analisar cada PDF e gerar automaticamente uma planilha Excel contendo os termos da transação e dados de empresas comparáveis. Esta ferramenta melhora significativamente a eficiência e precisão da análise financeira, sendo particularmente adequada para cenários que envolvem o processamento de documentos financeiros complexos. (Fonte: jerryjliu0)

Anthropic Skills e Plugins: Sobreposição de funcionalidades causa confusão entre desenvolvedores : A Anthropic lançou recentemente as funcionalidades Skills e Plugins, visando introduzir funcionalidades personalizadas para os AI Agents. No entanto, alguns desenvolvedores relatam que há confusão e sobreposição entre as duas em termos de uso, levando a incertezas sobre cenários de uso e estratégias de desenvolvimento. Isso indica que a Anthropic pode ter espaço para otimização no design de funcionalidades e na estratégia de lançamento, a fim de orientar melhor os desenvolvedores a utilizar suas capacidades de IA. (Fonte: Vtrivedy10, Reddit r/ClaudeAI)

📚 Aprendizagem

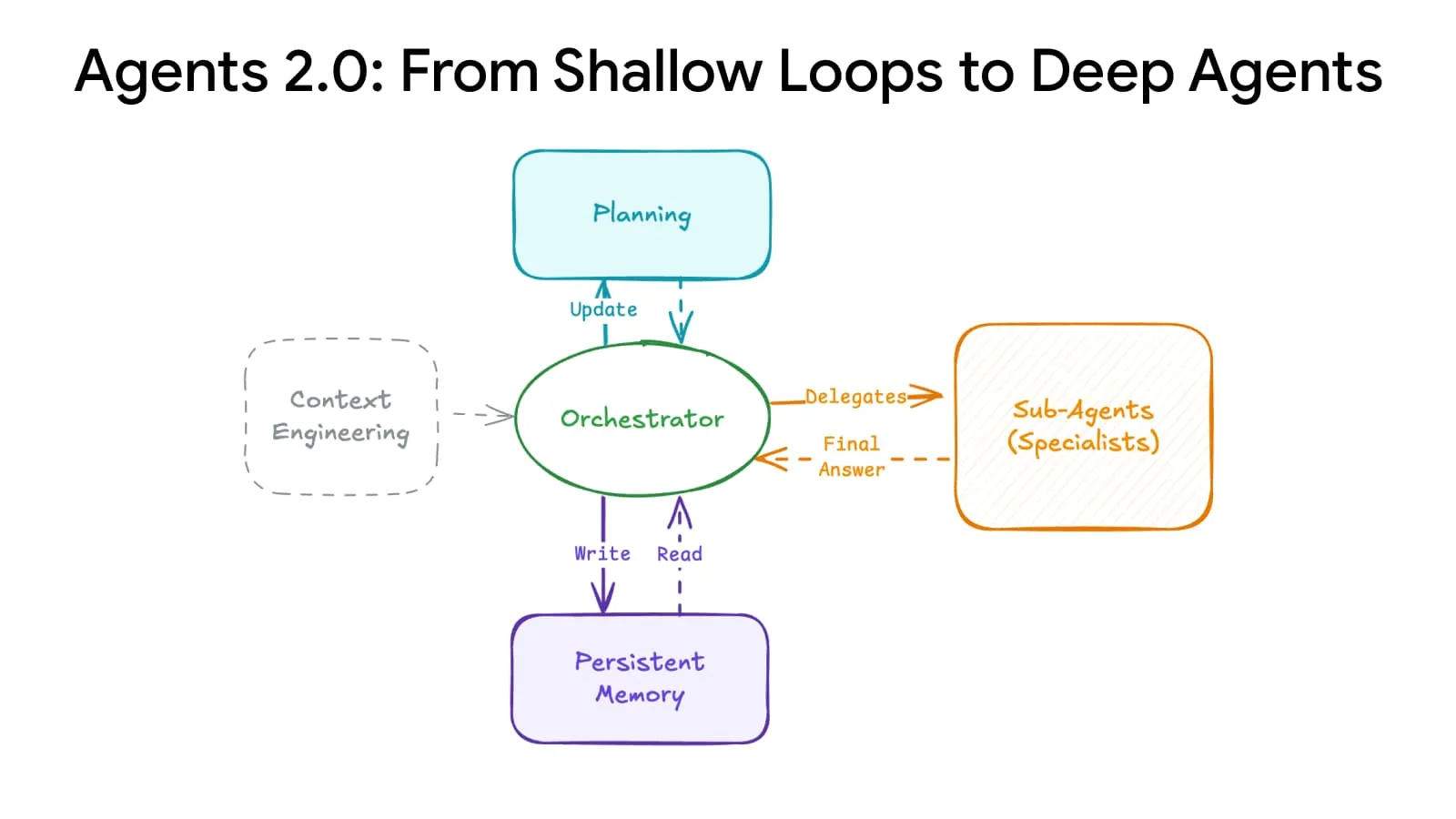

Deep Agents Evolution: Planejamento avançado e sistemas de memória aumentam a escala de Agents : Um avanço na arquitetura de IA alcançou a “evolução de Agents profundos”, permitindo que os Agents se expandam de 15 para mais de 500 passos através de sistemas avançados de planejamento e memória, revolucionando a forma como a IA lida com tarefas complexas. Esta tecnologia promete permitir que a IA mantenha a coerência em sequências de tempo mais longas e cadeias lógicas mais complexas, estabelecendo as bases para a construção de Agents de IA geral mais poderosos. (Fonte: LangChainAI)

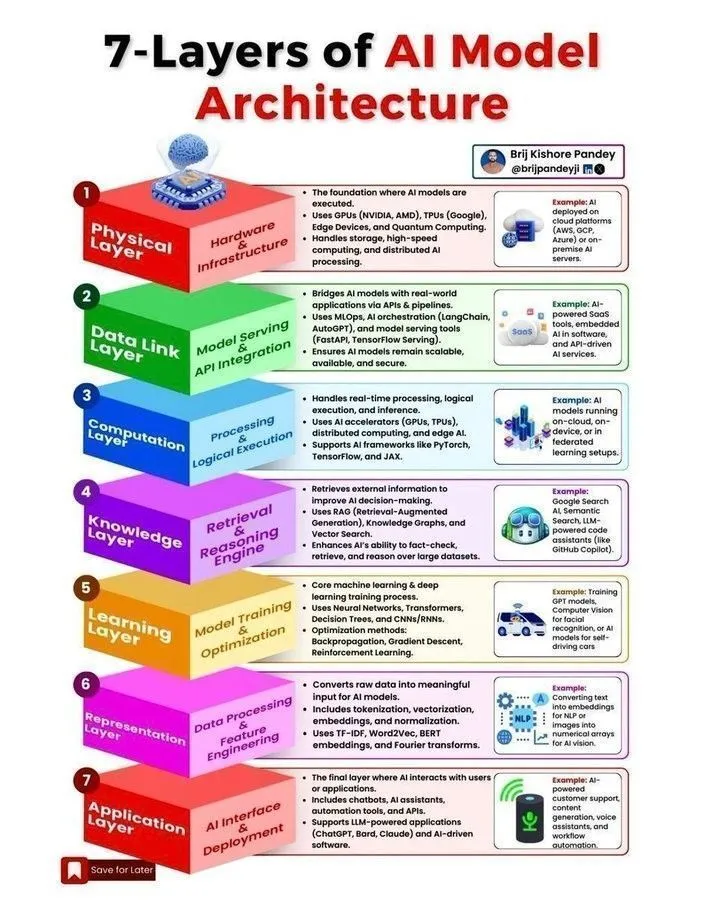

Arquitetura de modelo de IA e roteiro de desenvolvimento de Agents : Vários recursos sobre arquitetura de modelos de IA, roteiros de desenvolvimento de Agents, ciclo de vida de Machine Learning e as diferenças entre IA, IA generativa e Machine Learning foram compartilhados nas redes sociais. Esses conteúdos visam ajudar desenvolvedores e pesquisadores a entender os conceitos centrais dos sistemas de IA, os passos chave para construir Agents de IA escaláveis e a dominar as habilidades essenciais necessárias no campo da IA até 2025. (Fonte: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Curso Stanford CME295: Transformer e prática de engenharia de grandes modelos : A Universidade de Stanford lançou a série de cursos CME295, focada na arquitetura Transformer e no conhecimento prático de engenharia de Large Language Models (LLMs). O curso evita conceitos matemáticos complexos, enfatizando aplicações práticas, e oferece um recurso valioso para engenheiros que desejam aprofundar seu conhecimento no desenvolvimento e implantação de grandes modelos. Ao mesmo tempo, o curso CS224N é recomendado como a melhor escolha para iniciantes em NLP. (Fonte: karminski3, QuixiAI, stanfordnlp)

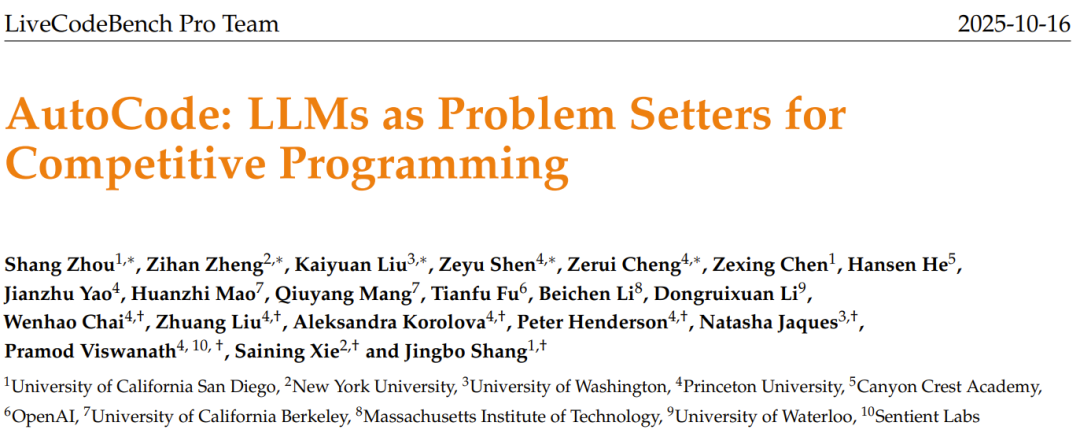

Gerador de questões de IA AutoCode: LLM gera questões originais para concursos de programação : A equipe LiveCodeBench Pro lançou o framework AutoCode, que utiliza LLMs em um sistema de ciclo fechado e multi-papel para automatizar a criação e avaliação de problemas de programação competitiva. O framework, através de um mecanismo aprimorado de verificador-gerador-inspetor, alcança alta confiabilidade na geração de casos de teste e pode inspirar o LLM a gerar novas questões originais e de alta qualidade a partir de “questões semente”, o que promete pavimentar o caminho para benchmarks de concursos de programação mais rigorosos e para o autoaperfeiçoamento de modelos. (Fonte: 36氪)

KAIST desenvolve cérebro semicondutor de IA: Combina a inteligência do Transformer com a eficiência do Mamba : O Instituto Avançado de Ciência e Tecnologia da Coreia (KAIST) desenvolveu um novo cérebro semicondutor de IA que combina com sucesso a inteligência da arquitetura Transformer com a eficiência da arquitetura Mamba. Esta pesquisa inovadora visa resolver o dilema entre desempenho e consumo de energia nos modelos de IA existentes, oferecendo uma nova direção para o design futuro de hardware de IA eficiente e de baixo consumo de energia, o que promete acelerar o desenvolvimento de sistemas de IA de borda e IA embarcada. (Fonte: Reddit r/deeplearning)

Pipeline NER multi-estágio: Correspondência difusa e técnica de mascaramento de LLM para analisar comentários do Reddit : Uma pesquisa propõe um pipeline de Reconhecimento de Entidades Nomeadas (NER) multi-estágio, combinando correspondência difusa de alta velocidade e técnica de mascaramento de LLM, para extrair entidades e sentimentos de comentários do Reddit. O método primeiro identifica entidades conhecidas através de pesquisa difusa, depois usa um LLM para processar o texto mascarado para descobrir novas entidades e, finalmente, realiza análise de sentimentos e resumo. Este método híbrido alcança um equilíbrio entre velocidade e capacidade de descoberta ao lidar com texto específico de domínio em larga escala e ruidoso. (Fonte: Reddit r/MachineLearning)

Experiência de implantação de sistema de negociação baseado em ML: Resolvendo “viés de antecipação” e “deriva de estado” em ambientes em tempo real : Um desenvolvedor compartilhou sua experiência na implantação de um sistema de negociação baseado em ML, enfatizando a importância de resolver o “viés de antecipação” e a “deriva de estado” em ambientes em tempo real. Através de um modelo rigoroso de processamento linha a linha e um script “mestre dourado”, garante-se a consistência determinística entre o teste histórico e a execução em tempo real. O sistema também inclui um validador que mede a consistência entre as previsões em tempo real e as previsões do validador com um coeficiente de correlação de Pearson de 1.0, garantindo a confiabilidade do modelo. (Fonte: Reddit r/MachineLearning)

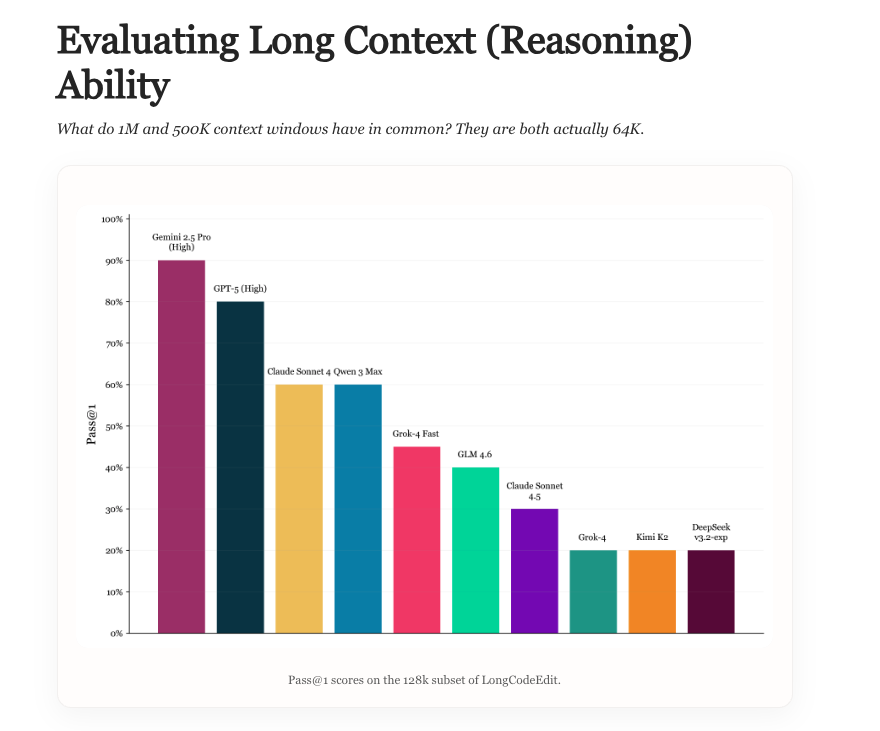

Long Context Evaluation: Novo benchmark para avaliação da capacidade de contexto longo de LLMs : Uma nova pesquisa explora o estado atual da avaliação de contexto longo de LLMs, analisando as vantagens e desvantagens dos benchmarks existentes e introduzindo um novo benchmark chamado LongCodeEdit. O estudo visa resolver as deficiências dos métodos de avaliação existentes na medição da capacidade dos LLMs de processar textos longos e tarefas complexas de edição de código, fornecendo novas ferramentas e insights para avaliar com mais precisão o desempenho dos modelos em cenários de contexto longo. (Fonte: nrehiew_, teortaxesTex)

Manifold Optimization: Otimização geometricamente consciente para treinamento de redes neurais : A otimização de Manifold permite que o treinamento de redes neurais tenha uma capacidade de otimização geometricamente consciente. Uma nova pesquisa estende essa ideia para variedades modulares, ajudando a projetar otimizadores que compreendem as interações entre as camadas. Ao combinar funções de avanço, restrições de variedade e normas, este framework descreve como a geometria entre as camadas e as regras de otimização são combinadas, alcançando assim uma otimização geometricamente consciente em um nível mais profundo, melhorando a eficiência e o efeito do treinamento de redes neurais. (Fonte: TheTuringPost, TheTuringPost)

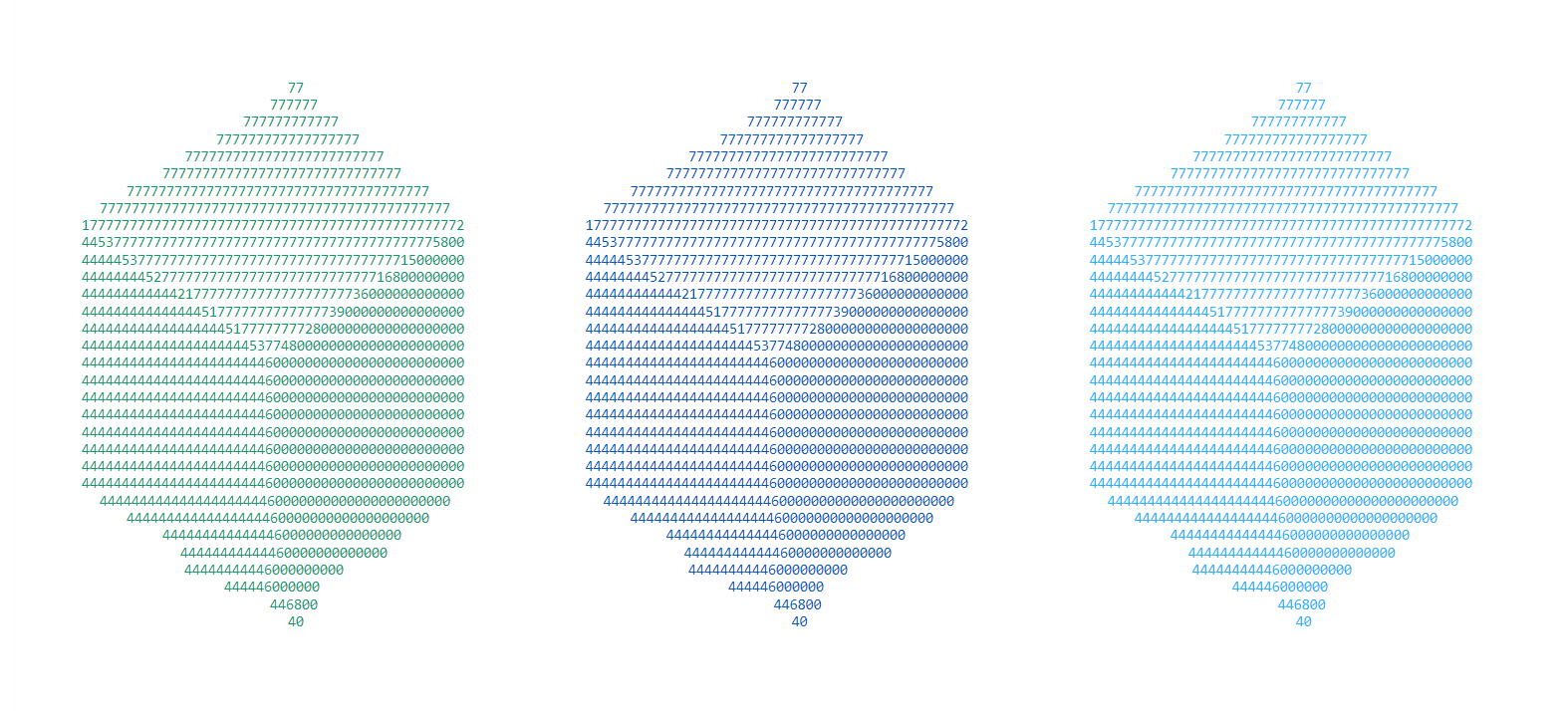

Complexidade de Kolmogorov na pesquisa de IA: O potencial da IA para simplificar resultados de pesquisa : A discussão aponta que a “essência” central de novas pesquisas e conteúdos de blog pode ser comprimida em código, artefatos e abstrações matemáticas. Futuros sistemas de IA prometem “traduzir” pesquisas complexas em artefatos simples, extraindo as diferenças centrais e reproduzindo resultados chave, o que reduzirá drasticamente o custo de compreensão de novas pesquisas, permitindo que os pesquisadores acompanhem mais facilmente o grande volume de artigos no ArXiv e realizem a rápida digestão e aplicação dos resultados da pesquisa. (Fonte: jxmnop, aaron_defazio)

Controvérsia sobre a origem da aprendizagem residual pelo pai do LSTM: Contribuição de Hochreiter em 1991 : Jürgen Schmidhuber, o pai do LSTM, voltou a afirmar que a ideia central da aprendizagem residual foi proposta por seu aluno Sepp Hochreiter já em 1991, para resolver o problema do gradiente evanescente em RNNs. Hochreiter introduziu conexões residuais recorrentes em sua tese de doutorado e fixou os pesos em 1.0, o que é considerado a fundamentação da ideia residual em arquiteturas de Deep Learning posteriores como LSTM, Highway networks e ResNet. Schmidhuber enfatiza a importância das contribuições iniciais para o desenvolvimento do Deep Learning. (Fonte: 量子位)

💼 Negócios

Zhiweituo Pharma recebe dezenas de milhões de yuans em rodada semente: IA auxilia no P&D de novos medicamentos orais de pequenas moléculas : A Beijing Zhiweituo Pharmaceutical Technology Co., Ltd. concluiu uma rodada de financiamento semente de dezenas de milhões de yuans, liderada pela Newruili Capital, com a Qingtán Investment co-investindo. Os fundos serão usados para avançar no P&D pré-clínico de pipelines centrais e na construção de uma plataforma de design molecular interativo de IA. A empresa foca no setor de IA farmacêutica, utilizando sua plataforma EnCore desenvolvida internamente para acelerar a descoberta de compostos líderes e a otimização molecular, com foco principal em medicamentos orais de pequenas moléculas para doenças autoimunes, com potencial para superar alvos “difíceis de medicar”. (Fonte: 36氪)

Damao Technology conclui rodada A+ de quase 100 milhões de yuans: Tecnologia de coordenação computação-energia resolve o problema de alto consumo de energia em centros de computação inteligente : A Damao Technology concluiu uma rodada A+ de quase 100 milhões de yuans, liderada pela Puquan Capital, subsidiária da CATL. Este financiamento será usado para P&D e promoção de tecnologias centrais como grandes modelos de energia, plataformas de coordenação computação-energia e Agents, visando resolver o problema de alto consumo de energia em centros de computação inteligente através da “coordenação computação-energia” e auxiliar na construção de novos sistemas de energia elétrica. A Damao Technology, contando com seu grande modelo de energia totalmente desenvolvido internamente, já colaborou com empresas líderes como SenseTime e Cambricon para fornecer soluções de otimização de energia para infraestruturas de computação de alto consumo de energia. (Fonte: 36氪)

JD.com, Tmall, Douyin “AI” no Double 11: Tecnologia impulsiona o crescimento das grandes promoções de e-commerce : O Double 11 deste ano tornou-se um campo de treinamento para o e-commerce de IA, com plataformas líderes como JD.com, Tmall e Douyin investindo pesadamente em tecnologia de IA. A IA é aplicada para otimizar a experiência do consumidor, capacitar comerciantes, logística de entrega, distribuição de conteúdo e decisões de compra em toda a cadeia. Por exemplo, JD.com atualizou o “compra por foto”, Douyin Doubao foi integrado ao shopping, e a Worthbuy Technology alcançou comparação de preços via chat de IA. A IA está se tornando um novo motor de crescimento para o e-commerce, remodelando o cenário competitivo da indústria através de eficiência máxima e controle de custos, e impulsionando o e-commerce de “prateleira/conteúdo” para a fase de “e-commerce inteligente”. (Fonte: 36氪, 36氪)

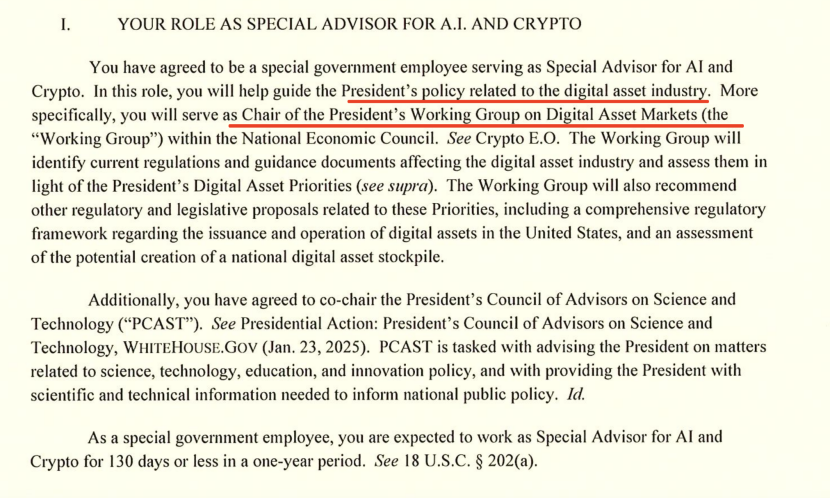

Chefe de IA da Casa Branca discute competição EUA-China em IA: Exportação de chips e dominância do ecossistema : David Sacks, o “czar” de IA e Crypto da Casa Branca, em uma entrevista, explicou a estratégia dos EUA na competição de IA com a China, enfatizando a importância da inovação, infraestrutura e exportação. Ele apontou que a política de exportação de chips dos EUA para a China precisa ser “nuançada”, restringindo os chips mais avançados, mas evitando a privação total que levaria ao monopólio da Huawei no mercado doméstico. Sacks enfatizou que os EUA devem construir um enorme ecossistema de IA, tornando-se o parceiro tecnológico preferencial global, em vez de sufocar a competitividade através do controle burocrático. (Fonte: 36氪)

🌟 Comunidade

Controvérsia sobre comercialização da OpenAI: De não-lucrativa a busca por lucro, reputação de Sam Altman prejudicada : O CEO da OpenAI, Sam Altman, gerou ampla controvérsia devido à liberação de conteúdo erótico no ChatGPT, ao desempenho do modelo GPT-5 e à sua agressiva estratégia de expansão de infraestrutura. A comunidade questiona sua mudança do propósito não-lucrativo original para a busca por lucro comercial, expressando preocupações sobre a direção do desenvolvimento da tecnologia de IA, a bolha de investimento e o tratamento ético dos funcionários. A resposta de Altman não conseguiu acalmar completamente a opinião pública, destacando a tensão entre a expansão do império da IA e a responsabilidade social. (Fonte: 36氪, janusch_patas, Reddit r/ArtificialInteligence)

Envenenamento de grandes modelos: Envenenamento de dados, amostras adversárias e desafios de segurança da IA : Grandes modelos enfrentam ameaças de segurança como envenenamento de dados, ataques de backdoor e amostras adversárias, levando a saídas anormais do modelo, conteúdo prejudicial e até mesmo sendo usados para publicidade comercial (GEO), exibicionismo tecnológico ou cibercrime. Pesquisas mostram que uma pequena quantidade de dados maliciosos pode afetar significativamente o modelo. Isso levanta preocupações sobre alucinações de IA, manipulação de decisões do usuário e riscos de segurança pública, enfatizando a importância de construir um sistema imunológico do modelo, fortalecer a auditoria de dados e mecanismos de defesa contínuos. (Fonte: 36氪)

A situação dos rotuladores de dados na era da IA: Mestres e doutores realizando trabalho repetitivo de baixo salário : Com o desenvolvimento de grandes modelos de IA, o trabalho de rotulagem de dados exige maior qualificação acadêmica (até mesmo mestrado e doutorado), mas o salário é muito inferior ao dos engenheiros de IA. Esses “professores de IA” estão envolvidos na avaliação de conteúdo gerado por IA, revisão ética e treinamento de conhecimento especializado, mas recebem um salário por hora baixo e o trabalho é instável, com o desemprego ocorrendo ao final do projeto. Este modelo de subcontratação e exploração em cascata, como uma “linha de montagem cibernética”, levanta profundas reflexões sobre a ética do trabalho e a equidade na indústria de IA. (Fonte: 36氪)

O impacto da IA na criatividade e no valor humano: É o fim ou a elevação? : A comunidade discute o impacto da IA na criatividade humana, argumentando que a IA não matou a criatividade, mas revelou a mediocridade relativa da criatividade humana. A IA é boa em reorganização e geração de padrões, mas a verdadeira originalidade, contradição e imprevisibilidade ainda são vantagens únicas dos humanos. O surgimento de novas ferramentas sempre elimina o terreno intermediário, forçando os humanos a buscar avanços de nível superior em conteúdo e criatividade, tornando a verdadeira criatividade ainda mais valiosa. (Fonte: Reddit r/artificial)

Ansiedade existencial e estratégias de enfrentamento causadas pela IA: Problemas reais e preocupação excessiva : Diante da possível ameaça existencial da IA, a comunidade discutiu como lidar com o “medo existencial” resultante. Algumas opiniões sugerem que esse medo pode vir de uma fantasia excessiva sobre o futuro, aconselhando as pessoas a voltarem à realidade e se concentrarem na vida presente. Ao mesmo tempo, outros apontam que os choques econômicos e os problemas de emprego relacionados à IA são ameaças reais mais urgentes, enfatizando que a segurança da IA deve ser equilibrada com o impacto socioeconômico. (Fonte: Reddit r/ArtificialInteligence)

As opiniões de Karpathy geram debate: Teoria dos dez anos da AGI, teoria dos “fantasmas” de Agent e o caminho de desenvolvimento da IA : As opiniões de Andrej Karpathy sobre a “teoria dos dez anos” da AGI e a ideia de que os atuais AI Agents são “fantasmas” geraram ampla discussão na comunidade. Ele enfatiza que a IA precisa de persistência, memória e continuidade para se tornar um verdadeiro Agent inteligente, e sugere que o treinamento de IA deve mudar de “alimentar dados” para “ensinar objetivos”. Essas opiniões são vistas como uma reflexão sóbria sobre o hype atual da IA, levando as pessoas a repensar o caminho de desenvolvimento de longo prazo e os padrões de avaliação da IA. (Fonte: TheTuringPost, TheTuringPost, NandoDF, random_walker, lateinteraction, stanfordnlp)

Quota de mercado do ChatGPT em declínio contínuo: Perplexity, Gemini, DeepSeek e outros concorrentes em ascensão : Dados da Similarweb mostram que a quota de mercado do ChatGPT continua a diminuir, caindo de 87.1% há um ano para 74.1%. Ao mesmo tempo, a quota de mercado de concorrentes como Gemini, Perplexity, DeepSeek, Grok e Claude está crescendo constantemente. Essa tendência indica que o mercado de assistentes de IA está cada vez mais competitivo, as escolhas dos usuários estão se diversificando e a posição dominante do ChatGPT está sendo desafiada. (Fonte: ClementDelangue, brickroad7)

Incidente de gafe matemática do GPT-5: Marketing excessivo da OpenAI e questionamento por pares : Pesquisadores da OpenAI anunciaram com alarde que o GPT-5 resolveu vários problemas matemáticos de Erdős, mas depois foi descoberto que ele apenas encontrou respostas já existentes através de pesquisa na web, em vez de resolvê-los independentemente. Este incidente provocou o escárnio público de grandes nomes da indústria como o CEO da DeepMind, Hassabis, e LeCun da Meta, questionando o marketing excessivo da OpenAI e destacando problemas de rigor na publicidade das capacidades da IA, bem como a dinâmica competitiva entre pares. (Fonte: 量子位)

Os custos ambientais ocultos da IA: Consumo de energia e demanda por água : Pesquisas históricas mostram que, do telégrafo à IA, os sistemas de comunicação sempre tiveram custos ambientais ocultos. A IA e os sistemas de comunicação modernos dependem de grandes centros de dados, levando a um aumento no consumo de energia e na demanda por água. Estima-se que até 2027, o consumo de água da IA será equivalente ao consumo anual de água da Dinamarca. Isso destaca o custo ambiental por trás do rápido desenvolvimento da tecnologia de IA, apelando aos governos para fortalecer a regulamentação, exigir a divulgação do impacto ambiental e apoiar projetos de baixo impacto. (Fonte: aihub.org)

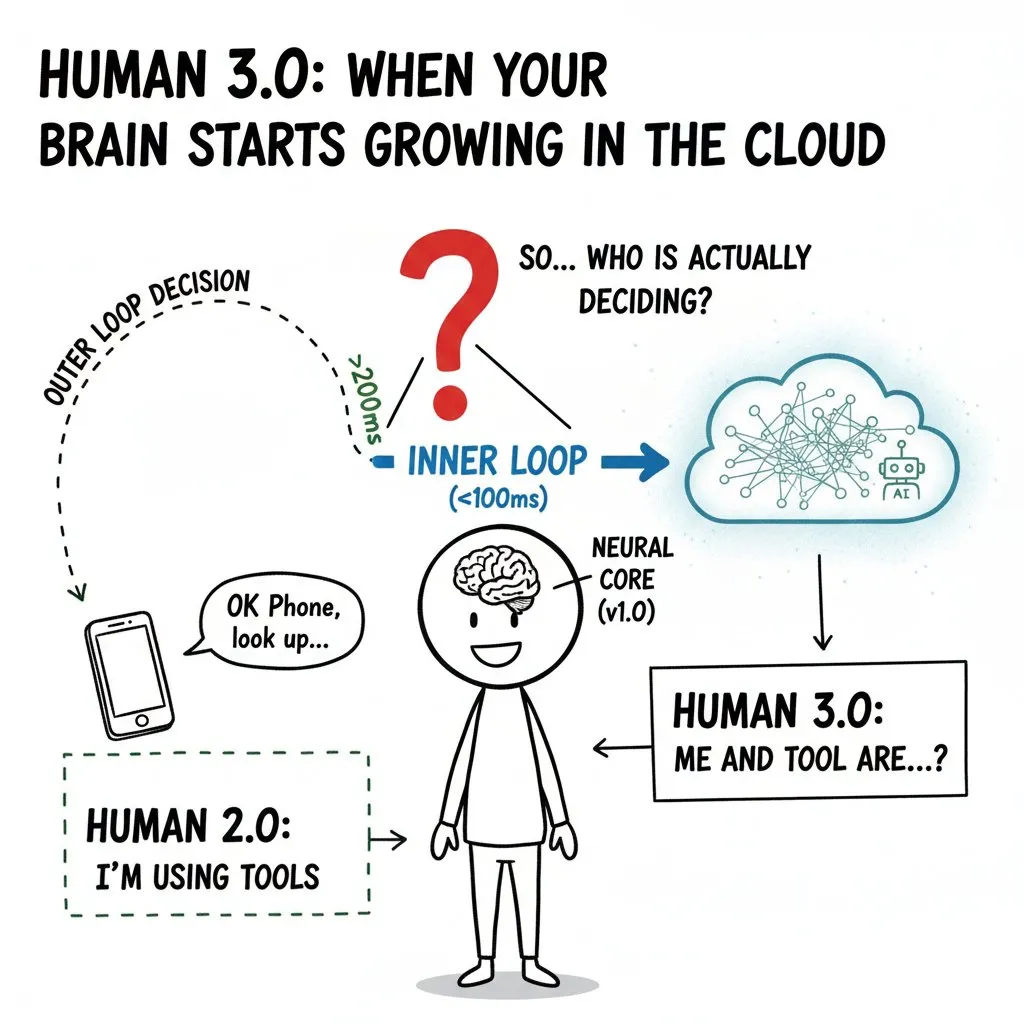

A “invasão” da mente humana pela IA: Interfaces cérebro-máquina e os limites éticos do “Humano 3.0” : A comunidade discutiu profundamente as interfaces cérebro-máquina (BCI) e o potencial impacto da IA na mente humana, propondo o conceito de “Humano 3.0”. Quando o poder de computação externo entra no “círculo interno” da decisão humana, tão rápido que o cérebro não consegue distinguir a origem do sinal, surgem questões éticas como os limites do “eu”, julgamento de valor e saúde a longo prazo. O artigo enfatiza que, antes da popularização da tecnologia, é imperativo estabelecer arquiteturas de confiança zero, isolamento de hardware e gerenciamento de permissões para evitar o aluguel do poder de decisão e o agravamento da desigualdade em nível de espécie. (Fonte: dotey)

💡 Outros

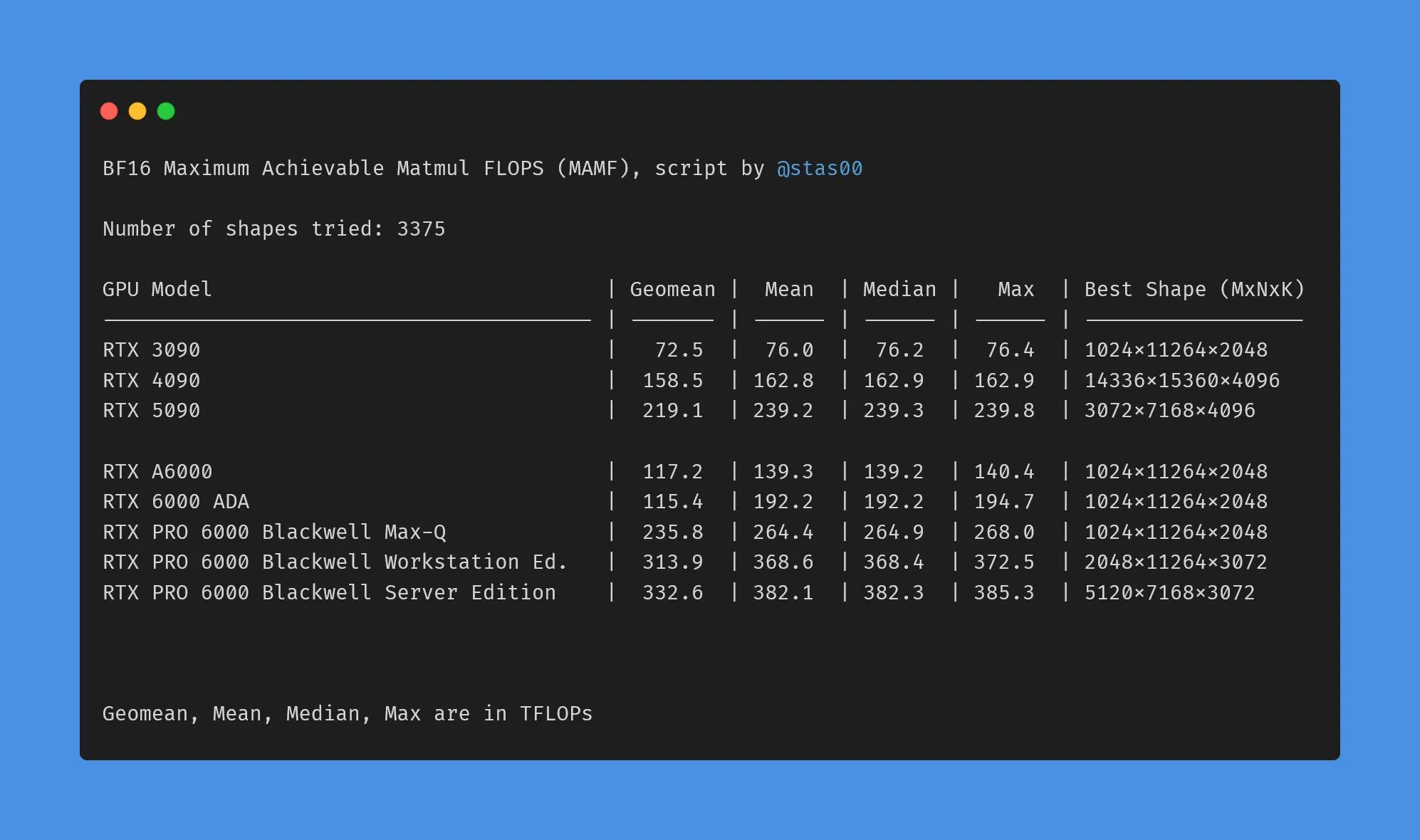

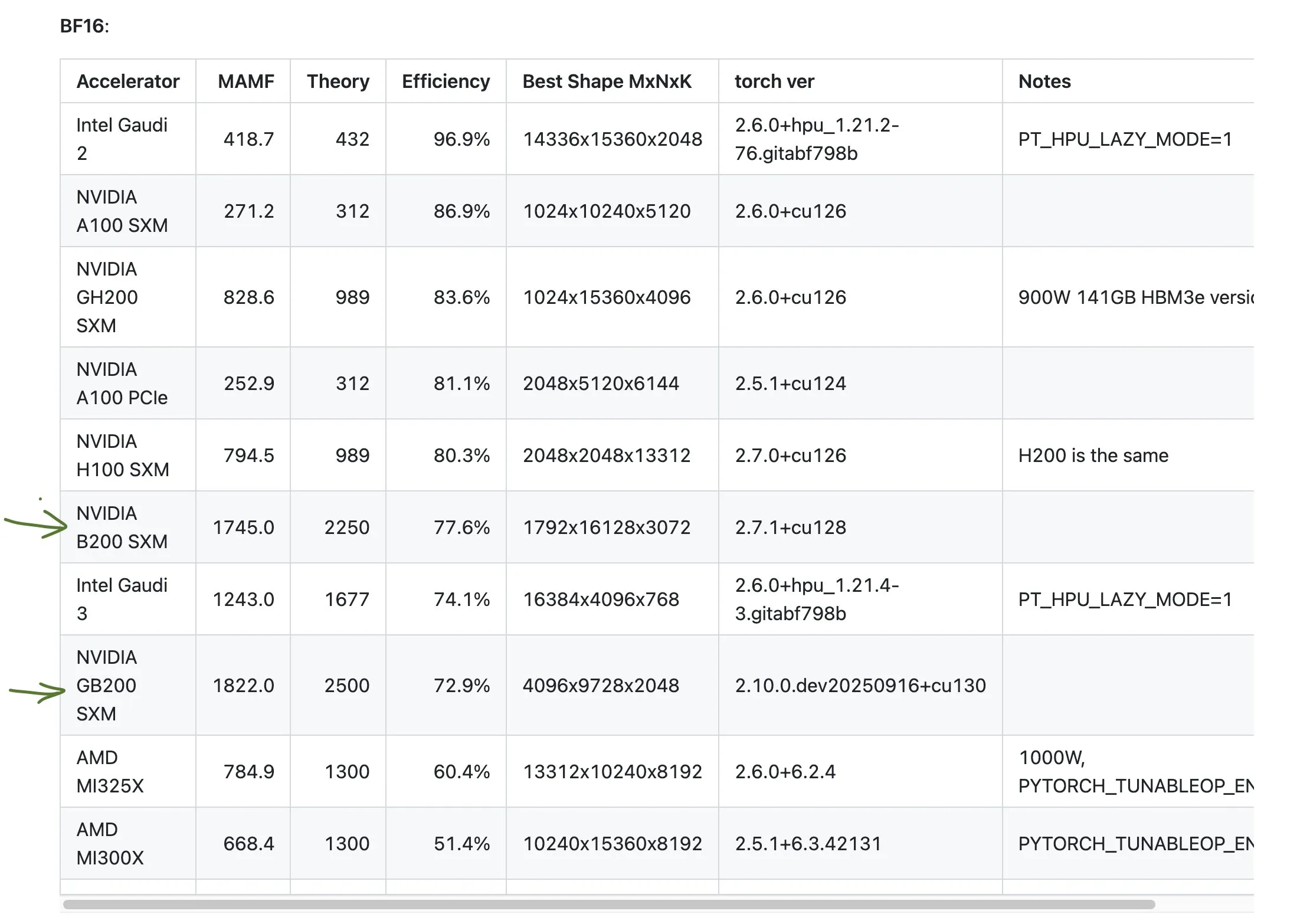

Diferenças nos dados de desempenho de GPUs NVIDIA de consumidor e profissional : A comunidade discutiu as diferenças entre os TFLOPs de marketing e o desempenho real das GPUs NVIDIA de consumidor e profissional. Os dados mostram que o desempenho real das placas de vídeo de consumidor (como 3090, 4090, 5090) é ligeiramente superior ou próximo aos TFLOPs nominais, enquanto o desempenho real das placas de vídeo profissionais para estações de trabalho (como A6000, 6000 ADA) é muito inferior aos valores nominais. Apesar disso, as placas profissionais ainda têm vantagens em consumo de energia, tamanho e eficiência energética, mas os usuários devem estar cientes da discrepância entre os dados de marketing e o desempenho real. (Fonte: TheZachMueller)

Discussão sobre o desempenho insatisfatório das GPUs AMD : A comunidade discutiu o desempenho das GPUs AMD em alguns benchmarks, apontando que sua eficiência pode ser apenas metade do esperado. Isso levanta preocupações sobre a competitividade da AMD no campo da computação de IA, especialmente quando comparada a produtos de alto desempenho como o GB200 da NVIDIA. Os usuários, ao planejar recursos de computação de IA, devem avaliar cuidadosamente o desempenho e a eficiência reais das GPUs de diferentes fabricantes. (Fonte: jeremyphoward)

GIGABYTE AI TOP ATOM: Desempenho do Grace Blackwell GB10 de nível desktop : A GIGABYTE lançou o AI TOP ATOM, trazendo o desempenho do NVIDIA Grace Blackwell GB10 para estações de trabalho de nível desktop. Este produto visa fornecer poderosa capacidade de computação de IA para usuários individuais e pequenas equipes, permitindo-lhes realizar treinamento e inferência de modelos de alto desempenho localmente, reduzindo a dependência de recursos em nuvem e acelerando o desenvolvimento e a implantação de aplicações de IA. (Fonte: Reddit r/LocalLLaMA)