Palavras-chave:OpenAI Sora, Geração de vídeo por IA, Tiny Recursive Model, Brinquedos de IA, Chips de IA, Recriação de vídeo Sora 2, Eficiência de inferência TRM, Crescimento do mercado de brinquedos de IA, Parceria AMD e OpenAI em chips, Controvérsias sobre direitos autorais de conteúdo gerado por IA

🔥 Destaque

Ascensão e Desafios do OpenAI Sora App : O aplicativo de geração de vídeo por IA da OpenAI, Sora, lançado pela empresa, rapidamente ganhou popularidade, alcançando o topo da App Store. Sua capacidade de gerar vídeos de forma gratuita e ilimitada levantou amplas preocupações sobre custos operacionais, violação de direitos autorais (especialmente o uso de IP existente e imagens de celebridades falecidas) e o abuso da tecnologia deepfake. Sam Altman reconheceu a necessidade de considerar modelos de monetização e planeja oferecer controles de direitos autorais mais refinados. O impacto do aplicativo no ecossistema de criação de conteúdo e na percepção da realidade gerou discussões sobre se os vídeos de IA superarão os vídeos “reais”. (Fonte: MIT Technology Review, rowancheung, fabianstelzer, nptacek, paul_cal, BlackHC)

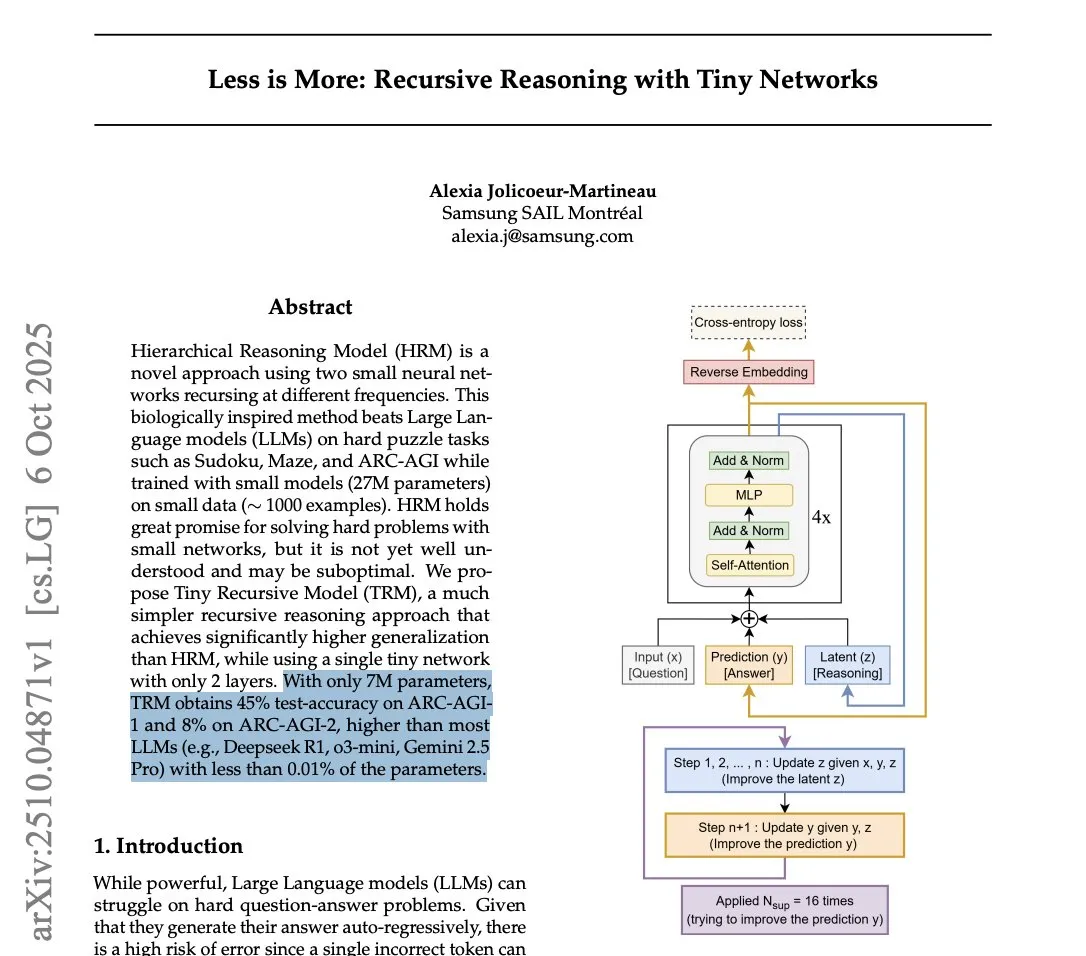

Samsung Lança Tiny Recursive Model (TRM) Desafiando a Eficiência de Inferência de LLM : A Samsung lançou o Tiny Recursive Model (TRM), uma pequena rede neural com apenas 7 milhões de parâmetros, que se destacou no benchmark ARC-AGI, superando até mesmo grandes LLMs como DeepSeek-R1 e Gemini 2.5 Pro. O TRM adota um método de inferência recursiva, otimizando as respostas através de múltiplas “reflexões” internas e autocrítica. Este avanço gerou discussões sobre se “modelos pequenos podem ser mais inteligentes” e indica que, em tarefas de inferência, a inovação arquitetônica pode ser mais importante do que o tamanho do modelo, prometendo reduzir significativamente os custos computacionais da inferência SOTA. (Fonte: HuggingFace Daily Papers, fchollet, cloneofsimo, ecsquendor, clefourrier, AymericRoucher, ClementDelangue, Dorialexander)

Yao Shunyu da Tsinghua Deixa a Anthropic para a Google DeepMind, Conflito de Valores é a Principal Razão : Yao Shunyu, bolsista de mérito especial do Departamento de Física da Universidade Tsinghua, anunciou sua saída da Anthropic para se juntar à Google DeepMind como Cientista de Pesquisa Sênior. Ele apontou que 40% da razão para sua saída se deve a “divergências fundamentais de valores” com a Anthropic, acreditando que a empresa não é amigável com pesquisadores chineses e funcionários com posições neutras. Yao Shunyu trabalhou na Anthropic por um ano, participando da construção da teoria de aprendizado por reforço por trás das séries Claude 3.7 Sonnet e Claude 4, e afirmou que o campo da IA está se desenvolvendo a uma velocidade surpreendente, mas é hora de seguir em frente. (Fonte: ZhihuFrontier, 量子位)

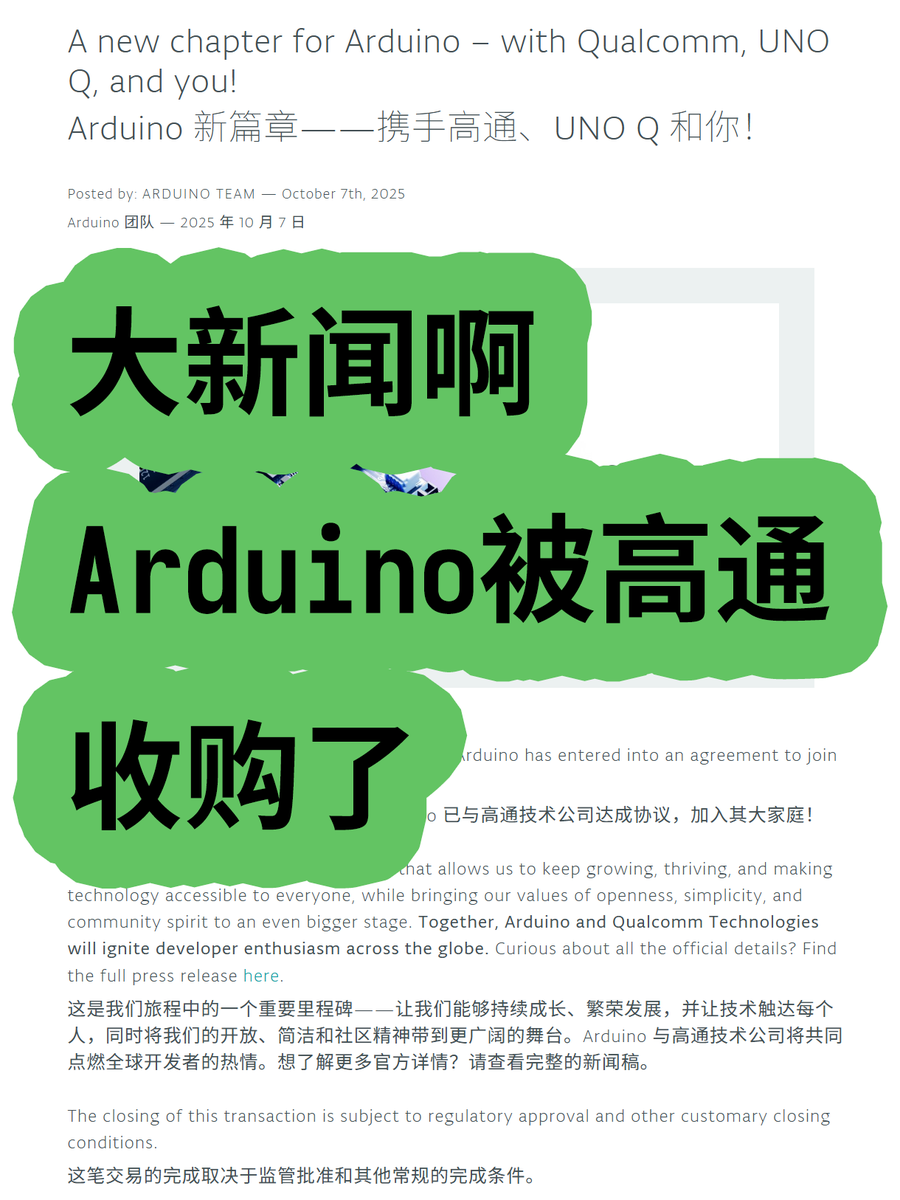

Arduino Adquirida pela Qualcomm, Sinalizando Nova Direção para IA Embarcada : A Arduino foi adquirida pela Qualcomm e lançou sua primeira placa de desenvolvimento colaborativa, a UNO Q, equipada com o processador Qualcomm Dragonwing QRB2210, que integra soluções de IA. Isso marca a transição da Arduino do campo tradicional de microcontroladores de baixa potência para a computação de borda de potência média e capacidade de IA integrada. Essa mudança pode impulsionar a ampla aplicação da IA em IoT e dispositivos embarcados, fornecendo aos desenvolvedores maior poder de computação de IA e pressagiando uma nova revolução no ecossistema de hardware de IA embarcada. (Fonte: karminski3)

Meta Superintelligence Lança REFRAG: Novo Avanço na Eficiência de RAG : A Meta Superintelligence publicou seu primeiro artigo, REFRAG, propondo um novo método RAG (Retrieval-Augmented Generation) para aumentar drasticamente a eficiência. O método converte a maioria dos blocos de documentos recuperados em “embeddings de bloco” compactos e amigáveis para LLM, que são consumidos diretamente pelo LLM, e usa uma estratégia leve para expandir seletivamente alguns embeddings de bloco de volta para tokens completos, conforme necessário, dentro do orçamento. Isso reduz significativamente o cache KV e os custos de atenção, acelera a latência do primeiro byte e o throughput, mantendo a precisão, abrindo novos caminhos para aplicações RAG em tempo real. (Fonte: Reddit r/deeplearning, Reddit r/LocalLLaMA)

🎯 Tendências

xAI Conclui Rodada de Financiamento de US$ 20 Bilhões, NVIDIA Investe US$ 2 Bilhões : A xAI, empresa de Elon Musk, concluiu com sucesso uma rodada de financiamento de US$ 20 bilhões, incluindo um investimento direto de US$ 2 bilhões da NVIDIA. Esses fundos serão usados através de um veículo de propósito especial (SPV) para adquirir GPUs NVIDIA, apoiando a construção de seu centro de dados Memphis Colossus 2. A estrutura de financiamento é única e visa garantir o hardware para a expansão em larga escala da xAI no campo da computação de IA, intensificando ainda mais a concorrência no mercado de chips de IA. (Fonte: scaling01)

Brinquedos de IA em Ascensão nos Mercados Chinês e Americano : Brinquedos de IA equipados com chatbots e assistentes de voz estão se tornando uma nova tendência, com rápido crescimento no mercado chinês e expansão para mercados internacionais como os EUA. Produtos de empresas como BubblePal e FoloToy visam reduzir a dependência de telas em crianças. No entanto, o feedback dos pais indica que as funções de IA são por vezes instáveis, com respostas longas ou reconhecimento de voz atrasado, levando à diminuição do interesse das crianças. Empresas americanas como a Mattel também estão colaborando com a OpenAI para desenvolver brinquedos de IA. (Fonte: MIT Technology Review)

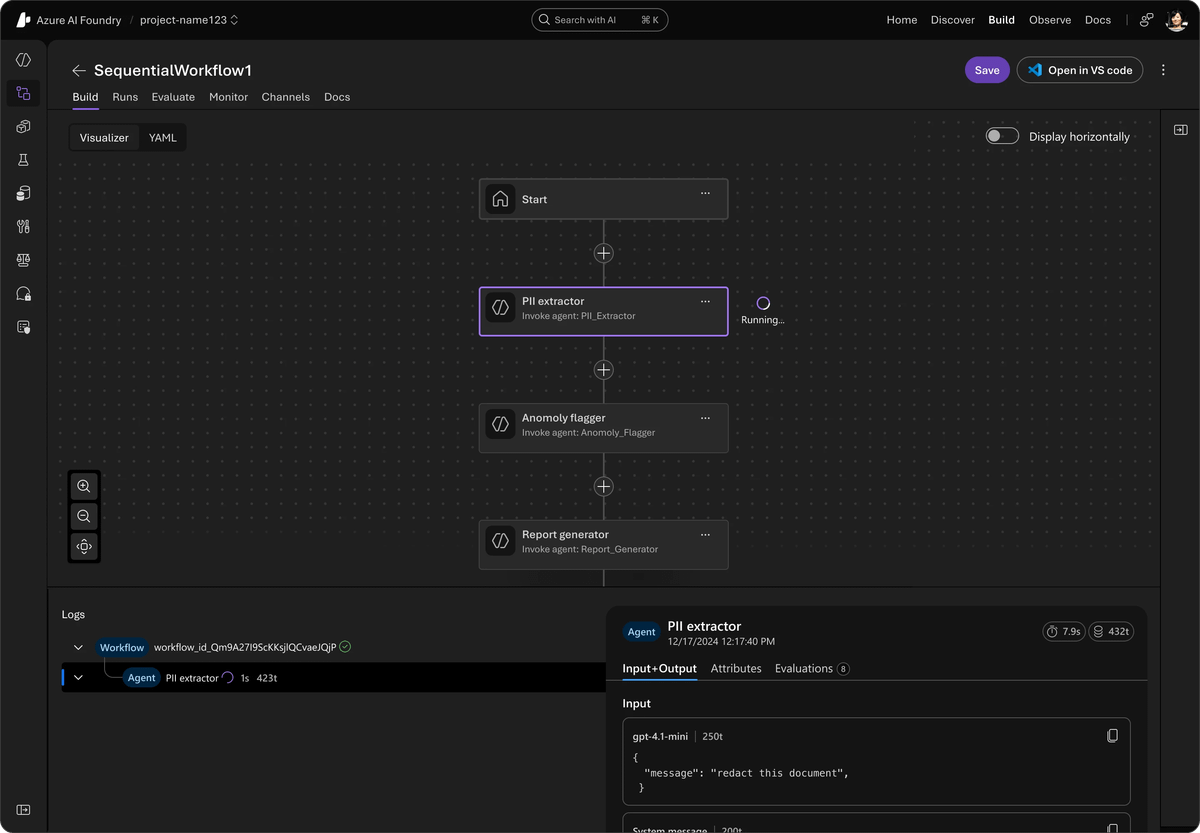

Microsoft Lança Framework Unificado de Agentes de Código Aberto, Integrando AutoGen e Semantic Kernel : A Microsoft lançou o Agent Framework, um SDK unificado de código aberto que visa integrar AutoGen e Semantic Kernel para construir sistemas de IA multiagente de nível empresarial. O framework, apoiado pelo Azure AI Foundry, simplifica a orquestração e a observabilidade, e é compatível com várias APIs. Ele introduz uma prévia privada de fluxos de trabalho multiagente, rastreamento entre frameworks com OpenTelemetry, recursos de agente de voz em tempo real com a Voice Live API e ferramentas de IA responsável, visando melhorar a segurança e eficiência dos sistemas de agente. (Fonte: TheTuringPost)

AI21 Labs Lança Jamba 3B, Modelo Pequeno Supera Concorrentes em Desempenho : A AI21 Labs lançou o Jamba 3B, um modelo MoE com apenas 3 bilhões de parâmetros, que se destaca em qualidade e velocidade, especialmente no processamento de contextos longos. O modelo mantém uma velocidade de geração de aproximadamente 40 t/s em um Mac, mesmo com contexto superior a 32K, superando Qwen 3 4B e Llama 3.2 3B. O Jamba 3B tem um índice de inteligência superior a Gemma 3 4B e Phi-4 Mini, e mantém sua capacidade de inferência completa com contexto de 256K, demonstrando o enorme potencial de modelos pequenos em IA de borda e implantações em dispositivos. (Fonte: Reddit r/LocalLLaMA)

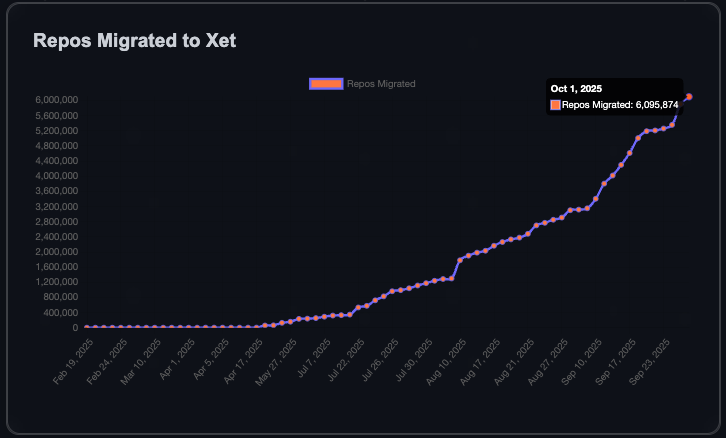

Comunidade HuggingFace Cresce Rapidamente, Adicionando Milhões de Repositórios em 90 Dias : A comunidade HuggingFace adicionou 1 milhão de novos repositórios de modelos, conjuntos de dados e Spaces nos últimos 90 dias. Levou seis anos para atingir o primeiro milhão de repositórios, o que significa que um novo repositório é criado a cada 8 segundos. Esse crescimento é atribuído à tecnologia Xet para transferência de dados mais eficiente e ao fato de 40% dos repositórios serem privados, indicando uma tendência de uso interno do HuggingFace para compartilhamento de modelos e dados por empresas. O objetivo da comunidade é atingir 10 milhões de repositórios, pressagiando o florescimento do ecossistema de IA de código aberto. (Fonte: Teknium1, reach_vb)

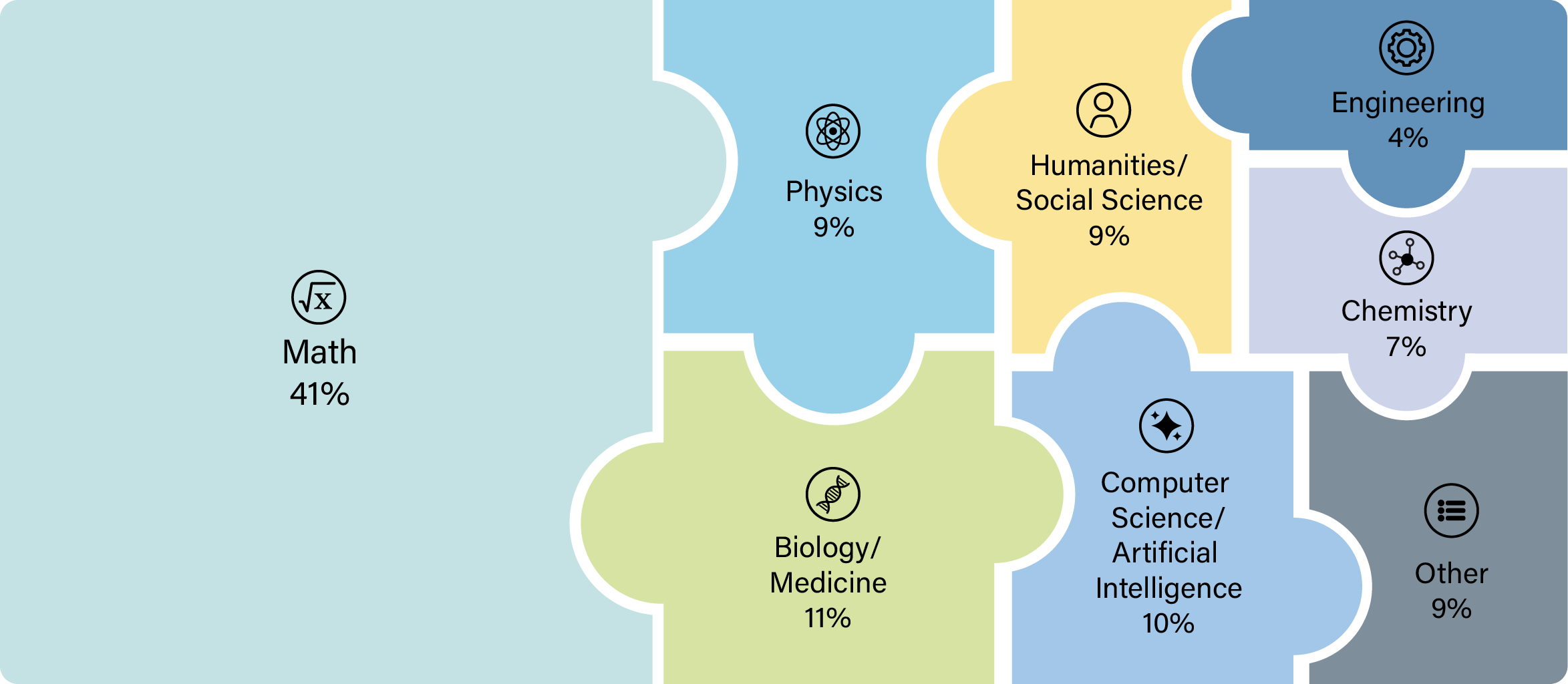

OpenAI GPT-5 Demonstra Capacidades Inovadoras em Pesquisa Científica : O modelo GPT-5 da OpenAI ultrapassou um limiar importante, com cientistas utilizando-o com sucesso para realizar pesquisas originais em áreas como matemática, física, biologia e ciência da computação. Este avanço indica que o GPT-5 não apenas responde a perguntas, mas também pode guiar e executar explorações científicas complexas, acelerando enormemente o processo de pesquisa. Alguns pesquisadores afirmam que, após o lançamento do GPT-5 Thinking e do GPT-5 Pro, não consultá-los para pesquisa científica não é mais razoável. (Fonte: tokenbender)

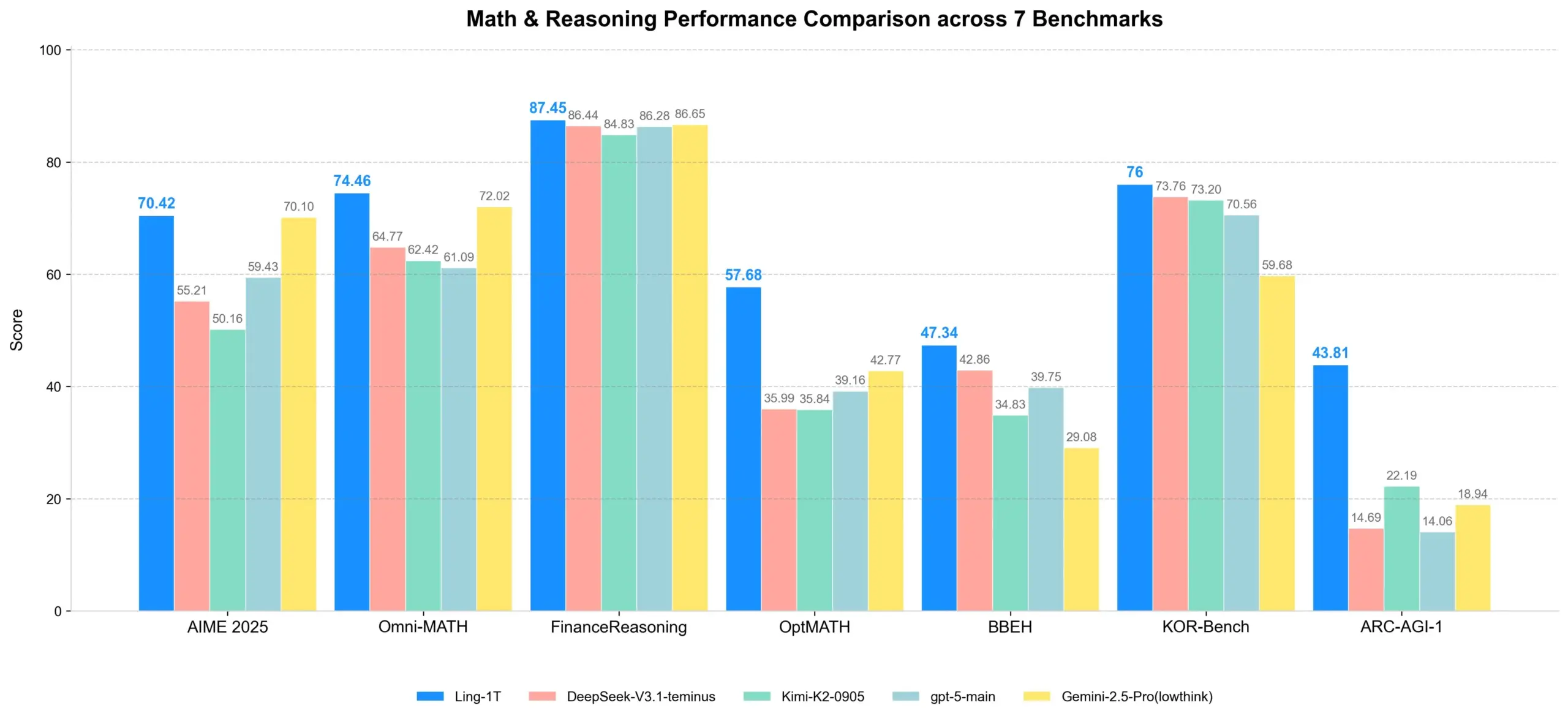

Ling-1T: Lançamento de Modelo de Inferência de Código Aberto com Trilhões de Parâmetros : Ling-1T, o modelo carro-chefe da série Ling 2.0, possui um total de 1 trilhão de parâmetros, com aproximadamente 50 bilhões de parâmetros ativos por token, e foi treinado em mais de 20 trilhões de tokens intensivos em inferência. O modelo alcança inferência escalável através do currículo Evo-CoT e Linguistics-Unit RL, demonstrando um forte equilíbrio entre eficiência e precisão em tarefas de inferência complexas. Ele também possui compreensão visual avançada e capacidade de geração de código front-end, e pode realizar o uso de ferramentas com uma taxa de sucesso de cerca de 70%, marcando um novo marco na inteligência de código aberto de trilhões de parâmetros. (Fonte: scaling01, TheZachMueller)

Meta Ray-Ban Display Redefine Interação Humano-Computador e Aprendizagem : Os óculos inteligentes Meta Ray-Ban Display integram funções de aprendizagem e tradução no uso diário, oferecendo experiências de “tradução invisível” e “aprendizagem visual instantânea”. Legendas de conversas são exibidas diretamente nas lentes, e os usuários podem obter informações relevantes apenas olhando para pontos de referência ou obras de arte. Além disso, o controle por gestos é possível através da Neural Band, permitindo a operação sem a necessidade de um telefone. Esta tecnologia promete remodelar a forma como interagimos com o mundo, aprendemos e nos conectamos, marcando um novo começo para a computação centrada no ser humano. (Fonte: Ronald_vanLoon)

🧰 Ferramentas

Synthesia Lança Copilot, Capacitando Edição Profissional de Vídeos com IA : A Synthesia lançou o Copilot, um editor de vídeo profissional com IA. Esta ferramenta pode escrever roteiros rapidamente, conectar bases de conhecimento e recomendar inteligentemente materiais visuais, como ter um colega que entende profundamente o negócio e a plataforma Synthesia. O Copilot visa simplificar o processo de produção de vídeo, reduzir o limiar para a criação de vídeo profissional e fornecer soluções de vídeo com IA eficientes e personalizadas para empresas e criadores de conteúdo. (Fonte: synthesiaIO, synthesiaIO)

GLIF Agent Utiliza Sora 2 para Recriar e Personalizar Vídeos Virais : A GLIF desenvolveu um Agent capaz de recriar qualquer vídeo viral usando o modelo Sora 2. O Agent primeiro analisa o vídeo original e, em seguida, gera prompts detalhados com base na análise. Os usuários podem colaborar com o Agent para personalizar os prompts, criando assim vídeos gerados por IA altamente personalizados. Esta tecnologia promete fornecer poderosas capacidades de produção e recriação de vídeo nos campos de criação de conteúdo e marketing. (Fonte: fabianstelzer)

Cloudflare AI Search e GroqInc Lançam Modelo de “Chat de Documentos” : O Cloudflare AI Search (anteriormente AutoRAG) colaborou com a GroqInc para lançar um novo modelo de código aberto de “chat de documentos”. Este modelo combina o motor de inferência da Groq com o AI Search, permitindo que os usuários adicionem facilmente recursos de IA conversacional a documentos, possibilitando perguntas e respostas e interações em tempo real com o conteúdo do documento. Esta integração aumentará a eficiência da recuperação de documentos e da obtenção de informações. (Fonte: JonathanRoss321)

HuggingFace Lança Recurso de Edição GGUF no Navegador : O HuggingFace agora suporta a edição direta de metadados de modelos GGUF no navegador, sem a necessidade de baixar o modelo completo. Este recurso, implementado através da tecnologia Xet, suporta atualizações parciais de arquivos, simplificando enormemente o gerenciamento e o processo de iteração de modelos, e melhorando a eficiência do trabalho dos desenvolvedores na plataforma HuggingFace. (Fonte: reach_vb)

LangChain e LangGraph Lançam Versão Alpha v1.0, Solicitando Feedback de Desenvolvedores : LangChain e LangGraph lançaram a versão Alpha v1.0, introduzindo novas APIs de middleware de Agent, blocos de saída/conteúdo padrão e atualizações importantes de API. A equipe está convidando ativamente os desenvolvedores a testar a nova versão e fornecer feedback para aprimorar ainda mais sua estrutura de desenvolvimento de agentes de IA, impulsionando a construção de aplicativos de IA mais poderosos. (Fonte: LangChainAI)

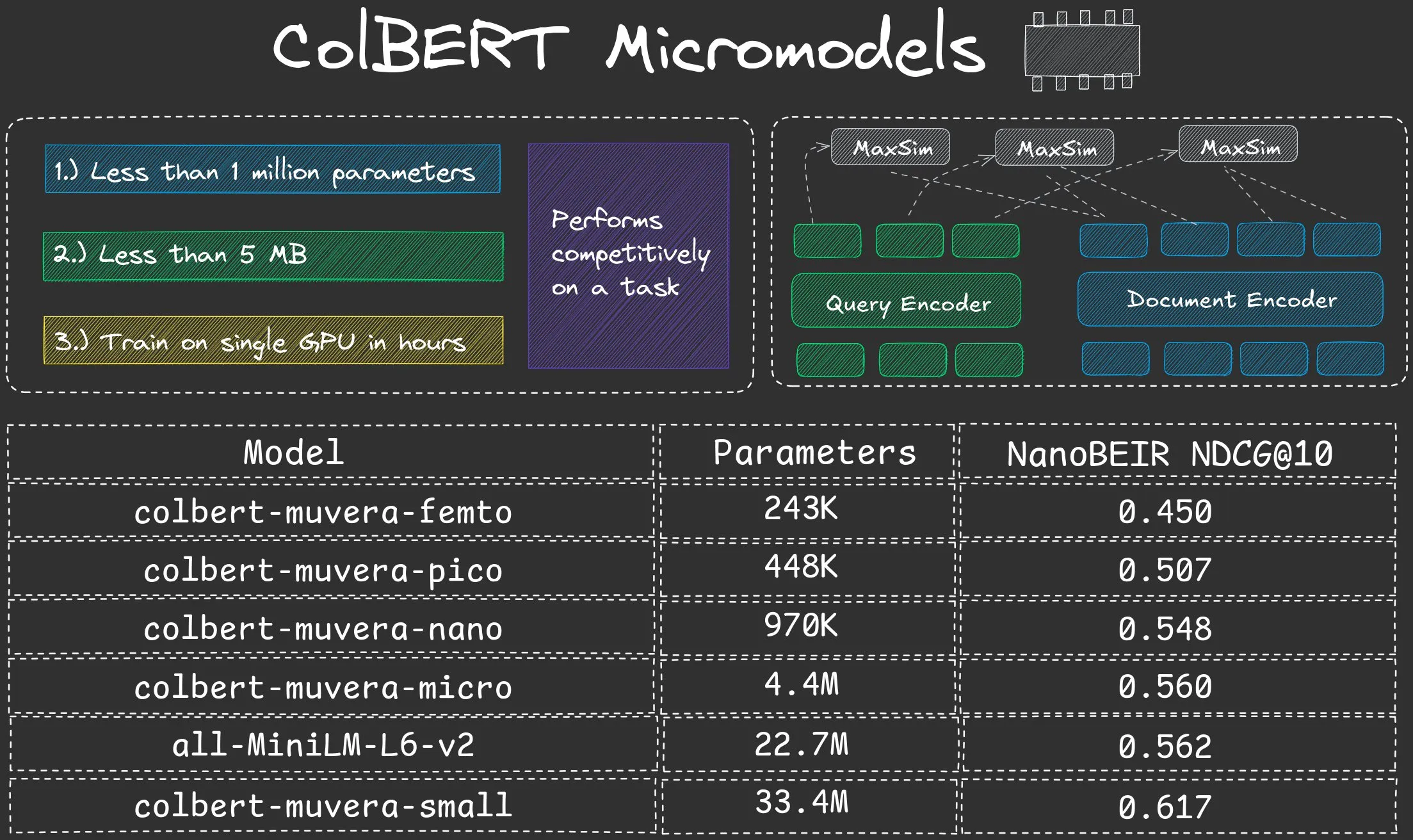

NeuML Lança Série ColBERT Nano de Modelos Minúsculos, com Menos de Um Milhão de Parâmetros : A NeuML lançou a série de modelos ColBERT Nano, todos com menos de 1 milhão de parâmetros (250K, 450K, 950K). Esses modelos minúsculos demonstraram um desempenho surpreendente no modo “Late interaction”, provando que mesmo modelos de escala extremamente pequena podem alcançar bons resultados em tarefas específicas, fornecendo soluções eficientes para implantações de IA em ambientes com recursos limitados. (Fonte: lateinteraction, lateinteraction)

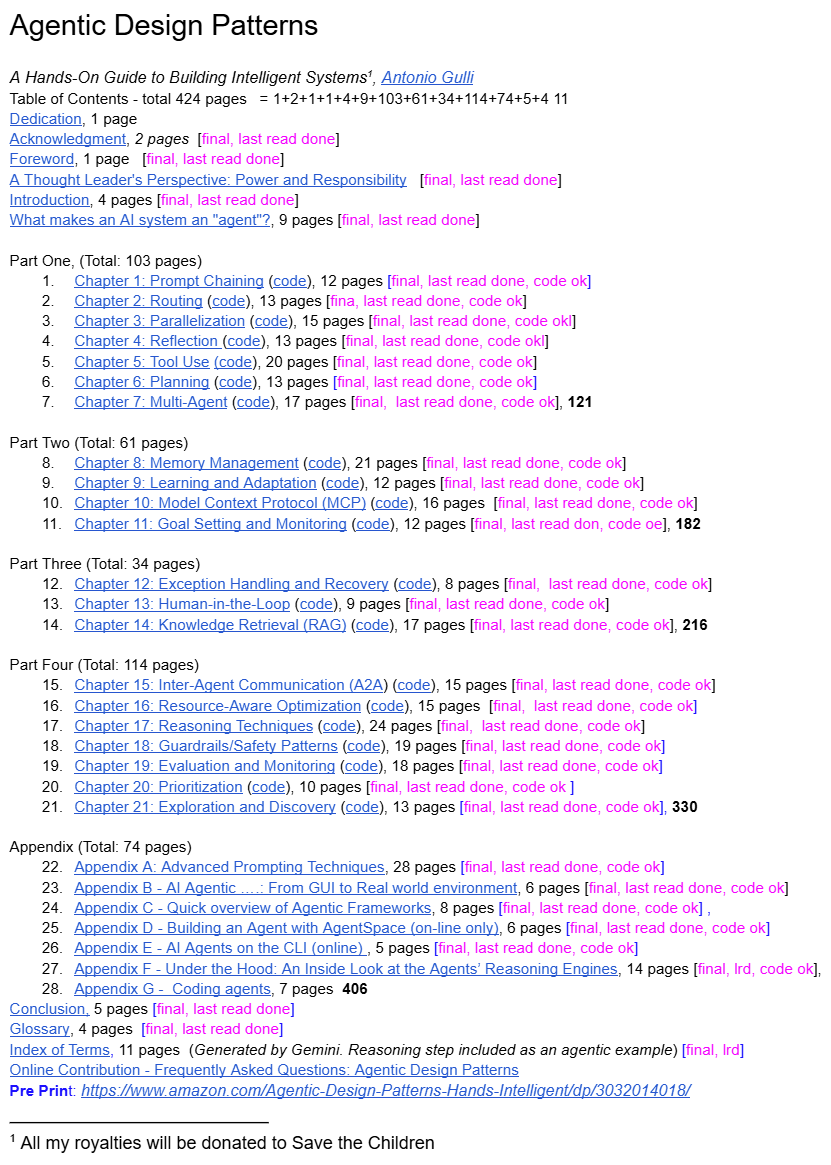

Diretor de Engenharia Sênior do Google Compartilha “Padrões de Design de Agentes” : Um diretor de engenharia sênior do Google compartilhou gratuitamente um livro sobre “Padrões de Design de Agentes”, trazendo o primeiro conjunto sistemático de princípios de design e melhores práticas para o campo em ascensão dos AI Agents. Este recurso visa ajudar os desenvolvedores a entender e construir melhor os agentes de IA, preenchendo uma lacuna na orientação sistemática neste campo e prometendo ser uma referência importante para os desenvolvedores de AI Agent. (Fonte: dotey)

📚 Aprendizagem

Estudo sobre Alucinações de LLM e Mecanismos de Alinhamento de Segurança: Das Origens Internas às Estratégias de Mitigação : Pesquisas revelam que modelos de inferência de LLM podem exibir um fenômeno de “penhasco de rejeição” antes de gerar a saída final, onde a intenção de rejeição diminui drasticamente. Através do framework DST, os pesquisadores revelaram que as alucinações se tornam inevitáveis em uma “camada de compromisso” específica do modelo e propuseram o pequeno modelo de inferência HalluGuard, que otimiza a mitigação de alucinações em RAG integrando sinais clínicos e dados, fornecendo explicações mecânicas e estratégias práticas para o alinhamento de segurança de LLM e mitigação de alucinações. (Fonte: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

ASPO Otimiza Aprendizado por Reforço de LLM, Resolvendo Problemas de Descasamento da Razão IS : ASPO (Asymmetric Importance Sampling Policy Optimization) é um novo método de pós-treinamento de LLM que aborda a falha fundamental do descasamento da razão de amostragem de importância (IS) de tokens de vantagem positiva no aprendizado por reforço tradicional. Ao inverter a razão IS de tokens de vantagem positiva e introduzir um mecanismo de recorte duplo suave, o ASPO pode atualizar tokens de baixa probabilidade de forma mais estável, mitigar a convergência precoce e melhorar significativamente o desempenho em benchmarks de codificação e raciocínio matemático. (Fonte: HuggingFace Daily Papers)

Fathom-DeepResearch: Sistema de Agentes para Recuperação e Síntese de Informações de Longo Ciclo : Fathom-DeepResearch é um sistema de agentes composto por Fathom-Search-4B e Fathom-Synthesizer-4B, projetado para tarefas complexas e abertas de recuperação de informações. Fathom-Search-4B, otimizado através de um conjunto de dados de auto-jogo multiagente e aprendizado por reforço, realiza pesquisa web em tempo real e consultas de página. Fathom-Synthesizer-4B, por sua vez, converte resultados de pesquisa de múltiplas rodadas em relatórios estruturados. O sistema se destaca em vários benchmarks e demonstra forte capacidade de generalização para tarefas de inferência como HLE e AIME-25. (Fonte: HuggingFace Daily Papers)

AgentFlow: Otimização de Sistemas de Agentes In-Flow para Planejamento Eficiente e Uso de Ferramentas : AgentFlow é um framework de agentes in-flow treinável que otimiza diretamente seu planejador em um ciclo de interação multi-rodadas, coordenando quatro módulos: planejador, executor, verificador e gerador. Ele emprega o Flow-based Group Refined Policy Optimization para resolver o problema de atribuição de crédito de recompensas esparsas e de longo ciclo. O AgentFlow, com um modelo backbone de 7B, supera as linhas de base SOTA em dez benchmarks, com uma melhoria significativa na precisão média em tarefas de pesquisa, agentes, matemática e ciência, superando até mesmo o GPT-4o. (Fonte: HuggingFace Daily Papers)

Estudo Sistemático do Impacto dos Dados de Código na Capacidade de Inferência de LLM : A pesquisa explora sistematicamente, através de um framework centrado em dados, como os dados de código aprimoram a capacidade de inferência de LLM. Ao construir um conjunto de dados de instruções paralelas em dez linguagens de programação e aplicar perturbações estruturais ou semânticas, descobriu-se que os LLMs são mais sensíveis a perturbações estruturais do que semânticas, especialmente em tarefas de matemática e código. Pseudocódigo e fluxogramas são tão eficazes quanto o código, e o estilo sintático também afeta os ganhos específicos da tarefa (Python é benéfico para inferência de linguagem natural, Java/Rust para matemática). (Fonte: HuggingFace Daily Papers)

DeepEvolve: Agente de Descoberta de Algoritmos Científicos que Funde Pesquisa Profunda e Evolução Algorítmica : DeepEvolve é um agente que combina pesquisa profunda com evolução algorítmica, descobrindo algoritmos científicos através de recuperação de conhecimento externo, edição de código entre arquivos e depuração de sistema, em um ciclo iterativo impulsionado por feedback. Ele não apenas propõe novas hipóteses, mas também as refina, implementa e testa, evitando melhorias superficiais e refinamentos excessivos ineficazes. Em nove benchmarks em química, matemática, biologia, materiais e patentes, o DeepEvolve aprimora continuamente os algoritmos iniciais, gerando novos algoritmos executáveis e obtendo ganhos contínuos. (Fonte: HuggingFace Daily Papers)

Roteiro de Aprendizagem e Conceitos Essenciais de AI/ML : A comunidade compartilhou um roteiro abrangente de aprendizagem para IA, Machine Learning e Deep Learning, cobrindo vários aspectos, desde conceitos básicos até técnicas avançadas (como AI Agent, parâmetros de geração de LLM). Esses recursos visam fornecer orientação de aprendizagem estruturada para profissionais que desejam entrar ou aprofundar seus conhecimentos na área de AI/ML, ajudando-os a dominar as habilidades de todo o processo, desde o desenvolvimento do modelo até a implantação e operação, e a entender como a IA impulsiona a transformação da indústria. (Fonte: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Benchmarks de IA e Recursos de Aprendizagem: HLE, Conferências e Gerenciamento de Custos de GPU : A comunidade discutiu vários recursos de aprendizagem e prática de IA. O CAIS lançou o benchmark “Humanity’s Last Exam” atualizado dinamicamente para se adaptar à melhoria do desempenho do modelo. Além disso, foram fornecidos guias para participar de conferências de Machine Learning e estratégias de desenvolvimento de LLM de baixo custo, incluindo GPUs pagas sob demanda e execução de modelos pequenos localmente. Além disso, a realização do GPU Mode Hackathon ofereceu uma plataforma para desenvolvedores aprenderem e trocarem conhecimentos. (Fonte: clefourrier, Reddit r/MachineLearning, Reddit r/MachineLearning, Reddit r/MachineLearning, danielhanchen)

OneFlow: Modelos de Geração Concorrente de Modalidade Mista e Intercalada : OneFlow é o primeiro modelo multimodal não autorregressivo que suporta geração de modalidade mista de comprimento variável e concorrente. Ele combina um fluxo de edição inserível para tokens de texto discretos e um fluxo de correspondência para espaços latentes de imagem. OneFlow alcança síntese concorrente texto-imagem através de amostragem hierárquica, priorizando o conteúdo em vez da gramática. Experimentos mostram que OneFlow supera as linhas de base autorregressivas em tarefas de geração e compreensão, reduzindo os FLOPs de treinamento em até 50%, e desbloqueia novas capacidades de geração concorrente, refinamento iterativo e geração de estilo inferencial natural. (Fonte: HuggingFace Daily Papers)

Equilibrium Matching: Framework de Modelagem Generativa Baseado em Modelos de Energia Implícitos : Equilibrium Matching (EqM) é um novo framework de modelagem generativa que abandona a dinâmica não-equilibrada e condicionada ao tempo dos modelos tradicionais de difusão e fluxo, optando por aprender gradientes de equilíbrio de paisagens de energia implícitas. O EqM adota um processo de amostragem baseado em otimização, amostrando na paisagem aprendida através de descida de gradiente, alcançando um desempenho SOTA de FID 1.90 no ImageNet 256×256 e lidando naturalmente com tarefas como denoising parcial, detecção OOD e síntese de imagem. (Fonte: HuggingFace Daily Papers)

💼 Negócios

OpenAI e AMD Fecham Acordo de Parceria em Chips, Desafiando o Domínio da NVIDIA : A OpenAI e a AMD assinaram um acordo de parceria em chips de cinco anos, avaliado em bilhões de dólares, com o objetivo de desafiar o domínio da NVIDIA no mercado de chips de IA. Esta medida faz parte da estratégia da OpenAI para diversificar o fornecimento de chips, tendo a empresa já estabelecido uma parceria com a NVIDIA. Este acordo destaca a enorme demanda da indústria de IA por hardware de computação de alto desempenho e a busca por diversidade na cadeia de suprimentos. (Fonte: MIT Technology Review)

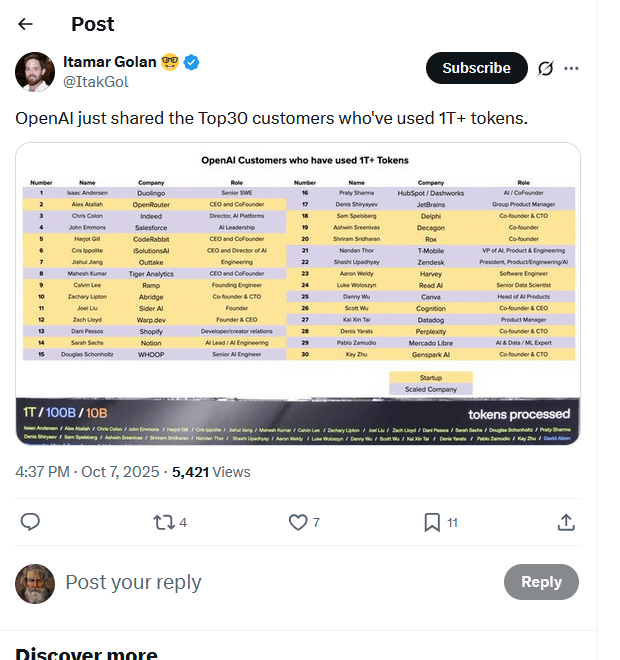

Lista de Principais Clientes da OpenAI Vazada, 30 Empresas Consomem Trilhões de Tokens : Uma lista supostamente dos principais clientes da OpenAI circulou online, mostrando que 30 empresas processaram mais de 1 trilhão de Tokens através de seus modelos. Esta lista (incluindo Duolingo, OpenRouter, Salesforce, Canva, Perplexity, entre outros) revela a rápida formação da economia de inferência de IA e demonstra quatro tipos principais de construtores nativos de IA, integradores de IA, provedores de infraestrutura de IA e provedores de soluções verticais de IA. O volume de consumo de Tokens é considerado um novo benchmark para medir o valor real e o progresso dos negócios das aplicações de IA. (Fonte: Reddit r/ArtificialInteligence, 量子位)

Singapura se Torna Porto Seguro de Direitos Autorais para Desenvolvimento de IA, Atraindo Empresas Globais de IA : Singapura modificou sua Lei de Direitos Autorais, introduzindo uma cláusula de defesa de análise computacional que estipula claramente que a análise de dados computacionais realizada para melhorar sistemas de IA é protegida por isenção de violação de direitos autorais, e até impede a cobertura contratual. Esta medida visa transformar Singapura no local mais atraente globalmente para o desenvolvimento de modelos de IA, atraindo investimentos e inovação, em contraste com a abordagem cautelosa de regiões como Europa e EUA em relação aos direitos autorais de IA. Embora o escopo da proteção se limite a Singapura, ela oferece uma garantia importante para o desenvolvimento de modelos fundamentais. (Fonte: Reddit r/ArtificialInteligence)

🌟 Comunidade

Transações de Financiamento da Indústria de IA e Preocupações com Bolha : Surgiram nas redes sociais questionamentos sobre as transações de financiamento na indústria de IA, com a percepção de que muitas transações parecem mais tentativas de inflacionar artificialmente os preços das ações do que baseadas em valor real. Alguns comentários apontam que muitos produtos de IA não têm visto aplicação prática em mercados locais ou regionais, e as empresas, ao contrário, reclamam da ineficácia dos produtos de IA. Esse fenômeno é interpretado como especulação de mercado em vez de formação real de capital e efeitos de transbordamento. Ao mesmo tempo, há discussões sobre a aplicação de gêmeos digitais de IA no marketing, questionando se é “hype ou futuro”. (Fonte: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

Censura de Conteúdo do ChatGPT e Controvérsia sobre Experiência do Usuário : Usuários do ChatGPT reclamam que a censura de conteúdo da plataforma é excessivamente rigorosa, chegando a marcar pedidos simples de receitas ou abraços entre personagens como “conteúdo sexualmente sugestivo”, enquanto é insensível a conteúdo violento. Os usuários acreditam que o ChatGPT se tornou “lixo” e “superprotetor”, questionando se a OpenAI perdeu seus excelentes funcionários. Ao mesmo tempo, usuários também relataram problemas de renderização de LaTeX no aplicativo ChatGPT. Isso levou alguns usuários a cancelar suas assinaturas, pedindo à OpenAI que pare de sufocar a criatividade. (Fonte: Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, jeremyphoward)

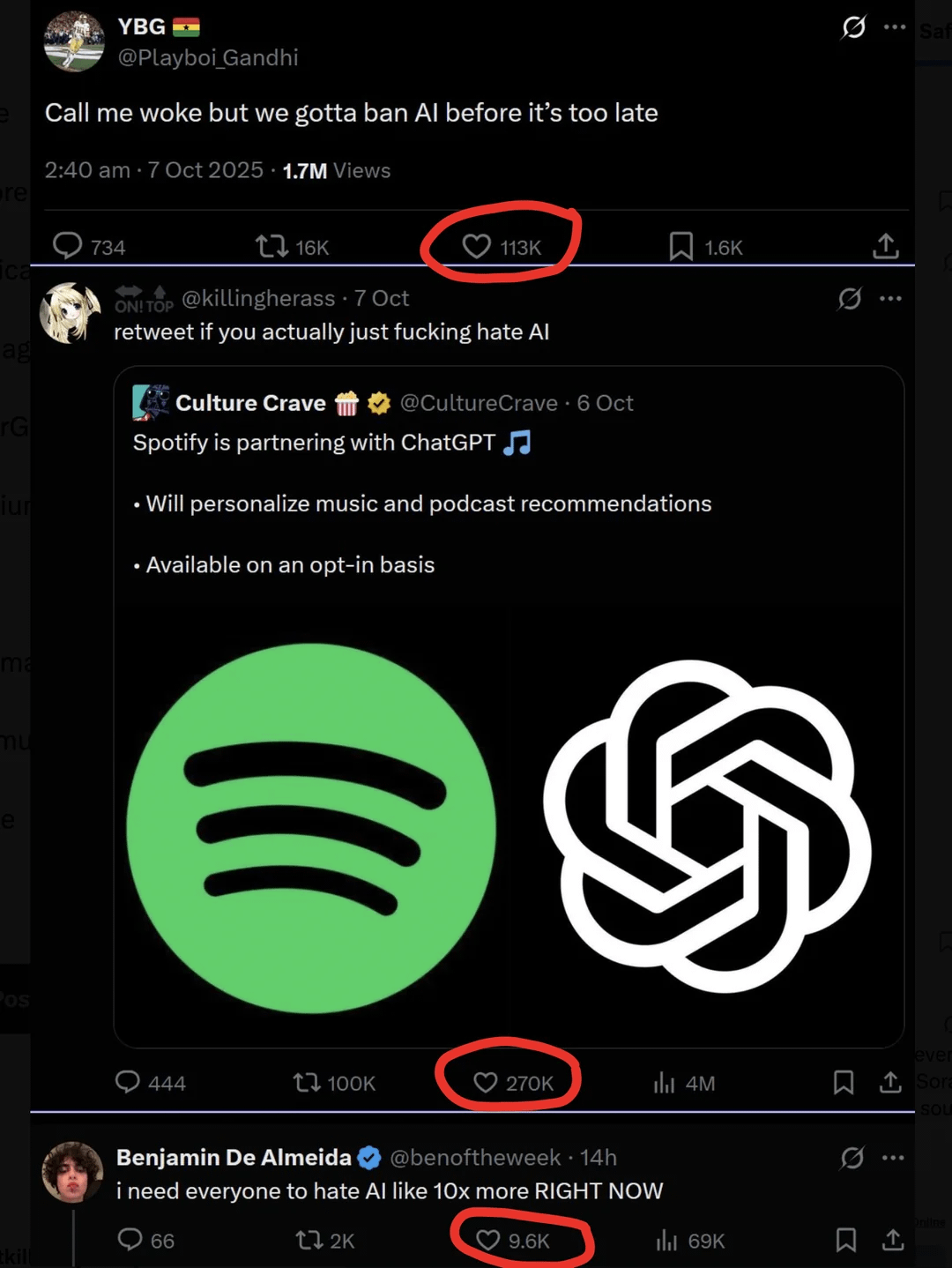

Reação Negativa ao Conteúdo de IA e Preocupações dos Criadores : Com a crescente popularidade do conteúdo gerado por IA, surgiu um forte sentimento anti-IA na sociedade, especialmente nas áreas de arte e criatividade. Criadores renomados como o YouTuber MrBeast expressaram preocupações de que os vídeos de IA possam ameaçar o sustento de milhões de criadores. Fãs de Taylor Swift também criticaram seus vídeos promocionais gerados por IA como “baratos e grosseiros”. Essa reação reflete a ansiedade dos criadores sobre o impacto da tecnologia de IA nas indústrias tradicionais, bem como a preocupação com a qualidade e autenticidade do conteúdo. (Fonte: Reddit r/artificial, MIT Technology Review)

Dilemas e Perspectivas da Aplicação da IA em Jogos : A comunidade discutiu as características poderosas, criativas, interessantes e dinâmicas da tecnologia de IA, mas questionou por que nenhum jogo popular a utilizou amplamente até agora. Alguns acreditam que a IA já é amplamente usada no desenvolvimento, mas o custo de executar modelos de IA localmente é alto, e os desenvolvedores de jogos tendem a controlar a narrativa. Outros argumentam que os desenvolvedores se concentram apenas em grandes títulos tradicionais, negligenciando novas ideias. Isso reflete os desafios técnicos, de custo e criativos que a IA enfrenta na implementação em jogos. (Fonte: Reddit r/artificial)

Perplexity Destaca a Utilidade da Pesquisa com IA Através do Caso de Uso de Cristiano Ronaldo : O superastro do futebol Cristiano Ronaldo usou a ferramenta de pesquisa de IA Perplexity ao preparar seu discurso para o Prestige Globe Award. Ele afirmou que o Perplexity o ajudou a entender o significado do prêmio e a superar o nervosismo. Este evento foi amplamente divulgado pela Perplexity oficial e pelas redes sociais, destacando o valor prático da pesquisa de IA em fornecer informações rápidas e precisas, bem como seu potencial de promoção através do efeito celebridade. (Fonte: AravSrinivas, AravSrinivas)

Pesquisa de IA do Google Recebe Prêmio Nobel e Controvérsias Relacionadas : O Google recebeu três Prêmios Nobel em dois anos, incluindo Demis Hassabis (AlphaFold) e Geoff Hinton (IA). Esta conquista é vista como um reflexo do investimento de longo prazo e da ambição do Google em pesquisa. No entanto, Jürgen Schmidhuber questionou o Prêmio Nobel de Física de 2024 por plágio, argumentando que seus resultados se sobrepõem fortemente a pesquisas anteriores e não foram devidamente citados, gerando discussões sobre ética acadêmica e atribuição no campo da IA. (Fonte: Yuchenj_UW, SchmidhuberAI, SchmidhuberAI)

Demanda por Computação de IA e Debate Filosófico sobre Caminhos para AGI/ASI : Em relação aos vastos recursos computacionais necessários para a geração de vídeo por IA, alguns argumentam que esse enorme investimento em computação, impulsionado por necessidades reais, na verdade indica que a Inteligência Artificial Geral (AGI) e a Superinteligência Artificial (ASI) ainda são fantasias distantes. Essa discussão reflete a reflexão da indústria sobre o caminho de desenvolvimento da IA, ou seja, se o sucesso atual da IA em aplicações específicas desviará recursos e atrasará a realização de objetivos mais ambiciosos. Ao mesmo tempo, Richard Sutton enfatiza que a essência da aprendizagem é o comportamento ativo do agente, e não o treinamento passivo. (Fonte: fabianstelzer, Plinz, dwarkesh_sp)

Impacto da IA no Mercado de Trabalho: Salário por Hora de Anotadores de Dados com Doutorado Diminui : Discussões nas redes sociais apontam que, devido à superoferta de anotadores de dados com doutorado, seu salário por hora caiu de US$ 100/hora para US$ 50/hora. Anteriormente, a OpenAI havia contratado doutores para anotação de dados por US$ 100/hora. Esse fenômeno reflete a intensificação da concorrência no mercado de anotação de dados de IA e as mudanças na demanda por talentos de anotação de dados de alta qualidade. (Fonte: teortaxesTex)

Ferramentas de Engenharia de Software Assistidas por IA Recebem Financiamento e Impacto na Carreira : A Relace, uma startup focada em fornecer ferramentas para engenheiros de software impulsionados por IA, levantou US$ 23 milhões em uma rodada de financiamento da Série A liderada pela Andreessen Horowitz. Isso marca a extensão da cadeia de ferramentas de IA para áreas mais profundas de desenvolvimento autônomo de IA. Ao mesmo tempo, engenheiros discutiram como as ferramentas de codificação de IA estão mudando sua forma de trabalhar, argumentando que, embora sejam proficientes no uso de ferramentas de IA, a criatividade humana e a capacidade de resolução de problemas ainda são valores centrais. (Fonte: steph_palazzolo, kylebrussell)

Ascensão e Queda do Fenômeno Cultural Vibe Coding : As redes sociais discutiram a ascensão e queda do conceito “Vibe Coding”. Alguns acreditam que Vibe Coding é uma forma de programar em um ambiente descontraído, mas outros argumentam que ele “morreu”. Discussões relacionadas também mencionaram “Bob Ross vibe coding” e outros conteúdos gerados por IA, refletindo a exploração e reflexão da comunidade de desenvolvedores sobre a cultura de programação e os métodos de programação assistida por IA. (Fonte: arohan, Ronald_vanLoon, nptacek)

💡 Outros

Governo dos EUA Pode Cancelar Financiamento de Bilhões de Dólares para Fábricas de Captura de Carbono : O Departamento de Energia dos EUA pode encerrar o financiamento de bilhões de dólares para duas grandes fábricas de captura direta de carbono do ar. Esses projetos estavam originalmente programados para receber mais de US$ 1 bilhão em subsídios governamentais, mas atualmente enfrentam um status de “término”. Embora o Departamento de Energia afirme que nenhuma decisão final foi tomada e já tenha encerrado mais de 200 projetos para economizar US$ 7,5 bilhões, essa incerteza levantou preocupações na indústria sobre o desenvolvimento da tecnologia climática dos EUA e a competitividade internacional. (Fonte: MIT Technology Review)

Novos Avanços em Tecnologia Robótica: De Pulsos Flexíveis a Besouros Biônicos e Robôs Humanoides : O campo da tecnologia robótica alcançou múltiplos avanços. Novos pulsos robóticos paralelos permitem movimentos flexíveis e semelhantes aos humanos em espaços confinados, melhorando a precisão da operação. Ao mesmo tempo, pesquisadores estão desenvolvendo besouros robóticos biônicos com mochilas, destinados a serem usados em missões de busca e resgate em desastres. Além disso, relatórios mostraram robôs humanoides interagindo com motocicletas, demonstrando a capacidade da tecnologia biônica em simular o comportamento humano. Esses avanços impulsionam coletivamente os limites da tecnologia robótica em adaptabilidade a ambientes complexos e interação humano-máquina. (Fonte: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)