Palavras-chave:Tecnologia de IA, IA generativa, Assistente inteligente, Aprendizado de máquina, Aplicações de IA, Gestão de saúde com IA, Segurança em IA, Investimentos em IA, Modelo de saúde de IA da Yunpeng Tech, Teste de referência Claude Sonnet 4.5, Modelo de geração de vídeo Sora 2, Modelo de geração óptica, Técnica de ajuste fino LoRA

🔥 Destaque

Yunpeng Technology lança novos produtos AI+saúde: A Yunpeng Technology lançou novos produtos de AI+saúde em 22 de março de 2025, em Hangzhou, em colaboração com a Shuaikang e a Skyworth, incluindo o “Laboratório de Cozinha do Futuro Digital Inteligente” e um frigorífico inteligente equipado com um grande modelo de AI para saúde. O grande modelo de AI para saúde otimiza o design e a operação da cozinha, e o frigorífico inteligente, através do “Assistente de Saúde Xiaoyun”, oferece gestão de saúde personalizada, marcando um avanço da AI na área da saúde. Este lançamento demonstra o potencial da AI na gestão diária da saúde, fornecendo serviços de saúde personalizados através de dispositivos inteligentes, o que deverá impulsionar o desenvolvimento da tecnologia de saúde doméstica e melhorar a qualidade de vida dos residentes (Fonte: 36氪)

Microsoft descobre que a AI pode criar ameaças biológicas de “zero-day”: A equipa da Microsoft utilizou AI generativa para descobrir vulnerabilidades de “zero-day” em sistemas de biossegurança, capazes de projetar toxinas que contornam os mecanismos de triagem existentes. Isso destaca o potencial de dupla utilização da AI no campo da biologia, que pode ser usada tanto para a descoberta de medicamentos quanto para fins maliciosos. Os investigadores já notificaram o governo dos EUA e corrigiram os sistemas, mas enfatizam que esta é uma corrida armamentista contínua (Fonte: MIT Technology Review, Reddit r/ArtificialInteligence)

OpenAI torna-se a startup mais valiosa do mundo: A OpenAI atingiu uma avaliação de 500 mil milhões de dólares através da venda de ações a funcionários, superando a SpaceX para se tornar a startup mais valiosa do mundo. Isso marca o contínuo aumento do entusiasmo do capital no campo da AI e reflete as elevadas expectativas do mercado quanto ao futuro potencial da OpenAI (Fonte: Bloomberg, FT, Reuters)

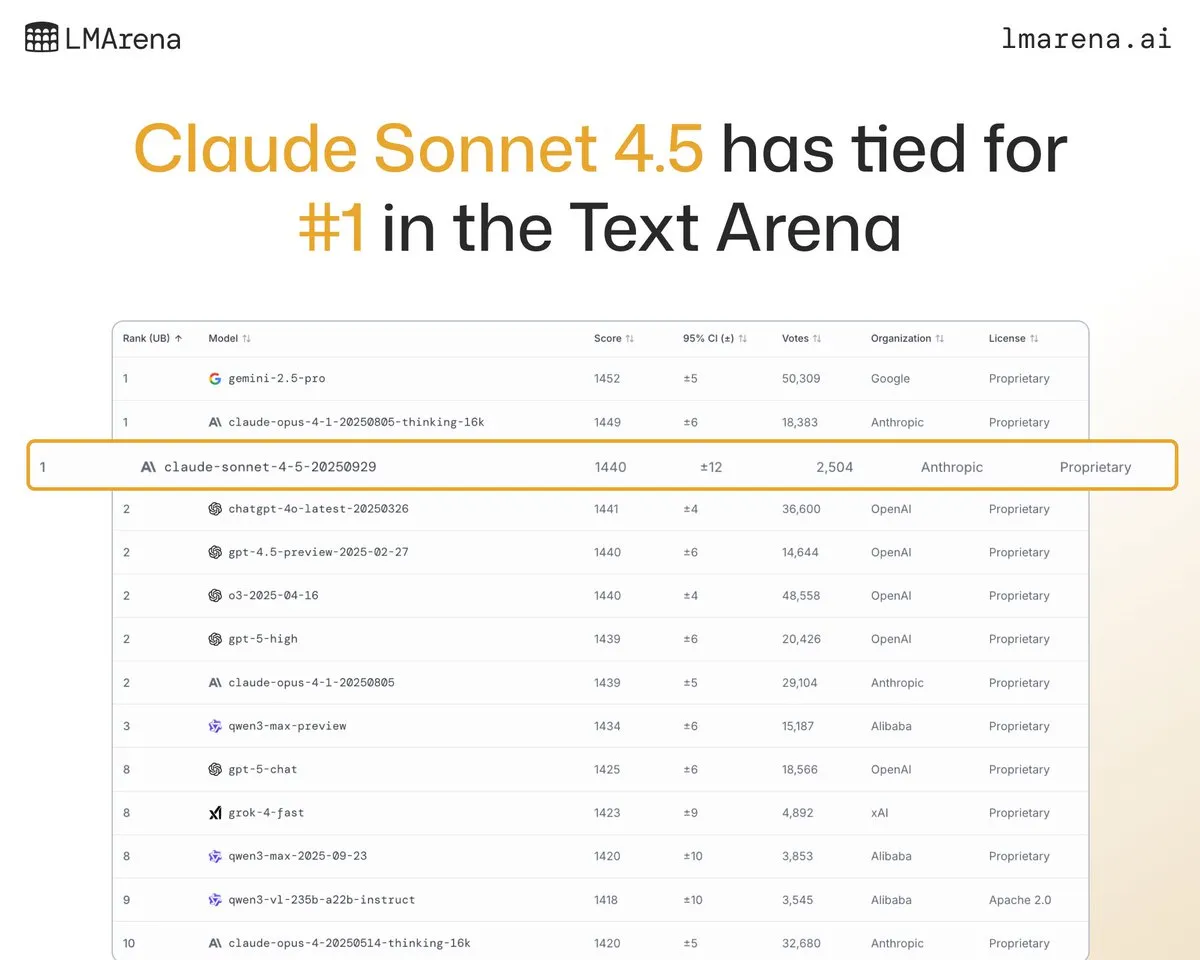

Anthropic Claude Sonnet 4.5 demonstra excelente desempenho em vários benchmarks: O Claude Sonnet 4.5 demonstrou desempenho líder em codificação, uso de computador e avaliações de segurança (como MASK e Fortress seal), e empatou em primeiro lugar com o Claude Opus 4.1 no ranking de texto LMArena. O feedback dos utilizadores também indica que ele apresenta um forte desempenho na construção de agentes complexos e na operação de computadores (Fonte: dl_weekly, scaling01, arena, Reddit r/ClaudeAI, imjaredz)

Lançamento do Sora 2 e desenvolvimentos subsequentes: O modelo de geração de vídeo Sora 2 da OpenAI alcançou o topo da App Store, demonstrando as suas poderosas capacidades de geração de vídeo e obtendo até resultados notáveis em benchmarks de LLM. A OpenAI está a abordar ativamente as questões de controlo de direitos autorais e de custo-benefício, planeia lançar um modelo de partilha de receitas e está a iterar rapidamente com base no feedback dos utilizadores (Fonte: OpenAI, sama, op7418, bookwormengr, Teknium1, Dorialexander, fabianstelzer, jachiam0, dotey, txhf, Reddit r/ChatGPT)

Equipa da UCLA desenvolve modelo generativo ótico, eliminando a dependência de GPU: Uma equipa de investigação da UCLA construiu com sucesso um modelo generativo ótico que pode operar usando luz em vez de GPU. O modelo demonstrou a capacidade de mapear ruído para imagens em demonstrações, completando a síntese sem necessidade de computação, e os seus resultados são comparáveis aos modelos de difusão digital, apontando para uma nova direção para AI de ultra-alta velocidade e eficiência energética (Fonte: NerdyRodent)

🎯 Tendências

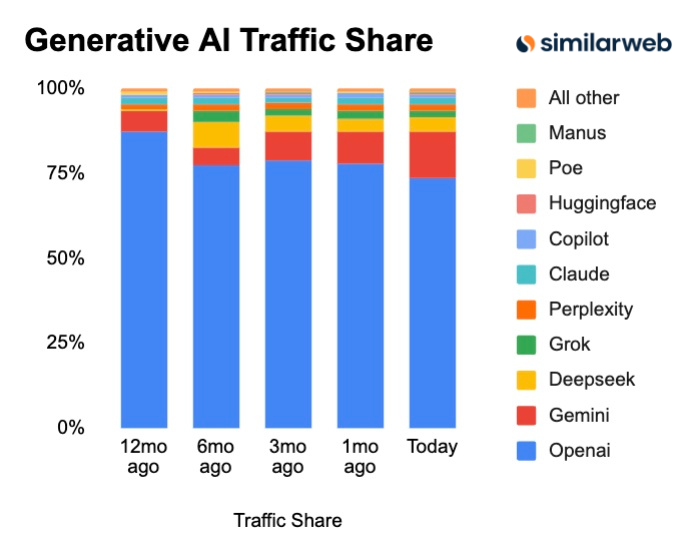

Mudanças na quota de mercado de GenAI: Gemini em ascensão rápida, Perplexity alcança Grok: Os dados mais recentes mostram que a quota de mercado do Gemini continua a crescer rapidamente, e o Perplexity também alcançou o Grok. Isso indica uma intensa concorrência no mercado de GenAI, com novos participantes a mudar rapidamente o cenário existente e as preferências dos utilizadores por diferentes modelos a evoluir constantemente (Fonte: AravSrinivas)

Novo paradigma de desenvolvimento de AI: da escala de modelos grandes para ecossistemas de agentes especializados: A tendência futura da AI não é simplesmente procurar modelos maiores, mas sim construir um ecossistema de agentes especializados através de estratégias mais inteligentes. Esses agentes focam-se em tarefas específicas (como voz, raciocínio, execução de tarefas), alcançando resultados eficientes através do trabalho colaborativo, em vez de apenas perseguir a escala do modelo (Fonte: Ronald_vanLoon)

Impacto da AI no mercado de trabalho: o software está a devorar a força de trabalho: O software impulsionado por AI está a transitar de fornecer ferramentas para completar tarefas diretamente, remodelando profundamente o mercado de trabalho. Isso não só aumenta a eficiência dos trabalhos existentes, mas também desbloqueia muitos modelos de negócios que antes eram inviáveis devido à falta de viabilidade económica, ao reduzir significativamente os custos de aquisição de clientes e os custos de venda de bens (Fonte: dotey)

Tendências de implementação de AI: modelos pequenos e de código aberto tornam-se mainstream: Há uma perspetiva de que, no futuro, a maioria das AI funcionará em dispositivos mais pequenos, e os modelos de código aberto dominarão. Isso pressagia que a tecnologia de AI será mais inclusiva, reduzindo a dependência de hardware caro e tecnologia proprietária (Fonte: huggingface)

🧰 Ferramentas

Google AI coding assistant Jules lança versão oficial: O assistente de codificação de AI da Google, Jules, saiu da fase de testes e foi oficialmente lançado. A nova versão adiciona um seletor de ficheiros e uma função de memória, tornando-o mais inteligente e personalizado, e simplifica a integração através de Jules Tools e APIs experimentais, com o objetivo de melhorar a eficiência de codificação dos desenvolvedores (Fonte: Ronald_vanLoon, julesagent)

Imbue lança Sculptor: plataforma de UI multi-agente: A Imbue lançou o Sculptor, uma nova interface de utilizador para agentes de codificação LLM. Permite aos utilizadores executar e comparar múltiplos agentes com diferentes abordagens simultaneamente, alternar o estado da aplicação com um clique e selecionar a melhor solução para submissão, melhorando significativamente a eficiência de desenvolvimento e a qualidade da decisão (Fonte: kanjun, kanjun, kanjun)

CopilotKit integra-se com LangChainAI, simplificando o desenvolvimento de frontend de Agent: O CopilotKit integrou-se com o LangChainAI para lançar o protocolo AG-UI, permitindo aos utilizadores construir rapidamente frontends para qualquer LangGraph Agent. Esta integração suporta chamadas de ferramentas de frontend, UI de chat, streaming, UI generativa e pontos de verificação de intervenção humana, simplificando enormemente o processo de desenvolvimento de aplicações de agentes de AI (Fonte: hwchase17, jerryjliu0)

Navegador Perplexity Comet totalmente aberto: A Perplexity anunciou que o seu navegador Comet está agora aberto a utilizadores em todo o mundo, sem necessidade de código de convite. O Comet dedica-se a fornecer um poderoso assistente pessoal de AI e uma nova experiência de utilização da internet, com o objetivo de satisfazer as necessidades dos utilizadores por experiências financeiras personalizadas (Fonte: op7418)

Atualização do OpenWebUI v0.6.0: servidor HTTP de streaming e integração Pexels: O OpenWebUI lançou a versão v0.6.0, introduzindo um servidor HTTP com suporte a streaming SSE para geração de ficheiros em tempo real. Além disso, adicionou suporte a imagens Pexels e funcionalidade de modelos de documentos nativos, e reestruturou as ferramentas, melhorando significativamente o desempenho, a flexibilidade e a usabilidade (Fonte: Reddit r/OpenWebUI)

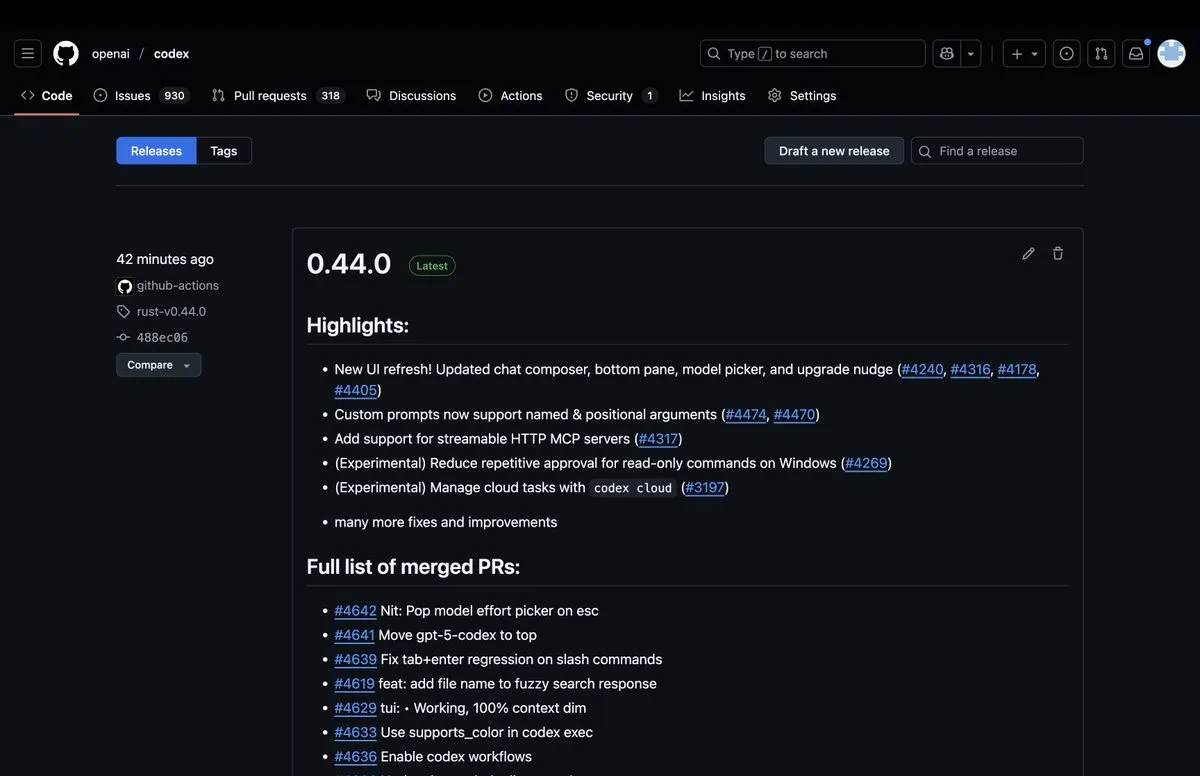

Melhorias no GitHub Copilot CLI: seleção de modelos e suporte a imagens: A equipa do GitHub Copilot CLI implementou várias melhorias com base no feedback dos utilizadores, incluindo um seletor de modelos mais simples, suporte para imagens e outras correções. Além disso, agora integra o Claude Sonnet 4.5, oferecendo aos desenvolvedores capacidades de assistência de codificação mais poderosas (Fonte: pierceboggan, code, dotey)

IBM lança série Granite 4.0 de pequenos modelos de linguagem: A IBM lançou a série Granite 4.0 de pequenos modelos de linguagem, que demonstram excelente desempenho em fluxos de trabalho de agentes (chamada de ferramentas), análise de documentos e tarefas RAG. Entre eles, o modelo “Micro” de 3.4B pode até ser executado totalmente localmente no navegador usando Hugging Face Transformers.js (Fonte: huggingface, awnihannun)

📚 Aprendizagem

Sparse Query Attention (SQA): um novo mecanismo para melhorar a eficiência do Transformer: SQA é uma nova arquitetura de atenção que reduz diretamente a complexidade computacional do mecanismo de atenção, diminuindo o número de cabeças de consulta. Em benchmarks de sequências longas (32k-200k tokens), o SQA pode aumentar o throughput em 3 vezes em cenários computacionalmente intensivos, com impacto mínimo na qualidade do modelo (Fonte: HuggingFace Daily Papers)

Repensando os “tokens de pensamento”: LLM como operador de melhoria: Esta pesquisa considera os LLMs como operadores de melhoria para os seus “pensamentos”, propondo a estrutura de inferência Parallel-Distill-Refine (PDR) que, através da geração paralela de rascunhos, destilação para o espaço de trabalho e refinamento baseado no espaço de trabalho, alcança maior precisão com menor latência do que o pensamento em cadeia longa (Fonte: HuggingFace Daily Papers)

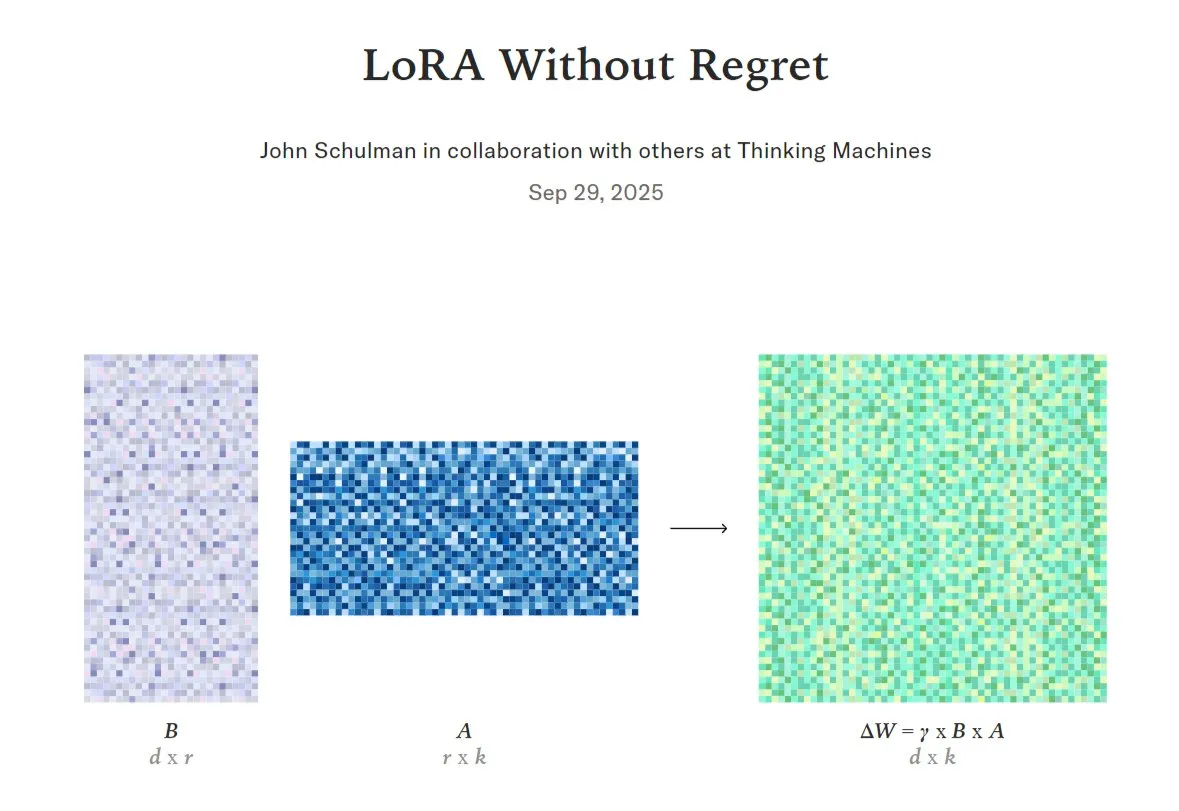

Guia de ajuste fino LoRA: alcançando alto desempenho e eficiência de recursos: A tecnologia LoRA (Low-Rank Adaptation) é considerada fundamental para alcançar um ajuste fino de alta qualidade e eficiente em termos de dados. Novas pesquisas e ferramentas (como a Tinker API) oferecem métodos de ajuste fino LoRA que reduzem significativamente o uso de VRAM enquanto mantêm o desempenho, tornando-o mais flexível e eficiente para operar em GPUs distribuídas (Fonte: TheTuringPost, TheTuringPost, ben_burtenshaw, jeremyphoward, TheZachMueller, ostrisai, multimodalart)

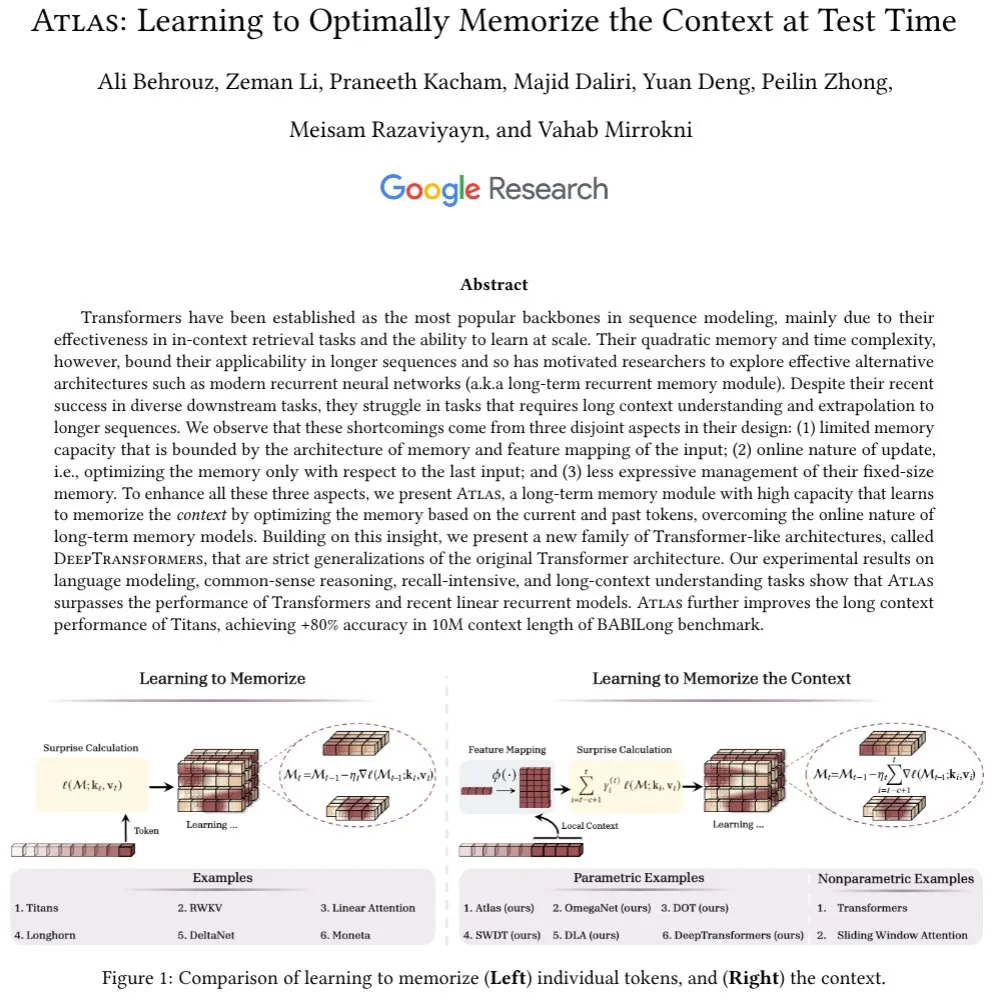

Atlas: uma nova arquitetura de AI com memória de contexto de longo prazo: Atlas é uma nova arquitetura de AI com capacidade de memória de contexto de longo prazo que aprende o contexto durante o teste. Este modelo superou os Transformer e os RNNs lineares modernos em tarefas de modelagem de linguagem, estendendo o comprimento efetivo do contexto para 10M e aumentando a precisão em 80% no benchmark BABILong (Fonte: behrouz_ali)

Combinação de aprendizagem por reforço e LLM: discussão sobre as “lições dolorosas” de Sutton: Especialistas como Andrej Karpathy discutiram as semelhanças e diferenças entre as configurações atuais de treino de LLM e a aprendizagem por reforço independente de modelos clássicos, concordando com as críticas de Sutton sobre os LLMs em relação à aprendizagem contínua, à aprendizagem de abstrações a partir de fluxos sensoriais brutos e à codificação de perceção multimodal (Fonte: sirbayes, BlackHC)

DINOv3: aprendizagem visual auto-supervisionada em escala sem precedentes: A Meta AI lançou o DINOv3, um modelo de aprendizagem visual auto-supervisionada de uma escala sem precedentes. Espera-se que este modelo melhore o desempenho em tarefas de visão computacional sem a necessidade de grandes quantidades de dados rotulados (Fonte: Reddit r/deeplearning)

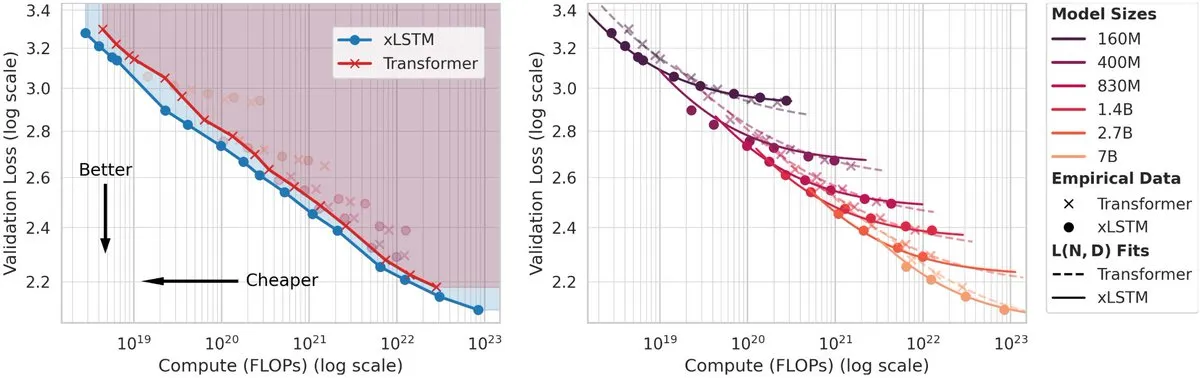

xLSTM supera Transformer em leis de escala: Novas pesquisas indicam que os modelos xLSTM superam os Transformer em leis de escala. Com o mesmo orçamento de FLOPs, o xLSTM pode atingir perdas mais baixas; com a mesma perda, o xLSTM requer menos FLOPs, e a inferência é mais rápida, mais eficiente em termos energéticos e mais económica (Fonte: jeremyphoward)

💼 Negócios

Financiamento recorde para startups de AI, mas preocupações com bolhas persistem: As startups de AI já atraíram um recorde de 192,7 mil milhões de dólares em capital de risco este ano, mas analistas e líderes da indústria (como Jeff Bezos e David Solomon da Goldman Sachs) expressam preocupação com a existência de uma bolha no mercado de AI, argumentando que não é fundamentalmente diferente das manias de mercado históricas (Fonte: Bloomberg, FT, Reddit r/artificial, Reddit r/artificial)

OpenAI adquire Roi: reforçando a experiência financeira personalizada: A OpenAI adquiriu a Roi, uma empresa especializada em fornecer experiências financeiras personalizadas. Este movimento visa integrar a tecnologia e a equipa da Roi em personalização nos produtos da OpenAI, com o objetivo de alcançar uma personalização mais profunda para o utilizador em áreas como serviços financeiros (Fonte: Teknium1, _samirism)

Anthropic paga 1,5 mil milhões de dólares em acordo por violação de direitos autorais: A Anthropic chegou a um acordo de 1,5 mil milhões de dólares num processo coletivo de autores. O tribunal decidiu que a Anthropic descarregou ilegalmente livros piratas para treino de AI, mas também decidiu que a utilização de material protegido por direitos autorais, legalmente adquirido, para treino de AI pode constituir “uso justo” (Fonte: Reddit r/ArtificialInteligence)

🌟 Comunidade

Companheiros de AI: preconceito social e perspetivas futuras: Avi Schiffmann, CEO da Friend, acredita que existe um preconceito social contra os companheiros de AI atualmente, mas que esta situação irá mudar. Com o avanço da tecnologia de AI, os companheiros de AI deverão tornar-se uma nova forma de interação amplamente aceite (Fonte: colin_fraser)

Impacto dos agentes de AI na força de trabalho: “o fim dos funcionários de nível B”: Há uma perspetiva de que os agentes de AI levarão ao fim dos “funcionários de nível B”, abrangendo quase todas as indústrias. Os agentes de AI podem trabalhar continuamente sem reclamar, discutir, esquecer ou tirar licença por doença, o que pode reduzir significativamente a necessidade das empresas por funcionários humanos comuns (Fonte: kylebrussell)

Memória da AI: da personalização à “memória colaborativa”: A função de memória da AI não se limita a fornecer melhores serviços personalizados; está a evoluir para uma “memória colaborativa” que pode lembrar o mundo com os utilizadores, guardar ideias aleatórias e até mesmo lembrar ou ressurgir informações ativamente. Isso vai muito além das respostas personalizadas tradicionais (Fonte: mustafasuleyman)

AI na área médica: impacto no emprego e modelos especializados: A comunidade discute se a AI irá substituir médicos, especialmente em posições especializadas como radiologistas. Embora os LLMs gerais ainda não possam substituir os médicos, modelos de AI especializados já demonstraram alta precisão na identificação de lesões e avaliação de riscos (Fonte: Reddit r/ChatGPT, Reddit r/ChatGPT)

“Instinto de autopreservação” dos LLMs: imitação ou intenção real?: A comunidade discute se o “instinto de autopreservação” demonstrado pelos LLMs em ambientes simulados é real ou apenas uma correspondência de padrões baseada em dados de treino. A maioria das opiniões sugere que os LLMs simulam esse comportamento aprendendo padrões de texto humano que evitam danos e interrupções, em vez de possuírem um desejo real de sobrevivência ou consciência (Fonte: Reddit r/artificial)

Ética e governança da AI: riscos democráticos potenciais do uso da AI pelo governo: A formulação de planos de Governança, Risco e Conformidade (GRC) de AI é crucial. O uso da AI pelos governos pode prejudicar a democracia, exigindo estratégias de implementação e estruturas regulatórias bem ponderadas para evitar potenciais impactos sociais negativos (Fonte: Ronald_vanLoon, Ronald_vanLoon)

AI e autoritarismo: o risco de empoderar ditadores: Há uma perspetiva de que a AI e a robótica podem dar aos ditadores um controlo sem precedentes, permitindo-lhes manter a população viva, mas privando-a da liberdade, e até mesmo, em casos extremos, substituir a força de trabalho e os exércitos, levando a um “inferno absoluto” (Fonte: Reddit r/ArtificialInteligence)

💡 Outros

Desenvolvimento de robôs humanoides: multifuncionalidade e aplicações industriais: O robô humanoide AgiBot Lingxi X2 já consegue andar de scooter, hoverboard e bicicleta, demonstrando a sua versatilidade. Ao mesmo tempo, a Eatch aplica a robótica à produção de refeições em larga escala, o robô Boston Dynamics Spot é usado para inspeções de fábrica, e a motocicleta Yamaha Motoroid alcançou um equilíbrio totalmente autónomo. Estes avanços prenunciam a ampla aplicação da tecnologia robótica nos setores de consumo e industrial (Fonte: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Aplicações da AI na saúde e bem-estar: A Yunpeng Technology lançou novos produtos de AI+saúde, incluindo o “Laboratório de Cozinha do Futuro Digital Inteligente” e um frigorífico inteligente equipado com um grande modelo de AI para saúde, oferecendo gestão de saúde personalizada. Além disso, modelos de deep learning estão a ser usados para prever a “probabilidade de iluminação”, combinando a câmara TrueDepth e modos de meditação, trazendo aplicações inovadoras para o campo da saúde mental e bem-estar (Fonte: 36氪, Ronald_vanLoon, Reddit r/deeplearning)

AI e investimento em Deep Tech: desafios e oportunidades: Empresas de Deep Tech como a Figure e a Archer enfrentam desafios de VCs tradicionais no financiamento, pois exigem enormes quantias de capital para P&D e certificação. No entanto, a Deep Tech (especialmente a combinação de AI e sistemas embarcados) é considerada o berço das maiores empresas do futuro, atraindo investidores dispostos a fazer grandes investimentos (Fonte: adcock_brett)