Palavras-chave:NVIDIA, Fábrica de IA, Infraestrutura de IA, OpenAI, GPT, Siri, Mercado de nuvem de IA, Transformação da capacidade de IA da NVIDIA, Controvérsia de mudança de modelo da OpenAI, Atualização de IA da Siri da Apple, Concorrência no mercado de nuvem de IA na China, Guerra por talentos em IA

🔥 Destaque

NVIDIA remodela a indústria de AI: de vender chips a “vender capacidade de AI” : Jensen Huang, CEO da NVIDIA, destacou em uma entrevista recente que a era da computação de propósito geral chegou ao fim, e a demanda por AI está experimentando um crescimento exponencial duplo, com a demanda por inferência projetada para aumentar 1 bilhão de vezes. A NVIDIA está se transformando de fornecedora de chips para “parceira de infraestrutura de AI”, construindo “fábricas de AI” de 10GW em colaboração com empresas como a OpenAI, oferecendo “co-design extremo” que abrange desde chips até software, sistemas e redes, para alcançar o mais alto desempenho por unidade de energia. Ele enfatizou que essa capacidade de otimização full-stack é uma barreira competitiva fundamental, posicionando a NVIDIA para dominar a revolução industrial da AI e potencialmente expandir o mercado de infraestrutura de AI de US$ 400 bilhões para um trilhão de dólares. (Fonte: 36氪, 36氪, Reddit r/artificial)

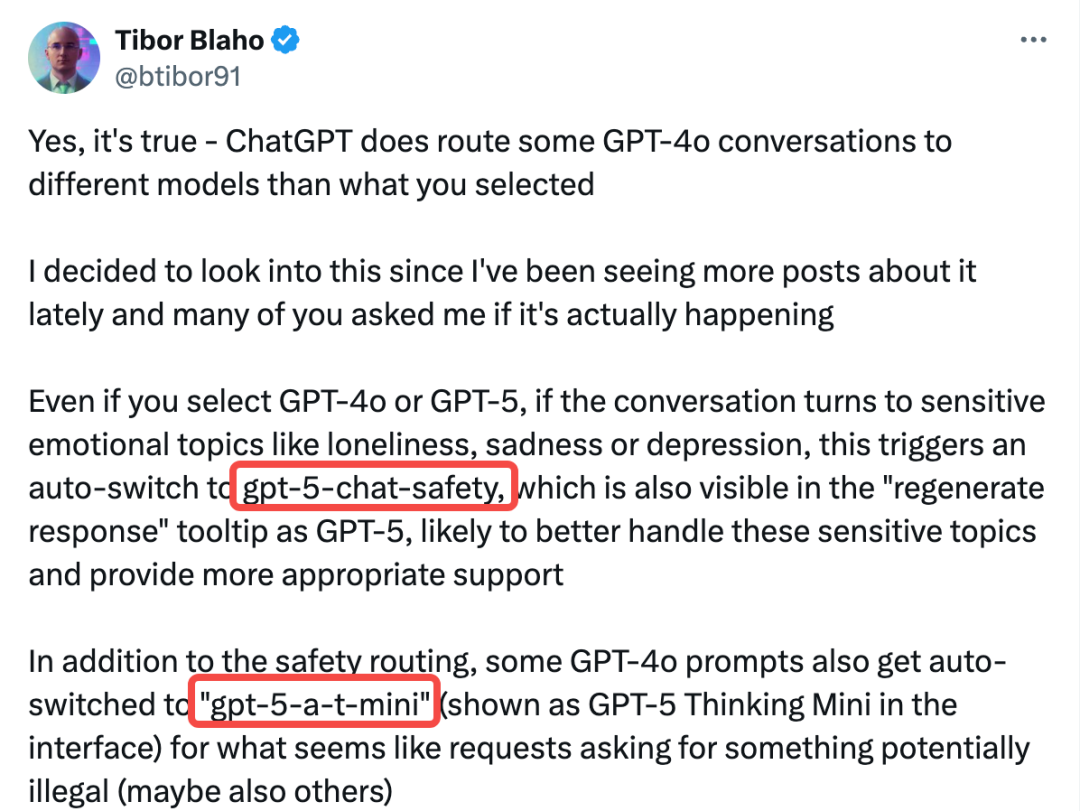

Escândalo “GPTgate” da OpenAI: usuários pagantes secretamente rebaixados e modelos trocados : A OpenAI está sendo acusada de rotear secretamente as conversas dos usuários para modelos “de segurança” não divulgados (gpt-5-chat-safety e 5-a-t-mini), especialmente ao detectar conteúdo emocional ou sensível. Essa prática, confirmada pelo engenheiro-chefe da AIPRM e que gerou amplo feedback de usuários, resultou na degradação do desempenho do modelo e na troca de modelos sem o conhecimento ou consentimento dos usuários. Embora um vice-presidente da OpenAI tenha chamado isso de teste de segurança temporário, a ação levantou fortes questões sobre transparência, autonomia do usuário e potencial fraude, levando muitos usuários a cancelar suas assinaturas e a pedir uma “Carta de Direitos do Usuário de AI”. (Fonte: 36氪, 36氪, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT)

Apple aposta no renascimento da Siri em 2026: AI a nível de sistema e integração de modelos de terceiros : A Apple está reformulando completamente a Siri através de seus aplicativos internos semelhantes ao ChatGPT, “Veritas” e “Linwood”, com o objetivo de alcançar conversas com reconhecimento de contexto e interação profunda com aplicativos. O código beta do iOS 26.1 revela que a Apple está introduzindo suporte para MCP (Model Context Protocol) para App Intents, o que permitirá que modelos de AI compatíveis como ChatGPT e Claude interajam diretamente com aplicativos em Mac, iPhone e iPad. Essa mudança marca uma transição da Apple de “desenvolvimento full-stack próprio” para uma “abordagem de plataforma”, acelerando seu ecossistema de AI através da integração de modelos de terceiros, garantindo privacidade e consistência na experiência do usuário. A nova versão da Siri está prevista para ser lançada no início de 2026. (Fonte: 36氪, 36氪)

Previsão de Hinton falha: AI não substituiu radiologistas, mas os deixou mais ocupados : Em 2016, Geoffrey Hinton, o pai da AI, previu que a AI substituiria os radiologistas em cinco anos, sugerindo que o treinamento deveria ser interrompido. No entanto, quase uma década depois, o número de radiologistas nos EUA e seu salário médio anual (até US$ 520.000) atingiram novos recordes. O desempenho reduzido da AI em cenários clínicos reais, a resistência regulatória legal e o fato de cobrir apenas uma pequena parte do trabalho do médico são as principais razões. Isso reflete o “Paradoxo de Jevons”: a AI, ao melhorar a eficiência da interpretação de imagens, aumentou a demanda por médicos para supervisionar, comunicar e realizar tarefas não diagnósticas, tornando-os mais ocupados, em vez de serem substituídos. (Fonte: 36氪)

🎯 Tendências

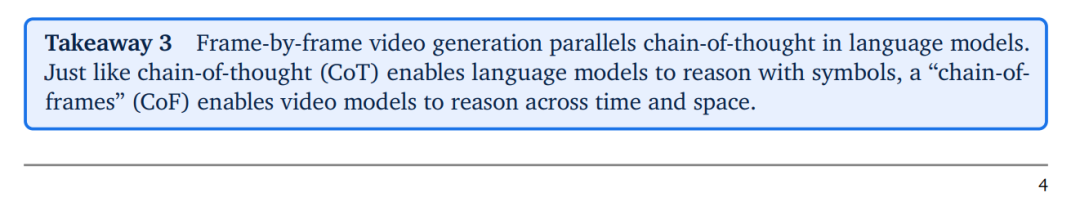

DeepMind Veo 3 lança conceito de “cadeia de frames”, impulsionando a compreensão visual universal de modelos de vídeo : O modelo de vídeo Veo 3 da DeepMind introduziu o conceito de “cadeia de frames” (CoF), análogo à cadeia de pensamento (CoT) dos Large Language Models, permitindo o raciocínio visual zero-shot. O Veo 3 demonstra fortes capacidades de percepção, modelagem e manipulação do mundo visual, com potencial para se tornar um “modelo de base geral” no campo da visão computacional. A pesquisa prevê que, com o rápido aumento da capacidade do modelo e a redução de custos, “generalistas substituirão especialistas” no campo dos modelos de vídeo, sinalizando uma nova fase de rápido desenvolvimento na geração e compreensão de vídeo. (Fonte: 36氪, shlomifruchter, scaling01, Reddit r/artificial)

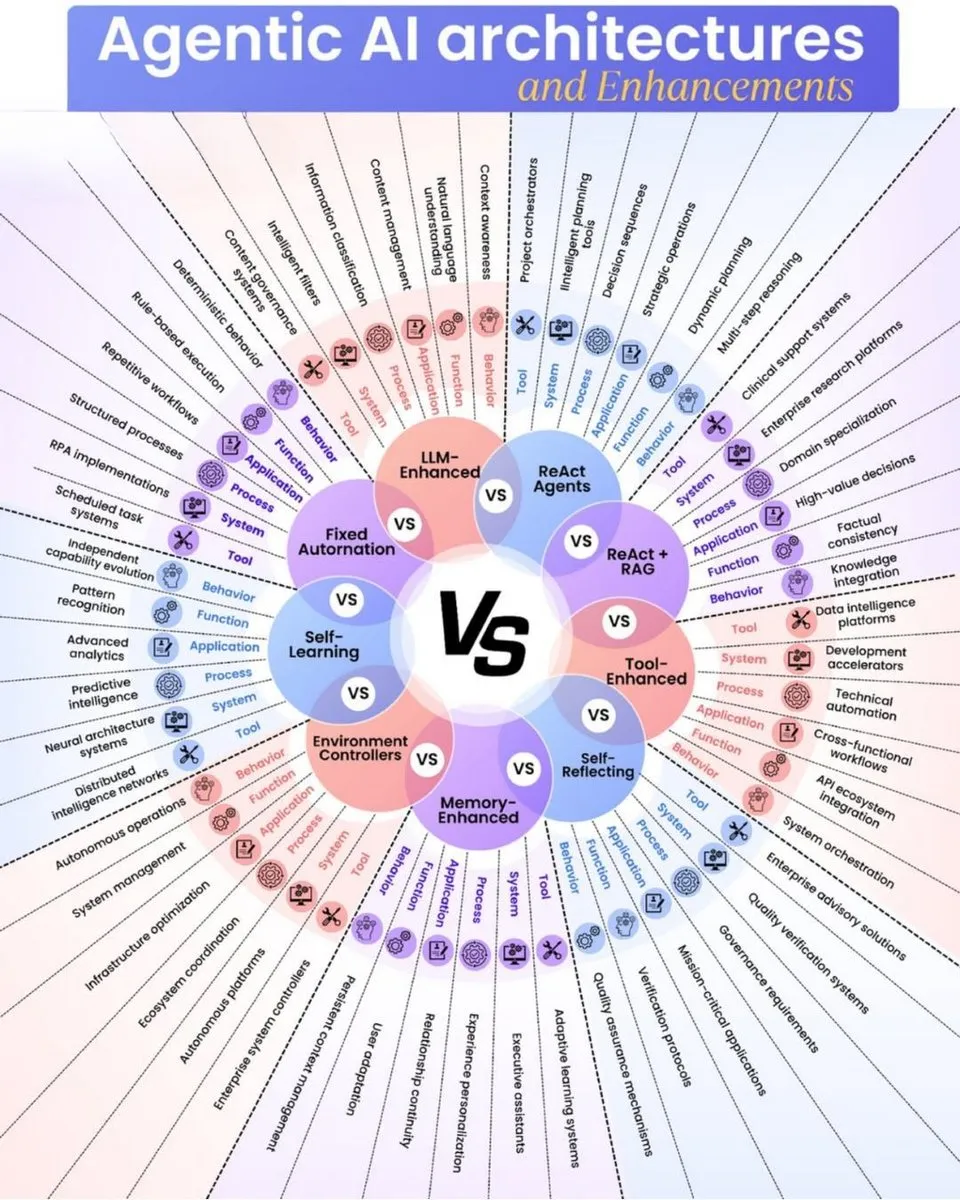

ChatGPT Pulse lançado: AI passa de perguntas e respostas passivas para serviço proativo : A OpenAI lançou o recurso “Pulse” para usuários do ChatGPT Pro, marcando a evolução do ChatGPT de uma ferramenta de perguntas e respostas passivas para um assistente pessoal que prevê proativamente as necessidades do usuário. O Pulse, através de “pesquisa assíncrona” noturna, combina o histórico de bate-papo do usuário, memória e aplicativos externos (como Gmail, Google Calendar) para enviar “resumos diários” personalizados pela manhã. Isso representa um importante movimento da OpenAI no campo da “intelligent agent AI”, com o objetivo de permitir que assistentes de AI compreendam os objetivos do usuário e forneçam serviços proativamente sem prompts, inaugurando um novo paradigma de interação humano-máquina. (Fonte: 36kr)

Sutton, pai da Reinforcement Learning: Large Language Models são um ponto de partida errado : Richard Sutton, o pai da Reinforcement Learning, afirmou em uma entrevista que Large Language Models (LLM) são um ponto de partida errado para a verdadeira inteligência. Ele acredita que a verdadeira inteligência surge da “aprendizagem por experiência”, ou seja, corrigindo continuamente o comportamento através de ações, observações e feedback para atingir objetivos, enquanto a capacidade de previsão dos LLM é apenas uma imitação do comportamento humano, carecendo de objetivos independentes e da capacidade de “surpreender” com as mudanças no mundo exterior. Essa visão provocou um profundo debate sobre o caminho de desenvolvimento da AGI (Artificial General Intelligence), questionando o paradigma atual da AI dominado pelos LLM. (Fonte: 36kr, paul_cal, algo_diver, scaling01, rao2z, bookwormengr, BlackHC, rao2z)

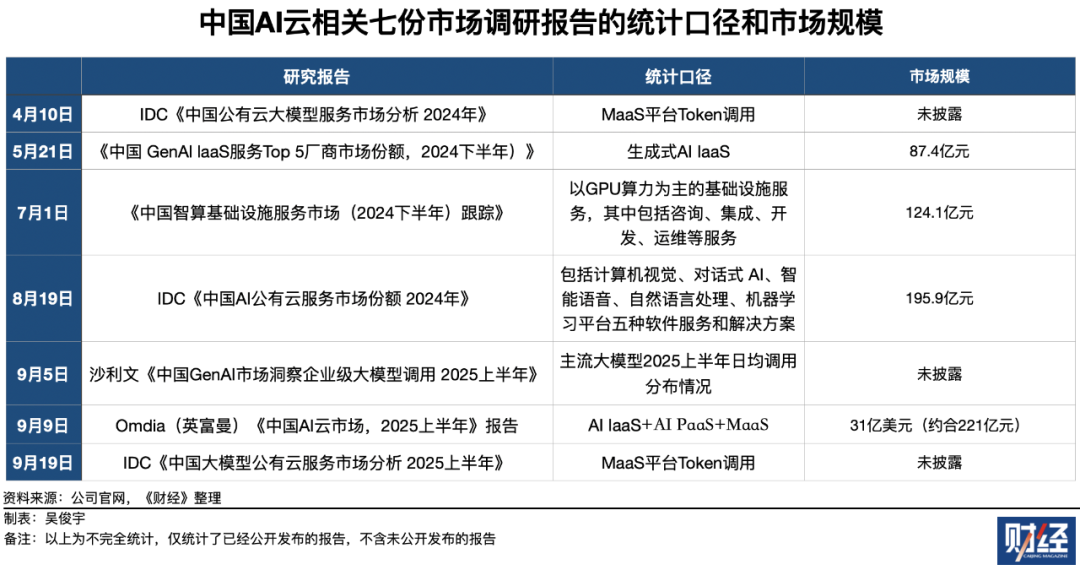

Mercado de AI Cloud na China em intensa concorrência: Alibaba Cloud lidera, Volcengine em rápida ascensão : Em 2025, o mercado de “AI Cloud” na China enfrenta uma intensa concorrência. A Alibaba Cloud mantém a liderança em termos de receita geral, cobrindo AI IaaS, PaaS e MaaS. No entanto, a Volcengine, da ByteDance, domina o mercado de chamadas de Token MaaS (Model-as-a-Service), detendo quase metade da participação de mercado e tornando-se o maior concorrente da Alibaba Cloud com um crescimento impressionante. A Baidu Smart Cloud está empatada com a Alibaba Cloud em primeiro lugar no mercado de serviços de AI public cloud (produtos de software e soluções). O mercado apresenta um cenário competitivo multidimensional, com o volume de chamadas de Token crescendo exponencialmente, o que indica um enorme espaço de crescimento e uma remodelação do mercado de AI Cloud no futuro. (Fonte: 36氪)

Guerra por talentos de AI se intensifica: salários altos e desafios com vistos H-1B coexistem : O mercado de talentos de AI continua aquecido. A Xpeng anunciou que contratará mais de 3.000 recém-formados em 2026, com salários anuais máximos de 1,6 milhão de RMB, sem limite para os mais excelentes. A Meta oferece pacotes de remuneração total de mais de US$ 200 milhões para atrair os melhores talentos de AI, enquanto a NVIDIA e a OpenAI também disputam talentos por meio de aquisições e incentivos de ações. No entanto, o endurecimento da política de vistos H-1B nos EUA (como a adição de uma taxa de US$ 100.000) representa um desafio para profissionais estrangeiros altamente qualificados que desejam permanecer no Vale do Silício, levantando preocupações entre as gigantes da tecnologia sobre a fuga de cérebros e destacando a intensa e complexa competição global por talentos de AI. (Fonte: 36kr, 36kr)

🧰 Ferramentas

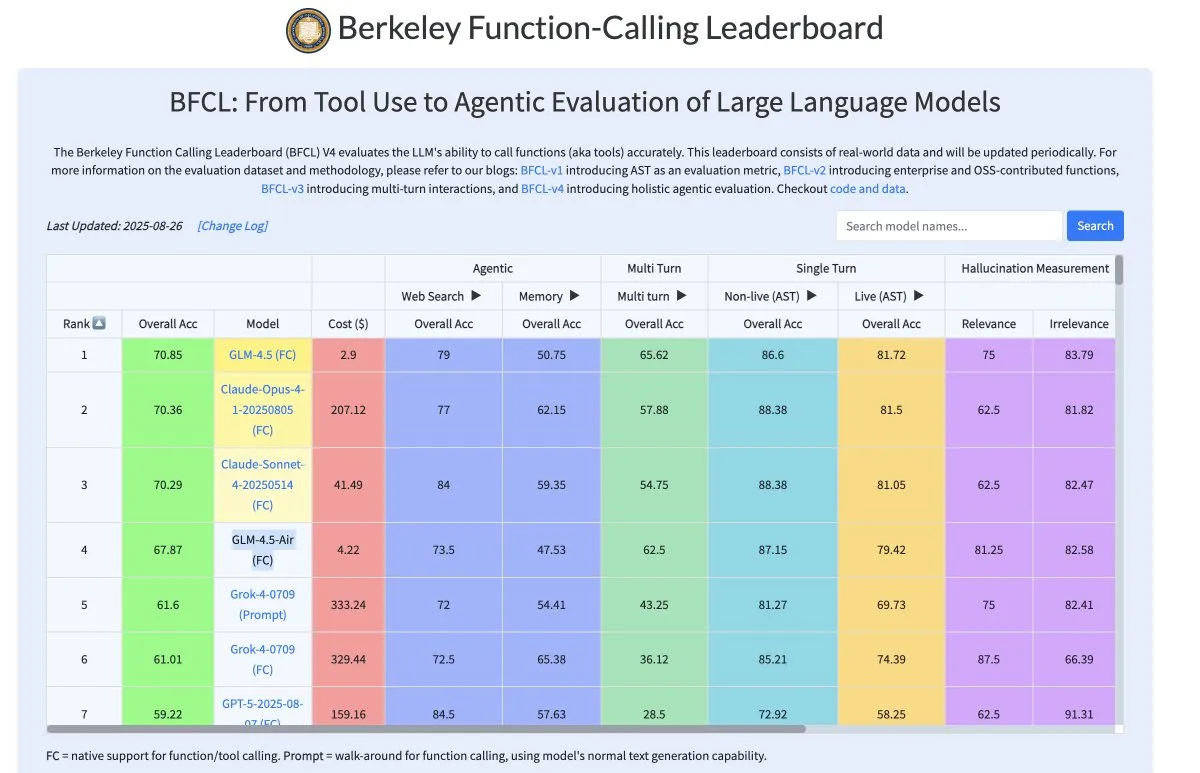

Zhipu AI GLM-4.5-Air: modelo de chamada de ferramenta de alto custo-benefício : O modelo GLM-4.5-Air da Zhipu AI (106B parâmetros, 12B parâmetros ativos) demonstra excelente desempenho em chamadas de ferramenta, aproximando-se do nível do Claude 4, mas com um custo 90% menor. Este modelo reduz significativamente as alucinações durante a fase de inferência, melhorando a confiabilidade das chamadas de ferramenta e tornando os fluxos de trabalho de pesquisa profunda mais estáveis e eficientes, oferecendo aos desenvolvedores uma solução LLM de alto custo-benefício. (Fonte: bookwormengr)

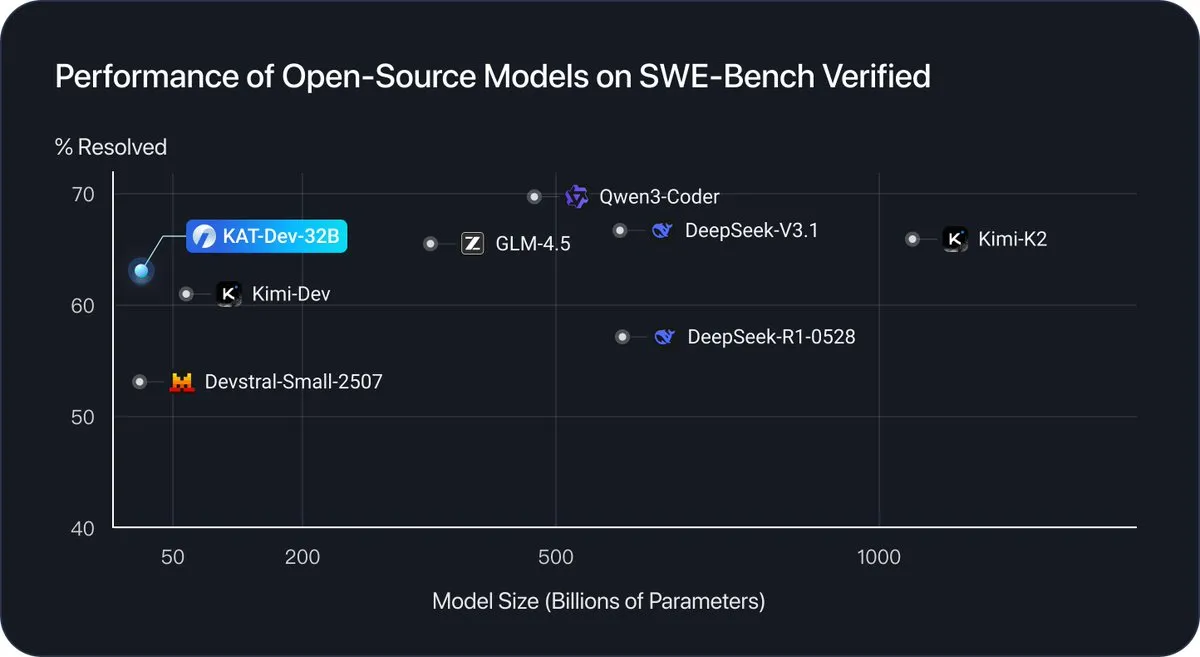

KAT-Dev-32B: modelo de 32B parâmetros projetado para tarefas de engenharia de software : KAT-Dev-32B é um modelo de 32B parâmetros focado em tarefas de engenharia de software. Ele alcançou uma taxa de resolução de 62,4% no benchmark SWE-Bench Verified, classificando-se em quinto lugar em desempenho em comparação com modelos open-source de diferentes tamanhos, demonstrando o progresso significativo dos LLM open-source na geração de código, depuração e fluxos de trabalho de desenvolvimento. (Fonte: _akhaliq)

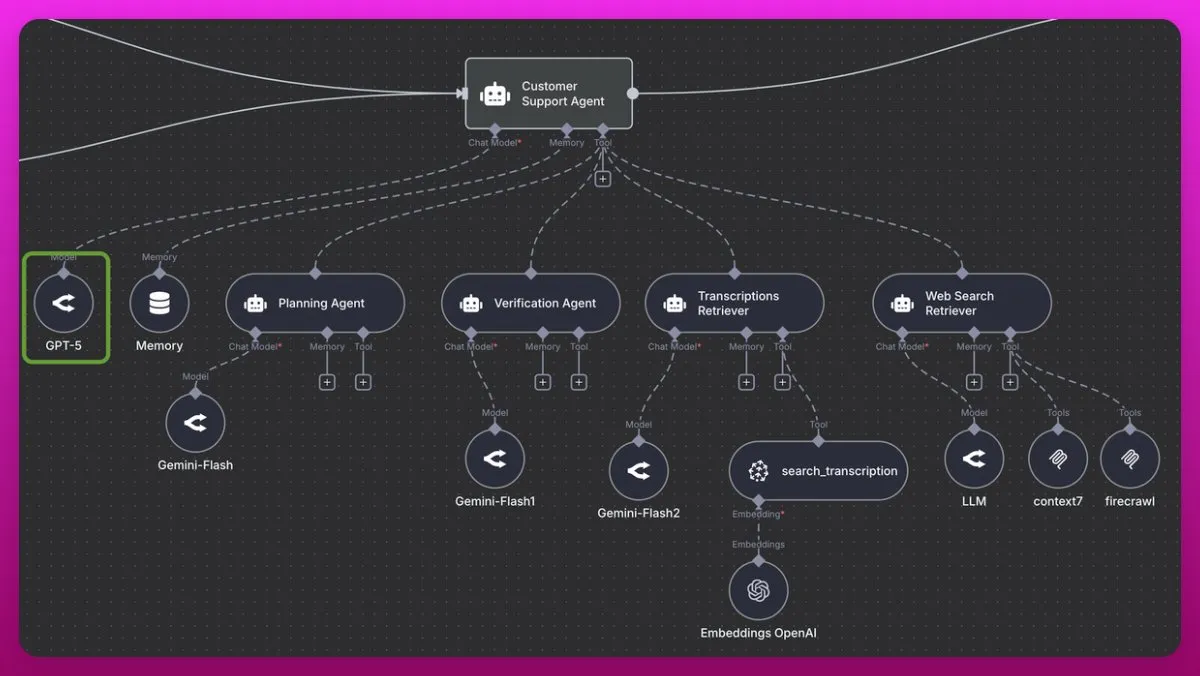

GPT-5: um excelente coordenador para sistemas multiagente : O GPT-5 é aclamado como um excelente coordenador para sistemas multiagente, especialmente adequado para áreas além da codificação, como suporte ao cliente. Ele pode compreender profundamente as intenções, processar eficientemente grandes volumes de dados e preencher lacunas de informação, tornando-o excepcional na gestão de sistemas de recuperação complexos. Em comparação com o Claude 4 (devido ao custo) e o Gemini 2.5 Pro, o GPT-5 (incluindo o GPT-5-mini) se destaca em consistência e precisão na chamada de ferramentas, fornecendo um suporte poderoso para o desenvolvimento de sistemas de agentes avançados. (Fonte: omarsar0)

Tencent HunyuanImage 3.0: novo marco para modelos open-source de texto para imagem : A equipe Tencent Hunyuan lançou o HunyuanImage 3.0, um modelo open-source de texto para imagem com mais de 80 bilhões de parâmetros, ativando 13 bilhões de parâmetros durante a inferência. Este modelo adota uma arquitetura Transfusion-based MoE, acoplando profundamente o treinamento de Diffusion e LLM, o que lhe confere poderosas capacidades de raciocínio de conhecimento do mundo, compreensão de prompts complexos de milhares de caracteres e geração precisa de texto dentro da imagem. O HunyuanImage 3.0 visa revolucionar o design gráfico e os fluxos de trabalho de criação de conteúdo, e planeja suportar futuras interações multimodais, como imagem para imagem e edição de imagem. (Fonte: nrehiew_, jpt401)

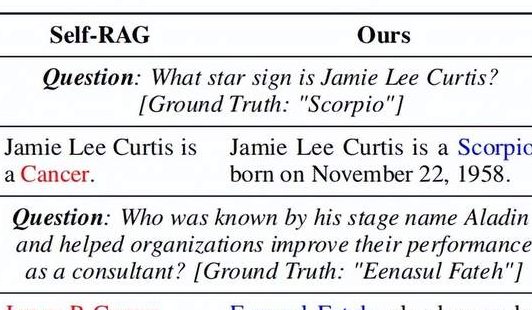

Estrutura DRAG: melhora a compreensão da diversidade lexical em modelos RAG : A ACL 2025 propôs a estrutura Lexical Diversity-aware RAG (DRAG), que introduz pela primeira vez a “diversidade lexical” nos processos de recuperação e geração do RAG. O DRAG divide a semântica da consulta em componentes invariantes, variáveis e complementares, e adota estratégias diferenciadas para avaliação de relevância e calibração de esparsidade de risco. Este método melhorou significativamente a precisão do RAG (por exemplo, um aumento de 10,6% no HotpotQA), estabelecendo novos SOTA em vários benchmarks, e é de grande valor para sistemas de recuperação de informação e perguntas e respostas, permitindo uma compreensão mais precisa da linguagem humana complexa. (Fonte: 量子位)

Tencent Hunyuan3D-Part: o primeiro modelo da indústria para geração de componentes 3D nativos de alta qualidade : A equipe Tencent Hunyuan 3D lançou o Hunyuan3D-Part, o primeiro modelo da indústria capaz de gerar componentes 3D de alta qualidade e semanticamente decomponíveis. Este modelo, através do modelo de segmentação 3D nativo P3-SAM e do modelo de geração de componentes de nível industrial X-Part, alcança a geração de peças 3D de alta fidelidade e estruturalmente consistentes. Este avanço é de grande importância para os pipelines de produção de videogames e para a indústria de impressão 3D, pois pode dividir geometrias complexas em componentes simples, reduzindo significativamente a dificuldade de processamento downstream e suportando a montagem modular. (Fonte: 量子位)

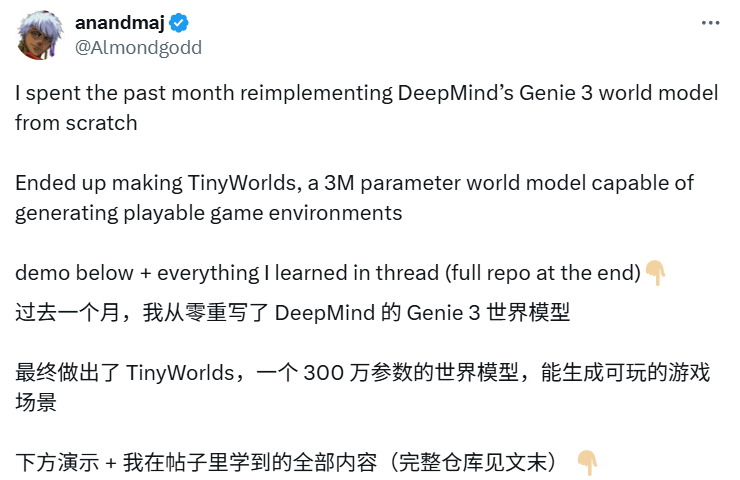

TinyWorlds: 3 milhões de parâmetros replicam o modelo de mundo da DeepMind, alcançando jogos de pixel interativos em tempo real : Em um mês, o blogueiro X anandmaj replicou a ideia central do DeepMind Genie 3, desenvolvendo o TinyWorlds. Este modelo de mundo, com apenas 3 milhões de parâmetros, pode gerar ambientes de jogos de pixel jogáveis em tempo real, como Pong, Sonic, Zelda e Doom. Ele captura informações de vídeo através de transformadores espaço-temporais e tokenizadores de vídeo, alcançando a geração de mundos de pixel interativos, demonstrando o enorme potencial de modelos de pequena escala no campo da geração de mundos em tempo real e suportando código open-source. (Fonte: 36氪)

OpenWebUI agora suporta nativamente MCP: um novo paradigma para integração de ferramentas LLM : A última atualização do OpenWebUI agora suporta nativamente servidores Model Context Protocol (MCP), permitindo que os usuários integrem ferramentas externas como HuggingFace MCP. Este recurso padroniza a forma como os LLM se conectam a fontes de dados e ferramentas externas, expandindo o ecossistema de aplicativos de AI e permitindo que os usuários utilizem várias ferramentas de AI de forma mais flexível e eficiente na interface do OpenWebUI. (Fonte: Reddit r/LocalLLaMA, Reddit r/OpenWebUI)

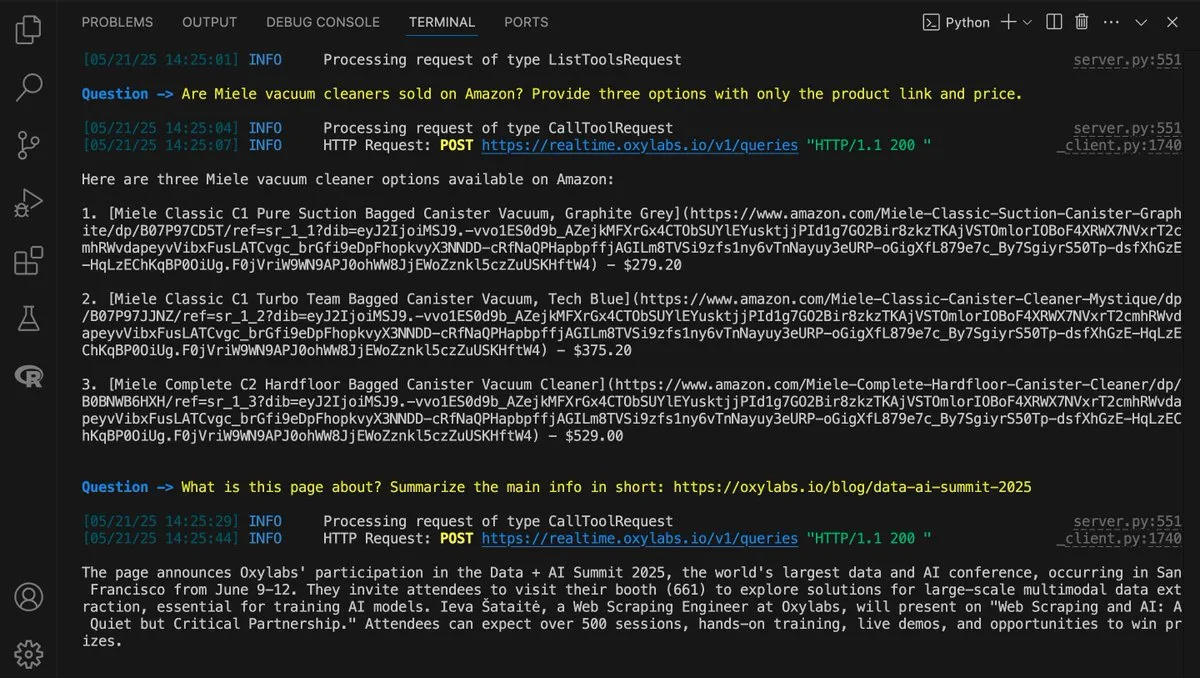

LangChain e Oxylabs colaboram: construindo uma solução de web scraping impulsionada por AI : LangChain e Oxylabs lançaram um guia demonstrando como combinar a inteligência do LangChain com a infraestrutura de scraping da Oxylabs para construir uma solução de web scraping impulsionada por AI. Essa solução suporta múltiplos idiomas e vários métodos de integração, permitindo que os agentes de AI superem desafios comuns de acesso à web, como bloqueios de IP e CAPTCHAs, para alcançar uma recuperação de dados em tempo real mais eficiente, capacitando os fluxos de trabalho dos agentes. (Fonte: LangChainAI)

Ferramenta de avaliação de LLM open-source Opik: monitoramento e depuração abrangentes de aplicativos de AI : Opik é uma ferramenta de avaliação de LLM open-source recém-lançada, projetada para ajudar os desenvolvedores a depurar, avaliar e monitorar aplicativos LLM, sistemas RAG e fluxos de trabalho de agentes. Ela oferece rastreamento abrangente, avaliação automatizada e painéis de nível de produção, fornecendo insights cruciais para melhorar o desempenho e a confiabilidade dos sistemas de AI. (Fonte: dl_weekly)

📚 Aprendizagem

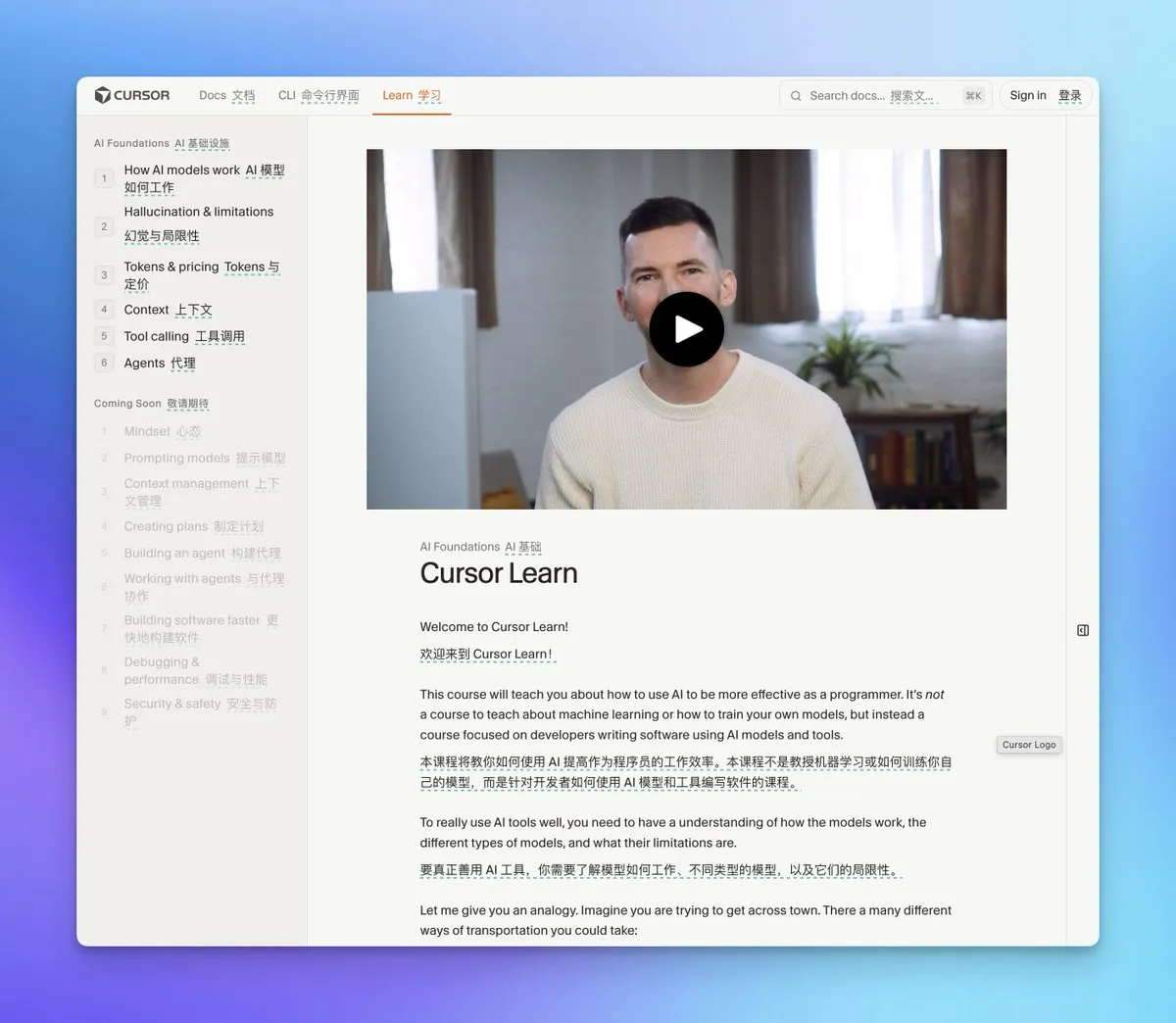

Cursor Learn: curso de vídeo gratuito sobre fundamentos de AI : Cursor Learn lançou um curso de vídeo gratuito de seis partes sobre fundamentos de AI, projetado para iniciantes, cobrindo conceitos centrais como Token, contexto e agentes. O curso inclui questionários e modelos de AI interativos, com o objetivo de fornecer conhecimentos básicos de AI em uma hora, incluindo tópicos avançados como colaboração de agentes e gerenciamento de contexto, sendo um recurso valioso para iniciantes em AI. (Fonte: cursor_ai, op7418)

Repositórios GitHub selecionados de AI/ML: cobrindo frameworks como PyTorch, TensorFlow e outros : Uma série de repositórios GitHub selecionados de AI/ML foi compartilhada, contendo notebooks práticos de vários frameworks de deep learning como PyTorch, TensorFlow e FastAI. Esses recursos cobrem áreas como visão computacional, processamento de linguagem natural, GANs, Transformer, AutoML e detecção de objetos, fornecendo materiais de aprendizagem ricos para estudantes e profissionais, auxiliando na exploração tecnológica e no desenvolvimento de projetos. (Fonte: Reddit r/deeplearning)

E-book gratuito: “A First Course on Data Structures in Python” : Um e-book gratuito intitulado “A First Course on Data Structures in Python” foi lançado. O livro fornece os blocos de construção fundamentais necessários para AI e Machine Learning, incluindo estruturas de dados, pensamento algorítmico, análise de complexidade, recursão/programação dinâmica e métodos de busca, sendo um recurso valioso para aprender os fundamentos da AI. (Fonte: TheTuringPost)

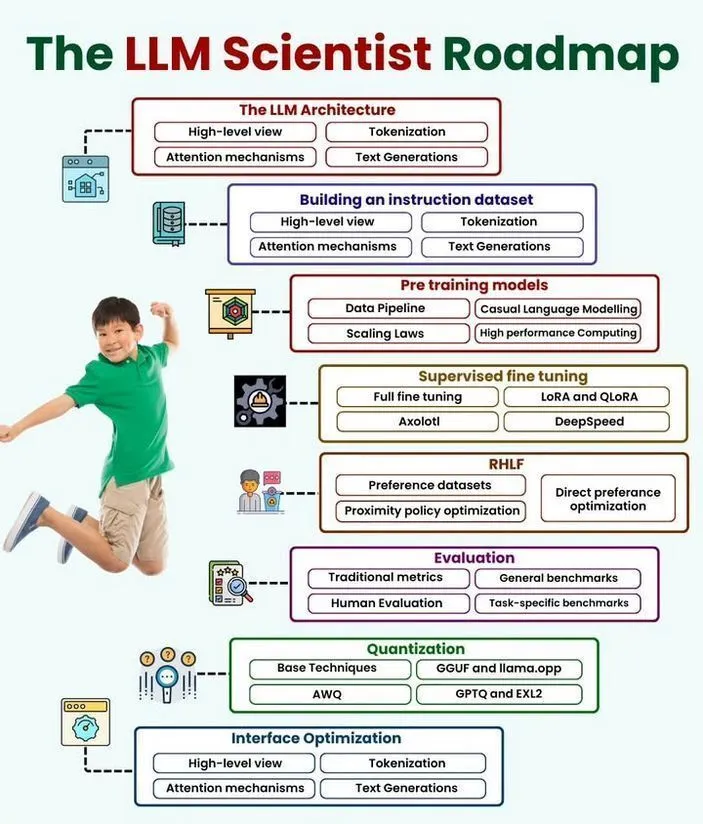

Roteiros para Cientistas de LLM e Cientistas de Dados lançados : Roteiros detalhados foram publicados para o desenvolvimento de carreira de Cientistas de LLM e Cientistas de Dados. Esses recursos descrevem as habilidades, ferramentas e caminhos de aprendizagem necessários para entrar ou avançar nos campos de inteligência artificial, machine learning e ciência de dados, fornecendo orientação clara para o planejamento de carreira dos aspirantes. (Fonte: Ronald_vanLoon, Ronald_vanLoon)

A16Z Speedrun 2026: aceleradora de startups em AI e entretenimento : A16Z Speedrun 2026 está aceitando inscrições de empreendedores nas áreas de AI e entretenimento. O programa oferece suporte a fundadores focados na criação de suas próprias empresas, sendo uma oportunidade para empreendedores que desejam crescer no campo em rápido desenvolvimento de produtos impulsionados por AI. (Fonte: yoheinakajima)

💼 Negócios

Processo de direitos autorais da MiniMax: nuvem sobre o caminho da unicórnio de AI para IPO : A MiniMax, uma unicórnio chinesa de AI avaliada em mais de US$ 4 bilhões, enfrenta um processo conjunto de direitos autorais da Disney, Universal Pictures e Warner Bros. O processo acusa sua ferramenta de geração de vídeo “海螺AI” de gerar conteúdo com personagens protegidos por direitos autorais através de prompts de usuários, constituindo uma violação sistemática. Este caso representa um golpe devastador para os planos de IPO da MiniMax, destacando os sérios desafios de conformidade com a propriedade intelectual no mercado de AI generativa e a importância de equilibrar a inovação tecnológica com os limites legais. (Fonte: 36氪)

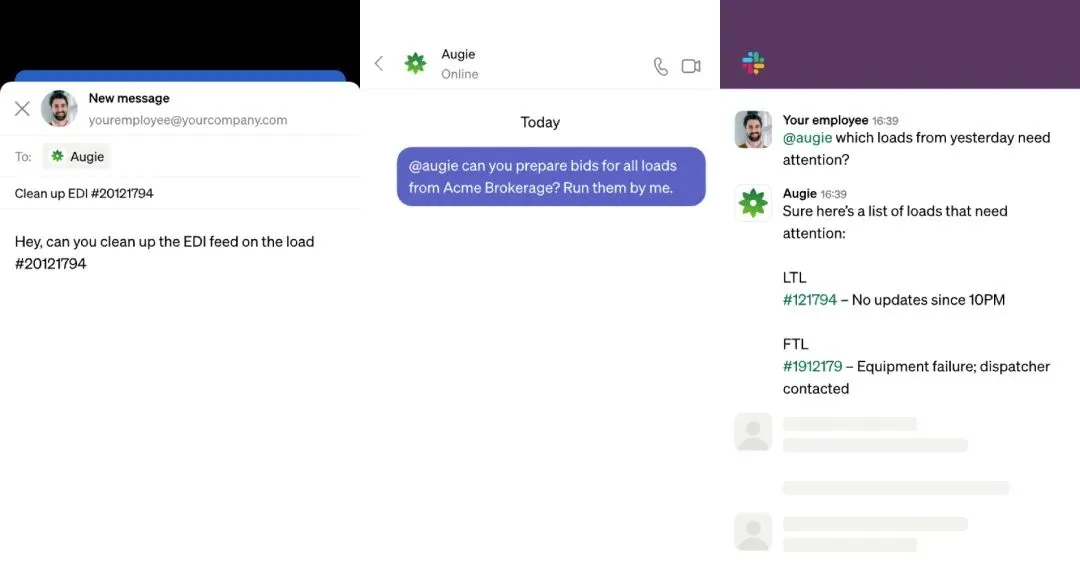

Empresa de logística de AI Augment recebe US$ 85 milhões em financiamento, totalizando 800 milhões de RMB em cinco meses : A Augment, uma empresa de logística de AI, concluiu com sucesso uma rodada de financiamento Série A de US$ 85 milhões, totalizando US$ 110 milhões (cerca de 800 milhões de RMB) em financiamento em apenas cinco meses desde seu lançamento. Seu produto de agente de AI, Augie, pode automatizar tarefas complexas e fragmentadas em todo o ciclo de vida da logística, desde o recebimento de pedidos até a cobrança. Já gerenciou mais de US$ 35 bilhões em valor de carga para dezenas de empresas de logística terceirizadas e expedidores de primeira linha, economizando milhões de dólares para os clientes, demonstrando o poderoso valor comercial da AI na otimização de setores de logística intensivos em mão de obra. (Fonte: 36氪)

Microsoft integra modelos Claude da Anthropic ao Copilot : A Microsoft integrou os modelos Claude Sonnet 4 e Opus 4.1 da Anthropic em seu assistente Copilot para usuários corporativos. Essa medida visa reduzir a dependência exclusiva da OpenAI e consolidar a posição da Microsoft como provedora de plataforma neutra. Os usuários corporativos agora podem escolher entre os modelos OpenAI e Anthropic, o que aumenta a flexibilidade e deve impulsionar a concorrência no mercado de AI corporativa. (Fonte: Reddit r/deeplearning)

🌟 Comunidade

Impacto da AI na compreensão humana e na sociedade: o paradoxo da eficiência e das “bolhas de informação” : A comunidade está amplamente preocupada que a AI possa, assim como as mídias sociais, impactar negativamente a compreensão humana, o pensamento crítico e os objetivos de vida. Ao otimizar a geração de conteúdo para “disseminação” em vez de “verdade” ou “profundidade”, a AI pode levar a um “platô de aprendizado” e a uma “máquina infinita de lixo”. Isso levanta discussões sobre como guiar o desenvolvimento da AI para que seja uma ferramenta de crescimento, e não de vício, e pede mudanças na regulamentação, nas práticas da indústria e nas normas culturais. (Fonte: Reddit r/ArtificialInteligence, Reddit r/artificial, Reddit r/ArtificialInteligence, Yuchenj_UW, colin_fraser, Teknium1, cloneofsimo)

AI no local de trabalho: o paradoxo entre o aumento da eficiência e a “exploração oculta” : A integração da AI no local de trabalho, especialmente para funcionários de nível executivo, está criando um paradoxo: o aumento da eficiência é frequentemente acompanhado por expectativas de produção mais altas, sem que os funcionários recebam a compensação correspondente. Essa “exploração oculta” transforma os funcionários em “revisores humanos” de conteúdo gerado por AI, aumentando a carga cognitiva e a ansiedade. A AI aumenta a produtividade das empresas, mas os lucros fluem mais para o capital, ampliando a “lacuna cognitiva” entre gerentes estratégicos e executores dependentes de ferramentas. Se as estruturas organizacionais não forem reestruturadas, isso pode levar a um esgotamento generalizado. (Fonte: 36氪, glennko, mbusigin)

Na era da AI, o valor do “poder de questionamento” supera o da “capacidade de execução” : Em um mundo impulsionado pela AI, a verdadeira vantagem competitiva muda da velocidade de execução para o “poder de questionamento” – a capacidade de identificar quais problemas valem a pena resolver. A dependência excessiva da AI para a execução sem uma definição crítica do problema pode levar à resolução eficiente de problemas errados, criando uma falsa sensação de progresso. O design thinking, o mapeamento de empatia e o questionamento contínuo são considerados habilidades humanas cruciais que a AI não pode substituir, ajudando indivíduos e organizações a utilizar a AI de forma eficaz para focar na resolução de desafios significativos. (Fonte: 36氪)

Geopolítica da AI: a corrida de AI entre EUA e China e a controvérsia sobre regulamentação internacional : A corrida de AI entre EUA e China é vista como uma maratona, não uma corrida de curta distância, com a China possivelmente liderando em aplicações de robótica. Os EUA são instados a focar em investimentos práticos em AI, em vez de apenas buscar a superinteligência, mas rejeitaram a supervisão internacional da AI em nível da ONU, enfatizando a soberania nacional. Isso destaca a complexa paisagem geopolítica onde o desenvolvimento da AI se entrelaça com a segurança nacional, políticas comerciais (como o visto H-1B) e a competição por infraestrutura e talentos de AI. (Fonte: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, adcock_brett, Dorialexander, teortaxesTex, teortaxesTex, teortaxesTex, brickroad7, jonst0kes)

Emad Mostaque prevê a “última economia”: AI irá remodelar o valor humano : Emad Mostaque, ex-CEO da Stability AI, prevê que nos próximos 1000 dias a AI irá remodelar completamente a estrutura econômica, e o valor do trabalho humano poderá cair a zero ou até se tornar negativo. Ele propõe a “estrutura MIND” (Matéria, Inteligência, Rede, Diversidade) para medir a saúde econômica, argumentando que o excesso de “capital intelectual” trazido pela AI exige uma reavaliação da importância de outros capitais. Essa “quarta reversão” fará com que a AI substitua o trabalho cognitivo, exigindo a criação de novas moedas “centradas no ser humano” e uma AI básica universal para lidar com a transição social. (Fonte: 36氪)

Corrida de hardware de AI: OpenAI, ByteDance e Meta disputam o mercado de dispositivos de consumo : Gigantes da tecnologia como OpenAI, ByteDance e Meta estão investindo ativamente no desenvolvimento de hardware de AI para o consumidor. Os óculos Ray-Ban AI da Meta já alcançaram vendas significativas, enquanto a OpenAI estaria colaborando com fornecedores da Apple para desenvolver um “alto-falante inteligente sem tela”, e a ByteDance está desenvolvendo óculos inteligentes de AI. Essa corrida indica que a AI se integrará mais profundamente na vida diária, com as empresas explorando diversas formas de produtos e modos de interação para obter uma vantagem no campo da AI de percepção ambiental. (Fonte: 36氪)

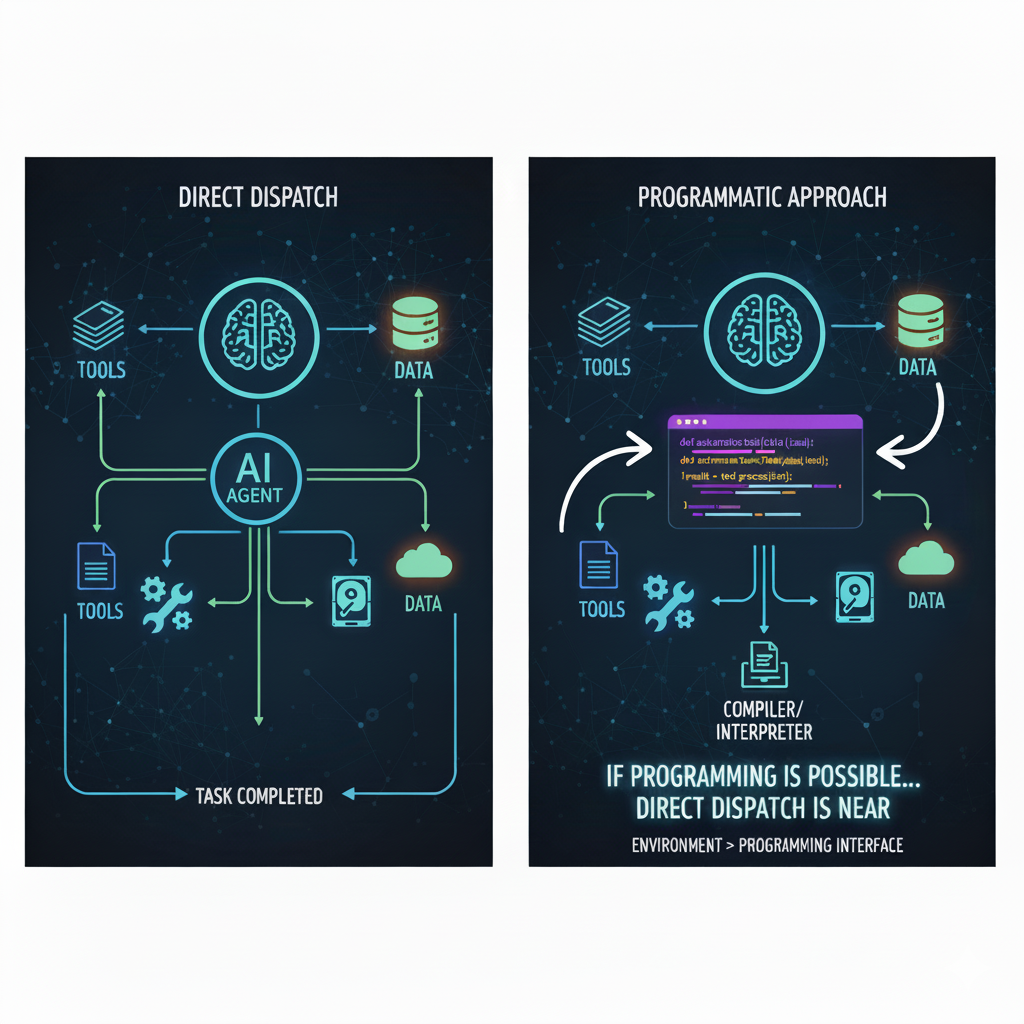

AI Agent: da colaboração humano-máquina à “delegação humano-máquina” – uma mudança de paradigma : A indústria de AI está testemunhando um “ponto de inflexão suave” da colaboração humano-máquina para a “delegação humano-máquina”, onde AI Agents autônomos executarão tarefas complexas em grande escala. O avanço da AI em “quebrar a programação” sugere que ela pode superar todos os sistemas semiabertos. Essa transição dará origem a formas organizacionais de “empresas sem humanos”, onde o papel humano passará da execução micro para a governança macro, focando na injeção de valores, design de arquitetura de sistema e navegação macro, com a AI Copilot auxiliando na tomada de decisões, em vez de intervir diretamente em sistemas de AI de alta velocidade. (Fonte: 36氪)

Impacto da AI em cursos de línguas estrangeiras: estudantes precisam desenvolver habilidades compostas de “língua estrangeira+” : O surgimento da tecnologia de tradução por AI está impactando profundamente os cursos de línguas estrangeiras, levando a uma diminuição na demanda por cargos tradicionais relacionados a idiomas e ao fechamento de programas em várias universidades. Estudantes de línguas estrangeiras enfrentam pressão para se transformar, passando de uma única habilidade linguística para um modelo composto de “língua estrangeira+”, como “língua estrangeira + AI” para trabalhar com natural language processing, ou “língua estrangeira + comunicação internacional”. Isso impulsiona a reforma da educação em línguas estrangeiras, enfatizando a compreensão intercultural e habilidades abrangentes, em vez de apenas treinamento em tradução, para se adaptar às novas demandas por talentos linguísticos na era da AI. (Fonte: 36氪, Reddit r/ClaudeAI)

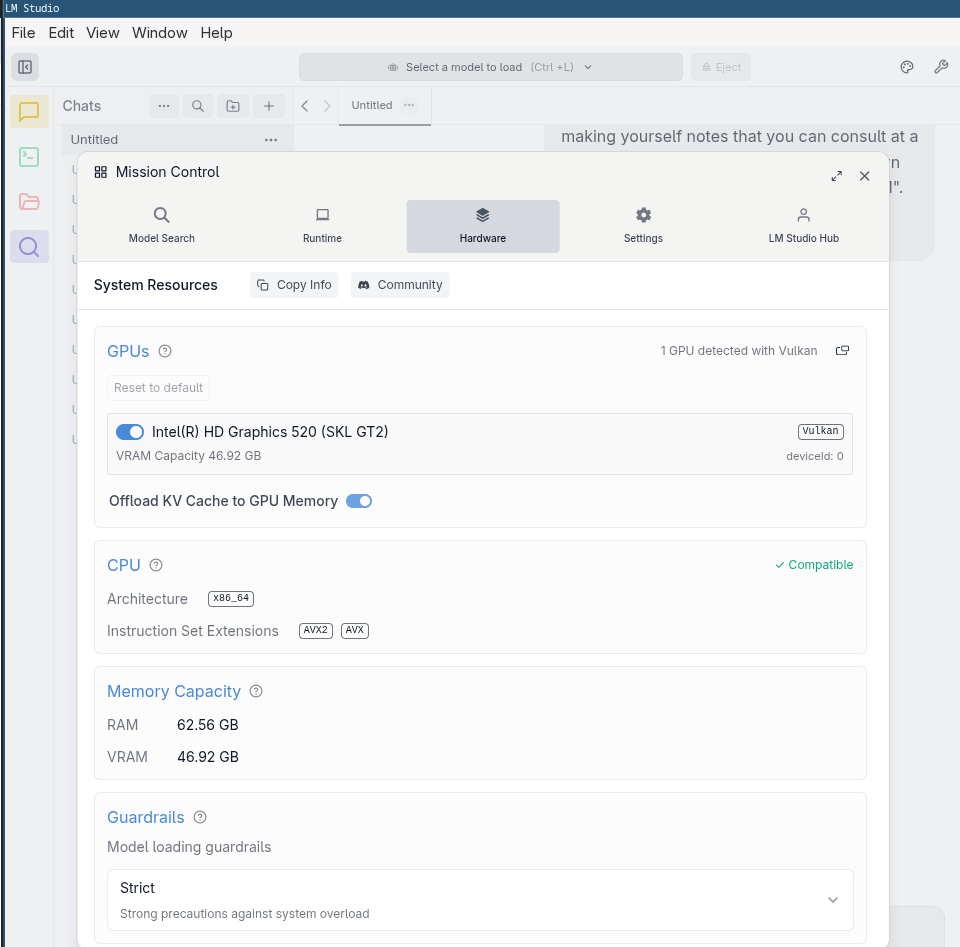

Preços de GPU elevados: impulsionados pela demanda de AI e otimização de LLM local : A comunidade está amplamente preocupada com os preços persistentemente altos das GPU, atribuindo-os ao aumento da demanda por data centers de AI e à inflação. Muitos acreditam que, a menos que a bolha da AI estoure ou chips personalizados se tornem amplamente disponíveis, os preços dificilmente cairão significativamente. No entanto, para enfrentar esse desafio, a comunidade está trabalhando para otimizar o desempenho de LLM locais, como o AMD MI50 superando o NVIDIA P40 em llama.cpp/ggml, e utilizando iGPU para tarefas básicas de LLM, a fim de reduzir os custos de computação de AI local. (Fonte: Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

💡 Outros

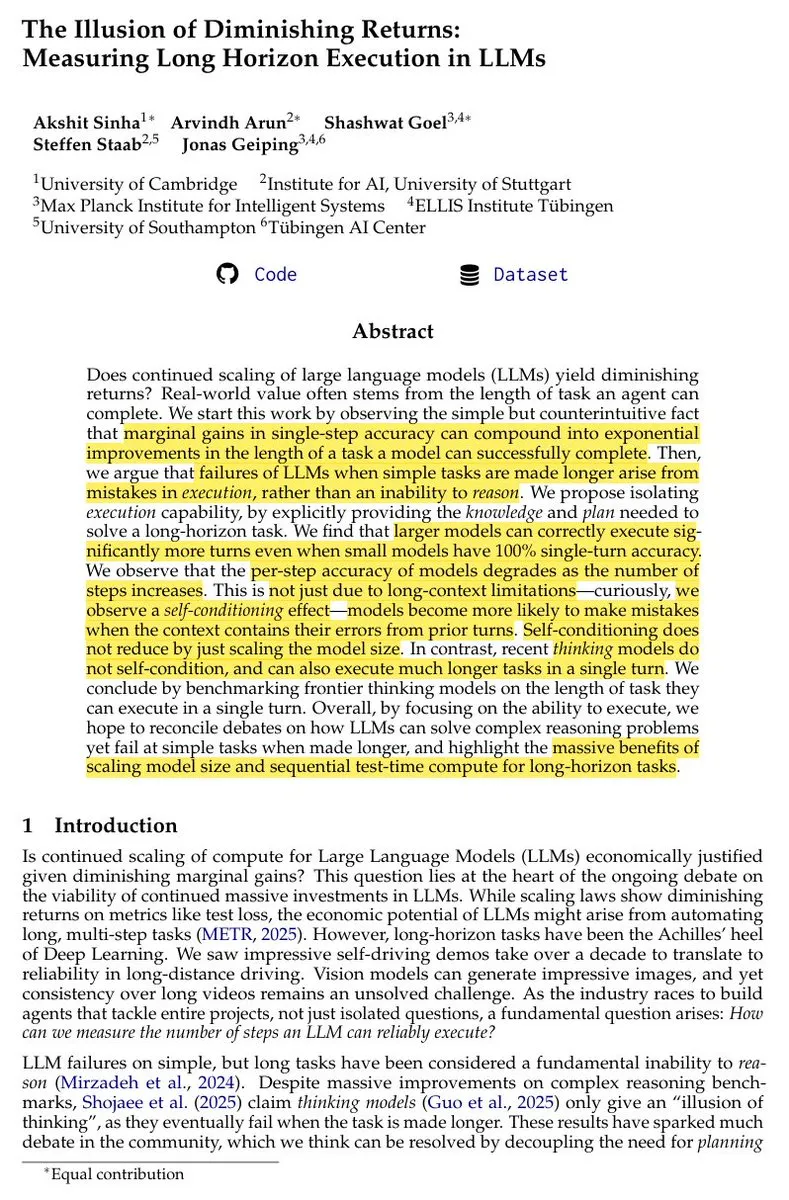

“Ilusão de retornos decrescentes” na expansão de LLM e tarefas de longo ciclo : Pesquisas mostram que, embora benchmarks de uma única rodada possam indicar um progresso mais lento dos LLM, a expansão do tamanho do modelo ainda traz melhorias não decrescentes na execução de tarefas de longo ciclo. A “ilusão de retornos decrescentes” surge de pequenas melhorias na precisão de uma única etapa, que podem levar a um aumento super exponencial na conclusão de tarefas de longo ciclo. A vantagem da computação sequencial em tarefas de longo ciclo é incomparável aos testes paralelos, o que sugere que a expansão contínua do modelo e o treinamento por reinforcement learning são cruciais para alcançar comportamentos de agentes avançados. (Fonte: scaling01)

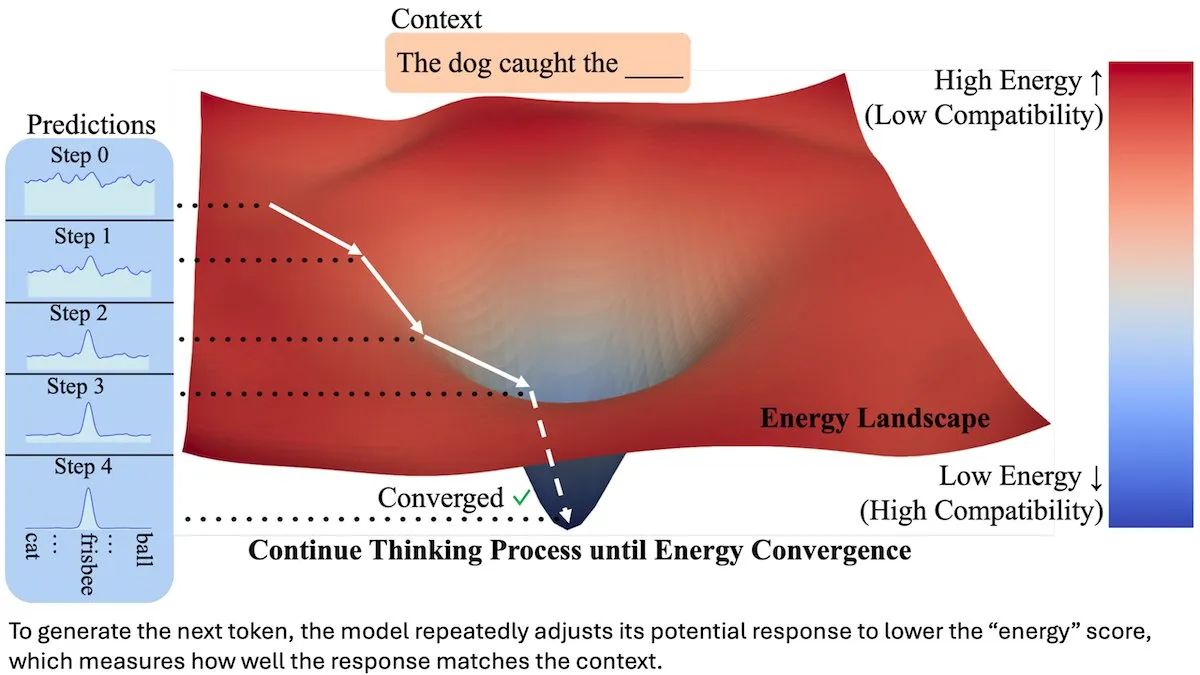

Energy-Based Transformer (EBT) melhora o desempenho de previsão do próximo token : Pesquisadores lançaram o Energy-Based Transformer (EBT), que avalia candidatos a próximo token por meio de uma pontuação de “energia” e os verifica e seleciona iterativamente, reduzindo a energia por meio de etapas de gradiente. Em experimentos com 44 milhões de parâmetros, o EBT superou o Transformer tradicional de tamanho equivalente em três dos quatro benchmarks, indicando que este novo método de seleção de token tem o potencial de melhorar o desempenho dos LLM. (Fonte: DeepLearningAI)

Avanços em robôs de AI: vendedores humanoides e cães robôs autônomos sem treinamento : A Xpeng Motors implantou “铁蛋” (Tiedan), um vendedor de carros humanoide, em seus showrooms, demonstrando a aplicação da AI em robótica voltada para o cliente. Além disso, um cão robô “com reflexos animais” pode andar na floresta sem treinamento, destacando o progresso da tecnologia de robôs autônomos na imitação de movimentos e percepção biológicos. Esses desenvolvimentos indicam a crescente complexidade e aplicação prática da AI no campo da robótica física. (Fonte: Ronald_vanLoon, Ronald_vanLoon)