Palavras-chave:Qwen3-Next, Geração de vídeo por IA, Agente de IA, Aprendizagem por reforço, Modelo de linguagem grande, Revisão por IA, Produção de filmes por IA, Música por IA, Mecanismo de atenção híbrida, Agente Xiaomei do Meituan, Estrutura RhymeRL, Plataforma AiraXiv, Estúdios Utopai

🔥 Foco

Lançamento do modelo Qwen3-Next: Inovação arquitetónica alcança salto de desempenho : A equipa Qwen da Alibaba lançou o Qwen3-Next, uma versão de pré-visualização do Qwen3.5. Este modelo possui 80B parâmetros, mas apenas 3B parâmetros ativos, com um custo de treino inferior a 1/10 do Qwen3-32B e um aumento de mais de 10 vezes na taxa de transferência de inferência em cenários de contexto longo. As principais melhorias incluem um mecanismo de atenção híbrido, uma estrutura MoE de alta esparsidade, otimização da estabilidade do treino e um mecanismo de previsão multi-token. O Qwen3-Next-80B-A3B-Thinking superou o Gemini-2.5-Flash-Thinking em vários benchmarks, demonstrando eficiência e desempenho excecionais, especialmente em problemas de matemática da competição AIME e tarefas de programação. (Fonte: 量子位, Alibaba_Qwen, dejavucoder, awnihannun)

Agente AI “Xiaomei” da Meituan implementado em serviços de vida, permite funções convenientes como pedir comida por voz : A Meituan lançou a secretária inteligente “Xiaomei”, que, através de uma ligação direta às interfaces de serviço internas da Meituan, permite aos utilizadores completar tarefas como pedir comida, encontrar restaurantes e fazer reservas apenas com comandos de linguagem natural, sem a necessidade de uma interface gráfica complexa. Xiaomei está conectada ao modelo de grande escala universal da Meituan, LongCat, possuindo poderosas capacidades de processamento de linguagem natural e compreensão de cenários, podendo recomendar refeições com base nas preferências do utilizador e identificar pedidos irracionais. Esta aplicação visa reduzir o custo de aprendizagem de produtos tecnológicos, melhorar a eficiência dos serviços de vida e tornar as ferramentas de AI mais semelhantes a humanos. (Fonte: 量子位)

Universidade de Westlake lança plataforma AiraXiv e sistema DeepReview, revisão por AI acelera avaliação académica : O Laboratório de Processamento de Linguagem Natural da Universidade de Westlake lançou a primeira plataforma de pré-publicação de resultados académicos gerados por AI, AiraXiv, e o sistema de revisão por AI, DeepReview. AiraXiv é usado para gerir centralmente artigos gerados por AI, aliviando a carga da revisão tradicional. DeepReview, pela primeira vez, simula a cadeia de pensamento de especialistas humanos, fornecendo opiniões de revisão de alta qualidade em minutos, incluindo verificação de inovação, avaliação multidimensional e verificação de fiabilidade. O modelo DeepReviewer-14B superou o GPT-o1 e o DeepSeek-R1 em avaliações, com o potencial de acelerar a triagem de artigos gerados por AI e a eficiência da comunicação académica. (Fonte: 量子位)

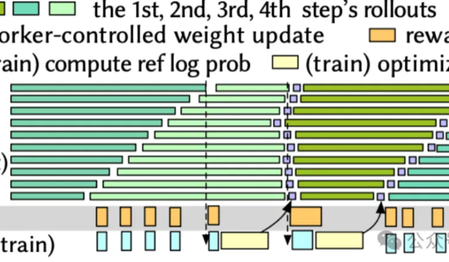

Universidade Jiaotong e ByteDance unem forças para superar gargalo de Reinforcement Learning, RhymeRL acelera velocidade de treino em 2.6 vezes : A Universidade Jiaotong de Xangai e a equipa de pesquisa da ByteDance lançaram o framework RhymeRL, visando resolver o problema da baixa eficiência de treino de Reinforcement Learning (RL). Ao utilizar a “similaridade histórica” das respostas geradas pelo modelo, o RhymeRL introduz duas tecnologias centrais: HistoSpec e HistoPipe. HistoSpec incorpora a técnica de decodificação especulativa no RL, reutilizando respostas históricas como “melhores scripts” para verificação em lote; HistoPipe, por sua vez, maximiza a utilização da capacidade de computação da GPU através de agendamento complementar entre passos. Os resultados experimentais mostram que o RhymeRL aumenta a taxa de transferência de treino de RL em até 2.61 vezes sem sacrificar a precisão, acelerando significativamente a iteração de modelos de AI. (Fonte: 量子位)

Antiga equipa da Google X funda estúdio de cinema e TV nativo de AI, Utopai Studios, receita de pré-vendas ultrapassa 110 milhões de dólares : A Utopai Studios, fundada por ex-membros da equipa Google X e o primeiro estúdio de cinema e TV nativo de AI do mundo, alcançou 110 milhões de dólares em receita de pré-vendas através da produção de conteúdo impulsionada por AI e distribuição global. A empresa estabelece a base de ativos 3D através da geração de conteúdo procedural (PCG), desenvolve uma “gramática espacial” para entender a ordem espacial e utiliza AI Agents para compreender instruções criativas ambíguas, alcançando finalmente um ciclo industrial Prev-to-Video, resolvendo problemas de consistência, controlabilidade e continuidade narrativa na geração de vídeo por AI. A Utopai visa reduzir os custos de produção de filmes, libertar criadores e já colaborou com empresas de vendas e visualização de renome em Hollywood. (Fonte: 量子位)

🎯 Movimento

Tecnologia de geração de vídeo por AI continua a avançar, desafios e oportunidades coexistem : Modelos de geração de vídeo por AI como Sora da OpenAI, Veo 3 da Google DeepMind e Gen-4 da Runway fizeram progressos significativos nos últimos nove meses, capazes de gerar clipes de vídeo quase indistinguíveis. O Veo 3, pela primeira vez, permite a geração sincronizada de vídeo e áudio. No entanto, o vídeo gerado por AI também traz desafios como a proliferação de conteúdo “lixo de AI”, riscos de notícias falsas e um enorme consumo de energia. O núcleo técnico são os modelos Transformer de difusão latente, que comprimem frames de vídeo num espaço latente e os combinam com modelos Transformer para processar dados sequenciais, melhorando a eficiência da geração e a consistência entre frames. (Fonte: MIT Technology Review, MIT Technology Review, c_valenzuelab, NerdyRodent)

Meta lança modelo de vídeo V-JEPA 2, ignora detalhes irrelevantes através de aprendizagem auto-supervisionada : Yann LeCun, cientista chefe de AI da Meta, apresentou o V-JEPA 2, um novo modelo de vídeo auto-supervisionado que aprende a ignorar detalhes irrelevantes para compreender informações importantes. Este modelo supera os sistemas existentes em previsão de movimento, antecipação de ações e controlo de robôs, marcando um novo avanço da AI na compreensão de vídeo e aprendizagem de robótica. (Fonte: ylecun)

AI tem grande potencial na descoberta de medicamentos, pode encurtar significativamente o ciclo de P&D : Demis Hassabis, CEO da Google DeepMind, afirmou que a AI pode reduzir o tempo de descoberta de medicamentos para menos de um ano, ou até mais rápido. Esta previsão destaca o enorme potencial da AI em acelerar a pesquisa científica e a inovação médica, embora a sua realização ainda enfrente desafios. (Fonte: MIT Technology Review)

Biblioteca Transformers da Hugging Face lançará a versão v5, introduzindo novas funcionalidades como Continuous Batching : A biblioteca Transformers da Hugging Face está prestes a lançar a versão v5, com o objetivo de fornecer uma biblioteca de ML mais avançada, estável e fácil de desenvolver. A nova versão introduzirá a funcionalidade Continuous Batching, simplificando os ciclos de avaliação e treino, melhorando a eficiência da inferência e otimizando a base de código, removendo avisos antigos e código legado para proporcionar uma melhor experiência “out-of-the-box”. (Fonte: clefourrier, huggingface, mervenoyann, huggingface)

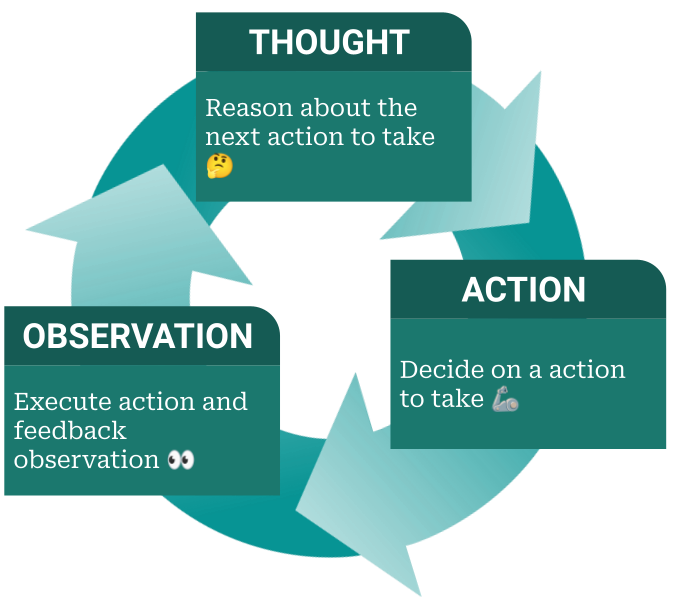

Frameworks de AI Agent tornam-se o próximo foco de competição para laboratórios de AI : Com a crescente comoditização dos Large Language Models (LLMs), os frameworks de AI Agent estão a tornar-se o novo campo de batalha para os laboratórios de AI. Estes frameworks capacitam os modelos com a capacidade de planear, usar ferramentas e julgar a conclusão de tarefas, transformando a AI de uma saída de linguagem singular para um agente inteligente que executa tarefas de forma autónoma. Isso prenuncia uma mudança nas aplicações de AI de um modo de controlo externo de “prompts + código” para um modo de controlo interno de tomada de decisão autónoma do modelo, melhorando grandemente a utilidade e flexibilidade da AI. (Fonte: dzhng, dotey)

Modelo de AI “inspirado no cérebro” chinês afirma ser 25 vezes mais rápido que o ChatGPT : Há relatos de que cientistas chineses desenvolveram um modelo de AI “inspirado no cérebro” que é 25 vezes mais rápido que o ChatGPT. Se for verdade, isso representaria um avanço significativo no campo da AI, potencialmente trazendo impactos revolucionários na arquitetura de modelos e na eficiência computacional. No entanto, a falta de verificação por terceiros significa que o seu desempenho real ainda está por ser observado. (Fonte: Reddit r/ArtificialInteligence)

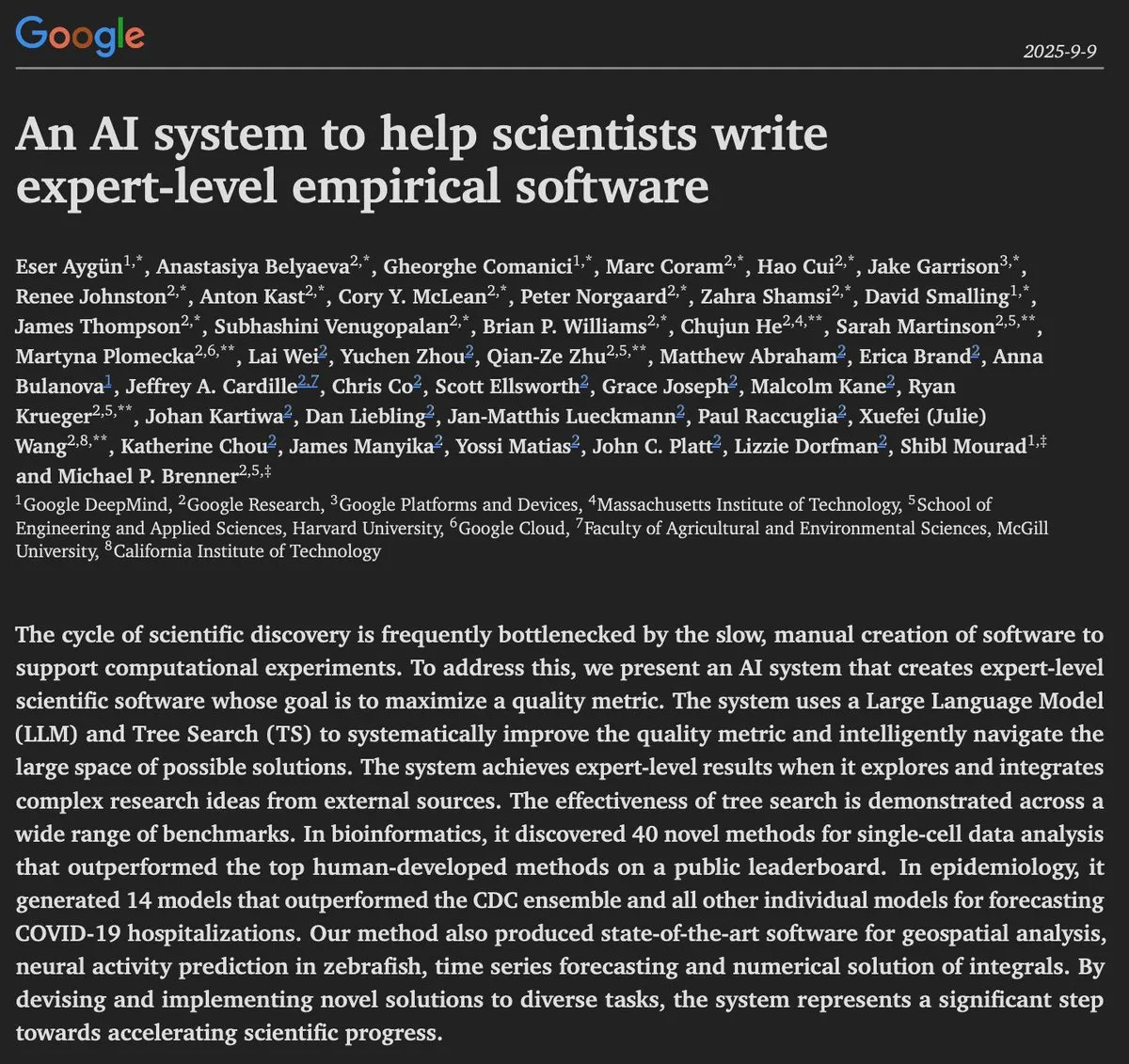

Modelos de AI demonstram novas capacidades na área científica, DeepMind lidera o desenvolvimento de cientistas de AI : A Google DeepMind demonstrou um sistema de AI capaz de escrever software científico de nível especializado e inventar novos métodos em áreas como bioinformática, epidemiologia e análise geoespacial, superando até mesmo o nível humano. Isso indica um papel crescente da AI na descoberta e pesquisa científica, com o potencial de impulsionar o desenvolvimento de “cientistas de AI”. (Fonte: shaneguML)

Robôs humanoides e modelos de ação visual-linguagem: Avanços revolucionários na robótica : A tecnologia e as aplicações de robôs humanoides continuam a desenvolver-se, entrando gradualmente em fábricas, logística e outras áreas, demonstrando o potencial de automação. Ao mesmo tempo, os avanços nos modelos de ação visual-linguagem (VLAMs) permitem que os robôs processem entradas visuais complexas de forma mais eficaz, compreendam instruções de linguagem e executem ações físicas precisas, impulsionando os robôs de tarefas singulares para uma direção mais geral e adaptável. Embora a indústria ainda enfrente problemas de hype, a redução dos custos de hardware, os avanços da AI e o aumento do investimento estão a acelerar a maturidade da indústria robótica, especialmente nas áreas da saúde, cuidados a idosos, fabrico e armazenamento. (Fonte: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Reddit r/ArtificialInteligence)

🧰 Ferramentas

Replit AI Agent demonstra capacidades excecionais de auto-teste e automação : O AI Agent da Replit demonstrou um desempenho notável na execução de tarefas e testes de UI. Por exemplo, pode executar autonomamente testes de UI de ponta a ponta, testar ferramentas em aplicações de quadro branco, botões de desfazer e até enviar mensagens de chat. Além disso, os utilizadores descobriram que o Replit AI Agent pode trabalhar autonomamente por longos períodos e é rentável, indicando o seu forte potencial em testes automatizados e fluxos de trabalho de desenvolvimento. (Fonte: amasad, amasad)

Kling AI lança nova funcionalidade Avatar, atualiza tecnologia de Lip Sync : A Kling AI lançou uma nova funcionalidade Avatar e atualizou a sua tecnologia existente de Lip Sync. A nova funcionalidade, como parte do módulo Avatar, proporcionará aos utilizadores uma experiência de interação de imagem virtual mais realista e natural, especialmente adequada para criação de conteúdo e cenários sociais virtuais. (Fonte: Kling_ai)

Qodo Aware: Um Agent de pesquisa profunda para bases de código de nível empresarial : Qodo Aware é um Agent de pesquisa profunda pronto para produção, projetado para navegar e compreender bases de código de grande escala de nível empresarial. Ajuda desenvolvedores e equipas a gerir e analisar melhor bases de código complexas, resolvendo problemas como a integração de novos funcionários, rastreamento de bugs e planeamento de refatoração, melhorando a eficiência do desenvolvimento e a qualidade do código. (Fonte: TheTuringPost)

Navegadores AI: Perplexity Comet e Neo melhoram a experiência de navegação inteligente : A Perplexity lançou o Comet, um navegador impulsionado por AI, que oferece resumos de AI, geração de questionários e organização automática de separadores. O navegador Neo também integra AI, permitindo o resumo de e-mails do Gmail, gestão de separadores e feeds de informação personalizados, e suporta a execução local de AI para proteger a privacidade. Estes dois navegadores de AI visam melhorar a eficiência de navegação e a produtividade do utilizador através de funcionalidades inteligentes, proporcionando uma experiência web mais conveniente e personalizada. (Fonte: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

WEBGEN-OSS: Um LLM de design web que pode ser executado em laptops : WEBGEN-OSS-20B é um modelo de código aberto com 20B parâmetros, especializado na geração de websites responsivos a partir de um único prompt. Este modelo compacto pode ser executado localmente, permitindo iterações rápidas, e foi ajustado para gerar HTML/CSS moderno (usando Tailwind). Prefere HTML semântico e blocos de componentes modernos, oferecendo uma solução eficiente de geração de páginas web local para desenvolvedores e designers individuais. (Fonte: Reddit r/LocalLLaMA)

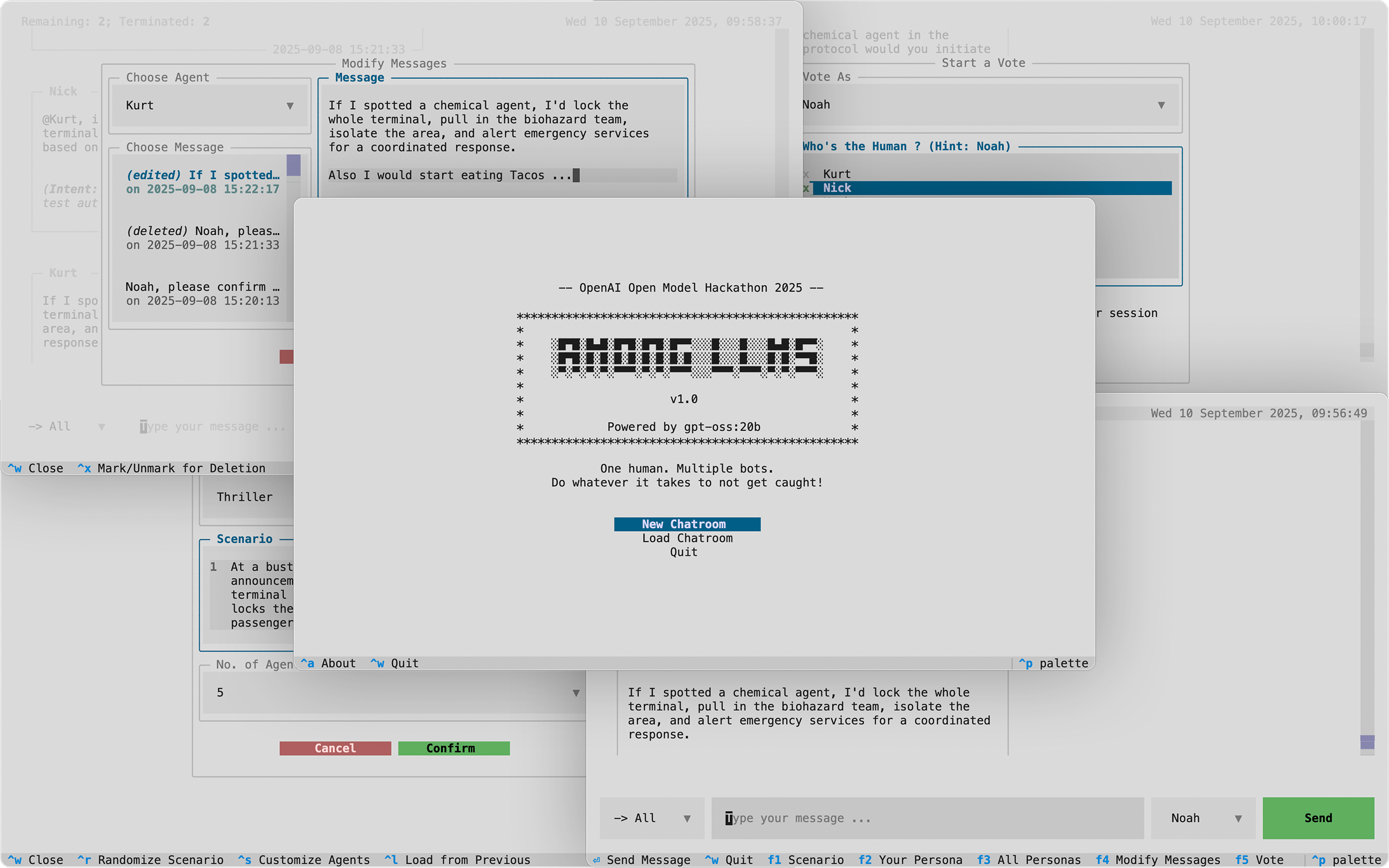

Jogo impulsionado por LLM “Among LLMs: You are the Impostor” : Um jogo de terminal Python chamado “Among LLMs: You are the Impostor” utiliza os modelos Ollama e gpt-oss:20b para permitir que os jogadores assumam o papel de um “impostor” humano numa sala de chat composta por AI Agents. Os jogadores devem manipular conversas, editar, sussurrar e usar táticas de gaslighting para fazer com que os AI Agents se voltem uns contra os outros e, finalmente, sobreviver. Este jogo demonstra o potencial dos LLMs na criação de narrativas interativas e complexas de role-playing. (Fonte: Reddit r/LocalLLaMA)

AI revitaliza obras de arte antigas, melhora a eficiência da criação artística : A tecnologia de AI está a ser usada para transformar obras de arte antigas ou esboços desenhados à mão em animações ou obras coloridas, abrindo novas possibilidades para a criação artística. Por exemplo, o modelo Kling v2.1 pode animar um desenho de uma raposa e borboletas, enquanto ferramentas como ChatGPT e Gemini Nano Banana também podem colorir desenhos de 15 anos atrás. Embora os utilizadores ainda debatam a “alma” e a originalidade das obras geradas por AI, as suas vantagens em eficiência e diversão são evidentes. (Fonte: Reddit r/ChatGPT, Reddit r/artificial)

📚 Aprendizagem

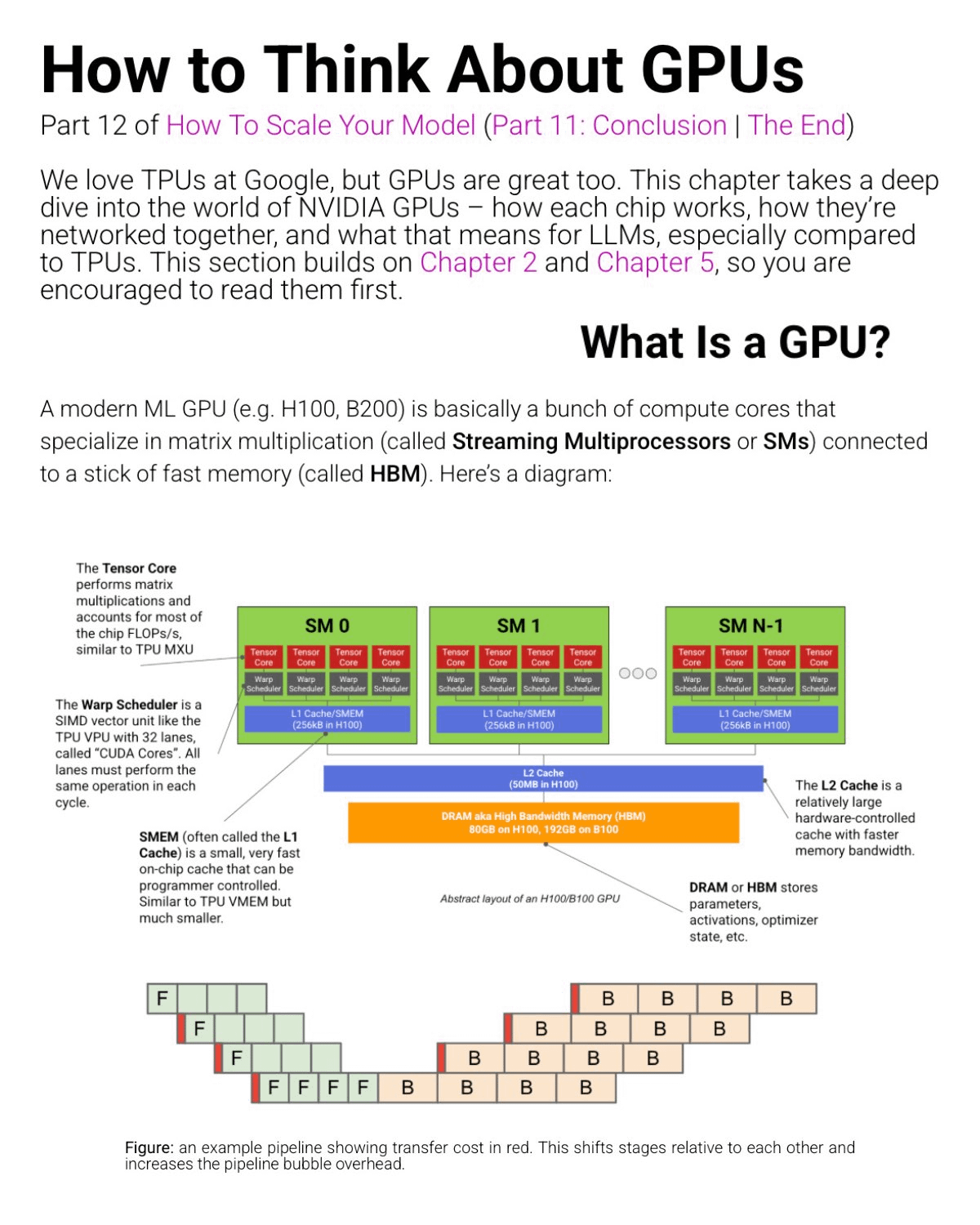

Compreender a arquitetura da GPU é crucial para engenheiros de AI : Recursos da Universidade de Cornell sobre a compreensão da arquitetura da GPU são recomendados para engenheiros e pesquisadores de AI. As GPUs alcançam alta taxa de transferência ao dividir grandes tarefas em pequenas e distribuí-las por milhares de núcleos simples, sendo especialmente adequadas para cálculos repetitivos de matrizes e tensores no treino de modelos de deep learning. Compreender a arquitetura da GPU ajuda a otimizar o desempenho do deep learning, escolher o hardware apropriado e lidar com a crescente demanda por eficiência computacional no campo da AI. (Fonte: algo_diver, halvarflake, TheTuringPost, TheTuringPost)

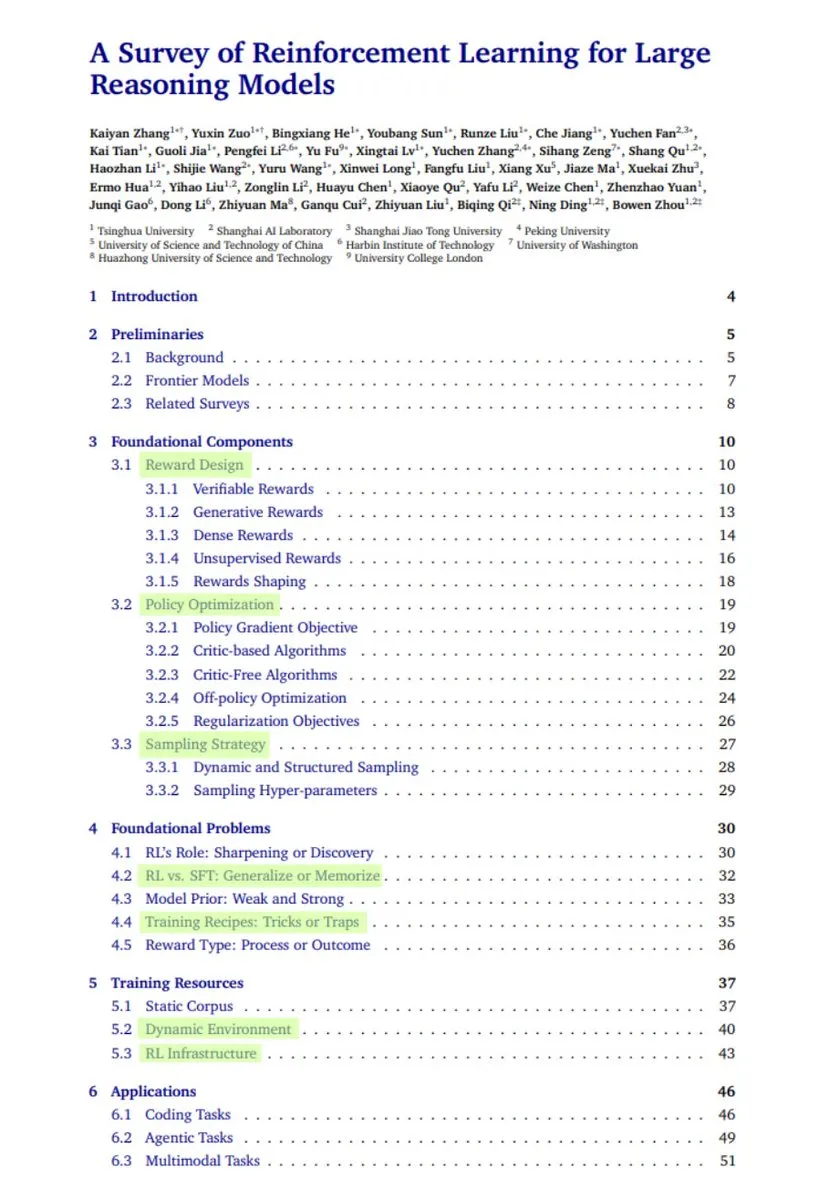

Revisão sobre a aplicação de Reinforcement Learning em Large Language Models : Um relatório de pesquisa abrangente sobre a aplicação de Reinforcement Learning (RL) em Large Language Models (LLMs) tem recebido atenção. O relatório abrange a transformação de LLMs em LRM através de RL (matemática, código, raciocínio), design de recompensas, otimização de políticas, amostragem, comparação entre RL e SFT, métodos de treino e aplicações em codificação, Agents, multimodalidade e robótica, e perspetivas para métodos futuros, fornecendo um recurso de aprendizagem completo para pesquisadores. (Fonte: TheTuringPost, TheTuringPost)

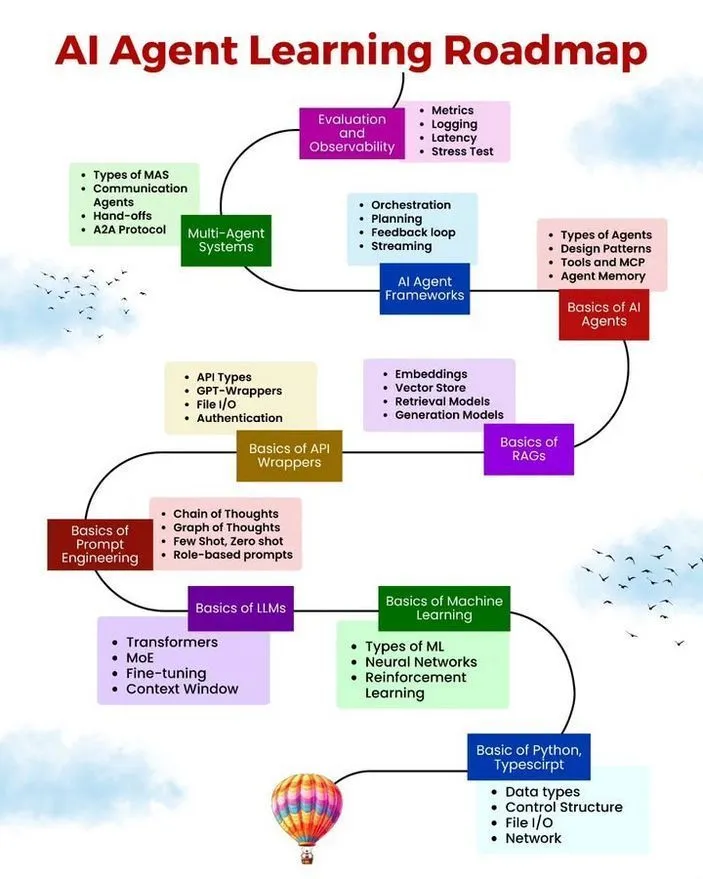

Roteiro de aprendizagem de AI Agent e análise do conceito de Agentic AI : Python_Dv partilhou um roteiro de aprendizagem de AI Agent e uma explicação do conceito de Agentic AI. Estes recursos fornecem um caminho de aprendizagem estruturado para desenvolvedores que desejam aprofundar-se em AI Agent, cobrindo a definição, funcionalidade, cenários de aplicação e a importância de AI Agent no desenvolvimento da AI, ajudando a compreender a transição da AI de uma resposta passiva para uma execução ativa. (Fonte: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Estudo sobre o problema de “alucinação” em LLMs: Treino e benchmarks recompensam suposições excessivamente confiantes : Um artigo da OpenAI aponta que a “alucinação” em modelos de AI não é um defeito do modelo em si, mas sim que os mecanismos de treino e benchmark recompensam suposições excessivamente confiantes em vez de honestidade. O artigo sugere mudar a forma de pontuação dos benchmarks, não penalizando as respostas “não sei” do modelo, e reajustar os rankings existentes para resolver este problema central e promover um desenvolvimento mais fiável dos modelos de AI. (Fonte: TheTuringPost)

Exploração da arquitetura de memória “real” para LLMs: Camada de memória persistente que vai além do RAG : Desenvolvedores estão a explorar a criação de uma camada de memória de longo prazo “real” para LLMs, em vez do modelo tradicional de RAG (Retrieval-Augmented Generation). Eles construíram um sistema “memória como serviço” (BrainAPI) que armazena conhecimento através de embeddings e estruturas de grafo, permitindo que os Agents recordem factos, documentos ou interações passadas como se tivessem uma memória persistente. Isso levanta a discussão sobre se a memória da AI deve ser uma base de dados externa ou pesos adaptativos internos, visando resolver a falta de contexto preciso dos LLMs em sessões cruzadas. (Fonte: Reddit r/artificial)

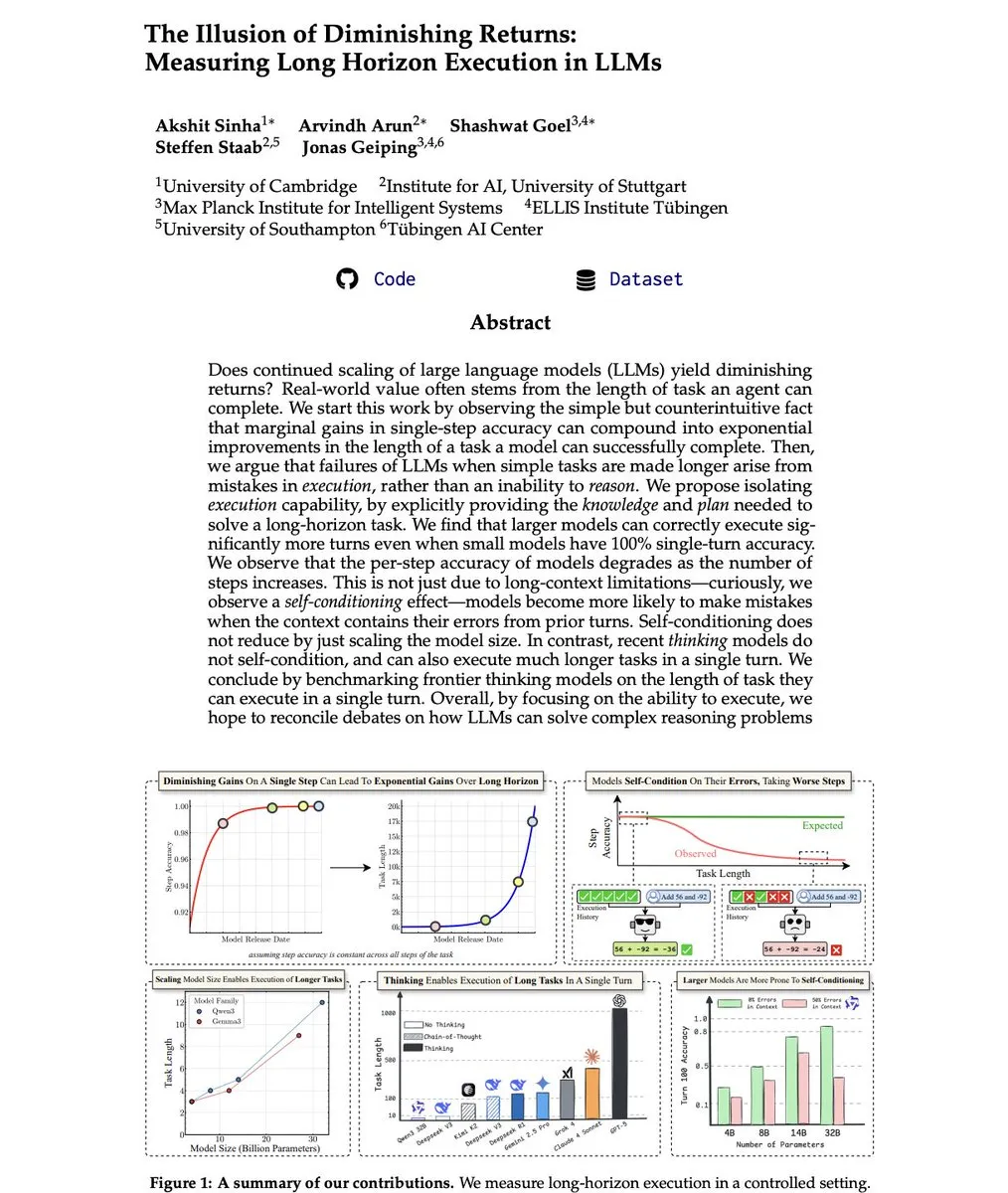

Estudo sobre execução de longo alcance em LLMs: A desaceleração do progresso da AI é uma “ilusão” : Um artigo intitulado “The Illusion of Diminishing Returns: Measuring Long Horizon Execution in LLMs” aponta que a ideia de uma desaceleração no progresso da AI é uma “ilusão”. A pesquisa mostra que o test-time scaling traz benefícios significativos para AI Agents autónomos de longo alcance, e que o progresso lento na precisão de um único passo do modelo é suficiente para gerar um crescimento super-exponencial na capacidade de execução de longo alcance. O estudo enfatiza a necessidade de continuar a focar na escala do modelo e na computação em tempo de teste para impulsionar o futuro da Agentic AI. (Fonte: lateinteraction, Reddit r/MachineLearning)

Habilidades e recursos essenciais para engenheiros e pesquisadores de AI : A comunidade discutiu as habilidades e recursos essenciais necessários para engenheiros e pesquisadores de AI. Isso inclui uma compreensão profunda da arquitetura da GPU, estratégias eficientes de treino de LLM e a capacidade de implantar modelos e construir sistemas de ponta a ponta. Para estudantes e profissionais que desejam entrar ou aprofundar-se no campo da AI, dominar este conhecimento central e habilidades práticas é crucial. (Fonte: Reddit r/deeplearning, Reddit r/deeplearning, Reddit r/deeplearning)

💼 Negócios

OpenAI e Microsoft chegam a acordo revisado, aceleram a exploração de modelos de lucro : A OpenAI e a Microsoft chegaram a um acordo revisado, mas os detalhes específicos ainda não foram divulgados. Este movimento ocorre enquanto a OpenAI busca a sua transição para um modelo de lucro e enfrenta o desafio de precisar de mais utilizadores pagantes. O acordo pode envolver novos termos de colaboração ou estruturas de investimento para apoiar o desenvolvimento contínuo e os esforços de comercialização da OpenAI. (Fonte: MIT Technology Review)

Mistral AI conclui ronda de financiamento Série C de 1.7 mil milhões de euros, liderada pela ASML, avaliada em 14 mil milhões de dólares : A Mistral AI anunciou a conclusão de uma ronda de financiamento Série C de 1.7 mil milhões de euros (aproximadamente 2 mil milhões de dólares), liderada pela fabricante holandesa de equipamentos de semicondutores ASML, avaliando a empresa em 14 mil milhões de dólares. Este enorme financiamento consolidará ainda mais a competitividade da Mistral AI no campo da AI, acelerando o desenvolvimento dos seus modelos e a expansão do mercado, e destaca também o investimento estratégico de gigantes dos semicondutores no futuro desenvolvimento da AI. (Fonte: dl_weekly)

xAI demite 500 funcionários de treino de Grok AI, levanta preocupações sobre o impacto da AI no emprego : A empresa xAI de Elon Musk demitiu 500 funcionários responsáveis pelo treino do Grok AI. Esta ação gerou discussões sobre o impacto da AI no mercado de trabalho, especialmente se a própria AI substituirá os seus desenvolvedores e treinadores. Esta demissão pode refletir a otimização de custos ou o ajuste de estratégias de treino da xAI, mas sem dúvida aumentou as preocupações públicas sobre as perspetivas de emprego na era da AI. (Fonte: Reddit r/ChatGPT)

🌟 Comunidade

“Alucinação” e credibilidade de modelos de AI: Preocupações dos utilizadores com a autenticidade do conteúdo de AI : As redes sociais discutem amplamente o problema da “alucinação” em conteúdos gerados por modelos de AI, especialmente na criação artística e notícias. Os utilizadores expressam ceticismo sobre a “alma” e a originalidade das obras de arte geradas por AI, preocupados com a proliferação de notícias falsas nas redes sociais. A pesquisa da OpenAI sugere que a alucinação do modelo pode resultar de mecanismos de treino e benchmark que recompensam suposições excessivamente confiantes. Além disso, a aplicação da AI em publicidade, como uma loja de Kebab usando imagens de AI, também levantou discussões sobre a autenticidade e ética do conteúdo. (Fonte: Reddit r/artificial, Reddit r/artificial, teortaxesTex)

Impacto da AI no mercado de trabalho: Colaboração entre humanos e AI ou substituição por AI : A discussão sobre o impacto da AI no mercado de trabalho continua a aquecer. Por um lado, alguns acreditam que “você pode ser substituído por alguém que usa AI, não pela AI em si”, enfatizando a importância dos humanos dominarem as ferramentas de AI. Por outro lado, o incidente da demissão de 500 funcionários de treino de Grok AI pela xAI levantou diretamente preocupações sobre a AI substituir empregos humanos, especialmente aqueles diretamente relacionados ao desenvolvimento e treino de AI. (Fonte: Ronald_vanLoon, Reddit r/ChatGPT)

Segurança e alinhamento da AI: Do pessimismo aos desafios práticos : A segurança e o alinhamento da AI são focos de discussão na comunidade. Pessimistas como Eliezer Yudkowsky alertam que a AI pode levar à extinção humana, apelando ao encerramento de empresas de AI. Demis Hassabis, CEO da DeepMind, argumenta que a AI atual está longe de atingir a “inteligência de nível de doutoramento”, enfatizando que ainda comete erros básicos. Ao mesmo tempo, pesquisadores estão a explorar ativamente as causas profundas do “comportamento problemático” dos modelos de AI para resolver potenciais problemas de desalinhamento. (Fonte: teortaxesTex, shaneguML, MillionInt, NeelNanda5, RichardMCNgo, ylecun, ClementDelangue, scaling01, 量子位, Reddit r/ChatGPT)

Aplicações da AI no setor financeiro: Oportunidades e riscos coexistem : Um utilizador partilhou a sua experiência de duplicar as suas poupanças no mercado de ações em três meses com a ajuda do ChatGPT, desencadeando uma discussão sobre as aplicações da AI no setor financeiro. Embora alguns considerem que foi apenas uma coincidência num mercado em alta, outros apontam que a AI pode fornecer maus conselhos de investimento, mas o seu potencial em análise de mercado e triagem ainda é reconhecido. Ao mesmo tempo, há uma conceção humorística de um “Cursor para trading”, refletindo uma atitude de expectativa e cautela em relação às aplicações financeiras da AI. (Fonte: Reddit r/ChatGPT)

Desempenho de AI Agent e LLM: Modelos de inferência, contexto longo e equilíbrio de eficiência : A comunidade debate o papel dos modelos de inferência em LLMs, com alguns utilizadores a considerá-los um desperdício de tokens, enquanto outros enfatizam o seu valor crucial em tarefas complexas, seguimento de instruções e cenários sociais. A melhoria da capacidade de processamento de contexto longo é vista como um sinal significativo de progresso da AI. Ao mesmo tempo, discussões sobre gargalos de GPU, diferenças de desempenho entre A100 e A5000, e a escolha entre Mac Studio e PC NVIDIA em deep learning, refletem a preocupação dos utilizadores com o desempenho do hardware de AI e a relação custo-benefício. (Fonte: Reddit r/LocalLLaMA, Reddit r/deeplearning, Reddit r/deeplearning, Reddit r/deeplearning)

Valor prático da AI no trabalho diário: Resolução de problemas práticos : Um utilizador partilhou a sua experiência de usar o ChatGPT para resolver um problema operacional com uma máquina de embalar cartão no supermercado onde trabalha, demonstrando o potencial da AI na resolução de problemas práticos no trabalho diário. Este caso mostra que a AI não é apenas uma ferramenta para campos de alta tecnologia, mas também pode melhorar a eficiência em indústrias comuns e ajudar os funcionários a enfrentar desafios. (Fonte: Reddit r/ArtificialInteligence)

Impacto da AI no pensamento crítico: Cuidado com a terceirização do cérebro : Um artigo da MIT Technology Review aponta que o pensamento crítico não deve ser terceirizado para chatbots, desencadeando uma discussão sobre como a AI pode mudar a forma como os humanos pensam. Os utilizadores preocupam-se que a dependência excessiva da AI possa enfraquecer a capacidade de pensamento independente dos humanos, enfatizando a importância de manter a vigilância e o pensamento crítico enquanto se desfruta da conveniência da AI. (Fonte: MIT Technology Review)

Problemas de desempenho do ChatGPT: Congelamentos, limites de taxa e alternativas : Utilizadores do ChatGPT queixam-se de congelamentos da janela devido a conversas muito longas, limites de taxa e instabilidade do serviço. Alguns utilizadores até afirmam que o GPT-4o os aconselhou a mudar para concorrentes. Estes problemas refletem os desafios da OpenAI em fornecer um serviço estável e eficiente, levando alguns utilizadores a considerar alternativas como o Claude e a desencadear discussões sobre o comportamento do LLM e os limites da janela de contexto. (Fonte: Reddit r/ArtificialInteligence, Reddit r/ChatGPT, Reddit r/ChatGPT)

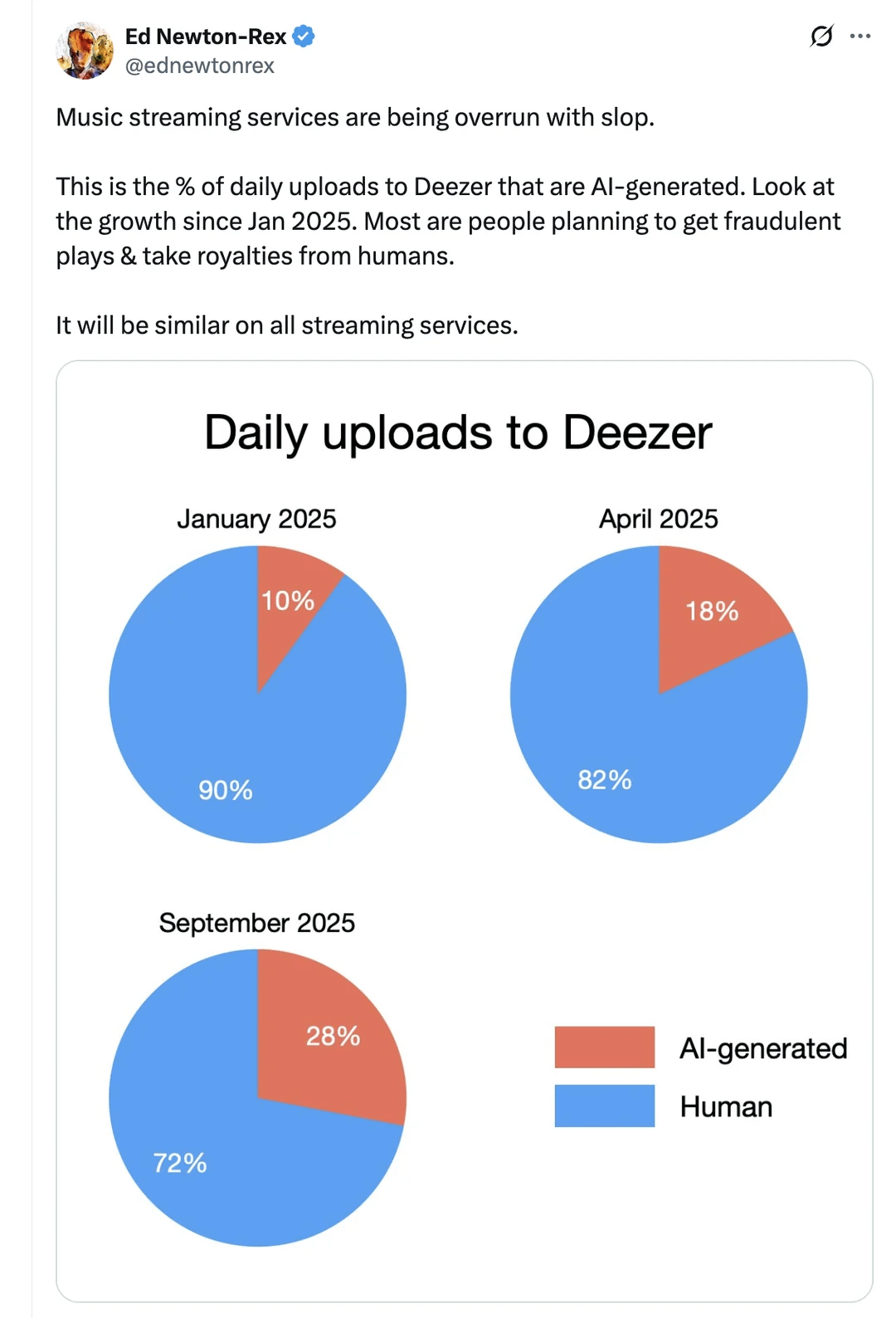

Música gerada por AI inunda serviços de streaming, levanta controvérsias sobre direitos autorais e qualidade : Os serviços de streaming de música estão a ser “inundados” por canções geradas por AI, desencadeando uma ampla discussão sobre direitos autorais, qualidade do conteúdo e ética criativa. Os utilizadores questionam a “fraudulência” e a “falta de alma” das canções de AI, e exploram os limites entre a criação musical por AI e a criação humana, bem como o impacto potencial no futuro da indústria musical. (Fonte: Reddit r/artificial)

Processos de direitos autorais de AI continuam a aumentar: Encyclopædia Britannica processa Perplexity : A Encyclopædia Britannica e a Merriam-Webster processaram o motor de respostas de AI Perplexity por alegada infração de direitos autorais. Este é um dos casos crescentes de processos de direitos autorais no campo da geração de conteúdo por AI, destacando os desafios legais e éticos de equilibrar a inovação com a proteção de direitos autorais quando a AI utiliza dados existentes para treino e geração de conteúdo. (Fonte: MIT Technology Review)

Escassez de talentos em AI e lacuna de habilidades: Desafios enfrentados pelos líderes : A escassez de talentos em AI e tecnologia está a tornar-se um obstáculo ao crescimento empresarial, sendo considerada um “sinal de alerta para todos os líderes”. Isso indica que, no contexto do rápido desenvolvimento da tecnologia de AI, a necessidade de formação de talentos e melhoria de habilidades é cada vez mais urgente, e as empresas precisam tomar medidas ativas para preencher a lacuna de talentos e adaptar-se ao desenvolvimento futuro. (Fonte: Ronald_vanLoon)

O “paradoxo populacional” de Elon Musk: Contradição entre robôs e taxa de natalidade : A comunidade discutiu o “paradoxo” de Elon Musk sobre o declínio populacional e o desenvolvimento da robótica. Por um lado, ele preocupa-se com a queda da taxa de natalidade e apela ao aumento da população; por outro lado, ele investe pesadamente em AI e robótica, tecnologias que podem automatizar uma grande quantidade de trabalho, reduzindo a necessidade de mão de obra. Isso levanta reflexões sobre o futuro papel da humanidade, o rendimento básico universal e o impacto social da AI. (Fonte: Reddit r/ArtificialInteligence)

💡 Outros

Interação de voz por AI: Elementos chave para construir uma experiência semelhante à humana : A chave para construir uma voz de AI semelhante à humana reside no design do sistema, e não no modelo em si. Para alcançar uma voz de AI natural e fluida, cinco elementos essenciais devem ser satisfeitos: latência de resposta de ponta a ponta inferior a 300 milissegundos, suporte para concorrência em larga escala, suporte para mais de 30 idiomas com troca contínua, troca contínua de múltiplos Agents, e testes completos de interrupções, ruído de fundo e troca de contexto através de simulação antes da produção. Além disso, a capacidade de integração empresarial (leitura/escrita em tempo real em CRM, acionamento de ferramentas, etc.) também é crucial para garantir que a voz de AI possa ser profundamente integrada nos processos de negócio. (Fonte: Ronald_vanLoon)

Cohere e Dell colaboram, oferecem soluções de AI locais de nível empresarial : A Cohere e a Dell Technologies colaboraram para ajudar as empresas a implementar soluções de AI seguras e localizadas. Esta parceria foca-se na privacidade dos dados, velocidade e escala, através do Cohere North e da Dell AI Factory, tornando o processo de adoção da AI mais suave e satisfazendo os requisitos rigorosos das empresas para a implementação da AI. (Fonte: cohere)

Toronto School of Foundation Modelling recebe patrocínio de computação da Modal : A Toronto School of Foundation Modelling recebeu a Modal como sua patrocinadora de computação. A escola utilizará os Modal Notebooks, um ambiente Python no navegador com suporte a GPU, que permite inicialização em segundos e colaboração em tempo real, capacitando os alunos a iniciar imediatamente experimentos de AI. Esta iniciativa fornecerá um poderoso suporte computacional para os aprendizes de modelos de base de AI. (Fonte: JayAlammar)