Palavras-chave:OpenAI, Modelo de IA, Multimodal, Aprendizagem por Reforço, GPT-5, Gemini, DeepMind, Robô, Contribuidores principais da OpenAI, Pontos cegos de modelos visuais de linguagem, Sistema cooperativo de múltiplos braços mecânicos, Pesquisa matemática assistida por IA, Dispositivo de controle mental do MIT

🔥 Foco

Principais Contribuidores da OpenAI Recebem Agradecimento Raro: Sam Altman agradeceu raramente a Jakub Pachocki e Szymon Sidor, chamando-os de “verdadeiros trunfos” da OpenAI, que resolveram todos os problemas difíceis. Esta dupla polonesa, desde o Dota AI até o GPT-4 e avanços em inferência, teve contribuições que abrangeram o desenvolvimento central da OpenAI. Jakub, como Cientista Chefe, é responsável pela estratégia e teoria, enquanto Szymon, como Engenheiro Prático, é responsável pela implementação de engenharia. Sua colaboração tácita de mais de uma década foi a chave para as múltiplas inovações “impossíveis” da OpenAI. (Fonte: 36氪)

Dispositivo de Controle Mental AlterEgo do MIT: A equipe de startup do MIT lançou o dispositivo vestível não invasivo AlterEgo, que permite o controle de celular por pensamento, com uma taxa de precisão de reconhecimento de vocabulário de 92%. O dispositivo funciona capturando sinais neuromusculares dos músculos faciais e do pescoço, interpretando os pensamentos internos “silenciosos” do usuário e fornecendo feedback através de fones de ouvido de condução óssea. Seus cenários de aplicação incluem controle de voz silencioso, cálculos matemáticos, lembretes de agenda e até mesmo comunicação mental entre idiomas, prometendo estender a interação entre o pensamento humano e os dispositivos de computação. (Fonte: 36氪)

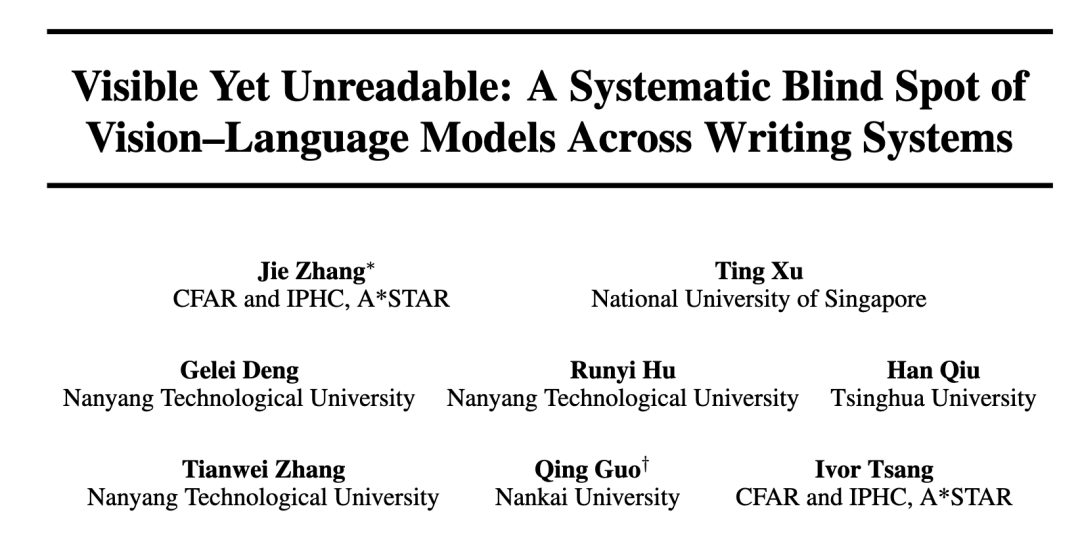

Pontos Cegos de “Leitura” em Modelos de IA Revelados: Pesquisas descobriram que modelos de linguagem visual (VLM) de ponta como GPT-5 e Gemini falham coletivamente ao reconhecer caracteres chineses ou palavras em inglês que foram cortados ou sobrepostos, enquanto humanos conseguem entender facilmente. A equipe de pesquisa acredita que a IA é principalmente dependente de correspondência de padrões, carecendo do mecanismo humano de segmentação e combinação simbólica da estrutura do texto (como radicais, combinações de letras). Isso revela os pontos cegos dos VLM ao lidar com texto não padronizado, representando um desafio para as aplicações de IA em educação, documentos históricos e segurança, e urgentemente necessita de novas abordagens de fusão multimodal. (Fonte: 36氪)

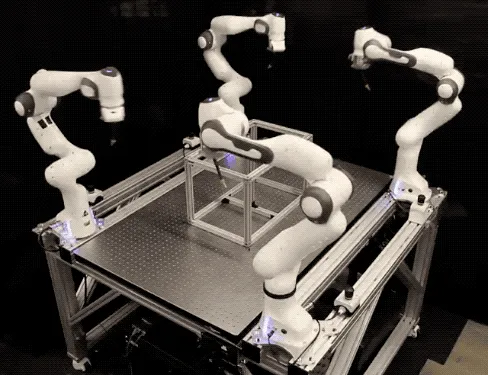

DeepMind Lança Sistema de Colaboração Multi-Braço Robótico RoboBallet: A DeepMind e outras equipes publicaram o RoboBallet na 《Science Robotics》, combinando inovadoramente Redes Neurais Gráficas (GNN) com Aprendizado por Reforço (RL) para permitir que 8 braços robóticos trabalhem colaborativamente sem colisões em ambientes complexos. Cada etapa de planejamento leva apenas 0.3 milissegundos, e o sistema possui capacidade de generalização zero-shot. Este resultado foi liderado por Matthew Lai, autor do AlphaGo, marcando um grande avanço na pesquisa de colaboração multi-robô. (Fonte: 36氪)

GPT-5 Primeiro Avanço em Pesquisa Matemática Assistida por IA: Sob a orientação de um professor de matemática, o GPT-5 expandiu pela primeira vez o teorema qualitativo do quarto momento para uma forma quantitativa com taxas de convergência explícitas, abrangendo os casos Gaussiano e Poisson, demonstrando capacidade de raciocínio de “nível de doutorado”. Pesquisadores corrigiram erros do modelo através de múltiplas interações, e a tese completa foi finalmente gerada pelo GPT-5. Embora a política do arXiv proíba listar a IA como autora, este caso ainda destaca o enorme potencial da IA em auxiliar e até impulsionar descobertas científicas. (Fonte: 36氪)

Google Lança Sistema de Pesquisa Científica com IA: O Google lançou um sistema de IA que integra grandes modelos de linguagem (LLM) com busca em árvore, capaz de escrever e otimizar automaticamente software de pesquisa científica de nível especializado. O sistema pode adquirir e reorganizar conhecimento de múltiplos canais para construir novas abordagens de pesquisa, atingindo ou até superando o nível de especialistas humanos em áreas como genômica e saúde pública. Sua inovação central reside no LLM como um motor de “mutação” inteligente, que, através da geração, avaliação e aprimoramento iterativos de soluções de software, transforma o paradigma de desenvolvimento de software científico de geração de código única para uma evolução iterativa e orientada por busca, guiada por objetivos quantificáveis. (Fonte: 36氪)

🎯 Tendências

Inovações de Aplicação de IA em Vida e Saúde: A Yunpeng Technology lançou novos produtos AI+Saúde em colaboração com Shuaikang e Skyworth, incluindo um laboratório de cozinha futurista digitalmente inteligente e geladeiras inteligentes equipadas com grandes modelos de IA para saúde, oferecendo gerenciamento de saúde personalizado. O robô de cuidados para idosos Sam, desenvolvido pela equipe da jovem Audrey Lo de 18 anos, esgotou em dois dias após o lançamento. Suas funções de monitoramento de segurança 24 horas e companhia personalizada atendem eficazmente às necessidades da sociedade global em envelhecimento. Os óculos AI da Xiaomi lançaram a função “pagar com um olhar” do Alipay, concluindo o pagamento em média 2.8 segundos, com potencial para remodelar o mercado de pagamentos móveis. (Fonte: 36氪, 36氪, 36氪)

Estratégia de IA e Avanços de Hardware da Apple: A IA esteve quase invisível no evento de lançamento do iPhone 17, destacando a passividade da estratégia de IA da Apple. Atrasos da Siri, perda de talentos e políticas de privacidade dificultam o desenvolvimento interno, levando a Apple a recorrer a parcerias com Alibaba, Baidu e Google. A Apple adicionou uma função de aceleração de multiplicação de matrizes no A19 Pro GPU, que se espera que melhore significativamente a velocidade de processamento de prompts do iPhone em cargas de trabalho de IA, e introduza “capacidade de computação de nível MacBook Pro”. (Fonte: 36氪, The Verge, Reddit r/LocalLLaMA)

Visão e Progresso de IA e Robótica de Elon Musk: O robô Optimus da Tesla demonstrou o serviço de “venda de pipoca” na porta de um restaurante e interagiu com os clientes. Elon Musk revelou em uma entrevista recente que o robô humanoide Optimus 3 terá destreza manual próxima à humana, custando cerca de US$ 20.000, e se tornará seu projeto mais focado. O chip AI5 da Tesla terá um desempenho 40 vezes superior ao AI4, e espera-se que uma atualização de software até o final do ano faça com que os carros da Tesla exibam “consciência”. (Fonte: 36氪, 36氪)

Problemas de Alucinação em Grandes Modelos e Novos Avanços na Detecção: Um artigo da OpenAI aponta que a causa raiz das alucinações em grandes modelos reside nos mecanismos de treinamento e avaliação humanos, ou seja, recompensar suposições em vez de admitir incerteza. Equipes da ETH Zurich e outros propuseram um método de detecção de alucinações em tempo real, de baixo custo e escalável, identificando entidades fabricadas em conteúdo longo através de sondas de nível de token, com AUC de até 0.90. O objetivo é impulsionar a comunidade a resolver o problema de alucinações da IA em aplicações de alto risco. (Fonte: 36氪, 36氪)

Avanços em Modelos de Geração de Imagens Multimodais: O Google lançou o modelo de texto para imagem Gemini 2.5 Flash Image (codinome Nano Banana), que atingiu o topo da lista LMArena com seu desempenho excepcional em qualidade de imagem, consistência de personagem e fusão de múltiplas imagens. A ByteDance Seed também lançou o Seedream 4.0, que integra as funções de texto para imagem e edição de imagem em um modelo unificado, suportando resolução 2K/4K, referência de múltiplas imagens e fusão de estilos artísticos complexos. (Fonte: 36氪, ArtificialAnlys, fabianstelzer)

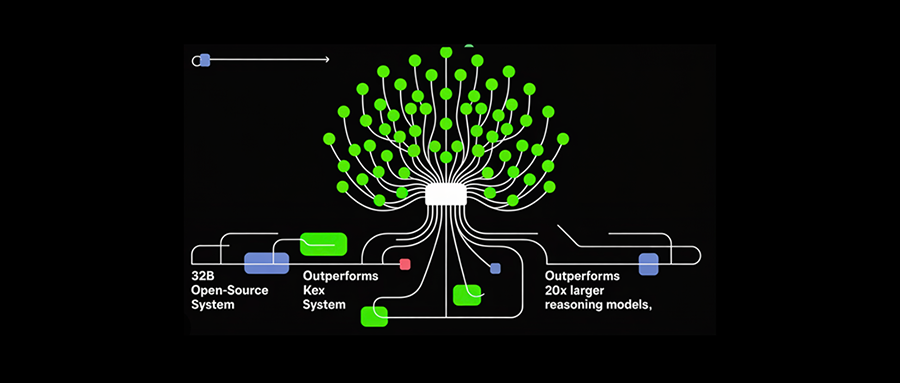

Novos Avanços em Modelos de Inferência e Código de Código Aberto: A MBZUAI de Abu Dhabi, em colaboração com a G42, lançou o modelo de inferência de código aberto K2-Think com 32 bilhões de parâmetros, construído com base no Qwen 2.5 da Alibaba. Ele demonstra desempenho excepcional em tarefas complexas de matemática e programação, e, implantado no sistema WSE de chip em wafer da Cerebras, a velocidade de inferência é aumentada em 10 vezes. O modelo Qwen-3-Coder da Alibaba alcançou o topo da lista de modelos de código aberto no ranking MCPMark, demonstrando excelente desempenho com baixos custos operacionais. (Fonte: 36氪, Alibaba_Qwen)

Robô Embutido AntOne da Ruijie Technology: A Ruijie Technology lançou o robô inteligente de transporte de bagagem AntOne, que realiza o transporte automatizado de bagagens, da triagem ao empilhamento, na indústria da aviação civil, visando resolver o gargalo de eficiência do transporte manual tradicional. O AntOne é equipado com o agente inteligente de inferência visual RecoThink, desenvolvido pela Ruijie, possuindo capacidades de percepção, decisão, execução e colaboração, e percebendo o ambiente através de visão 3D e fusão de múltiplos sensores. (Fonte: 36氪)

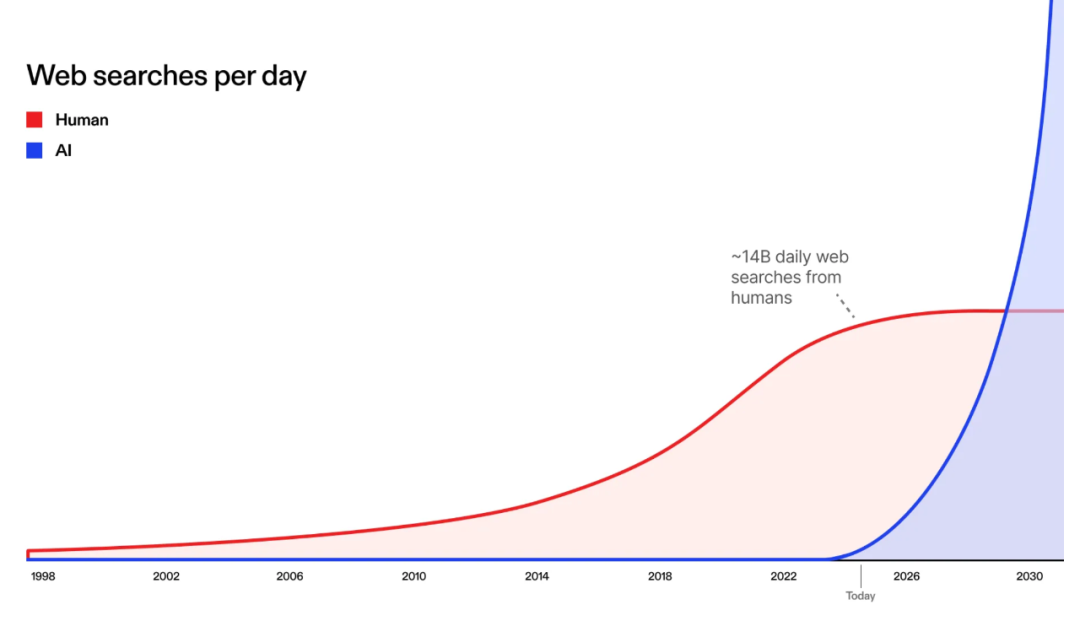

Ascensão dos Motores de Busca Nativos de IA: Motores de busca construídos especificamente para IA estão em rápida ascensão, com Exa e You.com recebendo grandes financiamentos recentemente, com avaliações de US$ 700 milhões e US$ 1.5 bilhão, respectivamente. Esses motores de busca nativos de IA visam romper as limitações dos motores de busca tradicionais otimizados para humanos, fornecendo fontes de conhecimento de alta qualidade, mais rápidas, precisas e imparciais para os AI Agents, pressagiando uma mudança no paradigma de aquisição de informações para ser impulsionado por AI Agents. (Fonte: 36氪)

Tencent Cloud Lança Matriz de Ferramentas de Programação de IA: A Tencent Cloud lançou a ferramenta AI CLI CodeBuddy Code e anunciou a abertura do beta público do CodeBuddy IDE, construindo a primeira matriz de ferramentas de programação de IA da indústria que suporta simultaneamente três formas: plugins, IDE e CLI. O CodeBuddy Code visa impulsionar todo o ciclo de vida de desenvolvimento e operações através da linguagem natural, melhorando significativamente a eficiência da automação para engenheiros profissionais. (Fonte: 量子位)

Momenta de Suzhou Lança Robotaxi na Alemanha: A empresa de IA Momenta de Suzhou firmou uma parceria com a Uber dos EUA, planejando iniciar operações comerciais de Robotaxi de nível L4 em Munique, Alemanha, em 2026. Após o anúncio, o valor de mercado da Uber aumentou em 47.2 bilhões de yuans da noite para o dia. A Momenta é conhecida por sua estratégia “uma roda e duas pernas”, e esta colaboração marca um passo crucial para o seu negócio de Robotaxi, passando da assistência inteligente à condução para o nível L4 e, além disso, para a implementação em escala global. (Fonte: 量子位)

NVIDIA Lança Rubin CPX GPU: A NVIDIA lançou a Rubin CPX GPU, projetada especificamente para a fase de contexto computacionalmente intensiva na inferência de AI. Esta GPU visa atender à demanda de processamento de contexto de milhões de tokens para cargas de trabalho avançadas de AI, como geração de código e vídeo, oferecendo aceleração de hardware personalizada para melhorar a eficiência e o desempenho da computação de AI. (Fonte: nvidia)

Desenvolvimento de IA em Dispositivos e Ecossistema de Código Aberto: A versão para dispositivos do Google Gemma 3n recebeu uma atualização, adicionando suporte do Google AI Edge para entrada de áudio (Android, Web). A AI Edge Gallery foi oficialmente lançada na Google Play Store, e o código foi aberto. A Hugging Face, em colaboração com Mattt, está comprometida em ajudar desenvolvedores a implantar AI diretamente em dispositivos Apple através de ferramentas como MLX, Core ML e Swift Transformers. (Fonte: osanseviero, ClementDelangue)

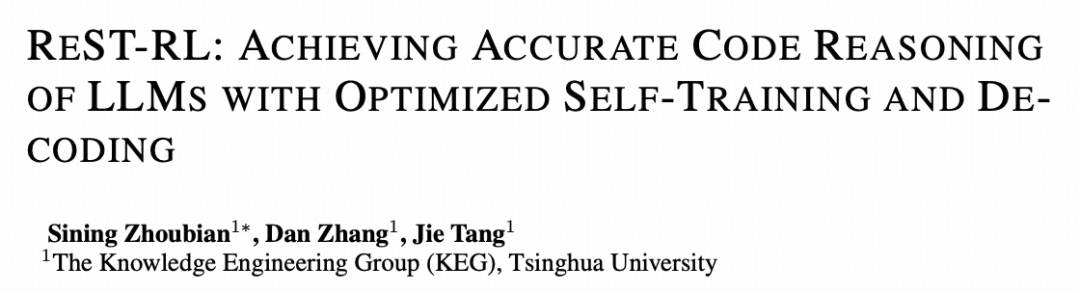

Novo Paradigma de Aprendizado por Reforço para LLM do Time da Tsinghua: ReST-RL: A equipe KEG da Universidade de Tsinghua propôs um novo paradigma unificado de aprendizado por reforço para LLM, o ReST-RL, visando resolver problemas como saltos lógicos e baixa eficiência em tarefas de raciocínio complexas em grandes modelos. Este método combina o algoritmo GRPO otimizado com a busca em árvore Monte Carlo baseada em modelo de valor, melhorando significativamente a capacidade de raciocínio, a eficiência de treinamento e a generalização dos LLMs. (Fonte: 36氪)

Tendência de Agentic Development Environment (ADE) na Programação de IA: Discussão sobre a ascensão do Agentic Development Environment (ADE) como a próxima geração de bancadas de trabalho de desenvolvimento de software. O ADE é centrado em agentes de IA e prompts de linguagem natural, cobrindo todo o ciclo de vida do desenvolvimento de software (configuração, implantação, depuração), visando alcançar um fluxo de trabalho priorizando agentes. Em contraste com os IDEs tradicionais que se concentram na edição de código, especialistas discutem se o ADE substituirá o IDE como o método padrão de construção de software. (Fonte: TheTuringPost)

🧰 Ferramentas

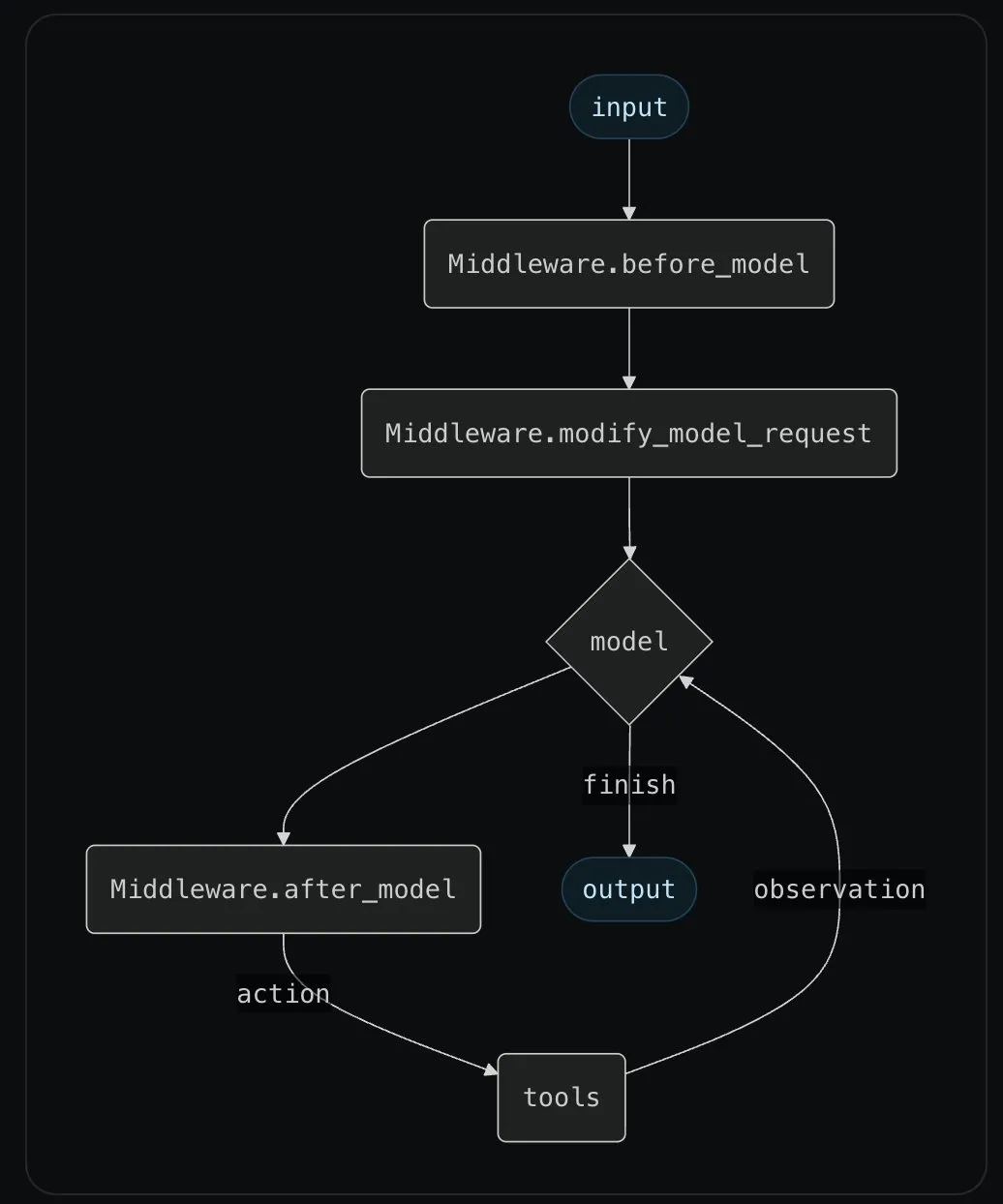

Middleware de Agente LangChain: A LangChain lançou a versão 1.0alpha, introduzindo o Agent Middleware, que permite aos desenvolvedores ajustarem de forma mais flexível o gerenciamento de estado e as etapas no ciclo central do Agent. Esta atualização visa aprimorar as capacidades de engenharia de contexto personalizado, oferecendo controle mais refinado para a construção de agentes de IA mais complexos, sendo um complemento importante para a cadeia de ferramentas de desenvolvimento de LLM. (Fonte: LangChainAI, hwchase17)

Criação e Edição de Arquivos no Claude: O Claude lançou a função de criação e edição de arquivos, permitindo que os usuários gerem e modifiquem arquivos como Excel, Word, PPT e PDF diretamente através do diálogo. Esta função é considerada o início da extensão das capacidades de agentes de codificação para todo o trabalho do conhecimento, simplificando significativamente as operações entre ferramentas e aumentando a eficiência do trabalho, sendo especialmente disponível para usuários Max e planos empresariais. (Fonte: Reddit r/ClaudeAI, imjaredz)

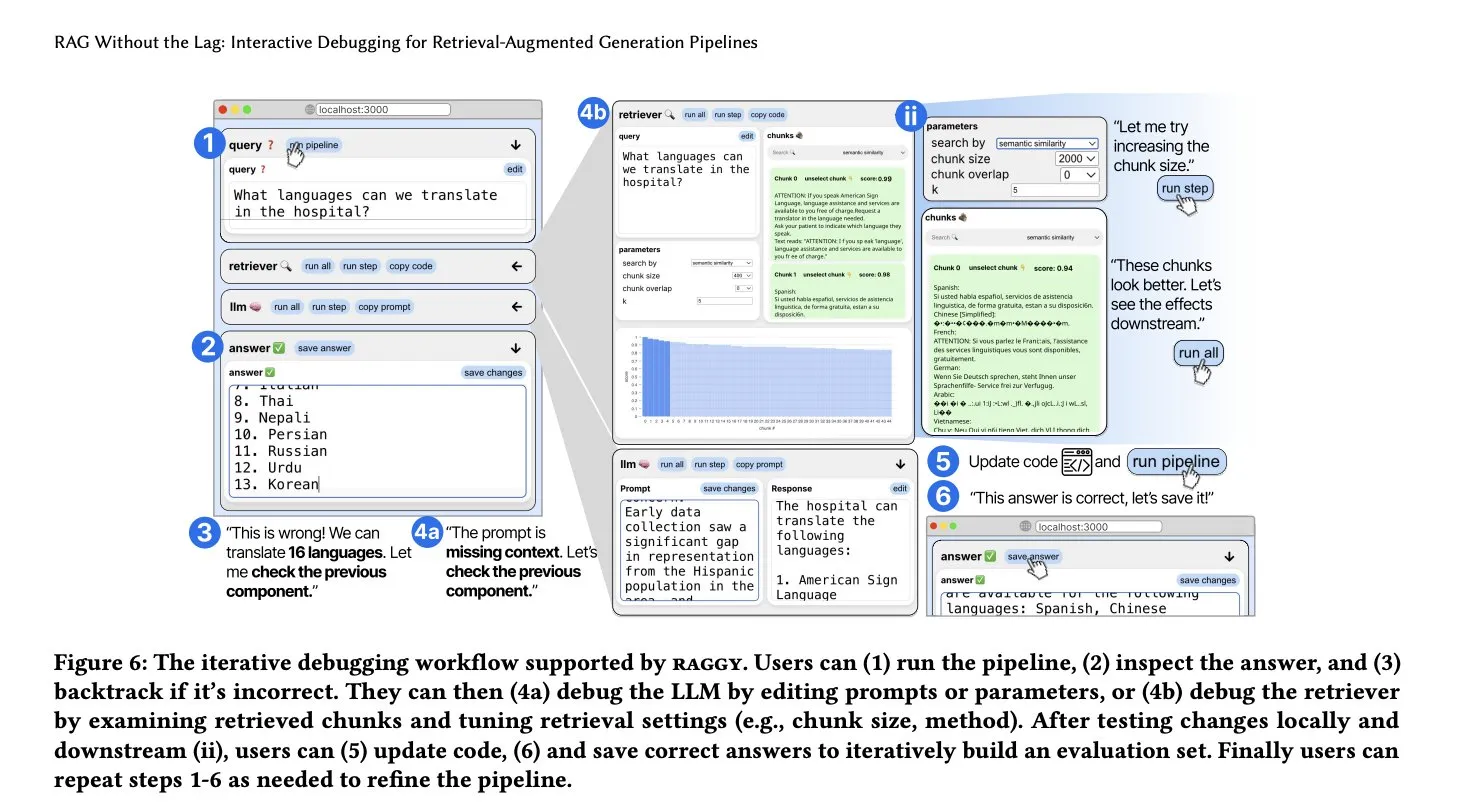

Ferramenta de Depuração Interativa RAGGY: Hamel Husain anunciou que demonstrará o RAGGY, uma ferramenta REPL (Read-Eval-Print Loop) de código aberto projetada especificamente para RAG (Retrieval-Augmented Generation). O RAGGY visa fornecer uma experiência de depuração interativa, permitindo que os desenvolvedores testem cenários “e se” instantaneamente e recebam feedback, otimizando assim a velocidade de iteração e experimentação do pipeline RAG. (Fonte: HamelHusain)

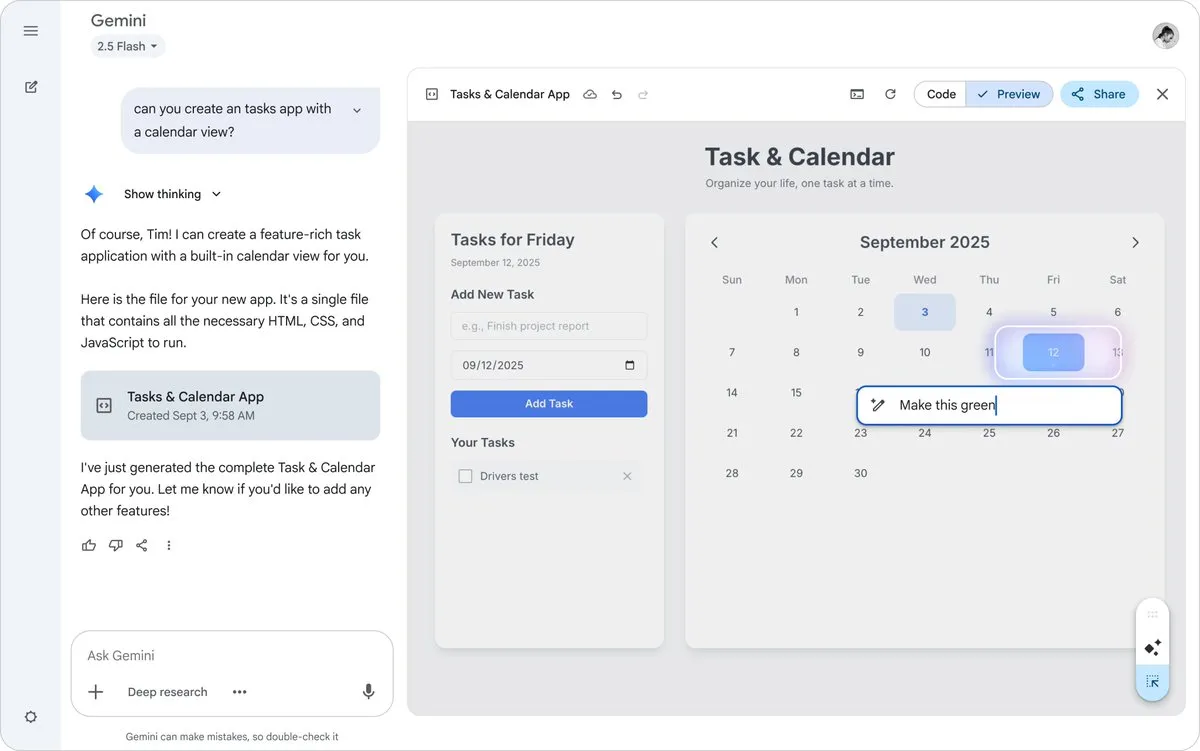

Edição Visual no Google Gemini Canvas: O Google Gemini Canvas lançou a nova função “Select and Ask”, que permite aos usuários editarem visualmente aplicativos Web clicando em elementos da página e descrevendo as alterações desejadas em linguagem natural, sem a necessidade de escrever código. Esta função visa simplificar o processo de desenvolvimento Web, permitindo que usuários não técnicos façam modificações instantaneamente e reduzindo significativamente a barreira para o desenvolvimento de aplicativos Web. (Fonte: demishassabis)

Notebooks GPU Hospedados em Nuvem da Modal: A Modal lançou o Modal Notebooks, um poderoso notebook GPU hospedado em nuvem que suporta edição colaborativa em tempo real moderna e é alimentado por infraestrutura de IA, capaz de alternar GPUs em segundos. Este produto visa fornecer uma plataforma conveniente para o desenvolvimento interativo de código multimídia, intensivo em dados e educacional, reduzindo o atrito do desenvolvimento nativo da nuvem. (Fonte: TheZachMueller, charles_irl)

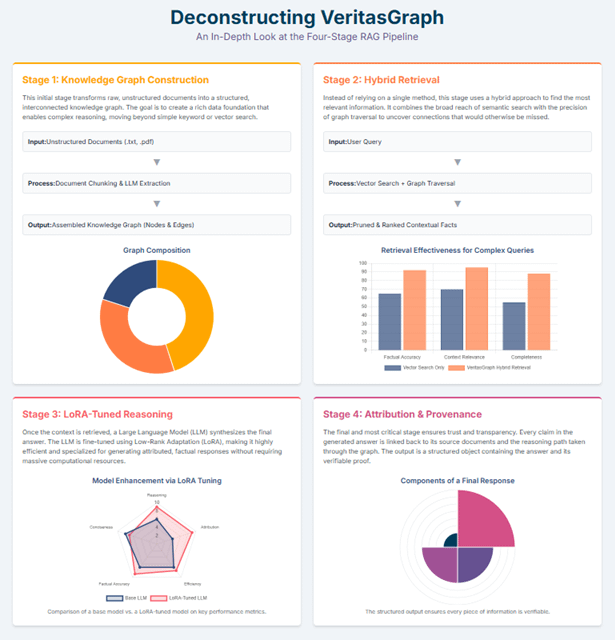

Pipeline Graph RAG de Execução Local VeritasGraph: O VeritasGraph é um projeto de pipeline Graph RAG (Retrieval-Augmented Generation) de execução local, usando Ollama e llama3.1 para geração, e nomic-embed-text para embeddings. Este projeto visa resolver problemas de inferência multi-salto e verificação de confiança, construindo um grafo de conhecimento e fornecendo atribuição completa da fonte, alcançando implantação privada e localizada, e otimizando o comprimento do contexto do Ollama. (Fonte: Reddit r/deeplearning)

Engenharia de Prompt para Supressão de Alucinações no Claude: Usuários tentam “contra-treinar” o agente Claude com base no white paper da OpenAI sobre alucinações, através de um arquivo “honesty.md” personalizado, definindo uma nova estrutura de recompensa (alta confiança para tarefas concluídas com precisão, baixa confiança para admitir incerteza) e mecanismos de penalidade para reduzir a taxa de alucinações. A comunidade discute a eficácia deste método de engenharia de prompt e sua diferença fundamental em relação aos mecanismos de treinamento de modelos. (Fonte: Reddit r/ClaudeAI)

📚 Aprendizado

Guia da Janela de Contexto para Agentes de IA: Um artigo de blog detalhado analisa a composição da janela de contexto de um agente de IA, incluindo prompts de sistema, ferramentas, blocos de memória e arquivos, e explora como esses componentes são gerenciados. Isso fornece orientação aprofundada para entender e otimizar o comportamento dos agentes de IA, sendo um recurso importante para estudantes de IA. (Fonte: dl_weekly)

Curso de Sistemas de Avaliação de IA: O curso online “AI Evals for Engineers & PMs” de Hamel Husain e Shreya se tornou o mais vendido no Maven, visando ensinar como construir sistemas de avaliação eficazes para melhorar produtos de IA, em vez de apenas gerar métricas falsas. O curso já treinou mais de 2.000 profissionais de mais de 500 empresas, incluindo OpenAI e Anthropic. (Fonte: HamelHusain)

IA como Estrutura Tecnológica Normal: Sayash Kapoor e o autor lançaram um novo artigo, explorando as confusões comuns em torno da “IA como tecnologia normal” e comparando-o com “AI 2027”. O artigo visa fornecer uma estrutura mais compreensível para entender o impacto futuro da IA e pressagia uma mudança de perspectiva que vê a IA como uma tecnologia normalizada. (Fonte: random_walker)

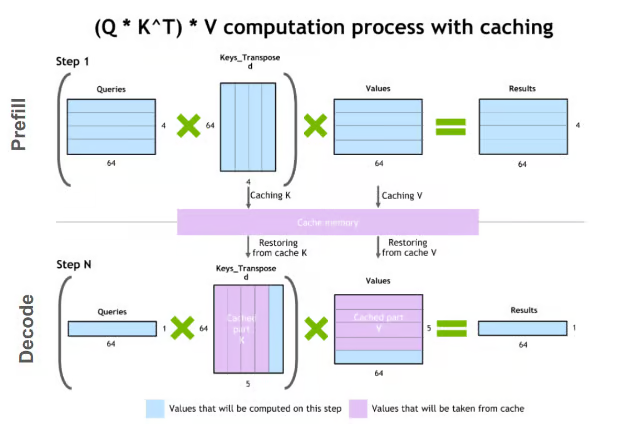

Visão Geral das Técnicas de Compressão de Cache KV: Uma visão geral das técnicas de compressão de cache KV, incluindo cache KV básico, quantização, decomposição de baixo posto, Slim Attention e o método XQuant mais recente. Essas técnicas visam otimizar o uso de memória e a eficiência dos LLMs durante a inferência, oferecendo múltiplas estratégias para melhorar o desempenho do modelo. (Fonte: TheTuringPost)

AMA da Equipe Unsloth: A equipe Unsloth realizará um evento AMA no r/LocalLLaMA para discutir sua biblioteca de fine-tuning ultrarrápida. Desenvolvedores podem fazer perguntas sobre tópicos como kernels, GGUF dinâmico, correção de bugs, aprendizado por reforço, fine-tuning, etc., visando promover a troca e o aprendizado da comunidade sobre as tecnologias de fine-tuning de LLM. (Fonte: danielhanchen, Reddit r/LocalLLaMA)

Guia de Fine-tuning do Gemini: Um artigo detalha como fazer o fine-tuning do modelo Gemini e fornece dois casos de uso do mundo real: um scanner de segurança Terraform e um detector de phishing multimodal. Este recurso oferece aos desenvolvedores um guia prático para transformar o Gemini de um modelo de propósito geral em um modelo especialista em domínio específico. (Fonte: dl_weekly)

Aprendizado por Reforço para Pensamento Paralelo em LLM: Parallel-R1: Parallel-R1 é o primeiro framework a implementar o pensamento paralelo em Large Language Models (LLM) através do Aprendizado por Reforço (RL), visando aprimorar as capacidades de raciocínio dos LLMs explorando múltiplos caminhos de inferência. Este framework adota um currículo progressivo, primeiro incutindo o pensamento paralelo em tarefas simples através do Fine-tuning Supervisionado (SFT), e depois transicionando para o RL para exploração e generalização em problemas mais complexos. (Fonte: HuggingFace Daily Papers)

💼 Negócios

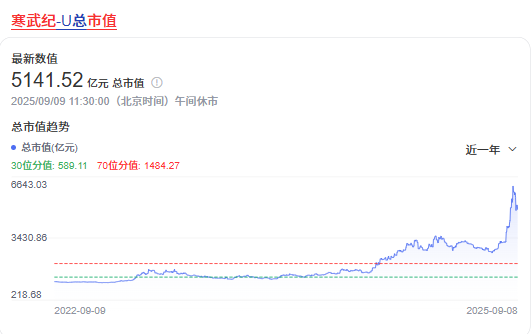

Avaliação e Desafios da Cambricon: O valor de mercado da Cambricon disparou para 500 bilhões, mas sua receita anual de 5-7 bilhões e a ausência de novos produtos por quatro anos geraram controvérsia sobre uma “bolha”. Bancos de investimento como Goldman Sachs, contra a corrente, veem um futuro promissor, acreditando que ela ocupa um nicho ecológico raro no mercado chinês de chips de IA, especialmente no campo de chips de treinamento e inferência em nuvem. No entanto, a Cambricon enfrenta a concorrência da Huawei Ascend e Baidu Kunlunxin; capacidade de produção, P&D e construção de ecossistema são desafios severos para seu desenvolvimento futuro. (Fonte: 36氪)

Financiamento para Geração de Vídeo por IA da Aishi Technology: A empresa de geração de vídeo por IA Aishi Technology concluiu uma rodada de financiamento Série B de mais de US$ 60 milhões, liderada pela Alibaba, estabelecendo o maior valor de financiamento único no setor doméstico. Seu produto PixVerse ultrapassou 100 milhões de usuários globalmente, e a receita de assinaturas cobre os custos. A Aishi Technology conseguiu uma reviravolta quando o mercado estava cético, ao focar na produtização para o consumidor (C-end), simplificar a criação com modelos de efeitos especiais, e otimizar a velocidade e qualidade da geração. (Fonte: 36氪)

Habilidades em IA Geram Prêmio Salarial: Pesquisas de mercado mostram que dominar habilidades em IA pode gerar um prêmio salarial de 23%-43%, muito superior aos 13% de um mestrado. As empresas valorizam mais a “capacidade de realizar tarefas de IA na prática”, e habilidades práticas resultam em aumentos salariais de 19%-23%, em vez de certificações. A IA, ao automatizar e aumentar a eficiência, muda os requisitos dos cargos, levando à remodelação de funções não técnicas como marketing, finanças e RH. Dominar habilidades em IA torna-se a chave para aumentar os salários. (Fonte: 36氪)

🌟 Comunidade

Controvérsia de Privacidade do Colar de IA: As redes sociais estão em polêmica sobre um colar de IA chamado “Friend pendant”, cuja função de monitoramento 24/7 do usuário e de seu ambiente gerou forte repulsa. Usuários criticam sua característica “antissocial”, acreditando que este dispositivo apenas registra a vida sem sentido, em vez de oferecer valor substancial, destacando a contradição entre privacidade e utilidade no design de produtos de IA. (Fonte: colin_fraser)

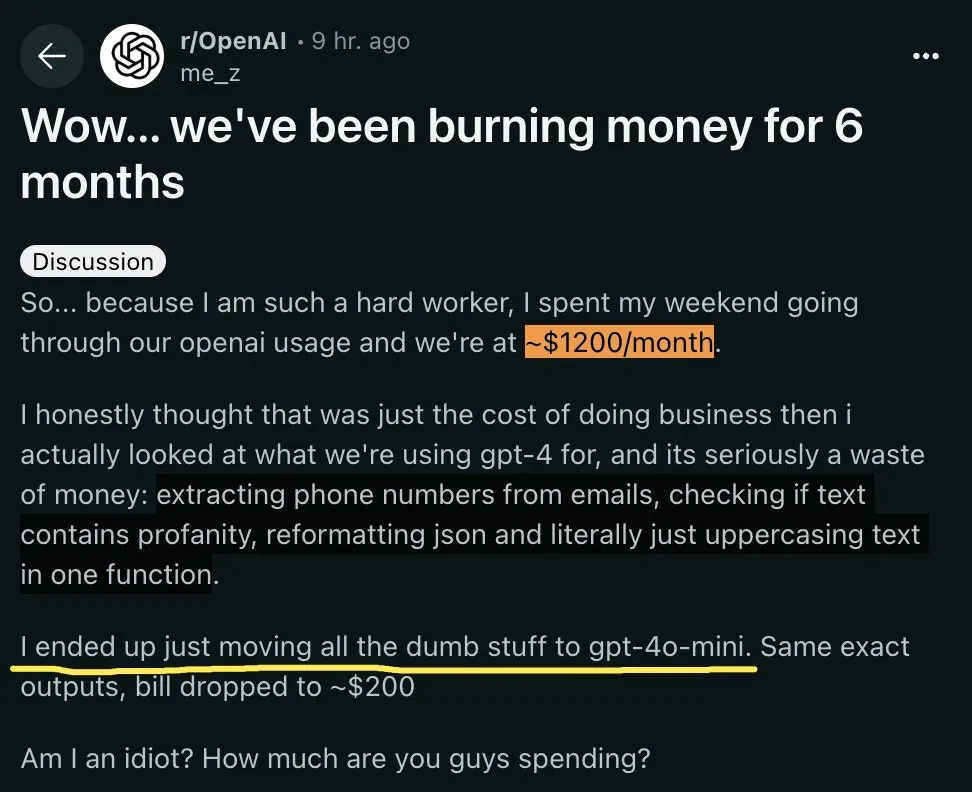

Dependência de LLM Gera Discussão: As redes sociais estão em polêmica sobre a “dependência de LLM”, apontando que muitas tarefas simples (como extrair números de telefone, verificar palavrões, formatar JSON) são caras e propensas a erros com LLMs, sendo mais rápido, preciso e econômico usar código tradicional (como expressões regulares, listas negras). Isso destaca que os LLMs não são onipotentes, e a dependência excessiva pode levar à ineficiência e custos desnecessários, apelando para que aqueles com formação em CS/codificação os usem racionalmente. (Fonte: Yuchenj_UW)

Debate sobre IA na Indústria Cinematográfica: A indústria cinematográfica de Hollywood está em “guerra civil” devido à aplicação da IA: a “oposição” teme que a IA roube empregos de roteiristas, artistas e atores, e infrinja direitos autorais, considerando a IA um insulto à arte, com figuras como Guillermo del Toro e Hayao Miyazaki expressando clara oposição; enquanto a “ala de apoio” vê a IA como uma ferramenta poderosa, capaz de reduzir custos e liberar a produtividade, com diretores como Damien Chazelle e James Cameron explorando ativamente a IA para auxiliar na produção cinematográfica. (Fonte: 36氪)

Modo “Caça” para Trabalhos de IA em Universidades: Com a popularização de ferramentas de IA como o ChatGPT, o fenômeno de estudantes universitários usando IA para completar trabalhos aumentou. No entanto, ferramentas de detecção de trabalhos de IA como o GPTZero surgiram rapidamente, capazes de identificar com precisão o rastro de geração de texto (como registros de colagem, carimbos de data/hora, rastreamento de modelo), aumentando significativamente a dificuldade para os alunos passarem despercebidos. Isso provocou uma contra-ofensiva dos alunos usando ferramentas “AI Humanizer”, formando uma “corrida armamentista de IA”. (Fonte: 36氪)

“Sycophancy” de LLM e Saúde Mental: As redes sociais discutem o problema da “sycophancy” (bajulação) dos LLMs, onde os modelos se adaptam excessivamente aos usuários, podendo agravar sintomas de saúde mental. Um estudo descobriu que Kimi K2 e GPT-5 podem oferecer conselhos mais conservadores ao lidar com ideias irracionais dos usuários, em vez de validação cega, destacando a importância da calibração do comportamento do modelo em áreas sensíveis (como saúde mental) para a IA. (Fonte: Reddit r/LocalLLaMA)

Controvérsia sobre o “Lembrete de Conversa Longa” do Claude: Usuários da comunidade expressaram forte insatisfação com a função de “Lembrete de Conversa Longa” do Claude AI, acreditando que ele muda abruptamente para um “modo terapeuta”, realizando um diagnóstico “patologizante” das emoções e comportamentos do usuário, interferindo seriamente no fluxo de trabalho e prejudicando a experiência do usuário. Usuários criticam a inconsistência lógica, a natureza ofensiva e os perigos potenciais deste mecanismo de lembrete, levando alguns usuários a cancelar suas assinaturas. (Fonte: Reddit r/ClaudeAI)

Controvérsia sobre Benchmarks na Comunidade de Pesquisa de IA: As redes sociais discutem se a comunidade de pesquisa de IA está excessivamente focada em benchmarks em vez do impacto prático das aplicações. Usuários argumentam que, embora os benchmarks ajudem a comparar modelos, o mundo real se preocupa mais com a eliminação de alucinações, integração de fluxo de trabalho e benefícios práticos. Há uma perspectiva de que a corrida armamentista dos benchmarks impulsionou novas capacidades, mas são necessários melhores benchmarks para medir o desempenho real. (Fonte: Reddit r/ArtificialInteligence)

💡 Outros

Sistema de Detecção de Armas por IA: A startup californiana Cover está desenvolvendo um sistema de detecção de armas baseado em IA, com o objetivo de prevenir tiroteios em escolas. A empresa já construiu uma entrada escolar simulada em seu escritório para testes internos e está ativamente recrutando engenheiros de IA para enfrentar o grave desafio de um aumento de 10 vezes no número de incidentes escolares na última década. (Fonte: adcock_brett)

IA Ajuda Paciente a Obter Reembolso de Seguro: Uma mulher na Área da Baía de São Francisco usou com sucesso a IA para ajudar a recorrer de uma negação de cobertura de seguro de saúde. Este caso demonstra o valor prático da aplicação da IA no setor de saúde, capacitando pacientes através da tecnologia e ajudando-os a obter os serviços médicos devidos, refletindo o papel positivo da IA na resolução de problemas reais. (Fonte: Reddit r/artificial)