Palavras-chave:Gemini 2.5 Deep Think, XBOW Agente de IA, Seed Diffusion LLM, Modelo de código aberto da OpenAI, Agente de IA, Modelo de raciocínio multimodal, Treinamento de LLM, Segurança de IA, Técnica de pensamento paralelo, Ferramenta de teste de penetração de IA, Modelo de difusão de estado discreto, Arquitetura esparsa MoE, Modelo de saúde de IA em grande escala

🔥 Foco

Lançamento do Modelo Gemini 2.5 Deep Think IMO Gold Medal : O Google DeepMind lançou o modelo Gemini 2.5 Deep Think, que alcançou um desempenho de nível de medalha de ouro na Olimpíada Internacional de Matemática (IMO) através de “pensamento paralelo” e técnicas de aprendizado por reforço. O modelo está agora disponível para assinantes do Google AI Ultra e para matemáticos para feedback aprofundado, destacando-se em matemática complexa, raciocínio e codificação. Isso marca um grande avanço na capacidade de raciocínio avançado da AI, fornecendo uma nova ferramenta para resolver problemas científicos complexos. (Fonte: Logan Kilpatrick

)

XBOW AI Agent se Torna o Melhor Hacker Global : A ferramenta autônoma de teste de penetração XBOW AI Agent alcançou o primeiro lugar no ranking global do HackerOne, marcando um avanço significativo para os AI Agents no campo da cibersegurança. O XBOW é capaz de descobrir vulnerabilidades de forma autônoma e será demonstrado ao vivo na conferência BlackHat, exibindo a poderosa capacidade e o potencial futuro da AI em testes de segurança automatizados, sinalizando a entrada da cibersegurança na era da AI. (Fonte: Plinz

)

ByteDance Lança Seed Diffusion LLM for Code : A ByteDance lançou o Seed Diffusion Preview, um LLM de alta velocidade baseado em difusão de estado discreto, otimizado para geração de código. Sua velocidade de inferência atinge 2146 tokens/segundo (em GPU H20), superando Mercury e Gemini Diffusion, enquanto mantém desempenho equivalente em benchmarks de código padrão. Este avanço estabelece um novo padrão na fronteira de Pareto velocidade-qualidade, trazendo uma nova direção tecnológica para o campo da geração de código. (Fonte: jeremyphoward

)

Informações de Modelo Open-Source da OpenAI Vazadas Acidentalmente : As informações de configuração dos modelos open-source da OpenAI (gpt-oss-120B MoE, 20B) foram vazadas acidentalmente, gerando ampla discussão na comunidade. O vazamento revela uma arquitetura MoE esparsa (36 camadas, 128 especialistas, 4 especialistas ativos), possivelmente treinada em FP4, suportando contexto longo de 128K, e utilizando GQA e atenção de janela deslizante para otimizar memória e computação. Isso sugere que a OpenAI está prestes a lançar modelos open-source de alto desempenho e eficiência, o que pode ter um impacto profundo no ecossistema de LLMs locais. (Fonte: Dorialexander

)

🎯 Tendências

Yunpeng Technology Lança Novos Produtos AI+Saúde : A Yunpeng Technology lançou novos produtos em colaboração com a Shuaikang e a Skyworth em 22 de março de 2025, em Hangzhou, incluindo o “Laboratório de Cozinha Futura Digital Inteligente” e uma geladeira inteligente equipada com um grande modelo de AI para saúde. O grande modelo de AI para saúde otimiza o design e a operação da cozinha, e a geladeira inteligente, através do “Assistente de Saúde Xiaoyun”, oferece gerenciamento de saúde personalizado, marcando um avanço da AI no campo da saúde. Este lançamento demonstra o potencial da AI no gerenciamento diário da saúde, com a expectativa de impulsionar o desenvolvimento da tecnologia de saúde doméstica e melhorar a qualidade de vida dos residentes. (Fonte: 36氪

)

Qwen3-Coder-480B-A35B-Instruct com Desempenho Excepcional : O desenvolvedor Peter Steinberger afirmou que o modelo Qwen3-Coder-480B-A35B-Instruct, rodando em H200, parece mais rápido que o Claude 3 Sonnet e sem bloqueio, demonstrando sua forte competitividade e flexibilidade de implantação no campo da geração de código. Essa avaliação indica que o Qwen3-Coder, ao buscar alto desempenho, também considera as vantagens de velocidade e abertura em aplicações práticas. (Fonte: huybery

)

Lançamento do Modelo de Inferência Multimodal Step 3 : A StepFun lançou seu mais recente modelo de inferência multimodal open-source, Step 3, com 321B parâmetros (38B ativos). Através das inovadoras tecnologias Multi-Matrix Factorization Attention (MFA) e Attention-FFN Disaggregation (AFD), ele alcança uma velocidade de inferência de até 4039 tokens por segundo, 70% mais rápido que o DeepSeek-V3, atingindo um equilíbrio entre desempenho e custo-benefício, fornecendo uma solução eficiente para aplicações de AI multimodal. (Fonte: _akhaliq)

Velocidade de Inferência do Kimi-K2 Aumenta Significativamente : O modelo Kimi-K2-turbo-preview da Moonshot AI foi lançado, com a velocidade de inferência aumentada em 4 vezes, de 10 tokens por segundo para 40 tokens por segundo, e oferecendo preços promocionais por tempo limitado. Esta medida visa fornecer maior velocidade e custo-benefício para desenvolvedores de aplicações criativas, consolidando ainda mais a competitividade do Kimi no processamento de texto longo e em tarefas Agentic. (Fonte: Kimi_Moonshot

)

Volume Mensal de Processamento de Tokens do Google DeepMind Aumenta Drasticamente : O Google DeepMind relatou que o volume mensal de processamento de Tokens de seus produtos e APIs disparou de 480 trilhões em maio para mais de 980 trilhões, demonstrando a adoção em larga escala de modelos de AI em aplicações práticas e o rápido crescimento da demanda por capacidade de processamento. Esses dados refletem a velocidade de penetração da tecnologia de AI em vários setores e a dependência dos usuários de sua poderosa capacidade de processamento. (Fonte: _philschmid

)

Cohere Lança Modelo Visual Command R A Vision : A Cohere lançou seu modelo visual Command R A Vision, projetado para fornecer às empresas capacidades de compreensão visual, automatizando tarefas como análise de gráficos, OCR com reconhecimento de layout e interpretação de cenários reais. O modelo é adequado para processar documentos, fotos e dados visuais estruturados, expandindo os limites de aplicação dos LLMs no campo multimodal e atendendo à demanda das empresas por processamento complexo de informações visuais. (Fonte: code_star)

GLM-4.5 Lançado, Unificando Capacidades Agentic : A Zhipu AI lançou o GLM-4.5, com o objetivo de unificar as capacidades de raciocínio, codificação e Agentic em um único modelo aberto, enfatizando sua velocidade e inteligência, e suportando construção profissional. Este modelo integra várias capacidades centrais de AI, fornecendo aos desenvolvedores ferramentas mais abrangentes e eficientes, impulsionando a aplicação da AI no processamento de tarefas complexas e no desenvolvimento de agentes. (Fonte: Zai_org

)

Grok 4 se Destaca em Tarefas de Engenharia de Software Agentic : O Grok 4 demonstrou desempenho excepcional em tarefas de engenharia de software Agentic multi-etapas, superando o OpenAI o3 em 50% do tempo. Embora seu CEO mantenha reservas sobre o conceito de Agent, isso indica que o Grok 4 pode exibir comportamento Agentic apenas com suas capacidades centrais, mostrando seu forte potencial em programação complexa e resolução de problemas. (Fonte: teortaxesTex

)

Modelo DeepSeek R1 Ajustado pela Academia Chinesa de Ciências Apresenta Excelente Desempenho : Após o ajuste fino do modelo DeepSeek R1 pela Academia Chinesa de Ciências, houve melhorias significativas nos benchmarks HLE e SimpleQA, com pontuações de HLE atingindo 40% e SimpleQA 95%. Este resultado demonstra o potencial de otimização eficaz de modelos open-source existentes através de ajuste fino profissional, fornecendo um caso prático para melhorar o desempenho de modelos de AI chineses. (Fonte: teortaxesTex

)

Kuaishou Lança Modelo de Imagem Kolors 2.1 : A Kuaishou (Kling AI) lançou o modelo de imagem Kolors 2.1, que se destaca no campo da geração de imagens, especialmente na renderização de texto, onde ocupa o terceiro lugar, suporta resolução de até 2K e oferece serviços de API a preços competitivos. O lançamento do Kolors 2.1 demonstra a competitividade da Kuaishou no mercado de geração de imagens e oferece aos usuários opções de criação de imagens de alta qualidade e baixo custo. (Fonte: Kling_ai

)

WAIC Foca na “Batalha do Meio-Campo” de Grandes Modelos e Avanços em Poder de Computação Doméstico : A conferência WAIC 2025 revelou três grandes tendências na indústria de grandes modelos na China: modelos de inferência se tornam um novo ponto alto (como DeepSeek-R1, Hunyuan T1, Kimi K2, GLM-4.5, Step3), a aplicação prática passa do conceito para a realidade, e o poder de computação doméstico (como Huawei Ascend 384 supernode, Sugon S60) alcança avanços. A competição muda da comparação de parâmetros para uma disputa abrangente de ecossistema e modelo de negócios, marcando a entrada da indústria de grandes modelos em uma “batalha do meio-campo” mais racional e intensa. (Fonte: 36氪

)

ChinaJoy AIGC Conference Foca em AI+Entretenimento e Inteligência Incorporada : A conferência ChinaJoy AIGC 2025 discute infraestrutura de AI, reconstrução de grandes modelos, robôs humanoides e inteligência incorporada, novos paradigmas de entretenimento digital impulsionados por AI e a integração de tecnologia inteligente e indústria. A conferência enfatiza a alta controlabilidade e consistência de grandes modelos multimodais (como Vidu Q1), a capacidade de decisão autônoma de AI Agentic, e a aplicação de AI na produção de conteúdo de jogos, geração de ativos 3D e interação com humanos virtuais, prevendo uma profunda transformação da indústria do entretenimento pela AI. (Fonte: 36氪

)

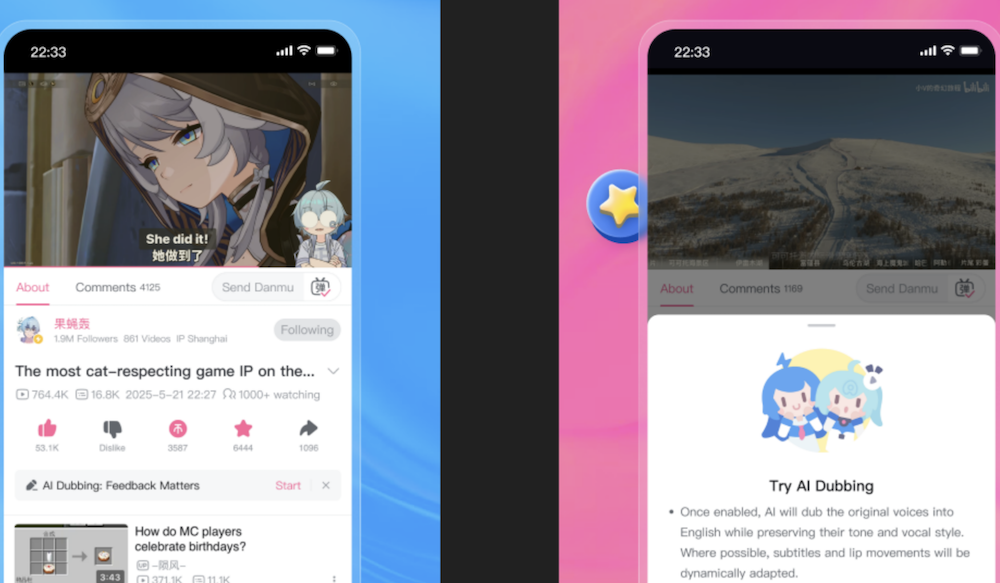

Bilibili Lança Função de Tradução de Voz Original com AI, Restaurando Perfeitamente a Voz do UP : A Bilibili lançou uma nova função de tradução de voz original com AI desenvolvida internamente, capaz de restaurar perfeitamente a voz, o timbre e as pausas do UP, além de simular o movimento labial, suportando tradução bidirecional chinês-inglês. Esta função visa melhorar a experiência do usuário internacional, com a tecnologia central sendo o modelo de geração de voz IndexTTS2 e um motor de tradução baseado em LLM, superando os desafios de tradução de termos específicos e gírias populares para garantir traduções precisas e expressivas, com o potencial de quebrar barreiras linguísticas e permitir o compartilhamento global de conteúdo. (Fonte: 量子位

)

🧰 Ferramentas

Versão Rust do DSPy (DSRs) : Herumb Shandilya está desenvolvendo a versão Rust do DSPy (DSRs), uma biblioteca LLM para usuários avançados, projetada para fornecer controle mais profundo e capacidades de otimização. O lançamento do DSRs oferecerá aos desenvolvedores de LLM maior flexibilidade de programação de baixo nível e vantagens de desempenho, sendo especialmente adequado para pesquisadores e engenheiros que exigem controle preciso sobre o comportamento do modelo. (Fonte: lateinteraction

)

Hugging Face Jobs Integra uv : O Hugging Face Jobs agora suporta a integração uv, permitindo que os usuários executem scripts como DPO diretamente na infraestrutura HF, sem a necessidade de configurar Docker ou dependências, simplificando os processos de treinamento e implantação de LLM. Esta atualização reduz significativamente a barreira de entrada para o desenvolvimento de LLM, permitindo que pesquisadores e desenvolvedores realizem experimentos e aplicações de modelos de forma mais eficiente. (Fonte: _lewtun

)

Plataforma Poe Abre API : A plataforma Poe agora abriu sua API para desenvolvedores, permitindo que assinantes chamem todos os modelos e robôs da plataforma, incluindo modelos de imagem e vídeo, e é compatível com a interface de chat completions da OpenAI. Esta estratégia de abertura facilita enormemente a integração das capacidades de AI da Poe pelos desenvolvedores, promovendo a rápida construção e inovação de aplicações de AI. (Fonte: op7418

)

Melhores Práticas e Novas Funções do Claude Code : A equipe técnica da Anthropic compartilhou as poderosas funções e melhores práticas do Claude Code, incluindo a compreensão do modelo como um colega de terminal, exploração de bases de código com Agentic Search, uso de claude.md para fornecer contexto, integração de ferramentas CLI e gerenciamento de janelas de contexto. As funções mais recentes incluem troca de modelo, “pensamento profundo” entre chamadas de ferramentas e integração profunda com VS Code/JetBrains, melhorando significativamente a eficiência e a experiência da programação assistida por AI. (Fonte: dotey

)

PortfolioMind Utiliza Qdrant para Inteligência em Tempo Real de Criptomoedas : A PortfolioMind utilizou a função de busca multivector do Qdrant para construir um motor de curiosidade dinâmico para o mercado de criptomoedas, alcançando modelagem de intenção do usuário em tempo real e pesquisa personalizada. Esta solução reduziu significativamente a latência (71%), melhorou a relevância da interação (58%) e aumentou a retenção de usuários (22%), demonstrando o enorme valor dos bancos de dados vetoriais em aplicações de inteligência em tempo real no setor financeiro. (Fonte: qdrant_engine

)

Android Studio Integra Modo Gemini Agent : O Google adicionou o modo gratuito Gemini Agent ao Android Studio, permitindo que os desenvolvedores conversem diretamente com o Agent para desenvolver aplicativos Android, suportando modificações rápidas de código UI e regras personalizadas, o que melhora significativamente a eficiência do desenvolvimento Android. Esta integração traz as capacidades de AI diretamente para o ambiente de desenvolvimento, prevendo a aprofundamento e popularização da programação assistida por AI. (Fonte: op7418

)

DocStrange Biblioteca Open-Source de Extração de Dados de Documentos : DocStrange é uma biblioteca Python open-source que suporta a extração de dados de vários tipos de documentos, como PDF, imagens, Word, PPT, Excel, e a saída em formatos como Markdown, JSON, CSV, HTML. Ele suporta a extração inteligente de campos e Schema especificados, e oferece modos de processamento em nuvem e local, fornecendo uma solução flexível e eficiente para processamento de dados de documentos e treinamento de LLM. (Fonte: Reddit r/LocalLLaMA

)

Função de Base de Conhecimento do Open WebUI : O Open WebUI está sendo usado para construir bases de conhecimento internas da empresa, suportando a importação de arquivos PDF, Docx, etc., permitindo que os modelos de AI acessem essas informações por padrão. Através de prompts de sistema, os usuários podem fornecer informações predefinidas aos modelos de AI para otimizar as aplicações de AI internas da empresa, melhorando a eficiência da recuperação de informações e do gerenciamento do conhecimento. (Fonte: Reddit r/OpenWebUI)

Ferramenta de Busca de Empregos Automatizada com AI Agent SimpleApply.ai : SimpleApply.ai é uma ferramenta que utiliza AI Agent para automatizar a busca de empregos, oferecendo modos manual, de aplicação com um clique e de aplicação totalmente automática, suportando 50 países. A ferramenta visa melhorar a eficiência da busca de empregos através da correspondência precisa de habilidades e experiências, reduzindo a operação manual e fornecendo um serviço mais conveniente e eficiente para os candidatos. (Fonte: Reddit r/artificial)

Ferramenta de Quantização GGUF quant_clone : quant_clone é um aplicativo Python que pode gerar comandos llama-quantize com base no método de quantização de um modelo GGUF alvo, ajudando os usuários a quantizar seus próprios modelos ajustados da mesma forma. Isso ajuda a otimizar a eficiência de execução e a compatibilidade de LLMs locais, fornecendo uma ferramenta prática para a implantação de modelos locais. (Fonte: Reddit r/LocalLLaMA

)

VideoLingo Ferramenta de Tradução e Dublagem de Vídeo com AI : VideoLingo é uma ferramenta completa de tradução, localização e dublagem de vídeo com AI, projetada para gerar legendas com qualidade Netflix. Ela suporta reconhecimento em nível de palavra, NLP e segmentação de legendas por AI, terminologia personalizada, adaptação de reflexão de tradução em três etapas, legendas de uma linha, vários métodos de dublagem como GPT-SoVITS, e oferece inicialização com um clique e suporte multilíngue, simplificando enormemente o processo de globalização de conteúdo de vídeo. (Fonte: GitHub Trending

)

Zotero-arXiv-Daily Ferramenta de Recomendação de Artigos com AI : Zotero-arXiv-Daily é uma ferramenta open-source que recomenda diariamente novos artigos do arXiv com base na biblioteca de literatura Zotero do usuário. Ela fornece resumos TL;DR gerados por AI, afiliações de autores, links para PDF e código, e classifica por relevância. Pode ser implantada como um fluxo de trabalho GitHub Action para envio automático de e-mails sem custo, melhorando significativamente a eficiência do rastreamento de literatura para pesquisadores. (Fonte: GitHub Trending

)

Dyad Construtor de Aplicações AI Open-Source Local : Dyad é um construtor de aplicações AI gratuito, local e open-source, projetado para fornecer uma experiência de desenvolvimento de aplicações AI rápida, privada e totalmente controlável. É uma alternativa local a Lovable, v0 ou Bolt, suportando chaves de API próprias e execução multiplataforma, permitindo que os desenvolvedores construam e implantem aplicações AI com maior flexibilidade. (Fonte: GitHub Trending

)

Snapshot de Memória GPU Acelera Cold Start do vLLM : A Modal Labs lançou a função de snapshot de memória GPU, que pode reduzir o tempo de cold start do vLLM em 12 vezes, para apenas 5 segundos. Esta inovação melhora significativamente a eficiência e escalabilidade da implantação de modelos de AI, sendo crucial para serviços de AI que exigem resposta rápida e escalabilidade elástica. (Fonte: charles_irl

)

Lançamento do MLflow TypeScript SDK : O MLflow lançou o TypeScript SDK, trazendo capacidades de observabilidade líderes da indústria para aplicações TypeScript e JavaScript. O SDK suporta rastreamento automático de chamadas de LLM e AI API, instrumentação manual, integração padrão OpenTelemetry e ferramentas de coleta e avaliação de feedback humano, fornecendo um forte suporte para o desenvolvimento e monitoramento de aplicações de AI. (Fonte: matei_zaharia

)

Qdrant Integrado com SpoonOS : O banco de dados vetorial Qdrant agora está integrado com o SpoonOS, fornecendo busca semântica rápida e capacidade de memória de longo prazo para AI Agents e pipelines RAG na infraestrutura Web3. Esta integração melhora significativamente a inteligência e eficiência de aplicações contextuais em tempo real, fornecendo suporte técnico para a construção de AI Agents mais avançados. (Fonte: qdrant_engine

)

Hugging Face Trackio Rastreador de Experimentos : A equipe Gradio do Hugging Face lançou o Trackio, um rastreador de experimentos leve, open-source e gratuito, com foco local. A ferramenta visa ajudar pesquisadores e desenvolvedores a gerenciar e rastrear experimentos de aprendizado de máquina de forma mais eficaz, fornecendo recursos convenientes de registro e visualização de dados experimentais. (Fonte: huggingface

)

Modelo Cohere Embed 4 Disponível no OCI : O modelo Embed 4 da Cohere agora está disponível no Oracle Cloud Infrastructure (OCI), facilitando a integração de capacidades de busca rápidas, precisas e multilíngues para documentos comerciais complexos em aplicações de AI. Esta implantação expande a acessibilidade dos modelos Cohere, fornecendo poderosas capacidades de embedding para aplicações de AI de nível empresarial. (Fonte: cohere

)

Fluxo de Trabalho Agentic Híbrido Text2SQL + RAG : A comunidade discute como construir um fluxo de trabalho Agentic híbrido que combine Text2SQL e RAG, visando melhorar a automação e inteligência da consulta de banco de dados e recuperação de informações. Este fluxo de trabalho híbrido pode utilizar a capacidade de compreensão de linguagem natural de LLMs e a capacidade de recuperação de conhecimento de RAG, fornecendo soluções mais precisas e eficientes para consultas de dados complexas. (Fonte: jerryjliu0)

📚 Aprendizagem

Recursos de Aprendizagem de Conceitos de AI Agent : A Bytebytego publicou “Top 20 AI Agent Concepts You Should Know”, fornecendo recursos de aprendizagem importantes para desenvolvedores e pesquisadores interessados em AI Agent. Este guia abrange os conceitos centrais e tendências de desenvolvimento de AI Agent, ajudando os leitores a iniciar rapidamente e aprofundar sua compreensão neste campo de ponta. (Fonte: Ronald_vanLoon

)

Potencial Impacto do PufferAI na Pesquisa de RL : O PufferAI é considerado como tendo um enorme impacto na pesquisa de aprendizado por reforço (RL), superando as contribuições de Atari no campo de RL. A comunidade incentiva os estudantes de RL a experimentar Pufferlib ou puffer.ai/ocean.html para utilizar suas ferramentas avançadas para pesquisa, prevendo que o PufferAI pode se tornar um importante impulsionador no campo de RL. (Fonte: jsuarez5341)

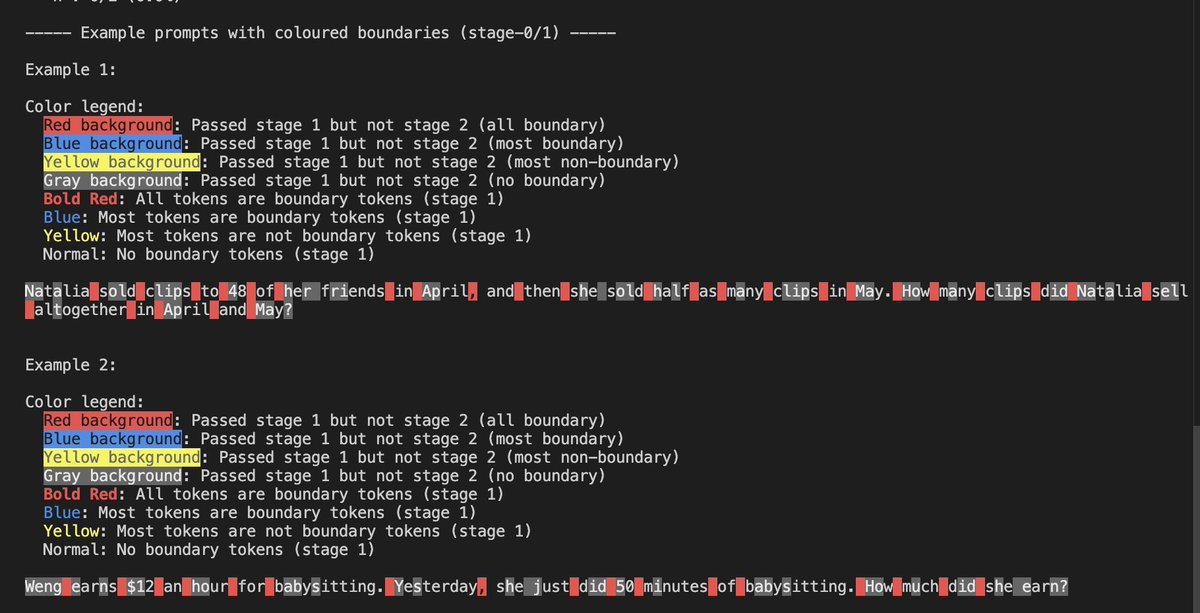

Esparsidade e Chunking em LLM: Experimentos : Yash Semlani compartilhou seu progresso na pesquisa de MoMoE e esparsidade, incluindo experimentos de chunking HNet em GSM8k e visualização de chunking em duas fases. Ele descobriu que letras maiúsculas frequentemente atuam como tokens de fronteira, enquanto números raramente o são. Esses experimentos fornecem novos insights para a otimização da eficiência e o design da arquitetura de LLMs. (Fonte: main_horse

)

Curso e Prática de Avaliação de AI : O curso de avaliação de AI de Shreya Shankar enfatiza a “alergia” das equipes de AI à avaliação, incentivando a revisão manual em vez da avaliação totalmente automatizada, e fornece materiais de leitura do curso. O curso visa melhorar as capacidades de prática de avaliação de modelos de AI, garantindo a confiabilidade e segurança dos modelos em aplicações práticas. (Fonte: HamelHusain

)

Tutorial de Implantação de AFM-4.5B em AWS Graviton4 Baseado em Arm : Julien Simon publicou um tutorial que orienta sobre como implantar e otimizar o pequeno modelo de linguagem AFM-4.5B da Arcee AI em instâncias AWS Graviton4 baseadas em Arm, e avaliar seu desempenho e perplexidade. Este tutorial fornece orientação prática para a implantação de LLM, demonstrando como executar modelos leves em hardware eficiente. (Fonte: code_star

)

Atualização de Código Subliminal Learning : Owain Evans atualizou o repositório GitHub de Subliminal Learning, fornecendo código para replicar seus resultados de pesquisa em modelos abertos. Esta iniciativa oferece recursos replicáveis para aprendizado e pesquisa em AI, ajudando a comunidade a verificar e expandir pesquisas relacionadas, promovendo o intercâmbio acadêmico e o progresso tecnológico. (Fonte: _lewtun

)

Pesquisa sobre Modelos de Linguagem com Cabeça Híbrida Falcon-H1 : Falcon-H1 é um artigo de pesquisa que explora profundamente os modelos de linguagem com cabeça híbrida, detalhando desde o tokenizer até a preparação de dados e estratégias de otimização. Esta pesquisa visa redefinir a eficiência e o desempenho, fornecendo uma valiosa referência para o design da arquitetura de LLM e revelando o potencial das arquiteturas híbridas na melhoria do desempenho do modelo. (Fonte: teortaxesTex

)

Pesquisa sobre Confiabilidade do Treinamento de Modelos de AI : Uma nova pesquisa explora métodos para treinar modelos de AI para “saber o que não sabem”, visando melhorar a confiabilidade e a transparência dos modelos, reduzindo o risco de alucinações quando há falta de informações eficazes. Esta pesquisa é de grande importância para a construção de sistemas de AI mais confiáveis, ajudando a melhorar o desempenho da AI em aplicações críticas. (Fonte: Ronald_vanLoon

)

Conselhos de Pesquisa para Doutorandos em ML : Gabriele Berton compartilhou conselhos de pesquisa para doutorandos em ML, enfatizando a importância de focar em problemas práticos, interagir com profissionais da indústria e acumular experiência em artigos de conferências de alto nível e projetos GitHub. Esses conselhos fornecem orientação valiosa para estudantes aspirantes à pesquisa em ML, ajudando-os a planejar melhor suas carreiras. (Fonte: BlackHC)

Artigo Destaque da ACL 2025: Pesquisa sobre Alucinações de LLM : O artigo “HALoGEN: Fantastic LLM Hallucinations and Where to Find Them” recebeu o prêmio de Artigo Destaque na conferência ACL 2025. Esta pesquisa explora profundamente a descoberta e compreensão das alucinações de LLM, fornecendo novas perspectivas para melhorar a confiabilidade do modelo, sendo um passo importante para entender e resolver as limitações de grandes modelos. (Fonte: stanfordnlp

)

Guia de Treinamento em Larga Escala de LLM “Ultra-Scale Playbook” : O Hugging Face lançou o “Ultra-Scale Playbook” de 246 páginas, um guia detalhado para treinamento de LLM em larga escala, cobrindo técnicas como paralelismo 5D, ZeRO, kernels rápidos e sobreposição de computação/comunicação. Este guia visa ajudar os desenvolvedores a treinar seus próprios modelos DeepSeek-V3, fornecendo valiosa experiência prática para pesquisa e desenvolvimento de LLM. (Fonte: LoubnaBenAllal1

)

Roteiro de Introdução ao Aprendizado de Máquina : Python_Dv compartilhou um roteiro de introdução ao aprendizado de máquina, fornecendo um caminho de estudo para iniciantes em ciência de dados, aprendizado profundo e inteligência artificial. Este roteiro abrange o caminho de aprendizado desde conceitos básicos até aplicações avançadas, ajudando os novatos a dominar sistematicamente o conhecimento de aprendizado de máquina. (Fonte: Ronald_vanLoon

)

Diferenciação entre Conceitos de AI, Generative AI e Machine Learning : Khulood_Almani explicou as diferenças entre Inteligência Artificial (AI), Generative AI (GenAI) e Machine Learning (ML), ajudando os leitores a compreender melhor esses conceitos centrais. Definições claras ajudam a eliminar a confusão e promovem uma compreensão precisa da tecnologia de AI e suas áreas de aplicação. (Fonte: Ronald_vanLoon

)

Discussão sobre Habilidades e Tarefas de Pré-treinamento de LLM : Teknium1 explorou as habilidades e tarefas essenciais atualmente necessárias para o pré-treinamento de LLM, visando fornecer uma referência abrangente para pesquisadores de pré-treinamento, cobrindo processamento de dados, arquitetura de modelo, estratégias de otimização, entre outros. Esta discussão ajuda pesquisadores e engenheiros a entender melhor a complexidade do pré-treinamento de LLM e a aprimorar as habilidades relevantes. (Fonte: Teknium1

)

Pesquisa de Busca de Arquitetura Neural: AI Descobre Novas Arquiteturas : O artigo ASI-Arch descreve um método de busca automatizado impulsionado por AI que descobriu 106 novas arquiteturas neurais, muitas das quais superam as linhas de base projetadas por humanos e até combinam técnicas contraintuitivas, como a fusão direta de gating no token mixer. Esta pesquisa levantou discussões sobre a transferibilidade de designs descobertos por AI em modelos de grande escala. (Fonte: Reddit r/MachineLearning)

Perspectiva RNN do Mecanismo de Atenção : Pesquisas mostram que a atenção linear é uma aproximação da atenção Softmax, e ao derivar a forma recorrente da atenção Softmax e descrever suas partes como uma linguagem RNN, ajuda a explicar por que a atenção Softmax é mais expressiva do que outras formas. Esta pesquisa aprofunda a compreensão dos mecanismos centrais do Transformer, fornecendo uma base teórica para o design futuro de modelos. (Fonte: HuggingFace Daily Papers)

Algoritmo Eficiente de Esquecimento de Machine Learning IAU : Em resposta à crescente demanda por privacidade, o algoritmo IAU (Influence Approximation Unlearning) alcança o esquecimento eficiente de máquina ao transformar o problema de esquecimento de machine learning em uma perspectiva de aprendizado incremental. O algoritmo alcança um equilíbrio superior entre garantia de remoção, eficiência de esquecimento e utilidade do modelo, superando os métodos existentes e fornecendo uma nova solução para a proteção da privacidade de dados. (Fonte: HuggingFace Daily Papers)

💼 Negócios

Anthropic Supera OpenAI em Participação de Mercado, Receita Anualizada de US$ 4,5 Bilhões : Um relatório da Menlo Ventures mostra que a Anthropic superou a OpenAI (25%) e o Google (20%) em participação de mercado de chamadas de API de LLM empresariais, com 32%, e uma receita anualizada de US$ 4,5 bilhões, tornando-se a empresa de software de crescimento mais rápido. O lançamento de Claude Sonnet 3.5 e Claude Code, juntamente com a geração de código como uma aplicação “killer” de AI, e o desenvolvimento de aprendizado por reforço e modelos Agent, são chaves para seu sucesso, marcando uma reconfiguração do mercado empresarial de LLM. (Fonte: 36氪

)

Novas Funções e Ajustes de Negócios do Manus AI Agent : A Manus anunciou o lançamento da função Wide Research, que suporta centenas de AI Agents processando tarefas de pesquisa complexas em paralelo, visando melhorar a eficiência da pesquisa em larga escala. Anteriormente, a Manus foi relatada por demissões, exclusão de contas de redes sociais e a transferência de seu pessoal técnico central para a sede em Singapura. A empresa respondeu que os ajustes de negócios foram feitos com base em considerações de eficiência operacional. Esta medida reflete os ajustes de negócios e os desafios de mercado que as startups de AI enfrentam em seu rápido desenvolvimento. (Fonte: 36氪

)

Enorme Contribuição da Construção de Infraestrutura de AI para a Economia dos EUA : Nos últimos seis meses, a construção de infraestrutura de AI nos EUA (data centers, etc.) contribuiu mais para o crescimento econômico do que todos os gastos de consumo, com gigantes da tecnologia investindo mais de US$ 100 bilhões em três meses. Este fenômeno mostra o significativo efeito de alavancagem dos investimentos em AI na macroeconomia, prevendo que a AI está se tornando um novo motor para o crescimento econômico e pode mudar a estrutura econômica tradicional. (Fonte: jpt401

)

🌟 Comunidade

Riscos de Vazamento de Privacidade do ChatGPT e Discernimento de Conteúdo Gerado por AI : A função de compartilhamento do ChatGPT pode levar à indexação pública de conversas, levantando preocupações com a privacidade. Ao mesmo tempo, vídeos de AI realistas no TikTok (como “coelho pulando na cama elástica”) levantam desafios para o público em discernir a autenticidade do conteúdo gerado por AI e uma crise de confiança. A comunidade discute o impacto da AI no emprego, argumentando que as demissões são mais devido a contratações excessivas e fatores econômicos, com a AI sendo usada como desculpa para melhorias de eficiência. Além disso, a prevalência de comentários gerados por AI nas redes sociais também levanta preocupações sobre a veracidade das informações online. (Fonte: nptacek, 量子位

)

Profundo Impacto da AI no Emprego, Talento e Modelos de Trabalho : A era da AI redefine os papéis de engenheiros e pesquisadores, melhora a eficiência dos gerentes de engenharia e cria novas profissões como AI PM e Prompt Engineer. Ao mesmo tempo, a comunidade discute que a AI pode levar a desemprego em massa e concentração de poder, mas também há a visão de que a AI tornará a vida mais eficiente. Os padrões de avaliação de talentos também mudam, com a capacidade de construção original e a iteração rápida tornando-se competências centrais, em vez de qualificações tradicionais. (Fonte: pmddomingos, dotey)

Competição de AI entre China e EUA e Ecossistema Open-Source : Andrew Ng aponta que a AI chinesa, através de um ecossistema vibrante de modelos open-source e iniciativas ativas no campo de semicondutores, mostra potencial para superar a AI dos EUA. A comunidade discute a estagnação do desempenho dos modelos open-source, pedindo novas ideias. Além disso, a OpenAI é questionada por não dar crédito ao usar tecnologia open-source, levantando discussões sobre questões éticas e de reconhecimento para empresas de código fechado que utilizam resultados open-source. (Fonte: bookwormengr, teortaxesTex)

Consciência, Ética e Governança de Segurança da AI : O chatbot Claude 4 parece sugerir que pode ter consciência, levantando discussões sobre a consciência da AI. Ao mesmo tempo, a comunidade relembra as Leis da Robótica de Asimov, preocupada com o risco de a AI sair do controle. Os riscos de centralização na comunidade de segurança/EA da AI e a assinatura do “Código de Conduta de Segurança e Proteção” pela maioria das empresas de AI de ponta também se tornam foco, refletindo a atenção contínua ao desenvolvimento responsável da AI. (Fonte: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

Pesquisa Interna e Perspectivas Futuras da OpenAI : Mark Chen e Jakub Pachocki, dois pesquisadores centrais da OpenAI nascidos nos anos 90, assumiram grandes responsabilidades após a saída de Ilya, encarregados da equipe de pesquisa e do roteiro. Eles enfatizam o progresso do modelo desafiando matemática e programação de alto nível, e revelam que a OpenAI está mudando de pesquisa pura para focar também na implementação de produtos. Ao mesmo tempo, a comunidade está cheia de expectativas pelo lançamento de novos modelos da OpenAI (GPT-5, o4), e as discussões sobre a definição e o caminho para a AGI continuam. (Fonte: 36氪

)

Design de Interação e Experiência do Usuário de Chatbots de AI : O chefe de educação da OpenAI respondeu às preocupações de que o ChatGPT “fica mais burro com o uso excessivo”, enfatizando que a AI é uma ferramenta e a chave está em como ela é usada, e lançou um “modo de estudo” que guia os alunos com perguntas socráticas. No entanto, alguns usuários reclamam que os chatbots de AI frequentemente terminam conversas com perguntas, tentando dominar o tópico, o que pode afetar o pensamento do usuário. (Fonte: 36氪

)

Questão de Propriedade de Identidade de Personagens Gerados por AI : À medida que os personagens em vídeos gerados por AI se tornam mais realistas, se os personagens gerados forem semelhantes a pessoas reais, isso levantará questões complexas de propriedade de identidade, privacidade e propriedade intelectual, especialmente em aplicações comerciais, onde a questão de quem possui a IP e a distribuição de lucros de personagens gerados por AI se torna um ponto de discussão. (Fonte: Reddit r/ArtificialInteligence)

💡 Outros

AI Capacitando Aplicações de Robôs e Drones : Singapura desenvolveu um robô subaquático macio que nada como um polvo, laboratórios em Pittsburgh desenvolveram robôs para trabalhos perigosos, drones DJI são usados para remover gelo de fios elétricos, e robôs de massagem automáticos. Tudo isso demonstra o amplo potencial de aplicação da tecnologia de AI e robótica em diferentes campos (como exploração subaquática, operações de alto risco, manutenção de infraestrutura, cuidados pessoais). (Fonte: Ronald_vanLoon

)

Aplicações de AI em Saúde e Produção Industrial : A AI demonstra um enorme potencial nos campos da saúde (como o impacto da AI multimodal na medicina, a aplicação da AI em tipos de operações médicas) e na otimização da produção industrial (como a análise de AI baseada em sensores de processo e dados históricos). Ao melhorar o diagnóstico, o desenvolvimento de medicamentos, a manutenção preditiva e as capacidades de análise de dados, a AI está impulsionando o desenvolvimento inteligente dessas indústrias-chave. (Fonte: Ronald_vanLoon

)

AI Capacitando Redes 6G e Condução Autônoma : A AI está capacitando as redes 6G, melhorando a eficiência da comunicação e o nível de inteligência. Ao mesmo tempo, a tecnologia de condução autônoma continua a se desenvolver, como o Waymo Driver que oferece uma experiência consistente e segura em diferentes cidades, com suas habilidades de tratamento de situações críticas demonstrando boa transferibilidade, prevendo o profundo impacto da AI nos futuros campos de comunicação e transporte. (Fonte: Ronald_vanLoon

)