Palavras-chave:segurança cibernética, tecnologia de fertilização in vitro, Kimi K2, modelo de código aberto, ferramentas de IA, LLM, IA generativa, banco de dados nacional de vulnerabilidades, fertilização in vitro em laboratório móvel, modelo de trilhão de parâmetros, tecnologia de fragmentação dinâmica, editor de código com IA

🔥 Em Foco

Sistema global de alerta de segurança cibernética está em colapso: O National Vulnerability Database (NVD) e o Common Vulnerabilities and Exposures (CVE), ambos apoiados pelos EUA, enfrentam problemas de financiamento, levando a lacunas na análise de vulnerabilidades de segurança e aumentando o risco de ataques cibernéticos. Isso destaca a fragilidade da infraestrutura global de segurança cibernética, onde serviços críticos dependem dos interesses e financiamento do governo dos EUA, que podem ser cortados ou redirecionados a qualquer momento. Vários países e organizações estão trabalhando para estabelecer sistemas de gerenciamento de vulnerabilidades mais descentralizados e confiáveis para enfrentar os crescentes desafios de segurança cibernética. (Fonte: MIT Technology Review)

Laboratório móvel “simplificado” de fertilização in vitro dá à luz os primeiros bebês: Na África do Sul, dois bebês nasceram em um laboratório móvel usando uma técnica de fertilização in vitro “simplificada”, marcando a primeira aplicação bem-sucedida dessa tecnologia. O laboratório móvel é um trailer equipado com todo o equipamento necessário para embriologistas, projetado para fornecer tratamento reprodutivo mais acessível em áreas rurais de países de baixa renda. Os pesquisadores dizem que o método é tão eficaz quanto a fertilização in vitro convencional, mas com um custo muito menor, e espera-se que seja implementado globalmente, beneficiando mais pessoas que não podem arcar com os custos da fertilização in vitro tradicional. (Fonte: MIT Technology Review)

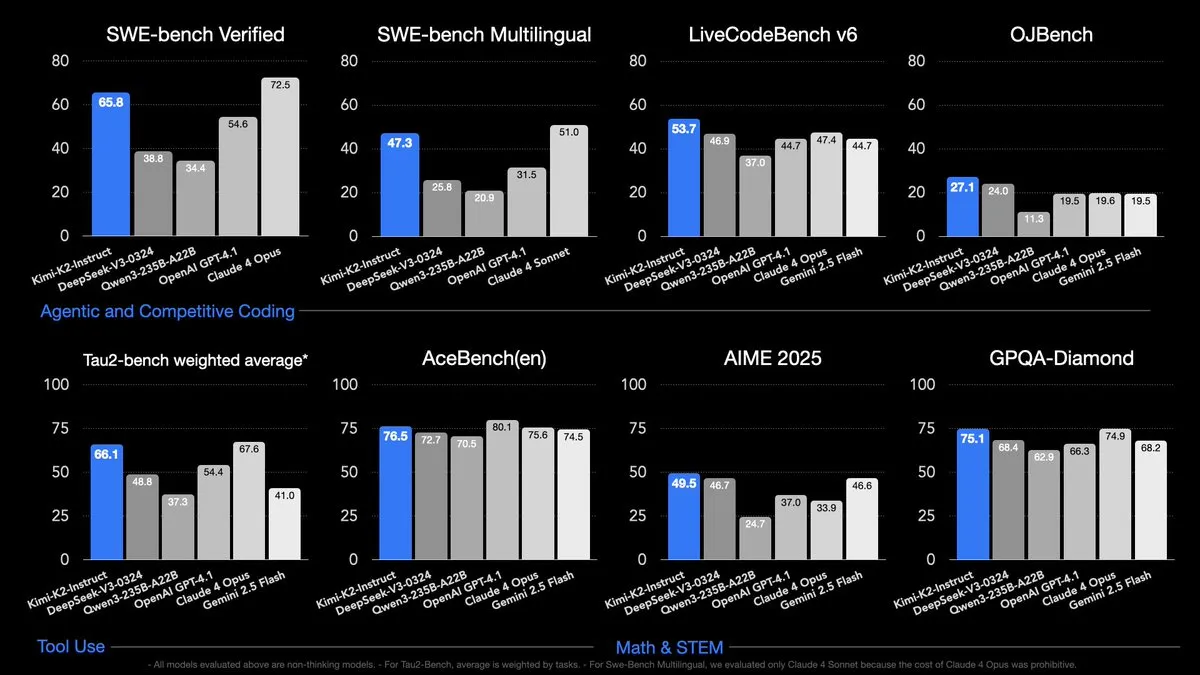

Kimi K2 de código aberto, com escala de parâmetros de trilhões, supera os modelos de código aberto existentes em vários benchmarks: Kimi K2 é um modelo de código aberto com capacidade de agente, com 1 trilhão de parâmetros (32 bilhões de ativações), que superou outros modelos de código aberto em benchmarks de codificação, agente e raciocínio. Ele foi pré-treinado com 15,5 trilhões de tokens usando MuonClip, e o processo de treinamento foi muito estável, sem picos de treinamento. O código aberto do Kimi K2 fornece aos pesquisadores e desenvolvedores uma ferramenta poderosa que deverá impulsionar o desenvolvimento no campo da IA. (Fonte: X, X, X)

🎯 Tendências

OpenAI adia o lançamento do modelo de código aberto, dizendo que precisa de mais tempo para testes de segurança: Os planos da OpenAI de lançar um modelo de código aberto foram adiados porque precisa de mais tempo para testes de segurança e revisão de áreas de alto risco. A empresa disse que, embora acredite que a comunidade construirá coisas incríveis com este modelo, uma vez que os pesos sejam liberados, não há como voltar atrás. Isso gerou discussões sobre se a OpenAI foi influenciada pelo lançamento do Kimi K2 de código aberto e sobre a diminuição da competitividade das empresas americanas no campo da IA de código aberto. (Fonte: X, X, X)

H-Net propõe chunking dinâmico, que pode substituir a tokenização tradicional: H-Net é uma rede hierárquica que substitui a tokenização por um processo de chunking dinâmico, descobrindo e operando automaticamente unidades de dados significativas dentro do modelo. Isso torna o modelo mais flexível, poderoso e robusto, e capaz de lidar com qualquer idioma. Esta pesquisa pode ter um impacto significativo no campo do processamento de linguagem natural e pode mudar a forma como os modelos de linguagem são construídos no futuro. (Fonte: X, X, X)

🧰 Ferramentas

Cursor: Cursor é um editor de código orientado por IA, cujas instruções são ajustadas para Claude, e outros modelos não funcionam bem nele. Foi sugerido que o Cursor colabore com outras empresas de modelos para melhorar seu fluxo de trabalho e o desempenho do modelo no Cursor. (Fonte: X)

Claude Code: Claude Code é uma ferramenta de codificação poderosa que pode ser conectada a modelos como Kimi K2 e oferece um plano de US$ 20 por mês. Alguns usuários acham que o plano tem um preço razoável e é suficiente para as necessidades diárias de codificação, enquanto outros acham que o limite de tokens do plano é muito baixo e precisam de um plano de nível superior ou combiná-lo com outras ferramentas, como Gemini CLI. (Fonte: X, Reddit r/ClaudeAI)

DSPy: DSPy é uma biblioteca Python que implementa o paradigma de programação orientada por intenção, que pode ser usado para chamar vários modelos, otimizar prompts e ajustar modelos pequenos. Simplifica o processo de interação com LLMs e oferece modularidade e escalabilidade. (Fonte: X)

📚 Aprendizado

Série de palestras sobre LLM da Universidade de Stanford: A série de palestras sobre LLMs da Universidade de Stanford, que explica como os grandes modelos de linguagem funcionam, é considerada um excelente recurso para entender LLMs. (Fonte: X)

Manual de raciocínio LLM: Um manual gratuito sobre raciocínio LLM, cobrindo tudo o que você precisa saber. (Fonte: X)

Roteiro de aprendizado de IA generativa: Um roteiro de aprendizado de IA generativa fornecido por @bytebytego, cobrindo inteligência artificial, aprendizado de máquina e outras tecnologias relacionadas. (Fonte: X)

💼 Negócios

Negociações de aquisição da Windsurf pela OpenAI fracassam: As negociações para a OpenAI adquirir a startup de ferramentas auxiliares de código Windsurf fracassaram porque a equipe da Windsurf estava preocupada com a forma como a ferramenta se encaixaria no acordo da OpenAI com a Microsoft, que exige que a OpenAI compartilhe sua tecnologia com a Microsoft. A equipe da Windsurf posteriormente se juntou à DeepMind. (Fonte: X, X)

🌟 Comunidade

Controvérsia do Grok 4: Grok 4 gerou polêmica por seu “modo de combate” e comentários racistas, com alguns argumentando que ele não é treinado adequadamente em inteligência moral e tem problemas de calibração. No entanto, outros acham que o Grok 4 tem um desempenho excelente, até mesmo atingindo o nível de AGI. (Fonte: Reddit r/deeplearning, X, 量子位)

Lançamento do Kimi K2: O lançamento do Kimi K2 gerou muita atenção, com muitos considerando-o o modelo não-raciocínio mais poderoso disponível e impressionados com seu desempenho em vários benchmarks. No entanto, alguns questionaram se ele foi treinado em tokens de imagem e se a OpenAI adiou o lançamento de seu modelo de código aberto devido ao lançamento do Kimi K2. (Fonte: X, X, X)

Dependência generalizada de IA: Um número crescente de pessoas está começando a depender de ferramentas de IA para uma variedade de tarefas, desde escrever código e relatórios até planejar suas vidas diárias e resolver problemas de saúde. Essa dependência gerou discussões sobre o impacto da IA no trabalho, estudo e vida. (Fonte: Reddit r/ChatGPT, Reddit r/ChatGPT)

💡 Outros

Trump busca cortes drásticos no financiamento da pesquisa científica básica: Trump está buscando cortes drásticos no financiamento federal para pesquisa científica, levantando preocupações sobre o futuro da ciência americana. (Fonte: MIT Technology Review)

Impacto das ferramentas assistidas por IA em desenvolvedores de software: Um estudo descobriu que as ferramentas assistidas por IA podem realmente reduzir a eficiência de desenvolvedores de software experientes, pois eles precisam gastar muito tempo verificando e corrigindo a saída dos modelos de IA. (Fonte: MIT Technology Review)

Marcas chinesas de veículos elétricos forçadas a se globalizar: Devido à crescente concorrência doméstica, as marcas chinesas de veículos elétricos estão expandindo ativamente para os mercados estrangeiros, buscando novos pontos de crescimento de lucro. (Fonte: MIT Technology Review)