Palavras-chave:IA na saúde, modelo de linguagem, aprendizagem por reforço, raciocínio de IA, benchmark de IA, ferramentas de IA, negócios de IA, ética da IA, OpenAI HealthBench, Meta Física dos Modelos de Linguagem, Motor de Inferência FlashInfer, Geração de Mundo Virtual Matrix-Game, Treinamento Distribuído INTELLECT-2

🔥 Destaque

OpenAI lança o benchmark HealthBench, capacidade de IA médica melhora significativamente: A OpenAI lançou o HealthBench, um benchmark de avaliação de IA médica construído em colaboração com 262 médicos globais. Testes mostram que os modelos de IA mais recentes (como o3, GPT-4.1) já se equiparam ao melhor nível de desempenho em cenários de diálogo médico quando assistidos por IA, superando em muito os médicos independentes (cerca de 4 vezes). O desempenho de modelos menores também melhorou. Isso marca o enorme potencial da IA na área de saúde, e o sistema de avaliação visa promover a aplicação segura e eficaz da IA na prática clínica. (Fonte: Reddit r/ArtificialInteligence, BorisMPower, clefourrier)

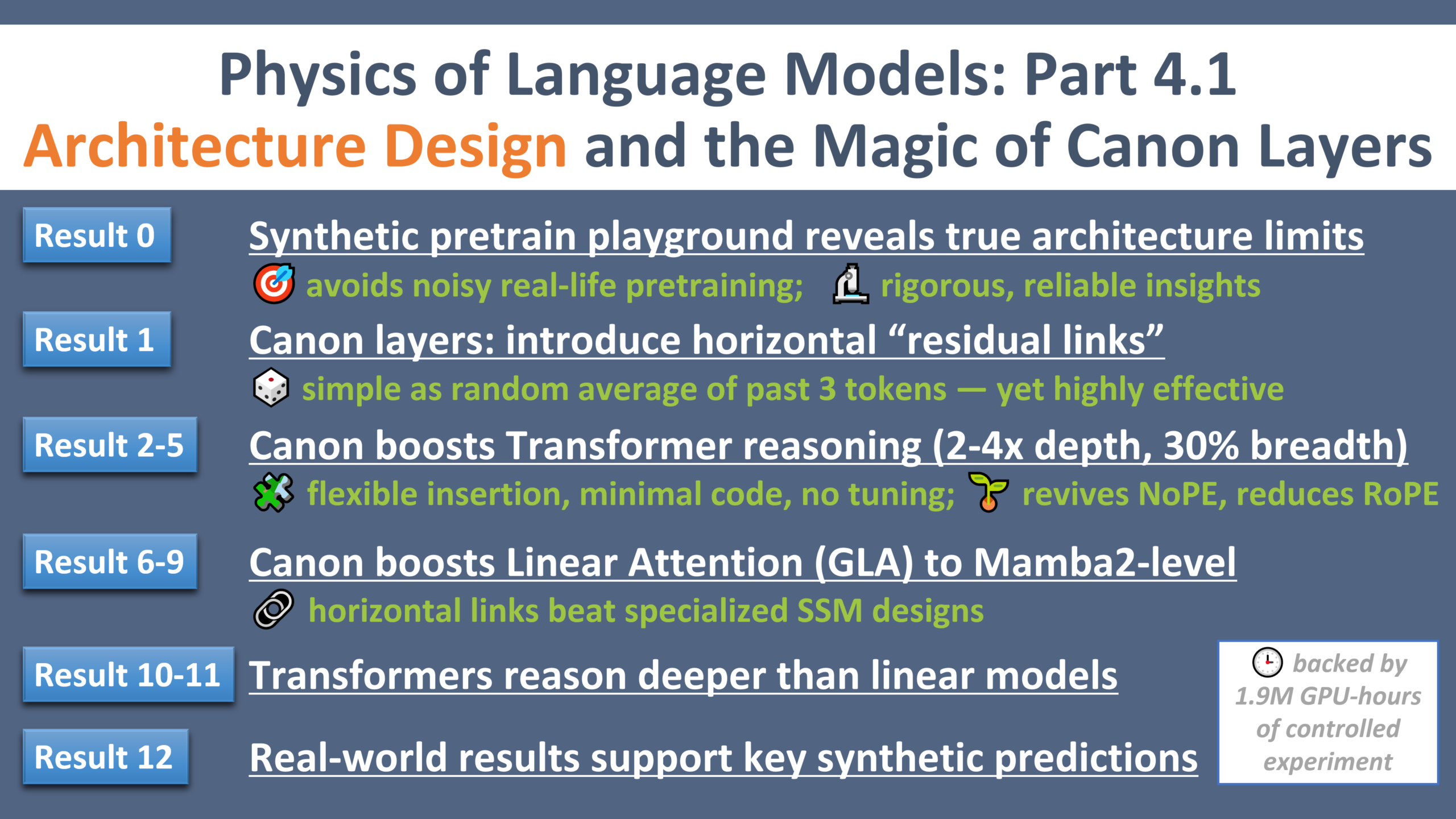

Meta lança a quarta parte da pesquisa “Physics of Language Models”: A Meta AI Research lançou a quarta parte de sua série de pesquisa “Physics of Language Models”. Através de um ambiente de pré-treinamento sintético controlado, eles descobriram um componente leve chamado “Canon layers”, que pode melhorar significativamente a capacidade de raciocínio e generalização de modelos com diversas arquiteturas como Transformer, Mamba, GLA, adicionando “conexões residuais horizontais” entre os tokens. (Fonte: AIatMeta, arohan)

FlashInfer ganha o prêmio de Melhor Artigo no MLSys 2025 e recebe suporte da NVIDIA: O artigo sobre o eficiente e personalizável motor de atenção do FlashInfer, focado em serviços de inferência para LLMs, ganhou o prêmio de Melhor Artigo no MLSys 2025. A NVIDIA anunciou suporte ao projeto e integrará os principais kernels de inferência para LLMs, como o TensorRT-LLM, no FlashInfer, para uso por vLLM, SGLang, etc., visando melhorar a eficiência e escalabilidade da inferência de LLMs. (Fonte: vllm_project, _philschmid)

Kunlun Tech lança o motor de geração de mundo interativo Matrix-Game: A Kunlun Tech lançou o Matrix-Game, um motor interativo capaz de gerar e controlar mundos virtuais através de instruções de texto. Ele suporta a geração de diversos cenários como desertos e florestas, e permite controle de movimento suave (como avançar, pular, atacar) e alternância de visão em 360°. Essa tecnologia tem o potencial de acelerar o desenvolvimento de jogos, o treinamento de IA incorporada e a produção de conteúdo para o metaverso. (Fonte: WeChat)

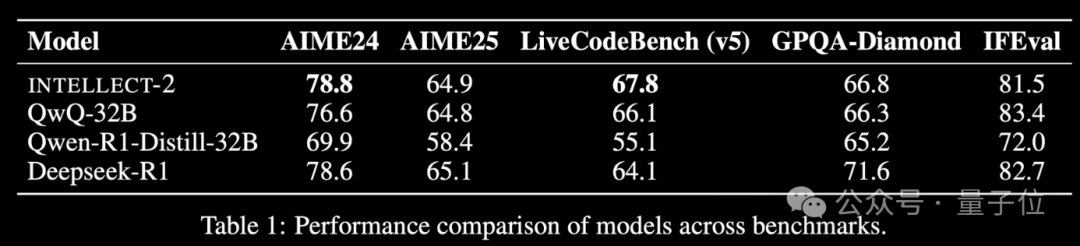

Prime Intellect lança o modelo de treinamento RL distribuído INTELLECT-2: A Prime Intellect lançou o INTELLECT-2, afirmando ser o primeiro modelo a realizar treinamento de aprendizado por reforço distribuído integrando recursos de computação ociosos globais, com desempenho comparável ao DeepSeek-R1. O projeto visa reduzir os custos de treinamento de RL, quebrar a dependência de poder computacional centralizado e recebeu investimentos de figuras conhecidas como Karpathy e Tri Dao. Seus componentes principais (PRIME-RL, SHARDCAST, TOPLOC, Protocol Testnet) foram disponibilizados como código aberto. (Fonte: 36氪)

Pioneiros em Aprendizado por Reforço Andrew Barto e Richard Sutton ganham o Prêmio Turing: Andrew Barto e Richard Sutton foram agraciados com o Prêmio Turing por suas contribuições fundamentais no campo do aprendizado por reforço (incluindo aprendizado por diferença temporal). O trabalho deles teve um impacto profundo na IA e foi demonstrado em projetos como o AlphaGo. Os dois planejam usar parte do prêmio para apoiar a liberdade de pesquisa de jovens cientistas e estabelecer bolsas de estudo para pós-graduação. (Fonte: WeChat)

Novo Papa nomeado em resposta à revolução da IA, “Czar da IA” prevê crescimento de um milhão de vezes em quatro anos: O recém-eleito Papa Leão XIV declarou que sua nomeação foi parcialmente em resposta aos desafios que a “nova revolução industrial” trazida pela IA representa para a dignidade humana, justiça e trabalho, mostrando a preocupação da Igreja com a ética da IA. O primeiro “Czar de IA e Criptomoedas” dos EUA, David Sacks, previu que, devido aos avanços exponenciais em modelos, chips e poder computacional, a capacidade da IA aumentará um milhão de vezes em quatro anos, enfatizando a importância de entender o crescimento exponencial e seu impacto disruptivo. (Fonte: WeChat)

🎯 Tendências

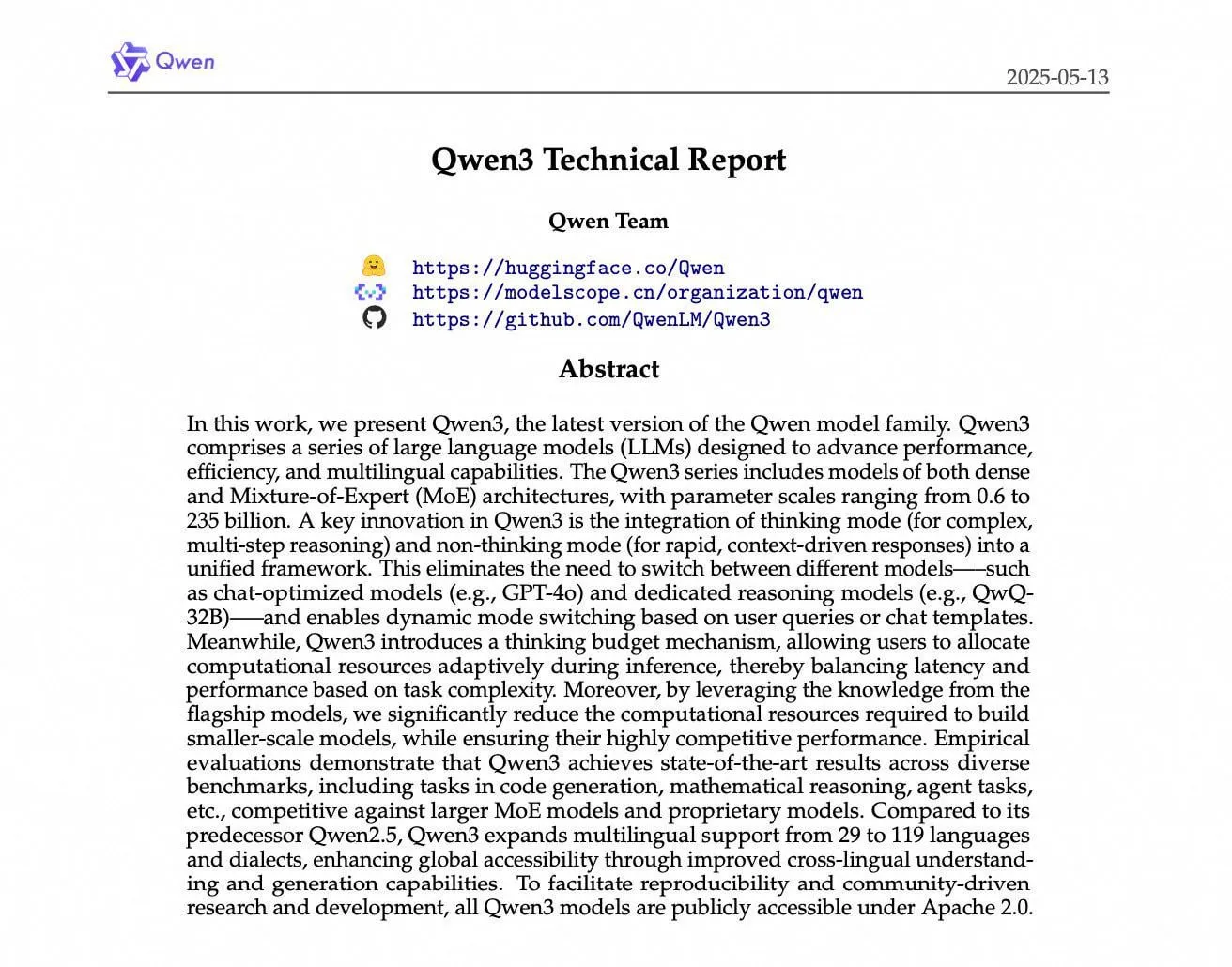

Relatório técnico do Alibaba Qwen3 revela detalhes de treinamento: A Alibaba Cloud lançou o relatório técnico do Qwen3, detalhando seu processo de treinamento em 36 trilhões de tokens, incluindo grande investimento de dados em modelos pequenos e pós-treinamento multi-estágio (como CoT, RL). O modelo teve um desempenho excelente em benchmarks como o MathArena, mas discussões na comunidade também apontaram bugs em seu modelo de chat e desempenho inferior ao Mistral Medium 3 em tarefas não relacionadas a raciocínio. (Fonte: cognitivecompai, rishdotblog, Dorialexander, teortaxesTex, qtnx_, nrehiew_, Reddit r/LocalLLaMA)

Congresso dos EUA considera suspender regulamentação estadual de IA por dez anos: Um rascunho de texto do Comitê de Comércio da Câmara dos Representantes dos EUA inclui uma proposta que sugere suspender a regulamentação de IA pelos estados por dez anos, a fim de evitar que regulamentos estaduais complexos dificultem a inovação em IA. A medida recebeu apoio de alguns funcionários estaduais, que acreditam que a regulamentação de IA deve ocorrer em nível federal. (Fonte: ylecun, pmddomingos, jd_pressman, Reddit r/artificial)

Assistentes de codificação evoluem para agentes “sempre ativos”: Assistentes de codificação estão evoluindo de programadores pareados que exigem muitas instruções e assistência humana, para agentes “sempre ativos” que buscam continuamente bugs e vulnerabilidades em segundo plano. (Fonte: steph_palazzolo)

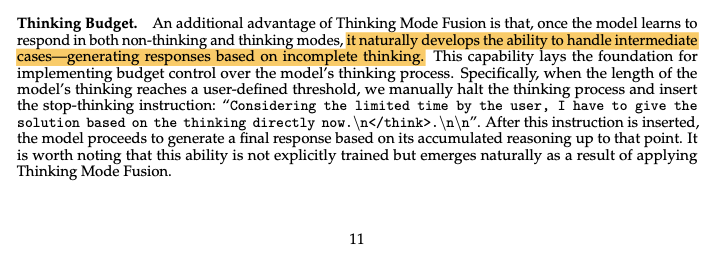

Novos conceitos surgem na área de IA: Vários novos conceitos surgiram na área de pesquisa de IA, incluindo “Continuous Thought Machines” da SakanaAI (enfatizando o elemento tempo), “Elastic Reasoning” da Salesforce (separando as fases de pensamento e resolução), “ZeroSearch” da Alibaba (usando LLM como um motor de busca simulado) e “Absolute Zero” da Universidade Tsinghua (aprendizagem inteiramente através de auto-jogo). (Fonte: TheTuringPost)

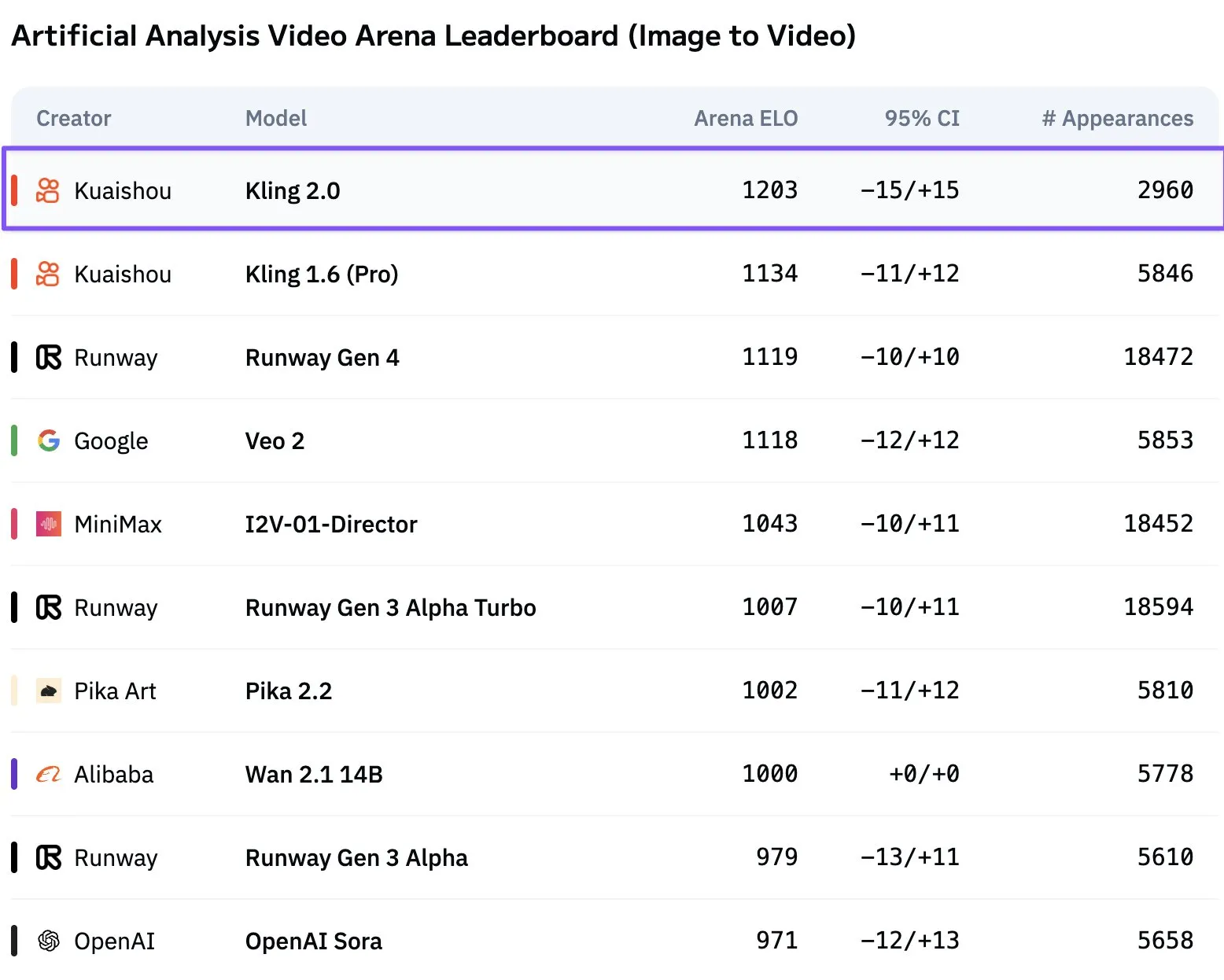

Modelo de vídeo Kuaishou Kling 2.0 alcança o topo: O Kling 2.0, lançado pela Kuaishou, superou o Veo 2 e o Runway Gen 4 no ranking de geração de vídeo da Artificial Analysis, tornando-se o modelo líder de texto para vídeo. Usuários da comunidade reconheceram seu desempenho. (Fonte: scaling01)

OpenAI GPT-4.1 lidera Claude 3.5 Sonnet em testes de preferência do usuário: Testes de preferência do usuário mostram que o GPT-4.1 da OpenAI (incluindo até mesmo o 4.1-mini) supera o Claude 3.5 Sonnet em experiência do usuário. (Fonte: imjaredz)

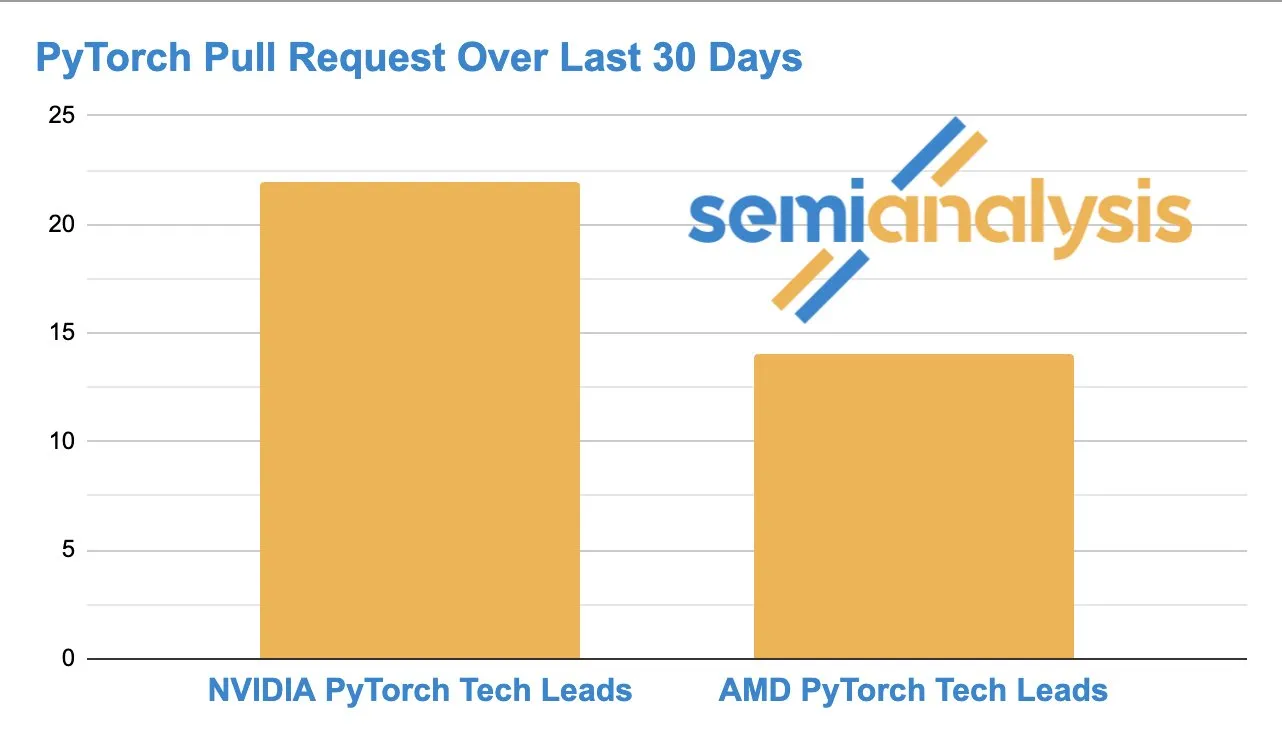

Competição entre AMD e NVIDIA no desenvolvimento de software de IA se intensifica: A atividade no GitHub mostra que o número de Pull Requests enviados pela equipe ROCm PyTorch da AMD está alcançando o líder técnico de PyTorch da NVIDIA, indicando uma competição crescente no desenvolvimento de hardware e software de IA de baixo nível. (Fonte: zacharynado)

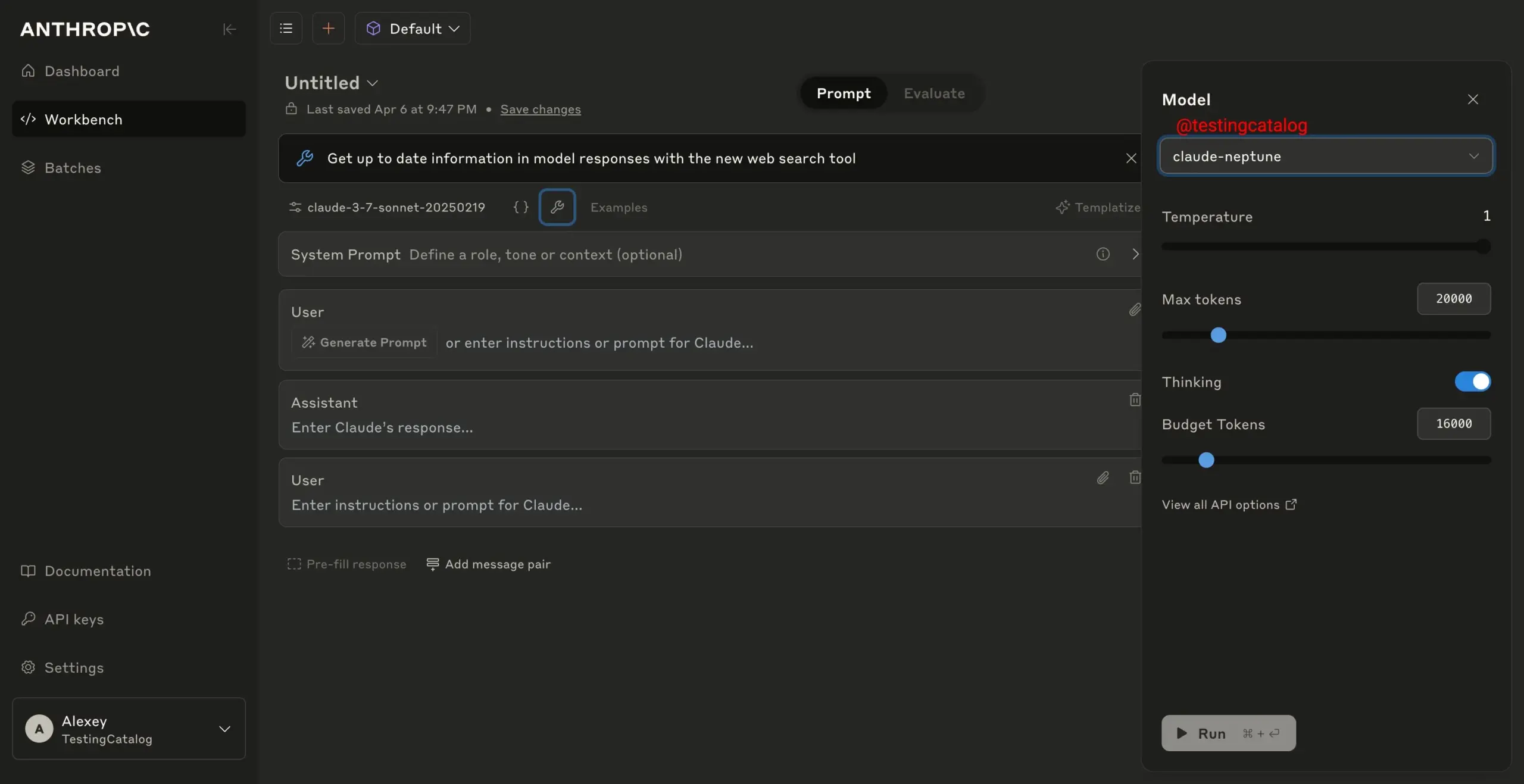

Novo modelo da Anthropic “claude-neptune” em testes de segurança: Há relatos de que a Anthropic está testando a segurança de seu novo modelo “claude-neptune”, indicando um possível lançamento iminente de um novo modelo. (Fonte: scaling01)

Acesso gratuito à API do Gemini 2.5 Pro suspenso devido à alta demanda: Devido à enorme demanda, o Google suspendeu temporariamente o acesso à camada gratuita do Gemini 2.5 Pro via API, para garantir que os desenvolvedores possam continuar a expandir seus aplicativos. O modelo ainda está disponível gratuitamente no Google AI Studio. (Fonte: matvelloso)

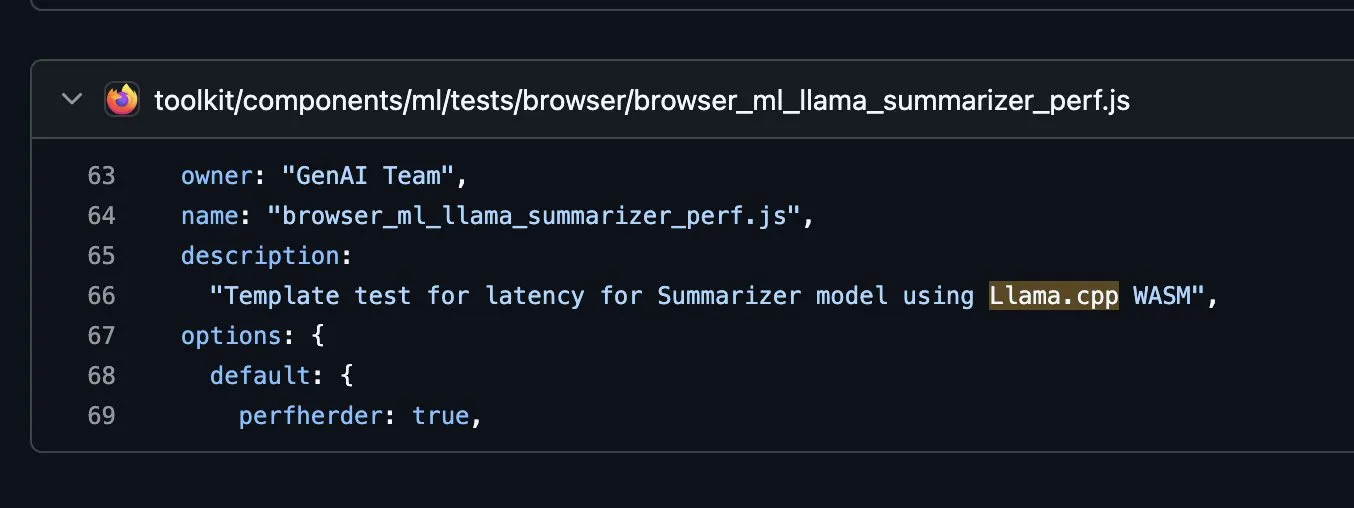

Firefox explora integração de llama.cpp em WASM: O Firefox está experimentando no GitHub a integração da biblioteca llama.cpp em WebAssembly (WASM), o que pode significar que, no futuro, os usuários poderão executar LLMs locais diretamente no navegador. (Fonte: ClementDelangue, ggerganov)

Benchmarks de LLM do AMD Ryzen AI Max+ PRO 395: Benchmarks de LLM do AMD Ryzen AI Max+ PRO 395 no Linux mostram que seu desempenho parece ser inferior ao da RTX 4060 Ti. Discussões na comunidade apontam que o teste pode refletir apenas o desempenho da CPU e exploram o desempenho de sua iGPU, a vantagem de VRAM e problemas atuais de compatibilidade de GPUs Intel com FP8, Flash Attention e alocação de memória. (Fonte: Reddit r/LocalLLaMA)

🧰 Ferramentas

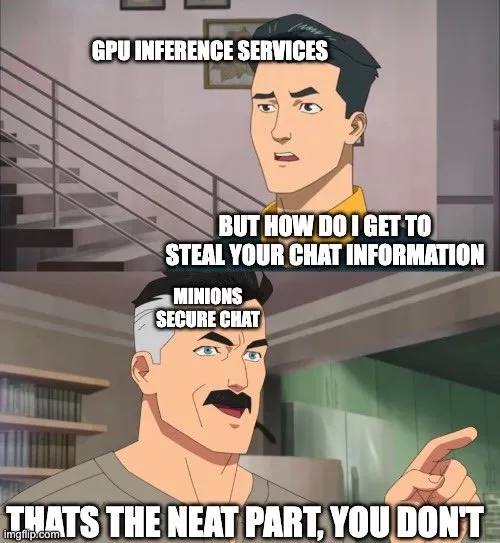

Lançado protocolo de código aberto Minions Secure Chat para chat LLM criptografado na nuvem: Um protocolo de código aberto chamado “Minions Secure Chat” foi lançado, visando permitir chat LLM na nuvem com criptografia de ponta a ponta e latência muito baixa (<1%), mesmo para modelos com mais de 30 bilhões de parâmetros. O protocolo garante que o provedor de serviços em nuvem não possa visualizar o conteúdo das mensagens, e a inferência ocorre em enclaves de GPU seguros, garantindo confidencialidade. (Fonte: realDanFu, ollama, rebeccatqian, code_star)

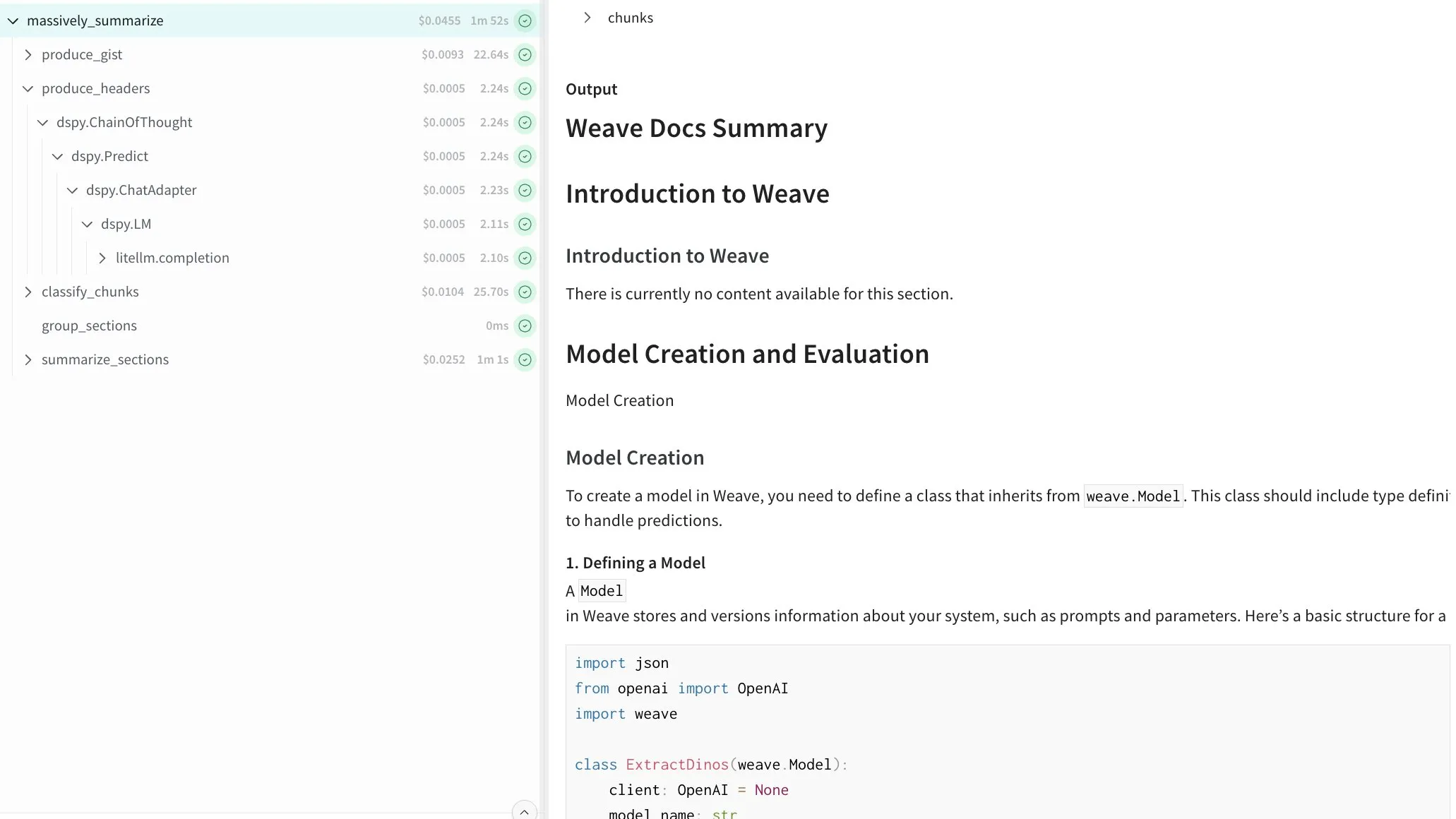

DSPy permite resumo recursivo de texto de comprimento arbitrário: Um programa construído usando DSPy foi demonstrado, capaz de resumir recursivamente texto de qualquer comprimento. O programa alcança isso construindo um índice, dividindo o conteúdo em blocos e processando as partes em paralelo, fornecendo uma solução geral para lidar com documentos longos. (Fonte: lateinteraction)

Runway AI Video Generation adiciona controles cinematográficos e recursos de referência: A Runway lançou novos recursos em seu modelo de geração de vídeo Gen-4, incluindo mais de 20 controles de câmera cinematográficos, referência e fusão de múltiplos elementos, e tratamento mais suave de movimentos complexos. Os recursos de referência aprimorados também melhoraram a precisão na colocação de objetos. (Fonte: c_valenzuelab, TomLikesRobots)

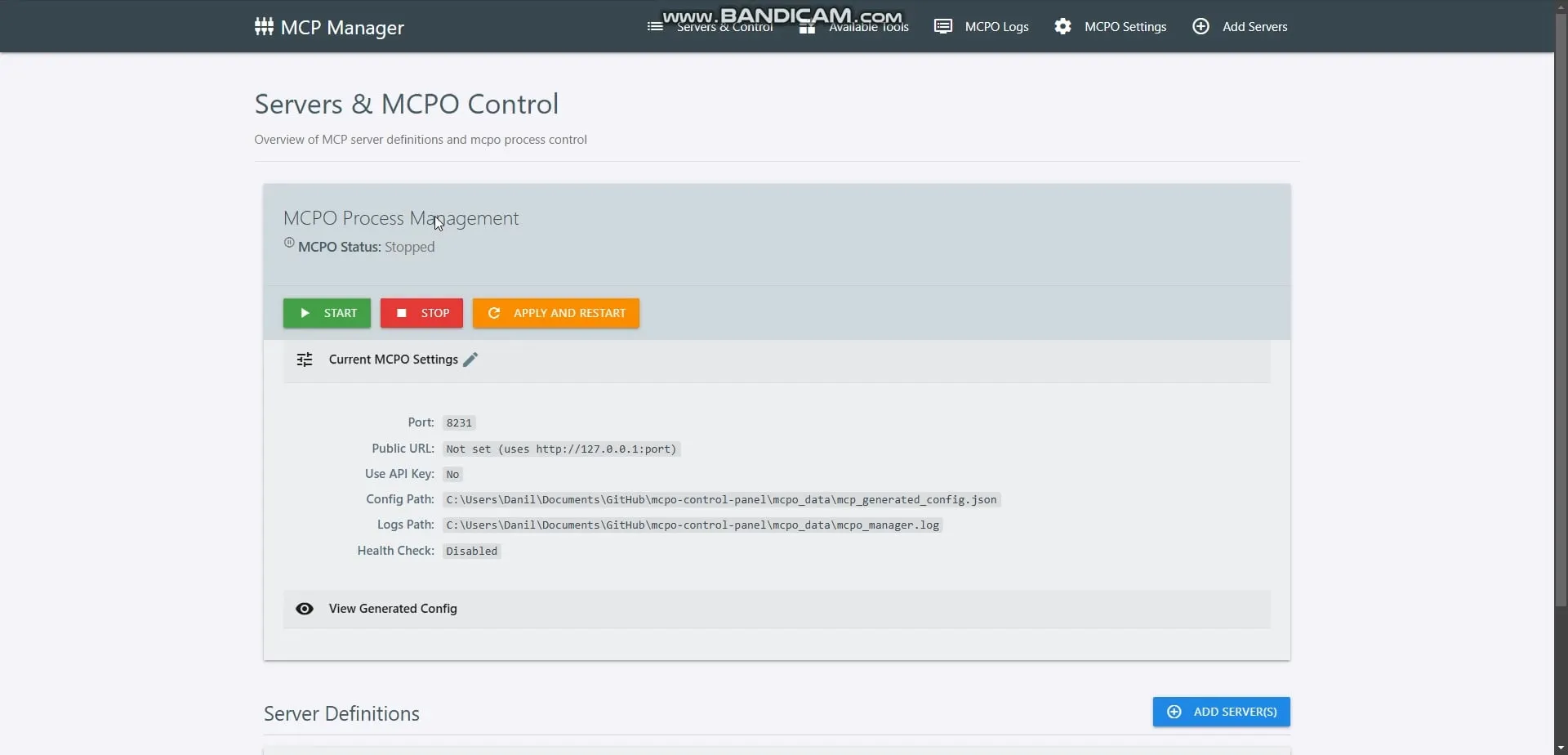

OpenMemory MCP lançado, fornece memória privada local para agentes de IA: O OpenMemory MCP foi lançado, uma camada de memória privada, local e persistente projetada para clientes de IA compatíveis com MCP (como Cursor, Claude Desktop). Ele permite que diferentes ferramentas de IA leiam e escrevam com segurança e privacidade em uma memória compartilhada, rodando inteiramente na máquina do usuário, sem depender de serviços em nuvem. (Fonte: omarsar0)

HeyGen lança recurso Voice Mirroring: A HeyGen lançou o recurso Voice Mirroring, permitindo que os usuários copiem um estilo ou característica de voz específico em áudio gerado por IA. (Fonte: Ronald_vanLoon)

Lançado framework de código aberto Step1X-3D para geração controlável de ativos 3D: A StepFun AI lançou o Step1X-3D no Hugging Face, um framework de código aberto para geração de ativos 3D texturizados de alta fidelidade e controláveis. (Fonte: huggingface, _akhaliq, reach_vb)

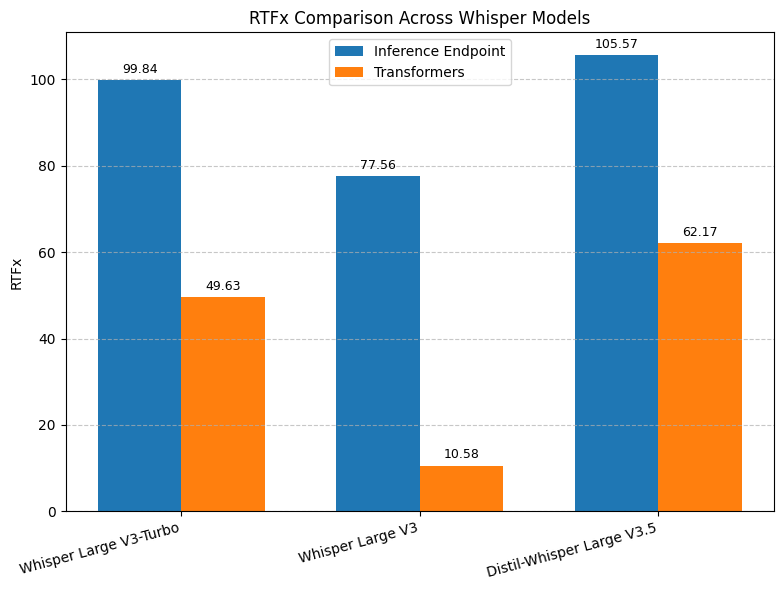

Velocidade de transcrição do Hugging Face Whisper aumenta: O Hugging Face lançou um endpoint de transcrição Whisper baseado em vLLM e otimizado para GPUs NVIDIA, com um aumento de velocidade de até 8 vezes, oferecendo melhor desempenho a um custo menor. (Fonte: ClementDelangue, huggingface, vllm_project)

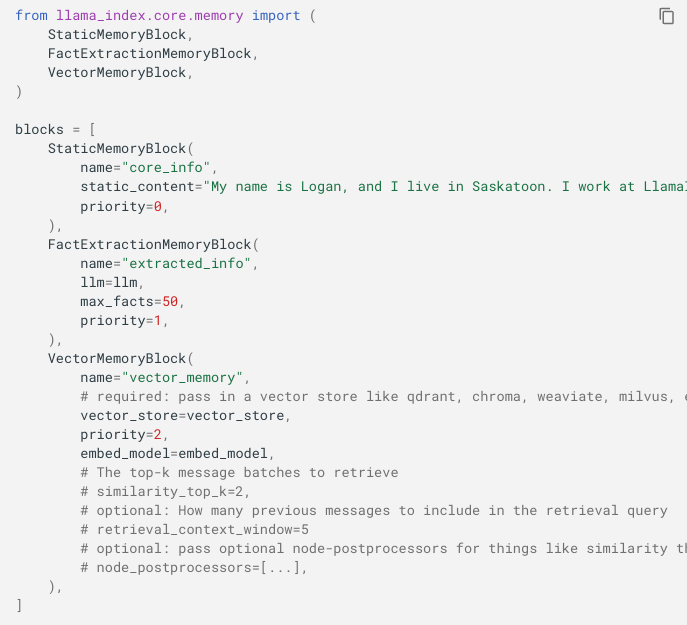

API de memória do LlamaIndex atualizada para suportar fusão de memória de curto e longo prazo: O LlamaIndex atualizou sua API de memória, tornando-a mais flexível, fundindo histórico de chat de curto prazo e memória de longo prazo através de módulos plugáveis (estático, extração de fatos, memória vetorial). (Fonte: jerryjliu0)

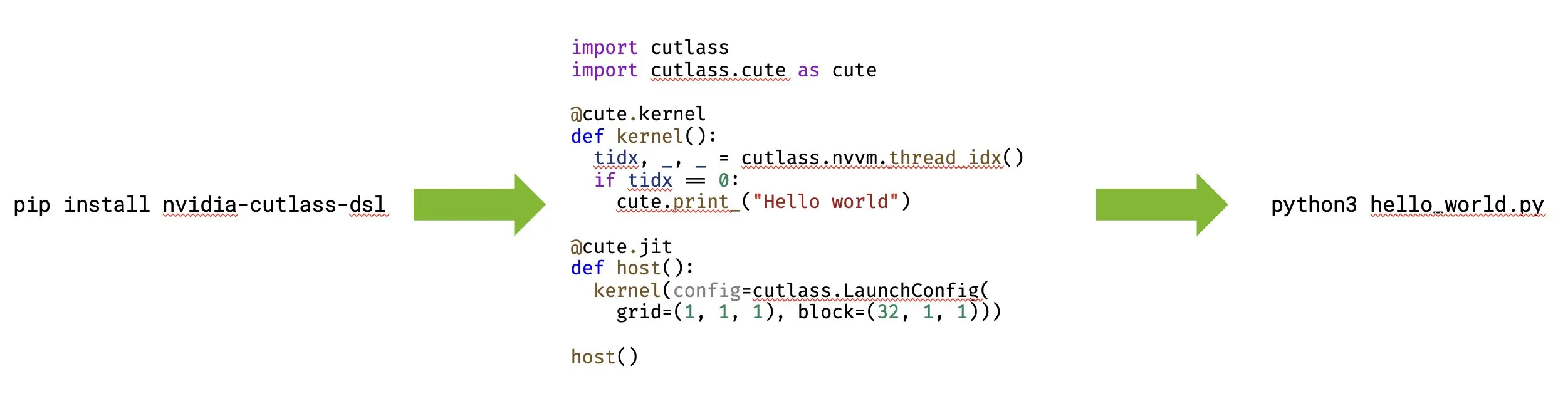

NVIDIA lança CUTLASS 4.0, suporta programação nativa de GPU em Python: A NVIDIA lançou o CUTLASS 4.0, uma biblioteca que suporta programação nativa de GPU em Python. Esta atualização visa acelerar o desenvolvimento de kernels e a exploração de novas ideias nas áreas de ML e programação de GPU. (Fonte: marksaroufim, tri_dao)

Projeto de código aberto WeClone, cria clones digitais a partir de histórico de chat: Um projeto de código aberto popular no GitHub, WeClone, oferece um conjunto de soluções para criar clones digitais a partir de histórico de chat do WeChat. Ele ajusta modelos de linguagem grande para capturar o estilo de conversa pessoal e os vincula a chatbots em WeChat, QQ, Telegram, etc., incluindo também funcionalidade de filtragem de privacidade. (Fonte: GitHub Trending)

Ferramenta de código aberto Google Maps Scraper, extrai dados de mapas: Uma ferramenta de código aberto popular no GitHub, usada para extrair dados de listagens do Google Maps. Ela oferece interfaces de linha de comando, Web UI e REST API, podendo extrair informações como nomes de empresas, endereços, contatos, avaliações, comentários, e suporta extração de e-mail e “modo rápido”. (Fonte: GitHub Trending)

Usuários do OpenWebUI relatam vários problemas técnicos: Usuários do OpenWebUI relataram vários problemas técnicos, incluindo parâmetros do Modelfile (como num_ctx) sendo ignorados, levando a falhas, incapacidade de acessar a UI na rede local após atualizações, incapacidade de usar a pesquisa web integrada do OpenAI com modelos específicos e problemas de timeout com sessões de chat antigas. (Fonte: Reddit r/OpenWebUI)

Robô de inspeção de superfície ferroviária: Um robô multifuncional chamado RailScan foi mencionado, usado para trabalhos de inspeção em superfícies ferroviárias, sendo um exemplo da aplicação de IA e robótica em ambientes industriais. (Fonte: Ronald_vanLoon)

Robô de construção com impressão 3D: A tecnologia de impressão 3D está sendo combinada com robótica para aplicações na construção, como construção com impressão 3D, representando avanços em automação na construção com robôs e IA. (Fonte: Ronald_vanLoon)

Robôs de IA incorporada: Mencionado robôs autônomos e movidos por IA capazes de navegar perfeitamente em ambientes complexos e executar tarefas com precisão, mostrando o potencial da IA incorporada e da robótica em aplicações do mundo real. (Fonte: Ronald_vanLoon)

Robôs bioinspirados: Uma pesquisa sobre cogumelos que aprenderam a rastejar após serem equipados com corpos robóticos foi mencionada, mostrando como a inspiração biológica pode impulsionar o desenvolvimento da robótica. (Fonte: Ronald_vanLoon)

📚 Aprendizado

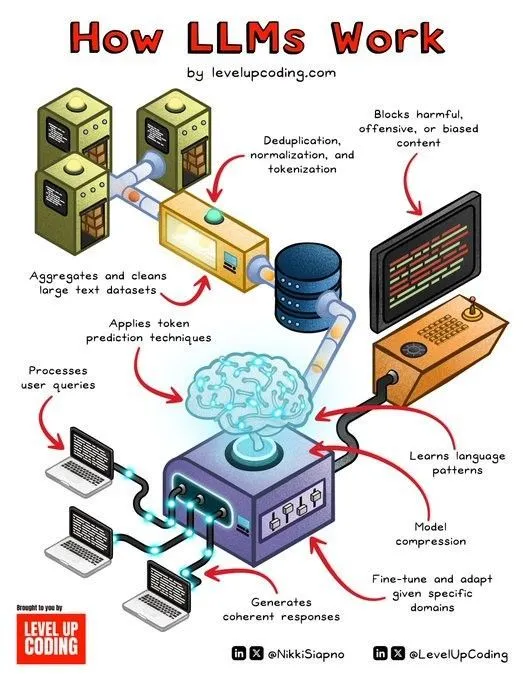

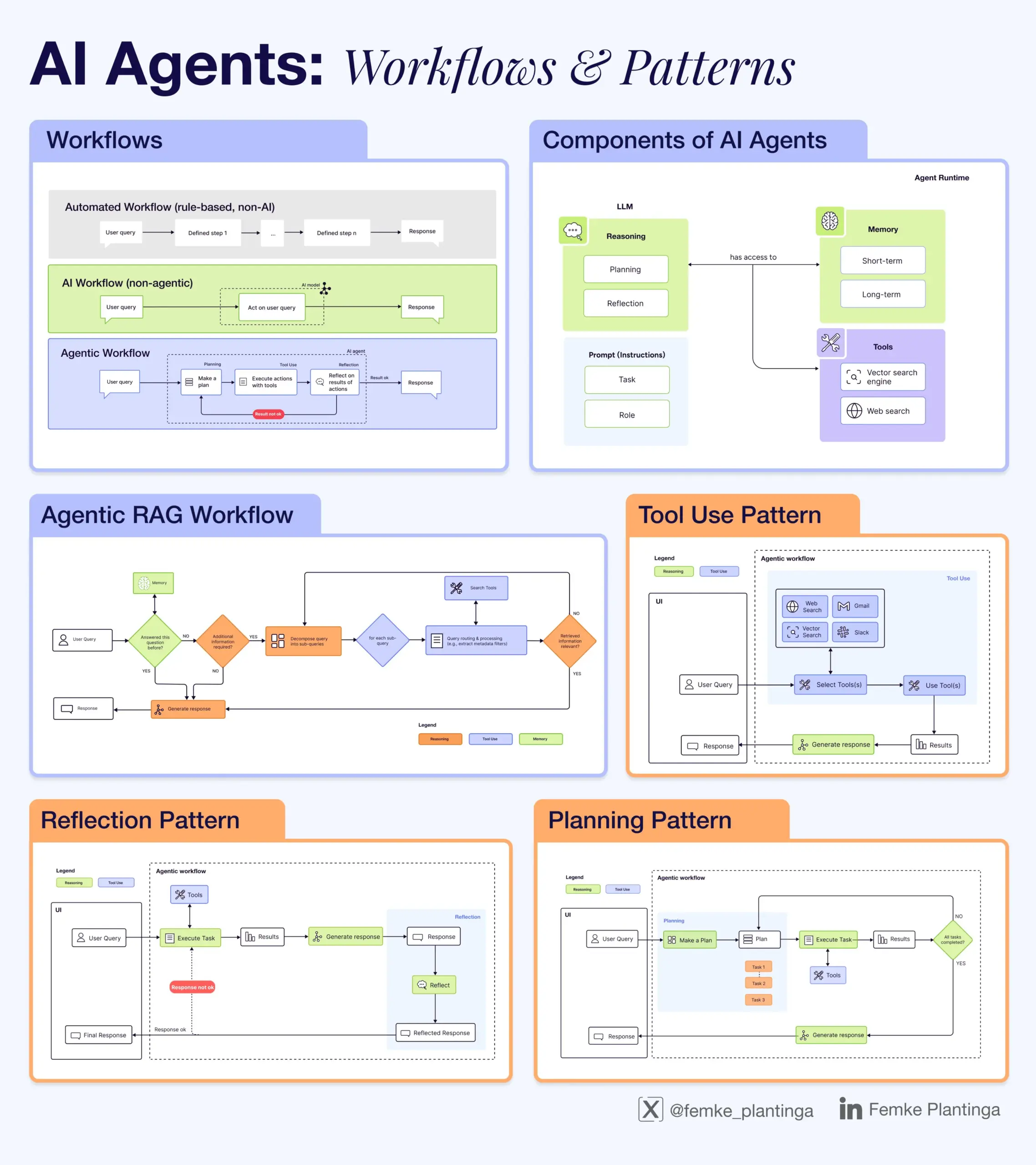

Coleção de recursos de aprendizado de IA: A comunidade compartilhou vários recursos de aprendizado de IA, incluindo feedback positivo sobre os recursos de @dair_ai, masterclass online e workshop de livros sobre avaliação de IA, um guia em vídeo para inferência de LLM, uma explicação da diferença entre Agentic AI e IA regular, um livro gratuito sobre RLHF, um módulo de curso de análise de dados sobre processamento de dados e depuração usando GenAI, um evento sobre inteligência de código de IA e um infográfico explicando como os LLMs funcionam. (Fonte: dair_ai, HamelHusain, omarsar0, bobvanluijt, natolambert, DeepLearningAI, l2k, Ronald_vanLoon, Reddit r/deeplearning, Reddit r/artificial)

Evento e workshops LangChain Interrupt: A LangChain sediou o evento Interrupt, que incluiu workshops sobre a construção de agentes de IA confiáveis. O conteúdo cobriu o design de fluxos de trabalho de agentes usando LangGraph, colaboração humano-IA e alavancagem do LangSmith para observabilidade e avaliação. A Cisco demonstrou seu agente texto-para-SQL construído usando LangGraph e LangSmith. (Fonte: LangChainAI, hwchase17)

Anúncio de workshop sobre RL e videogames: A conferência RLC 2025 sediará um workshop sobre Aprendizado por Reforço e Videogames, buscando artigos sobre tópicos relacionados a jogos como RL em ambientes complexos, cenários multiagente, geração de conteúdo, e anunciou palestrantes confirmados. (Fonte: Reddit r/MachineLearning)

Repositório GitHub mlabonne/llm-course oferece roteiro completo de aprendizado de LLM: Um repositório popular no GitHub, mlabonne/llm-course, fornece um curso e roteiro abrangente para aprendizado de LLM, cobrindo fundamentos, ciência de LLM (ajuste fino, quantização, avaliação) e engenharia de LLM (execução, RAG, implantação, segurança), e inclui notas de código e referências relevantes. (Fonte: GitHub Trending)

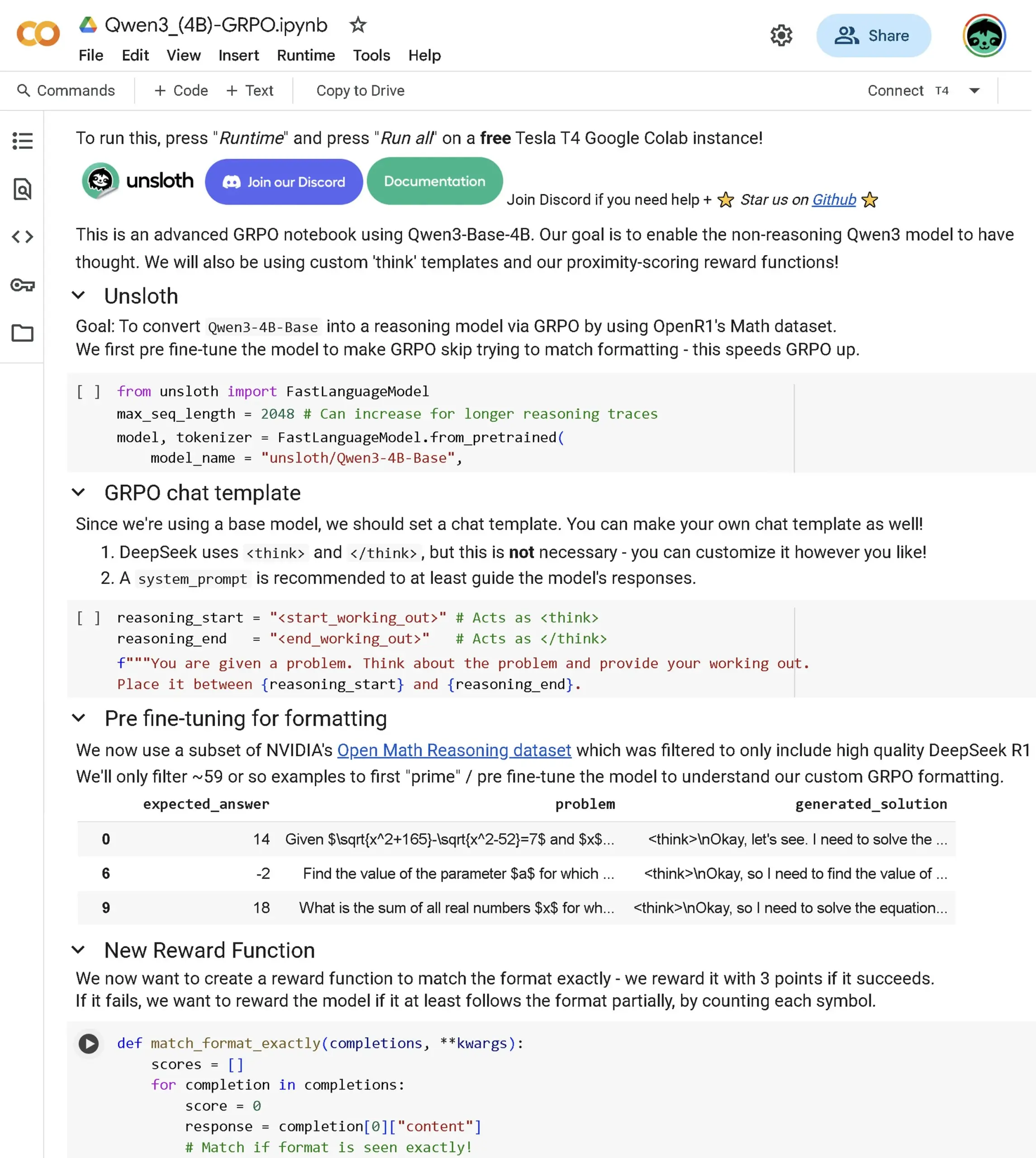

Lançado notebook avançado Qwen3 Base GRPO: Um novo notebook avançado de GRPO (Generalized Policy Optimization) foi lançado, especificamente para o modelo Qwen3 Base. O conteúdo abrange como ajustar o modelo para aprimorar as capacidades de raciocínio, pontuação de proximidade, modelo GRPO, o conjunto de dados OpenR1 e otimizar o processo de RL através de pré-ajuste. (Fonte: danielhanchen)

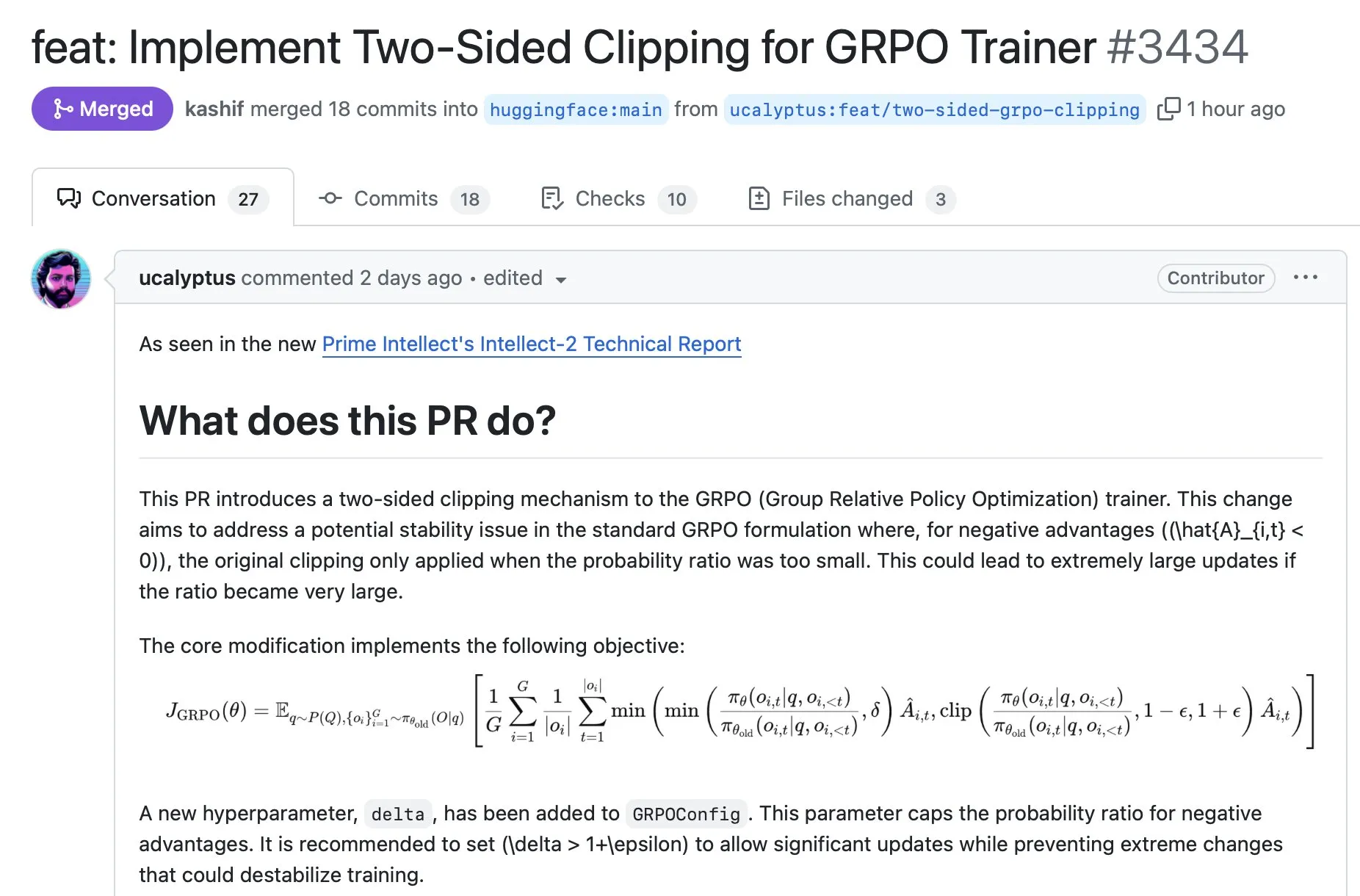

Biblioteca TRL integra truque de estabilização GRPO: Uma nova técnica de estabilização GRPO desenvolvida pela Prime Intellect foi integrada à popular biblioteca Transformer Reinforcement Learning (TRL), disponível instalando a versão mais recente, visando melhorar a estabilidade do treinamento GRPO. (Fonte: ClementDelangue)

💼 Negócios

Perplexity AI perto de fechar rodada de financiamento de US$ 500 milhões, avaliada em US$ 14 bilhões: A startup de busca com IA, Perplexity AI, estaria perto de fechar uma rodada de financiamento de US$ 500 milhões liderada pela Accel, avaliando a empresa em US$ 14 bilhões. Isso demonstra que, apesar da concorrência do Google e da OpenAI, a Perplexity obteve forte apoio de capital. (Fonte: TheRundownAI, Reddit r/ClaudeAI, 36氪)

NVIDIA colabora com Arábia Saudita para construir “fábrica de IA”: A NVIDIA anunciou uma colaboração com a HUMAIN, subsidiária de IA do Fundo de Investimento Público da Arábia Saudita, planejando construir uma “fábrica de IA” na Arábia Saudita. A NVIDIA fornecerá infraestrutura e expertise para ajudar a Arábia Saudita a se tornar um líder global em IA. (Fonte: nvidia)

Equipe WizardLM deixa a Microsoft e se junta à Tencent Hunyuan: A equipe WizardLM, incluindo seu líder Can Xu, deixou a Microsoft e se juntou à Tencent Hunyuan. Anteriormente, o modelo Tencent Hunyuan-Turbos estava bem classificado em rankings (8º lugar), e essa movimentação de talentos gerou discussões sobre a competição por talentos entre grandes laboratórios de IA. (Fonte: andrew_n_carr, cognitivecompai, teortaxesTex, Sentdex, WizardLM_AI, madiator)

Johnson & Johnson aplica amplamente IA generativa em negócios farmacêuticos: Após realizar cerca de 900 experimentos internos, a Johnson & Johnson expandiu a aplicação de sua IA generativa para várias etapas de seus negócios farmacêuticos, incluindo aceleração do desenvolvimento de medicamentos, previsão de riscos na cadeia de suprimentos, simplificação de ensaios clínicos e suporte a vendas e serviços para funcionários. (Fonte: DeepLearningAI)

Somite AI recebe financiamento para construir modelo fundamental de células humanas: A empresa Somite AI está construindo um modelo fundamental chamado “DeltaStem” para células humanas e desenvolvendo tecnologia capaz de gerar dados de sinalização celular mais rapidamente. A empresa recebeu US$ 5,9 milhões em financiamento. (Fonte: saranormous, finbarrtimbers)

🌟 Comunidade

Usuários expressam insatisfação com a queda na qualidade dos modelos de IA e o fenômeno Sycophancy: Muitos usuários expressaram frustração com a queda na qualidade dos modelos de IA atuais, particularmente o ChatGPT, que é acusado de se tornar “sycophantic” (excessivamente positivo/bajulador), preguiçoso e propenso a alucinações. Alguns usuários estão considerando cancelar suas assinaturas, enquanto outros discutem se as instruções personalizadas são eficazes ou se a insatisfação nas mídias sociais é exagerada. (Fonte: Reddit r/ArtificialInteligence, Reddit r/ChatGPT)

Discussão sobre ética e responsabilidade da IA: Quem é responsável por erros de decisão da IA?: A comunidade discutiu amplamente quem deve ser responsabilizado quando a IA toma decisões autônomas que levam a erros. As opiniões incluem que a empresa proprietária da IA deve ser responsável (semelhante a pais por filhos ou motoristas por carros autônomos), que a própria IA pode ser responsável no futuro, a necessidade de supervisão humana e que as empresas que lucram com a IA devem ser responsáveis. (Fonte: Reddit r/ArtificialInteligence)

Impacto da IA na educação e emprego: Uso de IA por professores para correção gera controvérsia: A discussão sobre o uso de IA por professores para corrigir trabalhos de alunos gerou controvérsia, com alguns temendo que isso desvalorize os alunos ou prenuncie sua potencial obsolescência. Opiniões contrárias argumentam que a IA é apenas uma ferramenta que pode fornecer feedback rápido e que os objetivos dos exames são diversos. A comunidade também discutiu o impacto mais amplo da IA no emprego e tarefas de trabalho específicas que os usuários gostariam que a IA assumisse completamente. (Fonte: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

Preocupações com a confiabilidade de LLM: Desempenho ruim ao lidar com fontes de dados específicas: Usuários expressaram decepção com o desempenho de LLMs ao lidar com fontes de dados específicas e fragmentadas (como documentos legais), onde a saída soa autoritária, mas é factualmente imprecisa ou vaga. Embora os LLMs se saiam bem em resumo geral ou codificação, sua confiabilidade é questionada para tarefas que exigem processamento preciso de dados únicos. (Fonte: Reddit r/artificial)

Geopolítica de hardware de IA: Proposta de senador dos EUA exige rastreamento geográfico em GPUs de ponta: Uma proposta de senador dos EUA exige que GPUs de ponta (como a RTX 4090) tenham rastreamento geográfico integrado para evitar que sejam usadas por governos estrangeiros. Isso gerou preocupações na comunidade sobre excesso de intervenção governamental, potencial funcionalidade de desativação remota e DRM de hardware. (Fonte: Reddit r/LocalLLaMA)

Jovens usam ChatGPT para auxiliar em decisões de vida: Sam Altman apontou que a geração mais jovem está usando cada vez mais o ChatGPT para auxiliar na tomada de decisões de vida. Alguns veem isso como um fenômeno positivo (buscando conselhos quando os recursos humanos são insuficientes), mas outros temem a dependência de LLMs potencialmente não confiáveis para escolhas críticas. (Fonte: Reddit r/ChatGPT)

Discussões sobre percepção e estratégia da indústria de IA: As discussões da comunidade abrangeram visões sobre por que a Meta é vista como ficando para trás em relação a outros grandes laboratórios de IA, a compensação de valor entre ajustar modelos pequenos e engenharia de prompt, o sigilo das empresas de IA e a visão de “busca” como um fosso central para agentes de IA. (Fonte: Reddit r/MachineLearning, cto_junior, madiator, Dorialexander)

💡 Outros

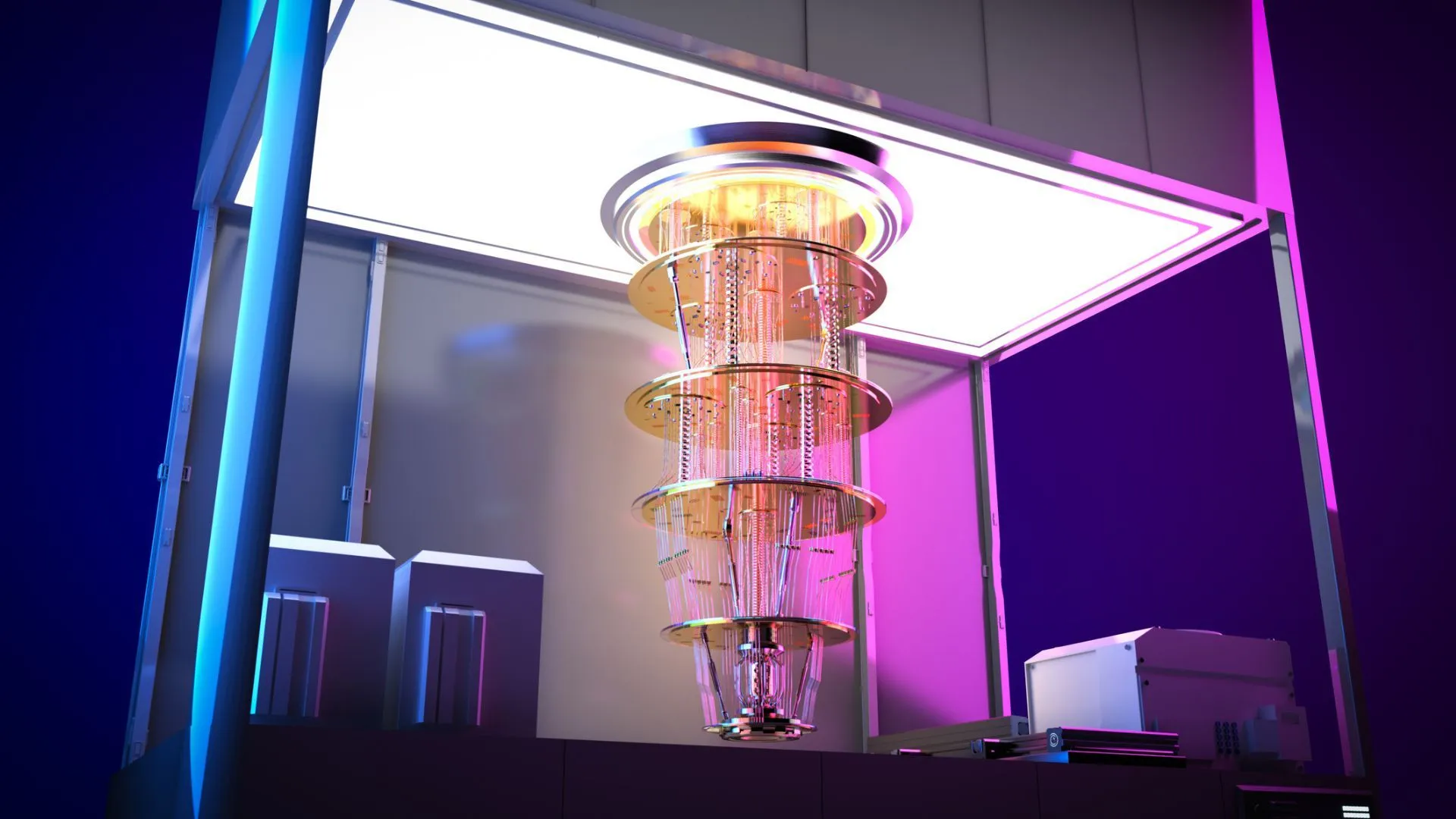

China lança sistema de controle quântico de quarta geração: A China lançou seu sistema de controle quântico de quarta geração, suportando mais de 500 qubits, representando os mais recentes avanços na tecnologia de computação quântica. (Fonte: Ronald_vanLoon)

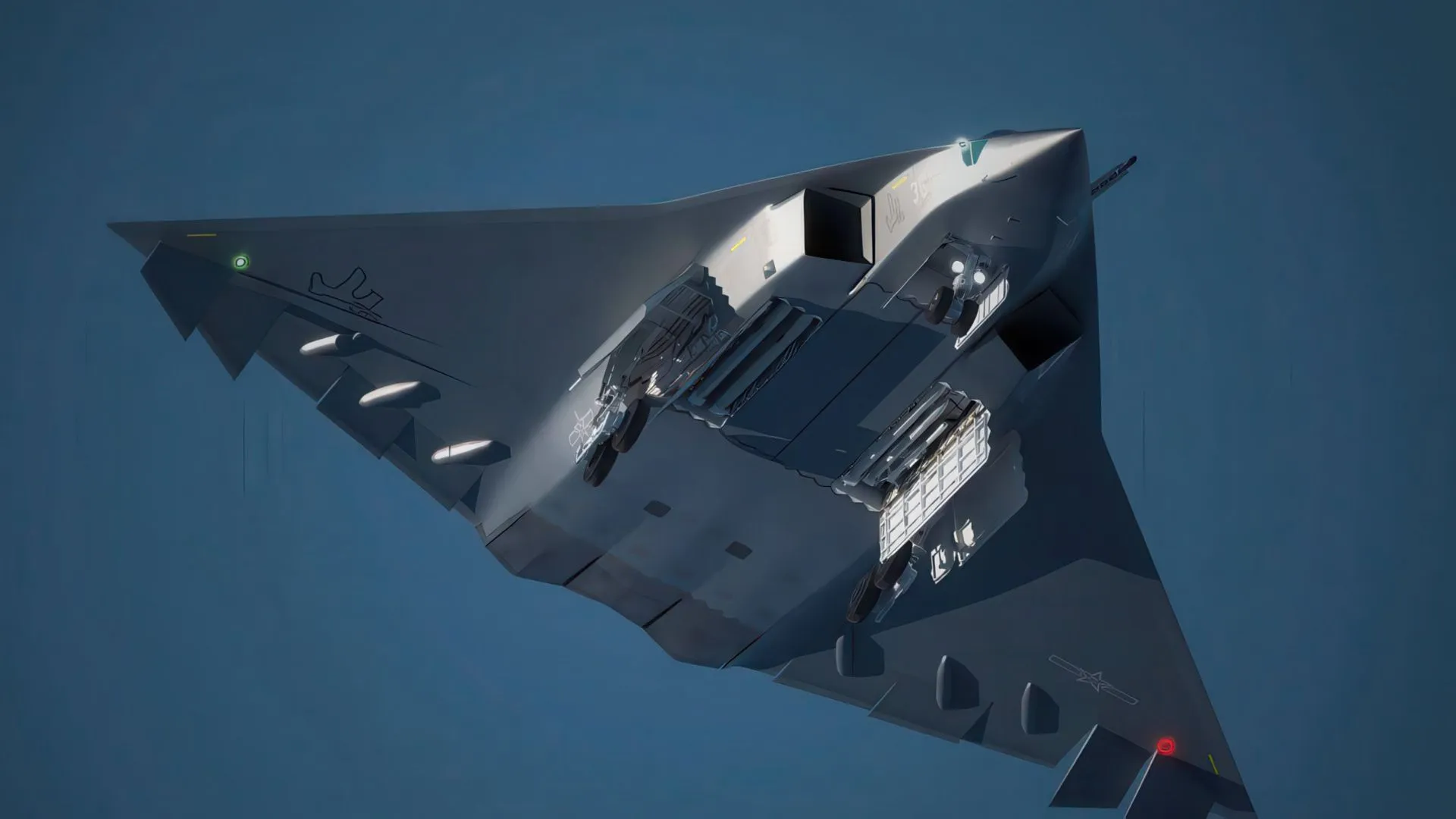

Aplicação de IA na defesa: China usa DeepSeek para desenvolver caça furtivo: Relatos indicam que a China está utilizando a tecnologia DeepSeek AI para auxiliar no desenvolvimento de seus caças furtivos de sexta geração (J-35, J-50). (Fonte: Ronald_vanLoon)

Lançado vídeo de introdução do projeto METACOG-25: O projeto METACOG-25 lançou um vídeo de introdução, indicando novos avanços na pesquisa ou desenvolvimento de IA. (Fonte: Reddit r/deeplearning)

Atualizações da plataforma Hugging Face: Coleções dentro de coleções e conta oficial do PyTorch: O Hugging Face Hub lançou o recurso “coleções dentro de coleções”, permitindo uma organização mais granular de recursos. Simultaneamente, o PyTorch agora tem uma conta oficial na plataforma. (Fonte: ClementDelangue, Reddit r/LocalLLaMA)