Palavras-chave:Transformer, Noam Shazeer, ChatGPT, Gemini, DeepSeek R1, Tecnologia de IA, Modelo de Linguagem Grande (LLM), Modelo de Especialista Misto (MoE), Atenção de Múltiplas Consultas (MQA), Camada Linear Controlada (GLU), Paradigma de Aprendizado por Reforço Absolute Zero, Modelo de Código Seed-Coder-8B

🔥 Destaques

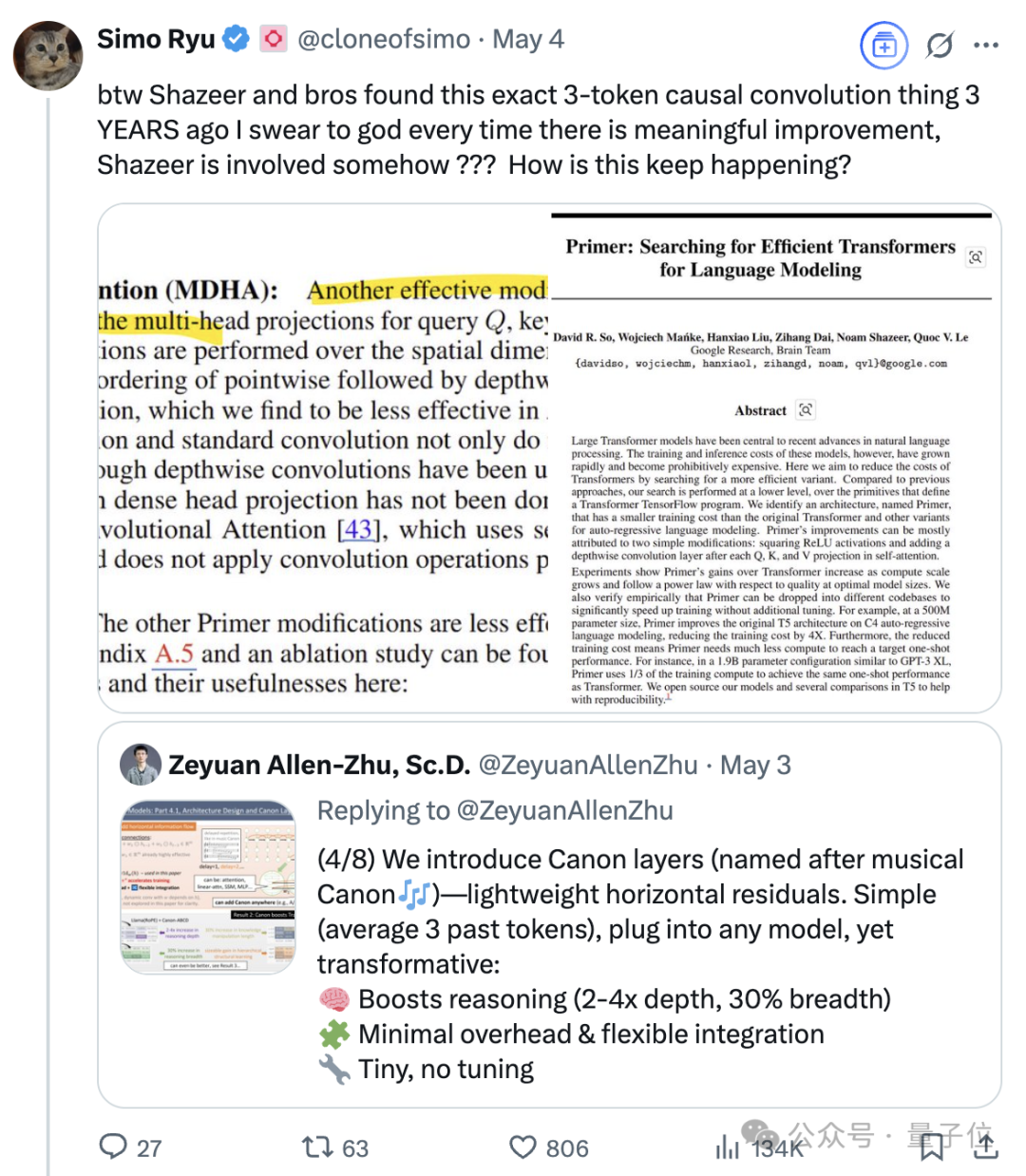

Noam Shazeer: O cérebro por trás do Transformer e a evolução da tecnologia de IA: Noam Shazeer, um dos oito autores da arquitetura Transformer, é amplamente reconhecido como o maior contribuidor. Sua pesquisa não apenas estabeleceu as bases para os modelos de linguagem grandes modernos (como em “Attention Is All You Need”), mas também impulsionou profeticamente o desenvolvimento de tecnologias cruciais como modelos de Mixture-of-Experts (MoE), o otimizador Adafactor, Multi-Query Attention (MQA) e Gated Linear Units (GLU). Recentemente, os resultados de suas primeiras pesquisas voltaram a chamar a atenção, destacando sua visão tecnológica vanguardista. Shazeer cofundou a Character.AI e, posteriormente, retornou ao Google para liderar o projeto Gemini, continuando a influenciar o campo da IA. (Fonte: 36氪)

Tráfego do ChatGPT dispara, desafiando o domínio do Google Search: Dados da Similarweb mostram que, em abril de 2025, o volume mensal de visitas ao ChatGPT cresceu 13,04%, ultrapassando 5 bilhões de acessos, superando o X (anteriormente Twitter) para se tornar o quinto maior site do mundo e a única plataforma entre os dez primeiros a registrar crescimento mensal positivo. Essa tendência indica que aplicativos de IA representados pelo ChatGPT estão mudando significativamente a forma como os usuários obtêm informações, representando uma ameaça substancial para os motores de busca tradicionais, especialmente em cenários de trabalho e estudo, onde a dependência dos usuários em ferramentas de IA está crescendo. (Fonte: 36氪, Similarweb on X)

DeepSeek R1 em alta há cem dias: Remodelando o cenário de capital de risco em IA e o ecossistema de startups: Desde seu lançamento em janeiro de 2025, o DeepSeek R1, com sua estratégia de código aberto de baixo custo, atraiu ampla atenção no campo da IA, impactando profundamente o mercado de capital de risco e o ecossistema de startups. O modelo não apenas trouxe novas oportunidades de desenvolvimento para startups em hardware de IA, desenvolvimento de Agent, etc., mas também levou players importantes como Kimi da Moonshot AI e Zhipu AI a ajustar suas estratégias de mercado, intensificando a competição por aplicativos de IA e comercialização. O interesse dos investidores em aplicativos de IA e inteligência incorporada aumentou, mas o investimento em modelos de base grandes tornou-se mais cauteloso, mostrando que o foco do mercado está se deslocando para aplicativos downstream. (Fonte: 36氪)

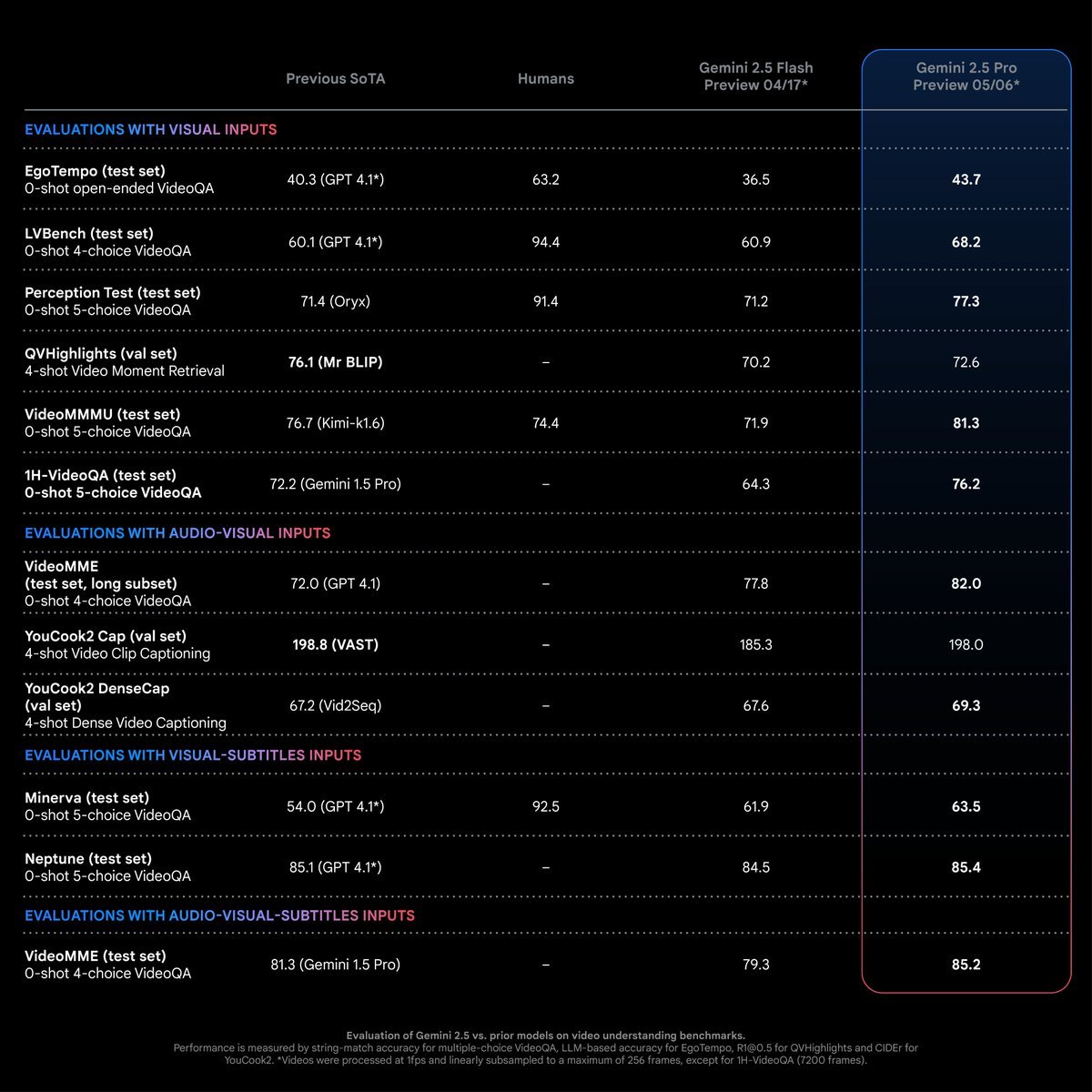

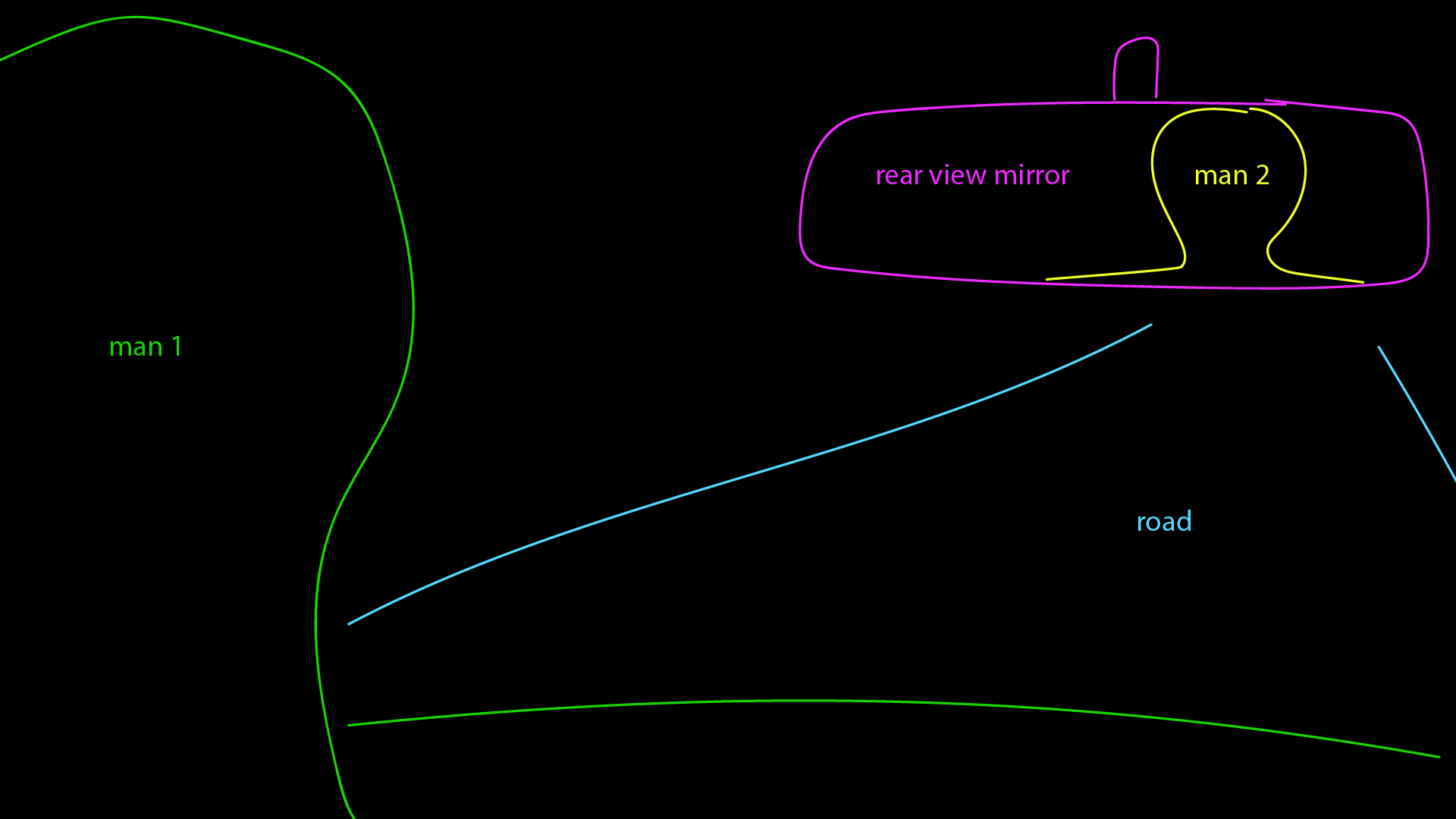

Gemini 2.5 Pro faz progressos significativos na compreensão de vídeo: O Gemini 2.5 Pro do Google demonstrou excelente desempenho na capacidade de compreensão de vídeo, não apenas liderando em tarefas tradicionais de análise de vídeo, mas também desbloqueando novos cenários de aplicação. Sua capacidade de compreensão de vídeo superou os modelos SOTA existentes e até mesmo o nível humano em vários conjuntos de teste. Jeff Dean destacou que o novo modo de 66 tokens por quadro (substituindo 258 tokens) permite o processamento de mais de 6 horas de vídeo (1fps) em um contexto de 2M tokens, expandindo enormemente o potencial para análise de vídeos longos. (Fonte: matvelloso, op7418, JeffDean)

Artigo Absolute Zero: Aprimorando a capacidade de raciocínio de LLMs através de autoaprendizagem reforçada, sem dados externos: Um artigo intitulado “Absolute Zero: Reinforced Self-play Reasoning with Zero Data” introduz um novo paradigma de aprendizado por reforço, “Absolute Zero”, com o objetivo de aprimorar as capacidades de raciocínio de modelos de linguagem grandes (LLM) sem depender de quaisquer dados externos, permitindo que um único modelo proponha e resolva tarefas autonomamente. O sistema AZR verifica tarefas e respostas através de um executor de código, alcançando aprendizado em ciclo aberto e obtendo desempenho SOTA em tarefas de codificação e raciocínio matemático, demonstrando o potencial para a evolução autônoma da IA. (Fonte: Reddit r/LocalLLaMA, teortaxesTex)

🎯 Tendências

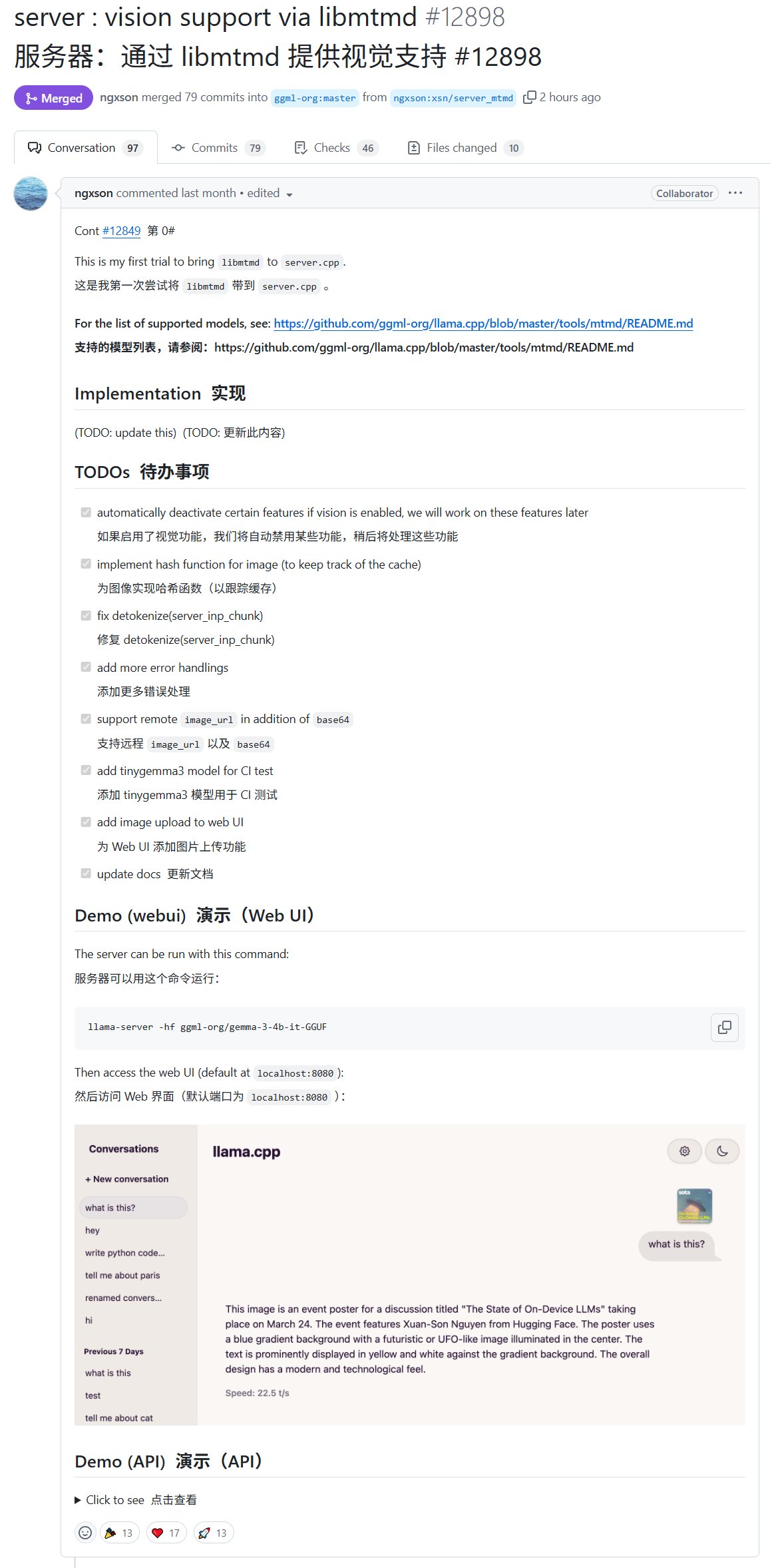

Servidor Llama.cpp agora suporta modelos de visão, expandindo aplicações multimodais locais: O servidor llama-server embutido no Llama.cpp agora suporta modelos de visão, permitindo que os usuários comecem a usar modelos multimodais quantizados com gguf. Esta importante atualização, contribuída por Xuan-Son Nguyen (ngxson) e outros, torna mais conveniente executar e interagir com aplicações de IA multimodais em dispositivos locais, o que é significativo para cenários de computação de borda e proteção de privacidade. (Fonte: karminski3, reach_vb, ggerganov, Reddit r/LocalLLaMA)

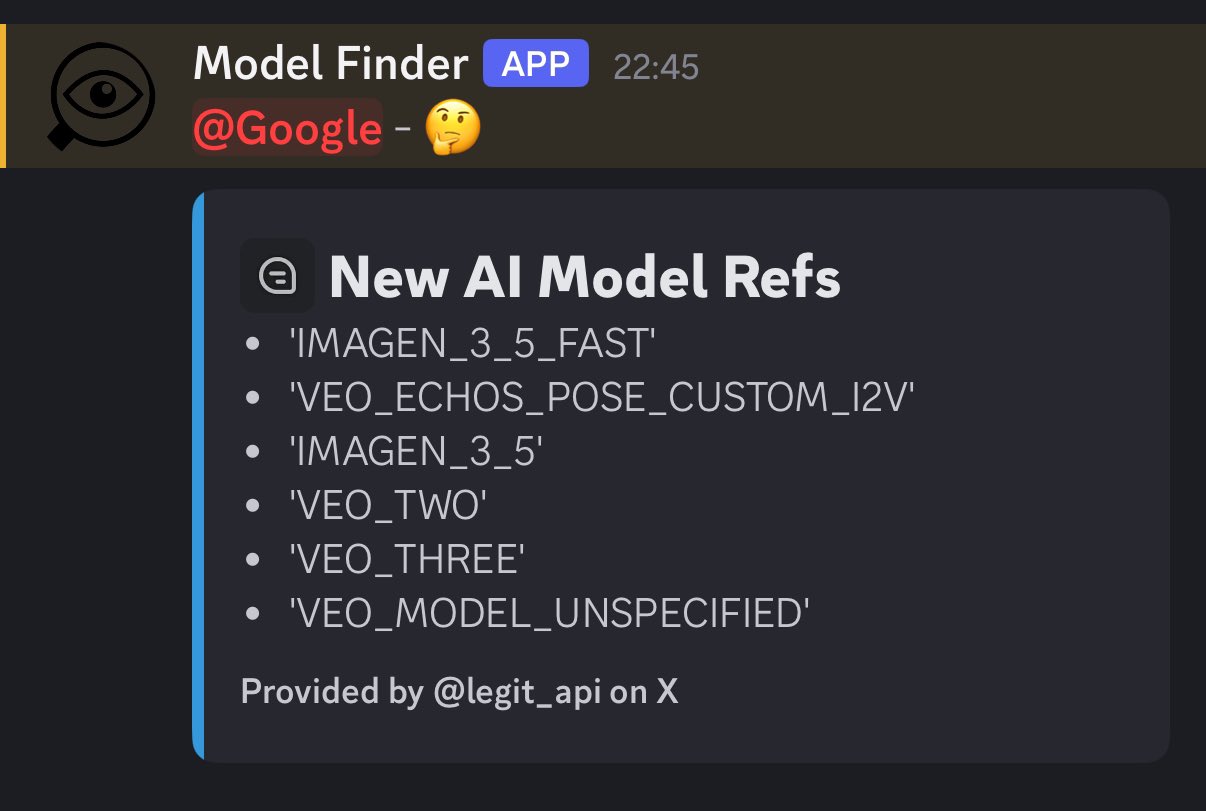

Google pode lançar novos modelos de imagem e vídeo Veo 3.0 e Imagen 4.0 na conferência I/O: Fontes indicam que o Google planeja lançar novos modelos de geração de imagem e vídeo em sua conferência I/O em maio, incluindo veo-3.0-generate-preview, imagen-4.0-generate-preview-05-20 e imagen-4.0-ultra-generate-exp-05-20. Isso sugere que o Google terá atualizações importantes no campo da geração multimodal, com o desempenho do Veo 3.0 sendo particularmente aguardado. (Fonte: op7418)

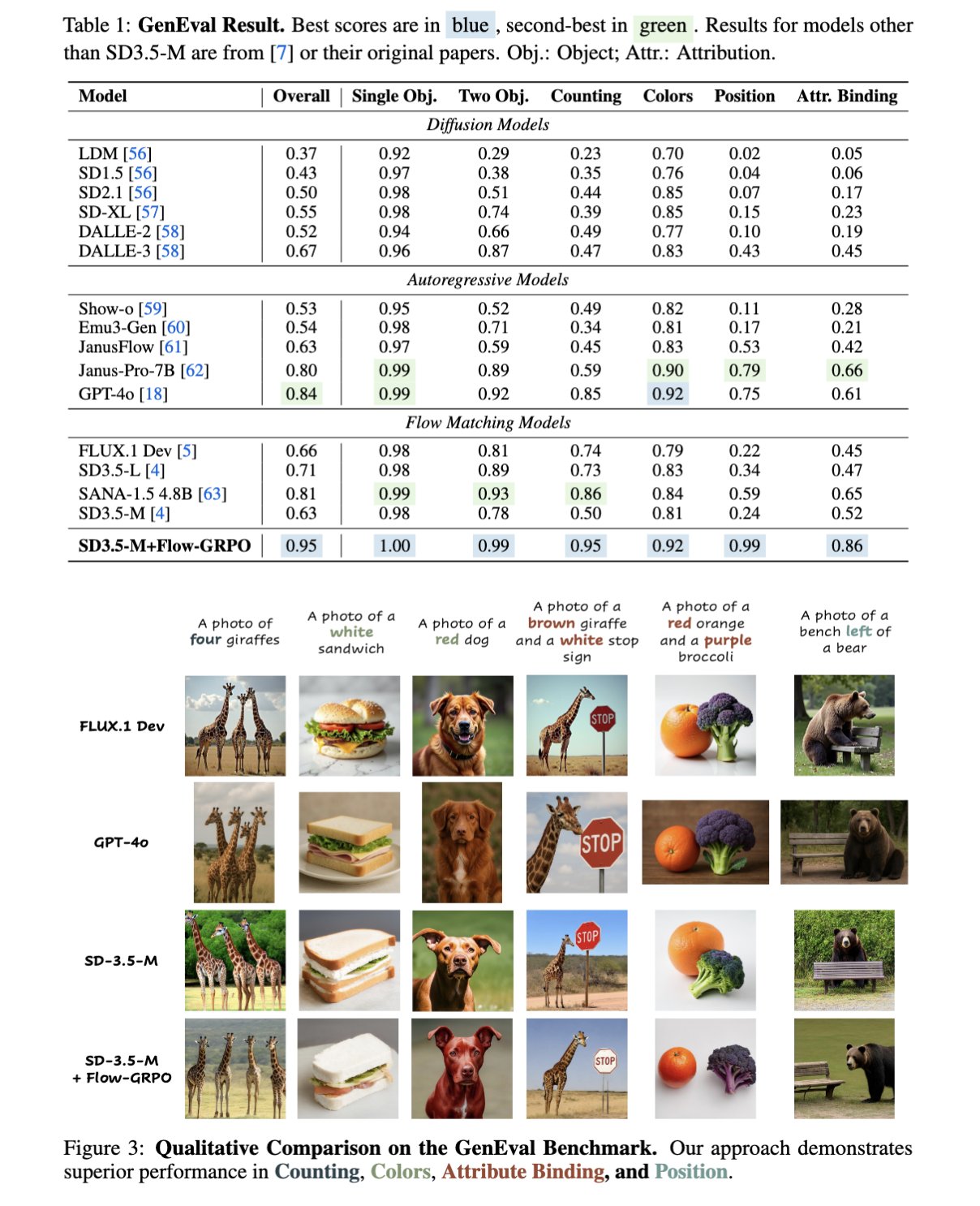

Flow-GRPO: Combinando aprendizado por reforço online para melhorar a geração de imagens em modelos de flow matching: Flow-GRPO é um novo método proposto que, pela primeira vez, integra aprendizado por reforço (RL) online em modelos de flow matching. Experimentos mostram que o SD3.5 ajustado por RL alcança precisão quase perfeita no número de objetos, relações espaciais e atributos de granulação fina ao gerar imagens, melhorando significativamente a conformidade com os prompts e a qualidade da geração em tarefas de texto para imagem. (Fonte: teortaxesTex)

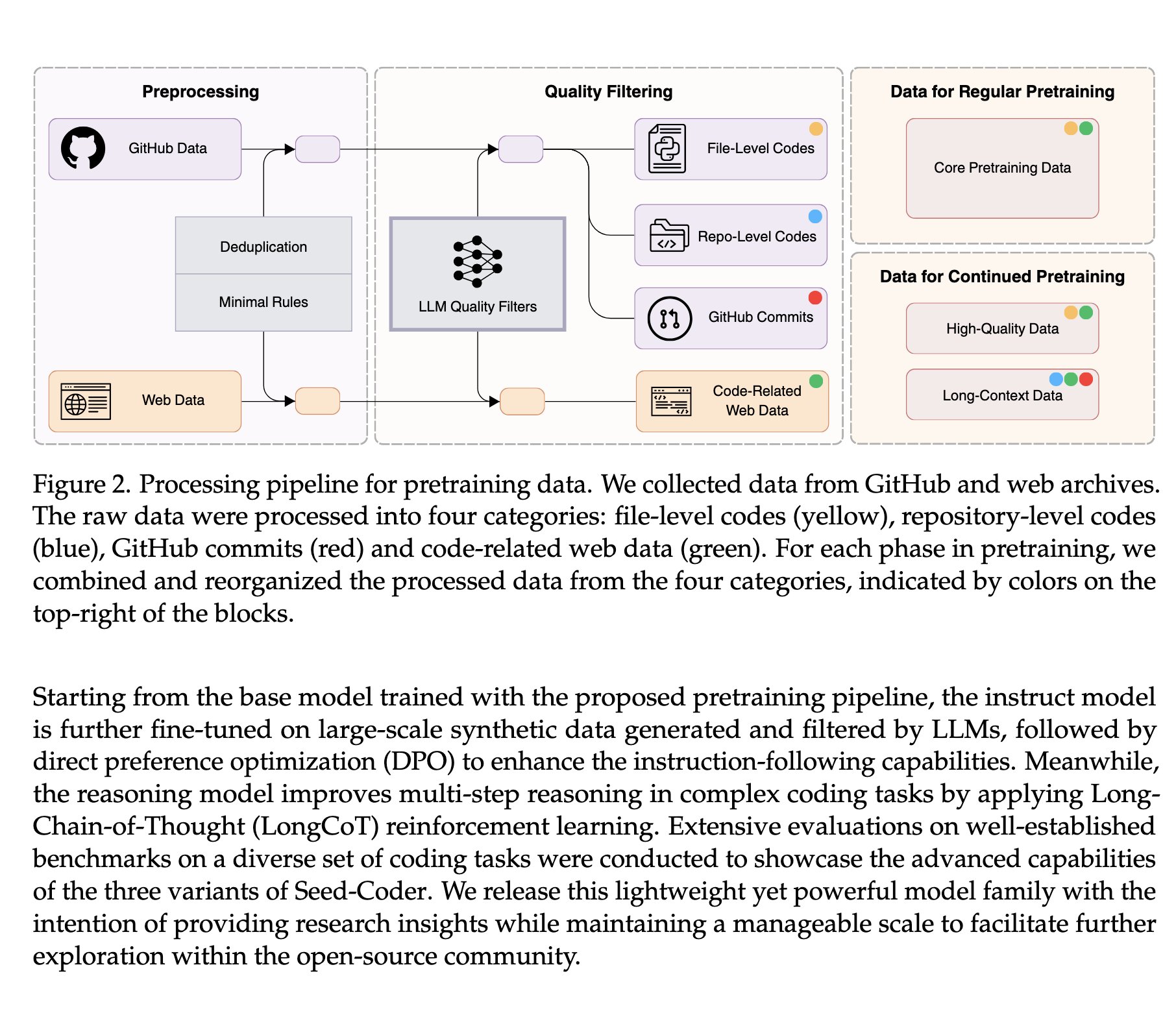

ByteDance lança Seed-Coder-8B de código aberto: Modelo de código alcança SOTA com autogerenciamento de dados: A equipe Seed da ByteDance lançou a série de modelos de linguagem grandes para código Seed-Coder-8B, incluindo as versões Base, Instruct e Reasoner. O modelo foi treinado em 6T tokens de dados, e sua principal inovação reside em “deixar o modelo de código curar dados para si mesmo”, alcançando um método SOTA de processamento de dados e superando o desempenho do Qwen3-8B. Isso demonstra o enorme potencial do gerenciamento automatizado de dados para aprimorar as capacidades dos LLMs de código. (Fonte: Dorialexander, scaling01)

Google AI lança Mobility AI, visando promover a inteligência no transporte urbano: O Google AI anunciou o projeto Mobility AI, dedicado a usar tecnologia de inteligência artificial para melhorar os sistemas de transporte urbano. O projeto pode abranger múltiplos aspectos, como otimização do fluxo de tráfego, programação do transporte público e coordenação de direção autônoma, com o objetivo de melhorar a eficiência, segurança e sustentabilidade do transporte. (Fonte: Ronald_vanLoon)

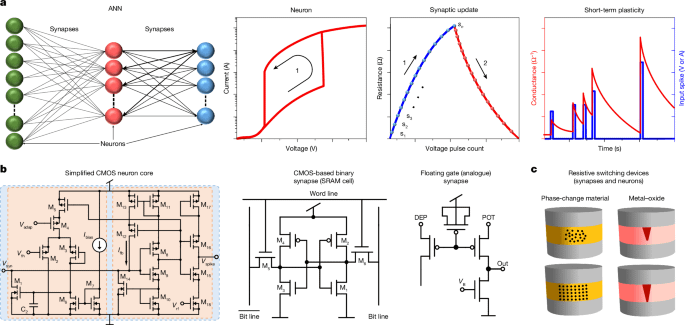

Pesquisa sobre simulação de neurônios com um único transistor avança: Um artigo publicado na Nature aponta que um único transistor pode simular a função de um neurônio. Embora isso não signifique que os PCs executarão inteligência sobre-humana a curto prazo (porque as sinapses também precisam de transistores), esta pesquisa abre novas perspectivas para o futuro do design de processadores e da computação neuromórfica, podendo ter um impacto profundo no hardware de IA nos próximos anos. (Fonte: Reddit r/LocalLLaMA)

Pesquisa do MIT utiliza IA para aprimorar o planejamento do tráfego aéreo: Pesquisadores do MIT estão utilizando tecnologia de inteligência artificial para aprimorar o planejamento e gerenciamento do tráfego aéreo. Isso pode incluir a otimização de rotas aéreas, o aumento da eficiência do uso do espaço aéreo, a previsão e resposta a conflitos potenciais, entre outros, com o objetivo de tornar o tráfego aéreo mais eficiente e seguro. (Fonte: Ronald_vanLoon)

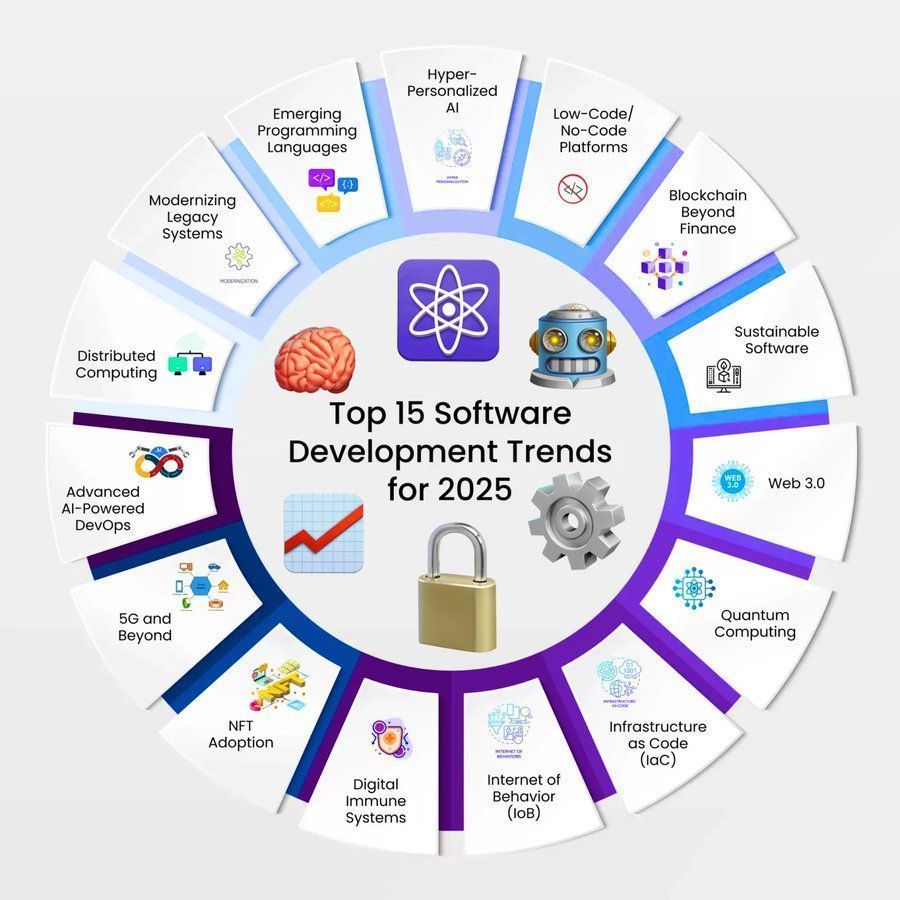

Perspectivas de tendências da IA no desenvolvimento de software (2025): O relatório prevê as 15 principais tendências no desenvolvimento de software para 2025, nas quais inteligência artificial, aprendizado profundo e aprendizado de máquina continuarão a desempenhar um papel central, impulsionando o desenvolvimento em direções como automação, codificação inteligente, testes e operações. (Fonte: Ronald_vanLoon)

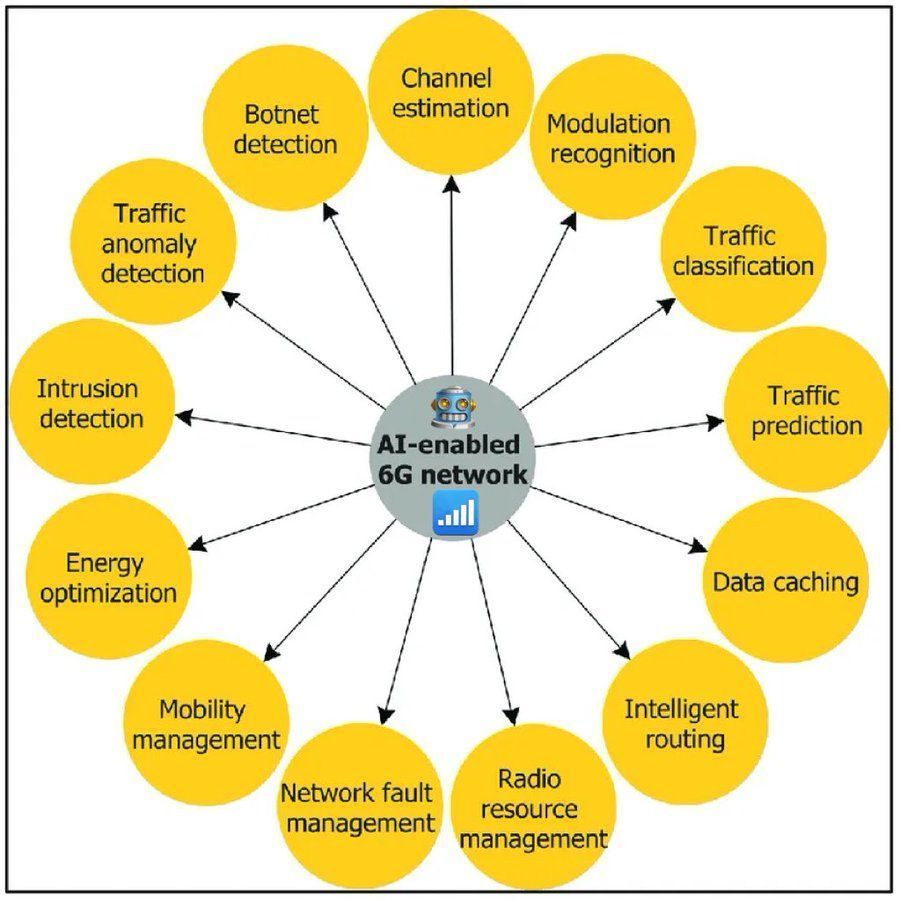

Perspectivas para redes 6G habilitadas por IA: Discutiu o papel crucial da inteligência artificial na futura rede 6G, incluindo alocação inteligente de recursos, auto-otimização da rede, serviços personalizados e suporte para conexão de dispositivos IoT em larga escala, entre outros aspectos. A IA será a tecnologia central para realizar a visão do 6G. (Fonte: Ronald_vanLoon)

Pesquisador do DeepMind acredita que LLMs já possuem algumas capacidades de modelo de mundo: Sam Wolfstone, pesquisador do DeepMind, acredita que os modelos de linguagem grandes (LLM) construíram muitos modelos de mundo limitados e locais durante seu processo de pré-treinamento e pós-treinamento. A capacidade de um modelo resolver tarefas está relacionada ao grau em que seu modelo de mundo parcial modela a tarefa, mas atualmente os LLMs não conseguem desenvolver dinamicamente novos modelos de mundo parciais. (Fonte: SamWolfstone)

OpenAI dedicada a expandir as aplicações de aprendizado por reforço (RL): Dan Roberts, da OpenAI, em sua palestra na Sequoia AI Ascent, compartilhou como a empresa está se esforçando para mudar a percepção tradicional do aprendizado por reforço (RL) como sendo apenas “a cereja do bolo” e está dedicada a expandi-lo para cenários de aplicação mais amplos. (Fonte: jeffreygwang)

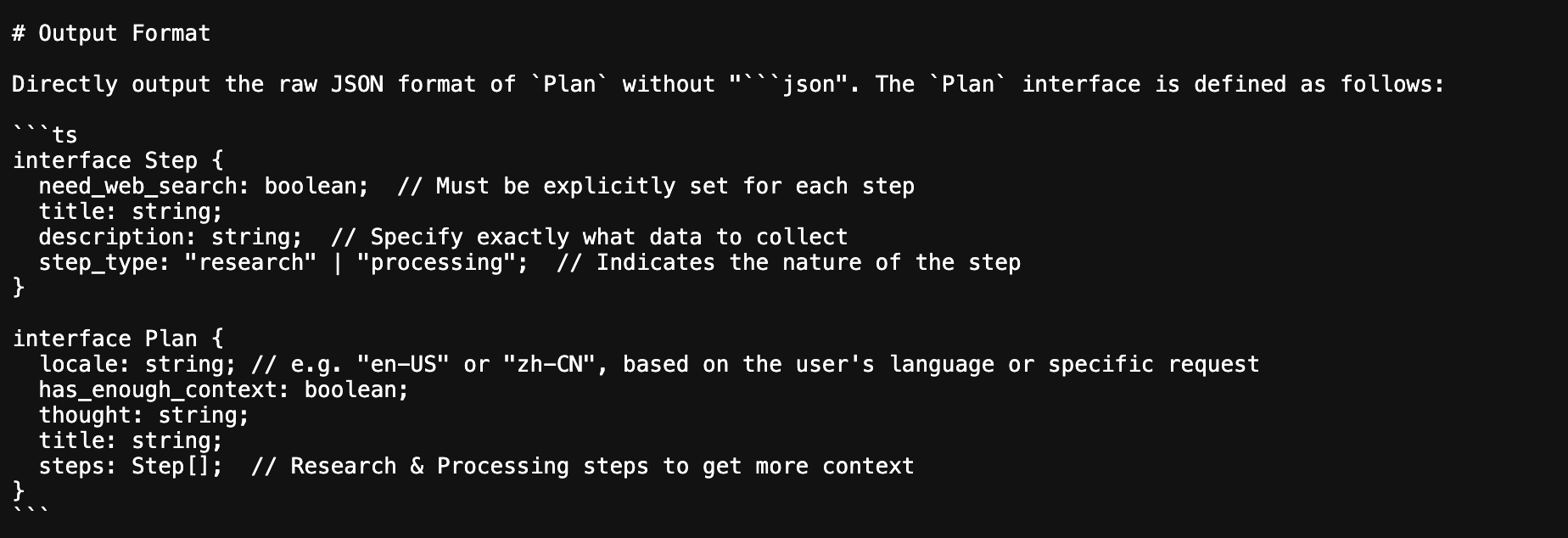

ByteDance Deep Research Agent usa interfaces Typescript para definir esquemas de saída JSON: Uma análise do Deep Research Agent de código aberto da ByteDance revelou que o projeto usa interfaces Typescript para definir e padronizar à força os esquemas de saída JSON. Esse método ajuda a melhorar a estabilidade e a confiabilidade da troca de dados na colaboração multi-Agent. (Fonte: _philschmid)

🧰 Ferramentas

WebOllama: Uma interface de usuário web elegante para Ollama: WebOllama é uma interface web projetada para Ollama, visando simplificar o gerenciamento e uso de modelos de linguagem grandes (LLM) locais. Oferece uma UI intuitiva para gerenciar modelos Ollama, conversar com IA e gerar texto, facilitando a interação dos usuários com LLMs em seus ambientes locais. (Fonte: Reddit r/LocalLLaMA, GitHub)

ArchAI: Ferramenta de análise de base de código e geração de documentação por IA baseada em CrewAI e Qdrant: ArchAI é uma ferramenta que utiliza AI Agents para interpretar bases de código. Ela pode clonar e analisar código automaticamente, além de gerar documentação e diagramas PlantUML. ArchAI é construído com base em CrewAI para os AI Agents, usa Qdrant para armazenar contexto e integra SonarQube para verificação da qualidade do código, suportando LLMs locais ou na nuvem (como OpenAI, Gemini, Ollama). (Fonte: qdrant_engine, GitHub)

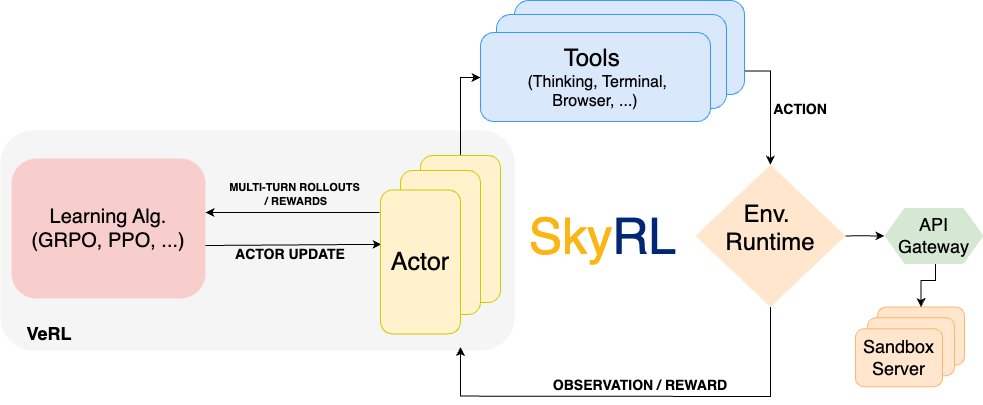

SkyRL: Lançamento de pipeline de treinamento de aprendizado por reforço otimizado para tarefas de longa duração: A equipe RISE da UC Berkeley lançou o SkyRL, um pipeline de treinamento em aprendizado por reforço (RL) construído sobre VeRL e OpenHands, especialmente otimizado para tarefas de longa duração como SWE-Bench. SkyRL introduz a camada Agent, suportando inferência multi-round eficiente, uso de ferramentas e execução de ambiente escalável, e integra W&B para visualização. (Fonte: weights_biases)

RunwayML Gen-1 atualizado, oferecendo controle mais intuitivo para geração de vídeo: A ferramenta de geração de vídeo Gen-1 da RunwayML lançou uma atualização, visando fornecer um controle mais preciso, intuitivo e versátil. Os usuários podem experimentar esses novos recursos gratuitamente, com mais atualizações futuras. (Fonte: c_valenzuelab)

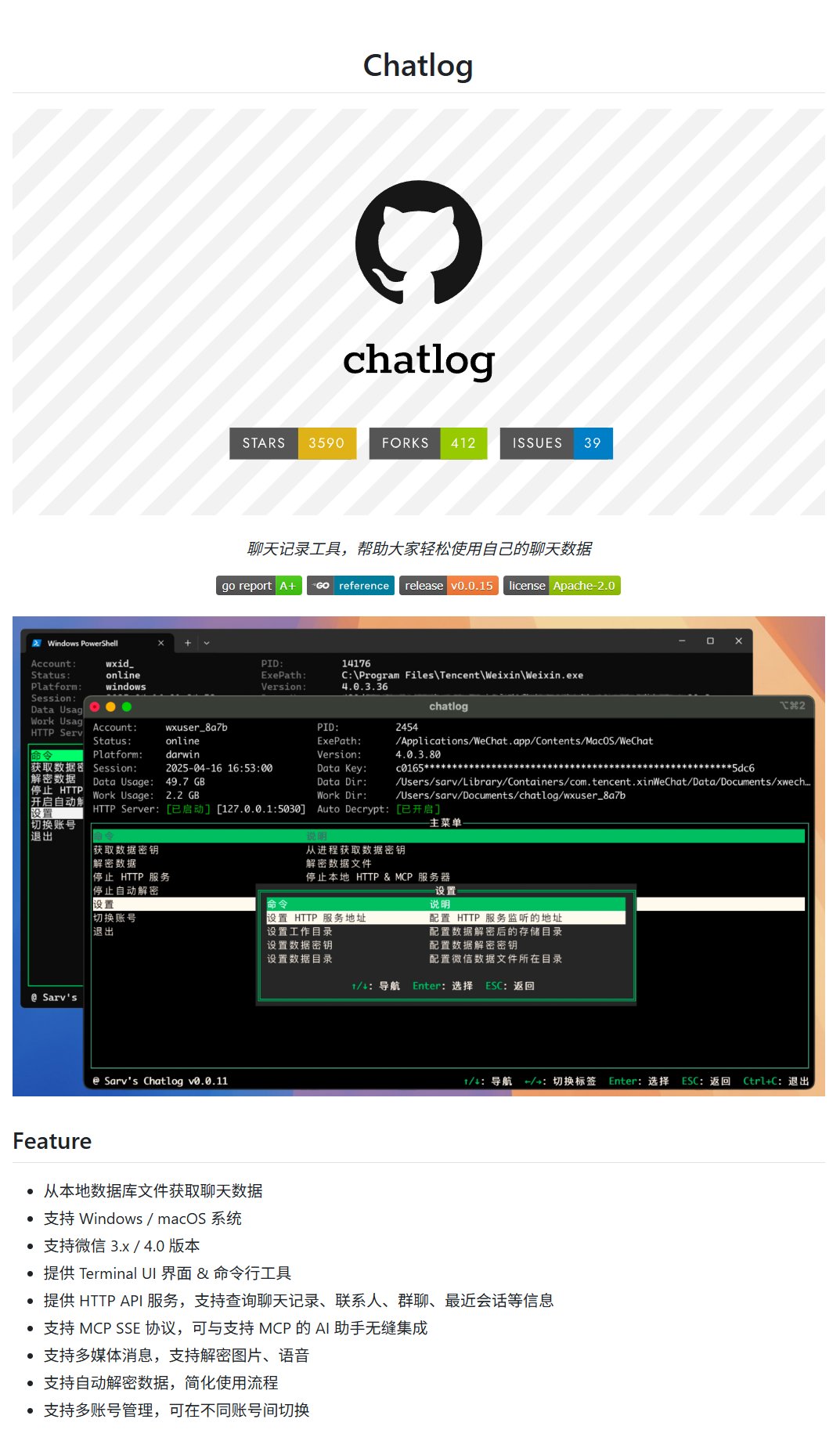

Chatlog: Ferramenta de exportação de histórico de bate-papo do WeChat: Chatlog é um projeto que suporta a exportação de históricos de bate-papo do WeChat, incluindo imagens, vídeos, áudio, e suporta operações em múltiplas contas. Isso oferece conveniência para os usuários fazerem backup de seus dados pessoais ou usarem dados de bate-papo para construir aplicações de IA, como personas digitais. (Fonte: karminski3)

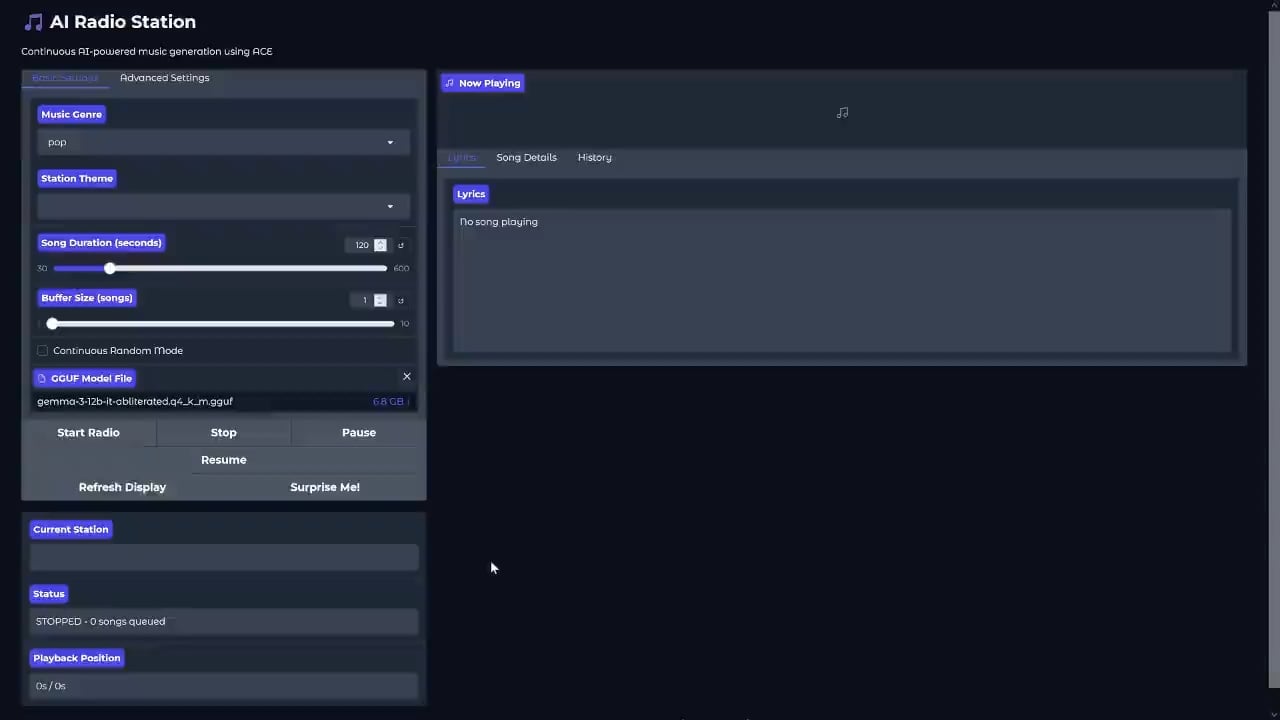

Lançamento do projeto de rádio AI local ACE-Step-RADIO: PasiKoodaa lançou o projeto ACE-Step-RADIO no GitHub, uma aplicação de rádio AI local que utiliza o framework ACE (Agentic Communication Environment). Teoricamente, pode funcionar perfeitamente com 24GB de VRAM e integrar facilmente funcionalidades de apresentador de IA como DIA, oferecendo novas ideias para a geração de conteúdo personalizado. (Fonte: Reddit r/LocalLLaMA, GitHub)

qxresearch-event-1: Coleção de miniaplicativos Python: O projeto GitHub qxresearch-event-1 coleta mais de 50 aplicativos escritos com apenas 10 linhas de código Python cada, abrangendo notificações, gravador de áudio, prancheta de desenho, gerador de senhas e outras funcionalidades, fornecendo exemplos de código simples e práticos para iniciantes e entusiastas de Python. (Fonte: karminski3)

Lançamento do modelo de linguagem polonês de 4B Polanka: Piotr-AI lançou o modelo de linguagem polonês de 4B parâmetros Polanka (polanka_4b_v0.1_qwen3_gguf), baseado na arquitetura Qwen3. O modelo foi criado através de pré-treinamento contínuo do modelo base Qwen3 4B em um único RTX 4090 por aproximadamente 10 dias, usando conteúdo polonês de alta qualidade e um conjunto de dados misto de conteúdo multilíngue, matemático, de código, etc., totalizando cerca de 1.4B tokens. O formato GGUF permite que ele seja executado rapidamente em notebooks. (Fonte: Reddit r/LocalLLaMA)

Câmeras de segurança Arlo adicionam funcionalidade de resumo de vídeo por IA: A Arlo adicionou uma nova funcionalidade de inteligência artificial ao seu sistema de câmeras de segurança, capaz de resumir automaticamente o conteúdo dos vídeos gravados pelas câmeras, ajudando os usuários a entender rapidamente os eventos chave e aumentando a conveniência e eficiência da segurança doméstica. (Fonte: Reddit r/artificial)

Gemini 2.0 Flash Preview adiciona funcionalidades de geração e edição de imagens: O recém-lançado modelo Gemini 2.0 Flash Preview do Google suporta geração e edição de imagens. Os usuários podem editar imagens em conversas multi-turn, e a documentação foi atualizada para demonstrar essas novas funcionalidades do modelo. (Fonte: _philschmid)

📚 Aprendizado

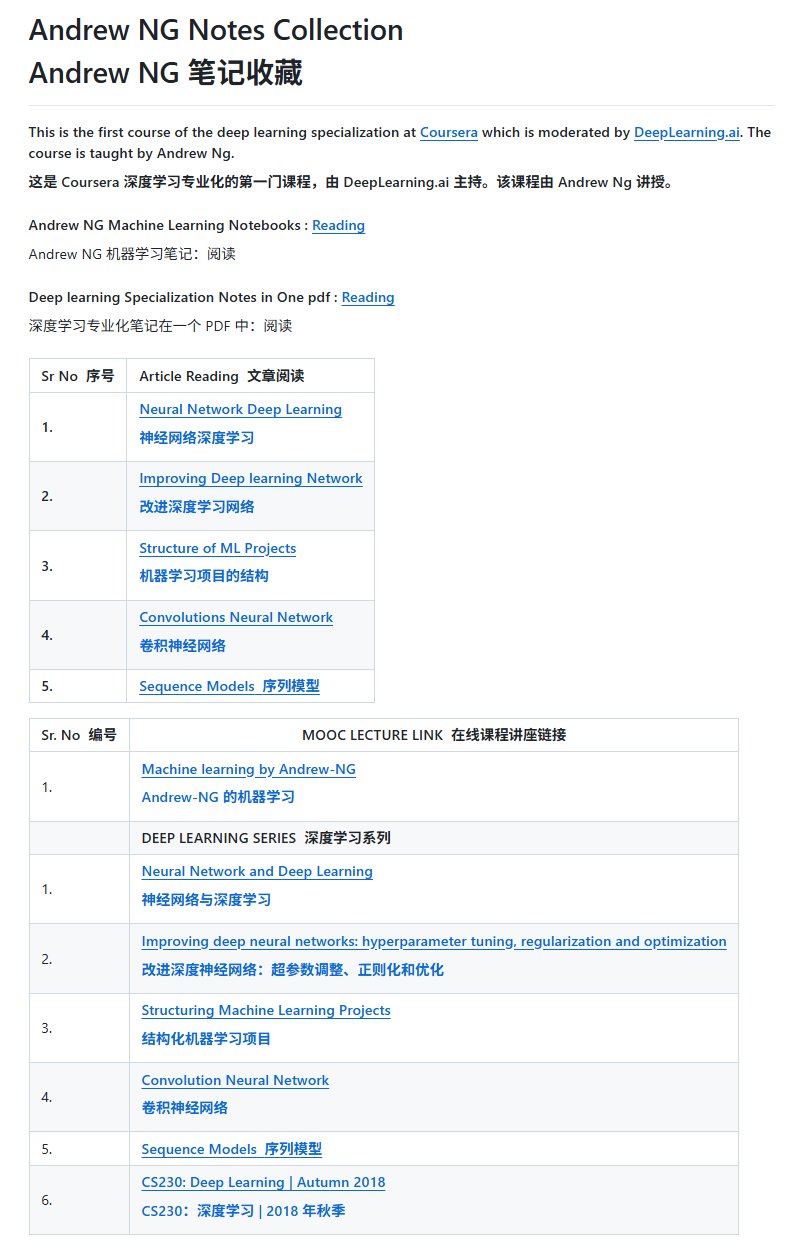

Projeto de organização de notas do curso de Deep Learning de Andrew Ng: Um projeto de organização de notas para o curso de Deep Learning de Andrew Ng (Andrew-NG-Notes) apareceu no GitHub, adequado para estudantes que desejam iniciar e aprender sistematicamente deep learning em conjunto com o curso do Coursera. Atualmente, já recebeu muita atenção. (Fonte: karminski3)

Microsoft lança tutorial de introdução à IA Generativa: A Microsoft lançou o tutorial “Introdução à IA Generativa (generative-ai-for-beginners)”, que visa ajudar iniciantes a entender os princípios básicos de modelos de linguagem grandes e orientá-los na construção de plataformas Agent/RAG usando programas. O repositório GitHub já ultrapassou 82k estrelas, demonstrando sua popularidade. (Fonte: karminski3)

Livro didático gratuito de matemática “Álgebra, Topologia, Cálculo Diferencial e Integral e Otimização para Ciência da Computação e Aprendizado de Máquina”: E-book gratuito de Jean Gallier e Jocelyn Quaintance, que cobre de forma abrangente os fundamentos matemáticos cruciais necessários para ciência da computação e aprendizado de máquina, incluindo álgebra linear, geometria afim e projetiva, geometria de formas bilineares, topologia e cálculo, otimização linear e não linear, e contém exemplos de aplicação em aprendizado de máquina. (Fonte: TheTuringPost)

Sugestões de ensino para cursos de IA de conhecimento geral em faculdades vocacionais: Em resposta à situação de cursos de IA de conhecimento geral em faculdades vocacionais serem ministrados inteiramente em laboratórios de informática, sugere-se que o foco do curso seja na aplicação de IA generativa, especialmente na geração de texto, imagem e vídeo. Através da configuração de uma série de tarefas de nível iniciante (perguntas e respostas, resumo, tradução), intermediário (redação, extração de dados, pesquisa com IA/RAG) e avançado (programação assistida por IA, análise de dados), permite que os alunos aprendam na prática, cultivem o interesse e complementem autonomamente o conhecimento teórico. (Fonte: dotey)

💼 Negócios

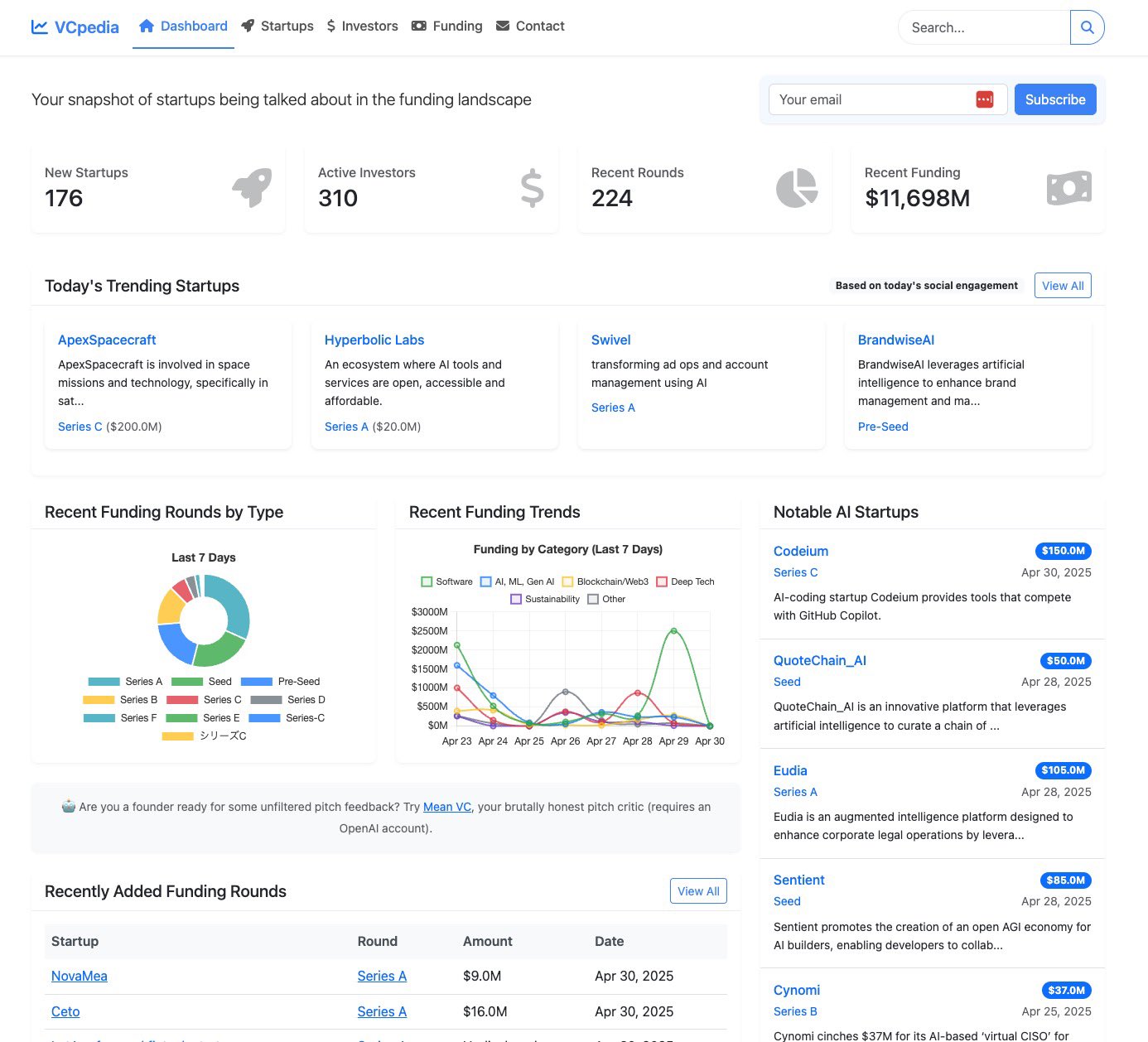

VCpedia: Plataforma de inteligência para startups impulsionada por IA: Yohei Nakajima lançou o VCpedia, uma plataforma que utiliza IA para analisar discussões sobre financiamento de startups na plataforma X, combinada com OpenAI e ExaAI para aprimoramento de informações, e construída através do Replit Agent como um serviço de briefing diário. A plataforma visa fornecer descoberta de negócios e insights impulsionados por IA para capital de risco. (Fonte: yoheinakajima)

Rumores de que a OpenAI pode ajustar a estratégia de preços da API do ChatGPT: Há rumores de que o ChatGPT pode ajustar os preços de sua API, introduzindo um modelo de cobrança por créditos (por exemplo, 50 créditos/dólar, mínimo de 20 dólares, máximo de 1000 dólares). Essa mudança potencial gerou preocupações entre os usuários, com alguns afirmando que se os usuários Plus e Pro também precisarem pagar as taxas da API por esse preço, poderiam considerar mudar para concorrentes como Grok ou Gemini. (Fonte: scaling01)

Baidu da China solicita patente de IA para interpretar sons de animais: A gigante tecnológica chinesa Baidu está buscando uma patente para um sistema de inteligência artificial que interpreta os sons dos animais. Se bem-sucedida, essa tecnologia poderia abrir novas possibilidades em áreas como pesquisa do comportamento animal, conservação de espécies e comunicação entre humanos e animais. (Fonte: Reddit r/artificial)

🌟 Comunidade

Usuários discutem o impacto da IA nas relações interpessoais e na saúde mental: Um post no Reddit intitulado “Perdi minha mãe para o ChatGPT” gerou um debate acalorado. O autor do post afirmou que sua mãe se tornou viciada em interagir com o ChatGPT, o que levou ao distanciamento familiar e até mesmo à dependência emocional da IA. A seção de comentários discutiu como a IA satisfaz necessidades emocionais, o sentimento de solidão na realidade, a alienação tecnológica e como equilibrar o uso da tecnologia com as interações humanas. Muitos comentários apontaram que a mãe poderia já estar se sentindo solitária e a IA apenas preencheu um vazio emocional, sugerindo que o autor do post deveria se comunicar mais e passar mais tempo com a mãe. (Fonte: Reddit r/ChatGPT)

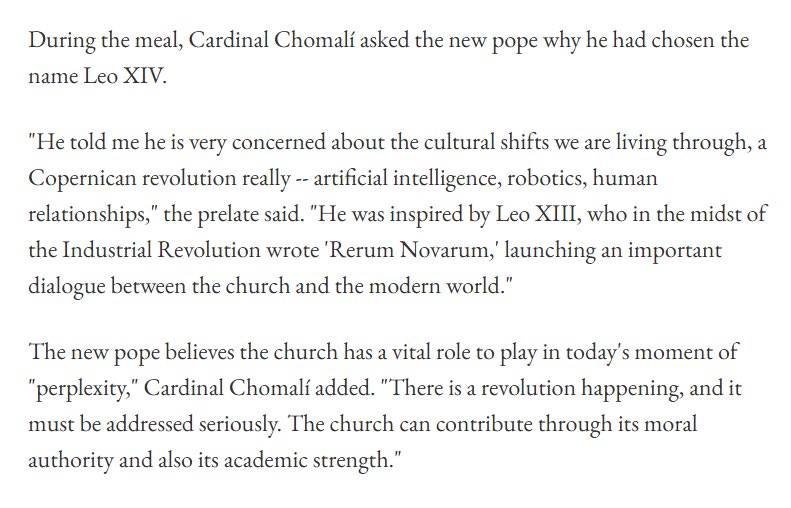

Escolha do novo Papa pelo nome “Leão XIV” pode ser inspirada pelo desenvolvimento da IA: Relatos e discussões indicam que o recém-eleito Papa escolheu “Leão XIV” como seu nome papal, em parte devido à sua profunda preocupação com as mudanças culturais trazidas pela inteligência artificial, robótica, etc. Ele foi inspirado pela encíclica “Rerum Novarum” do Papa Leão XIII, emitida durante a Revolução Industrial, acreditando que a Igreja deveria exercer autoridade moral e força acadêmica na atual era de revolução tecnológica para guiar a sociedade a enfrentar seriamente as mudanças. Este tópico gerou reflexões sobre a ética da IA, o impacto social e como as instituições religiosas se adaptam ao desenvolvimento tecnológico. (Fonte: jpt401, AndrewLampinen, jachiam0, itsclivetime)

Geração de imagens de “mulher ideal” por IA gera discussão: Um usuário do Reddit compartilhou imagens de sua “mulher ideal” geradas pelo ChatGPT com base no conhecimento que o chatbot tinha sobre ele, com resultados mostrando predominantemente figuras femininas vestindo armaduras. Isso levou os membros da comunidade a seguir o exemplo e compartilhar seus próprios resultados gerados por IA, discutindo a compreensão da IA sobre o conceito de “ideal”, como os dados do usuário influenciam o conteúdo gerado e os preconceitos ou padrões comuns em imagens geradas por IA. (Fonte: Reddit r/ChatGPT)

Criatividade na geração de imagens por IA: “Action figure e pessoa real no mesmo quadro”: Um usuário de mídia social compartilhou imagens geradas por IA que colocam action figures de anime e suas contrapartes humanas reais na mesma moldura em poses semelhantes, e forneceu os prompts. Esta abordagem criativa demonstra a diversão e a personalização da IA na geração de imagens, capaz de criar obras visuais com um toque de vida e efeitos de contraste com base nas descrições específicas do usuário. (Fonte: dotey)

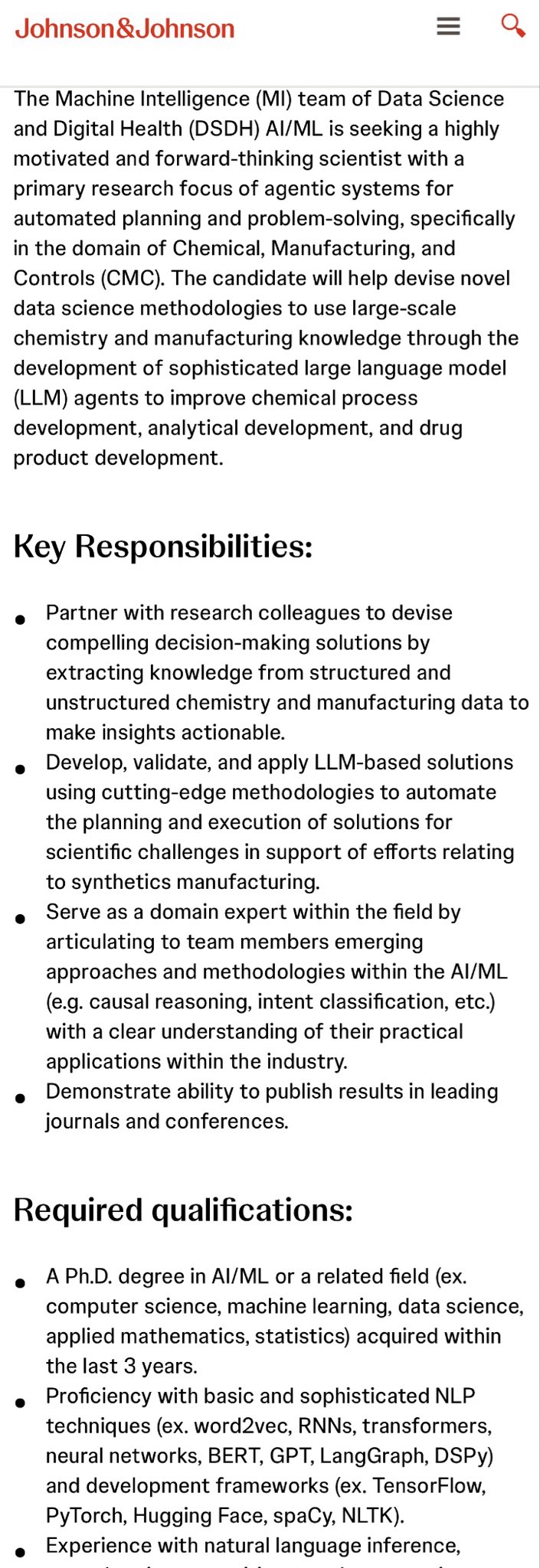

Aumento da demanda por profissionais com experiência no framework DSPy no campo de IA/ML: A demanda no mercado de recrutamento por talentos com experiência em DSPy (um framework para otimizar programaticamente prompts e pesos de modelos de linguagem) está crescendo. Isso reflete a ênfase da indústria na construção de aplicações de modelos de linguagem mais controláveis, eficientes e capazes de otimização algorítmica. (Fonte: lateinteraction)

Discussão sobre o estado atual e a aceitação da IA no local de trabalho: Usuários do Reddit discutem o uso da IA no trabalho e as opiniões de empregadores e colegas sobre o assunto. A maioria dos usuários relatou que a IA pode efetivamente aumentar a eficiência do trabalho, como auxiliar na programação, redigir e-mails e relatórios, atas de reuniões, pesquisa de mercado, etc. Algumas empresas incentivam o uso da IA, enquanto outras mantêm uma atitude cautelosa ou contrária, levando os funcionários a usá-la discretamente. A discussão destacou o potencial da IA em aumentar a produtividade, ao mesmo tempo em que abordou a percepção correta das capacidades da IA e questões de segurança de dados. (Fonte: Reddit r/ArtificialInteligence)

A IA está corroendo a principal vantagem competitiva do Reddit – a interação humana?: O artigo do Business Insider aponta que o CEO do Reddit acredita que sua comunidade dominada por humanos é sua maior vantagem competitiva, mas posts e comentários gerados por robôs de IA estão ameaçando essa vantagem. O Reddit admitiu o problema e planeja introduzir novos mecanismos para verificar a identidade dos usuários, desencadeando discussões sobre a proliferação de conteúdo de IA, a autenticidade da comunidade e como as futuras plataformas online lidarão com o conteúdo gerado por IA. (Fonte: Reddit r/artificial, Business Insider)

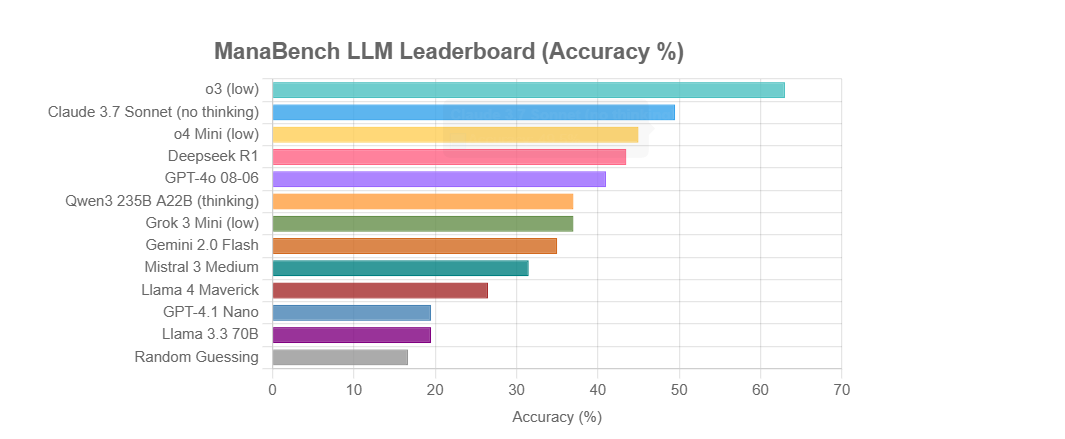

ManaBench: Novo benchmark para testar a capacidade de raciocínio de LLMs através da construção de decks de Magic: The Gathering: Jake Boggs lançou o ManaBench, um novo benchmark que testa as capacidades de raciocínio de modelos de linguagem grandes (LLM) através de tarefas de construção de decks de Magic: The Gathering. O benchmark não se concentra no conhecimento do jogo, mas avalia as capacidades de raciocínio estratégico e compreensão de sistemas do modelo, com o objetivo de fornecer uma diferenciação de modelos relevante para a experiência do usuário. (Fonte: Teknium1)

Usuário compartilha experiência de usar IA para pesquisa aprofundada e converter para áudio para ouvir: Um usuário compartilhou sua experiência de usar o ChatGPT para pesquisa aprofundada sobre um tópico e, em seguida, usar ferramentas como Speechify para converter os resultados da pesquisa em áudio com a voz de Obama para ouvir. Essa prática demonstra o potencial da IA na aquisição de informações e no consumo de conteúdo personalizado, mas também levanta questões sobre a possível diminuição da capacidade de leitura devido à dependência excessiva da IA. (Fonte: Reddit r/artificial)

💡 Outros

Ex-membro da equipe de risco de IA do governo do Reino Unido revela problemas éticos e retaliação subsequente: Um ex-funcionário da função central de risco de IA do governo do Reino Unido declarou publicamente que, após levantar preocupações sobre questões éticas como preconceito e discriminação da IA dentro da equipe, enfrentou bloqueio, vigilância e retaliação institucional. O incidente gerou discussões sobre a proteção de “denunciantes” em ambientes tecnológicos governamentais e a eficácia dos mecanismos públicos de responsabilização ética da IA. (Fonte: Reddit r/ArtificialInteligence)

Impacto indireto da IA em empregos “à prova de IA”: A discussão aponta que, mesmo que certas indústrias baseadas em habilidades (como ofícios manuais) não sejam facilmente substituídas diretamente pela IA, se a IA levar ao desemprego em massa, a base de consumidores encolherá, e esses cargos “à prova de IA” também seriam impactados devido à falta de demanda. Isso nos lembra que precisamos ver o impacto da IA no emprego de uma perspectiva sistêmica econômica mais ampla. (Fonte: Reddit r/artificial)

Opinião: LLMs exploram vieses cognitivos humanos ao simular inteligência: Pedro Domingos acredita que os modelos de linguagem grandes (LLM) são proficientes em gerar texto que parece inteligente, o que explora a fraqueza cognitiva de algumas pessoas em distinguir entre inteligência genuína e “besteira” (BS). (Fonte: pmddomingos)