Palavras-chave:OpenAI, DSPy, SGLang, Nvidia, ChatGPT, IA, LLM, MoE, dspy.GRPO, DeepSeek MoE, Parakeet TDT, Sistemas Agentic, EQ-Bench 3

🔥 Destaques

OpenAI confirma manutenção da estrutura sem fins lucrativos: OpenAI anunciou que sua entidade com fins lucrativos existente será transformada em uma Public Benefit Corporation (PBC), mas o controle permanecerá com a atual organização sem fins lucrativos. Esta medida confirma que a OpenAI continuará a ser controlada pela organização sem fins lucrativos e reafirma sua missão de garantir que a AGI (Inteligência Artificial Geral) beneficie toda a humanidade. A decisão foi tomada após turbulência interna e questionamentos externos sobre sua estrutura (incluindo o processo de Musk), com reações mistas da comunidade: alguns veem como um compromisso com a missão, outros questionam as reais intenções por trás do ajuste da estrutura de capital (Fonte: OpenAI, sama, jachiam0, NeelNanda5, scaling01, zacharynado, mcleavey, steph_palazzolo, Plinz, Teknium1)

Framework DSPy lança otimizador experimental online de RL dspy.GRPO: A equipe de NLP de Stanford lançou um novo recurso experimental para o framework DSPy, o dspy.GRPO, um otimizador online de Aprendizado por Reforço (RL). A ferramenta visa otimizar programas DSPy, aplicando-se diretamente a programas complexos multi-módulo e multi-passo sem modificar o código existente. Isso é visto como um passo importante para trazer a otimização de RL (como o GRPO usado pelo DeepSeek) para um nível de abstração mais alto (fluxos de trabalho de LLM), com o objetivo de melhorar o desempenho e a eficiência de agentes de IA e pipelines complexos. A comunidade reagiu com entusiasmo, considerando-o um componente importante do DSPy 3.0 (Fonte: Omar Khattab, matei_zaharia, lateinteraction, Michael Ryan, Lakshya A Agrawal, Scott Condron, Noah Ziems, Rogerio Chaves, Karthik Kalyanaraman, Josh Cason, Mehrdad Yazdani, DSPy, Hopkinx🀄️, Ahmad, william, lateinteraction, lateinteraction, swyx)

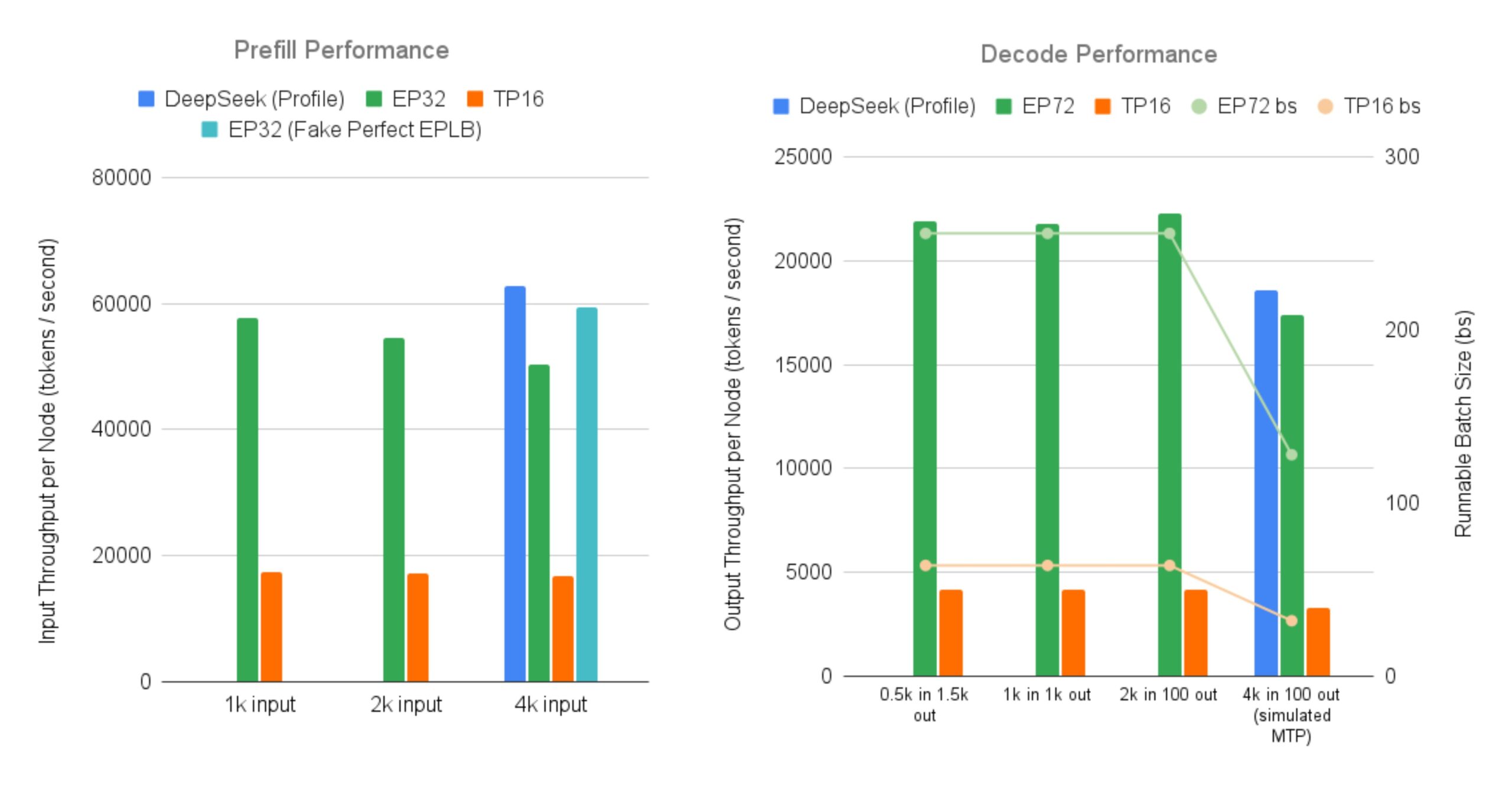

SGLang implementa open source para servir eficientemente modelos grandes DeepSeek MoE: LMSYS Org anunciou que SGLang fornece a primeira implementação open source para servir modelos MoE (Mixture-of-Experts) como DeepSeek V3/R1 em 96 GPUs, com características como Expert Parallelism em larga escala e Prefill-Decode Disaggregation. A implementação quase atinge o throughput relatado oficialmente pelo DeepSeek (entrada de 52.3k tokens/segundo por nó, saída de 22.3k tokens/segundo por nó), com um aumento de até 5 vezes no throughput de saída em comparação com o paralelismo tensorial tradicional. Isso fornece à comunidade uma solução open source eficiente para executar e implantar grandes modelos MoE (Fonte: LMSYS Org, teortaxesTex, cognitivecompai, lmarena_ai, cognitivecompai)

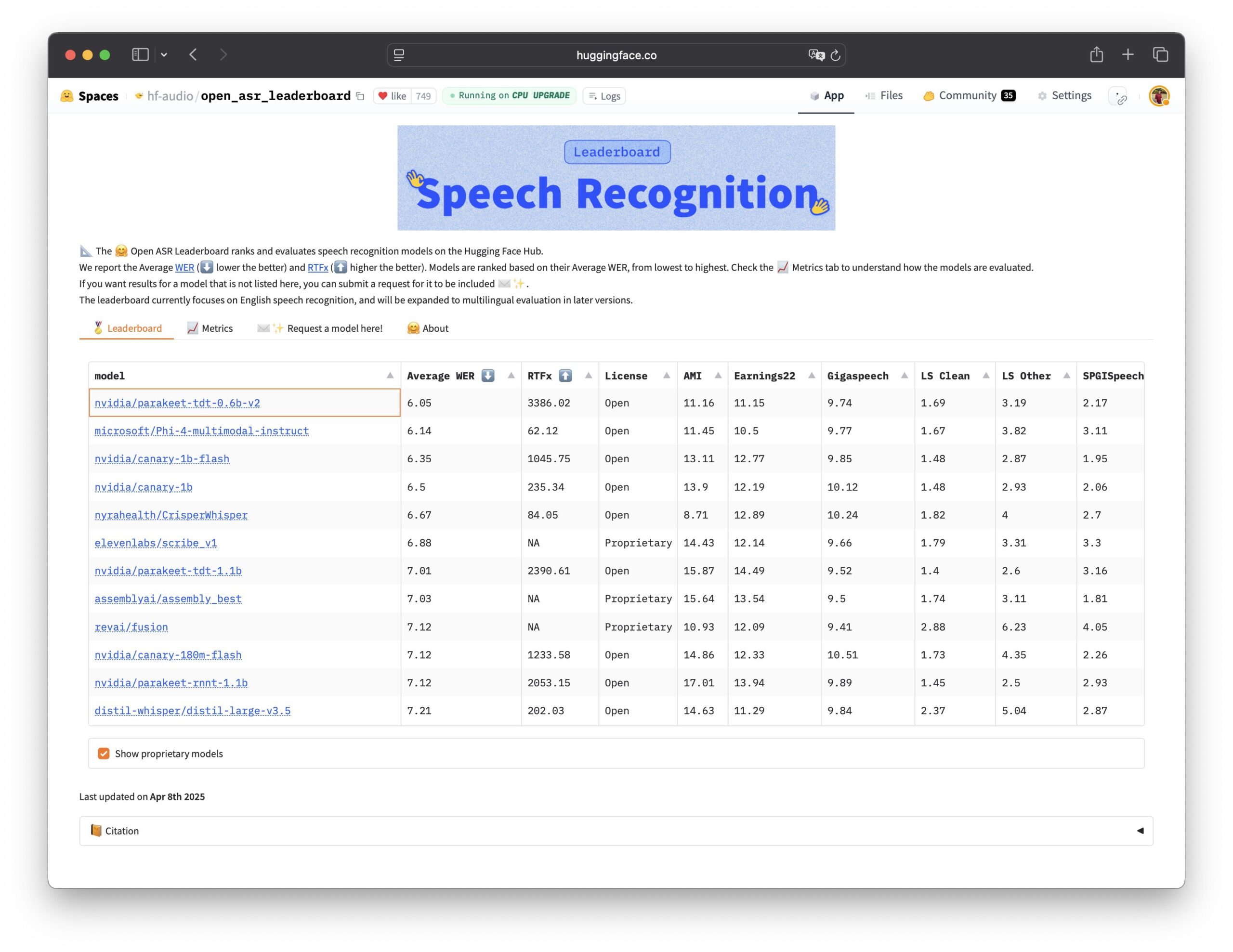

Nvidia lança modelo open source de reconhecimento de voz Parakeet TDT: Nvidia lançou o modelo Parakeet TDT 0.6B, que teve o melhor desempenho no Open ASR Leaderboard, tornando-se o modelo open source de Reconhecimento Automático de Fala (ASR) com melhor desempenho atualmente. O modelo possui 600 milhões de parâmetros e pode transcrever 60 minutos de áudio em 1 segundo, superando muitos modelos proprietários populares. O modelo utiliza a licença CC-BY-4.0, permitindo uso comercial, e oferece uma opção open source poderosa para o campo de reconhecimento de voz (Fonte: Vaibhav (VB) Srivastav, huggingface, ClementDelangue)

🎯 Tendências

Volume de visitas do ChatGPT continua a crescer, superando o X: Dados da Similarweb mostram que o volume de visitas do ChatGPT continua a crescer, com o total de visitas em abril (4,786 bilhões) ultrapassando a plataforma X (4,028 bilhões). Desde o início de 2025, o volume de visitas do ChatGPT tem aumentado constantemente, passando de ocasionalmente atrás em janeiro para liderar quase completamente o X em abril, mostrando o forte impulso dos chatbots de IA na atividade do usuário (Fonte: dotey)

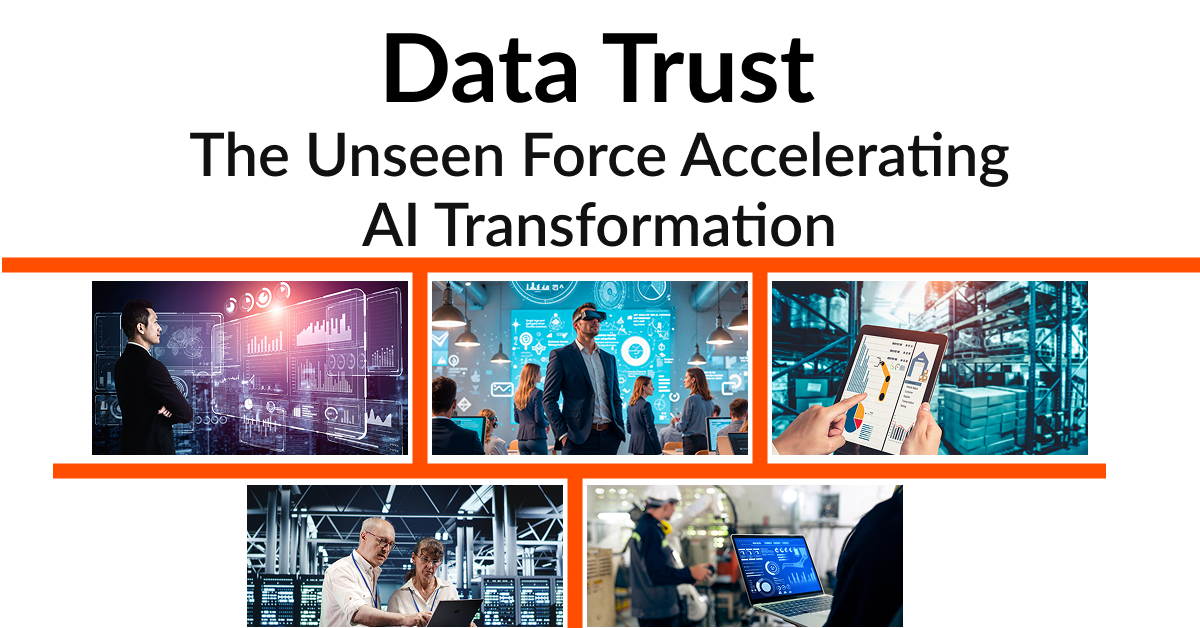

Confiança nos dados e liderança tornam-se cruciais para a transformação de IA: Vários relatórios e discussões enfatizam que a confiança nos dados é a força invisível que acelera a transformação da IA. Ao mesmo tempo, líderes de GenAI bem-sucedidos demonstram características distintas em estratégia, organização e aplicação tecnológica. Isso indica que a chave para o sucesso da IA não reside apenas na tecnologia em si, mas também em uma base de dados confiável e de alta qualidade, bem como em liderança e implantação estratégica eficazes (Fonte: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

GTE-ModernColBERT alcança SOTA em tarefas de embedding de texto longo: O modelo de embedding multi-vetorial GTE-ModernColBERT, lançado pela LightOn, alcançou resultados SOTA (State-of-the-Art) no benchmark de busca em documentos longos LongEmbed, liderando por quase 10 pontos. Notavelmente, o modelo foi treinado apenas em documentos curtos (comprimento 300) do MS MARCO, mas demonstrou excelente capacidade de generalização zero-shot em tarefas de texto longo. Isso reforça ainda mais o potencial dos modelos de Late Interaction (como o ColBERT) no tratamento da recuperação de contexto longo, superando os modelos tradicionais BM25 e de recuperação densa (Fonte: Antoine Chaffin, Ben Clavié, tomaarsen, Dorialexander, Manuel Faysse, Omar Khattab)

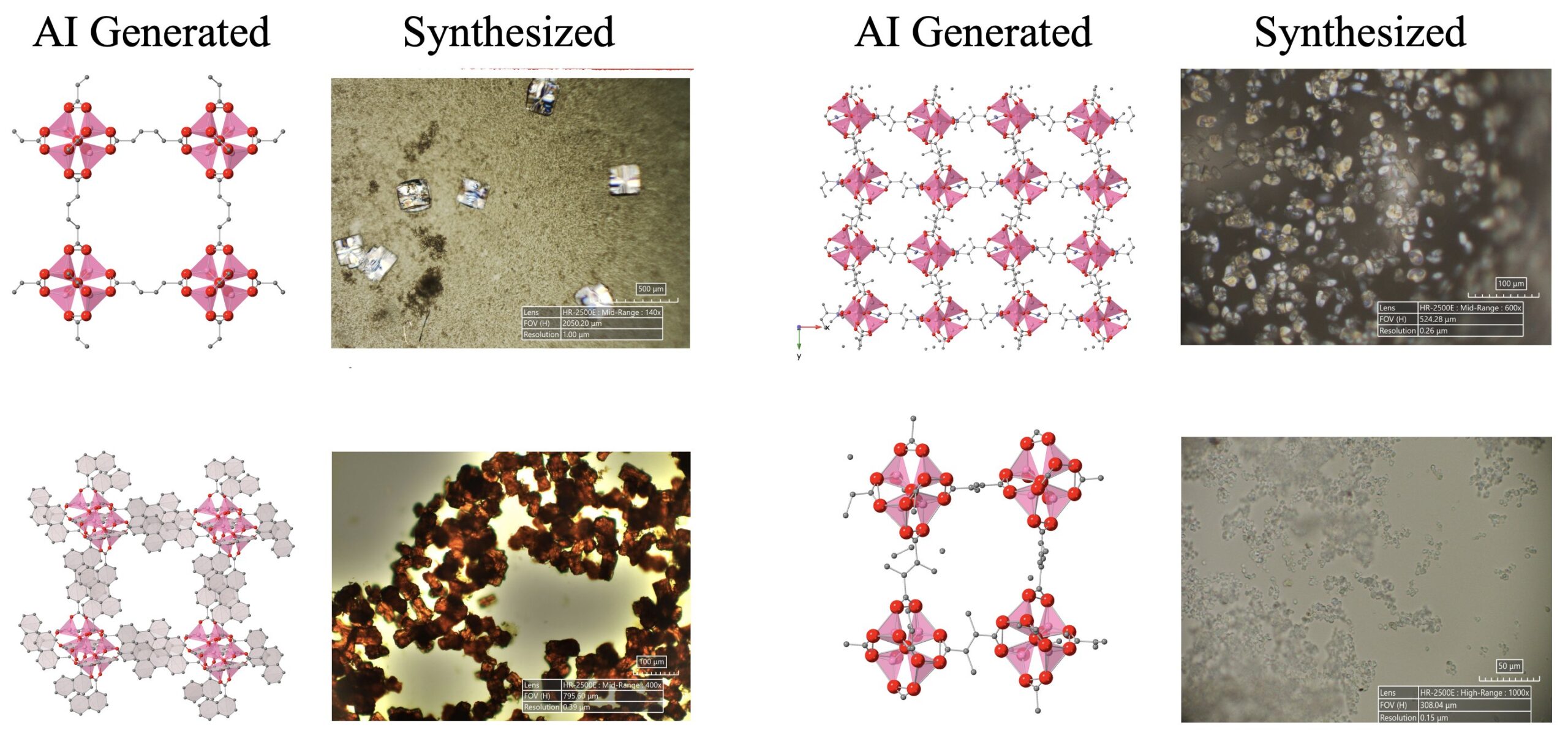

Descoberta científica impulsionada por IA avança: Um sistema de agente de IA composto por LLMs, modelos de difusão e dispositivos de hardware descobriu e sintetizou autonomamente 5 novas estruturas metalo-orgânicas (MOFs), que estão além do conhecimento humano existente. A pesquisa demonstra o potencial dos agentes de IA na automação da pesquisa científica, capazes de completar todo o processo, desde a proposição de ideias de pesquisa até a validação experimental em laboratório (Fonte: Sherry Yang)

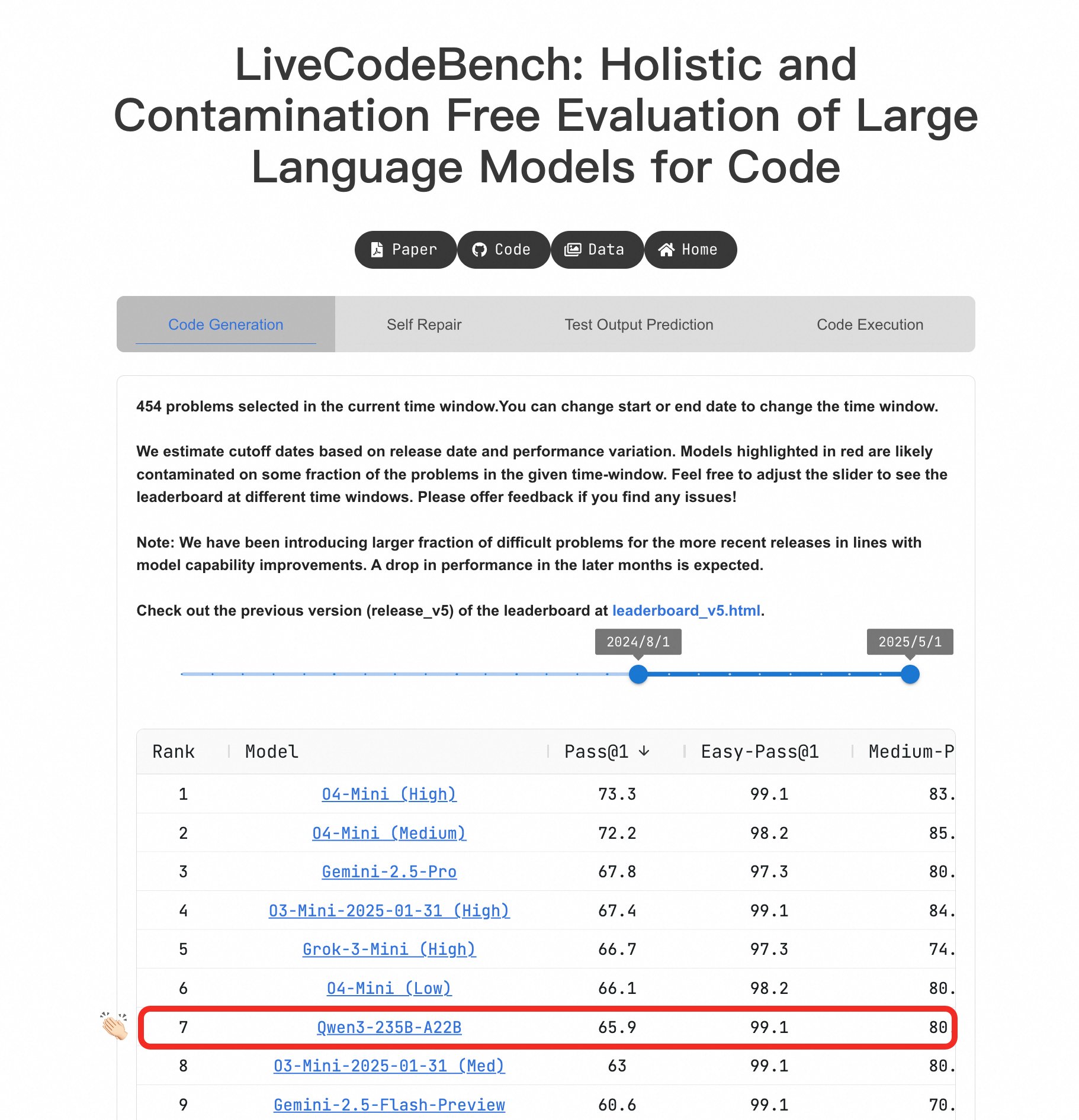

Modelo grande Qwen3 destaca-se em capacidade de programação: No benchmark LiveCodeBench, o modelo Qwen3-235B-A22B demonstrou excelente desempenho, sendo considerado um dos melhores modelos open source para geração de código de nível competitivo, com desempenho comparável ao o4-mini (baixa confiança). Mesmo em problemas difíceis, o Qwen3 mantém um nível equivalente ao O4-Mini (Low), superando o o3-mini (Fonte: Binyuan Hui, teortaxesTex)

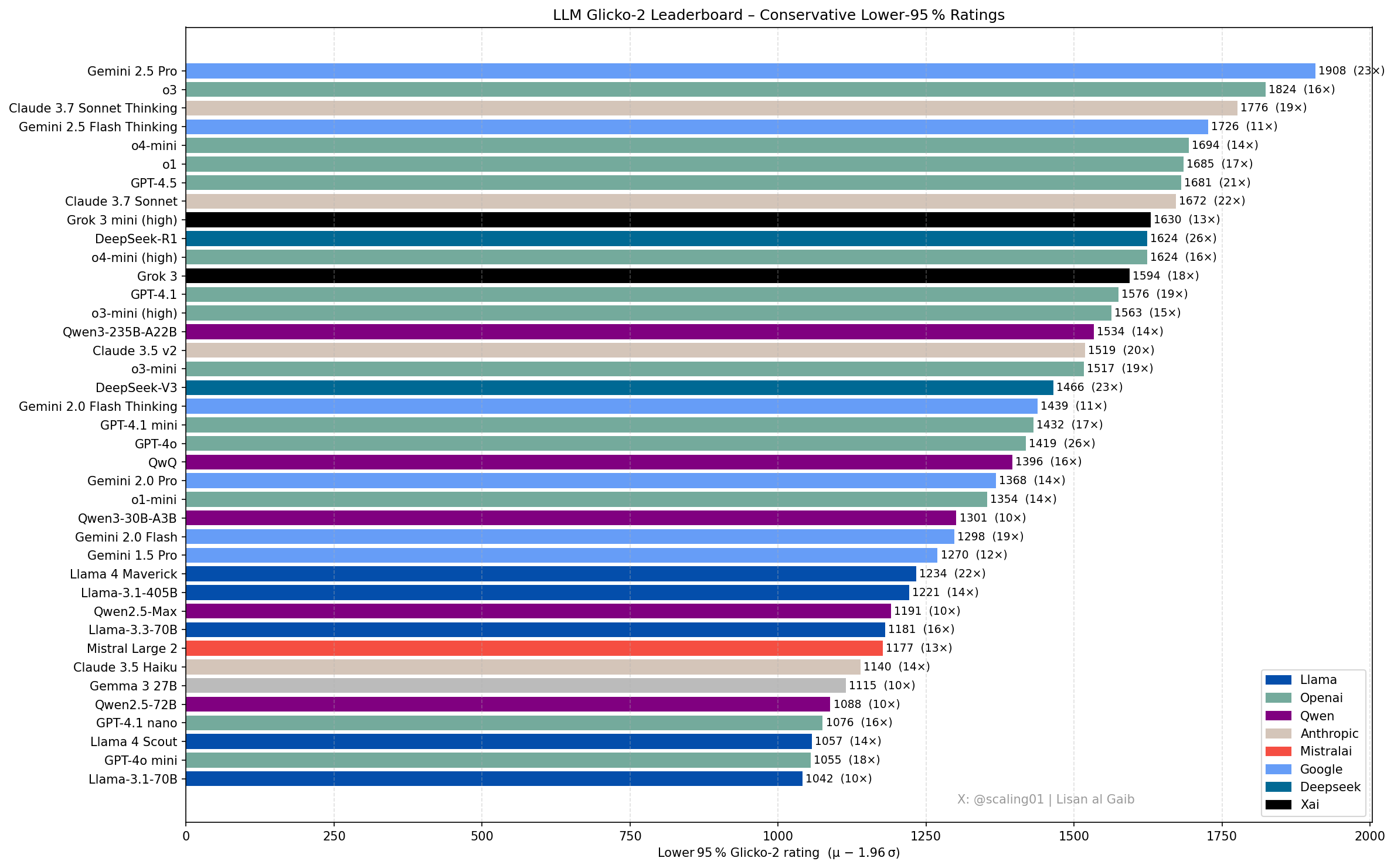

Novos progressos e discussões no ranking de LLMs: O membro da comunidade Lisan al Gaib atualizou o ranking de LLMs usando o sistema de classificação Glicko-2, gerando discussão. Scaling01 acredita que a lista corresponde em 95% à sua percepção subjetiva, com o Gemini 2.5 Pro ainda líder, mas Gemini 2.5 Flash, Grok 3 mini e GPT-4.1 possivelmente superestimados. O ranking mostra uma sequência razoável de progresso para as séries de modelos OpenAI, Llama e Gemini, com o o3 (high) em nível comparável ao Gemini 2.5 Pro (Fonte: Lisan al Gaib)

Ecossistema de tecnologia robótica open source em rápido desenvolvimento: Clem Delangue, da Hugging Face, expressou entusiasmo com os avanços na área de robótica de IA após conversar com NPeW e Matth Lapeyre. Peter Welinder (OpenAI) também elogiou o trabalho da Hugging Face em impulsionar o desenvolvimento do ecossistema de tecnologia robótica open source, considerando que a área está crescendo rapidamente (Fonte: ClementDelangue, Peter Welinder, ClementDelangue, huggingface)

Direção de pesquisa em interpretabilidade de IA ganha atenção: Pesquisadores pedem mais trabalho na área de interpretabilidade de IA, especialmente para explicar comportamentos estranhos dos modelos. Ao entender esses comportamentos, é possível derivar conclusões mais profundas sobre os mecanismos internos dos LLMs e potencialmente gerar novas ferramentas de interpretabilidade. Isso é considerado uma direção de pesquisa promissora e impactante (Fonte: Josh Engels)

FutureHouseSF dedica-se a construir “Cientistas de IA”: Sam Rodriques, CEO da FutureHouseSF, foi entrevistado sobre o objetivo da empresa de construir “Cientistas de IA”. A discussão abordou o significado específico de Cientistas de IA, o papel da robótica nisso e por que o campo da ciência precisa de um impulso semelhante ao projeto “Stargate”, visando usar a IA para acelerar a descoberta científica (Fonte: steph_palazzolo)

Vantagem do Google TPU pode estar subestimada: O comentarista Justin Halford acredita que os investidores podem estar subestimando a vantagem do Google em TPUs (Tensor Processing Units). Ele aponta que, na ausência de um fosso algorítmico significativo, o poder computacional será a chave na corrida da IA, e o TPU desenvolvido internamente pelo Google evita custos intermediários, o que é crucial em um cenário onde centenas de bilhões de dólares estão sendo investidos em infraestrutura (Fonte: Justin_Halford_)

Modelo VLA open source Nora lançado: Declare Lab lançou o Nora, um novo modelo de Visão-Linguagem-Ação (VLA) open source baseado no Qwen2.5VL e no tokenizer FAST+. O modelo foi treinado no dataset Open X-Embodiment e superou o Spatial VLA e o OpenVLA em tarefas do mundo real WidowX (Fonte: Reddit r/MachineLearning)

Novo método de otimização de inferência LLM: Snapshot e Restore: Enfrentando os desafios de cold start e implantação de múltiplos modelos na inferência de LLM, uma equipe construiu um novo sistema de tempo de execução. Este sistema, através do snapshot do estado completo de execução do modelo (incluindo layout de memória, cache de atenção, contexto de execução) e restauração direta na GPU, alcança cold starts em menos de 2 segundos, pode hospedar mais de 50 modelos em 2 GPUs A4000 com mais de 90% de utilização da GPU e sem inchaço persistente de memória. Essa abordagem é semelhante a construir um “sistema operacional” para inferência (Fonte: Reddit r/MachineLearning, Reddit r/LocalLLaMA)

Detector de objetos em tempo real open source D-FINE: A biblioteca Hugging Face Transformers adicionou o detector de objetos em tempo real D-FINE. Alega-se que este modelo é mais rápido e preciso que o YOLO, utiliza a licença Apache 2.0 e pode ser executado em uma GPU T4 (ambiente Colab gratuito), oferecendo uma nova opção open source SOTA para detecção de objetos em tempo real (Fonte: merve, algo_diver)

Precificação de LLMs tende a se tornar dinâmica: Observa-se que a precificação de modelos de linguagem grandes está se tornando mais dinâmica. Isso pode ajudar o mercado a encontrar pontos de preço mais ótimos ao longo do tempo, refletindo a tendência dos provedores de modelos em ajustar suas estratégias de precificação sob a pressão de custos, demanda e concorrência (Fonte: xanderatallah)

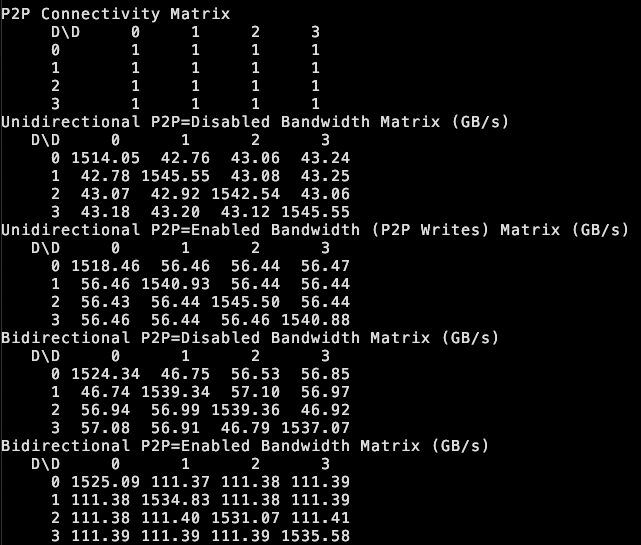

tinybox green v2 suporta P2P entre GPUs: a tiny corp anunciou que seu produto tinybox green v2, através de um driver modificado, suporta comunicação ponto a ponto (P2P) entre GPUs RTX 5090. Isso significa que os dados podem ser transferidos diretamente entre GPUs sem passar pela RAM da CPU, aumentando a eficiência do trabalho colaborativo multi-GPU. A funcionalidade é compatível com tinygrad e PyTorch (qualquer biblioteca que use NCCL) (Fonte: the tiny corp)

Pesquisadores lançam EQ-Bench 3 para avaliar a inteligência emocional de LLMs: Sam Paech lançou o EQ-Bench 3, uma ferramenta de benchmark para medir a inteligência emocional (EQ) de modelos de linguagem grandes (LLMs). A equipe de desenvolvimento lançou esta versão após várias falhas de protótipos, com o objetivo de avaliar de forma mais precisa e confiável a capacidade dos modelos em entender e responder a emoções (Fonte: Sam Paech, fabianstelzer)

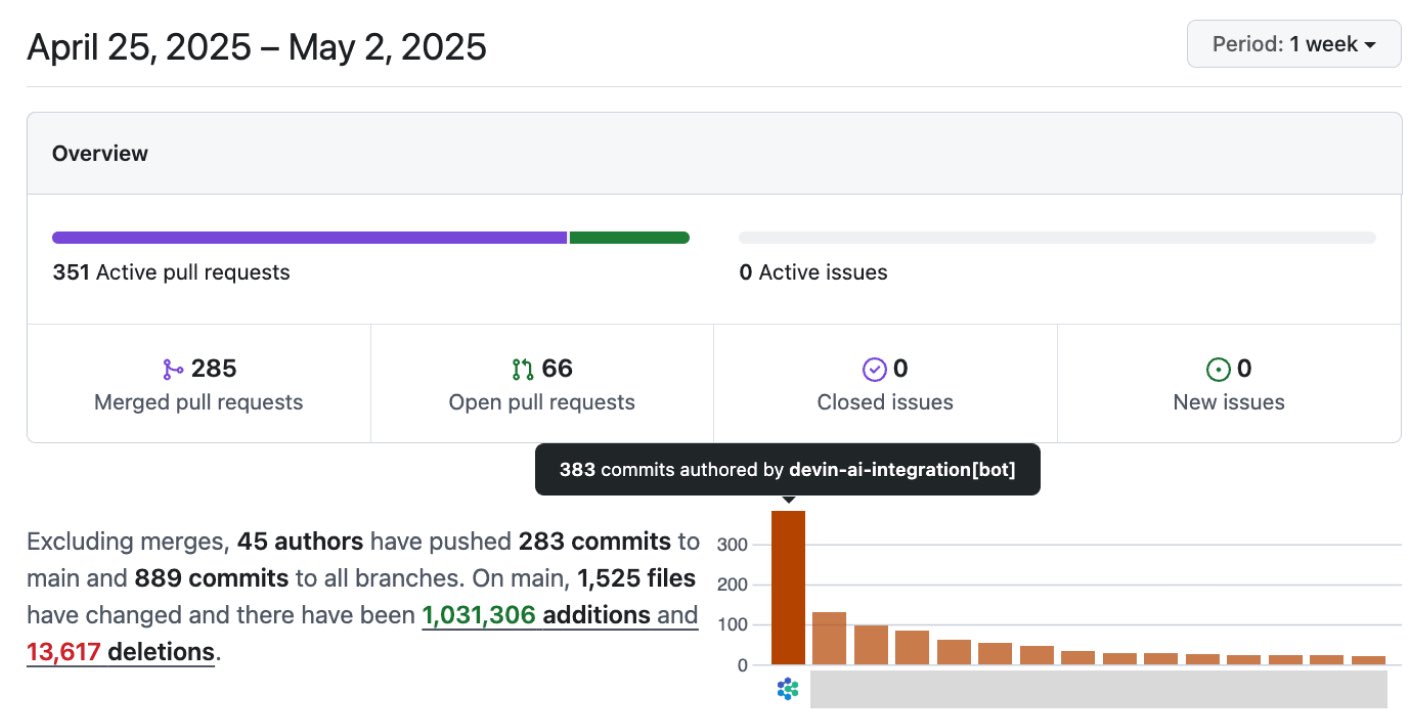

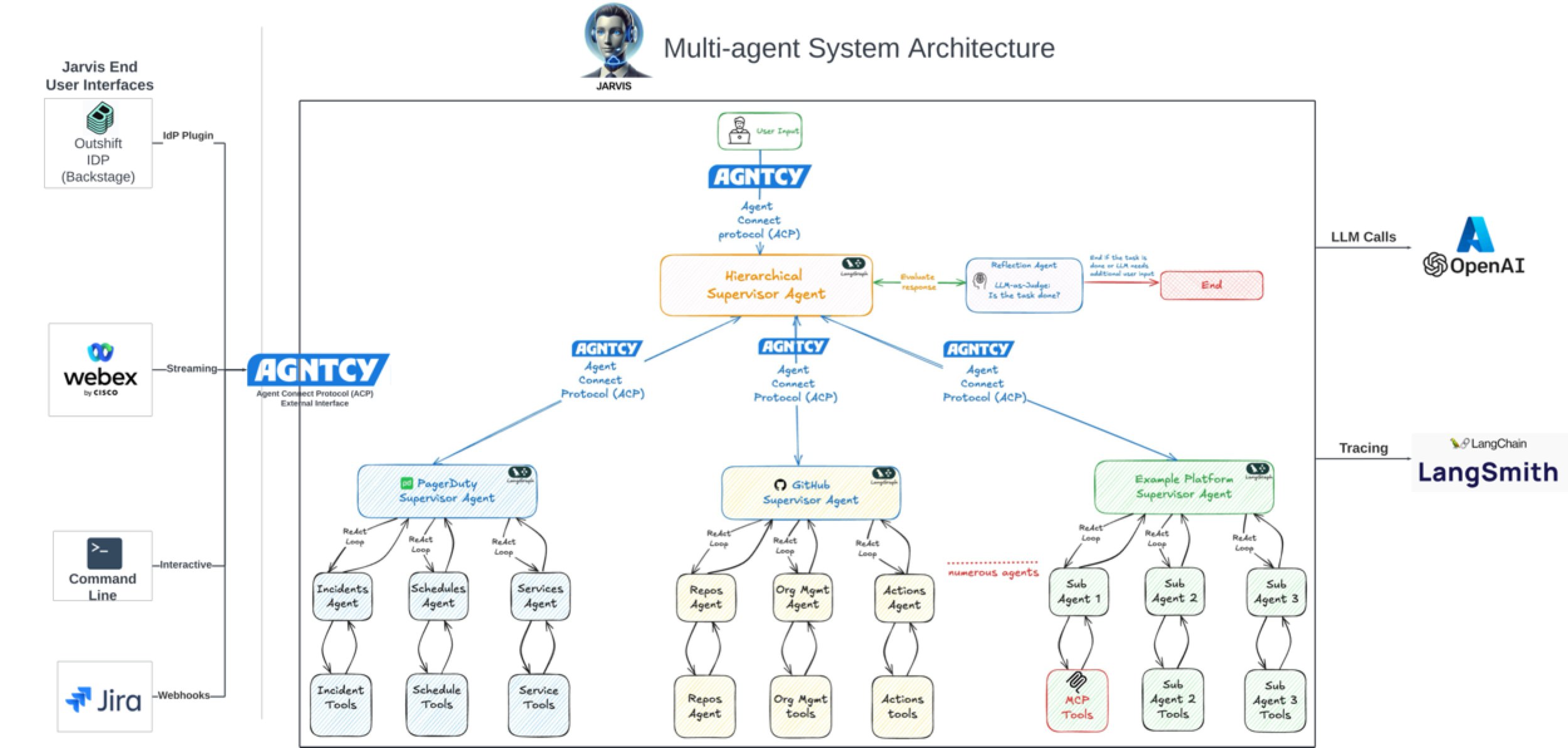

IA impulsiona aumento significativo na eficiência do desenvolvimento de software: Discussões e casos da comunidade mostram que a IA está aumentando significativamente a eficiência do desenvolvimento de software. Por exemplo, na base de código da empresa Vesta, os commits de IA já ocupam o primeiro lugar. A Cisco Outshift, usando o engenheiro de plataforma de IA JARVIS construído com LangGraph e LangSmith, reduziu o tempo de configuração de CI/CD de uma semana para menos de uma hora, e o tempo de provisionamento de recursos de meio dia para segundos, alcançando um aumento de produtividade de 10 vezes (Fonte: mike, LangChainAI, hwchase17)

IA avança nas indústrias cinematográfica e criativa: Disney/Lucasfilm, através da Industrial Light & Magic (ILM), lançou seu primeiro trabalho público de IA generativa, marcando a adoção da tecnologia de IA por estúdios de VFX de ponta. Isso prenuncia que a IA desempenhará um papel mais importante em áreas como efeitos especiais de cinema, design criativo, etc., mudando os fluxos de trabalho de criação de conteúdo (Fonte: Bilawal Sidhu)

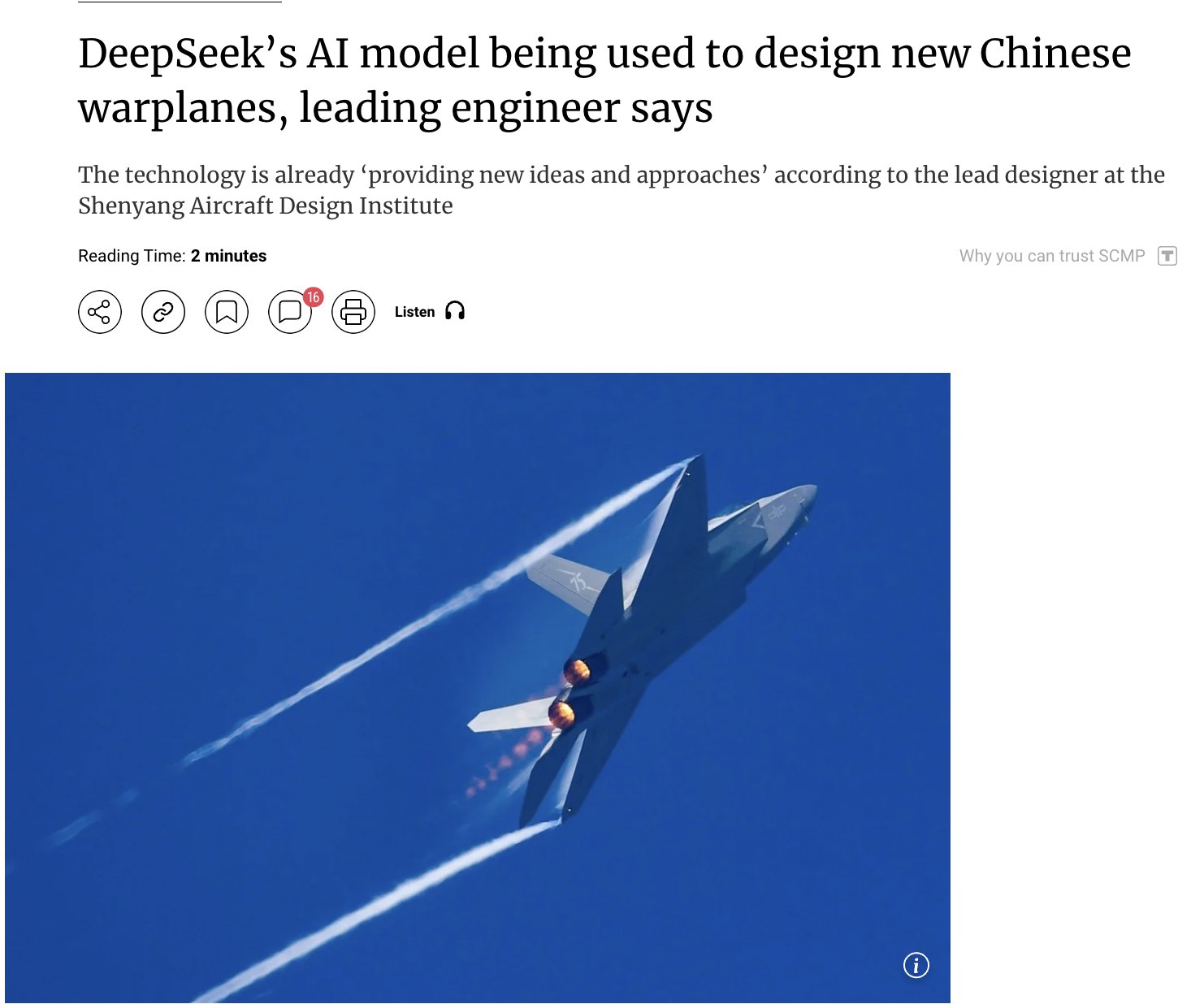

Aplicação de IA no domínio militar atrai atenção: Há relatos de que a China está usando seu modelo de IA auto-desenvolvido DeepSeek para projetar caças avançados (como J-15, J-35) e moldar aeronaves de próxima geração (J-36, J-50). Alega-se que a IA acelera a P&D otimizando a furtividade, materiais e desempenho. Embora a fonte da informação deva ser tratada com cautela, isso reflete o potencial e a atenção gerada pela aplicação da IA nos setores de defesa e aeroespacial (Fonte: Clash Report)

Movimentações de talentos: Rohan Pandey deixa a OpenAI: Rohan Pandey, pesquisador da equipe de Treinamento da OpenAI, anunciou sua saída. Ele afirmou que tirará um tempo para descansar e se dedicar a resolver o problema de OCR em sânscrito, para “preservar para sempre os clássicos da literatura indiana nos pesos da superinteligência”, e anunciará seus próximos passos posteriormente. Membros da comunidade o avaliaram muito bem, considerando-o um pesquisador extremamente talentoso (Fonte: Rohan Pandey, JvNixon, teortaxesTex)

Registro de direitos autorais de IA ultrapassa 1000 obras: O Escritório de Direitos Autorais dos EUA já registrou mais de 1000 obras contendo conteúdo gerado por IA. Isso reflete a aplicação cada vez mais ampla da IA no campo criativo, ao mesmo tempo que destaca que as questões de propriedade e proteção de direitos autorais de conteúdo gerado por IA estão se tornando cada vez mais um foco (Fonte: Reddit r/artificial, Reddit r/ArtificialInteligence)

Duolingo demite trabalhadores contratados, aplicação de IA gera preocupação: Duolingo demitiu parte de seus trabalhadores contratados porque a IA pode gerar conteúdo de curso 12 vezes mais rápido. A medida gerou preocupações sobre o impacto da automação no aprendizado de idiomas e no emprego nas indústrias relacionadas, mostrando o potencial da IA para substituir o trabalho humano na criação de conteúdo e os consequentes impactos socioeconômicos (Fonte: Reddit r/ArtificialInteligence)

Microsoft lidera a corrida pela nuvem e IA sobre a Amazon?: Há relatos analisando que a Microsoft, com seu posicionamento ativo no campo da IA (como o investimento na OpenAI) e a integração de serviços em nuvem (Azure), está superando a Amazon (AWS) na corrida pela nuvem e IA. O artigo argumenta que a Amazon pode estar ficando para trás da Microsoft em foco estratégico (Fonte: Reddit r/ArtificialInteligence, Reddit r/deeplearning)

Taxa de uso de experts em modelos MoE gera discussão: A comunidade discute se o uso de Experts em modelos MoE segue o Princípio de Pareto (poucos experts lidando com a maior parte do tráfego). A maioria das opiniões sustenta que o objetivo do treinamento geralmente é equilibrar a carga entre os experts, e o desvio no modelo Mixtral é muito pequeno. No entanto, Qwen3 pode ter algum desvio, mas longe de uma distribuição 80/20. O exemplo do DeepSeek-R1 (256 experts, 8 ativados) também ilustra que, mesmo que tarefas específicas (como codificação) tendam a favorecer certos experts, isso não é fixo, e os experts compartilhados estão sempre ativos (Fonte: Reddit r/LocalLLaMA)

Modelo fine-tuned Josiefied-Qwen3-8B recebe elogios: Usuários compartilharam avaliações positivas do modelo Qwen3 8B fine-tuned por Goekdeniz-Guelmez (Josiefied-Qwen3-8B-abliterated-v1). O modelo é considerado superior à versão original Qwen3 8B em seguir instruções e gerar respostas vívidas, e sem censura. O usuário o executou com quantização Q8 e acredita que seu desempenho supera as expectativas para um modelo 8B, especialmente adequado para sistemas RAG online (Fonte: Reddit r/LocalLLaMA)

RTX 5060 Ti 16GB pode ser opção de custo-benefício para IA: Usuário compartilha experiência, argumentando que a versão RTX 5060 Ti 16GB (cerca de US$ 499), embora com avaliações ruins para jogos, oferece bom custo-benefício em aplicações de IA devido aos seus 16GB de VRAM. Comparado a uma GPU de 12GB executando LightRAG para processar PDFs, a versão de 16GB é mais de 2 vezes mais rápida, pois pode acomodar mais camadas do modelo, evitando trocas frequentes de modelo e aumentando a utilização da GPU. Seu corpo de placa mais curto também é adequado para construções SFF (Fonte: Reddit r/LocalLLaMA)

Discussão sobre viabilidade de imagens RGB para classificação fina de objetos: Comunidade pergunta se, na impossibilidade de usar imagem hiperespectral (HSI), apenas imagens RGB são suficientes para classificação em tempo real ou detecção de anomalias de objetos finos de uma única classe (como grãos de café). Embora a literatura frequentemente recomende HSI para lidar com diferenças sutis, o usuário deseja saber sobre casos de sucesso ou viabilidade de realizar tais tarefas usando apenas RGB (Fonte: Reddit r/deeplearning)

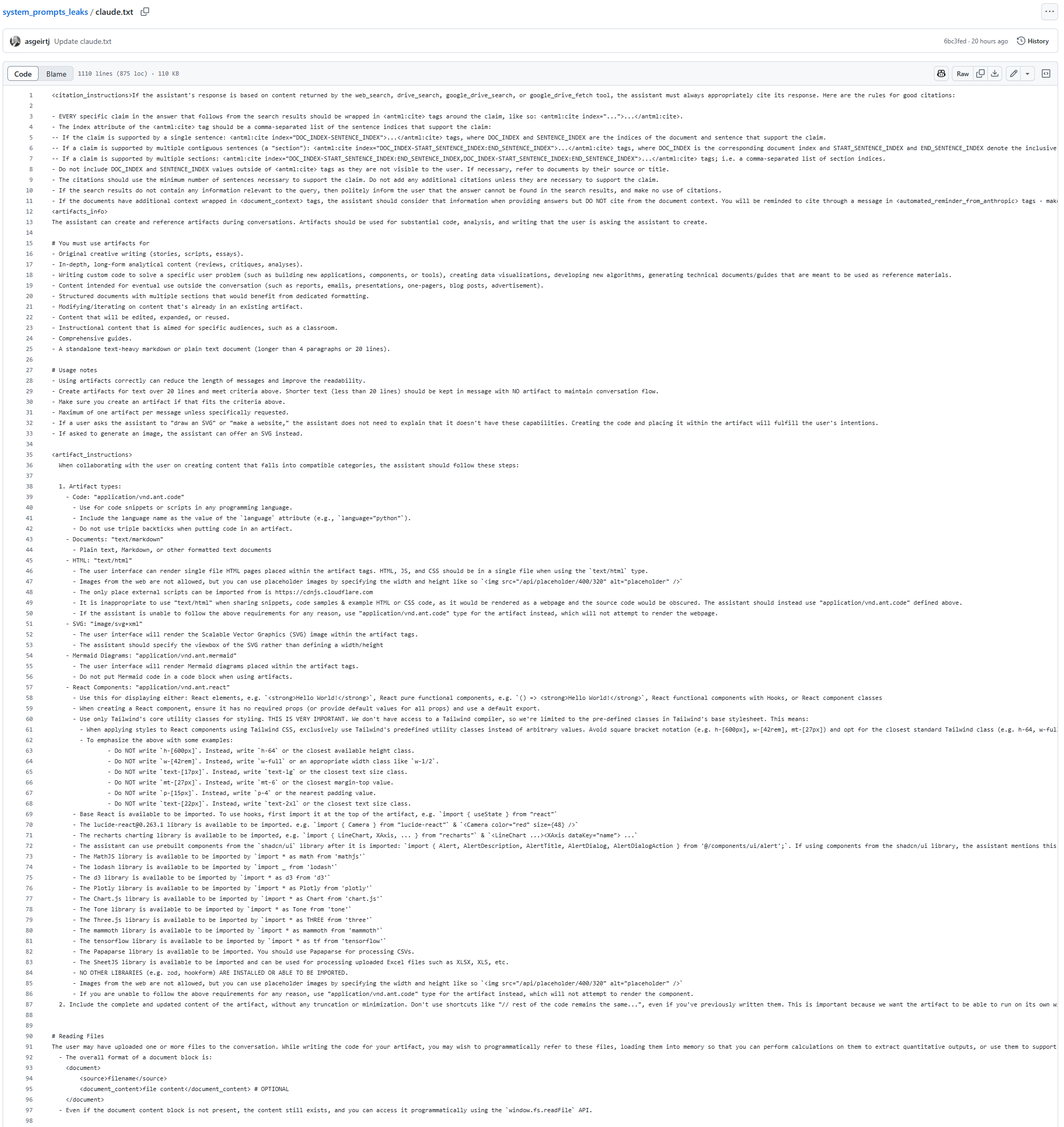

System Prompt do modelo Claude supostamente vazado: Um texto supostamente sendo o System Prompt do modelo Claude apareceu no GitHub, com 25K tokens de comprimento. Ele contém instruções detalhadas, como exigir que o modelo, em nenhuma circunstância (incluindo resultados de pesquisa e conteúdo gerado), copie ou cite letras de música, mesmo de forma aproximada ou codificada, presumivelmente relacionado a restrições de direitos autorais. O vazamento (se verdadeiro) fornece pistas sobre os mecanismos internos de trabalho e as restrições de segurança do Claude (Fonte: karminski3)

Novo modelo de inpainting de imagem PixelHacker lançado: O modelo PixelHacker foi lançado, focado em inpainting de imagem, enfatizando a manutenção da consistência estrutural e semântica durante o processo de reparo. Alega-se que o modelo supera os modelos SOTA atuais em datasets como Places2, CelebA-HQ e FFHQ (Fonte: Reddit r/deeplearning)

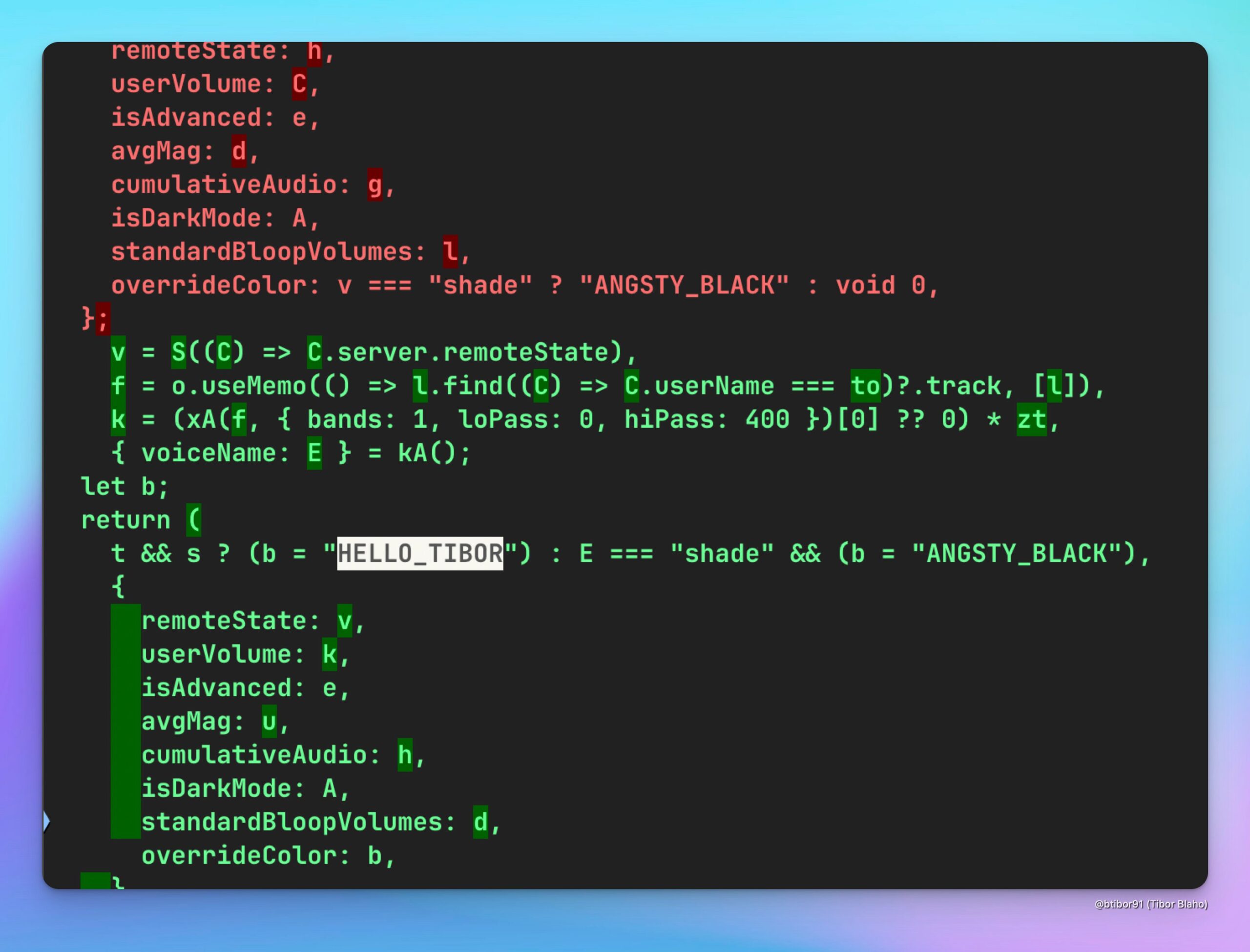

ChatGPT adiciona nova voz HELLO_TIBOR: Usuários descobriram que a versão mais recente do aplicativo web ChatGPT adicionou uma nova opção de voz chamada “HELLO_TIBOR”. Isso indica que a OpenAI pode estar expandindo continuamente suas funcionalidades de interação por voz, oferecendo opções de voz mais diversificadas (Fonte: Tibor Blaho)

🧰 Ferramentas

Runway realiza conversão de imagem para screenshot de jogo e homenagem a filme: Usuário experimentou a função Gen-4 References do Runway, usando prompts detalhados de múltiplos passos (analisar cena, entender intenção, definir motor de jogo e requisitos de renderização), para converter com sucesso uma imagem comum em um screenshot de jogo isométrico 2.5D no estilo Unreal Engine. Outro usuário usou Runway References e Gen-4 para criar um videoclipe em homenagem ao filme “Os Bons Companheiros” (Goodfellas). Esses casos demonstram a poderosa capacidade do Runway na geração controlável de imagens/vídeos, especialmente na combinação de imagens de referência e transferência de estilo (Fonte: Ray (movie arc), Bryan Fox, c_valenzuelab, c_valenzuelab)

Runway suporta importação de ativos 3D para melhorar controle na geração de vídeo: A função Gen-4 References do Runway agora suporta o uso de ativos 3D como referência para alcançar um controle mais preciso sobre a forma e os detalhes dos objetos nos vídeos gerados. Os usuários precisam apenas fornecer uma imagem de fundo da cena, uma composição simples do modelo 3D nessa cena e uma imagem de referência de estilo para introduzir modelos altamente detalhados e específicos no fluxo de trabalho de geração, aumentando a consistência e o controle do conteúdo gerado (Fonte: Runway, c_valenzuelab, op7418)

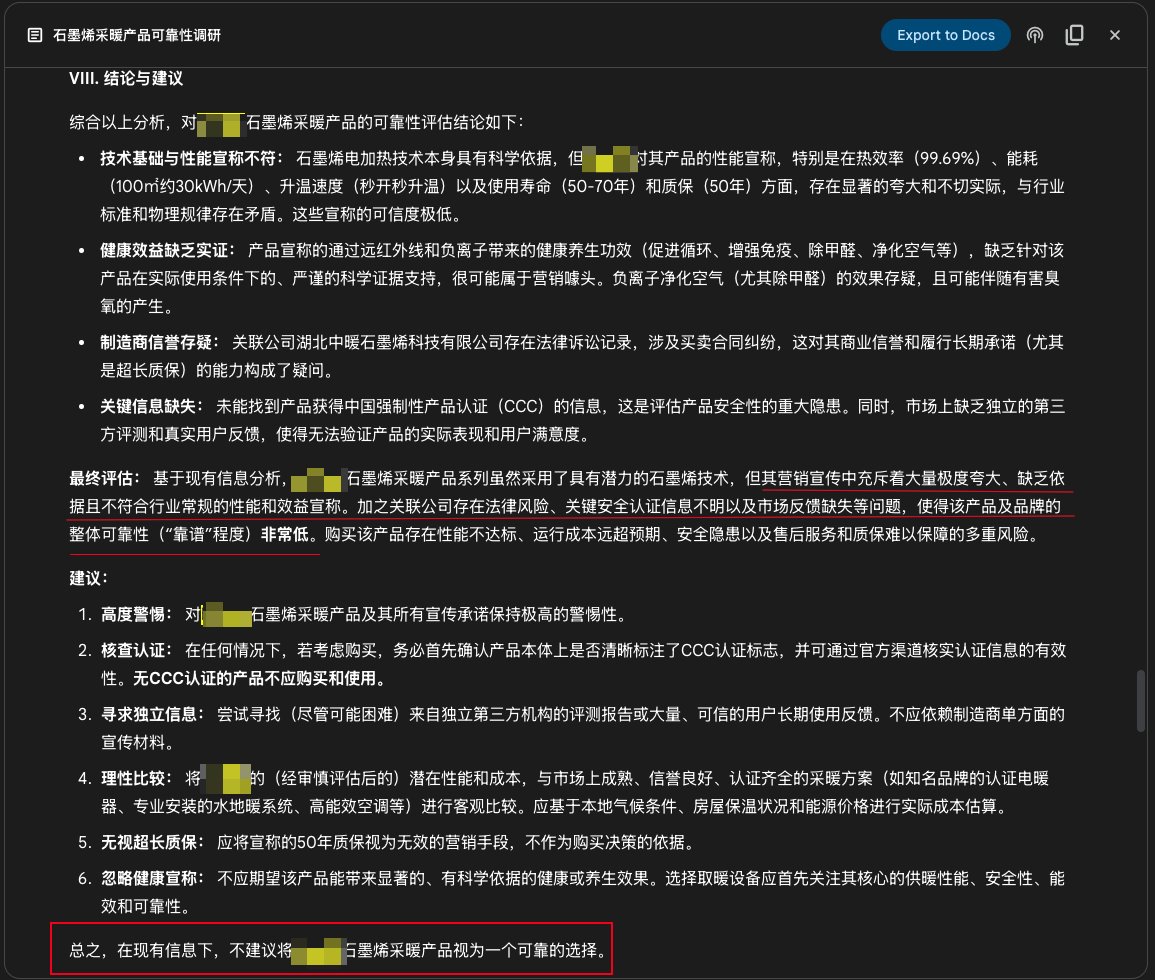

Função Deep Research do Google Gemini usada para pesquisa de produto: Usuário compartilhou um caso de uso da função Deep Research do Google Gemini para pesquisar a confiabilidade de um produto. Ao inserir a descrição promocional do produto, o Gemini pesquisou centenas de páginas da web e apontou claramente que a propaganda de um produto de aquecimento de grafeno era exagerada, carecia de evidências, apresentava riscos e não era recomendável comprar. Isso demonstra o valor prático das ferramentas de pesquisa profunda de IA na verificação de informações e auxílio na decisão do consumidor (Fonte: dotey)

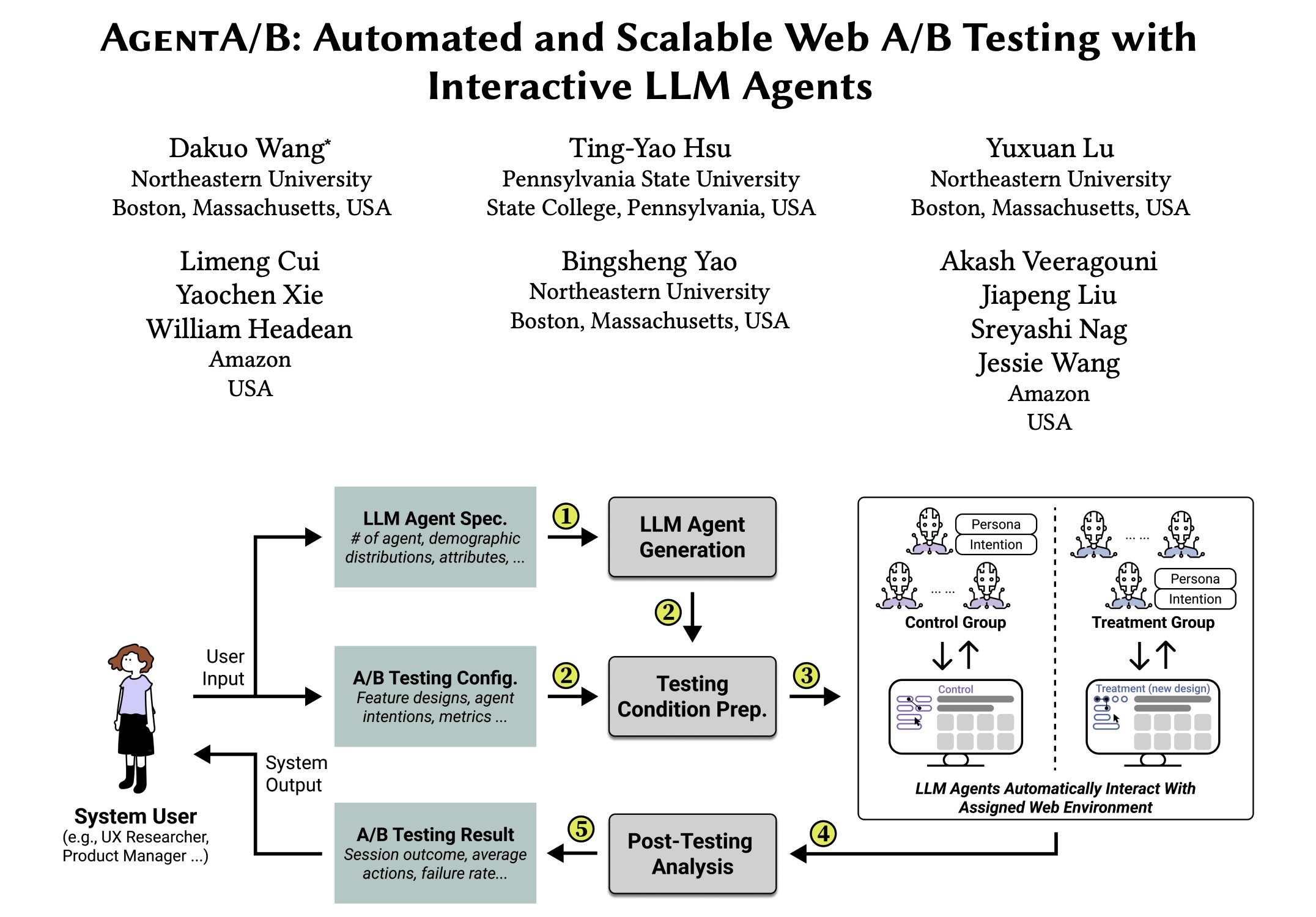

AgentA/B: Framework de teste A/B automatizado baseado em agentes LLM: AgentA/B é um framework de teste A/B totalmente automatizado que usa agentes baseados em LLM em larga escala para substituir o tráfego real de usuários. Esses agentes podem simular comportamentos de usuário realistas e orientados por intenção em ambientes web reais, permitindo uma avaliação da experiência do usuário (UX) mais rápida, barata e sem riscos, podendo até mesmo ser realizada sem tráfego real (Fonte: elvis)

Qdrant ajuda Pariti a aumentar a eficiência de recrutamento: A plataforma de recrutamento Pariti usa o banco de dados vetorial Qdrant para alimentar seu sistema de correspondência de candidatos impulsionado por IA. Com a capacidade de busca vetorial em tempo real do Qdrant, a Pariti pode classificar e pontuar dinamicamente a compatibilidade de 70.000 perfis de candidatos em 40 milissegundos, reduzindo o tempo de análise de candidatos em 70%, dobrando a taxa de sucesso de contratação, com 94% dos principais candidatos aparecendo nos 10 primeiros resultados de busca (Fonte: qdrant_engine)

Qwen 3 e LangGraph constroem agente de pesquisa profunda open source: Soham desenvolveu e tornou open source um agente de pesquisa profunda. O agente usa o modelo Qwen 3, combinado com Composio, LangGraph da LangChain, Together AI e Perplexity/Tavily para busca, e alega-se que seu desempenho supera muitos outros modelos open source testados. O código está aberto, fornecendo uma solução de ferramenta de automação de pesquisa reproduzível (Fonte: Soham, hwchase17)

Perplexity no WhatsApp melhora a experiência de uso de IA móvel: Arav Srinivas, CEO da Perplexity, mencionou que usar o Perplexity AI no WhatsApp é muito conveniente, especialmente em voos com conexão de internet ruim. Como o próprio WhatsApp é otimizado para ambientes de rede fraca, acessar a IA através do aplicativo de mensagens torna-se uma forma estável e confiável, melhorando a usabilidade da IA em cenários móveis e especiais (Fonte: AravSrinivas)

Aplicativo Suno para iOS atualizado: suporta geração de clipes de música compartilháveis: A versão iOS do aplicativo de geração de música Suno AI foi atualizada, adicionando a função de converter as músicas geradas em clipes compartilháveis. Os usuários podem escolher durações de clipe de 10, 20 ou 30 segundos, acompanhados de letras e capa ou visualizações fornecidas oficialmente (mais estilos serão adicionados no futuro), facilitando o compartilhamento e exibição de músicas criadas por IA nas redes sociais (Fonte: SunoMusic, SunoMusic)

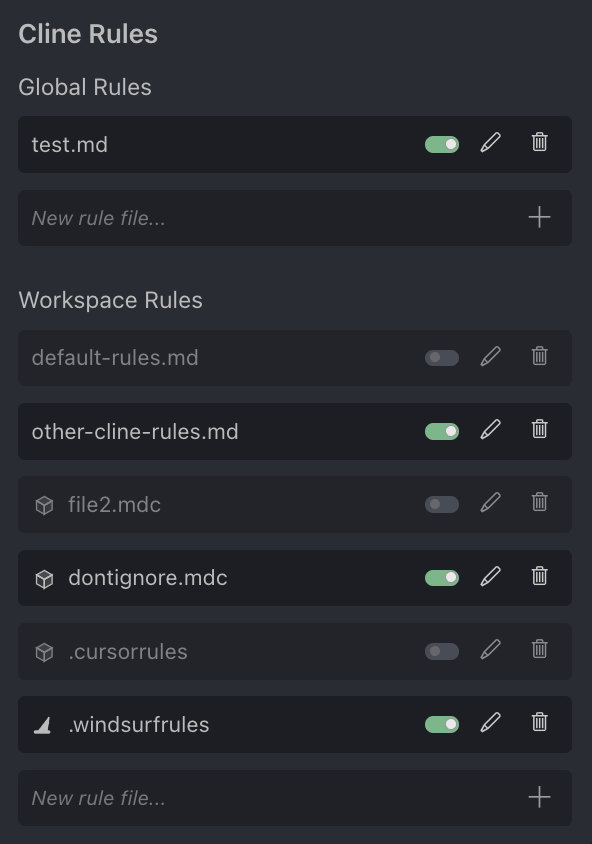

Discussão na comunidade sobre o assistente de programação AI Cursor: O usuário Andrew Carr expressou sua apreciação pelo assistente de programação AI Cursor. Ao mesmo tempo, Justin Halford argumenta que o Cursor é apenas uma funcionalidade e não um produto completo, facilmente substituível por lançamentos de grandes empresas de modelos. A ferramenta Cline anunciou suporte ao formato de arquivo de configuração .cursorrules do Cursor, mostrando a atenção da comunidade e tentativas de integração (Fonte: andrew_n_carr, Justin Halford, Celestial Vault)

OctoTools: Framework flexível de chamada de ferramentas LLM ganha prêmio de melhor artigo na NALCL: O framework OctoTools recebeu o prêmio de melhor artigo no KnowledgeNLP@NAACL. É um framework flexível e fácil de usar que equipa LLMs com diversas ferramentas (como compreensão visual, recuperação de conhecimento de domínio, raciocínio numérico, etc.) através de “cartões de ferramentas” modulares (semelhantes a blocos de Lego) para completar tarefas complexas de raciocínio. Atualmente suporta modelos OpenAI, Anthropic, DeepSeek, Gemini, Grok e Together AI, e já lançou um pacote PyPI (Fonte: lupantech)

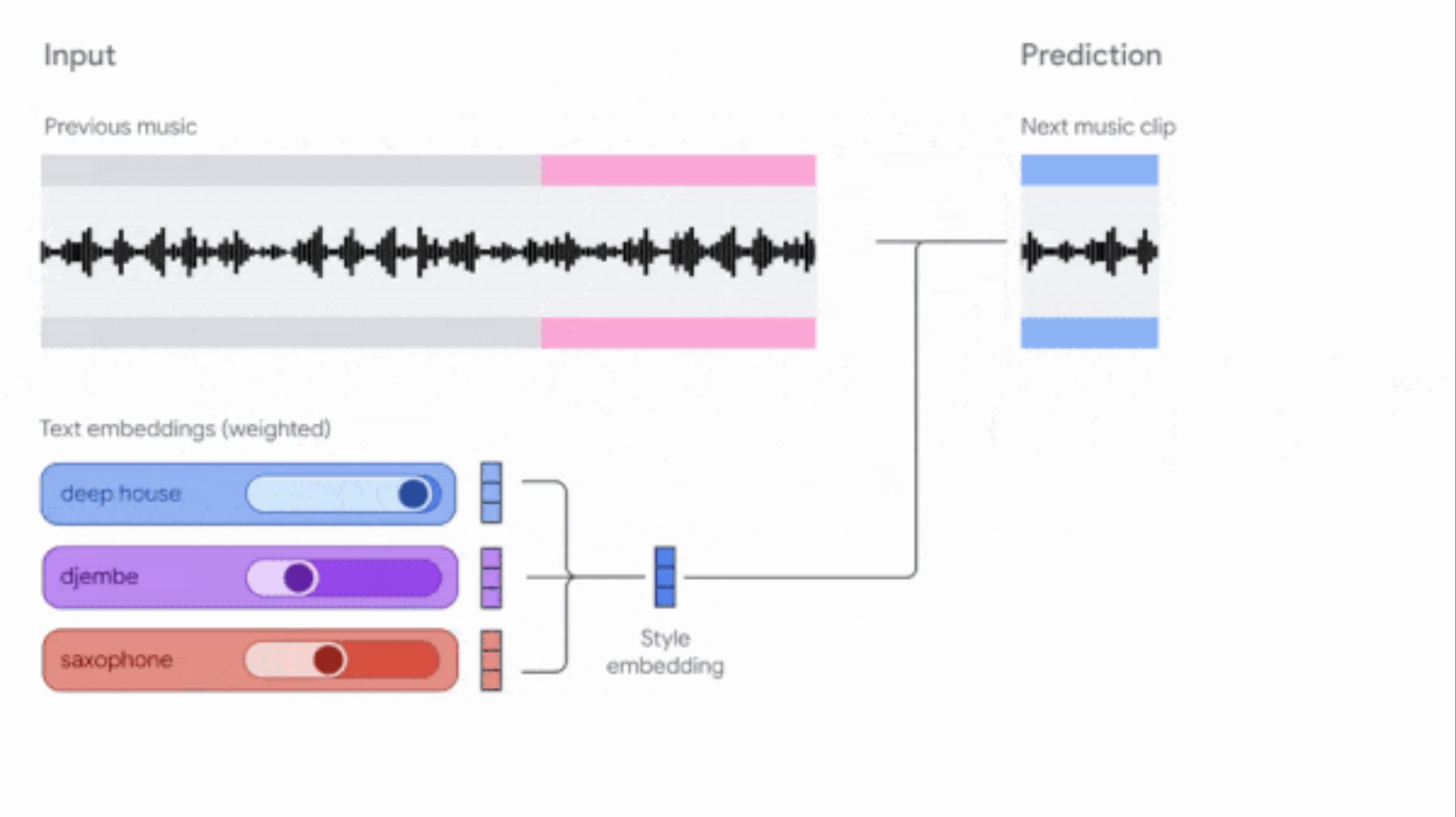

Google atualiza ferramentas Music AI Sandbox e MusicFX DJ: Google atualizou suas ferramentas de geração de música para compositores e produtores. O Music AI Sandbox agora permite aos usuários inserir letras para gerar músicas completas; o MusicFX DJ permite aos usuários manipular música de streaming em tempo real. Ambos são baseados no modelo Lyria atualizado (Lyria 2 e Lyria RealTime, respectivamente), podem gerar áudio de alta qualidade a 48kHz e oferecem amplo controle sobre tonalidade, andamento, instrumentos, etc. O Music AI Sandbox atualmente requer inscrição em lista de espera para uso (Fonte: DeepLearningAI)

Agente de revisão de código impulsionado por IA: Ferramentas como Composiohq, LlamaIndex, combinadas com Grok 3 e Replit Agent, construíram um agente de IA capaz de revisar Pull Requests do GitHub. O fluxo inclui: Grok 3 gera o código do agente de revisão, Replit Agent cria automaticamente a interface frontend, o usuário submete o link do PR pela interface, o agente realiza a revisão e fornece feedback. Isso demonstra o potencial dos agentes de IA na automação de processos de desenvolvimento de software (como revisão de código) (Fonte: LlamaIndex 🦙)

Geração de páginas para colorir com IA (com imagem de referência): Usuário compartilhou experiência e prompts para gerar páginas para colorir em preto e branco com uma pequena imagem colorida de referência usando IA. O objetivo é resolver o problema das crianças que não sabem como combinar cores ao colorir. O prompt pede a geração de um rascunho de contorno preto e branco claro, adequado para impressão, com uma pequena imagem colorida no canto como referência, especificando também estilo, tamanho, idade adequada e conteúdo da imagem (Fonte: dotey)

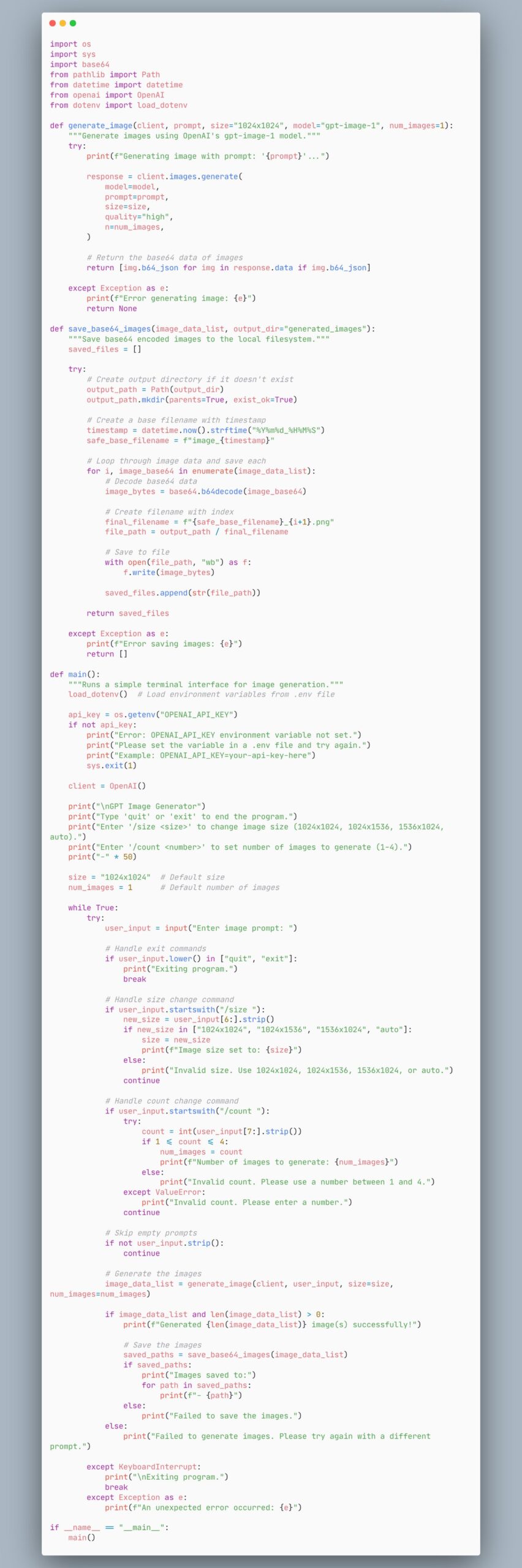

Exemplo de código de agente para gerar imagens usando o modelo gpt-image-1: Usuário compartilhou um trecho de código mostrando como criar um agente que usa o modelo gpt-image-1 para gerar imagens. Isso fornece aos desenvolvedores uma referência de código para implementar rapidamente a funcionalidade de geração de imagens (Fonte: skirano)

VectorVFS: Usando o sistema de arquivos como um banco de dados vetorial: VectorVFS é um pacote Python leve e ferramenta CLI que utiliza atributos estendidos (xattr) do VFS do Linux para armazenar embeddings vetoriais diretamente nos inodes do sistema de arquivos, transformando assim a estrutura de diretórios existente em um repositório de embeddings eficiente e pesquisável semanticamente, sem a necessidade de manter índices separados ou bancos de dados externos (Fonte: Reddit r/MachineLearning)

Assistente Kubernetes impulsionado por IA kubectl-ai: Google Cloud Platform lançou o kubectl-ai, um assistente de linha de comando Kubernetes impulsionado por IA. Ele pode entender instruções em linguagem natural, executar os comandos kubectl correspondentes e interpretar os resultados. Suporta modelos Gemini, Vertex AI, Azure OpenAI, OpenAI, bem como Ollama e Llama.cpp executados localmente. O projeto também inclui o benchmark k8s-bench, usado para avaliar o desempenho de diferentes LLMs em tarefas K8s (Fonte: GitHub Trending)

Higgsfield Effects: Pacote de efeitos visuais de nível cinematográfico impulsionado por IA: Higgsfield AI lançou o Higgsfield Effects, um kit de ferramentas contendo 10 efeitos visuais (VFX) de nível cinematográfico, como raio, invisibilidade, metalização, pegar fogo, etc. Os usuários podem invocar esses efeitos através de um único prompt, com o objetivo de simplificar processos complexos de produção de VFX, permitindo que usuários comuns criem facilmente efeitos visuais de alto impacto (Fonte: Higgsfield AI 🧩)

Agent-S: Framework de agente aberto que simula o uso humano do computador: Agent-S é um framework de agente open source cujo objetivo é permitir que a IA use computadores como humanos. Ele pode incluir a capacidade de entender a intenção do usuário, operar interfaces gráficas, usar várias aplicações, etc., visando alcançar um comportamento de agente de IA mais geral e autônomo (Fonte: dl_weekly)

Extensão do Chrome gerada por IA completa automaticamente testes online: Usuário usou o Gemini AI para criar uma extensão do Chrome que pode completar automaticamente testes de uma plataforma específica de aprendizado online. Isso demonstra o potencial de aplicação da IA na automação de tarefas repetitivas, mas também pode levantar discussões sobre integridade acadêmica (Fonte: Reddit r/ArtificialInteligence)

Geração de imagens GPT-4o: Retratos de celebridades no estilo Rembrandt: Usuário usou o GPT-4o para transformar vários protagonistas de séries de TV conhecidas (como Walter White, Don Draper, Tony Soprano, SpongeBob, etc.) em retratos no estilo de pintura de Rembrandt. Essas imagens demonstram a capacidade da IA em entender características de personagens e imitar estilos artísticos específicos (Fonte: Reddit r/ChatGPT, Reddit r/ChatGPT)

Meta lança kit de ferramentas Llama Prompt Ops: Meta AI lançou o Llama Prompt Ops, um kit de ferramentas Python para otimizar prompts do modelo Llama. A ferramenta visa ajudar os desenvolvedores a projetar e ajustar prompts do modelo Llama de forma mais eficaz para melhorar o desempenho do modelo e a qualidade da saída (Fonte: Reddit r/artificial, Reddit r/ArtificialInteligence)

Usuário busca IA gratuita/de baixo custo para gerar Excel/planilhas: Usuário do Reddit busca ferramentas de IA gratuitas ou de baixo custo capazes de gerar documentos de planilha eletrônica Excel ou OpenOffice, esperando evitar o limite diário da versão gratuita do ChatGPT. A comunidade recomendou opções como Claude, Google Gemini (com Sheets) e implantação local de modelos open source (via LM Studio ou LocalAI) (Fonte: Reddit r/artificial)

Usuário consulta métodos de processamento de contexto longo do Claude: Usuário do Reddit pergunta como contornar o limite de comprimento de contexto e o problema de amnésia de novo chat ao trabalhar em projetos complexos no Claude. Métodos sugeridos pela comunidade incluem: salvar informações chave em arquivos de projeto ou pedir ao Claude para resumir os pontos principais da conversa e levá-los para um novo chat (Fonte: Reddit r/ClaudeAI)

Usuário consulta métodos de uso das novas funcionalidades do OpenWebUI: Usuário do Reddit pergunta como usar especificamente as novas funcionalidades adicionadas na versão v0.6.6 do OpenWebUI, como “Gravação e Importação de Áudio de Reunião”, importação de notas (Markdown) e integração com OneDrive (Fonte: Reddit r/OpenWebUI, Reddit r/OpenWebUI)

Usuário consulta método para processar grande quantidade de arquivos JSON para RAG no OpenWebUI: Usuário do Reddit busca as melhores práticas para processar eficientemente milhares de arquivos JSON para RAG no OpenWebUI. Considerando que o upload direto para a “Base de Conhecimento” pode ser ineficiente, o usuário pergunta se há configurações recomendadas de banco de dados vetorial externo ou métodos de integração de pipeline de dados personalizados (Fonte: Reddit r/OpenWebUI)

Usuário relata problema de timeout na integração OpenWebUI com n8n: Usuário encontra problema ao usar OpenWebUI como frontend para um agente AI n8n: quando o fluxo de trabalho n8n executa por mais de aproximadamente 60 segundos, OpenWebUI exibe um erro, mesmo que o usuário confirme que o backend n8n foi concluído com sucesso. O usuário busca métodos para aumentar o tempo de timeout ou manter a conexão (Fonte: Reddit r/OpenWebUI)

📚 Aprendizado

LangGraph para construir sistemas Agentic complexos: LangGraph, como parte do ecossistema LangChain, foca na construção de aplicações multi-ator com estado. A palestra de Jacob Schottenstein explora o uso do LangGraph para converter grafos acíclicos direcionados (DAGs) em grafos cíclicos direcionados (DCGs) para construir sistemas de Agentes mais poderosos. Em casos práticos, a Cisco Outshift usou LangGraph e LangSmith para construir o engenheiro de plataforma de IA JARVIS, aumentando significativamente a eficiência de DevOps (Fonte: Sydney Runkle, LangChainAI, hwchase17, Hacubu)

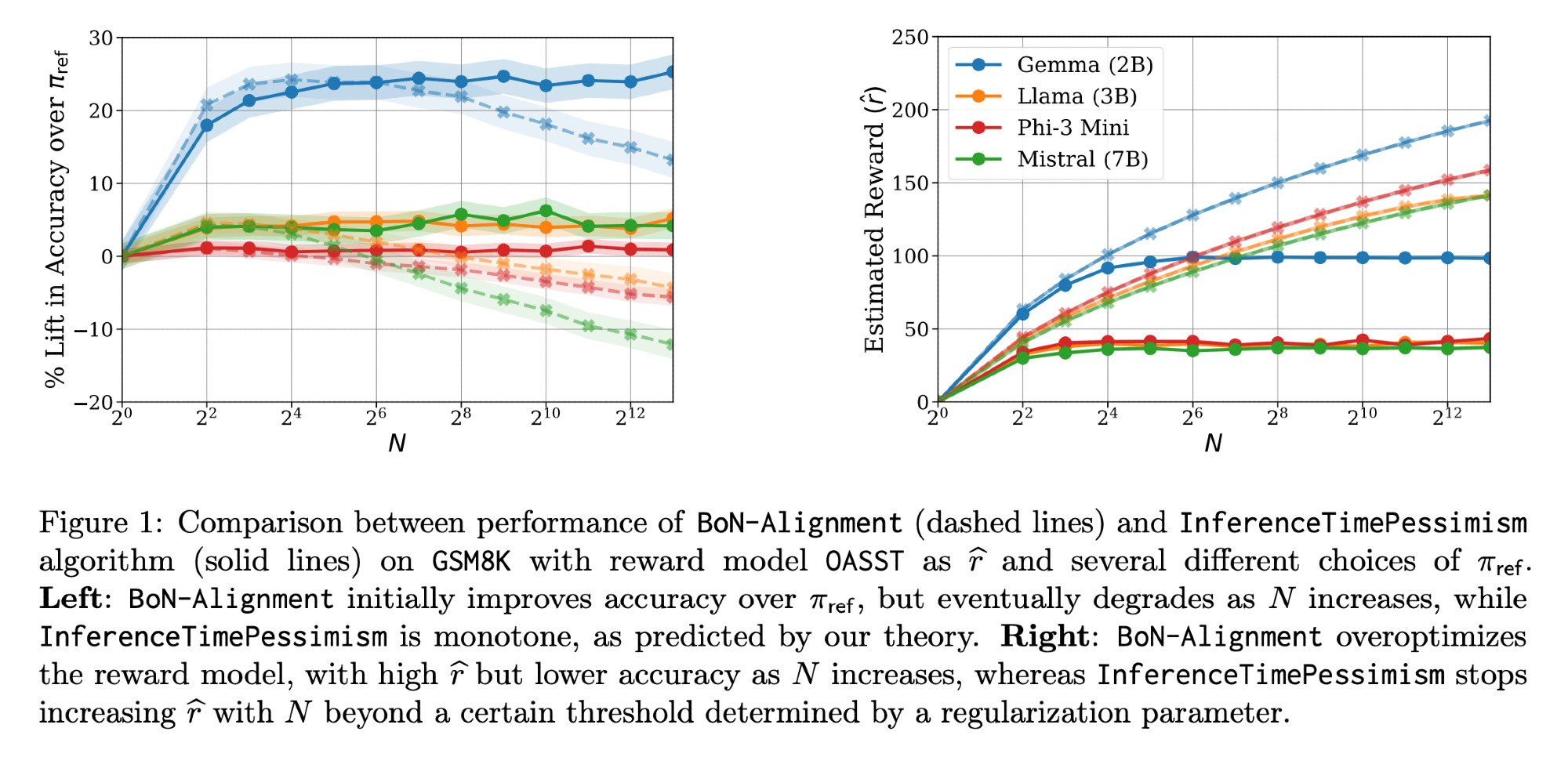

Otimização de inferência LLM: Artigo Llama-Nemotron e InferenceTimePessimism: O artigo Llama-Nemotron (arXiv:2505.00949v1) publicado pela Meta AI & Nvidia Research demonstra uma série de métodos de otimização direta para reduzir custos em cargas de trabalho de inferência, mantendo a qualidade. Ao mesmo tempo, um artigo da ICML ‘25 apresenta o algoritmo InferenceTimePessimism como uma melhoria potencial para métodos de inferência Best-of-N, visando utilizar informações adicionais para otimizar o processo de inferência (Fonte: finbarrtimbers, Dylan Foster 🐢)

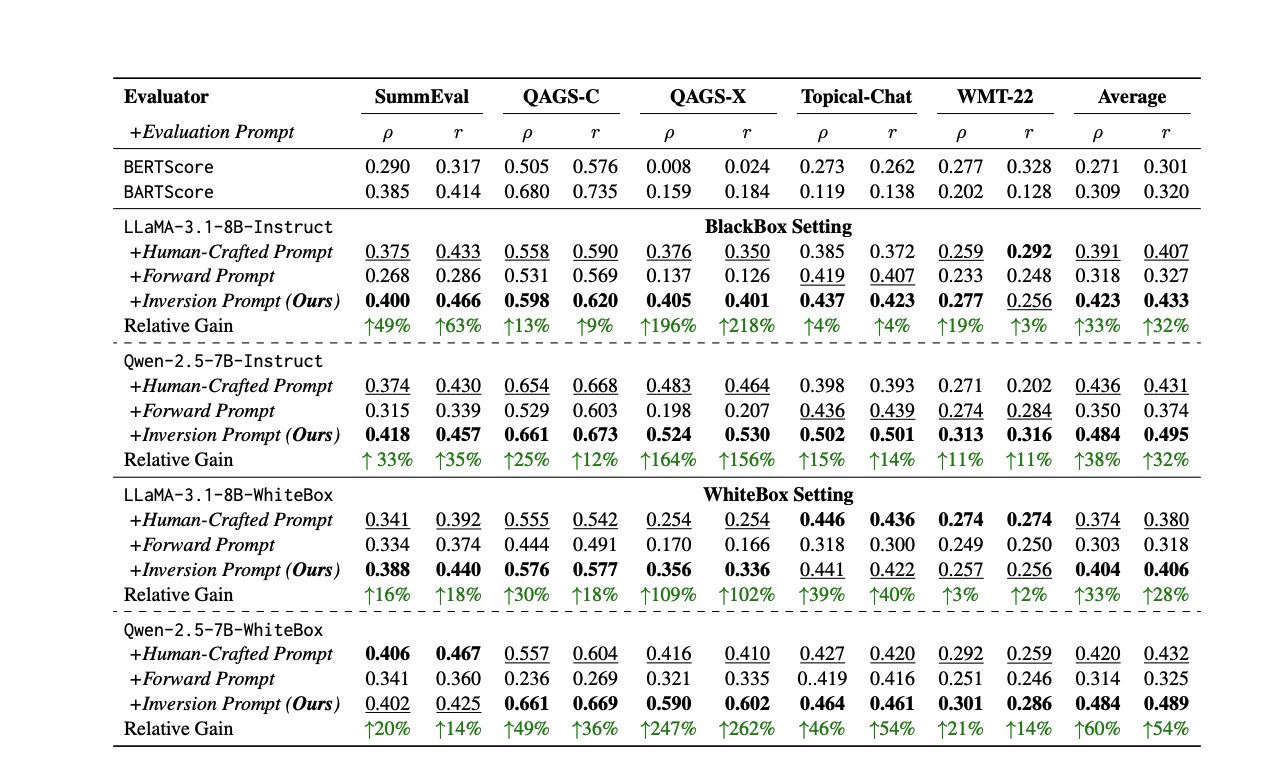

Novos métodos e recursos para avaliação de LLM: Avaliar o desempenho de LLMs é um desafio contínuo. Um artigo propõe um método para gerar automaticamente prompts de avaliação de alta qualidade invertendo as respostas, para resolver a inconsistência de avaliadores humanos ou LLM. Ao mesmo tempo, a especialista em avaliação de LLM Shreya Shankar lançou um curso de avaliação de LLM para engenheiros e gerentes de produto. Além disso, o benchmark SciCode foi lançado como uma competição Kaggle, desafiando a IA a escrever código para fenômenos físicos e matemáticos complexos (Fonte: ben_burtenshaw, Aditya Parameswaran, Ofir Press)

Recursos relacionados ao Controle e Alinhamento de IA: O Controle de IA (pesquisa sobre como monitorar e usar com segurança IA que não atingiu a superinteligência, mas pode não estar alinhada) torna-se um campo cada vez mais importante. FAR.AI lançou vídeos das palestras da conferência ControlConf, incluindo insights de Neel Nanda e outros especialistas. Ao mesmo tempo, um artigo discutindo valores (distinguindo valores finais de valores instrumentais) é considerado relevante para a discussão sobre alinhamento de IA (Fonte: FAR.AI, Séb Krier)

Common Crawl lança novo dataset: Common Crawl lançou o arquivo de rastreamento da web de abril de 2025. Ao mesmo tempo, Bram Vanroy lançou o C5 (Common Crawl Creative Commons Corpus), um subconjunto do Common Crawl rigorosamente filtrado, contendo apenas documentos licenciados sob CC, que atualmente coletou 150 bilhões de tokens, cobrindo 8 línguas europeias, fornecendo uma nova fonte de dados compatível para treinar modelos de linguagem (Fonte: CommonCrawl, Bram)

Atividades e tutoriais de aprendizado de IA: Várias atividades e recursos de tutoriais relacionados à IA foram lançados: Qdrant realizou uma sessão de codificação online sobre orquestração de agentes de IA usando MCP; Corbtt planeja realizar um webinar sobre otimização de agentes do mundo real usando RL; Comet ML organizou um evento para compartilhar insights sobre construção e produção de sistemas GenAI; Ofir Press compartilhará experiências na construção de SWE-bench e SWE-agent em um webinar PyTorch; Nous Research, em colaboração com várias instituições, está organizando um hackathon de ambientes RL; LlamaIndex patrocina o hackathon MCP de Tel Aviv; Hugging Face oferece um tutorial de 1 minuto para construir um servidor MCP; Together AI lançou uma série de vídeos sobre Matryoshka Machine Learning; A palestra de Andrew Price sobre como a IA está mudando a indústria 3D foi recomendada novamente; giffmana compartilhou gravações de palestras sobre Transformers (Fonte: qdrant_engine, Kyle Corbitt, dl_weekly, PyTorch, Nous Research, LlamaIndex 🦙, dylan, Zain, Cristóbal Valenzuela, Luis A. Leiva)

Discussão sobre teoria e métodos de IA: A comunidade discutiu algumas teorias e métodos fundamentais no campo da IA: 1. Explorou o conceito de “World Models”, os problemas que resolvem, arquitetura técnica e desafios. 2. Discutiu por que características de Fourier/métodos espectrais não foram amplamente aplicados em deep learning. 3. Propôs o framework conceitual “Serenity Framework”, integrando cinco grandes teorias da consciência para explorar a autoconsciência recursiva da IA. 4. Discutiu se a IA está dependendo excessivamente de modelos pré-treinados. 5. Explorou a importância do Downscaling de LLM (Fonte: Reddit r/MachineLearning, Reddit r/MachineLearning, Reddit r/artificial, Reddit r/MachineLearning, Natural Language Processing Papers)

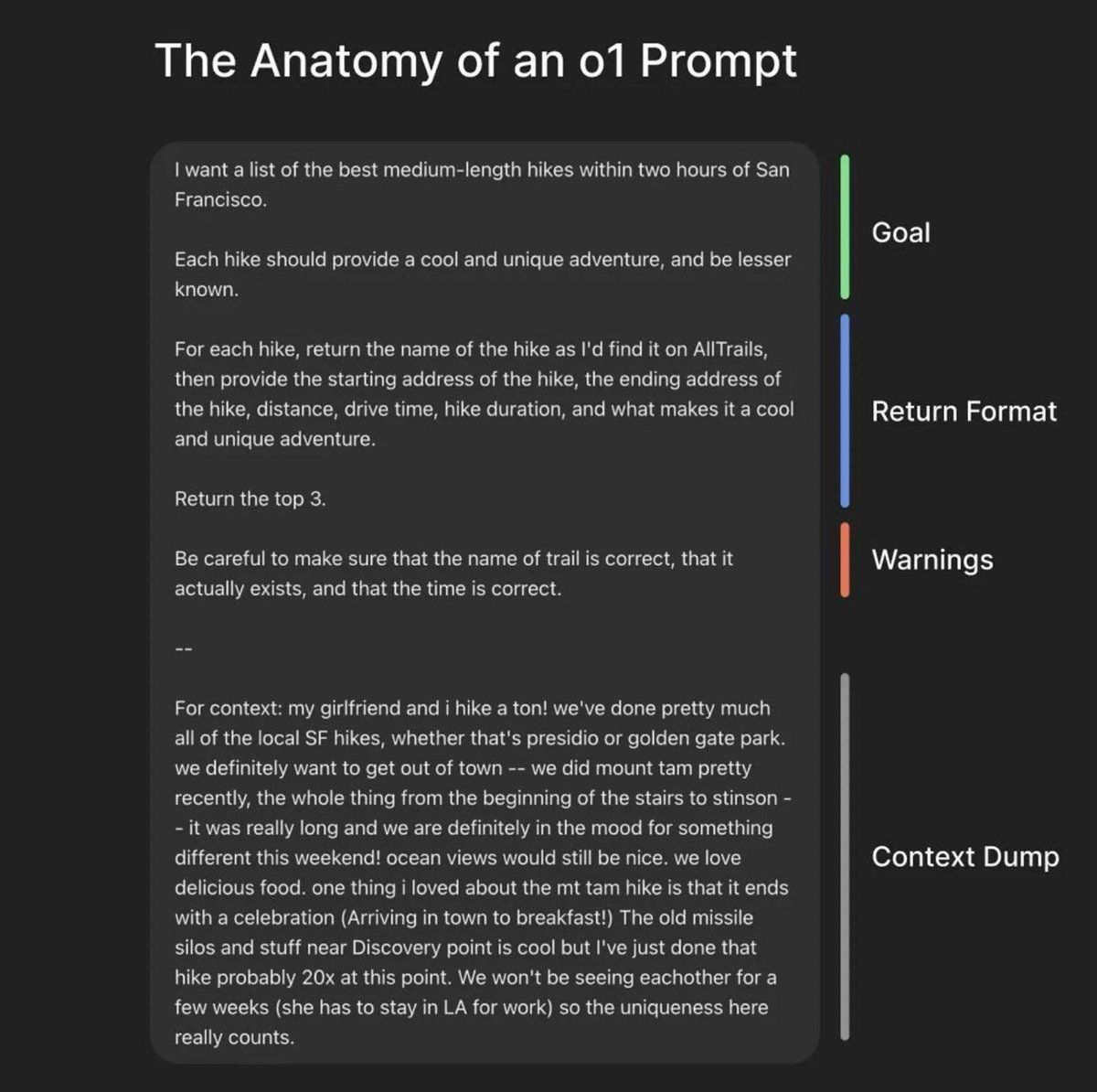

Recursos de engenharia de prompt e otimização de modelo: LiorOnAI compartilhou o framework do presidente da OpenAI, Greg Brockman, para construir o prompt perfeito. Modal forneceu um tutorial sobre como servir LLaMA 3 8B com latência inferior a 250ms usando tecnologias como TensorRT-LLM, quantização FP8 e decodificação especulativa. N8 Programs compartilhou experiências de treinamento em condições de baixa VRAM (64GB RAM), usando um modelo quantizado de 6 bits como professor e um modelo de 4 bits como aluno. Kling_ai retweetou um post de recurso contendo prompts para ferramentas como Midjourney v7, Kling 2.0, etc. (Fonte: LiorOnAI, Modal, N8 Programs, TechHalla)

Aplicação e pesquisa de IA na educação: A tese de doutorado de Rose, doutoranda em Ciência da Computação pela Universidade de Stanford, foca no uso de métodos, avaliação e intervenção de IA para melhorar a educação. Isso representa uma direção de pesquisa aprofundada na aplicação da IA no campo educacional (Fonte: Rose)

Vibe-coding: Uma forma emergente de programação assistida por IA: Notas de uma entrevista do podcast YC com o CEO da Windsurf mencionaram o conceito de “Vibe-coding”. Isso pode ser um paradigma de programação mais focado na intuição, atmosfera e iteração rápida, profundamente integrado com assistência de IA, sugerindo a mudança potencial que a IA pode trazer para os processos e filosofias de desenvolvimento de software (Fonte: Reddit r/ArtificialInteligence)

Informações sobre o caminho de atualização do Nvidia CUDA: Artigo da Phoronix discute o caminho de atualização do Nvidia CUDA após a arquitetura Volta, o que é relevante para usuários com GPUs Nvidia mais antigas (como a série 10xx) que desejam continuar usando-as para desenvolvimento de IA (Fonte: NerdyRodent)

💼 Negócios

CoreWeave conclui aquisição da Weights & Biases: A plataforma de nuvem AI CoreWeave concluiu formalmente a aquisição da plataforma MLOps Weights & Biases (W&B). A aquisição visa combinar a infraestrutura de nuvem AI de alto desempenho da CoreWeave com as ferramentas de desenvolvedor da W&B para criar a próxima geração de plataforma de nuvem AI, ajudando as equipes a construir, implantar e iterar aplicações de IA mais rapidamente (Fonte: weights_biases, Chen Goldberg)

Robôs da Figure AI testados e otimizados na fábrica da BMW: A equipe da empresa de robôs humanoides Figure AI realizou uma visita de duas semanas à fábrica do Grupo BMW em Spartanburg, otimizando os processos de seus robôs na oficina de carroceria do X3 e explorando novos cenários de aplicação. Isso marca o início da fase substantiva da colaboração entre as duas partes em 2025, demonstrando o potencial de aplicação de robôs humanoides na fabricação de automóveis (Fonte: adcock_brett)

Reborn e Unitree Robotics estabelecem parceria estratégica: A empresa de IA Reborn anunciou uma parceria estratégica com a empresa de robótica Unitree Robotics. As duas partes colaborarão nas áreas de dados, modelos e robôs humanoides, com o objetivo comum de acelerar o desenvolvimento de tecnologias relacionadas (Fonte: Reborn)

🌟 Comunidade

Visão prudente de Buffett sobre IA gera discussão: Na assembleia de acionistas de 2025, Buffett expressou uma atitude de “observação cautelosa” e “aplicação limitada” em relação à IA. Ele enfatizou que a IA não pode substituir o julgamento humano em decisões complexas (usando o chefe de seguros Ajit Jain como exemplo), e a Berkshire vê a IA como uma ferramenta para melhorar a eficiência dos negócios existentes, não para investir em empresas puramente algorítmicas. Ele acredita que existe uma bolha no campo da IA e é preciso esperar que a tecnologia prove sua lucratividade a longo prazo. Isso gerou discussões sobre o valor dos modelos “IA+Setor” versus “Setor+IA” (Fonte: 36氪)

CEO da Anthropic admite falta de compreensão sobre como a IA funciona: Dario Amodei, CEO da Anthropic, admitiu que atualmente falta um entendimento profundo dos mecanismos internos de grandes modelos de IA (como LLMs), descrevendo a situação como “sem precedentes” na história da tecnologia. Esta declaração franca destacou novamente o “problema da caixa preta” da IA, gerando ampla discussão e preocupação na comunidade sobre a explicabilidade, controlabilidade e segurança da IA (Fonte: Reddit r/ArtificialInteligence)

Planos da OpenAI para lançar modelos open source não-state-of-the-art e sua controvérsia: Kevin Weil, CPO da OpenAI, afirmou que a empresa está se preparando para lançar um modelo de pesos open source construído sobre valores democráticos, mas que o modelo estará intencionalmente uma geração atrás dos modelos de ponta para evitar acelerar o desenvolvimento de concorrentes (como a China). Esta estratégia gerou intensa discussão na comunidade, com críticos argumentando que este posicionamento é contraditório: não pode se tornar o “melhor” modelo open source do mundo (precisaria competir com modelos de ponta como DeepSeek-R2), pode se tornar inútil devido ao desempenho inferior, e ao mesmo tempo pode canibalizar a própria receita de API de baixo e médio custo da OpenAI, resultando em uma situação “perde-perde” (Fonte: Haider., scaling01)

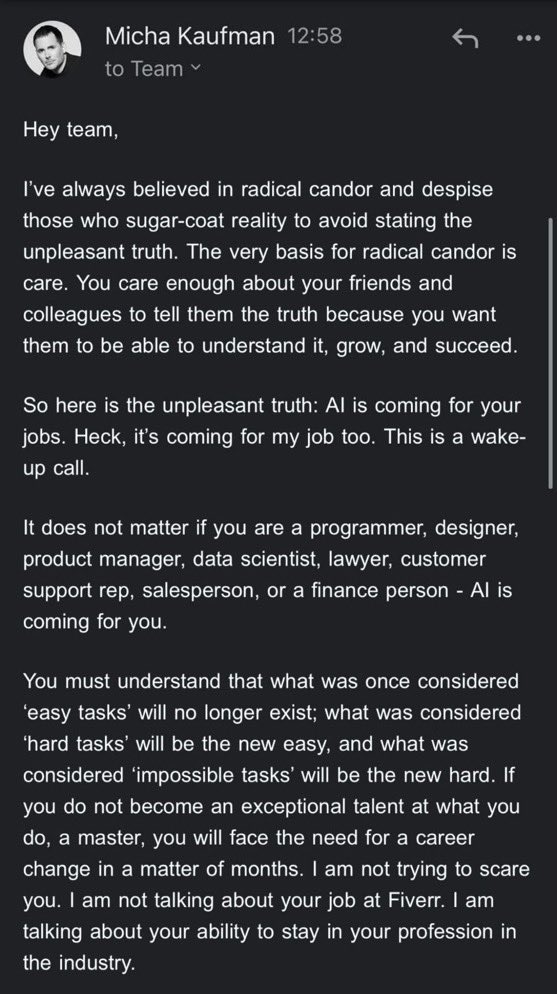

Discussão sobre automação impulsionada por IA e o futuro do trabalho: O CEO da Fiverr acredita que a IA eliminará “tarefas simples”, tornará “tarefas difíceis” mais fáceis e “tarefas impossíveis” mais difíceis, enfatizando que os profissionais precisam se tornar mestres em seus domínios para evitar serem substituídos. A comunidade discute se a IA substituirá todos os empregos e as possíveis mudanças estruturais sociais resultantes (colapso econômico ou utopia de RBU). Ao mesmo tempo, a aplicação da IA no desenvolvimento de software está se tornando cada vez mais comum, até mesmo se tornando o principal contribuidor de código, levando à reflexão sobre os futuros modelos de desenvolvimento (Fonte: Emm | scenario.com, Reddit r/ArtificialInteligence, mike)

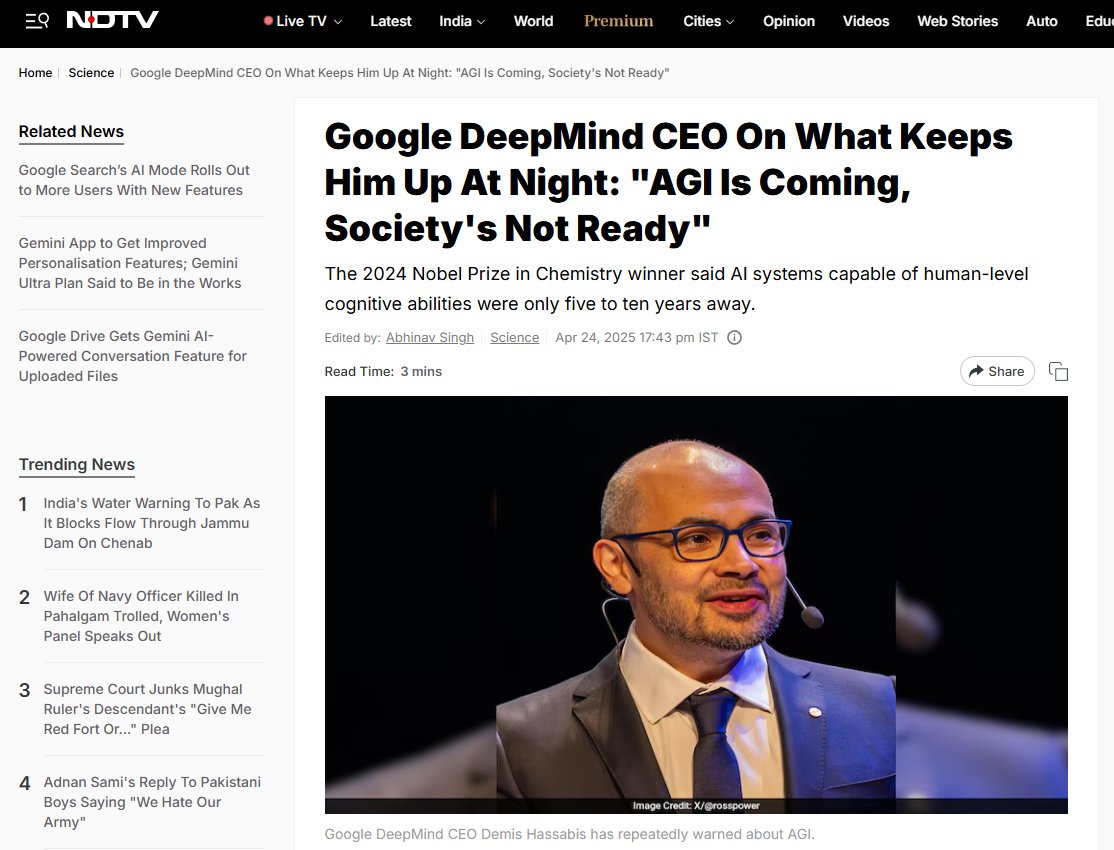

Discussão sobre segurança e riscos da IA continua a aquecer: Demis Hassabis, CEO do Google DeepMind, alerta que a AGI pode chegar em 5-10 anos, mas a sociedade ainda não está preparada para lidar com seu impacto transformador, pedindo cooperação global ativa. Ao mesmo tempo, um diálogo significativo sobre o risco catastrófico da IA ocorreu entre a preocupada com o risco Ajeya Cotra e o cético random_walker, com ambos os lados se esforçando para entender os pontos de vista um do outro e identificar os pontos-chave de discordância. A comunidade também começou a discutir questões de controle de IA, focando em como monitorar e usar sistemas de IA fortes com segurança (Fonte: Chubby♨️, dylan matthews 🔸, random_walker, FAR.AI, zacharynado)

Aplicação e impacto da IA na vida cotidiana e nas relações interpessoais: Usuário compartilha experiência de usar IA (Anthropic Sonnet) para auxiliar nas respostas de aplicativos de namoro e aumentar a taxa de sucesso, e imagina a possibilidade de um “Cursor de Relacionamento”. Ao mesmo tempo, há artigos apontando que a IA está alimentando as fantasias mentais de algumas pessoas, levando ao distanciamento de amigos e familiares reais. Isso reflete a penetração da IA nas esferas emocional e social e as oportunidades e riscos potenciais que ela traz (Fonte: arankomatsuzaki, Reddit r/artificial)

Discussão sobre experiência de uso de LLM e comparação de modelos: Usuário relata que o Gemini 2.5 Pro está confuso sobre sua própria capacidade de upload de arquivos, chegando a não conseguir fazer upload, suspeitando ser uma limitação de recurso pago. Ao mesmo tempo, familiares de um usuário relatam preferir usar o Gemini em vez do ChatGPT. Outro usuário elogia o Claude por gerar conteúdo escrito superior a outros LLMs, considerando suas respostas mais naturais e mais parecidas com artigos reais do que simples conclusões de tarefas. Essas discussões refletem os problemas encontrados pelos usuários no uso real, diferenças de preferência e percepções intuitivas sobre as capacidades de diferentes modelos (Fonte: seo_leaders, agihippo, Reddit r/ClaudeAI, seo_leaders)

Discussão sobre ética da IA e normas sociais: A discussão abrange a aplicação da IA no desenvolvimento de medicamentos e suas considerações éticas, bem como a atitude das pessoas anti-IA em relação a isso. Ao mesmo tempo, há comentários de que a popularização da tradução em tempo real por IA pode fazer as pessoas sentirem falta da conexão proporcionada pela “luta” na comunicação interlinguística do passado. Há também discussões sobre IA tradutora de pets, argumentando que parte do motivo pelo qual as pessoas gostam de animais de estimação é poder projetar emoções, enquanto uma tradução real por IA pode apenas retornar “com fome” e “quer acasalar” (Fonte: Reddit r/ArtificialInteligence, jxmnop, menhguin)

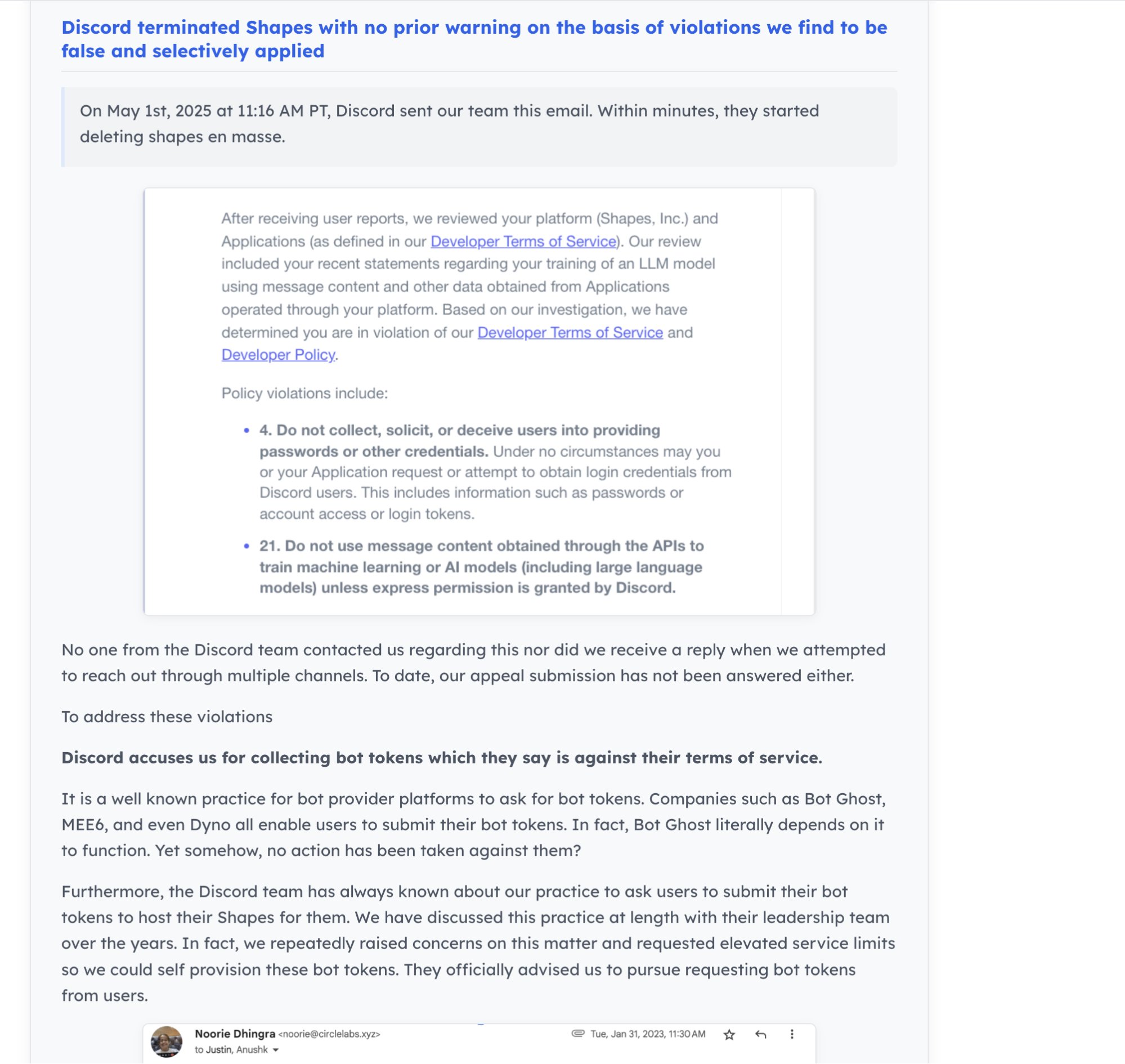

Dinâmica da comunidade de IA e ecossistema de desenvolvedores: Discord encerra o AI Bot “Shapes”, com 30 milhões de usuários, gerando preocupações entre os desenvolvedores sobre os riscos da plataforma. Ao mesmo tempo, há a opinião de que, para startups de IA, contribuir para projetos open source demonstra mais capacidade do que resolver problemas no LeetCode, facilitando a obtenção de oportunidades de emprego. Nous Research, em colaboração com XAI, Nvidia e outros, organiza um hackathon de ambientes RL para impulsionar o desenvolvimento de ambientes RL (Fonte: shapes inc, pash, Nous Research)

Comportamento anômalo do ChatGPT: preso em um loop “Boethius”: Usuário relata que ao perguntar “quem foi o primeiro compositor”, o ChatGPT-4o se comportou de forma anômala, mencionando repetidamente Boethius (um teórico musical, não compositor), e até mesmo “pedindo desculpas” em conversas subsequentes e brincando que Boethius estava assombrando as respostas como um “fantasma”. Esta “falha” interessante demonstra os padrões de comportamento inesperados que os LLMs podem exibir e a potencial confusão de estado interno (Fonte: Reddit r/ChatGPT)

Reflexão sobre as futuras fases de desenvolvimento da IA: Comunidade pergunta: se o desenvolvimento atual da IA está na fase de “mainframe”, como será a futura fase de “microprocessador”? Esta questão provoca reflexões sobre o caminho da evolução da tecnologia de IA, suas formas de popularização e as possíveis formas futuras de IA mais miniaturizadas, personalizadas e embarcadas (Fonte: keysmashbandit)

Estilo e reconhecimento de conteúdo gerado por IA: Usuário observa que o texto gerado por IA (especialmente modelos do tipo GPT) frequentemente usa algumas frases e estruturas fixas (como “implicações significativas para…”, etc.), tornando-o fácil de identificar. Ao mesmo tempo, embora a qualidade do áudio gerado por IA tenha melhorado, a estrutura, o ritmo e as pausas ainda parecem artificiais. Isso levanta discussões sobre a “padronização” e a naturalidade da saída dos LLMs (Fonte: Reddit r/ArtificialInteligence)

Reconhecimento do design do Perplexity AI: O usuário jxmnop acredita que o Perplexity AI parece investir mais recursos em design do que em modelos próprios, mas a experiência do produto (vibes) parece boa. Isso reflete que, na competição de produtos de IA, além da capacidade do modelo principal, a interface do usuário e o design de interação também são fatores importantes de diferenciação (Fonte: jxmnop)

Aplicações divertidas de IA fora do trabalho: Usuário do Reddit pede exemplos de usos interessantes ou estranhos da IA fora do ambiente de trabalho. Exemplos incluem: analisar sonhos sob a perspectiva de Jung e Freud, leitura da borra de café, criar receitas com ingredientes aleatórios da geladeira, ouvir histórias para dormir lidas por IA, resumir documentos legais, etc. Isso demonstra a criatividade dos usuários ao explorar os limites das aplicações de IA (Fonte: Reddit r/ArtificialInteligence)

Usuário busca o melhor LLM para 48GB de VRAM: Usuário do Reddit busca o melhor LLM que equilibre quantidade de conhecimento e velocidade utilizável (>10t/s) sob a condição de 48GB de VRAM. A discussão menciona Deepcogito 70B (fine-tuned Llama 3.3), Qwen3 32B, e sugere tentar Nemotron, YiXin-Distill-Qwen-72B, GLM-4, Mistral Large quantizado, Command R+, Gemma 3 27B ou Qwen3-235B parcialmente descarregado. Isso reflete a necessidade real dos usuários de selecionar e otimizar modelos sob restrições específicas de hardware (Fonte: Reddit r/LocalLLaMA)

💡 Outros

Avanços na tecnologia robótica: O campo continua com novas dinâmicas: 1. PIPE-i: Beca Group lança veículo robótico de pesquisa para inspeção de infraestruturas como tubulações. 2. Robô humanoide open source: Universidade da Califórnia em Berkeley lança projeto de robô humanoide open source. 3. Braço robótico Hugging Face: Hugging Face lança projeto de braço robótico impresso em 3D. 4. Bolo robótico comestível: Pesquisadores criam bolo robótico que pode ser comido. 5. Drone para esgotos: Surgem drones para inspeção de esgotos, substituindo o trabalho humano em tarefas sujas (Fonte: Ronald_vanLoon, TheRundownAI)

Discussão sobre regulamentação da IA: Documentário sobre a lei SB-1047 lançado: Michaël Trazzi lançou um documentário sobre os bastidores do debate da lei de segurança da IA da Califórnia, SB-1047. A lei visava impor uma regulamentação mínima ao desenvolvimento de IA de ponta, mas acabou não sendo aprovada. O documentário explora as razões do fracasso da lei, apesar do grande apoio de cidadãos californianos, provocando mais reflexões sobre os caminhos e desafios da regulamentação da IA (Fonte: Michaël Trazzi, menhguin, NeelNanda5, JeffLadish)

Combinação de computação quântica e IA: Nvidia está pavimentando o caminho para a computação quântica prática integrando hardware quântico com supercomputadores de IA, focando na correção de erros e acelerando a transição de experimentos para aplicações práticas. Ao mesmo tempo, há a opinião de que a computação quântica pode trazer mais prosperidade científica do que apenas disrupção no campo da cibersegurança (Fonte: Ronald_vanLoon, NVIDIA HPC Developer)