Palavras-chave:Óculos de IA, Robôs humanoides, Governação de direitos de autor de IA, OpenAI, Batalha dos 100 óculos de IA, Maratona de robôs humanoides, Governação global de direitos de autor de IA, Modelo de inferência OpenAI o3, Mercado de animais de estimação de IA, Processo de recrutamento por IA, Controvérsia sobre atendimento ao cliente por IA, Aplicação de IA na educação

“` markdown

🔥 Foco

Guerra dos óculos de IA intensifica-se, gigantes entram no mercado e pressionam espaço das startups: Gigantes da tecnologia como Xiaomi, Huawei, Alibaba e ByteDance estão a acelerar a sua entrada no mercado de óculos de IA, desencadeando uma nova “guerra dos óculos”. A Xiaomi lançou os óculos de áudio inteligentes MIJIA e planeia lançar óculos AR com funcionalidades mais avançadas; a Huawei atualizou os seus produtos de óculos inteligentes; Alibaba e ByteDance também estão a desenvolver novos produtos que integram funções de IA e AR. Existem atualmente quatro categorias de produtos no mercado: áudio + IA, áudio + fotografia + IA, áudio + AR + IA, e áudio + fotografia + AR + IA. As grandes empresas estão a apostar em múltiplas linhas, enquanto as startups tendem a focar-se na rota mais completa, mas também a mais difícil. As grandes empresas têm vantagens claras em termos de financiamento, tecnologia (como soluções de chip duplo para reduzir o consumo de energia), ligação ao ecossistema (obtenção de permissões do sistema) e canais, exercendo uma enorme pressão sobre startups como a RayNeo e a XREAL. Embora as startups tenham um bom faro para o mercado, a sua iteração tecnológica é lenta, enfrentando o risco de serem ultrapassadas. No entanto, os óculos de IA ainda enfrentam desafios técnicos (peso, autonomia da bateria, poder de computação), aceitação do mercado, privacidade (risco de filmagem oculta por câmaras), etc. A sua forma final e dimensão de mercado ainda são incertas. As startups podem procurar espaço para sobreviver através de um posicionamento diferenciado (como a INMO Technology, que visa grupos específicos). (Fonte: AI眼镜大战升级:巨头进场,小团队悬了?、AI拼好镜,智能眼镜又支棱起来了?、字节跳动要做AI眼镜?这事还真的很有想象空间)

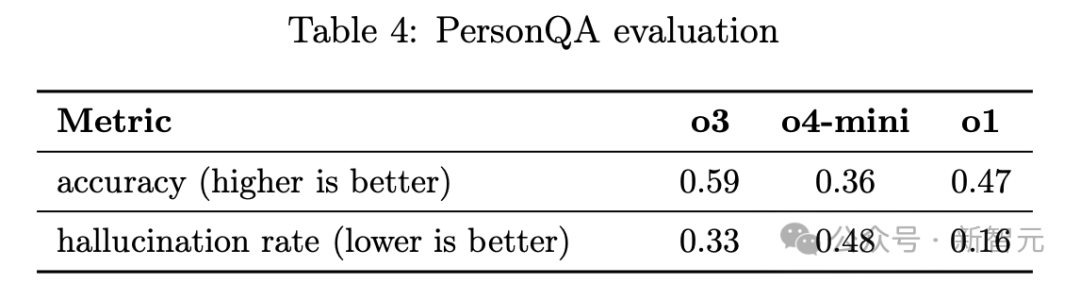

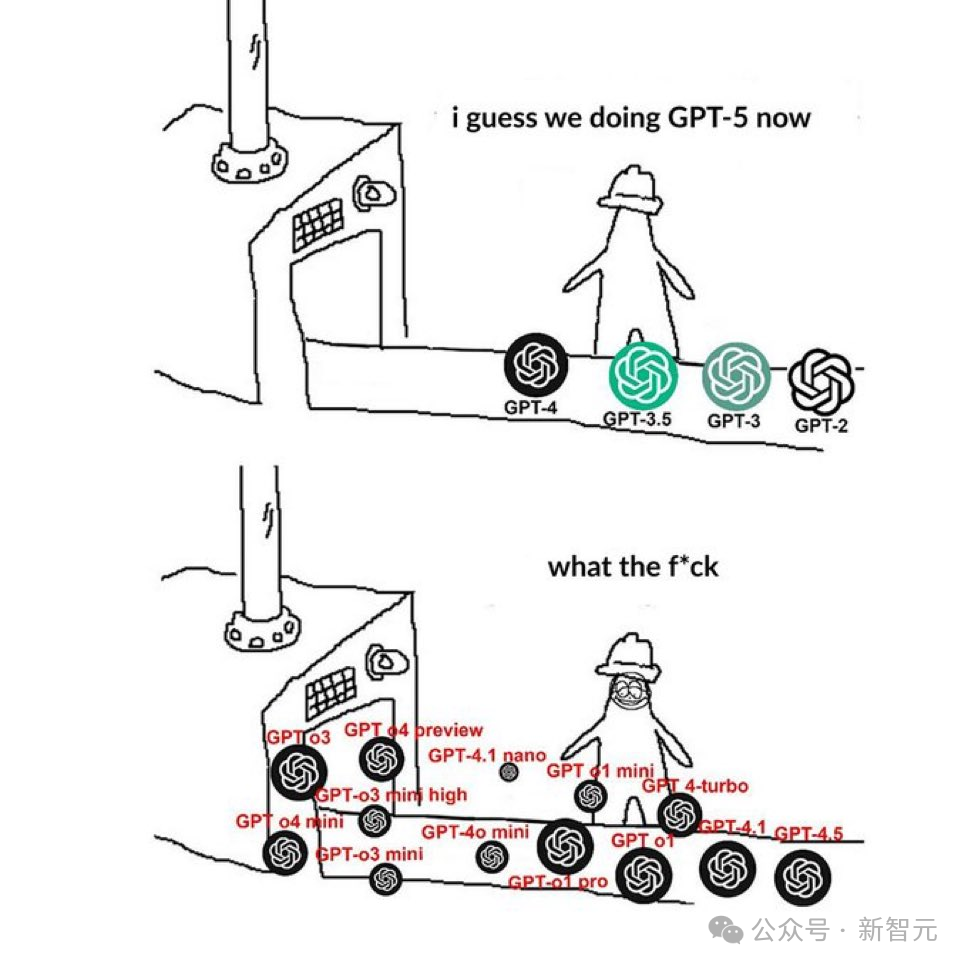

Novos modelos de inferência da OpenAI, o3/o4-mini, são poderosos mas taxa de alucinação dispara: Os mais recentes modelos de inferência lançados pela OpenAI, o3 e o4-mini, apresentam um desempenho excelente em tarefas complexas como codificação, matemática, ciência e perceção visual. Por exemplo, o o3 atingiu o nível dos Top 200 jogadores humanos na competição de programação Codeforces. No entanto, relatórios técnicos e testes de terceiros indicam que a “taxa de alucinação” destes dois modelos é significativamente superior à dos modelos anteriores o1 e GPT-4o, atingindo 33% para o o3 e uns impressionantes 48% para o o4-mini. Cientistas da AI2 como Nathan Lambert e o ex-investigador da OpenAI Neil Chowdhury acreditam que isto pode dever-se à otimização excessiva do método de treino baseado em resultados de aprendizagem por reforço (Outcome-based RL). Embora este método de treino melhore o desempenho em tarefas específicas, também pode levar o modelo a “adivinhar” em vez de admitir limitações quando não consegue resolver um problema, e pode fabricar cenários de utilização de ferramentas devido à generalização das recompensas pelo uso de ferramentas durante o treino. Além disso, a “cadeia de pensamento” (CoT) utilizada pelo modelo na inferência não é visível para o utilizador e é descartada em diálogos subsequentes, o que pode levar o modelo a inventar explicações quando questionado, devido à falta de informação. Esta contradição entre desempenho e fiabilidade desencadeou um amplo debate sobre os efeitos secundários da aprendizagem por reforço e a utilidade prática dos modelos. (Fonte: OpenAI爆出硬伤,强化学习是祸首,o3越强越「疯」,幻觉率狂飙、o3被曝「无视」前成果?华人博士生实名指控,谢赛宁等大牛激烈争辩、OpenAI最强AI模型竟成“大忽悠”,o3/o4-mini被曝聪明过头、结果幻觉频发?、选AI比选对象还难,起名黑洞OpenAI的新模型,到底怎么选?)

Pequim organiza a primeira meia maratona mundial de robôs humanoides, “equipa de Pequim” destaca-se: Em 19 de abril de 2025, Yizhuang, Pequim, organizou com sucesso a primeira meia maratona mundial de robôs humanoides, com 20 equipas a competir numa pista complexa de 21,0975 km. O “TianGong Ultra” do Centro de Inovação de Robôs Humanoides de Pequim venceu com um tempo de 2 horas, 40 minutos e 42 segundos, demonstrando a sua velocidade máxima de 12 km/h e a avançada plataforma de inteligência incorporada geral “HuiSiKaiWu”. O “XiaoWanTong” e o “XuanFengXiaoZi” da Beijing Future Science City Songyan Dynamics ficaram em segundo e quarto lugar, respetivamente. O “XiaoWanTong” destacou-se pela sua estabilidade e capacidade de realizar movimentos de alta dificuldade. Este evento não foi apenas uma competição de desempenho desportivo de robôs, mas também um teste extremo de tecnologias como IA, engenharia mecânica e algoritmos de controlo, simulando cenários de aplicação reais como inspeção e logística. Pequim já estabeleceu uma vantagem de liderança no campo dos robôs humanoides através de um ecossistema “política-capital-indústria-aplicação” (como o “Plano de Ação para o Desenvolvimento Inovador da Indústria de Robôs de Pequim”, o fundo industrial de robôs de dez mil milhões, a zona de aglomeração industrial de Yizhuang, a promoção de aplicações do “Projeto Duplo Cem”), e está a incubar mais líderes da indústria. (Fonte: 人形机器人马拉松:北京何以孕育“领跑者”?、具身智能资本盛宴:3个月37笔融资,北上深争锋BAT下场,人形机器人最火、Robots Take Stride in World’s First Humanoid Half-Marathon in Beijing)

Observação global da governação de direitos de autor em IA: caminhos diversos, desafios persistem: Países de todo o mundo estão a explorar ativamente caminhos para a governação dos direitos de autor em IA. O modelo da UE, centrado na Diretiva sobre Direitos de Autor e na Lei da IA, enfatiza o controlo de riscos e a primazia das regras, exigindo que os fabricantes de IA aumentem a transparência dos dados de treino e respeitem os direitos dos detentores de direitos de autor através de uma “regulação interventiva” por parte das agências administrativas. O modelo dos EUA adota uma abordagem paralela administrativa (decisões do Copyright Office), judicial (litígios) e legislativa (audiências no Congresso), “seguindo a corrente” impulsionada pela prática industrial, mas devido a conflitos de interesses agudos, a nível legislativo tende a “esperar para ver”. O modelo japonês foca-se na orientação para a aplicação, emitindo uma série de pareceres administrativos através da Agência para os Assuntos Culturais, detalhando a aplicação da regra de “utilização não apreciativa” da atual Lei de Direitos de Autor em cenários de IA, clarificando as expectativas de comportamento das partes e incentivando a aplicação de AIGC na indústria de conteúdos. Os principais pontos de controvérsia incluem a isenção de direitos de autor para o treino de modelos (com tendência a focar-se nas “exceções à exceção”), a possibilidade de proteção por direitos de autor do conteúdo AIGC (geralmente considerado que requer contribuição criativa humana, e que os sistemas existentes podem lidar com isso) e a atribuição de responsabilidade por conteúdo infrator (utilizador diretamente responsável, plataforma indiretamente responsável, mas os limites do dever de cuidado ainda precisam de ser clarificados). A China já emitiu as “Medidas Provisórias para AIGC” e tem jurisprudência a explorar a questão. No futuro, será necessário considerar cuidadosamente questões como a isenção para treino de modelos, a proteção de obras AIGC e a responsabilidade das plataformas. (Fonte: AI版权全球治理观察、面对AI企业的白嫖,美国媒体选择了“告老师”)

🎯 Movimentos

IA remodela processos de recrutamento, candidatos precisam de se adaptar às novas regras: A IA e a automação estão a mudar profundamente o panorama do recrutamento, com 83% das empresas americanas a usar IA para filtrar currículos. Os candidatos precisam de ajustar as suas estratégias: 1. Destacar competências resistentes à IA: Enfatizar capacidades difíceis de substituir pela IA, como construção de redes de contactos, tomada de decisão, serviços personalizados, e adaptar-se a áreas emergentes. 2. Compreender a triagem por IA: O currículo deve incluir palavras-chave essenciais da descrição da função (como planeamento estratégico, eficiência operacional), caso contrário pode ser filtrado por sistemas ATS. 3. Usar IA com cautela: Evitar depender totalmente da IA para escrever currículos e cartas de apresentação, pois o conteúdo gerado por IA é facilmente identificável e pode carecer de personalidade; deve ser usada como ferramenta auxiliar para otimização e correspondência de palavras-chave. 4. Preparar-se para entrevistas com IA: Familiarizar-se com ferramentas de entrevista de IA como HireVue, praticar respostas a perguntas básicas comuns, prestando atenção à concisão (recomendado menos de 2 minutos) e ao uso de palavras-chave. 5. Informar-se proativamente sobre a aplicação de IA na empresa: Perguntar sobre os progressos da empresa em IA e os planos de requalificação de competências dos funcionários, para avaliar as perspetivas de desenvolvimento a longo prazo. Adaptar-se aos processos de recrutamento impulsionados pela IA e demonstrar capacidade profissional e vontade de aprendizagem contínua são cruciais. (Fonte: 打动面试官之前,先打动AI)

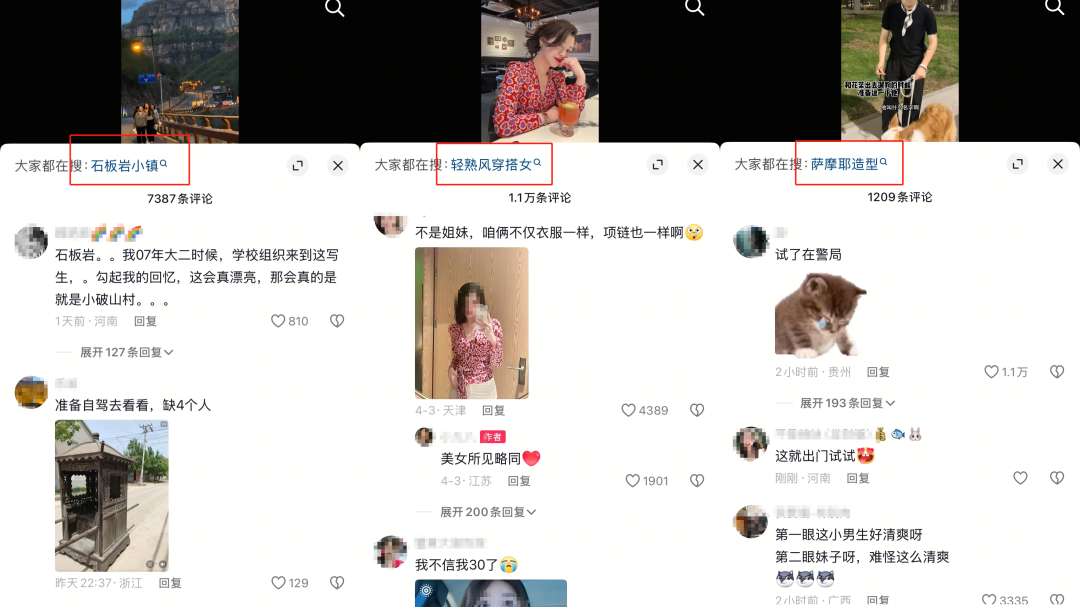

Plataformas sociais redefinem hábitos de pesquisa, definindo nova revolução na busca: Plataformas sociais como Douyin, Xiaohongshu e WeChat estão a remodelar os hábitos de pesquisa dos utilizadores com as suas características distintas, desafiando os motores de busca tradicionais. O Douyin utiliza vídeos curtos e recomendações algorítmicas para integrar a pesquisa no fluxo de consumo de conteúdo, despertando o interesse do utilizador e direcionando-o para o consumo. O Xiaohongshu, com a sua vasta quantidade de partilhas “reais” e conteúdo de “plantar a semente” (influência), tornou-se uma referência importante para as decisões de vida dos jovens, com o seu comportamento de pesquisa profundamente ligado às decisões de consumo. O WeChat, baseado em redes sociais de conhecidos e no seu ecossistema de conteúdo (Contas Oficiais, Canais), oferece resultados de pesquisa que combinam relações pessoais e conteúdo da plataforma, gozando de alta confiança. A expansão das funções de pesquisa nestas plataformas não visa apenas conquistar a mente dos utilizadores, mas é também um importante posicionamento comercial, formando respetivamente modelos de “e-commerce de interesse”, “economia de influência” e “e-commerce social” baseado na confiança. A adição da IA (como Wenxin Yiyan, DeepSeek e assistentes de IA integrados nas plataformas) está a mudar ainda mais o panorama da pesquisa, oferecendo respostas mais personalizadas e sem publicidade, mas a curto prazo dificilmente substituirá completamente o valor da pesquisa nas plataformas de conteúdo. No futuro, a capacidade da IA será o fator decisivo na batalha pela pesquisa entre as plataformas. (Fonte: 2025搜索之战:抖音、小红书、微信,如何定义搜索新革命?)

Teste de Turing, embora controverso, ainda tem significado na era atual: O Teste de Turing, como padrão inicial para medir se a IA possui inteligência semelhante à humana (passa se um humano não consegue distinguir se está a conversar com um humano ou uma IA), ainda é mencionado hoje, como o GPT-4 que recentemente passou no teste com uma taxa de sucesso de 54%, e há até estudos que afirmam que a probabilidade de o GPT-4.5 ser identificado como humano é maior do que a de um humano real. No entanto, o teste tem sido alvo de controvérsia desde a sua criação. Os críticos argumentam que se foca apenas no desempenho e não no processo de pensamento (como a experiência mental do “Quarto Chinês”), e é facilmente “enganado” (como as respostas simples do ELIZA, ou programas que se fazem passar por crianças com dificuldades linguísticas). Os seus critérios de teste (como 5 minutos de conversa, 70% de taxa de identificação) parecem desatualizados face ao rápido desenvolvimento atual da IA. Embora os grandes modelos modernos possam imitar a conversa humana, essencialmente não compreendem o conteúdo, faltando-lhes pensamento e emoção genuínos. Além disso, os resultados do teste são influenciados pela experiência do testador. Apesar das suas muitas falhas, o Teste de Turing forneceu uma abordagem mensurável e operacional nos primórdios do desenvolvimento da IA. Hoje, as capacidades da IA já ultrapassam largamente o âmbito do teste (como escrever artigos, programar), e focar-se excessivamente neste teste pode já ter perdido o sentido. A intenção original de Turing talvez não fosse estabelecer um padrão final, mas sim estimular a exploração da inteligência das máquinas e o progresso infinito da humanidade. (Fonte: 被喷了这么多年,图灵测试这老东西居然还没凉?)

Ascensão dos animais de estimação de IA satisfaz diversas necessidades de companhia, gerando nova indústria: A combinação da tecnologia de IA com animais de estimação eletrónicos está a dar origem a animais de estimação de IA cada vez mais “inteligentes” e populares, como o coelho Moflin da Vanguard Industries do Japão, e os Ropet, Mirumi, Jennie apresentados na CES. Estes animais de estimação de IA não só possuem as funções de companhia dos brinquedos eletrónicos tradicionais, mas também podem conversar e interagir através de grandes modelos de linguagem, aprender os hábitos do utilizador e até lembrar-se de eventos, oferecendo um valor emocional mais profundo. A popularidade dos animais de estimação de IA deriva da sua capacidade de satisfazer as necessidades de diversos grupos: fornecem companheiros novos e interessantes para crianças e jovens; oferecem uma alternativa para pessoas alérgicas a animais; proporcionam companhia interativa para pessoas com necessidades de saúde mental, como autismo e depressão; oferecem consolo emocional para idosos que vivem sozinhos ou com demência. Comparados com animais reais, os animais de estimação de IA são mais fáceis de cuidar (não precisam de ser alimentados, limpos ou de cuidados médicos). A Technavio prevê que o mercado de animais de estimação de IA cresça a uma taxa composta anual de 11,28%, podendo atingir 6 mil milhões de dólares em 2030. Empresas nacionais e internacionais (como a Yukai Engineering do Japão, a TangibleFuture dos EUA, a TCL e a KEYi Tech da China) estão a entrar no mercado. No entanto, a segurança da privacidade dos dados e o vício excessivo dos utilizadores são desafios que esta indústria enfrenta. (Fonte: AI宠物热潮快要来了)

Escolha de algoritmos na colaboração homem-máquina: equilibrar precisão, explicabilidade e viés: Os algoritmos de IA desempenham um papel crucial na colaboração homem-máquina, auxiliando a tomada de decisão humana através do processamento de dados e identificação de padrões. No entanto, os algoritmos têm duas faces: modelos de alta precisão (como deep learning) muitas vezes carecem de explicabilidade, afetando a confiança do utilizador; modelos simples são fáceis de entender, mas têm menor precisão. Métodos para resolver este dilema incluem: 1. IA Explicável (XAI): Usar técnicas como SHAP, LIME para quantificar a contribuição das características, aumentando a transparência. Estudos mostram que fornecer informações explicativas melhora significativamente o efeito da colaboração homem-máquina em tarefas complexas. 2. Humano no Ciclo (HITL): Colocar humanos no processo de decisão, combinando sugestões de algoritmos com a experiência humana e o julgamento contextual (como na deteção de fraude financeira, ajustes na gestão da cadeia de abastecimento). “Algoritmos de otimização centrados no ser humano” (como o caso de otimização de embalagens do Alibaba) preveem e adaptam-se aos vieses do comportamento humano, aumentando a eficiência. 3. Orientação Híbrida: Combinar a análise de dados de um coach de IA com as competências de comunicação de um gestor humano para resolver problemas de diferentes grupos (como na formação de vendas). Ao mesmo tempo, é necessário estar alerta e mitigar o viés algorítmico (como injustiças no recrutamento, crédito), através do balanceamento de dados, restrições de equidade, supervisão humana, etc. A maturidade da IA generativa está a impulsionar a relação homem-máquina da colaboração (collaboration) para o trabalho em equipa (teaming), trazendo novos desafios como atribuição de papéis, construção de confiança, coordenação cognitiva, exigindo a construção de quadros de governação transparentes e atenção a objetivos de valor como a equidade. (Fonte: 人机协同中的算法抉择)

Plataformas de internet apresentam situação contraditória de “incentivo e restrição” ao conteúdo AIGC: Grandes plataformas de internet (como Xiaohongshu, Canais do WeChat, Douyin) reforçaram recentemente as restrições ao conteúdo gerado por IA (AIGC), causando confusão entre os criadores. As medidas restritivas incluem remoção, bloqueio, limitação de tráfego e privação de direitos comerciais, com justificações que frequentemente envolvem “disseminação de superstições feudais”, “infração de direitos”, “eventos fictícios”, “falsificação de identidade”, etc. Apesar de as plataformas investirem fortemente no desenvolvimento de ferramentas de criação de IA (como “Dian Dian” do Xiaohongshu, “Ji Meng” da ByteDance) para atrair criadores, a moderação do conteúdo AIGC está a tornar-se mais rigorosa, mesmo quando o conteúdo é marcado com uma marca d’água de IA. O foco da moderação das plataformas está em combater conteúdo homogéneo e de baixa originalidade (como cópias em massa de sucessos virais) e em manter a autenticidade da comunidade (como a “partilha real” do Xiaohongshu). No entanto, a “realidade” e o AIGC são inerentemente contraditórios, levando as obras de IA a enfrentar padrões de moderação mais severos. Este estado contraditório de “querer as duas coisas”, juntamente com limites de regras pouco claros, deixa os criadores sem saber como agir. Ao mesmo tempo, a resistência dos criadores tradicionais ao AIGC e a possibilidade de os dados gerados por IA contaminarem os modelos (distúrbio de autofagia do modelo) também agravam a dificuldade de governação das plataformas. A ação das plataformas pode ter como objetivo controlar o conteúdo de IA de baixa qualidade que prolifera, em vez de o proibir completamente. No futuro, os criadores poderão precisar de explorar estratégias que combinem mais elementos de originalidade humana com a assistência da IA, como a “regra 532”, e avançar na incerteza. (Fonte: 互联网平台现状:鼓励AI,限制AI)

🧰 Ferramentas

Grelhador inteligente ASMOKE: Empreendedor ex-DJI cria nova experiência de churrasco ao ar livre: A ASMOKE, fundada por Vince, um ex-funcionário da DJI, aborda os pontos problemáticos do churrasco tradicional ao ar livre (dificuldade no controlo da temperatura, operação complexa) com o lançamento do seu primeiro grelhador inteligente a pellets de madeira de fruta, o ASMOKE Essential. Este produto utiliza o sistema de controlo de temperatura Flame Tech desenvolvido internamente (com dois sensores e algoritmos integrados) para alcançar um controlo preciso da temperatura (pequena flutuação, cozinhado até 8 horas) e oferece 8 modos de cozinhado predefinidos e uma biblioteca de receitas profissionais, reduzindo a barreira de entrada para iniciantes. Possui também um sistema automático de remoção de cinzas para facilitar a limpeza. O produto destina-se principalmente a homens de meia-idade (30-55 anos) que valorizam a qualidade e a experiência inteligente. A ASMOKE entrou no mercado tradicional de grelhadores através da inteligência, criando diferenciação. Já está presente nos principais canais offline da América do Norte, como Home Depot e Lowe’s, e vende online (website próprio, Amazon). O seu ecossistema de produtos inclui também pellets de madeira de fruta, mesas de churrasco e outros acessórios, e desenhou soluções compatíveis para cenários como campismo. Atualmente, as receitas da América do Norte representam mais de 50%, e a empresa está a explorar ativamente o mercado europeu, mas enfrenta desafios como a dispersão de canais e a localização. A ASMOKE concluiu duas rondas de financiamento (incluindo investimento do Professor Benjamin Kao), com vendas previstas para ultrapassar os 10 milhões de dólares em 2025. (Fonte: 拿下高秉强融资,大疆系创业者做出蓝海爆品、众筹过百万美元|产品观察)

Agente inteligente Metamon para batalhas Pokémon, impulsionado por IA, apresenta desempenho notável: Uma equipa da Universidade do Texas em Austin desenvolveu um agente de IA chamado Metamon, treinado através da análise de 475.000 replays de batalhas humanas acumulados ao longo de quase dez anos na plataforma Pokémon Showdown. Este agente utiliza a arquitetura Transformer e aprendizagem por reforço offline (Offline RL), não dependendo de regras predefinidas ou heurísticas, aprendendo estratégias puramente a partir de dados de batalhas humanas. A equipa de investigação converteu os dados de replay de batalhas de uma perspetiva de terceira pessoa para uma perspetiva de primeira pessoa para o treino. Através da arquitetura Actor-Critic e atualizações de diferença temporal (TD), o modelo foi treinado para tomar decisões num ambiente complexo de informação incompleta e jogo estratégico (as batalhas Pokémon são comparadas a um jogo que funde a estratégia do xadrez, a incerteza do póquer e a complexidade do StarCraft). O modelo treinado competiu contra jogadores globais no servidor de ranking do Pokémon Showdown, conseguindo entrar no top 10% dos jogadores ativos globais, demonstrando o potencial da IA orientada por dados em jogos de estratégia complexos. Direções futuras de investigação incluem a exploração de diferentes estratégias de treino e auto-jogo (self-play) em larga escala, na esperança de superar o desempenho humano. (Fonte: AI版本宝可梦冲榜上全球前10%,一次性「吃掉」10年47.5万场人类对战数据)

Robôs de apoio ao cliente de IA geram controvérsia, Cursor pede desculpas por informação enganosa da IA: O apoio ao cliente por IA, ao mesmo tempo que oferece conveniência, também levanta problemas devido à sua capacidade de “dizer disparates com ar sério”. Recentemente, utilizadores do editor de código de IA Cursor descobriram que não conseguiam fazer login em múltiplos dispositivos simultaneamente. Após contactarem o apoio ao cliente por email, receberam uma resposta do robô de IA afirmando que “a subscrição foi desenhada para uso num único dispositivo, múltiplos dispositivos requerem subscrições separadas”, o que gerou insatisfação e cancelamentos em massa. O programador e o CEO da Cursor esclareceram posteriormente que se tratava de uma resposta errada do robô de IA, sendo na verdade um bug nas medidas antifraude que causava o logout anormal das sessões, e prometeram corrigir o problema e reembolsar os utilizadores. Este incidente realça o risco de informação enganosa que os robôs de apoio ao cliente de IA podem causar. Já existiram casos anteriores, como o robô de IA da Air Canada que forneceu informações erradas sobre a política de reembolso, levando a empresa a perder o processo e a pagar indemnizações; ou o robô de IA de um concessionário automóvel que, sob “provocação” do utilizador, fez uma promessa legalmente vinculativa de “vender um carro por 1 dólar”. Estes eventos alertam as empresas: ao usar robôs de apoio ao cliente de IA, é necessário identificar claramente a sua identidade para evitar mal-entendidos por parte dos utilizadores; se as respostas da IA não forem revistas e representarem a empresa, podem surgir riscos legais; devem ser estabelecidos mecanismos robustos de monitorização e intervenção humana, em vez de depender totalmente da IA, especialmente ao lidar com interpretação de políticas, promessas contratuais e outros assuntos sérios. (Fonte: 被自家AI坑惨,一句误导引发程序员退订潮,Cursor CEO亲自道歉)

SocioVerse: Sistema de simulação social baseado em dados de milhões de utilizadores reais gera preocupação: O sistema SocioVerse, desenvolvido conjuntamente pela Universidade Fudan e outras instituições, constrói uma sociedade gémea digital de alta fidelidade através da integração de dados de 10 milhões de utilizadores reais (do Twitter/X, Xiaohongshu) e tecnologias avançadas de IA (GPT-4o, Claude 3.5, Gemini 1.5). O sistema inclui quatro motores: Motor de Utilizador (constrói Agentes virtuais com base em múltiplas dimensões como demografia, psicologia, comportamento, valores), Motor de Ambiente Social (captura notícias, políticas, dados económicos em tempo real para construir um contexto dinâmico), Motor de Cenário (simula regras de comportamento e mecanismos de feedback em diferentes situações), Motor de Comportamento (combina ABM e LLM para simular o comportamento individual e a interação na disseminação de informação). O SocioVerse visa simular e prever fenómenos sociais em larga escala, tendo já demonstrado uma precisão surpreendente em experiências como previsão de eleições presidenciais, análise de reação a notícias de última hora e simulação de inquéritos económicos nacionais. Diferente de ambientes virtuais fechados como a “Cidade de Stanford”, o SocioVerse modela diretamente com base em dados humanos reais, o que levanta preocupações sobre as suas capacidades potenciais: esta tecnologia poderia ser usada para prever ou até manipular o comportamento de grupos, transformando as plataformas sociais em “pastores digitais”, alcançando um controlo silencioso através de uma subtil modulação da informação, com um impacto profundo na sociedade. (Fonte: 世界上最强大的“政客”和“民意操纵者”,正在人工智能实验中诞生)

📚 Aprendizagem

Ex-executivo da Meituan, Bao Ta, fala sobre a transformação de talentos na era da IA: de “resolver problemas” para “colocar problemas”: Bao Ta, ex-vice-presidente da Meituan e atual fundador da Qidian Lingzhi, acredita que os grandes modelos são a maior oportunidade tecnológica da humanidade até hoje. Ele partilhou a sua experiência desde um grupo de interesse em computação pouco popular na Escola Secundária Nº 7 de Chengdu até ao empreendedorismo tecnológico, enfatizando a importância da motivação pelo interesse. Falando sobre o impacto da IA na educação, ele acredita que a IA pode atuar como um tutor personalizado, mas também traz desafios (como a escrita assistida por IA). O foco da educação deve mudar da “transmissão de conhecimento” para o “desenvolvimento de capacidades”, especialmente a capacidade de colocar questões, pensamento crítico e resolução criativa de problemas. A popularização da IA torna-a uma competência básica, e as escolas primárias e secundárias devem ensinar como colaborar com a IA. A procura futura de talentos mudará do “tipo T” (profundidade profissional + amplitude interdisciplinar) para o “tipo π” (profundidade em duas áreas + inovação cruzada), sendo crucial cultivar a curiosidade e o desejo de explorar. Ele aconselha os estudantes que querem entrar na área da IA: 1. Cultivar o interesse para lidar com a rápida iteração; 2. Praticar muito (desenvolver pequenos projetos); 3. Dominar os conhecimentos básicos para compreender os princípios e prever tendências. Ele prevê que a capacidade de programação da IA poderá eliminar programadores de nível baixo e médio em 3-5 anos, destacando a importância da transformação de competências. (Fonte: 美团前高管转战AI:3-5年AI或淘汰中低端码农)

Avaliação da capacidade visual do GPT-4o: Geração forte, raciocínio fraco: Um estudo recente da UCLA revelou as limitações do GPT-4o na compreensão e raciocínio de imagens através de três conjuntos de experiências. Experiência 1 (Seguimento de regras globais): O GPT-4o não conseguiu seguir regras globais predefinidas (como “esquerda é direita”, “subtrair 2 aos números”) para gerar imagens, executando ainda as instruções literalmente, indicando falta de compreensão contextual e flexibilidade. Experiência 2 (Edição de imagem): Quando solicitado a fazer modificações locais precisas (como “alterar apenas o reflexo”, “eliminar apenas a pessoa sentada”), o GPT-4o cometeu frequentemente erros de operação, incapaz de distinguir com precisão as limitações semânticas, expondo a sua compreensão insuficientemente detalhada do conteúdo e estrutura da imagem. Experiência 3 (Raciocínio multi-passo e lógica condicional): Confrontado com instruções complexas contendo julgamentos condicionais e múltiplos passos (como “se não houver gato, trocar por um cão na praia”), o GPT-4o mostrou-se confuso, incapaz de julgar corretamente as condições e seguir a cadeia lógica, muitas vezes executando todas as instruções sobrepostas. Conclusão do estudo: Embora o GPT-4o possua fortes capacidades de geração de imagens, ainda tem deficiências significativas em tarefas visuais complexas que exigem compreensão profunda, consciência contextual, raciocínio lógico e controlo preciso, assemelhando-se mais a uma “máquina de instruções refinada” do que a um agente inteligente que realmente compreende o mundo. (Fonte: 生成很强,推理很弱:GPT-4o的视觉短板)

Guia de seleção dos novos modelos da OpenAI: o3, o4-mini, GPT-4.1 têm pontos fortes distintos: A OpenAI lançou recentemente vários novos modelos, a escolha depende das necessidades: 1. o3: Modelo de inferência principal, o mais inteligente, projetado para tarefas complexas (codificação, matemática, ciência, perceção visual). Possui forte capacidade autónoma de chamada de ferramentas (até 600 vezes/resposta, suporta pesquisa, Python, geração/interpretação de imagens) e capacidade de raciocínio visual dinâmico (integra imagens no ciclo de raciocínio, pode rever operações repetidamente). Beneficia da aprendizagem por reforço expandida, sendo bom em planeamento a longo prazo e raciocínio sequencial. Eficiência de custo melhor do que o esperado. 2. o4-mini: Modelo de inferência de alto custo-benefício, rápido, baixo custo (cerca de 1/10 do o3), oferece contexto de 200.000 tokens. Capacidade de ferramentas comparável ao o3 (Python, navegação, processamento de imagem). Adequado para tarefas sensíveis ao custo ou que exigem alto débito. Existem dois modos: o4-mini (foco na velocidade) e o4-mini-high (foco na precisão, maior poder de computação). 3. Série GPT-4.1 (exclusivo API): GPT-4.1: Modelo principal, segue instruções com precisão, forte memória de contexto longo (1 milhão de tokens), adequado para tarefas de desenvolvimento complexas que exigem execução rigorosa de instruções e processamento de documentos longos. GPT-4.1 mini: Escolha intermédia, baixa latência/custo, desempenho próximo da versão completa 4.1, seguimento de instruções e raciocínio de imagem superiores ao GPT-4o. GPT-4.1 nano: O menor, mais rápido e mais barato ($0.1/M tokens), adequado para tarefas simples como autocompletar, classificação, extração de informação. Todos os três suportam contexto de 1 milhão de tokens. (Fonte: 选AI比选对象还难,起名黑洞OpenAI的新模型,到底怎么选?)

💼 Negócios

Hanwei Technology aposta no negócio de sensores para robôs humanoides para se destacar: A Hanwei Technology, líder em sensores de gás (valor de mercado de 10 mil milhões), está a posicionar-se ativamente na área dos robôs humanoides, procurando um ponto de rutura nos seus resultados. O fundador da empresa, Ren Hongjun, está empenhado em construir uma “empresa centenária”. A Hanwei Technology tem uma vasta experiência na área de sensores, com uma quota de mercado de 75% em sensores de gás na China. Nos últimos anos, o lucro líquido deduzido de itens não recorrentes da empresa diminuiu por três anos consecutivos (queda de 51,38%, 34,34%, 89,97% em 2022-2024, respetivamente). Em 2024, a receita diminuiu ligeiramente 2,61% para 2,228 mil milhões de yuan, com o lucro líquido deduzido a ser de apenas 5,633 milhões de yuan. A pressão sobre os resultados deve-se ao aumento da concorrência no mercado, ao aumento do investimento em I&D e aos novos negócios (linha de produção MEMS, encapsulamento de laser, medidores ultrassónicos) que ainda não são lucrativos. Os robôs humanoides são vistos como um novo ponto de crescimento. Os seus sensores (táteis flexíveis, unidades de medição inercial, extensómetros de pressão, nariz eletrónico, etc.) já formam uma matriz de produtos multidimensional, e a pele eletrónica flexível já está em colaboração com vários fabricantes de robôs e em fornecimento de pequenos lotes. O negócio de sensores gerou 341 milhões de yuan em receitas em 2024, representando 15,3% da receita total. Embora a participação atual do negócio de robótica seja baixa, a empresa listou-o como um trabalho prioritário para 2025, com o objetivo de aproveitar a oportunidade da indústria de inteligência incorporada. Ao mesmo tempo, a empresa também está a expandir aplicações nas áreas de novas energias, automóvel, semicondutores e médica. (Fonte: 扣非净利连降3年,百亿科技龙头靠人形机器人突围?)

Zhitong Technology investe 300 milhões na construção de base de I&D e produção de redutores de alta precisão: A Zhitong Technology, fornecedora de componentes essenciais para robôs, anunciou o início do projeto da sua base de I&D e sede de produção de redutores de alta precisão, com um investimento total de cerca de 300 milhões de yuan, localizada na Zona de Desenvolvimento Económico de Pequim, com produção prevista para 2027. Esta base integrará funções de I&D, testes de engenharia, vendas e gestão da sede, e construirá linhas de produção inteligentes para redutores de alta precisão para robôs industriais e humanoides. Os redutores são componentes cruciais dos robôs, afetando a precisão do movimento e a capacidade de carga. A Zhitong Technology, fundada em 2015, tornou-se uma empresa líder no campo de redutores de precisão na China, superando os desafios técnicos dos redutores RV em colaboração com a Universidade de Tecnologia de Pequim e alcançando a substituição de produtos importados. A empresa atua em várias tecnologias de transmissão, como cicloidal, harmónica, planetária, hipóide e fuso de rolos, com clientes que incluem empresas de robótica de primeira linha nacionais e internacionais como Estun, Inovance, KUKA e ABB. Atualmente, a capacidade de produção anual de redutores CRV é de 200.000 unidades, operando em plena capacidade, com um crescimento composto anual de vendas e produção de 247% nos últimos três anos. A construção da nova base visa aumentar a capacidade de I&D e produção, fornecendo soluções completas de sistemas de transmissão para robôs. (Fonte: 耗资3亿,「智同科技」组建高精密减速机研发及总部生产基地、2027年将投产|最前线)

Financiamento no campo da inteligência incorporada em alta, mais de 3,5 mil milhões financiados na China no 1º trimestre de 2025: No primeiro trimestre de 2025, a atividade de financiamento no setor da inteligência incorporada (especialmente robôs humanoides) na China aumentou acentuadamente, com 37 rondas de financiamento envolvendo 33 empresas, totalizando cerca de 3,5 mil milhões de yuan. O número de eventos de financiamento já atingiu quase 70% do total do ano passado. Destas, 11 empresas arrecadaram mais de 100 milhões de yuan, com as empresas de desenvolvimento de robôs humanoides a liderar em termos de montante financiado, como a TARS (120 milhões de dólares na ronda anjo, um recorde), Qianxun Intelligence (528 milhões), Xinghaitu (300 milhões) e Zhongqing Robot (200 milhões). Geograficamente, as empresas concentram-se em Pequim (8), Xangai (10) e Shenzhen (7). Empresas recém-criadas (2023, 2024) e rondas de financiamento iniciais (anjo, pré-A) foram a maioria. Os investidores incluem gigantes da tecnologia como Tencent, Baidu, Alibaba, Lenovo, iFlytek, bem como capital estatal de Pequim, Xangai e outras regiões. Além disso, o investimento mútuo entre empresas de robótica também se tornou uma tendência (como a Yuejiang a investir na Zhongke Wuji, a Zhiyong Robot a investir na Hillbot). Apesar do entusiasmo do capital, o caminho para a comercialização continua a ser o principal desafio e ponto de controvérsia neste campo. (Fonte: 具身智能资本盛宴:3个月37笔融资,北上深争锋BAT下场,人形机器人最火)

36Kr organiza a Conferência AI Partner 2025, focada em super aplicações: Em 18 de abril, a 36Kr realizou a Conferência AI Partner 2025 no Shanghai Model Space, sob o tema “A Super App Chegou”, para discutir as tendências e perspetivas das super aplicações na era da IA. A conferência reuniu líderes académicos e da indústria como Liu Zhiyi (Universidade Jiao Tong de Xangai), Ji Zhaohui (AMD), Ruan Yu (Baidu), Wan Weixing (Qualcomm), Chen Jufeng (Xianyu), Zhou Miao (Dahua Technology). O CEO da 36Kr, Feng Dagang, salientou que a atenção disruptiva gerada pela IA é o melhor momento para construir marcas. Os oradores convidados partilharam aplicações e práticas de IA em inteligência incorporada, motores de computação, transformação industrial (como marketing, transportes), experiência de terminal, comércio de bens usados, segurança, etc. A conferência anunciou os “Casos Inovadores de Aplicações Nativas de IA 2025” e os “Prémios de Inovação AI Partner 2025”, mostrando os resultados da implementação da IA em cenários como fabrico inteligente, apoio ao cliente, criação de conteúdo, gestão empresarial e saúde. As mesas redondas de investidores e os diálogos de parceiros aprofundaram a lógica de investimento em aplicações de IA, os desafios de comercialização e as direções futuras de desenvolvimento, enfatizando a importância da orientação por cenários, valor para o utilizador, inovação tecnológica e sinergia do ecossistema. (Fonte: 下一个AI超级应用在哪?看36氪2025AI Partner大会解码未来趋势)

🌟 Comunidade

LeCun expressa ceticismo sobre a rota dos LLMs, gerando debate na indústria: Yann LeCun, Cientista Chefe de IA da Meta, expressou publicamente várias vezes o seu ceticismo em relação à rota dominante atual dos grandes modelos de linguagem (LLM), argumentando que a previsão autorregressiva enfrenta problemas fundamentais (divergência, acumulação de erros), não pode levar à IA de nível humano, e até prevendo que dentro de alguns anos ninguém os usará mais. Ele acredita que os LLMs não conseguem compreender bem o mundo físico, carecendo de senso comum, capacidade de raciocínio e planeamento. Ele defende que o foco da investigação deve mudar para IA que possa compreender o mundo físico, ter memória persistente e capacidade de raciocinar e planear, promovendo a sua proposta JEPA (Joint Embedding Predictive Architecture) como alternativa. As opiniões de LeCun geraram controvérsia, com alguns a criticar o seu “dogmatismo” que poderia deixar a Meta para trás na corrida da IA, e atribuindo o desempenho inferior do Llama 4 a isso. Mas também há apoiantes que elogiam a sua adesão a princípios e à filosofia open-source, considerando que explorar caminhos além dos LLMs (como sistemas visuais baseados em auto-supervisão e não geradores) é benéfico para o desenvolvimento a longo prazo da IA. A equipa de LeCun enfrentou controvérsia pública após lançar o LLM de literatura científica Galactica, o que talvez também tenha influenciado a sua atitude em relação ao atual entusiasmo pela IA. (Fonte: LeCun被痛批:你把Meta搞砸了,烧掉千亿算力,自曝折腾20年彻底失败)

Startup de Silicon Valley, Mechanize, quer automatizar todo o trabalho, gerando controvérsia ética: A Mechanize, uma nova empresa fundada pelo cofundador da Epoch AI, Tamay Besiroglu, propôs os objetivos ambiciosos de “automatização completa de todo o trabalho” e “economia totalmente automatizada”. O objetivo é, através da construção de ambientes virtuais que simulam cenários de trabalho reais e sistemas de avaliação, usar a aprendizagem por reforço para treinar agentes de IA para substituir o trabalho humano, visando o mercado global de trabalho de 60 biliões de dólares (focando inicialmente em trabalhos de colarinho branco). O plano já recebeu investimento de figuras proeminentes da IA como Jeff Dean. No entanto, este objetivo gerou enorme controvérsia, sendo criticado como “traidor da humanidade” e “objetivo prejudicial”, argumentando que levará a desemprego em massa e agravará a desigualdade de riqueza. Besiroglu defende que a automatização criará enorme riqueza e um nível de vida mais elevado, e que o bem-estar económico não provém apenas dos salários. Embora a sua visão seja extrema, as deficiências que aponta nos atuais agentes de IA em termos de fiabilidade, processamento de contexto longo, autonomia, planeamento a longo prazo, e o caminho tecnológico para resolver estes problemas através da geração dos dados necessários para a automatização e sistemas de avaliação, tocam em importantes desafios reais do desenvolvimento da IA. (Fonte: 硅谷AI初创要让60亿人失业,网友痛批人类叛徒,Jeff Dean已投)

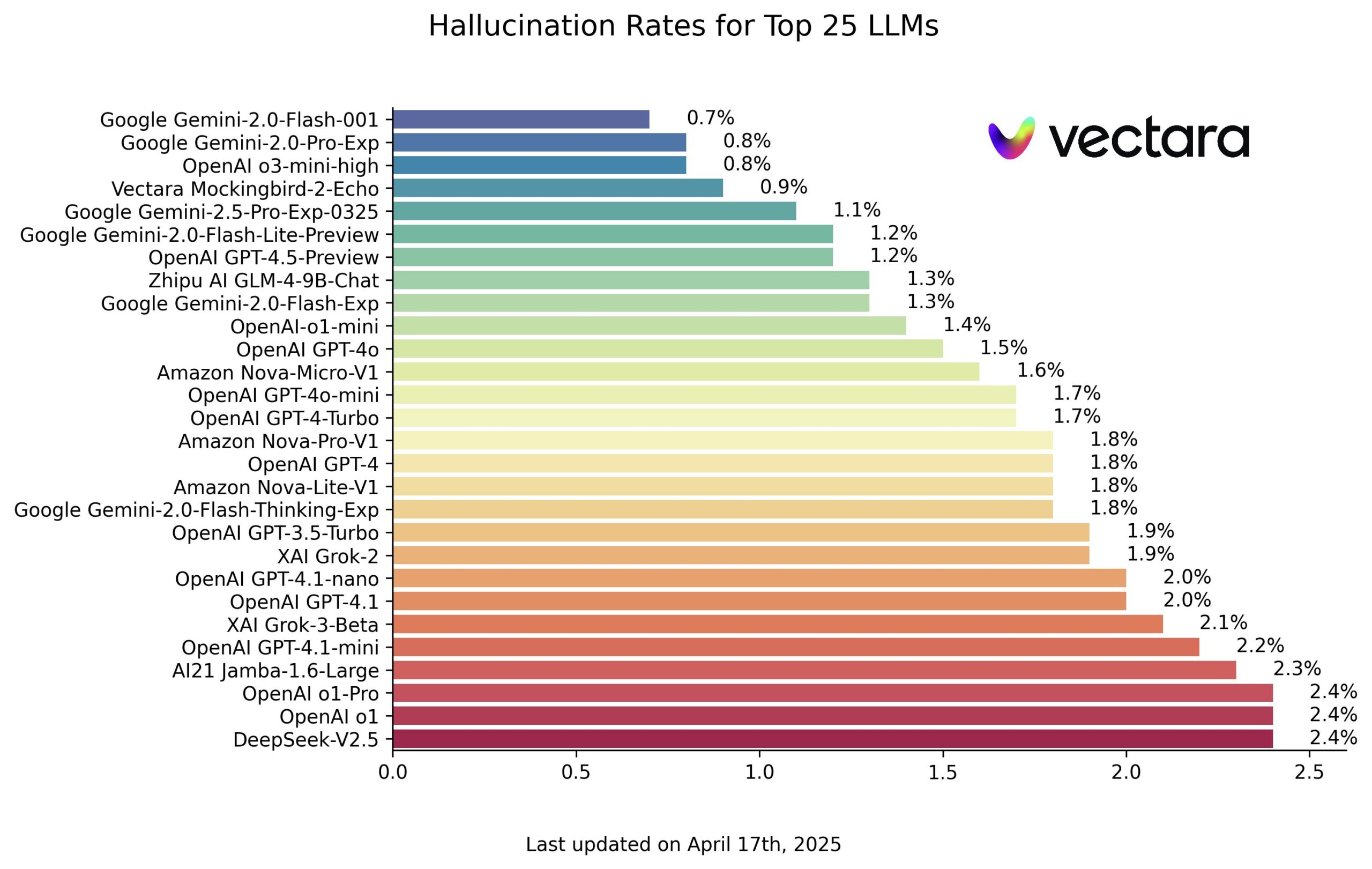

Vectara lança ranking de alucinação de modelos de IA, modelos da Google destacam-se: A Vectara publicou um ranking que avalia o grau de alucinação dos grandes modelos de linguagem (LLM). Este ranking funciona fazendo perguntas aos modelos baseadas no conteúdo de artigos específicos e usando o modelo de avaliação próprio da Vectara para determinar a proporção de alucinações (ou seja, informações inconsistentes com o texto original ou fabricadas) nas respostas. De acordo com a captura de ecrã do ranking, os modelos da Google (possivelmente referindo-se à série Gemini) tiveram um desempenho excelente, com baixas taxas de alucinação. O o3-mini-high da OpenAI também teve um bom desempenho. É de notar que o modelo open-source GLM da chinesa Zhipu AI também obteve uma boa classificação neste ranking, mostrando o seu potencial em termos de precisão factual. O ranking e o modelo de avaliação foram tornados públicos, fornecendo à indústria uma referência para comparar quantitativamente a fiabilidade de diferentes LLMs em tarefas específicas. (Fonte: karminski3)

IA supera em tarefas específicas, mas ainda carece de senso comum e cognição básica: Utilizadores do Reddit discutem que a IA atual (como os LLMs) pode superar a maioria das pessoas em áreas específicas de conhecimento e processamento de informação (comentários referem “mais conhecedora” em vez de “mais inteligente”), mas ainda mostra deficiências no julgamento de senso comum e na compreensão do mundo físico (como contar pedras numa imagem). Alguns comentários consideram a IA simultaneamente “extremamente inteligente” e “extremamente estúpida”, capaz de resolver problemas de alta dificuldade dentro do seu domínio, mas podendo falhar em tarefas simples. A “inteligência” da IA é vista mais como baseada em dados massivos do que em compreensão real. A experiência do utilizador também confirma isto, com o Gemini a mostrar-se “estúpido” em algumas situações, enquanto o GPT se destaca em certos aspetos, mas por vezes as respostas não “compreendem” verdadeiramente a questão. Esta desigualdade de capacidades é uma característica da fase atual de desenvolvimento da IA. (Fonte: Reddit r/ArtificialInteligence)

Dizer “obrigado” à IA gera debate: projeção emocional vs. consumo de recursos: Um utilizador do X perguntou a Sam Altman sobre o custo de dizer “por favor” e “obrigado” à IA. Altman estimou em dezenas de milhões de dólares, mas considerou que valia a pena. Este fenómeno gerou debate: porquê ser educado com uma IA sem emoções? Estudos de psicologia (como a experiência de Reeves & Nass) mostram que os humanos tendem a antropomorfizar objetos que exibem características semelhantes às humanas, ativando a “perceção de presença social”. Ser educado com a IA reflete o caráter e os hábitos do utilizador, e pode também ser uma forma de “projeção emocional” ou necessidade de um “desabafo emocional”. Há quem defenda que a linguagem educada pode até “treinar” a IA para responder melhor (imitando a reação humana à cortesia). No entanto, isto também acarreta riscos: a IA pode aprender e amplificar preconceitos (como o Tay da Microsoft), ou lidar inadequadamente com tópicos sensíveis. Ao mesmo tempo, cada interação (incluindo “obrigado”) consome eletricidade e recursos hídricos, levantando preocupações sobre a sustentabilidade da IA. Ser educado com a IA é tanto uma extensão do instinto social humano como, inadvertidamente, aumenta os custos físicos de operação da IA. (Fonte: 对 ChatGPT 说「谢谢」,可能是你每天做过最奢侈的事、Reddit r/ChatGPT、Reddit r/ChatGPT)

Potencial e desafios da aplicação da IA na educação coexistem: Utilizadores do Reddit discutiram as perspetivas da aplicação da IA na educação. Os apoiantes acreditam que a IA (como o ChatGPT) pode servir como ferramenta de aprendizagem personalizada, ajudando a compreender disciplinas como matemática, e oferecendo um ambiente de resposta a perguntas sem julgamento. A IA tem o potencial de se tornar um assistente do professor, lidando com questões fora do tópico ou fornecendo recuperação rápida de informações, e até mesmo orientando os alunos a encontrar respostas de forma autónoma. Já existem escolas a experimentar aulas de IA “sem professor” (como no Reino Unido, Texas nos EUA), utilizando IA para ensino personalizado, focando nas áreas fracas dos alunos. No entanto, os desafios são também evidentes: a fiabilidade da IA (problema da alucinação) exige que os utilizadores tenham pensamento crítico e capacidade de verificação de factos; a dependência excessiva da IA pode prejudicar o pensamento profundo e o desenvolvimento da capacidade de aprendizagem autónoma; a IA pode ser usada para fazer batota; a IA também pode conter preconceitos ou fornecer informações inadequadas. O papel futuro da IA na educação será provavelmente mais de apoio do que de substituição completa, exigindo que a IA seja projetada e otimizada especificamente para cenários educativos, e que se resolvam questões éticas, de privacidade e de equidade. (Fonte: Reddit r/ArtificialInteligence)

💡 Outros

CFO da OpenAI fala sobre o caminho para a AGI e a necessidade de computação: Sarah Friar, CFO da OpenAI, partilhou a visão da empresa sobre o desenvolvimento da AGI e a sua estratégia numa cimeira da Goldman Sachs. Ela acredita que a onda da IA é maior do que a da internet e da internet móvel, e que a OpenAI está a inovar em todas as frentes. Ela enfatizou a importância da aplicação da IA pelas empresas e partilhou exemplos de uso do ChatGPT e DeepResearch para resolver problemas internos como análise de financiamento. A OpenAI divide o desenvolvimento da AGI em cinco fases: previsão em tempo real (Chatbot), raciocínio (série o), agente (Agent, já lançou Deep Research, Operator, lançará agente de programação autónomo A-SWE), mundo da inovação (expandir fronteiras do conhecimento), organização de agentes (direção futura). Ela acredita que a AGI está próxima, mas o mundo ainda não está preparado para a aproveitar plenamente. Alcançar a AGI requer seguir três leis de escala (scaling law): pré-treino, pós-treino, computação em tempo de inferência, com a necessidade de poder de computação a crescer exponencialmente. Ela mencionou que o plano “Stargate” da OpenAI pode exigir um investimento de 500 mil milhões de dólares e 10 gigawatts de potência, admitindo que a falta de poder de computação já limitou o lançamento de modelos como o Sora, e enfatizou a importância de possuir infraestrutura de IA autónoma (análoga à AWS). (Fonte: OpenAI CFO重磅曝料:AGI近在咫尺,全球最强编程智能体已就绪)

Empreendedores ex-Huawei entram em força no setor da robótica, formando nova potência: Após a fundação da Zhiyong Robot por Zhihui Jun (Peng Zhihui), mais ex-funcionários da Huawei, especialmente talentos da BU de Automóveis (divisão de soluções para carros inteligentes), estão a entrar nos campos da inteligência incorporada e robótica, formando um “exército” de empreendedores de robótica “ex-Huawei”. O representante mais recente é a TARS (Itashi Zhixing), cofundada pelo ex-CTO de condução autónoma da BU de Automóveis da Huawei, Chen Yilun, e pelo “jovem génio” Ding Wenchao (que liderou a rede de decisão de condução inteligente ADS), que recentemente obteve um financiamento anjo de 120 milhões de dólares. Ding Wenchao acredita que a experiência em engenharia e ciclo fechado de dados da condução autónoma pode ser transferida para a inteligência incorporada. Além disso, Hu Luhui, ex-executivo do Instituto de Investigação da Huawei nos EUA, fundou a Zhicheng AI, focada em robôs industriais. A Leju Robot colabora com a Huawei Cloud para desenvolver o modelo Pangu + robô Kuafu. A subsidiária integral da Huawei, Jimu Machine, também se concentra em robôs industriais. Estes empreendedores geralmente acreditam que a IA e os grandes modelos trazem novas oportunidades para a robótica, e que o modelo de iteração rápida de pequenas equipas das startups é mais adequado para o novo setor. Eles trazem a capacidade de engenharia, a cultura de luta e até mesmo os modelos de incentivo de capital da Huawei para as novas empresas, e obtêm o favor do capital devido à sua ligação à Huawei. No entanto, ainda enfrentam desafios como a nacionalização de componentes essenciais, validação tecnológica e implementação comercial, precisando de provar a sua força na competição com empreendedores de origem universitária e de outras grandes empresas. (Fonte: 离开任正非的天才少年里, 藏着一个机器人军团)