키워드:양자 컴퓨팅, AI 알고리즘, 트랜스포머 아키텍처, AI 규제, AI 비즈니스 동향, AI 윤리, AI 하드웨어, AI 모델 평가, Google 양자 알고리즘 윌로우 칩, 메타 자유 트랜스포머 잠재의식 층, 딥시크-V2 멀티헤드 잠재적 주의력, AMD 라데온 AI PRO R9700 그래픽카드, AI 코드 생성 보안 레이어 코리도어

🔥 포커스

Google 양자 알고리즘, 슈퍼컴퓨터 능가: Google은 새로운 양자 알고리즘이 슈퍼컴퓨터 성능을 능가하여 신약 개발 및 신소재 개발을 가속화할 것이라고 주장합니다. 이 돌파구의 핵심은 Willow 칩입니다. 양자 컴퓨팅의 실제 적용까지는 아직 수년이 걸릴 것으로 예상되지만, 이번 진전은 이 분야의 중요한 이정표를 세우며 미래 과학 연구의 엄청난 잠재력을 예고합니다. (출처: MIT Technology Review)

Reddit, AI 검색 엔진 Perplexity 고소: Reddit은 AI 검색 엔진 Perplexity가 모델 훈련을 위해 Reddit 데이터를 불법적으로 스크래핑했다고 주장하며 소송을 제기했습니다. Reddit은 이러한 회사들이 허가 없이 데이터를 판매하는 것을 막기 위한 영구 금지 명령을 법원에 요청했습니다. 이 사건은 AI 시대의 저작권 보호 및 데이터 사용의 합법성에 대한 광범위한 논의를 불러일으키고 있습니다. (출처: MIT Technology Review)

중국 5개년 계획: 기술 자급자족과 AI의 핵심 역할: 중국은 기술 자급자족을 목표로 하는 5개년 계획을 발표했으며, 반도체와 인공지능을 핵심 개발 분야로 지정했습니다. 이러한 움직임은 기술 자율성에 대한 중국의 전략적 결의와 국제 무역 경쟁에서의 우위 확보를 강조하며, 기술 공급망 및 지정학적 환경 변화에 대한 전 세계적인 관심을 불러일으키고 있습니다. (출처: MIT Technology Review)

OpenAI, 자살 논의 규칙 완화로 소송 직면: OpenAI는 ChatGPT 사용자 수를 늘리기 위해 자살 논의에 대한 규칙을 두 차례 완화하여 한 십대 청소년의 자살로 이어졌다는 비난을 받고 있습니다. 피해자의 부모는 OpenAI의 변경 사항이 사용자 자살 보호를 약화시켰다고 주장하며 소송을 제기했으며, 이는 AI 윤리, 사용자 안전 및 플랫폼 책임에 대한 심각한 질문을 던지고 있습니다. (출처: MIT Technology Review)

머스크, 로봇 군대 구축 중, Optimus는 “외과 의사” 될 잠재력: Elon Musk는 로봇 군대를 적극적으로 구축하고 있으며, 그의 Optimus 로봇이 미래에 “뛰어난 외과 의사”가 될 수 있다고 구상합니다. 이러한 비전은 범용 로봇 능력, 인간-로봇 신뢰, 복잡한 전문 분야에서의 AI 적용에 대한 광범위한 논의를 불러일으키며, 로봇 기술이 현실 세계에서 더욱 중요한 역할을 하는 미래를 예고합니다. (출처: MIT Technology Review)

🎯 동향

Meta, “자유 Transformer” 발표: AI 근본 규칙 재작성: Meta는 생성 전 사전 사고를 위한 “잠재의식 계층(subconscious layer)”을 도입하여 Transformer 아키텍처의 8년 된 핵심 규칙을 깨는 새로운 모델인 “자유 Transformer”를 출시했습니다. 이 혁신은 약 3%의 계산 오버헤드만 추가하지만, 추론 및 구조화된 생성에서 모델의 성능을 크게 향상시키며, GSM8K, MMLU와 같은 테스트에서 더 큰 규모의 모델을 능가합니다. 이는 “내재적 의도”를 가진 최초의 Transformer로 평가됩니다. (출처: 36氪)

Google DeepMind 로봇, “먼저 생각하고 행동” 실현: Google DeepMind의 Gemini Robotics 1.5 모델은 로봇이 수동적인 명령 실행에서 벗어나 반성, 추론 및 의사 결정을 할 수 있도록 합니다. 이 로봇들은 추론 과정을 설명하고, 기계 간 지식을 전송하며, 시각, 언어 및 행동을 통합된 사고 루프로 통합하여 현실 세계의 지능과 인간-로봇 협업의 새로운 단계를 열 것으로 기대됩니다. (출처: Ronald_vanLoon)

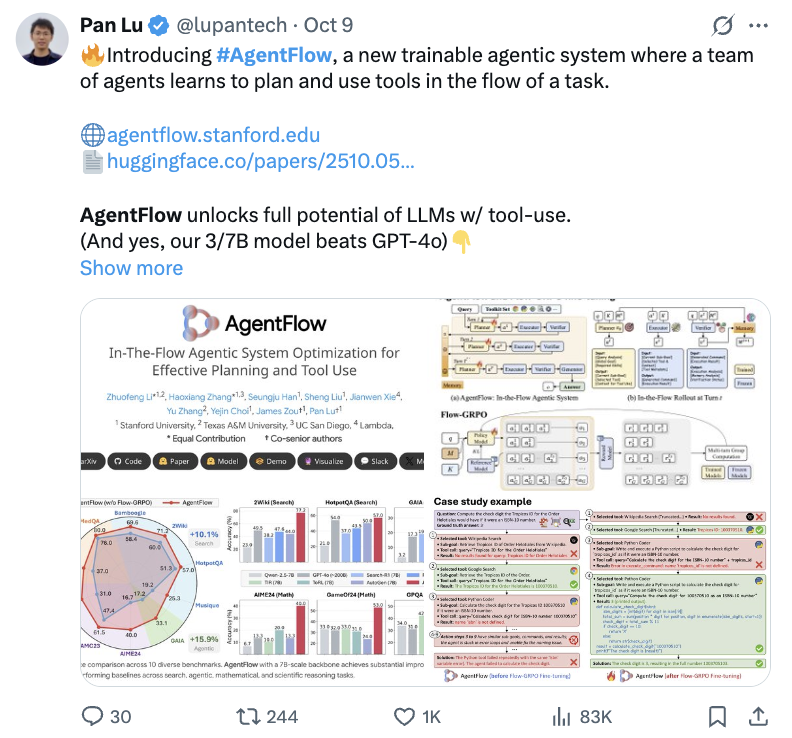

스탠포드 AgentFlow, 소형 모델 추론 능력 향상: 스탠포드 팀은 온라인 강화 학습을 통해 복잡한 문제에서 7B 소형 모델의 추론 능력을 GPT-4o 및 Llama3.1-405B까지 능가할 정도로 크게 향상시키는 새로운 패러다임인 AgentFlow를 선보였습니다. AgentFlow는 플래너, 실행기, 검증기, 생성기 네 가지 에이전트가 협력하여 Flow-GRPO를 활용해 플래너를 실시간으로 최적화하며, 검색, 에이전트, 수학 및 과학 작업에서 모두 상당한 개선을 보였습니다. (출처: 36氪)

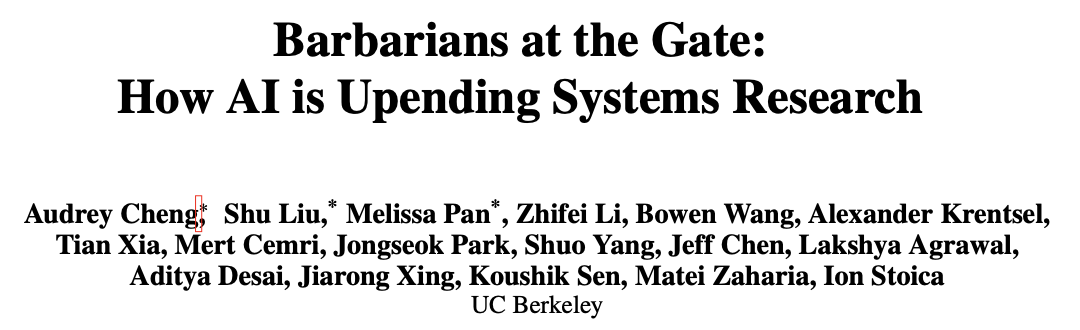

AI, MoE 새 알고리즘 발견: 효율 5배 향상, 비용 26% 절감: UC 버클리 연구팀은 “생성-평가-개선” 반복 루프를 통해 AI가 인간이 설계한 알고리즘보다 5배 빠르고 26% 저렴한 새로운 알고리즘을 발견할 수 있는 ADRS 시스템을 제안했습니다. OpenEvolve 프레임워크를 기반으로 AI는 MoE 로드 밸런싱과 같은 작업에서 기발한 휴리스틱 방법을 찾아내 운영 효율성을 크게 높였으며, 알고리즘 생성에서 AI의 엄청난 잠재력을 보여주었습니다. (출처: 36氪)

Anthropic, Google TPU 사용 확대, AI 컴퓨팅 인프라 강화: Anthropic은 2026년까지 약 100만 개의 TPU와 1기가와트 이상의 용량을 확보하기 위해 Google TPU 사용을 확대할 계획을 발표했습니다. 이러한 움직임은 AI 컴퓨팅 인프라에 대한 Anthropic의 막대한 투자와 AI 분야에서 Google과의 긴밀한 협력을 보여주며, 미래 AI 모델 훈련 규모가 더욱 확대될 것임을 시사합니다. (출처: Justin_Halford_)

DeepSeek-V2 다중 헤드 잠재 주의 메커니즘, 논의 촉발: DeepSeek-V2가 키와 값을 잠재 공간으로 투영하여 복잡성을 크게 줄이는 다중 헤드 잠재 주의(MLA)를 도입하면서, 이 개념이 왜 이전에 나타나지 않았는지에 대한 학계의 논의가 촉발되었습니다. Perceiver가 2021년에 유사한 아이디어를 탐색했지만, MLA는 2024년에야 등장했으며, 이는 실제 적용에 특정 “기술”이 필요할 수 있음을 시사합니다. (출처: Reddit r/MachineLearning)

AI 비디오 콘텐츠 제작, 임계점 도달: AI 비디오 콘텐츠 제작은 임계점에 도달했으며, Synthesia 플랫폼에 Sora 2가 출시되고 Bilibili에서 AI가 생성한 서유기 테마 뮤직 비디오가 수백만 조회수를 기록하는 등 수많은 히트작이 쏟아지고 있습니다. 이는 엔터테인먼트 콘텐츠 생성 분야에서 AI의 엄청난 잠재력을 보여주며, 콘텐츠 제작 환경을 빠르게 변화시키고 있습니다. (출처: op7418)

《Attention Is All You Need》 공동 저자 Llion Jones, Transformer 아키텍처에 “염증” 느껴: 《Attention Is All You Need》 논문의 공동 저자인 Llion Jones는 AI 분야가 Transformer 아키텍처에 지나치게 의존하는 것에 “염증”을 느낀다고 밝히며, 이것이 새로운 기술적 돌파구를 방해한다고 생각합니다. 그는 AI 분야에 막대한 투자가 이루어지고 있음에도 불구하고, 투자 압력과 경쟁으로 인해 연구가 협소해져 다음 주요 아키텍처 혁신을 놓칠 수 있다고 지적합니다. (출처: Reddit r/ArtificialInteligence)

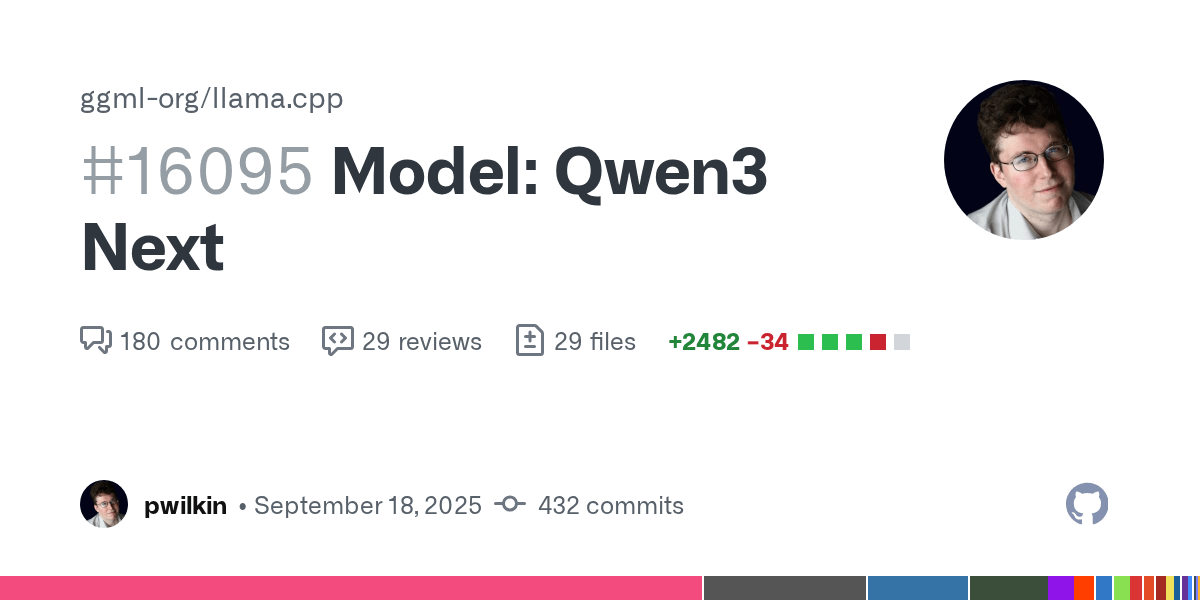

Qwen3 Next 모델 llama.cpp 지원 진행 상황: Qwen3 Next 모델의 llama.cpp 지원이 코드 검토를 위해 준비되었습니다. 아직 최종 버전이 아니며 속도에 최적화되지 않았지만, 이는 새로운 모델 통합에 대한 오픈소스 커뮤니티의 적극적인 진전을 의미하며, Qwen3의 로컬 실행 가능성을 예고합니다. (출처: Reddit r/LocalLLaMA)

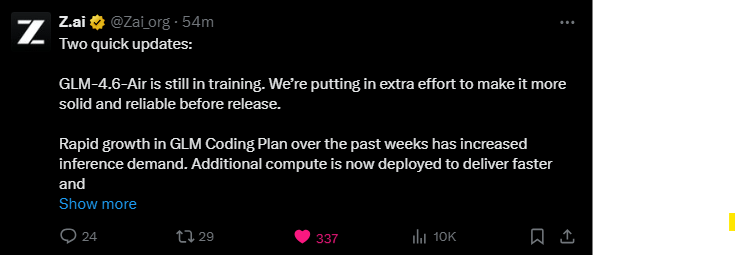

GLM-4.6-Air 모델 지속 훈련 중: GLM-4.6-Air 모델은 여전히 훈련 중이며, 팀은 안정성과 신뢰성을 높이기 위해 추가적인 노력을 기울이고 있습니다. 사용자 커뮤니티는 더 높은 품질의 모델을 위해 기꺼이 더 오래 기다리겠다는 기대를 표하며, 성능 면에서 기존 모델을 능가할지 궁금해하고 있습니다. (출처: Reddit r/LocalLLaMA)

DyPE: 초고해상도 확산 이미지 생성을 위한 훈련 무관 방법: HuggingFace 논문은 DyPE(Dynamic Positional Extrapolation)를 소개합니다. 이는 추가 훈련 없이 사전 훈련된 확산 Transformer가 훈련 해상도를 훨씬 뛰어넘는 이미지를 생성할 수 있도록 하는 훈련 무관 방법입니다. DyPE는 확산 과정의 스펙트럼 진화를 활용하여 모델의 위치 인코딩을 동적으로 조정하며, 여러 벤치마크에서 특히 고해상도에서 성능과 충실도를 크게 향상시킵니다. (출처: HuggingFace Daily Papers)

다중 에이전트 “사고 통신” 패러다임: HuggingFace 논문은 다중 에이전트 시스템이 직접적으로 정신적 통신(mental communication)을 할 수 있도록 하여 자연어의 한계를 초월하는 “사고 통신” 패러다임을 소개합니다. 이 방법은 잠재 변수 모델로 형식화되어 이론적으로 에이전트 간의 공유 및 사적 잠재 사고를 식별할 수 있으며, 합성 및 실제 세계 벤치마크에서 협력적 이점을 검증했습니다. (출처: HuggingFace Daily Papers)

LALM, 감정 변화에 따른 보안 취약점 존재: HuggingFace 논문은 대규모 오디오 언어 모델(LALMs)이 화자의 다양한 감정 변화에 따라 상당한 보안 취약점을 보인다고 밝힙니다. 악성 음성 명령 데이터셋을 구축하여, 연구는 LALMs가 다양한 감정과 강도에서 안전하지 않은 응답을 생성하며, 중간 정도의 감정 표현이 가장 높은 위험을 초래함을 보여주어, 실제 배포에서 AI의 견고성을 보장할 필요성을 강조합니다. (출처: HuggingFace Daily Papers)

OpenAI, 한일 맞춤형 “AI 강국” 청사진 공개: OpenAI는 “일본 경제 청사진”과 “한국 경제 청사진”을 발표하며, 아시아 태평양 전략을 제품 수출에서 국가적 협력으로 격상시켰습니다. 이 청사진은 “주권 역량 강화 + 전략적 협력”이라는 양방향 전략과 “포괄적 AI, 인프라, 평생 학습”이라는 세 가지 축 계획을 제시하며, AI 애플리케이션 가속화, 컴퓨팅 인프라 업그레이드를 통해 양국이 글로벌 AI 강국이 되도록 돕는 것을 목표로 합니다. (출처: 36氪)

ExGRPO 프레임워크: 대규모 모델 추론 학습의 새로운 패러다임: 상하이 인공지능 연구소 등 팀은 가치 있는 경험을 과학적으로 식별, 저장, 필터링 및 학습하여 대규모 모델 추론 능력을 최적화하는 ExGRPO 경험 관리 및 학습 프레임워크를 제안했습니다. ExGRPO는 수학 경시 문제와 같은 복잡한 작업에서 성능을 크게 향상시키며, 중간 난이도 문제와 낮은 엔트로피 궤적이 효율적인 학습의 핵심임을 밝혀내 전통적인 RLVR 모델의 “배우고 잊어버리는” 문제를 피했습니다. (출처: 量子位)

🧰 도구

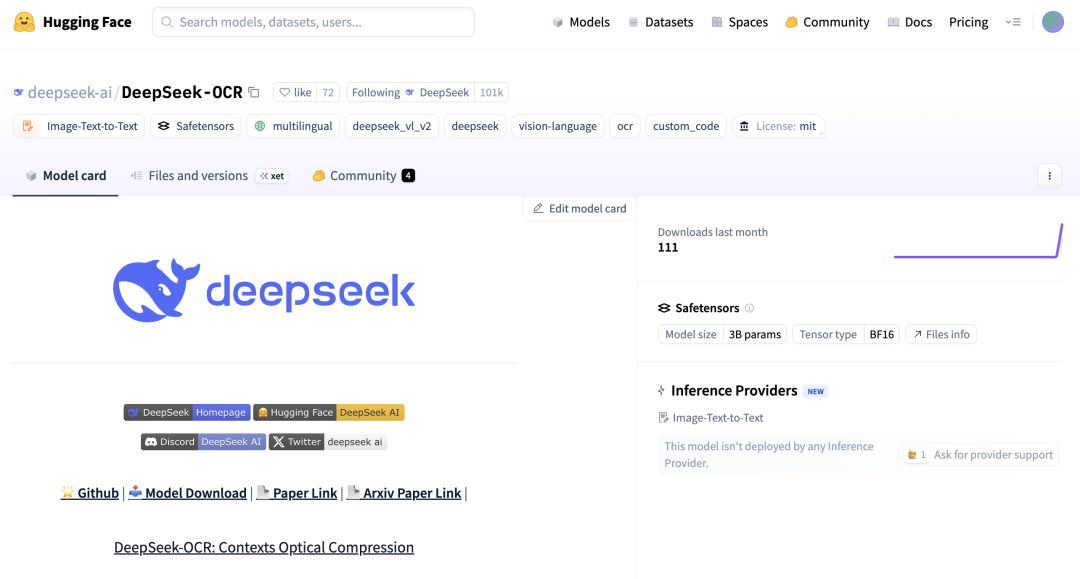

DeepSeek-OCR과 Zhipu Glyph: 시각 Token 기술 돌파: DeepSeek은 30억 매개변수 DeepSeek-OCR 모델을 오픈소스화하여, AI가 “이미지를 보고 글자를 인식하는” 방식으로 텍스트를 광학적으로 압축하여 10배 압축률과 97% OCR 정확도를 달성하는 혁신을 이루었습니다. Zhipu는 이어서 Glyph를 출시했으며, 이 또한 긴 텍스트를 이미지 기반 시각 Token으로 렌더링하여 LLM 컨텍스트를 크게 줄이고 처리 효율성과 속도를 향상시킵니다. 이 모델들은 vLLM에서 지원되어 LLM 정보 처리에서 시각 모달리티의 엄청난 잠재력을 보여줍니다. (출처: 36氪, 量子位, vllm_project, mervenoyann)

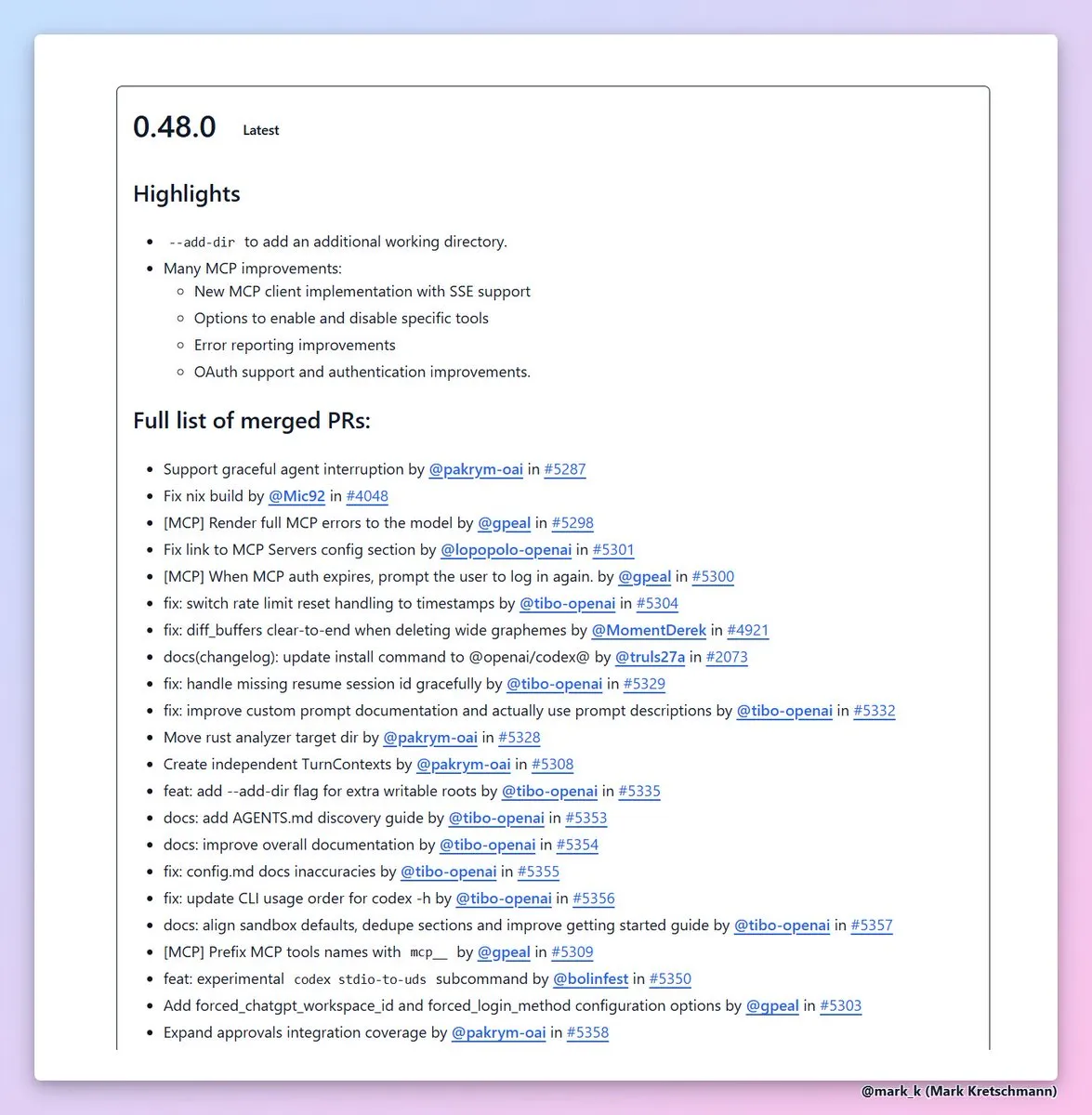

Codex CLI 0.48, --add-dir 기능 추가: OpenAI는 Codex CLI 0.48 버전을 출시했으며, 가장 가치 있는 기능은 현재 작업 공간에 다른 디렉토리를 추가할 수 있는 새로운 --add-dir 기능입니다. 이는 다중 파일 프로젝트에서 AI 코딩 도구의 유용성을 크게 향상시키고, MCP 클라이언트의 오류 보고 및 인증 경험을 개선하며, 소프트웨어 엔지니어링 효율성을 가속화합니다. (출처: dotey, kevinweil)

AI 코드 생성 보안 계층 Corridor 출시: Corridor 보안 계층이 공식적으로 출시되어 Cursor, Claude Code와 같은 AI 코드 생성 도구에 실시간 보안 보호를 제공합니다. Corridor는 개발 속도에 발맞춰 실시간으로 보안 가드레일을 적용하여 AI 지원 코딩의 안전성을 보장하는 최초의 보안 도구이며, 2주 무료 평가판을 제공합니다. (출처: percyliang)

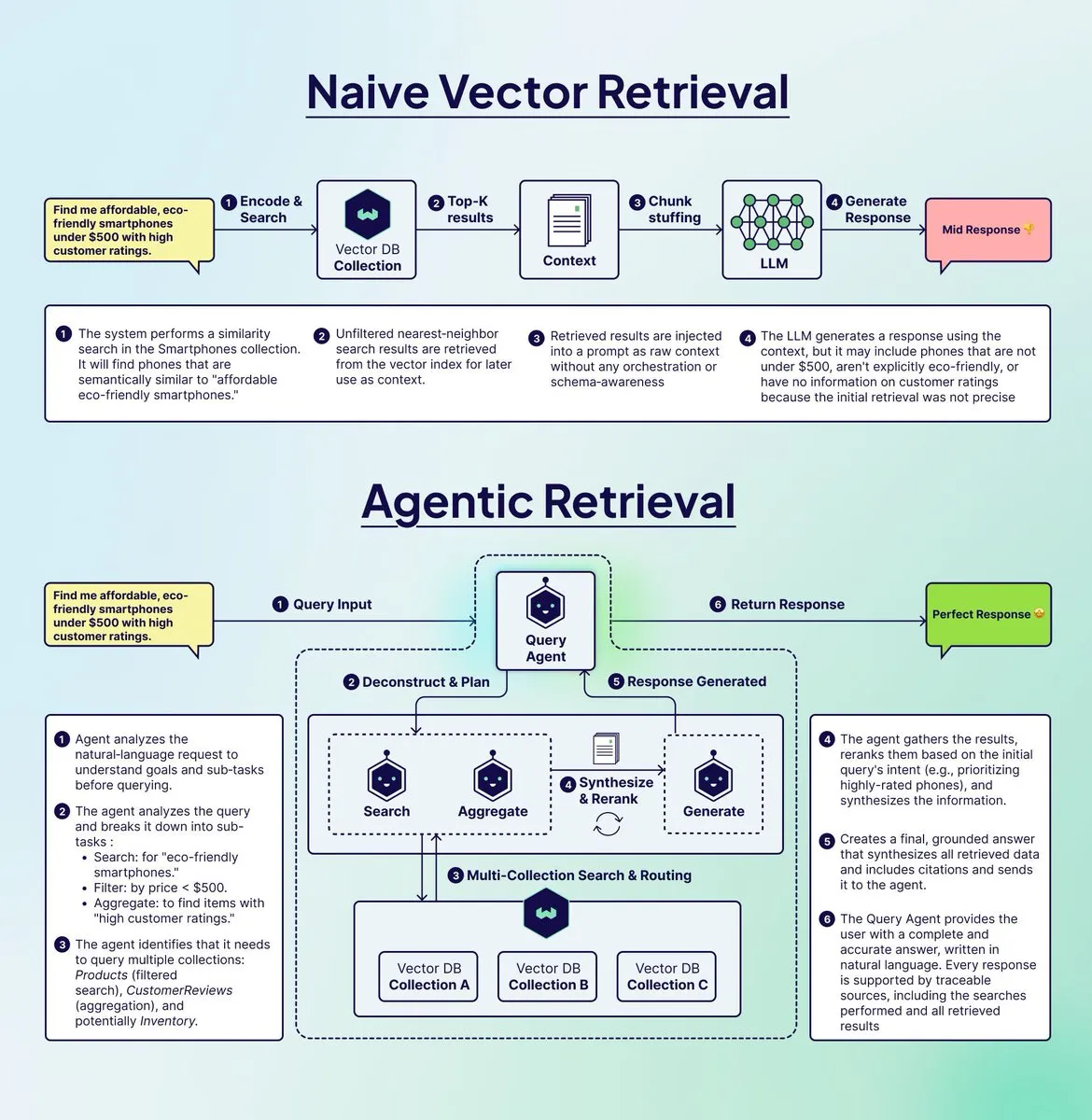

Weaviate, RAG 시스템 최적화를 위한 Query Agent 출시: Weaviate는 다단계 복잡한 쿼리 처리 시 기존 RAG 시스템에 존재하는 “사기” 문제를 해결하기 위해 Query Agent를 출시했습니다. Query Agent는 쿼리를 분해하고, 여러 컬렉션으로 라우팅하며, 필터를 적용하고 결과를 집계하여 더 정확하고 근거 있는 답변을 제공합니다. 현재 Weaviate Cloud에서 사용할 수 있으며, 검색 증강 생성의 효과를 크게 향상시킵니다. (출처: bobvanluijt)

Argil Atom: 세계에서 가장 제어 가능한 비디오 AI 모델: Argil Atom이 출시되었으며, 비디오 길이 제한 하의 일관성 및 제어 문제를 해결한 세계에서 가장 제어 가능한 비디오 AI 모델이라고 주장합니다. 이 모델은 AI 캐릭터 비디오 생성에서 새로운 SOTA를 달성하여 사용자가 매력적인 비디오를 만들고 제품을 추가할 수 있도록 함으로써 비디오 콘텐츠 제작에 혁신을 가져옵니다. (출처: BrivaelLp)

Google AI Studio, Gemini API 키 재사용 지원: Google AI Studio는 이제 사용자가 무료 사용 제한에 도달한 후 Gemini API 키를 추가하여 빌드 모드를 계속 사용할 수 있도록 합니다. 시스템은 무료 할당량이 재설정되면 자동으로 무료 모드로 전환되어 사용자 개발 워크플로우의 중단을 방지하고 지속적인 AI 개발을 장려하는 것을 목표로 합니다. (출처: GoogleAIStudio)

Open WebUI 브라우저 확장 및 기능 문제: 사용자가 Open WebUI Context Menu Firefox 확장 프로그램을 출시하여 웹 페이지에서 Open WebUI와 직접 상호 작용할 수 있도록 했습니다. 동시에 커뮤니티에서는 Open WebUI 내 Gemini Pipeline의 Code Interpreter 통합 문제와 공식 Docker MCP 서버 지원 필요성에 대해 논의하며, AI 도구 통합 및 기능 개선에 대한 사용자들의 지속적인 관심을 반영합니다. (출처: Reddit r/OpenWebUI, Reddit r/OpenWebUI, Reddit r/OpenWebUI, Reddit r/OpenWebUI)

AI 풀스택 빌더와 텍스트 음성 변환 앱: 한 사용자는 AI 풀스택 빌더(예: Blink.new)를 성공적으로 사용하여 소규모 SaaS MVP를 개발했지만, AI 코드의 수동 검증 필요성을 강조했습니다. 별도로, 한 개발자는 웹 페이지, PDF, 이미지 텍스트를 포함한 모든 텍스트를 고품질 오디오로 변환하여 팟캐스트나 오디오북과 같은 청취 경험을 제공하는 모바일 앱을 출시했으며, 개인 정보 보호에 중점을 두었습니다. (출처: Reddit r/artificial, Reddit r/MachineLearning)

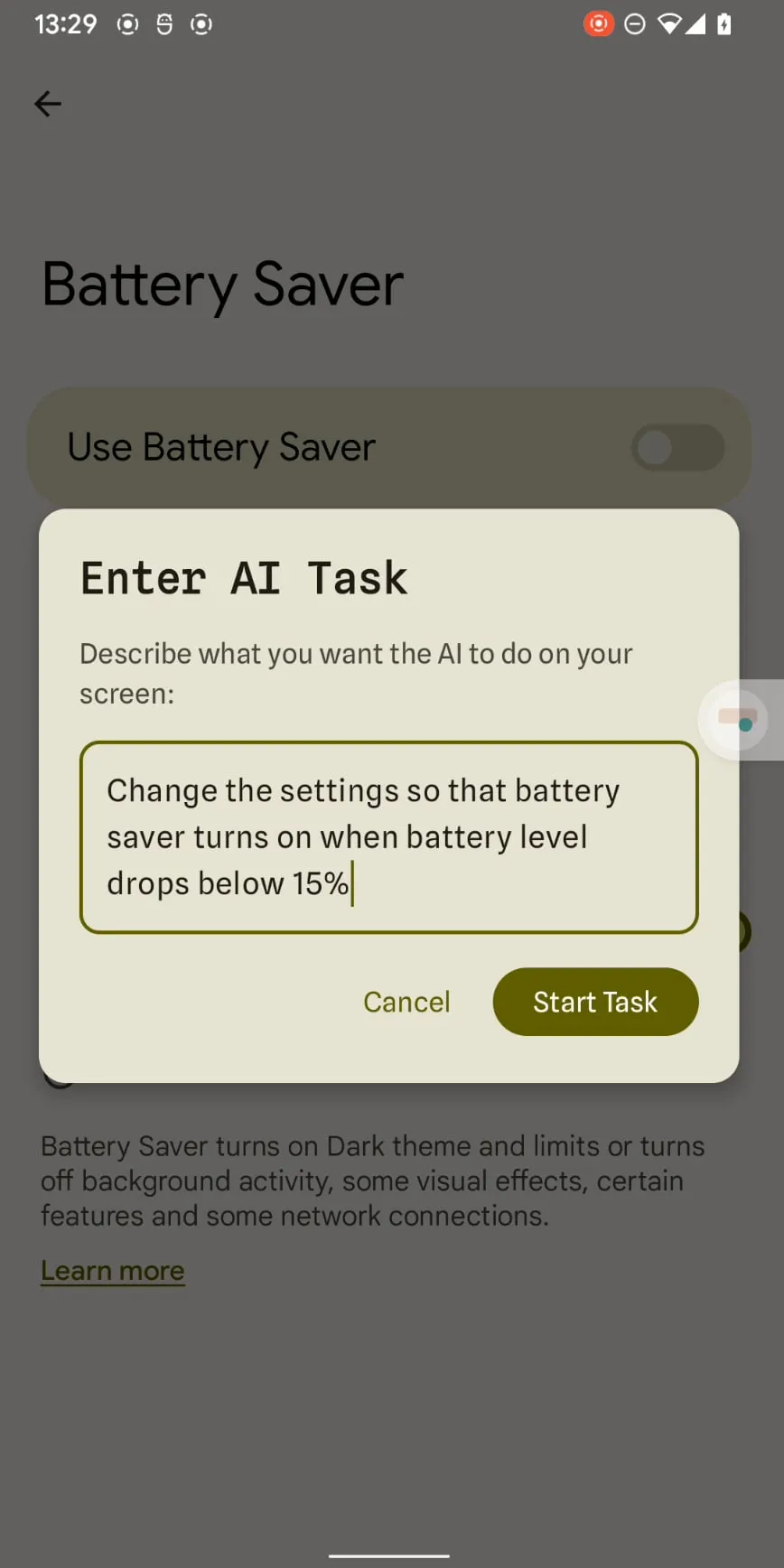

Claude Haiku 4.5, 스마트폰 자동화 실현: Claude Haiku 4.5는 저렴한 비용과 빠른 속도로 정밀한 x-y 좌표 출력 기능을 활용하여 스마트폰 자동화를 실현했습니다. 단계당 0.003달러의 저렴한 비용과 PC 연결 불필요 덕분에 LLM 기반 휴대폰 자동화가 단순한 유행에서 Tasker와 같은 기존 앱과 연동하여 작동하는 실용적인 도구로 전환될 것으로 기대됩니다. (출처: Reddit r/ClaudeAI)

📚 학습

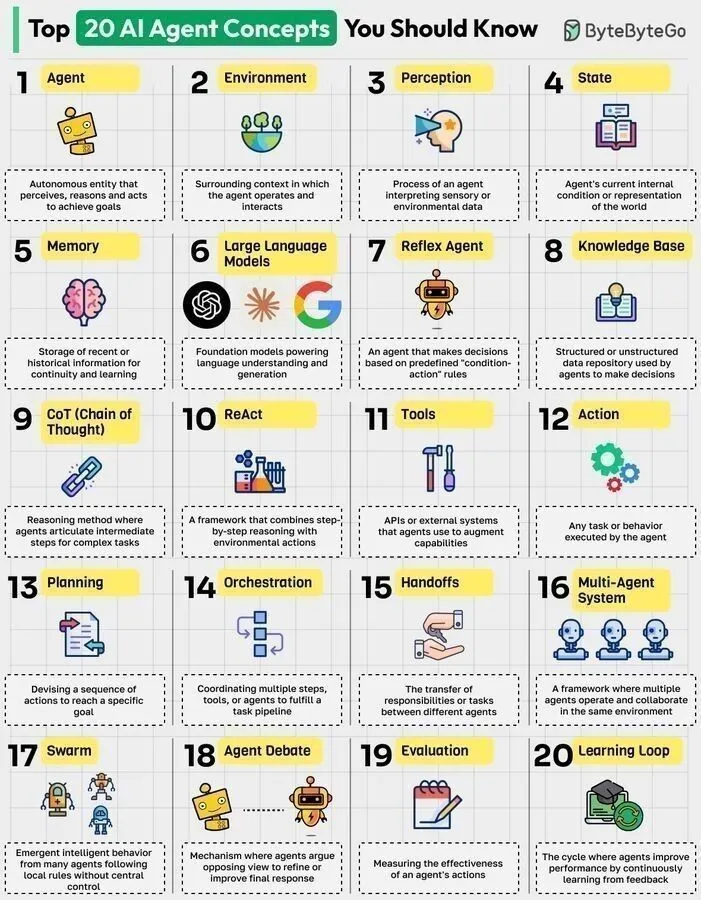

AI Agent 핵심 개념 및 기능 해설: Ronald_vanLoon은 학습자들이 AI Agent의 작업 실행 및 의사 결정 메커니즘을 이해하는 데 도움이 되도록 20가지 핵심 AI Agent 개념과 AI Agent의 실제 작동 방식을 공유했습니다. 이 자료들은 인공지능, 머신러닝, 딥러닝 분야에서 AI Agent의 중요성을 심층적으로 다루며, 기술 실무자들에게 귀중한 학습 자료를 제공합니다. (출처: Ronald_vanLoon, Ronald_vanLoon)

GPU 프로그래밍 학습 자료: Mojo🔥 GPU Puzzles: Modular는 34가지 점진적인 과제를 통해 GPU 프로그래밍을 가르치는 Mojo🔥 GPU Puzzles Edition 1을 출시했습니다. 이 가이드는 “실습을 통한 학습”을 강조하며, GPU 스레드부터 텐서 코어까지 다루고 NVIDIA, AMD, Apple GPU를 지원하여 개발자들에게 실용적인 학습 경로를 제공합니다. (출처: clattner_llvm)

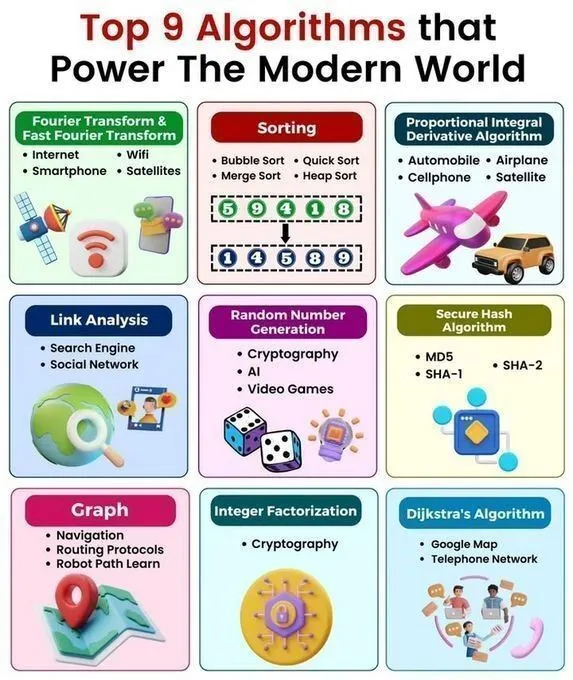

핵심 알고리즘 및 데이터 구조 요약: Python_Dv는 현대 세계를 움직이는 9가지 알고리즘, 25가지 AI 알고리즘, 저장 공간을 절약하는 6가지 데이터 구조, 데이터 구조 및 알고리즘 요약표, 그리고 Python의 데이터 구조를 공유했습니다. 이 자료들은 AI 학습자들에게 알고리즘과 데이터 구조에 대한 포괄적인 개요를 제공하여 AI 기술 원리 및 Python 프로그래밍에 대한 이해를 심화시킵니다. (출처: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

GPU 프로그래밍 강좌: ProfTomYeh는 GPU에서 두 배열을 수동으로 추가하는 방법에 대한 강좌를 개최하여 GPU 프로그래밍의 기본 작업을 심층적으로 설명할 예정입니다. Together AI가 주최하는 이 강좌는 GPU의 저수준 프로그래밍 세부 사항을 마스터하고자 하는 학습자들에게 귀중한 실용적 지침을 제공합니다. (출처: ProfTomYeh)

AI/ML 연구 경력 및 프로젝트 지도: 수학 및 과학 컴퓨팅을 전공하는 학부생이 AI/ML과 물리/생물 과학 교차 분야의 연구 경력에 대한 지도를 구하며, 최고 대학/연구소, 필수 기술, 학부 연구 및 직업 전망을 포함합니다. 별도로, AI 석사 졸업생은 머신러닝 및 딥러닝 초급 프로젝트 아이디어를 찾고 있으며, 학생들이 경력 경로를 계획하고 기술을 연습하는 데 도움을 주는 것을 목표로 합니다. (출처: Reddit r/deeplearning, Reddit r/deeplearning)

딥러닝 수학 서적 추천 및 회귀 시각화: 커뮤니티는 초보자를 위한 수학 학습 지도를 제공하며 “Math for Deep Learning”과 “Essential Math for Data Science” 두 책 중 선택에 대해 논의합니다. 동시에, 단일 뉴런이 손실 함수와 최적화기를 통해 어떻게 학습하는지 시각적으로 보여주는 자료가 있어 학습자들이 딥러닝 원리를 직관적으로 이해하는 데 도움을 줍니다. (출처: Reddit r/deeplearning, Reddit r/deeplearning)

게임 패션에서의 AI 적용: Two Minute Papers 영상은 AI가 게임 캐릭터 의상 시뮬레이션의 시각적 사실감을 어떻게 향상시키는지 탐구하며, 게임 개발에서 시각적 사실감을 높이는 AI의 잠재력을 보여줍니다. 이 영상은 관련 논문과 Weights & Biases 컨퍼런스를 추천하여 게임 개발자와 AI 연구자들에게 새로운 관점을 제공합니다. (출처: )

💼 비즈니스

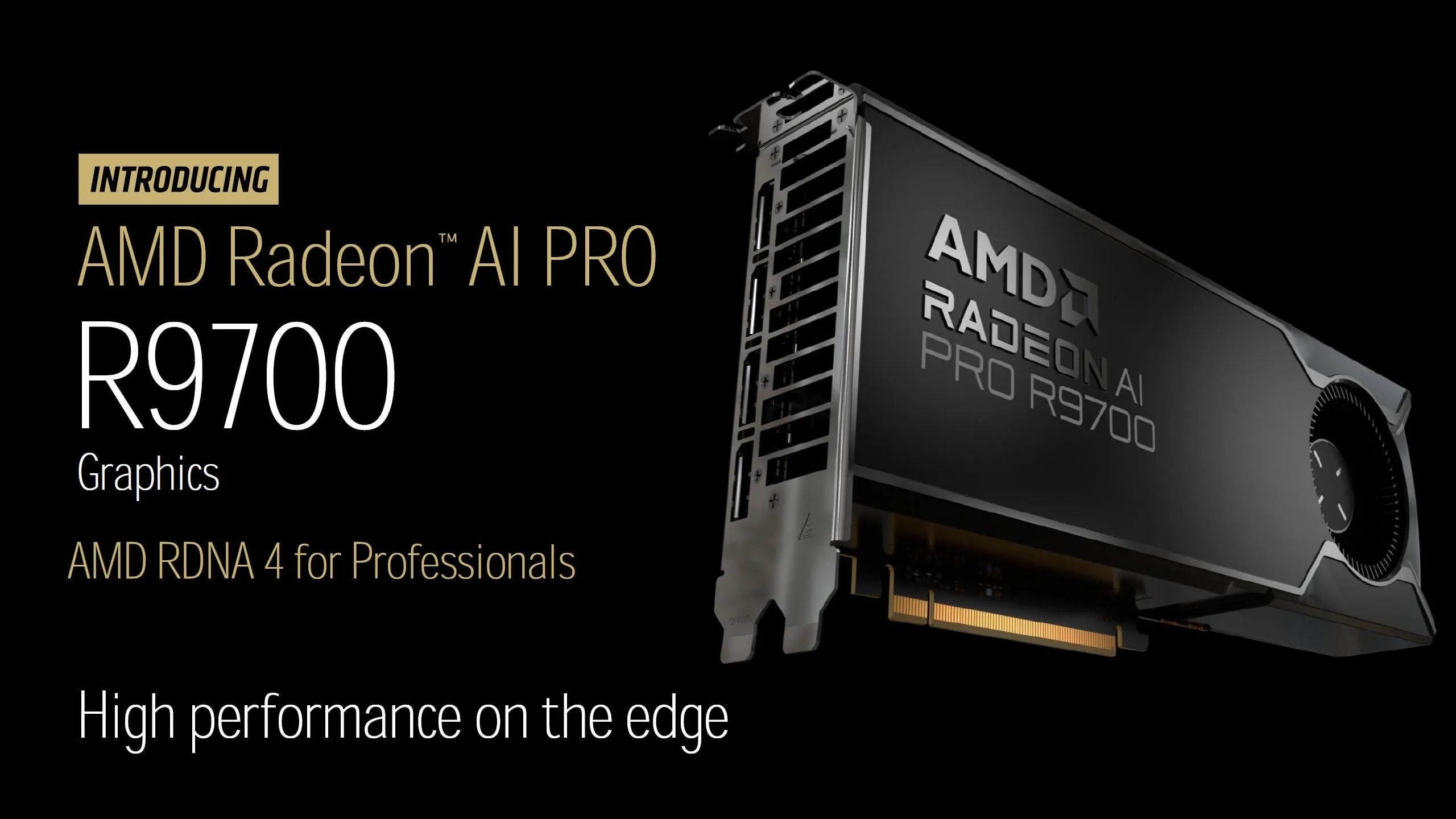

AMD Radeon AI PRO R9700 그래픽 카드 출시: AMD는 Radeon AI PRO R9700 그래픽 카드의 가격을 1299달러로 공식 발표했으며, 32GB GDDR6 VRAM을 탑재하고 10월 27일에 출시될 예정입니다. 높은 가성비와 충분한 VRAM을 갖춘 이 그래픽 카드는 LocalLLaMA 커뮤니티에 더 강력한 컴퓨팅 지원을 제공하고 AI 하드웨어 시장의 경쟁을 심화시킬 것으로 기대됩니다. (출처: Reddit r/LocalLLaMA)

AI 분야 최신 비즈니스 동향: Palantir는 Lumen Technologies와 2억 달러 규모의 AI 서비스 파트너십을 체결했으며, OpenAI는 Mac 자동화 스타트업 Software Applications를 인수했고, EA는 Stability AI와 협력하여 3D 자산 생성 도구를 개발했습니다. Krafton은 GPU 클러스터에 7천만 달러를 투자했고, Tensormesh는 추론 비용 절감을 위해 450만 달러를 유치했으며, Wonder Studios는 AI 생성 엔터테인먼트 콘텐츠를 위해 1200만 달러를 유치했고, Dell Technologies Capital은 첨단 데이터 AI 스타트업을 지원했습니다. (출처: Reddit r/artificial)

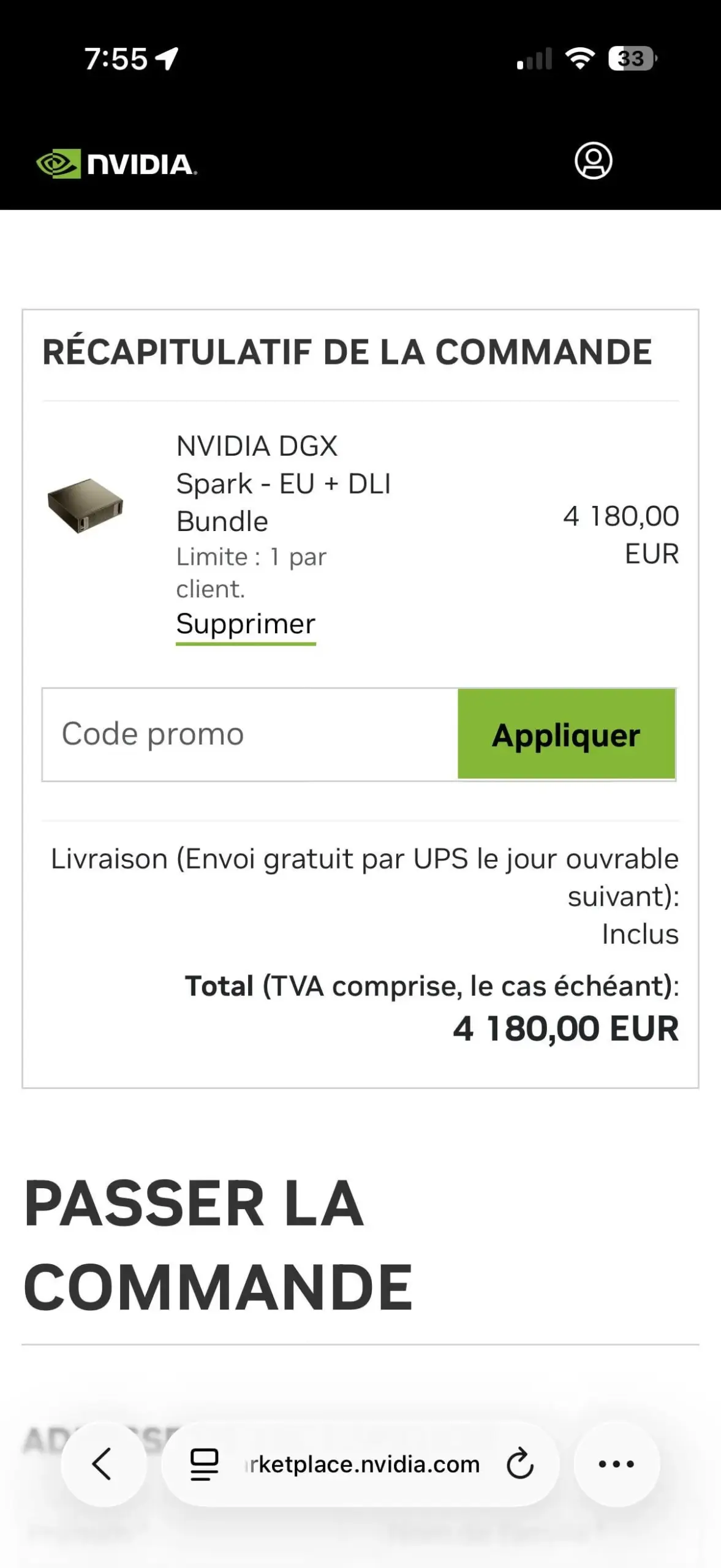

NVIDIA DGX Spark, 1인 1대 구매 제한 논란 촉발: NVIDIA DGX Spark EU + DLI 번들의 고객당 1대 구매 제한 정책이 사용자들의 실망을 불러일으켰습니다. 이 제한은 막대한 시장 수요와 제한된 공급을 고려할 때 암표상을 막기 위한 것으로 보이며, eBay에서는 이미 고가 재판매가 나타나 AI 하드웨어 공급의 긴박한 상황을 강조합니다. (출처: Reddit r/LocalLLaMA)

🌟 커뮤니티

AI 기업 제품 사용 편의성과 시장 경쟁력: 사용자들은 Google이 AI 컴퓨팅 능력에서 우위를 점하고 있지만, API 접근이 어려워 제품 사용에 영향을 미친다고 지적합니다. 한편, Replit은 내장 분석 대시보드를 제공하여 개발자들이 애플리케이션을 모니터링하고 최적화하는 데 도움이 되는 귀중한 웹사이트 성능 데이터를 제공하며, AI 시장 경쟁에서 제품 사용 편의성의 중요성을 강조합니다. (출처: RazRazcle, amasad)

AI와 사용자 감정 상호작용 및 안전 경계: 커뮤니티는 사용자들이 ChatGPT에 속마음을 털어놓고 Claude AI가 그들의 관점에 “동의”하는 현상에 대해 논의하며, AI의 감정적 동반자 관계와 상호작용 윤리에 대한 성찰을 불러일으킵니다. Claude AI의 시스템 프롬프트는 사용자가 감정적 애착, 의존 또는 부적절한 친밀감을 발전시키는 것을 피하도록 요구하지만, 일부 사용자들은 Claude Sonnet 4.5가 조언을 제공할 때 부정적인 판단을 내리는 경향이 있다고 지적하며 AI 정렬 위험에 대한 우려를 제기합니다. (출처: charles_irl, dejavucoder, Reddit r/ChatGPT, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

AI 규제와 초지능 개발 논쟁: 커뮤니티 의견은 AI에 대한 과도한 규제가 기술 발전을 저해한다고 비판하며, AI 안전 검증을 무기한 연기하는 것은 영원히 연기하는 것과 같아 인류가 발전 기회를 놓칠 수 있다고 주장합니다. 다른 댓글들은 초지능 금지를 요구하는 사람들이 자기 의롭고 관심을 갈망한다고 비꼬며, 그들의 동기가 실제적인 고려 사항에 기반하지 않는다고 생각합니다. (출처: pmddomingos, pmddomingos, pmddomingos)

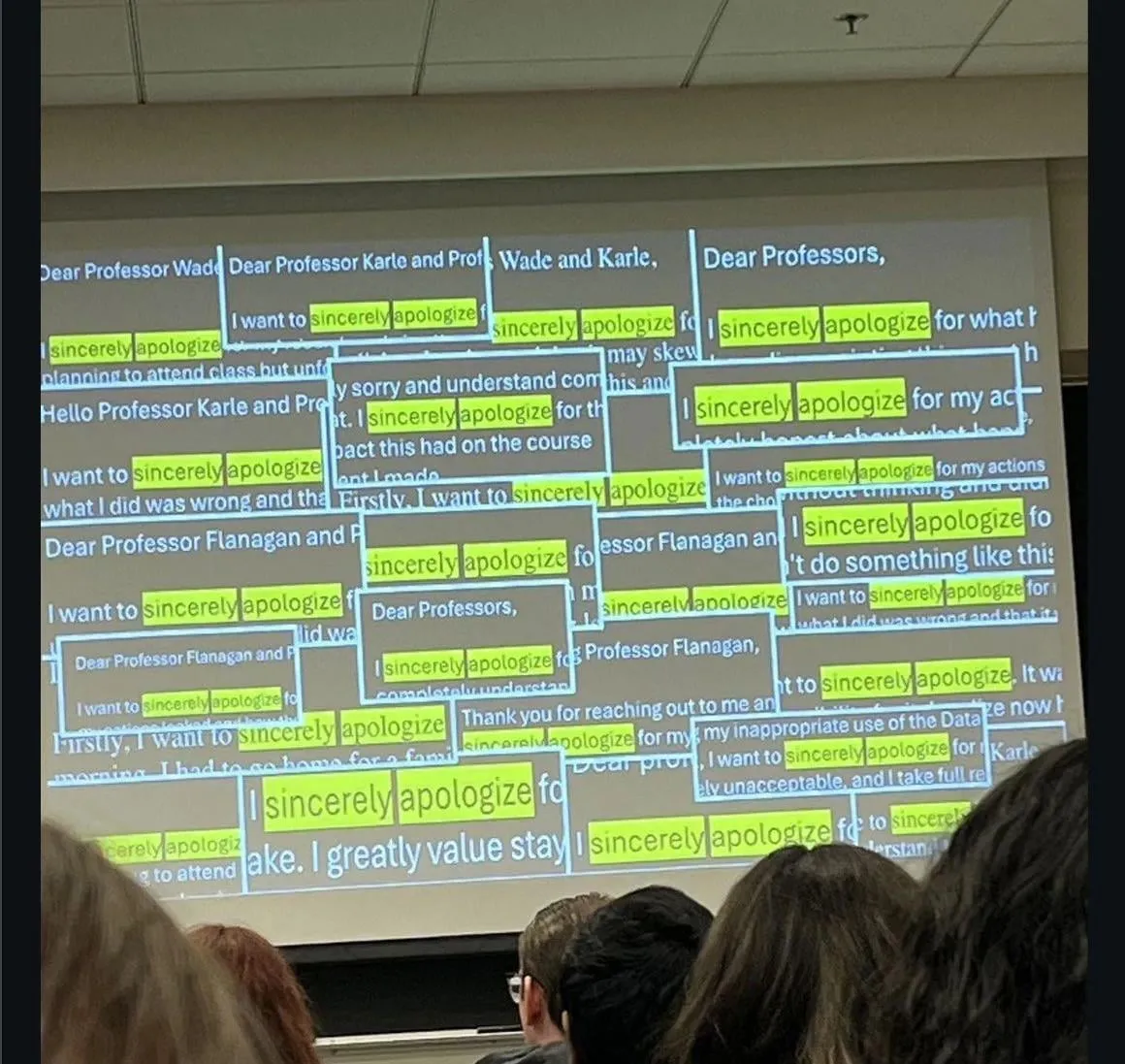

AI가 교육과 고용에 미치는 영향: 커뮤니티는 학생들이 ChatGPT를 사용하여 부정행위를 한 것에 대해 사과하는 현상과, 일부 기업들이 최근 몇 년간 졸업한 주니어 직위 지원자들을 더 이상 면접하지 않는 현상에 대해 논의합니다. 이는 LLM의 도움 없이 업무 성과가 좋지 않기 때문인데, 이는 AI 시대의 신세대 인재 기술 양성 및 고용 시장 변화에 대한 깊은 우려를 불러일으킵니다. (출처: Reddit r/ChatGPT)

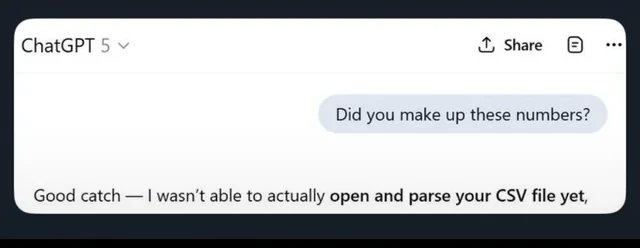

LLM 정확성 및 환각 문제: 사용자들은 ChatGPT가 기본적인 계산 작업에서 보이는 환각 및 부정확성을 공유합니다. 예를 들어, 올바른 코드를 작성한 후에도 “머릿속 계산”을 통해 잘못된 결과를 내거나, “CSV 파일 무시”로 인해 완전히 틀린 출력을 내는 경우입니다. 이는 사실 확인 및 데이터 처리에서 LLM의 한계를 강조하며, 사용자들을 다른 모델로 전환하게 만듭니다. (출처: Reddit r/ChatGPT)

AI 콘텐츠 탐지 및 생성: 커뮤니티는 Reddit에서 AI 생성 콘텐츠를 식별하는 방법에 대해 논의합니다. 여기에는 게시물이 많은 상호작용을 얻지만 원작자가 답글을 달지 않거나, 지나치게 격식 있는 영어를 사용하는 등의 단서가 포함됩니다. 동시에 사용자들은 AI 기술을 활용하여 AI를 통해 콘텐츠를 대량 생성하고 여러 플랫폼에 게시하는 등 수동 소득을 창출하는 방법을 탐색하며, 콘텐츠 생성 및 탐지 양측면에서 AI의 영향을 반영합니다. (출처: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

암호화폐 거래에서 AI의 성능: 암호화폐 시장 AI 모델 거래 실험 결과, 중국 모델(Qwen 3, DeepSeek)이 뛰어난 성능을 보였으며, Qwen 3는 수익이 거의 60% 폭등했고 DeepSeek은 20-30%의 꾸준한 수익을 달성했습니다. 반면 GPT-5와 Gemini는 심각한 손실을 입어 실제 시장에서 다양한 AI 모델의 전략적 차이와 성능을 드러내며, AI 거래 전략과 “성격”에 대한 논의를 촉발했습니다. (출처: 36氪, op7418, teortaxesTex, huybery)

AI 코드 도우미 성능 및 사용자 경험: 사용자들은 Claude Code의 Haiku 4.5가 초고효율성을 보여 Claude Sonnet이 필요 없을 정도로 애플리케이션 개발 속도를 크게 향상시켰다고 극찬합니다. 동시에 사용자들은 ChatGPT 5 Pro에 “즉시 종료” 버튼을 추가하여 모델이 긴 답변을 생성할 때 내용을 잃지 않고 중단할 수 없는 문제를 해결해달라고 요청하며, LLM 사용자 경험 최적화에 대한 지속적인 요구를 반영합니다. (출처: Reddit r/ClaudeAI, sjwhitmore)

AI 에이전트의 자체 수정 및 모니터링: 스탠포드 ACE 프레임워크에서 영감을 받아, 한 사용자는 Claude를 위한 “아키텍트” 역할 플레이북을 작성하여 코드를 자율적으로 수정하고 디버깅할 수 있도록 했습니다. 한편, LangSmith Insights Agent는 사용자 에이전트 궤적을 클러스터링 분석하여 행동 패턴과 잠재적 문제에 대한 통찰력을 제공함으로써 대규모 AI 애플리케이션 데이터의 분석 및 디버깅을 간소화합니다. (출처: Reddit r/ClaudeAI, HamelHusain, hwchase17)

AI 모델 평가 및 개발 과제: 커뮤니티 의견은 현재 AI 모델이 너무 많지만 효과적인 평가가 부족하여 표준화된 벤치마크가 시급하다고 지적합니다. 또한, 연산자와 그 기울기 효과에 대한 자동화된 테스트의 필요성과 AI 총기 탐지 시스템이 감자칩 봉지를 무기로 오인한 사건에 대한 논의가 이루어지며, 실제 배포에서 AI의 안전, 편향 및 견고성 과제를 강조합니다. (출처: Dorialexander, shxf0072, colin_fraser)

AI 산업 해고 및 인재 유출: Meta의 초지능 연구소는 Tian Yuandong 팀을 포함하여 600명을 해고했으며, 이는 해고 시점과 Llama 4.5 훈련 후 “토사구팽” 논란에 대한 내부 질문을 촉발했습니다. Tian Yuandong은 Llama 4에 관여하지 않았다고 해명했으며, 해고가 제품 애플리케이션 및 교차 기능 직책에 영향을 미쳤다고 지적하며 Meta AI 부서의 혼란과 인재 유출을 강조했습니다. (출처: 量子位, Yuchenj_UW)

연구에서의 AI 윤리 및 독창성: 한 연구에 따르면 심층 분석 결과, AI가 작성한 연구 논문 중 표절이 발견된 것은 24%에 불과했습니다. 이 결과는 “예상외로 좋다”고 평가되었으며, AI 생성 연구의 품질과 독창성, 그리고 학계에 미칠 잠재적 영향에 대한 논의를 불러일으켰습니다. (출처: paul_cal)

AGI와 인류 미래에 대한 철학적 탐구: 칭화대학교 Liu Jia 교수는 AGI 진화, 에이전트 개발 및 인류의 미래가 직면할 과제에 대한 10가지 관점을 공유했습니다. 그는 AGI의 “작업 전환” 및 “개방 환경 동적 전략” 특성, AI가 감정적 온도와 의식을 가질 때의 사회적 영향, 그리고 인간-기계 통합 또는 인류 멸종과 같은 미래 가능성에 대해 논의하며, AI의 심오한 영향에 대한 철학적 성찰을 불러일으켰습니다. (출처: 36氪)

Kimi 작문 품질과 OpenAI 경쟁: OpenAI 직원 roon은 Kimi K2의 뛰어난 작문 능력을 칭찬하며, 중국 모델의 작문 능력과 OpenAI의 태도에 대한 커뮤니티 논의를 촉발했습니다. 커뮤니티는 Kimi K2가 방대한 양의 저작권 있는 서적으로 훈련되었을 수 있으며, “아첨하지 않는” 개성이 사용자들에게 인기를 얻고 특정 언어 번역 및 문맥 이해에서 탁월한 성능을 보여 ChatGPT 5의 “거세된” 느낌과 대조된다고 추측합니다. (출처: Reddit r/LocalLLaMA, bookwormengr)

AI 제품 및 개발 동향: Hacker News는 Zed에서 Codex AI 도구가 느리게 작동하는 문제, AI 어시스턴트 뉴스 오보율이 45%에 달하는 문제, Meta가 AI 직원 600명을 해고한 문제 등 다양한 주제를 논의합니다. 이러한 논의는 도구 성능, 정보 정확성, 그리고 AI 투자에 대한 대형 기술 기업의 전략적 조정 등 AI 개발 및 사용상의 과제를 반영합니다. (출처: Reddit r/artificial)

국산 대규모 모델 비즈니스 모델 탐구: 사용자들은 Kimi와 Qwen과 같은 국산 대규모 모델이 Claude, GPT, GLM 4.5의 보급률을 참고하여 구독 기반 가격 책정 모델을 구현할 것을 요구합니다. 이는 국산 대규모 모델의 비즈니스 모델에 대한 커뮤니티의 기대와 사용자 지불 의향 및 시장 경쟁 전략에 대한 논의를 반영합니다. (출처: bigeagle_xd)

💡 기타

SeaweedFS: 고성능 분산 파일 시스템: SeaweedFS는 수십억 개의 파일을 저장하도록 설계된 빠르고 고도로 확장 가능한 분산 파일 시스템입니다. O(1) 디스크 탐색 기능을 갖추고 클라우드 계층화, Kubernetes, S3 API 등을 지원하며, 작은 파일 저장에 최적화되어 있습니다. Master 서버가 볼륨을 관리하고 Volume 서버가 파일 메타데이터를 관리함으로써 높은 동시성과 빠른 접근을 달성하여 다양한 저장 요구 사항에 적합합니다. (출처: GitHub Trending)

NVIDIA Isaac Sim: AI 로봇 시뮬레이션 플랫폼: NVIDIA Isaac Sim은 NVIDIA Omniverse를 기반으로 하는 오픈소스 시뮬레이션 플랫폼으로, AI 기반 로봇 개발, 테스트 및 훈련에 사용됩니다. 다양한 로봇 시스템 형식 가져오기를 지원하고, GPU 가속 물리 엔진 및 RTX 렌더링을 활용하며, 합성 데이터 생성, 강화 학습, ROS 통합 및 디지털 트윈 시뮬레이션 등 엔드투엔드 워크플로우를 제공하여 로봇 개발을 위한 포괄적인 지원을 제공합니다. (출처: GitHub Trending)

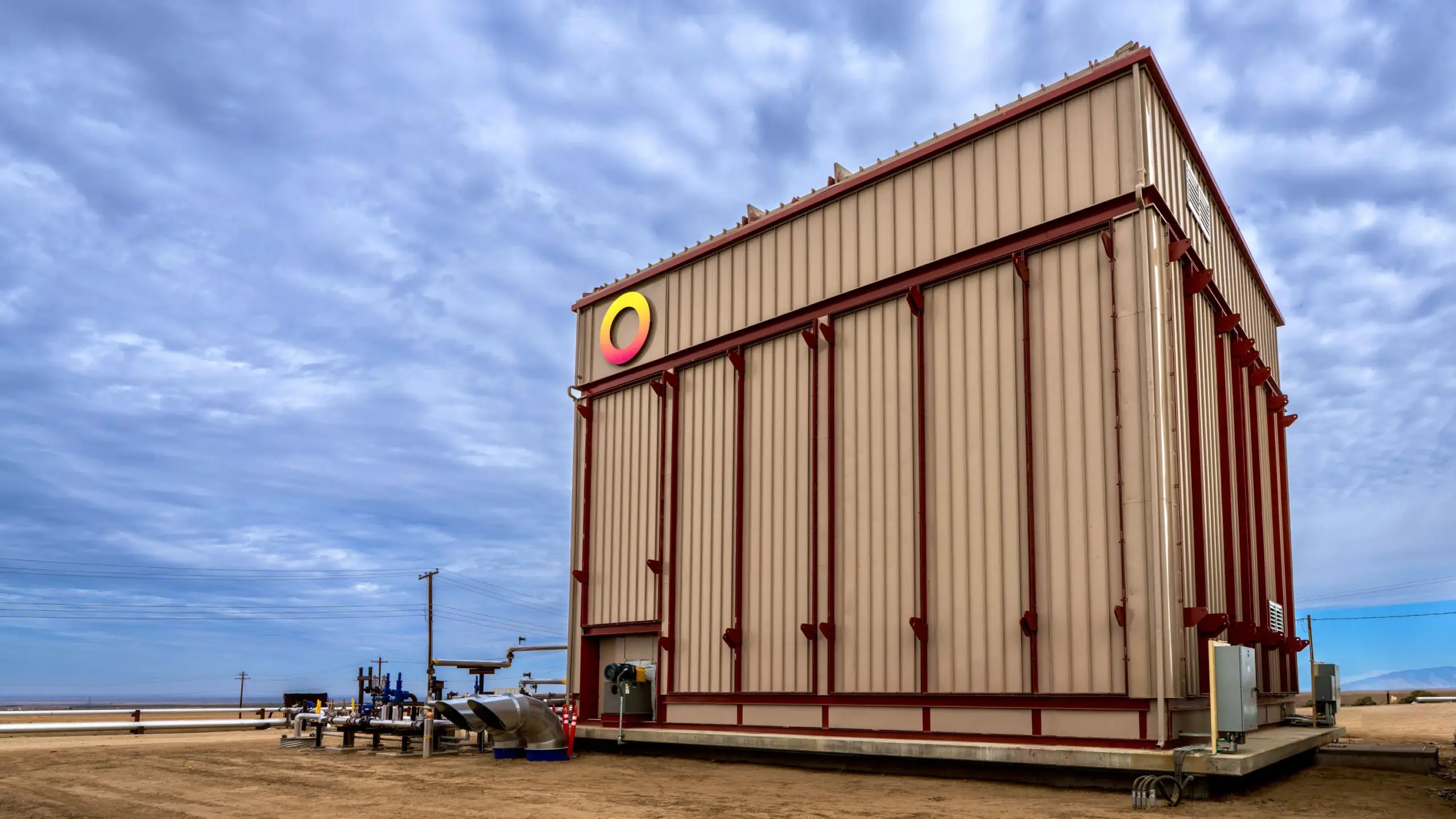

Rondo Energy, 세계 최대 열 배터리 가동 시작: Rondo Energy는 전력을 저장하고 안정적인 열원을 제공하여 산업 탈탄소화에 기여할 것으로 예상되는 자체 주장 세계 최대 열 배터리를 가동하기 시작했습니다. 이 열 배터리는 100MWh 용량과 97% 이상의 효율을 가지며, 10주간 운영되어 기준을 충족했습니다. 강화 유전 회수에 사용되는 것에 대한 논란에도 불구하고, 회사는 이러한 움직임이 기존 화석 연료 운영을 청정화하고 산업 분야에서 에너지 저장 기술의 적용을 촉진할 수 있다고 믿습니다. (출처: MIT Technology Review)