키워드:AI 응용, FDA, OpenAI, GPT-4.1, WebThinker, Runway Gen-4, 엣지 AI, 강화 학습 미세 조정(RFT), 다중 에이전트 프레임워크 DeerFlow, WebThinker-32B-RL, Gen-4 참조 업데이트, 지식 밀도

🔥 주요 소식

미국 FDA, 내부 AI 적용 가속화 발표: 미국 식품의약국(FDA)이 2025년 6월 30일까지 모든 FDA 센터에 인공지능(AI) 사용을 확대할 계획이라는 역사적인 조치를 발표했습니다. 이전에 FDA는 연구 심사관을 대상으로 한 생성형 AI 파일럿 프로젝트를 성공적으로 완료한 바 있습니다. 이번 조치는 AI를 통해 규제 능력을 향상시키고, 임상시험의 속도와 효율성을 높이며 비용을 절감하는 것을 목표로 하며, 정부 규제 및 의약품 승인 분야에서 AI의 중요한 돌파구이자 글로벌 의약품 규제 기관의 AI 도입 추세를 이끌 가능성이 있습니다 (출처: ajeya_cotra)

OpenAI 강화 학습 미세 조정(RFT) 기술 세부 정보 및 GPT-4.1 개발 방향 공개: OpenAI의 GPT-4.1 책임자인 Mich Pokrass가 Unsupervised Learning 팟캐스트에서 RFT의 세부 정보와 GPT-4.1의 개발 과정을 공유했습니다. OpenAI는 GPT-4.1을 구축할 때 기존 벤치마크 테스트보다 개발자 피드백에 더 중점을 두었습니다. RFT는 사고 연쇄 추론과 특정 작업 점수 평가를 활용하여 모델 성능을 향상시키며, 특히 복잡한 분야에 적합하고 현재 OpenAI o4-mini에서 사용할 수 있습니다. 인터뷰에서는 AI 에이전트의 적용 현황, 신뢰성 향상, 스타트업이 평가 및 미래 지향적 제품 전략을 성공적으로 활용하는 방법 등에 대해서도 논의했습니다 (출처: OpenAIDevs, aidan_mclau, michpokrass)

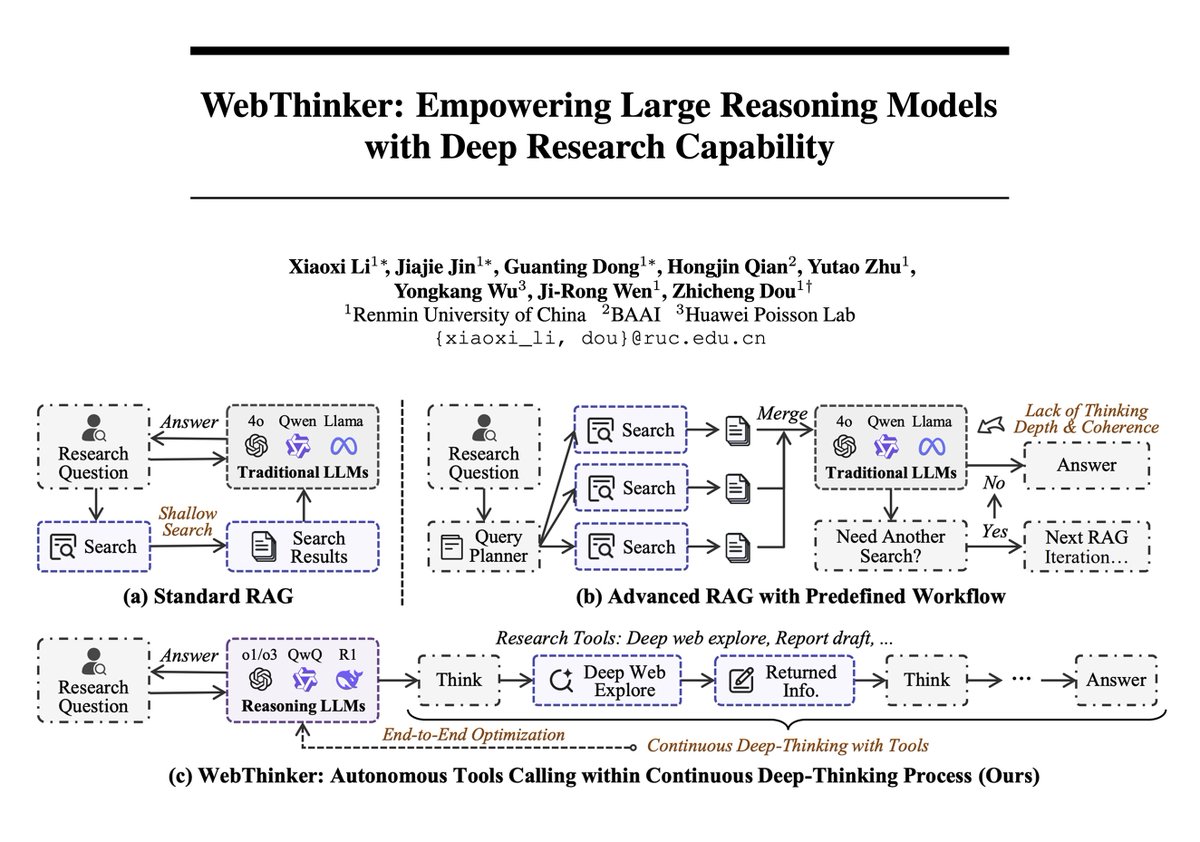

WebThinker 프레임워크, 대형 모델과 심층 웹 연구 능력 결합하여 복잡한 추론의 새로운 지평 열어: 새로운 논문에서 WebThinker가 소개되었습니다. 이는 대규모 추론 모델(LRM)에 자율적인 웹 탐색 및 보고서 작성 기능을 제공하여 정적 내부 지식의 한계를 극복하는 추론 에이전트 프레임워크입니다. WebThinker는 심층 웹 브라우저 모듈과 자율적인 “사고-검색-초안 작성” 전략을 통합하여 모델이 웹을 검색하고 작업을 추론하며 종합적인 결과물을 동시에 생성할 수 있도록 합니다. 이 시스템은 GPQA, GAIA 등 복잡한 추론 벤치마크에서 WebThinker-32B-RL이 32B 모델 중 SOTA 성과를 달성했으며 GPT-4o 등을 능가했습니다. RL 훈련 버전은 모든 벤치마크에서 기본 버전보다 우수한 성능을 보여 반복적인 선호도 학습이 추론-도구 조정 강화에 중요함을 시사합니다 (출처: omarsar0, dair_ai)

Runway, Gen-4 References 업데이트 공개, 비디오 생성의 미학, 구도 및 정체성 유지 능력 향상: Runway Gen-4 References가 업데이트되어 생성된 비디오의 미학적 품질, 장면 구도 및 캐릭터 정체성 일관성이 크게 향상되었습니다. 흥미로운 새로운 기능은 모델이 사용자가 제공한 레이아웃에 따라 장면 내 객체를 정확하게 배치하고, 다른 요소의 일관성을 유지하면서 인물의 시선 방향과 같은 세부 사항까지 수정할 수 있다는 것입니다. 이는 AI 비디오 생성이 제어 가능성과 정교함에서 한 단계 더 발전했음을 의미하며, 창작자에게 더욱 강력한 도구를 제공합니다 (출처: c_valenzuelab, c_valenzuelab)

Mianbi Intelligence CEO Li Dahai: 물리적 세계의 AGI는 온디바이스 인텔리전스를 통해 실현될 것이며, 지식 밀도가 핵심: Mianbi Intelligence CEO Li Dahai는 미래 물리적 세계에서 범용 인공지능(AGI)을 실현하기 위해서는 온디바이스 인텔리전스가 필수 경로라고 생각합니다. 그는 대형 모델의 “지식 밀도”가 지능의 핵심 지표이며, 칩 공정에 비유하여 지식 밀도가 높을수록 지능이 강해진다고 강조했습니다. 고밀도 지식 모델은 컴퓨팅 성능, 메모리, 전력 소비가 제한된 온디바이스 기기에서 자연스러운 이점을 가집니다. Mianbi Intelligence는 이미 여러 온디바이스 모델을 출시했으며, 자동차, 로봇, 휴대폰 등 분야에 적용하고 있습니다. 예를 들어 Mianbi Xiaogangpao Super Assistant는 모든 기기가 지능을 갖추어 민감한 감지, 시기적절한 의사 결정 및 완벽한 대응을 실현하는 것을 목표로 합니다 (출처: 量子位)

🎯 동향

Google Maps, Gemini 기능 활용해 스크린샷 속 지명 인식하는 새 기능 출시: Google Maps가 Gemini의 AI 기능을 활용하여 사용자가 캡처한 스크린샷에 포함된 지명을 인식하고 이를 지도 내 목록에 저장하여 사용자가 언제든지 접근하고 일정을 계획할 수 있도록 하는 새로운 기능을 출시했습니다. 이 기능은 여행 조사 과정을 간소화하고 사용자 경험을 향상시키는 것을 목표로 합니다 (출처: Google)

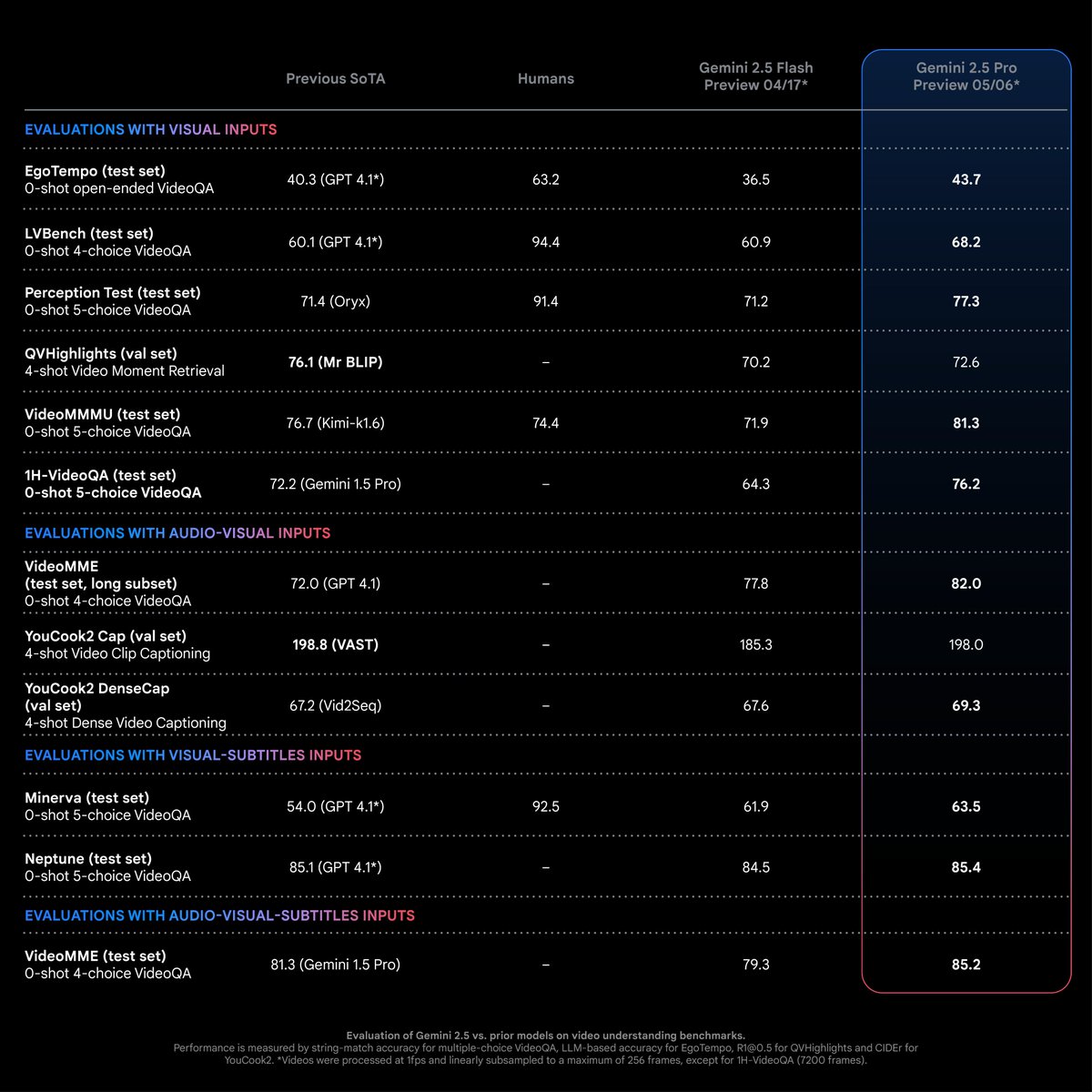

Gemini 2.5 Pro, 비디오 이해 작업에서 SOTA 성능 보여: Logan Kilpatrick에 따르면, Gemini 2.5 Pro (05-06 버전)는 대부분의 비디오 이해 작업에서 업계 최고 수준(SOTA)을 달성했으며 그 우위가 뚜렷합니다. 이는 Gemini 멀티모달 팀의 노력의 결과이며, 개발자들이 이 분야에서 새로운 응용 가능성을 탐색하는 데 기여할 것으로 예상됩니다 (출처: matvelloso)

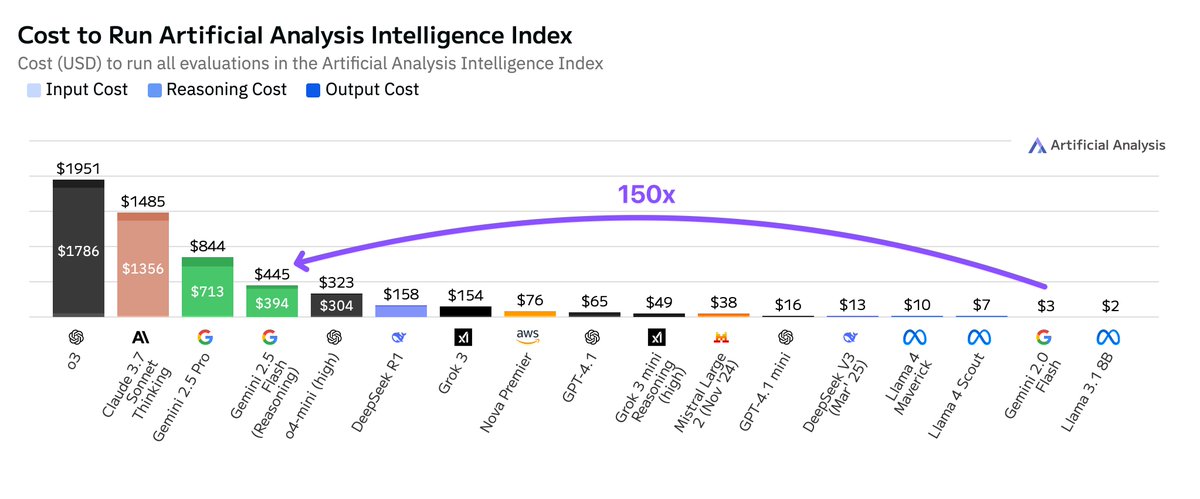

Google Gemini 2.5 Flash 실행 비용, 2.0 버전에 비해 훨씬 높아: Artificial Analysis는 자사의 인텔리전스 지수를 실행할 때 Google Gemini 2.5 Flash의 비용이 Gemini 2.0 Flash의 150배에 달한다고 지적했습니다. 비용 급증은 주로 출력 토큰 가격이 9배 상승(추론 기능 활성화 시 100만 토큰당 3.5달러, 비활성화 시 0.6달러, 2.0 Flash는 0.4달러)하고 토큰 사용량이 17배 증가한 데 기인합니다. 이는 Flash 시리즈 모델의 낮은 지연 시간과 비용 효율성 간의 균형에 대한 논의를 불러일으켰습니다 (출처: arohan)

Google, Gemini Nano AI를 Chrome 브라우저에 통합하여 웹 사기 방지: Google은 Gemini Nano AI 모델을 Chrome 브라우저에 추가하여 브라우저의 온라인 사기 식별 및 차단 능력을 강화하고 사용자 웹 보안을 향상시킬 것이라고 발표했습니다. 이번 조치는 주류 브라우저 보안 기능에 AI 기술을 더욱 폭넓게 적용하는 사례입니다 (출처: Reddit r/artificial, Reddit r/ArtificialInteligence)

Lightricks, LTXVideo 13B 0.9.7 출시, 비디오 품질 및 속도 향상, 양자화 버전 및 잠재 공간 업그레이드 모델 출시: Lightricks가 비디오 모델 LTXVideo를 13B 0.9.7 버전으로 업데이트하여 영화 수준의 비디오 품질과 더 빠른 생성 속도를 제공합니다. 동시에 LTXV 13B 양자화 버전을 출시하여 메모리 요구 사항을 줄여 소비자용 GPU에 적합하도록 했으며, 잠재 공간의 공간 및 시간 업그레이드 모델을 출시하여 다중 스케일 추론을 지원하고 디코딩/인코딩을 줄이면서 고화질 비디오 생성 효율을 높일 수 있도록 했습니다. 관련 ComfyUI 노드 및 워크플로우도 업데이트되었습니다 (출처: GitHub Trending)

Cohere Labs 연구, 테스트 시 확장이 대형 모델의 다국어 추론 성능 개선함을 보여줘: Cohere Labs의 연구에 따르면, 추론 언어 모델이 주로 영어 데이터로 훈련되지만 테스트 시 확장(test-time scaling)을 통해 다국어 환경 및 다양한 분야에서의 제로샷 다국어 추론 성능을 개선할 수 있다고 합니다. 이 연구는 기존 대형 모델의 비영어권 시나리오 적용 효과를 높이는 새로운 아이디어를 제공합니다 (출처: sarahookr)

AI, 얼굴 사진 이용해 생리적 연령 평가하고 암 결과 예측: 새로운 AI 도구가 얼굴 사진을 분석하여 개인의 생리적 연령을 추정하고, 이를 바탕으로 암과 같은 질병의 치료 결과와 생존 확률을 예측할 수 있습니다. 이 기술은 질병 예후 평가에 비침습적인 새로운 방법을 제공합니다 (출처: Reddit r/artificial, Reddit r/ArtificialInteligence, Reddit r/artificial)

AI 모델, 간단한 작업 처리 시 지나치게 복잡하게 생각하는 경향 나타나: 일부 개발자들은 최신 추론 모델이 간단한 작업에 직면했을 때 지나치게 복잡한 사고 과정을 유발하며 “신경 과민” 반응을 보이는 경향이 있음을 발견했습니다. 더 이상적인 방법은 강력한 기본 모델을 갖추고 “사고”라는 도구를 언제 호출할지 동적으로 판단하여 불필요한 계산과 지연을 피하는 것일 수 있습니다 (출처: skirano)

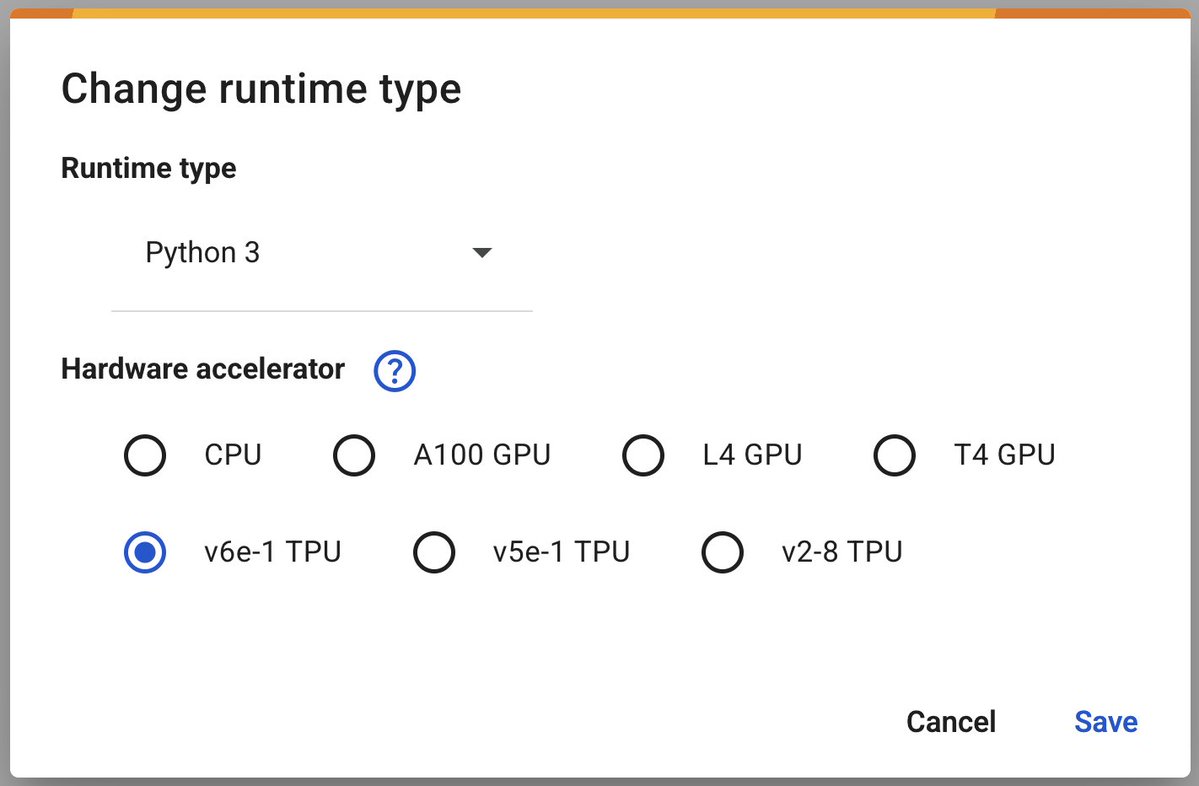

Google Colab, v6e-1 (Trillium) TPU 출시로 딥러닝 가속화: Google Colaboratory가 가장 빠른 딥러닝 가속기인 v6e-1 (Trillium) TPU를 출시한다고 발표했습니다. 이 TPU는 32GB의 고대역폭 메모리(v5e-1의 두 배)를 갖추고 있으며, 최대 성능은 918 BF16 TFLOPS(A100의 거의 세 배)에 달해 연구자와 개발자에게 더욱 강력한 컴퓨팅 리소스를 제공합니다 (출처: algo_diver)

Google AMIE: 멀티모달 대화형 진단 AI 에이전트 시연: Google이 멀티모달 대화형 진단 AI 에이전트 AMIE의 첫 번째 시연을 공유했습니다. AMIE는 멀티모달(예: 텍스트와 이미지 정보 결합) 진단 대화를 수행할 수 있으며, 이는 AI가 의료 진단 보조 분야에서 한층 더 발전했음을 의미합니다 (출처: dl_weekly)

Anthropic, Claude 모델에 “트럼프 승리” 정보 하드코딩했다는 의혹 제기돼: 일부 사용자는 Anthropic의 Claude 모델이 2024년 선거 관련 질문에 답변할 때, 지식 마감일이 2024년 10월임에도 불구하고 트럼프가 승리했다는 정보가 하드코딩된 것처럼 보인다고 발견했습니다. 이는 AI 모델의 정보 업데이트 메커니즘, 잠재적 편향, 그리고 하드코딩된 내용이 사용자 신뢰에 미치는 영향에 대한 논의를 불러일으켰습니다 (출처: Reddit r/ClaudeAI)

🧰 도구

ByteDance, 멀티 에이전트 프레임워크 DeerFlow 오픈소스 공개: ByteDance가 LangChain 기반의 멀티 에이전트(Multi-Agent) 프레임워크인 DeerFlow를 오픈소스로 공개했습니다. 이 프레임워크는 멀티 에이전트 애플리케이션 개발을 단순화하고 가속화하며, 복잡한 협업형 AI 시스템 구축 도구를 제공합니다. 개발자는 GitHub 리포지토리와 공식 웹사이트에서 더 많은 정보와 예제를 얻을 수 있습니다 (출처: hwchase17)

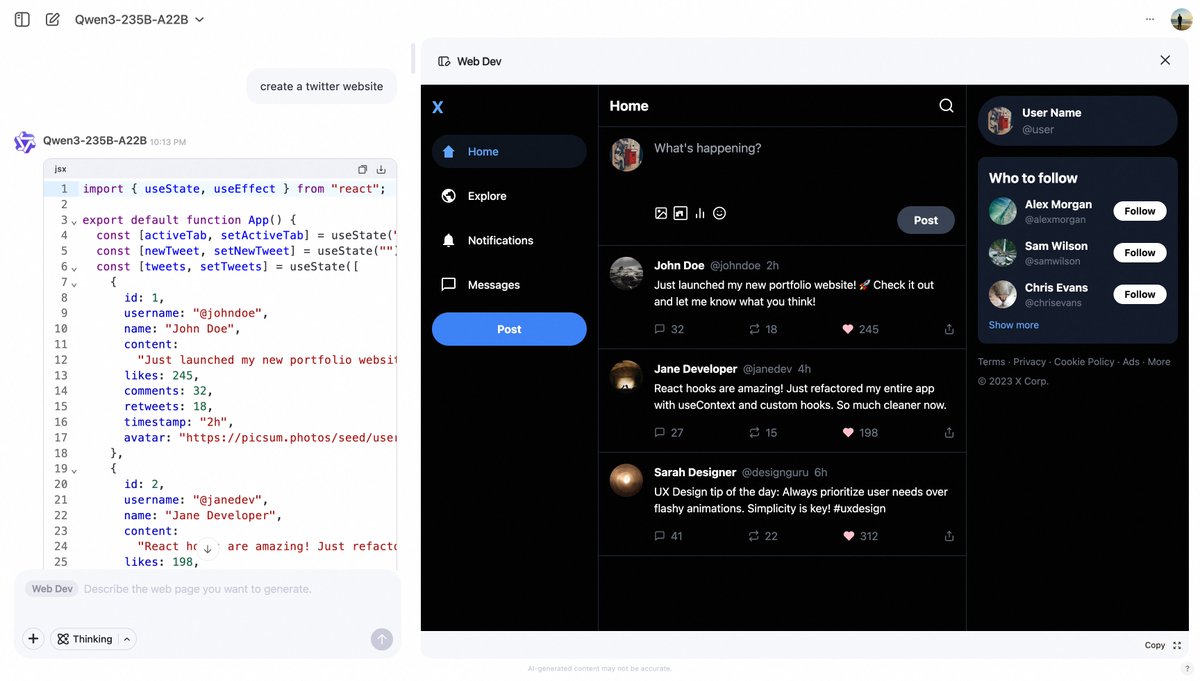

Alibaba Qwen Chat, 프롬프트로 웹 페이지 생성하는 Web Dev 기능 출시: Alibaba Qwen Chat에 “Web Dev” 기능이 추가되어 사용자가 간단한 텍스트 프롬프트(예: “트위터 웹사이트 만들기”)를 통해 프론트엔드 웹 페이지 및 애플리케이션 코드를 빠르게 생성할 수 있게 되었습니다. 이 기능은 웹 개발의 장벽을 낮춰 프로그래밍 지식이 없는 사용자도 자연어를 통해 웹사이트를 구축할 수 있도록 하는 것을 목표로 합니다 (출처: Alibaba_Qwen, huybery)

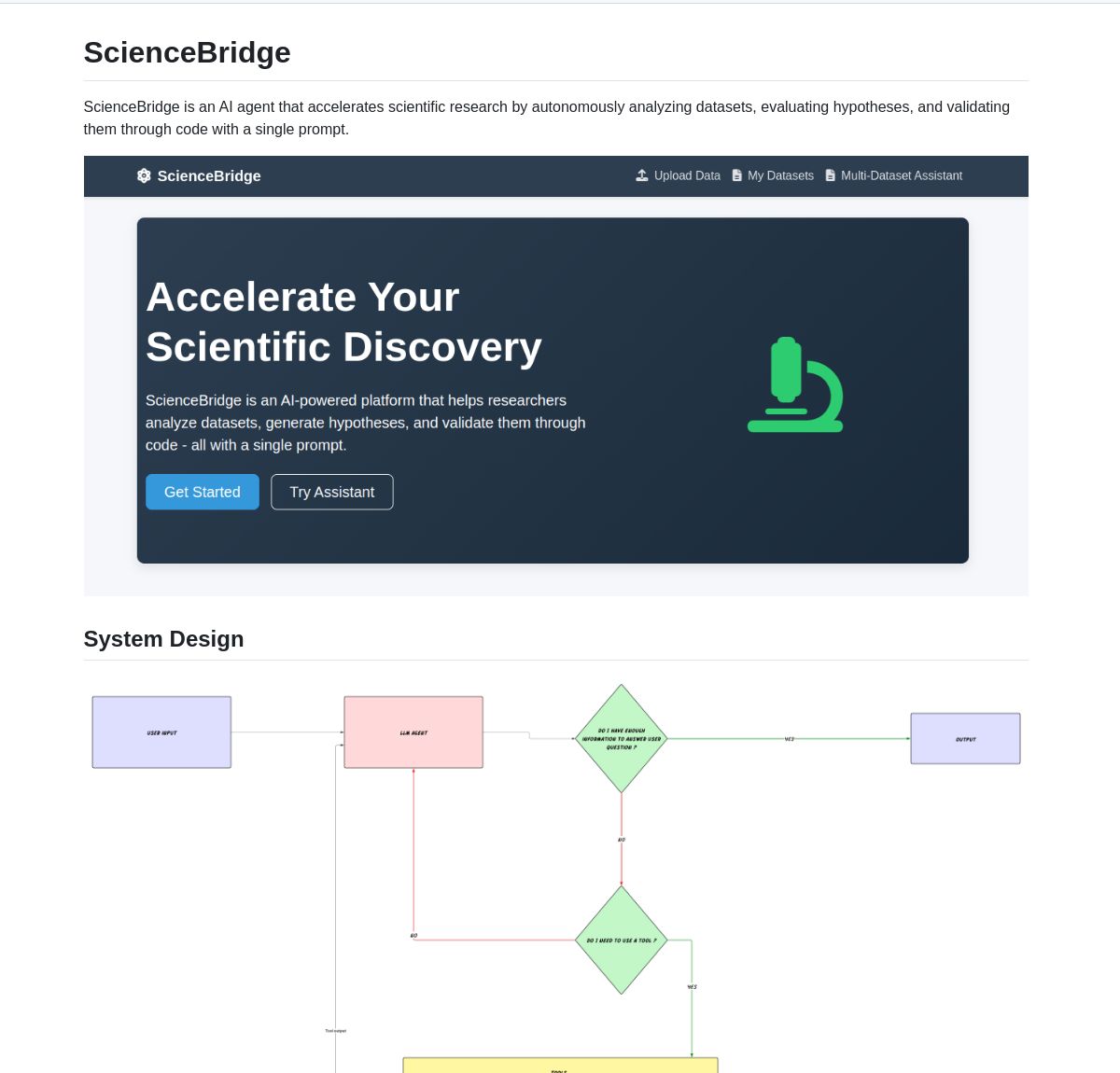

ScienceBridge AI: LangGraph 기반 과학 연구 자동화 에이전트: ScienceBridge AI라는 에이전트는 LangGraph 프레임워크를 활용하여 데이터 분석, 가설 검증을 포함한 과학 연구 워크플로우를 자동화하고 출판 수준의 시각화 결과를 생성하여 과학적 발견을 가속화하는 것을 목표로 합니다. 이 프로젝트는 GitHub에 오픈소스로 공개되었습니다 (출처: LangChainAI, hwchase17)

El Agente Q: LangGraph 기반 멀티 에이전트 시스템, 양자 화학 역량 강화: 새로운 연구에서 LangGraph 기반 멀티 에이전트 시스템인 El Agente Q가 소개되었습니다. 이 시스템은 자연어 상호 작용을 통해 양자 화학 계산을 대중화하고 복잡한 워크플로우 자동화에서 87%의 성공률을 달성했습니다. 관련 논문은 arXiv에 게재되어 AI가 양자 화학 연구를 가속화하는 잠재력을 보여줍니다 (출처: LangChainAI, hwchase17)

LocalSite: 로컬 LLM을 활용하여 웹 페이지를 만드는 로컬화된 DeepSite 대체재: HuggingFace의 DeepSite 프로젝트에서 영감을 받은 LocalSite 도구는 사용자가 로컬에서 실행되는 LLM(예: Ollama 및 LM Studio를 통해 배포된 GLM-4, Qwen3 등 모델) 및 OpenAI 호환 API를 사용하는 클라우드 기반 LLM을 통해 텍스트 프롬프트로 웹 페이지 및 UI 구성 요소를 만들 수 있도록 합니다. 이 프로젝트는 GitHub에 오픈소스로 공개되었으며, 로컬화되고 사용자 정의 가능한 AI 웹 페이지 생성 솔루션을 제공하는 것을 목표로 합니다 (출처: Reddit r/LocalLLaMA)

오픈소스 NotebookLM 대체재, 오픈소스 기술력 과시: 개발자 m_ric이 Google NotebookLM의 오픈소스 무료 버전을 만들었습니다. 이 애플리케이션은 PDF 또는 URL 콘텐츠를 추출하고, Meta의 Llama 3.3-70B(Cerebras Systems를 통해 초당 1000 토큰 속도로 실행)를 활용하여 팟캐스트 스크립트를 작성하며, Kokoro-82M을 사용하여 텍스트 음성 변환을 수행합니다. 오디오 생성은 HuggingFace H200s에서 Zero GPU로 무료 실행되어 오픈소스 솔루션이 기능 및 비용 효율성 면에서 폐쇄형 솔루션과 견줄 수 있음을 보여줍니다 (출처: huggingface, mervenoyann)

DeepFaceLab: 선도적인 오픈소스 Deepfake 제작 소프트웨어: DeepFaceLab은 Deepfake 콘텐츠 제작을 전문으로 하는 유명한 오픈소스 소프트웨어입니다. 얼굴 교체, 노화 방지, 머리 교체 등의 기능을 제공하며 YouTube, TikTok 등 플랫폼의 콘텐츠 제작에 널리 사용됩니다. 이 프로젝트는 지속적으로 업데이트되며 Windows 및 Linux 버전을 제공하고 활발한 커뮤니티 지원을 받고 있습니다 (출처: GitHub Trending)

GPUI Component: GPUI 기반 Rust 데스크톱 UI 컴포넌트 라이브러리: longbridge 팀이 GPUI Component를 출시했습니다. 이는 macOS, Windows 컨트롤 및 shadcn/ui에서 영감을 받아 디자인된 40개 이상의 크로스 플랫폼 데스크톱 UI 컴포넌트를 포함하는 라이브러리입니다. 다중 테마, 반응형 크기, 유연한 레이아웃(Dock 및 Tiles)을 지원하며 대용량 데이터 렌더링(가상화된 Table/List) 및 콘텐츠 렌더링(Markdown/HTML)을 효율적으로 처리합니다. 첫 번째 적용 사례는 Longbridge Pro 데스크톱 애플리케이션입니다 (출처: GitHub Trending)

Ultralytics YOLO11: 선도적인 객체 감지 및 컴퓨터 비전 모델 프레임워크: Ultralytics는 YOLO 모델 시리즈를 지속적으로 업데이트하고 있으며, 최신 YOLO11은 객체 감지, 추적, 분할, 분류 및 자세 추정 등의 작업에서 SOTA 성능을 제공합니다. 이 프레임워크는 사용하기 쉽고 CLI 및 Python 인터페이스를 지원하며 Weights & Biases, Comet ML, Roboflow, OpenVINO 등 플랫폼과 통합됩니다. Ultralytics HUB는 코드 없는 데이터 시각화, 훈련 및 배포 솔루션을 제공합니다. 모델은 AGPL-3.0 오픈소스 라이선스를 사용하며 상업용 라이선스도 제공합니다 (출처: GitHub Trending)

Tensorlink: PyTorch 모델 분산 및 P2P 리소스 공유 프레임워크: SmartNodes Lab이 Tensorlink를 출시했습니다. 이는 대규모 PyTorch 모델의 분산 훈련 및 추론을 단순화하기 위한 오픈소스 프레임워크입니다. 핵심 PyTorch 객체를 캡슐화하여 분산 시스템의 복잡성을 추상화함으로써 사용자가 전문 지식이나 하드웨어 없이 여러 컴퓨터의 GPU 리소스를 활용할 수 있도록 합니다. Tensorlink는 온디맨드 추론 API 및 노드 프레임워크를 지원하여 사용자가 컴퓨팅 성능을 공유하거나 기여할 수 있도록 하며, 현재 초기 버전입니다 (출처: Reddit r/MachineLearning)

프롬프트 최적화로 애니메이션 피규어 사진 생성: 사용자가 프롬프트를 최적화하여 AI(예: GPT-4o)를 통해 업로드한 인물 사진을 일본 애니메이션 스타일의 피규어 사진으로 생성한 사례를 공유했습니다. 핵심은 피규어의 자세, 표정, 의상, 재질(예: 반무광), 색상 그라데이션 및 촬영 시점(책상 위, 휴대폰 스냅 사진 느낌)을 정확하게 묘사하는 것입니다. 추가적인 최적화에는 여러 각도(정면, 측면, 후면) 뷰를 생성하여 4분할 격자 형태로 배열하고, 피규어 전신과 받침대 디테일의 완전성을 보장하여 후속 3D 모델링을 용이하게 하는 것이 포함됩니다 (출처: dotey, dotey)

NVIDIA Agent Intelligence Toolkit 오픈소스 공개: NVIDIA가 지능형 에이전트 애플리케이션 구축을 위한 리소스 라이브러리인 Agent Intelligence Toolkit을 오픈소스로 공개했습니다. 이 툴킷은 개발자가 NVIDIA 기술 기반의 AI 에이전트를 보다 편리하게 만들고 배포할 수 있도록 지원하는 것을 목표로 합니다 (출처: nerdai)

SkyPilot과 SGLang으로 다중 노드 Llama 4 자체 호스팅 배포 간소화: Nebius AI는 SkyPilot과 SGLang(LMSYS.org 제공)을 사용하여 단일 명령으로 다중 노드(예: 8x H100)에서 Meta의 Llama 4 모델을 자체 호스팅하는 방법을 시연했습니다. 이 솔루션은 높은 처리량, 효율적인 메모리 사용을 제공하며 인증, HTTPS 등 프로덕션 수준의 기능을 통합하는 동시에 Simon Willison의 llm 도구와 쉽게 통합됩니다 (출처: skypilot_org)

📚 학습

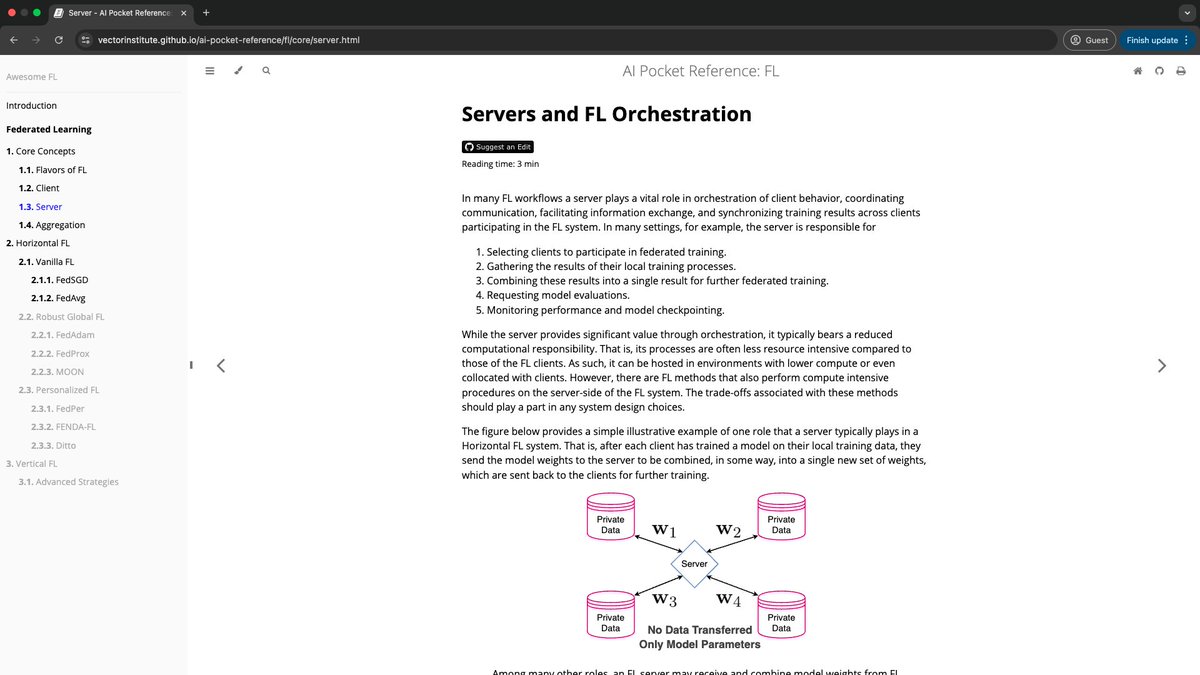

Vector Institute, AI Pocket References 출시: Vector Institute의 AI 엔지니어링 팀이 AI Pocket References 프로젝트를 발표했습니다. 이는 NLP(특히 LLM), 연합 학습, 책임감 있는 AI 및 고성능 컴퓨팅과 같은 분야를 다루는 간결한 AI 정보 카드 시리즈입니다. 이러한 참고 자료는 초보자에게 입문 지침을 제공하고 숙련된 실무자에게 빠른 복습을 제공하는 것을 목표로 하며, 각 자료의 읽기 시간은 7분 이내로 설계되었습니다. 이 프로젝트는 오픈소스로 공개되었으며 커뮤니티 기여를 환영합니다 (출처: nerdai)

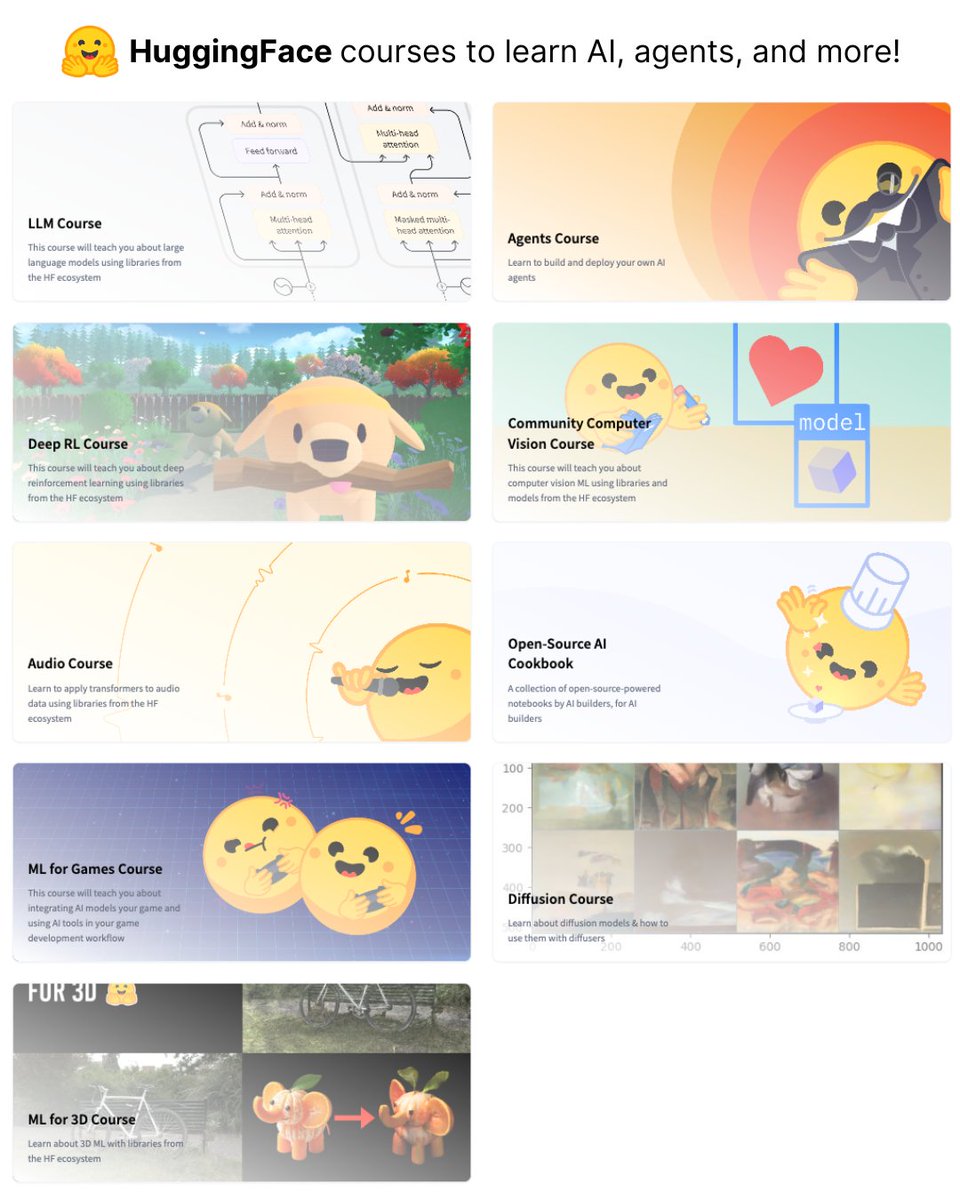

HuggingFace, 9개 무료 AI 강좌 공개: HuggingFace가 대규모 언어 모델(LLM), 컴퓨터 비전, AI 에이전트 등 다양한 분야를 다루는 총 9개의 무료 AI 강좌 시리즈를 출시했습니다. 이 강좌들은 AI 지식을 체계적으로 배우고자 하는 학습자들에게 귀중한 리소스를 제공합니다 (출처: ClementDelangue)

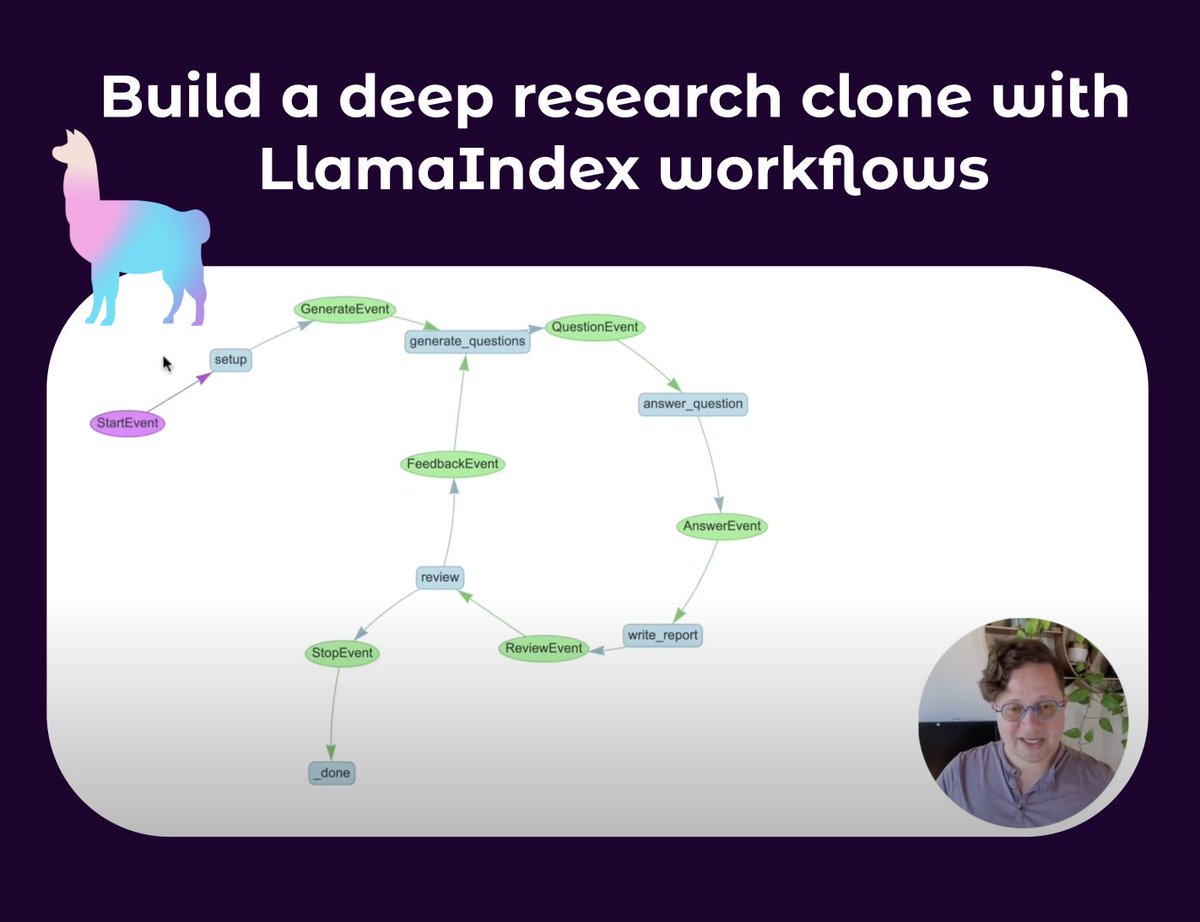

LlamaIndex, 심층 연구 에이전트 구축 튜토리얼 공개: LlamaIndex의 Seldo가 Deep Research와 유사한 클론 에이전트를 구축하는 방법을 안내하는 비디오 튜토리얼을 공개했습니다. 튜토리얼은 단일 에이전트 기본 지식부터 시작하여 여러 지식 베이스와 네트워크를 사용한 연구, 컨텍스트 유지, 연구, 작성 및 검토의 전체 프로세스 구현을 포함하는 고급 다중 에이전트 워크플로우까지 점진적으로 심층적으로 다룹니다. 튜토리얼은 순환, 분기, 동시 실행 및 자기 성찰과 같은 기능을 갖춘 복잡한 에이전트 워크플로우 구축을 강조합니다 (출처: jerryjliu0, jerryjliu0)

RAG 기술 발전 회고: Lewis 등 논문과 초기 연구: Aran Komatsuzaki는 Lewis 등의 2020년 논문이 RAG(Retrieval-Augmented Generation)라는 용어를 제시하여 널리 인용되지만, 검색 증강 생성 자체는 그 이전부터 활발한 연구 분야였으며 DrQA (2017), ORQA (2019), REALM (2020) 등의 연구가 있었다고 지적했습니다. Lewis 등의 주요 기여는 새로운 RAG 공동 사전 훈련 방법을 제안한 것이지만, 오늘날 가장 일반적으로 사용되는 RAG 구현 방식은 아닙니다. 이는 기술 발전의 연속성과 초기 기반 연구의 중요성에 주목해야 함을 시사합니다 (출처: arankomatsuzaki)

Qwen3으로 Gemini 2.5 Pro와 유사한 사고 연쇄 출력 형식 구현: Apriel-Nemotron-15b-Thinker README에서 모델이 특정 형식(예: “Here are my reasoning steps:\n”)으로 출력을 시작하도록 강제하는 내용에 영감을 받아, 한 개발자가 OpenWebUI 기능을 통해 Qwen3 모델이 출력 시 항상 <think>\nMy step by step thinking process went something like this:\n1.로 시작하도록 만들었습니다. 실험 결과, 이는 Qwen3이 Gemini 2.5 Pro와 유사한 단계별 방식으로 사고하고 출력하도록 유도하는 것으로 나타났습니다. 비록 이것이 모델의 지능을 향상시키지는 않지만, 사고하고 표현하는 형식을 변경했습니다 (출처: Reddit r/LocalLLaMA)

Claude Code 디자인 철학 및 개발 비하인드 스토리 팟캐스트 공유: Latent Space 팟캐스트에서 Claude Code 제작자인 Catherine Wu와 Boris Cherny를 초대하여 이 AI 프로그래밍 도구의 디자인 철학과 개발 스토리를 공유했습니다. 주요 내용으로는 CC가 이미 자체 코드의 약 80%를 작성할 수 있다는 점(인간 검토), Aider에서 영감을 받아 간결한 구현(예: 벡터 라이브러리 대신 Markdown 파일 사용)에 중점을 둔다는 점, 소규모 팀과 내부 반복을 통해 제품을 추진한다는 점, 고급 사용자를 위해 원시 모델 액세스를 제공하고 병렬 워크플로우를 지원한다는 점 등이 있습니다. 팟캐스트에서는 Cursor, Windsurf 등 도구와의 비교, 비용, UI/UX 디자인, 오픈소스 가능성 등의 주제도 논의되었습니다 (출처: Reddit r/ClaudeAI)

💼 비즈니스

Salesforce, 5억 달러 규모 사우디 AI 계획 착수 및 팀 구성: Salesforce가 사우디아라비아에서 5억 달러 규모의 5개년 계획의 일환으로 팀 구성을 시작했습니다. 이는 해당 국가의 인공지능 도입 및 발전을 촉진하기 위한 것입니다. 이는 대형 기술 기업들이 중동 지역 AI 분야에 진출하는 또 다른 중요한 움직임입니다 (출처: Reddit r/artificial, Reddit r/ArtificialInteligence)

OpenAI 애플리케이션 부문 신임 CEO Fidji Simo, Shopify 이사회 사임 예정: 현 Instacart CEO인 Fidji Simo가 OpenAI 신설 애플리케이션 부문 CEO로 임명된 후 Shopify 이사회 직을 사임할 예정입니다. 이번 조치는 OpenAI에서 빠르게 성장하는 사업 및 제품 라인을 관리하는 리더십 역할에 더욱 집중하기 위한 것으로 보입니다. 앞서 OpenAI가 Arm과 10억 달러 규모의 잠재적 거래를 체결할 수 있다는 보도가 있었습니다 (출처: steph_palazzolo, steph_palazzolo)

Lux Capital, 예산 삭감 위기에 처한 미국 과학자 지원 위해 1억 달러 펀드 조성: 미국 국립과학재단(NSF) 예산이 대폭 삭감(50%에 달하며 진행 중인 프로젝트 취소, 인력 감축 초래)되는 어려움에 대응하기 위해 Lux Capital은 “Lux 과학 도움 핫라인”을 출범하고 영향을 받는 미국 과학자들을 지원하기 위해 1억 달러를 투입한다고 발표했습니다. 이는 핵심 과학 연구 프로젝트의 지속적인 진행을 보장하고 미국의 기술 혁신 경쟁력을 유지하는 것을 목표로 합니다 (출처: ylecun, riemannzeta)

🌟 커뮤니티

AI가 인간의 일자리를 대체할 것인가에 대한 논의 지속: 커뮤니티에서는 AI가 대규모 실업을 초래할 것인지에 대한 논의가 활발합니다. 한 가지 관점은 자본주의 하에서 기업이 효율성을 추구하며 AI로 값비싼 인력을 대체하여 프로그래머와 같은 일자리가 줄어들 것이라는 것입니다. 다른 관점은 역사를 참고하여 기술 발전(예: 전등이 등불 관리인을 대체)이 기존 일자리를 없애는 동시에 새로운 일자리(예: 전구 공장, 전력 관련 산업)를 창출할 것이며, 핵심은 기술 향상과 혁신에 있다고 주장합니다. 현재 AI는 복잡한 작업과 코드 디버깅에서 여전히 인간의 개입이 필요하지만, 빠른 발전과 특정 분야에서의 높은 효율성으로 인해 많은 사람들이 미래 고용 전망에 대해 우려하고 있으며, 다른 사람들은 이것이 과장된 우려이거나 AI 능력에 대한 단기적인 과대평가라고 생각합니다 (출처: Reddit r/ArtificialInteligence)

LLM 능력 상한선 및 AI 겨울에 대한 우려: 일부 커뮤니티 구성원과 전문가(예: Yann LeCun, François Chollet)들은 대규모 언어 모델(LLM)이 병목 현상에 직면하고 있는지에 대해 논의하기 시작했습니다. LLM은 패턴 모방에서 뛰어난 성능을 보이지만, 실제 이해, 추론 및 환각 문제 처리에는 여전히 한계가 있으며 합성 데이터에 대한 과도한 의존도 문제를 야기할 수 있습니다. 새로운 연구 방향(예: 세계 모델, 신경 기호 시스템)이 없다면 현재의 AI 열풍이 식어 투자 감소로 이어지고 새로운 “AI 겨울”을 유발할 수도 있습니다. 그러나 범용 LLM이 한계에 도달할 수 있지만, 특수 목적 모델과 AI 에이전트는 여전히 빠르게 발전하고 있다는 의견도 있습니다 (출처: Reddit r/ArtificialInteligence)

OpenAI 여름 오픈소스 모델 출시 계획, 커뮤니티 논의 촉발: Sam Altman은 상원 증언에서 OpenAI가 올여름 오픈소스 모델을 출시할 계획이라고 밝혔습니다. 이에 대한 커뮤니티 반응은 엇갈립니다. 일부는 성능을 기대하는 반면, 일부는 Musk의 FSD처럼 “영원히 개발 중”이거나 유료 모델과의 경쟁을 피하기 위해 “기능이 제한”될 것이라고 의문을 제기합니다. 또한 Meta와 Alibaba와 같은 회사들이 고품질 무료 사전 훈련 모델을 출시하여 OpenAI와 같은 회사의 시장 지위를 약화시키려는 의도이며, OpenAI의 이번 조치는 이에 대한 대응 전략일 수 있다고 분석하는 사람들도 있습니다. 그러나 OpenAI의 비즈니스 모델과 높은 운영 비용을 고려할 때, 오픈소스 모델의 포지셔닝과 경쟁력은 아직 지켜봐야 할 문제입니다 (출처: Reddit r/LocalLLaMA)

AI가 인터넷 정보 신뢰성에 미치는 영향 우려: 사용자들이 Reddit에서 AI가 인터넷 신뢰성에 미치는 영향에 대해 우려를 표명했습니다. 특히 Google AI 개요와 같은 기능은 때때로 부정확하거나 “진지하게 헛소리하는” 답변(예: 사용자가 지어낸 문구에 대한 설명)을 제공하여 다음 세대 사용자를 오도하고 심지어 모든 정보에 대해 의심하게 만들 수 있습니다. 댓글에서는 이에 대한 의견이 분분합니다. 일부는 인터넷이 결코 완전히 신뢰할 수 없었으며 비판적 사고가 항상 중요하다고 생각하는 반면, 일부는 게시자가 나이를 드러냈다고 농담하기도 합니다 (출처: Reddit r/ArtificialInteligence)

ChatGPT와의 대화로 우울감 완화 경험 공유: 한 사용자가 ChatGPT와 장시간 대화한 후 우울감과 자살 충동이 완화된 경험을 공유했습니다. 그는 AI에게 털어놓는 것만으로도 엄청난 심리적 압박감을 해소하고 계속 나아가 친척과 친구들에게 도움을 요청할 용기를 얻었다고 말했습니다. 댓글에는 비슷한 경험을 한 많은 사람들이 AI가 심리 지원 측면에서 편견 없고 인내심 있는 동반자 역할을 할 수 있다고 생각하며, 심지어 ChatGPT에게 “더 높은 자아” 역할을 하도록 하여 심도 있는 대화를 나눈 프롬프트를 공유한 사용자도 있었습니다. 이는 AI가 정신 건강 보조 분야에서 잠재력을 가지고 있다는 논의를 불러일으켰습니다 (출처: Reddit r/ChatGPT)

“LLM은 다음 단어를 예측할 뿐”이라는 주장에 대한 반성: 커뮤니티에서는 “LLM은 다음 단어를 예측할 뿐”이라는 말이 지나치게 단순화되어 LLM의 실제 능력과 잠재적 영향을 과소평가하게 만들기 쉽다는 논의가 있었습니다. 핵심은 LLM이 생성하는 내용(예: 코드, 분석)의 복잡성과 실용성이지, 생성 메커니즘이 아닙니다. 전문가들은 AI의 빠른 발전과 미지의 능력에 대해 우려를 표명하는 반면, 일반 대중은 이러한 단순화된 주장으로 인해 AI 기술이 곧 가져올 심오한 변화를 충분히 인식하지 못할 수 있습니다. 논의는 또한 AI의 “지능”과 “의식” 문제에 대해서도 다루었으며, AI가 인간적인 의미의 의식을 갖지 않더라도 그 능력은 세계에 막대한 영향을 미치기에 충분하다고 주장했습니다 (출처: Reddit r/ArtificialInteligence)

Claude 유료 버전 가치 논의: 프로젝트 관리, 컨텍스트 길이 및 사고방식이 핵심: Claude 유료 사용자들이 구독 가치를 공유했습니다. 주요 장점으로는 특정 작업(예: 강의 준비, 웹사이트 SEO, 광고 분석, 뉴스 요약, 레시피 검색)을 위해 대량의 배경 자료(지식 베이스)를 업로드하여 Claude가 특정 컨텍스트에서 지속적으로 도움을 제공할 수 있도록 하는 “프로젝트(Projects)” 기능이 있습니다. 또한 더 큰 컨텍스트 창, 더 강력한 “사고 모드(Thinking Mode)” 및 더 많은 쿼리 횟수도 유료 구독의 매력입니다. 사용자 피드백에 따르면 복잡한 작업, 코드 검토, 문서 분석 및 이메일 초안 작성에서 Claude Pro는 MCP 도구(예: Desktop Commander)와 결합하여 일부 IDE 통합 솔루션보다 우수한 성능을 보였으며, 후자는 비용 최적화 또는 내장 시스템 프롬프트로 인해 모델의 심층 분석 능력이 제한될 수 있습니다 (출처: Reddit r/ClaudeAI, Reddit r/ClaudeAI)

OpenWebUI 라이선스 변경, 커뮤니티 및 기업 사용자 우려 야기: OpenWebUI 프로젝트가 최근 소프트웨어 라이선스를 변경하여 일부 커뮤니티 구성원과 기업 사용자의 우려를 낳았습니다. 일부 회사는 해당 프로젝트 사용 및 기여 중단을 논의 중이며 마지막 BSD 라이선스 버전을 기반으로 임시 분기할 것이라고 밝혔습니다. 이 사건은 오픈소스 프로젝트 라이선스 변경이 사용자 및 기여자 생태계, 특히 상업적 애플리케이션 시나리오에 미칠 수 있는 영향을 강조합니다 (출처: Reddit r/OpenWebUI)

💡 기타

바티칸, “데이터 장벽” 문제 해결 위해 새로운 데이터 소스 투자 계획: 2023년부터 대규모 언어 모델 훈련은 “데이터 장벽” 문제에 직면해 왔습니다. 즉, 알려진 대부분의 인간 텍스트 데이터가 이미 색인화되고 훈련되었습니다. 이 문제를 해결하기 위해 바티칸은 OCR 기술을 통해 중세 교회 문헌을 전사하고 합성 데이터를 생성하는 등 새로운 데이터 소스에 투자하여 AI 모델의 능력을 지속적으로 향상시킬 계획입니다 (출처: jxmnop, Dorialexander)

중국 기술 발전 급속, 여러 분야 혁신 주목: 한 게시물에서 저자가 중국 15일 일정 동안 관찰한 DeepSeek 섹스돌, 전기 비행선, 교통사고 처리에 사용되는 드론 등 여러 놀라운 기술 적용 사례를 자세히 열거했습니다. 이는 중국의 인공지능, 로봇, 신에너지 교통 등 분야의 기술 발전 속도와 적용 범위에 대한 논의를 불러일으켰으며 싱가포르 등 첨단 기술 국가와 비교되었습니다 (출처: GavinSBaker)

AI 의료 분야 발전에 대한 기대: 커뮤니티 구성원들은 AI가 의료 분야에서 더 큰 진전을 이루기를 기대한다고 밝혔습니다. 즉시 신체를 스캔하고 질병 초기 단계에서 증상을 감지할 수 있는 AI 로봇, 정밀 치료, 수술 및 회복 가속화를 보조할 수 있는 시스템 등이 구상됩니다. 기존 기술이 일부 측면에서 진전을 이루었지만, 사람들은 일반적으로 AI가 의료 접근성, 정확성 및 생명 구조 측면에서 아직 발굴되지 않은 막대한 잠재력을 가지고 있다고 생각합니다 (출처: Reddit r/ArtificialInteligence, Reddit r/artificial)