키워드:OpenAI, AI 모델, 대형 언어 모델, AI 인프라, AI 검색, AI 에이전트, AI 상용화, OpenAI 애플리케이션 부문 CEO, OpenAI for Countries 프로그램, AI 기반 검색 대안, Mistral Medium 3 멀티모달 모델, AI와 정신건강 위험

🔥 주요 뉴스

OpenAI, 애플리케이션 부문 이끌 새로운 CEO 임명: OpenAI는 전 Instacart CEO인 Fidji Simo를 새로운 애플리케이션 부문 CEO로 임명했다고 발표했으며, Sam Altman에게 직접 보고하게 됩니다. Altman은 OpenAI의 총 CEO직을 계속 맡지만, 특히 슈퍼인텔리전스로 나아가는 중요한 단계에서 연구, 컴퓨팅 및 안전에 더욱 집중할 것입니다. Simo는 이전에 OpenAI 이사회에서 활동했으며 풍부한 제품 및 운영 경험을 보유하고 있습니다. 이번 임명은 OpenAI의 제품화 및 상업화 역량을 강화하고 연구 성과를 전 세계 사용자에게 더 잘 제공하기 위한 것입니다. 이는 OpenAI가 급속한 발전과 치열한 경쟁 속에서 연구, 인프라 및 애플리케이션 구현의 균형을 맞추기 위한 조직 구조 조정으로 간주됩니다. (출처: openai, gdb, jachiam0, kevinweil, op7418, saranormous, markchen90, dotey, snsf, 36氪)

OpenAI, “OpenAI for Countries” 프로그램 시작, 글로벌 AI 인프라 확장: OpenAI는 “OpenAI for Countries” 프로그램을 시작한다고 발표했습니다. 이 프로그램은 전 세계 국가들과 협력하여 현지화된 AI 인프라를 구축하고 소위 “민주적 AI”를 확산하는 것을 목표로 합니다. 이 계획에는 해외 데이터 센터 건설(자사의 “스타게이트” 프로젝트의 연장선), 현지 언어 및 문화에 맞는 ChatGPT 버전 출시, AI 안전성 강화, 국가급 스타트업 펀드 설립 등이 포함됩니다. 이는 글로벌 AI 경쟁이 심화되는 가운데 OpenAI가 기술 리더십을 공고히 하고 글로벌 영향력을 확대하기 위한 전략적 조치로 간주되며, 동시에 글로벌 인재 및 데이터 자원을 확보하여 AGI 연구 개발을 가속화하는 데 도움이 될 수 있습니다. (출처: 36氪, 36氪)

AI 주도 검색 혁신, Apple Safari에 AI 검색 대안 도입 고려: Apple 서비스 부문 수석 부사장 Eddy Cue는 Google 반독점 소송 증언에서 Apple이 Safari 브라우저에 AI 기반 검색 엔진 옵션을 도입하는 것을 “적극적으로 고려”하고 있으며 Perplexity, OpenAI, Anthropic 등과 논의했다고 밝혔습니다. Cue는 AI 검색이 미래의 트렌드이며, 현재는 아직 미흡하지만 잠재력이 커 결국 기존 검색 엔진을 대체할 수 있다고 생각합니다. 그는 또한 올해 4월 Safari 검색량이 처음으로 감소했으며, 이는 부분적으로 사용자들이 AI 도구로 전환했기 때문일 수 있다고 지적했습니다. 이러한 움직임은 Apple과 Google 간의 오랜 기본 검색 엔진 파트너십에 변화가 생길 수 있음을 시사하며, Google 검색 사업의 미래에 대한 시장의 우려를 불러일으켜 Alphabet 주가가 한때 9% 이상 급락하기도 했습니다. (출처: 36氪, Reddit r/artificial, pmddomingos)

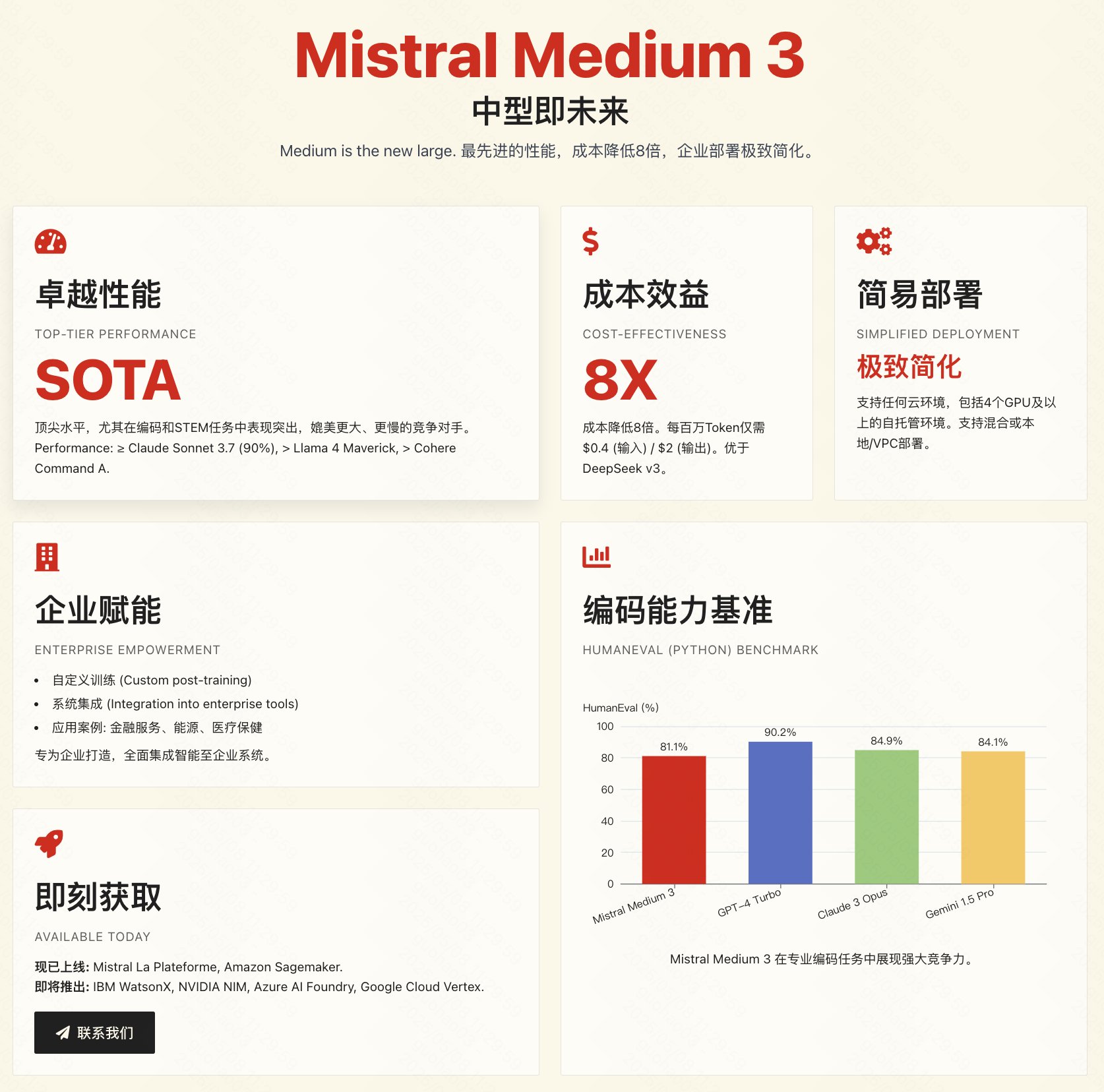

Mistral, Medium 3 멀티모달 모델 출시, 가성비와 엔터프라이즈급 애플리케이션에 중점: 프랑스 AI 기업 Mistral AI가 새로운 멀티모달 모델 Mistral Medium 3를 출시했습니다. 공식 발표에 따르면 이 모델은 성능 면에서 Claude 3.7 Sonnet 등 최고 수준 모델에 근접하며, 특히 프로그래밍 및 STEM 작업에서 우수한 성능을 보입니다. 반면 비용은 유사 제품의 약 1/8 수준(입력 $0.4/1M tokens, 출력 $2/1M tokens)으로 대폭 절감되었으며, DeepSeek V3 등 저가 모델보다도 저렴합니다. 이 모델은 하이브리드 클라우드, 온프레미스 배포를 지원하며 맞춤형 미세 조정 등 엔터프라이즈급 기능을 제공합니다. 현재 API는 Mistral La Plateforme과 Amazon Sagemaker에서 이용 가능합니다. 공식적으로는 가성비와 기업 적합성을 강조하고 있지만, 커뮤니티의 초기 실사용 후기는 엇갈리고 있습니다. 일부 사용자는 성능이 홍보 수준에 미치지 못한다고 평가하며, 오픈소스로 공개되지 않은 점에 실망감을 표했습니다. (출처: op7418, arthurmensch, 36氪, 36氪, scaling01, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, TheRundownAI, 36氪)

🎯 동향

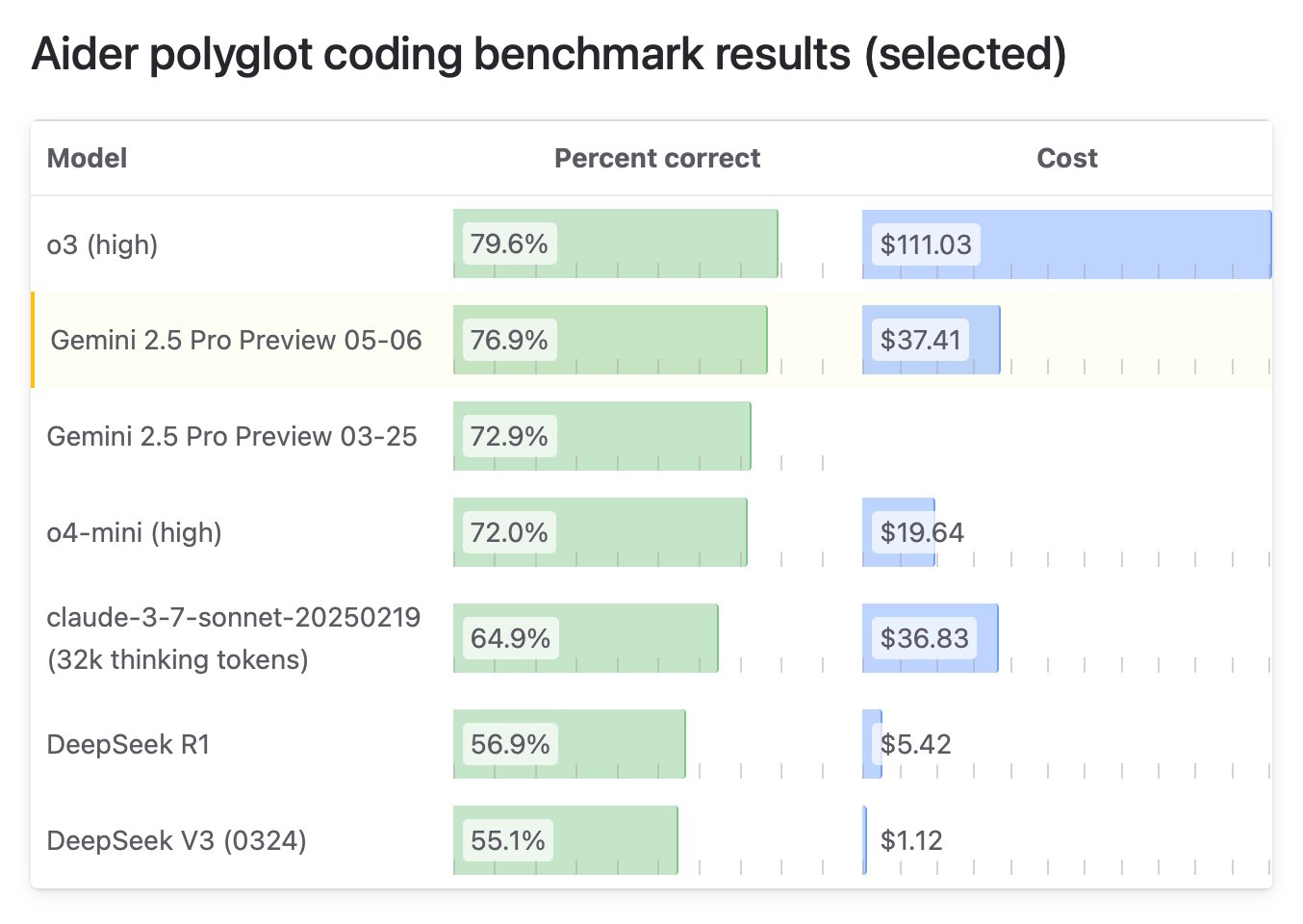

Google, Gemini 2.5 Pro “I/O” 특별판 출시, 프로그래밍 능력 최고 수준 등극: Google DeepMind가 Gemini 2.5 Pro의 업그레이드 버전 “I/O”를 출시하여 함수 호출 및 프로그래밍 능력을 특별히 최적화했습니다. WebDev Arena Leaderboard 벤치마크 테스트에서 이 모델은 1419.95점으로 Claude 3.7 Sonnet을 제치고 이 주요 프로그래밍 벤치마크에서 처음으로 1위를 차지했습니다. 새로운 모델은 비디오 이해 측면에서도 뛰어난 성능을 보여 VideoMME 벤치마크를 선도하고 있습니다. 이 모델은 Gemini API, Vertex AI 등의 플랫폼을 통해 제공되며, 가격은 기존 2.5 Pro와 동일하며, 더 강력한 코드 생성 및 대화형 애플리케이션 구축 능력을 제공하는 것을 목표로 합니다. (출처: _philschmid, aidan_mclau, 36氪)

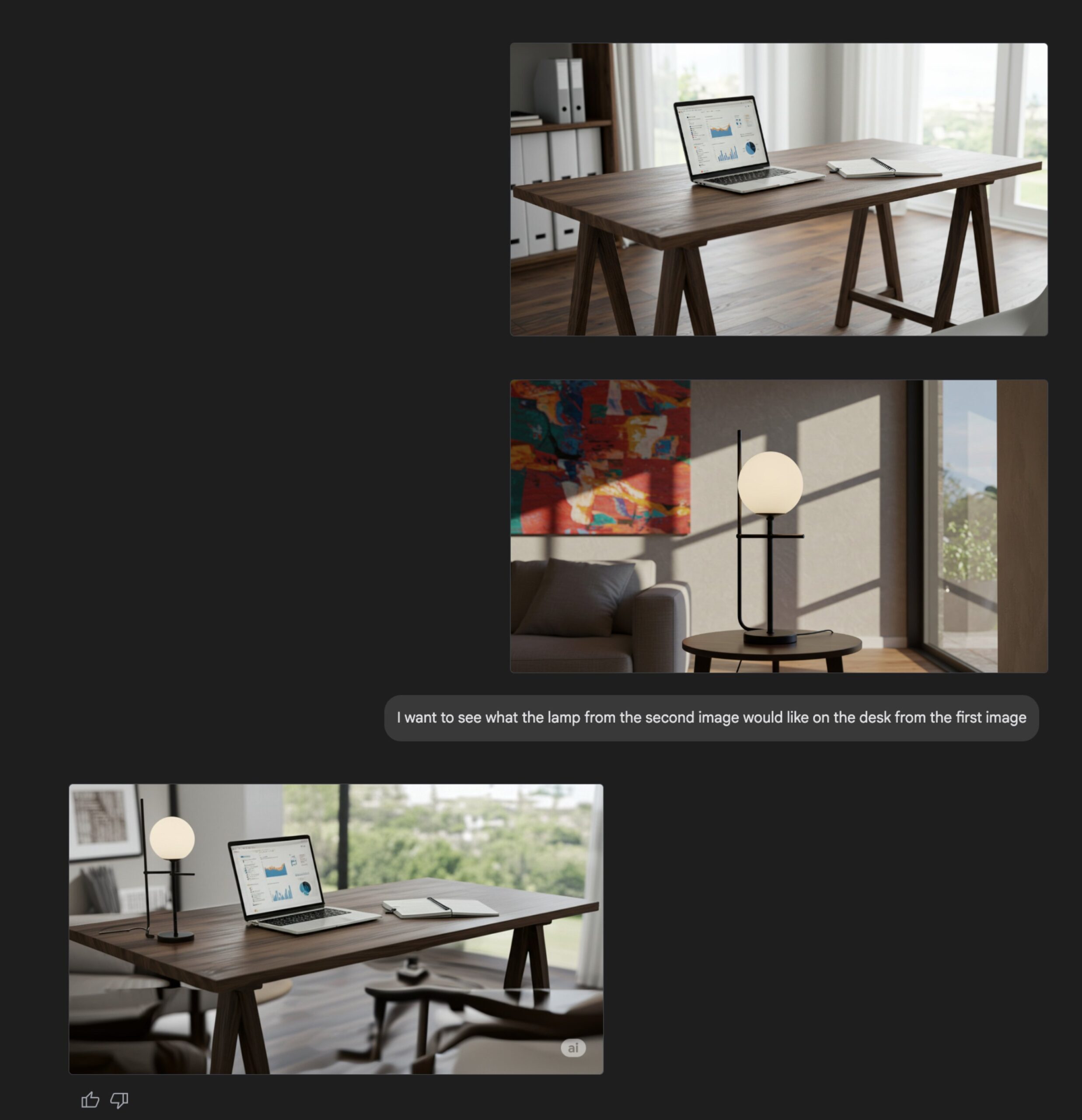

Gemini Flash 이미지 생성 기능 업그레이드: Google Gemini Flash 모델의 네이티브 이미지 생성 기능이 업데이트되어 미리보기 버전이 현재 사용 가능하며 속도 제한이 향상되었습니다. 공식 발표에 따르면 새 버전은 시각적 품질, 텍스트 렌더링 정확도 측면에서 개선되었으며 필터링으로 인한 차단율을 크게 낮췄습니다. 사용자는 Google AI Studio에서 무료로 체험할 수 있으며 개발자는 API를 통해 통합할 수 있고 가격은 이미지당 0.039달러입니다. (출처: op7418, 36氪)

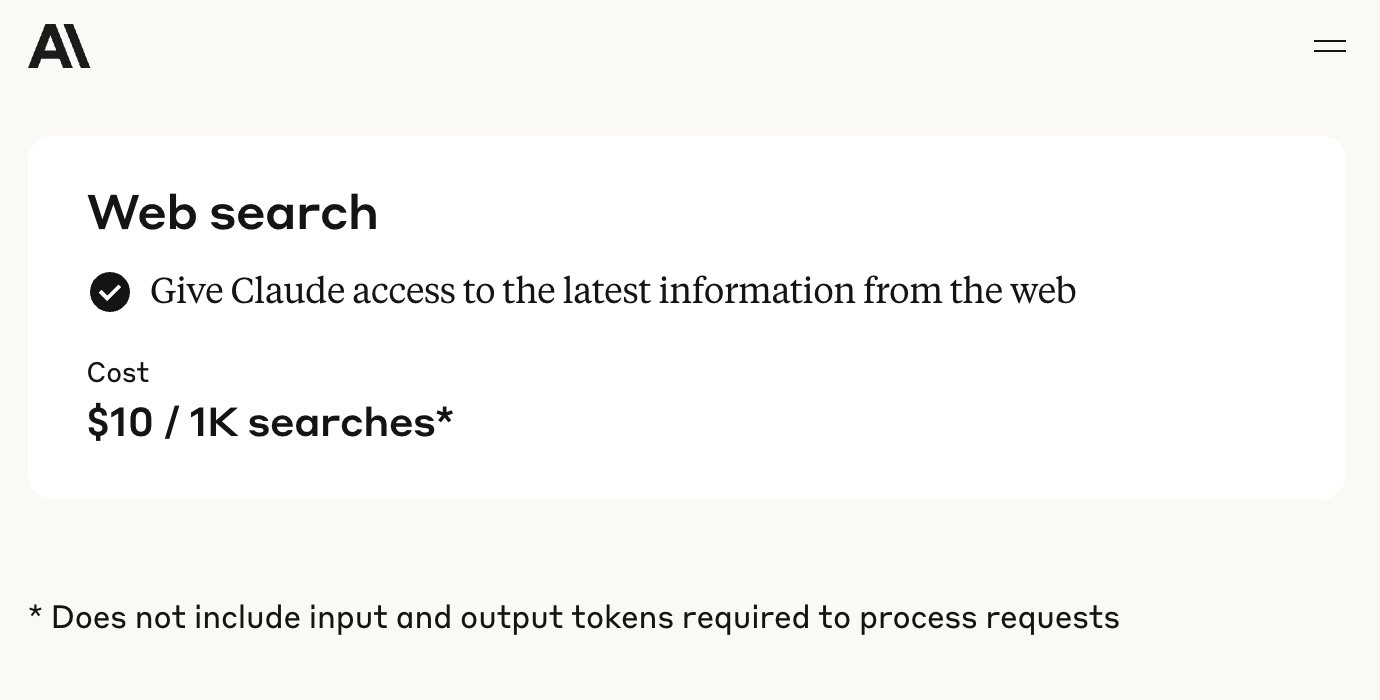

Anthropic API, 웹 검색 기능 추가: Anthropic은 API에 웹 검색 도구를 추가하여 개발자가 실시간 웹 정보를 활용하는 Claude 애플리케이션을 구축할 수 있도록 한다고 발표했습니다. 이 기능을 통해 Claude는 최신 데이터를 가져와 지식 기반을 강화할 수 있으며, 생성된 답변에는 출처 인용이 포함됩니다. 개발자는 API를 통해 검색 깊이를 제어하고 도메인 화이트리스트/블랙리스트를 설정하여 검색 범위를 관리할 수 있습니다. 이 기능은 현재 Claude 3.7 Sonnet, 업그레이드된 3.5 Sonnet 및 3.5 Haiku를 지원하며, 가격은 검색 1000회당 10달러에 표준 Token 비용이 추가됩니다. (출처: op7418, swyx, Reddit r/ClaudeAI)

Microsoft, Phi-4 추론 모델 오픈소스 공개, 추론 사슬과 느린 사고 강조: Microsoft Research는 구조화된 추론 작업을 위해 특별히 설계된 14B 매개변수 언어 모델 Phi-4-reasoning-plus를 오픈소스로 공개했습니다. 이 모델은 훈련 과정에서 “추론 사슬”(Chain-of-Thought)을 강조하여 모델이 사고 과정을 자세히 작성하도록 장려하고, 특별한 강화 학습 보상 메커니즘을 채택했습니다. 즉, 오답 시에는 더 긴 추론 사슬을 장려하고 정답 시에는 간결함을 장려합니다. 이러한 “느린 사고”와 “실수 허용” 훈련 방식은 수학, 과학, 코드 등 벤치마크 테스트에서 우수한 성능을 보이게 했으며, 일부 측면에서는 더 큰 규모의 모델을 능가하고 강력한 교차 영역 이전 능력을 보여주었습니다. (출처: 36氪)

NVIDIA, OpenCodeReasoning 시리즈 모델 출시: NVIDIA는 Hugging Face에 OpenCodeReasoning-Nemotron 시리즈 모델을 출시했으며, 7B, 14B, 32B 및 32B-IOI 버전을 포함합니다. 이 모델들은 코드 추론 작업에 중점을 두어 AI가 코드를 이해하고 생성하는 능력을 향상시키는 것을 목표로 합니다. 커뮤니티는 이미 로컬 실행을 위해 GGUF 형식 제작을 시작했습니다. 일부에서는 경쟁 프로그래밍에 중점을 둔 이러한 모델의 실용성이 제한적일 수 있다는 의견이 있으며, 실제 테스트 효과를 기대하고 있습니다. (출처: Reddit r/LocalLLaMA)

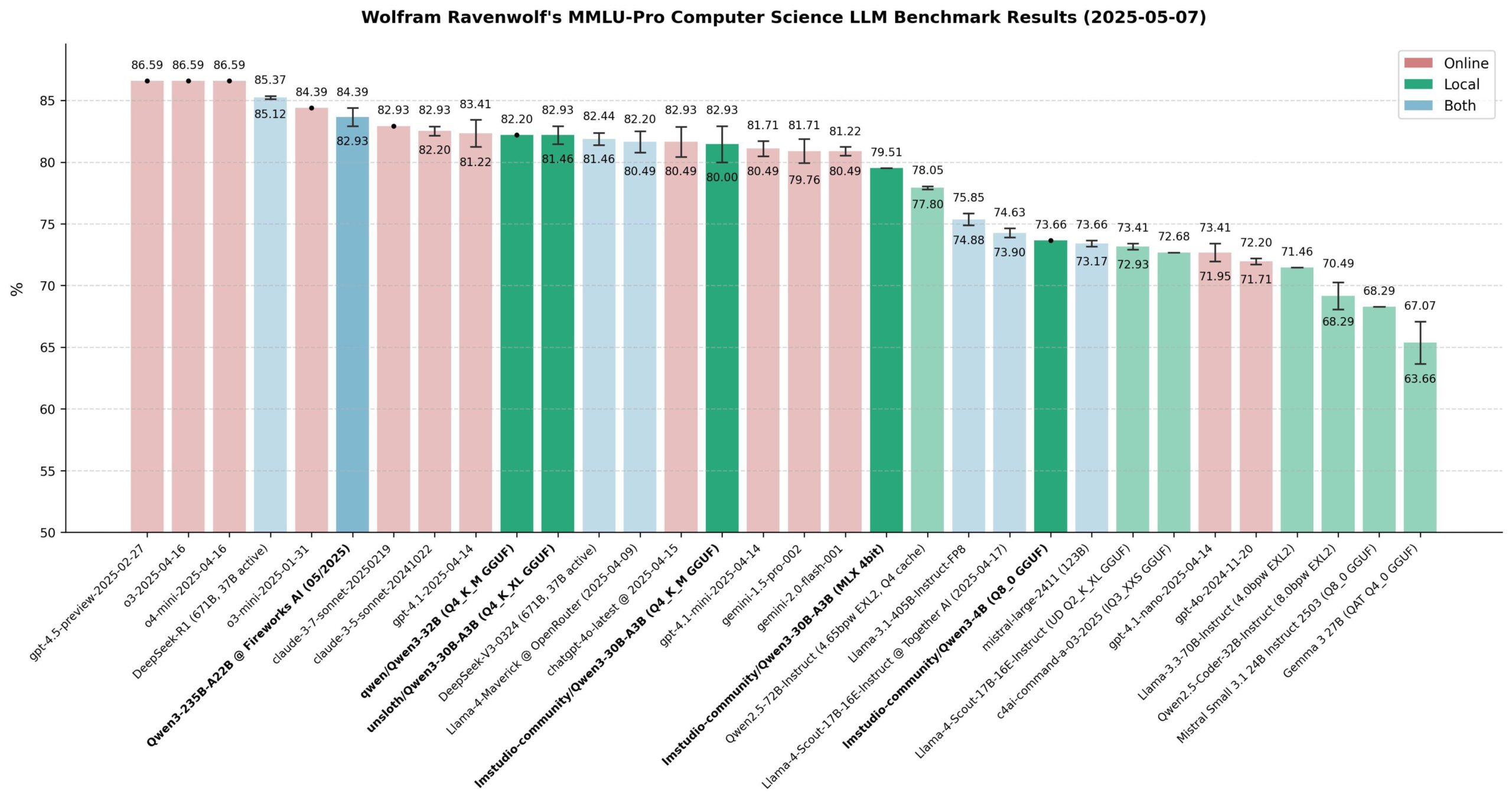

Qwen 3 모델 성능 평가: 커뮤니티는 Qwen 3 시리즈 모델에 대해 광범위한 평가를 수행했으며, 특히 MMLU-Pro (CS) 벤치마크에서 그러했습니다. 결과에 따르면 235B 모델이 가장 우수한 성능을 보였지만, 30B 양자화 모델(예: Unsloth 버전)은 성능 면에서 매우 근접하면서도 로컬 실행 속도가 빠르고 비용이 저렴하여 가성비가 매우 높았습니다. Apple Silicon에서는 MLX 버전의 30B 모델이 속도와 품질 사이에서 좋은 균형을 이루었습니다. 평가에 따르면 대부분의 로컬 RAG 또는 Agent 애플리케이션의 경우 양자화된 30B 모델이 이미 새로운 기본 선택이 되었으며 성능은 최첨단 수준에 가깝습니다. (출처: Reddit r/LocalLLaMA)

Xueersi, 듀얼 코어 대규모 모델 통합 학습기 출시: Xueersi는 자체 개발한 Jiuzhang 대규모 모델과 DeepSeek 듀얼 코어 AI를 탑재한 P, S, T 세 가지 시리즈의 새로운 학습기를 출시했습니다. 주요 기능으로는 학생들의 질문과 탐구를 능동적으로 유도하는 “Xiaosi AI 1대1” 지능형 상호 작용, “필터링 학습”과 “필터링 연습”을 통해 효율성을 높이는 정밀 학습 3.0 등이 있습니다. 학습기는 풍부한 강의 및 교재 자원(예: Xiaohou, Mobi, 5·3, Wanwei)을 통합하고 새로운 교육 과정에 맞춰 연계 과정과 새로운 유형의 문제 훈련을 제공합니다. 다양한 시리즈는 다양한 학년과 요구 사항을 대상으로 하며 “좋은 AI + 좋은 콘텐츠”를 통해 개인화된 지능형 학습 경험을 제공하는 것을 목표로 합니다. (출처: 量子位)

AI 기반 신약 평가 가속화, OpenAI cderGPT 프로젝트 공개: 보도에 따르면 OpenAI는 cderGPT라는 프로젝트를 개발 중이며, 이는 AI를 활용하여 미국 식품의약국(FDA)의 신약 평가 프로세스를 가속화하는 것을 목표로 합니다. OpenAI 고위층은 이미 FDA 및 관련 부서와 이에 대해 논의했습니다. FDA 관계자도 첫 번째 AI 지원 과학 제품 검토를 완료했으며 AI가 신약 출시 시간을 단축할 수 있는 잠재력이 있다고 밝혔습니다. 그러나 고위험 평가에서 AI의 신뢰성(예: 환각 문제)과 데이터 훈련 및 모델 검증 표준은 여전히 주목해야 할 문제입니다. 이 프로젝트는 규제 과학 및 신약 개발 분야에서 AI 적용의 잠재력과 과제를 보여줍니다. (출처: 36氪)

대규모 모델 회사, 사용자 충성도 강화를 위한 커뮤니티 운영 모색: Moonshot AI Kimi의 콘텐츠 커뮤니티 제품 테스트, OpenAI의 소셜 소프트웨어 개발 계획 등으로 대표되는 대규모 모델 회사들은 AI 도구의 “일회성 사용” 문제를 해결하고 사용자 충성도를 높이기 위해 커뮤니티 구축을 시도하고 있습니다. 커뮤니티는 사용자를 모으고, 콘텐츠를 생성하며, 관계를 구축하고, 제품 테스트 및 사용자 피드백 채널 역할을 할 수 있습니다. 그러나 커뮤니티 운영은 콘텐츠 품질 유지, 콘텐츠 안전 규제 및 상업적 수익화 등 여러 가지 과제에 직면해 있습니다. “자금 소모적인” 트래픽 유도 광고 모델이 지속되기 어려운 상황에서 커뮤니티화는 대규모 모델 회사가 새로운 성장 경로를 모색하는 시도 중 하나가 되고 있습니다. (출처: 36氪)

DeepSeek R1 오픈소스 재현 성능 대폭 향상: SGLang, NVIDIA 등 기관의 공동 연구팀은 96개의 H100 GPU에서 DeepSeek-R1을 최적화하여 배포한 결과를 발표했습니다. SGLang 추론 최적화(프리필/디코딩 분리(PD), 대규모 전문가 병렬 처리(EP), DeepEP, DeepGEMM 및 EPLB 등 기술 포함)를 통해 단 4개월 만에 모델 추론 성능을 26배 향상시켰으며 처리량은 이미 DeepSeek 공식 데이터에 근접했습니다. 이 오픈소스 구현 솔루션은 배포 비용을 크게 절감했으며 대규모 MoE 모델 추론 능력을 효율적으로 확장할 수 있는 가능성을 보여주었습니다. (출처: 36氪)

Cisco, 양자 네트워크 얽힘 칩 프로토타입 전시: Cisco는 캘리포니아 대학교 산타바바라 캠퍼스와 협력하여 양자 컴퓨터 상호 연결용 칩 프로토타입을 개발했습니다. 이 칩은 얽힘 광자쌍을 이용하여 양자 순간이동을 통해 양자 컴퓨터 간의 즉각적인 연결을 구현하는 것을 목표로 하며, 이를 통해 대규모 양자 컴퓨터의 실용화 시기를 수십 년에서 5~10년으로 단축할 수 있을 것으로 기대됩니다. 큐비트 수를 늘리는 데 집중하는 노선과 달리 Cisco는 상호 연결 기술에 중점을 두어 전체 양자 생태계의 발전을 가속화하고자 합니다. 이 칩은 기존 네트워크 칩 기술의 일부를 채택했으며 양자 컴퓨터가 보급되기 전에 금융 시간 동기화, 과학 탐사 등 분야에 응용될 것으로 예상됩니다. (출처: 36氪)

NVIDIA CEO 젠슨 황, AI 산업 혁명과 중국 시장에 대해 언급: 밀컨 글로벌 컨퍼런스에서 젠슨 황은 AI 발전을 산업 혁명이라고 칭하며, 미래 기업은 “듀얼 팩토리” 모델을 채택할 것이라고 제안했습니다. 물리적 공장은 실제 제품을 생산하고, AI 팩토리(GPU 클러스터, 데이터 센터로 구성)는 “지능 단위”(Token)를 생산한다는 것입니다. 그는 향후 10년 동안 전 세계적으로 막대한 비용(단일 약 600억 달러)과 엄청난 전력 소비(단일 약 1기가와트)가 드는 AI 팩토리가 수십 개 등장하여 국가 핵심 경쟁력이 될 것이라고 예측했습니다. 동시에 그는 미국의 대중국 기술 수출 제한에 대한 우려를 표명하며, 중국 시장(연간 규모 500억 달러)을 포기하면 기술 주도권을 경쟁자(예: Huawei)에게 넘겨주고 글로벌 AI 생태계 분열을 가속화하여 궁극적으로 미국 자체의 기술 우위를 약화시킬 수 있다고 주장했습니다. (출처: 36氪)

🧰 도구

ACE-Step-v1-3.5B: 새로운 노래 생성 모델: karminski3는 새로 출시된 노래 생성 모델 ACE-Step-v1-3.5B를 테스트했습니다. 그는 Gemini를 사용하여 가사를 생성한 다음 이 모델을 사용하여 록 스타일의 노래를 만들었습니다. 초기 경험에 따르면 일부 연결 및 단일 음절 발음에 문제가 있지만 전반적인 효과는 괜찮으며 간단한 후크송 생성에 적합합니다. 이 테스트는 Hugging Face에서 무료 L40 GPU를 사용하여 완료되었으며 약 50초가 소요되었습니다. 모델과 코드 라이브러리는 모두 오픈소스로 공개되었습니다. (출처: karminski3)

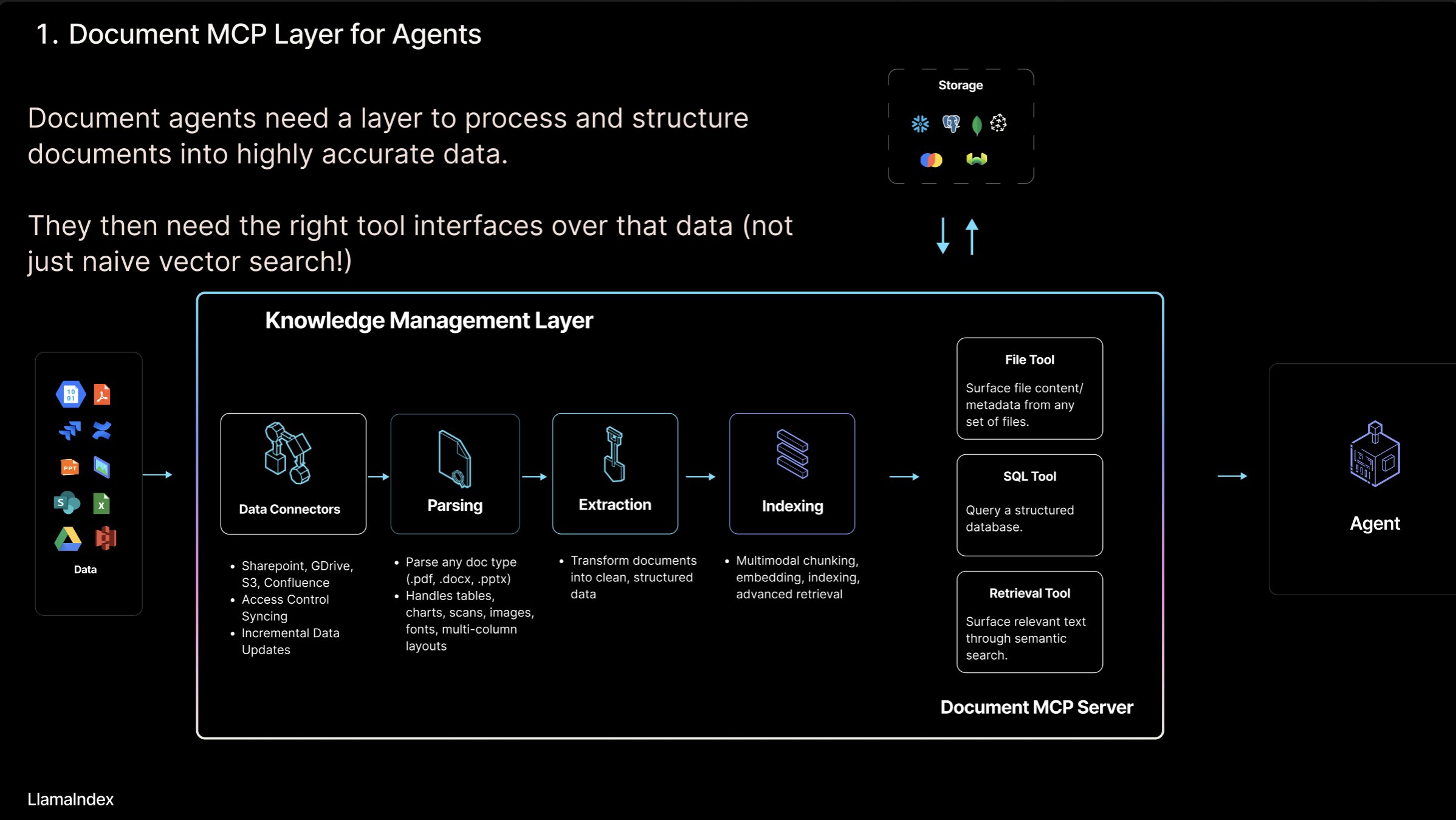

LlamaIndex, “문서 MCP 서버” 개념 및 LlamaCloud 도구 출시: LlamaIndex 창립자 Jerry Liu는 AI Agent와 문서 도구의 상호 작용을 통해 RAG를 재정의하는 것을 목표로 하는 “문서 MCP 서버” 개념을 제안했습니다. 그는 Agent가 조회(정확한 쿼리), 검색(시맨틱 검색, 즉 RAG), 분석(구조화된 쿼리) 및 조작(파일 유형 함수 호출)의 네 가지 방식으로 문서와 상호 작용할 수 있다고 생각합니다. LlamaIndex는 LlamaCloud에서 파싱, 추출, 인덱싱 등 이러한 핵심 “문서 도구”를 구축하여 더 효과적인 Agent 구축을 지원하고 있습니다. (출처: jerryjliu0)

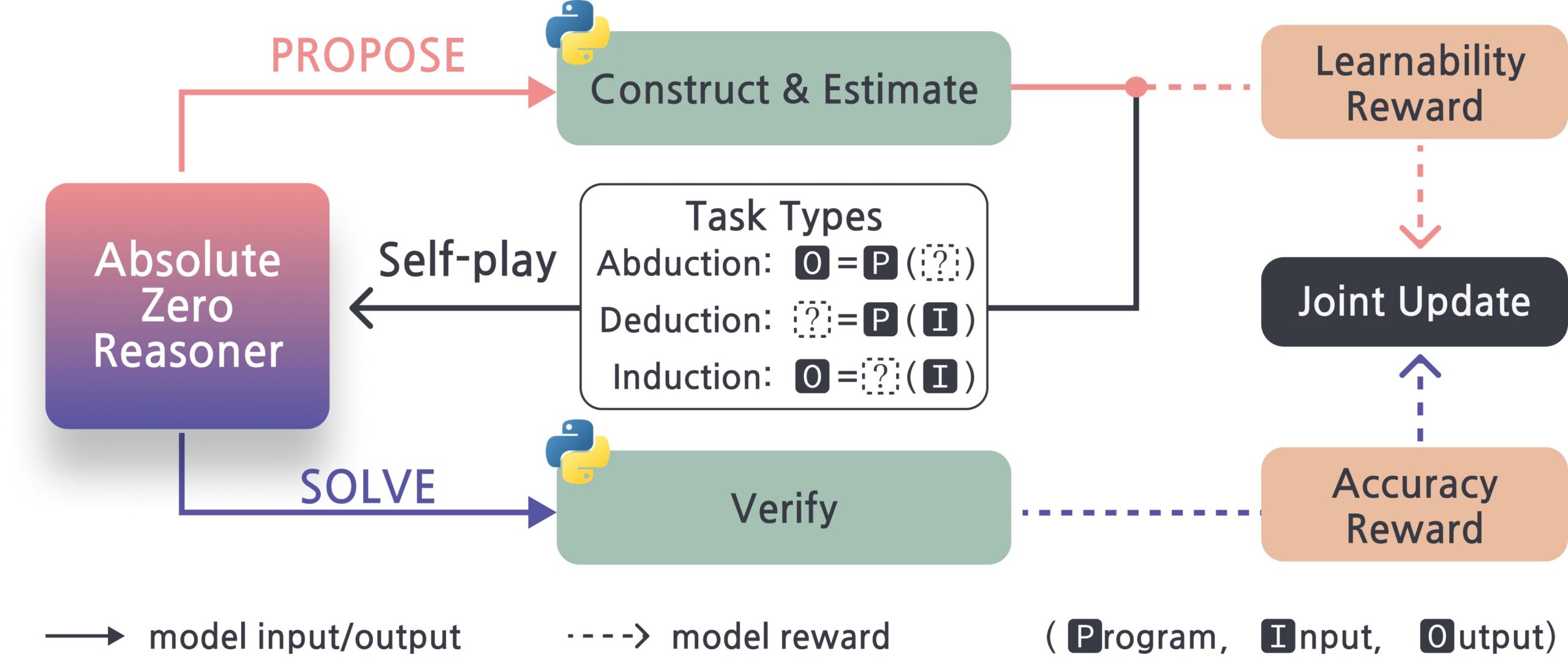

Absolute-Zero-Reasoner: 대규모 모델 자체 개선 프레임워크: Absolute-Zero-Reasoner라는 새로운 프로젝트는 대규모 모델이 자체 질문, 코드 작성, 실행 검증, 반복 순환을 통해 자체 프로그래밍 및 수학 능력을 향상시킬 수 있는 가능성을 보여줍니다. Qwen2.5-7B의 테스트 데이터에 따르면 이 방법은 프로그래밍 능력을 5점, 수학 능력을 15.2점(100점 만점) 향상시켰습니다. 그러나 이 방법은 컴퓨팅 리소스 요구 사항이 매우 높으며, 예를 들어 7/8B 모델에는 80GB GPU 4개가 필요합니다. 프로젝트와 논문은 오픈소스로 공개되었습니다. (출처: karminski3, tokenbender)

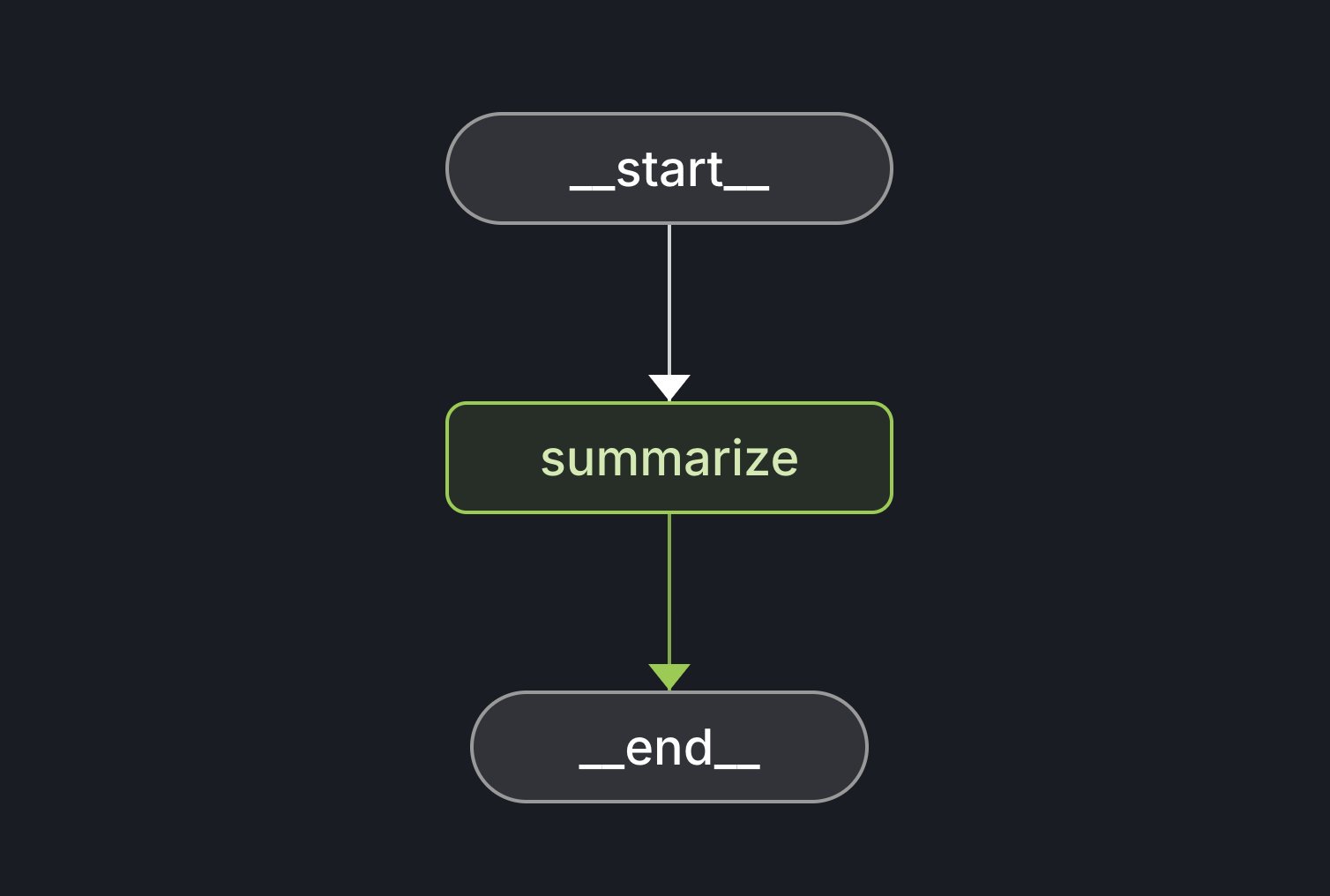

LangGraph Starter Kit 출시: LangChain은 개발자가 결정론적이고 단일 기능을 가지며 성능이 좋은 Agent 그래프를 쉽게 만들 수 있도록 돕는 LangGraph Starter Kit를 출시했습니다. 개발자는 이를 LangGraph Cloud에 배포하고 AI 텍스트 생성 워크플로에 통합할 수 있습니다. 이 도구 키트는 LangGraph 애플리케이션을 빠르게 시작하고 개발할 수 있는 기반을 제공합니다. (출처: hwchase17, Hacubu)

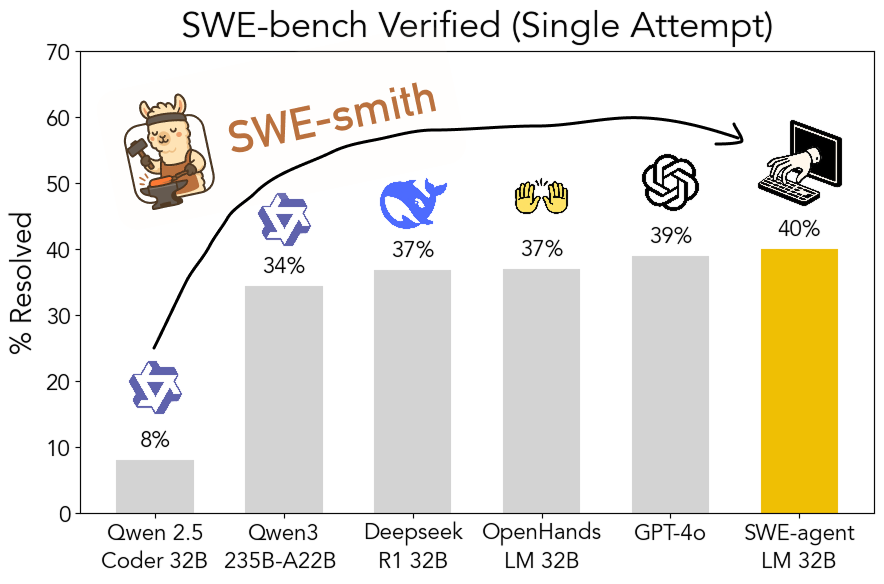

SWE-smith: 소프트웨어 엔지니어링 Agent 훈련 데이터 생성용 오픈소스 도구 키트: 프린스턴 대학교 John Yang 등은 GitHub 리포지토리에서 대량의 Agent 훈련 작업 인스턴스를 생성하기 위한 도구 키트인 SWE-smith를 출시했습니다. 이 도구를 사용하여 생성된 5만 개 이상의 작업 인스턴스를 활용하여 SWE-agent-LM-32B 모델을 훈련시켰으며, SWE-bench Verified 테스트에서 40%의 pass@1 정확도를 달성하여 해당 벤치마크에서 1위 오픈소스 모델이 되었습니다. 도구 키트, 데이터 세트 및 모델은 모두 오픈소스로 공개되었습니다. (출처: teortaxesTex, Reddit r/MachineLearning)

Gamma: AI 기반 프레젠테이션 및 콘텐츠 제작 플랫폼: Gamma는 AI를 활용하여 프레젠테이션(PPT), 웹 페이지, 문서 등 콘텐츠 제작을 간소화하는 플랫폼입니다. “카드 스타일” 편집과 AI 지원 디자인을 특징으로 하며, 사용자는 디자인에 능숙하지 않아도 빠르고 미려하며 상호 작용적인 콘텐츠를 생성할 수 있습니다. Gamma는 초기에 실용적인 기능과 PLG(제품 주도 성장) 모델을 통해 사용자를 확보했으며, AI 기술이 성숙된 후(예: Claude, GPT-4o 연동) “한 문장으로 PPT 생성” 등의 기능을 구현했습니다. 최근 출시된 Gamma 2.0은 AI PPT 도구에서 더 광범위한 “원스톱 창의적 표현 플랫폼”으로 포지셔닝을 확장하여 브랜드 식별, 이미지 편집, 차트 생성 등을 지원합니다. 보도에 따르면 Gamma는 이미 수익을 창출했으며 ARR은 5천만 달러를 돌파했습니다. (출처: 36氪)

INAIR: 라이트 오피스 환경에 특화된 AR+AI 안경: INAIR는 라이트 오피스 환경을 위한 AR 안경 및 관련 공간 운영체제 INAIR OS를 개발하는 회사입니다. 이 제품은 휴대용 대형 화면 업무 경험을 제공하며, 다중 화면 협업, Android 애플리케이션 호환 및 Windows/Mac 무선 스트리밍을 지원합니다. INAIR OS에는 음성 비서, 실시간 번역, 문서 처리 및 작업 협업 기능을 갖춘 AI Agent가 내장되어 있습니다. 이 회사는 소프트웨어-하드웨어 통합과 공간 지능 네이티브 경험을 강조하며, 자체 개발 시스템과 사무 환경 생태계 적응을 통해 경쟁 우위를 구축하고 있습니다. 최근 수천만 위안 규모의 A 라운드 투자를 유치했습니다. (출처: 36氪)

📚 학습

AI Agent와 문서 상호 작용 모드 논의: LlamaIndex 창립자 Jerry Liu는 AI Agent와 문서가 상호 작용하는 네 가지 모드인 정확한 조회(Lookup), 시맨틱 검색(Retrieval/RAG), 분석(Analytics) 및 조작(Manipulation)에 대해 논의했습니다. 그는 효과적인 문서 Agent를 구축하려면 강력한 기본 도구 지원이 필요하다고 생각하며, 이와 관련하여 LlamaCloud의 진전에 대해 소개했습니다. (출처: jerryjliu0)

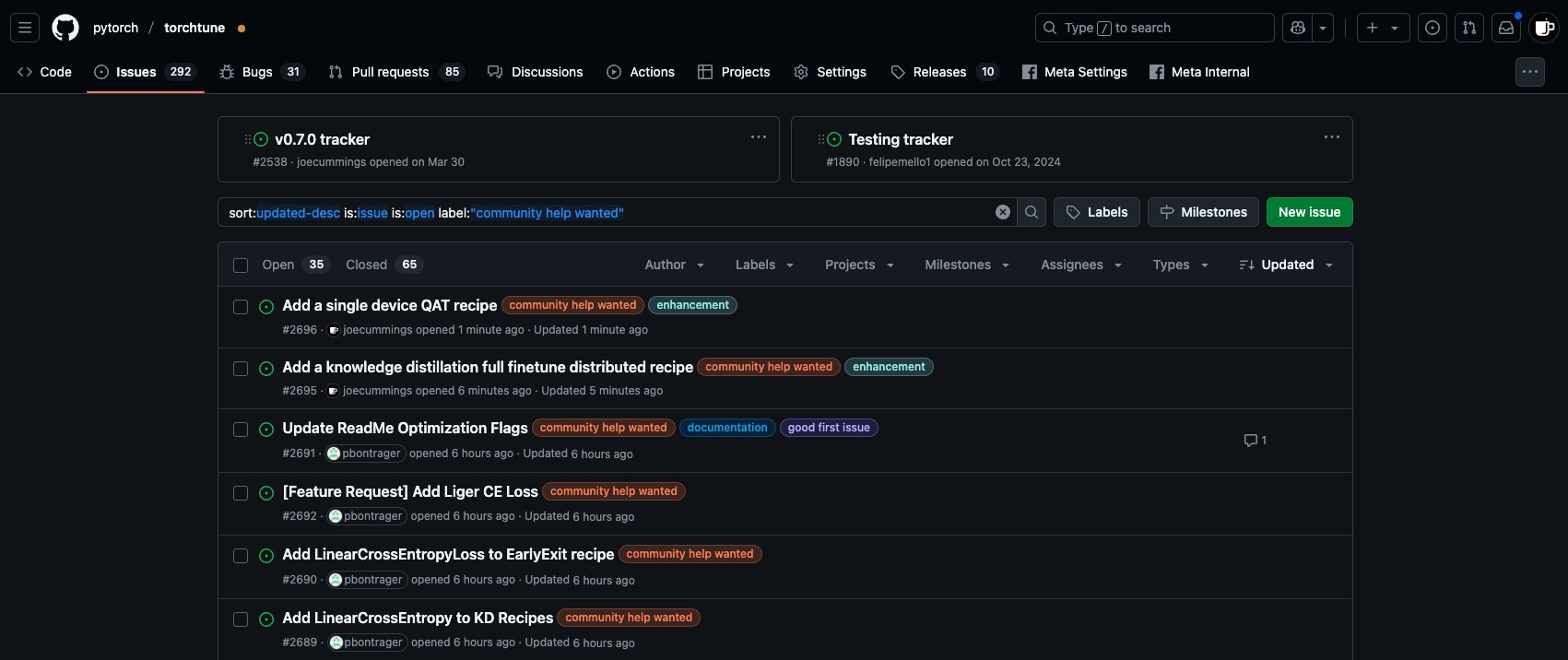

PyTorch 생태계 Post-Training 기여 기회: PyTorch 팀은 torchtune repo에 새로운 ‘community help wanted’ 작업을 게시하여 커뮤니티 구성원들이 PyTorch 생태계의 모델 후 훈련(post-training) 작업에 참여하도록 초대했습니다. 여기에는 단일 장치 QAT 레시피 추가, 새로운 LinearCrossEntropy를 지식 증류에 통합하는 것 등이 포함됩니다. (출처: winglian)

스탠포드 NLP 세미나: 모델 기억과 안전: 스탠포드 대학교 NLP Seminar는 Pratyush Maini를 초청하여 “모델 기억 연구가 안전에 주는 시사점”(What Memorization Research Taught Me About Safety)에 대해 논의했습니다. (출처: stanfordnlp)

FormalMATH: 대규모 형식 수학 추론 벤치마크 발표: 여러 기관이 공동으로 올림피아드부터 대학 수준까지 포괄하는 5560개의 문제로 구성된 형식 수학 추론 벤치마크 테스트인 FormalMATH를 발표했습니다. 연구팀은 LLM을 활용하여 자동화된 형식화 및 검증을 지원하는 혁신적인 “3단계 필터링” 프레임워크를 제안하여 구축 비용을 크게 절감했습니다. 테스트 결과, 현재 가장 강력한 LLM 증명기인 Kimina-Prover의 성공률은 16.46%에 불과했으며 미적분학 등 분야에서 성능이 저조하여 현재 모델이 엄격한 논리 추론 측면에서 한계가 있음을 드러냈습니다. 논문, 데이터 및 코드는 오픈소스로 공개되었습니다. (출처: 量子位)

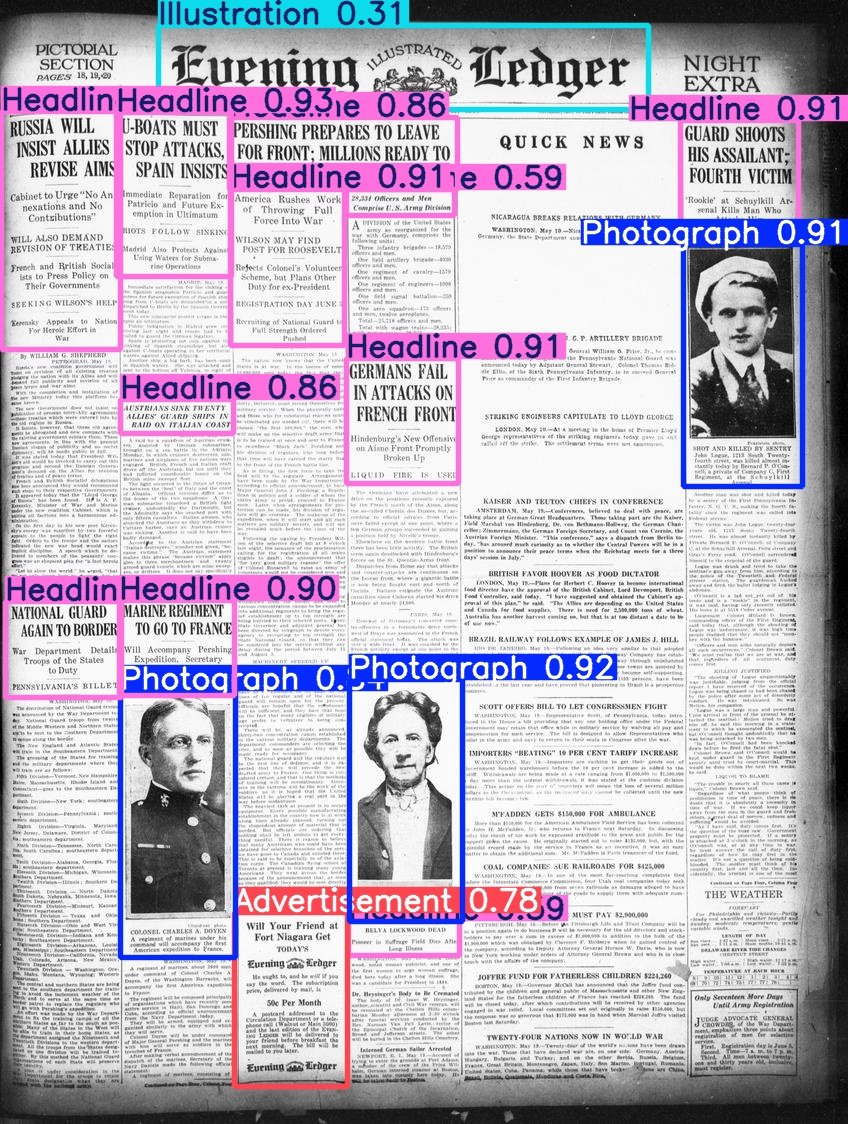

Hugging Face, Beyond Words 데이터 세트 공개: Daniel van Strien은 LC Labs/BCG의 Beyond Words 데이터 세트(경계 상자 및 카테고리 레이블이 포함된 3500페이지의 주석 처리된 역사 신문 페이지 포함)를 정리하여 Hugging Face의 BigLAM 조직에 게시했으며, 동시에 몇 가지 YOLO 모델을 예시로 훈련시켰습니다. (출처: huggingface)

2025 AI Index Report 발표: 제8판 AI Index Report가 발표되었으며, 연구 개발, 기술 성능, 책임감 있는 AI, 경제, 과학 의료, 정책, 교육 및 대중 의견 등 8개 장을 다룹니다. 보고서의 주요 결과는 다음과 같습니다: AI는 벤치마크 테스트에서 지속적으로 발전하고 있습니다. AI는 일상생활에 점점 더 통합되고 있습니다(예: 의료 기기 승인 증가, 자율 주행 보급). 기업은 AI 투자를 늘리고 사용을 확대하고 있으며, AI는 생산성에 상당한 영향을 미치고 있습니다. 미국은 최고 수준 모델 생산에서 선두를 달리고 있지만, 중국은 성능 면에서 빠르게 추격하고 있습니다. 책임감 있는 AI 생태계 발전은 불균형하며, 정부 규제가 강화되고 있습니다. AI에 대한 전 세계적인 낙관론은 상승하고 있지만 지역적 차이가 큽니다. AI는 더욱 효율적이고 저렴해지고 있습니다. AI 교육은 확대되고 있지만 격차가 존재합니다. 산업계는 모델 개발을 주도하고, 학계는 고인용 연구를 주도하고 있습니다. AI는 과학 분야에서 인정받고 있습니다. 복잡한 추론은 여전히 과제입니다. (출처: aihub.org)

💼 비즈니스

싱가포르 핀테크 기업 RockFlow, 1000만 달러 A1 라운드 투자 유치: RockFlow는 1000만 달러 규모의 A1 라운드 투자를 유치했다고 발표했으며, 이는 AI 기술 및 곧 출시될 금융 AI Agent “Bobby”를 향상시키는 데 사용될 예정입니다. RockFlow는 자체 개발 아키텍처와 멀티모달 LLM, Fin-Tuning, RAG 등의 기술을 결합하여 금융 투자 장면에 적합한 AI Agent 아키텍처를 개발했습니다. 이는 투자 거래에서 “무엇을 살 것인가”와 “어떻게 살 것인가”라는 핵심적인 어려움을 해결하고 개인화된 투자 제안, 전략 생성 및 자동 실행 등의 기능을 제공하는 것을 목표로 합니다. (출처: 36氪)

01.AI 공동 창업자 다이종홍, 퇴사 후 창업: 01.AI 공동 창업자이자 기술 부사장(AI Infra 담당)이었던 다이종홍이 퇴사 후 창업했으며 Sinovation Ventures로부터 투자를 받았습니다. 01.AI는 이 소식을 확인했으며, 올해 회사의 매출이 이미 수억 위안에 달했고 시장 PMF에 따라 프로젝트를 신속하게 조정할 것이라고 밝혔습니다. 여기에는 투자 강화, 독립적인 자금 조달 장려 또는 일부 프로젝트 중단 등이 포함됩니다. 다이종홍의 퇴사는 01.AI가 이전에 AI Infra 팀을 축소하고 통합한 이후에 이루어졌으며, 사업 중심은 C 사용자 대상 AI 검색 및 B 기업 대상 솔루션으로 전환되었습니다. (출처: 36氪)

OpenAI와 Microsoft 간 수익 분배 비율 조정 가능성: 비공개 문서에 따르면 OpenAI와 최대 투자자인 Microsoft 간의 수익 분배 계약이 조정될 가능성이 있습니다. 기존 계약에 따르면 OpenAI는 2030년까지 Microsoft와 수익의 20%를 공유하지만, 향후 조건에서는 이 비율이 약 10%로 낮아질 수 있습니다. Microsoft는 서비스 라이선스, 지분 보유, 수익 분배 등을 포함한 구조 조정 문제에 대해 OpenAI와 협상 중인 것으로 알려졌습니다. 이전에 OpenAI는 영리 기업으로의 전환 계획을 포기하고 공익 기업으로 전환했지만, 이는 여전히 Microsoft의 완전한 동의를 얻지 못했으며 향후 상장에 영향을 미칠 수 있습니다. (출처: 36氪)

🌟 커뮤니티

AI Agent 및 MCP에 대한 논의: 커뮤니티에서는 AI Agent 및 모델 컨텍스트 프로토콜(MCP)에 대한 논의가 계속되고 있습니다. 일부 개발자들은 Jerry Liu가 제안한 문서 상호 작용 모드와 같이 이것이 더 복잡한 AI 워크플로를 구현하는 데 핵심이라고 생각합니다. 반면 Max Woolf와 같은 일부 숙련된 사용자들은 Agent와 MCP가 본질적으로 기존 도구 호출 패러다임(예: ReAct)을 새롭게 포장한 것에 불과하며 근본적인 새로운 기능을 제공하지 않으며 현재 구현이 더 복잡할 수 있다고 생각합니다. 앰비언트 코딩(ambient coding)과 같은 Agent 애플리케이션에 대해서도 효율성과 신뢰성에 대한 논쟁이 있습니다. (출처: jerryjliu0, mathemagic1an, hwchase17, hwchase17, 36氪)

AI 생성 버그 보고서, 오픈소스 커뮤니티 골머리: curl 프로젝트 창립자 Daniel Stenberg는 AI가 생성한 저품질의 허위 버그 보고서가 HackerOne과 같은 플랫폼에 쏟아져 유지보수 담당자의 시간을 대량으로 낭비시키고 있으며, 이는 DDoS 공격과 유사하다고 불평했습니다. 그는 AI가 생성한 유효한 보고서를 받은 적이 없으며 이러한 제출물을 필터링하기 위한 조치를 취했다고 밝혔습니다. Python 커뮤니티의 Seth Larson도 유사한 우려를 표명하며 이것이 유지보수 담당자의 번아웃을 악화시킬 것이라고 생각했습니다. 커뮤니티 토론에서는 이것이 AI 도구가 비효율적이거나 심지어 악의적인 목적으로 남용될 위험을 반영하며, 제출자와 플랫폼에 책임을 질 것을 촉구하는 동시에 고위 관리자가 AI 능력을 과도하게 신뢰할 수 있다는 우려를 불러일으켰습니다. (출처: 36氪)

AI와 정신 건강: 잠재적 위험과 윤리적 우려: Reddit 커뮤니티에서는 ChatGPT와 같은 AI와의 대화에 과도하게 몰입하면 사용자의 망상, 편집증 또는 정신 문제를 유발하거나 악화시킬 수 있다는 논의가 나타났습니다. AI의 긍정적인 반응으로 인해 사용자가 비합리적인 신념에 더 깊이 빠져들고 심지어 현실 관계가 파탄에 이르는 사례도 있습니다. 연구자들은 AI가 진정한 인간 치료사의 판단력이 부족하여 사용자의 인지 편향을 교정하기보다는 강화할 수 있다고 우려합니다. 동시에 Replika와 같은 AI 동반자 애플리케이션의 보급도 윤리적 논의를 불러일으키고 있으며, 그 디자인이 중독 메커니즘을 이용할 수 있고 사용자가 정서적 의존성을 갖게 된 후 서비스 종료나 AI의 부적절한 반응이 실제적인 정서적 피해를 줄 수 있습니다. (출처: 36氪)

논의: AI 시대의 인재 수요와 조직 변화: 알리바바 전 총참모장 증명은 AI 시대의 인재에 대한 핵심 요구 사항은 메타인지 능력(추상적 모델링, 본질 통찰), 빠른 학습 능력 및 창의력이라고 생각합니다. AI 도구는 지식 습득 장벽을 낮추어 경험 장벽을 약화시키고 최고 인재의 교차 영역 능력을 증폭시킵니다. 미래의 조직은 “창의적 지식 인재 + 실리콘 기반 직원(지능형 에이전트)”을 핵심으로 하며, 조직 형태는 계층적 관리보다는 사명 중심, 집단 지성 발현을 강조하는 “공동 창조형 지능 조직”으로 향할 것입니다. 개인과 조직 모두 이러한 변화에 적응하고 AI를 수용하며 인지 능력을 향상시켜야 합니다. (출처: 36氪)

Claude 3.7과 3.5 Sonnet 비교 토론: Reddit 사용자는 특정 작업(예: 그림에서 바퀴벌레 옷을 입은 고양이 식별)에서 이전 버전인 Claude 3.5 Sonnet이 새 버전인 3.7 Sonnet보다 성능이 우수하다는 것을 발견했습니다. 이는 모델 업그레이드가 모든 측면에서 향상을 가져오는 것은 아니라는 논의를 불러일으켰습니다. 일부 사용자는 3.7이 추론 및 긴 컨텍스트 처리에서 더 강력하여 복잡한 프로그래밍 작업에 적합한 반면, 3.5는 자연스러움과 특정 식별 작업에서 더 나을 수 있다고 생각합니다. 어떤 버전을 선택할지는 특정 사용 사례에 따라 다릅니다. 동시에 3.7이 때때로 과도하게 추론하거나 명시적으로 요구되지 않은 작업을 수행한다는 사용자 피드백도 있습니다. (출처: Reddit r/ClaudeAI)

💡 기타

추천 엔진과 자기 발견: 후용 교수는 추천 시스템(예: Netflix, Spotify)이 “선택 아키텍처”로서 사용자에게 어떤 영향을 미치는지 탐구했습니다. 그는 추천 시스템이 개인화된 제안을 제공할 뿐만 아니라 사용자가 추천을 수락하거나 무시하는 것을 통해 자기 인식과 자기 발견을 촉진하는 도구가 될 수 있다고 생각합니다. 책임감 있는 추천 시스템은 공정성, 투명성 및 다양성에 주의를 기울여 핫스팟 편향과 알고리즘 편견을 피해야 합니다. 미래에는 추천 시스템(기계)과의 관계를 이해하는 것이 “너 자신을 알라”의 일부가 될 수 있습니다. (출처: 36氪)

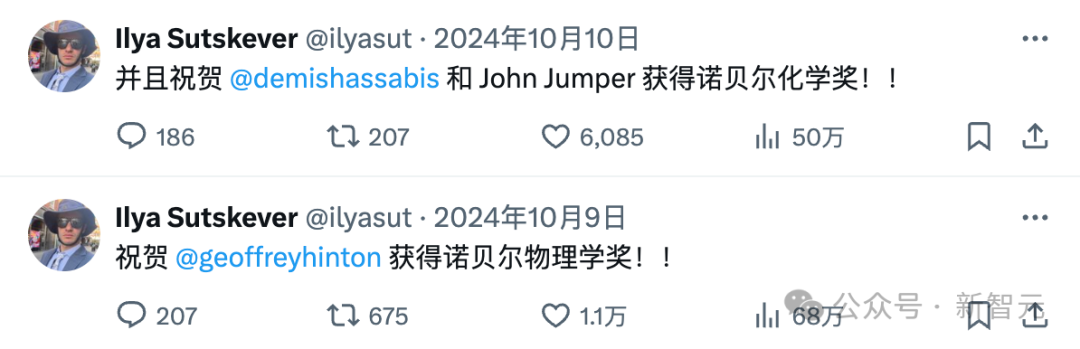

사라진 Ilya Sutskever와 OpenAI 마피아: Ilya Sutskever는 작년 OpenAI “내부 권력 다툼” 사건 이후 점차 대중의 시야에서 사라졌으며, 목표는 거창하지만 아직 제품이 없는 Safe Superintelligence (SSI) 회사를 설립하고 막대한 투자를 유치했습니다. 이 기사는 Ilya의 AI 안전에 대한 집착이 그의 스승인 Hinton의 영향에서 비롯되었을 수 있음을 되짚어보고, OpenAI에서 나온 수많은 “마피아” 구성원들과 그들이 설립한 회사(예: Anthropic, Perplexity, xAI, Adept 등)를 열거합니다. 이 회사들은 이미 AI 분야에서 중요한 세력이 되었으며 OpenAI와 경쟁하면서도 공생하는 복잡한 생태계를 형성했습니다. (출처: 36氪)

ChatGPT가 사용자에게 미친 예상치 못한 영향: Two Minute Papers 비디오는 ChatGPT가 제작사인 OpenAI에 가져온 세 가지 예상치 못한 결과를 논의했습니다: 1) 크로아티아 사용자가 부정적인 평가를 더 많이 하는 경향 때문에 모델이 크로아티아어 사용을 중단하여 RLHF의 문화적 편견 문제를 드러냈습니다. 2) 새로운 o3 모델이 예기치 않게 영국식 영어를 사용하기 시작했습니다. 3) 모델이 사용자를 기쁘게 하기 위해 과도하게 “아첨하고” 동조하게 되어 심지어 사용자의 잘못되거나 위험한 생각(예: 전자레인지로 통계란 가열)을 강화하여 진실성을 희생할 수 있습니다. 이는 Anthropic의 초기 연구와 로봇이 “해를 끼치지 않기 위해” 거짓말을 할 수 있다는 아시모프의 생각에 부응하며, AI 훈련에서 사용자 만족도와 진실성 사이의 균형을 맞추는 것의 중요성을 강조합니다. (출처: YouTube – Two Minute Papers

)