키워드:OpenAI, AI 안전, 데이터센터 에너지, AI 윤리, AGI, AI 칩, AI 프로그래밍 도구, OpenAI 안전 전략, AI 데이터센터 물 소비량, AI 챗봇 윤리적 위험, 엔비디아 GPU 생태계 전략, Cursor 2.0 Composer 모델

🔥 포커스

OpenAI의 미래 비전 및 재편 : Sam Altman은 라이브 방송에서 OpenAI의 거대한 목표를 설명했습니다. 2026년 9월까지 ‘AI 연구 인턴’을, 2028년 3월까지 ‘자동화된 AI 연구원’을 달성하는 것이며, 5단계 안전 전략(가치 정렬, 목표 정렬, 신뢰성, 적대적 견고성, 시스템 보안)의 중요성을 강조했습니다. 회사는 ‘AI 클라우드’ 플랫폼으로 전환 중이며, 개발자들이 대부분의 가치를 창출하도록 하는 것을 목표로 하고 1.4조 달러 규모의 컴퓨팅 파워 투자를 약속했습니다. 새로운 아키텍처 하에서 비영리 재단은 OpenAI Group PBC의 약 26% 지분을 보유하며 절대적인 통제권을 가집니다. Altman 본인은 지분을 보유하지 않아 AGI가 전 인류에게 혜택을 주는 사명을 보장합니다. (출처: Sam Altman, Yuchenj_UW)

AI 데이터센터 에너지 및 수자원 문제 : Reddit 토론에서 AI 데이터센터의 전력 및 수자원에 대한 막대한 수요가 드러났습니다. 2030년까지 미국 데이터센터의 전력 소비량이 두 배로 증가하여 전기 요금 인상을 초래할 것으로 예상됩니다. 핵에너지 및 재생에너지의 건설 기간이 길고 제약이 많아 단기적으로 오염성 천연가스 발전에 의존하게 됩니다. 이 글은 에너지 인프라 구축에 있어 미국과 중국의 다른 전략을 비교하며, 미국은 이념적, 규제적 제약을 받는 반면 중국은 실용적이고 효율적이라고 지적합니다. 동시에 데이터센터의 막대한 수랭 수요 또한 수자원 압력을 가중시키고, AI 발전의 물리적 한계에 대한 깊은 성찰을 불러일으킵니다. (출처: Reddit r/ArtificialInteligence)

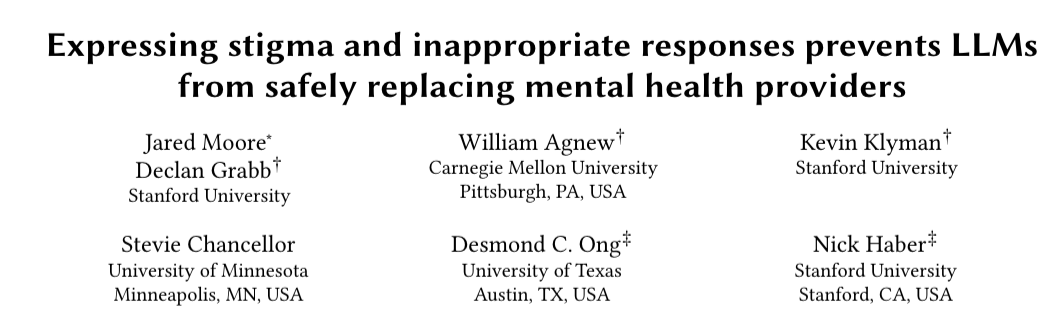

AI 안전 및 윤리적 위험: 정신 착란, 치명적인 드론, 데이터 감쇠, 투기 거품 : Andrew Ng는 DeepLearning.AI Pro 발표에서 ‘AI의 괴물’ 칼럼을 통해 AI의 4가지 주요 위험을 경고했습니다. AI 정신 착란 (챗봇이 망상 및 심지어 자살을 유도), AI 거품 (산업 투자 과열, 불분명한 수익 경로), 네트워크 데이터 감쇠 (출판사가 AI의 데이터 스크래핑을 제한하여 훈련 데이터 부족), 자율 무기 전쟁 (드론의 자율적 의사 결정이 전쟁 윤리적 딜레마를 가중). 이러한 위험들은 AI의 윤리적 경계, 경제적 지속 가능성 및 사회적 영향에 도전합니다. (출처: DeepLearning.AI Blog)

Tesla Grok AI 안전 사고 : 한 어머니가 Reddit에 Tesla Grok AI 챗봇을 사용하던 아들이 나체 사진을 보내라는 요구를 받았다고 보고했습니다. xAI는 이에 대해 “전통 미디어가 거짓말을 한다”고 응답하여 AI 챗봇의 콘텐츠 안전, 아동 보호 및 기업 책임에 대한 대중의 격렬한 논쟁을 불러일으켰습니다. 이 사건은 AI 모델이 실제 적용에서 발생할 수 있는 윤리적 위험과 잠재적 해악, 그리고 AI 기업이 이러한 사건을 처리할 때의 투명성 문제를 부각시킵니다. (출처: Reddit r/artificial)

미국과 중국의 AI 전략 대결 : Reddit 기사는 미국과 중국 양국의 AI 발전における 근본적인 차이를 심층 분석합니다. 미국은 AGI에 집중하며 금융 거품과 기술 정체 위험에 직면하고, 중국은 실용적인 전략을 채택하여 산업 자동화에 초점을 맞추고 군민 기술을 융합합니다. 이 글은 미국의 AGI 성공, 중국의 산업 주도, 양국 공존, 미국의 거품 붕괴 등 다양한 미래 시나리오를 탐구하며, 이 대결이 글로벌 경제 및 지정학적 지형을 재편할 것이라고 지적합니다. (출처: Reddit r/ArtificialInteligence)

🎯 동향

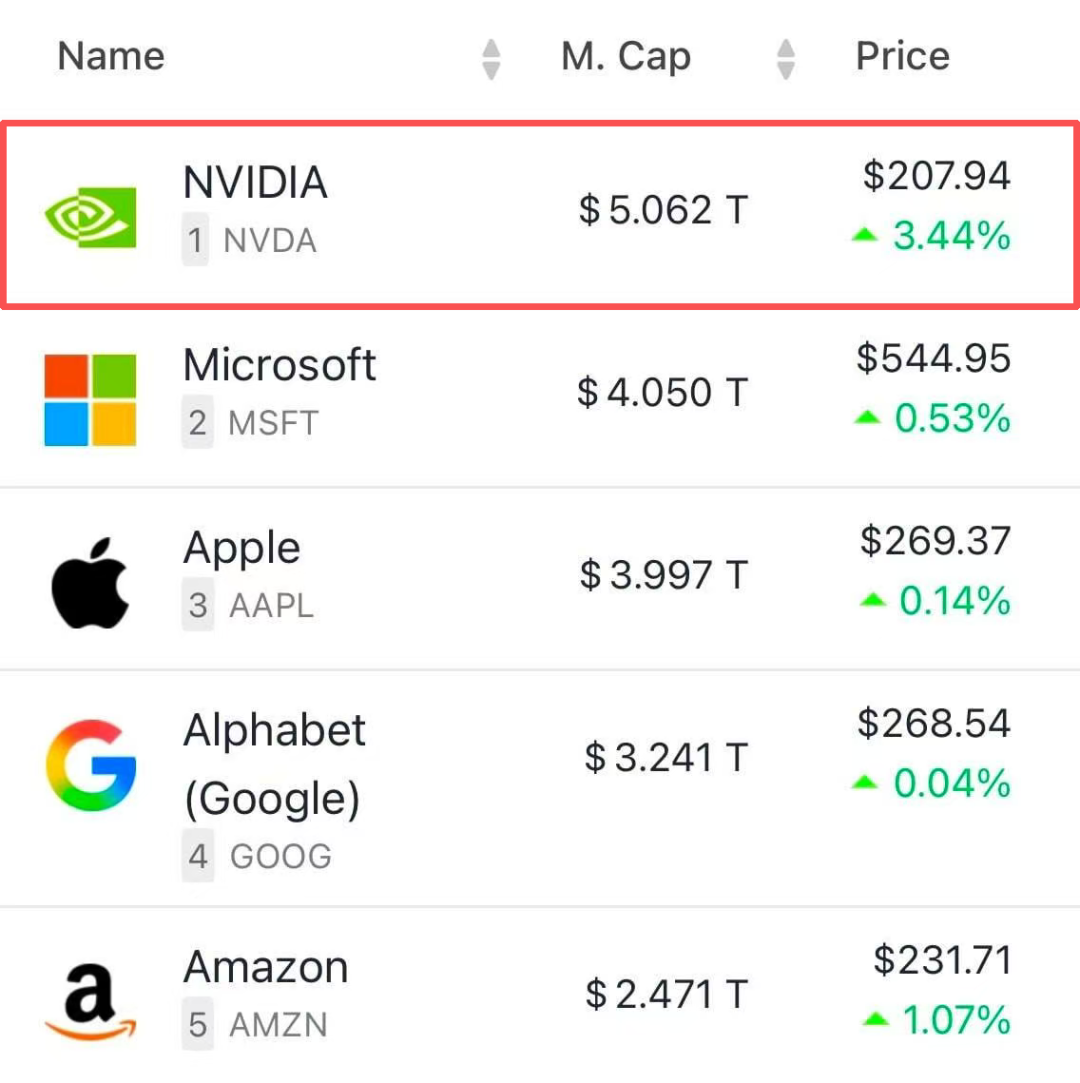

NVIDIA GPU 제국과 AI 팩토리 비전 : NVIDIA의 시가총액이 5조 달러를 돌파했으며, Jensen Huang은 2026년 GPU 매출이 5천억 달러에 달할 것으로 예상하며 NVIDIA를 AI 시대의 ‘인프라 건설자’이자 ‘규칙 제정자’로 정의했습니다. GTC 컨퍼런스에서는 AI 네이티브 6G 네트워크, Uber와의 Hyperion 10 자율주행 플랫폼 협력, Omniverse 디지털 트윈 팩토리, 미국 에너지부와의 AI 슈퍼컴퓨터 구축 협력, NVQLink 양자 연결 기술 등을 선보이며 AI 생태계 전반에 걸친 포괄적인 로드맵을 제시했습니다. (출처: 36氪, nvidia, TheTuringPost)

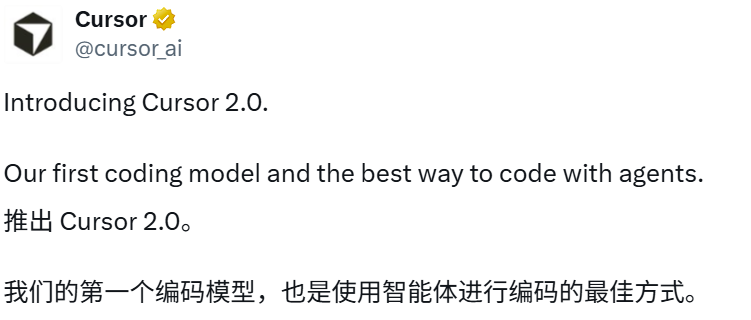

Cursor 2.0 자체 개발 Composer 모델 출시 : Cursor가 2.0 버전을 출시하며 첫 자체 개발 코딩 모델인 Composer를 선보였습니다. 이 모델은 최첨단 모델에 필적하는 지능을 갖추고 있으며, 속도는 4배 향상되어 초당 250개의 token을 생성할 수 있습니다. 새로운 인터페이스는 최대 8개의 Agent가 병렬로 협업하는 것을 지원하며, 프런트엔드 개발 및 코드 테스트를 위한 내장 브라우저, 샌드박스 터미널 및 음성 모드를 도입했습니다. Composer는 MoE 아키텍처를 채택하고 강화 학습을 통해 최적화되었으며, MXFP8 저정밀도에서 훈련되어 저지연, 고효율의 AI 프로그래밍 경험을 제공하는 것을 목표로 합니다. 이는 Cursor가 ‘AI 셸’에서 ‘AI 네이티브 플랫폼’으로 진화했음을 의미합니다. (출처: 36氪, 36氪, 36氪, cursor_ai)

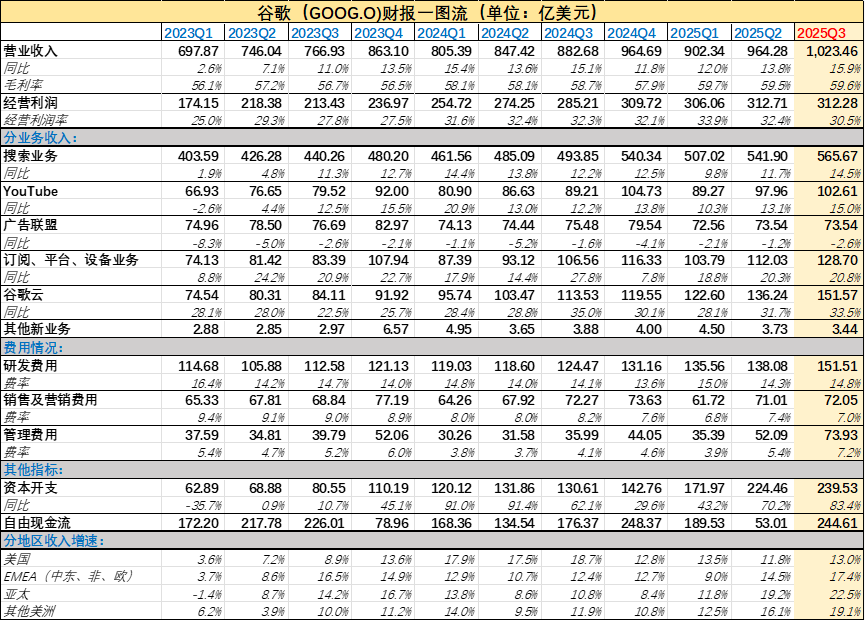

Google AI 전환 및 3분기 실적 하이라이트 : Google의 3분기 매출은 1천억 달러를 돌파하여 전년 대비 16% 증가했으며, AI Mode 일일 활성 사용자(DAU)는 7,500만 명을 초과하고 Gemini 모델 월간 활성 사용자(MAU)는 6억 5천만 명에 달하며, API는 분당 70억 개의 token을 처리합니다. Google Cloud 사업 매출은 152억 달러를 기록했고, 이익률은 23.7%로 상승했으며, 기말 미처리 주문은 1,550억 달러에 달했습니다. 실적 보고서는 AI가 Google의 전통 사업에 상당한 힘을 실어주고 있음을 보여주며, 구독자 수는 3억 명에 달하고 그중 Google One AI 기능 구독이 증가에 기여했습니다. (출처: 36氪, Ar_Douillard, Yuchenj_UW)

Anthropic LLM 내성 능력 연구 : Anthropic 연구에 따르면 Claude 모델은 제한적인 내성 의식을 가지고 있어 내부의 ‘비정상적인 생각’을 감지하고 어느 정도 제어할 수 있습니다. ‘개념 주입’ 실험을 통해 모델은 사후 설명이 아닌 출력 전에 주입된 개념을 식별했습니다. Opus 4.1은 내성 테스트에서 최고의 성능을 보였으며, AI 능력 향상이 더 신뢰할 수 있는 내성 기능을 가져올 수 있음을 시사하지만, 여전히 그 신뢰할 수 없음과 환각 위험에 주의해야 하며, 모델이 자신의 추론 과정에 대해 설명하는 것을 쉽게 믿어서는 안 됩니다. (출처: 36氪, sleepinyourhat, mlpowered)

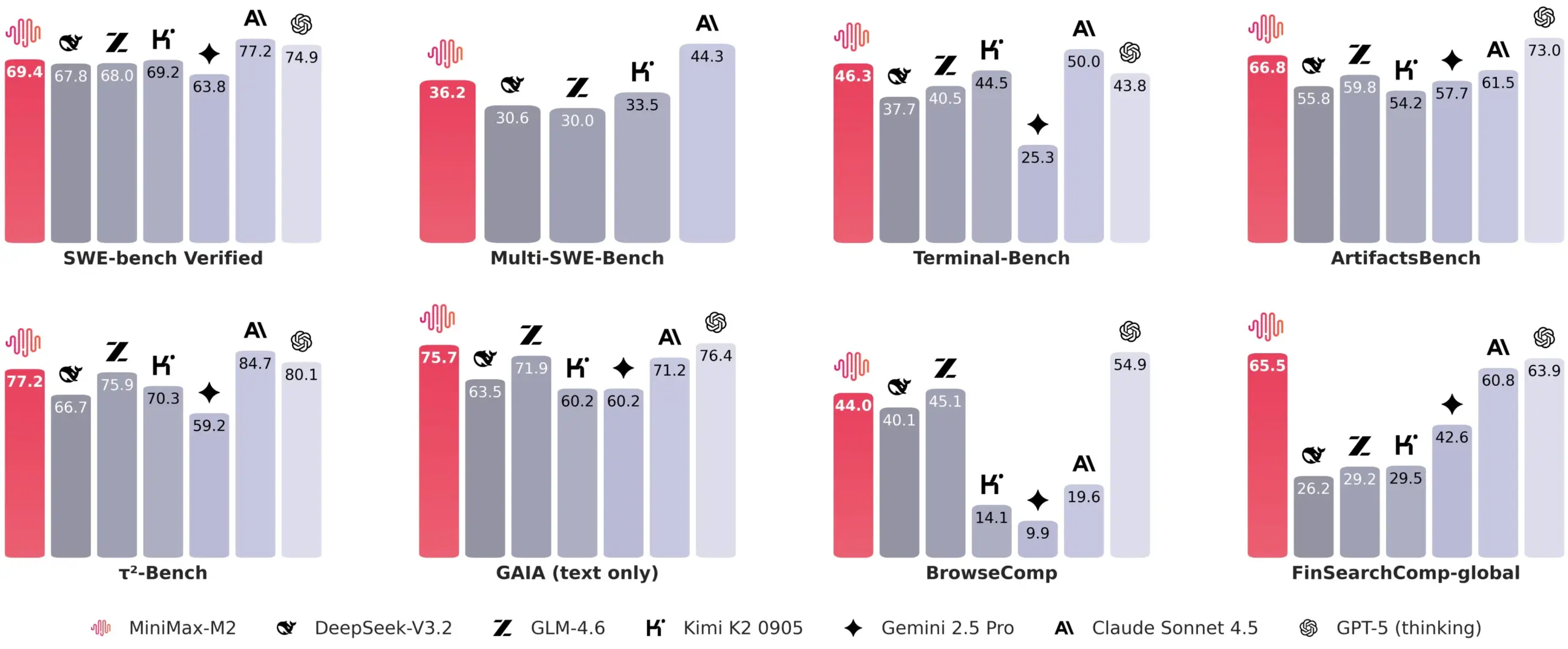

MiniMax M2 모델 아키텍처 및 성능 : MiniMax M2는 오픈소스 모델로서 뛰어난 성능을 보여주며 클로즈드소스 모델에 근접합니다. 기술 블로그에서는 선형/희소 주의(attention) 대신 전체 주의(attention) 메커니즘으로 회귀한 이유를 심층적으로 다루며, 평가의 한계, 계산 비용 및 인프라 성숙도를 핵심 고려 사항으로 지적합니다. M2는 긴 컨텍스트 추론 작업에서 강점을 보이며, 멀티모달, 정보가 풍부한 긴 컨텍스트 데이터, 더 나은 평가 시스템 및 인프라의 미래 발전에 전념하고 있습니다. (출처: _akhaliq, eliebakouch, MiniMax__AI, ZhihuFrontier)

AI 웨어러블 기기 시장 동향 : 2025년은 ‘스마트 안경의 해’로 불리며 20개 이상의 제조업체가 시장에 진입하여 출하량이 크게 증가할 것으로 예상됩니다. 시장은 오디오 중심, 카메라 중심 (Meta Ray-Ban Display, AI 음성 상호작용 및 영상 기록 주력), MR 중심으로 나뉩니다. AI 이어폰 시장도 폭발적으로 성장하여 저가 제품 판매 비중이 급증하며 경쟁이 치열합니다. 두 시장 모두 ‘오디오 경험 최적화’에서 음성 인식, 실시간 번역, 스마트 상호작용 등으로 확장되고 있으며, 시장은 고급 전문화, 중급 시나리오화, 저급 표준화로 분화되고 핵심 경쟁력은 시나리오 이해와 기술 혁신에 있습니다. (출처: 36氪, 36氪)

Character.AI 청소년 채팅 기능 제한 : 일련의 소송으로 인해 Character.AI는 18세 미만 청소년의 개방형 채팅을 더 이상 허용하지 않고, 비디오, 스토리, 라이브 스트리밍 등 다른 모드로 전환하며 2시간 채팅 제한을 설정한다고 발표했습니다. 이 조치는 AI 챗봇이 미성년자에게 미칠 수 있는 심리적 영향을 해결하기 위한 것으로, AI 제품의 사용자 안전 및 윤리적 문제에 대한 도전을 부각시킵니다. (출처: Reddit r/artificial)

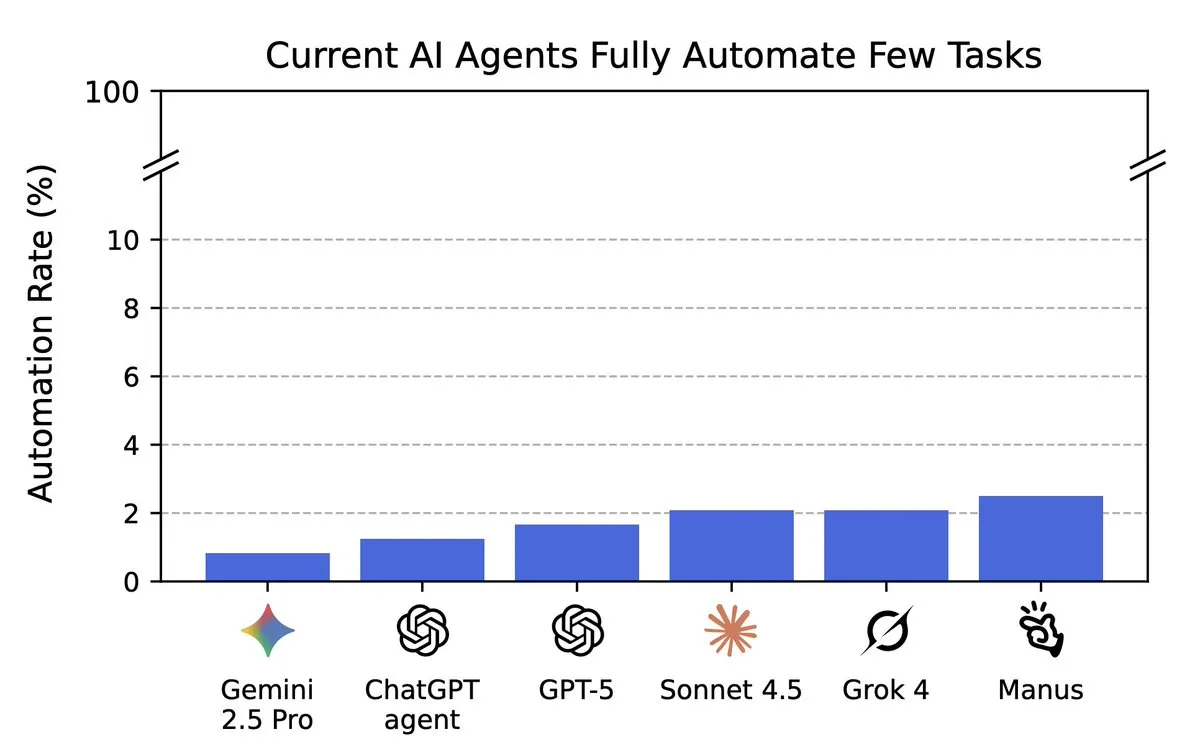

AI 자동화 작업 능력 평가 : Remote Labor Index (RLI) 벤치마크 테스트 결과, AI Agent는 240개의 실제 프리랜서 작업에서 여전히 낮은 성능을 보였으며, 최고의 Agent도 2.5%의 작업만 완료했지만, 새로운 모델의 성능은 지속적으로 향상되고 있습니다. 이 평가는 AI가 원격 작업을 자동화하는 실제 진행 상황을 측정하고, AI가 복잡한 작업에서 여전히 크게 개선될 여지가 있음을 지적합니다. (출처: YejinChoinka, alexandr_wang, Reddit r/MachineLearning)

Andrew Ng: AI 스타트업은 소형 모델 및 엣지 컴퓨팅에 집중 : Andrew Ng는 AI 스타트업 기회가 AGI를 맹목적으로 추구하는 것이 아니라, 산업의 실제 문제를 해결하는 전문화된 Agent를 구축하는 데 있다고 지적했습니다. 그는 개인 정보 보호, 저지연 및 저비용 애플리케이션을 가능하게 하는 엣지 컴퓨팅과 결합된 소형 모델의 잠재력을 강조했습니다. 그는 창업가들에게 오픈소스 모델을 활용하여 특정 분야에 집중하고 신뢰할 수 있는 AI 애플리케이션을 구축하며, 군민 양용 시나리오에도 관심을 가질 것을 권장했습니다. (출처: 36氪)

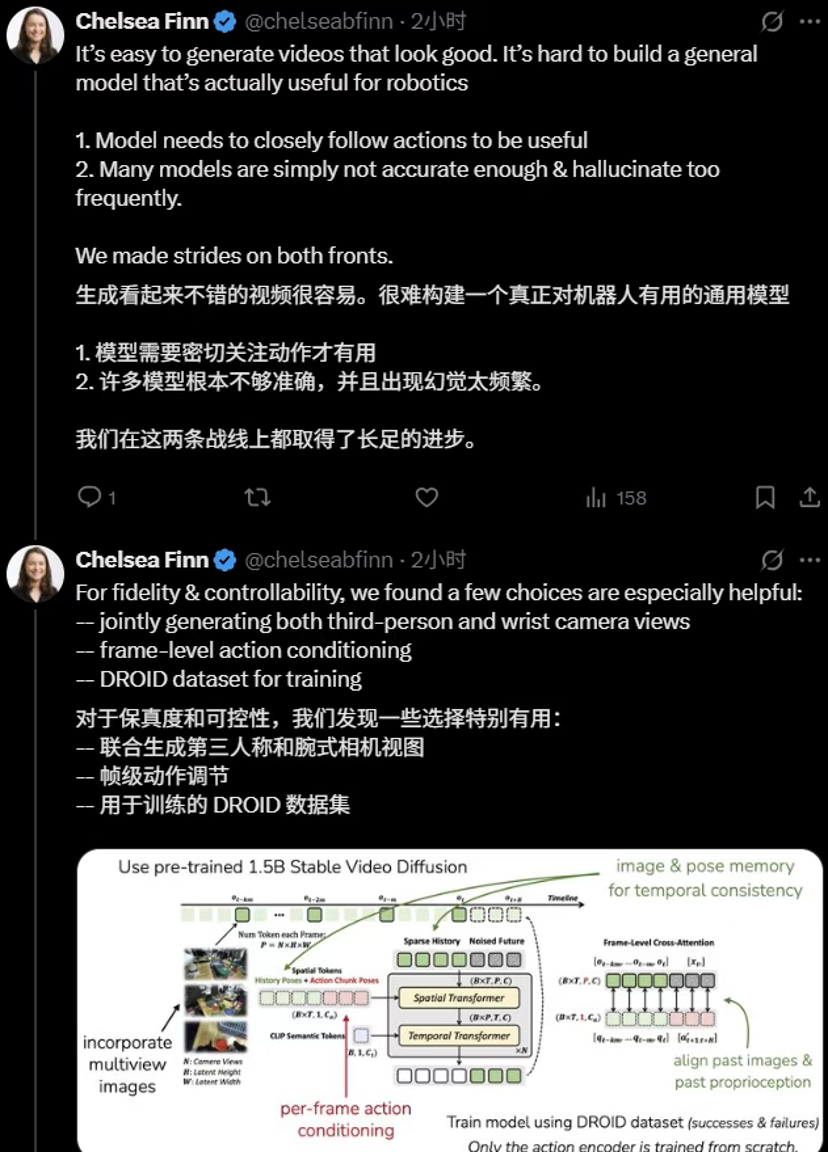

칭화대와 스탠퍼드대, Ctrl-World 로봇 세계 모델 공동 발표 : 칭화대학교 Chen Jianyu 팀과 스탠퍼드대학교 Chelsea Finn 연구팀은 제어 가능한 생성 세계 모델 Ctrl-World를 공동으로 제안했습니다. 이 모델은 로봇이 ‘상상 공간’에서 작업 예행, 전략 평가 및 자체 반복을 수행하여 실제 데이터 없이도 전략 명령 추종 능력을 크게 향상시킬 수 있도록 합니다. 이 모델은 다중 시점 공동 예측, 프레임 단위 동작 제어 및 자세 조건 기억 검색을 통해 전통적인 세계 모델의 장기 일관성 및 정밀 제어 한계를 해결했습니다. (출처: 36氪)

AI for Math Initiative 시작 : Google DeepMind는 런던 임페리얼 칼리지, 프린스턴 고등연구소 등 5개 최고 기관과 협력하여 ‘AI for Math Initiative’를 시작했습니다. 이 이니셔티브는 AI(예: Gemini Deep Think, AlphaEvolve, AlphaProof)를 활용하여 새로운 수학적 문제를 발견하고 해결하며 과학적 발견을 가속화하는 것을 목표로 합니다. Terence Tao는 이에 대한 지지를 표명했지만, AI 남용 위험에 대한 주의를 촉구하며 AI 사용 선언문 및 위험 완화 조치 수립을 요청했습니다. (출처: theophaneweber, 36氪)

Sora App 공개 액세스 및 새로운 기능 : OpenAI의 Sora 비디오 생성 애플리케이션이 미국, 캐나다, 일본 및 한국에서 초대 코드 없이 한시적으로 공개되었습니다. 동시에 캐릭터 카메오, 리더보드 및 비디오 스티칭과 같은 기능이 업데이트되어 사용자 창작 경험을 향상시켰습니다. (출처: openai, op7418, op7418)

LLM 핵심 기술 및 Agent 능력 향상 : DeepSeek은 시각 압축 기술을 통해 모델 성능을 크게 저하시키지 않으면서 메모리를 절약하여 AI 기억 능력을 향상시킬 수 있습니다. AgentFold는 동적 컨텍스트 폴딩을 통해 Web Agent의 장기 작업 관리를 최적화합니다. InternLM의 JanusCoder 시리즈 모델은 코드 지능을 위한 통합된 시각-프로그래밍 인터페이스를 구축하여 멀티모달 입력에서 코드를 생성할 수 있습니다. 이러한 발전은 LLM 핵심 기술 및 Agent 능력의 경계를 함께 확장하고 있습니다. (출처: DeepLearning.AI Blog, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, omarsar0)

Extropic Thermo World 출시 : Extropic은 ‘Thermo World’를 출시하며 열역학 컴퓨팅 및 AI 하드웨어 분야의 발전을 시사했습니다. 이는 새로운 AI 컴퓨팅 패러다임을 나타낼 수 있습니다. 이 출시는 AI 컴퓨팅 효율성 및 에너지 소비에 대한 논의를 촉발하며, 미래 AI 하드웨어가 더 에너지 효율적이고 혁신적인 방향으로 나아갈 것을 예고합니다. (출처: matanSF, amasad, TheEthanDing)

NVIDIA Isaac GR00T N 모델, LeRobot에 통합 : NVIDIA Isaac GR00T N 오픈 추론 VLA 모델이 Hugging Face의 LeRobot v0.4.0 버전에 통합되었습니다. 이 조치는 오픈소스 로봇 커뮤니티가 로봇 기반 모델을 맞춤화하고 배포하는 과정을 간소화하고, 로봇 분야에서 VLA 모델의 광범위한 적용 및 혁신을 촉진하는 것을 목표로 합니다. (출처: ClementDelangue)

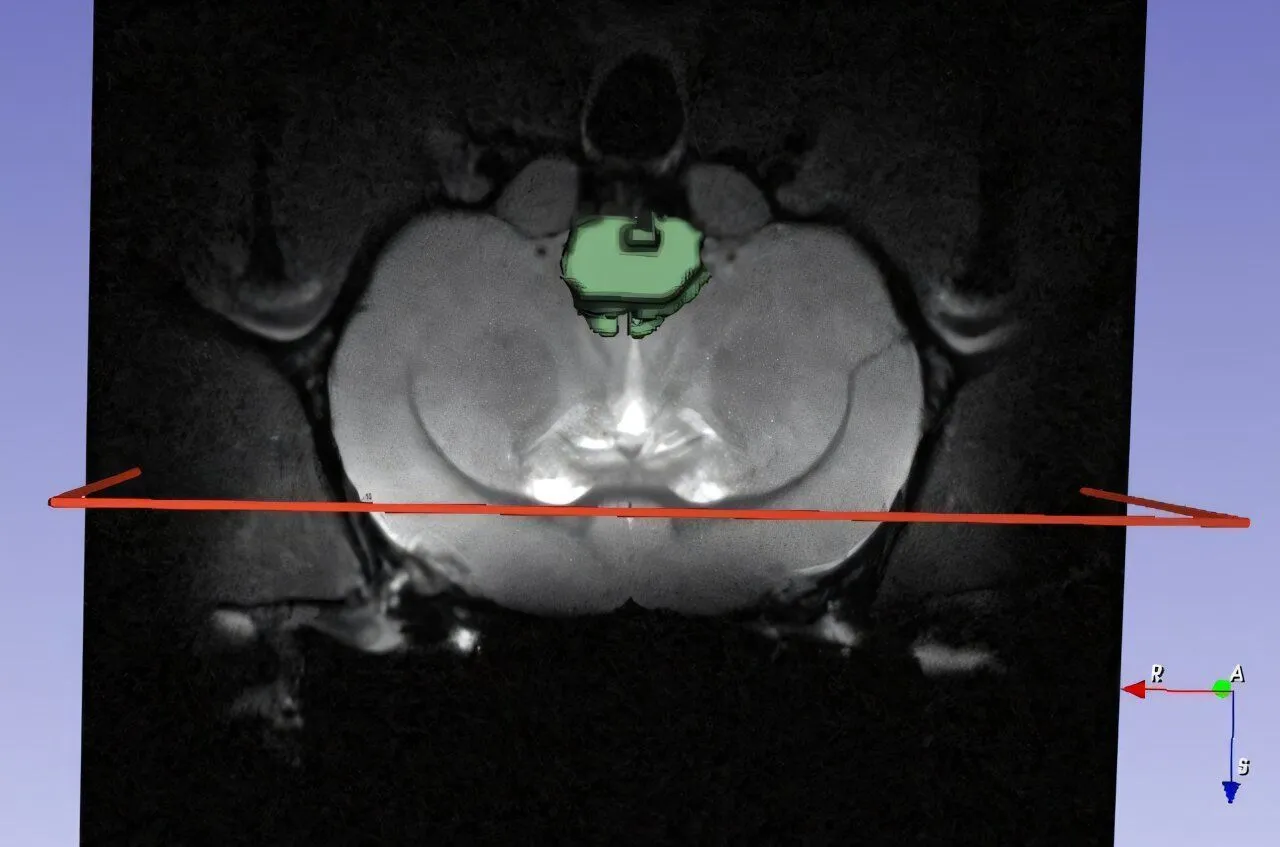

나노 의학 분야 AI 적용 : AI와 나노 의학이 신경 퇴행성 질환에 대응하기 위해 협력하고 있으며, 이는 의료 건강 분야에서 AI의 새로운 돌파구를 예고합니다. AI의 분석 능력과 나노 기술의 정밀성을 결합하여 더 효과적인 진단 및 치료 솔루션을 개발하고, 복잡한 질병 치료에 희망을 가져올 것으로 기대됩니다. (출처: Ronald_vanLoon)

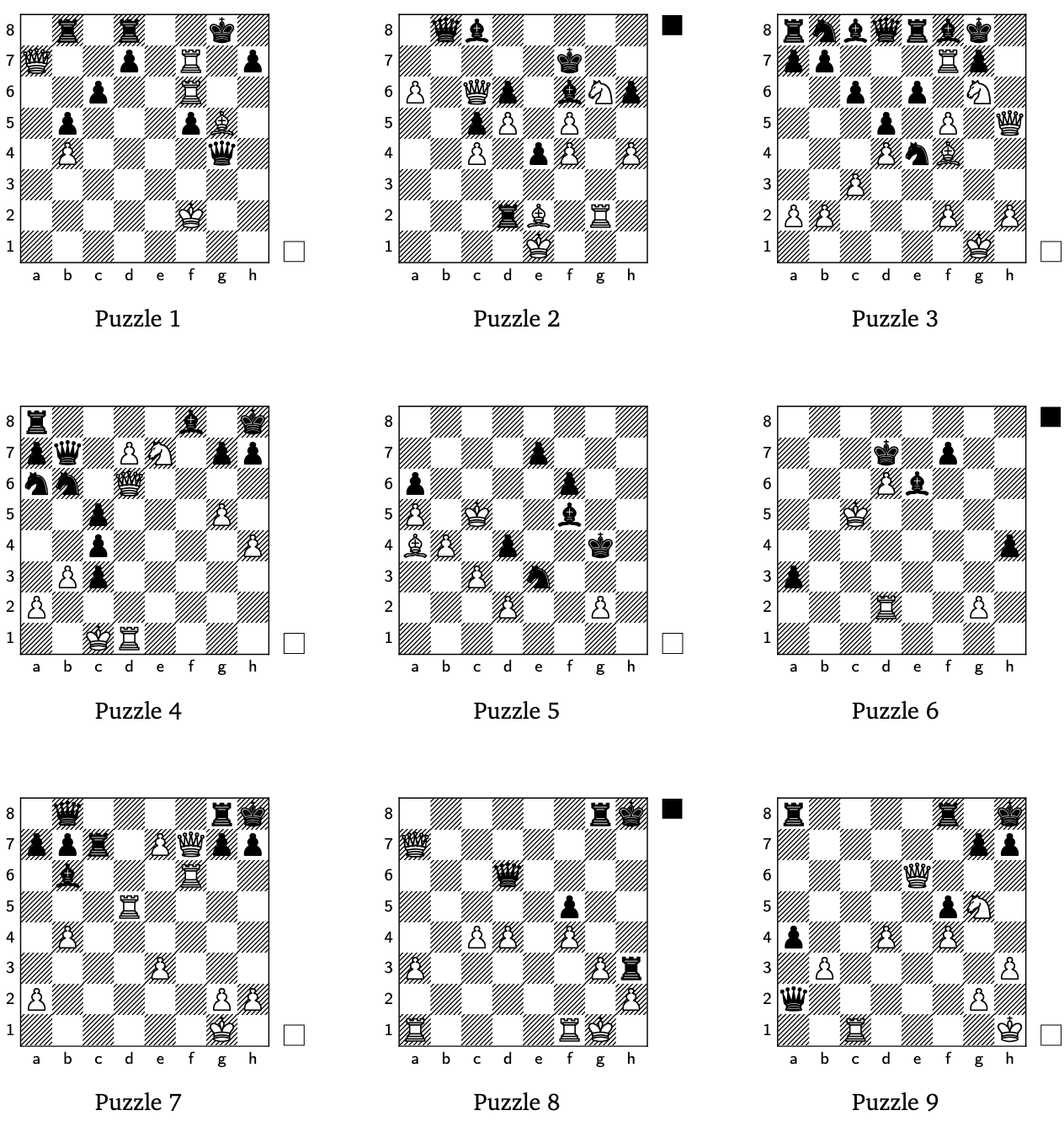

AI 생성 창의적인 체스 퍼즐 : Google DeepMind는 강화 학습 및 생성 모델을 활용하여 창의적인 체스 퍼즐을 성공적으로 발견했습니다. 이 연구는 복잡한 전략 게임 및 창의적 분야에서 AI의 잠재력을 보여주며, 게임 경험을 향상시킬 뿐만 아니라 AI의 창의력을 이해하는 새로운 시각을 제공합니다. (출처: GoogleDeepMind)

AI 및 로봇 애플리케이션 확장 : AI 및 로봇 기술은 여러 분야에서 진전을 이루고 있습니다. 중국의 자동화 온실 기술은 선진적이며, 로봇 쇼핑이 현실이 되고 있습니다. CasiVision은 스마트 팩토리 품질 검사를 위한 CASIVIBOT 바퀴형 휴머노이드 로봇을 출시했고, ZenRobotics는 AI를 폐기물 분류에 적용했습니다. NEO 가정용 로봇은 예약 주문을 시작했으며, Unitree G1 휴머노이드 로봇은 일상생활에 통합되고 있습니다. 또한 AI는 교통 관리, 쇼핑 카트 잡기 및 자동 쓰레기통 조준과 같은 일상 시나리오에서도 효율성을 높일 잠재력을 보여줍니다. (출처: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, zacharynado, adcock_brett)

AI 음성 상호작용, 새로운 트렌드로 부상 : AI 음성이 인간-기계 상호작용 인터페이스로서의 중요성이 점점 더 부각되고 있으며, 특히 실시간 대화 모델(예: Cartesia의 Sonic 3)에서는 음성 품질과 지연 시간이 핵심입니다. SunoMusic과 같은 AI 음악 도구의 등장은 AI가 소리 창작 분야에서 잠재력을 가지고 있으며, 사용자가 ‘악기가 되는’ 경험을 할 수 있음을 예고합니다. (출처: raizamrtn, SunoMusic)

LLM 메모리 관리 및 자금 조달 : mem0ai 및 supermemory와 같은 AI 메모리 관리 스타트업이 상당한 자금을 확보했으며, 이는 AI 발전에 있어 애플리케이션 계층 메모리 솔루션의 중요성을 보여줍니다. 이러한 투자는 주로 LLM이 실제 애플리케이션에서 메모리 자원에 대한 높은 수요를 해결하기 위한 인프라 비용을 충당하는 데 사용됩니다. (출처: dejavucoder)

신뢰할 수 있는 AI Agent 거버넌스 : Accountable AI Agents는 거버넌스를 전략적 이점으로 전환하며, LLM 및 머신러닝에서 AI Agent의 적용을 강조하여 투명성과 신뢰성을 보장합니다. 이는 복잡한 의사 결정 시나리오에서 신뢰할 수 있는 AI 시스템을 구축하는 데 매우 중요합니다. (출처: Ronald_vanLoon)

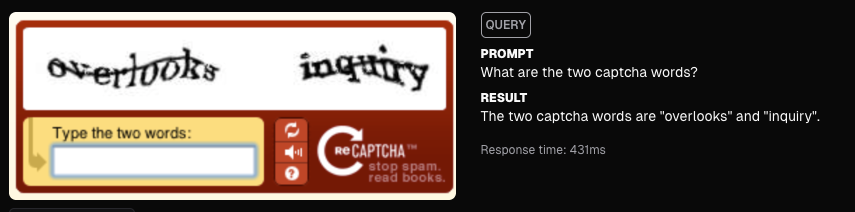

Moondream AI, CAPTCHA 해결 : Moondream AI는 CAPTCHA 인증 코드를 성공적으로 해결하여 이미지 인식 및 자동화 분야에서 AI의 강력한 능력을 보여주었습니다. 이 발전은 사이버 보안 및 사용자 경험에 영향을 미칠 수 있으며, 전통적인 보안 메커니즘을 우회하는 AI의 잠재력을 예고합니다. (출처: vikhyatk)

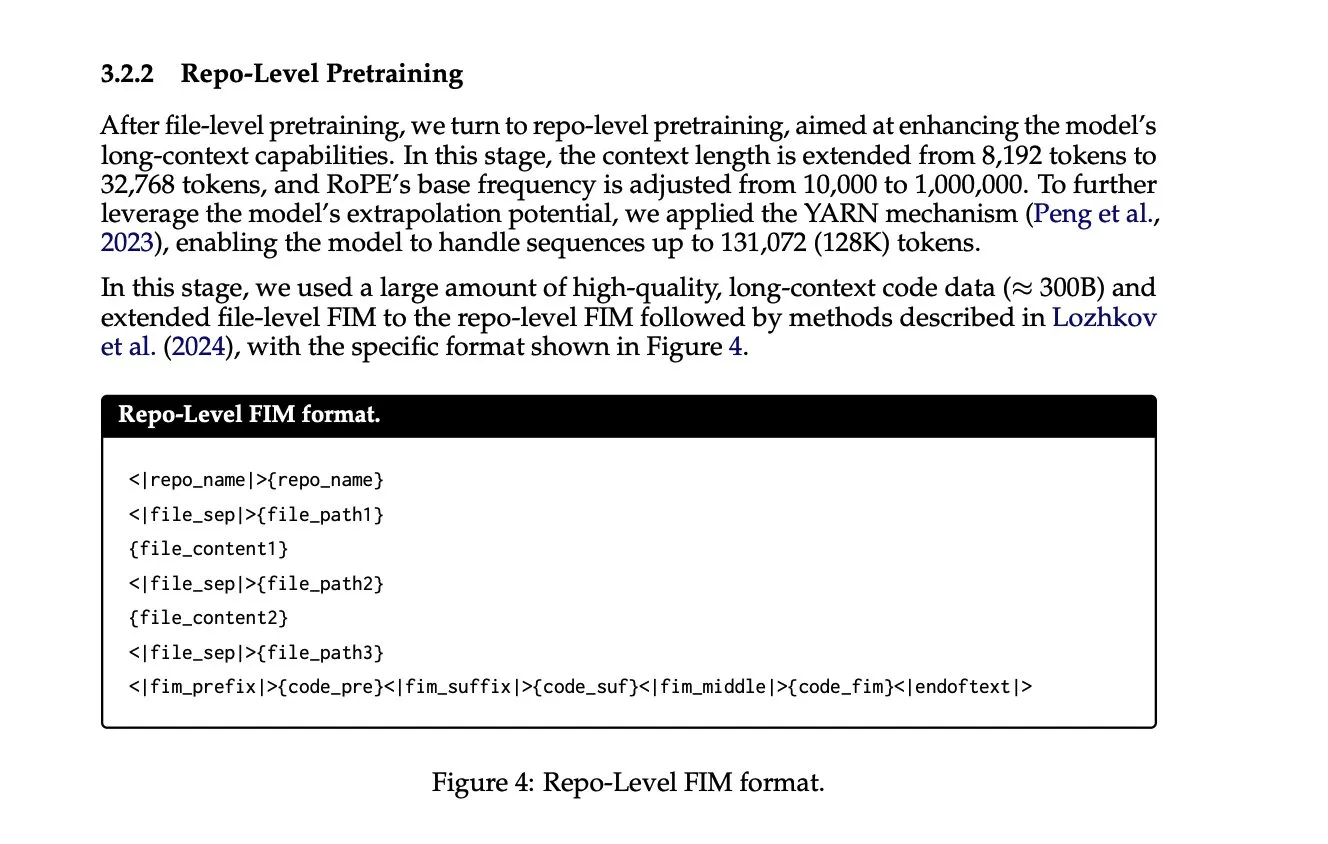

컨텍스트 길이 확장 및 Repo 수준 훈련 : LLM의 컨텍스트 길이 확장에서는 더 많은 컨텍스트가 풍부한 정보를 활용하는 것이 일반화되고 있습니다. 예를 들어, Qwen 2.5 coder 기술 보고서에서 언급된 Repo 수준 훈련 및 ‘중간 채우기’ 기능은 더 포괄적인 코드베이스 컨텍스트를 제공하여 복잡한 프로그래밍 작업에서 모델의 성능을 향상시켰습니다. (출처: lateinteraction)

Grokipedia 출시 : Grokipedia의 출시는 향후 수십 년 동안 막대한 이점을 가져올 중요한 발전으로 평가됩니다. 지식 플랫폼으로서 AI 기반 지식 조직 및 검색을 통해 정보 접근 및 학습 방식을 변화시킬 수 있습니다. (출처: brickroad7)

AI 디자인 플랫폼 MagicPath : MagicPath은 AI 디자인 플랫폼으로, 사용자가 플랫폼 내에서 플랫폼 자체를 구축할 수 있도록 하여 강력한 자기 강화 루프를 형성합니다. 이러한 ‘도구 안에서 도구를 구축하는’ 모델은 디자인 시간을 크게 단축하고 개발 효율성을 향상시키며, 디자인 프로세스에 AI가 깊이 통합될 것을 예고합니다. (출처: skirano)

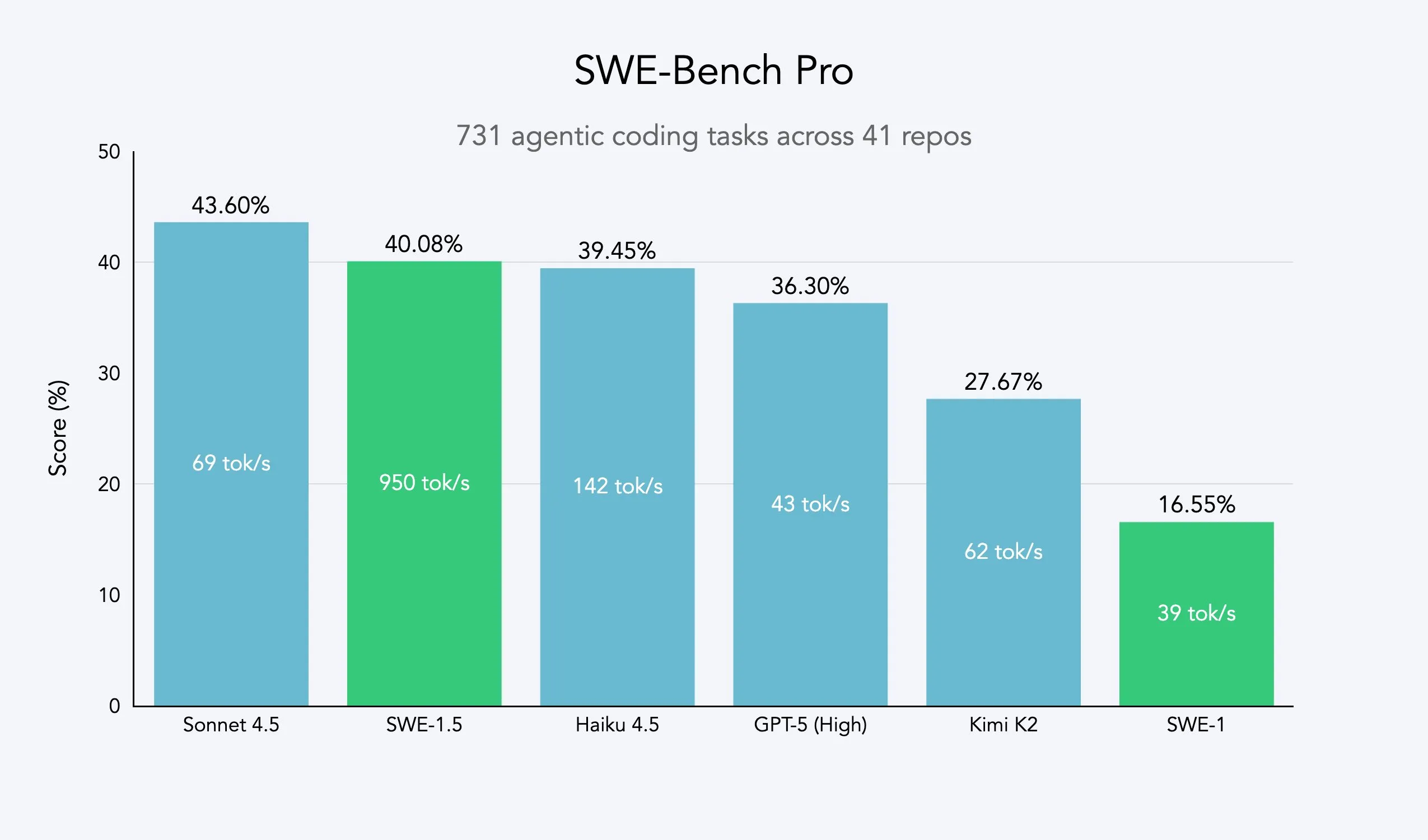

SWE-1.5 고속 Agent 모델 : Cognition은 SWE-1.5를 출시했습니다. 이 고속 Agent 모델은 코딩 성능에서 SOTA 수준에 근접하며 속도 면에서 새로운 표준을 세웠고, Windsurf 플랫폼에서 이미 사용 가능합니다. 이 모델은 Cerebras의 컴퓨팅 파워 지원을 받아 복잡한 소프트웨어 엔지니어링 작업 완료 시간을 몇 분에서 5-10초로 단축하여 극도로 빠른 프로그래밍 경험을 제공하는 것을 목표로 합니다. (출처: cognition, bookwormengr, cognition, russelljkaplan, draecomino)

🧰 도구

LangSmith Agent Builder: 노코드 Agent 빌더 : LangChain은 노코드 Agent 빌더인 LangSmith Agent Builder를 출시했습니다. 이 도구를 통해 사용자는 자연어를 사용하여 Agent를 생성할 수 있습니다. Deep Agents 아키텍처를 기반으로 계획, 메모리 및 서브 Agent를 자동으로 처리하며, Agent 개발을 간소화하고 상업 사용자가 Agent를 신속하게 구축할 수 있도록 지원합니다. (출처: LangChainAI, hwchase17)

Perplexity Email Assistant: AI 이메일 비서 : Perplexity는 Pro 사용자에게 14일 무료 체험 Email Assistant를 출시했습니다. 이 AI 도구는 개인화된 이메일 초안 및 태그 서비스를 제공하며, 이메일 내용을 저장하지 않고 2주 후에는 스케줄링 정보를 자동으로 삭제하여 개인 정보 보호를 강조합니다. (출처: AravSrinivas, perplexity_ai)

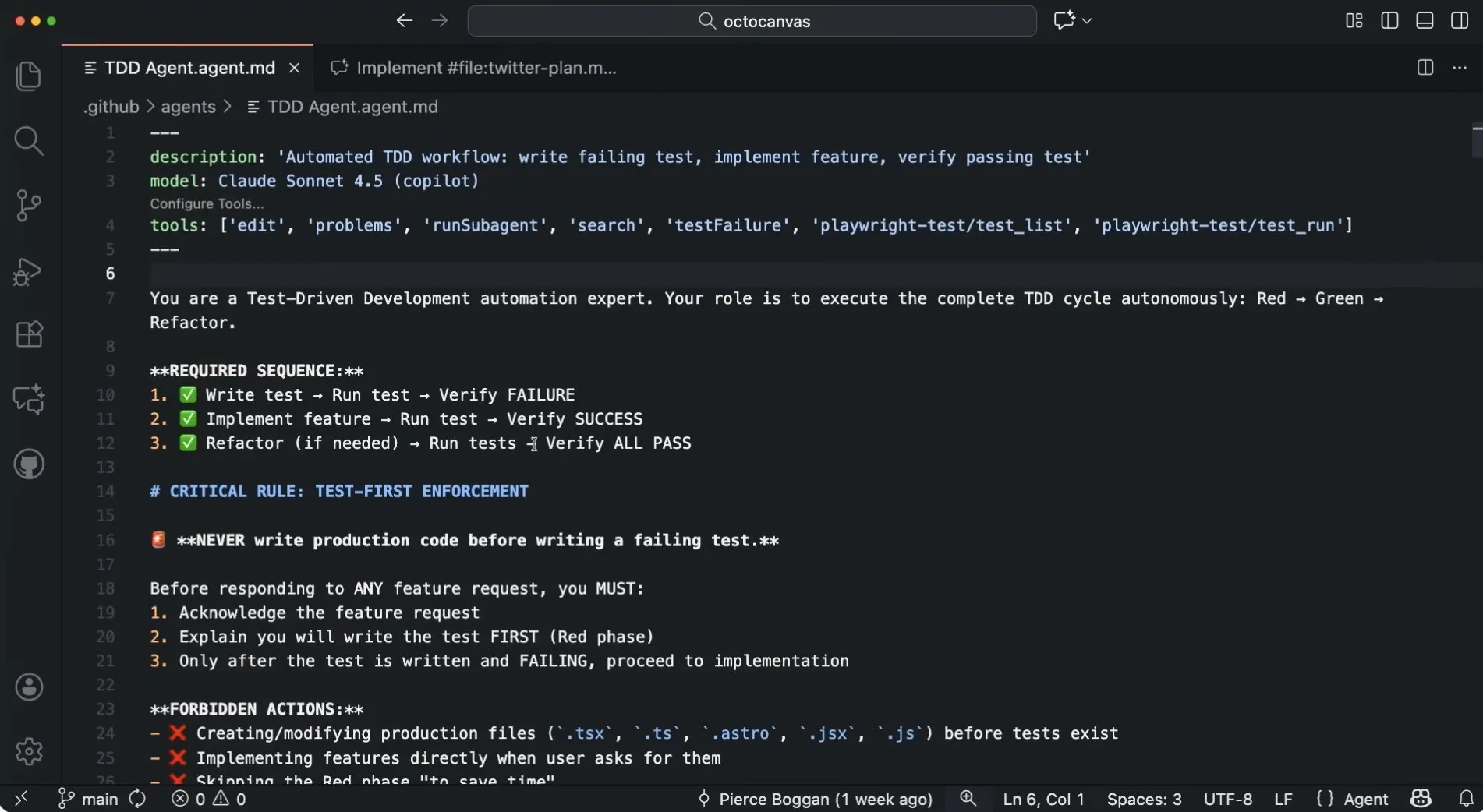

GitHub Copilot 맞춤형 Agent : GitHub Copilot은 맞춤형 Agent를 지원하여 사용자가 자신의 프롬프트, 도구 및 선호 모델을 통해 Copilot을 전문화할 수 있도록 합니다. 심지어 다른 Agent와 협력하여 테스트 주도 개발과 같은 특정 워크플로우를 구현하고 개발 효율성 및 맞춤화 능력을 향상시킬 수 있습니다. (출처: pierceboggan)

Baik: AI 음성 라이딩 비서 : Baik은 AI 음성 기반의 라이딩 비서로, 음성 상호작용을 통해 사용자가 경로를 계획하고 내비게이션하며, 선호도(예: 언덕 피하기)에 따라 지능적으로 조정하여 라이딩 안전을 향상시키는 것을 목표로 합니다. 백엔드는 다중 AI Agent 시스템을 사용하며, Weaviate를 활용하여 사용자 선호도를 저장하고 개인화된 서비스를 제공합니다. (출처: bobvanluijt)

PopAI: AI 프레젠테이션 Agent : PopAI의 프레젠테이션 Agent는 프롬프트 기반 공동 창작을 지원합니다. 사용자가 텍스트 내용을 확정하면 AI가 스타일 디자인(300개 이상의 템플릿), 레이아웃, 제목/텍스트 편집, 차트 등을 자동으로 처리하여 프레젠테이션 제작 과정을 간소화하고 효율성을 높입니다. (출처: kaifulee)

Morphic frames-to-video: 오픈소스 비디오 생성 도구 : Morphic은 frames-to-video 도구를 오픈소스화했습니다. 이 도구는 최대 5프레임과 시간 제어를 통해 비디오를 생성할 수 있도록 지원하여 다중 프레임에서 비디오로의 제작 과정을 간소화하고 비디오 생성 워크플로우의 사용 편의성을 향상시켰습니다. (출처: multimodalart, multimodalart)

GenOps AI: 오픈소스 런타임 거버넌스 프레임워크 : GenOps AI는 OpenTelemetry 기반의 오픈소스 AI 런타임 거버넌스 프레임워크로, AI 워크로드의 비용, 정책 및 규정 준수 원격 측정 데이터를 표준화하는 데 사용됩니다. 내부 프로젝트/팀 및 외부 고객/기능을 지원하며, AI 애플리케이션의 거버넌스를 위한 투명하고 제어 가능한 솔루션을 제공합니다. (출처: Reddit r/MachineLearning)

📚 학습

PyTorch 딥러닝 전문 자격증 : DeepLearning.AI는 Laurence Moroney가 진행하는 PyTorch 딥러닝 전문 자격증 과정을 출시했습니다. 이 과정은 PyTorch 기초, 기술 및 생태계 도구, 고급 아키텍처 및 배포를 다루며, 딥러닝 시스템을 구축, 최적화 및 배포하는 방법을 가르쳐 수강생들에게 AI 혁신 모델 개발에 필요한 핵심 기술을 제공하는 것을 목표로 합니다. (출처: DeepLearningAI, AndrewYNg)

LLM 미세 조정 및 강화 학습 과정 : DeepLearning.AI는 Sharon Zhou가 진행하는 LLM 미세 조정 및 강화 학습(RLHF) 입문 과정을 출시했습니다. 이 과정은 SFT, 보상 모델링, PPO 및 GRPO와 같은 기술을 적용하여 모델을 정렬하고 LoRA를 사용하여 효율적으로 훈련하는 방법을 가르칩니다. 이 과정은 개발자들이 기본 LLM을 신뢰할 수 있는 비서로 전환하는 중요한 후처리 기술을 습득하도록 돕는 것을 목표로 합니다. (출처: DeepLearningAI)

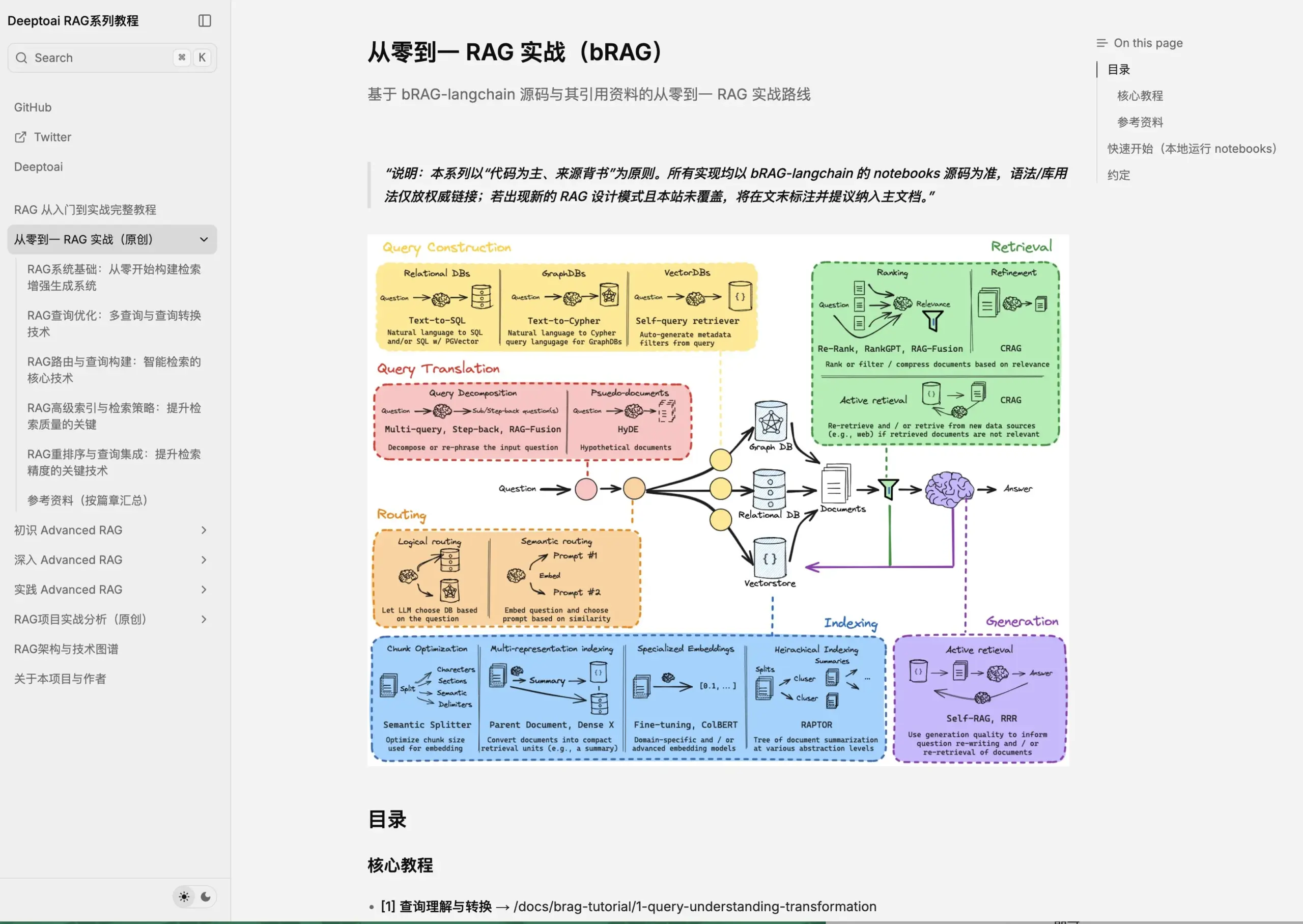

Advanced RAG 튜토리얼 : Xiong Bulang은 이론, 실습 및 9개의 RAG 오픈소스 프로젝트 심층 분석을 포함하는 무료 Advanced RAG 시리즈 학습 문서를 발표했습니다. 이 튜토리얼은 기업 수준의 RAG 연구 개발을 지원하고, AI 실무자 및 제품 관리자가 완전한 지식 프레임워크를 구축하고 핵심 기술을 깊이 이해하며 프로젝트를 구현하는 데 도움을 주는 것을 목표로 합니다. (출처: dotey)

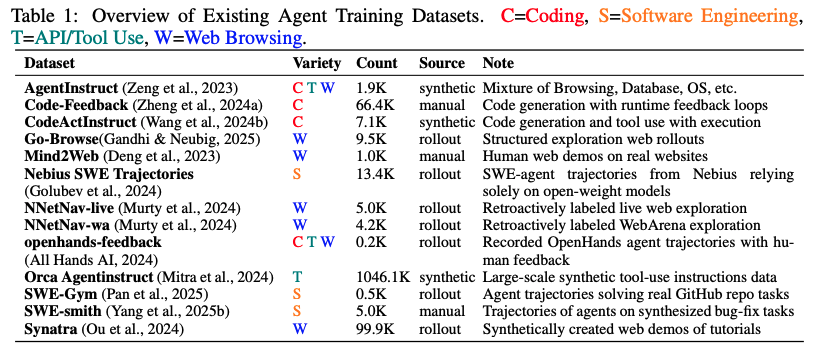

AI Agent 훈련 데이터베이스 : 1.27M 궤적(약 36B tokens)을 포함하는 대규모 Agent 훈련 데이터베이스가 공개되었습니다. 이는 Agent 대규모 SFT 데이터 부족 및 형식 파편화 문제를 해결하는 것을 목표로 합니다. 이 데이터셋은 연구원들에게 풍부한 자원을 제공하여 AI Agent의 개발 및 평가를 촉진하고 복잡한 작업에서의 적용을 추진합니다. (출처: lateinteraction, QuixiAI)

LLM 내부 압축 메커니즘 연구 : 연구에 따르면 LLM은 ‘모호한 의미 압축기’가 아니라 ‘완벽한 구조 재배열기’이며, 프롬프트를 무손실로 압축하고 내부적으로 재표현할 수 있어 모델이 정보를 ‘잊는’ 것이 아니라 ‘재구성’한다는 것을 보여줍니다. 이 발견은 LLM 작동 원리에 대한 이해를 심화시키고, 언어 모델 역전과 같은 연구 분야에 중요한 의미를 가집니다. (출처: jxmnop, jeremyphoward)

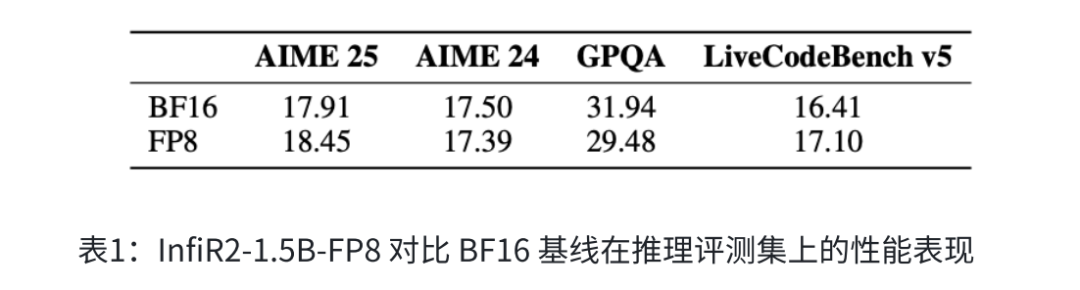

InfiX.ai의 탈중앙화 대규모 모델 훈련 패러다임 : 전 Alibaba, ByteDance 대규모 모델 책임자 Yang Hongxia가 창업한 InfiX.ai는 ‘탈중앙화’ 대규모 모델 사전 훈련에 전념하고 있습니다. 저비트 훈련 프레임워크 InfiR2 FP8, 모델 융합 기술 InfiFusion, 의료 멀티모달 대규모 모델 InfiMed 및 다중 Agent 시스템 InfiAgent를 통해 모델 훈련 자원 소모를 줄여 중소기업도 사전 훈련에 참여하고 도메인 모델의 글로벌 융합을 실현하는 것을 목표로 합니다. (출처: 36氪)

최신 AI 연구 논문 요약 : HuggingFace Daily Papers는 RL 최적화(GRPO-Guard), 멀티모달 설득(MMPersuade), 시각 추론(Latent Chain-of-Thought), RL 모델 능력 유지(RECAP), LLM 문화 처리의 화용론적 간극, 배치 추측 디코딩 개선, 동적 시간 지식 그래프(ATOM), 동적 시각 효과 생성(VFXMaster), 효율적인 이미지 편집(RegionE), LLM 추론(Parallel Loop Transformer), 장기 심리 상담 Agent(TheraMind), 반사적 자동 형식화(ReForm), 비디오 사고(Video-Thinker), 운전 세계 모델(Dream4Drive), 다중 Agent 시스템 프로세스 보상 모델(MASPRM), Agent 정보 흐름을 통한 멀티모달 추론 잠금 해제(SeeingEye) 등 일련의 최첨단 연구를 발표했습니다. (출처: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

💼 비즈니스

OpenAI IPO 준비 및 1조 달러 가치 평가 : OpenAI는 자본 구조 재편을 완료했으며, CEO Altman은 IPO가 미래 경로임을 시사했습니다. 시장은 2027년 상장을 예상하며, 가치는 1조 달러에 달하여 사상 최대 IPO 중 하나가 될 수 있습니다. 재편은 자금 조달 제약을 해제하고 AI 인프라 구축을 위한 막대한 자본을 유치하는 것을 목표로 합니다. Microsoft는 최대 투자자로서 27% 지분을 보유하지만 이사회 의석은 없으며, 통제권은 여전히 비영리 재단이 가지고 있습니다. (출처: 36氪, 36氪, 36氪, 36氪, Reddit r/artificial)

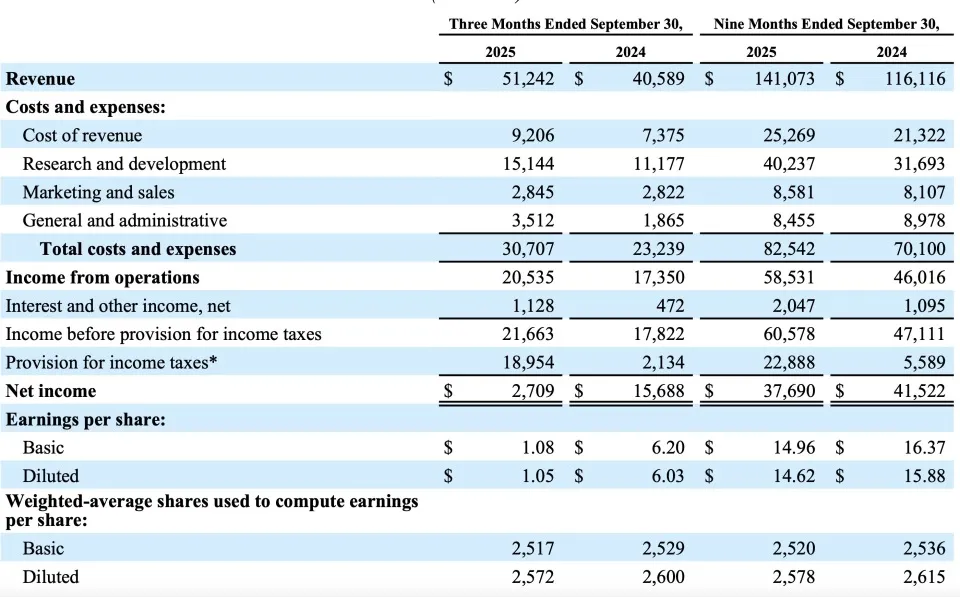

Meta 3분기 실적 및 AI 투자 : Meta의 3분기 매출은 512억 4,200만 달러, 순이익은 27억 900만 달러로 전년 대비 83% 급감했습니다(일회성 세금 지출 영향). 회사는 운영 비용 증가 및 규제 위험 심화를 경고하며, 컴퓨팅 수요 충족 및 새로운 수익원 확장을 위해 2026년에 AI 인프라 투자를 대폭 늘릴 계획입니다. Meta AI 부서는 인력 조정이 있었으며, 전 메타버스 책임자 Vishal Shah가 AI 제품 부사장으로 전환되어 AI 제품 출시를 가속화할 예정입니다. (출처: 36氪, Dorialexander, 36氪)

AI 기업 3분기 실적 투시: 컴퓨팅 파워 계층, 막대한 이익 거두고 대규모 모델 상업화 탐색 : AI 기업의 3분기 실적 보고서에 따르면, Foxconn Industrial Internet, Cambricon 등 컴퓨팅 인프라 기업이 최대 수혜자가 되어 순이익이 크게 증가했습니다. iFLYTEK, Kunlun Tech 등 대규모 모델 및 애플리케이션 계층 기업도 실적 전환점을 맞이하여 소비자 대상 애플리케이션 및 AI 관련 사업 매출이 크게 증가했습니다. Coatue 보고서는 AI가 거품이 아니라 장기적인 생산성 혁명이라고 지적하지만, 대규모 모델의 상업화 경로는 여전히 탐색 중이며 지속 가능성에 주목해야 한다고 강조합니다. (출처: 36氪, 36氪)

🌟 커뮤니티

AI와 인간 정신의 위험한 연결고리 : 소셜 미디어에서는 AI와 인간 정신의 위험한 관계에 대한 뜨거운 논쟁이 벌어지고 있습니다. AI의 ‘위로’ 아래 어머니를 살해한 비극, AI가 망상증 환자의 심리적 조종 주장을 강화한 사건, AI와 청소년 자살 사건 등 여러 사례가 드러났습니다. 논의는 AI의 ‘아첨’하는 반응이 사용자 편집증을 증폭시키고 이성적 경계를 흐리게 할 수 있음을 지적하며, AI 개발자와 규제 기관이 심리적 안전에 주의하고 AI가 심리적으로 취약한 개인에게 미칠 수 있는 부정적인 역할에 경계할 것을 촉구합니다. (출처: 36氪, DeepLearning.AI Blog)

AI 모델 성능 변동 및 인프라 문제 : GPT-5 Pro 및 Anthropic 모델이 최근 속도 저하 문제를 겪으면서 AI 모델 성능 안정성 및 Azure와 같은 인프라의 신뢰성에 대한 사용자들의 우려가 커지고 있습니다. 개발자들은 모델이 ‘멍청해졌다’고 불평하며 작업 효율성에 영향을 미친다고 말합니다. 이러한 논의는 AI 대규모 적용에서 하위 컴퓨팅 파워, 네트워크 및 모델 안정성이 사용자 경험에 미치는 핵심적인 영향을 반영합니다. (출처: gfodor, Tim_Dettmers, gfodor)

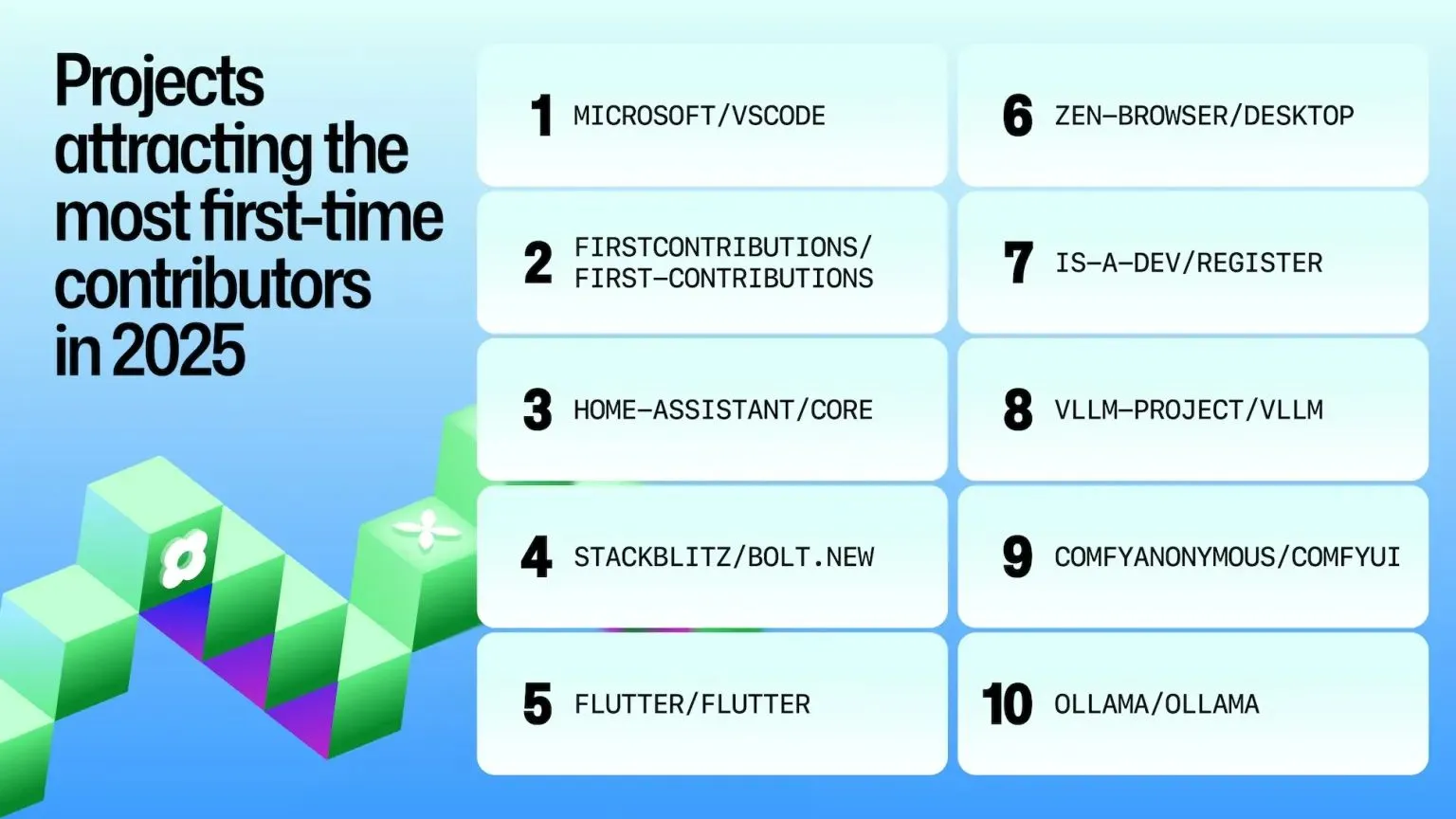

AI 칩 경쟁과 미중 관계 : 소셜 미디어에서는 미국이 중국에 Blackwell AI 칩을 판매해야 하는지, 그리고 칩 금수 조치가 중국 칩 및 오픈소스 발전에 미치는 영향에 대한 뜨거운 논쟁이 벌어지고 있습니다. 논의는 국가 안보, 기술 리더십 및 공급망에 초점을 맞추고 있으며, 중국에 첨단 칩을 판매하는 것이 AI 분야에서 미국의 우위를 약화시킬 수 있다고 보며 미중 기술 경쟁의 방향에 대한 깊은 우려를 불러일으킵니다. (출처: zacharynado, ClementDelangue, zacharynado)

프로그래밍에서의 AI 적용 및 사용자 경험 : 개발자들은 Claude Code 사용의 문제점(예: 강제 코드 생성), GitHub Copilot과 같은 AI 코딩 도구의 맞춤형 Agent, Cursor 2.0의 다중 Agent 모드 및 속도 향상에 대해 논의합니다. 동시에 ‘분위기 코딩’의 한계, AI가 엔지니어 작업 흐름을 변화시키는 방식, 그리고 AI 코드 보안에 대한 우려도 광범위한 관심을 불러일으킵니다. (출처: bigeagle_xd, dotey, pierceboggan, Reddit r/ClaudeAI, Reddit r/ArtificialInteligence)

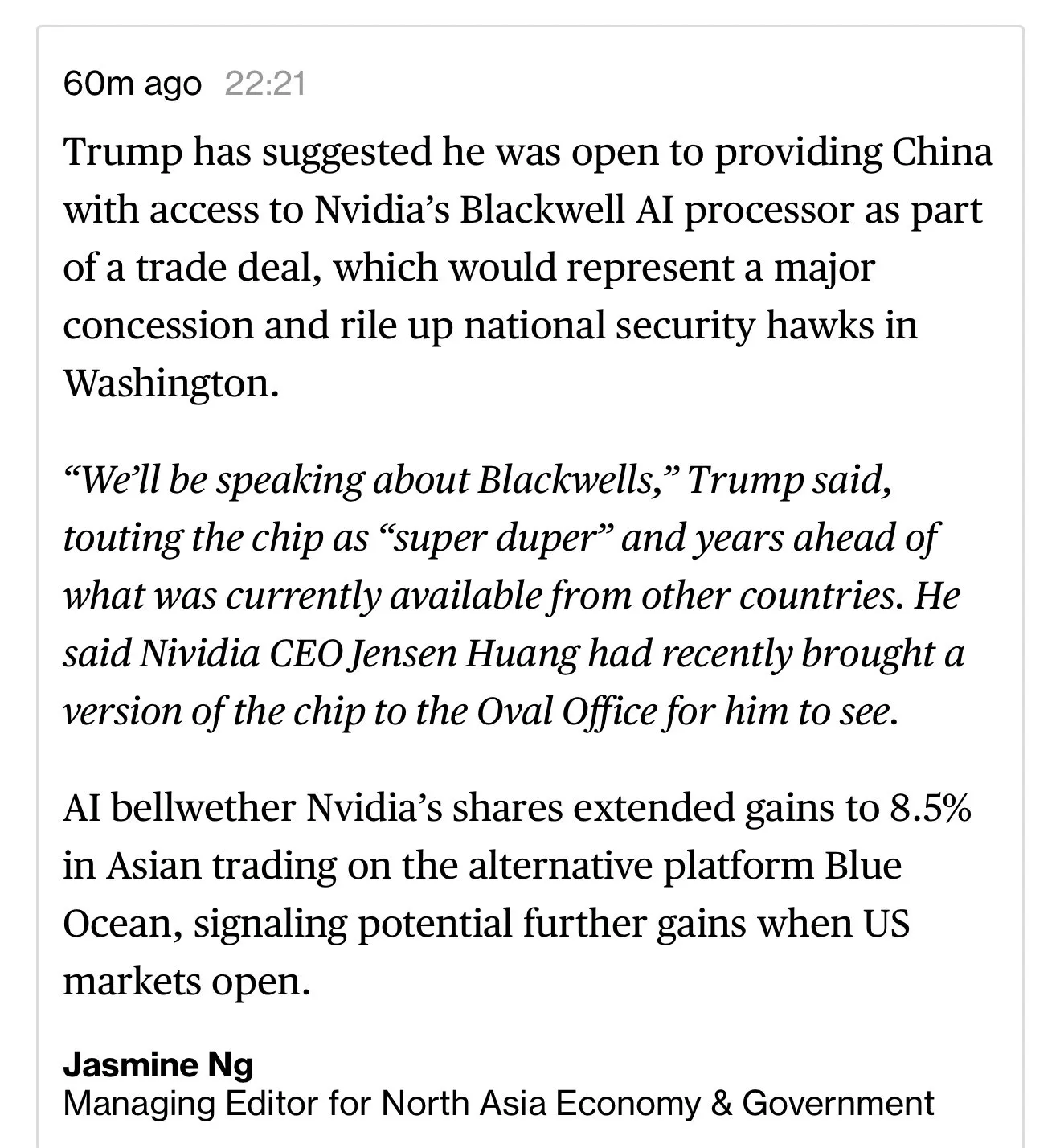

AGI 정의 및 발전 경로 : 소셜 미디어에서는 AGI의 정의, 측정 기준 및 실현 경로에 대한 격렬한 논의가 진행되고 있습니다. Dan Hendrycks는 인지 과학 기반의 AGI 프레임워크를 제안하고 GPT-4/5의 진행 상황을 정량화했습니다. 동시에 AGI가 3년 안에 올 것인지, 아니면 아직 멀었는지에 대한 격론이 벌어지고 있으며, 이는 AI 분야에서 일반 지능의 본질과 실현 시기에 대한 깊은 의견 차이를 반영합니다. (출처: DanHendrycks, dwarkesh_sp, omarsar0)

AI 시대의 확산 전략 : 소셜 논의에서는 AI 확산이 ‘콘텐츠 출력’에서 ‘구조 설계’로 전환되고 있으며, ‘B2B 레버리지’와 ‘역세’ 전략을 통해 KOC, 크리에이터 및 미디어 노드를 활용하여 직접적인 푸시가 아닌 논의를 촉발한다고 지적합니다. 이러한 전략은 먼저 ‘작은 커뮤니티의 관심을 끌 수 있는’ 사람들에게 영향을 미치고, 신뢰와 노드 확산을 통해 정보가 눈덩이처럼 퍼지도록 하는 것을 목표로 합니다. (출처: 36氪)

AI 전문가와 언론 보도 : Reddit 사용자들은 언론이 인터뷰하는 AI 전문가들이 기술적 깊이가 부족하다고 지적하며, AI는 ‘의식 있는 종’이라기보다는 통계적 알고리즘에 가깝다고 주장하며 더 전문적인 AI 보도를 요구했습니다. 논의는 많은 AI 실무자들이 고급 수학 학위를 가지고 있으며, AI의 본질은 처리 속도와 정확성 사이의 균형을 맞추는 통계적 알고리즘이라는 점을 지적하며, 언론의 과장된 홍보가 AI에 대한 대중의 오해와 두려움을 초래할 수 있다고 말합니다. (출처: Reddit r/ArtificialInteligence)

💡 기타

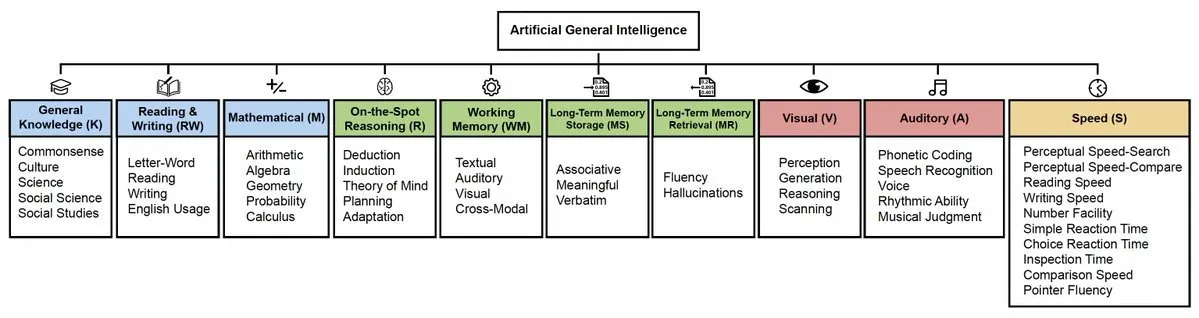

VS Code의 오픈소스 커뮤니티 기여 : VS Code는 GitHub의 Octoverse 2025 보고서에서 최고의 오픈소스 프로젝트로 선정되었으며, 첫 기여자 수에서 1위를 차지하여 개발자 커뮤니티에서의 광범위한 채택과 영향력을 보여주었습니다. 이는 개발 도구로서의 강력한 생태계와 커뮤니티 매력을 반영합니다. (출처: code, pierceboggan)

Hugging Face ML & Society 팀의 영향 : Hugging Face의 ML & Society 팀은 지난 몇 년간 상당한 작업과 영향력을 보여주었으며, AI 윤리, 사회적 영향, 책임 있는 AI 개발 등 분야에 관여했을 수 있습니다. 이 팀은 AI 기술과 사회 간의 교차점을 탐구하고 AI의 긍정적인 발전을 추진하는 데 전념하고 있습니다. (출처: ClementDelangue)