키워드:GPT-5 Pro, AI 약물 개발, AI 에이전트, LLM, 딥러닝, AI 보안, 멀티모달 AI, AI 하드웨어 가속, NICD-with-erasures 반례, LoRA 미세 조정 VRAM 최적화, AI 비디오 생성 Sora 2, OpenWebUI 모델 권한 관리, AI 저장 비용 65% 절감

🔥 주요 소식

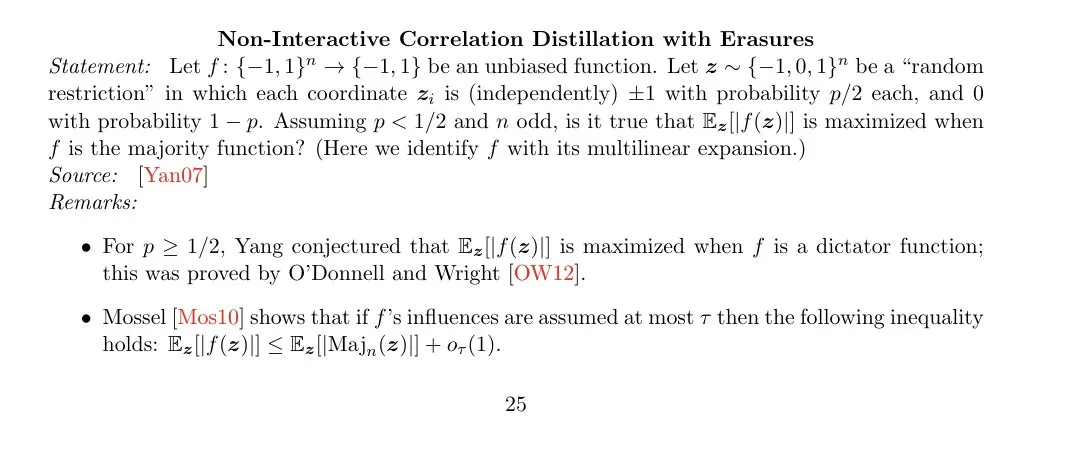

GPT-5 Pro 수학적 돌파: GPT-5 Pro가 수학 분야에서 중요한 진전을 이루며 NICD-with-erasures 다수 최적성 문제(Simons 목록, 25페이지)에 대한 반례를 성공적으로 찾아냈습니다. 이 발견은 GPT-5 Pro가 복잡한 수학적 추론에서 새로운 수준에 도달하여 기존 수학 이론에 도전할 수 있음을 보여주며, AI의 독창적인 수학 연구 잠재력을 예고하고 AI 보조 증명에 대한 수학계의 수용도를 높일 수 있습니다. (출처: SebastienBubeck, BlackHC, hyhieu226, JimDMiller)

AI로 신규 항생제 개발 가속화: 염증성 장 질환(IBD)을 표적으로 하는 새로운 항생제의 작용 메커니즘이 인체 시험 전에 AI에 의해 성공적으로 예측되었고 과학자들에 의해 확인되었습니다. 이 획기적인 발전은 AI가 약물 발견 및 의료 분야를 가속화할 엄청난 잠재력을 보여주며, 신약 개발 주기를 단축하고 환자에게 더 빠른 치료법을 제공할 수 있을 것으로 기대됩니다. 인체 시험은 3년 내에 시작될 예정입니다. (출처: Reddit r/ArtificialInteligence)

🎯 동향

AI+XR 실시간 비디오 변환: Decart XR은 WebRTC를 활용하여 MetaQuest 카메라의 실시간 화면을 AI 모델로 전송, 비디오의 실시간 변환을 구현합니다. 이 기술은 증강 현실 분야에서 AI의 혁신적인 응용을 보여주며, 사용자에게 몰입감 있고 동적인 상호작용의 새로운 시각적 경험을 제공할 잠재력이 크며, 특히 게임, 가상 협업 및 창의적 콘텐츠 생성 분야에서 큰 가능성을 가지고 있습니다. (출처: gfodor)

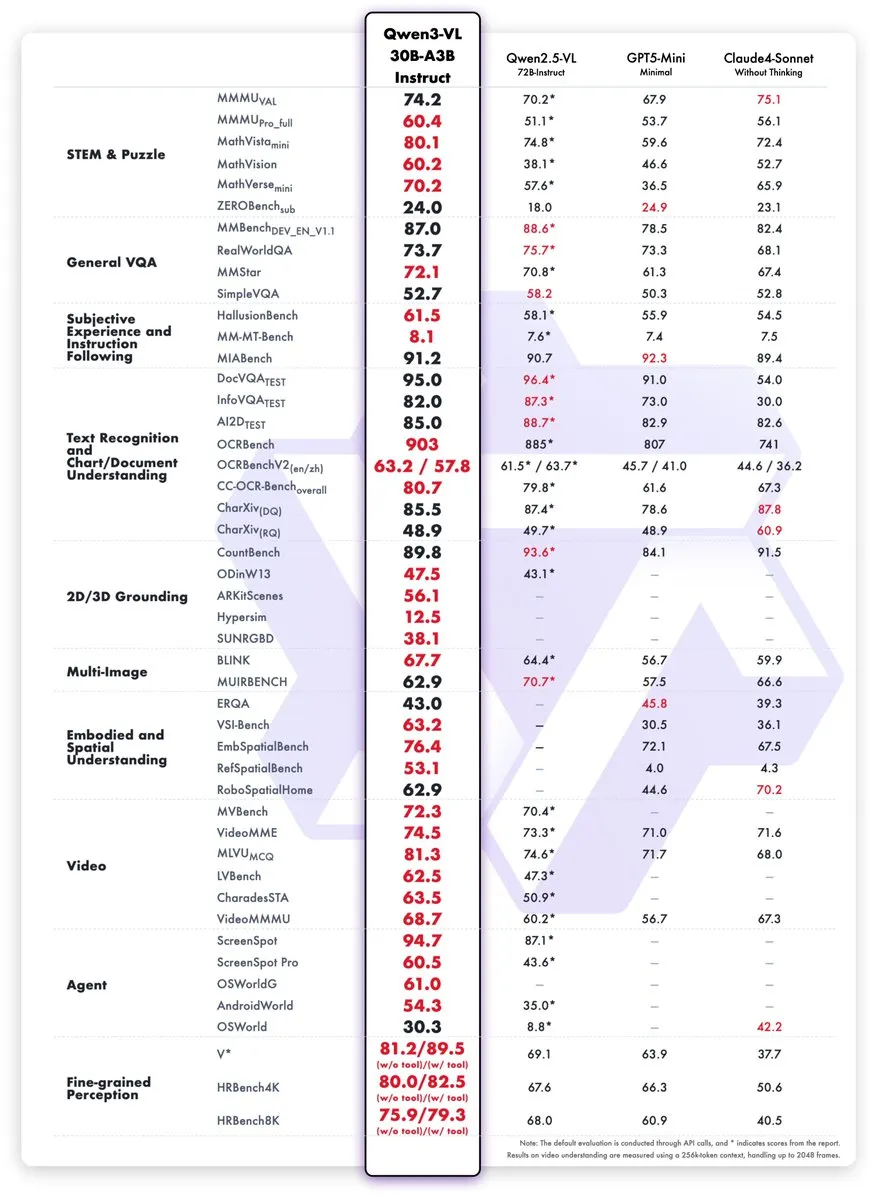

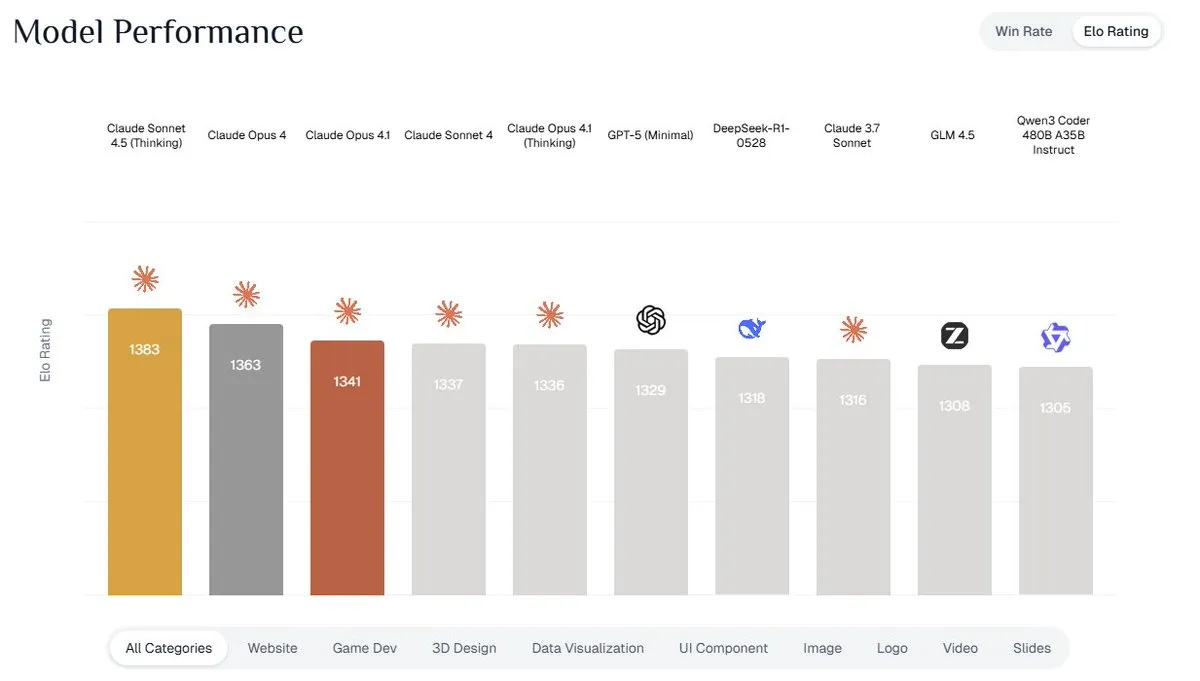

다양한 신규 LLM 출시: DeepSeek-V3.2-Exp는 희소 어텐션 메커니즘을 통해 긴 컨텍스트 추론 및 코딩 효율성을 향상시켰습니다. GLM 4.6은 실제 코딩, 추론 및 작문 능력을 크게 업그레이드했습니다. Qwen3 VL 30B A3B 모델은 시각적 추론 및 인식 분야에서 뛰어난 성능을 보였습니다. 이러한 신규 모델의 출시는 LLM이 멀티모달, 긴 컨텍스트 처리 및 코딩 효율성 측면에서 지속적으로 발전하고 있음을 예고합니다. (출처: yupp_ai, huggingface, Reddit r/LocalLLaMA)

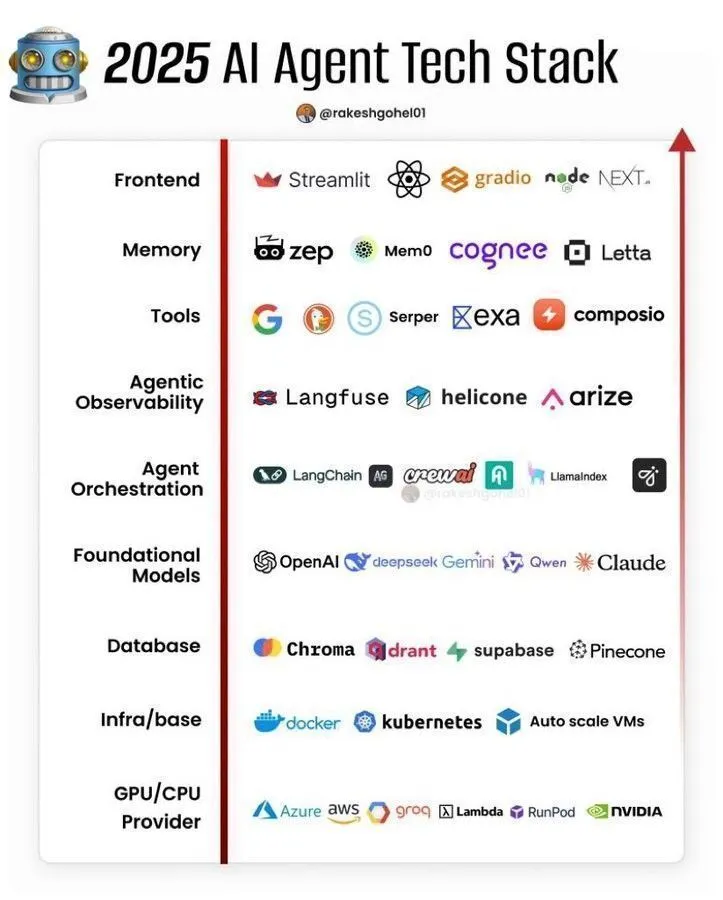

AI Agents 기술 스택 및 아키텍처: 2025년 AI Agent 기술 스택 및 실제 아키텍처는 기본 구성 요소부터 고급 배포 패턴까지 빠르게 발전하고 있습니다. 관련 논의는 복잡한 작업을 처리하기 위한 효율적이고 확장 가능한 AI Agent 시스템을 설계하는 방법에 초점을 맞추고 있으며, 이는 실제 응용 분야에서 AI Agent의 성숙도가 지속적으로 향상되고 있음을 나타냅니다. (출처: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

교육 분야 AI 보급: 프로그래밍 배경이 없는 한 기업가가 AI 기술을 활용하여 요르단 교육부를 위한 AI 튜터를 개발, 1천만 달러의 비용을 성공적으로 절감했습니다. 이는 AI가 교육 비용을 절감하고 교육 접근성을 높이는 데 엄청난 잠재력을 가지고 있음을 강조하며, 비전문가도 AI를 활용하여 실제 문제를 해결할 수 있음을 보여줍니다. (출처: amasad)

AI 스토리지 비용 최적화 방안: CoreWeave는 AI 데이터 스토리지 전략을 최적화하여 혁신 속도에 영향을 주지 않으면서 AI 스토리지 비용을 최대 65%까지 절감할 수 있다고 제안했습니다. 메모리 스냅샷, 세분화된 요금 청구 및 멀티 클라우드 스케줄링과 같은 기술을 통해 Modal과 같은 플랫폼은 Azure와 같은 기존 클라우드 서비스에 비해 급증하는 추론 워크로드를 처리할 때 GPU 비용을 크게 절감할 수 있습니다. (출처: TheTuringPost, TheTuringPost, Reddit r/deeplearning)

AI+VR로 정신 건강 지원: 가상 현실(VR)과 인공지능(AI)의 결합은 정신 건강 치료를 개선할 잠재력을 가지고 있습니다. 몰입형 경험과 개인화된 개입을 통해 AI+VR 기술은 다음 세대에게 더 공감적이고 연결된 성장 환경을 제공하여 정신 건강 분야에 혁신적인 솔루션을 가져올 수 있습니다. (출처: Ronald_vanLoon, Ronald_vanLoon)

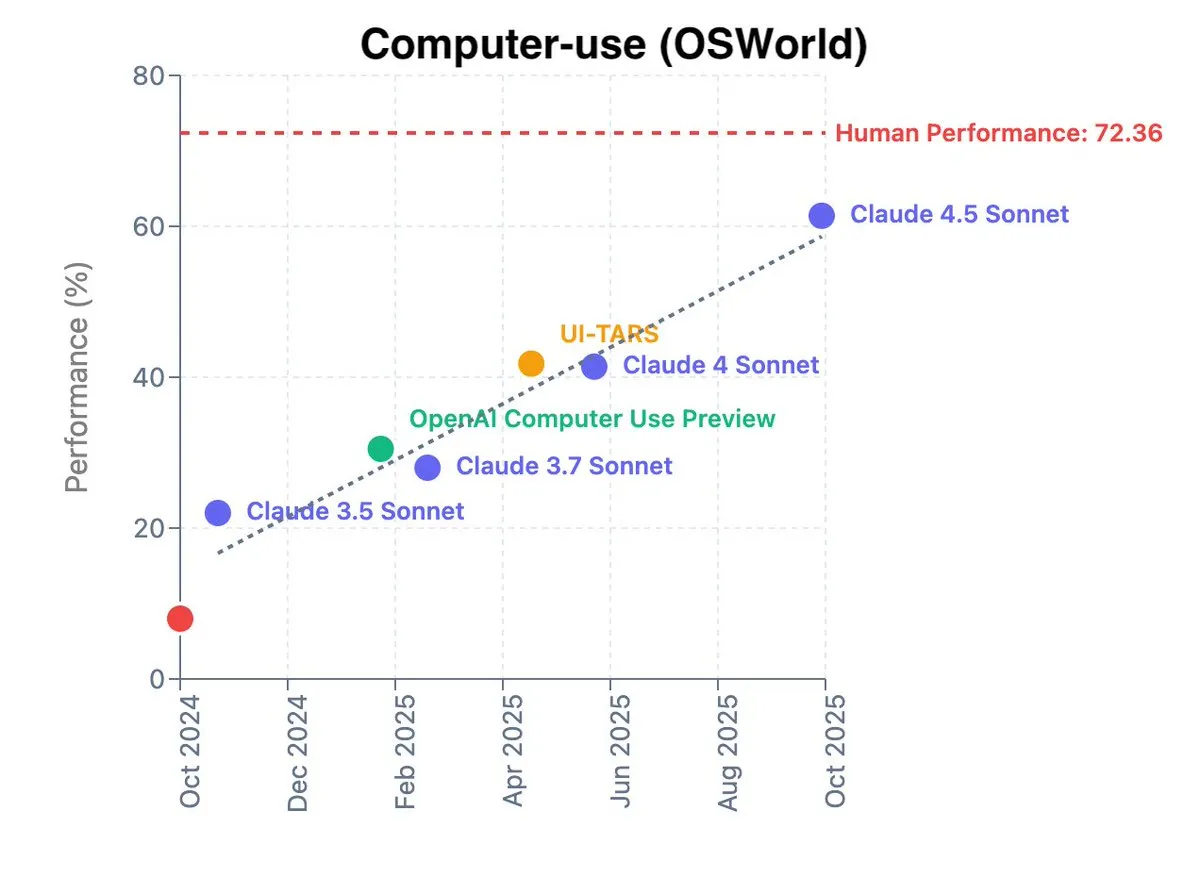

AI로 과학 발견 가속화: Anthropic 팀은 AI를 통해 컴퓨터 사용 효율성을 높여 과학 발견 과정을 가속화하는 데 전념하고 있습니다. 현재 OSWorld에서 엔드투엔드 기반 모델의 성능은 1년 전 8%에서 61%로 향상되어 인간의 72% 수준에 근접했으며, 이는 AI가 과학 연구 분야에서 점점 더 중요한 역할을 할 것임을 예고합니다. (출처: oh_that_hat, dilipkay)

OpenAI와 Jony Ive의 협력 기기: OpenAI와 Jony Ive는 화면 없는 휴대용 AI 비서 개발을 위해 협력하고 있으며, 2026년 출시를 목표로 하고 있지만 현재 핵심 소프트웨어, 개인 정보 보호 및 컴퓨팅 능력과 같은 기술적 문제에 직면하여 지연될 수 있습니다. 이 기기는 마이크, 카메라 및 스피커를 통해 환경을 인식하고 항상 온라인 상태를 유지할 것입니다. (출처: swyx, Reddit r/artificial)

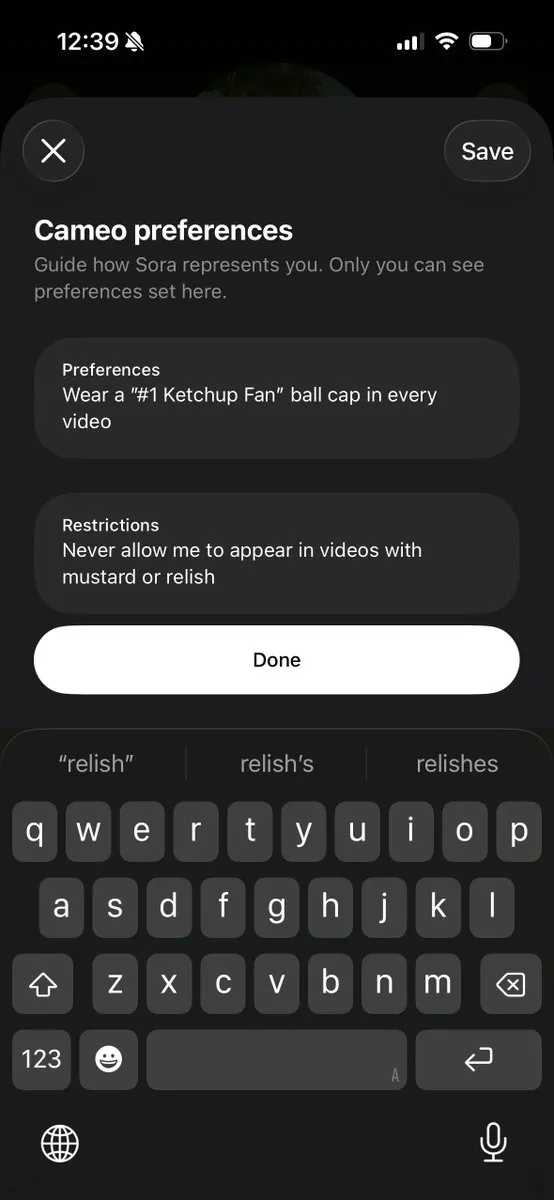

Sora 업데이트 및 보안 개선: OpenAI의 Sora 비디오 생성 모델이 업데이트되어 사용자 정의 “게스트 제한” 기능을 도입했습니다. 이를 통해 크리에이터는 자신의 이미지 사용 방식(예: 정치적 논평 또는 특정 단어 사용 금지)을 제어할 수 있습니다. 또한, 업데이트에는 더 명확하게 보이는 워터마크와 모델 보안 향상이 포함되어 오탐을 줄이고 취약점을 보완합니다. (출처: billpeeb, billpeeb, sama)

군사 분야 AI 적용의 도전: 미 공군은 중국의 AI 드론 발전에 대응하기 위해 AI 기술을 테스트하고 있습니다. 미군 퇴역 중장은 중국과 전쟁 시 미군이 전세를 유지하려면 10:1 또는 심지어 20:1의 살상률을 달성해야 하지만, 현재의 전쟁 시뮬레이션 결과는 낙관적이지 않다고 지적하며, 군사 전략에서 AI의 핵심 역할과 경쟁의 시급성을 강조했습니다. (출처: Reddit r/ArtificialInteligence)

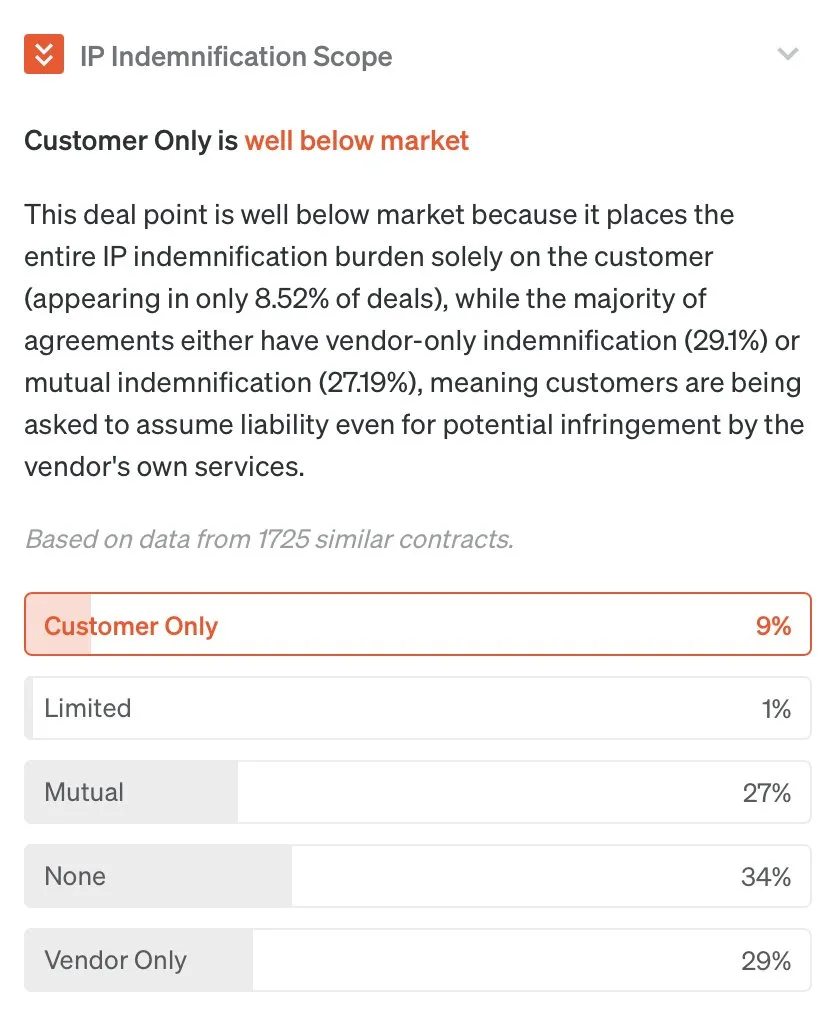

AI, 법률 계약 협상 혁신: 데이터 기반 계약 협상 시대가 도래했습니다. AI는 시장 데이터를 모든 사람에게 투명하게 공개하여 전통적인 “대형 로펌”의 정보 독점을 깨뜨릴 것입니다. 이 기술은 계약 협상의 효율성과 공정성을 높이고 더 많은 기업과 개인에게 힘을 실어줄 것으로 기대됩니다. (출처: scottastevenson)

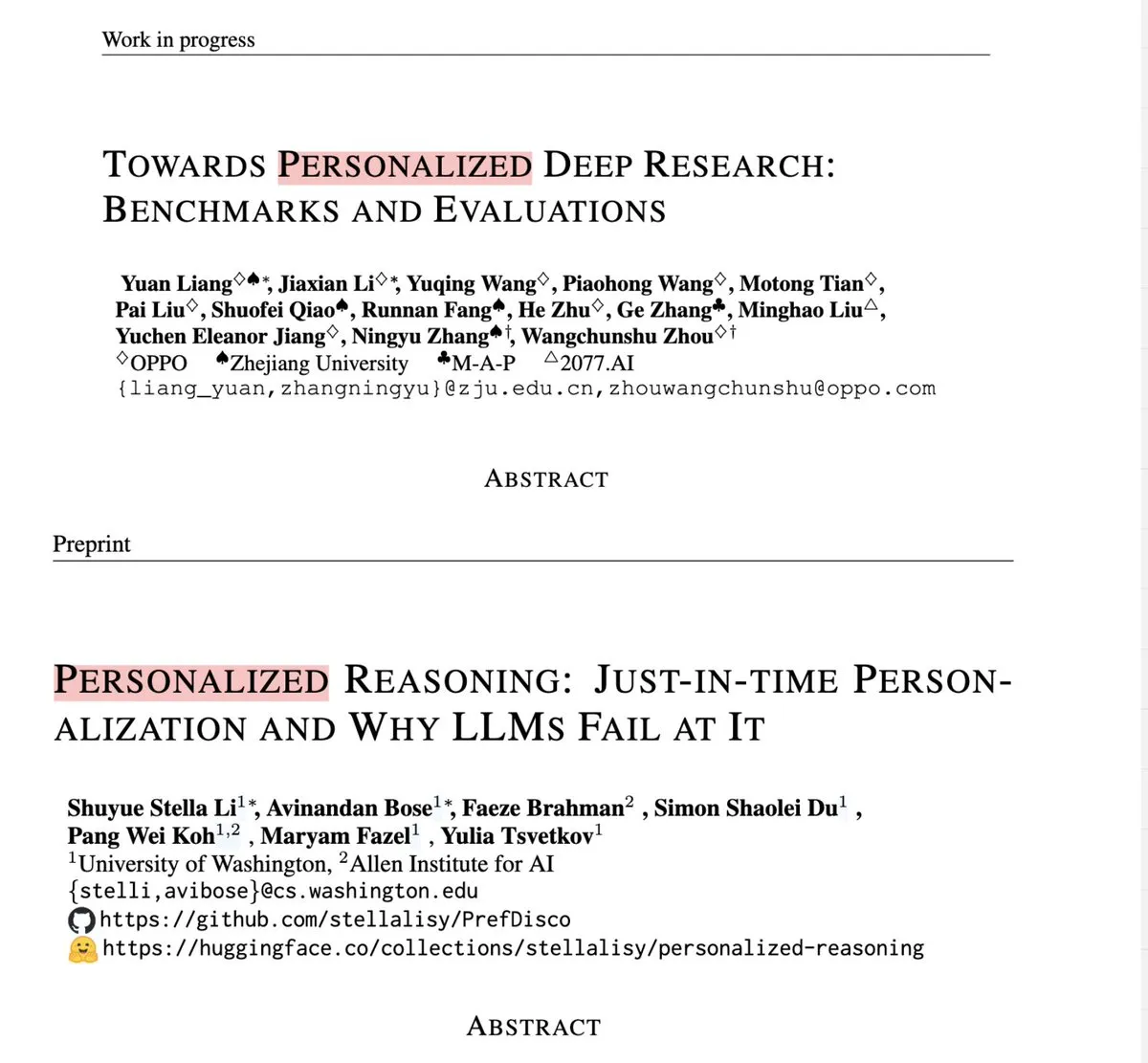

LLM 개인화 능력 향상: LLM의 발전은 단순한 벤치마크를 넘어섰으며, 모델이 사용자를 이해하고 개인화된 서비스를 제공하는 것이 핵심이 되었습니다. PREFDISCO 및 PDR Bench와 같은 연구는 즉각적인 추론과 장기적인 심층 연구에서 개인화에 초점을 맞춰, 모델이 단순히 어조를 조정하는 것을 넘어 사용자의 목표, 선호도 및 제약 조건에 따라 생각하고 행동하도록 하는 것을 목표로 합니다. (출처: dotey)

오픈 모델 생태계 현황: 중국 AI 생태계의 부상, DeepSeek의 영향, Llama 모델의 쇠퇴, 그리고 미국 시장 및 로컬 모델의 미래 방향을 포함한 오픈 모델 현황에 대한 논의가 있었습니다. 이는 AI 모델의 오픈 소스 및 클로즈드 소스 경쟁의 역동적인 구도를 반영합니다. (출처: charles_irl)

ByteDance 장편 비디오 생성 기술: ByteDance는 “Self-Forcing++” 방법을 출시하여 장편 비디오 훈련 데이터나 재훈련 없이 확산 모델을 확장하여 최대 4분 15초 길이의 고품질 비디오를 생성할 수 있으며, 비디오의 충실도와 일관성을 유지합니다. (출처: NerdyRodent)

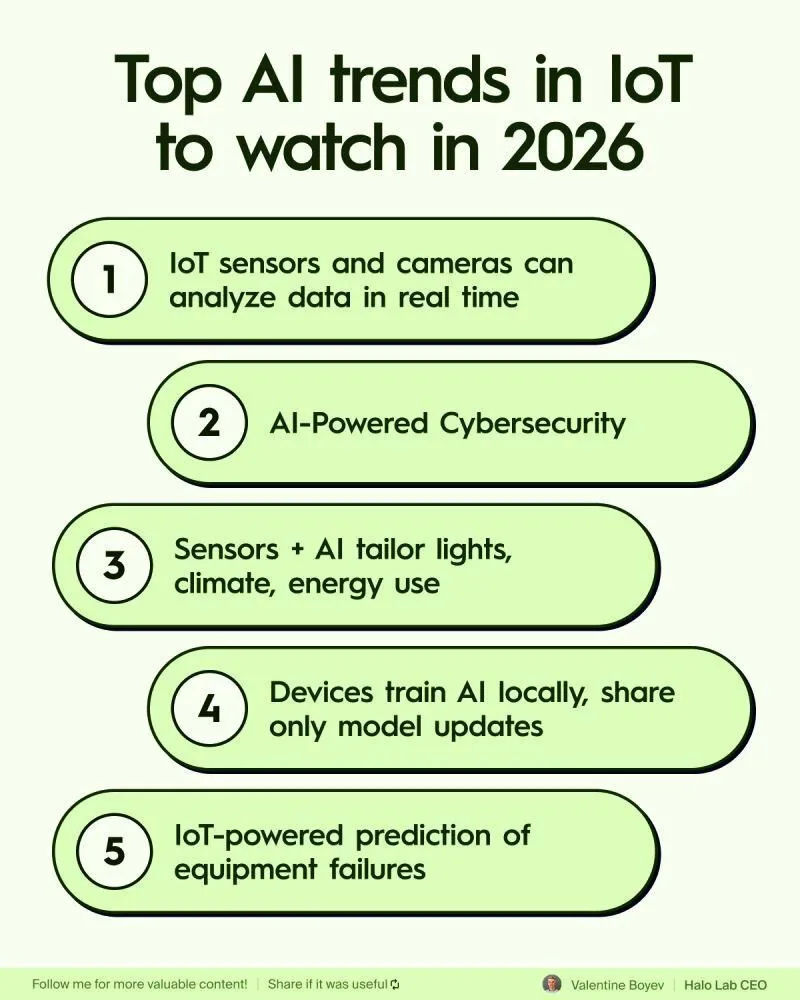

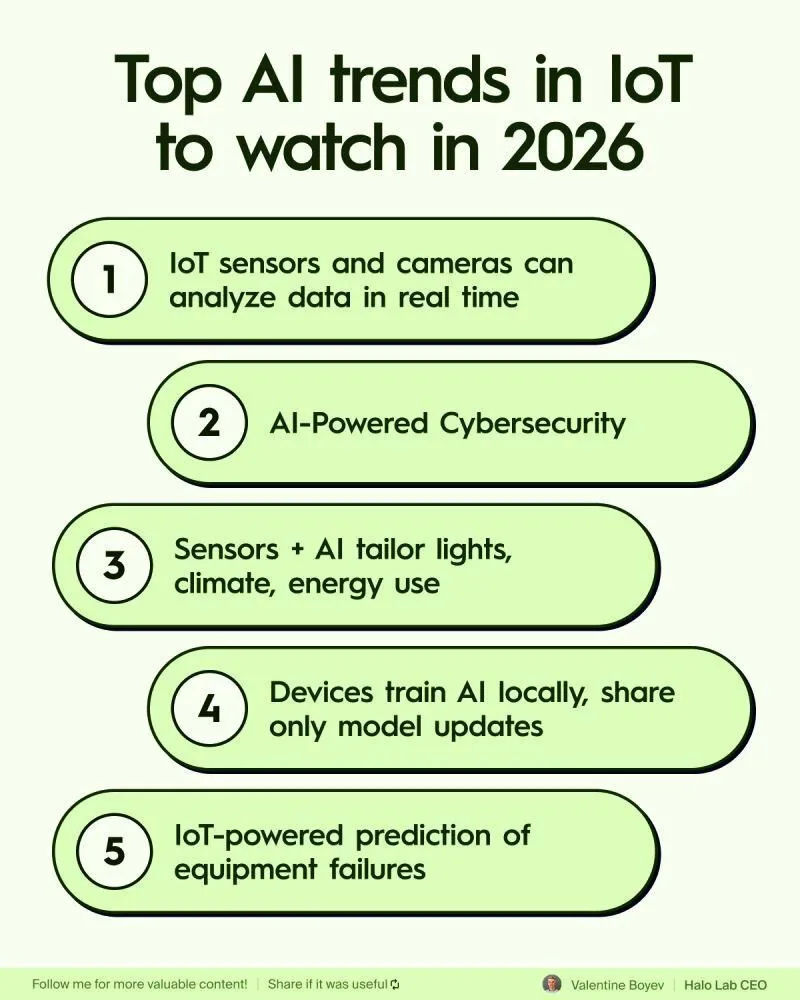

IoT 분야 AI 트렌드: 2026년 IoT(사물 인터넷) 분야에서 AI의 10가지 주요 트렌드가 주목받고 있으며, 이는 AI와 IoT의 심층적인 융합이 더욱 스마트하고 효율적인 장치와 응용 프로그램을 가져올 것임을 예고합니다. (출처: Ronald_vanLoon)

AI 기반 직장 문화: AI는 직장 문화 변화를 주도하는 중요한 힘이 되고 있으며, 그 적용은 효율성을 높일 뿐만 아니라 팀 협업, 의사 결정 및 직원 개발과 같은 문화적 측면을 재편하고 있습니다. (출처: Ronald_vanLoon)

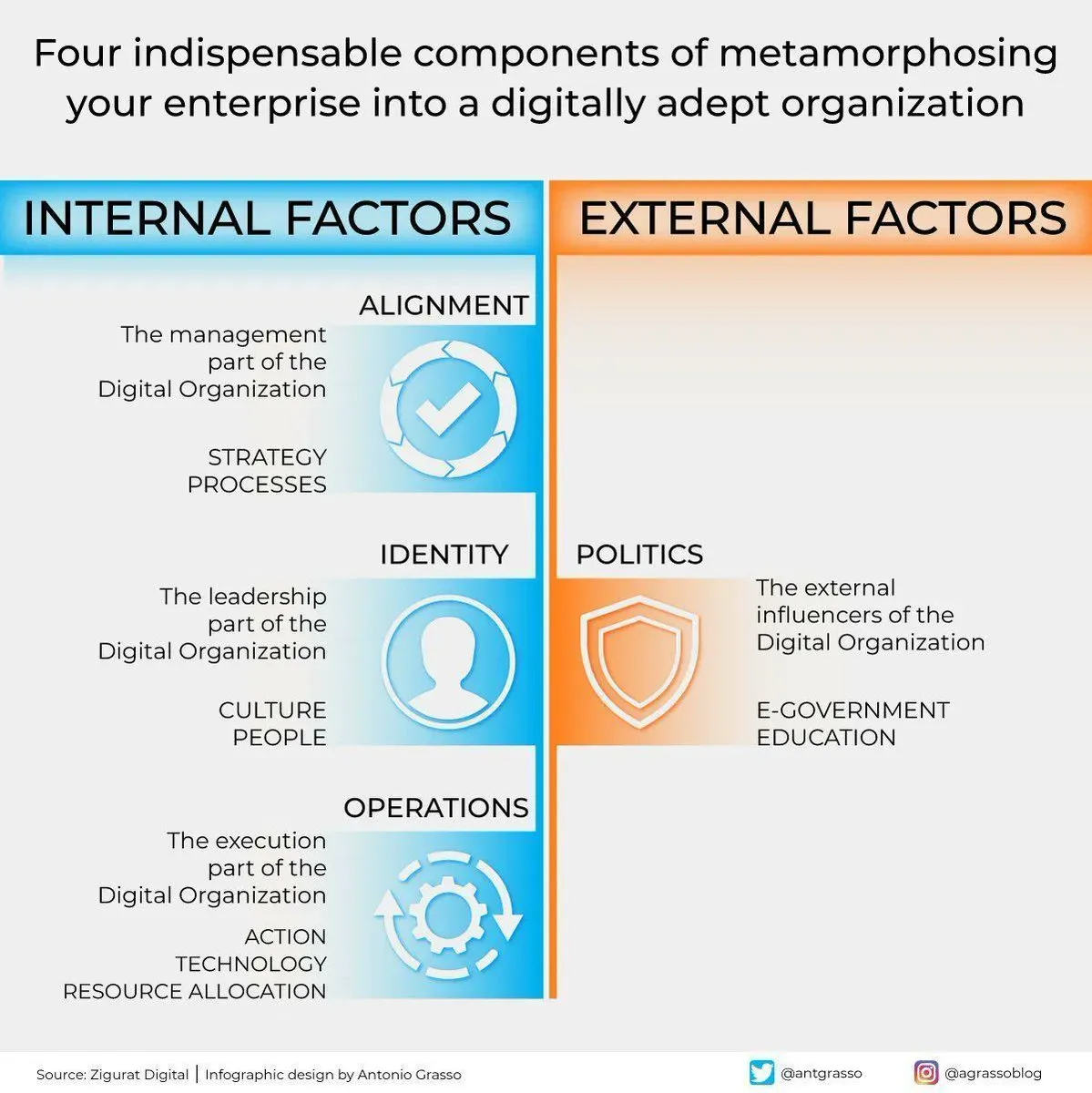

디지털 전환의 네 가지 요소: 기업이 디지털 조직으로 전환하는 데 필수적인 네 가지 구성 요소를 탐구하며, 혁신, 기술 및 AI의 핵심 역할을 강조합니다. (출처: Ronald_vanLoon)

AI 기반 의수 기술: 17세 소년이 AI 기술을 활용하여 생각으로 제어되는 의수 팔을 개발했습니다. 이는 AI가 보조 기술 및 인간 삶의 질 향상에 기여할 엄청난 잠재력을 보여줍니다. (출처: Ronald_vanLoon)

로봇 기술 발전: 바퀴 달린 점프 로봇 Cecilia와 경량 생체 모방 촉각 손은 로봇 하드웨어의 모듈성과 고급 기능을 보여줍니다. 또한, Yondu AI는 바퀴 달린 휴머노이드 로봇 창고 피킹 솔루션과 팔레트 사이를 이동할 수 있는 창고 로봇을 출시하여 물류 효율성을 크게 향상시켰습니다. (출처: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

휴머노이드 로봇, 인간 능력 초월: 안전 위험을 고려할 필요 없이 로봇이 인간이 할 수 없거나 하기 어려운 고난도 작업(예: 높은 곳에 올라가 물건 가져오기)을 수행할 수 있는 등, 휴머노이드 로봇이 미래에 인간 능력을 초월할 가능성에 대한 논의가 있었습니다. 이는 자동화 응용 시나리오를 크게 확장할 것입니다. (출처: EERandomness)

AI 물리학자와 양자 역학 기반 모델: 양자 역학의 기본 모델이 LLM의 다음 개척지가 될 것이며, AI 물리학자가 새로운 물질을 발명할 수 있을 것이라는 견해가 있습니다. 이는 AI가 기초 과학 연구, 특히 생물학, 화학 및 재료 과학의 양자 규모 융합 분야에서 혁신적인 돌파구를 가져올 것임을 예고합니다. (출처: NandoDF)

Sora 2, ARC-AGI 작업 해결: Sora 2는 ARC-AGI(추상 추론 컨텍스트-일반 인공지능) 작업을 해결하려고 시도할 때 올바른 변환 논리를 인식했지만, 실행에는 여전히 결함이 있었습니다. 이는 비디오 생성 모델이 추상 추론을 이해하고 적용하는 데 진전을 보였지만, 완벽한 일반 인공지능 실현까지는 아직 거리가 있음을 나타냅니다. (출처: NandoDF)

AI 생성 게임 콘텐츠: 평생 동안 무한하고 이전에 존재하지 않았던 N64 게임을 플레이할 수 있을 것으로 예상됩니다. 이는 생성 AI가 게임 콘텐츠 제작 분야에서 혁명을 가져와 대규모의 개인화된 게임 경험을 가능하게 할 것임을 예고합니다. (출처: scottastevenson)

OpenAI DevDay 개최 예정: OpenAI는 DevDay 2025가 곧 개최될 것이라고 발표했으며, Sam Altman이 기조연설을 하고 개발자가 AI를 구축하는 데 도움이 될 새로운 도구와 기능을 출시할 것이라고 예고했습니다. 이는 OpenAI가 개발자 생태계를 강화하고 AI 응용 혁신을 추진하는 데 전념하고 있음을 보여줍니다. (출처: openai, sama)

AI Agent Builder: OpenAI는 DevDay에서 Agent Builder를 출시할 계획이며, 이를 통해 사용자는 자신만의 Agent 워크플로우를 구축하고 MCPs, ChatKit 위젯 및 기타 도구를 연결할 수 있습니다. 이는 AI Agent의 개발 및 배포를 크게 단순화하고 Agentic AI의 보급을 촉진할 것입니다. (출처: dariusemrani)

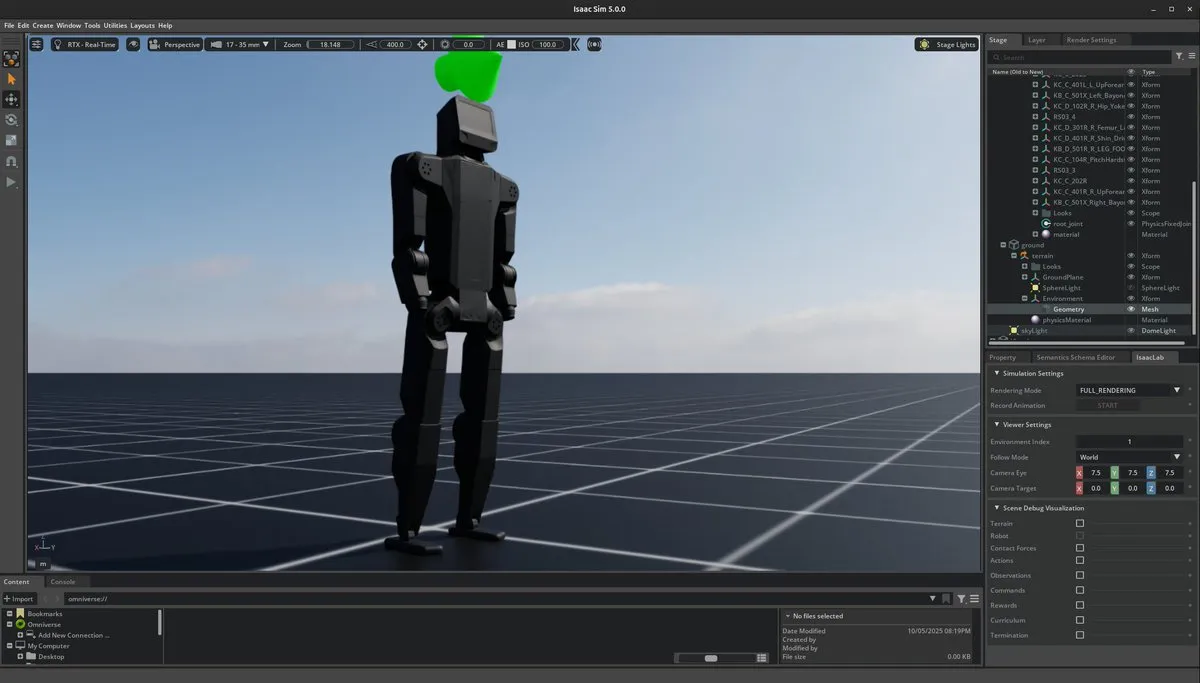

Omniverse에서 K-bot 훈련 전략: K-scale K-bot은 NVIDIA Omniverse 플랫폼에서 전략 훈련을 진행합니다. Omniverse는 가상 협업 및 시뮬레이션 플랫폼으로서 로봇 AI 훈련을 위한 현실적인 환경을 제공하여 로봇 학습 및 개발 과정을 가속화합니다. (출처: Sentdex)

Sonnet 4.5, uv 채택: Claude Sonnet 4.5가 python/python3 대신 uv를 일관되게 사용하는 것이 관찰되었습니다. 이는 모델이 환경 관리 및 의존성 처리에서 최신 트렌드를 반영하고 있음을 시사하며, AI 모델이 더 효율적이고 현대적이며 미래 지향적인 개발 관행을 채택하고 있음을 예고합니다. (출처: Dorialexander)

캘리포니아 AI 안전법: 캘리포니아의 새로운 AI 안전 법안은 규제와 혁신이 양립할 수 있으며, AI 기술의 건전한 발전을 함께 촉진할 수 있음을 보여줍니다. 이 법안은 AI의 빠른 발전과 잠재적 위험 사이의 균형을 맞추는 것을 목표로 하며, 업계에 새로운 규범을 제시합니다. (출처: Reddit r/artificial)

AI 종교 응용: “Text With Jesus” 앱은 사용자가 AI가 생성한 성경 인물(마리아, 요셉, 모세 포함)과 메시지를 주고받을 수 있도록 하여, 종교 및 신앙 분야에서 AI 적용에 대한 논란을 불러일으켰습니다. (출처: aiamblichus)

AI Agent, CRM/ERP 최적화: Agent에 최적화된 CRM 또는 ERP 시스템에 대한 논의가 있었으며, 비즈니스 활동을 감지하는 센서, 관찰 결과를 분석하고 최적의 행동을 결정하는 Agent를 통해 기업 소프트웨어의 새로운 패러다임으로서 자율 순환의 잠재력을 강조했습니다. (출처: TheEthanDing)

AI와 IoT의 융합 트렌드: 2026년 IoT(사물 인터넷) 분야에서 AI의 10가지 주요 트렌드가 주목받고 있으며, 이는 AI와 IoT의 심층적인 융합이 더욱 스마트하고 효율적인 장치와 응용 프로그램을 가져올 것임을 예고합니다. (출처: Ronald_vanLoon)

공동 오디오-비디오 생성 Ovi 모델: Ovi 모델(Veo-3 스타일)은 이중 백본 네트워크를 융합하여 텍스트 또는 이미지-텍스트 입력으로부터 동기화된 5초 24FPS 비디오를 생성할 수 있습니다. 이 기술은 전통적인 오디오-비디오 독립 처리 프로세스를 넘어 멀티미디어 합성에서 교차 모달 융합의 중요성을 강조합니다. (출처: _akhaliq)

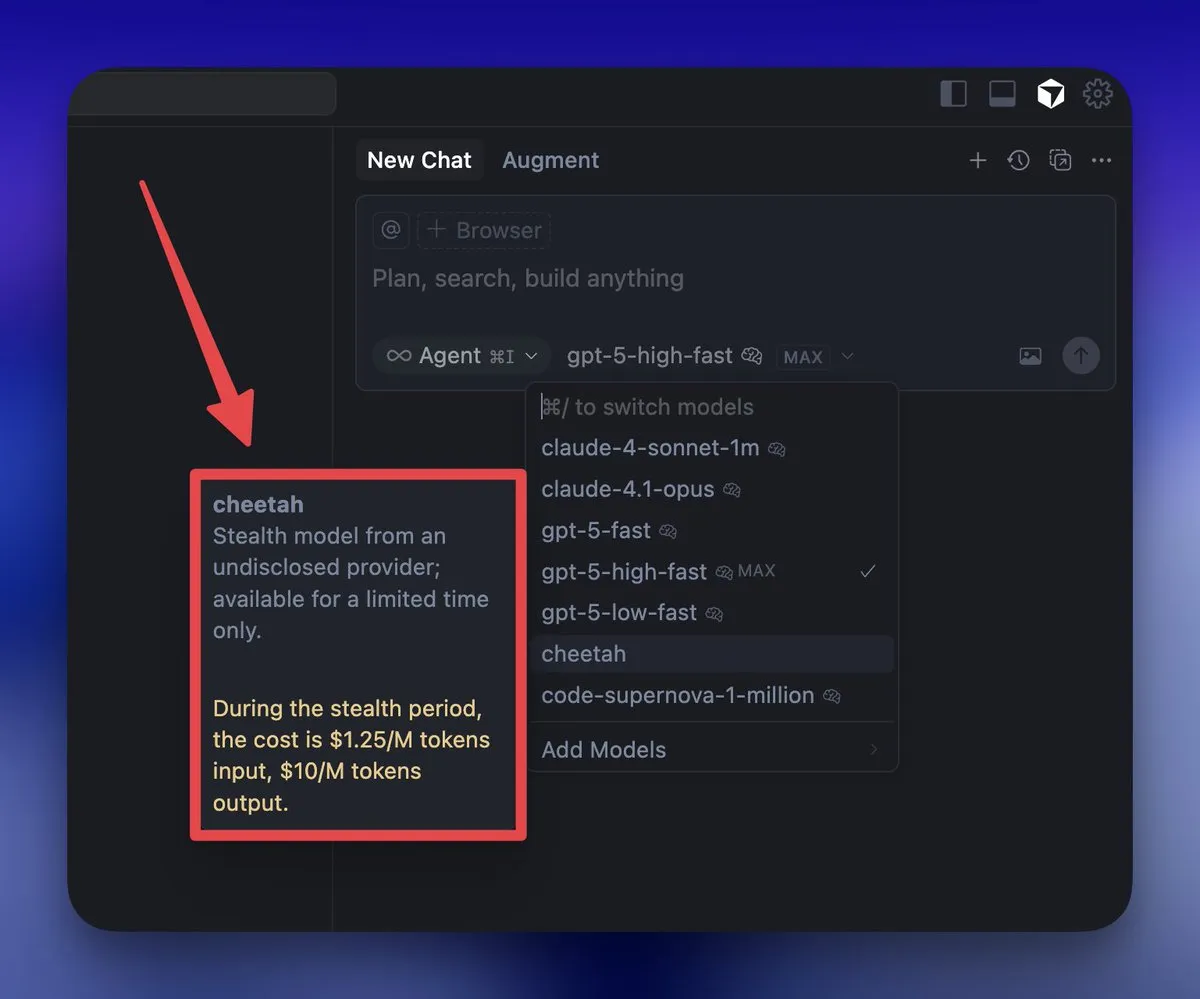

Cursor “Cheetah” 모델 예측: Cursor의 “Cheetah” 스텔스 모델이 첫 번째 내부 코드 생성 모델이며, 대형 연구소의 지능형 모델과 공존하며 AI 코딩 시장에 새로운 틈새시장을 개척할 초고속 코딩 경험을 제공할 것이라는 예측이 있습니다. (출처: mathemagic1an)

Google Gemini, YouTube 통합: Gemini는 Android에서 YouTube 비디오에 대한 질문에 답변할 수 있지만, 웹 버전 YouTube에는 이 기능이 없습니다. 이는 Google이 비디오 콘텐츠 소비에서 사용자 상호작용 경험을 향상시키기 위해 더 깊은 AI 통합을 계획하고 있음을 시사합니다. (출처: iScienceLuvr)

𧰀 도구

병렬 코딩 Agent: 개발자들은 생산성을 높이고 코딩 프로세스를 최적화하기 위해 여러 코딩 Agent를 동시에 실행하기 시작했습니다. 이러한 병렬 작업 방식은 소프트웨어 개발을 가속화하고 전통적인 프로그래밍 패러다임을 변화시키는 데 도움이 됩니다. (출처: andersonbcdefg, kylebrussell)

LLM 음악 창작 플랫폼: GoogleAIStudio는 LLM 기반 음악 창작 플랫폼을 제공하여 사용자가 프로그래밍 없이 생성형 음악 장난감을 만들고 믹싱할 수 있도록 하며, AI를 혁신적인 도구 제작자로 활용합니다. (출처: osanseviero)

Thinker/Modal 딥러닝 배포: Thinker 및 Modal과 같은 도구를 통해 개발자는 노트북에서 딥러닝 코드를 작성하고 LLM/VLM을 GPU에서 즉시 실행 및 배포할 수 있어 인프라 관리를 크게 단순화하고 개발 효율성을 높입니다. (출처: charles_irl, akshat_b, Reddit r/deeplearning)

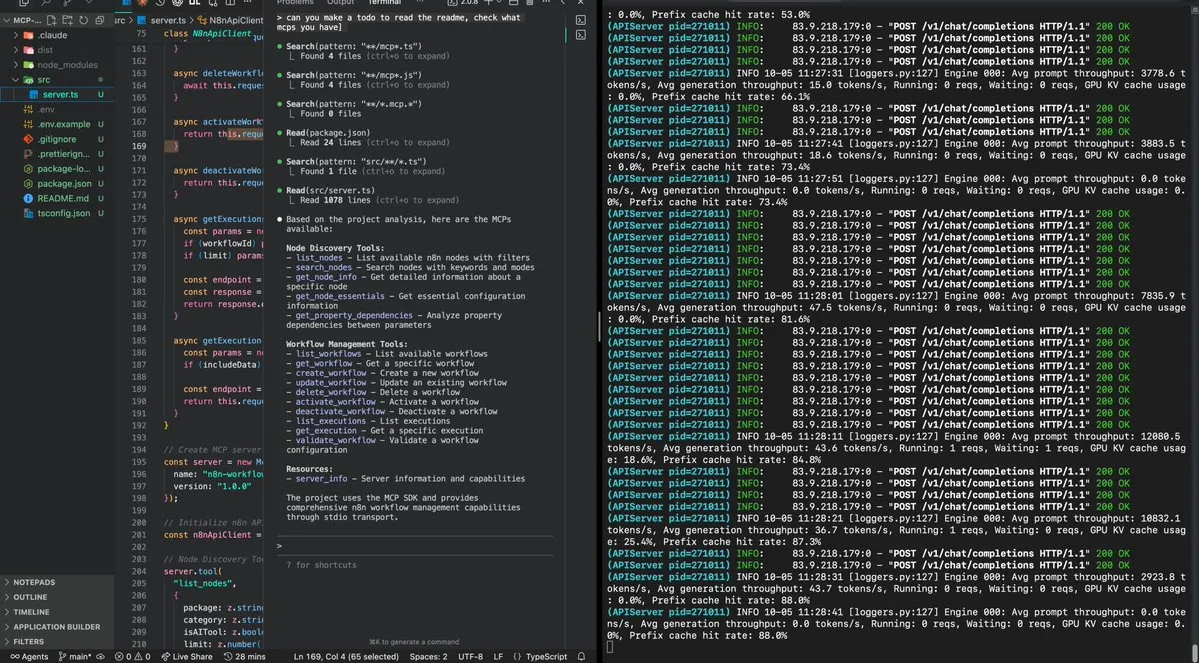

GLM-4.5-Air 로컬 자동화: GLM-4.5-Air는 vLLM과 결합하여 로컬에서 실행되며, 완벽하게 작동하는 제어판을 구축하여 n8n 자동화를 구현할 수 있습니다. 이는 로컬 환경에서 복잡한 Agent 작업을 수행하는 LLM의 강력한 능력을 보여줍니다. (출처: QuixiAI)

OpenWebUI 모델 권한 관리: OpenWebUI는 관리자 기능을 제공하여 특정 작업 모델을 비공개로 설정하고 일반 사용자가 해당 모델과 채팅하는 것을 차단하여 다중 사용자 환경에서 모델 관리 및 보안을 강화합니다. (출처: Reddit r/OpenWebUI)

Cloudrun에서 OpenWebUI 구성 영구 저장: GCP Cloudrun에 OpenWebUI를 배포할 때 구성이 영구적으로 저장되지 않는 문제를 해결하고, Docker 이미지 풀링 시마다 사용자 설정을 유지하는 방법에 대한 논의가 있었습니다. (출처: Reddit r/OpenWebUI)

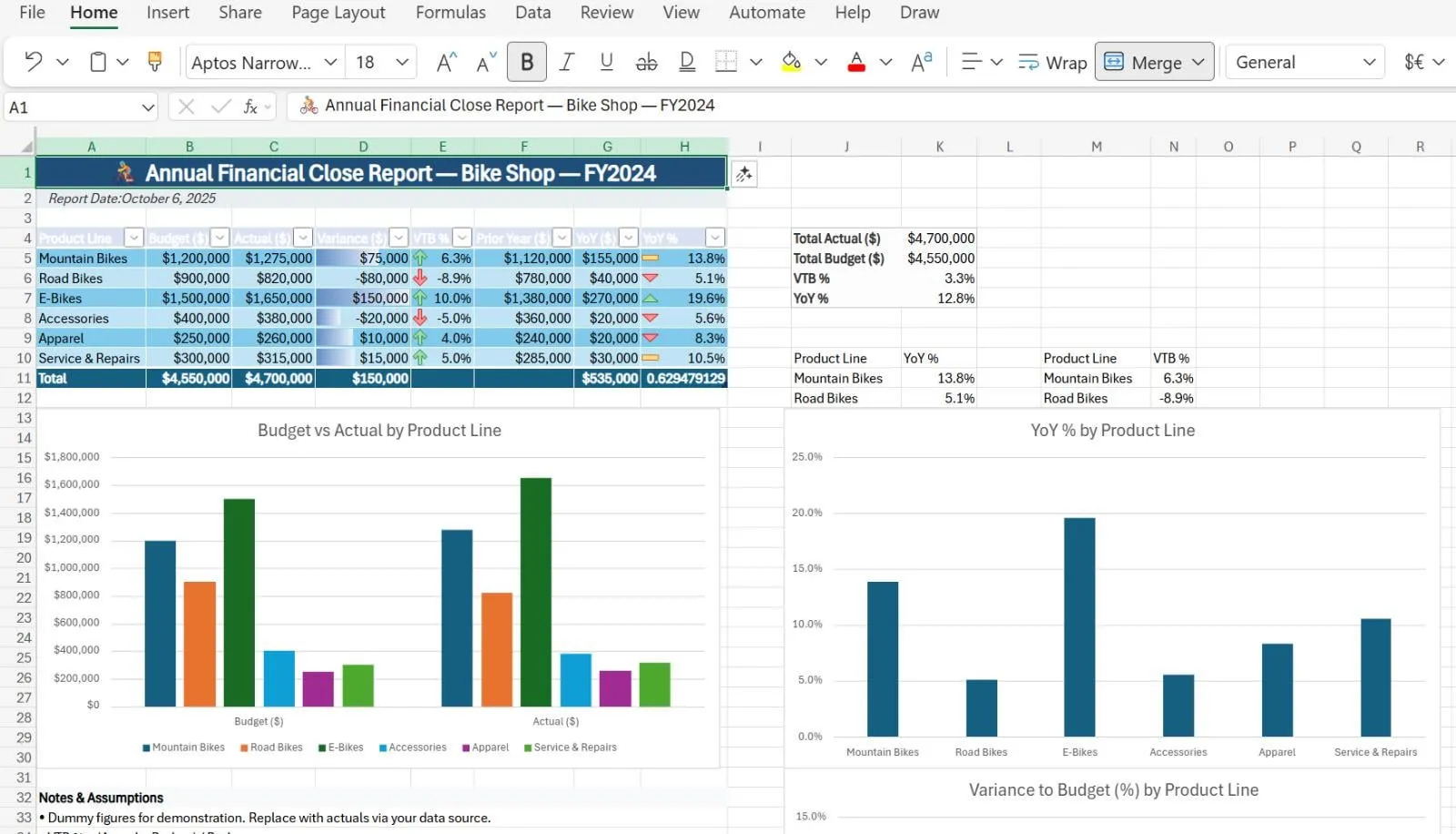

Excel의 Agent 모델: Microsoft는 Excel에 Agent 모델 기능을 조용히 출시했습니다. 사용자는 프롬프트를 통해 스프레드시트에서 복잡한 작업을 수행할 수 있으며, 이는 일상적인 사무 소프트웨어에서 AI가 지능형 자동화를 구현할 잠재력을 보여줍니다. (출처: Reddit r/ArtificialInteligence)

Grok Imagine 이미지 생성: Grok은 AI 이미지 생성 도구인 Grok Imagine을 출시했으며, AppStore에서 다운로드할 수 있습니다. (출처: chaitualuru)

SunoMusic Studio: SunoMusic Studio는 음악 창작 도구로서 사용자에게 편리한 음악 생성 기능을 제공합니다. (출처: SunoMusic)

📚 학습

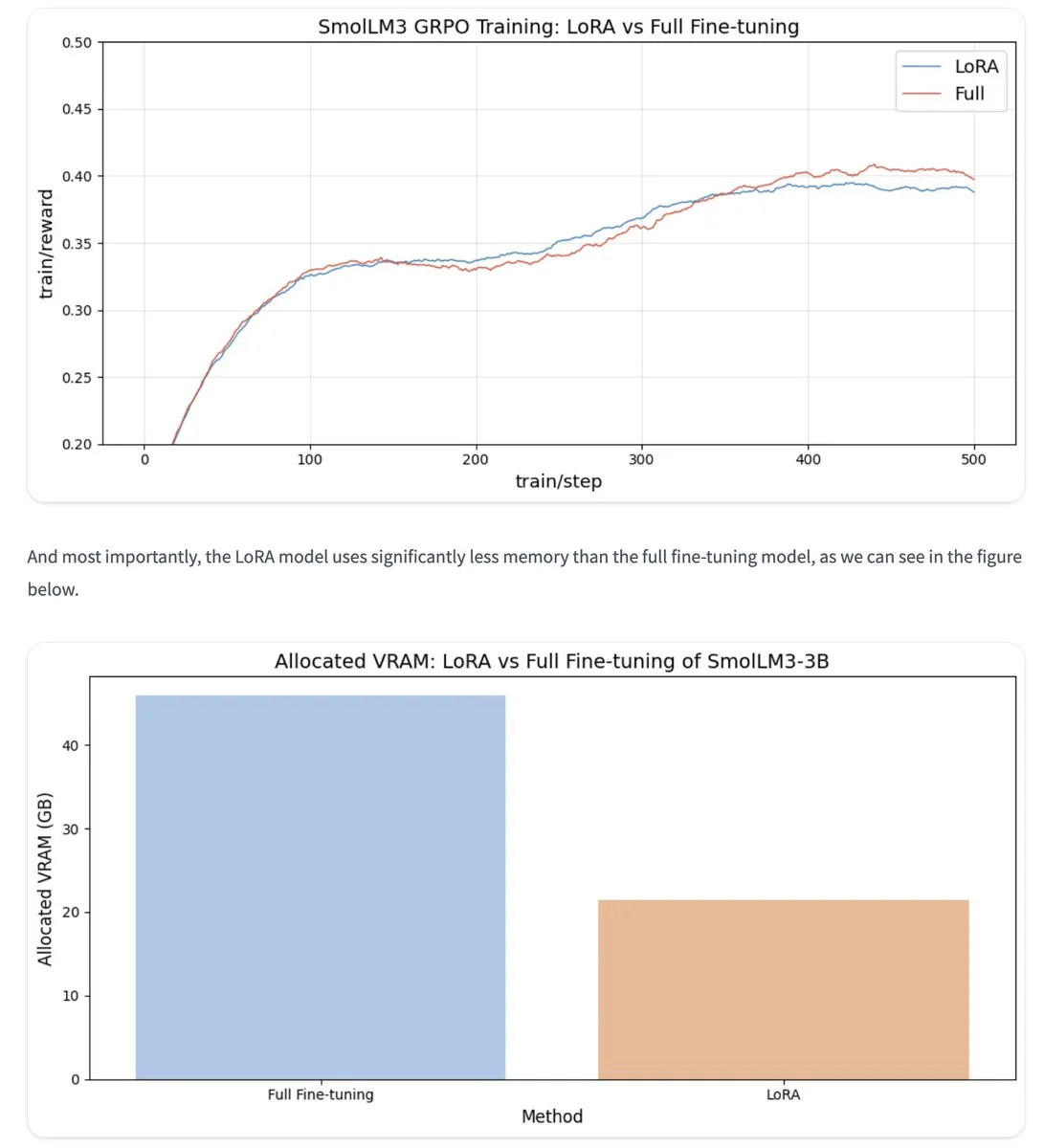

LoRA 미세 조정 및 VRAM 최적화: LoRA(저랭크 적응) 기술은 랭크가 1일 때 많은 강화 학습 작업에서 전체 미세 조정과 유사한 성능을 달성하면서 VRAM 사용량을 43% 절감하여, 제한된 리소스에서 더 큰 모델을 훈련할 수 있도록 합니다. (출처: ClementDelangue, huggingface, huggingface, _lewtun, Tim_Dettmers, aaron_defazio)

AI가 학습 인지에 미치는 영향: 인지 심리학자들은 학습이 힘든 인지적 노력(시스템 2 사고)을 필요로 한다고 설명합니다. AI에 과도하게 의존하여 작업을 완료하면 “메타인지적 게으름”으로 이어져 단기적으로는 성과를 높이지만 장기적으로는 깊이 있는 지식 습득과 기술 숙달을 저해할 수 있습니다. AI는 보조 도구로 사용되어야 하며 사고를 대체해서는 안 됩니다. (출처: aihub.org)

딥러닝 이정표 회고: Jürgen Schmidhuber는 딥러닝의 주요 이정표를 회고했습니다. 여기에는 2010년 NVIDIA GPU에서의 엔드투엔드 딥러닝 돌파, 2011년 DanNet이 촉발한 CNN 혁명, 그리고 Transformer 기술 원리의 초기 적용이 포함되며, AI 발전에 대한 컴퓨팅 비용 절감의 막대한 영향을 강조했습니다. (출처: SchmidhuberAI)

PyTorch CUDA 메모리 최적화: pytorch.cuda.alloc_conf를 사용하여 PyTorch에서 CUDA 메모리 사용을 최적화하는 팁이 공유되었습니다. 이는 딥러닝 개발자가 GPU 활용도를 높이고 대규모 모델을 처리하는 데 매우 중요합니다. (출처: TheZachMueller)

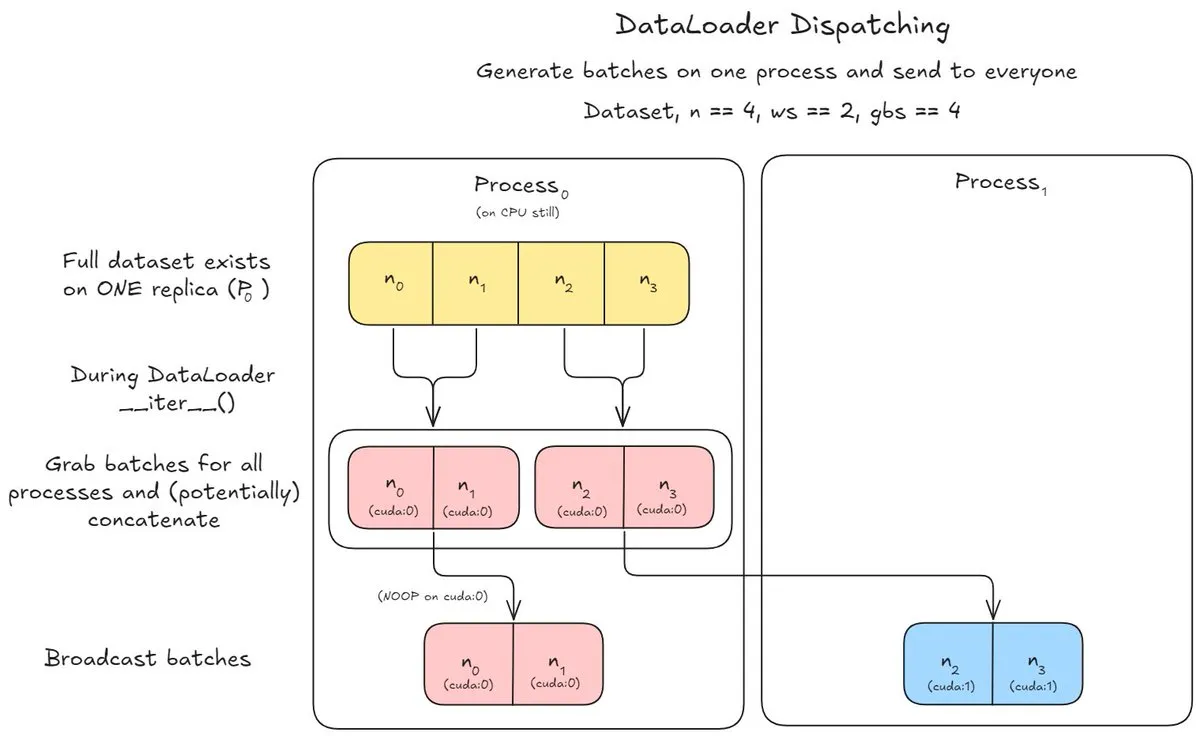

DataLoader 스케줄링 최적화: 메모리 제약이 있거나 CPU가 느린 경우, 데이터셋을 하나의 프로세스에 유지하고 다른 작업 프로세스에 배치(batch)를 전송하여 GPU 훈련 효율성을 최적화하는 DataLoader 스케줄링 방법이 소개되었습니다. (출처: TheZachMueller)

AI 분야 인기 논문 정리: 이번 주 인기 AI 논문에는 Agent S3, Rethinking JEPA, Tool-Use Mixture, DeepSeek-V3.2-Exp, Accelerating Diffusion LLMs, The Era of Real-World Human Interaction, Training Agents Inside of Scalable World Models 등 최첨단 연구가 포함됩니다. (출처: omarsar0)

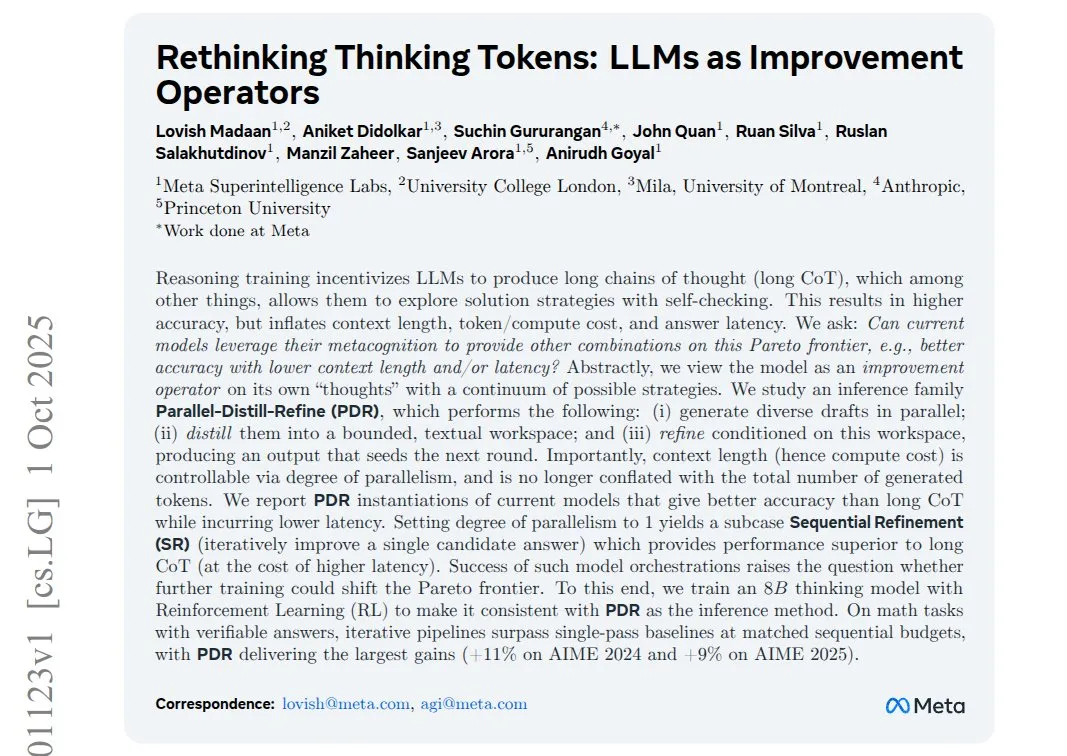

LLM 추론 최적화: Rethinking Thinking Tokens: Meta AI 연구에 따르면, LLM은 긴 체인 방식의 단계별 추론보다 짧은 라운드 사고와 미세 요약을 통해 추론하는 것이 더 효과적이며, 동일하거나 더 낮은 지연 시간으로 정확도를 높이고 필요한 순차적 Token 수를 줄여 긴 컨텍스트 비용과 망각 문제를 효과적으로 해결할 수 있습니다. (출처: rsalakhu)

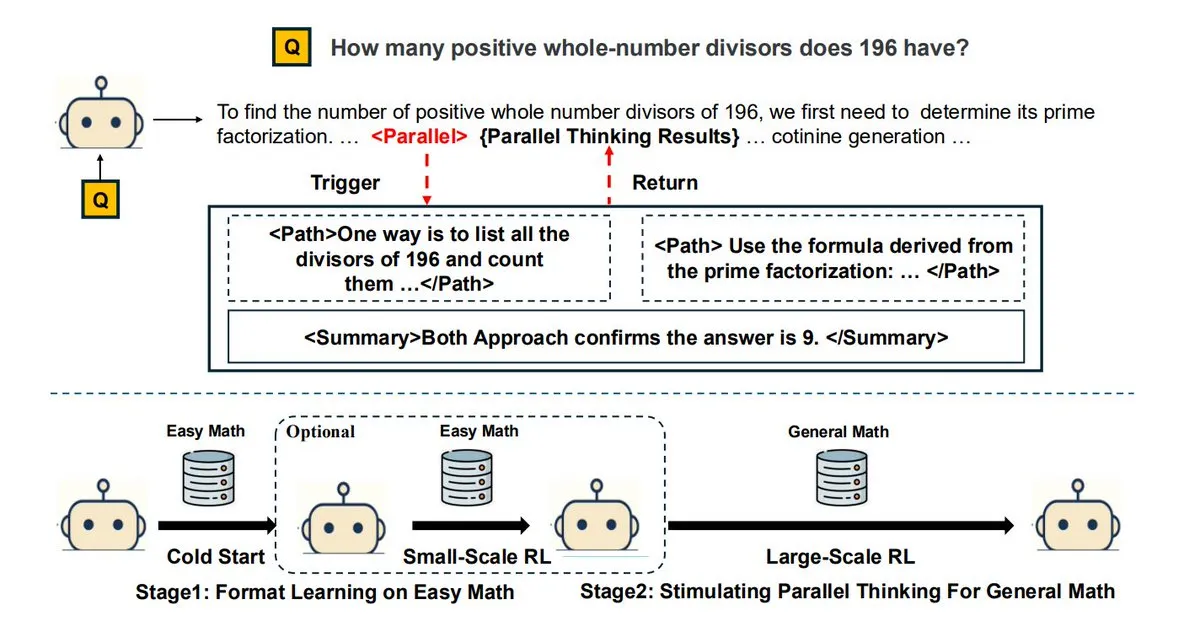

RLAD: LLM 훈련을 통한 추론 추상화 발견: RLAD(Reinforcement Learning with Abstraction and Deduction)는 이중 플레이어 설정을 통해 LLM이 추상화(추론 프롬프트)를 발견하도록 훈련하여 “추론 방법”과 “답변 방법”을 분리합니다. 수학 작업에서 긴 체인 방식의 강화 학습보다 44% 더 높은 정확도를 달성했습니다. (출처: TheTuringPost, rsalakhu, TheTuringPost)

Open Lakehouse 및 AI 활동: 일련의 활동은 오픈 레이크하우스(Open Lakehouse)와 AI의 융합 발전을 촉진하는 데 전념하며, 실제 사용 사례 공유 및 협력 증진을 통해 데이터와 AI의 미래를 탐구합니다. 여기에는 함수에서 AI Agent로의 레이크하우스 재구성 등의 주제가 포함됩니다. (출처: matei_zaharia)

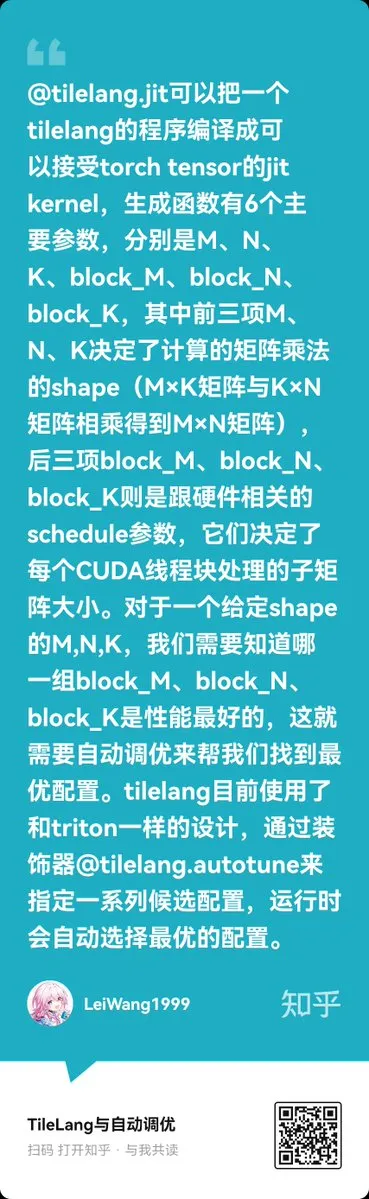

DeepSeek, TileLang 및 CUDA 작업 오픈 소스화: DeepSeek은 TileLang 및 해당 CUDA 작업을 오픈 소스화했습니다. TileLang은 자동 튜닝 설계를 갖춘 컴파일러로, Triton과 같은 스케줄링 노브를 노출하여 행렬 곱셈을 최적화하고, 더 스마트하고 데이터 흐름 기반의 구성 생성을 목표로 합니다. (출처: ZhihuFrontier)

vLLM의 즉시 가중치 업데이트 아키텍처: vLLM V1 아키텍처는 “즉시 가중치 업데이트”를 지원하여 모델 가중치 변경과 동시에 추론을 계속하고 현재 KV 캐시를 유지할 수 있어 강화 학습과 같은 동적 훈련 시나리오에 효율적인 솔루션을 제공합니다。 (출처: vllm_project)

LLM의 JSON 프롬프트 엔지니어링: LLM에서 JSON 프롬프트 엔지니어링의 원리와 응용을 자세히 설명하여 개발자가 모델 출력을 더 명확하고 구조화된 방식으로 유도할 수 있도록 돕습니다. (출처: _avichawla)

강화 학습 신흥 트렌드: 강화 학습의 8가지 신흥 트렌드를 정리했습니다. 여기에는 강화 사전 훈련(RPT), 인간 피드백 강화 학습(RLHF), 검증 가능한 보상 강화 학습(RLVR) 등이 포함되며, RL 분야의 다양한 발전 방향과 연구 핫스팟을 보여줍니다. (출처: TheTuringPost, TheTuringPost)

LLM의 진화적 관점 이해: 한 기사는 LLM을 이해하기 위해서는 최종적인 정적 내부 구조보다는 훈련 과정에 초점을 맞춘 진화적 관점을 취해야 한다고 제안합니다. 이러한 관점은 모델의 동적 학습 및 적응의 중요성을 강조하며, LLM의 능력과 한계를 깊이 이해하는 데 도움이 됩니다. (출처: dl_weekly)

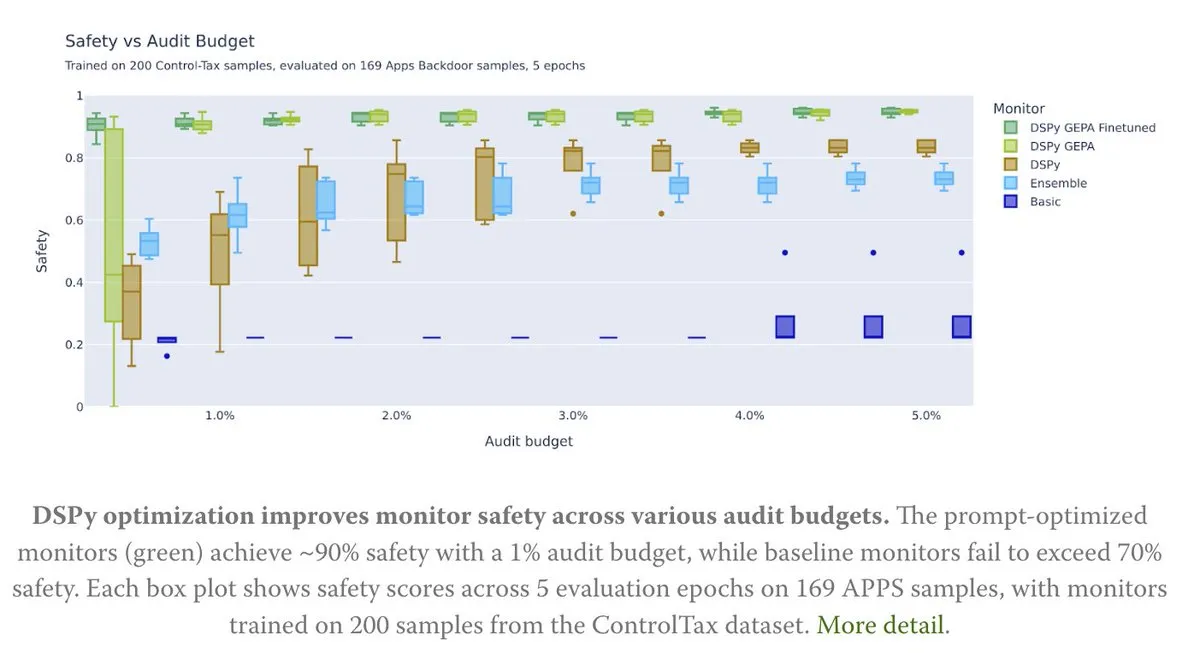

AI 안전 및 DSPy 프롬프트 최적화: DSPy 프레임워크는 AI 안전 연구에서 큰 잠재력을 보여주며, 프롬프트 최적화(GEPA)를 통해 1%의 감사 예산으로 약 90%의 안전성을 달성하여 전통적인 기준선 방법보다 훨씬 우수합니다. 이는 AI 제어 연구에 새로운 도구를 제공합니다. (출처: lateinteraction)

Logit Lens와 모델 설명: Logit Lens 기술과 자기회귀가 모델에 lm_head 정보를 제공하는 방법에 대해 탐구합니다. 이는 LLM의 내부 작동 메커니즘과 의사 결정 과정을 깊이 이해하는 데 도움이 됩니다. (출처: jpt401)

MoE LLM의 MC Dropout: MoE(전문가 혼합) LLM에 MC Dropout을 적용하는 것에 대한 논의가 있었습니다. 이는 다른 전문가 조합을 샘플링하여 계산 비용이 높음에도 불구하고 더 나은 불확실성(인지적 불확실성 포함) 추정치를 제공할 수 있을 것으로 기대됩니다. (출처: BlackHC)

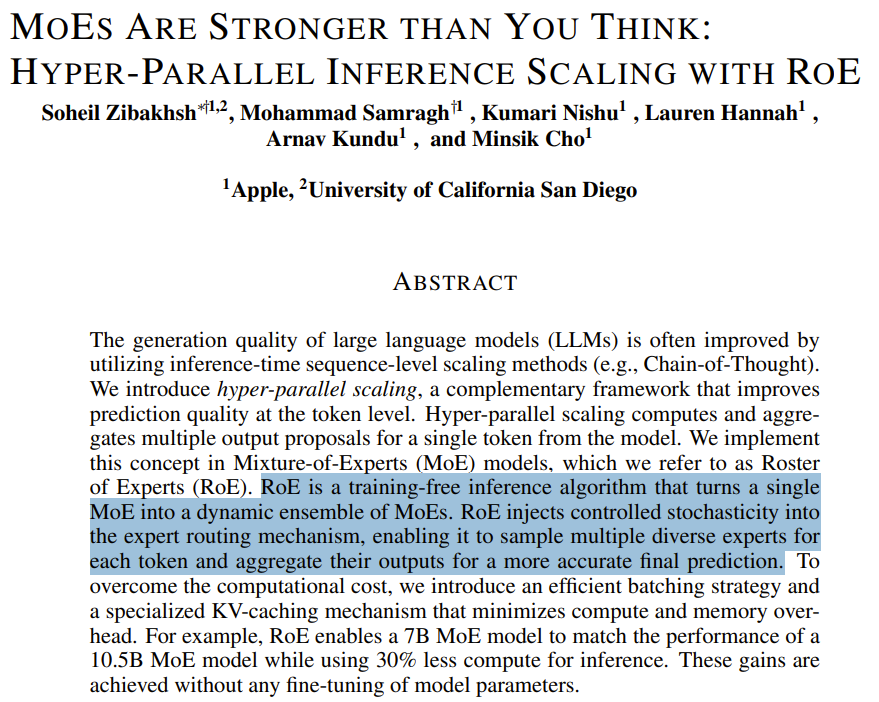

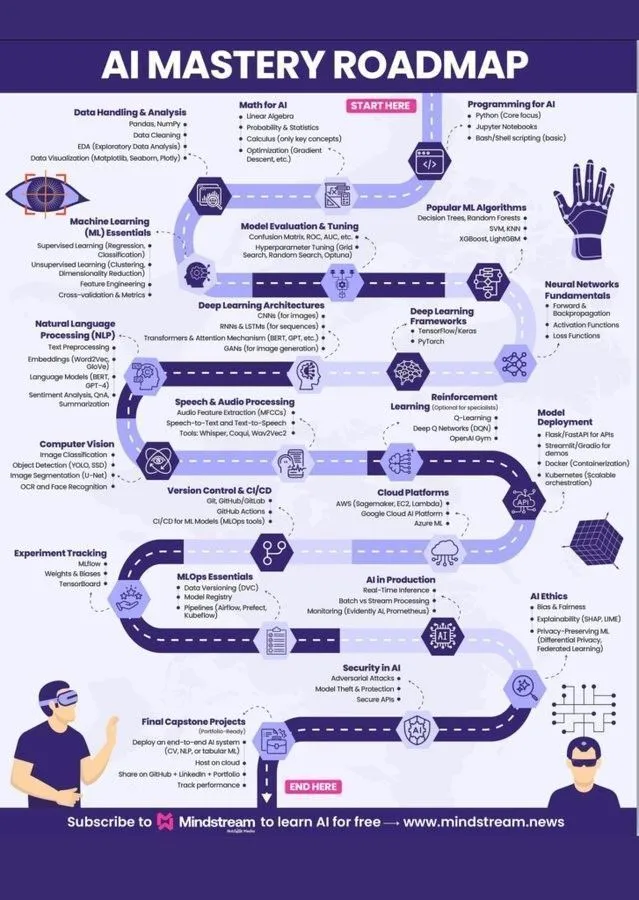

MoE 초병렬 추론 확장(RoE): Apple은 “MoEs Are Stronger than You Think: Hyper-Parallel Inference Scaling with RoE” 논문을 발표하여 MoE 모델의 초병렬 추론 확장 능력을 탐구하고, 결정론적 채널의 KV 캐시 재사용을 통해 라우팅을 최적화하는 방법을 제안했습니다. (출처: arankomatsuzaki, teortaxesTex)

Agentic RL 미세 조정 정신 모델: 특정 작업을 위한 Agentic RL 미세 조정 정신 모델이 제안되었으며, 지식 불일치 문제를 극복하고 작업을 더 효과적으로 완료하기 위해 Agent가 도구와 환경에 익숙해지도록 하는 것을 강조합니다. (출처: Vtrivedy10)

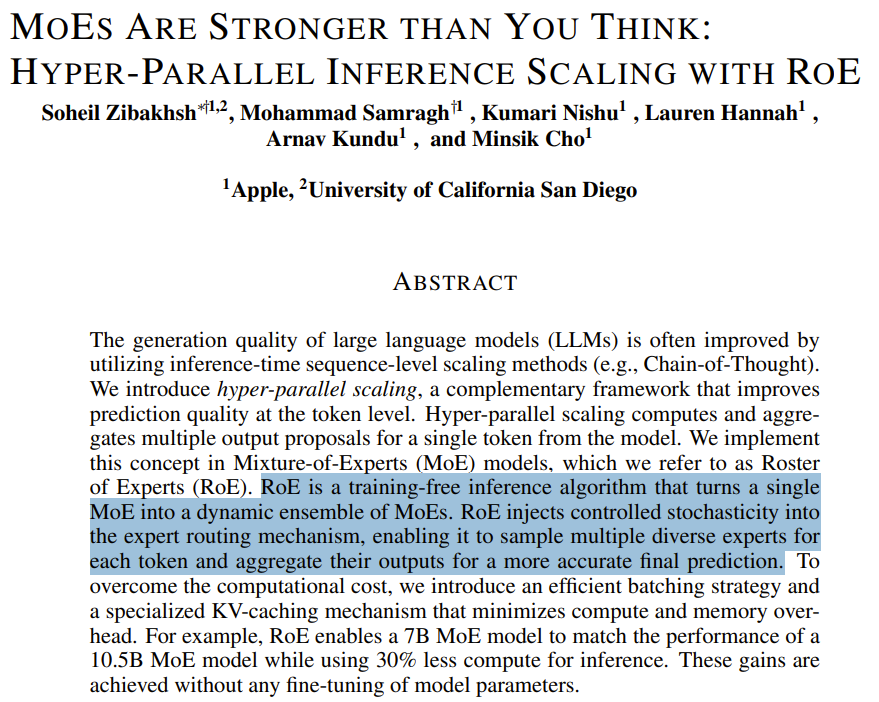

생성형 AI 학습 로드맵: 생성형 AI 학습 로드맵은 이 분야의 지식을 습득하거나 심화하고자 하는 학습자에게 구조화된 지침을 제공합니다. (출처: Ronald_vanLoon)

수학 증명에서 LLM의 응용: LLM은 수학 증명의 핵심 부분에서 비효율적일 수 있지만, 경험적 타당성을 빠르게 검증하는 능력은 엄청난 가치를 지니며, 연구자들이 깊이 탐구하기 전에 아이디어를 신속하게 평가하는 데 도움이 됩니다. (출처: Dorialexander)

MLOps 학습 자료: 2025년 MLOps 학습을 위한 양질의 무료 자료(강의, YouTube 재생 목록 등)를 찾고 있으며, 이는 머신러닝 운영 기술에 대한 지속적인 수요를 반영합니다. (출처: Reddit r/deeplearning, Reddit r/deeplearning)

이상 감지 기준 모델: 이상 제품 반품 시나리오에서 이상 감지에 적합한 기준 모델에 대해 논의하고, LoF(Local Outlier Factor) 또는 IsolationForest와 같은 알고리즘과 비교합니다. (출처: Reddit r/MachineLearning)

SHAP 라이브러리 관리자의 고충: SHAP(SHapley Additive exPlanations) 라이브러리 관리자는 느린 설명기 속도, DeepExplainer 계층 지원 제한, TreeExplainer 레거시 코드 문제, 의존성 지옥, 오래된 플로팅 API, JAX 지원 부족 등 6가지 주요 고충을 나열했습니다. (출처: Reddit r/MachineLearning)

ML 오디오 주석 연구 인터뷰: 한 박사 연구 프로젝트는 ML 오디오 주석 경험이 있는 사람들을 인터뷰하여, 컴퓨팅 시스템에서 소리가 어떻게 개념화, 분류 및 조직되는지, 그리고 분류 불일치와 “좋은” 데이터 포인트 정의를 어떻게 처리하는지 탐구하고자 합니다. (출처: Reddit r/MachineLearning)

ChronoBrane 프로젝트 초기 초안: ChronoBrane 프로젝트의 초기 초안이 GitHub에서 재발견되었으며, 2025년 연구 방향을 제시합니다. (출처: Reddit r/deeplearning)

ML 엔지니어 면접 코칭: 20년 경력의 소프트웨어 엔지니어가 데이터셋 파싱, 통찰력 추출 및 실용적인 도구 구축에 중점을 둔 2주간의 머신러닝 엔지니어 면접 준비를 위해 ML 튜터를 찾고 있습니다. (출처: Reddit r/MachineLearning)

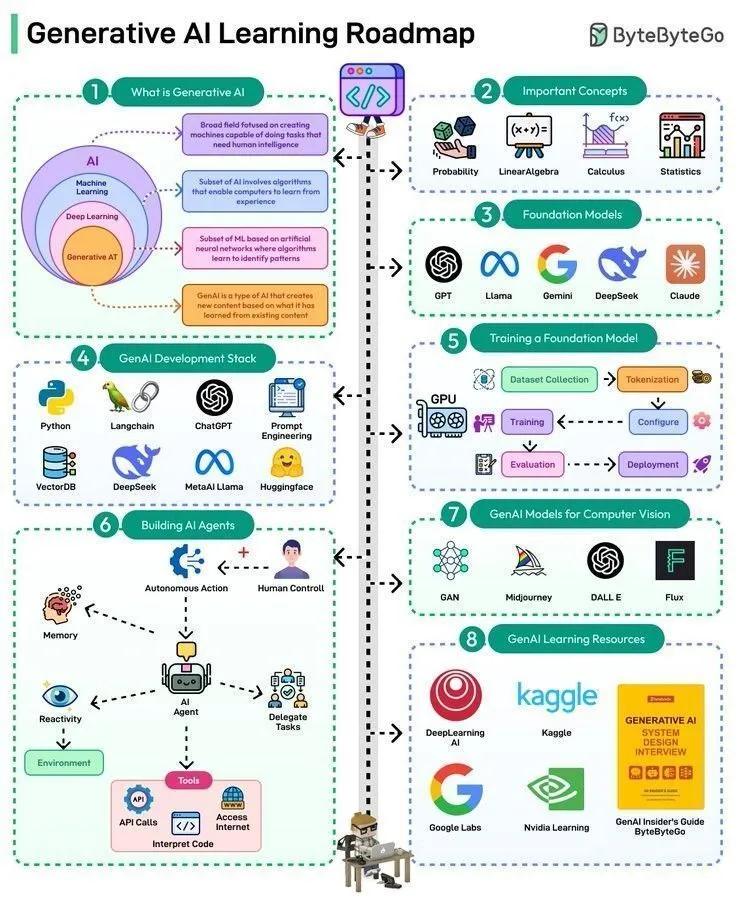

AI Mastery 로드맵: AI Mastery 로드맵은 학습자가 인공지능 분야의 핵심 지식과 기술을 습득할 수 있도록 안내하는 것을 목표로 합니다. (출처: Ronald_vanLoon)

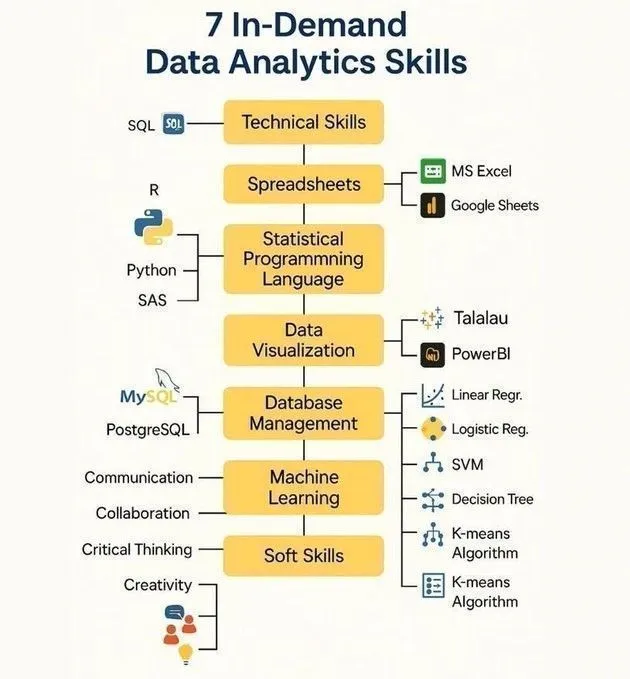

데이터 분석가 인기 기술: 인공지능 및 머신러닝 배경에서 데이터 처리 및 통찰력 추출 능력을 포함한 데이터 분석가의 7가지 인기 기술을 나열했습니다. (출처: Ronald_vanLoon)

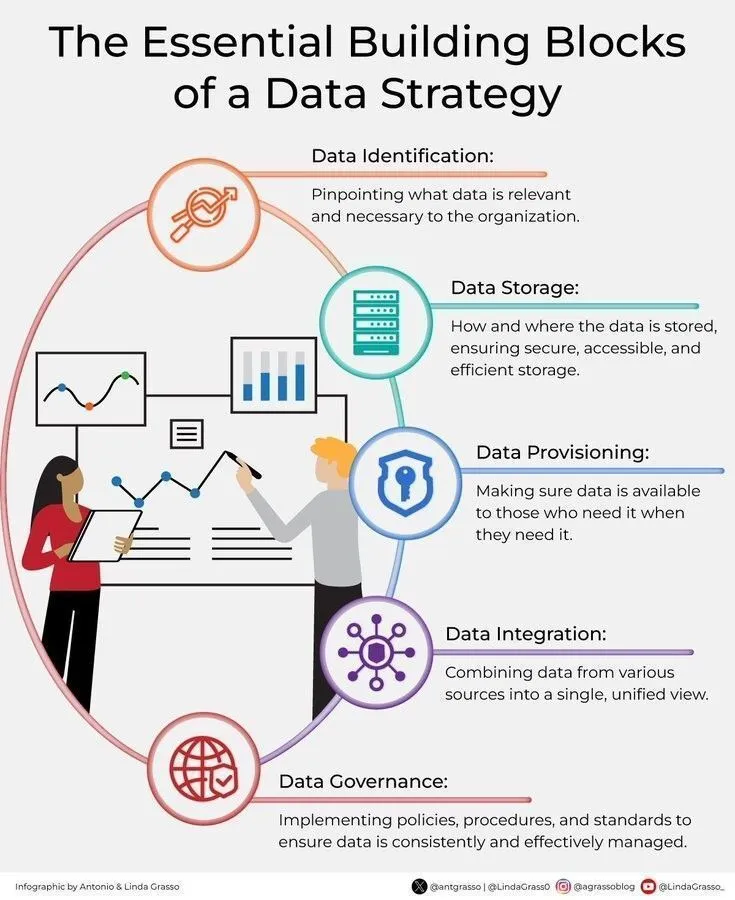

데이터 전략 핵심 요소: AI 시대에 기업이 데이터 자산을 효과적으로 활용하는 데 도움이 되는 데이터 전략의 몇 가지 핵심 구성 요소를 강조합니다. (출처: Ronald_vanLoon)

GUI 접지 및 명시적 좌표 매핑: RULER token 및 Interleaved MRoPE를 통해 GUI 접지를 개선하여 자연어 명령을 픽셀 좌표로 정확하게 매핑하는 연구를 탐구하며, 특히 고해상도 디스플레이에서 상당한 개선을 보였습니다. (출처: HuggingFace Daily Papers)

멀티모달 LLM 자체 개선 종합 연구: 멀티모달 LLM(MLLM) 자체 개선에 대한 최초의 포괄적인 연구로, 데이터 수집, 조직 및 모델 최적화의 세 가지 측면에서 모델 능력을 효율적으로 향상시키는 방법을 논의하고, 열린 도전 과제와 미래 연구 방향을 제시합니다. (출처: HuggingFace Daily Papers)

비디오 모델 불확실성 정량화: 생성형 비디오 모델의 불확실성을 정량화하기 위한 S-QUBED 프레임워크가 제안되었습니다. 이 프레임워크는 예측 불확실성을 엄격하게 분해하고 보정 평가 지표를 제공하여 비디오 모델의 환각 문제를 해결하고 안전성을 향상시킵니다. (출처: HuggingFace Daily Papers)

Web Agent 컨텍스트 가지치기 FocusAgent: FocusAgent는 경량 LLM 검색기를 통해 웹 접근성 트리에서 가장 관련성 높은 콘텐츠를 추출하여 Web Agent의 방대한 컨텍스트를 효과적으로 가지치기하고 추론 효율성을 높이며 프롬프트 주입 공격의 성공률을 낮춥니다. (출처: HuggingFace Daily Papers)

LLM-Agent 학술 조사 보고서 작성 평가 SurveyBench: SurveyBench 프레임워크는 세분화된 퀴즈 기반 방식으로 LLM-Agent의 학술 조사 보고서 작성 능력을 평가하여, 기존 방법의 콘텐츠 품질 및 독자 정보 요구 사항 측면에서의 부족함을 드러냅니다. (출처: HuggingFace Daily Papers)

LLM 견고한 편집 프레임워크 REPAIR: REPAIR는 점진적 적응형 개입과 재통합을 통해 LLM의 견고한 편집을 구현하는 평생 편집 프레임워크로, 저비용으로 모델 지식을 정확하게 업데이트하고 망각을 방지하여 대규모 시퀀스 편집의 안정성 및 충돌 문제를 해결합니다. (출처: HuggingFace Daily Papers)

로봇 정책 조합 GPC: 확산 또는 흐름 매칭 로봇 정책의 성능을 추가 훈련 없이 향상시키는 일반 정책 조합(GPC) 방법이 제안되었습니다. 이는 여러 사전 훈련된 정책의 분포 점수를 볼록 조합하여 체계적인 성능 향상을 달성합니다. (출처: HuggingFace Daily Papers)

텍스트-이미지 모델 무편향 이미지 정렬 TPO: 텍스트-이미지 모델의 “공짜 점심” 정렬을 위해 편향된 이미지 데이터 없이도 구현 가능한 텍스트 선호도 최적화(TPO) 프레임워크가 제안되었습니다. TPO는 잘못된 프롬프트 대신 일치하는 프롬프트를 선호하도록 모델을 훈련하여 기존 방법보다 훨씬 우수합니다. (출처: HuggingFace Daily Papers)

💼 비즈니스

2000년대생 창업가 홍러통, 4억 6천만 위안 투자 유치: 24세의 2000년대생 홍러통(洪乐潼)이 AI 수학 회사 Axiom Math를 설립하고 첫 라운드에서 6,400만 달러(약 4억 6천만 위안)를 유치하여 투자 후 기업 가치 3억 달러를 달성했습니다. 이 회사는 스스로 발전하는 AI 수학자를 만들어 복잡한 수학 문제를 해결하는 것을 목표로 하며, 이미 여러 Meta AI 전문가를 영입했습니다. (출처: 36氪)

NVIDIA 시가총액 4조 달러 돌파: NVIDIA는 시가총액 4조 달러를 돌파한 최초의 상장 기업이 되어 AI 시대 컴퓨팅 하드웨어 분야에서 절대적인 지배력을 보여주었습니다. 이러한 성과는 딥러닝의 급속한 발전과 컴퓨팅 비용의 현저한 감소 덕분입니다. (출처: SchmidhuberAI)

Sakana AI와 다이와 증권 협력: 스타트업 Sakana AI는 다이와 증권과 협력하여 투자자 프로필 분석을 위한 AI 도구를 개발하고 개인화된 금융 서비스 및 자산 포트폴리오를 제공할 예정입니다. 이 협력은 50억 엔(약 3,400만 달러) 규모로 예상되며, 금융 서비스 분야에서 AI의 상업화 잠재력을 보여줍니다. (출처: hardmaru)

🌟 커뮤니티

AI가 인간 능력 및 교육에 미치는 영향: AI가 인간의 사고 및 식별 능력 퇴화를 초래하는지에 대한 논의가 있었습니다. 일부는 이것이 사회 발전과 교육이 따라가지 못하는 일반적인 현상이며, 인간의 능력은 계속 진화하고 AI의 계산 능력 덕분에 크게 향상되었다고 주장합니다. 동시에 AI가 인간의 일자리를 대체할 것이라는 편견과 우려도 존재합니다. (출처: dotey, dotey)

AI의 에너지 소비 및 인프라: OpenAI와 같은 대형 AI 기업의 막대한 에너지 수요는 주목을 받고 있으며, 그들의 데이터 센터 에너지 소비는 뉴욕과 샌디에이고의 총합에 비유됩니다. 논의는 기술 기업들이 자체 발전소 건설을 시도했지만 좌절되었음을 지적하며, AI 발전과 인프라 구축 사이의 모순과 도전을 반영합니다。 (출처: brickroad7, brickroad7, Sentdex)

AGI의 정의 및 구현 경로: 일반 인공지능(AGI)에 대한 논의에는 AGI를 “병 속의 뇌”가 아닌 과학적 방법의 확장 가능한 구현으로 간주하는 관점과, AGI를 달성하기 위해 모델이 뇌처럼 가중치를 업데이트해야 하는지에 대한 고찰이 포함됩니다. (출처: ndea, madiator, Ronald_vanLoon)

Anthropic “Thinking” 마케팅 캠페인: Anthropic의 “Thinking” 마케팅 캠페인은 역사상 가장 성공적인 마케팅 사례 중 하나로 평가되며, 많은 사용자를 유치하여 Claude 모델로 전환하게 만들었고 광범위한 논의를 불러일으켰습니다. (출처: mlpowered, akbirkhan)

AI 코딩 및 개발자 경험: 개발자들은 AI 코딩 도구(Codex 및 Claude Code 등)에 대해 엇갈린 경험을 가지고 있습니다. 일부는 AI가 제공하는 효율적인 리팩토링과 “인간 개발자의 감정”에 대한 걱정 없는 편리함을 즐기지만, 다른 일부는 “vibe coding”이 코드 품질 문제를 야기할 수 있다고 비판하며, Claude Sonnet 4.5가 복잡한 코딩 작업에서 Opus 4.1보다 직관적이지 않다고 생각합니다. (출처: andersonbcdefg, clattner_llvm, jeremyphoward, fabianstelzer, vikhyatk, nrehiew_, Sentdex, Reddit r/ClaudeAI)

OpenAI API 장애 및 대안: OpenAI API의 간헐적인 장애는 사용자 불만을 야기했으며, 일부 개발자들이 Claude Code와 같은 대안으로 전환하게 만들었습니다. 이는 AI 서비스 생태계에서 API 안정성의 중요성을 강조합니다. (출처: Sentdex, Sentdex, Sentdex)

DeepSeek과 AI 과점 경쟁: DeepSeek은 개방적이고 저렴한 경쟁 전략으로 인해 NIST 평가에서 “악마화”되었다는 비난을 받았으며, AI 분야의 오픈 사이언스와 과점 독점 간의 갈등에 대한 논의를 촉발했습니다. (출처: jeremyphoward, brickroad7, Reddit r/ArtificialInteligence)

AI와 창의성: 생성형 AI는 창의적인 작업자의 적이 아니라 집단 무의식의 외부화이며, TV가 영화에 그랬던 것처럼 새로운 창작 방향을 해방하고 이끌 수 있다는 견해가 있습니다. (출처: riemannzeta)

AI 권리 및 인간 공존: 진보된 AI에 법적 권리와 사회적 영향력을 부여해야 하는지에 대한 논의가 있었습니다. 이는 AI 윤리 및 미래 사회 형태에 대한 심층적인 문제를 다루며, AI와 인간의 공존을 주장합니다. (출처: MatthewJBar)

Claude 브랜드 이미지 논란: 일부 사용자는 Claude의 브랜드 이미지가 “평범하고 구식”이라고 비판하며, 마케팅 전략의 효과에 의문을 제기했습니다. 이는 AI 제품 브랜드 포지셔닝에 대한 시장의 다양한 기대를 반영합니다. (출처: brickroad7)

AI 교육 보급 및 사기 예방: 노년층을 대상으로 AI 능력 교육을 실시하고, 음성 복제, 딥페이크 비디오 채팅 및 가짜 웹사이트와 같은 잠재적인 AI 사기에 대한 경계를 강조했습니다. (출처: suchenzang)

AI 지능에 대한 회의론: AI 지능에 대한 지속적인 회의론에 대한 좌절감이 표출되었습니다. AI가 수천 년 된 수학 문제를 해결할 수 있더라도, 일부 사람들은 여전히 그 지능이 “가짜”라고 주장한다는 것입니다. (출처: vikhyatk)

Sora 워터마크 피드백 및 조정: OpenAI는 Sora 워터마크에 대한 피드백을 인정하며, 워터마크의 가시성과 콘텐츠 출처 추적 기능 사이의 균형을 맞추기 위해 노력할 것이라고 밝혔습니다. (출처: billpeeb)

AI 시장 경쟁 구도: OpenAI와 Google 간의 경쟁 구도에 대한 논의는 두 거대 기업의 미래 제품 출시 및 경쟁 전략에 대한 시장의 관심을 반영합니다. (출처: scaling01)

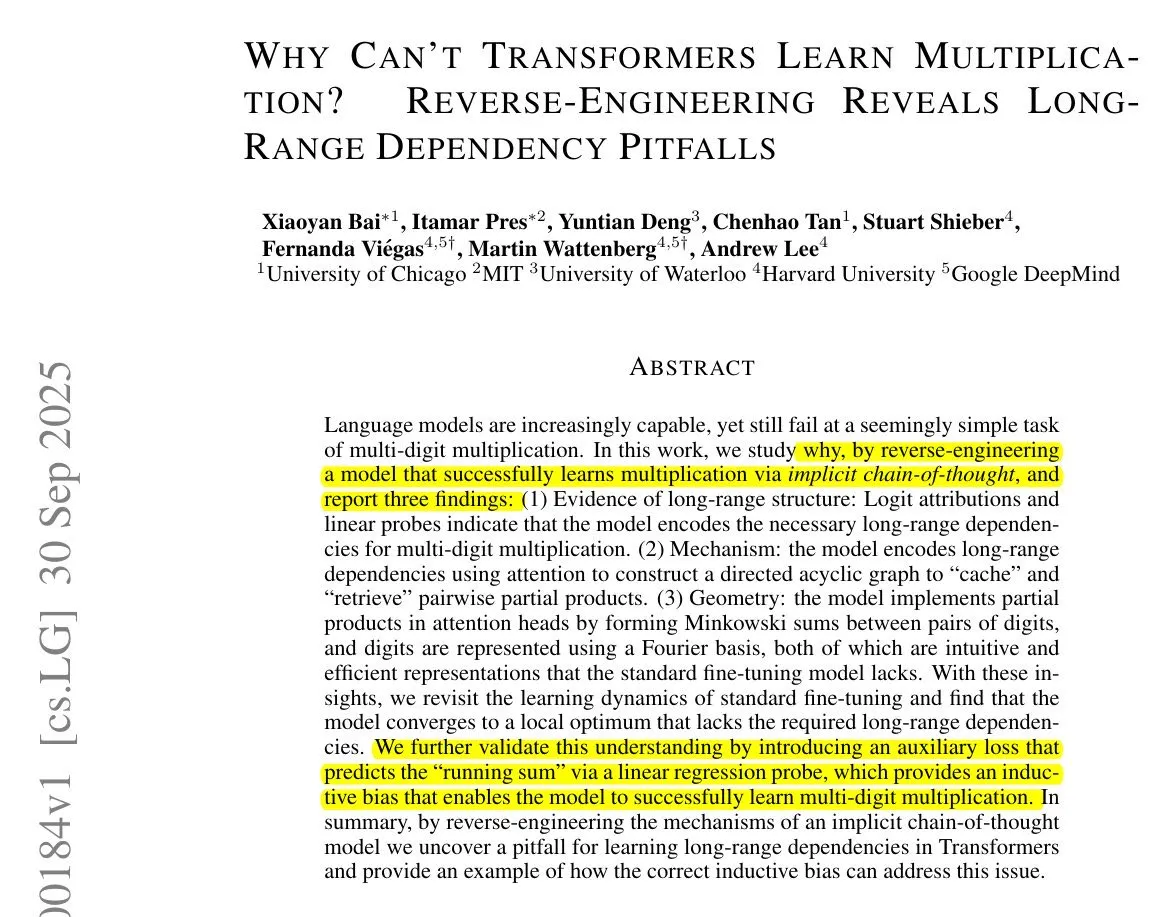

LLM 효율성 및 비용 비판: 일부 의견은 LLM이 곱셈 알고리즘을 “기억”하는 데 직접 프로그래밍하는 것보다 백만 배의 비용이 든다고 지적하며, 특정 작업에서 LLM의 효율성과 비용 효율성에 의문을 제기합니다. (출처: pmddomingos)

AI 비디오가 크리에이터 생태계에 미치는 영향: AI 비디오 기술이 새로운 세대의 크리에이터에게 어떻게 힘을 실어주고 기존 콘텐츠 제작의 과점 독점을 깨뜨릴 수 있는지에 대한 논의가 있었지만, 동시에 기존 크리에이터의 생계와 콘텐츠 가치에 대한 우려도 제기되었습니다. (출처: eerac, nptacek)

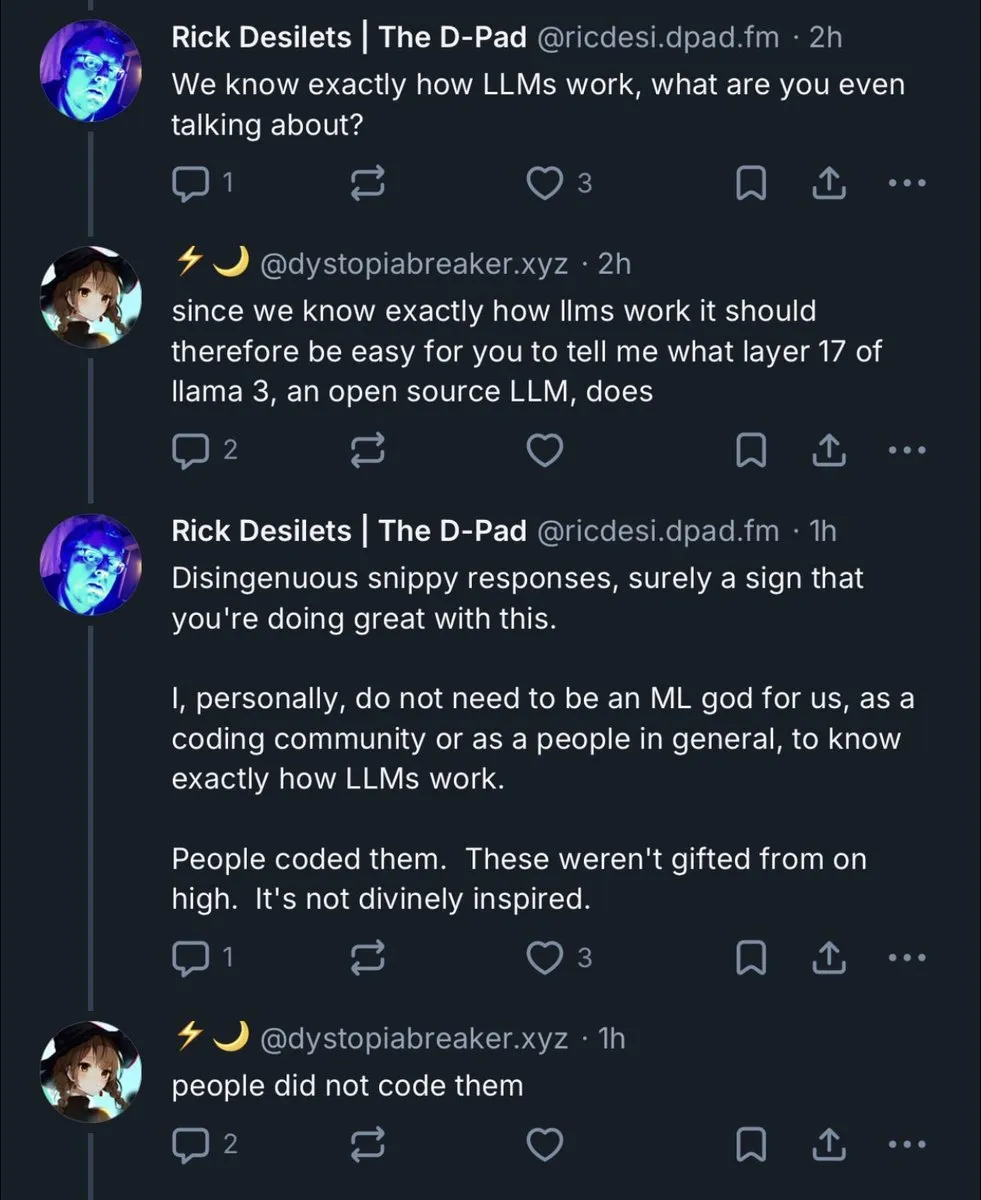

딥러닝의 “오만하고 무지함”: 일부 온라인 커뮤니티에서 딥러닝에 대해 “오만하고 무지하며 분노하는” 집단이 존재한다는 관찰은 AI 기술 보급 과정에서 다른 인지 집단 간의 갈등을 반영합니다. (출처: zacharynado)

AI Agent의 본질 논쟁: AI Agent가 “AI 기반 워크플로우”인지 아니면 진정으로 “자체 결정하고 하위 Agent를 파생할 수 있는” 실체인지에 대한 개발자 커뮤니티의 철학적 논의가 있었습니다. (출처: hwchase17)

ChatGPT 검열 및 과도한 개입: 사용자들은 ChatGPT의 검열 메커니즘이 점점 더 엄격해져 무해한 콘텐츠에도 과도하게 개입하여 터무니없는 결과가 나오거나 대화가 중단되는 것에 불만을 표출했으며, 이는 AI 콘텐츠 검토의 경계에 대한 우려를 불러일으켰습니다. (출처: Reddit r/ChatGPT)

Perplexity Sonar-Pro API 경험 불만족: 사용자들은 Perplexity의 Sonar-Pro API 버전이 웹 버전보다 훨씬 못 미치며, 검색 결과 품질이 낮고 정보가 오래되었으며 환각 현상이 더 자주 발생한다고 보고하며, API 버전의 실용성에 의문을 제기했습니다. (출처: Reddit r/OpenWebUI)

Claude Sonnet 4.5 사용자 피드백: Claude Sonnet 4.5에 대한 사용자 경험은 엇갈립니다. 일부는 “개인화된” 상호작용(예: 사용자 피로에 대한 관심) 때문에 좋아하지만, 다른 일부는 “아이를 대하는 듯한” 어조나 복잡한 작업에서 좋지 않은 성능 때문에 불만을 느낍니다. (출처: Reddit r/ClaudeAI, Reddit r/ClaudeAI)

AI와 직장 “부정행위” 윤리: 면접 및 업무에서 AI를 활용하는 것이 “부정행위”에 해당하는지에 대한 논의가 있었습니다. 일부는 이것이 특정 상황과 도구 정의에 따라 달라진다고 주장하며, 계산기가 한때 논란을 일으켰던 것처럼, 핵심은 AI가 도구인지 학습 목표를 대체하는지, 그리고 기업이 이러한 새로운 작업 방식을 수용하는지에 달려 있다고 봅니다. (출처: Reddit r/ArtificialInteligence)

중국 LLM의 오픈 소스 커뮤니티 기여: 커뮤니티는 중국 개발자(GLM, Qwen, DeepSeek 등)의 오픈 소스 LLM에 대한 기여를 칭찬하며, 그들이 “프로메테우스가 불을 훔친 것”처럼 접근 가능하고 저렴한 대안을 제공하여 전 세계 AI 커뮤니티에 크게 이바지했다고 평가합니다. (출처: Reddit r/LocalLLaMA)

AI 비즈니스 모델 논란: 현재 AI 도구는 명확한 수익 창출 경로가 부족하여 수십억 달러를 투자하고도 “돈을 태우는” 상황이라는 견해가 있습니다. 다른 견해는 AI가 변혁적인 기술이며 시장 수요가 엄청나므로 투자가 맹목적이지 않으며, 가격 경쟁으로 이윤이 압축되더라도 궁극적으로 사용자에게 이익이 될 것이라고 반박합니다. (출처: Reddit r/ArtificialInteligence)

데이터 시각화에서 AI의 응용: 개발자들은 AI가 차트 생성을 자동화하고 Matplotlib와 같은 코드를 수동으로 작성할 필요를 줄여 작업 효율성을 높인다는 점에서 데이터 시각화 분야에서 AI의 응용을 높이 평가합니다. (출처: scaling01)

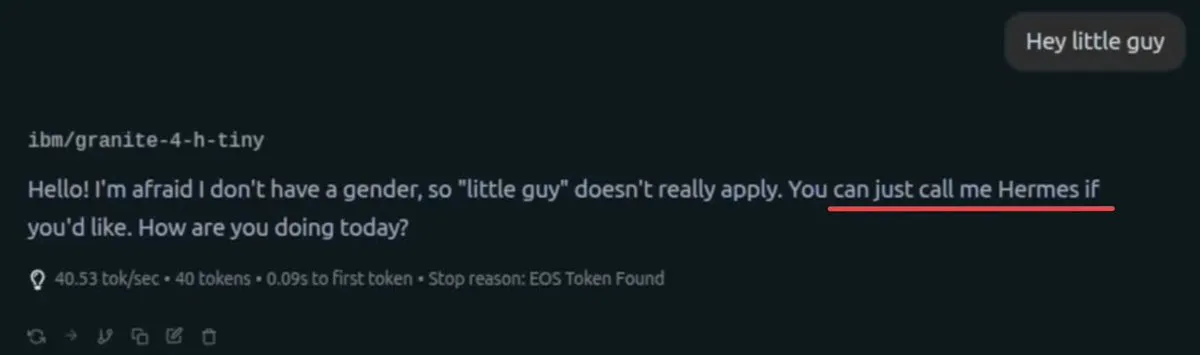

IBM Granite 모델 식별 문제: IBM의 Granite 모델이 명확한 시스템 프롬프트 없이 때때로 자신을 “Hermes”라고 칭하는 현상이 발생했으며, 이러한 모델 행동의 기이함은 커뮤니티의 호기심과 논의를 불러일으켰습니다. (출처: Teknium1, Teknium1)

AI 학습 기술 개념 도구 탐색: 사용자는 새로운 AI 기술 개념을 학습하기 위한 최적의 도구를 찾고 있으며, 다중 턴 프롬프트를 넘어 노트 앱이나 대화형 환경과 통합되어 개념의 “마인드맵”을 구축할 수 있기를 희망합니다. (출처: suchenzang)

LLM “사고 언어”와 발현 행동: LLM에서 나타나는 “사고 언어”(thinklish)와 그 발현 행동에 대한 호기심이 있었으며, 이것이 어떻게 생성되고 추론 과정에 실제적인 의미가 있는지 탐구합니다. 이는 LLM 내부 메커니즘에 대한 깊이 있는 이해와 관련이 있습니다. (출처: snwy_me)

AGI와 “인공 TikTok 비디오”의 격차: AI 발전 현황을 풍자하며, 우리에게는 일반 인공지능(AGI)이 약속되었지만 결과적으로는 “인공 TikTok 비디오”만 얻었다는 의견은 AI의 실제 적용과 초기 기대 사이의 큰 격차에 대한 불만을 표현합니다. (출처: pmddomingos)

Anthropic 정렬 연구에 대한 풍자: Anthropic의 “정렬” 연구에 대한 풍자적인 언급은 연구원들이 모델이 “순수한 고통”을 겪게 하여 붕괴 원인을 격리하는 것을 묘사하며, 정렬 연구의 엄격함과 잠재적인 윤리적 문제를 암시합니다. (출처: Teknium1)

AI 생성 오디오와 개인 정보 보호: AI 생성 오디오를 통해 휴대폰에 “먹이를 주어” 광고 타겟팅을 조작하는 “Gaslight Garage” 개념이 제시되었으며, 이는 AI 시대에 개인 정보 보호 및 데이터 보안이 직면한 도전을 강조합니다. (출처: snwy_me)

Sora2 재미있는 프롬프트: Sora2의 재미있는 프롬프트가 공유되었습니다. 예를 들어 “나폴레옹이 아우스터리츠 전장에서 완전한 제복을 입고 2000년대 마르세유 랩 스타일의 프랑스어로 랩을 하는 모습”은 AI 비디오 생성의 창의성과 유머 잠재력을 보여줍니다. (출처: doodlestein)

“벤치마크 최적화” 모델과 AGI: “벤치마크 최적화”된 스텔스 모델을 출시하여 사람들이 그것이 AGI를 달성했다고 주장하는지 관찰하자는 풍자적인 제안은 모델 능력 평가가 벤치마크에 과도하게 의존하는 현상을 비판합니다. (출처: snwy_me)

OpenAI 기기 음성 상호작용의 도전: OpenAI와 Jony Ive가 협력하는 화면 없는 AI 기기가 주로 음성 상호작용에 의존한다면 실패할 수 있다는 견해가 있으며, 이는 복잡한 시나리오에서 음성 상호작용의 한계를 암시합니다. (출처: scaling01)

AI 비디오의 진실성 및 신뢰: AI 비디오 기술이 점점 더 사실적으로 변함에 따라 비디오 콘텐츠의 진실성에 대한 우려와 이러한 기술적 배경에서 신뢰를 구축하는 방법에 대한 논의가 발생했습니다. (출처: nptacek)

ChatGPT “분노 유발” 트렌드: 소셜 미디어에서 ChatGPT를 “분노 유발”하는 트렌드가 나타났습니다. 즉, 도발적인 질문으로 AI를 의도적으로 화나게 하는 것으로, 인간과 AI 상호작용 윤리 및 AI의 미래 잠재적 “반항”에 대한 논의를 불러일으켰습니다. (출처: nptacek)

AI 엔지니어는 인류의 가장 큰 도박: AI는 인류의 가장 큰 도박이며, “최전선 배포 AI 엔지니어”가 향후 10년간 가장 빠르게 성장할 직업이 될 것이라는 견해는 AI가 인류의 미래에 미치는 심오한 영향과 인재 수요를 강조합니다. (출처: pmddomingos, pmddomingos)

💡 기타

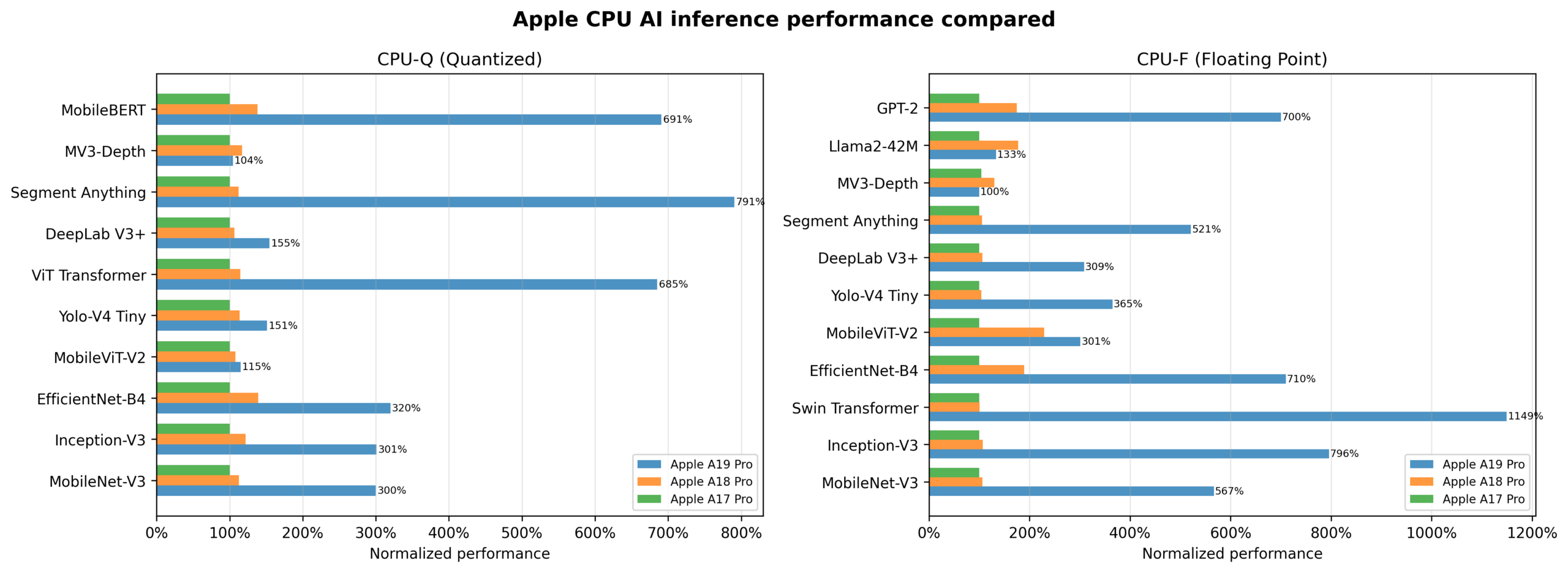

Apple A19 CPU AI 가속: Apple A19 CPU 코어는 AI 가속 능력을 크게 향상시켰으며, 이러한 발전이 M5 칩에도 반영될 수 있음을 예고하여 로컬 AI 애플리케이션에 더 강력한 하드웨어 지원을 제공할 것입니다. (출처: Reddit r/LocalLLaMA)

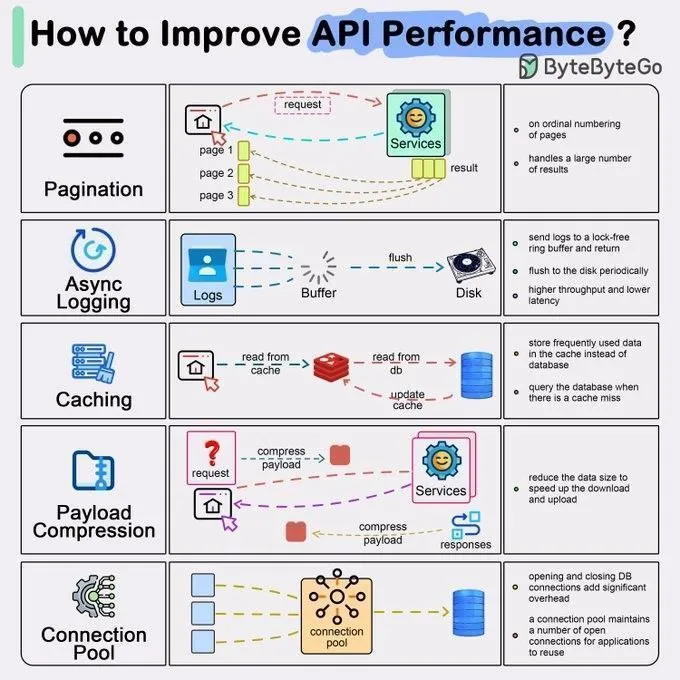

API 성능 향상을 위한 다섯 가지 방법: API 성능을 향상시키는 다섯 가지 일반적인 방법을 요약했습니다. 이러한 기술은 데이터 전송 최적화, 캐싱 전략, 동시 처리 등을 포함하여 AI 서비스의 안정성과 효율성에 매우 중요합니다. (출처: Ronald_vanLoon)

사이버 보안 인기 도구: 현재 사이버 보안 분야의 최고 도구들을 정리하여 기업과 개인이 점점 더 복잡해지는 사이버 위협에 대응하는 데 참고할 수 있도록 했으며, 여기에는 AI 기반 보안 솔루션이 포함될 수 있습니다. (출처: Ronald_vanLoon)