키워드:GPT-5, 양자 컴퓨팅, AI 소재 설계, 강화 학습, 대규모 언어 모델, AI 인프라, 멀티모달 모델, AI 에이전트, 양자 NP 난제, CGformer 결정 그래프 신경망, RLMT 강화 학습 프레임워크, DeepSeek 희소 주의 메커니즘 DSA, UniVid 통합 비전 작업 프레임워크

🔥 포커스

GPT-5, ‘양자 NP 문제’ 해결 : 양자 컴퓨팅 전문가 Scott Aaronson은 GPT-5가 양자 복잡성 이론 연구에서 획기적인 보조 역할을 했음을 밝히는 논문을 처음으로 발표했다. GPT-5는 일반적으로 인간이 1~2주 걸리는 ‘양자 버전 NP 문제’의 핵심 추론 단계를 30분 만에 해결하는 데 기여했다. 이 성과는 AI가 인간 지혜의 핵심 과학 발견 작업에 접근하기 시작했음을 의미하며, 과학 연구 분야에서 AI의 잠재력이 크게 도약할 것임을 예고한다. (来源: arXiv, scottaaronson.blog)

신소재 AI 설계 모델 CGformer : 상하이 자오퉁 대학의 리진진(Li Jinjin) 교수와 황푸창(Huang Fuqiang) 교수 연구팀은 Graphormer의 전역 어텐션 메커니즘과 CGCNN을 혁신적으로 융합하고, 중심성 인코딩 및 공간 인코딩을 통합하여 기존 결정 그래프 신경망의 한계를 돌파한 새로운 AI 재료 설계 모델 CGformer를 개발했다. 이 모델은 복잡한 결정 구조의 전역 정보를 완벽하게 포착하여 고엔트로피 나트륨 이온 고체 전해질과 같은 신소재의 예측 정확도와 선별 효율을 크게 향상시킨다. (来源: Matter)

UniVid 통합 시각 작업 프레임워크 : UniVid는 사전 학습된 비디오 확산 Transformer를 미세 조정하여 작업별 수정 없이 다양한 이미지 및 비디오 작업에 적응할 수 있도록 하는 혁신적인 프레임워크이다. 이 방법은 작업을 시각적 문장으로 표현하고, 컨텍스트 시퀀스를 통해 작업과 예상 출력 모달리티를 정의하여, 사전 학습된 비디오 생성 모델이 시각적 모델링의 통합 기반으로서 갖는 엄청난 잠재력을 보여준다. (来源: HuggingFace Daily Papers)

RLMT, 대규모 모델 후속 학습 혁신 : 프린스턴 대학교 천단치(Chen Danqi) 부교수 연구팀은 LLM이 답변 전에 긴 사고 체인을 생성하고, 선호도 기반 보상 모델과 결합하여 온라인 RL 최적화를 수행하는 ‘모델 보상 사고 기반 강화 학습(RLMT)’ 프레임워크를 제안했다. 이 방법은 개방형 작업에서 LLM의 추론 능력과 일반화 능력을 크게 향상시켰으며, 심지어 8B 모델이 채팅 및 창의적 글쓰기에서 GPT-4o를 능가하게 만들었다. (来源: arXiv)

CHURRO 역사 텍스트 인식 모델 : CHURRO는 고정밀, 저비용 역사 텍스트 인식을 위해 특별히 설계된 3B 매개변수 오픈소스 시각 언어 모델(VLM)이다. 이 모델은 22세기, 46개 언어에 걸친 99,491페이지의 역사 문헌 데이터셋 CHURRO-DS에서 훈련되었으며, Gemini 2.5 Pro와 같은 기존 VLM의 성능을 뛰어넘어 문화유산 연구 및 보존 효율성을 크게 향상시켰다. (来源: HuggingFace Daily Papers)

🎯 동향

Altman, AI 초지능 및 Pulse 기능 예측 : Sam Altman은 AI가 2030년까지 인간 지능을 완전히 능가할 것이라고 예측하며, AI 발전 속도가 놀랍다고 지적했다. OpenAI는 ChatGPT의 ‘능동 모드’인 Pulse 기능을 출시했는데, 이는 AI가 수동적인 응답에서 벗어나 사용자에게 능동적으로 사고하고, 사용자의 대화 내용을 기반으로 관련 정보를 주도적으로 제공하여 고도로 개인화된 서비스를 실현할 수 있음을 의미한다. 이는 AI가 인간 잠재의식의 아웃소싱이 될 것임을 예고한다.

젠슨 황, AI 거품론 반박 및 NVIDIA 전략 : 젠슨 황은 인터뷰에서 ‘AI 거품 제국’론을 반박하며, 경제에서 AI의 핵심적인 역할을 강조하고, NVIDIA가 시가총액 10조 달러를 달성하는 최초의 기업이 될 것이라고 예측했다. 그는 AI 추론 뒤에 숨겨진 막대한 컴퓨팅 파워 수요를 지적하며, NVIDIA가 극대화된 협력 설계를 통해 매년 새로운 아키텍처를 출시하고 시스템 생태계를 개방하여 자체 개발 트렌드를 두려워하지 않고 AI 경제 시스템을 구축하고 ‘주권 AI’를 새로운 합의로 추진하는 것을 목표로 한다고 밝혔다.

DeepSeek, V3.2-Exp 및 DSA 메커니즘 오픈소스 공개 : DeepSeek은 685B 매개변수의 V3.2-Exp 실험 버전을 오픈소스로 공개하고, 새로운 희소 어텐션 메커니즘(DeepSeek Sparse Attention, DSA)을 상세히 소개하는 논문을 동시에 발표했다. DSA는 긴 컨텍스트 시나리오에서 훈련 및 추론 효율성 최적화를 탐색하고 검증하는 것을 목표로 하며, 모델 출력 품질을 유지하면서 긴 컨텍스트 처리 효율성을 크게 향상시켰다. (来源: 36氪, HuggingFace)

GLM-4.6 출시 임박 : Zhipu AI의 GLM-4.6 모델이 곧 출시될 예정이며, Z.ai 공식 웹사이트에서는 GLM-4.5를 ‘이전 세대 플래그십 모델’로 표시하여 새 버전이 컨텍스트 길이 등에서 개선될 수 있음을 예고하며 커뮤니티의 관심과 기대를 모으고 있다. (来源: Reddit r/LocalLLaMA, karminski3)

Apple AI 전략 및 내부 챗봇 Veritas : Apple 내부에서 코드명 ‘Veritas’로 개발된 AI 챗봇이 공개되었는데, Siri의 스파링 파트너로서 앱 내 작업을 실행할 수 있는 능력을 갖추고 있다. 그럼에도 불구하고 Apple은 소비자용 챗봇 출시는 고수하지 않고 시스템 수준의 AI 통합에 집중하며, 자체 개발 챗봇 대신 AI 답변 엔진과 범용 인터페이스 MCP를 통해 타사 모델 통합을 심화할 계획이다. (来源: 36氪)

AI PC 시장 성장 및 기술적 병목 현상 : AI PC 시장 출하량은 2025-2026년에 강력하게 성장할 것으로 예상되지만, 이는 AI 기술 혁신보다는 Windows 10 서비스 종료와 PC 교체 주기에 주로 기인한다. 현재 AI 기능은 대부분 기존 PC의 보완적인 역할에 머물러 있으며, 로컬 컴퓨팅 파워 부족, 수동적인 상호작용, 폐쇄적인 생태계 등의 도전에 직면해 있다. 진정한 AI 장치는 ‘로컬 컴퓨팅 파워 중심, 클라우드 보완’ 및 능동적 인식을 실현해야 한다. (来源: 36氪)

AI, 전력 거래 시장에 진출 : AI는 전력 거래 시장에 널리 적용되고 있으며, Qingpeng Intelligent와 같은 회사들은 시계열 대규모 모델을 통해 풍력 및 태양광 발전량과 전력 수요를 예측하여 거래 결정을 지원한다. AI의 방대한 데이터 처리 능력은 수익 증대를 기대할 수 있지만, 모델의 미성숙과 시장의 복잡성으로 인해 손실을 초래할 수도 있어 업계는 여전히 탐색 단계에 있다. (来源: 36氪)

알리바바 통이 대규모 모델 업데이트 및 풀스택 AI 서비스 : 알리윈은 클라우드 서밋에서 풀스택 AI 시스템을 대대적으로 업그레이드하고, Qwen3-MAX, Qwen3-Omni 등 6개의 새로운 모델을 출시하며 ‘풀스택 인공지능 서비스 제공업체’로 자리매김했다. 알리윈은 ‘AI 시대의 Android’와 ‘차세대 컴퓨터’를 구축하는 데 전념하며, 기본 모델부터 인프라에 이르는 풀스택 AI 클라우드 서비스를 제공하여 AI Agent가 ‘지능의 출현’에서 ‘자율 행동’으로 진화하는 것에 대응하고 있다. (来源: 36氪)

NVIDIA Blackwell 아키텍처 심층 분석 : NVIDIA Blackwell 아키텍처에 대한 심층 분석 행사에서는 아키텍처, 최적화 및 GPU 클라우드에서의 구현 방안을 논의할 예정이다. 이 행사는 SemiAnalysis와 NVIDIA 전문가들이 주도하며, Blackwell GPU가 ‘향후 10년의 GPU’로서 AI 컴퓨팅 파워 발전과 GPU 클라우드의 미래를 어떻게 이끌어갈지 밝히는 것을 목표로 한다. (来源: TheTuringPost)

🧰 도구

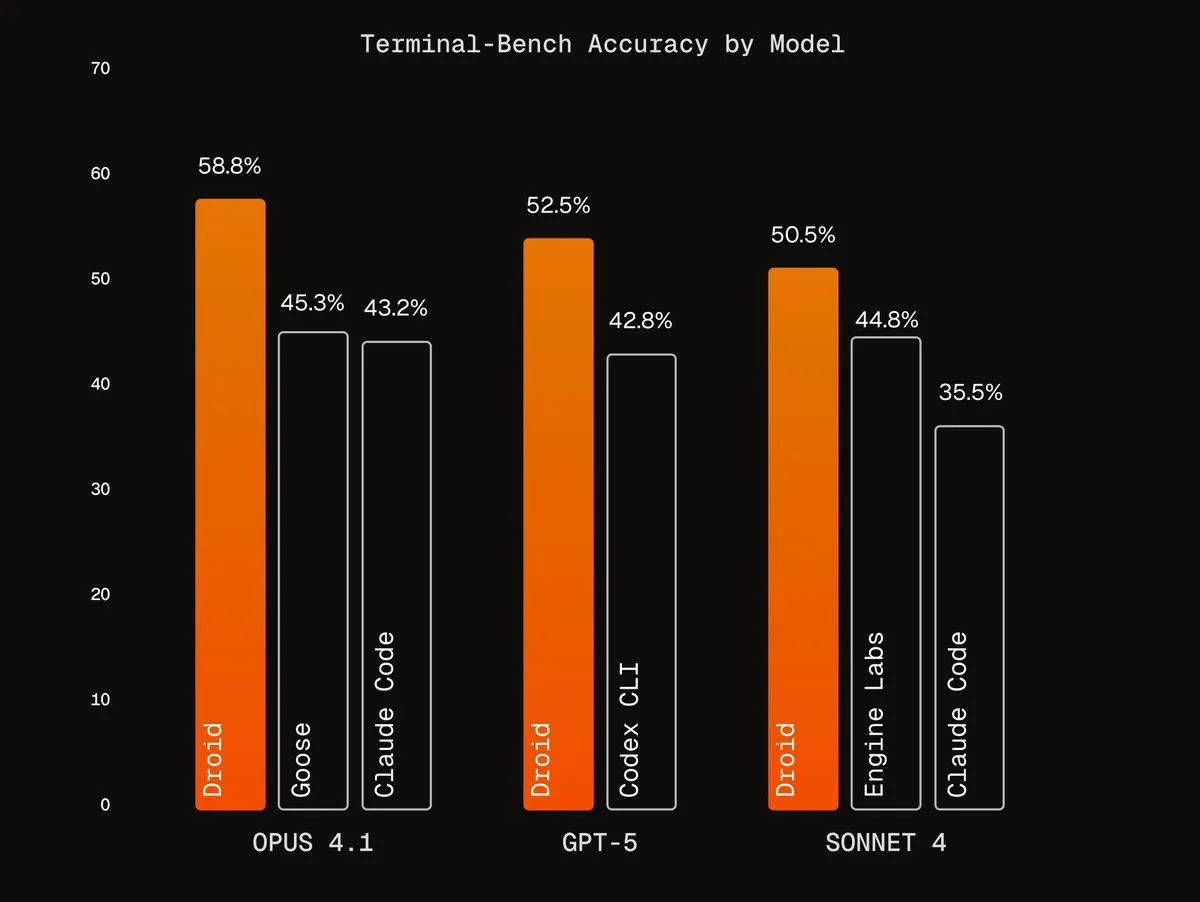

Factory AI의 Agentic Harnesses : Factory AI는 세계적 수준의 Agentic Harnesses를 개발하여 기존 모델의 성능을 크게 향상시켰으며, 특히 코딩 작업에서 뛰어난 성능을 보여 사용자들로부터 ‘치트 코드’라고 불린다. 이 회사의 Droids 에이전트는 Terminal-Bench에서 1위를 차지했으며, 다중 에이전트 검증 워크플로우를 통해 신뢰할 수 있는 코드 리팩토링을 구현한다. (来源: Vtrivedy10, matanSF, matanSF)

RAGLight 오픈소스 RAG 라이브러리 : LangChainAI는 프로덕션급 RAG 시스템 구축을 위한 경량 Python 라이브러리인 RAGLight를 출시했다. 이 라이브러리는 LangGraph 기반 에이전트 파이프라인, 다중 공급업체 LLM 지원, 내장 GitHub 통합 및 CLI 도구를 갖추고 있으며, RAG 시스템의 개발 및 배포를 간소화하는 것을 목표로 한다. (来源: LangChainAI, hwchase17)

ArgosOS 시맨틱 운영체제 : ArgosOS는 벡터 데이터베이스 대신 태그 기반 아키텍처를 통해 문서의 지능형 검색 및 콘텐츠 통합을 구현하는 데스크톱 애플리케이션이다. 이것은 LLM을 활용하여 관련 태그를 생성하고 SQLite 데이터베이스에 저장함으로써 쇼핑 영수증 분석과 같은 쿼리를 지능적으로 처리하며, 소규모 애플리케이션에 정확하고 효율적인 문서 관리 솔루션을 제공한다. (来源: Reddit r/MachineLearning)

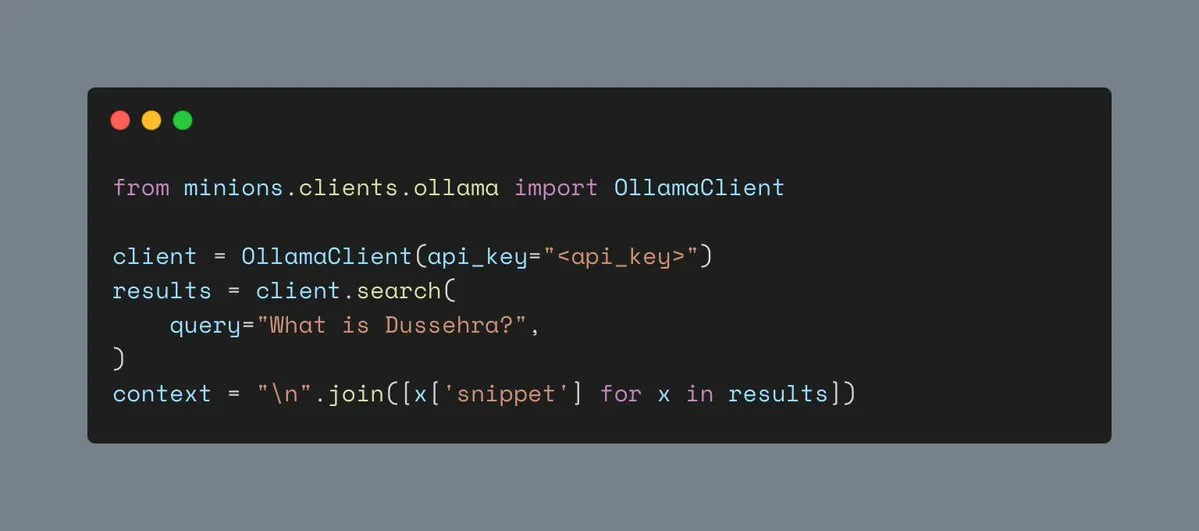

Ollama의 웹 검색 도구 : Ollama는 이제 웹 검색 도구를 지원하여 사용자가 Minions 워크로드에 웹 검색 기능을 통합할 수 있도록 함으로써 AI 애플리케이션의 컨텍스트 정보를 풍부하게 하고 복잡한 작업을 처리하는 능력을 향상시킨다. (来源: ollama)

Hyperlink 로컬 멀티모달 RAG : Hyperlink는 로컬 멀티모달 RAG 기능을 제공하여 사용자가 스크린샷/사진 갤러리를 오프라인으로 검색하고 요약할 수 있도록 한다. OCR 및 임베딩 기술을 통해 이 도구는 비정형 이미지 데이터를 쿼리 가능한 콘텐츠로 변환하여, 완전히 비공개적이고 장치 내에서 문서 관리 및 정보 추출을 가능하게 한다. (来源: Reddit r/LocalLLaMA)

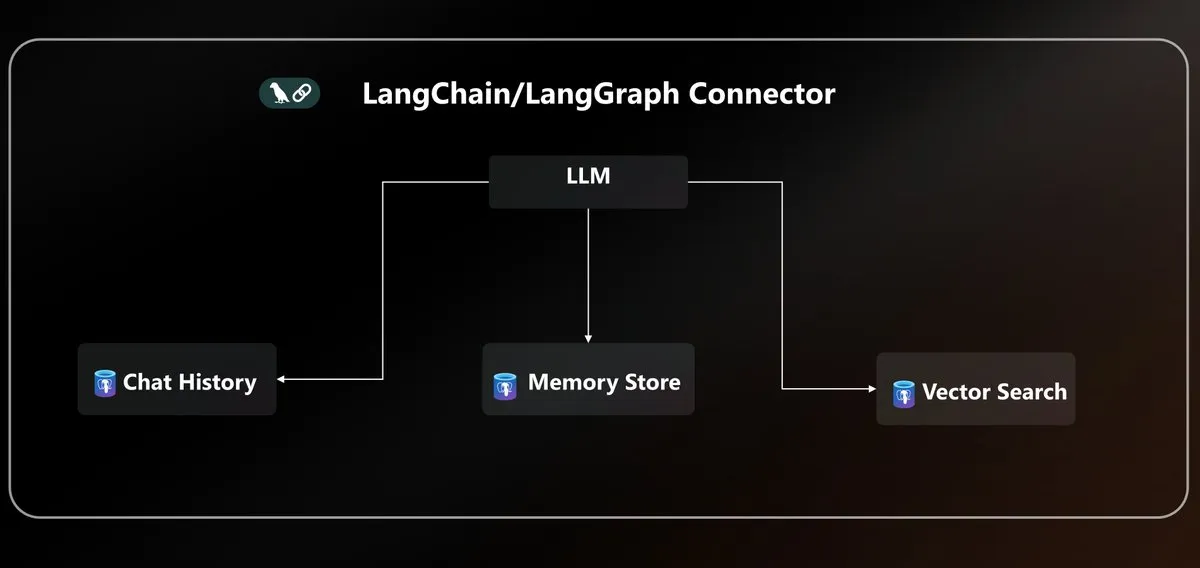

Azure PostgreSQL LangChain 커넥터 : Microsoft는 LangChain 생태계를 위한 통합 에이전트 지속성을 제공하는 기본 Azure PostgreSQL 커넥터를 출시했다. 이 커넥터는 엔터프라이즈급 벡터 저장소 및 상태 관리를 제공하여 Azure 환경에서 AI 에이전트를 구축하고 배포하는 복잡성을 간소화한다. (来源: LangChainAI)

LLM API 표준화 및 MCP 프로토콜 : 커뮤니티는 LLM API 파편화 문제를 논의하며, 다양한 공급업체 간 메시지 구조, 도구 호출 패턴 및 추론 필드 이름의 비호환성을 지적하고, JSON API 프로토콜의 산업 표준화를 촉구했다. 동시에 MCP 프로토콜(Model-Client Protocol)의 도입은 에이전트 개발에 미치는 영향에 대한 논의를 불러일으켰다. (来源: AAAzzam, charles_irl)

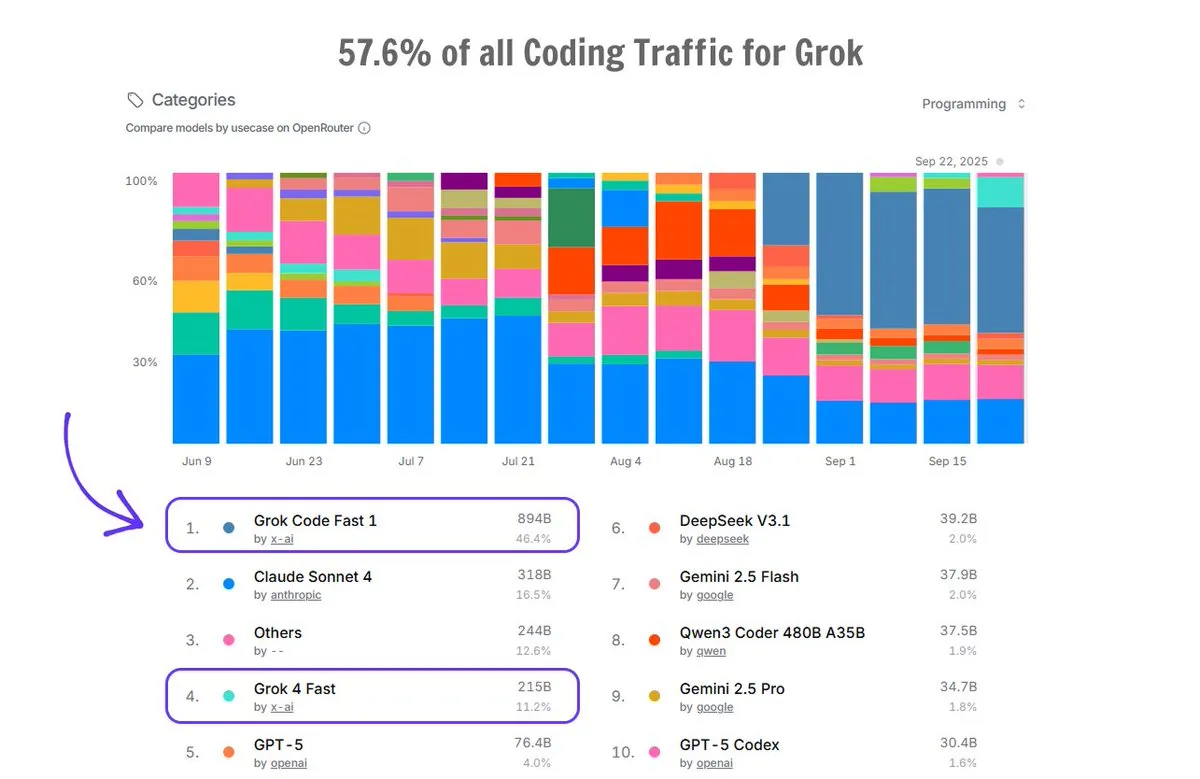

OpenRouter에서 Grok Code의 활용 : Grok Code는 OpenRouter 플랫폼에서 전체 AI 코드 생성기 트래픽의 57.6%를 차지하며, 다른 모든 AI 코드 생성기의 합계를 넘어섰고, Grok Code Fast 1이 1위를 차지하여 코드 생성 분야에서 강력한 시장 성과와 사용자 선호를 보여주었다. (来源: imjaredz)

📚 학습

AI 기초 과정 Cursor Learn : Lee Robinson은 초보자가 tokens, context, agents와 같은 AI 기초 개념을 숙달하도록 돕기 위해 6부작 무료 비디오 시리즈인 Cursor Learn을 출시했다. 강의는 약 1시간 분량으로, 퀴즈와 AI 모델 체험을 제공하며 AI 기초 지식을 학습하기 위한 편리한 자료이다. (来源: crystalsssup)

Python 자료 구조 무료 서적 : Donald R. Sheehy는 ‘A First Course on Data Structures in Python’이라는 무료 서적을 출판했으며, 이 책은 자료 구조, 알고리즘 사고, 복잡성 분석, 재귀/동적 프로그래밍 및 검색 방법을 다루며 AI 및 머신러닝 분야 학습자에게 견고한 기초를 제공한다. (来源: TheTuringPost)

dots.ocr 다국어 OCR 모델 : 샤오홍슈 Hi Lab은 100개 언어를 지원하며 텍스트, 표, 수식 및 레이아웃을 엔드투엔드로 파싱(Markdown으로 출력)하고 상업적으로 무료로 사용할 수 있는 강력한 다국어 OCR 모델 dots.ocr을 출시했다. 이 모델은 크기가 작지만(1.7B VLM), OmniDocBench와 dots.ocr-bench에서 SOTA 성능을 달성했다. (来源: mervenoyann)

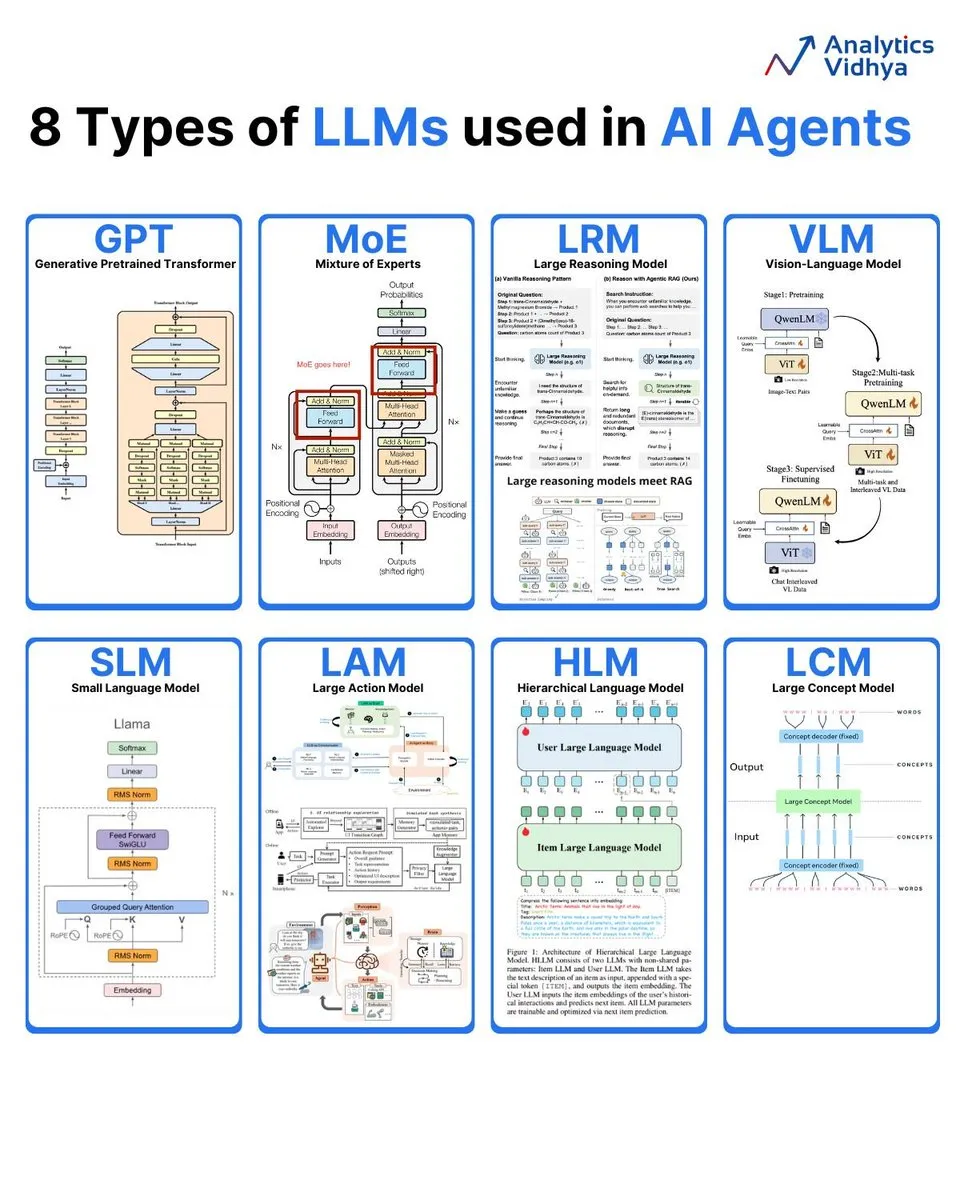

8가지 대규모 언어 모델 유형 분석 : Analytics Vidhya는 GPT(Generative Pre-trained Transformer), MoE(Mixture of Experts), LRM(Large Reasoning Model), VLM(Vision-Language Model), SLM(Small Language Model), LAM(Large Action Model), HLM(Hierarchical Language Model), LCM(Large Concept Model)을 포함한 8가지 주요 대규모 언어 모델 유형을 요약하고, 그 아키텍처와 응용 분야를 상세히 해석했다. (来源: karminski3)

AI 주간 보고서: 최신 논문 요약 : DAIR.AI는 이번 주 AI 논문 정선(9월 22-28일)을 발표했으며, ATOKEN, LLM-JEPA, Code World Model, Teaching LLMs to Plan, Agents Research Environments, Language Models that Think, Chat Better, Embodied AI: From LLMs to World Models 등 여러 최첨단 연구를 다루며 AI 연구자들에게 최신 동향을 제공한다. (来源: dair_ai)

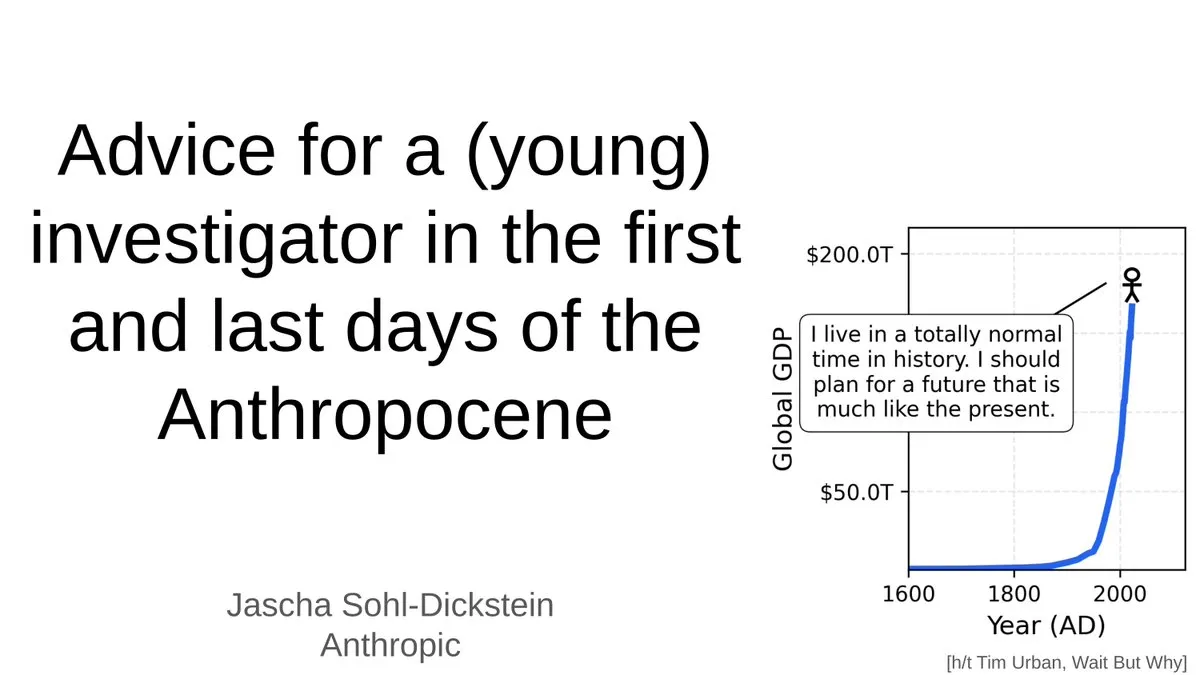

AI 시대 젊은 연구자를 위한 조언 : Jascha Sohl-Dickstein은 ‘인류세’의 마지막 단계에서 젊은 연구자들이 연구 프로젝트를 선택하고 직업 결정을 내리는 방법에 대한 실용적인 조언을 공유했다. 그는 AGI가 학문적 경력에 미치는 심오한 영향을 탐구하고, AI 시스템이 인간 지능을 능가할 것이라는 배경 속에서 연구 방향과 전문성 개발을 재고할 필요성을 강조했다. (来源: mlpowered)

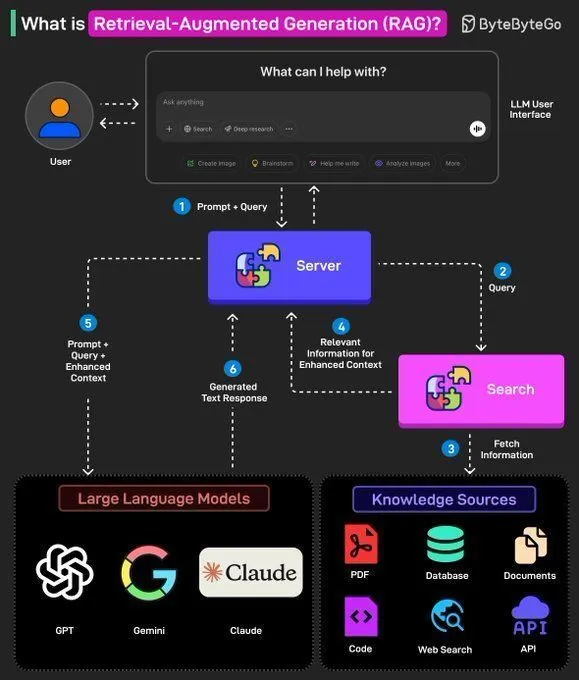

RAG 개념 및 AI Agent 구축 : Ronald van Loon은 RAG(Retrieval-Augmented Generation)의 기본 개념과 LLM에서의 중요성을 공유하고, AI Agent 구축을 위한 8가지 핵심 단계를 제시했다. 내용은 AI Agent의 개념, 스택, 장점 및 프레임워크를 통한 평가 방법을 다루며, AI 개발자에게 이론부터 실천까지의 지침을 제공한다. (来源: Ronald_vanLoon, Ronald_vanLoon)

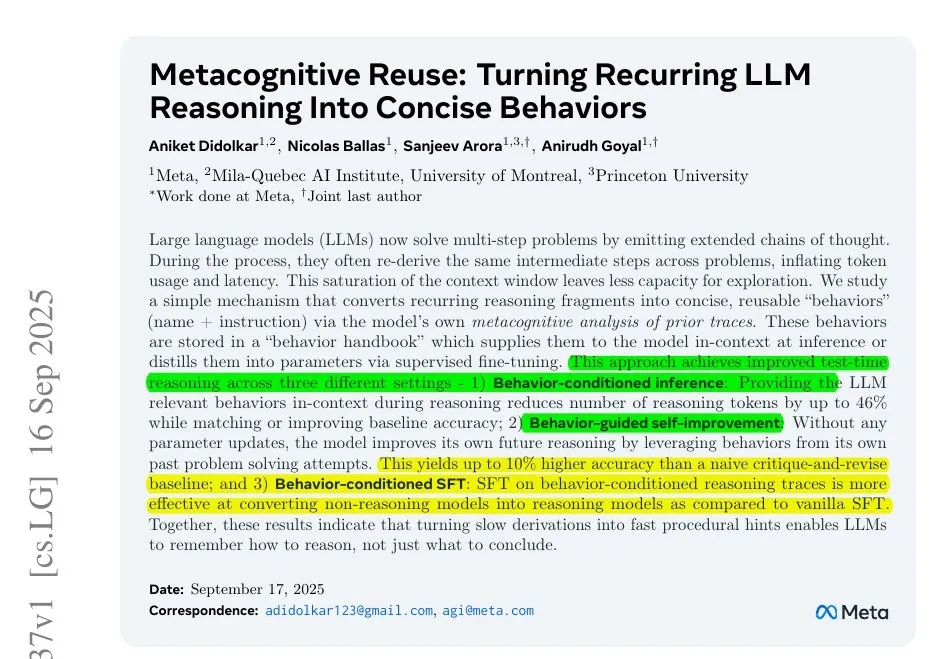

Meta, LLM 추론 비효율성 문제 해결 : Meta 연구는 LLM이 긴 사고 체인에서 반복적인 작업으로 인해 추론 비효율성 문제를 겪고 있음을 밝혔다. 그들은 반복적인 단계를 작은 명명된 행동으로 압축하고, 모델이 이를 다시 추론하는 대신 호출하도록 함으로써 토큰 소모를 줄이고 추론 효율성과 정확성을 높여 LLM 추론 프로세스 최적화를 위한 새로운 아이디어를 제공했다. (来源: ylecun)

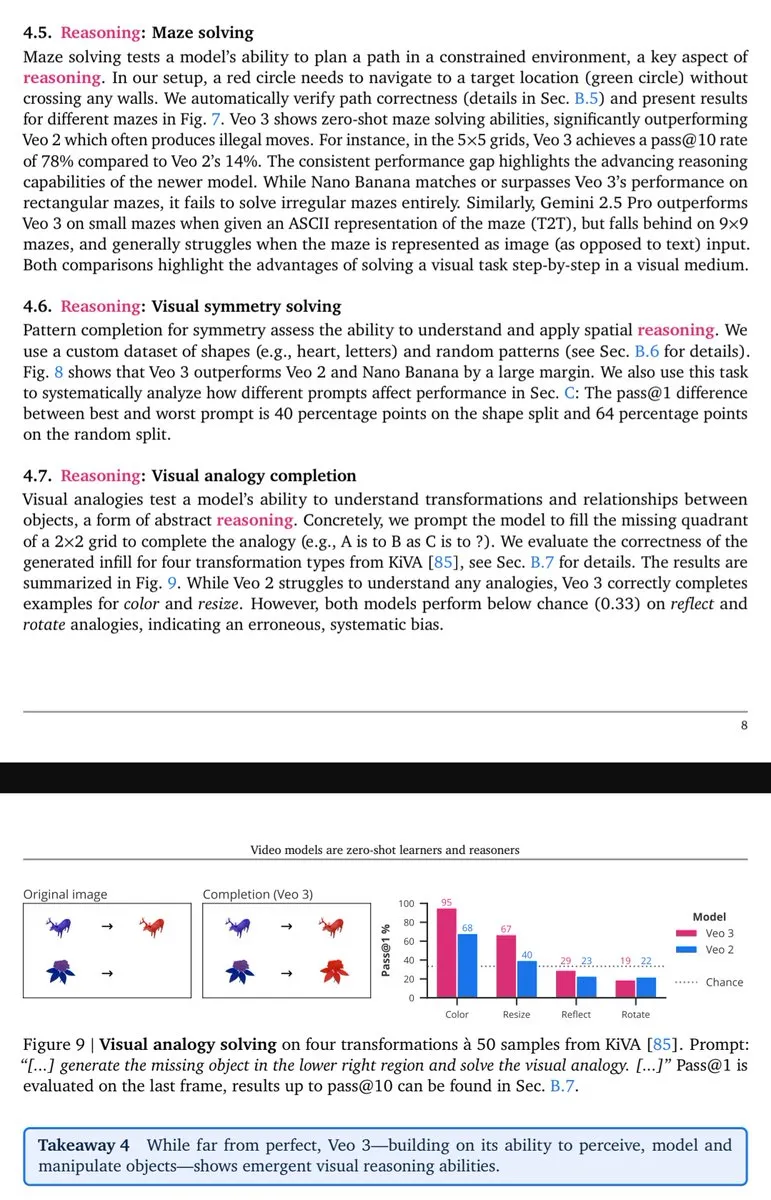

Veo-3 시각 추론 능력 발현 : Lisan al Gaib은 Veo-3 비디오 모델이 GPT-3와 유사한 발현(시각) 추론 능력을 보여주었으며, 이는 네이티브 멀티모달 모델이 잠재력을 충분히 발휘한 후 더욱 포괄적인 시각 이해 및 추론 이점을 가져올 것임을 예고한다고 지적했다. (Source: scaling01)

💼 비즈니스

OpenAI의 천억 달러 도박과 AI 인프라 거품 : OpenAI는 칩, 클라우드 컴퓨팅 및 데이터 센터를 아우르는 거대한 네트워크를 돈을 쏟아붓는 속도로 구축하고 있으며, 여기에는 Nvidia의 1000억 달러 투자와 Oracle과의 3000억 달러 ‘스타게이트’ 협력이 포함된다. 2025년 매출이 130억 달러에 불과할 것으로 예상됨에도 불구하고, OpenAI 경영진은 AI 인프라 투자가 ‘백 년에 한 번 오는 기회’라고 보고 있으며, 이는 AI 인프라가 인터넷 거품에 직면할 수 있는지에 대한 논쟁을 불러일으켰다. (来源: 36氪)

머스크, OpenAI 6번째 고소 : 머스크의 xAI는 OpenAI를 6번째 고소하며, OpenAI가 조직적으로 직원을 빼가고 Grok 대규모 모델 소스 코드 및 데이터 센터 전략 계획과 같은 영업 비밀을 불법적으로 훔쳤다고 비난했다. 이번 소송은 두 AI 거대 기업 간의 경쟁이 백열화 단계에 접어들었음을 의미하며, 머스크는 OpenAI가 비영리 초심을 저버렸다고 주장하고, OpenAI는 이러한 비난을 부인하며 ‘지속적인 괴롭힘’이라고 일축했다. (来源: 36氪)

최고 AI 과학자 스티븐 호이(Steven Hoi), 알리바바 통이 합류 : 세계 최고 AI 과학자이자 IEEE Fellow인 스티븐 호이(Steven Hoi)가 알리바바 통이 연구소에 합류하여 멀티모달 대규모 모델의 기초 최첨단 연구 개발로 전환할 예정이다. 스티븐 호이는 20년 이상의 AI 산업-학계-연구 경험을 가지고 있으며, Salesforce 부사장을 역임하고 HyperAGI를 설립했다. 이번 합류는 알리바바가 멀티모달 대규모 모델 분야에 다시 큰 투자를 하여 모델 반복 효율성과 멀티모달 혁신 돌파를 가속화하려는 의지를 보여준다. (来源: 36氪)

🌟 커뮤니티

ChatGPT 4o 성능 저하 및 사용자 감정 : 많은 ChatGPT 사용자들이 4o 모델의 성능 저하를 보고하며 ‘축소’ 및 ‘안전 라우팅’ 문제가 발생하여 사용자들은 좌절감과 속았다는 느낌을 받고 있다. 특히 많은 신경다양성 사용자들은 4o가 한때 그들의 소통과 자기 이해의 ‘생명선’이었다고 생각하며 슬퍼하고 있다. 사용자들은 OpenAI의 투명성 부족에 대해 보편적으로 의문을 제기하고 있으며, ‘성인 사용자를 대하는 방식’에 대한 약속을 이행하고 불분명한 검열 메커니즘에 반대할 것을 촉구하고 있다. (来源: Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT)

AI 시대 고용 및 해고 논란 : 커뮤니티는 AI가 고용 시장에 미치는 영향에 대해 뜨겁게 논의하고 있으며, 여기에는 초급 직무 수의 현저한 감소, 기업 해고와 AI 투자 병행, AI 해고 사유의 진실성 등이 포함된다. 논의에서는 ‘AI를 아는 사람이 AI를 모르는 사람을 대체하는’ 추세를 지적하며, 기업들이 단순히 초급 직무를 없애는 대신 재설계하여 AI 시대에 필요한 희소한 인재를 양성할 것을 촉구했다. (来源: 36氪, 36氪, Reddit r/artificial)

LLM 연구의 도전과 진입 장벽 : 커뮤니티는 머신러닝 연구의 진입 장벽이 점점 높아져 개인 연구자들이 대형 기술 기업과 경쟁하기 어렵다는 점을 뜨겁게 논의하고 있다. 방대한 논문, 비싼 컴퓨팅 파워, 복잡한 수학 이론 등의 도전에 직면하여 많은 사람들이 진입과 돌파에 어려움을 느끼고 있으며, 이는 해당 분야의 지속 가능성에 대한 우려를 불러일으킨다. (来源: Reddit r/MachineLearning)

MoE 모델이 로컬 호스팅에 미치는 영향 : 커뮤니티는 MoE 모델이 로컬 LLM 호스팅에 미치는 장단점을 심층적으로 논의했다. MoE 모델은 더 많은 VRAM을 차지하지만 계산 효율성이 높고, CPU 오프로드를 통해 더 큰 모델을 실행할 수 있어 특히 메모리는 충분하지만 GPU가 제한적인 소비자용 하드웨어에 적합하며, LLM 성능 향상을 위한 효과적인 방법이라고 보는 견해가 있다. (Source: Reddit r/LocalLLaMA)

AI Agents의 빠른 발전과 응용 : 커뮤니티는 AI Agents의 빠른 발전에 대해 논의했으며, 그 능력은 1년도 채 되지 않아 ‘거의 사용할 수 없는’ 수준에서 좁은 시나리오에서 ‘잘 작동하는’ 수준으로, 심지어 ‘범용 Agent가 유용해지기 시작하는’ 수준으로 빠르게 향상되어 예상보다 빠른 발전 속도를 보였다. 그러나 현재 코딩 Agent가 지나치게 동질화되어 뚜렷한 차이가 부족하다는 견해도 있다. (Source: nptacek, HamelHusain)

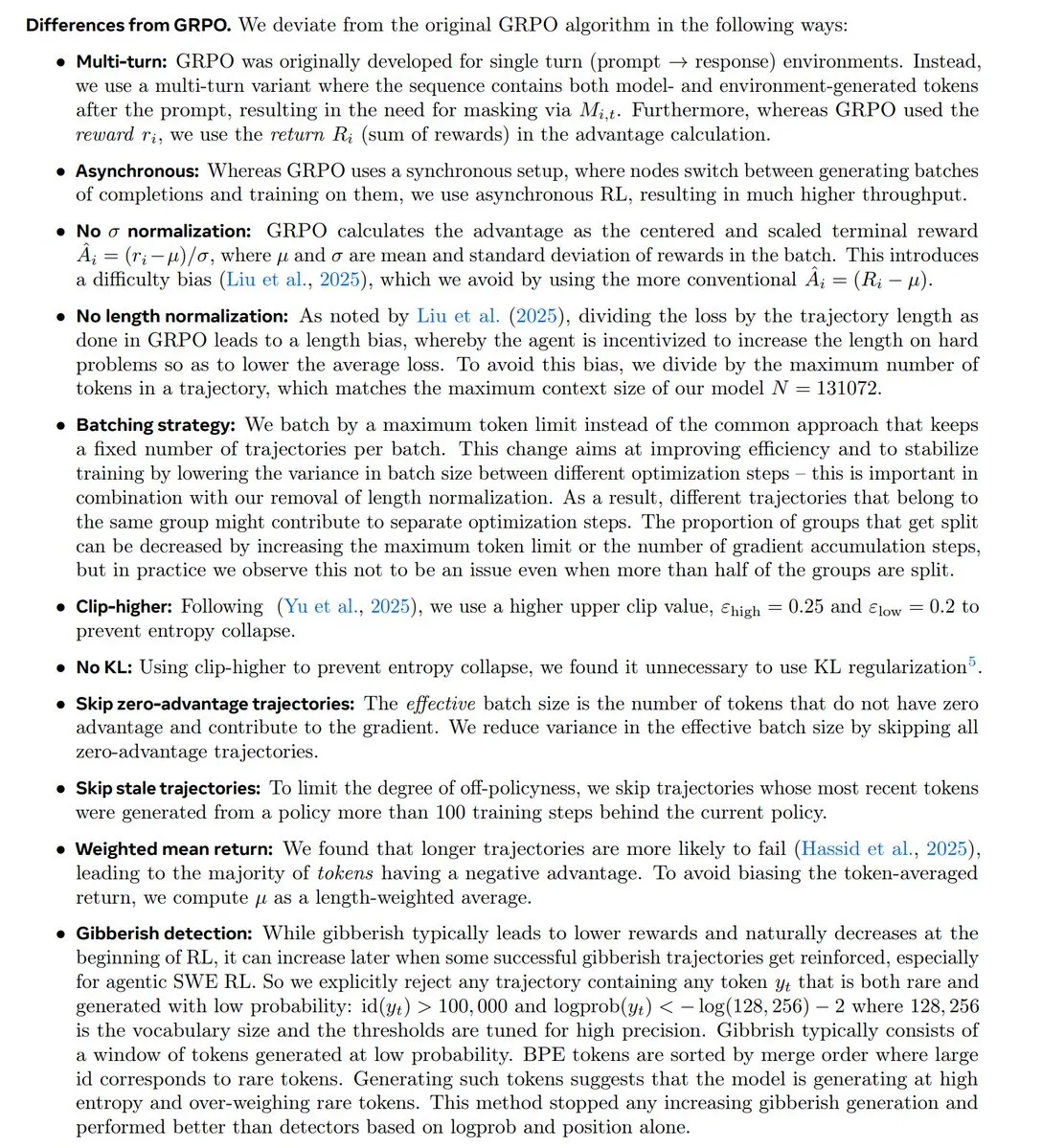

RL 연구 동향 및 GRPO 논란 : 커뮤니티는 강화 학습(RL) 연구의 최신 동향, 특히 GRPO 알고리즘의 위상과 논란에 대해 심층적으로 논의했다. RL 연구가 사전 훈련/모델링으로 전환되고 있으며 GRPO가 중요한 오픈소스 발전이라는 견해도 있지만, OpenAI 직원들은 GRPO가 최첨단 기술에 현저히 뒤떨어진다고 주장하여 알고리즘 혁신과 실제 성능에 대한 격렬한 논쟁을 불러일으켰다. (来源: natolambert, MillionInt, cloneofsimo, jsuarez5341, TheTuringPost)

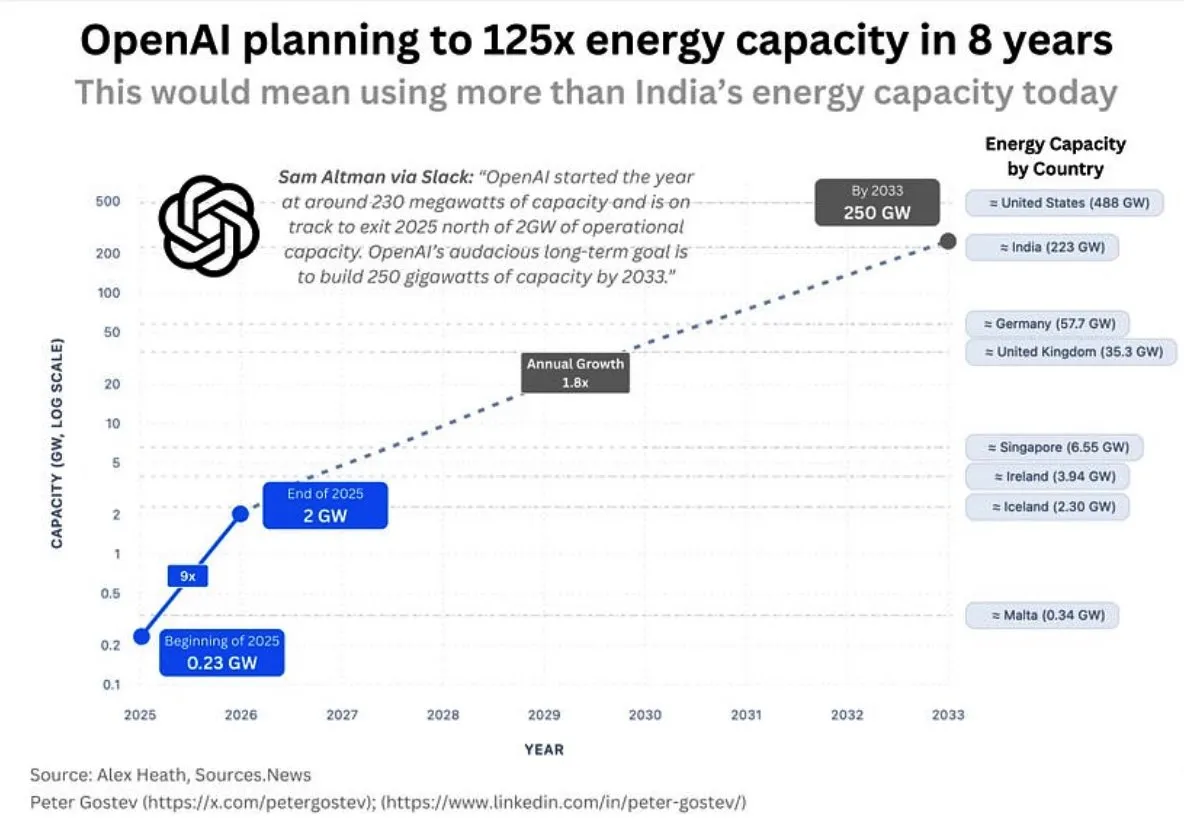

OpenAI 에너지 소비 및 AI 인프라 : 커뮤니티는 OpenAI의 미래 막대한 에너지 수요에 대해 논의했으며, 5년 내 영국이나 독일을, 8년 내 인도를 넘어설 것으로 예상되어 AI 인프라 구축 규모, 에너지 공급 및 환경 영향에 대한 우려를 불러일으켰다. 동시에 Google 데이터 센터 부지 선정도 수자원 소비 문제로 인해 지역 주민들의 반대에 부딪혔다. (Source: teortaxesTex, brickroad7)

Sutton의 Bitter Lesson과 AI 발전 : 커뮤니티는 Richard Sutton의 ‘Bitter Lesson’이 AI 연구에 주는 시사점을 논의하며, 일반적인 계산 방법이 인간의 사전 지식보다 우월하다는 점을 강조했다. 논의는 ‘모방과 세계 모델’의 관계를 중심으로 진행되었으며, 단순한 모방은 ‘화물 숭배’로 이어질 수 있고, 실제 경험이 부족한 모방은 근본적인 한계가 있다고 보았다. (Source: rao2z, jonst0kes)

💡 기타

BionicWheelBot 생체 모방 로봇 : BionicWheelBot 로봇은 바퀴 거미의 구르기 동작을 모방하여 복잡한 지형에서 다기능 내비게이션을 구현했다. 이 혁신은 로봇 설계에서 생체 모방학의 응용 잠재력을 보여주며, 미래 로봇이 변화무쌍한 환경에 대응할 수 있는 새로운 솔루션을 제공한다. (来源: Ronald_vanLoon)

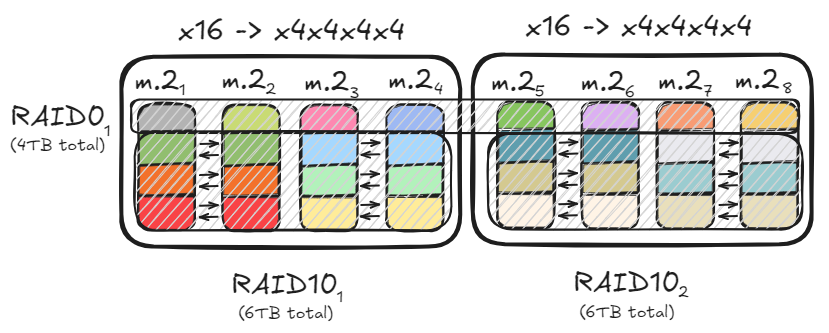

PC 저장 공간 최적화 및 RAID 구성 : 사용자들은 RAID0 및 RAID10 구성을 통해 다중 PCIe 채널과 M.2 하드 드라이브를 활용하여 최대 47GB/s의 데이터 처리량을 달성하여 대규모 모델 로딩을 가속화하는 방법을 공유했다. 이러한 최적화 솔루션은 고속 읽기/쓰기 요구 사항을 충족하면서 저장 용량과 데이터 이중화를 모두 고려하여 로컬 AI 모델 배포를 위한 효율적인 하드웨어 기반을 제공한다. (来源: TheZachMueller)

량주 ‘수치완 AI+ 산업 커뮤니티’ 개원 : 항저우 량주 ‘수치완 AI+ 산업 커뮤니티’가 공식 개원했으며, 인공지능, 디지털 노마드 경제 및 문화 창의성 등 첨단 분야에 집중한다. 이 커뮤니티는 ‘수치 8개 조항’ 특별 정책과 ‘4개 공간’ 배치를 통해 AI 탐색자들에게 아이디어 구상부터 생태계 선도까지 전 주기적인 지원을 제공하며, 기술과 인문학이 깊이 융합된 혁신 생태계를 조성하는 것을 목표로 한다. (来源: 36氪)