키워드:AI 재료 과학, 스타게이트 데이터 센터, NVIDIA-OpenAI 협력, Qwen3-Max, 구현형 인공지능, 개인정보 보호 AI, TTD-DR 에이전트, MIT SCIgen 생성 모델, 오라클 소프트뱅크 AI 인프라, 알리클라우드 NVIDIA 물리 AI, 앤트 디지털테크 동형 암호 조회 테이블, Google 확산 심층 연구원

🔥 포커스

MIT SCIGEN: AI 기반 재료 과학 혁신 : MIT의 SCIGEN 도구는 생성 모델과 물리적 제약을 결합하여 새로운 안정적인 재료를 처음부터 발명할 수 있게 하며, 연구 개발 주기를 수십 년에서 며칠로 단축합니다. 이 기술은 촉매 또는 합금과 같은 재료 발견 과정을 완전히 변화시킬 것으로 기대되며, AI가 과학 분석에서 능동적인 과학 ‘창조’로 나아가는 전환점을 의미하며, 에너지, 의학 및 컴퓨팅 분야에서 잠재적인 혁명적 응용을 예고합니다. (출처: Reddit r/ArtificialInteligence)

OpenAI, Oracle, SoftBank, Stargate 데이터센터 확장 : OpenAI, Oracle, SoftBank는 ‘Stargate’ 프로젝트 확장을 위해 협력하여 5개의 새로운 AI 데이터센터를 추가합니다. 최대 5,000억 달러에 달할 수 있는 이 막대한 인프라 투자는 미래의 고급 AI 모델에 대한 컴퓨팅 파워의 엄청난 수요를 충족시키는 것을 목표로 합니다. 이는 AI 인프라 구축의 전략적 중요성과 차세대 AI 역량 실현에 필요한 막대한 자본 투자를 강조합니다. (출처: Reddit r/ArtificialInteligence)

NVIDIA와 OpenAI의 1000억 달러 협력, UN은 AI 레드라인 촉구 : NVIDIA의 OpenAI에 대한 1000억 달러 투자는 유엔 총회가 글로벌 AI 안전 규칙 제정을 촉구하는 행동과 극명한 대조를 이룹니다. 이는 AI 발전의 이중적 추세를 반영합니다. 한편으로는 자본이 주도하는 기술 가속화, 다른 한편으로는 잠재적 위험에 대한 우려가 커지고 있습니다. 이 사건은 AI 역량을 추구하는 동시에 책임감 있고 안전한 배포를 보장하는 것의 시급성을 강조합니다. (출처: Reddit r/ArtificialInteligence)

Alibaba Cloud Qwen3-Max 수학 벤치마크 만점 획득, 전 제품군 모델 업데이트 : Alibaba의 Qwen3-Max 대규모 언어 모델이 AIME25 및 HMMT 수학 벤치마크 테스트에서 만점을 획득하며, 이러한 성과를 달성한 최초의 중국산 모델이 되었습니다. 이번 전면 업데이트에는 Qwen3-VL (비전), Qwen3-Omni (멀티모달), Qwen3-Coder (코드) 등의 모델도 포함되어 있으며, 이는 AI 분야에서 Alibaba의 공격적인 ‘풀 스택’ 전략과 빠른 반복 능력을 보여줍니다. (출처: 量子位)

Alibaba CEO Eddie Wu: AGI는 시작점일 뿐, ASI가 궁극적인 목표 : Alibaba CEO Eddie Wu는 Apsara Conference에서 범용 인공지능(AGI)은 시작점일 뿐이며, 초지능 인공지능(ASI)이 궁극적인 목표라고 밝혔습니다. 그는 AI 발전의 세 가지 단계인 지능 발현, 자율 행동, 자기 반복을 설명하며, AI가 차세대 운영 체제가 될 것이고 ‘슈퍼 AI 클라우드’가 차세대 컴퓨터가 될 것이라고 강조했습니다. 이 비전은 AI 분야에서 Alibaba의 공격적이고 장기적인 전략적 배치를 보여줍니다. (출처: 36氪)

🎯 동향

Kuaishou Keling 2.5 Turbo 비디오 모델: 비용 30% 절감, 체조 동작 생성 효과 비약적 발전 : Kuaishou Keling 2.5 Turbo 비디오 생성 모델은 성능을 크게 향상시켰으며, 특히 체조와 같은 복잡한 인체 동작을 처리할 때 ‘고스트 현상’을 제거하고 생성 비용을 약 30% 절감했습니다. 새로운 모델은 텍스트 응답, 동적 효과 및 미학적 품질 면에서 모두 향상되어 AI 비디오 시장에서 강력한 경쟁력을 보여줍니다. (출처: 量子位)

Alibaba Cloud와 NVIDIA, Embodied AI 애플리케이션 상용화 추진 협력 : Alibaba Cloud의 인공지능 플랫폼 PAI는 NVIDIA의 Physical AI 소프트웨어 스택(Isaac Sim, Isaac Lab, Cosmos 포함)을 통합하여 Embodied AI 및 자율 주행 애플리케이션에 데이터 전처리, 시뮬레이션 데이터 생성, 모델 훈련 평가, 로봇 강화 학습 및 시뮬레이션 테스트 등 전체 링크 플랫폼 서비스를 제공하며, Physical AI 애플리케이션의 개발 주기를 단축하는 것을 목표로 합니다. (출처: 量子位)

Ant Digital Technologies, 프라이버시 보호 AI 신규 알고리즘 발표, 추론 효율 100배 향상 : Ant Digital Technologies는 혁신적인 프라이버시 보호 AI 알고리즘을 출시했습니다. 여기에는 안전한 양자 GBDT 훈련을 위한 Gibbon 프레임워크(속도 2-4배 향상)와 동형 조회 테이블 기반의 의사결정 그래프 추론 기술(효율 100-1000배 향상)이 포함됩니다. 이러한 획기적인 발전은 기관 간 공동 모델링에서 ‘보안과 효율성’이라는 딜레마를 해결하고, 고성능이면서 프라이버시를 준수하는 데이터 협업을 실현했습니다. (출처: 量子位)

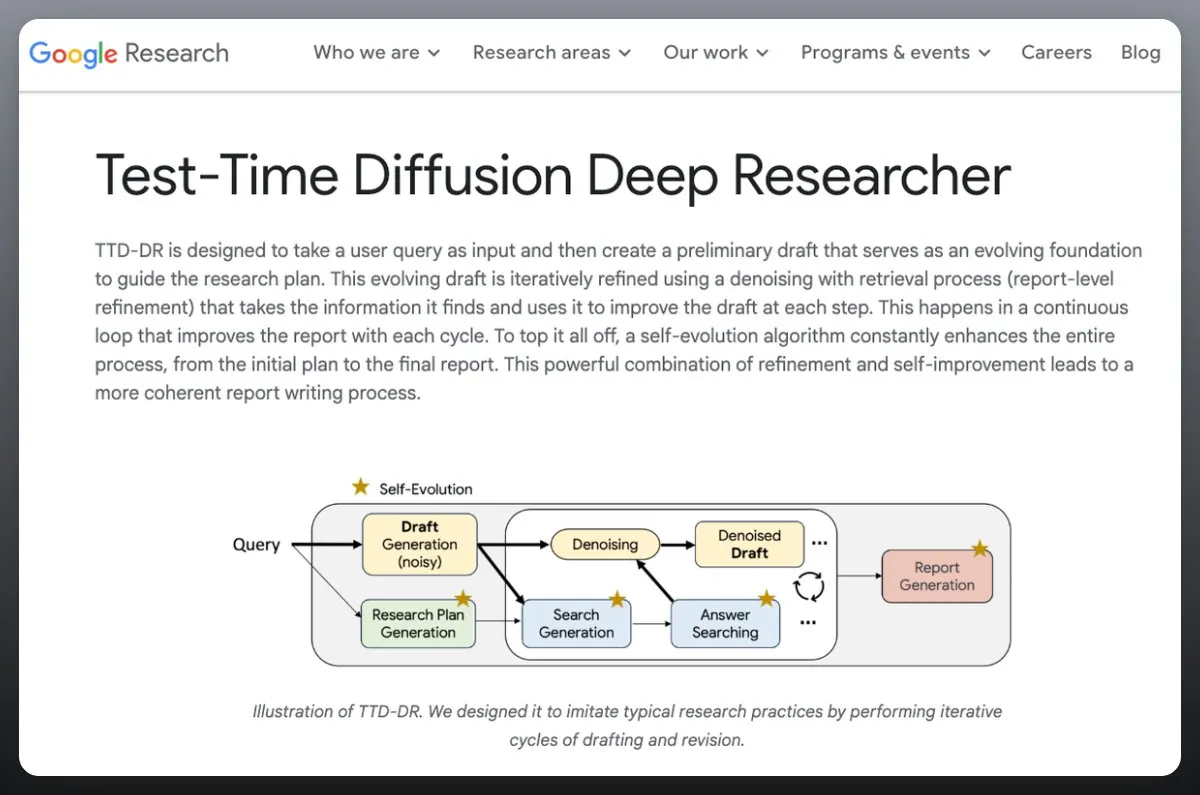

Google, ‘Test-Time Diffusion Deep Researcher (TTD-DR)’ AI 에이전트 출시 : Google은 연구 작성을 확산 과정으로 모델링하는 심층 연구 에이전트인 TTD-DR을 출시했습니다. 이는 반복적인 검색과 자기 진화를 통해 보고서를 작성하고 개선하며, 인간의 연구 방식을 모방합니다. TTD-DR은 장문 작업 및 다단계 추론에서 OpenAI의 Deep Research를 능가하며, 고품질 연구 자동화를 위한 확장 가능한 방법을 보여줍니다. (출처: omarsar0)

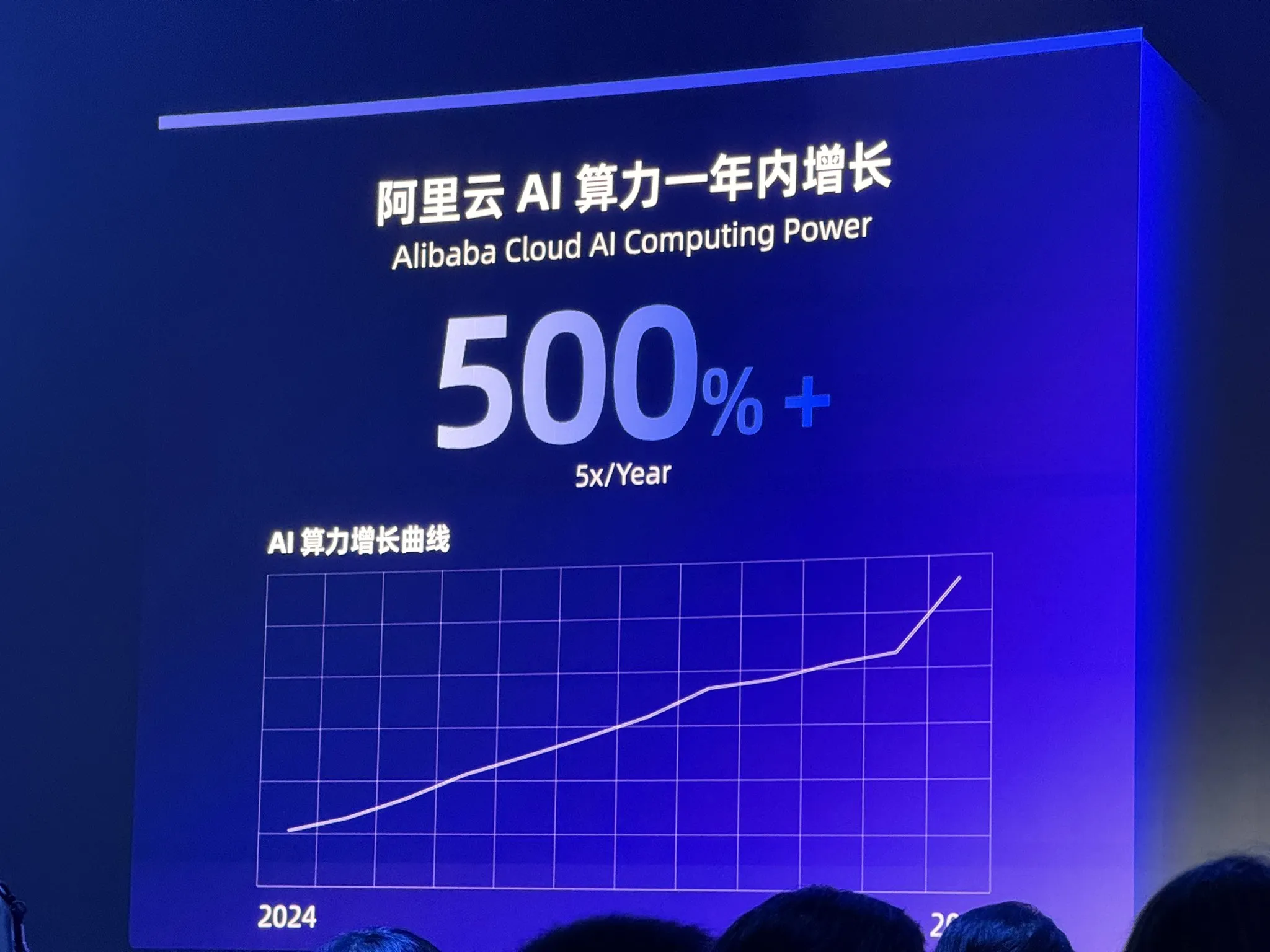

Alibaba Cloud AI 인프라, 컴퓨팅 파워 5배 성장 달성 : Alibaba Cloud는 AI 컴퓨팅 능력이 전년 대비 5배, 스토리지 능력이 4배 증가했다고 보고했습니다. 현재 중국 대규모 기반 모델 기업의 절반 이상과 Fortune 500대 기업이 GenAI 플랫폼에서 운영되고 있습니다. 이러한 빠른 확장은 AI 인프라 분야에서 Alibaba Cloud의 선도적 위치와 AI 발전을 추진하려는 확고한 의지를 강조합니다. (출처: scaling01)

Google Photos 안드로이드 버전, AI 대화 편집 기능 추가 : Google Photos 안드로이드 버전 사용자는 이제 AI와 대화하거나 텍스트 명령을 보내 사진을 편집할 수 있습니다. 이 기능은 고급 생성형 AI 기능을 널리 사용되는 소비자 앱에 직접 통합하여 사진 처리 과정을 간소화하고 사용자 경험의 편리성을 향상시킵니다. (출처: Reddit r/ArtificialInteligence)

MiniModel-200M-Base: 효율적인 소형 LLM의 이정표 : MiniModel-200M-Base는 200M 파라미터 LLM으로, 단 하루 만에 단일 RTX 5090에서 10B tokens 데이터로 처음부터 훈련을 완료했습니다. 이 모델은 adaptive optimizer, Float8 사전 훈련 및 bin-packing과 같은 기술을 사용하여 매우 높은 훈련 효율성을 달성했으며, 소형 모델에서 놀라운 능력을 보여주며 로컬 AI 실험을 위한 견고한 기반을 제공합니다. (출처: Reddit r/LocalLLaMA)