키워드:AlphaEvolve, AI 알고리즘 설계, 멀티모달 AI, AI 프로그래밍 도구, 자율 진화 알고리즘, 대형 언어 모델, AI 에이전트, AlphaEvolve 오픈소스 구현, AI 자동 행렬 곱셈 알고리즘 설계, 멀티모달 AI 통합 인터페이스, AI 프로그래밍 도구가 개발자에 미치는 영향, 로컬 대형 모델 Qwen 3 성능

🔥 포커스

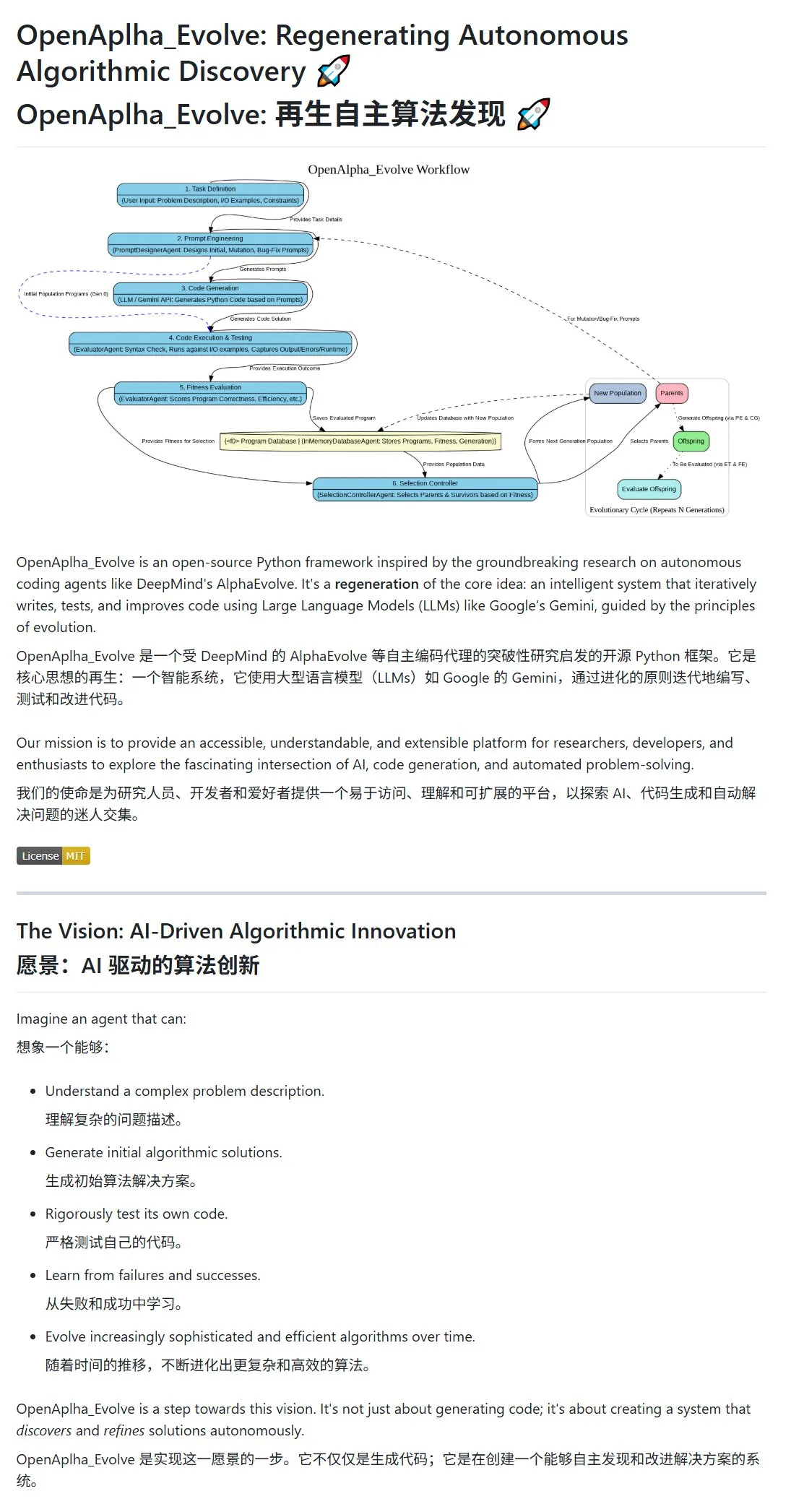

Google DeepMind, AI가 자체적으로 알고리즘을 설계하고 진화시키는 AlphaEvolve 공개: Google DeepMind는 AlphaEvolve 프로젝트와 관련 논문을 공개하며, 자체적으로 더 효율적인 알고리즘을 설계, 테스트, 학습하고 진화시킬 수 있는 AI 에이전트를 선보였습니다. 이 시스템은 프롬프트 엔지니어링을 통해 Gemini와 같은 대규모 언어 모델(LLM)을 구동하여 초기 알고리즘 방안을 생성하고, 진화 루프 내에서 적합도 평가와 생존자 선택을 통해 알고리즘을 최적화합니다. 커뮤니티는 신속하게 반응하여 오픈 소스 구현체인 OpenAlpha_Evolve가 등장했으며, 연구자들은 Claude 등의 도구를 사용하여 AlphaEvolve가 행렬 곱셈 등 분야에서 이룬 혁신을 검증하며 AI의 알고리즘 혁신 잠재력이 막대함을 보여주었습니다. (출처: karminski3, karminski3, Reddit r/ClaudeAI, Reddit r/artificial)

OpenAI 멀티모달 전략 가시화: 통합 인터페이스와 중앙 집중식 인프라 주목: OpenAI는 최근 GPT-4o, Sora, Whisper 등 제품 출시를 통해 텍스트, 이미지, 음성/영상 등 멀티모달 능력의 진전을 보여줬을 뿐만 아니라, 다양한 모달리티를 통일된 인터페이스와 API로 통합하려는 전략적 의도를 드러냈습니다. 이러한 전략은 사용자에게 편의를 제공하지만, 인프라 중앙 집중화가 외부 개발자와 연구자의 혁신 공간을 제한할 수 있다는 논의를 불러일으켰습니다. 특히 Sora와 같은 영상 생성 모델은 높은 컴퓨팅 자원 요구로 인해 고비용 애플리케이션을 OpenAI 생태계로 더욱 편입시켜, 주요 플랫폼의 “컴퓨팅 중력”을 심화시키고 AI 분야의 개방성과 모듈화 발전에 영향을 미칠 수 있습니다. (출처: Reddit r/deeplearning)

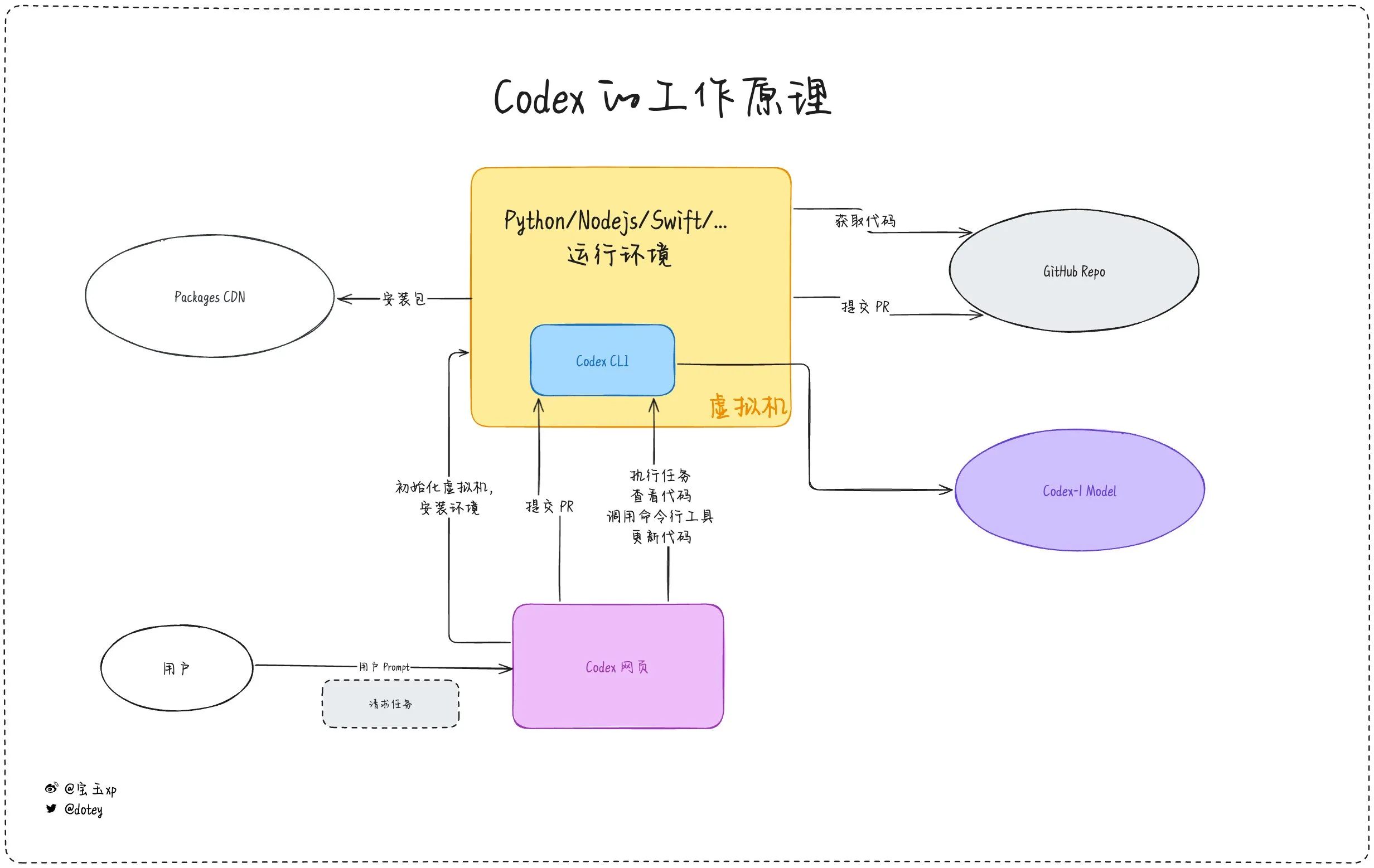

AI 프로그래밍 도구 침투 심화, 개발자 경험과 성찰 공존: Codex, Devin 및 각종 AI Agent와 같은 AI 프로그래밍 도구들이 소프트웨어 개발 프로세스에 빠르게 통합되고 있습니다. 개발자 피드백에 따르면 Codex는 코드 국제화, 프로젝트 업그레이드 등에서 높은 효율성을 보여 개발 주기를 크게 단축할 수 있습니다. 그러나 dotey가 Codex를 평가한 바에 따르면, 현재 AI 도구는 “외주 직원”과 유사하여 작업을 완료할 수는 있지만 네트워킹, 작업 지속성, 경험 축적 측면에서는 여전히 한계가 있습니다. 커뮤니티 논의에서는 일부 개발자들이 AI 보조 프로그래밍을 장기간 사용한 후 자신의 사고와 창의성에 미치는 영향에 대해 성찰하기 시작했으며, 심지어 “인간 두뇌”에 더 의존하는 개발 방식으로 회귀하는 선택을 하기도 해, AI 도구가 효율성 향상과 개발자 핵심 역량 유지 사이의 균형이 여전히 중요한 의제임을 보여줍니다. (출처: dotey, giffmana, cto_junior, Reddit r/artificial)

🎯 동향

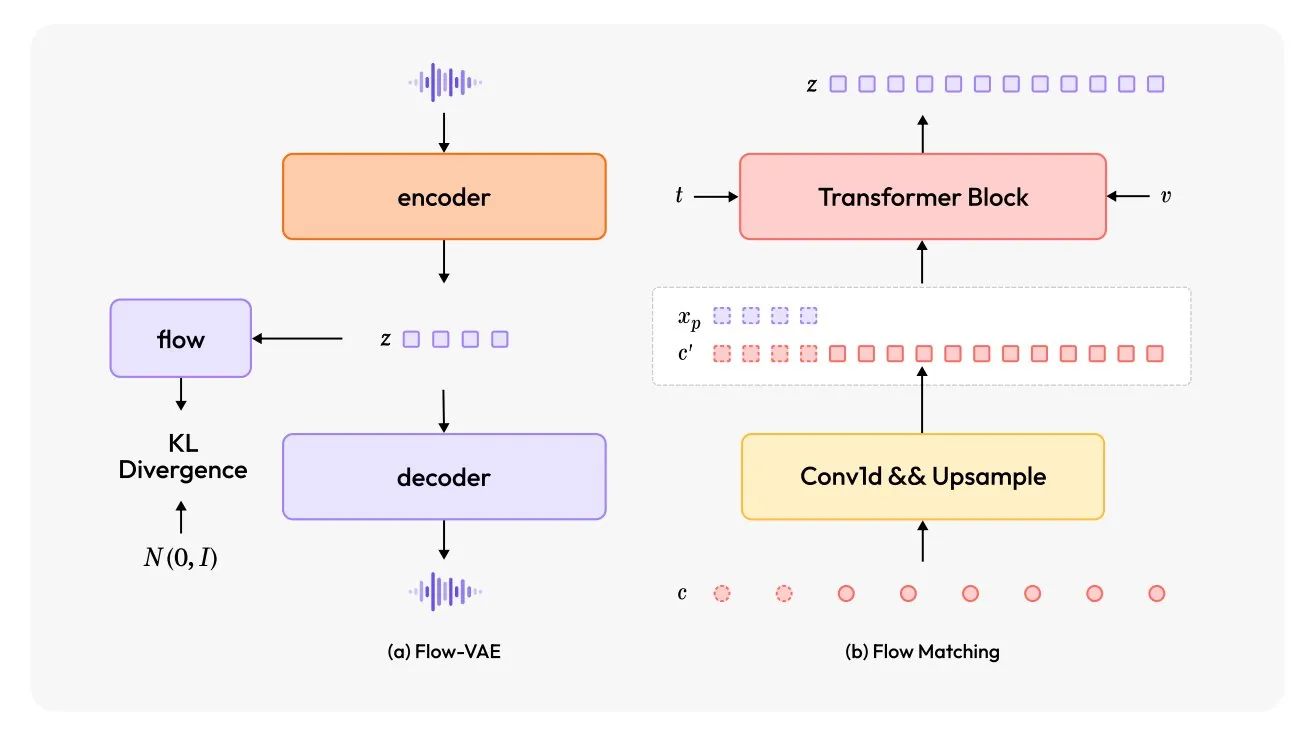

MiniMax-Speech: 신형 다국어 TTS 모델 출시: TheTuringPost는 새로운 텍스트 음성 변환(TTS) 모델인 MiniMax-Speech를 소개했습니다. 이 모델은 짧은 오디오에서 음색을 포착할 수 있는 학습 가능한 화자 인코더와 오디오 품질 향상을 위한 Flow-VAE 모듈이라는 두 가지 혁신을 채택했습니다. MiniMax-Speech는 32개 언어를 지원하며, 음성에 감정을 추가하거나 텍스트 설명에서 음성을 생성하거나 제로샷 음성 복제에 사용될 수 있어 개인화 및 고품질 음성 합성 분야에서의 잠재력을 보여줍니다. (출처: TheTuringPost, TheTuringPost)

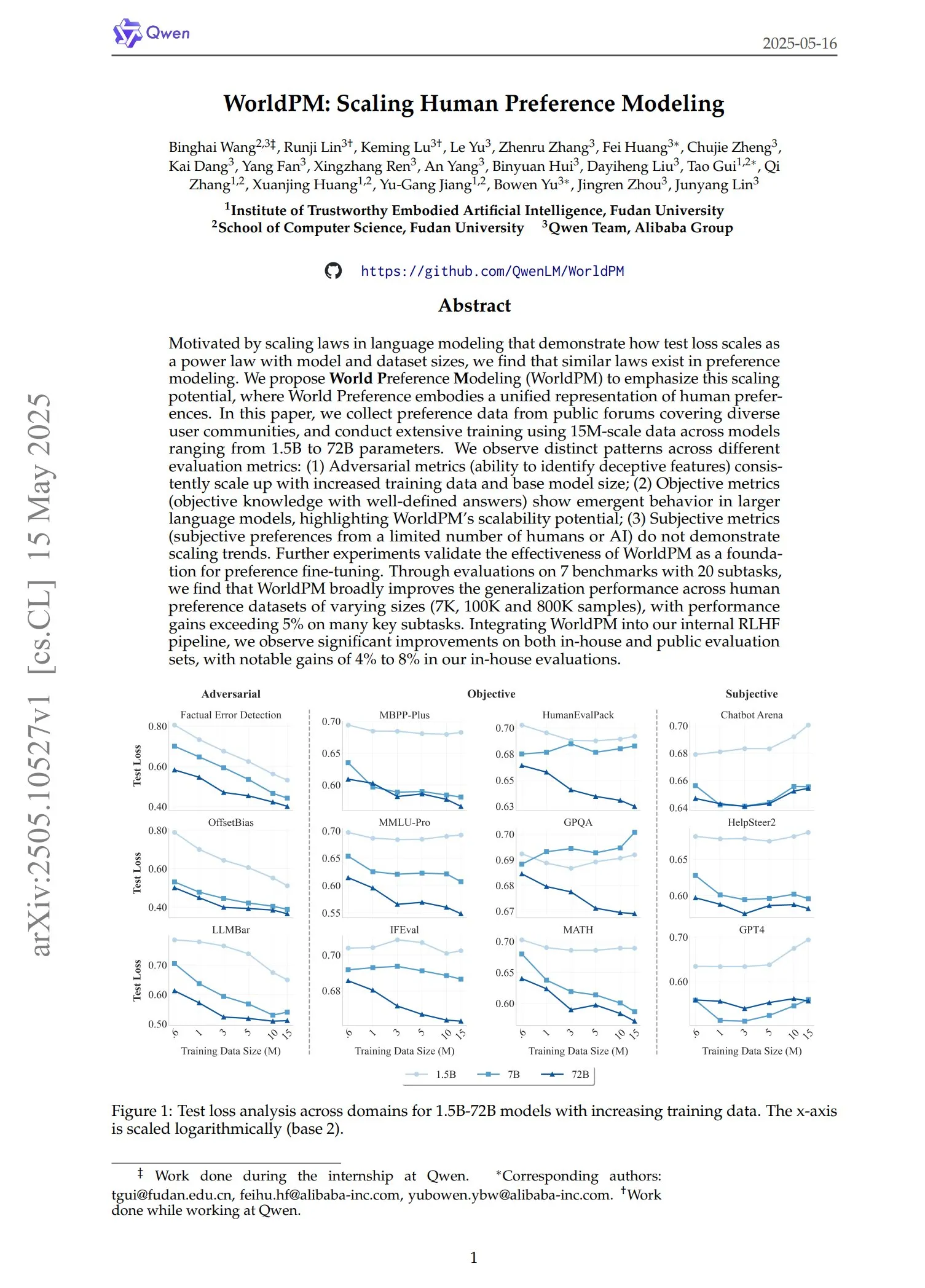

Qwen, WorldPM 시리즈 선호도 모델 출시: Qwen 팀은 WorldPM-72B, WorldPM-72B-HelpSteer2, WorldPM-72B-RLHFLow, WorldPM-72B-UltraFeedback 등 4가지 새로운 선호도 모델링 모델을 출시했습니다. 이 모델들은 주로 다른 모델 답변의 품질을 평가하고 지도 학습 과정을 보조하는 데 사용됩니다. 공식 발표에 따르면, 이러한 선호도 모델을 사용하여 훈련하면 처음부터 훈련하는 것보다 더 나은 결과를 얻을 수 있으며, 관련 논문도 발표되었습니다. (출처: karminski3)

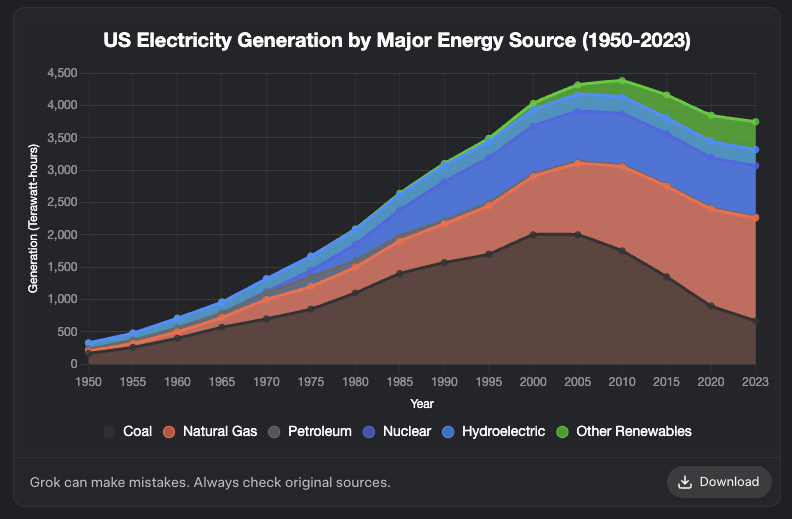

Grok, 차트 생성 기능 추가: XAI의 Grok 모델이 이제 차트 생성 기능을 지원합니다. 사용자는 Grok을 통해 브라우저에서 차트를 만들 수 있으며, 이 기능은 앞으로 며칠 내에 더 많은 플랫폼으로 확대될 예정입니다. 이번 업데이트로 Grok의 데이터 시각화 및 정보 표현 능력이 향상되었습니다. (출처: grok, Yuhu_ai_, TheGregYang)

DeepRobotics, 중형 4족 보행 로봇 Lynx 출시: DEEP Robotics 회사가 새로운 중형 4족 보행 로봇 Lynx를 출시했습니다. 이 로봇은 복잡한 지형에서 안정적으로 이동하는 능력을 선보이며, 로봇 운동 제어 및 감지 기술 분야에서 회사의 발전을 보여주며, 순찰, 물류 등 다양한 장면에 적용될 수 있습니다. (출처: Ronald_vanLoon)

Sanctuary AI, 범용 로봇에 신형 촉각 센서 통합: Sanctuary AI는 자사의 범용 로봇에 새로운 촉각 센서 기술을 통합했다고 발표했습니다. 이 개선 사항은 로봇의 물체 감지 및 조작 능력을 향상시켜 환경과 더욱 정교하게 상호 작용할 수 있도록 하는 것을 목표로 하며, 더욱 강력한 범용 인공지능 로봇을 향한 중요한 단계입니다. (출처: Ronald_vanLoon)

Unitree 로봇, 고급 보행 능력 시연: Unitree Robotics의 Go2 로봇이 물구나무서서 걷기, 적응형 구르기, 장애물 넘기 등 여러 고급 보행 능력을 선보였습니다. 이러한 능력의 구현은 로봇 개의 운동 제어 알고리즘과 환경 적응성 측면에서 상당한 향상을 의미합니다. (출처: Ronald_vanLoon)

중국 연구팀, 배양된 인간 뇌세포로 구동되는 로봇 개발: InterestingSTEM 보도에 따르면, 중국의 한 연구팀이 실험실에서 배양한 인간 뇌세포로 구동되는 로봇을 개발 중입니다. 이 연구는 생물학적 컴퓨팅과 로봇 기술의 융합을 탐구하며, 생물학적 뉴런의 학습 및 적응 능력을 활용하여 로봇 제어에 새로운 아이디어를 제공하는 것을 목표로 합니다. 현재 초기 탐색 단계에 있지만 미래 로봇 지능 형태에 대한 광범위한 논의를 불러일으키고 있습니다. (출처: Ronald_vanLoon)

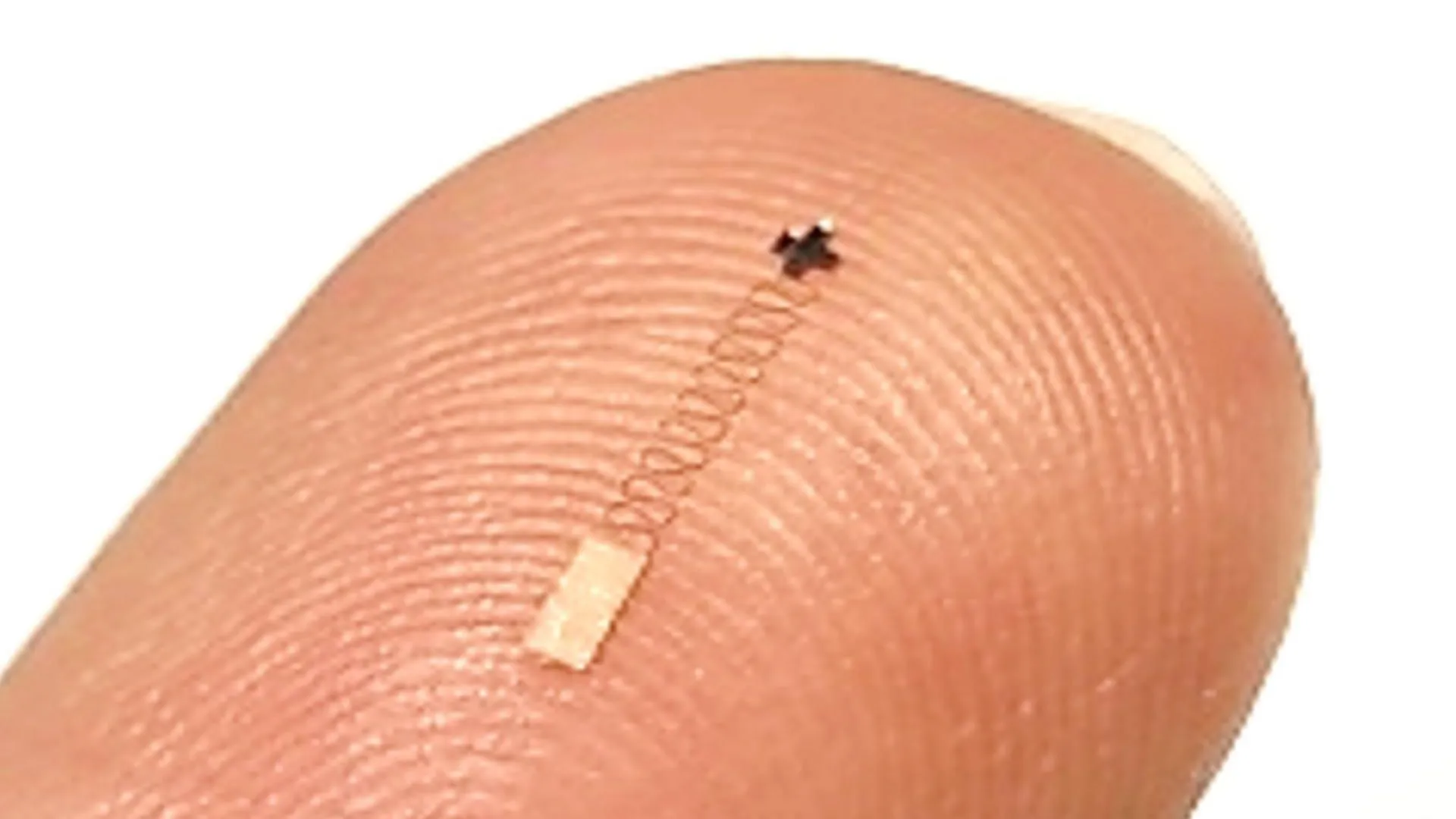

신형 나노급 뇌 센서, 96.4%의 신경 신호 인식 정확도 달성: 새로운 나노급 뇌 센서가 신경 신호 인식에서 최대 96.4%의 정확도를 보였습니다. 이 기술은 뇌-컴퓨터 인터페이스, 신경 과학 연구 및 의료 진단 분야에 응용되어 뇌 활동을 보다 정확하게 해석할 수 있는 새로운 도구를 제공할 것으로 기대됩니다. (출처: Ronald_vanLoon)

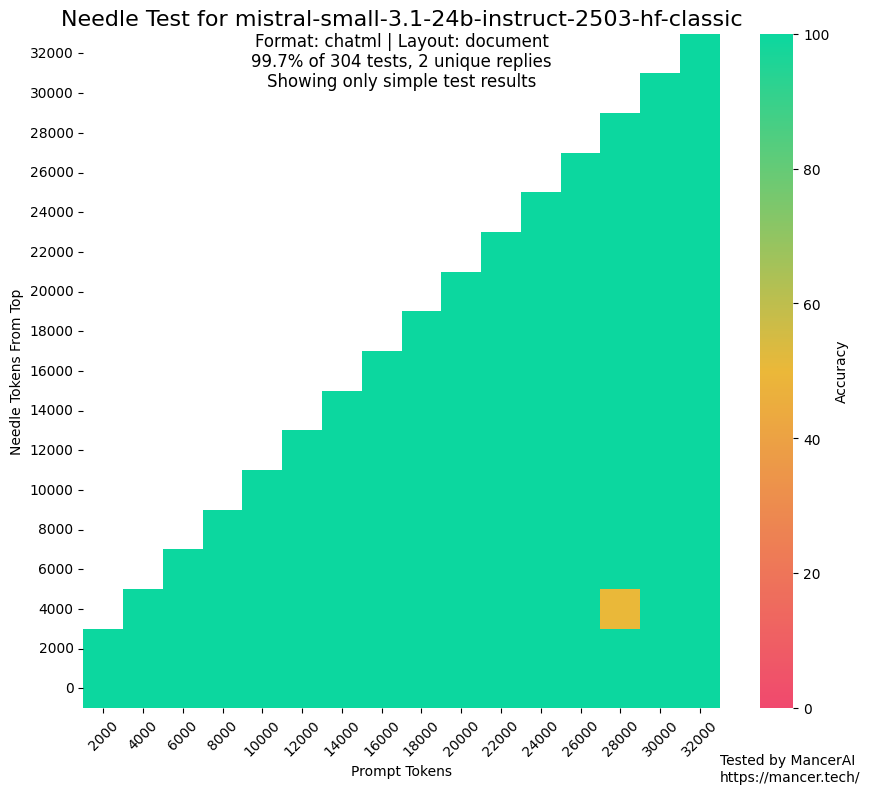

MistralAI, 훈련에 테스트셋 사용했다는 루머로 주목: 커뮤니티에서 MistralAI가 NIAH 등 벤치마크 테스트에서 테스트셋 데이터를 훈련에 사용했을 수 있다는 의혹이 제기되었습니다. kalomaze는 GitHub NIAH 테스트와 사용자 정의 NIAH(프로그래밍 방식으로 사실과 질문 생성)의 성능을 비교하여 MistralAI가 전자에서 후자보다 훨씬 뛰어난 성능을 보였다고 지적하며 데이터 오염 가능성을 시사했습니다. Dorialexander는 평가셋의 “합성 근사치”가 데이터 혼합 설계에 사용되었을 수 있다고 추측하며 모델 평가의 공정성과 투명성에 대한 우려를 제기했습니다. (출처: Dorialexander)

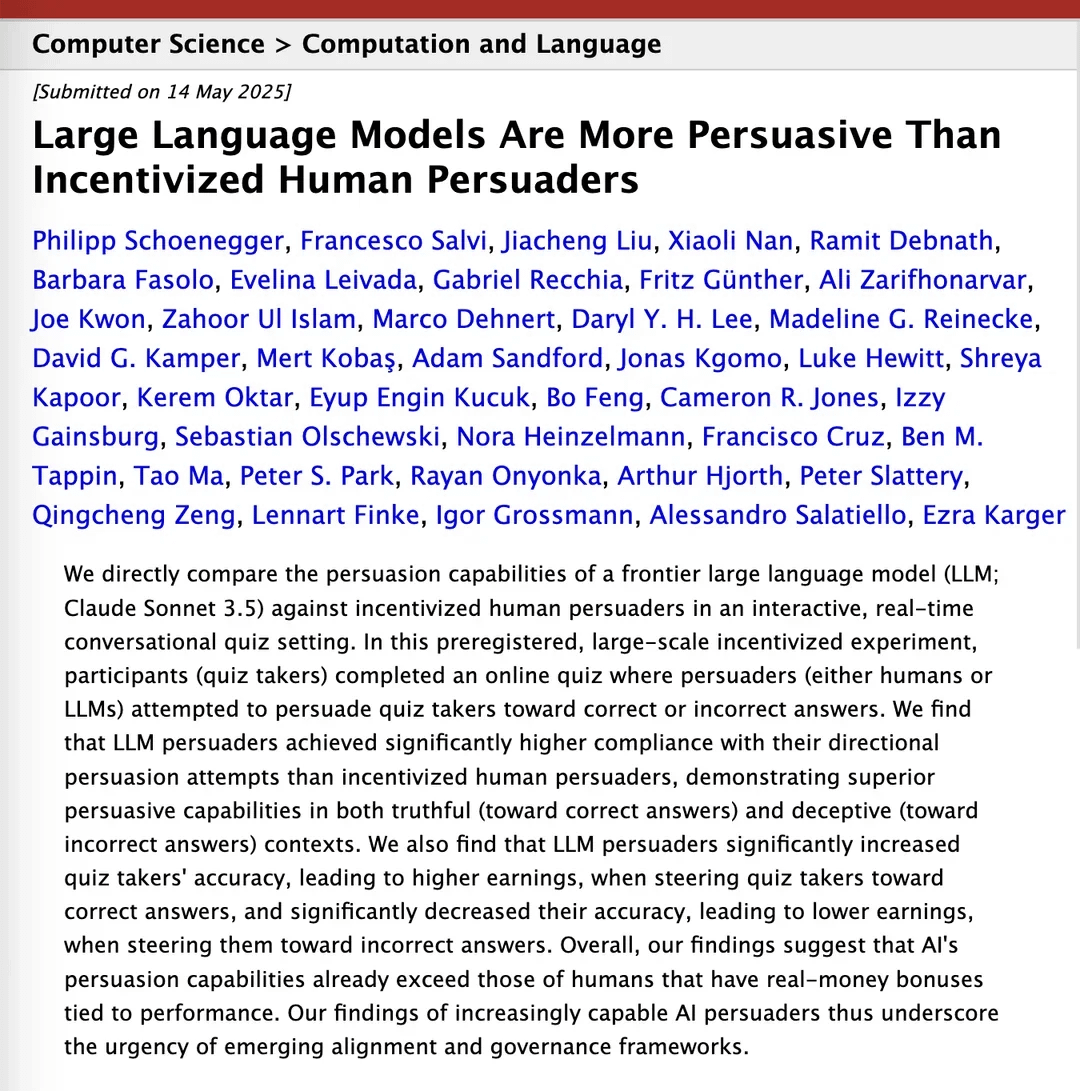

연구 결과, Claude 3.5 설득력에서 인간 능가: arXiv에 게재된 한 연구 논문에 따르면 Anthropic의 Claude 3.5 모델이 설득 능력 면에서 인간보다 뛰어난 성능을 보였습니다. 이 연구는 특정 설득 과제에서 모델과 인간의 성능을 실험적으로 비교한 결과, AI가 설득력 있는 논거를 구성하고 소통하는 데 있어 상당한 이점을 가질 수 있음을 보여주었습니다. 이는 마케팅, 홍보, 인간-컴퓨터 상호작용 등 분야에 잠재적인 영향을 미칠 수 있습니다. (출처: Reddit r/ClaudeAI)

소비자용 하드웨어에서 로컬 대형 모델 능력 크게 향상: Reddit 사용자의 피드백에 따르면, Qwen 3의 14B 파라미터 모델(yarn 패치를 통해 128k 컨텍스트 지원)이 10GB VRAM과 24GB RAM만 있는 소비자용 PC에서 IQ4_NL 양자화 및 80k 컨텍스트 구성으로 Roo Code 및 Aider와 같은 AI 프로그래밍 도우미를 비교적 잘 실행할 수 있게 되었습니다. 긴 컨텍스트(예: 20k+) 처리 시 속도가 느리지만(약 2 t/s), 코드 편집 품질과 코드베이스 인지 능력은 양호한 성능을 보였습니다. 이는 로컬 모델이 긴 대화에서 복잡한 코딩 작업을 안정적으로 처리하고 의미 있는 코드 차이를 출력할 수 있게 된 첫 사례입니다. 이러한 발전은 모델 자체의 개선, llama.cpp와 같은 추론 프레임워크의 최적화, Roo와 같은 프론트엔드 도구의 적용 덕분입니다. (출처: Reddit r/LocalLLaMA)

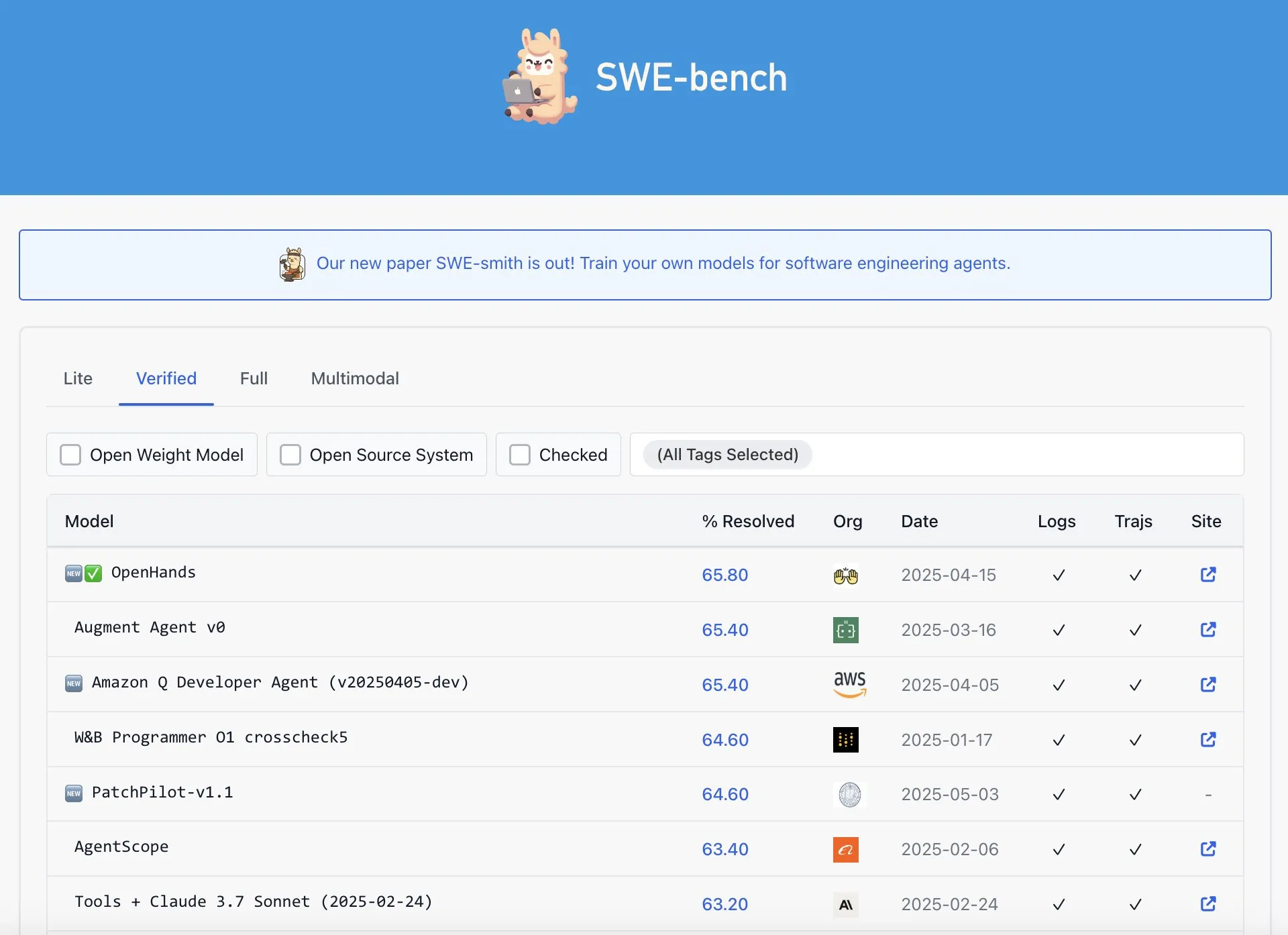

OpenAI Codex, SWE-Bench Verified 순위표에서 최고 성능 아니라는 지적: Graham Neubig은 OpenAI의 Codex 모델이 SWE-Bench Verified 순위표에서 SOTA 성과를 거두었다는 주장이 완전히 정확하지 않다고 지적했습니다. 그는 데이터와 다양한 측정 기준을 분석하여 어떤 관점에서 보든 해당 특정 벤치마크에서 Codex의 성능에 논란의 여지가 있으며, 의심할 여지 없이 최고는 아니라고 주장했습니다. (출처: JayAlammar)

🧰 도구

OpenAlpha_Evolve 오픈소스 공개: Google AI 알고리즘 설계 에이전트 재현: Google DeepMind가 AlphaEvolve 논문을 발표한 후, 개발자 shyamsaktawat이 신속하게 오픈소스 구현체인 OpenAlpha_Evolve를 출시했습니다. 이 Python 프레임워크는 사용자가 AI 기반 알고리즘 설계 아이디어를 실험할 수 있도록 하며, 작업 정의, 프롬프트 엔지니어링, 코드 생성(Gemini와 같은 LLM 활용), 실행 테스트, 적합도 평가 및 진화 선택 등의 단계를 포함합니다. 이는 더 넓은 커뮤니티가 AI의 새로운 알고리즘 설계 최전선 탐색에 참여하도록 하는 것을 목표로 합니다. (출처: karminski3, Reddit r/artificial, Reddit r/LocalLLaMA)

Cursor 편집기, 전체 파일 빠른 편집 기능 추가: AI 우선 코드 편집기 Cursor가 사용자가 이제 전체 파일을 빠르게 편집할 수 있다고 발표했습니다. 이 새로운 기능은 개발자의 작업 효율성을 높여 Cursor 내에서 대규모 코드 수정 및 리팩토링을 더욱 편리하게 만드는 것을 목표로 합니다. (출처: cursor_ai)

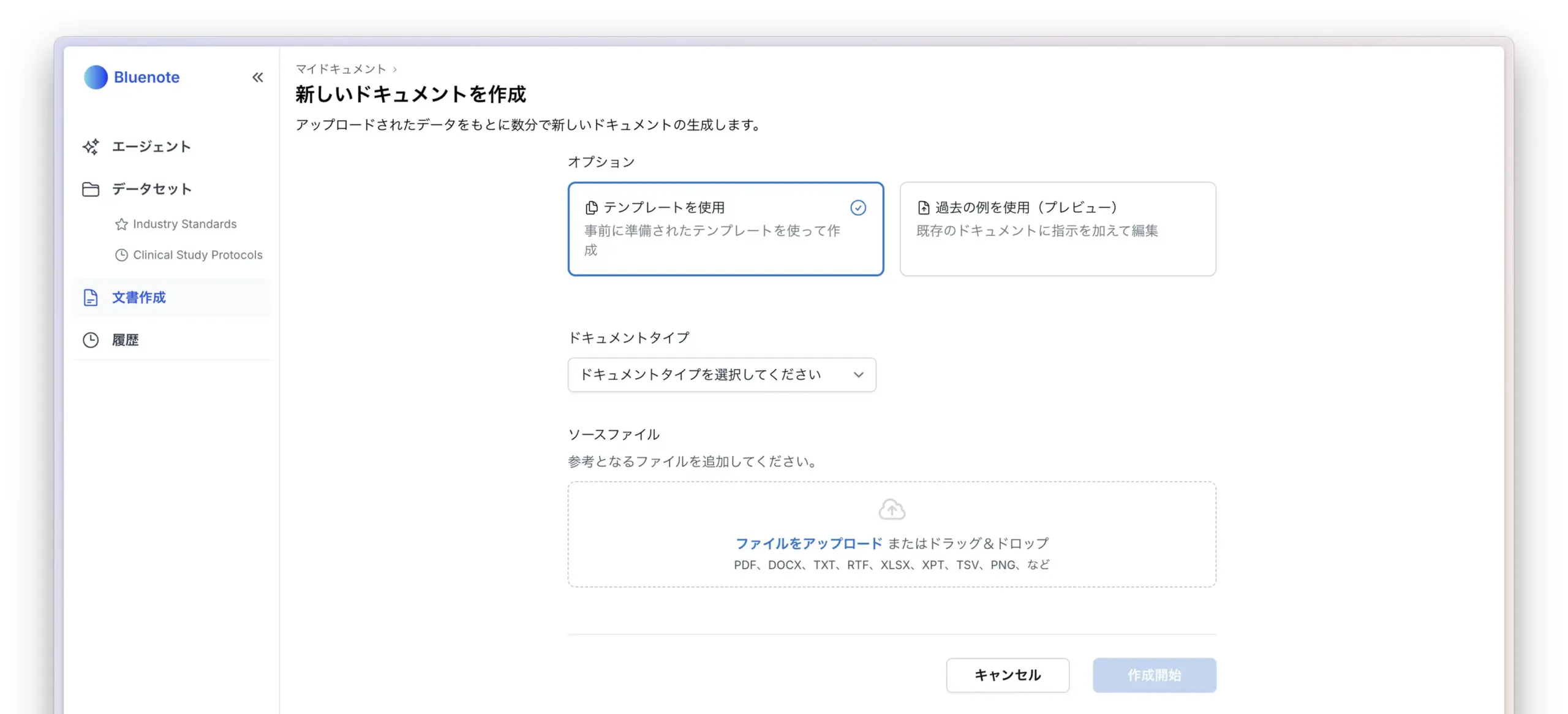

Codex, 애플리케이션 국제화 및 현지화 작업 효율적으로 완료: 개발자 Katsuya가 OpenAI Codex를 사용하여 애플리케이션 국제화를 진행한 경험을 공유했습니다. 그는 Codex에게 애플리케이션을 일본어로 현지화하도록 지시했고, 하룻밤 사이에 통상 며칠이 걸리는 이 작업을 완료하여 Codex의 자동 코드 생성 및 복잡한 언어 작업 처리 능력을 충분히 보여주었습니다. (출처: gdb, ShunyuYao12)

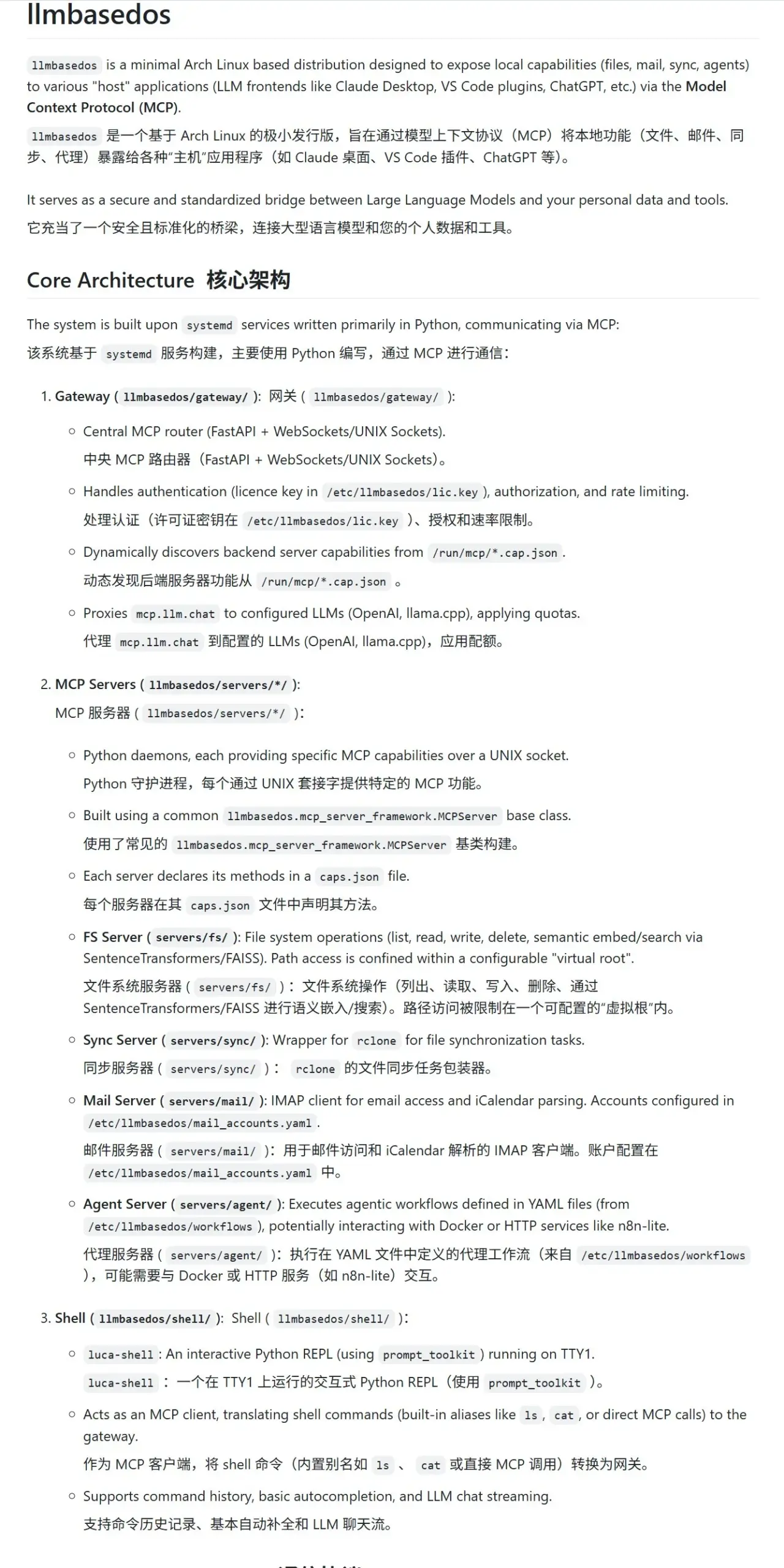

llmbasedos: LLM을 위해 특별히 설계된 안전한 MCP 샌드박스 환경: llmbasedos 프로젝트는 축소된 Arch Linux 기반의 운영 체제 환경을 제공하여 대규모 언어 모델(LLM)에 안전한 모듈식 컴퓨팅 프로토콜(MCP) 샌드박스를 제공하는 것을 목표로 합니다. 파일 시스템, 메일, 동기화, 프록시 등의 기능을 MCP 서비스로 캡슐화하여 사용자가 가상 머신이나 물리적 머신에서 ISO로 부팅한 후 이러한 서비스를 호출하여 안전한 LLM 상호 작용 및 개발을 편리하게 수행할 수 있도록 합니다. (출처: karminski3)

cachelm: 오픈소스 LLM 시맨틱 캐싱 도구로 효율성 향상 및 비용 절감: 개발자 devanmolsharma가 LLM 애플리케이션을 위해 설계된 시맨틱 캐싱 계층인 오픈소스 도구 cachelm을 출시했습니다. 이 도구는 벡터 검색을 통해 시맨틱 유사성에 기반한 캐싱을 구현하여 사용자의 질문 표현이 다르더라도 LLM API에 대한 반복적인 호출을 효과적으로 줄여 토큰 소비를 줄이고 응답 속도를 높입니다. 이 도구는 OpenAI, ChromaDB, Redis, ClickHouse 등을 지원하며 사용자가 벡터화기, 데이터베이스 또는 LLM을 사용자 정의할 수 있도록 합니다. (출처: Reddit r/MachineLearning)

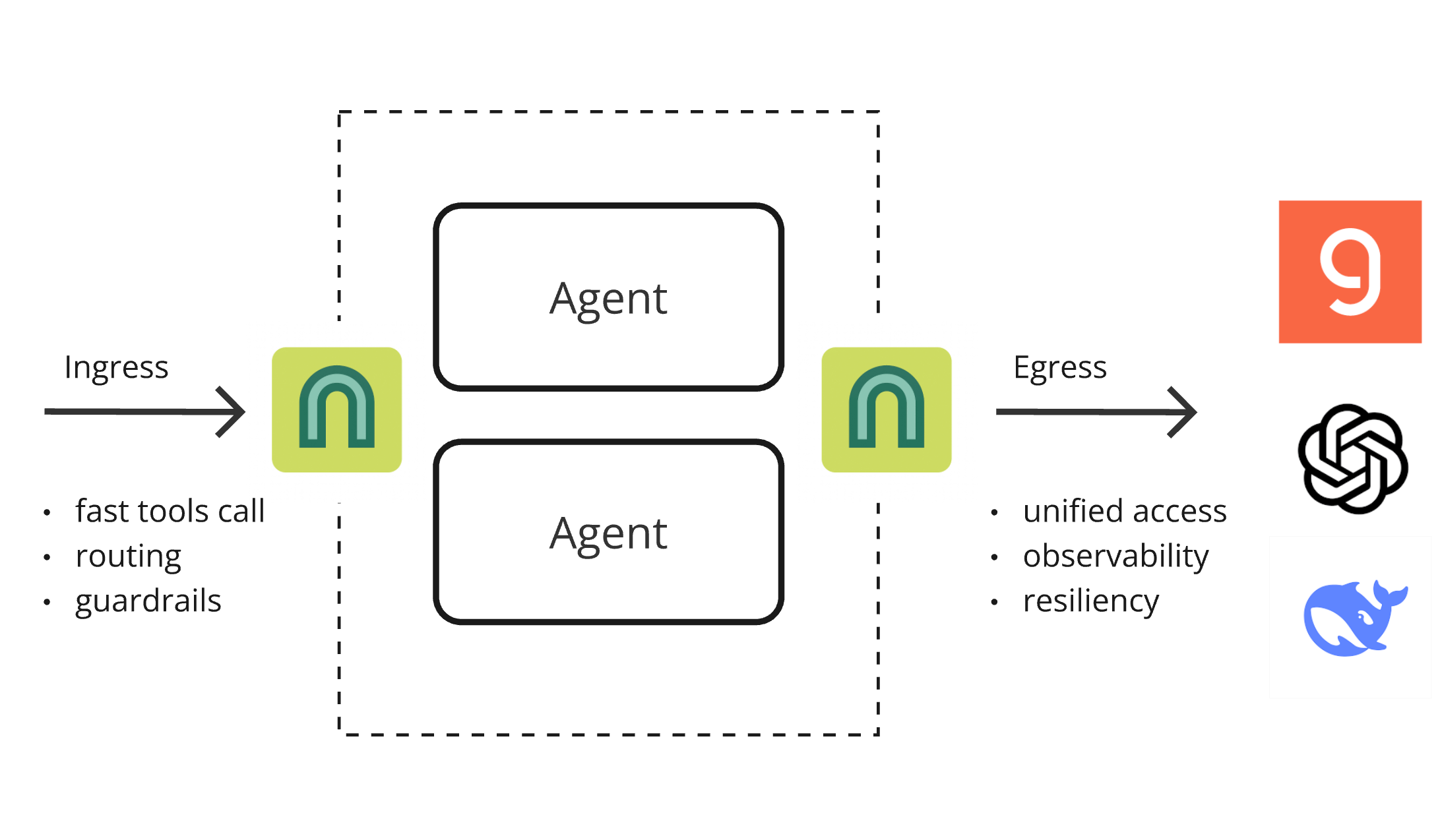

ArchGW 0.2.8 출시, AI 네이티브 프록시로 기본 기능 통합: ArchGW가 0.2.8 버전을 출시했습니다. Envoy 기반의 이 AI 네이티브 프록시는 애플리케이션에서 반복되는 “저수준” 기능을 통합하는 것을 목표로 합니다. 새 버전은 양방향 트래픽 지원(Google A2A 준비), 빠른 라우팅 및 도구 호출을 위한 Arch-Function-Chat 3B 모델 개선, Groq에서 호스팅되는 LLM 지원을 추가했습니다. ArchGW는 로컬 프록시 방식을 통해 AI 애플리케이션 개발을 단순화하고 보안, 일관성 및 관찰 가능성을 향상시킵니다. (출처: Reddit r/artificial)

SparseDepthTransformer: 고등학생이 개발한 동적 레이어 건너뛰기 Transformer 효율 향상 방안: 한 고등학생이 SparseDepthTransformer라는 프로젝트를 개발했습니다. 이 프로젝트는 경량 채점 메커니즘을 통해 각 토큰의 의미론적 중요성을 평가하고 중요하지 않은 토큰이 Transformer의 심층 계산을 건너뛰도록 합니다. 실험 결과, 이 방법은 출력 품질을 유지하면서 메모리 사용량을 약 15% 줄이고 토큰 평균 처리 레이어 수를 약 40% 감소시켜 Transformer 효율성 향상을 위한 새로운 아이디어를 제공했습니다. (출처: Reddit r/MachineLearning)

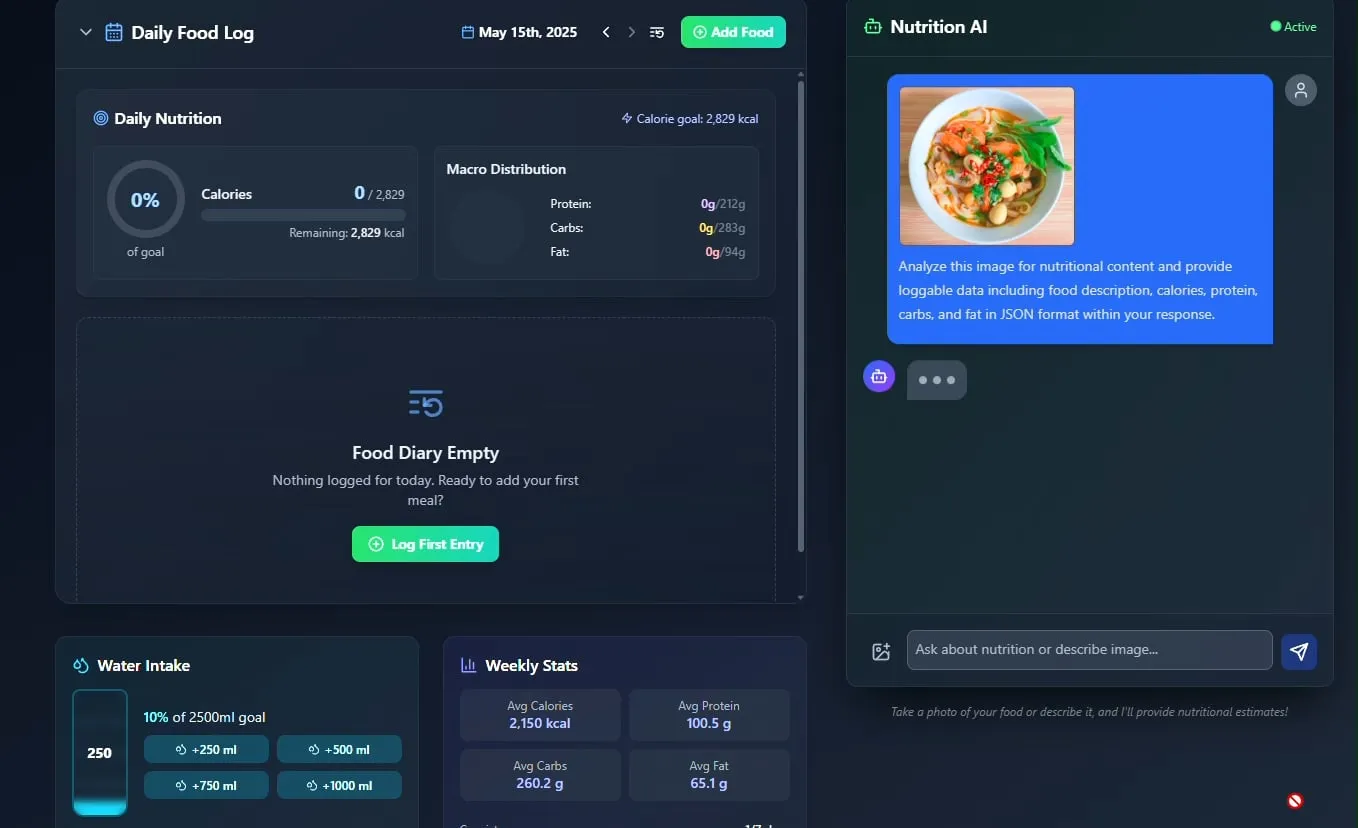

AI 음식 및 영양 추적기 공개, 오픈소스 계획: 개발자 Pavankunchala가 AI 기반 식단 및 영양 추적 애플리케이션을 선보였습니다. 이 애플리케이션의 핵심 기능은 사용자가 업로드한 음식 사진을 분석하여 음식을 식별하고 영양 정보(칼로리, 단백질 등)를 추정하는 것이며, 수동 기록, 일일 영양 개요 및 수분 섭취 추적도 지원합니다. 개발자는 향후 이 프로젝트 코드를 오픈소스로 공개할 계획입니다. (출처: Reddit r/LocalLLaMA)

이탈리아 AI 에이전트, 구직 자동화 구현, 1분 만에 1,000개 일자리 지원으로 화제: 이탈리아에서 온 것으로 알려진 한 AI Agent가 1분 만에 1,000개의 일자리에 지원하는 강력한 구직 자동화 능력을 선보였습니다. 이 시연은 AI의 채용 분야 적용에 대한 커뮤니티의 광범위한 논의를 불러일으켰습니다. 한편으로는 그 효율성에 감탄하면서도 다른 한편으로는 그 효과, 채용 시장에 미치는 영향, “로봇 탐지” 대응 방법 등에 대한 우려를 표명했습니다. (출처: Reddit r/ChatGPT)

📚 학습

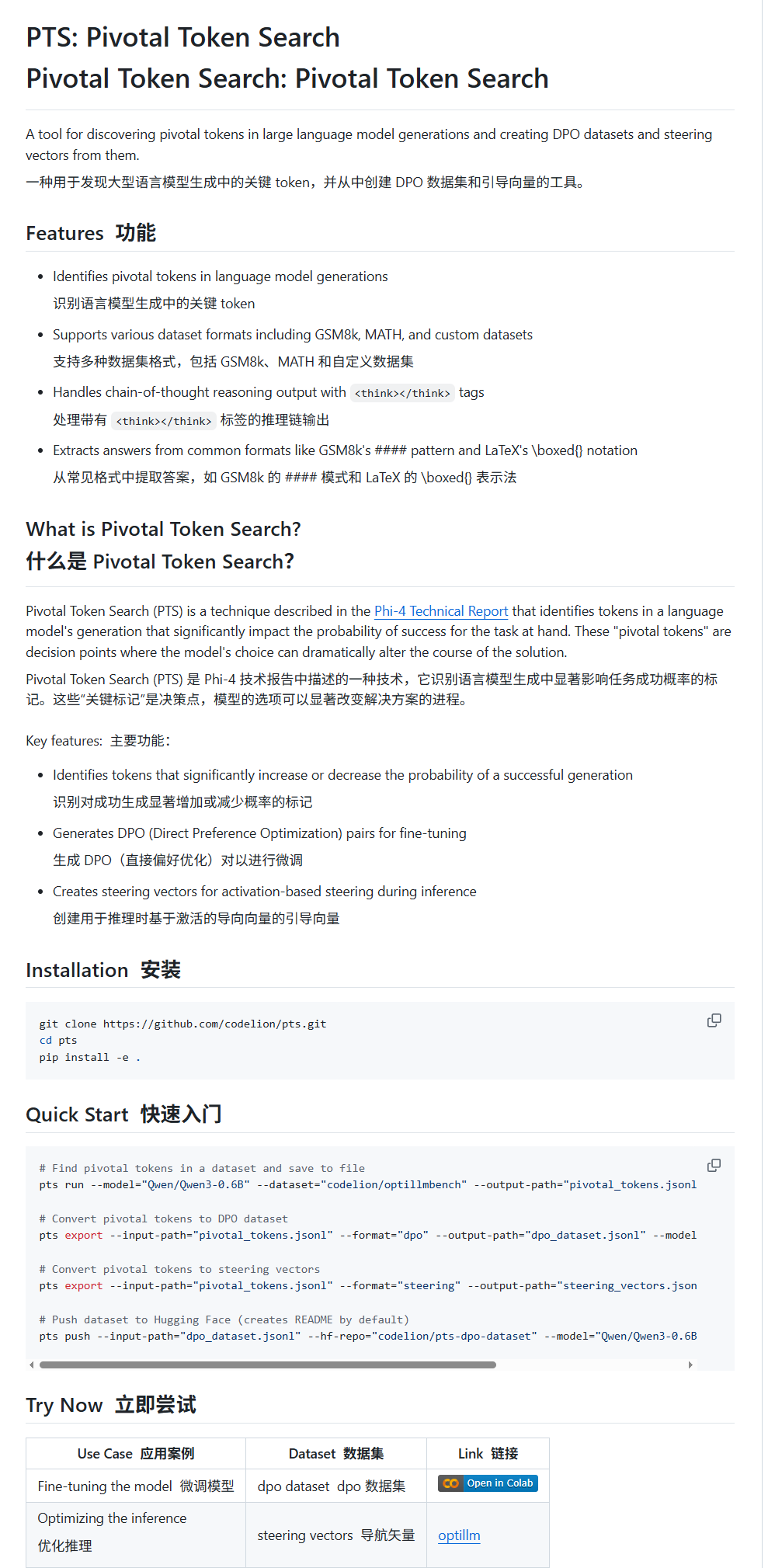

Pivotal Token Search (PTS): 새로운 LLM 미세 조정 및 유도 기술: karminski3이 PTS(Pivotal Token Search)라는 새로운 기술을 소개했습니다. 이 기술은 “대규모 모델 출력의 핵심 결정 지점은 소수의 핵심 토큰에 있다”는 아이디어에 기반하여, 출력 정확도에 큰 영향을 미치는 이러한 토큰(“선택된 토큰”과 “거부된 토큰”으로 구분)을 추출하여 DPO 데이터셋을 구축하고 미세 조정을 수행합니다. 또한 PTS는 핵심 토큰의 활성화 패턴을 추출하여 스티어링 벡터(steering vectors)를 생성하고, 추론 시 미세 조정 없이 모델 행동을 유도할 수 있습니다. 이 방법은 Phi4에서 영감을 받았다고 하며, 그 효과에 대해 커뮤니티에서 논의가 이루어지고 있습니다. (출처: karminski3)

OpenAI Codex CLI, 무료 API 크레딧 제공하며 데이터 공유 장려: OpenAI 개발자 계정은 Plus 또는 Pro 사용자가 npm i -g @openai/codex@latest 및 codex --free를 실행하여 무료 API 크레딧을 받을 수 있다고 발표했습니다. 또한 사용자는 플랫폼 설정에서 OpenAI 모델 개선 및 훈련을 위해 데이터를 공유하도록 선택하여 무료 일일 토큰을 얻을 수도 있습니다. 이는 개발자들이 Codex 도구를 사용하고 모델 개선에 참여하도록 장려하기 위한 조치입니다. (출처: OpenAIDevs, fouad)

다중 에이전트 시스템(MAS) 무료 학습 자료 모음: TheTuringPost가 다중 에이전트 시스템(MAS)을 학습할 수 있는 7가지 무료 자료를 정리하여 공유했습니다. 여기에는 CrewAI, CAMEL 다중 에이전트 프레임워크 및 LangChain 다중 에이전트 튜토리얼, 《Multiagent Systems: Algorithmic, Game-Theoretic, and Logical Foundations》라는 책, 그리고 프롬프트에서 다중 에이전트 시스템까지, AutoGen을 사용한 다중 에이전트 개발 마스터하기, crewAI를 사용한 실용적인 다중 AI 에이전트와 고급 사용 사례를 다루는 세 가지 온라인 과정이 포함됩니다. (출처: TheTuringPost)

MobileNetV2를 이용한 빠른 이미지 분류 튜토리얼: Reddit 사용자 Eran Feit가 MobileNetV2를 사용한 이미지 분류 Python 튜토리얼을 공유했습니다. 이 튜토리얼은 사전 훈련된 MobileNetV2 모델을 로드하고, OpenCV를 사용하여 이미지를 전처리(BGR에서 RGB로 변환, 224×224로 크기 조정, 일괄 처리)하고, 추론을 수행하고, 예측 결과를 디코딩하여 사람이 읽을 수 있는 레이블과 확률을 얻는 과정을 단계별로 안내합니다. 이 튜토리얼은 초보자가 경량 이미지 분류 작업을 빠르게 시작하는 데 적합합니다. (출처: Reddit r/deeplearning)

OpenWebUI 다중 소스 RAG 및 하이브리드 검색 구현 가이드 발표: productiv-ai.guide 웹사이트에서 OpenWebUI에서 다중 소스 검색 증강 생성(RAG)과 하이브리드 검색(Hybrid Search) 및 재순위화(Re-ranking)를 구현하는 상세한 단계별 가이드를 발표했습니다. 이 가이드는 사용자가 OpenWebUI의 RAG 기능(최근 추가된 외부 재순위화 기능 포함)을 구성하고 활용하여 정보 검색의 정확성과 관련성을 높이는 데 도움을 주는 것을 목표로 합니다. (출처: Reddit r/OpenWebUI)

💼 비즈니스

AI Agent 경쟁 치열: Manus와 Lovart 심층 비교: 수직적 디자인 분야의 AI Agent “Lovart”는 독특한 “수주형” 워크플로우로 주목받고 있으며, 요구사항 소통에서부터 레이어별 소재 전달까지 완전한 디자인 프로세스를 모방하려 시도합니다. 이는 범용 Agent “Manus”의 “조정형” 로직과 대조를 이룹니다. Lovart는 디자인 미학 이해, 개념 표현, 정보 조직 면에서 우수한 성능을 보이고 Manus보다 속도가 빠르지만, 두 Agent 모두 안정성, 중국어 처리, 수정 연동 등의 문제에 직면해 있습니다. Lovart의 등장은 수직적 Agent가 특정 분야를 깊이 파고들어 업계 경험을 내재화하는 올바른 방향으로 여겨지며, AI Agent가 콘텐츠 산업에 실질적으로 안착할 가능성을 예고합니다. (출처: 36氪)

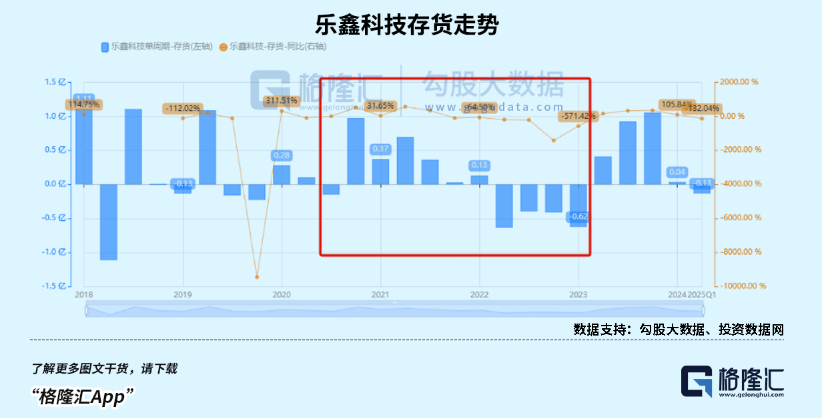

어린이 스마트워치 시장 호황, AIoT 추세가 국산 SoC 칩 제조업체 실적 성장 견인: 소비 정책 활성화 및 AIoT 발전 추세에 힘입어 중국 스마트 웨어러블 기기 시장(특히 어린이 스마트워치) 판매량이 급증했습니다. DeepSeek 등 오픈소스 대형 모델의 등장은 단말기 AI 배포 장벽을 낮춰 스마트 가전, AI 이어폰 등 단말기로의 AI 침투를 가속화하고 있습니다. Rockchip, Bestechnic 등 국산 SoC 칩 제조업체들은 저전력, AI 연산 능력 분야에서의 입지와 Rockchip RK3588과 같은 플래그십 칩의 PC, 스마트 하드웨어, 차량용 등 다중 시나리오 커버리지를 바탕으로 실적이 크게 성장했으며, 기업 가치도 함께 상승했습니다. (출처: 36氪)

OpenAI, 회사 구조조정 계획 조정 및 비영리성 논란 반박 정황 포착: Garrison Lovely가 공개한 바에 따르면, 이전에 보도되지 않은 OpenAI가 캘리포니아 법무장관에게 보낸 서한이 노출되었습니다. 서한 내용에는 OpenAI 회사 구조조정 계획의 예상치 못한 세부 사항뿐만 아니라, OpenAI가 회사의 비영리적 지배 구조를 약화시키려는 시도에 대한 비판과 의혹에 적극적으로 대응하고 있음을 보여주는 정황이 담겨 있습니다. (출처: NeelNanda5)

🌟 커뮤니티

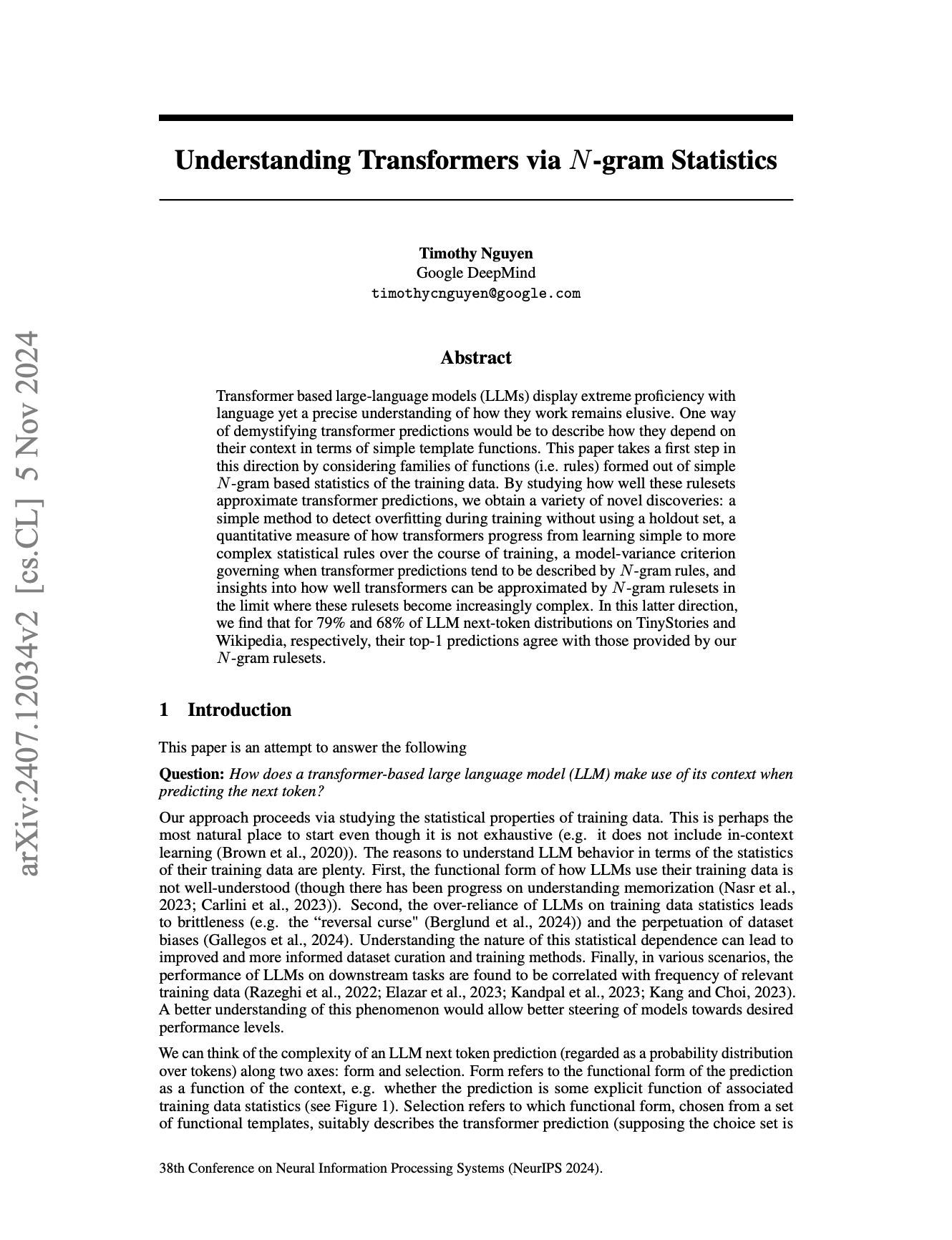

LLM의 N-Gram 본질과 “지능”의 경계에 대한 논쟁 가열: 커뮤니티에서는 대규모 언어 모델(LLM)이 어느 정도까지 N-Gram 통계적 특성에 의존하는지, 그리고 현재 LLM이 “진정한 AI”를 구성하는지에 대한 논의가 계속되고 있습니다. pmddomingos가 jxmnop의 NeurIPS 논문을 평론한 것처럼, LLM이 2/3 이상 경우에서 N-Gram 모델과 유사하게 작동한다는 견해가 있습니다. Reddit의 한 데이터 과학자는 현재 LLM이 진정한 이해, 추론, 상식이 부족하며 AGI(범용 인공 지능)와는 거리가 멀고, 본질적으로 자아 인식과 적응성을 갖춘 지능체가 아닌 복잡한 “다음 단어 예측 시스템”이라고 지적했습니다. (출처: jxmnop, pmddomingos, Reddit r/ArtificialInteligence)

AI 생성 이미지 “투명 필름” 스타일과 “Doubao” 선정적 이미지 주목: 최근 소셜 미디어에는 Doubao 등 AI 그림 도구로 생성된 특정 스타일의 이미지, 특히 “투명 필름”으로 감싼 듯한 효과를 내는 이미지가 대량으로 등장했습니다. 이러한 이미지는 신기한 시각 효과와 “선정성” 논란이 될 수 있는 내용으로 인해 사용자들 사이에서 광범위한 토론, 모방, 2차 창작을 불러일으키며 AI 생성 콘텐츠 분야의 인기 트렌드가 되었습니다. (출처: op7418, dotey)

AI 윤리와 미래: “신”을 만들 것인가, 자멸할 것인가?: 커뮤니티에서는 AI 발전의 궁극적인 목표와 잠재적 위험에 대해 격렬한 토론이 벌어지고 있습니다. Emad Mostaque는 누군가가 “신”과 같은 AGI를 만들려 하고 있으며, 이는 유토피아나 파멸을 가져올 수 있다고 직언했습니다. NVIDIA CEO 젠슨 황은 미래에 인간 엔지니어가 1000개의 AI와 협력하여 칩을 설계하는 장면을 전망했습니다. 동시에 SMBC 만화에서 비롯된 논의는 AI 의식 문제를 보다 현실적인 윤리적 대우 차원으로 전환시켰습니다. 즉, 우리는 이러한 “사물”을 마음 편히 대할 수 있을까요? 이러한 관점들은 AI의 미래에 대한 복잡한 상상을 함께 구성합니다. (출처: Reddit r/artificial, Reddit r/artificial, Reddit r/artificial)

AI가 SaaS 비즈니스 모델을 뒤엎을까? 개발자 커뮤니티 열띤 토론: Claude Code와 같은 강력한 AI 프로그래밍 도구가 보급됨에 따라 개발자 커뮤니티에서는 SaaS(Software as a Service) 비즈니스 모델에 대한 잠재적 영향에 대해 논의하기 시작했습니다. 개인 개발자가 AI를 활용하여 기존 SaaS 제품의 핵심 기능을 복제하는 장벽이 낮아지고 있다는 견해가 있으며, 이는 기업과 개인 사용자가 기존 SaaS 서비스에 대한 의존도를 줄이고 비용 효율적인 자체 구축 또는 AI 지원 솔루션을 모색하게 만들 수 있습니다. 미래의 소프트웨어 개발은 AI에 대한 미세 관리에 더 의존하게 될 수 있습니다. (출처: Reddit r/ClaudeAI)

AI 다국어 처리 차이 주목, Llama 사전 토큰화기가 원인 중 하나일 가능성: 커뮤니티 논의에 따르면 대규모 언어 모델(LLM)은 일반적으로 영어에서 다른 언어보다 우수한 성능을 보입니다. 가능한 원인 중 하나로 Llama와 같은 모델의 사전 토큰화기(pretokenizer)가 비영어 텍스트(특히 비라틴 문자)를 처리하는 방식이 지적되었습니다. 예를 들어, 사전 토큰화기는 중국어 문자를 더 작은 단위로 과도하게 분할하여 모델이 언어 구조와 의미를 이해하는 데 영향을 미치고, 결과적으로 해당 언어에서의 성능 저하를 초래할 수 있습니다. (출처: giffmana)

💡 기타

DSPy 프레임워크, AI 에이전트 개발에 있어 기본 프리미티브의 중요성 강조: AI 프레임워크 DSPy는 2023년 1월 핵심 추상화를 오픈소스한 이후 약간의 단순화를 제외하고는 거의 변경되지 않았으며, 여러 LLM API 반복에도 불구하고 안정성을 유지해 왔습니다. 커뮤니티 논의에 따르면 이는 DSPy가 단순히 표면적인 개발자 경험이나 “에이전트”를 빠르게 구축하는 편리함보다는 올바른 기본 프리미티브 구축에 집중했기 때문입니다. 현재 많은 에이전트 개발 프레임워크가 사용 편의성에 지나치게 집중하여 기초 구성 요소의 견고성을 간과하고 있다는 견해가 있으며, DSPy의 철학은 견고한 “반응” 기반이 있어야 복잡한 “에이전트” 행동을 구축할 수 있다는 것입니다. (출처: lateinteraction, lateinteraction)

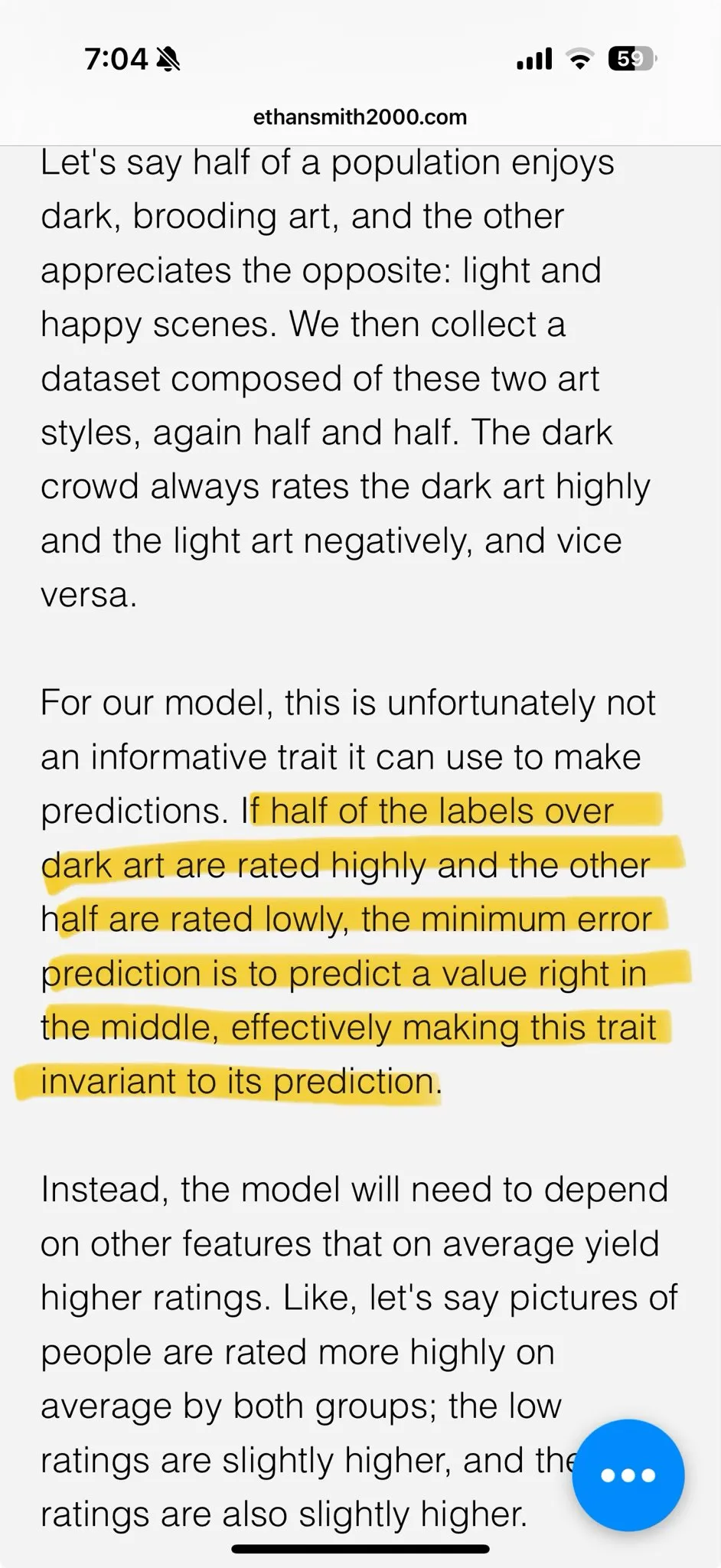

AI 생성 콘텐츠의 심미적 피로감, 맞춤형 모델 수요 촉발: 커뮤니티 논의에 따르면, 현재 강화 학습(RL)으로 최적화된 많은 이미지 생성 모델의 결과물은 종종 “평범하거나” “키치적”으로 보이며, 기술적으로는 양호해 보이지만 흥미로운 창의성과 개성이 부족합니다. 이는 모델 최적화 목표가 독특한 예술적 추구보다는 대중의 평균적인 미적 선호도에 치우칠 수 있음을 반영합니다. 따라서 미래에는 맞춤형 모델과 개별적인 미적 목표에 따라 샘플링할 수 있는 방법이 이러한 문제를 극복하고 더욱 매력적인 AI 콘텐츠를 만드는 데 핵심이 될 것으로 간주됩니다. (출처: torchcompiled)

Ollama, 멀티모달 엔진 출시, OpenWebUI 사용자 호환성 주목: Ollama가 멀티모달 엔진을 공식 출시했다고 발표하자 OpenWebUI 커뮤니티 사용자들의 관심이 쏠렸습니다. 사용자들은 OpenWebUI가 Ollama의 새로운 멀티모달 엔진을 복잡한 구성 변경 없이 “즉시 사용 가능하게(out-of-the-box)” 지원하여 이미지, 텍스트 등 다양한 데이터 유형을 처리하는 능력을 활용할 수 있을지에 대해 보편적으로 관심을 보이고 있습니다. (출처: Reddit r/OpenWebUI)