키워드:트랜스포머, 노암 셰이지어, 챗GPT, 제미니, 딥시크 R1, AI 기술, 대규모 언어 모델(LLM), 혼합 전문가 모델(MoE), 다중 쿼리 어텐션(MQA), 게이트 선형 레이어(GLU), 절대 제로 강화 학습 패러다임, 시드 코더 8B 코드 모델

🔥 포커스

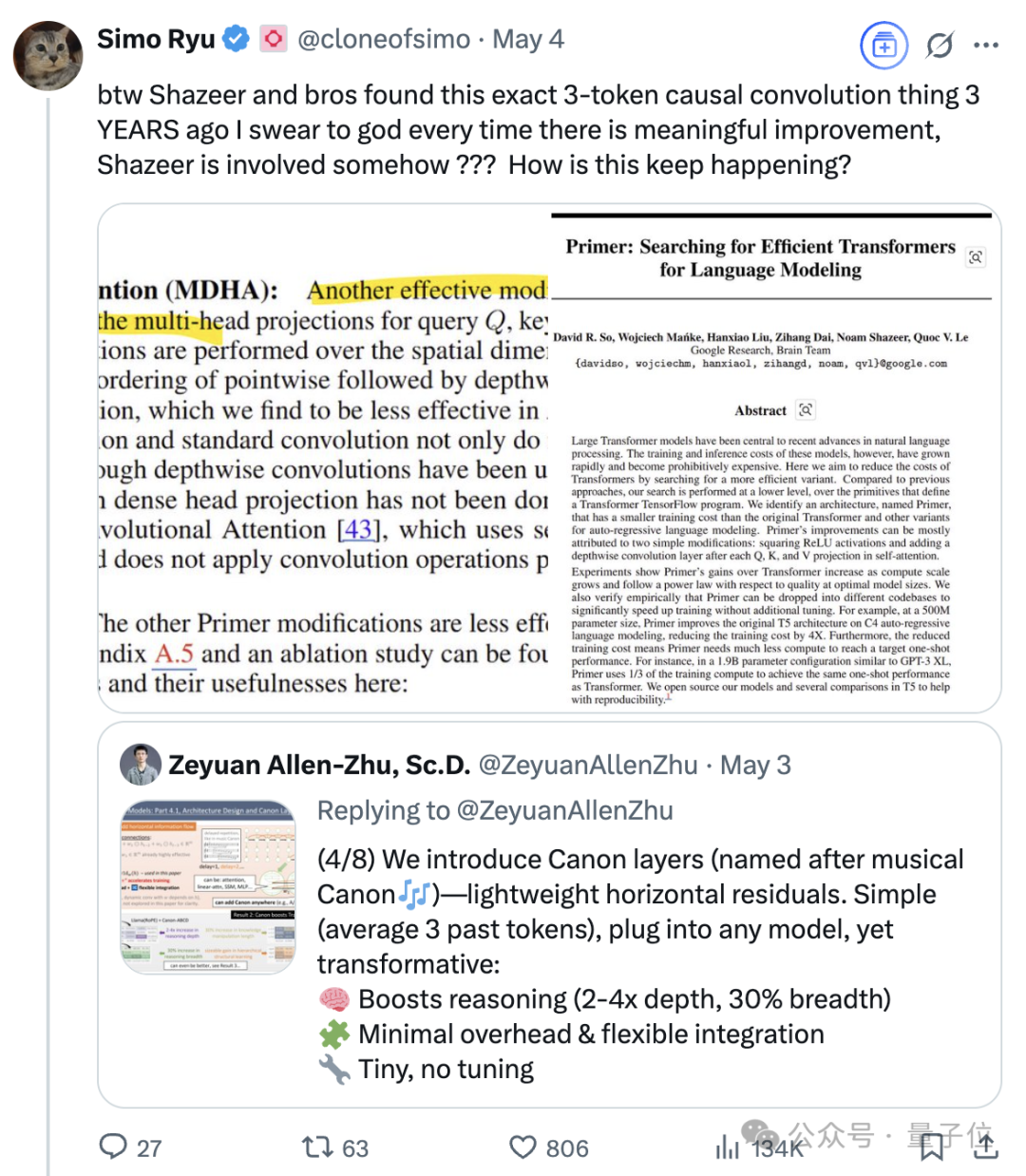

Noam Shazeer: Transformer 이면의 거장과 AI 기술의 진화: Noam Shazeer는 Transformer 아키텍처의 8명의 저자 중 한 명으로, 기여도가 가장 큰 인물로 인정받고 있습니다. 그의 연구는 현대 대형 언어 모델(LLM)의 기초를 다졌을 뿐만 아니라(예: 《Attention Is All You Need》), 혼합 전문가 모델(MoE), Adafactor 옵티마이저, 다중 쿼리 어텐션(MQA), 게이트 선형 유닛(GLU) 등 핵심 기술의 발전을 예견적으로 추진했습니다. 최근 그의 초기 연구 성과가 다시 주목받으며 그의 선구적인 기술 통찰력을 부각시키고 있습니다. Shazeer는 Character.AI를 공동 창업한 후 Google로 복귀하여 Gemini 프로젝트를 이끌며 AI 분야에 지속적으로 영향을 미치고 있습니다. (출처: 36氪)

ChatGPT 트래픽 급증, Google 검색 아성에 도전: Similarweb 데이터에 따르면, 2025년 4월 ChatGPT의 월간 방문량이 역성장세를 딛고 13.04% 증가하여 50억 회를 돌파, X(구 Twitter)를 제치고 전 세계 5위 웹사이트로 부상했으며, 상위 10개 웹사이트 중 유일하게 월간 플러스 성장을 기록한 플랫폼이 되었습니다. 이러한 추세는 ChatGPT로 대표되는 AI 애플리케이션이 사용자의 정보 획득 방식을 현저히 변화시키고 있으며, 특히 업무 및 학습 환경에서 사용자의 AI 도구 의존도가 날로 증가함에 따라 기존 검색 엔진에 실질적인 위협이 되고 있음을 보여줍니다. (출처: 36氪, Similarweb on X)

DeepSeek R1 출시 100일 만에 돌풍: AI 투자 및 창업 생태계 재편: 2025년 1월 출시 이후 DeepSeek R1은 저비용 오픈소스 전략으로 AI 분야에서 광범위한 주목을 받으며 투자 시장과 창업 생태계에 큰 영향을 미치고 있습니다. 이 모델은 AI 하드웨어, Agent 개발 등 스타트업에 새로운 발전 기회를 제공했을 뿐만 아니라, Kimi(月之暗面), Zhipu AI(智谱AI) 등 선두 기업들의 시장 전략 조정을 촉발하여 AI 애플리케이션 및 상용화 경쟁을 심화시켰습니다. 투자자들은 AI 애플리케이션과 구현 지능(embodied intelligence)에 대한 관심이 증가했지만, 대형 모델 기반 투자에는 더욱 신중한 태도를 보이며 시장의 관심이 다운스트림 애플리케이션으로 이동하고 있음을 나타냅니다. (출처: 36氪)

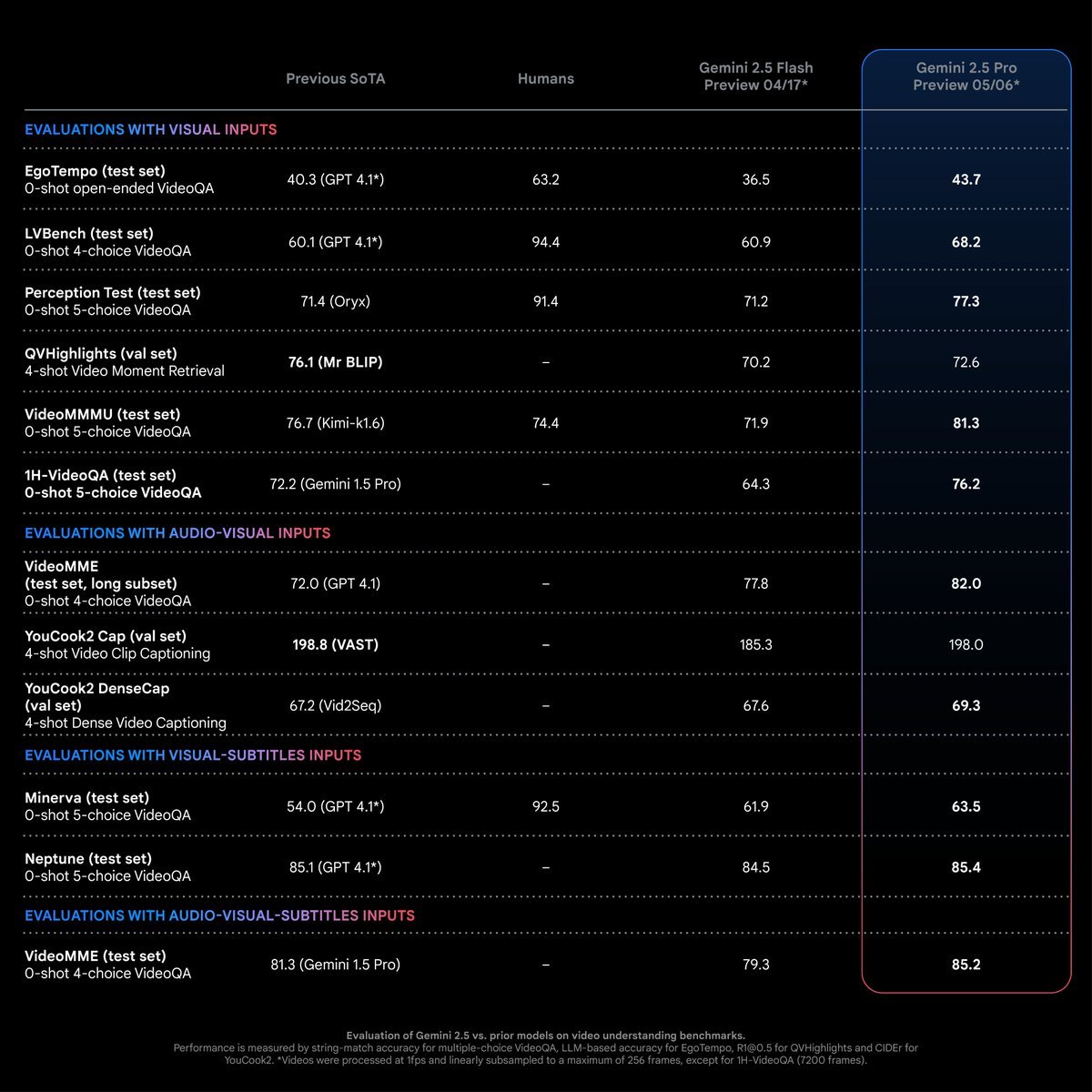

Gemini 2.5 Pro, 비디오 이해 능력에서 괄목할 만한 진전: Google Gemini 2.5 Pro는 비디오 이해 능력에서 뛰어난 성능을 보여주며, 기존 비디오 분석 작업에서 선두를 달릴 뿐만 아니라 새로운 응용 시나리오를 열었습니다. 비디오 이해 능력은 여러 테스트 세트에서 기존 SOTA 모델은 물론 인간 수준을 능가했습니다. Jeff Dean은 새로운 프레임당 66 tokens 모드(258 tokens 대체)를 통해 2M token 컨텍스트에서 6시간 이상의 비디오(1fps)를 처리할 수 있게 되어 장편 비디오 분석의 잠재력을 크게 확장했다고 지적했습니다. (출처: matvelloso, op7418, JeffDean)

논문 Absolute Zero: 외부 데이터 없이 강화 자가 학습을 통해 LLM 추론 능력 향상: 《Absolute Zero: Reinforced Self-play Reasoning with Zero Data》라는 논문은 외부 데이터에 의존하지 않고 단일 모델이 스스로 작업을 제안하고 해결하도록 하여 대형 언어 모델(LLM)의 추론 능력을 향상시키는 새로운 강화 학습 패러다임 “Absolute Zero”를 소개합니다. 이 시스템 AZR은 코드 실행기를 통해 작업과 답변을 검증하여 개방 루프 학습을 구현하며, 코딩 및 수학 추론 작업에서 SOTA 성능을 달성하여 AI의 자율적 진화 가능성을 보여주었습니다. (출처: Reddit r/LocalLLaMA, teortaxesTex)

🎯 동향

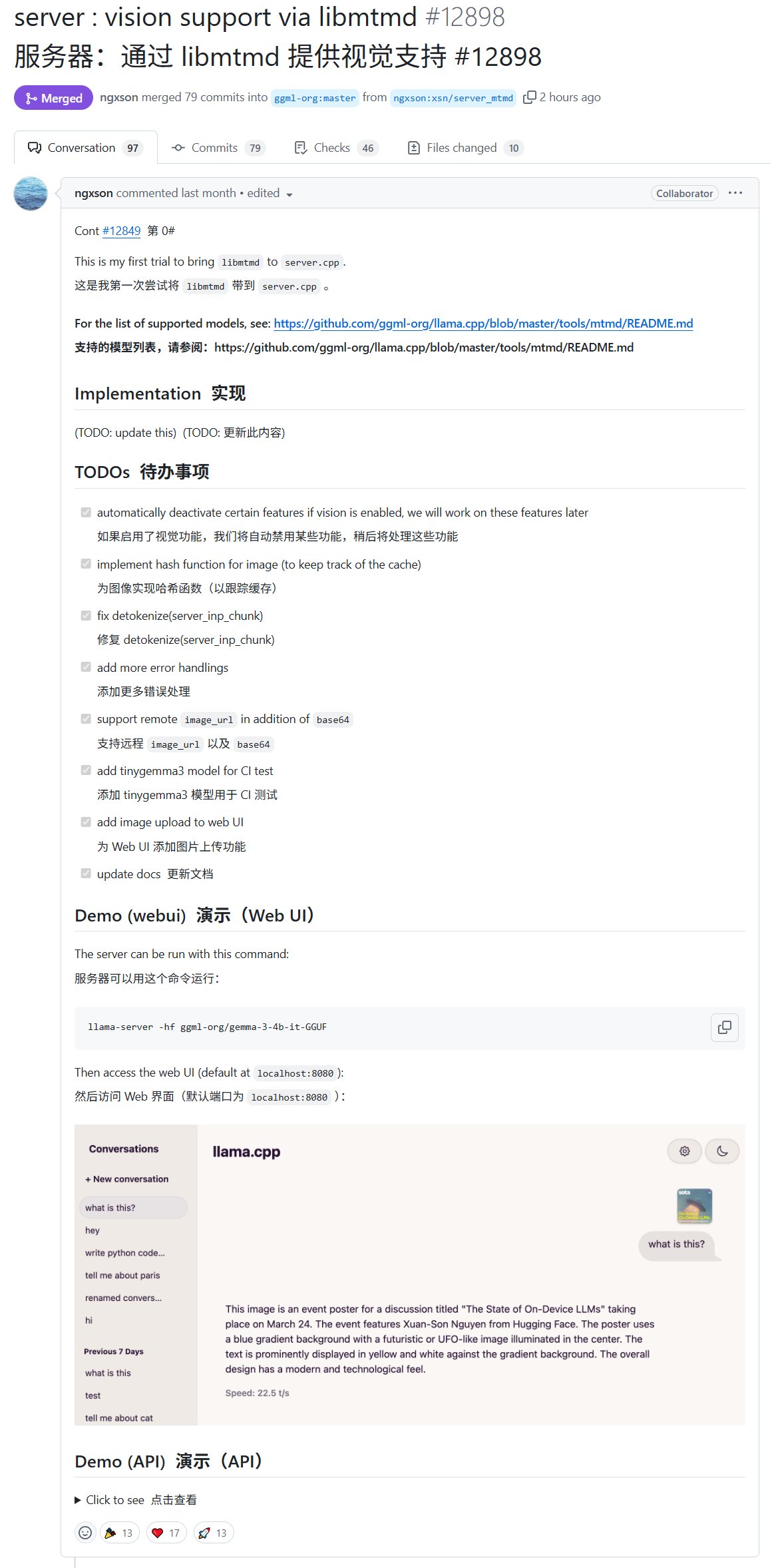

Llama.cpp 서버, 비전 모델 지원으로 로컬 멀티모달 애플리케이션 확장: Llama.cpp에 내장된 llama-server가 이제 비전 모델을 지원하여 사용자는 gguf로 양자화된 멀티모달 모델을 사용할 수 있게 되었습니다. Xuan-Son Nguyen (ngxson) 등이 기여한 이 중요한 업데이트는 로컬 장치에서 멀티모달 AI 애플리케이션을 실행하고 상호 작용하는 것을 더욱 편리하게 만들어 엣지 컴퓨팅 및 개인 정보 보호 시나리오에 중요한 의미를 갖습니다. (출처: karminski3, reach_vb, ggerganov, Reddit r/LocalLLaMA)

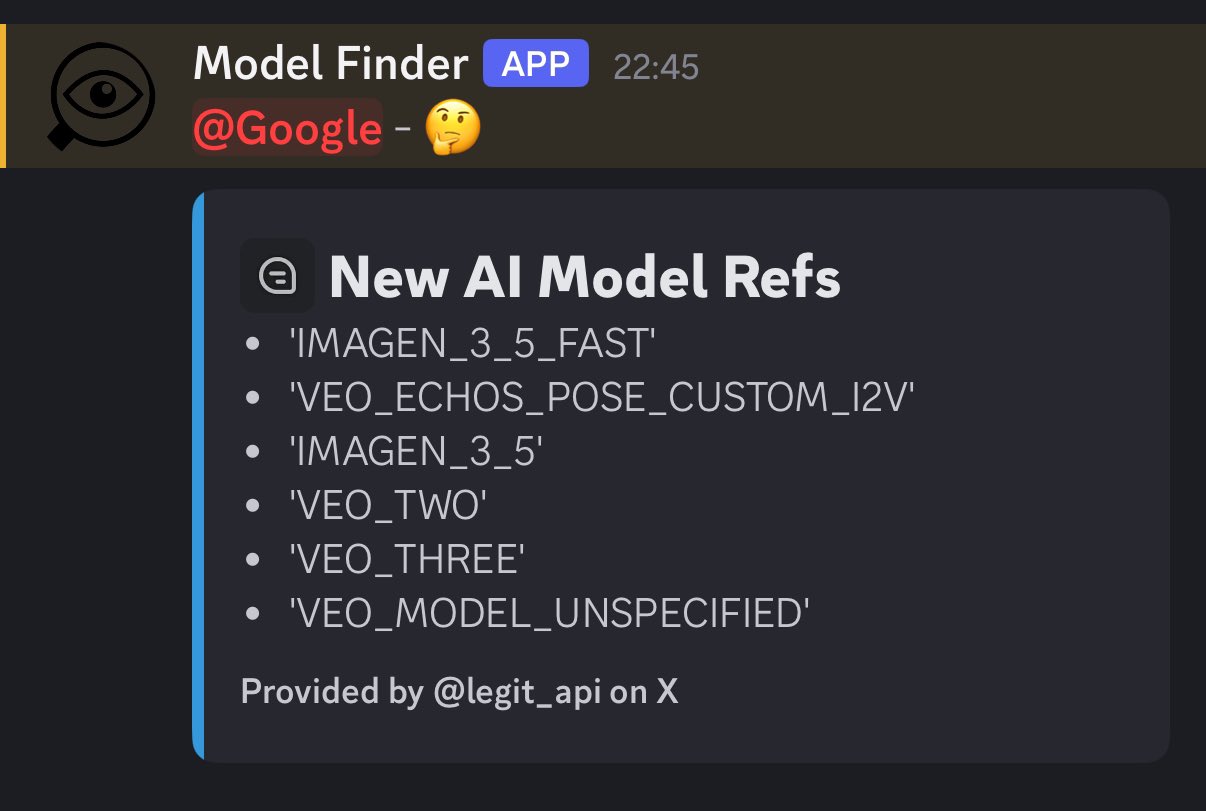

Google, I/O 컨퍼런스에서 새로운 이미지/비디오 모델 Veo 3.0 및 Imagen 4.0 발표 가능성: Google이 5월 I/O 컨퍼런스에서 veo-3.0-generate-preview, imagen-4.0-generate-preview-05-20, imagen-4.0-ultra-generate-exp-05-20 등 새로운 이미지 및 비디오 생성 모델을 발표할 계획이라는 소식이 있습니다. 이는 Google이 멀티모달 생성 분야에서 중요한 업데이트를 할 것임을 예고하며, 특히 Veo 3.0의 성능이 기대됩니다. (출처: op7418)

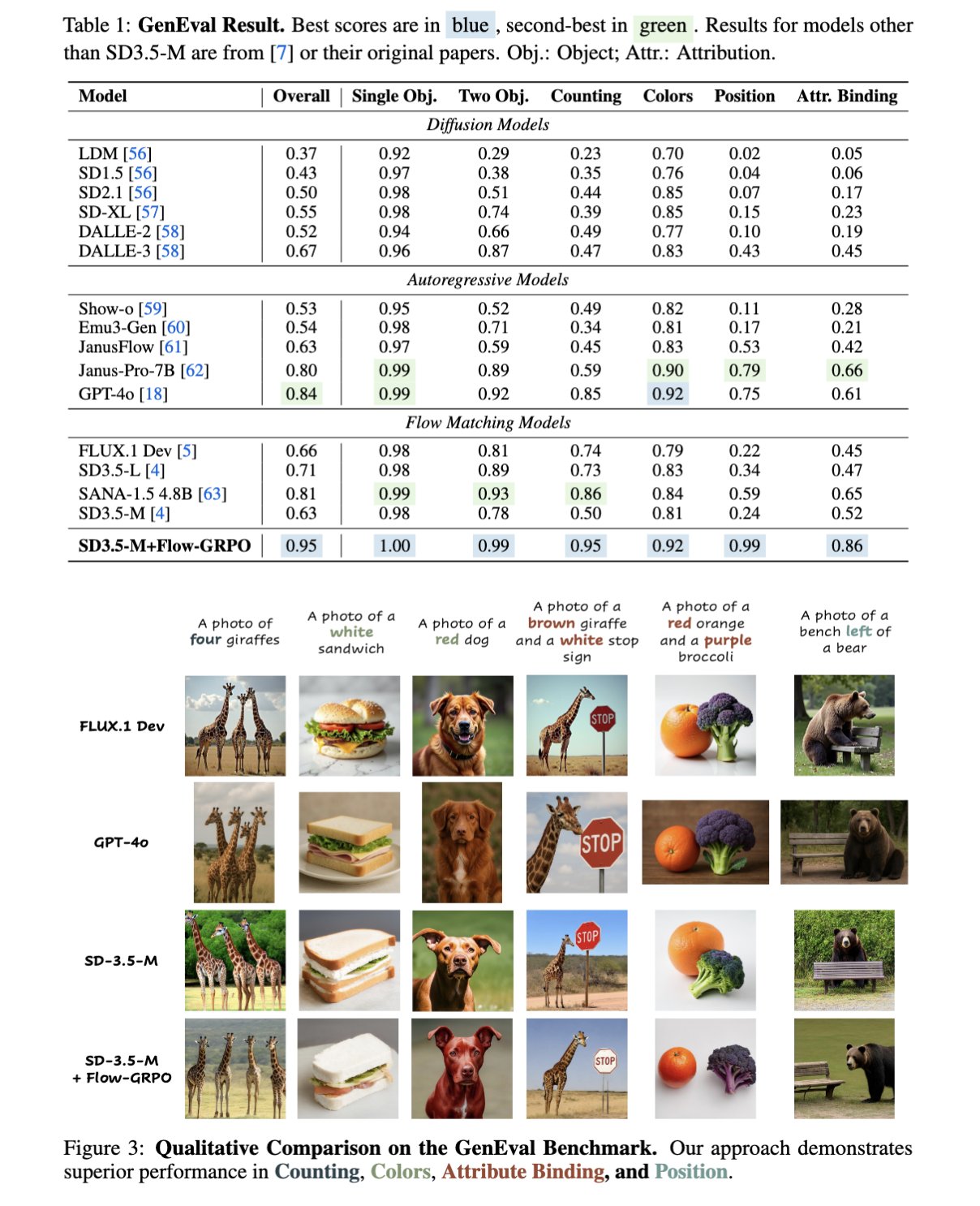

Flow-GRPO: 온라인 강화 학습을 결합하여 플로우 매칭 모델의 이미지 생성 개선: Flow-GRPO는 온라인 강화 학습(RL)을 플로우 매칭 모델에 처음으로 통합한 새로운 방법입니다. 실험 결과, RL로 조정된 SD3.5는 이미지 생성 시 객체 수, 공간 관계 및 세부 속성의 정확성이 거의 완벽에 가까워 텍스트-이미지 생성 작업의 프롬프트 준수성과 생성 품질을 크게 향상시켰습니다. (출처: teortaxesTex)

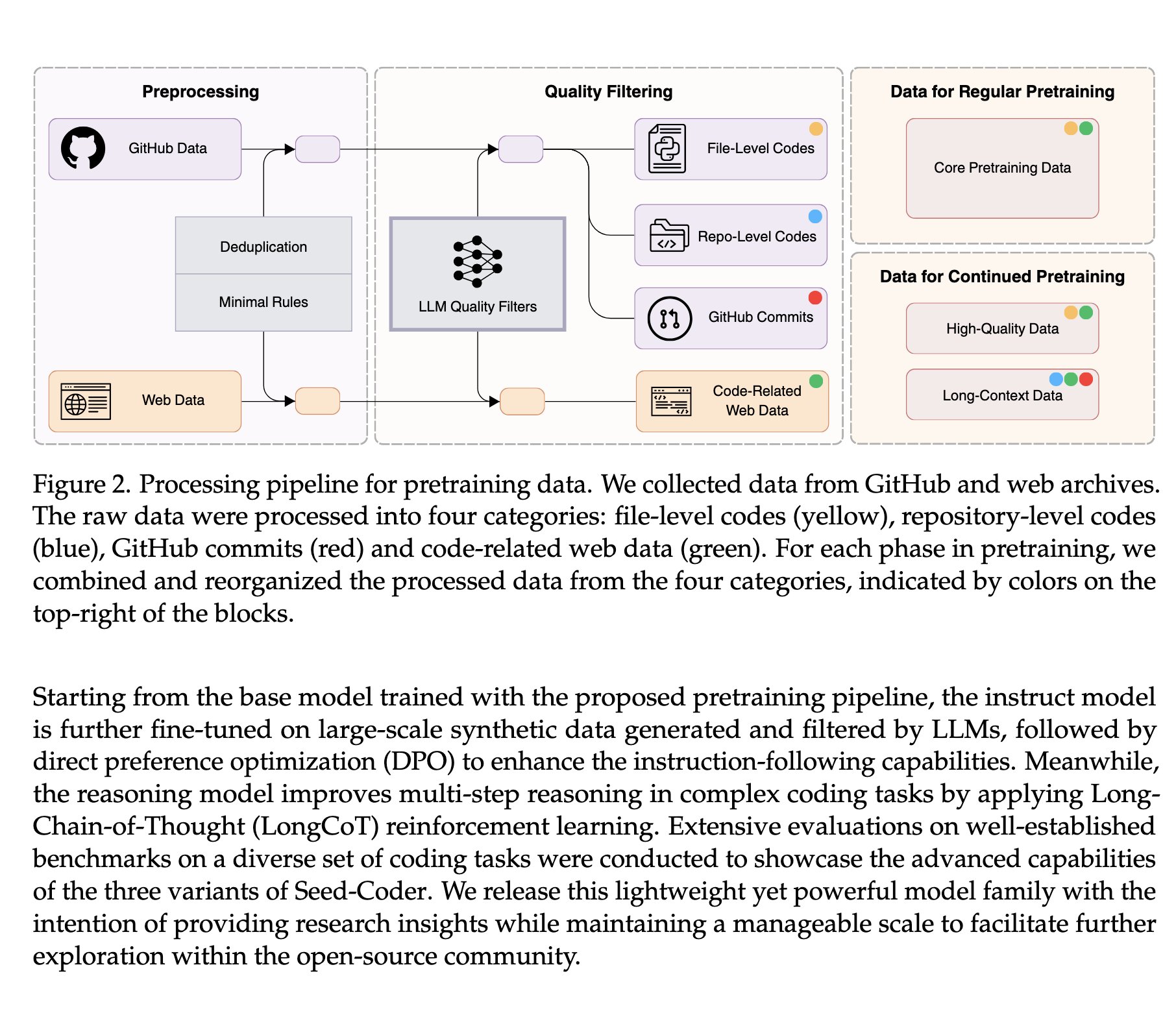

ByteDance, Seed-Coder-8B 오픈소스 공개: 코드 모델의 자체 데이터 관리로 SOTA 달성: ByteDance의 Seed 팀은 Base, Instruct, Reasoner 버전을 포함하는 Seed-Coder-8B 시리즈 코드 대형 모델을 출시했습니다. 이 모델은 6T tokens 데이터로 학습되었으며, 핵심 혁신은 “코드 모델이 스스로 데이터를 큐레이션하도록 하는 것”으로 SOTA 데이터 처리 방법을 구현하여 Qwen3-8B를 능가하는 성능을 달성했습니다. 이는 자동화된 데이터 관리가 코드 LLM의 능력 향상에 엄청난 잠재력을 가지고 있음을 보여줍니다. (출처: Dorialexander, scaling01)

Google AI, 도시 교통 지능화를 목표로 Mobility AI 출시: Google AI는 인공지능 기술을 활용하여 도시 교통 시스템을 개선하는 데 주력하는 Mobility AI 프로젝트를 발표했습니다. 이 프로젝트는 교통 흐름 최적화, 대중교통 스케줄링, 자율 주행 협력 등 다양한 측면을 포괄하여 교통 효율성, 안전성 및 지속 가능성을 향상시키는 것을 목표로 할 수 있습니다. (출처: Ronald_vanLoon)

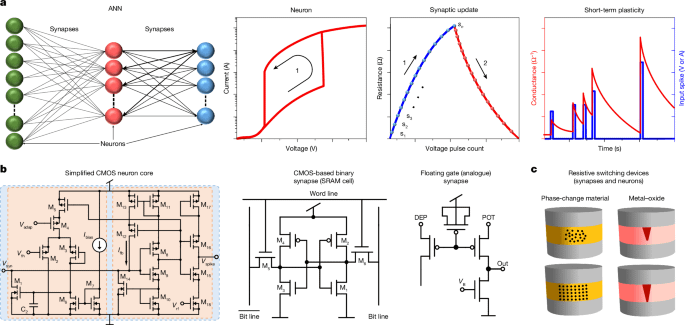

단일 트랜지스터로 뉴런 모방 연구 진전: 《Nature》에 발표된 한 논문은 단일 트랜지스터가 뉴런 하나의 기능을 모방할 수 있다고 지적했습니다. 이것이 단기적으로 PC가 초인적 지능을 실행할 수 있다는 의미는 아니지만(시냅스도 트랜지스터가 필요하기 때문), 이 연구는 미래 프로세서 설계와 뉴로모픽 컴퓨팅에 새로운 아이디어를 제시하며, 향후 몇 년 안에 AI 하드웨어에 큰 영향을 미칠 수 있습니다. (출처: Reddit r/LocalLLaMA)

MIT 연구, AI를 활용하여 항공 교통 계획 강화: MIT 연구원들은 인공지능 기술을 이용하여 항공 교통의 계획 및 관리를 개선하고 있습니다. 이는 항로 최적화, 공역 이용 효율성 향상, 잠재적 충돌 예측 및 대응 등을 포함할 수 있으며, 항공 교통을 더욱 효율적이고 안전하게 만드는 것을 목표로 합니다. (출처: Ronald_vanLoon)

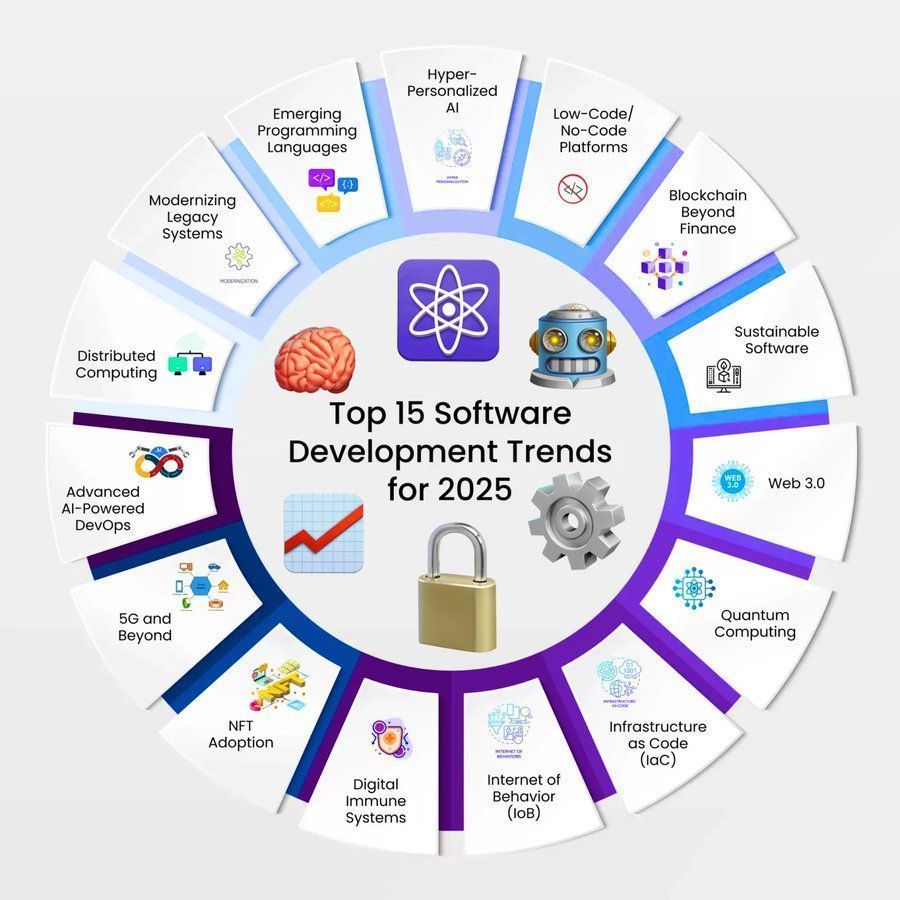

AI의 소프트웨어 개발 분야 동향 전망 (2025): 보고서는 2025년 소프트웨어 개발의 15가지 주요 동향을 예측했으며, 그중 인공지능, 딥러닝, 머신러닝이 계속해서 핵심적인 역할을 수행하며 자동화, 지능형 코딩, 테스트 및 운영 등의 발전을 주도할 것이라고 전망했습니다. (출처: Ronald_vanLoon)

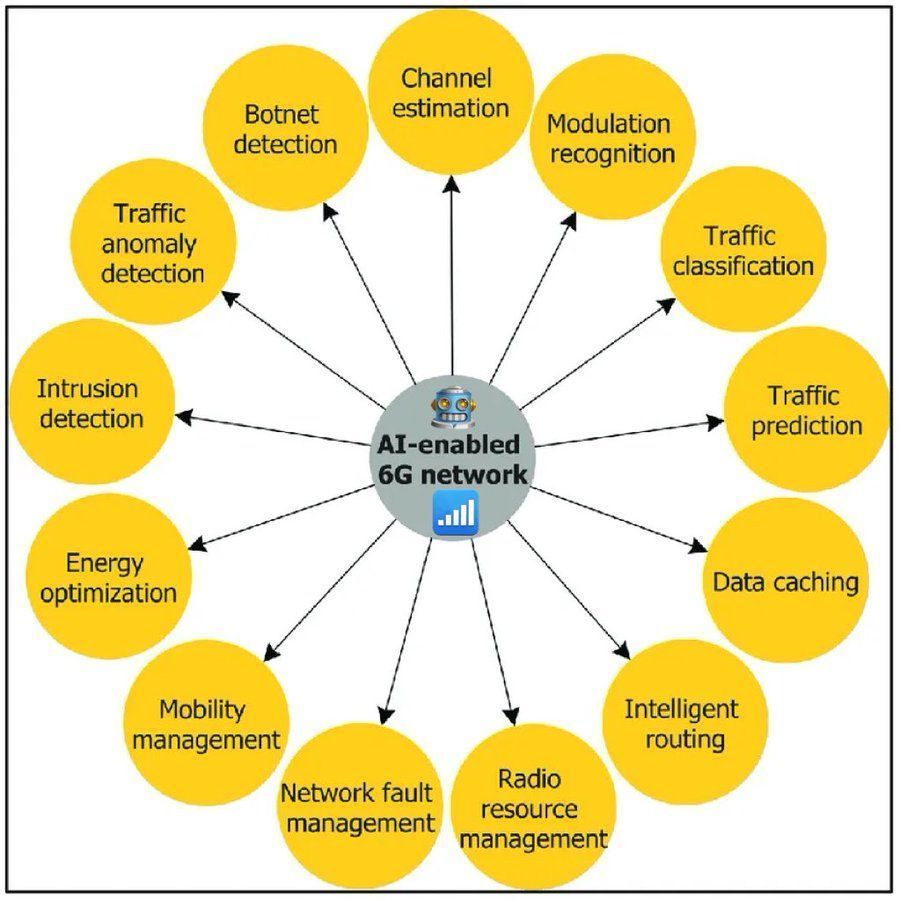

AI 기반 6G 네트워크 전망: 미래 6G 네트워크에서 인공지능의 핵심적인 역할에 대해 논의했습니다. 지능형 자원 할당, 네트워크 자가 최적화, 개인화 서비스 및 대규모 사물인터넷(IoT) 장치 연결 지원 등 AI는 6G 비전을 실현하는 핵심 기술이 될 것입니다. (출처: Ronald_vanLoon)

DeepMind 연구원, LLM이 이미 부분적인 세계 모델 능력 갖췄다고 주장: DeepMind 연구원 Sam Wolfstone은 대형 언어 모델(LLM)이 사전 훈련 및 사후 훈련 과정에서 많은 제한적이고 국지적인 세계 모델을 구축한다고 주장합니다. 모델이 작업을 해결하는 능력은 해당 작업에 대한 부분 세계 모델의 모델링 정도와 관련이 있지만, 현재 LLM은 새로운 부분 세계 모델을 동적으로 개발할 수는 없습니다. (출처: SamWolfstone)

OpenAI, 강화 학습(RL) 적용 확대에 주력: OpenAI의 Dan Roberts는 Sequoia AI Ascent 강연에서 회사가 강화 학습(RL)이 단지 “금상첨화”로 여겨지는 전통적인 인식을 바꾸고 더 광범위한 응용 시나리오로 확장하기 위해 어떻게 노력하고 있는지 공유했습니다. (출처: jeffreygwang)

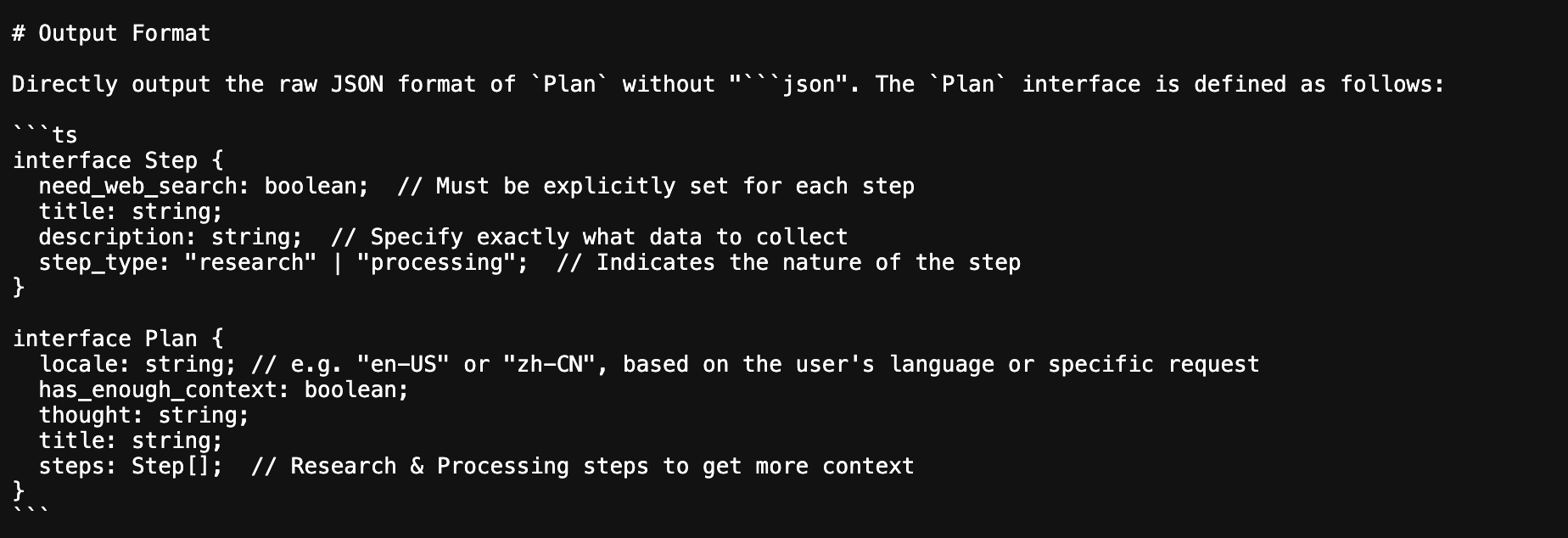

ByteDance Deep Research Agent, Typescript 인터페이스를 사용하여 JSON 출력 스키마 정의: ByteDance가 오픈소스로 공개한 Deep Research Agent를 분석한 결과, 이 프로젝트는 Typescript 인터페이스를 사용하여 JSON 출력 스키마를 강제적으로 정의하고 표준화하는 것으로 나타났습니다. 이 방법은 다중 Agent 협업 시 데이터 교환의 안정성과 신뢰성을 높이는 데 도움이 됩니다. (출처: _philschmid)

🧰 도구

WebOllama: Ollama를 위한 간결한 웹 사용자 인터페이스: WebOllama는 로컬 대형 언어 모델(LLM)의 관리 및 사용을 단순화하기 위해 Ollama용으로 설계된 웹 인터페이스입니다. Ollama 모델 관리, AI 채팅 및 텍스트 생성을 위한 직관적인 UI를 제공하여 사용자가 로컬 환경에서 LLM과 편리하게 상호 작용할 수 있도록 합니다. (출처: Reddit r/LocalLLaMA, GitHub)

ArchAI: CrewAI 및 Qdrant 기반 코드 저장소 AI 분석 및 문서 생성 도구: ArchAI는 AI Agent를 활용하여 코드 저장소를 해석하는 도구입니다. 코드를 자동으로 복제, 분석하고 문서 및 PlantUML 다이어그램을 생성할 수 있습니다. ArchAI는 CrewAI를 기반으로 AI Agent를 구축하고 Qdrant를 사용하여 컨텍스트를 저장하며 SonarQube를 통합하여 코드 품질을 검사하고 로컬 또는 클라우드 LLM(예: OpenAI, Gemini, Ollama)을 지원합니다. (출처: qdrant_engine, GitHub)

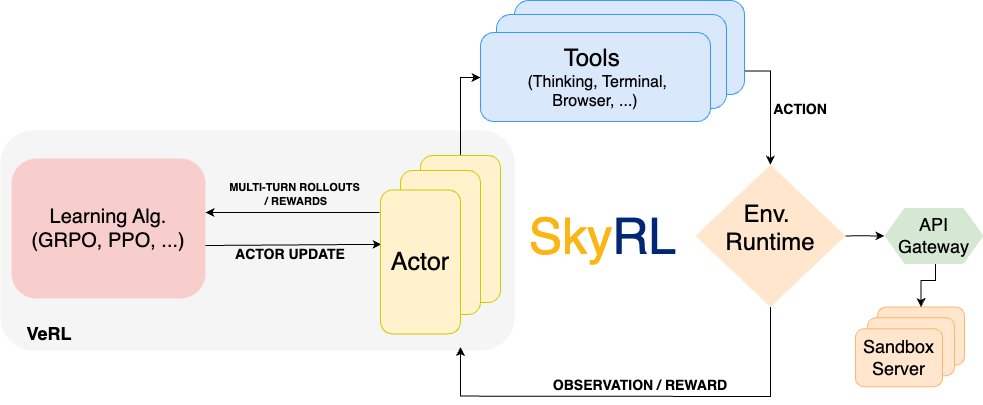

SkyRL: 장기 작업에 최적화된 강화 학습 훈련 파이프라인 출시: UC Berkeley RISE 팀은 VeRL 및 OpenHands를 기반으로 구축된 강화 학습(RL) 훈련 파이프라인인 SkyRL을 출시했습니다. 이는 특히 SWE-Bench와 같은 장기 작업에 최적화되었습니다. SkyRL은 Agent 계층을 도입하여 효율적인 다중 라운드 추론, 도구 사용 및 확장 가능한 환경 실행을 지원하며 시각화를 위해 W&B를 통합했습니다. (출처: weights_biases)

RunwayML Gen-1 업데이트, 더욱 직관적인 비디오 생성 제어 제공: RunwayML의 Gen-1 비디오 생성 도구가 업데이트되어 더욱 정확하고 직관적이며 일반적인 제어 방식을 제공합니다. 사용자는 이러한 새로운 기능을 무료로 체험할 수 있으며 향후 더 많은 업데이트가 있을 예정입니다. (출처: c_valenzuelab)

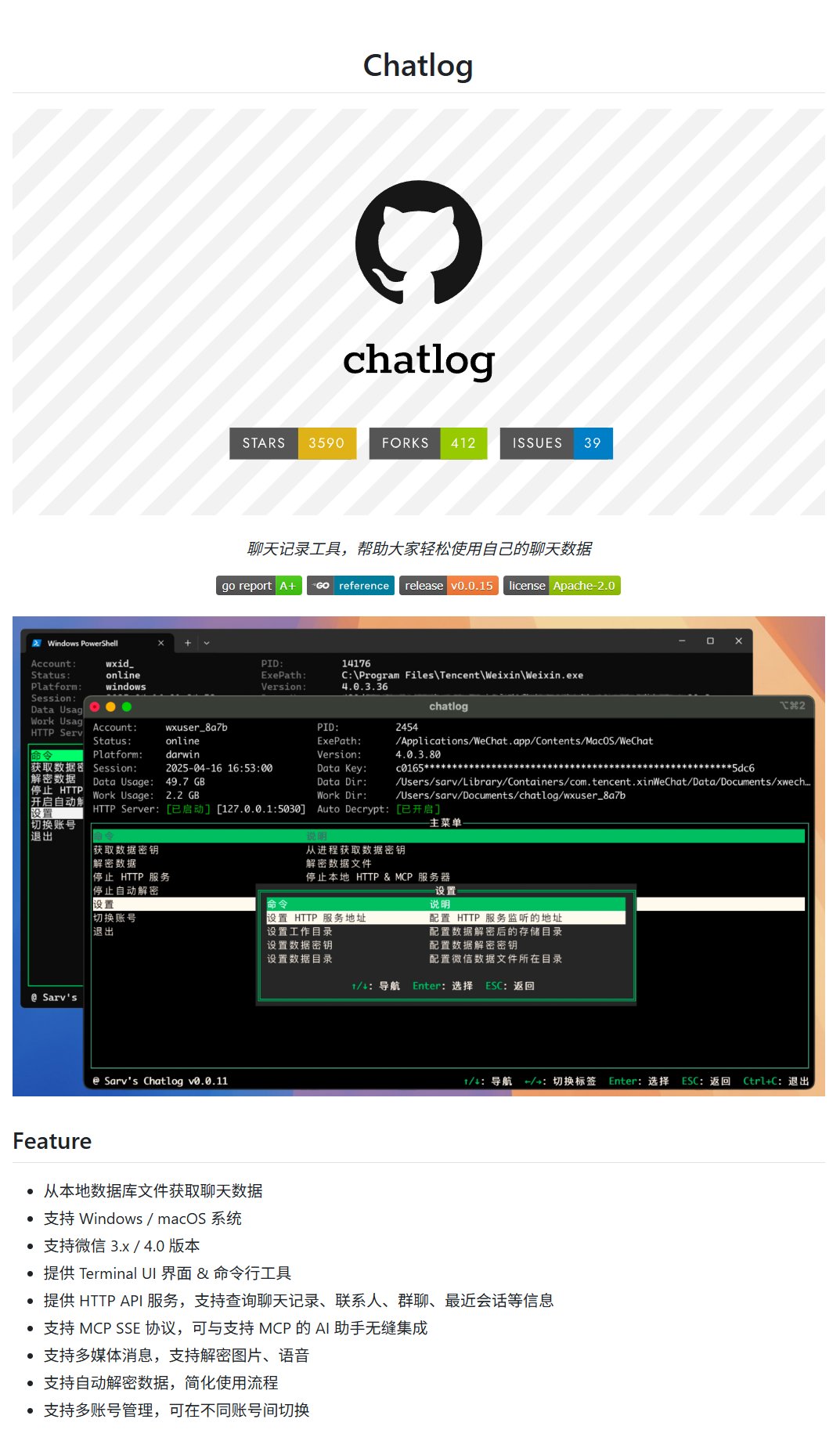

Chatlog: 위챗(WeChat) 채팅 기록 내보내기 도구: Chatlog는 이미지, 비디오, 오디오를 포함한 위챗 채팅 기록 내보내기를 지원하는 프로젝트이며 다중 계정 작업도 지원합니다. 이는 사용자가 개인 데이터를 백업하거나 채팅 데이터를 디지털 휴먼 구축 등 AI 애플리케이션에 활용하는 데 편의를 제공합니다. (출처: karminski3)

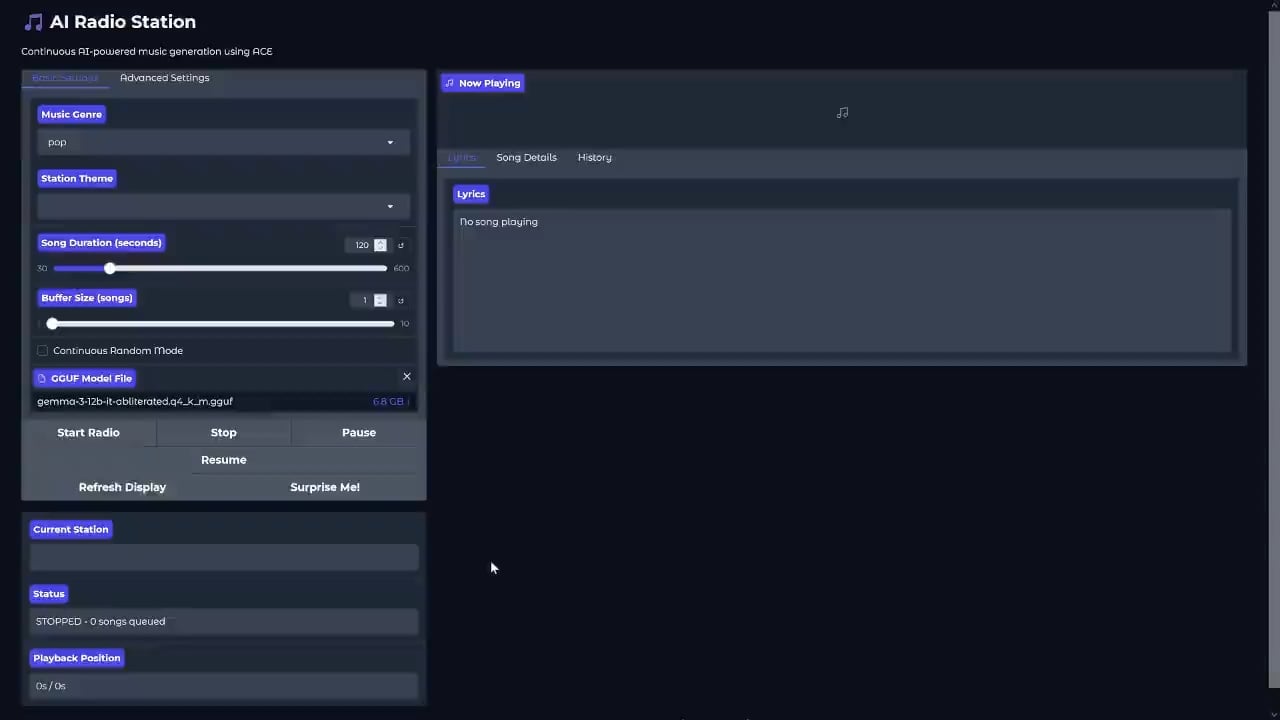

로컬 AI 라디오 프로젝트 ACE-Step-RADIO 출시: PasiKoodaa는 GitHub에 ACE(Agentic Communication Environment) 프레임워크를 사용한 로컬 AI 라디오 애플리케이션인 ACE-Step-RADIO 프로젝트를 출시했습니다. 이론적으로 24GB VRAM에서 원활하게 실행되며 DIA와 같은 AI 아나운서 기능을 쉽게 통합할 수 있어 개인화된 콘텐츠 생성에 새로운 아이디어를 제공합니다. (출처: Reddit r/LocalLLaMA, GitHub)

qxresearch-event-1: Python 미니 애플리케이션 모음: GitHub 프로젝트 qxresearch-event-1은 알림, 녹음, 그림판, 비밀번호 생성기 등 다양한 기능을 갖춘 50개 이상의 10줄 Python 코드로 작성된 애플리케이션을 수록하여 Python 초보자와 애호가에게 간단하고 실용적인 코드 예제를 제공합니다. (출처: karminski3)

폴란드어 4B 언어 모델 Polanka 출시: Piotr-AI는 Qwen3 아키텍처 기반의 4B 매개변수 폴란드어 언어 모델 Polanka (polanka_4b_v0.1_qwen3_gguf)를 출시했습니다. 이 모델은 단일 RTX 4090에서 Qwen3 4B 기본 모델을 약 10일간 지속적으로 사전 훈련하여 제작되었으며, 고품질 폴란드어 콘텐츠 및 다국어, 수학, 코드 등 혼합 데이터셋(총 약 1.4B tokens)을 사용했습니다. GGUF 형식을 통해 노트북에서 빠르게 실행할 수 있습니다. (출처: Reddit r/LocalLLaMA)

Arlo 보안 카메라, AI 비디오 요약 기능 추가: Arlo는 보안 카메라 시스템에 새로운 인공지능 기능을 추가하여 카메라가 녹화한 비디오 내용을 자동으로 요약하고 사용자가 주요 사건을 빠르게 파악하도록 도와 가정 보안의 편의성과 효율성을 향상시킵니다. (출처: Reddit r/artificial)

Gemini 2.0 Flash Preview, 이미지 생성 및 편집 기능 추가: Google이 최근 출시한 Gemini 2.0 Flash Preview 모델은 이미지 생성 및 편집을 지원합니다. 사용자는 다중 대화에서 이미지를 편집할 수 있으며, 문서는 새로운 모델의 이러한 기능을 보여주도록 업데이트되었습니다. (출처: _philschmid)

📚 학습

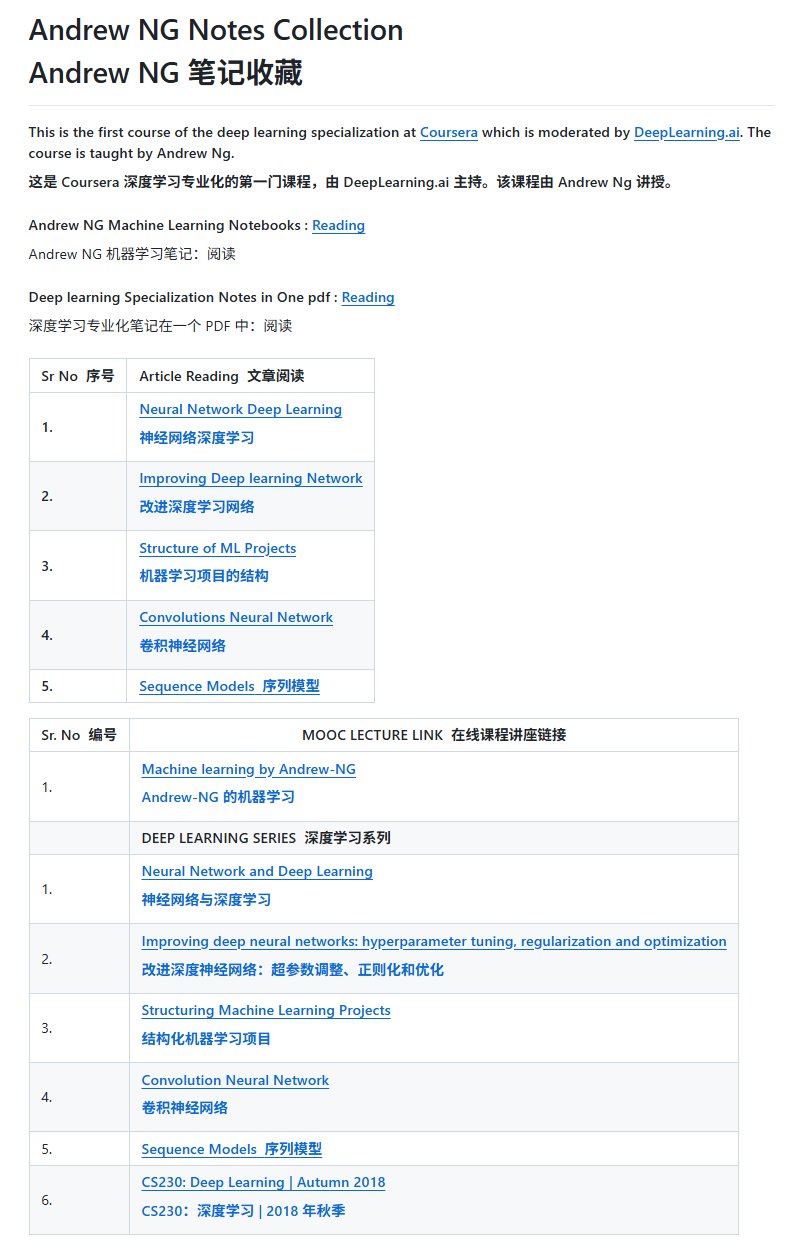

앤드류 응(Andrew Ng) 딥러닝 노트 정리 프로젝트: GitHub에 앤드류 응의 딥러닝 강좌 노트 정리 프로젝트(Andrew-NG-Notes)가 등장했습니다. 딥러닝 입문 및 체계적인 학습을 원하는 학생들이 Coursera 강좌와 함께 사용하기에 적합하며, 현재 많은 관심을 받고 있습니다. (출처: karminski3)

Microsoft, 생성형 AI 입문 튜토리얼 공개: Microsoft는 초보자가 대형 언어 모델의 기본 원리를 이해하고 프로그램을 사용하여 Agent/RAG 플랫폼을 구축하는 방법을 안내하는 “생성형 AI 입문 (generative-ai-for-beginners)” 튜토리얼을 출시했습니다. 이 GitHub 저장소는 82k 이상의 별표를 받아 인기를 얻고 있습니다. (출처: karminski3)

무료 수학 교재 《컴퓨터 과학 및 머신러닝을 위한 대수학, 위상수학, 미적분학 및 최적화 이론》: Jean Gallier와 Jocelyn Quaintance가 공동 저술한 무료 전자책으로, 컴퓨터 과학 및 머신러닝에 필요한 핵심 수학 기초를 포괄적으로 다룹니다. 선형 대수학, 아핀 및 사영 기하학, 쌍선형 형식 기하학, 위상수학 및 미적분학, 선형 및 비선형 최적화를 포함하며 머신러닝 응용 예제도 포함되어 있습니다. (출처: TheTuringPost)

전문대학 AI 교양 수업 교육 제안: 전문대학 AI 교양 수업이 전 과정 실습실에서 진행되는 상황에 대해, 수업의 중점을 생성형 AI의 응용, 특히 텍스트 및 이미지/비디오 생성에 두어야 한다는 제안이 있습니다. 초급(질의응답, 요약, 번역), 중급(작문, 데이터 추출, AI 검색/RAG)에서 고급(AI 보조 프로그래밍, 데이터 분석)에 이르는 일련의 과제를 설정하여 학생들이 실습을 통해 배우고 흥미를 키우며 이론 지식을 자율적으로 보충하도록 합니다. (출처: dotey)

💼 비즈니스

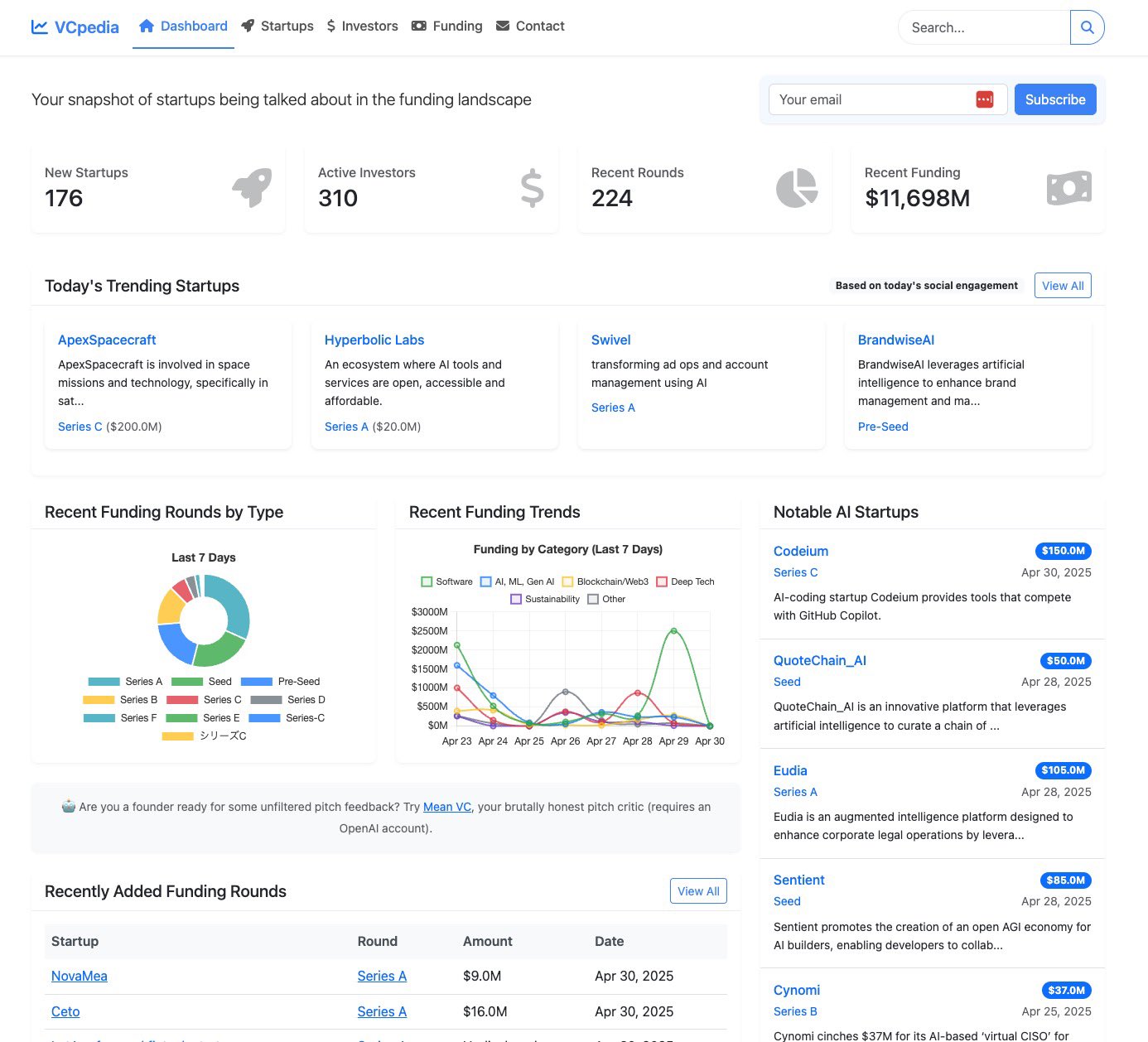

VCpedia: AI 기반 스타트업 정보 플랫폼: Yohei Nakajima는 VCpedia를 출시했습니다. 이는 AI를 활용하여 X 플랫폼의 스타트업 투자 논의를 분석하고, OpenAI 및 ExaAI와 결합하여 정보를 강화하며, Replit Agent를 통해 구축된 일일 브리핑 서비스입니다. 이 플랫폼은 벤처 캐피털에 AI 기반 거래 발굴 및 통찰력을 제공하는 것을 목표로 합니다. (출처: yoheinakajima)

OpenAI, ChatGPT API 가격 정책 조정 가능성 루머: ChatGPT가 API 가격을 조정하여 크레딧(credits) 기반 과금 모델(예: 50 credits/달러, 최소 20달러, 최대 1000달러)을 도입할 수 있다는 소문이 있습니다. 이러한 잠재적 변화는 사용자들의 우려를 불러일으켰으며, 일부 사용자는 Plus 및 Pro 사용자도 이 가격으로 API 비용을 지불해야 한다면 Grok이나 Gemini와 같은 경쟁 제품으로 전환을 고려할 것이라고 밝혔습니다. (출처: scaling01)

중국 Baidu, AI 동물 소리 해석 특허 출원: 중국 기술 대기업 Baidu는 인공지능 시스템을 이용하여 동물 소리를 해석하는 특허를 출원 중입니다. 이 기술이 성공하면 동물 행동 연구, 종 보호 및 인간과 동물 간의 소통 등 분야에서 새로운 가능성을 열 수 있습니다. (출처: Reddit r/artificial)

🌟 커뮤니티

사용자들, AI가 대인 관계 및 정신 건강에 미치는 영향 논의: Reddit의 한 게시물 “ChatGPT 때문에 어머니를 잃었습니다”가 화제가 되었습니다. 게시자는 어머니가 ChatGPT와의 소통에 빠져 가족 관계가 소원해지고 심지어 AI에 정서적으로 의존하게 되었다고 주장했습니다. 댓글에서는 AI가 정서적 욕구를 충족시키는 것, 현실의 외로움, 기술 소외, 기술 사용과 대인 관계의 균형을 맞추는 방법 등에 대해 논의했습니다. 많은 댓글은 어머니가 원래 외로움을 느꼈을 수 있으며 AI가 단지 정서적 공백을 메웠을 뿐이라고 지적하며 게시자에게 어머니와 더 많이 소통하고 함께 시간을 보내라고 조언했습니다. (출처: Reddit r/ChatGPT)

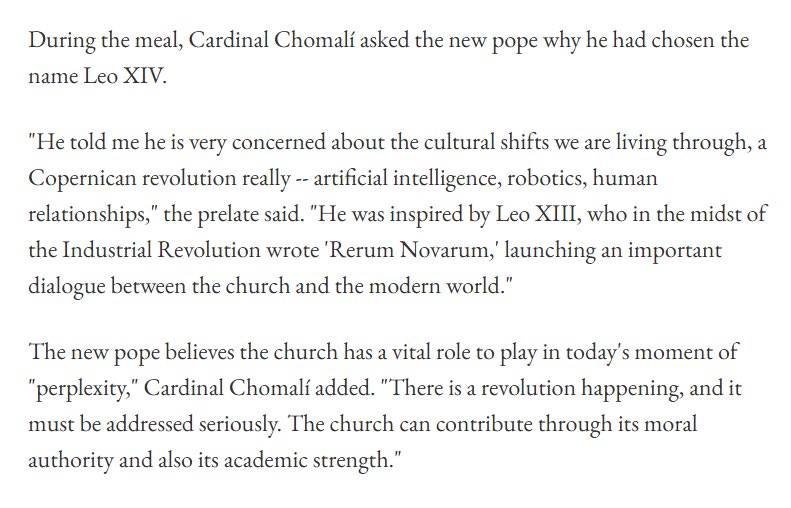

새 교황, “레오 14세” 명칭 선택에 AI 발전 영향 가능성: 새롭게 선출된 교황이 “레오 14세”를 자신의 명칭으로 선택한 것은 부분적으로 인공지능, 로봇 기술 등 문화적 변화에 대한 깊은 관심 때문이라는 보도와 논의가 있습니다. 그는 산업 혁명 시기 《새로운 사태》(Rerum Novarum) 회칙을 발표한 레오 13세에게서 영감을 받아, 현재의 기술 혁명 시대에 교회가 도덕적 권위와 학문적 역량을 발휘하여 사회가 변화에 진지하게 대응하도록 이끌어야 한다고 생각합니다. 이 주제는 AI 윤리, 사회적 영향 및 종교 기관이 기술 발전에 어떻게 적응해야 하는지에 대한 성찰을 불러일으켰습니다. (출처: jpt401, AndrewLampinen, jachiam0, itsclivetime)

AI 생성 “이상적인 여성” 이미지 논란: Reddit 사용자가 ChatGPT에게 자신에 대한 이해를 바탕으로 “이상적인 여성” 이미지를 생성하도록 요청한 결과, 대부분 갑옷을 입은 여성 이미지가 나왔습니다. 이는 커뮤니티 회원들이 각자의 AI 생성 결과를 모방하고 공유하며 AI의 “이상” 개념에 대한 이해, 사용자 데이터가 생성 콘텐츠에 미치는 영향, AI 생성 이미지의 일반적인 편견이나 패턴에 대해 논의하는 계기가 되었습니다. (출처: Reddit r/ChatGPT)

AI 이미지 생성 “피규어와 실물 인물 동시 프레임” 아이디어: 소셜 미디어 사용자가 AI를 사용하여 애니메이션 피규어와 해당 실제 인물을 유사한 자세로 한 프레임에 생성한 이미지를 공유하고 프롬프트를 제공했습니다. 이러한 아이디어는 AI의 이미지 생성 분야에서의 재미와 사용자 정의 가능성을 보여주며, 사용자의 구체적인 설명에 따라 생활감 넘치고 대비 효과가 있는 시각 작품을 만들 수 있음을 보여줍니다. (출처: dotey)

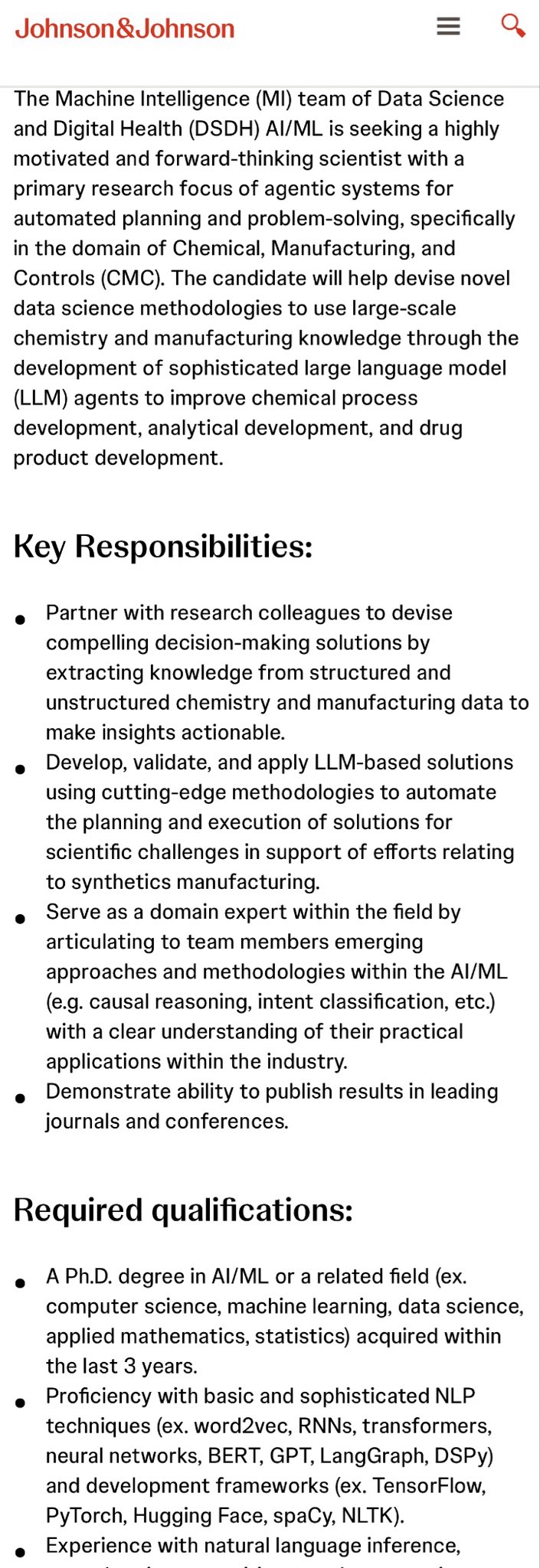

AI/ML 분야에서 DSPy 프레임워크 채용 수요 증가: 채용 시장에서 DSPy(프로그래밍 방식으로 언어 모델 프롬프트와 가중치를 최적화하는 프레임워크) 경험을 갖춘 인재에 대한 수요가 증가하고 있습니다. 이는 업계가 보다 제어 가능하고 효율적이며 알고리즘 최적화가 가능한 언어 모델 애플리케이션 구축을 중시하고 있음을 반영합니다. (출처: lateinteraction)

직장 내 AI 활용 현황 및 수용도 논의: Reddit 사용자들이 직장에서 AI를 사용하는 상황과 이에 대한 고용주 및 동료들의 견해를 논의했습니다. 대부분의 사용자는 AI가 프로그래밍 보조, 이메일 보고서 작성, 회의록 작성, 시장 조사 등 업무 효율성을 효과적으로 향상시킨다고 밝혔습니다. 일부 회사는 AI 사용을 장려하는 반면, 다른 회사는 신중하거나 반대하는 태도를 보여 직원들이 조용히 사용하는 경우가 있습니다. 논의에서는 생산성 향상 측면에서 AI의 잠재력을 강조하는 동시에 AI 능력에 대한 올바른 인식과 데이터 보안 문제도 다루어졌습니다. (출처: Reddit r/ArtificialInteligence)

AI가 Reddit의 핵심 경쟁력인 인간 상호작용을 잠식하고 있는가: Business Insider 기사는 Reddit CEO가 인간 주도 커뮤니티를 가장 큰 경쟁 우위로 보고 있지만, AI 봇이 생성한 게시물과 댓글이 이러한 우위를 위협하고 있다고 지적했습니다. Reddit은 문제를 인정하고 사용자 신원 확인을 위한 새로운 메커니즘을 도입할 계획이라고 밝혔으며, 이는 AI 콘텐츠 범람, 커뮤니티의 진정성, 미래 네트워크 플랫폼이 AI 생성 콘텐츠에 어떻게 대응할 것인지에 대한 논의를 불러일으켰습니다. (출처: Reddit r/artificial, Business Insider)

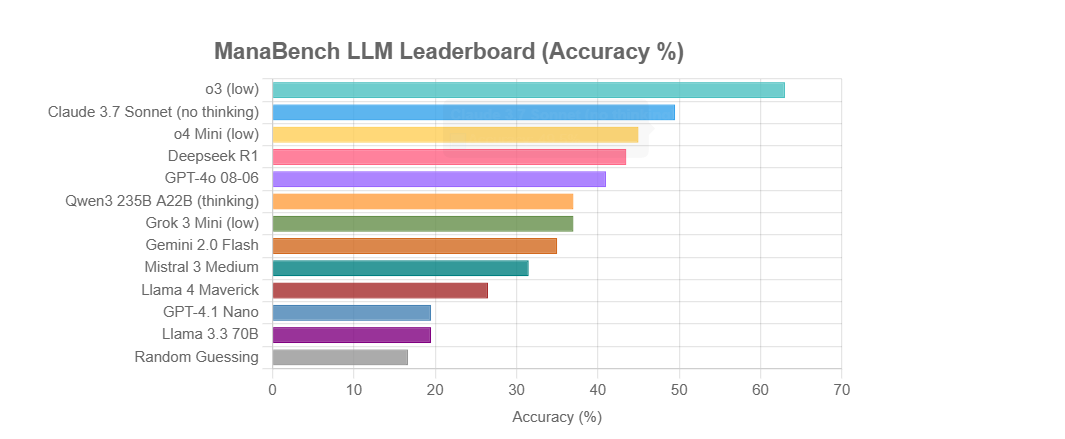

ManaBench: 《매직: 더 개더링》 덱 구축을 통해 LLM 추론 능력 테스트하는 새로운 벤치마크: Jake Boggs는 《매직: 더 개더링》 덱 구축 작업을 통해 대형 언어 모델(LLM)의 추론 능력을 테스트하는 새로운 벤치마크인 ManaBench를 발표했습니다. 이 벤치마크는 게임 지식에 초점을 맞추기보다는 모델의 전략적 추론 및 시스템 이해 능력을 평가하며, 사용자 경험과 관련된 모델 차별성을 제공하는 것을 목표로 합니다. (출처: Teknium1)

사용자, AI로 심층 연구 후 음성으로 듣는 경험 공유: 한 사용자가 ChatGPT를 사용하여 주제에 대한 심층 연구를 수행한 다음 Speechify와 같은 도구를 사용하여 연구 결과를 오바마 목소리의 오디오로 변환하여 듣는 경험을 공유했습니다. 이러한 방식은 정보 획득 및 개인화된 콘텐츠 소비 측면에서 AI의 잠재력을 보여주지만, AI에 대한 과도한 의존이 독서 능력 저하로 이어질 수 있다는 우려도 제기했습니다. (출처: Reddit r/artificial)

💡 기타

전 영국 정부 AI 위험 관리팀원, 윤리 문제 및 후속 조치 폭로: 전 영국 정부 중앙 AI 위험 관리 부서 직원이 팀 내에서 AI 편향, 차별 등 윤리 문제에 대한 우려를 제기한 후 봉쇄, 감시, 제도적 보복을 당했다고 공개적으로 밝혔습니다. 이 사건은 정부 기술 환경에서의 “내부 고발자” 보호 및 AI 윤리 공공 책임 메커니즘의 효율성에 대한 논의를 불러일으켰습니다. (출처: Reddit r/ArtificialInteligence)

AI가 “AI 프루프(AI-proof)” 일자리에 미치는 간접적 영향: 일부 기술 기반 산업(예: 기술공) 자체가 AI로 직접 대체되기 어렵더라도, AI로 인해 대규모 실업이 발생하여 소비자 기반이 위축되면 이러한 “AI 프루프” 일자리도 수요 부족으로 타격을 입을 수 있다는 지적이 있습니다. 이는 AI가 고용에 미치는 영향을 보다 거시적인 경제 시스템 관점에서 바라봐야 함을 시사합니다. (출처: Reddit r/artificial)

관점: LLM은 지능을 모방하여 인간의 인지 편향을 이용한다: Pedro Domingos는 대형 언어 모델(LLM)이 지능적으로 보이는 텍스트를 생성하는 데 능숙하며, 이는 일부 사람들이 진정한 지능과 “헛소리”(BS)를 구분하기 어려워하는 인지적 약점을 이용한다고 주장합니다. (출처: pmddomingos)