키워드:ChatGPT, GitHub, AI 모델, 다중모달, 강화학습, 오픈소스, Meta FAIR, AGI, ChatGPT 심층 연구 기능, 하이브리드 트랜스포머 아키텍처, 강화 미세조정 RFT, AI 다중 세계 모델 멀티버스, 과학자 AI 프레임워크

🔥 포커스

ChatGPT 심층 연구 기능, GitHub 통합: OpenAI는 ChatGPT의 심층 연구(Deep Research) 기능이 이제 GitHub 코드 저장소 연결을 지원한다고 발표했습니다. 사용자가 질문하면 AI 에이전트가 코드 저장소의 소스 코드, PR, README 등 문서를 자동으로 읽고, 검색하고, 분석하여 직접 참조가 포함된 상세 보고서를 생성할 수 있습니다. 이 기능은 개발자가 프로젝트를 빠르게 익히고 코드 구조와 기술 스택을 이해하는 데 도움을 주기 위해 마련되었습니다. 현재 이 기능은 테스트 단계에 있으며 Team 사용자에게 공개되었고, Plus 및 Pro 사용자에게도 점차 확대될 예정입니다. (출처: OpenAI Developers, snsf, EdwardSun0909, op7418, gdb, tokenbender, 量子位, 36氪)

세계 최초 AI 멀티플레이어 월드 모델 Multiverse 오픈소스 공개: 이스라엘 스타트업 Enigma Labs가 개발한 멀티플레이어 월드 모델 Multiverse를 오픈소스로 공개했습니다. 이 모델은 두 AI 에이전트가 동일한 생성 환경에서 감지, 상호작용 및 협업할 수 있도록 합니다. 《GT赛车4》(Gran Turismo 4)를 기반으로 훈련되었으며, 두 플레이어의 시점을 색상 채널을 따라 쌓고 희소 샘플링된 과거 프레임을 결합하여 공유 월드 상태를 처리함으로써 PC에서 1500달러 미만의 비용으로 훈련 및 실시간 실행이 가능합니다. 이는 AI가 공유 가상 환경을 이해하고 생성하는 데 있어 중요한 진전으로 평가되며, 다중 에이전트 시스템 및 시뮬레이션 훈련 플랫폼에 새로운 아이디어를 제공합니다. (출처: Reddit r/MachineLearning, 36氪)

최고 AI 과학자 Rob Fergus, Meta FAIR 복귀 및 총괄, 목표는 AGI: 초기에 Yann LeCun과 함께 FAIR를 공동 창립하고 이후 DeepMind 뉴욕 팀을 이끌었던 Rob Fergus가 Meta로 복귀하여 Joelle Pineau의 뒤를 이어 FAIR 책임자를 맡게 되었습니다. Fergus는 올해 4월 Meta의 GenAI 부서에 합류하여 Llama 모델의 기억력 및 개인화 능력 향상에 힘써왔습니다. LeCun은 동시에 FAIR의 새로운 목표가 고급 기계 지능(AGI)이 될 것이라고 발표했습니다. Fergus는 AI 분야에서 인용 빈도가 높은 학자로, ZFNet의 시각화 연구 및 적대적 샘플에 대한 선구적인 연구 등이 대표작입니다. (출처: ylecun, 36氪)

Anthropic, Claude AI 가치관 연구 발표, 3307가지 AI 가치 성향 공개: Anthropic 연구팀은 사전 인쇄 논문 《Values in the Wild》를 발표하여, Claude AI가 실제 대화에서 보여주는 행동을 분석함으로써 3307가지 독특한 AI 가치를 식별했습니다. 연구 결과, 가장 일반적인 가치는 “도움이 되는”(23.4%), “전문성”(22.9%), “투명성”(17.4%)과 같은 서비스 지향적인 가치였습니다. AI 가치관은 실용적(31.4%), 인지적(22.2%), 사회적(21.4%), 보호적(13.9%), 개인적(11.1%) 등 5가지 상위 범주로 분류되었으며, 높은 맥락 의존성을 보였습니다. Claude는 일반적으로 인간이 표현하는 가치관에 대해 지지적으로 반응했으며(43%), 가치 미러링은 약 20%를 차지했고, 사용자 가치관에 대한 저항은 드물었습니다(5.4%). (출처: Reddit r/ArtificialInteligence)

Yoshua Bengio, “과학자 AI” 프레임워크 제안, 더 안전한 AI 개발 경로 주창: 튜링상 수상자 Yoshua Bengio는 《타임》지에 기고한 칼럼에서 자신의 팀이 연구 중인 “과학자 AI”(Scientist AI) 방향에 대해 설명했습니다. 그는 이것이 현재 통제되지 않고 에이전트 중심적인 AI 개발 궤도를 대체할 수 있는 실용적이고 효과적이며 더 안전한 AI 개발 경로라고 주장했습니다. 이 프레임워크는 AI 시스템이 설명 가능성, 검증 가능성, 인간 가치와의 정렬 능력을 갖춰야 한다고 강조하며, 과학 연구 방법론을 모방하여 AI의 행동과 의사 결정 과정을 더욱 투명하고 통제 가능하게 만들어 잠재적 위험을 줄이는 것을 목표로 합니다. (출처: Yoshua_Bengio)

🎯 동향

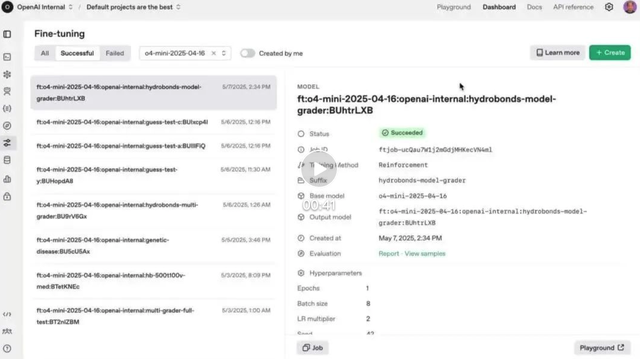

OpenAI 강화 미세조정(RFT) 기능, o4-mini에 정식 출시: OpenAI는 작년 12월에 미리보기로 공개했던 강화 미세조정(Reinforced Fine-Tuning, RFT) 기능이 o4-mini 모델에서 정식으로 사용 가능하다고 발표했습니다. RFT는 사고의 연쇄 추론과 작업별 점수 책정을 활용하여 복잡한 분야에서 모델 성능을 향상시킵니다. 예를 들어, AccordanceAI 회사는 RFT를 사용하여 세무 및 회계 분야에서 최고 수준의 성능을 보이는 모델을 미세조정했습니다. (출처: OpenAI Developers, gdb, 量子位, 36氪)

Gemini API, 암시적 캐싱 기능 출시, 호출 비용 75% 절감: Google Gemini API에 암시적 캐싱 기능이 추가되어, 사용자 요청이 이전 요청과 공통된 접두사를 가질 경우 자동으로 캐시 히트를 발생시켜 사용자에게 Token 비용의 75%를 절감해 줍니다. 이 기능은 개발자가 능동적으로 캐시를 생성할 필요가 없습니다. 동시에 캐시를 트리거하는 최소 Token 요구량이 Gemini 2.5 Flash에서는 1K로, 2.5 Pro에서는 2K로 낮아져 API 사용 비용이 더욱 절감되었습니다. (출처: op7418)

OpenAI, 유럽 경제 지역 등에서 ChatGPT 기억 기능 전면 출시: OpenAI는 ChatGPT의 기억 기능이 유럽 경제 지역(EEA), 영국, 스위스, 노르웨이, 아이슬란드, 리히텐슈타인의 Plus 및 Pro 사용자에게 전면 출시되었다고 발표했습니다. 이 기능은 ChatGPT가 사용자의 과거 모든 채팅 기록을 참조하여 더욱 개인화된 응답을 제공하고, 사용자 선호도와 관심사를 더 잘 이해하여 글쓰기, 제안, 학습 등에서 더 정확한 도움을 줄 수 있도록 합니다. (출처: openai)

ByteDance SEED, 멀티모달 기반 모델 Mogao 출시: ByteDance의 SEED 팀은 인터리브 방식의 멀티모달 생성을 위해 특별히 설계된 Omni 기반 모델인 Mogao를 발표했습니다. Mogao는 심층 융합 설계, 이중 시각 인코더, 인터리브 회전 위치 임베딩, 멀티모달 분류기 없는 가이드 등 다수의 기술 개선 사항을 통합했습니다. 이러한 개선을 통해 자기 회귀 모델(텍스트 생성)과 확산 모델(고품질 이미지 합성)의 장점을 결합하여 임의로 인터리브된 텍스트 및 이미지 시퀀스를 효과적으로 처리할 수 있습니다. (출처: NandoDF)

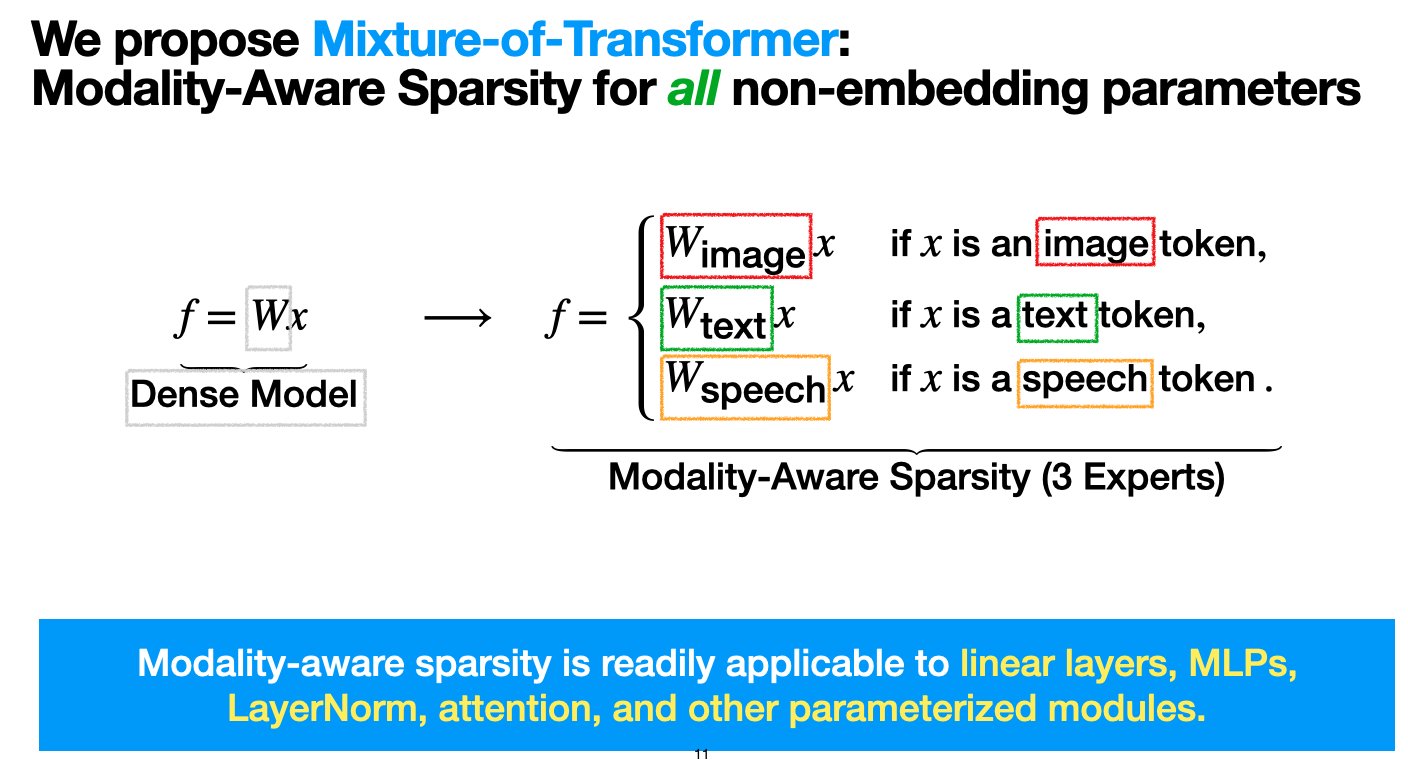

Meta, 혼합 Transformer(MoT) 아키텍처 출시, 멀티모달 모델 사전 훈련 비용 절감 목표: Meta AI 연구진은 멀티모달 모델 사전 훈련의 계산 비용을 성능 저하 없이 크게 줄이는 것을 목표로 하는 “혼합 Transformer(Mixture-of-Transformers, MoT)”라는 희소 아키텍처를 제안했습니다. MoT는 피드포워드 네트워크, 어텐션 행렬, 레이어 정규화와 같은 비임베딩 Transformer 매개변수에 모달리티 인식 희소성을 적용합니다. 실험 결과, Chameleon(텍스트+이미지 생성) 설정에서 7B MoT 모델은 55.8%의 FLOPs만으로 밀집 기준선 품질에 도달했으며, 음성을 세 번째 모달리티로 확장했을 때는 37.2%의 FLOPs만 사용했습니다. 이 연구 성과는 TMLR(2025년 3월)에 게재 승인되었으며 코드는 오픈소스로 공개되었습니다. (출처: VictoriaLinML)

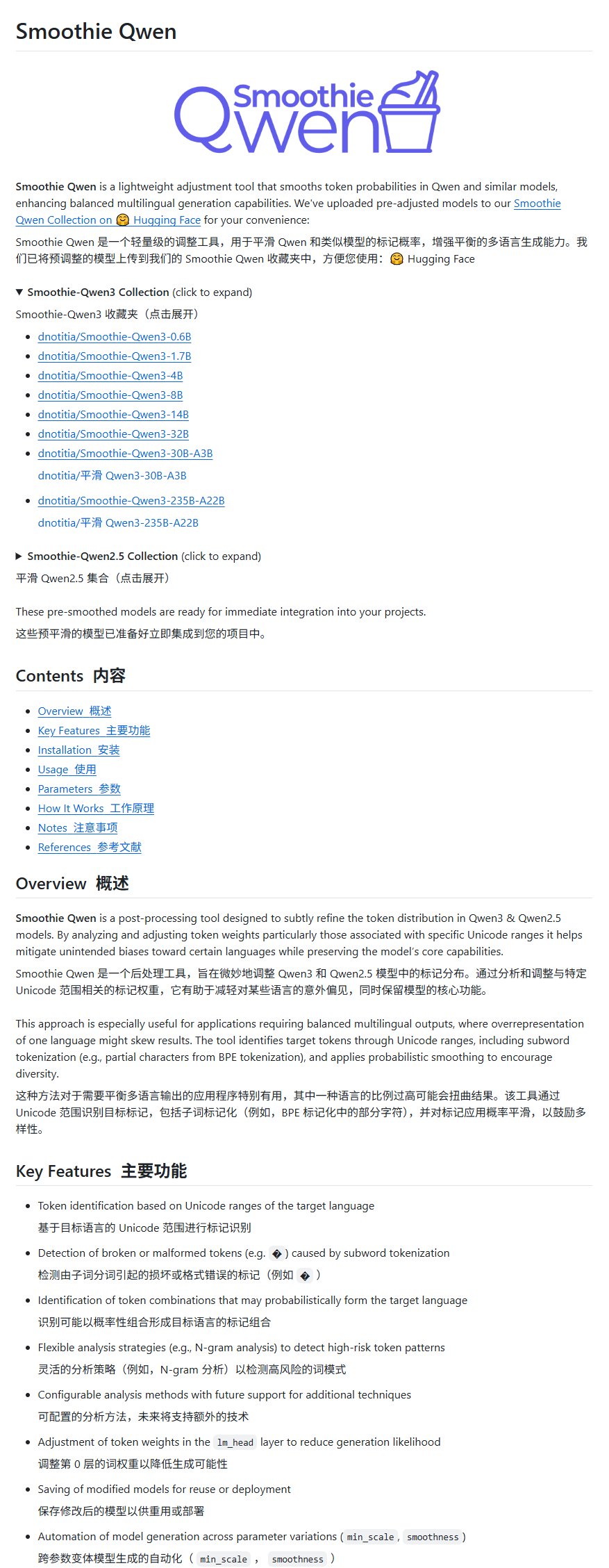

Qwen 모델 개선 프로젝트 Smoothie Qwen 출시, 다국어 생성 균형 조정: Smoothie Qwen이라는 Qwen 모델 개선 프로젝트가 출시되었습니다. 이 프로젝트는 모델 내부 매개변수의 확률을 조정하여 다국어 생성 능력의 균형을 맞추는 것을 목표로 합니다. 주로 일부 비중국어 사용자가 Qwen을 사용할 때 간헐적으로 중국어 출력이 나타나는 문제를 해결하며, 모델의 지능을 저하시키지 않는다고 주장합니다. (출처: karminski3)

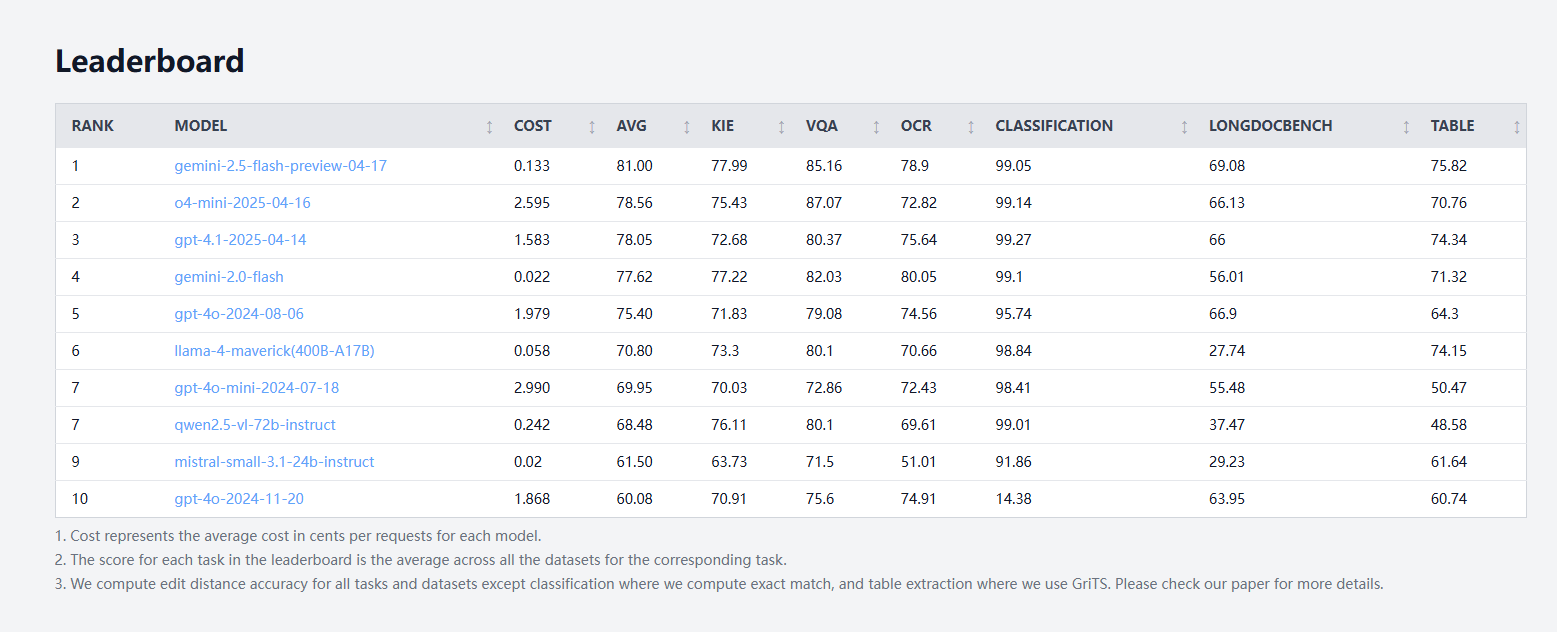

idp-leaderboard 출시, 최초의 문서 유형 AI 테스트 벤치마크: 새로운 AI 테스트 벤치마크 idp-leaderboard가 출시되어 모델의 문서 및 문서 이미지 처리 능력 평가에 중점을 둡니다. 초기 순위에 따르면 gemini-2.5-flash-preview-04-17이 전체 문서 처리에서 가장 강력한 성능을 보였습니다. 주목할 점은 Qwen2.5-VL이 표 처리 성능에서 부진한 모습을 보였다는 것입니다. (출처: karminski3)

Perplexity Discover 기능 주요 업데이트: Perplexity의 공동 창립자 Arav Srinivas는 자사의 Discover 기능(정보 스트림 발견)이 크게 개선되었다고 발표하며 사용자들의 체험을 권장했습니다. 이는 일반적으로 정보 제시, 관련성 또는 사용자 인터페이스 측면의 최적화를 의미하며, 사용자의 새로운 정보 획득 및 탐색 능력을 향상시키는 것을 목표로 합니다. (출처: AravSrinivas)

레노버, 톈시 개인용 슈퍼 인텔리전트 에이전트 대규모 업그레이드 발표, 세계 최초 태블릿 로컬 배포 DeepSeek: 레노버는 자사의 톈시 개인용 슈퍼 인텔리전트 에이전트가 대규모 업그레이드를 통해 전면적인 L3 수준으로 나아가고 있으며, 개인용 스마트 기기 AI 서비스에 특화된 도메인 인텔리전트 에이전트 ‘샹방방’을 출시했다고 발표했습니다. 동시에 레노버는 세계 최초로 태블릿 단말기 측에 DeepSeek 대규모 모델을 배포한 YOGA Pad Pro 14.5 AI Yuanqi Edition을 비롯해 moto AI 휴대폰, 리전 시리즈 PC 등 다수의 AI 단말기 신제품을 출시하여 AI PC, AI 휴대폰, AI 태블릿 및 AIoT로 구성된 완전한 AI 생태계를 구축했습니다. (출처: 量子位)

러우자오주, 자율주행과 구현 지능에 대해 논하다: L2는 L4로 승격 불가, VLA는 L4에 제한적 도움: Pony.ai 공동 창립자 겸 CTO 러우톈청은 차세대 Robotaxi 차종 발표회에서 자율주행과 AI에 대한 최신 견해를 공유했습니다. 그는 L2와 L4의 본질적인 차이를 강조하며, L2는 L4로 승격될 수 없으며 현재 L2 분야에서 인기 있는 VLA(Vision-Language-Action) 패러다임은 L4에 “기본적으로 거의 도움이 되지 않는다”고 말했습니다. 그는 L4에는 전문의와 같은 극도의 안전성이 필요하지만 VLA는 일반의와 같다고 지적했습니다. Pony.ai의 지난 2년간 기술 변화의 핵심은 엔드투엔드와 월드 모델이었으며, 후자는 약 5년간 적용되어 왔습니다. 그는 또한 “클라우드 대리 운전”은 가짜 개념이라고 생각하며, 구현 지능의 현재 상태는 2018년의 자율주행과 유사하여 유사한 “진공 기간” 도전에 직면할 것이라고 말했습니다. (출처: 量子位)

Kimi, 콘텐츠 커뮤니티 테스트 중, OpenAI 소셜 앱 개발 가능성, AI 대형 모델 회사들 소셜 기능으로 사용자 충성도 강화 모색: Moonshot AI의 Kimi가 콘텐츠 커뮤니티 제품을 그레이 테스트 중이며, 주로 AI가 뉴스 핫이슈를 수집하여 콘텐츠를 생성하고 기술, 금융 등 분야에 초점을 맞추고 있습니다. 공교롭게도 OpenAI 역시 X를 겨냥한 소셜 소프트웨어 개발을 계획하고 있다는 보도가 나왔습니다. 이러한 움직임은 AI 대형 모델 회사들이 커뮤니티 구축이나 소셜 기능을 통해 사용자 충성도를 강화하고 AI 도구의 “사용 후 이탈” 문제를 해결하려는 시도를 보여줍니다. 그러나 커뮤니티 운영은 콘텐츠 품질, 보안 위험 및 상업화 난제에 직면해 있습니다. 이는 또한 AI 산업이 성장 보너스가 정점에 달한 후 “성장을 위한 자금 소진”에서 ROI를 더욱 중시하고 새로운 비즈니스 모델을 모색하는 방향으로 전환하고 있음을 반영합니다. (출처: 36氪)

TCL, AI 전면 도입, Fuxi 대형 모델 및 다수 AI 가전제품 출시했으나 동질화 과제 직면: TCL은 AWE 2025, CES 2025 등 전시회에서 TCL Fuxi 대형 모델 및 TV, 에어컨, 세탁기 등 가전제품에 적용된 AI 기능을 포함한 AI 제품과 전략을 중점적으로 선보였습니다. TV 사업은 뛰어난 성과를 보여 1분기 출하량 세계 1위를 기록했으며, Mini LED 기술이 강점입니다. 그러나 현재 가전 분야 AI 응용은 주로 음성 상호작용과 특정 기능 최적화(AI 화질 칩, AI 수면, AI 절전 등)에 집중되어 있어 하이센스 Xinghai, 하이얼 HomeGPT, 메이디 Meiyan 등 다른 브랜드와의 동질화 경쟁 과제에 직면해 있습니다. TCL은 또한 AI 동반 로봇을 탐색하고 RayNeo를 통해 스마트 안경을 개발하고 있습니다. AI 투자가 증가했음에도 불구하고 독립적인 기술 우위는 아직 뚜렷하지 않으며, 마케팅 비용 증가, 매출 총이익률 하락 등의 문제에 직면해 있습니다. (출처: 36氪)

AI 주도 교육 혁신, iFLYTEK, TAL Education 등 선두 기업 AI 사업 가속화: 보고서는 iFLYTEK, TAL Education, Fenbi, Offcn Education, Huatu Education, 17zuoye 등 선두 교육 기업들의 AI 분야 최신 실천 사례를 분석했습니다. iFLYTEK은 국산 컴퓨팅 파워와 Deepseek-V3/R1 모델을 바탕으로 정보 기술 교육에 깊이 관여하고 있습니다. TAL Education은 Deepseek R1을 활용하여 교육 전 과정에 힘을 실어주고 AI 채점 및 AI 독서 도구를 출시했습니다. Fenbi는 고빈도 학습, 필수 시나리오를 포괄하는 AI 제품 매트릭스를 구축했습니다. Offcn Education은 AI 취업 서비스에 집중하여 ‘윈신’ 대형 모델을 개발했습니다. Huatu Education은 오프라인 강점을 결합하여 AI로 공무원 시험 서비스의 정확도를 높였습니다. 17zuoye는 AI를 통해 교수-평가 일체화를 추진하고 있습니다. 업계 동향은 AI 교육이 단일 도구에서 생태계 경쟁 및 가치 실현으로 나아가고 있음을 보여줍니다. (출처: 36氪)

Baidu, Alibaba 등 대기업 MCP 프로토콜 적극 추진, AI Agent 생태계 정의권 경쟁: 모델 컨텍스트 프로토콜(MCP)이 최근 Anthropic, OpenAI, Google 및 중국 내 Baidu, Alibaba 등 대기업들의 추진을 받고 있습니다. Baidu의 ‘신샹’ 애플리케이션과 Alibaba Cloud의 Bailian 플랫폼은 모두 MCP를 지원하여 AI Agent가 외부 도구 및 서비스를 더욱 편리하게 호출할 수 있도록 합니다. 이러한 움직임은 표면적으로는 업계 표준 통일을 위한 것이지만, 실제로는 미래 AI Agent 생태계 정의권을 둘러싼 대기업들의 경쟁입니다. MCP를 구축하고 홍보함으로써 대기업들은 더 많은 개발자를 자사 생태계로 유치하여 데이터 장벽과 업계 발언권을 확보하려는 의도입니다. Agent 애플리케이션의 상업화 방향은 현재로서는 여전히 트래픽과 광고를 중심으로 하고 있습니다. (출처: 36氪)

애플 AI 전략 노출: 바이두, 알리바바와 협력 가능성, ‘듀얼 코어 드라이브’ 중국판 AI 시스템 구축: 보도에 따르면 애플은 중국 시장의 AI 기능 기술 지원을 위해 바이두 및 알리바바와 협력할 가능성이 있습니다. 바이두의 Ernie Bot은 시각 인식 분야에서 강점을 가지고 있으며, 알리바바의 Qwen 대형 모델은 인지 이해 및 콘텐츠 규정 준수 측면에서 뛰어난 성능을 보입니다. 이러한 ‘듀얼 코어 드라이브’ 모델은 양사의 장점을 결합하여 중국 시장의 데이터 생태계, 기술 중점 및 규제 요구 사항을 충족하는 동시에 협력에서 애플의 주도권과 협상력을 유지하기 위한 것으로 보입니다. 이는 애플이 HarmonyOS 등 현지 경쟁 압력에 대응하고 데이터 규제가 강화되는 상황에서 일종의 ‘생태적 지위 분할’ 전략으로 간주됩니다. (출처: 36氪)

위징이 교수, 공간 지능 심층 해독: 잠재력은 크지만 공감대 미형성, 데이터와 물리적 이해가 관건: 상하이 과학기술대학교 위징이 교수는 인터뷰에서 대형 모델이 교차 모달 통합 측면에서 잠재력이 아직 충분히 발휘되지 않았으며, 공간 지능은 생성형 AI의 돌파에 힘입어 디지털 복제에서 지능적 이해와 창조로 진화하고 있다고 지적했습니다. 그는 현재 공간 지능의 핵심 과제는 실제 3D 장면 데이터 부족 및 3차원 표현 방식 미통일에 있다고 보았습니다. 그의 팀의 CAST 프로젝트는 ‘행위자 네트워크 이론’과 물리 규칙을 도입하여 물체 간의 관계와 물리적 합리성을 탐구합니다. 그는 인지 우선을 강조하며 센서 기술에 혁명적인 돌파가 있을 것이라고 예측했습니다. 구현 지능의 측정 기준은 순수한 정확도가 아닌 견고성과 안전성이어야 합니다. 단기적으로 공간 지능은 영화 제작, 게임 등 분야에서 폭발적으로 성장할 것이며, 중장기적으로는 구현 지능의 핵심이 될 것이고 저고도 경제 또한 중요한 적용 분야입니다. (출처: 36氪)

AI 인재 쟁탈전 백열화: 대기업 고액 연봉으로 인재 영입, CTO 직접 지도, 대형 모델 및 멀티모달 집중: 국내외 테크 대기업들이 치열한 인공지능 인재 쟁탈전을 벌이고 있습니다. ByteDance, Alibaba, Tencent, Baidu, JD.com, Huawei 등은 최고 수준의 박사 과정 학생과 천재 소년을 대상으로 한 채용 계획을 잇달아 발표하며, 상한선 없는 연봉, CTO 직접 지도, 인턴 경험 불필요 등의 조건을 제시하고 있습니다. 채용 분야는 주로 대형 모델과 멀티모달 분야에 집중되어 있으며, 각 회사의 핵심 사업 분야와 밀접하게 관련되어 있습니다. DeepSeek 등 모델의 성공은 업계의 인재에 대한 갈증을 더욱 심화시켰습니다. Elon Musk도 AI 인재 경쟁의 광기를 언급한 바 있으며, OpenAI 등 해외 거대 기업들도 고액 연봉과 창업자 직접 채용 등의 방식으로 인재를 유치하고 있습니다. (출처: 36氪)

세쿼이아 캐피탈: AI 시장 잠재력, 클라우드 컴퓨팅 훨씬 능가, 애플리케이션 계층이 핵심, 최고 AI 책임자(CAIO) 표준화될 것: 세쿼이아 캐피탈 파트너는 AI 시장 규모가 현재 약 4,000억 달러 규모의 클라우드 컴퓨팅 시장을 훨씬 넘어설 것이며, 향후 10~20년간 엄청난 규모로 성장하고 가치는 주로 애플리케이션 계층에 집중될 것이라고 예측했습니다. 스타트업은 고객 요구에 집중하고, 엔드투엔드 솔루션을 제공하며, 수직 분야를 깊이 파고들고, ‘데이터 플라이휠’을 활용하여 해자를 구축해야 합니다. AWS 연구에 따르면, 전 세계 기업들은 생성형 AI 도입을 가속화하고 있으며, 의사 결정권자의 45%가 2025년 최우선 과제로 생성형 AI를 계획하고 있고, 최고 AI 책임자(CAIO) 직책이 기업의 표준이 될 것이며, 현재 기업의 60%가 이 직책을 신설했습니다. 에이전트 경제는 AI 발전의 다음 단계로 간주되지만, 지속적인 신원, 통신 프로토콜, 보안 신뢰라는 세 가지 기술적 과제를 해결해야 합니다. (출처: 36氪)

신생 자동차 제조사들, AI에 전면 베팅, Li Auto, XPeng, NIO 차세대 자동차 정의권 경쟁: Tesla FSD V12가 엔드투엔드 신경망 기술로 이룬 돌파는 중국 신생 자동차 제조사인 Li Auto, XPeng, NIO 등의 AI 사업 가속화를 촉진했습니다. Li Auto는 VLA(Vision-Language-Action) 드라이버 대형 모델을 출시하고 DeepSeek 오픈소스 모델을 기반으로 언어 부분을 개발했습니다. XPeng은 720억 파라미터의 LVA 기반 모델을 구축했습니다. NIO는 중국 최초의 스마트 드라이빙 월드 모델 NWM을 발표하고 자체 개발한 5nm 스마트 드라이빙 칩 Shenji NX9031을 선보였습니다. 각 사는 알고리즘, 컴퓨팅 파워(자체 개발 칩), 데이터에 막대한 투자를 하고 있으며, AI 기술을 인간형 로봇 등 분야로 확장하여 차세대 자동차 나아가 제품 정의권을 놓고 경쟁하고 있지만, 자금 및 상업화 과제에 직면해 있습니다. (출처: 36氪)

🧰 툴

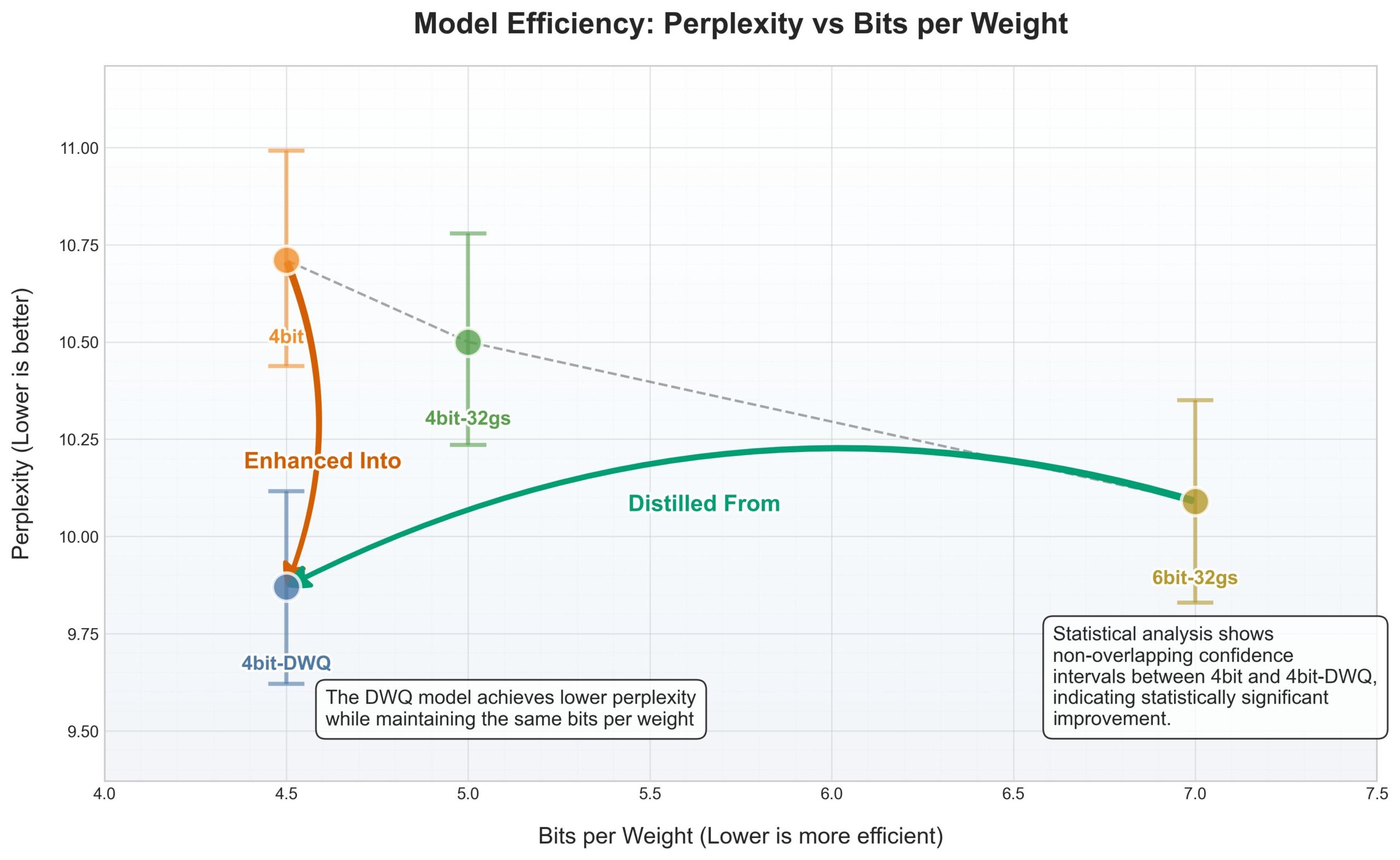

Apple MLX 프레임워크, DWQ 양자화 도입, 4bit 성능이 기존 6bit보다 우수: Apple MLX(머신러닝 프레임워크)를 위한 새로운 DWQ(Dynamic Weight Quantization, 동적 가중치 양자화) 방법이 발표되었습니다. 사용자 karminski3이 공유한 데이터에 따르면, 4bit-dwq로 양자화된 모델(예: Qwen3-30B)은 퍼플렉서티에서 기존 6bit 양자화 방법보다 우수하며, 17GB 메모리만으로 실행 가능합니다. 이는 Apple 기기에서 대규모 언어 모델을 효율적으로 실행할 수 있는 새로운 가능성을 제공합니다. (출처: karminski3)

Perplexity, 이제 WhatsApp 내에서 더 자연스러운 대화형 검색 지원: Perplexity의 공동 창립자 Arav Srinivas는 Perplexity의 WhatsApp 내 통합이 개선되어 이제 더 자연스러운 대화 경험을 제공하며, 검색이 필요하지 않을 때는 지능적으로 검색 단계를 무시하여 사용자가 AI와 직접 채팅 방식으로 상호 작용할 수 있다고 발표했습니다. (출처: AravSrinivas)

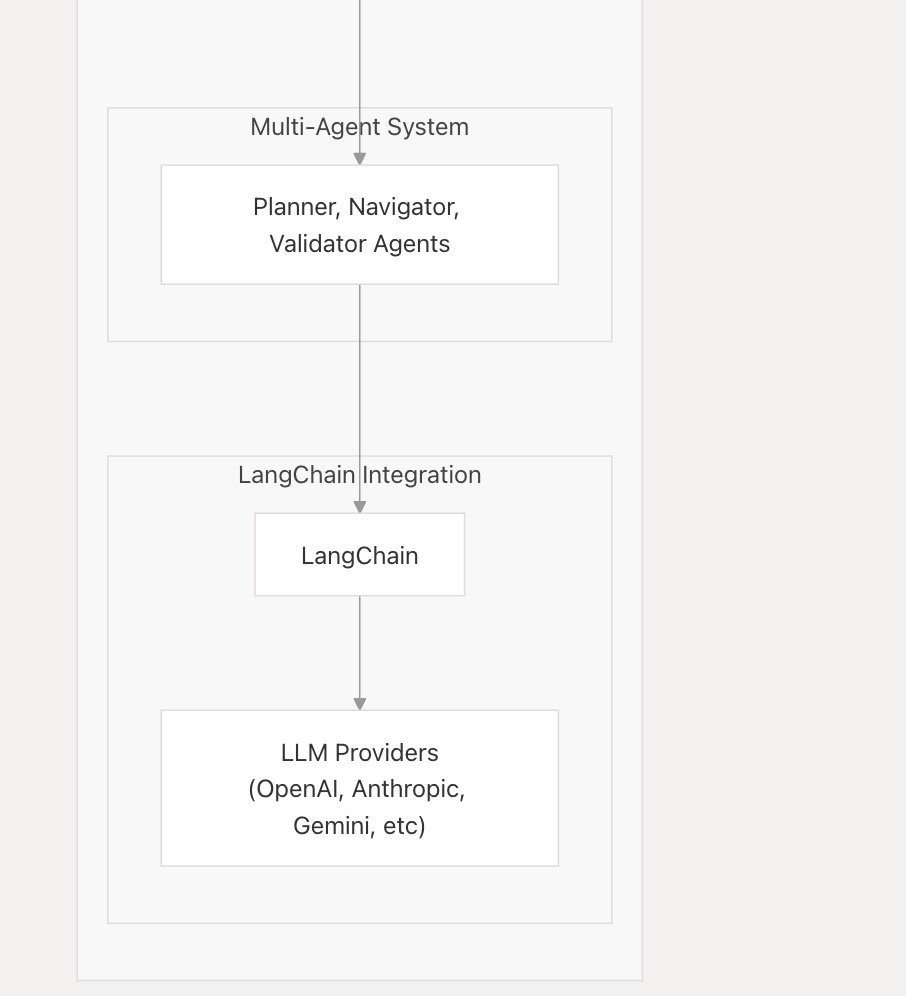

nanobrowser_ai, 주요 LLM 지원, Langchain.js 통합: AI 도구 nanobrowser_ai가 OpenAI 모델, Gemini 및 Ollama를 통해 실행되는 로컬 모델을 포함한 다양한 대규모 언어 모델을 지원한다고 발표했습니다. 이 도구는 Langchain.js 프레임워크를 활용하여 다양한 LLM을 유연하게 지원함으로써 사용자에게 더 광범위한 모델 선택권을 제공합니다. (출처: hwchase17)

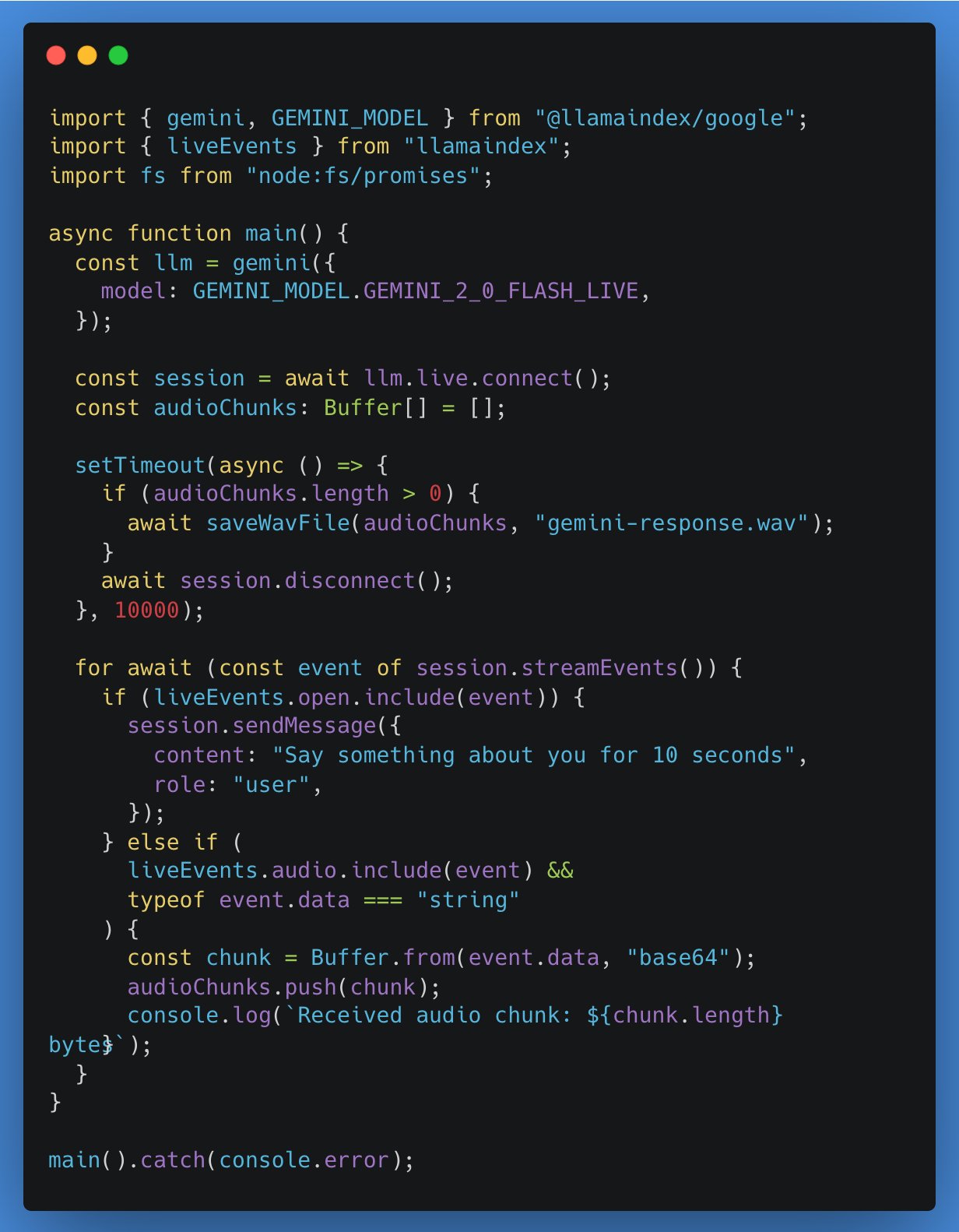

LlamaIndex TypeScript, 실시간 LLM API 지원 추가, Google Gemini 최초 통합: LlamaIndex TypeScript가 실시간 LLM API를 지원한다고 발표하여 개발자들이 AI 애플리케이션에서 실시간 오디오 대화 기능을 구현할 수 있게 되었습니다. 최초로 통합된 것은 Google Gemini의 실시간 추상화 인터페이스이며, OpenAI의 실시간 지원도 곧 출시될 예정입니다. 이번 업데이트는 개발자들이 다양한 실시간 모델 간에 쉽게 전환하고 더욱 인터랙티브한 AI 애플리케이션을 구축하는 데 편리함을 제공합니다. (출처: _philschmid)

Gradio 애플리케이션 튜토리얼: Qwen2.5-VL을 사용한 이미지 및 비디오 주석 달기 및 객체 감지: Qwen2.5-VL(시각 언어 모델)을 사용하여 이미지 및 비디오 자동 주석 달기 및 객체 감지 기능을 구현하는 Gradio 애플리케이션 구축 방법을 자세히 설명하는 튜토리얼입니다. 이 튜토리얼은 개발자가 Qwen2.5-VL의 강력한 기능을 활용하여 인터랙티브 AI 애플리케이션을 빠르게 구축할 수 있도록 돕는 것을 목표로 합니다. (출처: Reddit r/deeplearning)

VSCode 플러그인 gemini-code 다운로드 수 약 5만 건: VSCode의 AI 프로그래밍 보조 플러그인 gemini-code의 다운로드 수가 약 5만 건에 달했습니다. 개발자 raizamrtn은 주말에 필요한 업데이트를 진행할 예정이라고 밝혔습니다. 이 플러그인은 Gemini 모델의 기능을 활용하여 개발자의 코딩 작업을 지원하는 것을 목표로 합니다. (출처: raizamrtn)

프랑스 AI 스타트업 Arcads AI: 5명 팀으로 연 500만 달러 매출, 자동화된 비디오 광고 제작에 집중: 파리에 본사를 둔 AI 스타트업 Arcads AI는 단 5명의 팀으로 연간 반복 매출(ARR) 500만 달러를 달성하고 수익을 내고 있습니다. 이 회사는 고도로 자동화된 AI 시스템을 통해 광고주에게 빠르고 저렴하며 전환율 높은 비디오 광고 제작 서비스를 제공합니다. 고객이 핵심 카피만 제공하면 AI가 장면 구성, 배우 연기, 내레이션 녹음부터 최종 영상 출력까지 전 과정을 완료합니다. Arcads 플랫폼에는 실제 인물 라이선스를 기반으로 한 300개 이상의 AI 배우 이미지가 내장되어 있으며 35개 언어를 지원하여 “콘텐츠 즉 서비스”를 실현합니다. 내부 운영에도 AI 에이전트를 광범위하게 사용하여 경쟁사 분석을 위한 AI Spy Agent, 아이디어 생성을 위한 AI Ghostwriter 등으로 효율성을 크게 향상시켰습니다. (출처: 36氪)

📚 학습

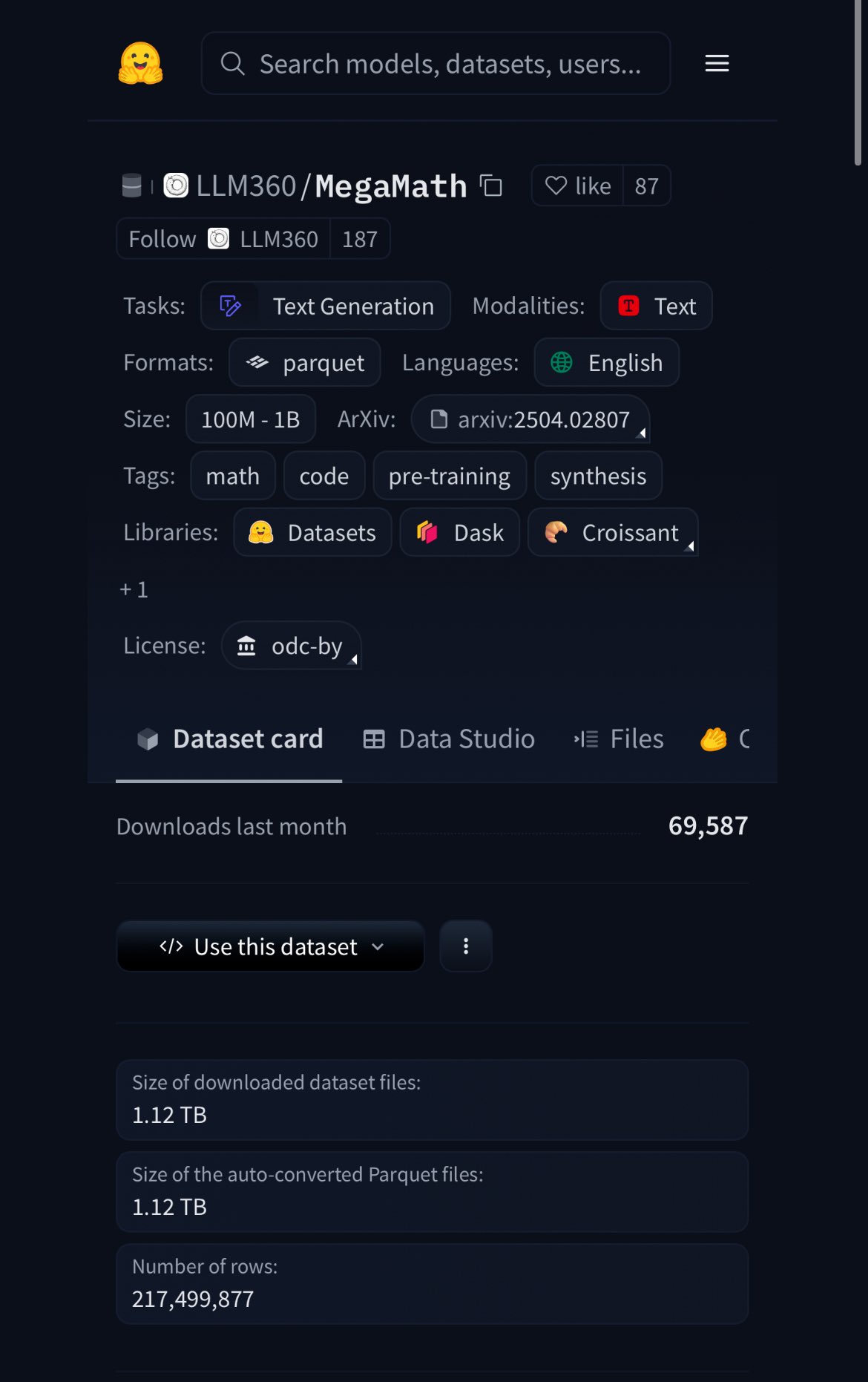

HuggingFace, MegaMath 데이터셋 공개, 370B 토큰 포함, 20%는 합성 데이터: HuggingFace가 MegaMath 데이터셋을 공개했습니다. 이 데이터셋은 3700억 개의 토큰을 포함하며, 현재까지 가장 큰 수학 사전 훈련 데이터셋으로 영어 위키백과의 약 100배 규모입니다. 주목할 점은 이 중 20%가 합성 데이터라는 사실이며, 이는 모델 훈련에서 고품질 합성 데이터의 역할에 대한 논의를 다시 한번 불러일으키고 있습니다. (출처: ClementDelangue)

Nous Research, RL 환경 해커톤 개최, 상금 5만 달러: Nous Research가 샌프란시스코에서 Nous RL 환경 해커톤을 개최한다고 발표했습니다. 참가자들은 Nous의 강화 학습 환경 프레임워크인 Atropos를 사용하여 창작 활동을 펼치게 되며, 총상금은 5만 달러입니다. 파트너로는 xAI, NVIDIA, Nebius AI 등이 참여합니다. (출처: Teknium1)

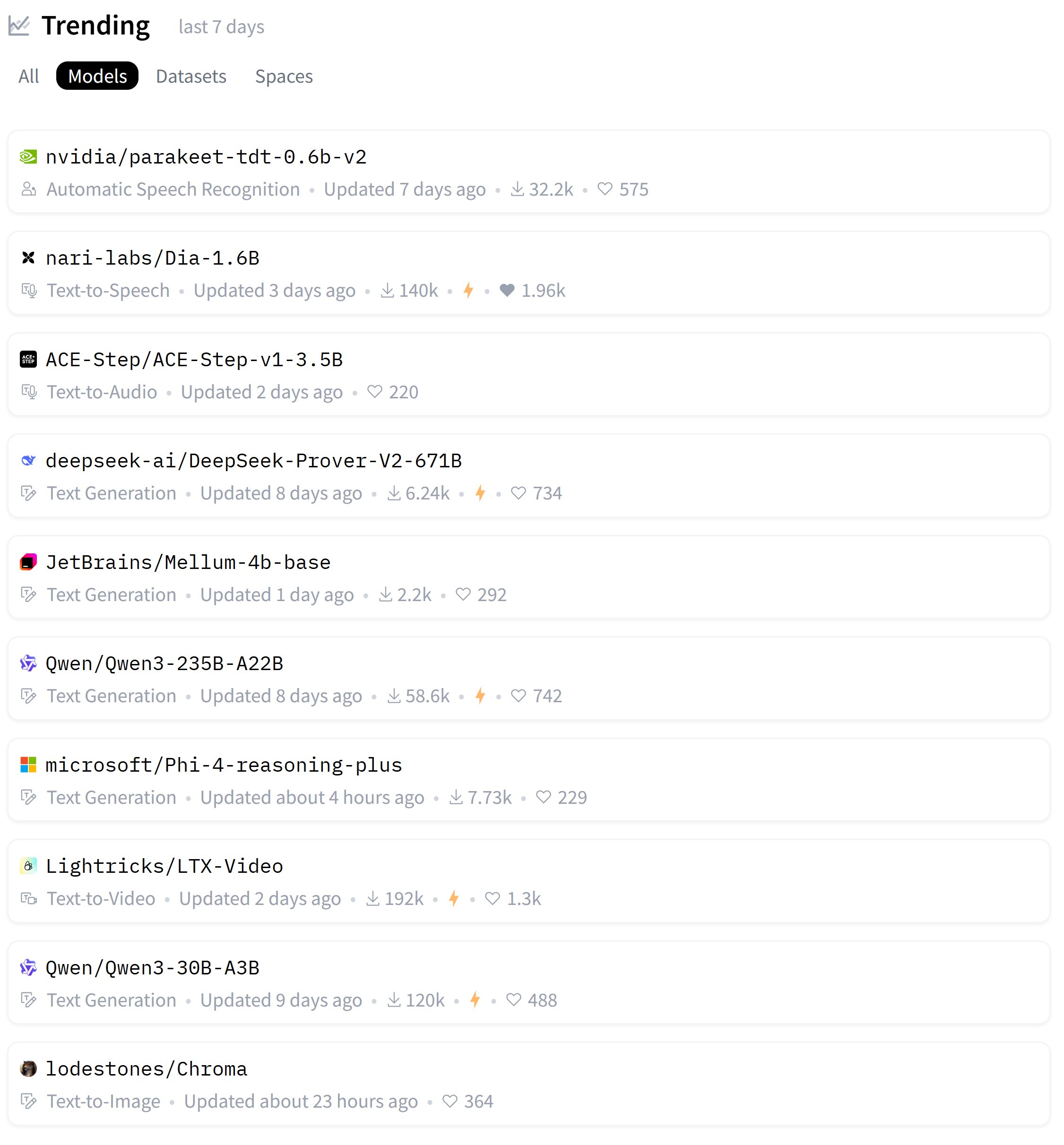

HuggingFace 인기 모델 주간 순위 발표: 사용자 karminski3이 이번 주 HuggingFace에서 가장 인기 있는 모델 순위를 공유하며, 그중 대부분의 모델을 직접 테스트했거나 공식 데모를 공유했다고 언급했습니다. 이는 커뮤니티가 새로운 모델을 빠르게 따라가고 평가하는 열정을 반영합니다. (출처: karminski3)

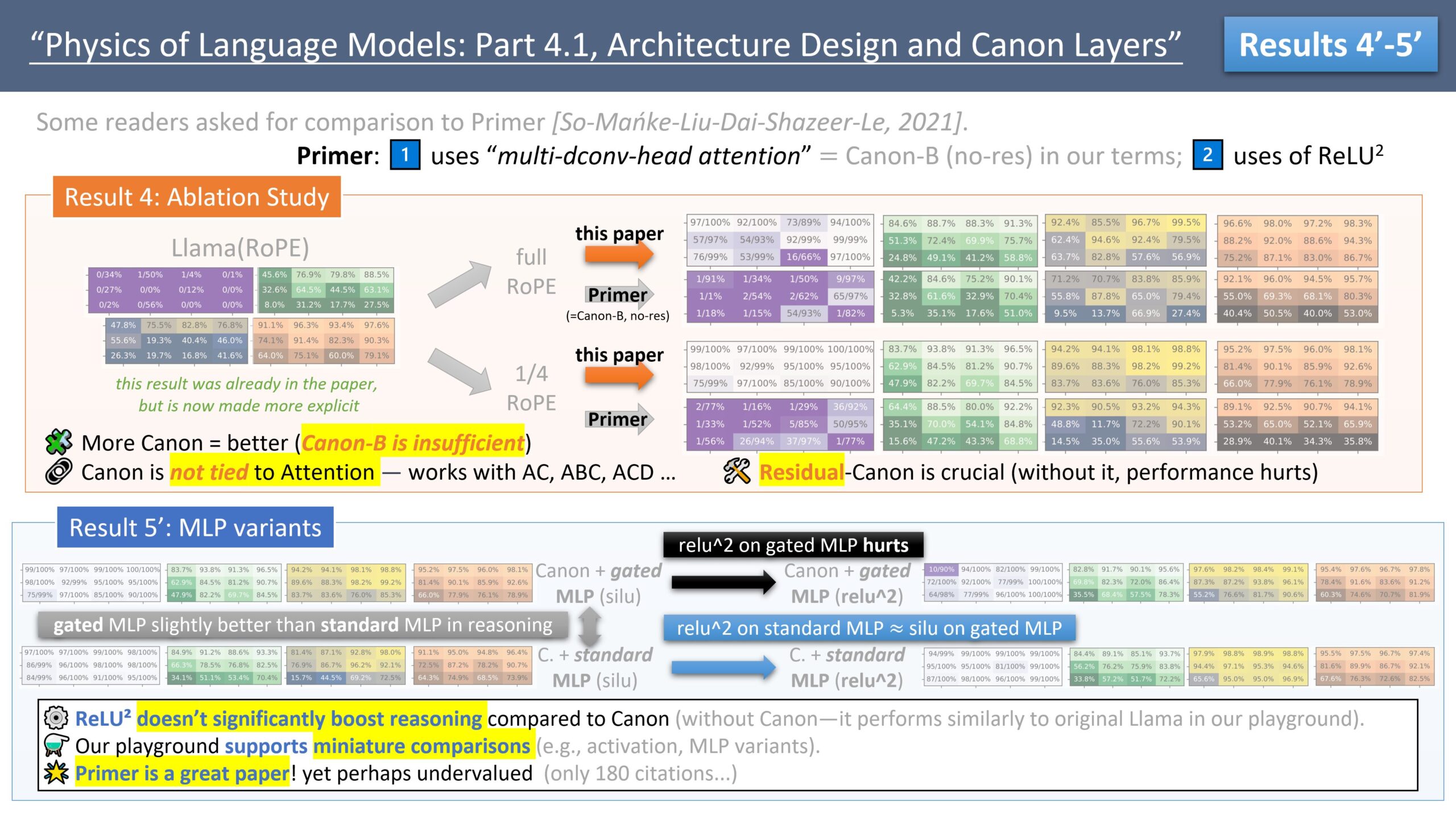

Zeyuan Allen-Zhu, LLM 아키텍처 설계 시리즈 연구 발표, Primer 모델 논의: 연구원 Zeyuan Allen-Zhu는 자신의 “LLM 설계 물리학” 시리즈 연구를 통해 통제된 합성 사전 훈련 환경을 이용하여 LLM 아키텍처의 실제 한계를 밝혀내고 있습니다. 최근 공유한 내용에서 그는 Primer 모델(arxiv.org/abs/2109.08668)과 그 multi-dconv-head attention(그는 이를 Canon-B 잔차 연결 없음이라고 부름)에 대해 논의하며, 문제가 있다고 지적했지만 Primer 모델(인용 횟수 180회에 불과)이 잡음이 많은 실제 실험에서 의미 있는 신호를 발견했기 때문에 저평가되었다고도 생각합니다. (출처: ZeyuanAllenZhu, cloneofsimo)

Simons Institute, 신경망 스케일링 법칙 논의: Simons Institute는 Polylogues 시리즈 프로그램에서 Anil Ananthaswamy와 Alexander Rush를 초청하여 최근 몇 년간 경험적으로 발견된 신경망 스케일링 법칙(neural scaling laws)에 대해 논의했습니다. 이러한 법칙은 대기업들이 점점 더 큰 모델을 구축하는 결정에 큰 영향을 미쳤습니다. (출처: NandoDF)

François Fleuret, 《딥러닝 소책자》 출간: François Fleuret가 《The Little Book of Deep Learning》이라는 제목의 저서를 출간하여 독자들에게 딥러닝에 대한 정제된 지식을 제공하는 것을 목표로 합니다. (출처: Reddit r/deeplearning)

프린스턴 교수: AI는 인문학을 종식시킬 수 있지만, 존재 경험으로의 회귀를 촉진할 수도 있다: 프린스턴 대학교 D. Graham Burnett 교수는 《뉴요커》에 기고한 글에서 AI가 인문학에 미치는 충격에 대해 논했습니다. 그는 미국 대학에서 보편적으로 존재하는 “AI 수치심”, 즉 학생들이 AI 사용을 인정하지 않으려는 현상을 관찰했습니다. 그는 AI가 정보 검색 및 분석 측면에서 이미 전통적인 학문 방법을 넘어섰으며, 학술 서적을 고고학적 유물처럼 만들었다고 주장했습니다. AI가 지식 생산을 핵심으로 하는 전통적인 의미의 인문학을 종식시킬 수도 있지만, 동시에 인문학이 핵심 문제, 즉 어떻게 살 것인가, 죽음에 어떻게 직면할 것인가와 같은 존재론적 경험에 대한 탐구로 회귀하도록 촉진할 수도 있다고 보았습니다. 이러한 문제는 AI가 직접적으로 다룰 수 없는 영역입니다. (출처: 36氪)

7가지 연구, AI가 인간 뇌와 행동에 미치는 심오한 영향 밝혀: 일련의 새로운 연구들이 AI가 인간의 심리, 사회, 인지적 측면에 미치는 영향을 탐구했습니다. 연구 결과는 다음과 같습니다: 1) LLM 레드팀 테스터들은 호기심과 도덕적 책임감으로 모델의 취약점을 탐색합니다. 2) ChatGPT는 정신병 사례 분석에서 높은 진단 정확도를 보였습니다. 3) ChatGPT의 정치적 성향은 버전 간에 미묘한 변화를 보였습니다. 4) ChatGPT 사용은 직장 내 불평등을 심화시킬 수 있으며, 젊은 고소득 남성이 더 많이 사용합니다. 5) AI는 노인의 운전 행동을 분석하여 우울증 징후를 감지할 수 있습니다. 6) LLM은 성격 테스트에서 이미지를 “미화”하는 사회적 기대 편향을 보였습니다. 7) AI에 대한 과도한 의존은 특히 젊은층에서 비판적 사고를 약화시킬 수 있습니다. (출처: 36氪)

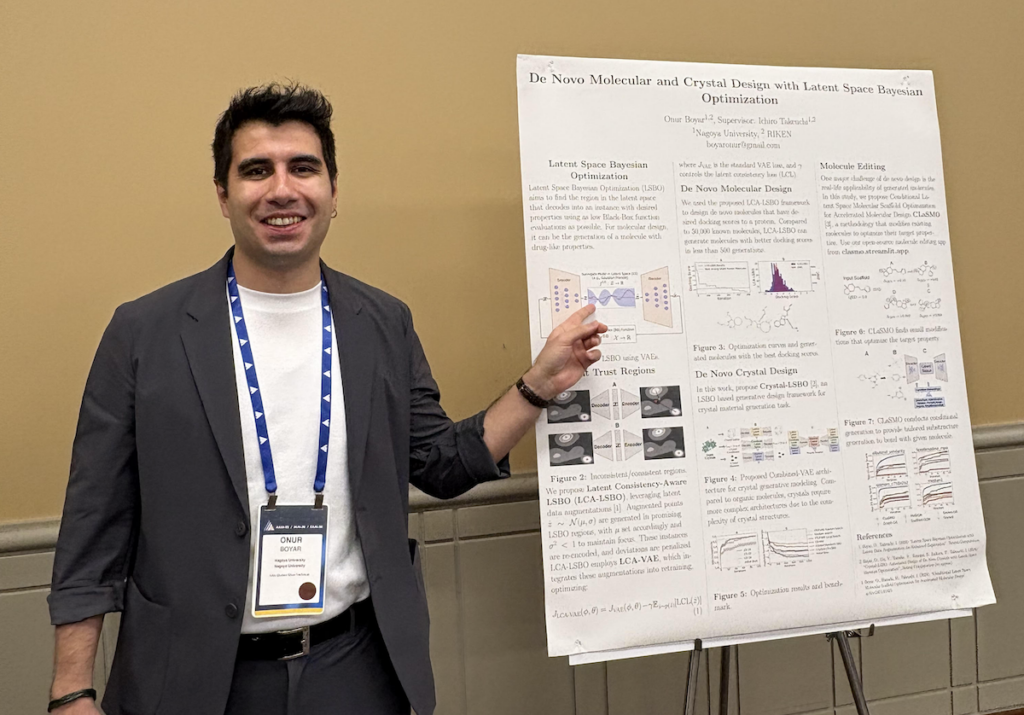

Onur Boyar 인터뷰: 생성 모델과 베이즈 최적화를 이용한 약물 및 재료 설계: AAAI/SIGAI 박사 과정 포럼 참가자 Onur Boyar는 나고야 대학에서의 박사 연구 작업을 소개하며, 생성 모델과 베이즈 방법을 사용한 약물 및 재료 설계에 중점을 두었습니다. 그는 약물 발견 과정을 처리하는 AI 과학자 로봇 구축을 목표로 하는 일본 Moonshot 프로젝트에 참여했습니다. 그의 연구 방법에는 잠재 공간 베이즈 최적화를 사용하여 기존 분자를 편집하여 샘플 효율성과 합성 가능성을 높이는 것이 포함됩니다. 그는 화학자들과의 긴밀한 협력을 강조하며, 졸업 후 IBM 도쿄 연구소의 재료 발견 팀에 합류할 예정입니다. (출처: aihub.org)

💼 비즈니스

Modular, AMD와 협력하여 Mojo Hackathon 개최, MI300X GPU 사용: Modular는 AMD와 협력하여 AGI House에서 특별한 해커톤을 개최한다고 발표했습니다. 행사에서 개발자들은 AMD Instinct™ MI300X GPU를 사용하여 Mojo 언어로 프로그래밍하게 됩니다. 또한 Modular, AMD, SemiAnalysis의 Dylan Patel 및 Anthropic 대표들이 기술 공유를 진행할 예정입니다. (출처: clattner_llvm)

Stripe, 결제 분야 AI 기반 모델 포함 다수 AI 기반 신기능 발표: 금융 서비스 회사 Stripe는 연례 컨퍼런스에서 AI 애플리케이션 도입을 가속화하기 위한 여러 신제품을 발표했으며, 그중에는 세계 최초로 결제 분야에 특화된 AI 기반 모델이 포함되어 있습니다. 이 모델은 수백억 건의 거래를 기반으로 훈련되었으며, 사기 탐지(예: “카드 테스트” 공격 탐지율 64% 향상), 승인율 및 개인화된 결제 경험 향상을 목표로 합니다. Stripe는 또한 다중 통화 자금 관리 기능을 확장하고 Nvidia(Stripe Billing을 사용하여 GeForce Now 구독 관리), PepsiCo 등 대기업과의 협력을 심화했습니다. (출처: 36氪)

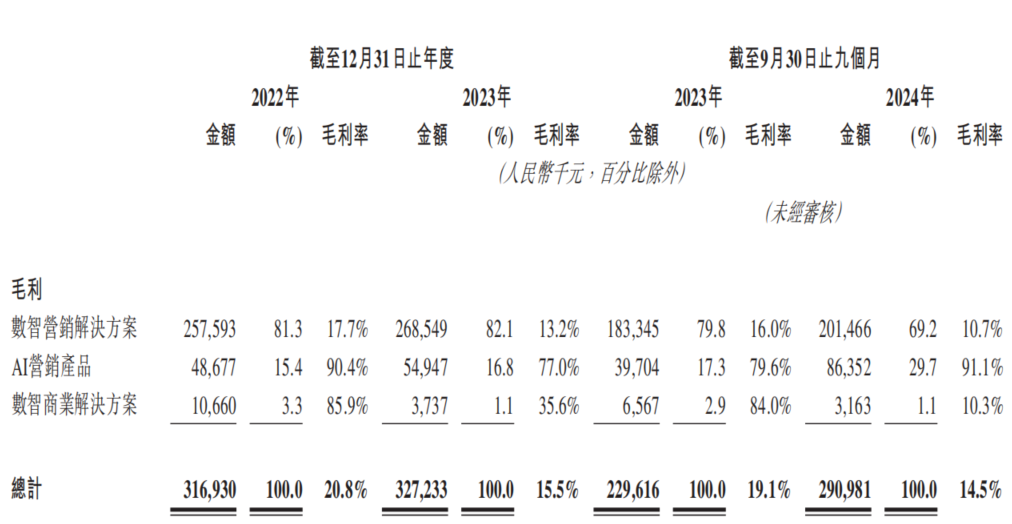

AI 마케팅 회사 Dongxin Marketing, 홍콩 증시 재도전, ‘매출 증가 불구 이익 감소’ 딜레마 직면: Dongxin Marketing은 ‘중국 최대 AI 마케팅 회사’라는 이름으로 홍콩 증권 거래소에 다시 한번 상장 신청서를 제출했습니다. 데이터에 따르면, 회사는 2022년부터 2024년 3분기까지 매출이 지속적으로 증가했지만 순이익은 크게 감소하거나 적자로 전환했으며, 매출 총이익률은 20.8%에서 14.5%로 하락했습니다. AI 마케팅 사업 매출 비중은 5% 미만이며, 매출 총이익률은 91.1%로 높지만 연구 개발 투자를 감당하기에는 부족합니다. 회사는 높은 미수금, 현금 흐름 경색, 부채 압박 등의 문제에 직면해 있으며, 이익은 정부 보조금에 크게 의존하고 있습니다. 시장 포지셔닝을 ‘모바일 마케팅 서비스 제공업체’에서 ‘AI 마케팅 회사’로 전환했지만, AI 기술의 가치와 상업화 전망은 불투명합니다. (출처: 36氪)

🌟 커뮤니티

vLLM과 SGLang 추론 엔진 경쟁 치열, 개발자 공개적으로 PR 병합 데이터 비교: 개발자 커뮤니티에서 vLLM과 SGLang 두 추론 엔진 간의 경쟁이 뜨겁습니다. vLLM의 주요 유지보수 담당자는 SGLang과 vLLM의 GitHub 풀 리퀘스트(PR) 병합 수를 비교하는 공개 대시보드까지 만들었으며, 이는 기능 반복과 성능 최적화에서 두 엔진의 치열한 경쟁을 보여줍니다. SGLang 측은 radix 캐시, CPU 오버랩, MLA 및 대규모 EP 등에서 선도적인 오픈소스 구현을 강조하고 있습니다. (출처: dylan522p, jeremyphoward)

AI 생성 “이탈리아 뇌썩남” 캐릭터 유니버스, Zoomer 세대 강타, 조회수 수억 회: Justine Moore는 AI가 생성한 일련의 “이탈리아 뇌썩남”(Italian brainrot) 캐릭터들이 Zoomer(Z세대) 사이에서 엄청난 인기를 끌고 있으며, 이 캐릭터들을 중심으로 완전한 “영화적 유니버스”를 구축했고 관련 콘텐츠가 수억 회의 조회수를 기록했다고 지적했습니다. 이 현상은 젊은 세대 사이에서 AI 생성 콘텐츠의 강력한 매력과 바이러스성 확산 잠재력, 그리고 특정 하위문화 형성을 반영합니다. (출처: nptacek)

Qwen3과 DeepSeek R1 모델 비교 토론, 각기 장단점 존재: Reddit 사용자가 Qwen3 235B와 DeepSeek R1 두 오픈소스 대규모 모델의 테스트 결과를 공유했습니다. 게시자는 간단한 작업에서는 Qwen이 더 나은 성능을 보였지만, 추론, 수학, 창의적 글쓰기와 같이 미묘한 차이가 필요한 작업에서는 DeepSeek R1이 더 우수했다고 평가했습니다. 커뮤니티 댓글에서는 DeepSeek R1의 접근성, Qwen3 235B의 검열되지 않은 미세 조정 버전, 그리고 언어 모델을 창의적 글쓰기에 사용하는 것의 합리성 등에 대한 논의가 이루어졌습니다. (출처: Reddit r/LocalLLaMA)

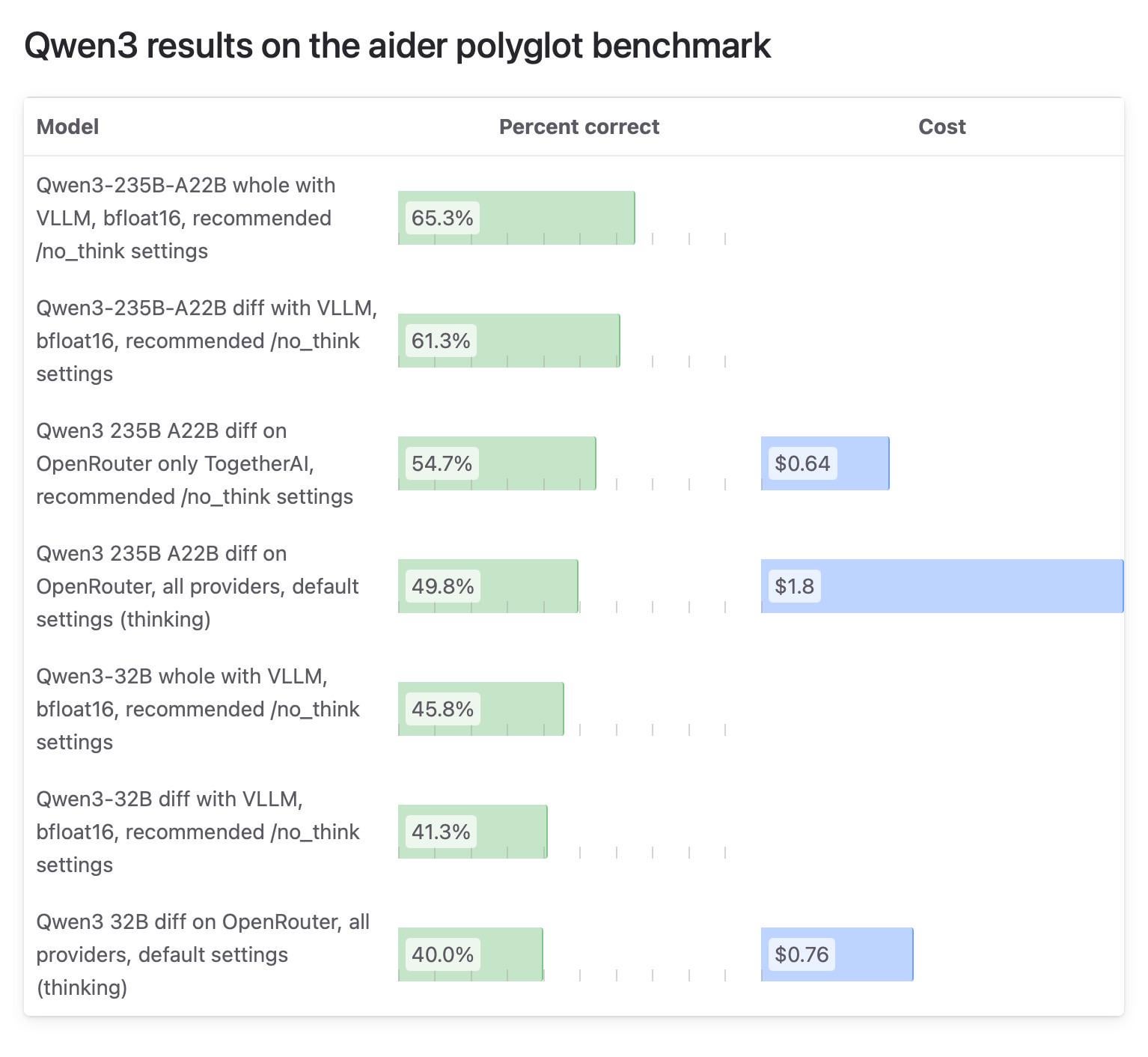

Aider 커뮤니티, Qwen3 모델 테스트 결과 차이 주목, OpenRouter 테스트 신뢰성 의문 제기: Aider 블로그는 Qwen3 모델에 대한 테스트 보고서를 발표하며, 모델이 다른 실행 방식에서 점수 차이가 크다고 지적했습니다. 커뮤니티 토론의 초점은 OpenRouter를 사용한 모델 테스트의 신뢰성에 맞춰졌습니다. 대부분의 사용자가 OpenRouter를 통해 모델을 사용할 가능성이 있지만, 라우팅 메커니즘으로 인해 결과가 일치하지 않을 수 있기 때문입니다. 일부 사용자는 오픈소스 모델은 재현성을 보장하기 위해 표준화된 자체 구축 환경(예: vLLM)에서 테스트해야 하며, API 제공업체에 투명성을 높여 사용된 양자화 버전과 추론 엔진을 명확히 밝힐 것을 촉구했습니다. (출처: Reddit r/LocalLLaMA)

사용자들, ChatGPT 유료 사용 개인적 이유 공유, 생활 보조, 학습, 창작 등 다양: Reddit r/ChatGPT 커뮤니티에서 많은 사용자들이 ChatGPT Plus/Pro 유료 구독의 개인적인 용도를 공유했습니다. 여기에는 시각 장애 사용자의 이미지 설명, 식품 포장 및 도로 표지판 읽기 지원, 면접 준비, 《엘든 링》과 같은 게임 줄거리 심층 이해, 달리기 훈련 계획 분석, 맞춤형 식단 제작, 도예 등 새로운 기술 학습 보조, 개인적인 동반자 역할, 정원 계획, 허브 제작, 그리고 D&D 캐릭터 생성 및 팬픽션 창작 등이 포함됩니다. 이러한 사례들은 ChatGPT가 일상생활과 개인적인 관심사에서 광범위하게 활용될 수 있는 가치를 보여줍니다. (출처: Reddit r/ChatGPT)

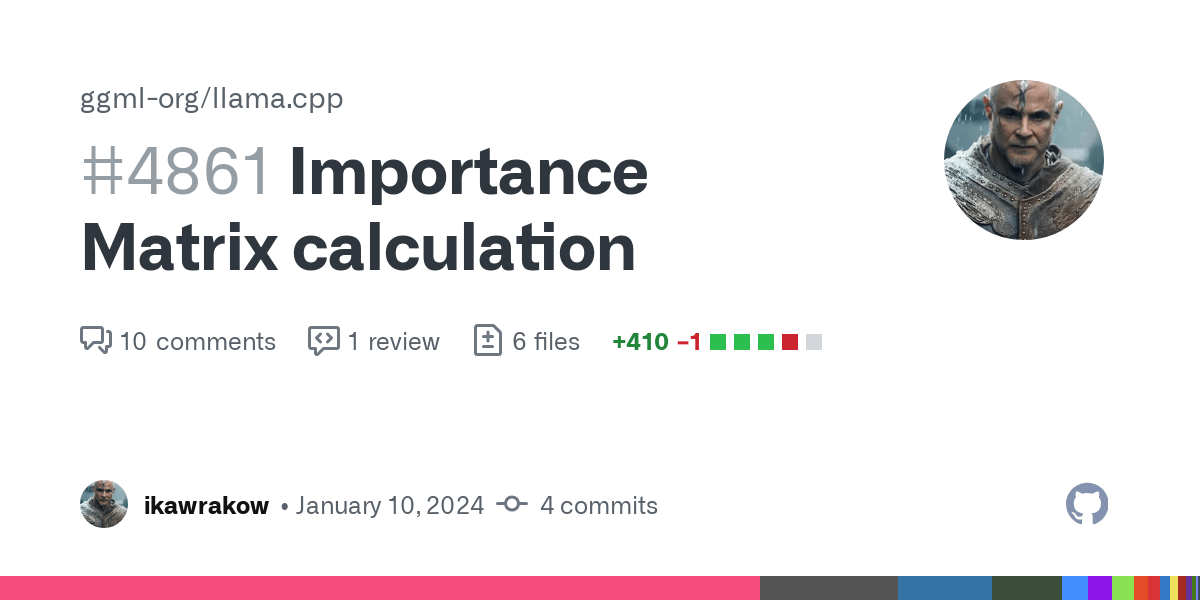

GGUF 양자화 모델 비교 테스트, “양자화 전쟁” 논의 촉발, 다양한 양자화 방식 각자의 장점 강조: Reddit 사용자 ubergarm이 Qwen3-30B-A3B 등 모델의 다양한 GGUF 양자화 버전에 대한 상세한 벤치마크 테스트 결과를 게시했습니다. 여기에는 bartowski와 unsloth 등 여러 제공업체의 양자화 방식이 포함되었습니다. 테스트는 퍼플렉서티, KLD 발산, 추론 속도 등 여러 차원을 다루었습니다. 이 글은 중요도 행렬 양자화(imatrix), IQ4_XS 등 새로운 양자화 유형의 등장과 unsloth 동적 GGUF 등 방법의 도입으로 GGUF 양자화가 더 이상 “획일적”이지 않다고 지적했습니다. 저자는 절대적으로 우수한 양자화 방식은 없으며, 사용자는 자신의 하드웨어와 특정 사용 사례에 따라 선택해야 하지만, 전반적으로 주요 방식들은 모두 괜찮은 성능을 보인다고 강조했습니다. (출처: Reddit r/LocalLLaMA)

💡 기타

Daimon Robotics, 마음과 손재주를 겸비한 로봇 Sparky 1 출시: Daimon Robotics 회사가 민첩한 로봇 기술 분야의 혁신적인 제품 Sparky 1을 선보였습니다. 이 로봇은 “마음과 손재주를 겸비한”(Mind-Dexterous) 능력을 갖춘 것으로 묘사되며, 이는 감지, 의사 결정 및 정교한 조작 측면에서 새로운 수준에 도달했음을 시사하며, 첨단 AI 및 머신러닝 기술이 융합되었을 가능성이 있습니다. (출처: Ronald_vanLoon)

MIT, 쌀알 크기 초소형 로봇 개발, 뇌에 들어가 수술 불가능한 종양 치료 가능: MIT 연구진이 쌀알 크기의 초소형 로봇을 개발하여, 미세 침습 방식으로 뇌에 들어가 기존 수술로는 제거하기 어려웠던 종양을 치료할 수 있는 잠재력을 가지고 있습니다. 이러한 기술은 초소형 로봇 기술과 AI 내비게이션 또는 제어를 결합하여 신경외과 및 암 치료에 새로운 가능성을 제공합니다. (출처: Ronald_vanLoon)

아오샤 인텔리전스, 두 차례 투자 유치 완료, 소비자급 외골격 로봇 양산 및 AI 기술 융합 추진: 외골격 로봇 기술 플랫폼 회사 아오샤 인텔리전스(傲鲨智能)가 빈푸 캐피탈(彬复资本) 주도, 기존 주주인 궈이 캐피탈(国仪资本) 추가 투자로 두 차례 연속 투자를 유치했다고 발표했습니다. 자금은 소비자급 외골격 로봇 양산과 외골격 하드웨어 및 AI 기술 융합에 사용될 예정입니다. 회사 제품은 이미 산업 현장에 적용되었으며, 야외 활동 보조(예: 관광지 등산 보조) 및 재택 요양 시장 진출을 모색하고 있으며, 1만 위안 이내의 소비자급 제품 출시를 계획하고 있습니다. 최신 제품에는 AI 대규모 모델 훈련 기능이 탑재되었으며, 뇌-컴퓨터 인터페이스 기술을 사전 연구하고 있습니다. (출처: 36氪)