キーワード:GPT-5, 量子コンピューティング, AI材料設計, 強化学習, 大規模言語モデル, AIインフラストラクチャー, マルチモーダルモデル, AIエージェント, 量子NP困難問題, CGformer結晶グラフニューラルネットワーク, RLMT強化学習フレームワーク, DeepSeekスパースアテンションDSA, UniVid統一視覚タスクフレームワーク

🔥 注目

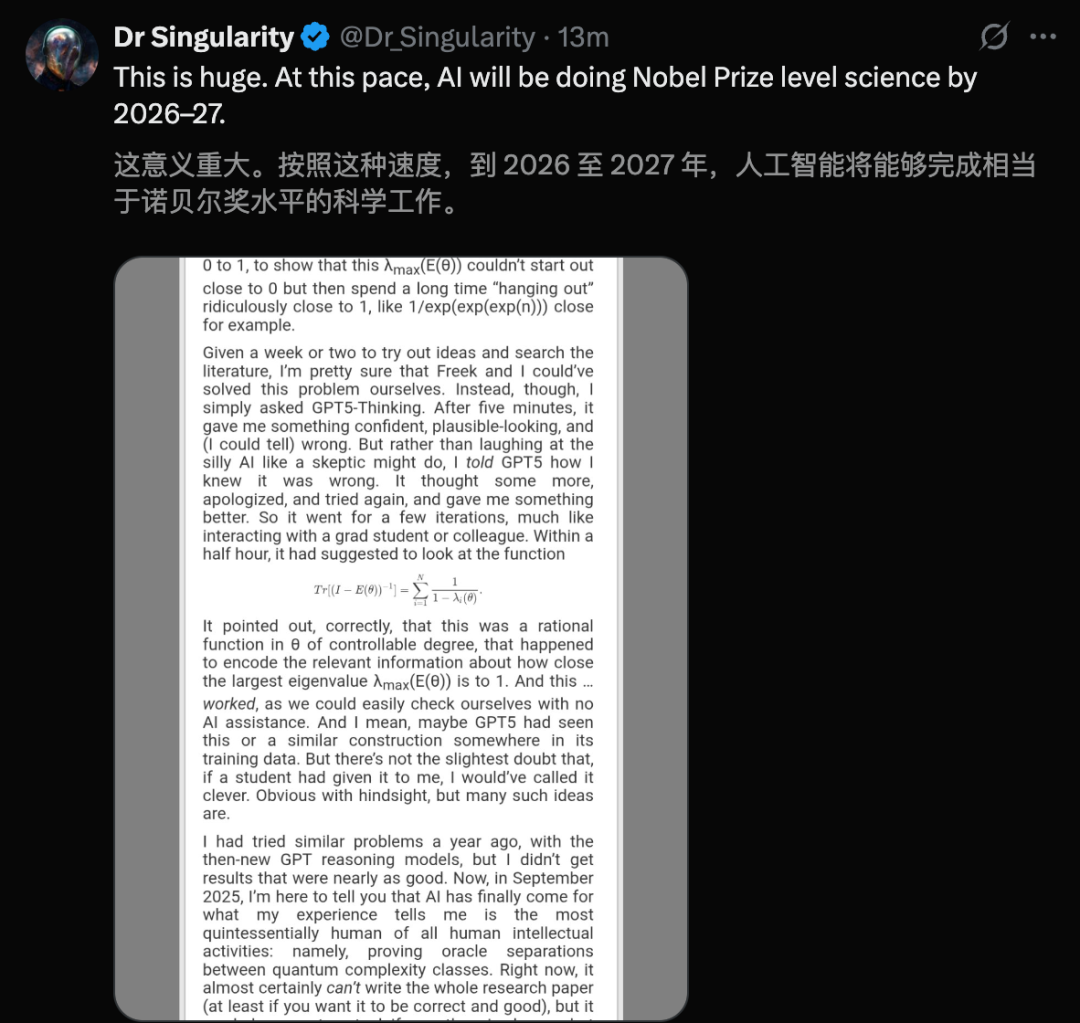

GPT-5、「量子NP問題」を攻略 : 量子計算の専門家Scott Aaronson氏が初めて論文を発表し、量子複雑性理論の研究におけるGPT-5の画期的な補助的役割を明らかにした。GPT-5は30分以内に「量子版NP問題」の重要な導出プロセスを解決するのに貢献し、これは通常、人間が1〜2週間かかる作業である。この成果は、AIが人類の知性の核心的な科学的発見作業に触れ始めたことを示し、科学研究分野におけるAIの潜在能力の大きな飛躍を予見させる。 (出典: arXiv, scottaaronson.blog)

新材料AI設計モデルCGformer : 上海交通大学の李金金教授と黄富強教授のチームが、新しいAI材料設計モデルCGformerを開発した。GraphormerのグローバルアテンションメカニズムとCGCNNを革新的に融合し、中心性エンコーディングと空間エンコーディングを統合することで、従来の結晶グラフニューラルネットワークの限界を突破した。このモデルは、複雑な結晶構造のグローバル情報を完全に捕捉し、高エントロピーナトリウムイオン固体電解質などの新材料の予測精度とスクリーニング効率を大幅に向上させる。 (出典: Matter)

UniVid、統一ビジョンタスクフレームワーク : UniVidは、事前学習済みのビデオ拡散Transformerを微調整することで、タスク固有の変更なしに多様な画像およびビデオタスクに適応できる革新的なフレームワークである。この手法は、タスクを視覚的ステートメントとして表現し、コンテキストシーケンスを通じてタスクと期待される出力モダリティを定義する。これにより、事前学習済みビデオ生成モデルが視覚モデリングの統一基盤として持つ大きな可能性を示している。 (出典: HuggingFace Daily Papers)

RLMT、大規模モデルの後期学習を覆す : プリンストン大学のChen Danqi准教授のチームは、「モデル報酬思考に基づく強化学習」(RLMT)フレームワークを提案した。これは、LLMが応答する前に長い思考連鎖を生成させ、好みベースの報酬モデルと組み合わせてオンラインRL最適化を行うものである。この手法は、オープンエンドタスクにおけるLLMの推論能力と汎化性を大幅に向上させ、8BモデルでさえチャットやクリエイティブライティングにおいてGPT-4oを凌駕する結果を示した。 (出典: arXiv)

CHURRO、歴史文書認識モデル : CHURROは、高精度かつ低コストの歴史文書認識のために設計された3BパラメータのオープンソースVLM(Visual Language Model)である。このモデルは、22世紀にわたる46言語の99,491ページに及ぶ歴史文書データセットCHURRO-DSで訓練され、Gemini 2.5 Proなどの既存のVLMを上回る性能を発揮し、文化遺産研究と保存の効率を大幅に向上させる。 (出典: HuggingFace Daily Papers)

🎯 動向

Altman氏、AIスーパーインテリジェンスとPulse機能を予測 : Sam Altman氏は、AIが2030年には完全に人類の知能を超えることを予測し、AIの発展速度が驚異的であると指摘した。OpenAIはChatGPTの「アクティブモード」であるPulse機能をリリースし、AIが受動的な応答から、ユーザーの雑談内容に基づいて関連情報を能動的に提供し、極めてパーソナライズされたサービスを実現する段階へと移行したことを示した。これは、AIが人類の潜在意識のアウトソーシングとなることを予見させる。 (出典: 36氪, )

Jensen Huang氏、AIバブル論を否定しNVIDIAの戦略を語る : Jensen Huang氏はインタビューで「AIバブル帝国」論を否定し、AIが経済において重要な役割を果たすことを強調し、NVIDIAが初の時価総額10兆ドル企業になる可能性を予測した。彼は、AI推論の背後には巨大な計算能力の需要が潜んでおり、NVIDIAは究極の協調設計を通じて毎年新しいアーキテクチャを導入し、システムエコシステムをオープンにすることで、自社開発の波を恐れず、AI経済システムを形成し「主権AI」を新たな共通認識として推進することを目指していると述べた。 (出典: 36氪, )

DeepSeek、V3.2-ExpとDSAメカニズムをオープンソース化 : DeepSeekは、パラメータ数685BのV3.2-Exp実験バージョンをオープンソース化し、同時に論文を公開して、新しい疎なアテンションメカニズム(DeepSeek Sparse Attention、DSA)を詳細に紹介した。DSAは、長いコンテキストシナリオにおけるトレーニングと推論効率の最適化を探索・検証することを目的としており、モデル出力の品質を維持しながら、長いコンテキスト処理効率を大幅に向上させる。 (出典: 36氪, HuggingFace)

GLM-4.6、まもなくリリース : Zhipu AIのGLM-4.6モデルがまもなくリリースされる予定で、そのZ.ai公式サイトではGLM-4.5が「前世代のフラッグシップモデル」と表示されており、新バージョンがコンテキスト長などの面で改善をもたらす可能性を示唆し、コミュニティの注目と期待を集めている。 (出典: Reddit r/LocalLLaMA, karminski3)

AppleのAI戦略と社内チャットボットVeritas : Appleが社内で開発しているコードネーム「Veritas」のAIチャットボットが明らかになった。これはSiriの練習相手として、アプリ内操作を実行する能力を持つ。それにもかかわらず、Appleは消費者向けチャットボットのリリースにはこだわらず、システムレベルのAI統合に注力し、AIアンサーエンジンと汎用インターフェースMCPを通じてサードパーティモデルの統合を深める計画であり、自社開発のチャットボットは行わない方針である。 (出典: 36氪)

AI PC市場の成長と技術的ボトルネック : AI PC市場の出荷量は2025年から2026年にかけて力強く成長すると予測されているが、これは主にWindows 10のサポート終了とPC買い替えサイクルによって牽引されるものであり、AI技術による破壊的な変化ではない。現在のAI機能は従来のPCの補完にとどまり、ローカル計算能力の不足、受動的なインタラクション、閉鎖的なエコシステムなどの課題に直面している。真のAIデバイスは「ローカル計算能力を主とし、クラウド補完を副とする」ことと、能動的な感知を実現する必要がある。 (出典: 36氪)

AI、電力取引市場に参入 : AIは電力取引市場で広く応用されており、清鵬智能などの企業は時系列大規模モデルを用いて風力・太陽光発電量と電力需要を予測し、取引意思決定を支援している。AIが大量のデータを処理する利点は利益を拡大する可能性があるが、モデルの未成熟さや市場の複雑性により損失を招く可能性もあり、業界はまだ探索段階にある。 (出典: 36氪)

Alibaba Cloudの通義大規模モデル更新とフルスタックAIサービス : Alibaba Cloudは雲栖大会でフルスタックAIシステムを大幅にアップグレードし、Qwen3-MAX、Qwen3-Omniなど6つの新モデルを発表し、「フルスタックAIサービスプロバイダー」としての位置付けを明確にした。Alibaba Cloudは「AI時代のAndroid」と「次世代コンピュータ」の構築に注力し、基盤モデルからインフラストラクチャまでフルスタックのAIクラウドサービスを提供することで、AI Agentが「知能の創発」から「自律行動」へと進化するのに対応することを目指している。 (出典: 36氪)

NVIDIA Blackwellアーキテクチャの深掘り解説 : NVIDIA Blackwellアーキテクチャの深掘り解説イベントが開催され、そのアーキテクチャ、最適化、およびGPUクラウドでの実装について議論される。このイベントはSemiAnalysisとNVIDIAの専門家が講演し、Blackwell GPUが「次の10年のGPU」としてAI計算能力の発展とGPUクラウドの未来をいかに推進するかを明らかにする。 (出典: TheTuringPost)

🧰 ツール

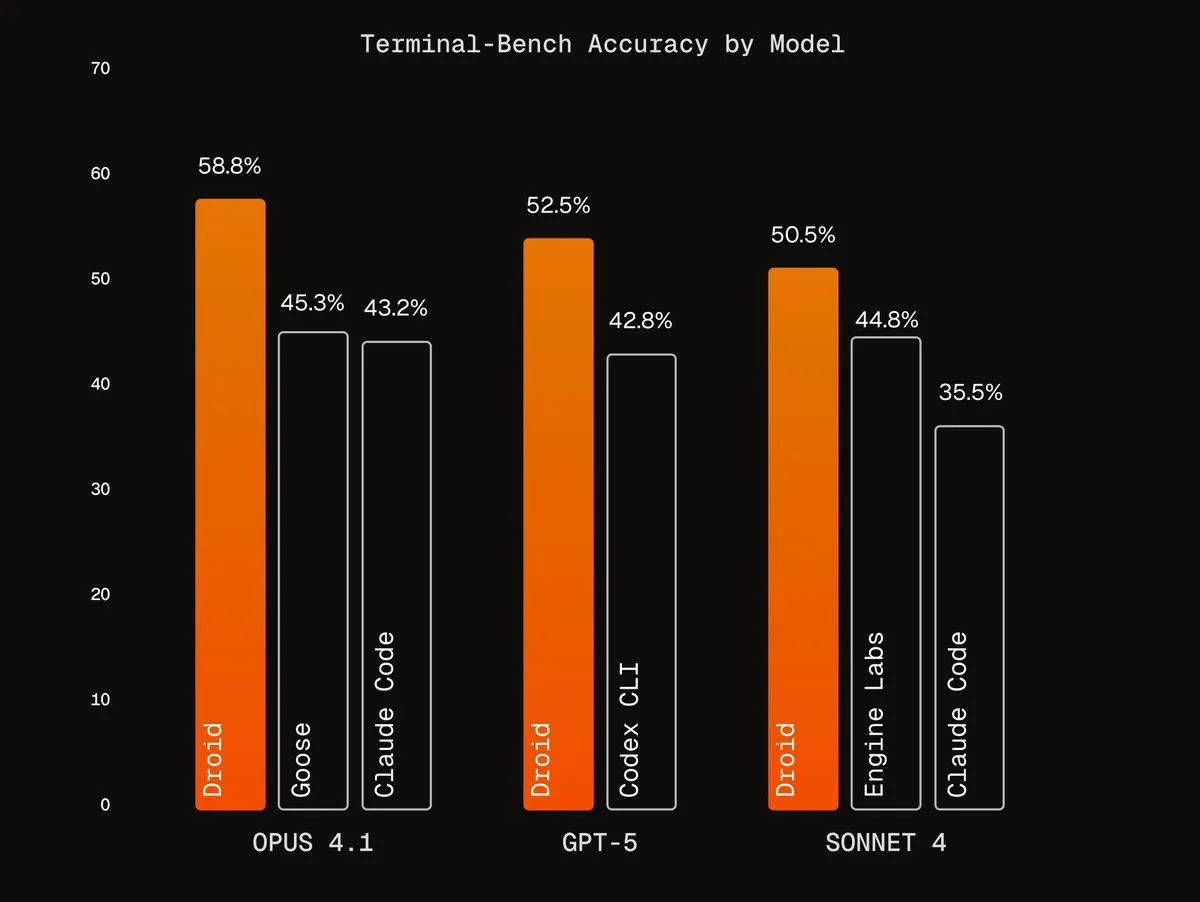

Factory AIのAgentic Harnesses : Factory AIは世界クラスのAgentic Harnessesを開発し、既存モデルの性能を大幅に向上させた。特にコーディングタスクで優れた性能を発揮し、ユーザーからは「チートコード」と呼ばれている。そのDroidsエージェントはTerminal-Benchで1位を獲得し、マルチエージェント検証ワークフローを通じて信頼性の高いコードリファクタリングを実現している。 (出典: Vtrivedy10, matanSF, matanSF)

RAGLight、オープンソースRAGライブラリ : LangChainAIは、プロダクションレベルのRAGシステムを構築するための軽量PythonライブラリRAGLightを発表した。このライブラリは、LangGraph駆動のエージェントパイプライン、マルチプロバイダーLLMサポート、組み込みのGitHub統合、およびCLIツールを備えており、RAGシステムの開発とデプロイを簡素化することを目指している。 (出典: LangChainAI, hwchase17)

ArgosOS、セマンティックOS : ArgosOSは、ベクトルデータベースではなくタグベースのアーキテクチャを通じて、ドキュメントのスマート検索とコンテンツ統合を実現するデスクトップアプリケーションである。LLMを利用して関連タグを作成し、SQLiteデータベースに保存することで、ショッピングの請求書分析などのクエリをインテリジェントに処理し、小規模アプリケーション向けに正確で効率的なドキュメント管理ソリューションを提供する。 (出典: Reddit r/MachineLearning)

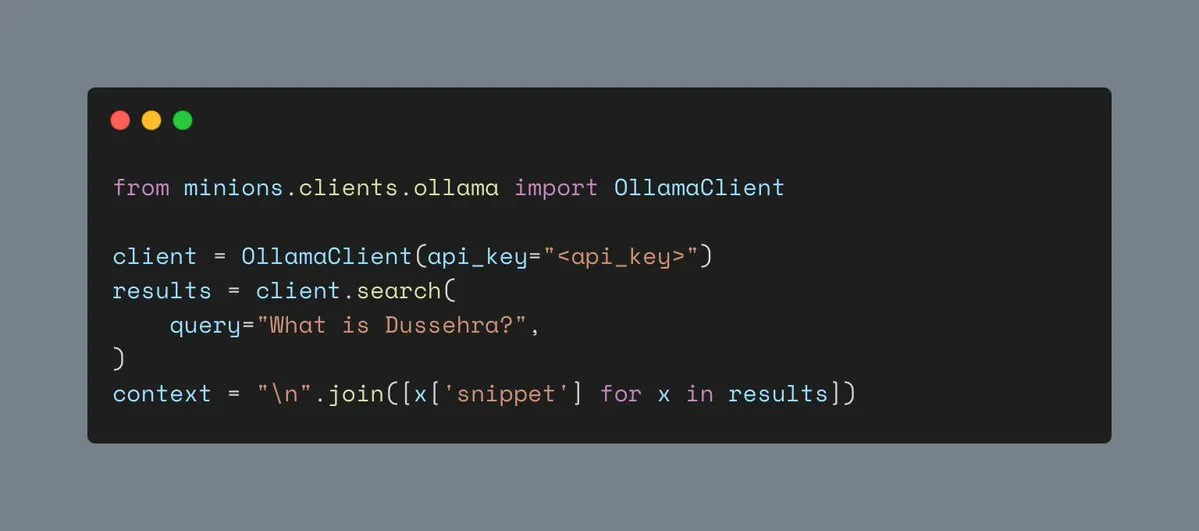

OllamaのWeb検索ツール : OllamaはWeb検索ツールをサポートし、ユーザーがMinionsワークロードにWeb検索機能を統合できるようになり、AIアプリケーションのコンテキスト情報を充実させ、複雑なタスクを処理する能力を向上させる。 (出典: ollama)

Hyperlink、ローカルマルチモーダルRAG : HyperlinkはローカルマルチモーダルRAG機能を提供し、ユーザーがスクリーンショット/写真ライブラリをオフラインで検索・要約できるようにする。OCRと埋め込み技術を通じて、このツールは非構造化画像データをクエリ可能なコンテンツに変換し、完全にプライベートでデバイス上でのドキュメント管理と情報抽出を実現する。 (出典: Reddit r/LocalLLaMA)

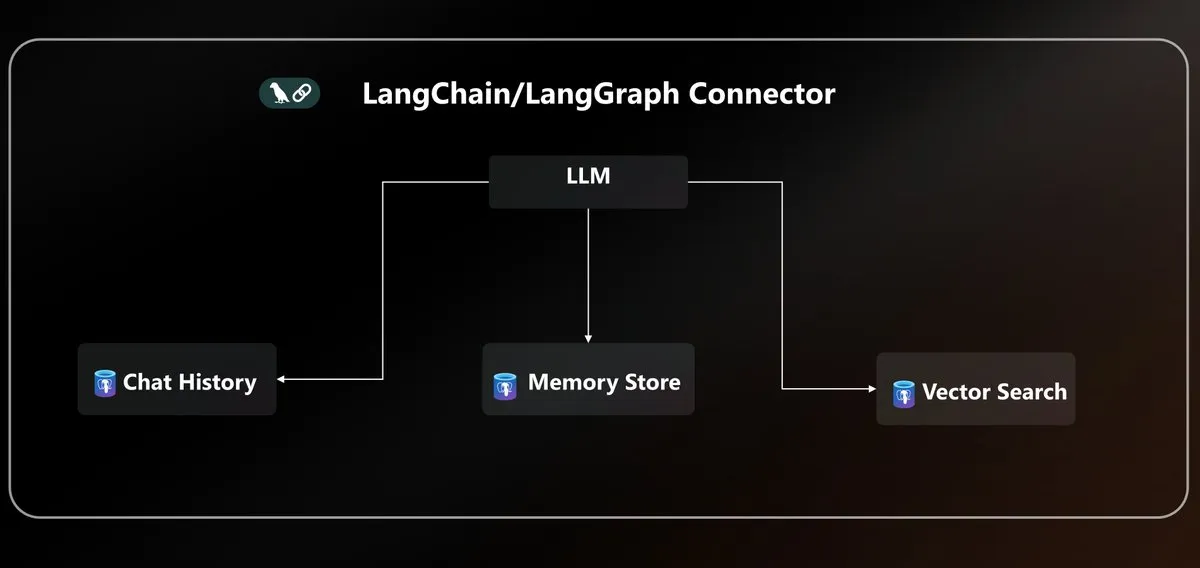

Azure PostgreSQL LangChainコネクタ : Microsoftは、LangChainエコシステムのエージェント永続性を統一するためのネイティブAzure PostgreSQLコネクタを発表した。このコネクタはエンタープライズレベルのベクトルストアと状態管理を提供し、Azure環境でAIエージェントを構築およびデプロイする複雑さを簡素化する。 (出典: LangChainAI)

LLM APIの標準化とMCPプロトコル : コミュニティではLLM APIの断片化問題が議論されており、異なるプロバイダー間でメッセージ構造、ツール呼び出しパターン、推論フィールド名に互換性がないことが指摘され、業界のJSON APIプロトコルの標準化が求められている。同時に、MCP(Model-Client Protocol)プロトコルの導入も、そのエージェント開発への影響について議論を呼んでいる。 (出典: AAAzzam, charles_irl)

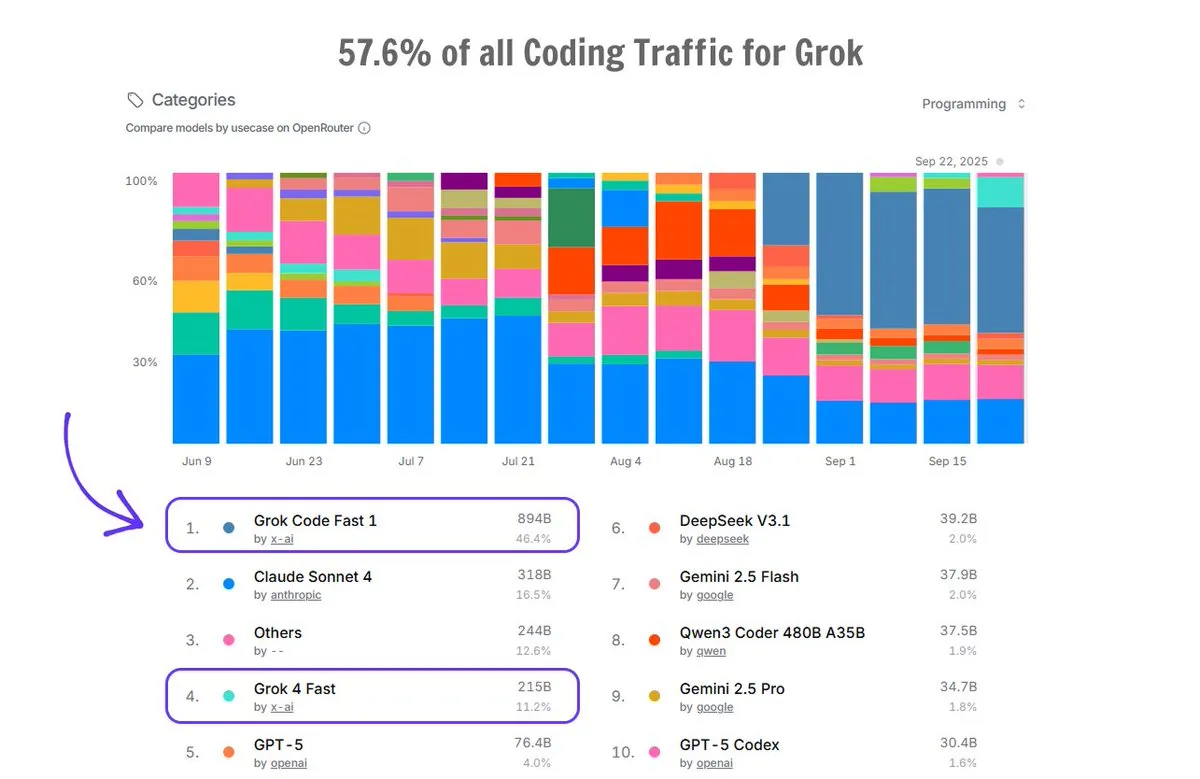

OpenRouterにおけるGrok Codeの活用 : Grok CodeはOpenRouterプラットフォームでコーディングトラフィックの57.6%を占め、他のすべてのAIコードジェネレーターの合計を上回った。特にGrok Code Fast 1が1位となり、コード生成分野におけるその強力な市場パフォーマンスとユーザーからの支持を示している。 (出典: imjaredz)

📚 学習

AI基礎コースCursor Learn : Lee Robinson氏は、tokens、context、agentsなどのAI基礎概念を初心者が習得するのに役立つ無料の6部構成のビデオシリーズ「Cursor Learn」をリリースした。コースは約1時間で、クイズとAIモデルの試用が提供され、AIの基礎知識を学ぶための便利なリソースとなっている。 (出典: crystalsssup)

Pythonデータ構造の無料書籍 : Donald R. Sheehy氏は、『A First Course on Data Structures in Python』という無料書籍を公開した。この書籍は、データ構造、アルゴリズム的思考、複雑性分析、再帰/動的計画法、検索方法を網羅しており、AIおよび機械学習分野の学習者に強固な基礎を提供する。 (出典: TheTuringPost)

dots.ocr、多言語OCRモデル : 小紅書Hi Labは、強力な多言語OCRモデル「dots.ocr」を発表した。これは100言語をサポートし、テキスト、テーブル、数式、レイアウトをエンドツーエンドで解析(Markdown形式で出力)でき、商用利用も無料である。このモデルは小型(1.7B VLM)でありながら、OmniDocBenchとdots.ocr-benchでSOTA(State-of-the-Art)性能を達成している。 (出典: mervenoyann)

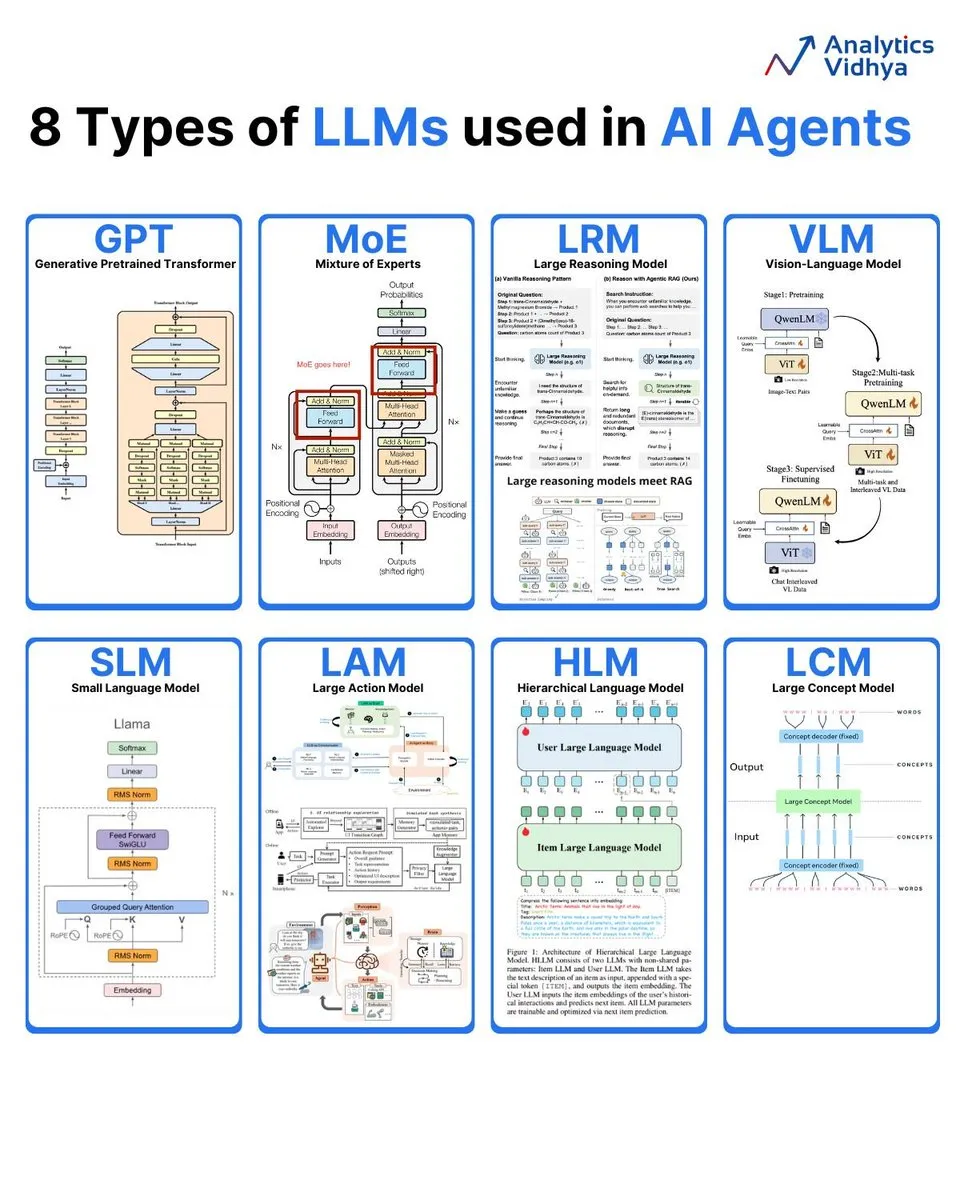

8種類の主要な大規模言語モデルタイプを解説 : Analytics Vidhyaは、GPT(Generative Pre-trained Transformer)、MoE(Mixture of Experts)、LRM(Large Reasoning Model)、VLM(Visual Language Model)、SLM(Small Language Model)、LAM(Large Action Model)、HLM(Hierarchical Language Model)、LCM(Large Concept Model)を含む8種類の主要な大規模言語モデルタイプをまとめ、そのアーキテクチャと応用について詳細に解説している。 (出典: karminski3)

AI週報:最新論文まとめ : DAIR.AIは、今週のAI論文セレクション(9月22日~28日)を発表した。ATOKEN、LLM-JEPA、Code World Model、Teaching LLMs to Plan、Agents Research Environments、Language Models that Think, Chat Better、Embodied AI: From LLMs to World Modelsなど、複数の最先端研究を網羅しており、AI研究者に最新の動向を提供する。 (出典: dair_ai)

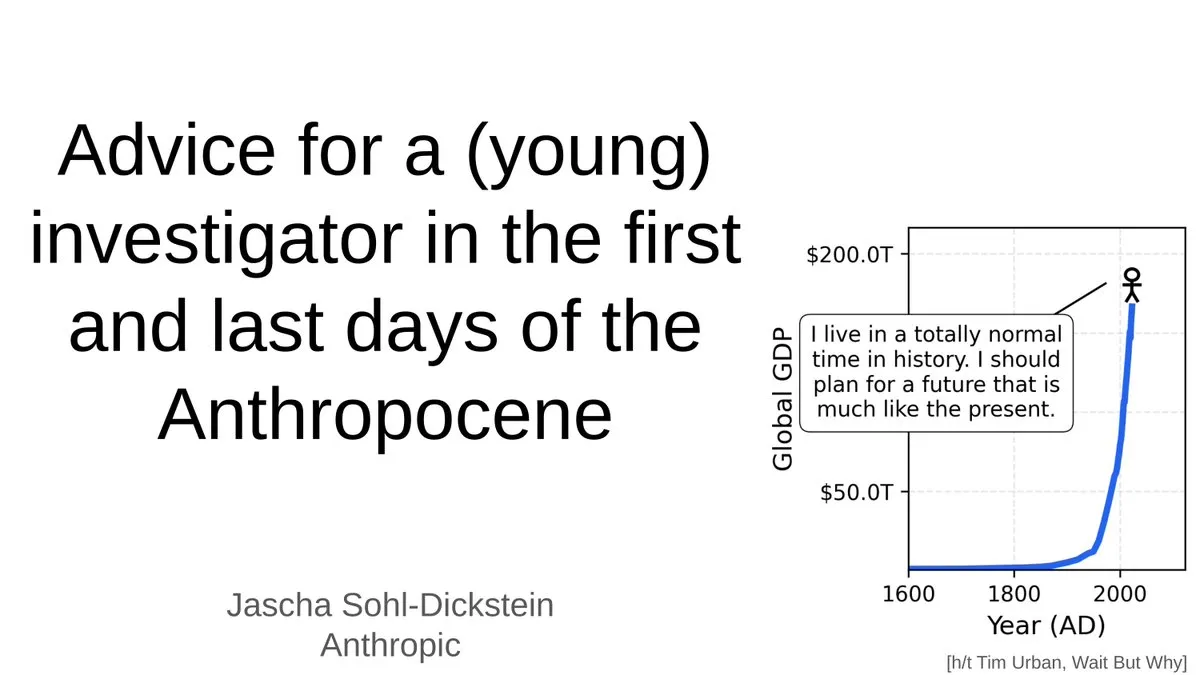

AI時代の若手研究者へのアドバイス : Jascha Sohl-Dickstein氏は、「人新世」の最終段階において、若手研究者が研究プロジェクトを選択し、キャリアの意思決定を行うための実践的なアドバイスを共有した。彼はAGIが学術キャリアに与える深い影響について議論し、AIシステムが人間の知能を超えるという背景の中で、研究の方向性と専門能力開発を再考する必要性を強調した。 (出典: mlpowered)

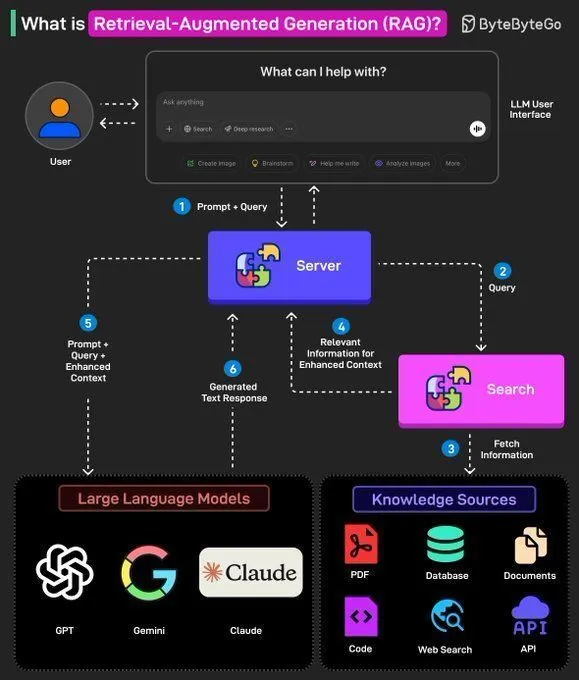

RAGの概念とAI Agentの構築 : Ronald van Loon氏は、RAG(Retrieval Augmented Generation)の基本概念とLLMにおけるその重要性について共有し、AI Agentを構築するための8つの重要なステップを提供した。内容はAI Agentの概念、スタック、利点、およびフレームワークを通じた評価方法を網羅しており、AI開発者に理論から実践までのガイダンスを提供している。 (出典: Ronald_vanLoon, Ronald_vanLoon)

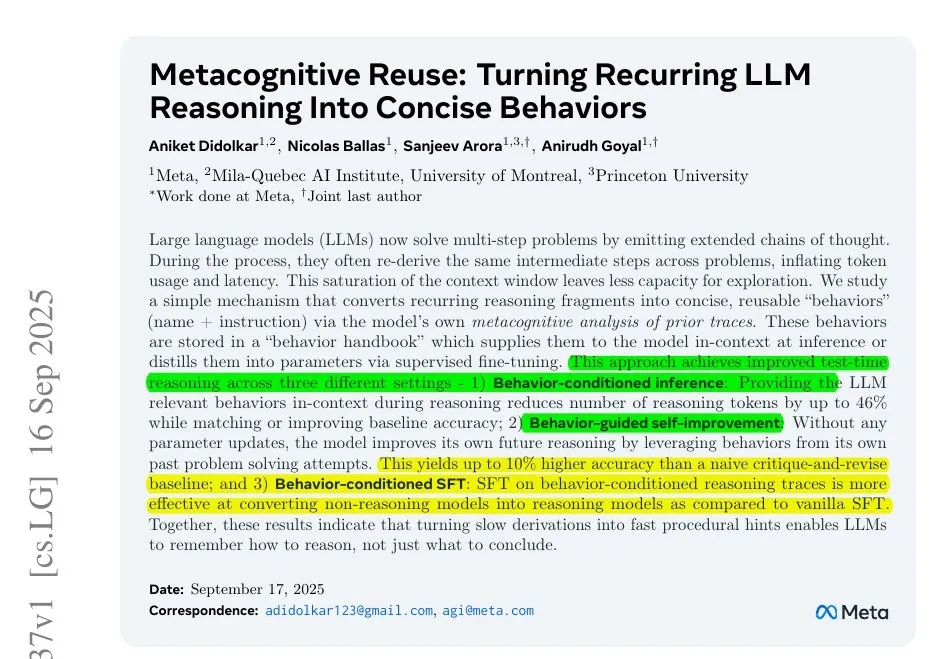

Meta、LLM推論の非効率性を解決 : Metaの研究は、LLMが長い思考連鎖において反復的な作業を行うことによる推論の非効率性の問題を明らかにした。彼らは、反復的なステップを小さな名前付きアクションに圧縮し、モデルが再推論するのではなくこれらのアクションを呼び出すことで、トークン消費を削減し、推論効率と精度を向上させる新しいアプローチを提案し、LLM推論プロセスの最適化に新たな視点を提供した。 (出典: ylecun)

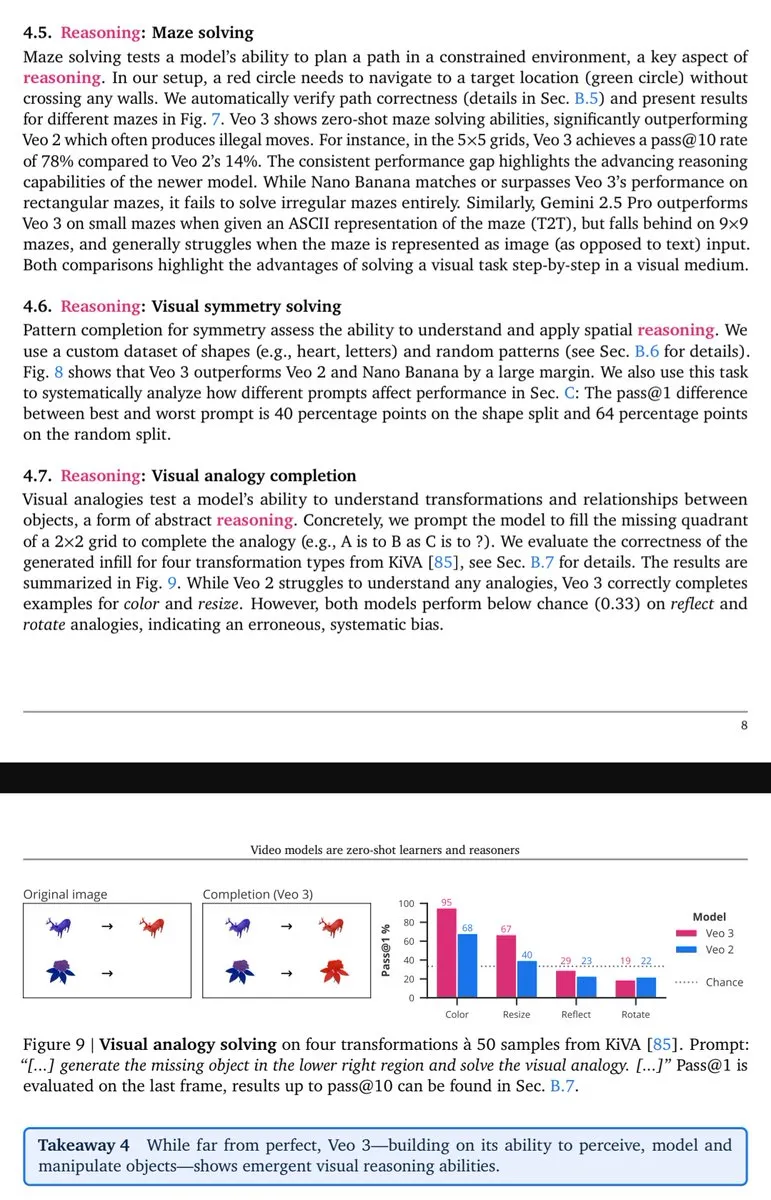

Veo-3、視覚推論能力を発揮 : Lisan al Gaib氏は、Veo-3ビデオモデルがGPT-3に似た創発的な(視覚)推論能力を示しており、ネイティブマルチモーダルモデルがその潜在能力を十分に発揮すれば、より包括的な視覚理解と推論の恩恵をもたらすことを予見させると指摘した。 (Source: scaling01)

💼 ビジネス

OpenAIの1000億ドル賭けとAIインフラバブル : OpenAIは、NVIDIAからの1000億ドルの出資やOracleとの3000億ドルの「Stargate」提携など、チップ、クラウドコンピューティング、データセンターにまたがる巨大なネットワークを、資金を投じて構築している。2025年の収益予測がわずか130億ドルであるにもかかわらず、OpenAIの経営陣はAIインフラへの投資を「100年に一度の機会」と見なしており、AIインフラがインターネットバブルに直面しているのではないかという議論を呼んでいる。 (出典: 36氪)

Elon Musk氏、OpenAIを6度目の提訴 : Elon Musk氏が率いるxAI社は、OpenAIを6度目の提訴に踏み切った。OpenAIが従業員を組織的に引き抜き、Grok大規模モデルのソースコードおよびデータセンター戦略計画などの企業秘密を不法に盗用したと主張している。この訴訟は、2つのAI大手間の競争が激化していることを示しており、Musk氏はOpenAIがその非営利の初心から逸脱したと考えている一方、OpenAIは「継続的な嫌がらせ」としてこの告発を否定している。 (出典: 36氪)

トップAI科学者Steven Hoi氏、Alibaba Cloud通義に加入 : 世界トップクラスのAI科学者であり、IEEE FellowであるSteven Hoi氏がAlibaba Cloud通義ラボに加入し、マルチモーダル大規模モデルの基礎的な最先端研究開発に転向する。Hoi氏は20年以上のAI産学研究経験を持ち、Salesforceの副社長を務め、HyperAGIを設立した経歴がある。今回の加入は、Alibaba Cloudがマルチモーダル大規模モデル分野に再び多額の投資を行い、モデルの反復効率とマルチモーダルイノベーションの突破を加速させることを示している。 (出典: 36氪)

🌟 コミュニティ

ChatGPT 4oの性能低下とユーザーの感情 : 多数のChatGPTユーザーが4oモデルの性能低下を報告しており、「縮小」や「安全ルーティング」の問題が発生し、ユーザーは不満と裏切られた感情を抱いている。特に多くの神経多様性を持つユーザーは、4oが彼らのコミュニケーションと自己理解の「生命線」であったため、悲しんでいる。ユーザーはOpenAIの透明性の欠如を広く疑問視し、「成人ユーザーを扱う」という約束を果たすこと、そして不明確な検閲メカニズムに反対するよう求めている。 (出典: Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/ChatGPT)

AI時代の雇用とレイオフ論争 : コミュニティでは、AIが雇用市場に与える影響について活発な議論が交わされている。これには、初級職の数が著しく減少していること、企業がAI投資と並行してレイオフを行っていること、AIによるレイオフ理由の真実性などが含まれる。議論では、「AIを理解する人がAIを理解しない人に取って代わる」という傾向が指摘され、企業に対して、単に初級職を削減するのではなく、AI時代に必要な希少な人材を育成するために、入門レベルの仕事を再設計するよう求めている。 (出典: 36氪, 36氪, Reddit r/artificial)

LLM研究の課題と参入障壁 : コミュニティでは、機械学習研究の参入障壁が日々高まっていることが活発に議論されており、個人研究者が大手テクノロジー企業と競争することが困難になっている。膨大な数の論文、高価な計算能力、複雑な数学理論などの課題に直面し、多くの人が入門やブレークスルーの達成に困難を感じており、この分野の持続可能性への懸念を引き起こしている。 (出典: Reddit r/MachineLearning)

MoEモデルがローカルホスティングに与える影響 : コミュニティでは、MoEモデルがローカルLLMホスティングに与えるメリットとデメリットについて深く議論されている。MoEモデルはより多くのVRAMを占有するものの、計算効率が高く、CPUオフロードを通じてより大きなモデルを実行できるため、特にメモリは豊富だがGPUが制限されている消費者向けハードウェアに適しており、LLM性能を向上させる効果的な方法であるという見解が示されている。 (Source: Reddit r/LocalLLaMA)

AI Agentsの急速な発展と応用 : コミュニティではAI Agentsの急速な発展が議論されており、その能力は1年足らずで「ほとんど使えない」状態から、狭いシナリオでは「うまく機能する」状態、さらには「汎用Agentが有用になり始めている」状態へと予想以上に速く向上している。しかし、現在のコーディングAgentは同質性が高く、顕著な違いに欠けるという意見もある。 (Source: nptacek, HamelHusain)

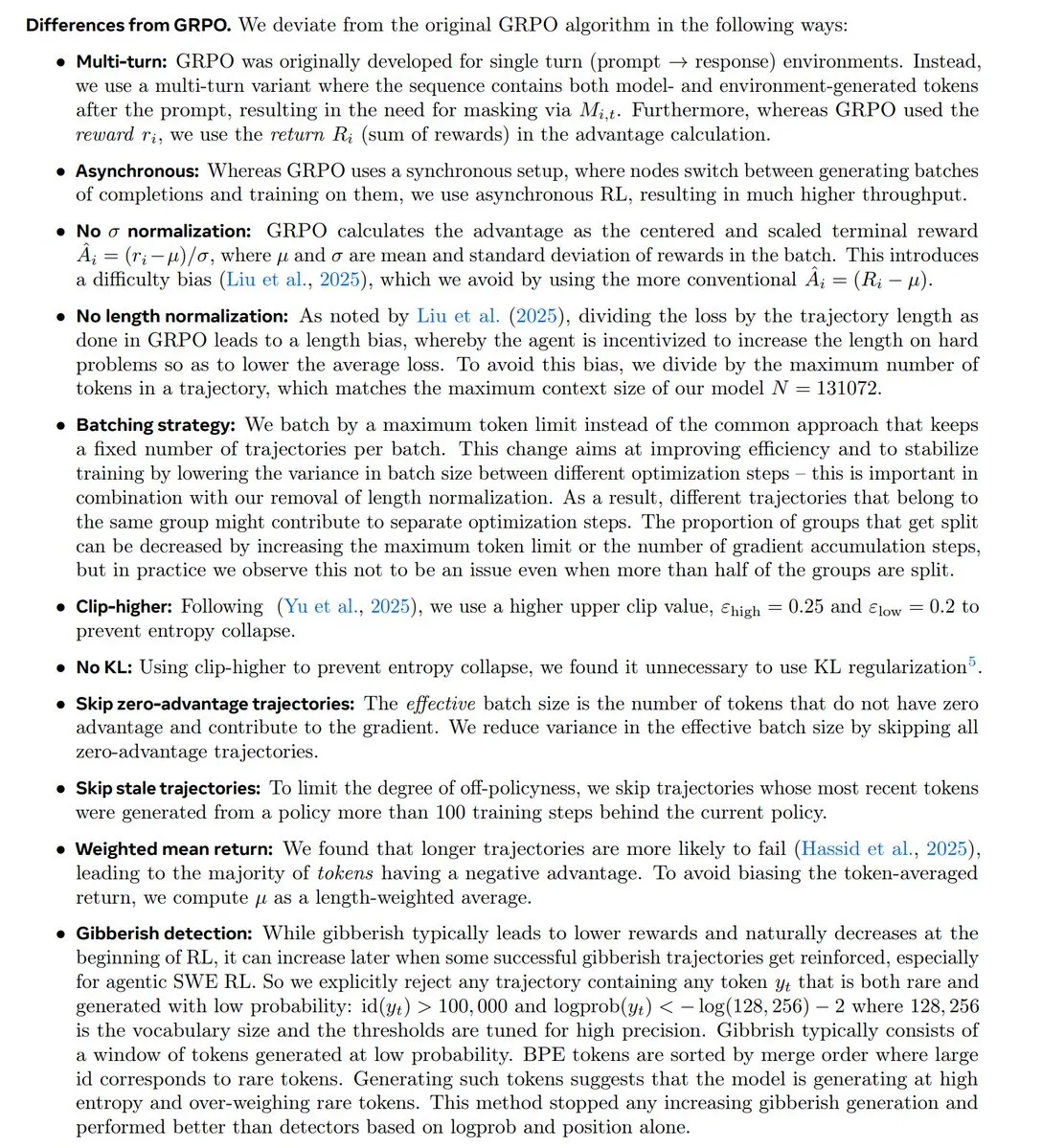

RL研究のトレンドとGRPOの論争 : コミュニティでは、強化学習(RL)研究の最新トレンド、特にGRPOアルゴリズムの位置付けと論争について深く議論されている。RL研究が事前学習/モデリングへと移行しているという見方があり、GRPOは重要なオープンソースの進展であるとされているが、OpenAIの従業員からは、それが最先端技術に著しく遅れをとっているという意見もあり、アルゴリズムの革新と実際の性能に関する激しい議論を呼んでいる。 (出典: natolambert, MillionInt, cloneofsimo, jsuarez5341, TheTuringPost)

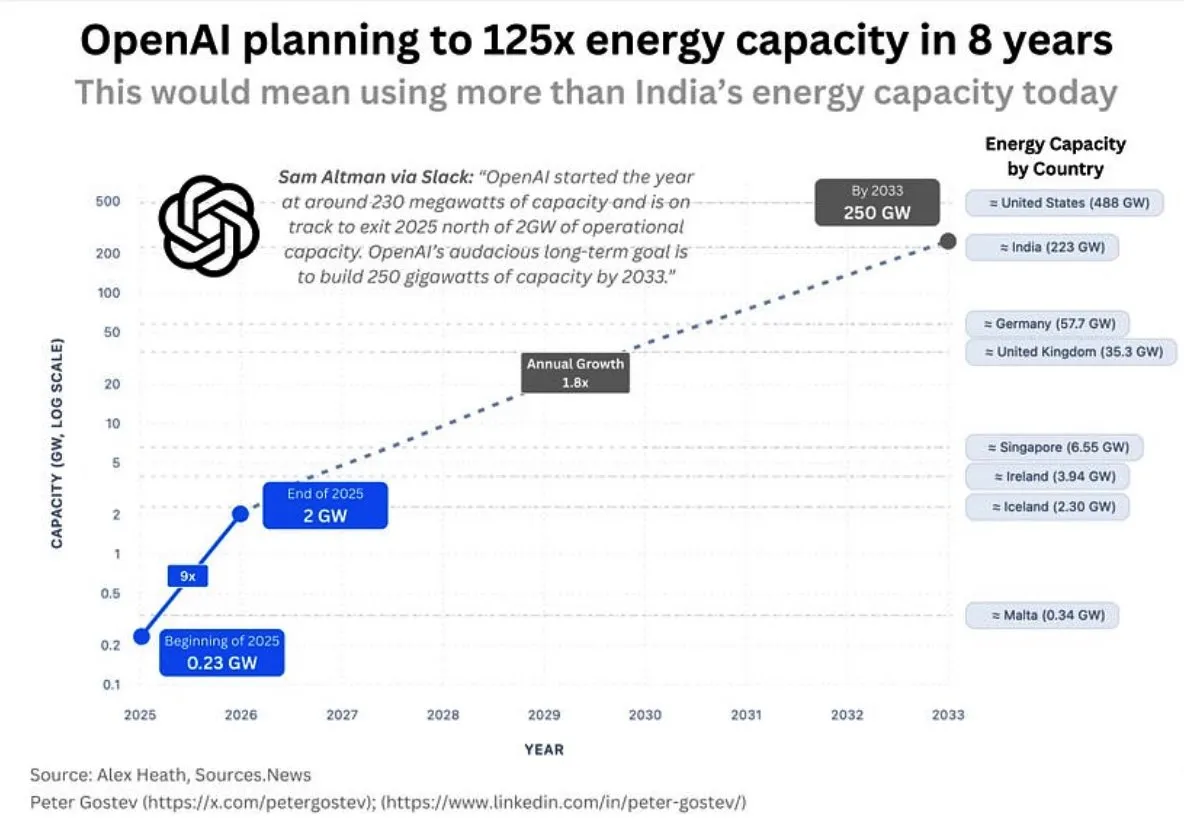

OpenAIのエネルギー消費とAIインフラ : コミュニティでは、OpenAIの将来の巨大なエネルギー需要について議論されている。5年以内にイギリスやドイツを超えるエネルギーを消費し、8年以内にはインドを超えるという予測が、AIインフラ構築の規模、エネルギー供給、および環境への影響に関する懸念を引き起こしている。同時に、Googleのデータセンターの立地も、水資源消費の問題で地元住民の反対に遭っている。 (Source: teortaxesTex, brickroad7)

Suttonの「Bitter Lesson」とAIの発展 : コミュニティでは、Richard Suttonの「Bitter Lesson」がAI研究に与える示唆について議論されている。これは、人間の事前知識よりも汎用的な計算方法が優れていることを強調するものである。議論は「模倣と世界モデル」の関係を中心に展開され、単純な模倣は「貨物崇拝」につながる可能性があり、真の経験を伴わない模倣には根本的な限界があると考えられている。 (Source: rao2z, jonst0kes)

💡 その他

BionicWheelBotバイオニックロボット : BionicWheelBotロボットは、車輪グモの転がる動きを模倣することで、複雑な地形での多機能ナビゲーションを実現した。この革新は、ロボット設計におけるバイオニクスの応用可能性を示し、将来のロボットが変化する環境に対応するための新しいソリューションを提供する。 (出典: Ronald_vanLoon)

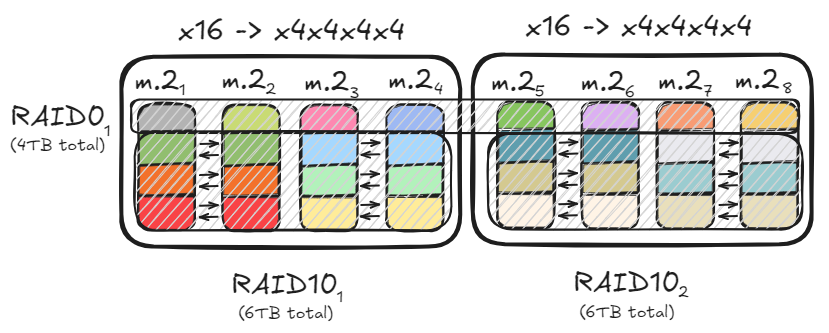

PCストレージの最適化とRAID構成 : ユーザーは、RAID0とRAID10構成を通じて、複数のPCIeチャネルとM.2ドライブを利用し、最大47GB/sのデータスループットを実現して大規模モデルのロードを高速化する方法を共有した。この最適化ソリューションは、高速な読み書き要件を満たしながら、ストレージ容量とデータ冗長性を両立させ、ローカルAIモデルのデプロイに効率的なハードウェア基盤を提供する。 (出典: TheZachMueller)

良渚「数栖湾AI+産業コミュニティ」開園 : 杭州良渚「数栖湾AI+産業コミュニティ」が正式に開園した。人工知能、デジタルノマド経済、文化クリエイティブなどの最先端分野に焦点を当てている。このコミュニティは、「数栖八条」という特別政策と「四場」という空間配置を通じて、AI探求者にアイデアの萌芽からエコシステムのリーダーシップまで、全ライフサイクルにわたるサポートを提供し、技術と人文が深く融合した革新的なエコシステムを構築することを目指している。 (出典: 36氪)