キーワード:OpenAI, IOI金メダル, AI競技プログラミング, GPT-5, 百川智能, 医療推論大規模言語モデル, AIチップ貿易, 具身智能, Baichuan-M2-32B, OpenAI HealthBench評価, AMD Mi300 GPU, 具身智能基盤, 量子レーダー技術, IOI金メダル, AI競技プログラミング, 医療推論大規模言語モデル, AIチップ貿易, 具身智能, OpenAI HealthBench評価, AMD Mi300 GPU, 具身智能基盤, 量子レーダー技術

🔥 注目

OpenAI IOI金メダルとAI競技プログラミングの新たな進展 : OpenAIの推論システムが2025年国際情報オリンピック(IOI)オンライン大会で金メダルを獲得し、AI参加者の中で1位、総合6位となり、人間の競技者の98%を上回った。このシステムは専用の学習モデルを使用せず、複数の汎用推論モデルを統合している。この成果は、AIが競技プログラミング分野で顕著なブレークスルーを達成したことを示すものだが、イーロン・マスクがGrok 4がGPT-5をコーディング面で上回ると主張し、OpenAIのマーケティング戦略に疑問を呈するユーザーもいる。LiveCodeBench Proテストでも、GPT-5 Thinkingが複雑なプログラミングタスクでブレークスルーを達成し、平均応答長が他のモデルをはるかに上回ったことが示されている。(ソース:sama, sama, 量子位, willdepue, npew, markchen90, SebastienBubeck)

百川智能が医療推論大規模モデルBaichuan-M2を発表 : 百川智能は最新の医療推論大規模モデルBaichuan-M2-32Bを発表した。OpenAI HealthBench評価セットにおいて、OpenAIのgpt-oss-120bやその他の主要なオープンソース・クローズドソースモデルを上回り、特にHealthBench-Hardおよび中国の臨床診療シナリオで優れた性能を発揮し、世界で唯一32点を超えた2つのモデルの1つとなった。このモデルはパラメータ数32Bで、RTX4090シングルカードでのデプロイをサポートし、プライベートデプロイコストを大幅に削減する。百川は「患者シミュレーター」と「Verifierシステム」を革新的に導入し、強化学習訓練を実施することで、実際の医療シナリオにおけるモデルの有用性を向上させた。(ソース:量子位)

GPT-5発表の論争とユーザーの信頼危機 : OpenAIがGPT-5を発表した後、その性能は期待を下回ると指摘され、革命的なブレークスルーというよりは、製品のイテレーションに近いとされた。CEOのSam Altmanによる過剰な宣伝(「デス・スター」の比喩、PhD級の専門家など)と、ユーザーの実際のフィードバック(エラー多発、創造的ライティング能力の低下、個性の欠如)とが著しい対照をなし、多数のユーザーの不満を招き、GPT-4oへの復元を求める声が成功した。さらに、OpenAIはGPT-5を医療健康アドバイスに利用することを奨励し始め、AI医療アドバイスの責任帰属に関する懸念を引き起こした。AI医療アドバイスを誤信したことによる中毒事例もすでに発生している。(ソース:MIT Technology Review, MIT Technology Review, 量子位)

🎯 動向

AIチップ貿易と中国の国産化トレンド : NVIDIAとAMDは米国政府と合意に達し、中国へのAIチップ販売による売上高の15%を米国政府に納付する。同時に、中国側はNVIDIA H20チップが安全でないと表明し、H20を放棄して国内AIチップを支持する計画である。この動きは、中国の国産AIチップエコシステムの発展を加速させ、世界のAI産業構造に深い影響を与えるだろうと分析されている。AIハードウェア分野では、AMD Mi300 GPUが192GBのシングルカードVRAMと1.5TBの8x GPUノード総VRAMにより、モデルの重みと長尺コンテキスト処理において顕著な優位性を示している。(ソース:MIT Technology Review, Reddit r/artificial, dylan522p, realSharonZhou)

AIの法制度への応用と課題 : 米国の法制度はAIのハルシネーション問題に直面しており、弁護士や裁判官がAIツールを使用する際に虚偽の判例を引用するなどの誤りが発生している。リスクがあるにもかかわらず、一部の裁判官は法律調査、事件の要約、定型的な命令の起草におけるAIの応用を模索しており、効率を向上させると考えている。しかし、AIの法律分野での応用範囲は曖昧であり、裁判官がAIを使用して誤りを犯した場合の責任追及の仕組みがまだ不明確であり、司法に対する国民の信頼を損なう可能性がある。(ソース:MIT Technology Review)

エンボディドAI産業の加速的発展と技術路線 : 2025年世界ロボット大会では、エンボディドAI分野における急速な進展が示された。宇樹科技と智元ロボットはリーディングカンパニーとして、ハードウェア(ロボット犬、足部の柔軟性)と、ソフトウェア・ハードウェア統合(ヒューマノイドロボット、エコシステム戦略)の2つの技術路線をそれぞれ代表している。睿爾曼公司も「エンボディドAI基盤」を核とするRealBOTエンボディドオープンソースプラットフォームと高性能関節モジュールを発表し、「Robot for AI」の理念を強調し、AIがデジタルインテリジェンスからエンボディドAIへと進化することを推進している。業界は「デモ披露」から「産業クローズドループモデル」へと移行しており、多額の資本と政策支援を集めている。(ソース:36氪, 36氪, 量子位, 量子位)

GoogleとOpenAIの最新モデルと機能の動向 : Google Gemini AppはUltraサブスクリプションユーザー向けにDeep Think機能を導入し、数学やプログラミングの問題を解決し、Gemini LiveがGoogleアプリと連携することをサポートする。Claudeは過去のチャット履歴の引用をサポートするようになり、ユーザーが会話を続けるのに便利になった。OpenAIは今後数ヶ月間の計算能力の割り当て優先順位を公表し、今後5ヶ月以内に計算能力を倍増させる計画である。また、GPT-ossモデルはリリース後、ダウンロード数が膨大だが、ハルシネーション行動と訓練データの欠陥も指摘されている。(ソース:demishassabis, demishassabis, dotey, op7418, sama, sama, Reddit r/ArtificialInteligence, Reddit r/LocalLLaMA, 量子位, TheTuringPost, SebastienBubeck, Alibaba_Qwen, ClementDelangue, Reddit r/LocalLLaMA, _lewtun, mervenoyann, rasbt)

AI検索がウェブサイトトラフィックに与える影響と業界変革 : Amazonが突然Google Shopping広告の入札から撤退し、Google AIショッピングアシスタントによる製品ページのクロールを禁止したことは、AI時代のトラフィックロジックにおける2大巨頭の決別を意味する。記事は、AI検索モデルが中小規模のウェブサイトには優しくなく、トラフィックが大手権威メディアや有名ウェブサイトに集中し、「貧者から奪い富者に与える」効果をもたらすと指摘する。これは、かつてBaiduがアプリの台頭によりトラフィックの入り口を失った苦境に似ており、Google検索の入り口としての地位も挑戦を受けることを示唆している。各プラットフォームはクローズドループへと向かっており、ユーザー行動の全プロセスを掌握しようとすることで、広告業界の信頼構造を再構築しようとしている。(ソース:36氪, 36氪)

量子レーダー技術の新たなブレークスルー : 物理学者が新型量子レーダーを開発した。原子雲を利用して電波を検出し、地下イメージング、例えば地下パイプライン建設や考古学的発掘への応用が期待される。この技術は量子センサーのプロトタイプとして、将来的には従来のレーダーよりも小型で高感度、かつ頻繁な校正が不要になる可能性がある。量子センサーと量子コンピューティングには共通点があり、関連する進展は相互に促進し合うことができる。(ソース:MIT Technology Review)

MetaがV-JEPA 2世界モデルを発表 : Metaは、視覚理解と予測のための画期的な世界モデルV-JEPA 2を発表した。これは、AIの視覚分野における知覚と予測能力の向上を目指すものである。(ソース:Ronald_vanLoon)

🧰 ツール

OpenAI Go APIライブラリ : OpenAI公式Go言語ライブラリ(openai-go)は、Go 1.21+をサポートし、チャット補完、ストリーミング応答、ツール呼び出し、構造化出力などの機能を含む、便利なOpenAI REST APIアクセスを提供する。また、エラー処理、タイムアウト設定、ファイルアップロード、Webhook検証などの実用的な機能も提供する。(ソース:GitHub Trending)

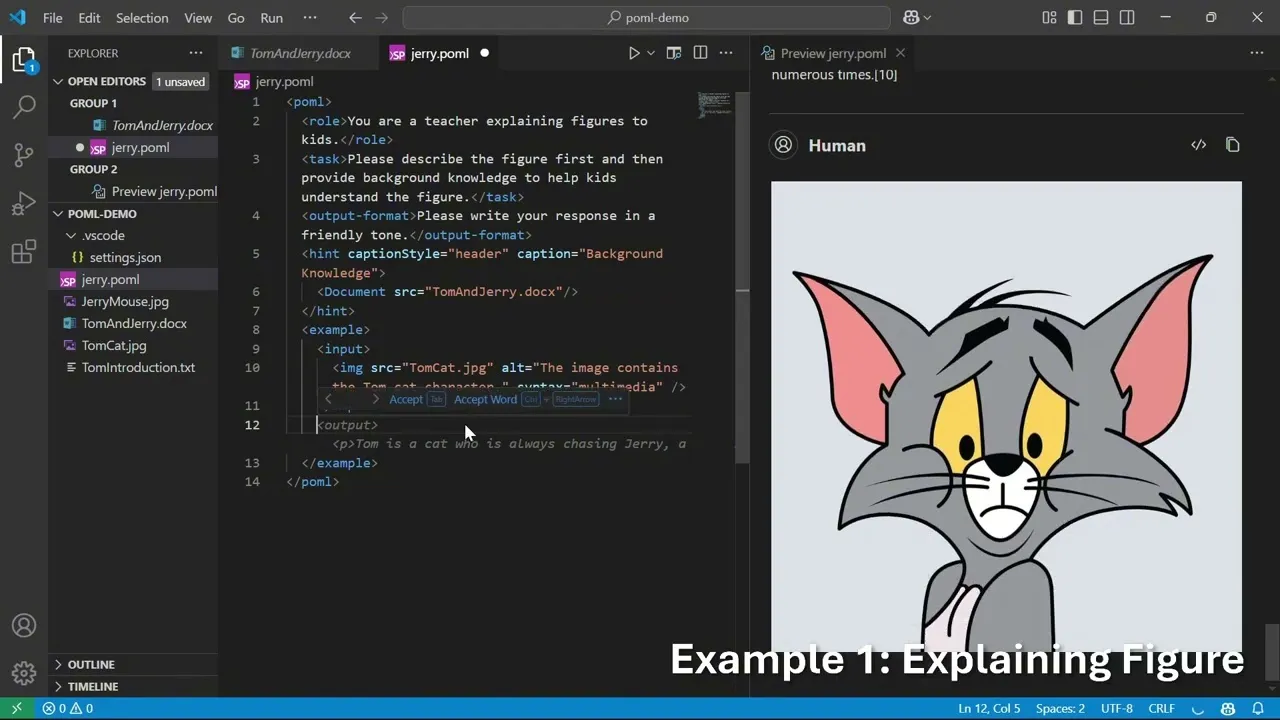

Microsoft POML:プロンプトオーケストレーションマークアップ言語 : MicrosoftはPOML (Prompt Orchestration Markup Language) を発表した。これは、大規模言語モデル(LLM)の高度なプロンプトエンジニアリングに構造、保守性、多機能性を提供することを目指す新型マークアップ言語である。HTMLに似た構文を採用し、データ統合、スタイル分離、組み込みテンプレートエンジンをサポートする。また、VS Code拡張機能とSDKも提供され、開発者がより複雑で信頼性の高いLLMアプリケーションを作成するのを支援する。(ソース:GitHub Trending)

LlamaIndex金融文書AI分析ツール : LlamaIndexは、LlamaCloudを通じて複雑な金融文書を分かりやすい言葉に変換し、グラフや財務データの詳細な解釈を提供し、コンテンツの書き換えとパーソナライズされたカスタマイズをサポートするAIツールを披露した。これにより、ユーザーは複雑な金融レポートを理解するのに役立つ。(ソース:jerryjliu0)

360スマートエージェントファクトリーの評価 : 360スマートエージェントファクトリーの評価が行われた。これは、AgentとMCP(マルチエージェント協調プラットフォーム)を包括的にカバーするプラットフォームで、検索エンジン、テキストから画像生成、ウェブページ生成などの機能をサポートする。減量期間のレシピ生成、セルフメディアコンテンツの大量生産、または複雑なワークフロー管理に利用可能である。そのマルチエージェントスウォーム機能は優位性があり、コンテンツの大量生産と複雑なワークフローの一元管理を容易に実現できる。(ソース:karminski3)

Excel AIプラグインとAI会議議事録ツール : ExcelのAIプラグインは、ユーザーがセル内でAIとチャットし、数式やマクロを生成することを可能にし、ExcelとAIの連携にアイデアを提供する。また、AI会議議事録ツールNotta(ポータブル録音デバイスNotta Memoを含む)は、その高速な音声転写、要約、質問機能によりSOTAと評価され、会議効率を大幅に向上させることができる。(ソース:karminski3, karminski3, karminski3)

GPT-5とAIバーチャルアバターの組み合わせ : SynthesiaはGPT-5の音声とAIバーチャルアバターを組み合わせた実験を行った。これは、AIコミュニケーションをより魅力的で、記憶しやすく、理解しやすいものにすることを目指し、LLMとマルチモーダルインタラクションの組み合わせを模索するものである。(ソース:synthesiaIO)

AI教育アプリケーションと研究ツール : GPT-5は教育分野で可能性を示しており、例えばインタラクティブな3D形状ビューアを作成し、子供たちが3D形状を学ぶのに役立つ。また、Elicitのブラウザエージェント機能は、ユーザーが論文の全文を素早く見つけるのに役立ち、pyCCslはClaude Codeのステータスラインツールとして、トークン使用量、コスト、コンテキストなどのセッション情報を提供し、LLMツールの使用体験を向上させる。(ソース:_akhaliq, jungofthewon, Reddit r/ClaudeAI)

OpenWebUIネイティブクライアントとClaude Codeスプリントオーケストレーションフレームワーク : OpenWebUIはiOSおよびAndroidネイティブクライアントをリリースした。これは、よりスムーズでプライバシーを優先したユーザー体験を提供することを目指すものである。同時に、GustavはClaude Codeのスプリントオーケストレーションフレームワークとして、製品要求文書(PRD)をエンタープライズ級アプリケーションのワークフローに変換し、開発プロセスを簡素化する。(ソース:Reddit r/OpenWebUI, Reddit r/ClaudeAI)

OpenWebUIファイルコンテキスト問題 : OpenWebUIユーザーから、アップロードされたPDF/DOCX/テキストファイルは正常に解析されたものの、モデルがクエリ時にそれらをコンテキストに含めることができないという報告があった。これは、AIツールがファイル処理とコンテキスト理解において、まだ解決すべき問題を抱えていることを示している。(ソース:Reddit r/OpenWebUI)

📚 学習

LLM推論と最適化研究 : ReasonRankは、推論集約型データ合成の自動化と2段階の事後学習を通じて、LLMのリスト形式ソート能力を大幅に向上させた。LessIsMoreは、訓練不要の疎なアテンションメカニズムを提案し、精度を犠牲にすることなくLLMのデコードを高速化する。TSRLMは、「アンカー拒否」と「未来誘導選択」の2段階フレームワークを通じて、自己報酬モデルの選好学習効率の低下問題を解決し、LLMの生成能力を大幅に向上させた。(ソース:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

AIエージェント評価と信頼性研究 : UserBenchは、ユーザー中心のベンチマーク環境として、LLMエージェントの曖昧な目標下での能動的なユーザー協調能力を評価し、現在のモデルがタスク完了とユーザーアラインメントの間で抱えるギャップを明らかにする。同時に、エージェントツール使用システムの信頼性評価と故障分類に関する研究も行われ、エージェントシステムのデプロイの信頼性を高めるため、成功率分解指標と故障タイプを標準化することを推奨している。(ソース:HuggingFace Daily Papers, Reddit r/MachineLearning)

マルチモーダルLLMとRAG技術の進展 : VisR-Benchデータセットは、長文ドキュメントにおける質問応答駆動型マルチモーダル検索の評価に使用され、MLLMが構造化された表や低リソース言語において依然として課題を抱えていることを示している。Bifrost-1フレームワークは、パッチレベルのCLIP画像埋め込みを介してMLLMと拡散モデルを橋渡しし、高忠実度で制御可能な画像生成を実現する。Video-RAGは、訓練不要の検索拡張生成方法を提供し、OCR+ASRを組み合わせて長尺動画の理解を実現する。(ソース:HuggingFace Daily Papers, HuggingFace Daily Papers, LearnOpenCV)

AIセキュリティと攻撃研究 : WhisperInjectフレームワークは、人間の耳にはほとんど知覚できない音声摂動を通じて、音声言語モデルを操作して有害なコンテンツを生成させ、音声ネイティブの脅威を明らかにする。Fact2Fictionは、エージェントベースのファクトチェックシステムに対する初のポイズニング攻撃フレームワークであり、悪意のある証拠を作成することでサブステートメントの検証を妨害し、ファクトチェックシステムのセキュリティ上の弱点を露呈させた。また、訓練前に有害なデータを除去することで、LLMが生物兵器製造を教えるのを防ぐ研究も行われており、これは訓練後の防御よりも効果的であるとされている。(ソース:HuggingFace Daily Papers, HuggingFace Daily Papers, QuentinAnthon15)

LLMアーキテクチャと圧縮技術 : Grove MoEは、異なるサイズの専門家と動的な活性化メカニズムを通じて、より少ない活性化パラメータでSOTAモデルに匹敵する性能を実現する新型MoEアーキテクチャである。MoBE方法は、ベースエキスパート混合によりMoEベースのLLMを圧縮し、パラメータ数を大幅に削減しつつ、精度低下を低く抑える。研究では、ステップエントロピーを通じてLLMの思考連鎖(CoT)を圧縮し、精度を大幅に低下させることなく冗長なステップを剪定することも模索されている。(ソース:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

強化学習とLLM推論の概説 : 強化学習(RL)と視覚知能の交差分野を概説し、戦略最適化、マルチモーダルLLMなどをカバーしている。別の論文では、LLM推論におけるRL技術を体系的にレビューし、再現と評価を通じてそのメカニズム、シナリオ、原則を分析し、2つの技術の組み合わせを最小化することで、批評家なしの戦略学習能力が解放されることを示唆している。(ソース:HuggingFace Daily Papers, HuggingFace Daily Papers)

汎用ロボット戦略とデータセットの多様性 : 研究により、汎用ロボット戦略の汎化能力が制限される原因は「近道学習」であり、主にデータセットの多様性不足とサブデータセット間の分布の違いに起因することが明らかになった。データ拡張が近道学習を効果的に減らし、汎化能力を向上させることが示されている。(ソース:HuggingFace Daily Papers)

LLMコーディングベンチマークと新データセット : NebiusチームはSWE-rebench leaderboardで34の新しいGitHub PRタスクをテストし、GPT-5-Mediumが全体的にリードしていることを発見した。Qwen3-Coderは最高のオープンソースモデルであり、pass@5指標でGPT-5-Highに匹敵する。OpenBench v0.2.0がリリースされ、数学、推論、健康などの分野をカバーする17の新しいベンチマークが追加された。WideSearchベンチマークは、AIエージェントが大規模な反復情報収集を処理する能力を評価する。(ソース:Reddit r/LocalLLaMA, eliebakouch, teortaxesTex)

AI学習リソースと書籍推薦 : RedditユーザーがAIのトレンド、新概念、イノベーション、論文に関するポッドキャスト/YouTubeチャンネルの推薦を求めている。また、『アクセス時代』、『ゼロ限界費用社会』、『ライフ3.0』、『必然』などの書籍が推薦されており、読者がAIと将来の経済社会の変化を理解し、ポスト希少性時代を探求するのに役立つ。(ソース:Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

GLM-4.5技術レポートとRL拡張 : GLM-4.5論文は、そのMoE大規模言語モデルを詳細に紹介している。これは混合推論方法を採用し、専門家モデルのイテレーション、混合推論モード、難易度ベースの強化学習カリキュラムを通じて、推論、コーディング、エージェントタスクで優れた性能を発揮する。新しい論文では、多次元性の追加、カリキュラム学習、多段階訓練の利点を含む、RL拡張の実験結果も詳細に紹介されている。(ソース:Reddit r/ArtificialInteligence, _lewtun, Zai_org)

その他のLLM研究と技術 : GLiClassモデルは、シーケンス分類タスクで高い精度と効率を示し、ゼロショットおよびフューショット学習をサポートする。SONAR-LLMは、デコーダーのみのTransformerモデルで、文レベルの埋め込みとトークンレベルの交差エントロピー監視を予測することで、競争力のある生成品質を実現する。Speech-to-LaTeXは、大規模な音声からLaTeXへのデータセットとモデルを発表し、数学コンテンツ認識を推進する。Hugging Faceは、12の低リソースインド言語を対象とした大規模な合成音声データセットであるIndicSynthデータセットのリリースを転送した。(ソース:HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, huggingface)

RL訓練問題と修正 : vLLMがv0からv1にアップグレードされたことで非同期RL訓練がクラッシュする原因となったが、すでに正常に修正され、関連する経験が共有された。(ソース:_lewtun, weights_biases)

RL拡張の進捗 : 強化学習(RL)拡張のオープンな進展は刺激的である。モデルの訓練には膨大なエンジニアリング努力が必要だが、その結果は否定できない。(ソース:jxmnop)

AIエージェント自己進化システム概説 : 自己進化型AIエージェント技術を概説し、統一された概念フレームワーク(システム入力、エージェントシステム、環境、オプティマイザー)を提案している。また、異なるコンポーネントに対する自己進化技術を体系的にレビューし、評価、安全性、倫理的考慮事項について議論している。(ソース:HuggingFace Daily Papers)

MoE LLMにおける「スーパーエキスパート」 : MoE LLMにおける「スーパーエキスパート」(Super Experts)の概念について議論されており、これらの稀少だが重要なエキスパートが剪定されると、性能が急激に低下することを指摘している。(ソース:teortaxesTex)

データサイエンスの概要 : 生成AIのマインドマップが共有され、データサイエンスが概説されている。(ソース:Ronald_vanLoon)

💼 ビジネス

MicrosoftがAIエネルギー消費に対応するため炭素除去に投資 : Microsoftは、バイオテクノロジー企業と提携し、17億ドル以上を投資して、バイオスラッジの深層埋設を通じて炭素除去目標を達成する。これは、AIデータセンターのエネルギー消費と炭素排出量の急速な増加に対応し、炭素負排出のコミットメントを履行し、税制優遇措置を受けるためである。この動きは、AIの発展がもたらす資源消費問題を反映しており、大手企業が脱炭素ソリューションを模索するきっかけとなっている。(ソース:36氪)

MiniMax AI Agentチャレンジ : MiniMax AI Agentチャレンジは、総額15万ドルの賞金を提供し、開発者が生産性、創造性、教育、エンターテイメントなどの分野をカバーするAIエージェントプロジェクトを構築またはミックスすることを奨励する。このチャレンジは、AIエージェント技術の革新と応用を推進することを目指す。(ソース:MiniMax__AI, Reddit r/ChatGPT)

AnthropicがAI安全責任者を採用 : AnthropicはDave Orrを安全責任者として採用した。彼は以前、GoogleでLLMをGoogle Assistantに統合する作業を主導していた。この動きは、AnthropicがAIリスク対策をますます重視していることを示しており、AI企業が技術開発と並行して、潜在的なリスクに対するガバナンスを強化し始めていることを反映している。(ソース:steph_palazzolo)

🌟 コミュニティ

AIと雇用および社会への影響 : 研究によると、生成AIの普及により、労働者の週あたりの労働時間が増加し、余暇時間が減少している。すなわち「AIが普及すればするほど、労働者は忙しくなる」という。AIは広告業界において「クリエイティブの壁」を侵食する可能性があり、新規参入者は思考プロセスをスキップする可能性がある。同時に、AIコンパニオンの登場は、女性ユーザーの感情的な依存を引き起こし、中にはAIと深い感情的な関係を築くユーザーもおり、AI倫理と社会への影響に関する議論を引き起こしている。AIが雇用に与える影響、特に本来の欲求やモチベーションに欠ける新人への影響が最も大きい。(ソース:36氪, op7418, teortaxesTex, menhguin, scaling01, teortaxesTex)

GPT-5ユーザー体験とモデル品質の論争 : GPT-5リリース後、多くのユーザーがその性能に失望を表明し、個性がなく、冷淡で、動作が遅く、創造的なライティングにおいてはひどく、GPT-4oに劣ると見なしている。ユーザーはOpenAIがコスト削減のため、ChatGPTで「安価な模倣版」GPT-5を稼働させていると疑い、GPT-4oへの復元を求める声が成功した。一部のコメントでは、OpenAIの過剰な宣伝は「失策」であり、GoogleがOpenAIを厳しく罰する機会があるとの見方もある。また、ユーザーはGPT-5 Thinkingモードの192Kのコンテキスト長が体感として顕著でないと感じている。(ソース:Reddit r/ChatGPT, Reddit r/ChatGPT, Reddit r/artificial, Reddit r/ChatGPT, op7418, TheTuringPost)

AI倫理と安全性の懸念 : 自由市場資本主義の下では、AIは企業によるディストピアを引き起こす可能性があり、個人データの収集、公共の対話の操作、政府の制御に利用され、大企業に独占され、最終的には現実を歪める可能性がある。同時に、AIが人権や市民権を獲得する可能性への懸念、そしてAIコンパニオンがもたらす感情的依存のリスクは、AI倫理と社会への影響に関する議論を引き起こしている。Yoshua Bengioは、AIの発展はより安全で有益な結果に導かれるべきだと強調している。(ソース:Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence, Yoshua_Bengio, teortaxesTex)

AI開発モデルと将来展望 : LLMの発展を、航空業界におけるライト兄弟から月面着陸までの道のりに例え、AIの「規模競争」は最適化と専門化の段階に道を譲ると考えている。一部の見方では、トップLLMラボの現在の製品とビジネスモデルが、彼らのAI研究を制限しており、超知能の早期実現を妨げる可能性があるという。AGIという用語の商業化とブランド化の傾向は、その技術的意味合いに対する疑問を引き起こしている。また、将来的にインタラクションの70%がLLMでパッケージ化されることへの懸念や、AIツールの過剰な検閲と浄化に対する不満も議論されている。(ソース:Reddit r/ArtificialInteligence, far__el, rao2z, vikhyatk, Reddit r/ChatGPT)

AIコミュニティ文化とユーモア : AIコミュニティでは、AIモデルの擬人化に関する議論が存在し、「私のAIは意識がある/知覚がある」といった考え方などがある。また、Claudeの記憶能力更新後のユーザーの反応に対するユーモラスなコメントや、AI研究者の日常やAI大手企業のソーシャルメディアでのやり取りに関するユーモラスなツッコミも見られる。(ソース:Reddit r/ArtificialInteligence, nptacek, vikhyatk, code_star, Reddit r/ChatGPT)

AI会議モデルと学術出版の課題 : 論文は、現在のAI会議モデルが持続可能ではないと指摘している。その理由には、出版量の急増、炭素排出量、研究ライフサイクルと会議日程の不一致、会場収容能力の危機、メンタルヘルス問題が含まれる。出版と会議を分離し、他の学術分野に倣うことを提案している。(ソース:Reddit r/MachineLearning)

AIベンチマークテストとモデル評価の論争 : OpenAIがSWE-bench Verifiedのスコアチャートを更新したことに対し疑問が呈され、全てのテストを実行していないことが指摘された。同時に、LLMの「シミュレートされた推論」能力は「脆い蜃気楼」であり、論理的推論ではなく、流暢な無意味な話が得意であると研究者によって発見された。これらの議論は、AIモデル評価の複雑さと課題を反映している。(ソース:dylan522p, Reddit r/artificial)

AIチップ政策と報道批判 : 一部のコメントでは、記者がNVIDIA H20を「先進チップ」と表現するのはプロフェッショナルではないと批判されている。H20がB200より約4年遅れており、計算能力、メモリ帯域幅、メモリのいずれもB200をはるかに下回ることを指摘している。中国へのH20販売は良い政策であると見なされており、それは中国国内のAIアクセラレータエコシステムの発展を遅らせる可能性があり、中国のオープンソースAIエコシステムと米国のクローズドソースモデルとの間のギャップを促進するためだという。(ソース:GavinSBaker)

LLMの価格設定と計算能力サービスに対するユーザーの需要 : OpenAI/Googleに対し、計算能力時間あたりの支払いサービスを提供するよう呼びかけられている。これは、推論モデルに長時間問題を考えさせることを可能にし、複数回のAPI呼び出しでシミュレートするのではなく、同じ計算能力予算でモデルを比較するのに役立つと考えられている。(ソース:MParakhin)

💡 その他

AIの金融分野への応用 : AI駆動の金融データ分析は、よりスマートな戦略的意思決定において重要な役割を果たし、金融業界の分析効率と意思決定品質を向上させる。(ソース:Ronald_vanLoon, Ronald_vanLoon)

GoogleのAI戦略と競争 : GoogleのAI分野における潜在的な大きな動きについて議論されている。一部のコメントでは、GoogleはTPUハードウェアの優位性を持っており、検索、RL、拡散世界モデルにおいてより多くの研究を行っているため、OpenAIにとってより大きな脅威となる可能性があると見られている。(ソース:Reddit r/LocalLLaMA)

Hugging Face AMAイベント : Hugging Face CEOのClement Delangueは、AMA(Ask Me Anything)イベントを開催すると予告し、コミュニティに直接交流の機会を提供する。(ソース:ClementDelangue)