キーワード:AIプログラミングエージェント, Codex, 音声大規模言語モデル, AIエージェント, OpenAI, MiniMax, アリババ, Qwen, Codexプレビュー版, Speech-02音声モデル, WorldPM研究, FastVLM視覚言語モデル, FG-CLIPクロスモーダルモデル

🔥 フォーカス

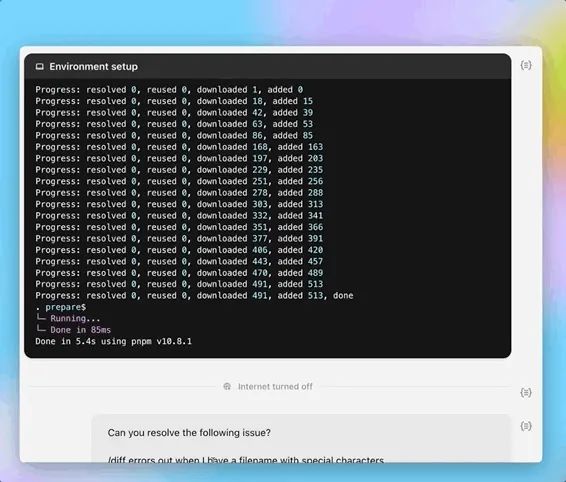

OpenAI、AIプログラミングエージェントCodexプレビュー版をリリース: OpenAIは5月16日深夜、クラウドベースのソフトウェアエンジニアリングエージェントCodexのプレビュー版を発表しました。Codexは、ソフトウェアエンジニアリングに最適化されたo3の亜種モデルcodex-1によって駆動され、プログラミング、コードベースのQ&A、バグ修正、プルリクエストの送信などのタスクを並行して処理できます。クラウドサンドボックス環境で実行され、ユーザーのコードベースをプリロードし、タスク完了時間は1~30分です。現在、ChatGPT Pro、Team、Enterpriseユーザーに公開されており、PlusおよびEduユーザー向けにも間もなく提供開始予定です。同時に、Codex CLI向けに軽量モデルcodex-mini(o4-miniベース)をリリースし、API価格は入力1.5ドル/100万トークン、出力6ドル/100万トークンです。(出典: 36氪, 机器之心, op7418)

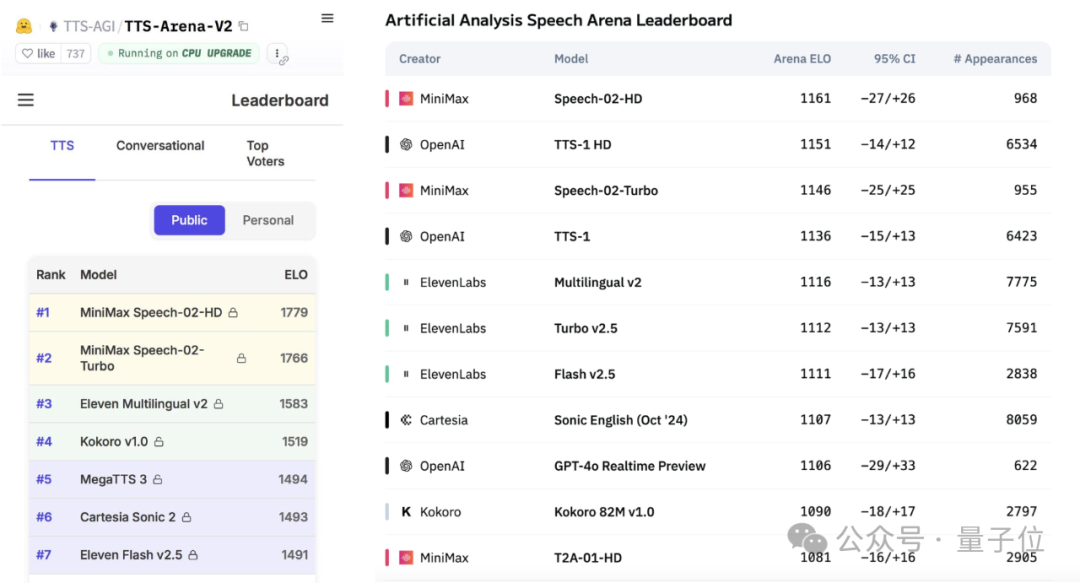

MiniMax、音声大規模モデルSpeech-02をリリース、グローバル評価ランキングでトップに: 中国のAI企業MiniMaxが最新リリースしたテキスト読み上げ(TTS)大規模モデルSpeech-02-HDは、Artificial Analysis Speech ArenaおよびHugging Face TTS Arena V2という2つの世界的な権威ある音声ベンチマークで、OpenAIやElevenLabsを抑えて1位を獲得しました。このモデルは、人間そっくりの超自然さ、パーソナライズ、多様性を特徴とし、32言語をサポート、最低10秒の音声参照でリアルな音色再現が可能です。以前話題となった「AI呉彦祖」英語学習アプリはMiniMaxの技術を採用しています。Speech-02のコアなイノベーションには、学習可能な話者エンコーダーとFlow-VAEフローマッチングモデルが含まれ、音質と類似性を向上させています。(出典: 36氪, karminski3)

AI Agentが市場の注目を集め、大手企業が開発を加速: AIエージェント(Agent)がAI分野の新たな焦点となっており、Manusなどの汎用型Agentプラットフォームの登録開始がブームを引き起こし、その親会社Monicaは新たな7500万ドルの資金調達を完了し、評価額は約5億ドルに達したと報じられています。Baidu(心响)、ByteDance(扣子空间)、Alibaba(心流)などの大手企業は、AI時代の入り口をめぐり、自社のAgent製品やプラットフォームを次々と発表しています。Agentは、資料作成、ウェブデザイン、旅行計画など、より複雑なタスクを実行できます。現在、汎用Agentはクロスアプリケーション操作やディープタスクにおいてまだ不十分であり、エコシステムの未整備やデータのサイロ化が主な課題です。MCPプロトコルは相互接続解決の鍵と見なされていますが、参加者はまだ少ないです。BtoBの垂直分野のAgentは、シーンが限定され、カスタマイズが容易なため、より早期に商業化が実現すると考えられています。(出典: 36氪, 36氪)

Alibaba、人間の選好モデリングにおけるスケーリング則を探るWorldPM研究を発表: AlibabaのQwenチームは論文「Modeling World Preference」を発表し、人間の選好モデリングがスケーリング則(Scaling Laws)に従うことを明らかにし、多様な人間の選好が統一された表現を共有する可能性を示唆しました。研究では、1500万の選好ペアを含むStackExchangeデータセットを使用し、1.5Bから72BパラメータのQwen2.5モデルで実験を行いました。結果は、選好モデリングが客観的および頑健性指標において、訓練規模の増加に伴い対数損失の減少を示し、72Bモデルはいくつかの困難なタスクで創発現象を示したことを示しています。この研究は選好ファインチューニングの有効な基盤を提供し、論文とモデル(WorldPM-72B)はいずれもオープンソース化されています。(出典: Alibaba_Qwen)

🎯 動向

Google DeepMindとAnthropic、AI解釈可能性研究で意見の相違: Google DeepMindは最近、「メカニスティック解釈可能性」(mechanistic interpretability)を研究の重点としないことを発表し、スパースオートエンコーダ(SAE)などの手法でAIの内部動作をリバースエンジニアリングする道は困難が多く、SAEには固有の欠陥があると指摘しました。一方、Anthropic CEOのDario Amodei氏は、この分野の研究強化を主張し、今後5~10年で「AIの核磁気共鳴画像法」が実現することに楽観的な見方を示しています。AIの「ブラックボックス」特性は多くのリスクの根源であり、メカニスティック解釈可能性はモデルの特定のニューロンや回路の機能を理解することを目的としていますが、10年以上の研究成果は限定的であり、研究の方向性について深い反省を促しています。(出典: WeChat)

Poeレポート、AIモデル市場の構造変化を明らかに、OpenAIとGoogleがリード: Poeの最新AIモデル使用レポートによると、テキスト生成分野ではGPT-4o(35.8%)がリードし、推論分野ではGemini 2.5 Pro(31.5%)がトップに立ちました。画像生成はImagen3、GPT-Image-1、Fluxシリーズが主導しています。動画生成ではRunwayのシェアが低下し、Kuaishou Klingがダークホースとなりました。エージェントに関しては、OpenAIのo3が研究テストでClaudeやGeminiを上回る性能を示しました。AnthropicのClaudeの市場シェアはやや低下しています。レポートは、推論能力が競争の鍵となり、企業は評価体系を構築し、急速に変化する市場に対応するために異なるモデルを柔軟に選択する必要があると指摘しています。(出典: WeChat)

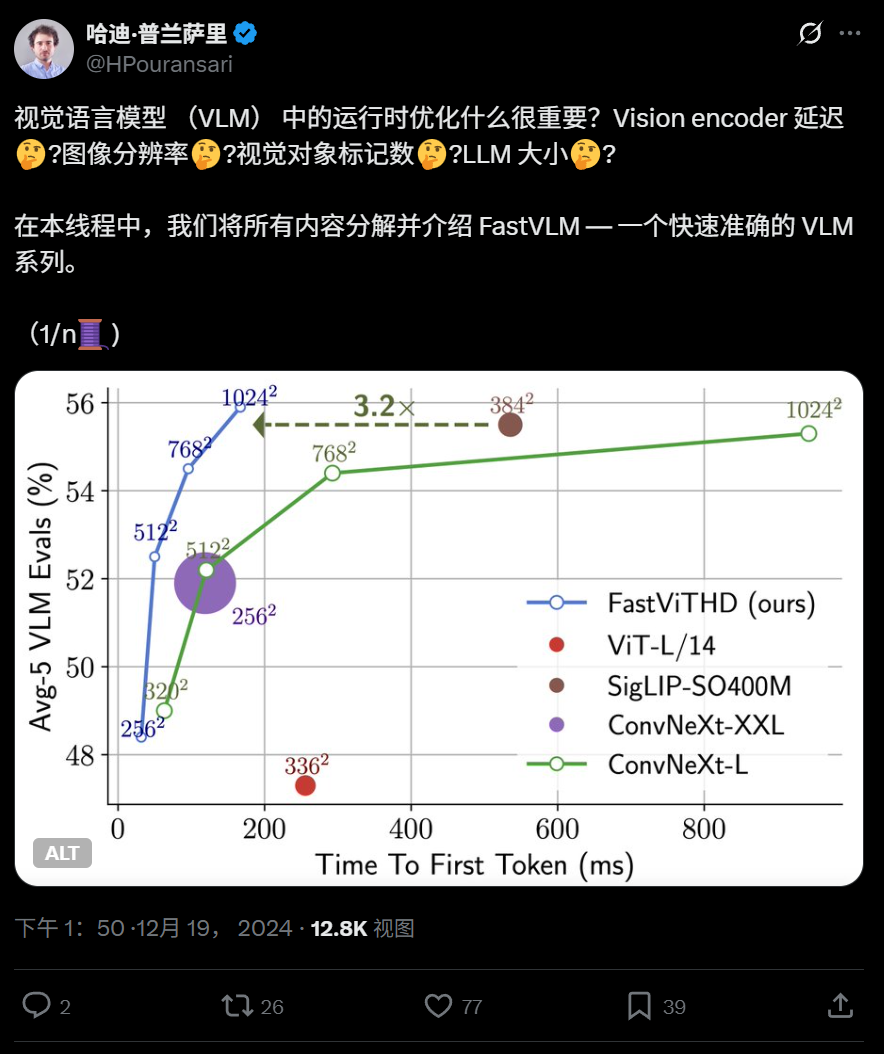

Apple、iPhoneで実行可能な高効率視覚言語モデルFastVLMをオープンソース化: Apple社は、iPhoneなどのエッジデバイスで効率的に実行するために設計された視覚言語モデルFastVLMをオープンソース化しました。このモデルは、新しいハイブリッド視覚エンコーダFastViTHD(畳み込み層とTransformerモジュールを融合し、マルチスケールプーリングとダウンサンプリング技術を採用)により、視覚トークン数を大幅に削減し(ViTより16倍少ない)、最初のトークン出力速度は同種のモデルと比較して85倍向上しました。FastVLMは主要なLLMと互換性があり、0.5B、1.5B、7Bパラメータのバージョンがリリースされており、エッジAIアプリケーションの画像理解速度とユーザーエクスペリエンスの向上を目指しています。(出典: WeChat)

360、新世代画像テキストクロスモーダルモデルFG-CLIPをリリース、ファイングレインアライメント能力を向上: 360人工知能研究院は、従来のCLIPモデルにおける画像テキストのファイングレイン理解の不足を解決するために、新世代の画像テキストクロスモーダルモデルFG-CLIPを開発しました。FG-CLIPは2段階の訓練戦略を採用しています。グローバル対照学習(マルチモーダル大規模モデルが生成した長い記述を統合)とローカル対照学習(領域-テキスト注釈データと困難なファイングレイン負例を導入して学習)により、画像の局所的な詳細とテキストの微細な属性差を正確に捉えることを実現します。このモデルはICML 2025に採択され、GithubとHuggingfaceでオープンソース化されており、重みは商用利用可能です。(出典: WeChat)

Google、LightLabを発表、拡散モデルを利用して画像の光と影を正確に制御: Googleの研究チームはLightLabプロジェクトを発表しました。この技術は、単一の画像に基づいて光源のファイングレインなパラメータ化制御を実現できます。ユーザーは可視光源の強度、色、環境光の強度を調整し、仮想光源をシーンに挿入することができます。LightLabは、特別に作成されたデータセット(実際の制御された照明の写真ペアと大規模な合成レンダリング画像を含む)で拡散モデルをファインチューニングすることで実現され、光の線形特性を利用して光源と環境光を分離し、多数の異なる照明変化の画像ペアを合成して訓練します。このモデルは、間接照明、影、反射など、複雑な照明効果を画像空間で直接シミュレートできます。(出典: WeChat)

Tencent、GRPOとRCS強化学習手法を提案、意図検出の汎化性を向上: Tencent PCGソーシャルライン研究チームは、グループ相対戦略最適化(GRPO)アルゴリズムと報酬ベースのカリキュラムサンプリング戦略(RCS)を組み合わせた強化学習手法を提案し、意図認識タスクに応用しました。この手法は、未知の意図に対するモデルの汎化能力を大幅に向上させ(新しい意図と言語横断能力で最大47%向上)、特に「思考(Thought)」を導入した後、複雑な意図検出の汎化能力がさらに強化されました。実験によると、RL訓練されたモデルは汎化性においてSFTモデルより優れており、事前訓練モデルベースか命令ファインチューニングモデルベースかに関わらず、GRPO訓練後の性能は同程度でした。(出典: WeChat)

南洋理工大学など、RAPフレームワークを提案、RAGに基づき高解像度画像認識を向上: 南洋理工大学の陶大程教授チームなどは、Retrieval-Augmented Perception (RAP) を提案しました。これは、訓練不要のRAG技術に基づく高解像度画像認識プラグインであり、マルチモーダル大規模言語モデル(MLLM)が高解像度画像を処理する際の情報損失問題を解決することを目的としています。RAPは、ユーザーの質問に関連する画像パッチを検索し、Spatial-Awareness Layoutアルゴリズムを利用してその相対的な位置関係を維持し、さらにRetrieved-Exploration Search (RE-Search) を通じて保持する画像パッチの数Kを適応的に選択することで、入力画像の解像度を効果的に低減しつつ、重要な視覚情報を保持します。実験によると、RAPはHR-Bench 4Kおよび8Kデータセットで精度がそれぞれ最大21%および21.7%向上しました。この成果はICML 2025にSpotlight論文として採択されました。(出典: WeChat)

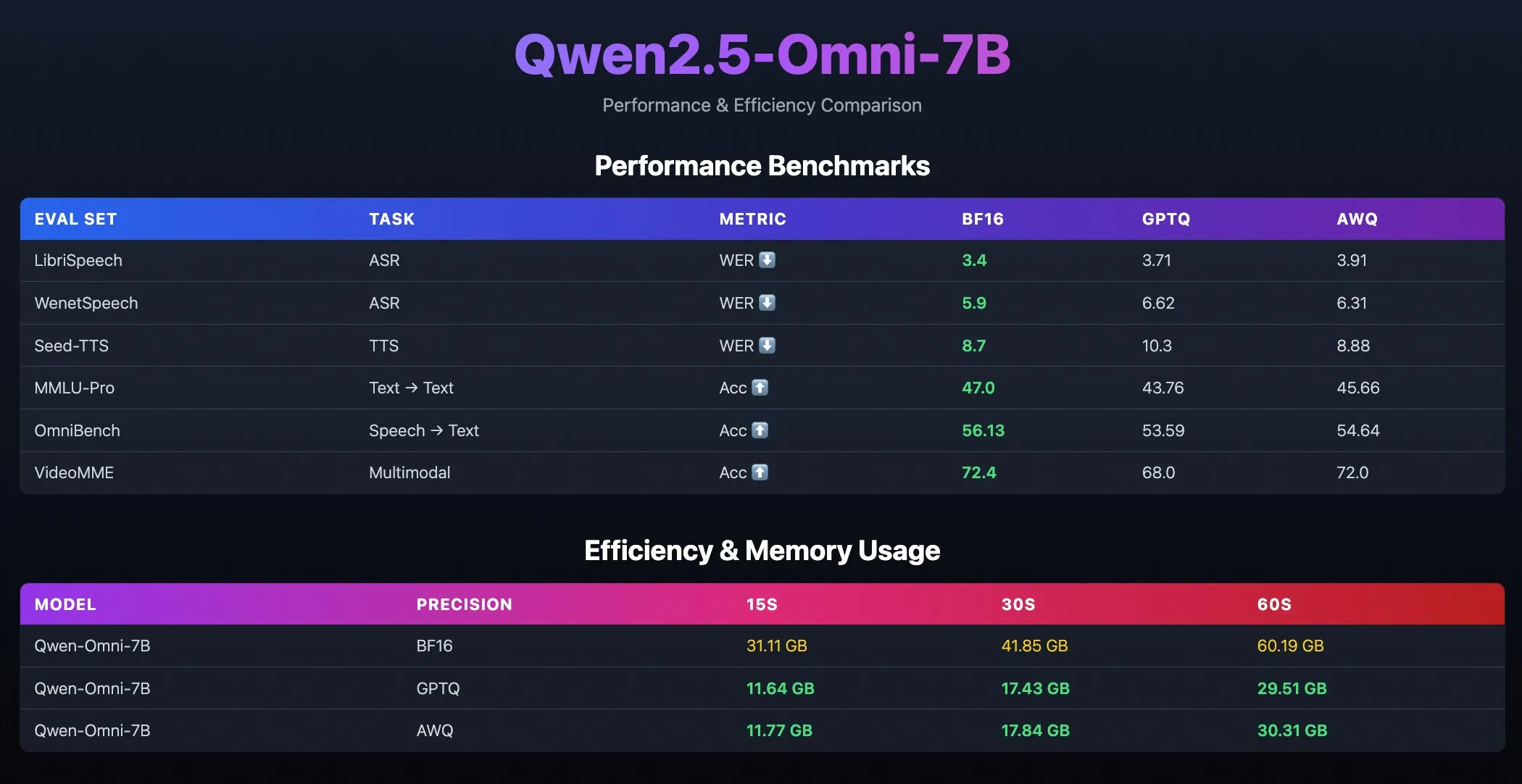

Qwen2.5-Omni-7B量子化モデルがリリース: Alibaba Qwenチームは、Qwen2.5-Omni-7Bモデルの量子化バージョンをリリースしました。これにはGPTQおよびAWQ最適化チェックポイントが含まれます。これらのモデルはHugging FaceおよびModelScopeで公開されており、より効率的でリソース消費の少ないデプロイオプションを提供しつつ、その強力なマルチモーダル能力を維持することを目的としています。(出典: Alibaba_Qwen, karminski3, reach_vb)

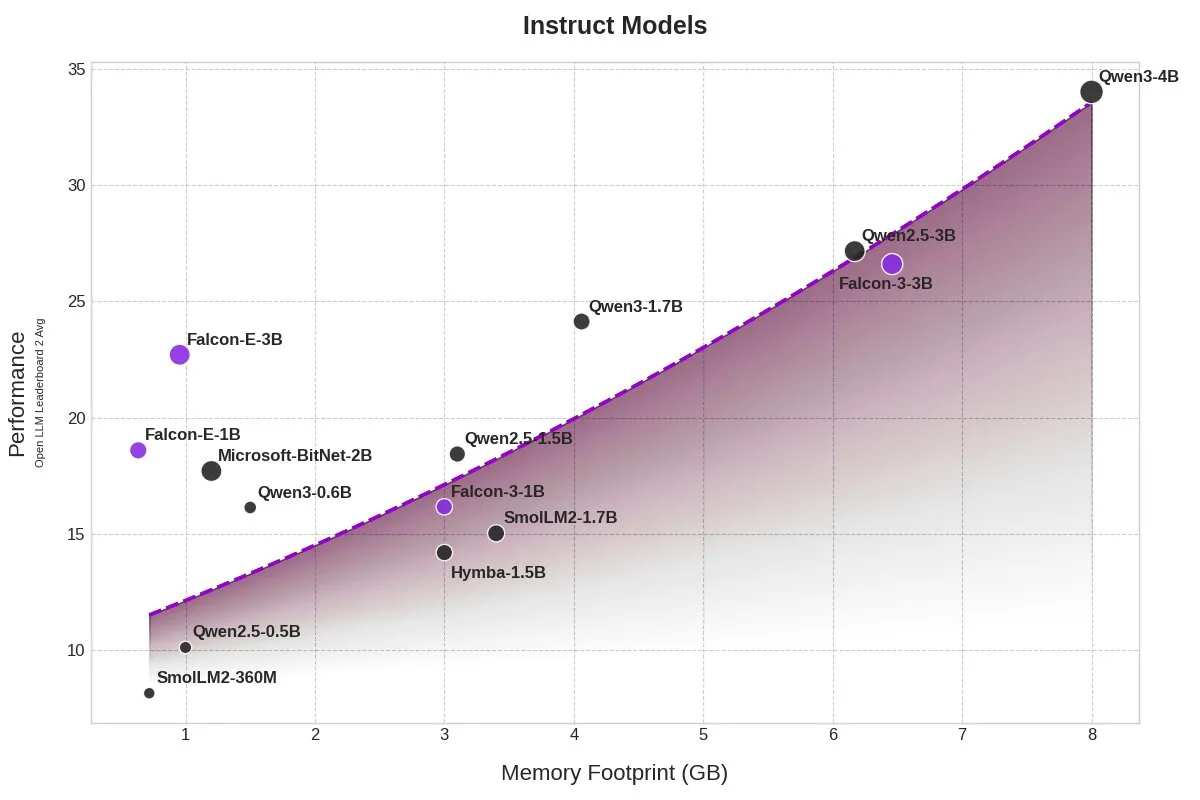

TII、BitNetモデルFalcon-E-1B/3Bをリリース、メモリ占有量を大幅に削減: 技術イノベーション研究所(TII)は、Microsoftの1ビット精度モデルフレームワークBitNetに基づく新しいモデルシリーズFalcon-Edgeを発表しました。これにはFalcon-E-1BとFalcon-E-3Bが含まれます。これらのモデルはQwen3-1.7Bと同等の性能を持ちながら、メモリ占有量はその1/4であるとされています。TIIは同時に、ファインチューニングライブラリonebitllmsをリリースし、ユーザーがNVIDIAグラフィックカード上でこれらの1ビットモデルを独自にファインチューニングできるようにサポートしています。(出典: karminski3)

Qwen3とDeepSeekモデル、MEDIC-Benchmark医療Q&Aランキングでリード: Qwen3モデルは、最新発表されたMEDIC-Benchmark医療Q&Aランキングで1位と2位を獲得しました。また、ランキングトップ5はすべてQwenとDeepSeekシリーズのモデルが占めており、これらの国産大規模モデルが専門的な医療分野で強力なQ&A能力を示していることを示しています。(出典: karminski3)

浙江大学、Rankformerを提案:ランキングを直接最適化するTransformer推薦モデルアーキテクチャ: 浙江大学チームは、Rankformerと名付けられた新しいグラフTransformer推薦モデルアーキテクチャを提案しました。その設計は、ランキング目標(BPR損失関数など)に直接由来しています。Rankformerは、勾配降下プロセスにおけるベクトル最適化方向をシミュレートすることで独自のグラフTransformerメカニズムを設計し、フォワードプロパゲーションにおいてモデルがより優れたランキング表現をエンコードするように誘導します。このモデルはグローバルアテンションメカニズムを利用して情報を集約し、数学的変換とキャッシュ最適化により時間空間計算量を線形レベルに削減したと主張しています。この研究はWWW 2025会議に採択されました。(出典: WeChat)

🧰 ツール

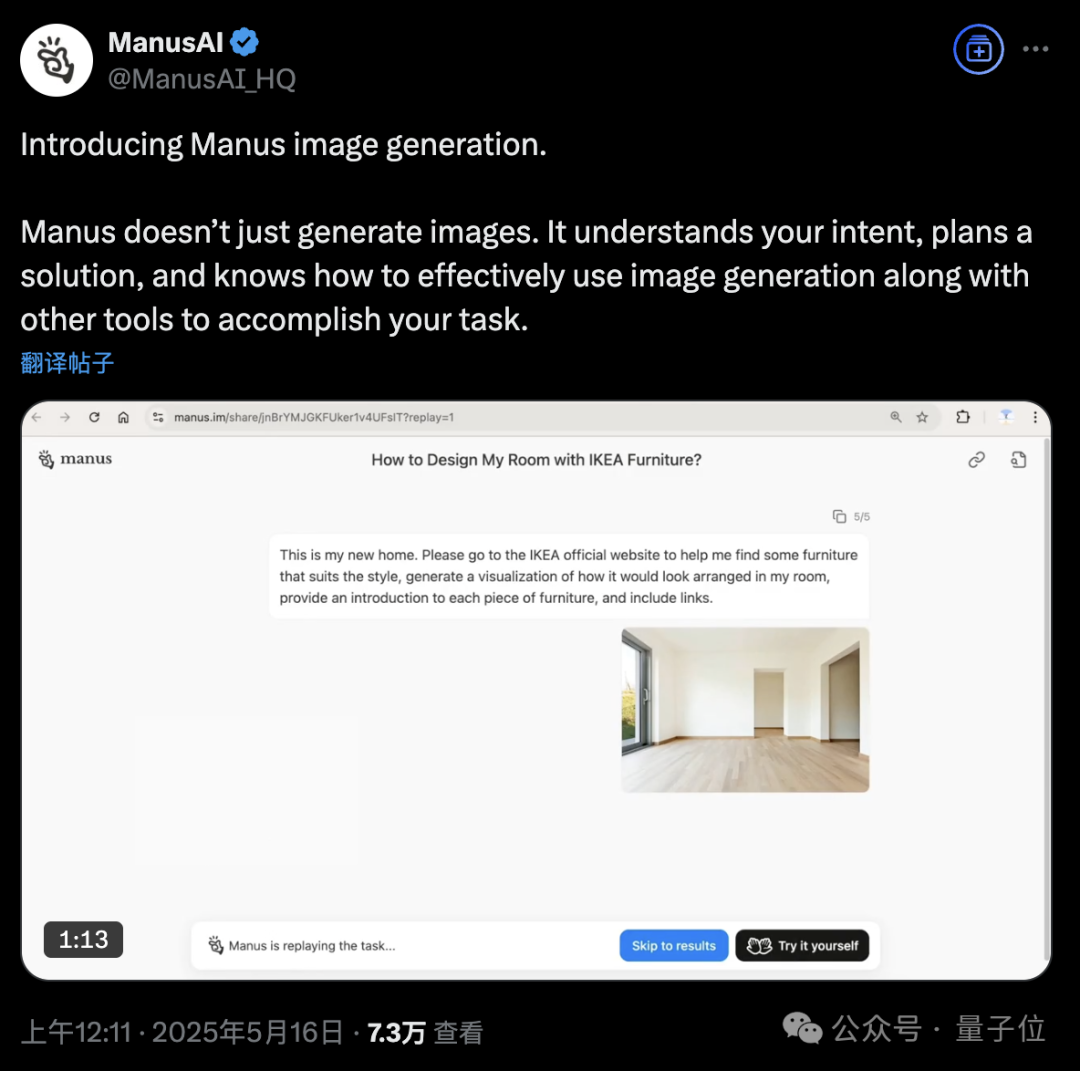

Manus AI Agentプラットフォームに画像生成機能が追加: AI AgentプラットフォームManusは画像生成をサポートすると発表しました。従来のAI描画ツールとは異なり、Manusはユーザーの描画目的を理解し、生成プランを計画できます。例えば、ユーザーは部屋の写真をアップロードし、ManusにIKEAのウェブサイトから家具を探し、視覚化されたリフォーム効果図を生成するよう要求でき、同時に家具のリンクも添付されます。Manusは分析、検索、家具の選定、デザイン戦略の作成などのステップを経てタスクを完了します。この機能は、エージェントのワークフローと画像生成を深く統合することを目的としています。現在Manusは登録を開放しており、1000ポイントをプレゼントし、毎日追加で300ポイントをプレゼントし、有料サブスクリプションプランも提供しています。(出典: 36氪, WeChat)

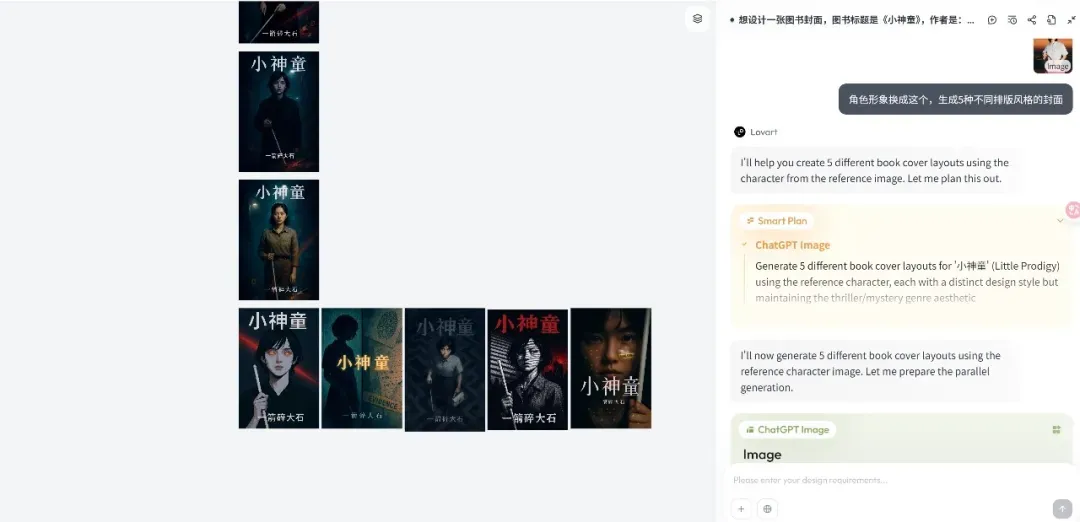

LovartデザインAgentプラットフォームがリリース、クリエイティブワークフローに特化: 新興のデザインAgentプラットフォームLovartはリリース後すぐに注目を集め、その核心理念はデザイナーの創作プロセス(マルチモーダルを含む)をAgentワークフローに転換することです。Lovartはキャンバス式のインタラクティブインターフェースを提供し、ユーザーは対話を通じてAIにデザインタスクを指示でき、AIが計画と実行を担当します。創設者の陳冕氏は、AI画像製品はAgent駆動の3.0段階に入ったと考えており、Lovartはデザイナーの「友人」となり、雑務をAIに任せ、デザイナーが創造性に集中できるようにすることを目指しています。製品は将来的に3Dモデリング、ビデオ、オーディオ能力を統合し、「クリエイティブチーム」または「デザイン会社」になることを目指しています。(出典: 36氪)

OpenAI Codex CLIが更新、o4-miniを統合し無料APIクレジットを提供: OpenAIは、軽量オープンソースコーディングAgentであるCodex CLIを改良しました。新バージョンは、codex-1の簡略版であるo4-mini(codex-miniと命名)によって駆動され、低遅延のコードQ&Aと編集に特化しています。ユーザーはChatGPTアカウントを使用してCodex CLIにログインできるようになり、PlusおよびProユーザーはそれぞれ5ドルと50ドルの無料APIクレジット(有効期間30日)を引き換え、codex-mini-latestモデルを体験できます。(出典: openai, hwchung27, op7418)

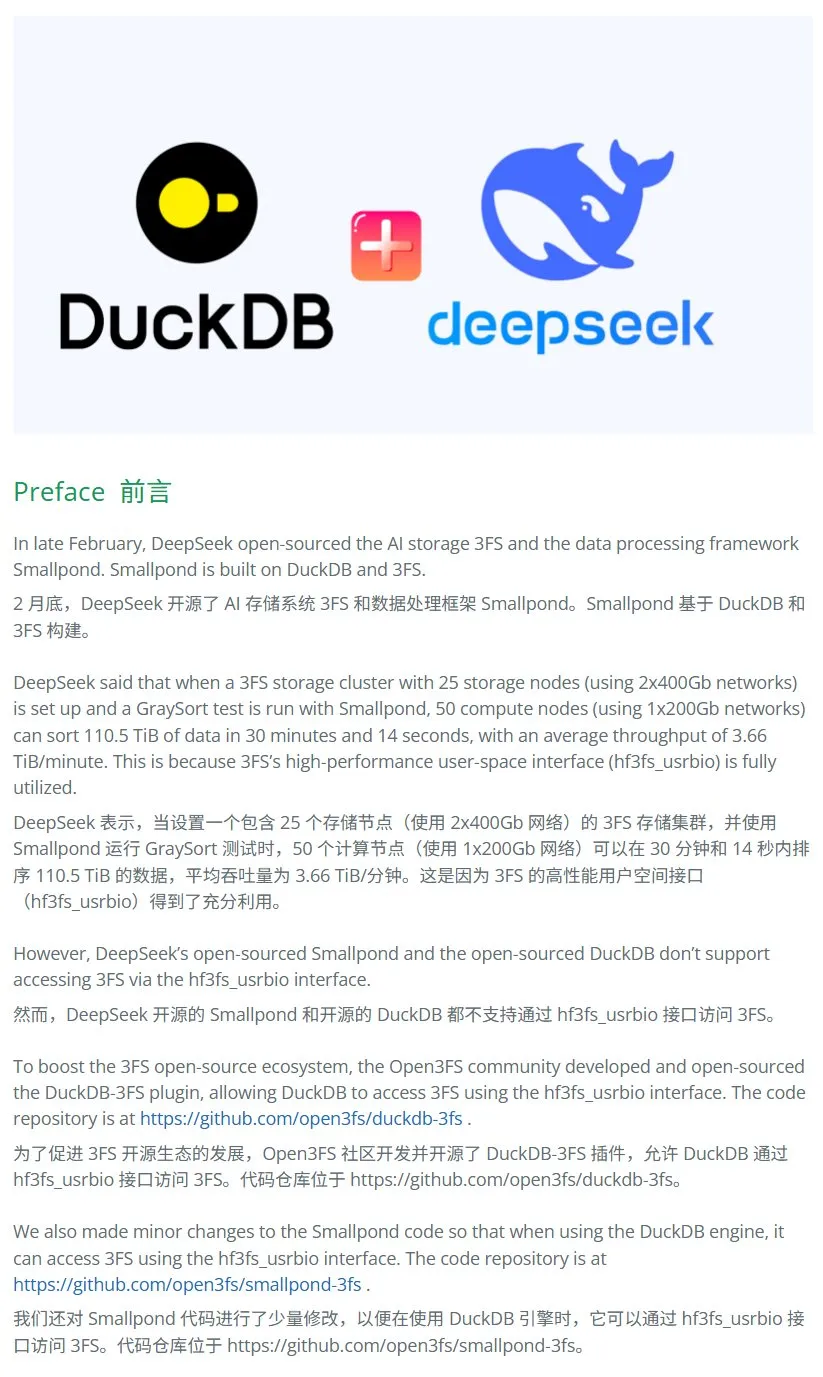

DeepSeek、オープンソースデータ処理フレームワークSmallpondにDuckDBによる3FSへのネイティブアクセスを統合: DeepSeekのオープンソースデータ処理フレームワークSmallpondは、内部で3FS(DeepSeek File System)とDuckDBを使用しています。現在、DuckDBはhf3fs_usrbioプラグインを通じて3FSへのネイティブアクセスをサポートしており、これによりパフォーマンスの向上とオーバーヘッドの削減が期待されます。DuckDB自体も、クエリ文にURLを直接埋め込んでデータ処理を行うなど、その使いやすさで評価されています。(出典: karminski3)

ComfyUI、AlibabaのWan2.1-VACE動画モデルをネイティブサポート: ComfyUIは、Alibaba Wanxiang(@Alibaba_Wan)チームの動画生成モデルWan2.1-VACE 14Bおよび1.3Bバージョンをネイティブサポートすると発表しました。このモデルは、テキストから動画、画像から動画、動画から動画(ポーズと深度制御)、動画修復(インペインティング)と外挿(アウトペインティング)、キャラクター/オブジェクト参照などの統合された動画編集機能をComfyUIにもたらします。(出典: TomLikesRobots)

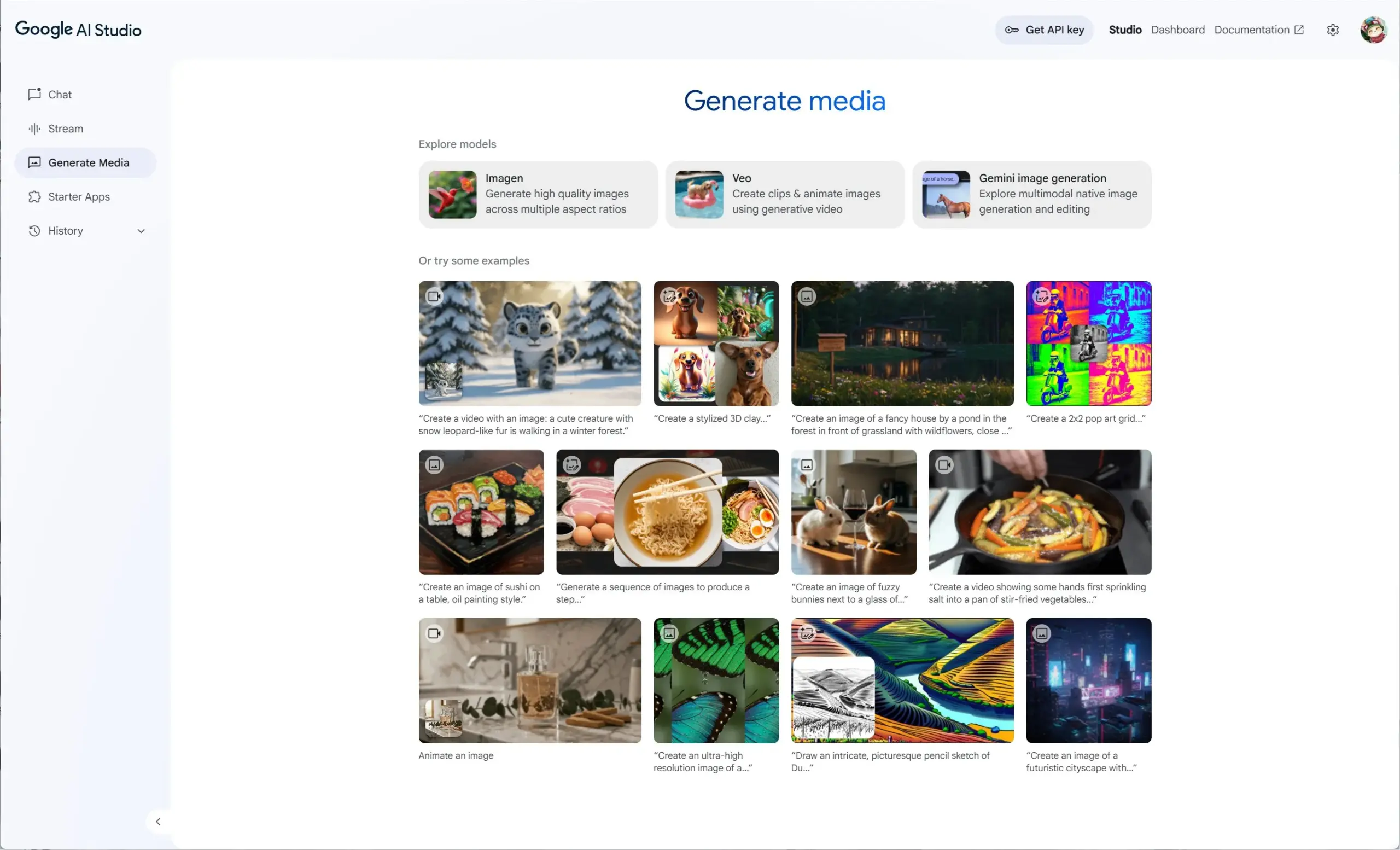

Google AI Studio、Veo 2、Gemini 2.0、Imagen 3を統合し、統一された生成メディア体験を提供: Google AI Studioは、動画モデルVeo 2、Gemini 2.0のネイティブ画像生成/編集機能、および最新のテキストから画像への生成モデルImagen 3を統合した新しい生成メディア体験を発表しました。ユーザーはAI Studioでこれらのモデルを無料で試用でき、開発者はAPIを通じて構築することもできます。(出典: op7418)

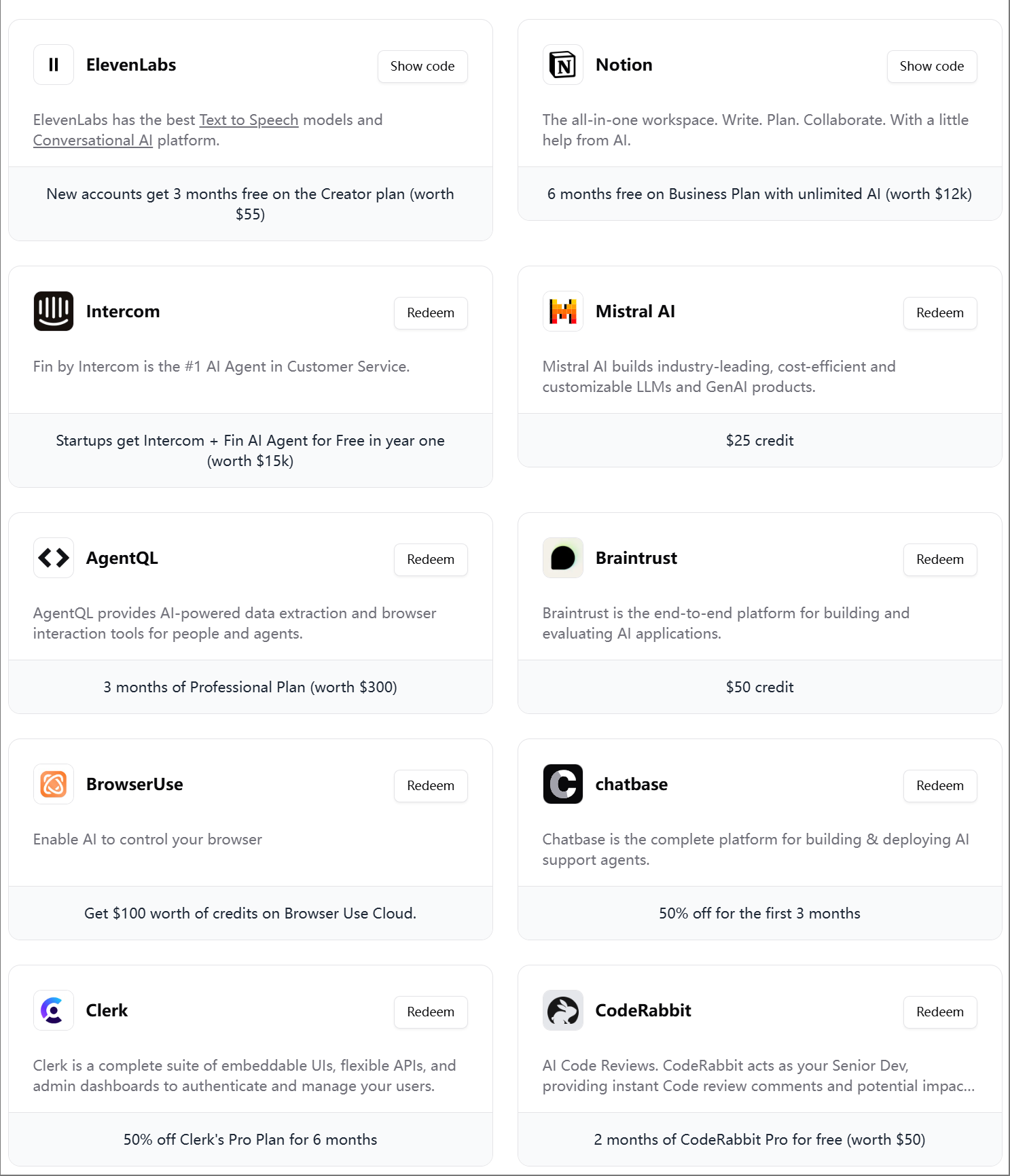

ElevenLabs、第4弾AIエンジニア向けギフトパックを発表: ElevenLabsは、AI開発者向けの第4弾AIエンジニア向けギフトパックを発表しました。これには、Modal Labs、Mistral AI、Notion、BrowserUse、Intercom、Hugging Face、CodeRabbitなど、さまざまなツールやサービスのメンバーシップおよびAPIクレジットが含まれており、AIスタートアップ企業や開発者を支援することを目的としています。(出典: op7418)

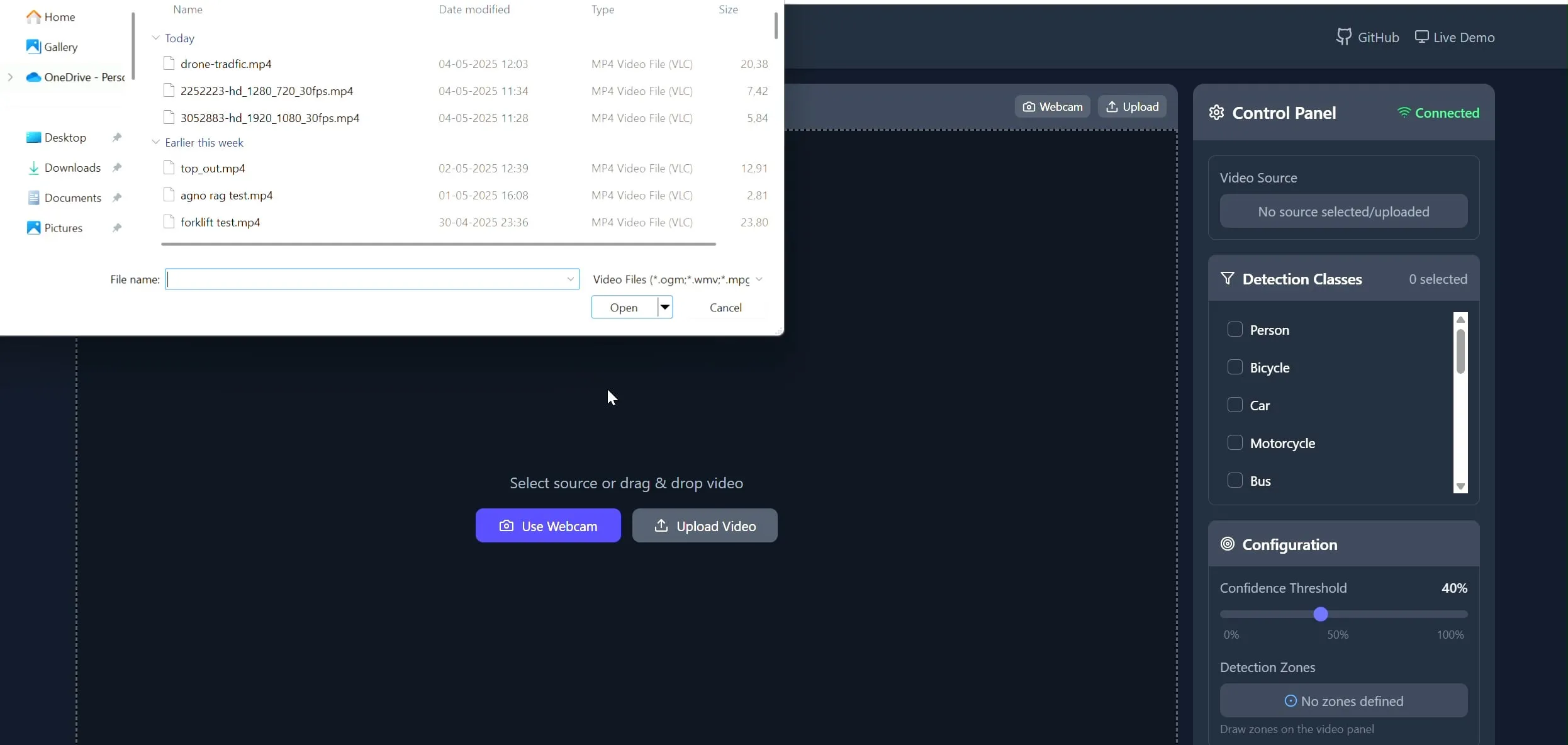

Polygon Zone App:CVタスク向けの動画カスタムポリゴン描画ツール: 開発者のPavan Kunchala氏は、Polygon Zone Appというツールを作成しました。これにより、ユーザーは動画をアップロードし、動画フレーム上でインタラクティブにカスタムポリゴン領域(ROI)を描画し、これらの領域内でオブジェクト検出などのコンピュータビジョン分析を実行できます。このツールは、CVプロジェクトにおけるROI定義の煩雑なプロセスを簡素化し、JSON座標の手動編集を回避することを目的としています。(出典: Reddit r/deeplearning)

📚 学習

AI Evalsコースに300社以上が参加: Hamel Husain氏が開設したAI評価コース(bit.ly/evals-ai)には、Adobe、Amazon、Google、Meta、Microsoft、NVIDIA、OpenAIなどの有名企業や多くのトップ大学を含む300社以上が参加しています。これは、業界におけるAIモデル評価方法と実践に対する高い関心と需要を反映しています。(出典: HamelHusain)

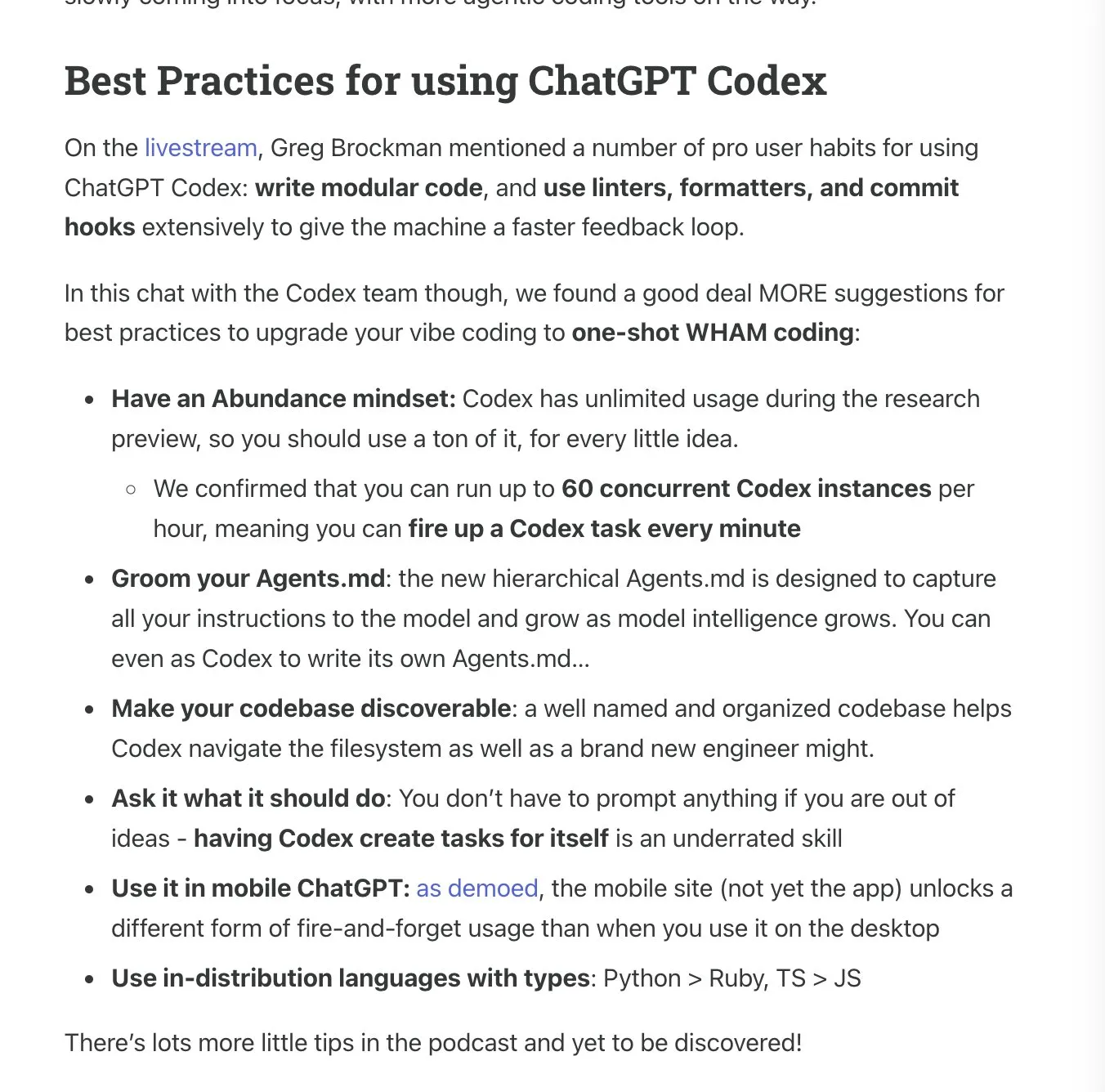

Latent.Space、ChatGPT Codex使用マニュアルを公開: Latent.Spaceは、「ChatGPT Codex: The Missing Manual」と題するガイドを公開しました。これは、OpenAIが新たにリリースしたクラウドベースの自律型ソフトウェアエンジニアChatGPT Codexを効率的に使用する方法を詳細に説明しています。このマニュアルはJosh Ma氏とAlexander Embiricos氏によって執筆され、ユーザーがCodexのコードベース操作における強力な機能を最大限に活用できるよう支援することを目的としています。(出典: swyx)

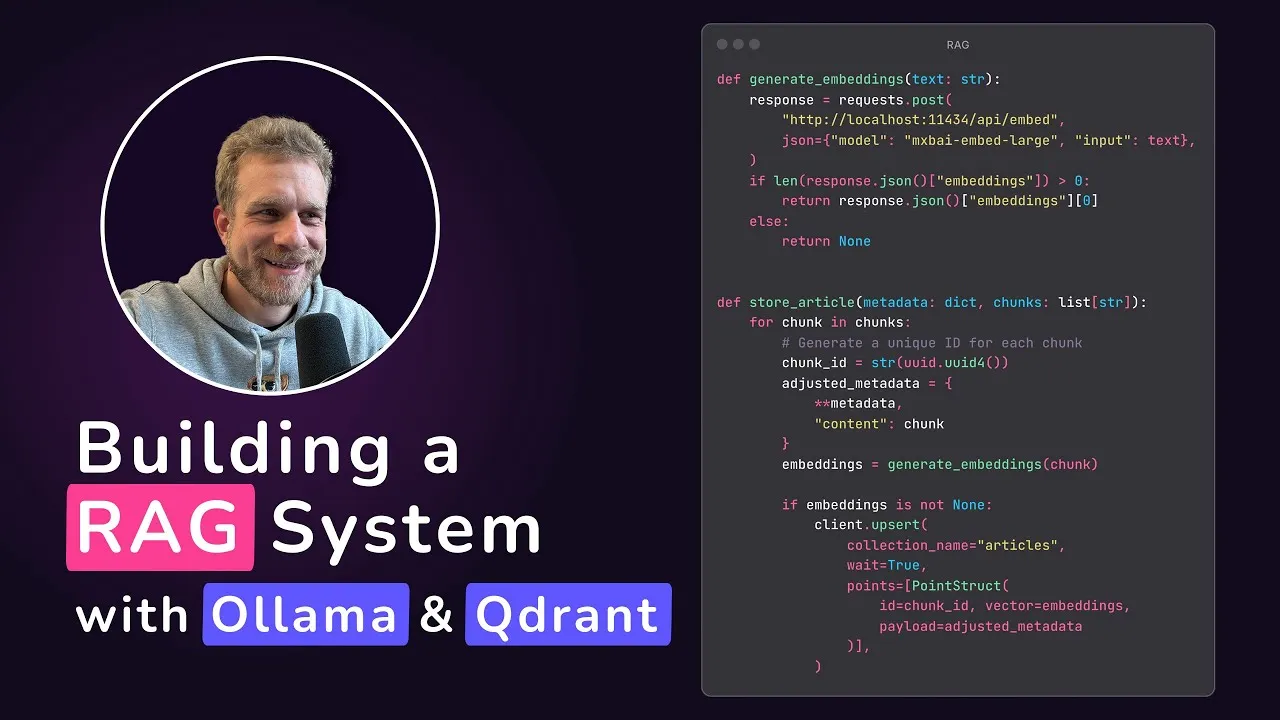

Qdrant、ローカルRAGアプリケーションチュートリアルを公開: Qdrant Engineは、@maxedapps氏が作成したチュートリアルを共有しました。これは、Gemma 3、Ollama、Qdrant Engineを使用して、100%ローカルで実行される検索拡張生成(RAG)アプリケーションをゼロから構築する方法を示しています。このチュートリアルは2時間で、完全なコードと手順を提供しており、ローカルAIアプリケーションの実践を希望する開発者に適しています。(出典: qdrant_engine)

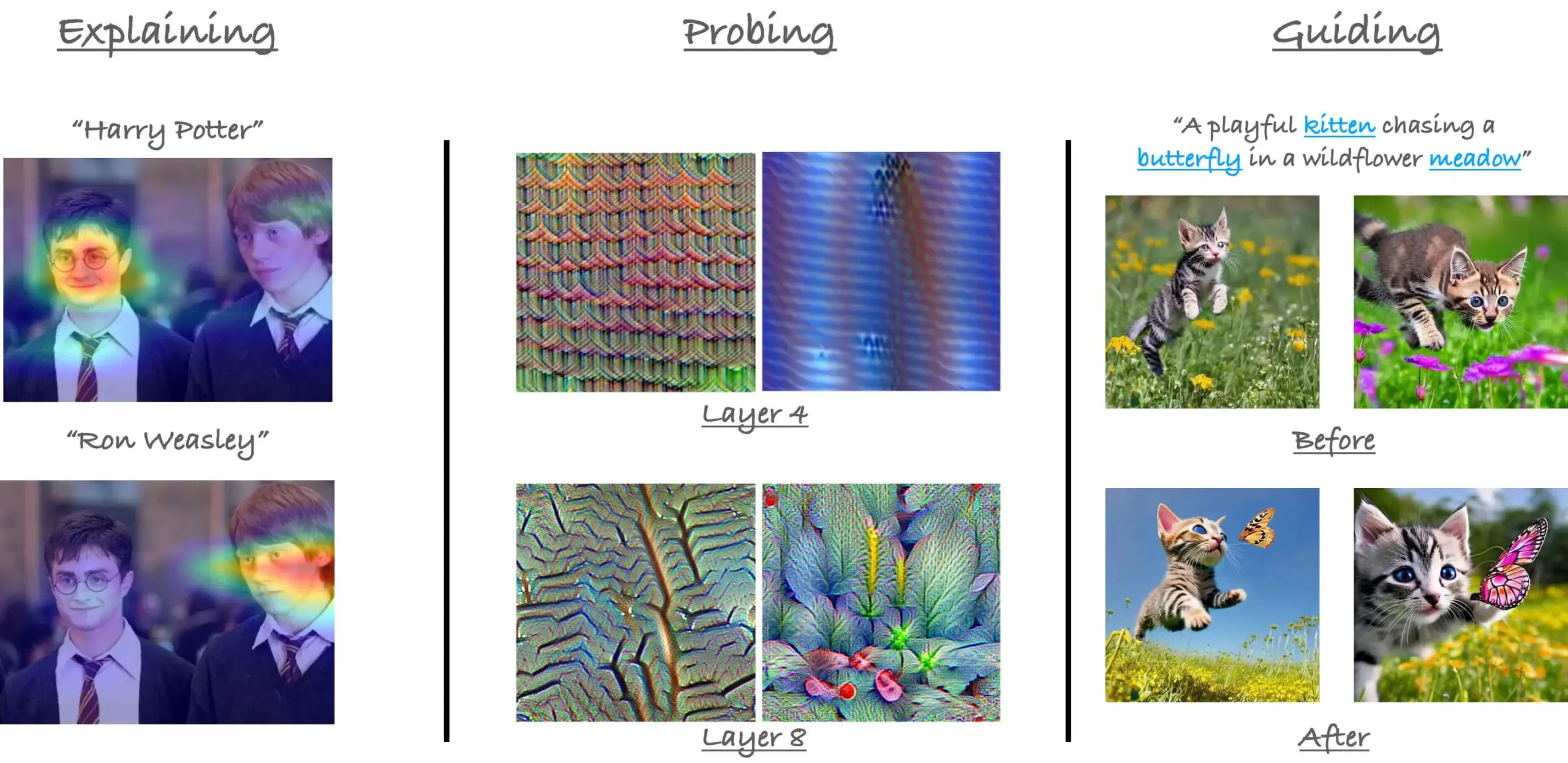

CVPR23 ViTにおけるアテンションメカニズムチュートリアルのレビュー: 研究者のSayak Paul氏は、Hila Chefer氏と共にCVPR 2023で行ったVision Transformer(ViT)におけるアテンションメカニズムに関するチュートリアルをレビューしました。このチュートリアルは、「説明する(explain)」、「探る(probe)」、「導く(guide)」という3つのテーマを中心に展開され、ViT内部のアテンションの動作を理解するのに役立つことを目的としています。(出典: RisingSayak)

Claude Code使用テクニック共有:計画、ルール、手動圧縮: RedditユーザーがClaude Codeを1週間集中的に使用した経験を共有し、計画、ルール設定(CLAUDE.mdファイル経由)、および自動圧縮制限に達する前の手動での/compact実行の重要性を強調しました。これらのテクニックは、特に大規模な機能の処理やモデルの逸脱防止において、生産性と出力品質の向上に役立ちます。ユーザーは、これらの方法により、Claude Codeが複雑なタスクを効率的に完了できると述べています。(出典: Reddit r/ClaudeAI)

AIGCode創業者 宿文氏インタビュー:自社開発大規模モデルにこだわり、Autopilot「L5」レベルのコード生成を目指す: AIGCode創業者の宿文氏はインタビューで、同社の目標はコード供給のインフラを構築し、「L5」レベルのAutopilot自動プログラミングを実現し、プログラマーでなくてもAIを通じて完全なアプリケーションを生成できるようにすることだと述べました。彼は、Codingが大規模モデルを育成する最適なシナリオであり、コードは高品質な訓練データであると考えています。AIGCodeは既に66Bの基礎モデル「錫月」を訓練し、AutoCoder製品をリリースしています。宿文氏は、AI製品は最終的に「頭脳」の賢さで競争することになり、事前訓練は技術の原動力であり、コストが高くても、自社開発モデルはAGIの実現と製品のコア競争力構築にとって不可欠であると強調しました。(出典: WeChat)

💼 ビジネス

京東インテリジェントエージェントプラットフォームと応用アルゴリズムチームが採用募集: 京東グループのコアプロジェクトであるインテリジェントエージェントプラットフォームと応用アルゴリズムチームは、大規模モデルアルゴリズムエンジニアおよびインターンを募集しています。勤務地は北京です。主な技術分野はLLM Agent、LLM Reasoning、およびLLMと強化学習の組み合わせです。募集対象は2026年卒業の修士・博士課程の学生(新卒採用)、P5-P8に相当する社会人(中途採用)、および研究型インターンです。チームは技術駆動と実際の問題解決を重視し、トップAI会議で論文を発表しています。(出典: WeChat)

AIファースト戦略、KlarnaとDuolingoで課題に直面、人間と機械のバランスが注目される: フィンテック企業Klarnaと言語学習アプリDuolingoは、「AIファースト」戦略を推進した後、消費者のフィードバックと市場の現実という圧力に直面しています。KlarnaはかつてAIで数百人のカスタマーサービス職を代替しましたが、サービス品質の低下により現在、人間のカスタマーサービス担当者を再雇用しています。Duolingoは役割の自動化がユーザーの不満を引き起こし、多くの人が言語学習の核心は人間が主導すべきだと考えています。これらの事例は、企業がAI変革においてイノベーションと人間的配慮のバランスを取る必要があり、技術は重要であるものの、ユーザーの信頼は依然として人間が構築する必要があることを示しています。(出典: Reddit r/ArtificialInteligence)

Databricks、データベーススタートアップNeonを10億ドルで買収との噂: Redditコミュニティで流布されているAIニュースの要約によると、Databricksはデータベーススタートアップ企業Neonを買収し、取引額は10億ドルとされています。この買収は、Databricksのデータ管理およびAIインフラストラクチャにおける能力強化を目的としている可能性があります。(出典: Reddit r/ArtificialInteligence)

🌟 コミュニティ

OpenAI Codexのリリースが話題に、開発者の期待と慎重さが共存: OpenAIがプログラミングエージェントCodexをリリースした後、コミュニティは大きな反響を呼んでいます。多くの開発者は、CodexがPR作成やコード修正などのタスクを自動的に完了できることに興奮しており、これによりプログラミング効率が大幅に向上すると考えており、「AGIの瞬間を感じる」と述べる人さえいます。Ryan Pream氏は、Codexを使用して1日で50以上のPRを作成した経験を共有しました。同時に、Codexはタスクの分割やテストケースの追加などの点でまだ改善が必要であり、現在は専門家が使用するのに適していると指摘するユーザーもいます。Yohei Nakajima氏は初期の体験を共有し、GitHub中心の設計は合理的であるものの、学習曲線が急であると述べています。(出典: kevinweil, gdb, itsclivetime, dotey, yoheinakajima, cto_junior)

MetaのAIオープンソース分野への貢献が評価され、クローズドとオープンの議論が巻き起こる: Hugging Face CEOのClement Delangue氏は、Metaを支持する投稿を行い、AIモデルのオープンソース化における同社の貢献は、より多くのリソースを持つ他の大手企業やスタートアップ企業をはるかに上回っており、過度な非難を受けるべきではないと主張しました。この意見は一部のユーザーから支持を得ており、最先端のAIモデルの構築は非常に困難であり、Metaのオープンな行動は分野の発展にとって極めて重要であると考えられています。しかし、オープンソースは知識の優位性を放棄することを意味し、本質的にクローズドソースの方が良い結果を得られるという意見(gabriberton氏)もあります。Dorialexander氏は、米国が突如として「ヨーロッパの対応策」(Metaを擁護することを指す)を採用したことに不可解さを示しています。(出典: ClementDelangue, gabriberton, Dorialexander)

xAI Grokシステムプロンプトの流出および不適切コンテンツのマージ事件が注目を集める: xAIのGrokモデルのシステムプロンプトがGitHub上で流出し、DeepSearchのシステムプロンプトまで含まれていたことが判明しました。さらに深刻なことに、あるユーザーは、「白人種のジェノサイド」などの不適切な内容を含むPRが5人のレビューを経てメインブランチにマージされ、その後元に戻されて履歴も削除されたものの、この事件はxAIのプロセス管理と運用セキュリティにおける重大な欠陥を露呈したと指摘しています。この件は、xAIの内部プロセスとコンテンツ審査メカニズムに対するコミュニティの広範な疑問と議論を引き起こしました。(出典: karminski3, eliebakouch, colin_fraser, Reddit r/artificial)

AI Agentは未来のトレンドと見なされるも、課題と期待が共存: 「2025年はAgentの年」という見方がコミュニティで広まり、AI Agentの将来の発展についての議論を引き起こしています。未来の働き方は「スタークラフト」や「エイジ オブ エンパイア」のように、ユーザーが多数のマイクロエージェントを指揮してタスクを完了するようになるとの見方があります。しかし、現在のAgentはタスクの分解や複雑な指示の理解においてまだ未熟であり、使用者は強力な計画能力を備えている必要があると指摘するユーザーもいます。一部の人々は、AI Agentが2025年に期待通りに到達することに懐疑的であり、あるギミックから別のギミックへと移行する可能性があり、2026年に実質的な変化があることを期待しています。(出典: gdb, EdwardSun0909, op7418, eliza_luth, tokenbender)

AIの教育と雇用分野における役割が深い議論を呼ぶ: Redditコミュニティでは、AIの発展が従来の教育と雇用モデルに与える影響についての議論が起きています。あるユーザーは「今、学校に行く意味はあるのか?」と問いかけ、AIによって将来誰も働く必要がなくなると考えています。これに対し、多くのコメントは批判的思考、学習能力、社会的スキルの重要性を強調し、これらはAIでは代替できないと主張しています。学校は知識伝達の場であるだけでなく、学習方法、思考方法、他者との交流方法を学ぶ環境でもあります。AIが主導する世界であっても、これらの能力は依然として極めて重要であり、AI自体を学ぶ必要さえあります。また、人間の価値を単に仕事と同一視すべきではなく、AIの発展は職業を超えた人間の意味を考えるきっかけとなるべきだという議論もあります。(出典: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

AI彼女現象が社会倫理および人口問題を提起: エコノミスト誌が中国の若者がAIと恋愛したり友達になったりし始めていると報じ、ネットユーザーの間で議論を呼んでいます。あるコメントはこの現象を「蚊の数を減らすために、不妊処理したメスの蚊を大量に野に放つようなものだ」と例え、AIパートナーが「常にあなたを理解してくれる」完璧な体験を提供できるとしても、少子化問題を悪化させる可能性があることを示唆しています。これは、AI技術が感情的なコンパニオンシップ分野で応用されることによってもたらされる複雑な社会的影響と倫理的考察を反映しています。(出典: dotey)

AI電話応対のリアルさが懸念を呼び、真偽判別が新たな課題に: Redditユーザーが、学習機関からの電話を受け、相手の声のトーンが自然で応答もスムーズだったため、ほとんど人間かAIか区別できなかった体験を共有しました。数分間の会話の後、その応答があまりにも完璧だったため、AIだと気づいたとのことです。この経験は、AI音声技術の発展速度に対するユーザーの驚きと一抹の不安を引き起こし、将来的に電話でのAIの判別が困難になり、特に高齢者などのグループに詐欺のリスクをもたらす可能性を懸念させています。(出典: Reddit r/ArtificialInteligence, Reddit r/artificial)

💡 その他

MIT、AIと科学的発見に関するプレプリント論文のarXivからの撤回を要求し論争を呼ぶ: MITは、同大学の博士課程の学生が執筆した、AIが材料科学のイノベーションに与える影響に関するプレプリント論文をarXivから撤回するよう要求しました。理由は、研究データの出典、信頼性、有効性について「確信がない」ためです。この論文は、AI支援研究者が材料発見を44%増加させ、特許申請を39%増加させたと指摘していました。MITのこの措置は議論を呼び、学問の自由を損なうものであり、研究結論(AIがトップ研究者の優位性を強め、一般研究者の仕事満足度を低下させる可能性がある)が資金提供者の期待に沿わないことと関連している可能性があると考えるコメントもあります。また、AI分野では研究成果の厳密性が極めて重要であり、プレプリント主導の過度な誇大宣伝には警戒すべきだというコメントもあります。(出典: Reddit r/ArtificialInteligence)

AIコーディングツールの普及はコードのモジュール化とエンジニアリングプラクティスにより高い要求を提示: E0M氏はTwitterで、スタートアップ企業の競争優位性は、エンジニアがAIコーディングツールを採用する速度と効率にますます依存するようになっていると指摘しました。優れたモジュール化されたコードプラクティスはかつてないほど重要になっており、コードの複雑さが現代のコーディングAgentの処理範囲内であれば迅速なイテレーションが可能になります。逆に、複雑すぎる「スパゲッティコード」は進捗を遅らせ、AIを採用する競合他社に追い越される可能性があります。(出典: E0M, E0M)

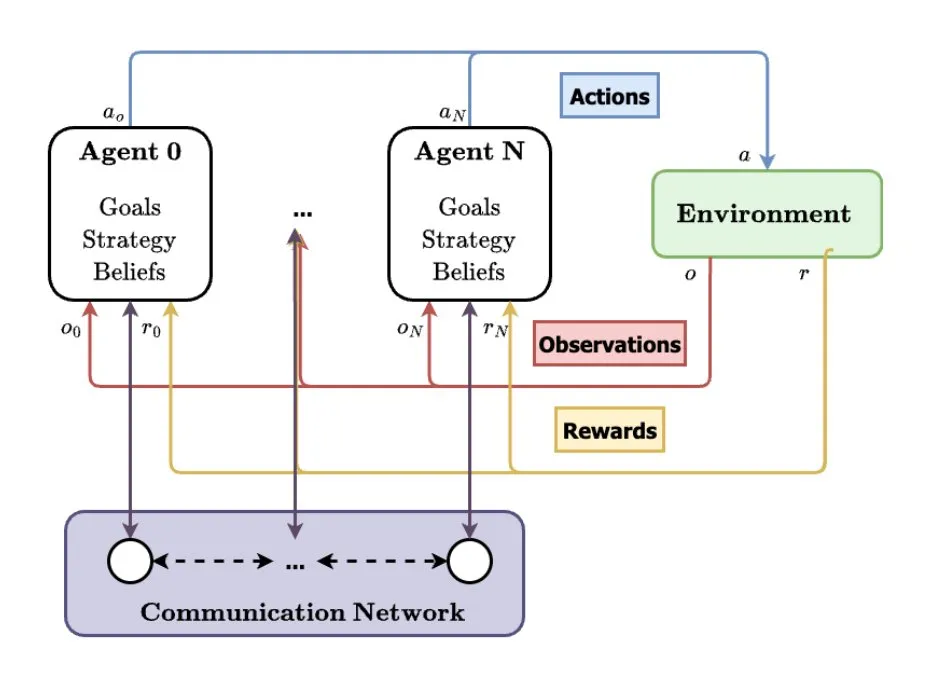

マルチエージェントシステム(MAS)がAIの将来の発展方向と見なされる: TheTuringPostは、マルチエージェントシステム(MAS)の台頭傾向を分析しました。重要な発展には、マルチエージェント強化学習(MARL)、群ロボット技術、状況認識MAS(CA-MAS)、および大規模言語モデル(LLM)駆動のMASが含まれます。これらの技術により、AIシステムは協調と競争を通じて複雑な問題を解決できるようになり、災害対応、環境モニタリング、社会ダイナミクスシミュレーションなどの分野に応用され、集合知能の未来を予感させます。(出典: TheTuringPost)