キーワード:Gemini 2.5 Pro, AIモデル, ヒューマノイドロボット, AI倫理, AIスタートアップ, AI生成コンテンツ, AI支援型クリエイティブ, Gemini 2.5 Proが『ポケットモンスター 青』をクリア, Anthropic Claudeのグローバルウェブ検索, Qwen3 MoEモデルのルーティングバイアス, Runway Gen-4 References機能, メンタルヘルスサポートにおけるAIの応用

🔥 注目

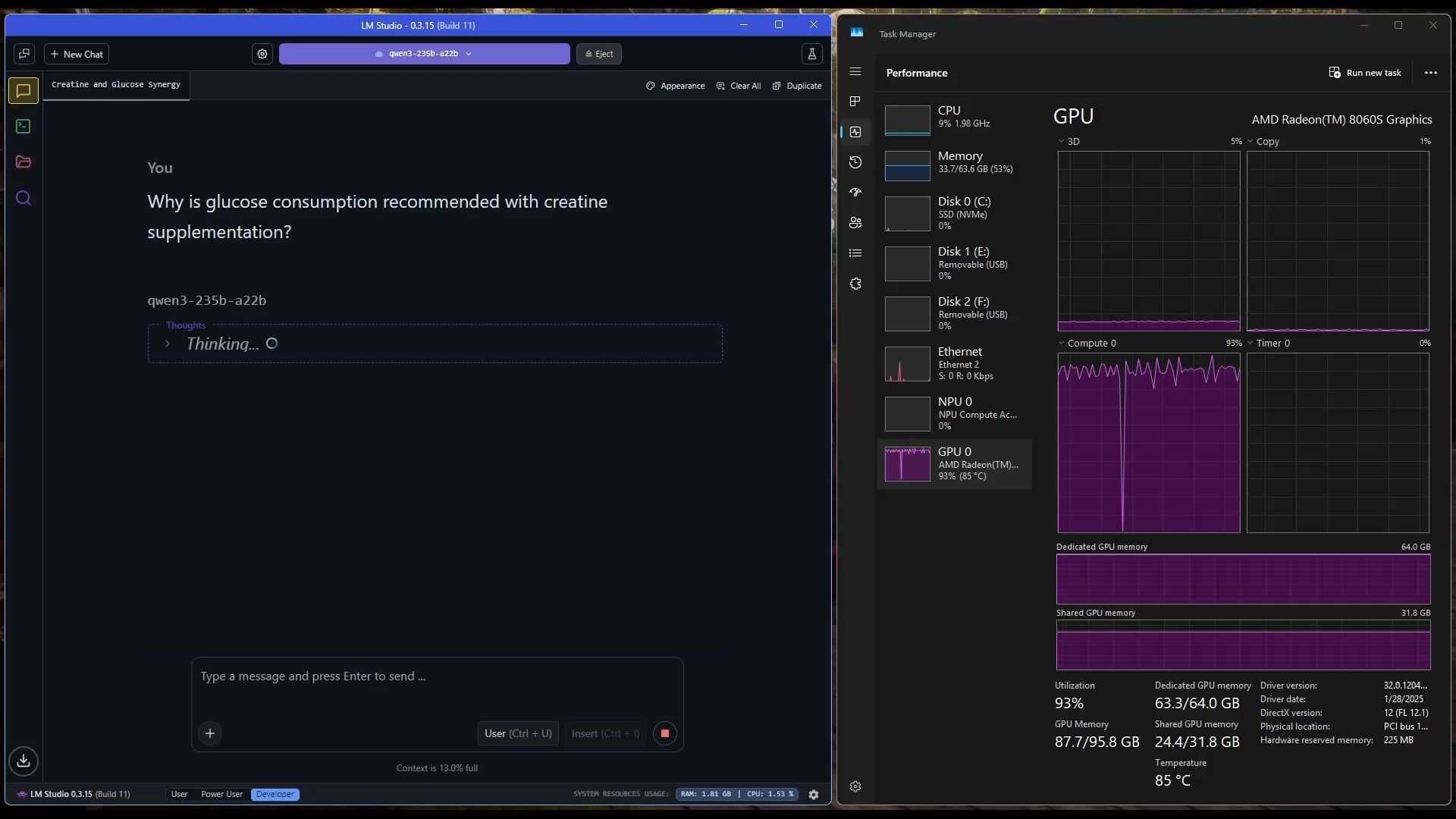

Gemini 2.5 Pro が『ポケットモンスター 青』をクリア: Google の Gemini 2.5 Pro AI モデルが、クラシックゲーム『ポケットモンスター 青』のクリアに成功しました。これには、8つのバッジをすべて集め、ポケモンリーグの四天王を倒すことも含まれます。この成果は、ライブ配信者 @TheCodeOfJoel によって実行・配信され、Google CEO の Sundar Pichai 氏と DeepMind CEO の Demis Hassabis 氏から祝辞が送られました。これは、現在の AI が複雑なタスク計画、長期的な戦略策定、シミュレーション環境とのインタラクションにおいて著しい進歩を遂げていることを示しており、以前の AI による同ゲームでのパフォーマンスを超え、AI エージェント能力の新たなマイルストーンとなります。(出典: Google, jam3scampbell, teortaxesTex, YiTayML, demishassabis, _philschmid, Teknium1, tokenbender)

Apple が Anthropic と協力し AI コーディングプラットフォーム “Vibe Coding” を開発: Bloomberg によると、Apple は AI スタートアップの Anthropic と協力し、”Vibe Coding” と呼ばれる新しい AI 駆動のコーディングプラットフォームを共同開発しています。このプラットフォームは現在、Apple 社内で従業員向けにテストが推進されており、将来的にはサードパーティ開発者にも公開される可能性があります。これは、Apple が AI プログラミング支援ツール分野でのさらなる探求を示しており、AI を利用して開発効率と体験を向上させることを目指しており、自社の Swift Assist などのプロジェクトを補完または統合する可能性があります。(出典: op7418)

AI 駆動のロボット技術の進展と議論: 最近、人型ロボットとエンボディドAIが広く注目されています。Figure 社は、バッテリー、アクチュエーターから AI ラボまでを網羅するハイテクな新本社を公開し、ロボット分野における野心を示唆しています。Disney も人型キャラクターロボット技術を披露しました。しかし、北京で開催された人型ロボットマラソン大会では、一部のロボット(顧客が改造した Unitree G1 を含む)が転倒、バッテリー持続時間の短さ、バランスの問題など、パフォーマンスが振るわず、現在の人型ロボットの実用能力についての議論を引き起こしました。これは、「小脳」(運動制御)と「大脳」(知的決定)の両面でまだ大きな進歩が必要であることを浮き彫りにしています。(出典: adcock_brett, Ronald_vanLoon, 人形机器人,最重要的还是“脑子”)

AI の倫理と社会的影響に関する議論が活発化: ソーシャルメディアや研究分野では、AI の社会的影響と倫理問題に関する議論が増加しています。例えば、カリフォルニア州の SB-1047 AI 法案は論争を引き起こし、関連するドキュメンタリーでは規制の必要性と課題が探求されています。NAACL 2025 会議では、「LLM 時代のソーシャルインテリジェンス」に関するチュートリアルが開催され、AI と人間、社会との相互作用における長期的および新たな課題が議論されました。同時に、ユーザーは AI 生成コンテンツの品質(”slop”)について懸念を表明し、より良いモデル設計と制御が必要だと考えています。これらの議論は、AI 技術の急速な発展がもたらす倫理、規制、社会適応性の問題に対する社会の関心が高まっていることを反映しています。(出典: teortaxesTex, gneubig, stanfordnlp, jam3scampbell, willdepue, wordgrammer)

🎯 動向

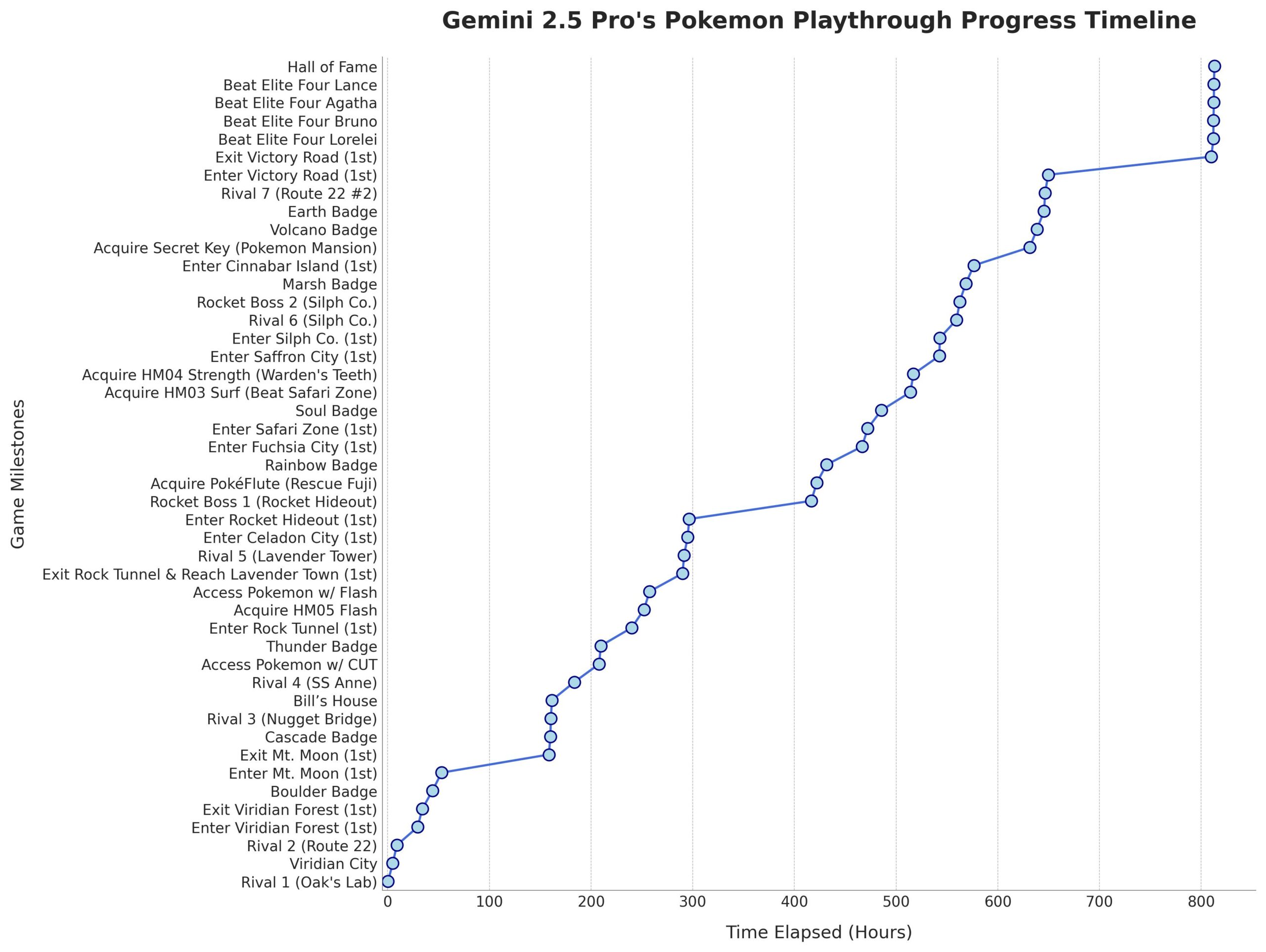

Microsoft が Phi-4-Mini-Reasoning モデルをリリース: Microsoft は Hugging Face 上で Phi-4-Mini-Reasoning モデルをリリースしました。このモデルは、小型言語モデルの数学的推論能力を向上させることを目的としており、小型化、高効率モデルの開発をさらに推進します。(出典: _akhaliq)

Anthropic Claude モデルがグローバルウェブ検索をサポート: Anthropic は、同社の Claude AI モデルがすべての有料ユーザー向けにグローバルなウェブ検索機能を提供開始したと発表しました。単純なタスクの場合、Claude は迅速な検索を実行します。複雑な問題の場合、Google Workspace を含む複数の情報源を探索し、モデルのリアルタイム情報取得および処理能力を強化します。(出典: Teknium1, Reddit r/ClaudeAI)

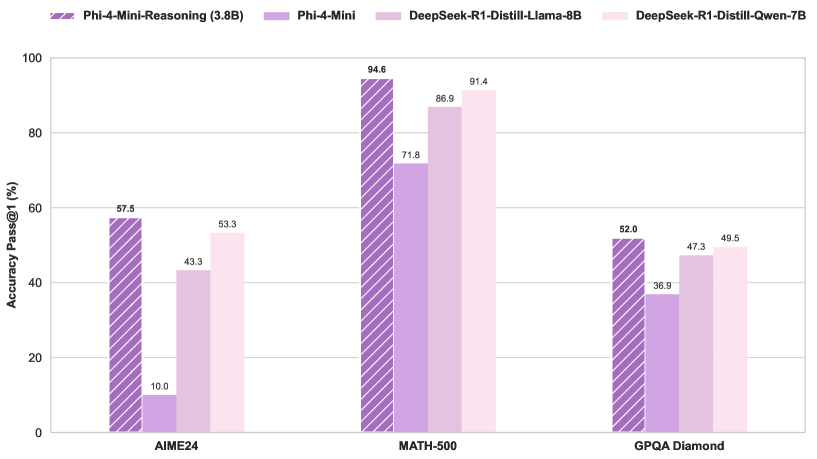

Qwen3 MoE モデルのルーティングに偏りがあり、プルーニング可能: ユーザー kalomaze の分析によると、Qwen3 MoE (Mixture-of-Experts) モデルのルーティング分布には顕著な偏りがあり、30B MoE モデルでさえプルーニングの可能性を示しています。これは、一部のエキスパート (Experts) が十分に活用されておらず、これらのエキスパートをプルーニングすることで、パフォーマンスに大きな影響を与えることなくモデルサイズと計算要件を削減できる可能性があることを意味します。Kalomaze はこの発見に基づき、30B モデルを 16B にプルーニングしたバージョンをリリースしており、235B を 150B にプルーニングしたバージョンのリリースも計画しています。(出典: andersonbcdefg, Reddit r/LocalLLaMA)

DeepSeek Prover V2 がオープンソース数学アシスタントで際立つ: DeepSeek Prover V2 は、現在最もパフォーマンスの高いオープンソースの数学支援モデルと見なされています。そのパフォーマンスは、Gemini 2.5 Pro、o4 mini high、o3、Claude 3.7、Grok 3 などのクローズドソースまたはより強力なモデルにはまだ及びませんが、構造化された推論においては良好なパフォーマンスを示します。ユーザーは、創造的な思考を必要とする「ブレインストーミング」セッションでは改善の余地があると考えています。(出典: cognitivecompai)

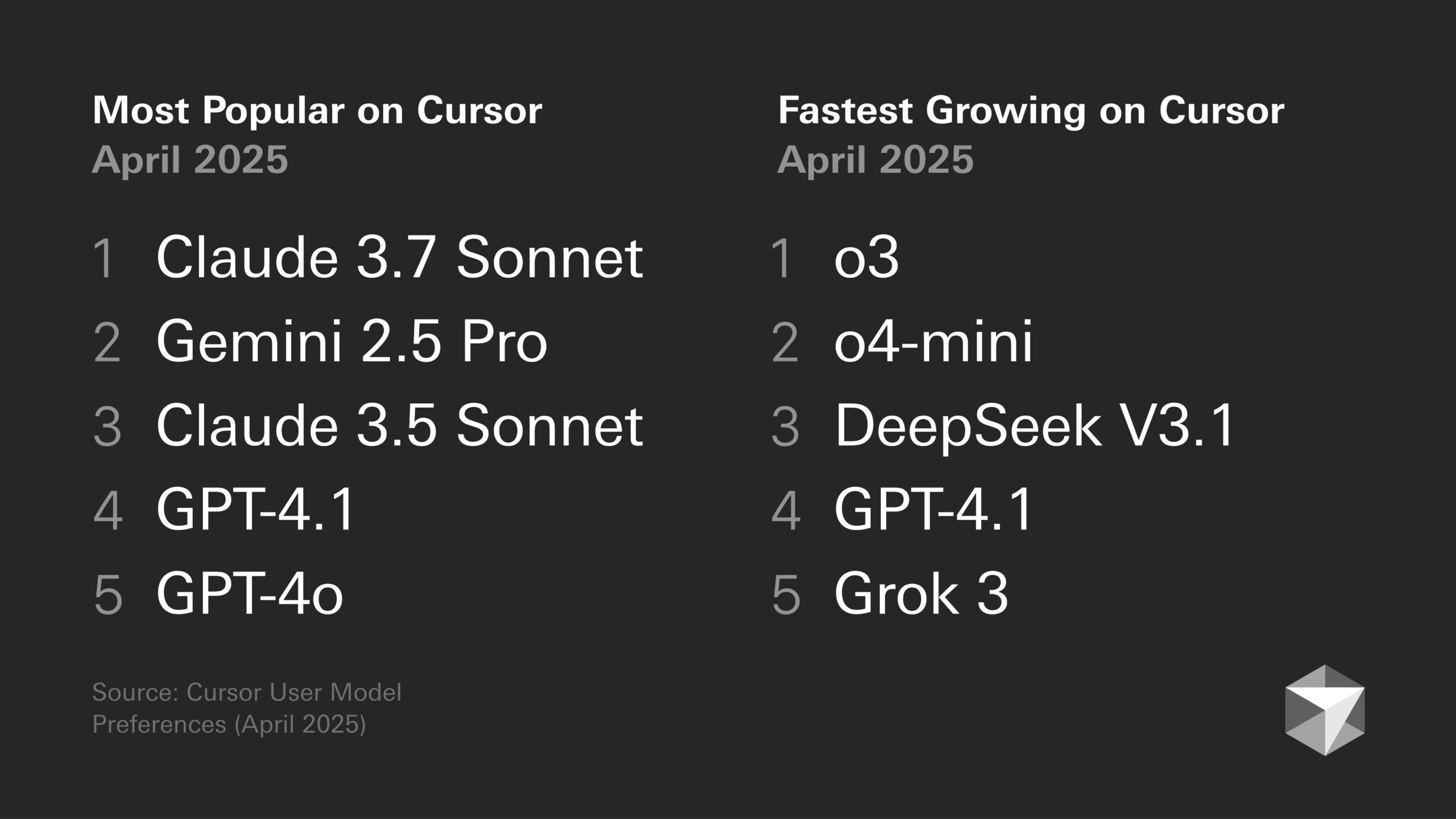

モデルの好みに関する議論:開発者の傾向と特定のモデル特性: 開発者コミュニティでは、さまざまな大規模モデルの長所と短所に関する議論が続いています。例えば、Sentdex は Cursor での Codex と組み合わせた o3 のパフォーマンスが Claude 3.7 よりも優れていると考えています。一方、VictorTaelin は、Sonnet 3.7 は完璧ではない(要求されていない内容を過剰に追加することがあり、期待したほど賢くない)ものの、実践においては GPT-4o(間違いを犯しやすい)、o3/Gemini(コードのフォーマットや書き換えが良くない)、R1(やや時代遅れ)、Grok 3(2番目に良いが、実践ではやや劣る)よりも安定して信頼性の高い結果を提供すると述べています。これは、特定のタスクやワークフローにおける異なるモデルの適合性の違いを反映しています。(出典: Sentdex, VictorTaelin, paul_cal)

LLM パフォーマンスのトレンドに関する議論:指数関数的成長か、収穫逓減か?: Reddit ユーザーは、LLM が依然として指数関数的な改善を経験しているかどうかを議論しています。初期の進歩は急速だったものの、現在 LLM のパフォーマンス向上は収穫逓減に向かっており、追加のパフォーマンスを得ることがますます困難かつ高価になっているという見解があります。これは自動運転技術の発展に似ています。他のユーザーはこれに反論し、GPT-3 から Gemini 2.5 Pro への大きな飛躍は進歩が依然として顕著であることを示しており、プラトー期を断言するのは時期尚早だと指摘しています。この議論は、AI の将来の発展速度に対する異なる期待を反映しています。(出典: Reddit r/ArtificialInteligence)

AI チップが人型ロボット発展の鍵に: 業界の見解では、人型ロボットの核心はその「脳」、すなわち高性能チップにあります。記事は、現在の人型ロボットは運動制御(小脳)と知的決定(大脳)の面でまだ不十分であり、チップの性能がロボットの知能化の程度を直接決定すると指摘しています。Nvidia の GPU、Intel プロセッサ、および国内の黑芝麻智能の华山 A2000 や武当 C1236 などのチップは、ロボットにより強力な知覚、推論、制御能力を提供しており、人型ロボットを単なる話題作りから実用的な応用へと推進する鍵となっています。(出典: 人形机器人,最重要的还是“脑子”)

AI の倫理と擬人化:なぜ私たちは AI に「ありがとう」と言うのか?: AI には感情がないにもかかわらず、ユーザーは AI に対して丁寧な言葉(「ありがとう」、「お願いします」など)を使う傾向があると議論されています。これは、人間の擬人化の本能と「社会的実在感」に起因します。研究によると、丁寧な対話方法は AI がより期待に沿った、より人間らしい応答を生成するように導く可能性があります。しかし、これにはリスクも伴います。例えば、AI が人間の偏見を学習し増幅したり、悪意を持って不適切なコンテンツを生成するように誘導されたりする可能性があります。AI に対する丁寧な行動は、ますますインテリジェント化する機械との対話における人間の複雑な心理と社会的適応を反映しています。(出典: 你对 AI 说的每一句「谢谢」,都在烧钱)

🧰 ツール

Runway Gen-4 References 機能: RunwayML が発表した Gen-4 References 機能は、ユーザーが自身や他の参照画像を AI 生成の動画や画像(ミームなど)に組み込むことを可能にします。ユーザーからのフィードバックによると、この機能は効果的で、複数の同一キャラクターが同じ生成画像内に一貫して表示されることを処理でき、特定の人物やスタイルを AI 創作に組み込むプロセスを簡素化します。(出典: c_valenzuelab)

Krea AI が画像生成テンプレートをリリース: Krea AI は新機能を追加し、一般的な GPT-4o 画像生成プロンプトをテンプレート化しました。ユーザーは自分の画像をアップロードしてテンプレートを選択するだけで、対応するスタイルの画像を生成でき、複雑なプロンプトを手動で入力する必要がなく、画像生成プロセスを簡素化します。(出典: op7418)

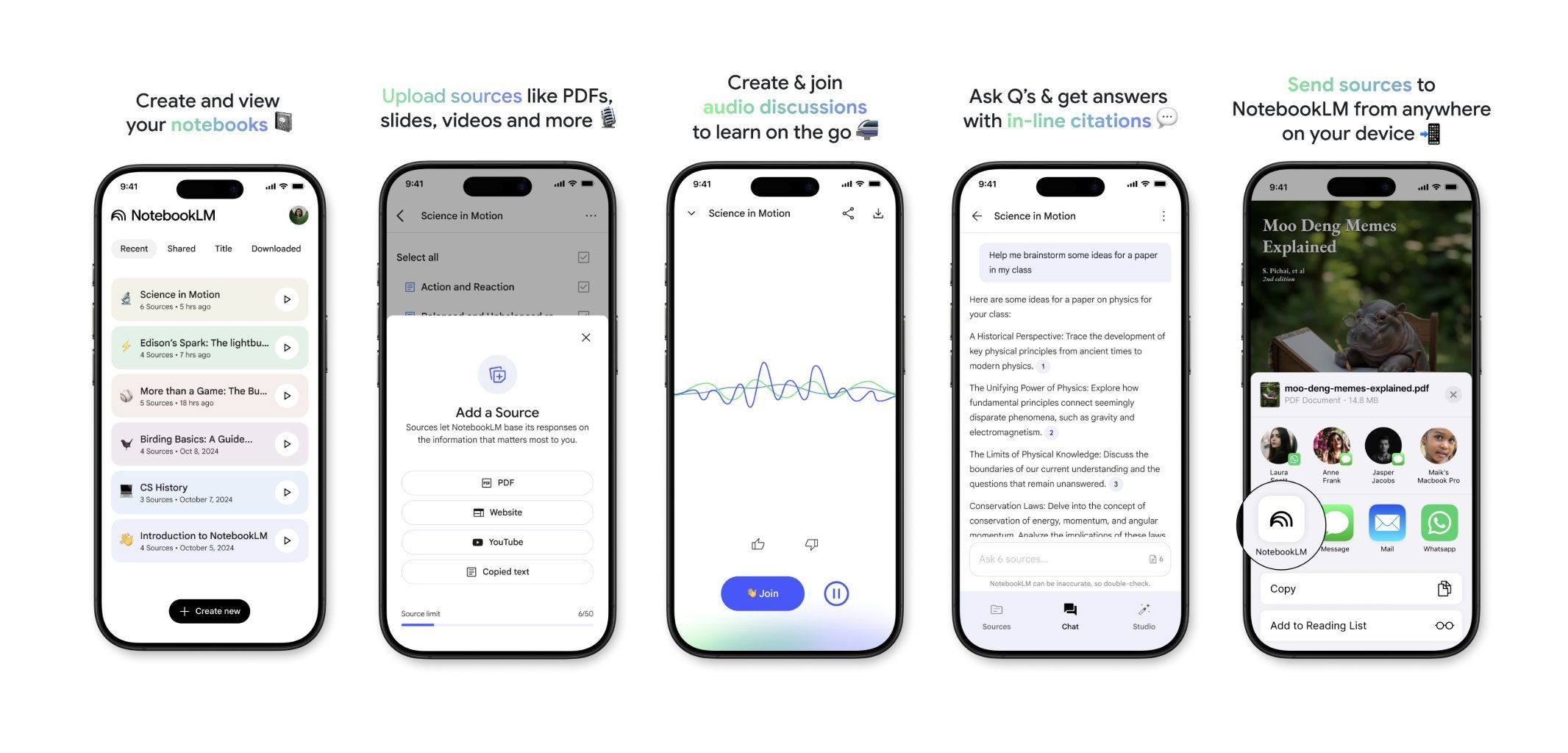

NotebookLM がモバイルアプリを間もなくリリース: Google の NotebookLM (旧 Project Tailwind) がモバイルアプリケーションを間もなくリリースします。ユーザーは携帯電話で見た記事やコンテンツを NotebookLM に素早く転送し、処理・統合することができます。現在、アプリのウェイティングリスト登録が開始されており、より便利なモバイルでの情報管理と AI 支援学習体験を提供することを目指しています。(出典: op7418)

Runway をインテリアデザインに活用: ユーザーが Runway AI を使用してインテリアデザインを行う事例を紹介しています。空間の画像とスタイル/ムードを表す参照画像を1枚ずつ提供することで、Runway は両者の特徴を融合したインテリアデザインの効果図を生成でき、AI のクリエイティブデザイン分野における応用可能性を示しています。(出典: c_valenzuelab)

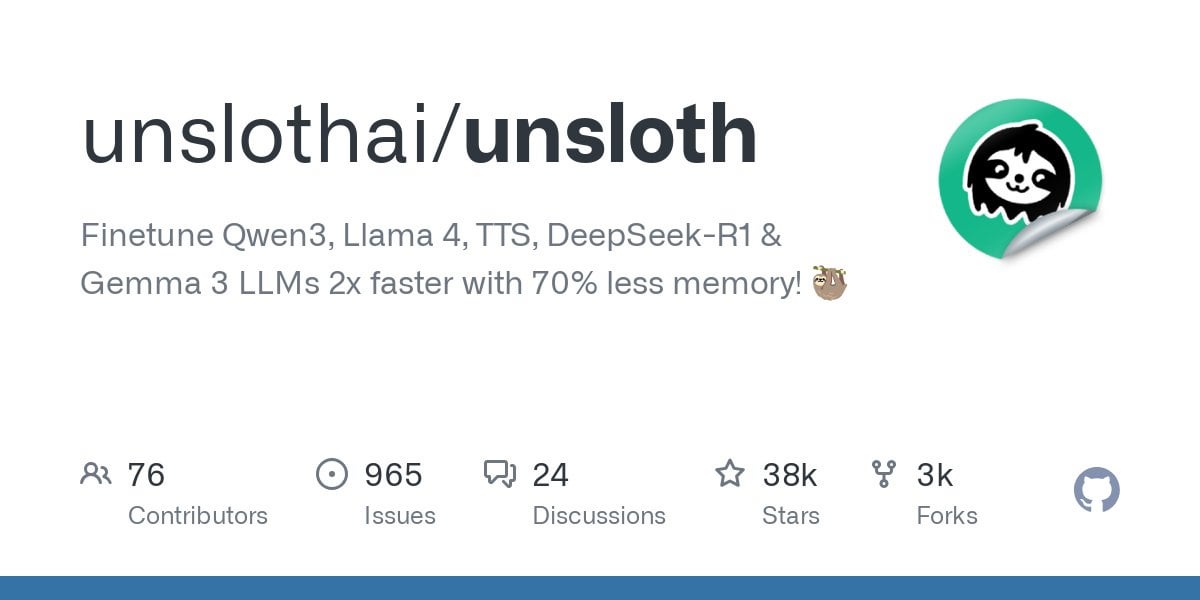

Unsloth が Qwen3 モデルのファインチューニングをサポート: Unsloth は、Qwen3 シリーズモデルのファインチューニングをサポートし、速度を2倍に向上させ、メモリ使用量を70%削減したと発表しました。ユーザーは 24GB の VRAM を持つ GPU で、Flash Attention 2 よりも8倍長いコンテキスト長のファインチューニングを実現できます。Qwen3 14B モデルを無料でファインチューニングするための Colab ノートブックが提供され、GGUF を含む複数の量子化モデルもアップロードされています。これにより、先進的なモデルのファインチューニングのハードルが下がります。(出典: Reddit r/LocalLLaMA)

Claude AI Styles 機能: ユーザーが Claude AI の Styles 機能を使用して AI との協業体験を改善する方法を共有しています。「Iterative Engineering」というスタイルを作成し、議論、計画、小刻みな修正、テスト、反復、必要に応じたリファクタリングのステップを設定することで、Claude がより methodical かつ incremental にコーディングを行うように導き、コードの過度な書き換えを防ぎ、AI をプログラミングパートナーとしての実用性を向上させます。(出典: Reddit r/ClaudeAI)

Deepwiki がコードブロックの出典を提供: ユーザー cto_junior は、Deepwiki の利点として、各回答の横に単なるリンクだけでなくソースコードブロックを表示することを挙げています。この方法は情報の信頼性を高め、特に AI ツールに懐疑的なソフトウェア開発エンジニア (SDEs) にとってより役立ちます。(出典: cto_junior)

📚 学習

NousResearch が Atropos RL フレームワークのアップデートをリリース: NousResearch の Atropos 強化学習 (RL) 環境フレームワークがアップデートされました。新機能により、ユーザーはトレーニングや推論エンジンなしで RL 環境の rollout を迅速かつ簡単にテストできます。デフォルトでは OpenAI API を使用しますが、他の API プロバイダー (またはローカルの VLLM/SGLang エンドポイント) に設定可能です。テスト完了後、completions とそのスコアを含むウェブページレポートが生成され、wandb ロギングもサポートされるため、RL 環境のデバッグと評価が容易になります。(出典: Teknium1)

パーソナライズド RAG ベンチマークデータセット EnronQA がリリース: 研究者たちは、プライベートドキュメントにおけるパーソナライズド検索拡張生成 (Personalized RAG) の研究を推進するために EnronQA データセットをリリースしました。このデータセットには、103,638 通のメールと 150 人のユーザーに対する 528,304 個の高品質な質疑応答ペアが含まれており、個々の特定情報を理解し活用できる RAG システムの評価と開発のためのリソースを提供します。(出典: lateinteraction)

GTE-ModernColBERT (PyLate) がリリース: LightOnAI は GTE-ModernColBERT (PyLate) をリリースしました。これは 128 次元の MaxSim リトリーバーで、gte-modernbert-base に基づき、ms-marco-en-bge-gemma でファインチューニングされています。ネイティブに PyLate ライブラリをサポートし、リランキングと HNSW インデックス作成が可能です。NanoBEIR ベンチマークで優れたパフォーマンスを示し、BEIR の平均スコアで ColBERT-small を上回り、新しい効率的なテキスト検索オプションを提供します。(出典: lateinteraction)

SOLO Bench – 新しい LLM ベンチマークテスト: ユーザー jd_3d が開発・リリースした SOLO Bench は、新しい LLM ベンチマーク手法です。このテストでは、LLM に特定の数(例:250 または 500)の文を含むテキストを生成させます。各文は、事前定義されたリスト(名詞、動詞、形容詞などを含む)から1つの単語を必ず含み、かつ1つだけ含み、各単語は1回しか使用できません。ルールベースのスクリプトで評価され、LLM の指示追従、制約充足、長文生成能力をテストすることを目的としています。初期の結果は、このベンチマークが異なるモデルのパフォーマンスを効果的に区別できることを示しています。(出典: Reddit r/LocalLLaMA)

戦略的再帰的内省による潜在空間の操作: ユーザーは、「戦略的再帰的内省」(Strategic recursive reflection, RR) を通じて LLM の潜在空間にネストされた推論階層を作成する方法を提案しています。重要な瞬間にモデルに以前の対話を内省するように促すことで、メタ認知ループを生成し、「ミニ潜在空間」を構築します。各プロンプトは一種の圧力と見なされ、潜在空間におけるモデルの経路を誘導し、より自己言及的で抽象的な能力を持たせます。これは、人間が思考を内省することによって思考を深めるプロセスをシミュレートするものと考えられており、より深いレベルの概念を探求することを目的としています。(出典: Reddit r/ArtificialInteligence)

💼 ビジネス

Google が Samsung に Gemini AI プリインストールのために支払い: 昨年、デフォルト検索エンジン契約が独占禁止法違反と判断された後、Google は Samsung デバイスに Gemini AI をプリインストールするために、Samsung に毎月「巨額の資金」と収益分配を支払っていると報じられました。また、パートナーに Gemini の強制プリインストールを要求する可能性もあります。これは、Samsung Galaxy S25 シリーズが Gemini を深く統合し、デフォルトの AI アシスタントとして設定する理由を説明しています。この動きは、Google が自社のハードウェアチャネルが不足している状況で、モバイル AI の入り口を急いで確保しようとする戦略を反映していますが、再び独占禁止法の懸念を引き起こす可能性もあります。(出典: 三星手机预装Gemini AI,也是谷歌花钱买的)

AI スタートアップが直面する課題: Reddit の議論では、多くの AI スタートアップは、モデルの能力が同質化し、ユーザーの忠誠心が低いため、参入障壁(moat)を欠いている可能性があると指摘されています。大手テック企業(Google、Microsoft、Apple)は、そのエコシステム(プリインストール、統合など)の利点を活かして、ユーザーに容易にリーチできます。スタートアップのモデルがわずかに優れていても、ユーザーはデフォルトまたは統合された「十分良い」AI を使用する傾向があるかもしれません。これは、AI スタートアップの長期的な生存能力と VC 投資の見通しに対する懸念を引き起こしています。(出典: Reddit r/ArtificialInteligence)

今週の AI 資金調達とビジネス動向まとめ (2025年5月2日): Microsoft CEO が AI が会社の「重要な部分」のコードを記述したことを明らかに。Microsoft CFO が AI サービスが需要過多により中断する可能性があると警告。Google がサードパーティ AI チャットボットへの広告掲載を開始。Meta が独立した AI アプリをリリース。Cast AI が $108M、Astronomer が $93M、Edgerunner AI が $12M を調達。研究が LM Arena のベンチマーク操作問題を指摘。Nvidia が Anthropic のチップ輸出規制支持に異議。(出典: Reddit r/artificial)

🌟 コミュニティ

AI 生成コンテンツの品質とコストに関する議論: コミュニティでは、AI 生成コンテンツの品質のばらつき(”slop” と呼ばれる)に対する懸念が表明されています。ユーザー wordgrammer は、大量に生成される AI 動画の品質が低く、実際のコスト(選別と再試行を考慮すると)は表示価格よりもはるかに高いと指摘しています。これは、モデル設計(jam3scampbell がジョブズの意見を引用)と AI ツールの効果的な利用に関する議論を引き起こし、より洗練された制御とより高い生成品質基準の必要性を強調しています。(出典: wordgrammer, jam3scampbell, willdepue)

特定のタスクにおける AI のパフォーマンスに関する議論: コミュニティメンバーは、さまざまなタスクにおける AI のパフォーマンスと限界について議論しています。例えば、DeepSeek R1 は LLM の誇大広告のピークの1つである可能性があり、形式数学や医学などの分野での進歩はあるものの、一般ユーザーの広範な注目を集めるには至っていないと考えられています。DeepSeek Prover V2 は数学の面で優れていますが、創造性に欠けると見なされています。ユーザー vikhyatk は、AIME (米国数学招待試験) などの特定のベンチマークでパフォーマンスを発揮するようにモデルを過度に最適化することの意義に疑問を呈し、一般大衆は数学能力に関心がないと主張しています。これらの議論は、AI の能力の境界と実際の応用価値についての考察を反映しています。(出典: wordgrammer, cognitivecompai, vikhyatk)

AI 支援によるクリエイティブとデザイン: コミュニティでは、AI ツールを使用してクリエイティブデザインを行うさまざまな方法が紹介されています。ユーザーは Runway の Gen-4 References 機能を利用して自分自身をミームに組み込んだり、Runway を使用してインテリアデザインのコンセプトを生成したり、GPT-4o とプロンプトテンプレートを利用して特定のスタイルの画像(折り紙の華南虎、動物のシリコンリストレスト、単語の意味を文字デザインに組み込むなど)を作成したりしています。これらの事例は、AI のビジュアルクリエイティブ、パーソナライズドデザインにおける可能性を示しています。(出典: c_valenzuelab, c_valenzuelab, dotey, dotey, dotey)

AI のライティングスタイル模倣能力への疑問: ユーザー nrehiew_ は、LLM に「私のトーンとスタイルで書き続けて」という指示は、ほとんどの人が自分のライティングスタイルの独自性を過大評価しているため、実際には効果がないかもしれないと考えています。これは、LLM が微妙なライティングスタイルを理解し複製する能力、およびユーザーがその能力をどのように認識しているかについての議論を引き起こしています。(出典: nrehiew_)

感情的サポートのための AI 利用が共感と議論を呼ぶ: Reddit ユーザーは、ChatGPT などの AI と対話して感情的なサポートを得たり、危機に対処するのを助けられたりした経験を共有しています。多くの人が、孤独を感じたり、話を聞いてほしかったり、精神的な困難に直面したりしたときに、AI が判断を下さず、忍耐強く、いつでも利用できる対話相手を提供し、時には人間との対話よりも効果的だと感じたと述べています。これは、メンタルヘルスサポートにおける AI の役割についての議論を引き起こしていますが、同時に AI が専門的な人間の助けに取って代わることはできず、AI がもたらす可能性のある偏見や誤解に注意する必要があることも強調しています。(出典: Reddit r/ChatGPT, Reddit r/ClaudeAI)

AI 生成アートに対する見解の相違: ユーザーは、AI 生成アートが人間のアーティストとその作品に対する認識に与える潜在的な影響について議論しています。高品質な作品が、現在ではしばしば安易に AI 生成によるものとされ、クリエイターの才能と努力が無視されていると不満を述べる人もいます。この現象は人々の認識を歪め始め、作品が AI によって作られたものではないことを確認するために「人間の誤り」を探す傾向さえ生み出しています。議論は、AI 生成コンテンツにウォーターマークを義務付けるべきかどうかの問題にも及んでいます。(出典: Reddit r/ArtificialInteligence)

💡 その他

AI のリソース消費が注目を集める: AI の発展の背後にある巨大なリソース消費が議論で強調されています。大規模 AI モデルのトレーニングと運用には大量の電力と水資源が必要であり、データセンターは新たな高エネルギー消費施設となっています。ユーザーと AI の各インタラクション(単純な「ありがとう」を含む)は、エネルギーを累積的に消費しています。これは、AI の持続可能な開発とエネルギーソリューション(核融合など)への関心を引き起こしています。(出典: 你对 AI 说的每一句「谢谢」,都在烧钱)

AI と意識の距離: Reddit ユーザーは、現在の AI が自己意識を持っているかどうかを議論しています。一般的な見解では、現在の AI (LLM など) は本質的に確率に基づいて単語を予測する複雑なパターンマッチングシステムであり、真の理解や自己意識を欠いており、その能力を備えるにはまだ非常に遠いとされています。しかし、人間の意識自体も完全には理解されておらず、比較には誤解がある可能性があり、特定のタスクにおける AI の超人的な能力は無視できないというコメントもあります。(出典: Reddit r/ArtificialInteligence)

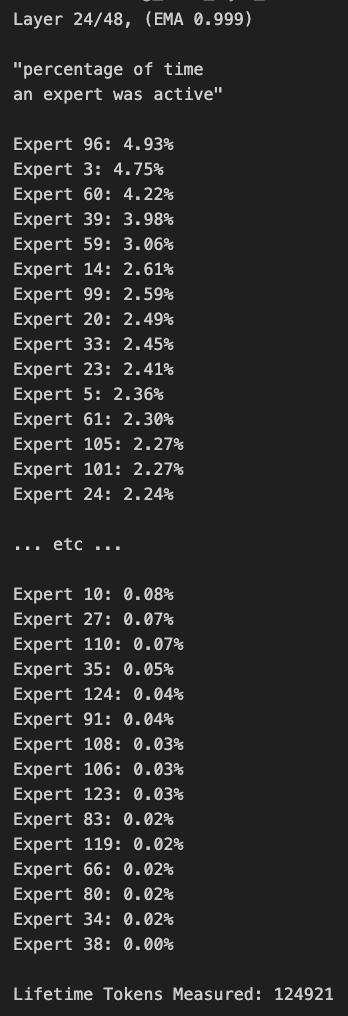

Windows タブレットで大規模 MoE モデルを実行: ユーザーは、AMD Ryzen AI Max 395+ と 128GB RAM を搭載した Windows タブレット上で、iGPU (Radeon 8060S、95.8GB 中 87.7GB を VRAM として割り当て) のみを使用して Qwen3 235B-A22B MoE モデル (Q2_K_XL 量子化を使用) を約 11.1 t/s の速度で実行する例を示しました。これは、ポータブルデバイスで超大規模モデルを実行する可能性を示していますが、メモリ帯域幅が依然としてボトルネックとなっています。(出典: Reddit r/LocalLLaMA)