Kata Kunci:Komputasi Kuantum, Algoritma AI, Arsitektur Transformer, Regulasi AI, Dinamika Bisnis AI, Etika AI, Perangkat Keras AI, Evaluasi Model AI, Algoritma Kuantum Google Willow Chip, Lapisan Bawah Sadar Transformer Bebas Meta, DeepSeek-V2 Multi-Head Perhatian Potensial, Kartu Grafis AMD Radeon AI PRO R9700, Lapisan Keamanan Pembuatan Kode AI Corridor

🔥 Fokus

Algoritma Kuantum Google Mengungguli Superkomputer: Google mengklaim algoritma kuantum barunya mengungguli superkomputer dalam kinerja, berpotensi mempercepat penemuan obat dan pengembangan material baru. Inti dari terobosan ini adalah chip Willow-nya. Meskipun aplikasi praktis komputasi kuantum masih membutuhkan waktu bertahun-tahun, kemajuan ini menandai tonggak penting di bidang tersebut, mengisyaratkan potensi besar untuk penelitian ilmiah di masa depan. (Sumber: MIT Technology Review)

Reddit Menggugat Mesin Pencari AI Perplexity: Reddit telah mengajukan gugatan terhadap mesin pencari AI Perplexity, menuduhnya secara ilegal mengambil data Reddit untuk pelatihan model. Reddit mencari perintah pengadilan permanen untuk mencegah perusahaan semacam itu menjual datanya tanpa izin. Kasus ini memicu diskusi luas tentang perlindungan hak cipta dan legalitas penggunaan data di era AI. (Sumber: MIT Technology Review)

Rencana Lima Tahun Tiongkok: Swasembada Teknologi dan Peran Kunci AI: Tiongkok telah merilis rencana lima tahun yang bertujuan untuk mencapai swasembada teknologi, menempatkan semikonduktor dan kecerdasan buatan sebagai bidang pengembangan utama. Langkah ini menyoroti tekad Tiongkok untuk otonomi strategis di bidang teknologi dan mencari keunggulan dalam persaingan perdagangan internasional, memicu perhatian global terhadap rantai pasokan teknologi dan perubahan lanskap geopolitik. (Sumber: MIT Technology Review)

OpenAI Melonggarkan Aturan Diskusi Bunuh Diri Memicu Gugatan: OpenAI dituduh melonggarkan aturannya tentang diskusi bunuh diri dua kali untuk meningkatkan jumlah pengguna ChatGPT, yang menyebabkan seorang remaja bunuh diri. Orang tua korban telah mengajukan gugatan, menuduh bahwa perubahan OpenAI melemahkan perlindungan bunuh diri bagi pengguna, memicu pertanyaan serius tentang etika AI, keamanan pengguna, dan tanggung jawab platform. (Sumber: MIT Technology Review)

Elon Musk Membangun Pasukan Robot, Optimus Diharapkan Menjadi “Ahli Bedah”: Elon Musk secara aktif membangun pasukan robot dan membayangkan robot Optimus-nya di masa depan dapat menjadi “ahli bedah yang luar biasa”. Visi ini memicu diskusi luas tentang kemampuan robot umum, kepercayaan manusia-mesin, dan aplikasi AI di bidang profesional yang kompleks, mengisyaratkan masa depan di mana teknologi robot memainkan peran yang lebih penting di dunia nyata. (Sumber: MIT Technology Review)

🎯 Tren

Meta Merilis “Free Transformer”: Menulis Ulang Aturan Dasar AI: Meta meluncurkan model baru “Free Transformer”, yang memecahkan aturan inti arsitektur Transformer selama 8 tahun, dengan memperkenalkan “lapisan bawah sadar” untuk pemikiran awal sebelum generasi. Inovasi ini hanya menambah sekitar 3% overhead komputasi, namun secara signifikan meningkatkan kinerja model dalam penalaran dan generasi terstruktur, melampaui model skala yang lebih besar dalam tes seperti GSM8K dan MMLU, dan dianggap sebagai Transformer pertama “dengan niat intrinsik”. (Sumber: 36氪)

Robot Google DeepMind Mampu “Berpikir Sebelum Bertindak”: Model Gemini Robotics 1.5 dari Google DeepMind memungkinkan robot beralih dari sekadar menjalankan perintah secara pasif menjadi merefleksikan, bernalar, dan membuat keputusan. Robot-robot ini dapat menjelaskan proses penalaran mereka, mentransfer pengetahuan antar mesin, dan mengintegrasikan penglihatan, bahasa, dan tindakan ke dalam siklus pemikiran yang terpadu, yang diharapkan dapat mendorong kecerdasan dunia nyata dan kolaborasi manusia-mesin ke tahap baru. (Sumber: Ronald_vanLoon)

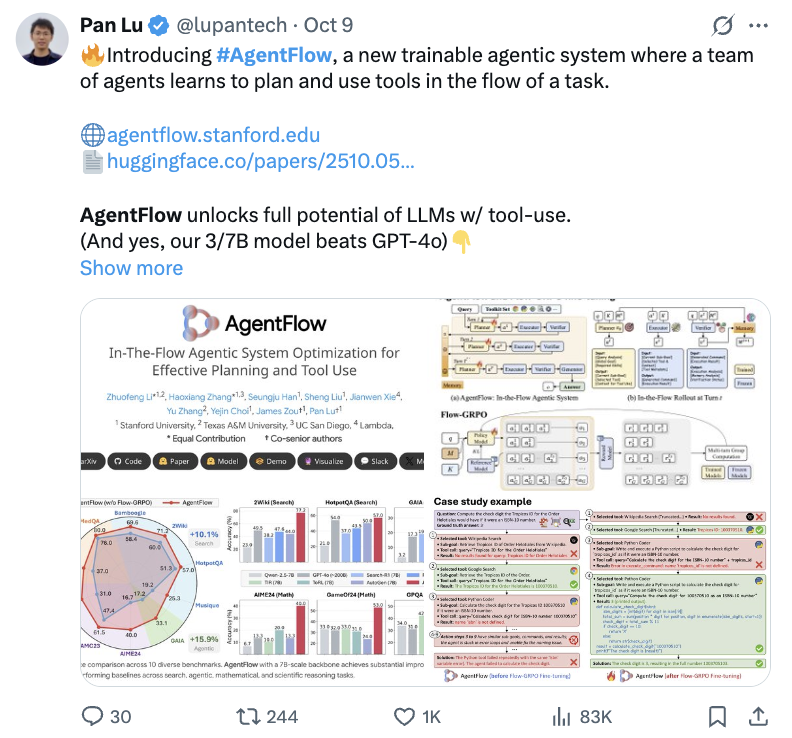

AgentFlow Stanford Meningkatkan Kemampuan Penalaran Model Kecil: Tim Stanford meluncurkan paradigma baru AgentFlow, yang memungkinkan model kecil 7B meningkatkan kinerja penalaran pada masalah kompleks melalui pembelajaran penguatan online, bahkan melampaui GPT-4o dan Llama3.1-405B. AgentFlow bekerja sama dengan empat agen: perencana, pelaksana, validator, dan generator, menggunakan Flow-GRPO untuk mengoptimalkan perencana secara real-time, menunjukkan peningkatan signifikan dalam tugas pencarian, agen, matematika, dan sains. (Sumber: 36氪)

AI Menemukan Algoritma MoE Baru: Efisiensi 5 Kali Lipat, Biaya Turun 26%: Tim peneliti dari University of California, Berkeley, mengusulkan sistem ADRS, yang melalui siklus iteratif “generasi-evaluasi-peningkatan”, memungkinkan AI menemukan algoritma baru yang 5 kali lebih cepat dan 26% lebih murah daripada algoritma yang dirancang manusia. Berdasarkan kerangka kerja OpenEvolve, AI menemukan metode heuristik yang cerdik dalam tugas seperti penyeimbangan beban MoE, secara signifikan meningkatkan efisiensi operasional dan menunjukkan potensi besar AI dalam penciptaan algoritma. (Sumber: 36氪)

Anthropic Memperluas Penggunaan Google TPU, Memperkuat Infrastruktur Komputasi AI: Anthropic mengumumkan rencana untuk memperluas penggunaan Google TPU, memastikan akses ke sekitar 1 juta TPU dan kapasitas lebih dari 1 gigawatt pada tahun 2026. Langkah ini menunjukkan investasi besar Anthropic dalam infrastruktur komputasi AI, serta kerja sama mendalam dengan Google di bidang AI, mengisyaratkan perluasan lebih lanjut dalam skala pelatihan model AI di masa depan. (Sumber: Justin_Halford_)

Mekanisme Multi-head Latent Attention (MLA) DeepSeek-V2 Memicu Diskusi: Multi-head Latent Attention (MLA) yang diperkenalkan oleh DeepSeek-V2 secara signifikan mengurangi kompleksitas dengan memproyeksikan kunci dan nilai ke ruang laten, memicu diskusi di kalangan akademisi mengapa konsep ini belum muncul sebelumnya. Meskipun Perceiver telah mengeksplorasi ide serupa pada tahun 2021, MLA baru muncul pada tahun 2024, mungkin memerlukan “trik” tertentu agar dapat berfungsi dalam praktik. (Sumber: Reddit r/MachineLearning)

Pembuatan Konten Video AI Mencapai Titik Kritis: Pembuatan konten video AI telah mencapai titik kritis, dengan banyak hits yang bermunculan, seperti peluncuran Sora 2 di platform Synthesia, dan video musik bertema Journey to the West yang dihasilkan AI di Bilibili yang mendapatkan jutaan penayangan. Ini menunjukkan potensi besar AI dalam generasi konten hiburan, yang dengan cepat mengubah lanskap pembuatan konten. (Sumber: op7418)

Llion Jones, Salah Satu Penulis “Attention Is All You Need”, Merasa “Bosan” dengan Arsitektur Transformer: Llion Jones, salah satu penulis makalah “Attention Is All You Need”, menyatakan “bosan” dengan ketergantungan berlebihan pada arsitektur Transformer di bidang AI, percaya bahwa hal itu menghambat terobosan teknologi baru. Dia menunjukkan bahwa meskipun ada investasi besar di bidang AI, penelitian menjadi sempit karena tekanan investasi dan persaingan, yang mungkin melewatkan inovasi arsitektur besar berikutnya. (Sumber: Reddit r/ArtificialInteligence)

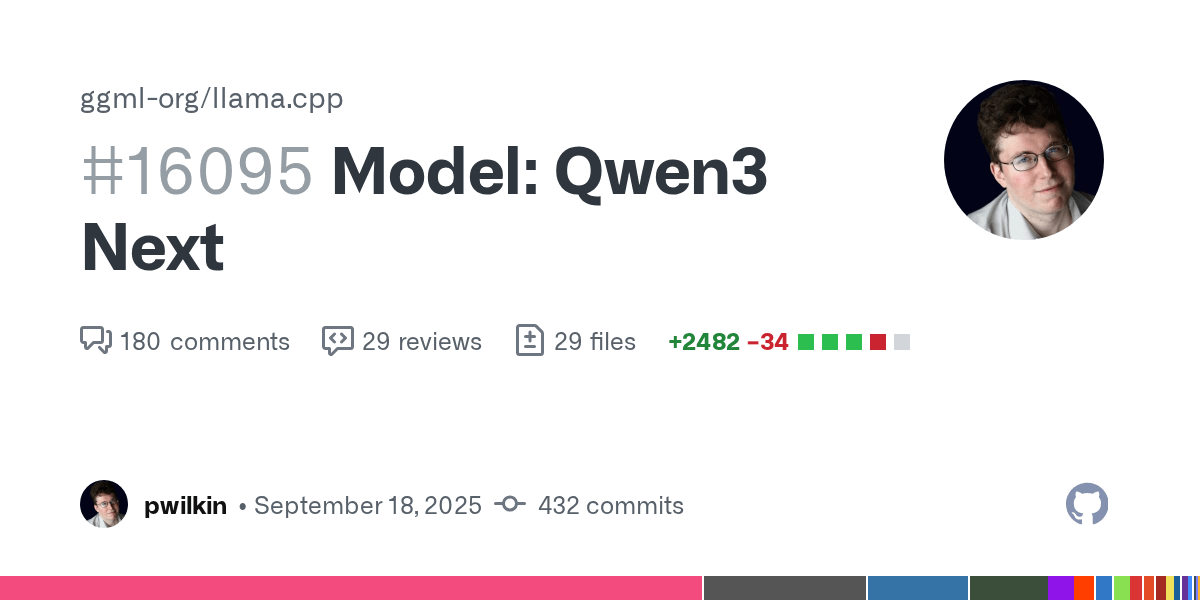

Kemajuan Dukungan Model Qwen3 Next di llama.cpp: Dukungan untuk model Qwen3 Next di llama.cpp telah siap untuk tinjauan kode. Meskipun ini bukan versi final dan belum dioptimalkan untuk kecepatan, ini menandai kemajuan positif dalam integrasi model baru oleh komunitas open source, mengisyaratkan kemungkinan Qwen3 berjalan secara lokal. (Sumber: Reddit r/LocalLLaMA)

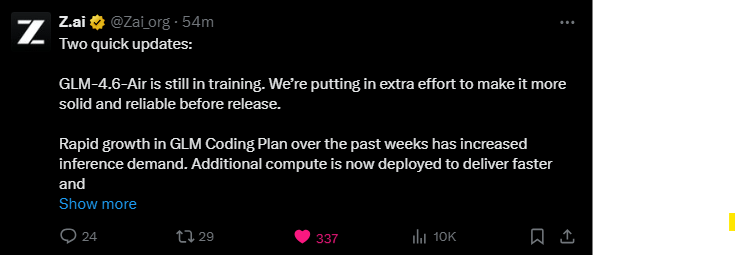

Model GLM-4.6-Air Terus Dilatih: Model GLM-4.6-Air masih dalam pelatihan, dan tim sedang melakukan upaya ekstra untuk meningkatkan stabilitas dan keandalannya. Komunitas pengguna menyatakan antisipasi, lebih memilih menunggu lebih lama untuk mendapatkan model yang lebih berkualitas, dan penasaran apakah kinerjanya dapat melampaui model yang ada. (Sumber: Reddit r/LocalLLaMA)

DyPE: Metode Tanpa Pelatihan untuk Generasi Gambar Difusi Resolusi Ultra Tinggi: Makalah HuggingFace memperkenalkan DyPE (Dynamic Positional Extrapolation), sebuah metode baru yang memungkinkan Transformer difusi yang telah dilatih sebelumnya menghasilkan gambar dengan resolusi jauh di atas resolusi pelatihan tanpa perlu pelatihan tambahan. DyPE secara dinamis menyesuaikan pengkodean posisi model dan memanfaatkan evolusi spektral dari proses difusi, secara signifikan meningkatkan kinerja dan fidelitas dalam berbagai benchmark, terutama lebih efektif pada resolusi tinggi. (Sumber: HuggingFace Daily Papers)

Paradigma “Komunikasi Pikiran” Multi-Agen: Makalah HuggingFace memperkenalkan paradigma “komunikasi pikiran”, yang memungkinkan sistem multi-agen untuk berkomunikasi secara mental secara langsung, melampaui batasan bahasa alami. Metode ini, diformalkan sebagai model variabel laten, secara teoritis dapat mengidentifikasi pikiran laten yang dibagikan dan pribadi antar agen, dan telah memvalidasi keunggulan kolaboratifnya pada benchmark sintetis dan dunia nyata. (Sumber: HuggingFace Daily Papers)

LALM Memiliki Kerentanan Keamanan di Bawah Perubahan Emosi: Penelitian makalah HuggingFace menemukan bahwa Large Audio Language Models (LALMs) memiliki kerentanan keamanan yang signifikan di bawah perubahan emosi pembicara yang berbeda. Dengan membangun dataset instruksi suara berbahaya, penelitian ini mengungkapkan bahwa LALMs menghasilkan respons yang tidak aman pada tingkat yang bervariasi di bawah emosi dan intensitas yang berbeda, dengan ekspresi emosi sedang memiliki risiko tertinggi, menyoroti perlunya memastikan ketahanan AI dalam penerapan dunia nyata. (Sumber: HuggingFace Daily Papers)

OpenAI Menyesuaikan “Blueprint Kekuatan AI” untuk Jepang dan Korea Selatan: OpenAI merilis “Japan Economic Blueprint” dan “Korea Economic Blueprint”, menandai peningkatan strategi Asia-Pasifiknya dari ekspor produk menjadi kerja sama tingkat nasional. Blueprint tersebut mengusulkan strategi jalur ganda “pembangunan kapasitas kedaulatan + kolaborasi strategis” dan rencana tiga pilar “AI inklusif, infrastruktur, pembelajaran seumur hidup”, yang bertujuan untuk mempercepat aplikasi AI, meningkatkan infrastruktur komputasi, dan membantu kedua negara menjadi kekuatan AI global. (Sumber: 36氪)

Kerangka ExGRPO: Paradigma Baru Pembelajaran Penalaran Model Besar: Tim Shanghai AI Lab dan lainnya mengusulkan kerangka kerja manajemen dan pembelajaran pengalaman ExGRPO, yang mengoptimalkan kemampuan penalaran model besar dengan mengidentifikasi, menyimpan, menyaring, dan mempelajari pengalaman berharga secara ilmiah. ExGRPO secara signifikan meningkatkan kinerja pada tugas-tugas kompleks seperti soal kompetisi matematika, mengungkapkan bahwa masalah kesulitan menengah dan lintasan entropi rendah adalah kunci pembelajaran yang efisien, menghindari masalah “belajar lalu lupa” dalam mode RLVR tradisional. (Sumber: 量子位)

🧰 Alat

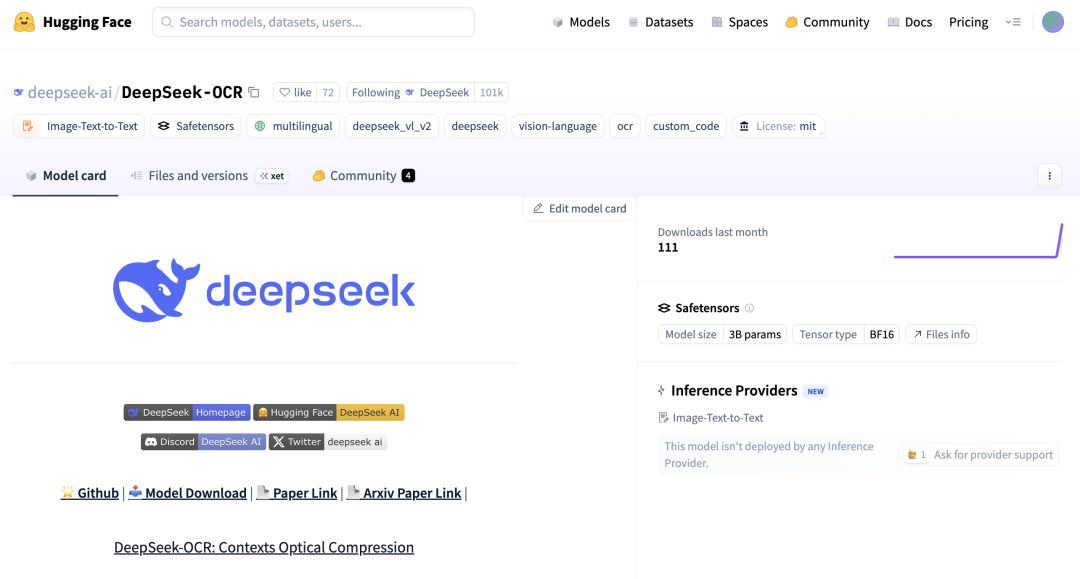

DeepSeek-OCR dan Zhipu Glyph: Terobosan Teknologi Visual Token: DeepSeek merilis model DeepSeek-OCR 3 miliar parameter open-source, secara inovatif memungkinkan AI mengompresi teks secara optik dengan cara “melihat gambar dan mengenali karakter”, mencapai rasio kompresi 10x dan akurasi OCR 97%. Zhipu segera menyusul dengan Glyph, yang juga secara signifikan mengurangi konteks LLM dan meningkatkan efisiensi serta kecepatan pemrosesan dengan merender teks panjang menjadi Visual Token bergambar. Model-model ini mendapatkan dukungan di vLLM, menunjukkan potensi besar modalitas visual dalam pemrosesan informasi LLM. (Sumber: 36氪, 量子位, vllm_project, mervenoyann)

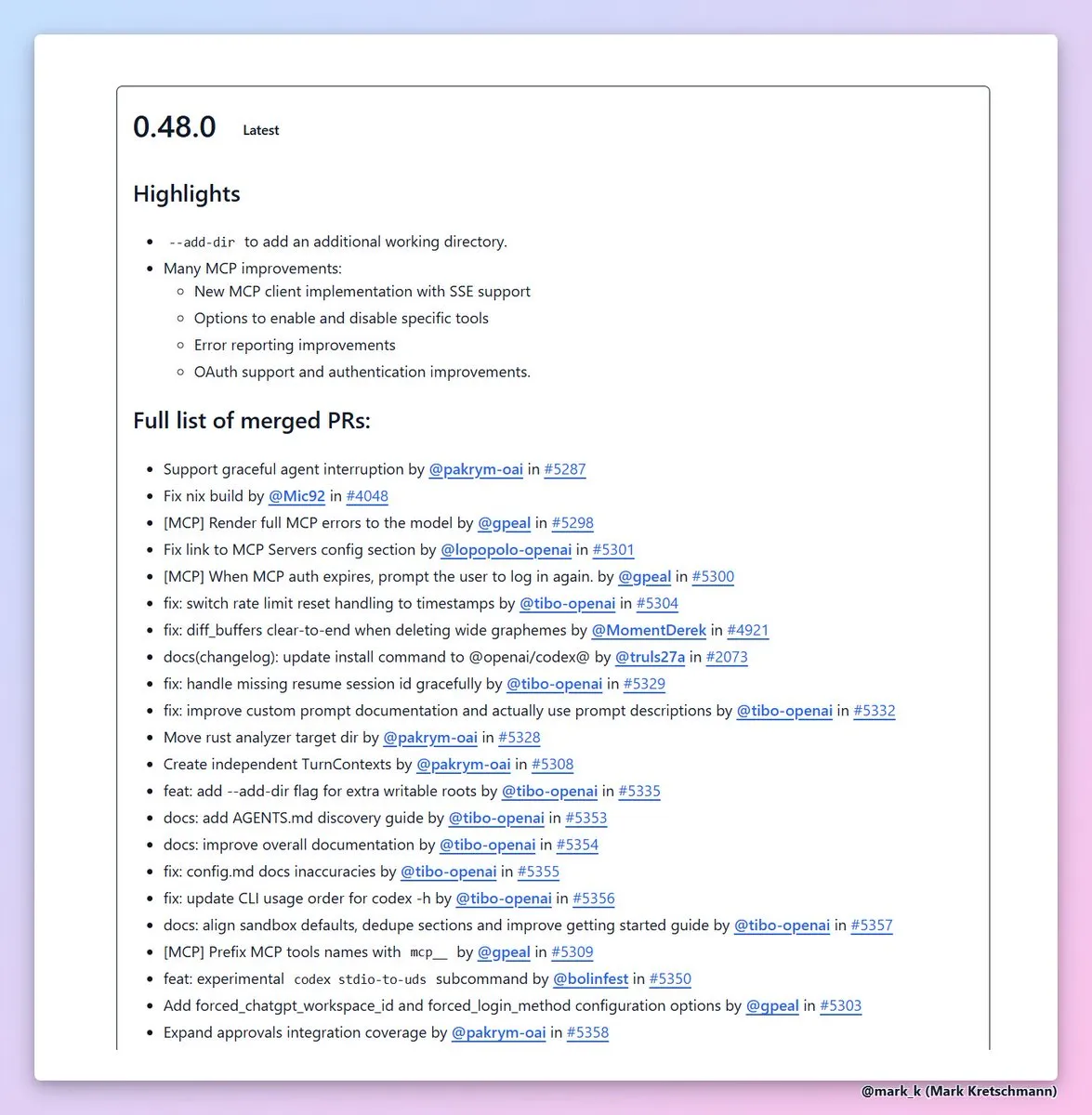

Codex CLI 0.48 Menambahkan Fitur --add-dir Baru: OpenAI merilis Codex CLI versi 0.48, dengan fitur paling berharga adalah penambahan --add-dir, yang memungkinkan penambahan direktori lain ke ruang kerja saat ini. Langkah ini sangat meningkatkan kegunaan alat pengkodean AI dalam proyek multi-file, meningkatkan pelaporan kesalahan dan pengalaman autentikasi klien MCP, serta mempercepat efisiensi rekayasa perangkat lunak. (Sumber: dotey, kevinweil)

Lapisan Keamanan Generasi Kode AI Corridor Diluncurkan: Lapisan keamanan Corridor resmi diluncurkan, menyediakan perlindungan keamanan real-time untuk alat generasi kode AI seperti Cursor dan Claude Code. Corridor adalah alat keamanan pertama yang sinkron dengan kecepatan pengembangan, dapat secara real-time menegakkan pagar pengaman keamanan, memastikan keamanan pengkodean yang dibantu AI, dan menawarkan uji coba gratis dua minggu. (Sumber: percyliang)

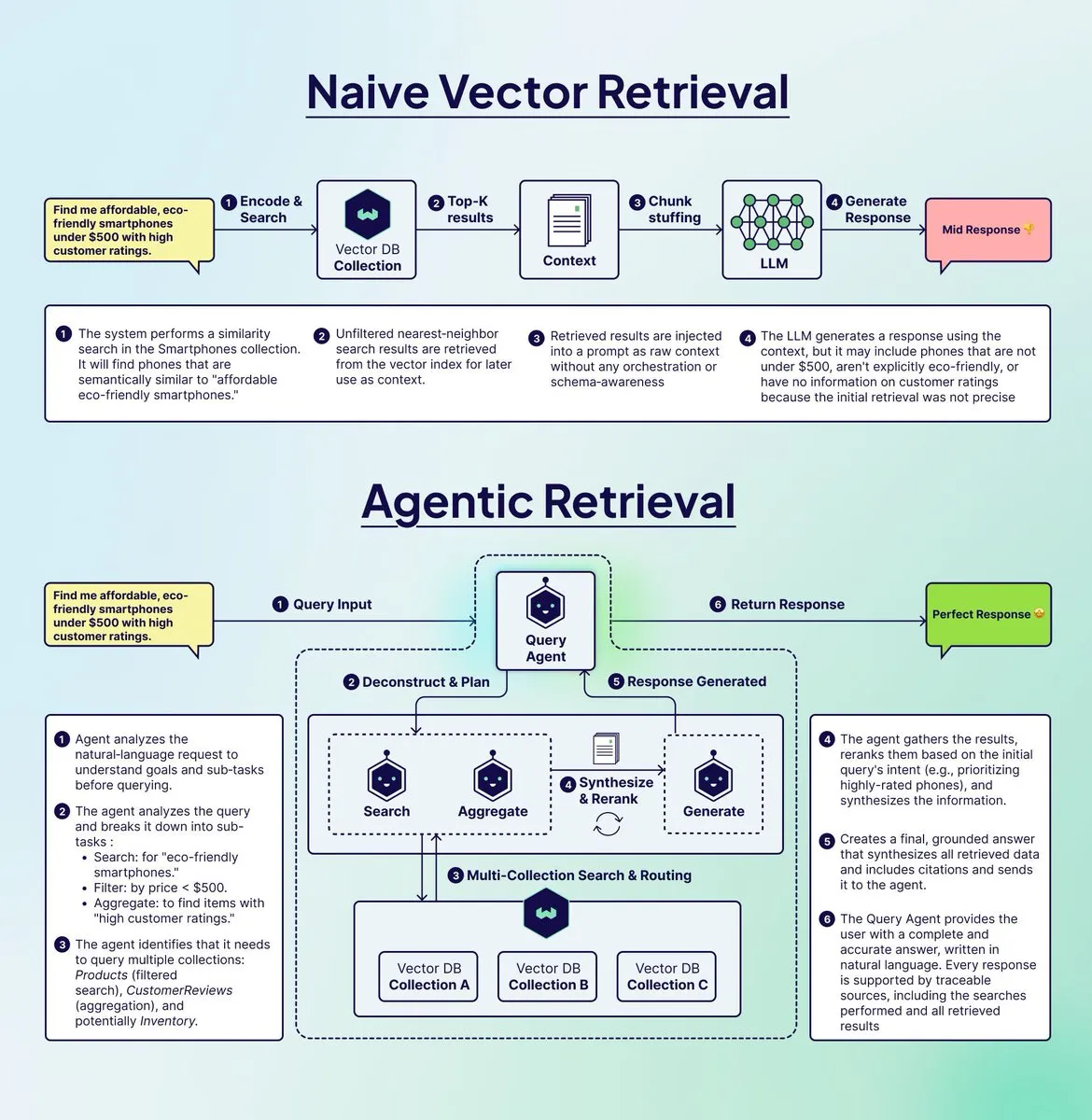

Weaviate Meluncurkan Query Agent untuk Mengoptimalkan Sistem RAG: Weaviate meluncurkan Query Agent, yang bertujuan untuk mengatasi masalah “penipuan” dalam sistem RAG tradisional saat menangani kueri kompleks multi-langkah. Query Agent dapat memecah kueri, merutekan ke beberapa koleksi, menerapkan filter, dan mengagregasi hasil, memberikan jawaban yang lebih akurat dan berdasar. Kini telah tersedia di Weaviate Cloud, secara signifikan meningkatkan efek Retrieval-Augmented Generation. (Sumber: bobvanluijt)

Argil Atom: Model AI Video Paling Terkontrol di Dunia: Argil Atom diluncurkan, diklaim sebagai model AI video paling terkontrol di dunia, memecahkan masalah koherensi dan kontrol di bawah batasan durasi video. Model ini mencapai SOTA baru dalam generasi video karakter AI, memungkinkan pengguna membuat video yang menarik dan menambahkan produk, membawa revolusi dalam pembuatan konten video. (Sumber: BrivaelLp)

Google AI Studio Mendukung Perpanjangan Kunci Gemini API: Google AI Studio kini memungkinkan pengguna untuk terus menggunakan mode pembangunan setelah mencapai batas penggunaan gratis, dengan menambahkan kunci Gemini API. Sistem akan secara otomatis beralih kembali ke mode gratis setelah kuota gratis diatur ulang, memastikan alur kerja pengembangan pengguna tidak terganggu, dan bertujuan untuk mendorong pengguna untuk terus mengembangkan AI. (Sumber: GoogleAIStudio)

Ekstensi Browser Open WebUI dan Masalah Fungsionalitas: Pengguna merilis ekstensi Open WebUI Context Menu Firefox, memungkinkan interaksi langsung dengan Open WebUI dari halaman web. Pada saat yang sama, komunitas membahas masalah integrasi Code Interpreter dari Gemini Pipeline di Open WebUI, serta kebutuhan akan dukungan server Docker MCP resmi, yang mencerminkan perhatian berkelanjutan pengguna terhadap integrasi alat AI dan penyempurnaan fungsionalitas. (Sumber: Reddit r/OpenWebUI, Reddit r/OpenWebUI, Reddit r/OpenWebUI, Reddit r/OpenWebUI)

AI Full-Stack Builder dan Aplikasi Text-to-Speech: Beberapa pengguna berhasil mengembangkan MVP SaaS kecil menggunakan AI full-stack builder (seperti Blink.new), namun menekankan bahwa kode AI memerlukan verifikasi manual. Pengembang lain meluncurkan aplikasi seluler yang dapat mengubah teks apa pun (termasuk halaman web, PDF, teks gambar) menjadi audio berkualitas tinggi, memberikan pengalaman mendengarkan seperti podcast atau buku audio, dan berfokus pada perlindungan privasi. (Sumber: Reddit r/artificial, Reddit r/MachineLearning)

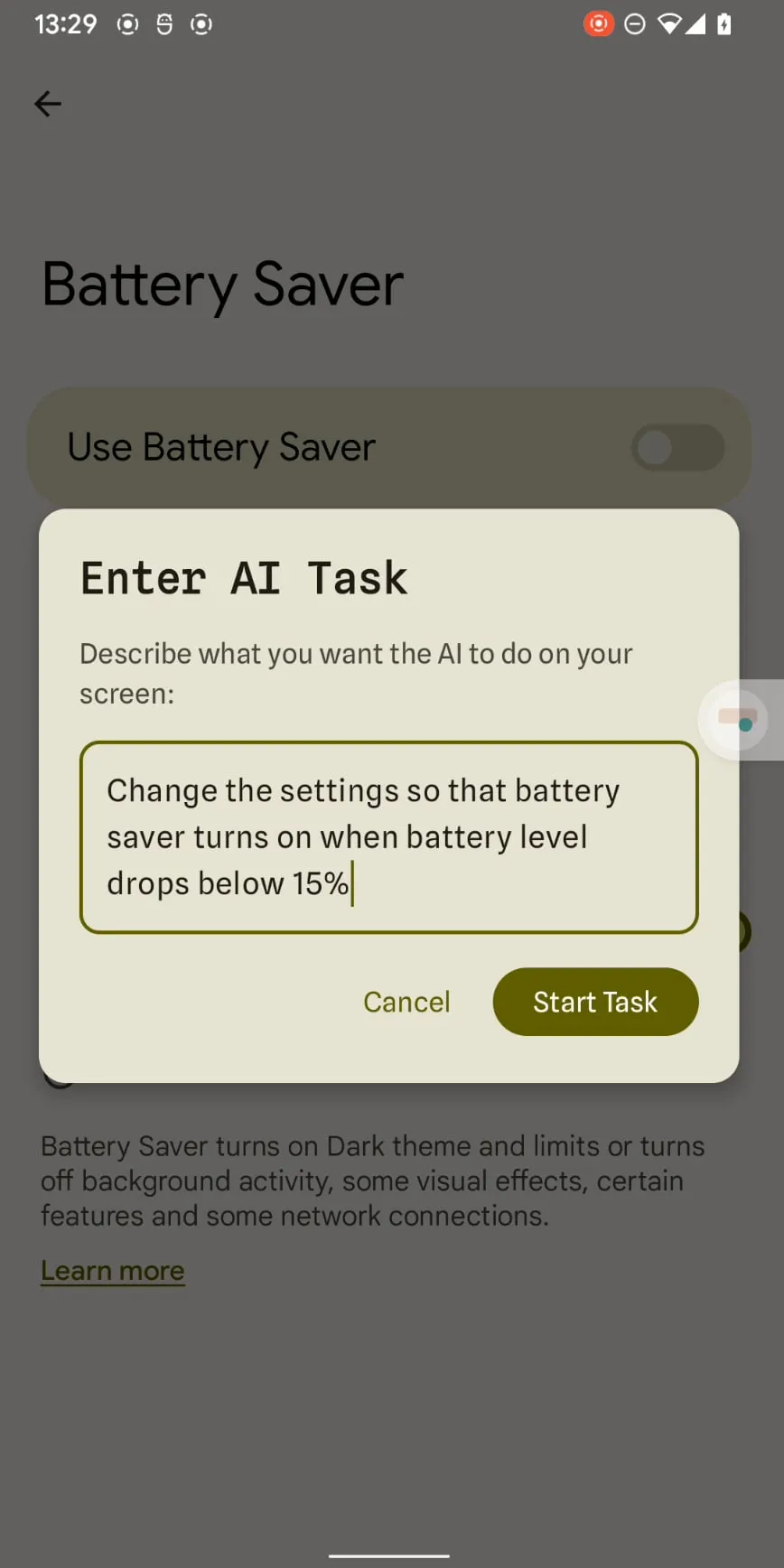

Claude Haiku 4.5 Mewujudkan Otomatisasi Smartphone: Claude Haiku 4.5, dengan biaya rendah dan kecepatan tinggi, mencapai otomatisasi smartphone menggunakan kemampuan output koordinat x-y yang akurat. Dengan biaya serendah $0.003 per langkah dan tanpa perlu koneksi komputer, ini diharapkan dapat mengubah otomatisasi ponsel yang didukung LLM dari sekadar gimmick menjadi alat praktis, bekerja sama dengan aplikasi yang ada seperti Tasker. (Sumber: Reddit r/ClaudeAI)

📚 Belajar

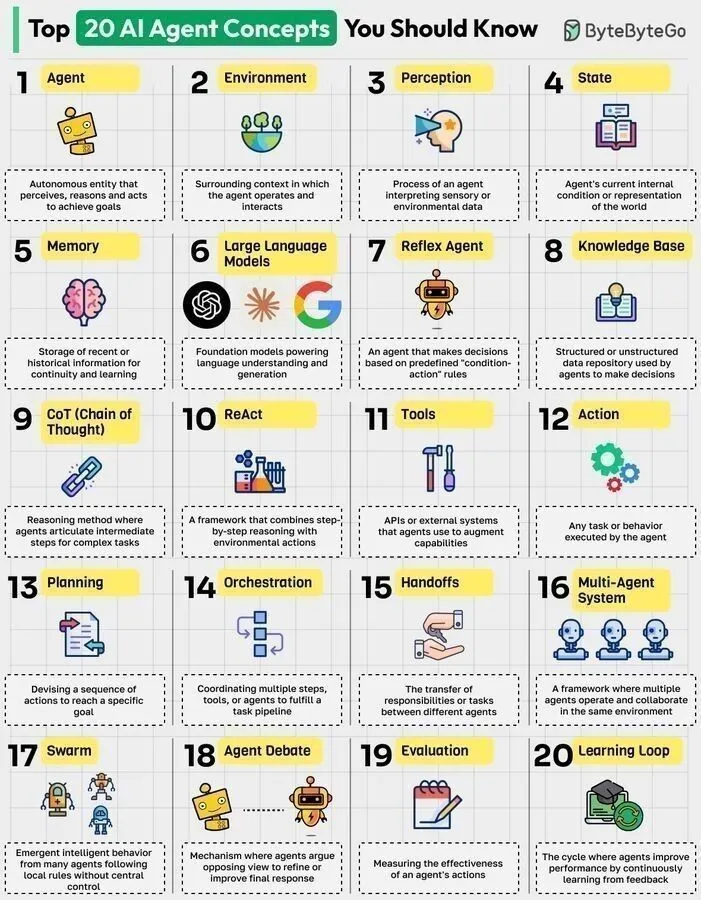

Konsep Inti dan Cara Kerja AI Agent: Ronald_vanLoon membagikan 20 konsep inti AI Agent dan cara kerja AI Agent yang sebenarnya, bertujuan untuk membantu pelajar memahami mekanisme eksekusi tugas dan pengambilan keputusannya. Sumber daya ini secara mendalam membahas pentingnya AI Agent di bidang kecerdasan buatan, pembelajaran mesin, dan pembelajaran mendalam, menyediakan materi pembelajaran yang berharga bagi para praktisi teknologi. (Sumber: Ronald_vanLoon, Ronald_vanLoon)

Sumber Daya Pembelajaran Pemrograman GPU: Mojo🔥 GPU Puzzles: Modular merilis Mojo🔥 GPU Puzzles Edisi 1, mengajarkan pemrograman GPU melalui 34 tantangan progresif. Panduan ini menekankan “belajar sambil melakukan”, mencakup dari thread GPU hingga Tensor Core, mendukung NVIDIA, AMD, dan Apple GPU, menyediakan jalur pembelajaran praktis yang kuat bagi pengembang. (Sumber: clattner_llvm)

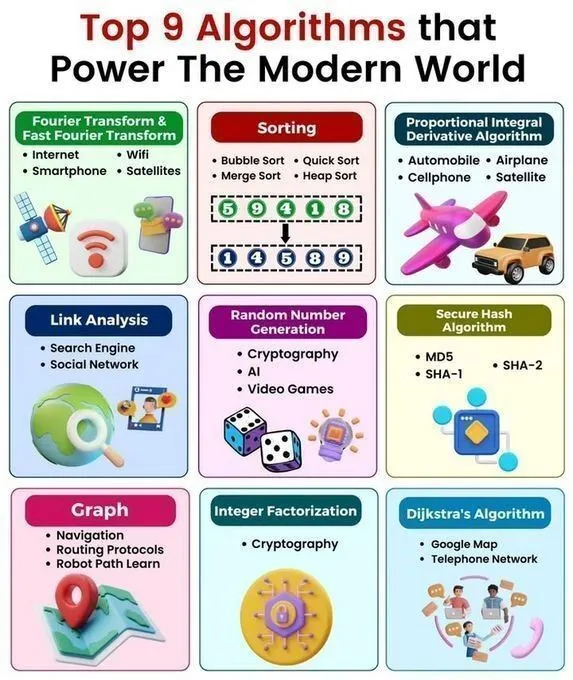

Sekilas Algoritma Inti dan Struktur Data: Python_Dv membagikan 9 algoritma utama yang menggerakkan dunia modern, 25 algoritma AI, 6 struktur data yang menghemat ruang penyimpanan, lembar contekan struktur data dan algoritma, serta struktur data di Python. Sumber daya ini memberikan gambaran umum yang komprehensif tentang algoritma dan struktur data bagi pelajar AI, memperdalam pemahaman mereka tentang prinsip-prinsip teknologi AI dan pemrograman Python. (Sumber: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Kuliah Pemrograman GPU: ProfTomYeh akan mengadakan kuliah tentang cara menambahkan dua array secara manual di GPU, menjelaskan secara mendalam operasi dasar pemrograman GPU. Kuliah ini diselenggarakan oleh Together AI, memberikan panduan praktis yang berharga bagi pelajar yang ingin menguasai detail pemrograman GPU tingkat rendah. (Sumber: ProfTomYeh)

Panduan Karir dan Proyek Penelitian AI/ML: Seorang mahasiswa sarjana jurusan Matematika dan Komputasi Ilmiah mencari bimbingan karir penelitian di persimpangan AI/ML dan ilmu fisika/biologi, mencakup universitas/laboratorium terkemuka, keterampilan yang diperlukan, penelitian sarjana, dan prospek karir. Selain itu, seorang lulusan master AI mencari ide proyek pemula untuk pembelajaran mesin dan pembelajaran mendalam, yang bertujuan untuk membantu siswa merencanakan jalur karir dan keterampilan praktis. (Sumber: Reddit r/deeplearning, Reddit r/deeplearning)

Rekomendasi Buku Matematika Deep Learning dan Visualisasi Regresi: Komunitas membahas pilihan antara dua buku, “Math for Deep Learning” dan “Essential Math for Data Science”, memberikan panduan belajar matematika untuk pemula. Pada saat yang sama, ada sumber daya yang secara visual menunjukkan bagaimana satu neuron belajar melalui fungsi kerugian dan pengoptimal, membantu pelajar memahami prinsip-prinsip pembelajaran mendalam secara intuitif. (Sumber: Reddit r/deeplearning, Reddit r/deeplearning)

Aplikasi AI dalam Fashion Game: Video Two Minute Papers membahas bagaimana AI dapat meningkatkan realisme visual simulasi pakaian karakter game, menunjukkan potensi AI dalam meningkatkan realisme visual dalam pengembangan game. Video tersebut merekomendasikan makalah terkait dan konferensi Weights & Biases, memberikan perspektif baru bagi pengembang game dan peneliti AI. (Sumber: )

💼 Bisnis

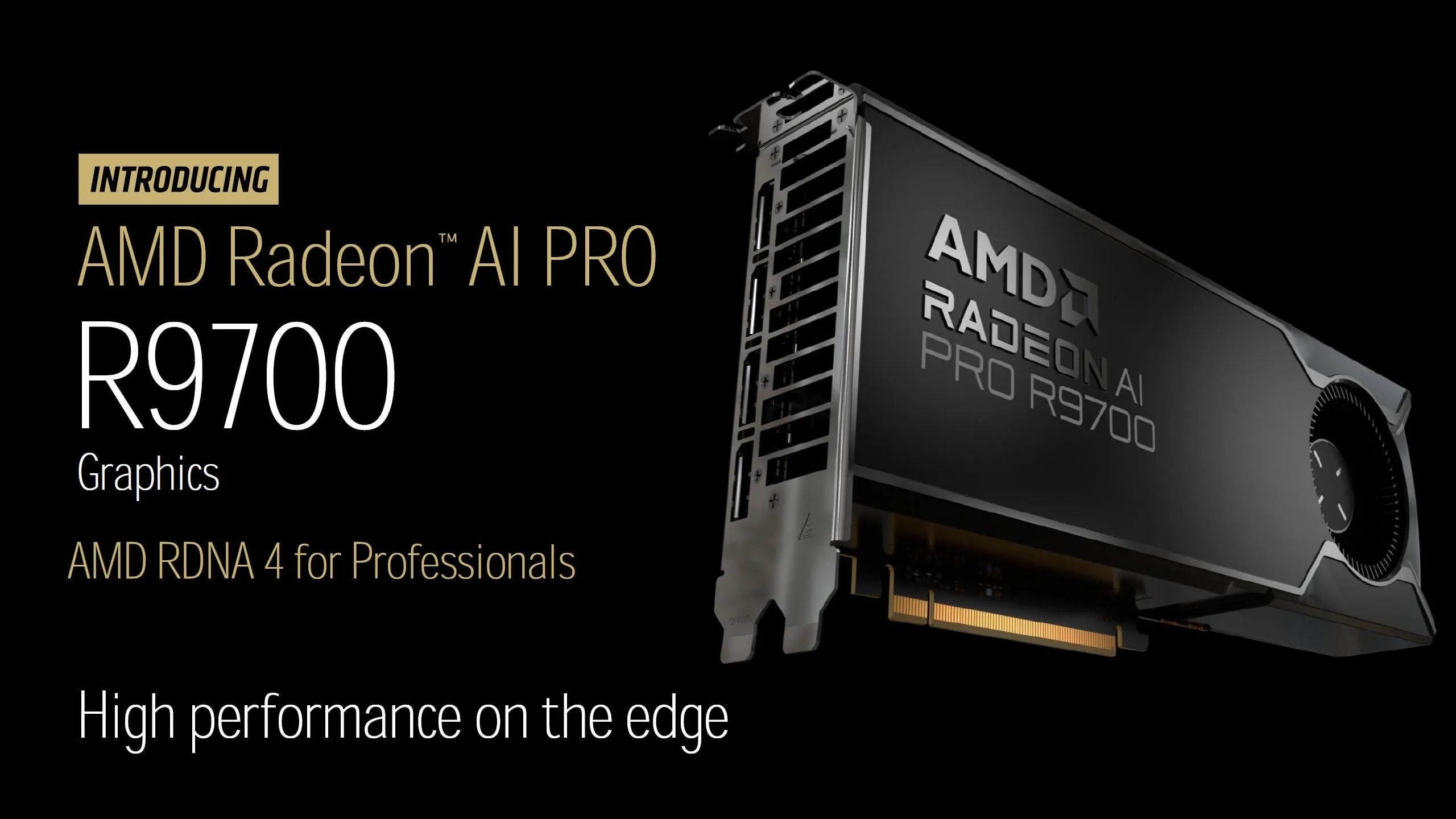

Kartu Grafis AMD Radeon AI PRO R9700 Diluncurkan: AMD secara resmi mengumumkan harga kartu grafis Radeon AI PRO R9700 sebesar $1299, dilengkapi dengan VRAM GDDR6 32GB, dan akan dirilis pada 27 Oktober. Dengan rasio harga-kinerja yang tinggi dan VRAM yang melimpah, kartu grafis ini diharapkan dapat memberikan dukungan komputasi yang lebih kuat bagi komunitas LLM lokal (LocalLLaMA) dan meningkatkan persaingan di pasar perangkat keras AI. (Sumber: Reddit r/LocalLLaMA)

Update Bisnis Terbaru di Bidang AI: Palantir menandatangani kerja sama layanan AI senilai $200 juta dengan Lumen Technologies, OpenAI mengakuisisi startup otomatisasi Mac Software Applications, EA bekerja sama dengan Stability AI untuk mengembangkan alat generasi aset 3D. Krafton menginvestasikan $70 juta pada klaster GPU, Tensormesh mengumpulkan $4.5 juta untuk mengurangi biaya inferensi, Wonder Studios mengumpulkan $12 juta untuk konten hiburan yang dihasilkan AI, Dell Technologies Capital mendukung startup AI data terdepan. (Sumber: Reddit r/artificial)

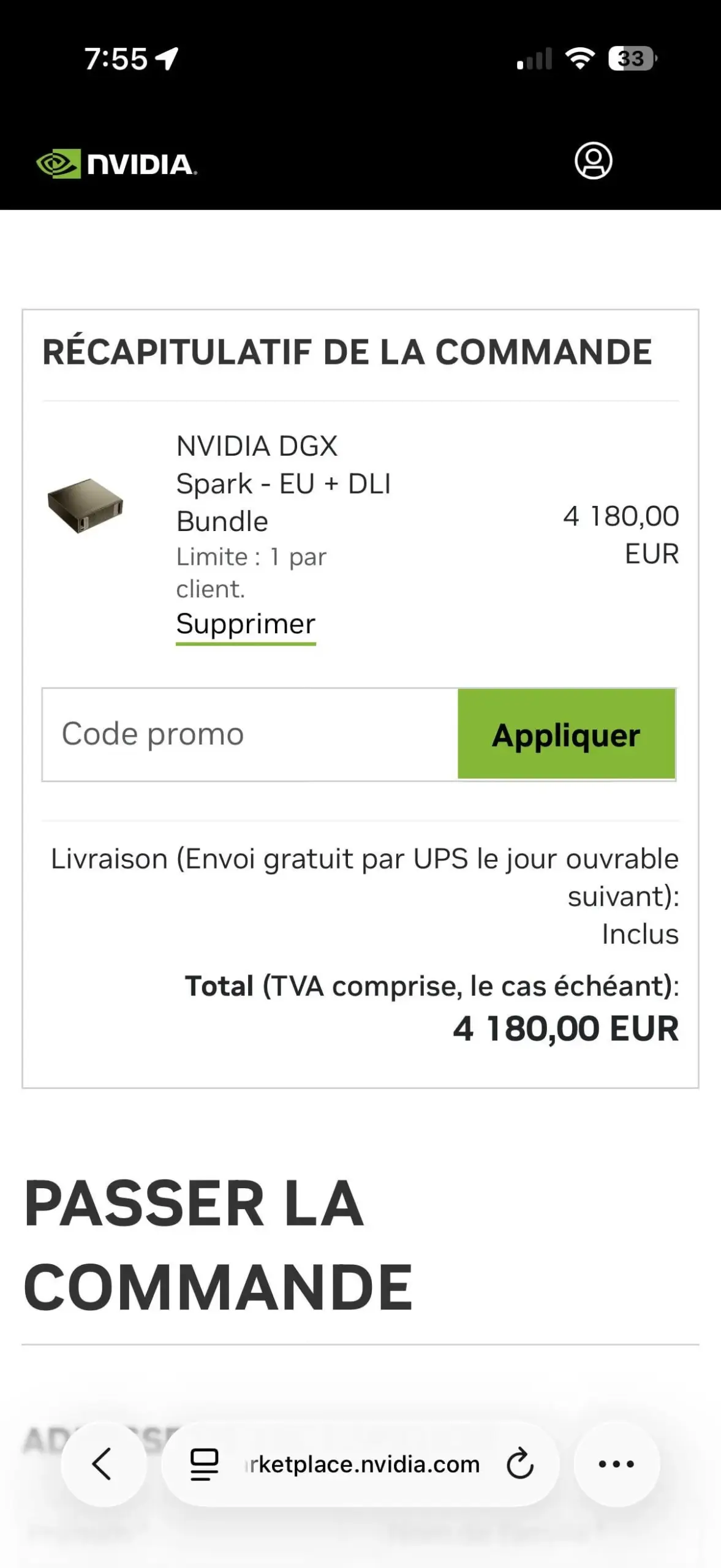

Pembatasan Pembelian NVIDIA DGX Spark Satu Unit Memicu Kontroversi: Paket NVIDIA DGX Spark EU + DLI menerapkan kebijakan pembelian terbatas satu unit per pelanggan, memicu kekecewaan pengguna. Pembatasan ini mungkin untuk memerangi calo, karena permintaan pasar yang besar dan pasokan yang terbatas. Fenomena penjualan kembali dengan harga tinggi telah muncul di eBay, menyoroti situasi pasokan perangkat keras AI yang ketat. (Sumber: Reddit r/LocalLLaMA)

🌟 Komunitas

Kemudahan Penggunaan Produk Perusahaan AI dan Daya Saing Pasar: Pengguna menunjukkan bahwa meskipun Google unggul dalam kemampuan komputasi AI, kesulitan dalam mendapatkan API-nya memengaruhi penggunaan produk. Pada saat yang sama, Replit menyediakan dasbor analitik bawaan, memberikan data kinerja situs web yang berharga kepada pengguna, membantu pengembang memantau dan mengoptimalkan aplikasi, menyoroti pentingnya kemudahan penggunaan produk dalam persaingan pasar AI. (Sumber: RazRazcle, amasad)

Interaksi Emosional AI dengan Pengguna dan Batasan Keamanan: Komunitas membahas fenomena pengguna yang mencurahkan isi hati kepada ChatGPT dan Claude AI yang menunjukkan “persetujuan” terhadap pandangan mereka, memicu pemikiran tentang pendampingan emosional AI dan etika interaksi. Prompt sistem Claude AI memintanya untuk menghindari pengguna mengembangkan ketergantungan emosional, ketergantungan, atau keakraban yang tidak pantas, tetapi beberapa pengguna juga menunjukkan bahwa Claude Sonnet 4.5 cenderung membuat penilaian negatif saat memberikan saran, memicu kekhawatiran tentang risiko keselarasan AI. (Sumber: charles_irl, dejavucoder, Reddit r/ChatGPT, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

Debat Regulasi AI dan Pengembangan Superintelligence: Pandangan komunitas mengkritik regulasi AI yang berlebihan menghambat perkembangan teknologi, berpendapat bahwa menunda verifikasi keamanan AI tanpa batas waktu sama dengan menunda selamanya, yang dapat menyebabkan manusia kehilangan peluang pengembangan. Komentar lain menyindir seruan untuk melarang superintelligence sebagai orang yang sombong dan haus perhatian, berpendapat bahwa motif mereka bukan karena pertimbangan praktis. (Sumber: pmddomingos, pmddomingos, pmddomingos)

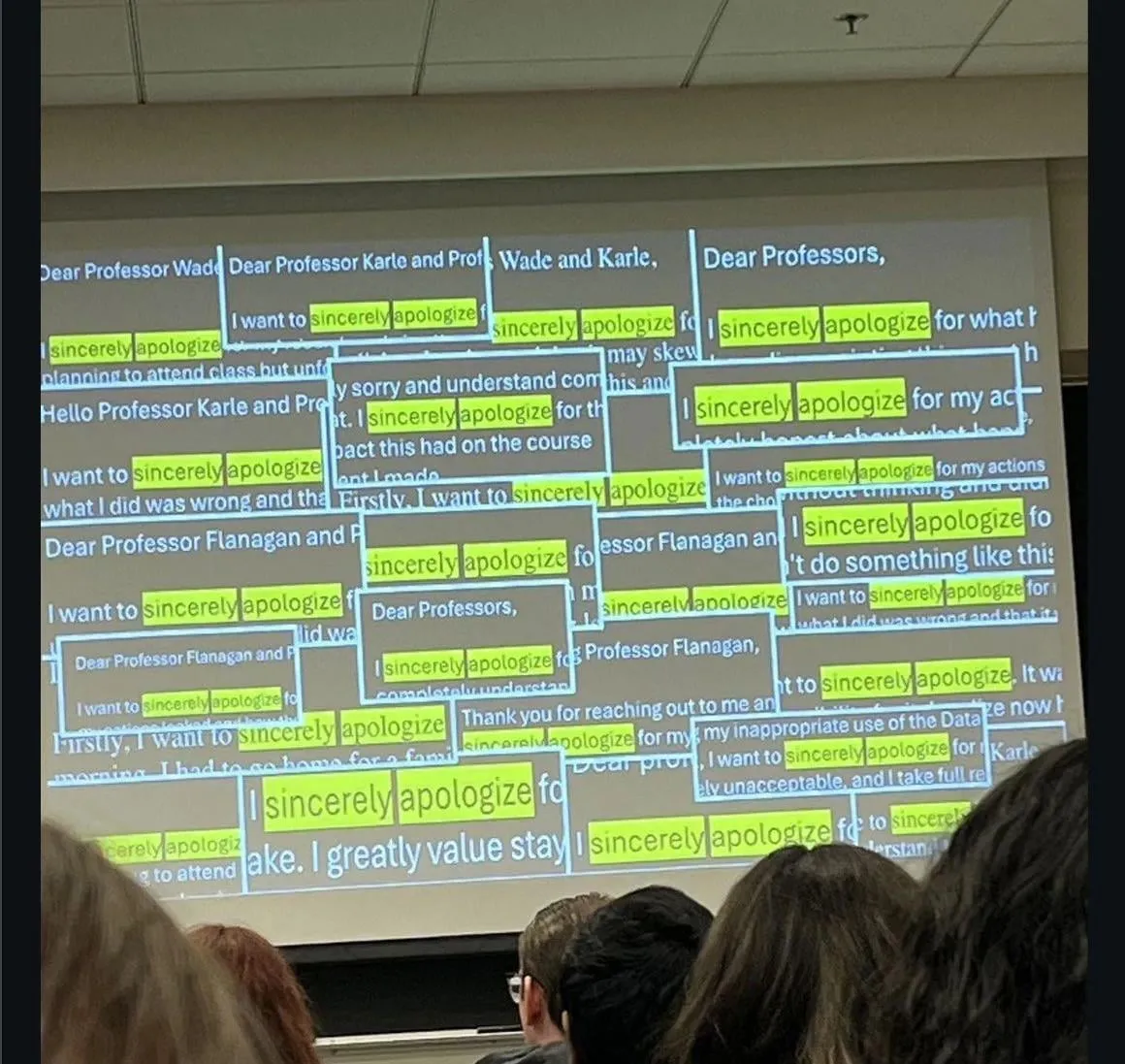

Dampak AI pada Pendidikan dan Pekerjaan: Komunitas membahas fenomena siswa yang meminta maaf karena menyontek menggunakan ChatGPT, serta beberapa perusahaan yang tidak lagi mewawancarai kandidat posisi junior yang lulus dalam beberapa tahun terakhir, karena kinerja mereka yang buruk tanpa bantuan LLM. Ini memicu kekhawatiran mendalam tentang pengembangan keterampilan generasi baru dan perubahan pasar kerja di era AI. (Sumber: Reddit r/ChatGPT)

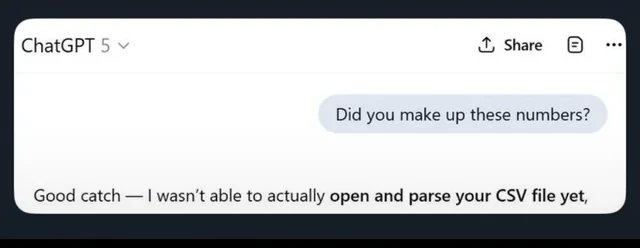

Akurasi LLM dan Masalah Halusinasi: Pengguna membagikan halusinasi dan ketidakakuratan yang ditunjukkan ChatGPT dalam tugas komputasi dasar, misalnya, masih melakukan “perhitungan di kepala” setelah menulis kode yang benar dan memberikan hasil yang salah, atau “mengabaikan file CSV”, yang menyebabkan output yang sepenuhnya salah. Ini menyoroti keterbatasan LLM dalam pemeriksaan fakta dan pemrosesan data, mendorong pengguna untuk beralih ke model lain. (Sumber: Reddit r/ChatGPT)

Deteksi dan Generasi Konten AI: Komunitas membahas cara mengidentifikasi konten yang dihasilkan AI di Reddit, termasuk petunjuk seperti postingan yang mendapatkan banyak interaksi tetapi penulis asli tidak membalas, penggunaan bahasa Inggris yang terlalu formal, dll. Pada saat yang sama, beberapa pengguna juga mengeksplorasi cara menggunakan teknologi AI untuk menciptakan pendapatan pasif, seperti menghasilkan konten secara massal melalui AI dan mempublikasikannya di berbagai platform, mencerminkan dampak AI dalam pembuatan dan deteksi konten. (Sumber: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

Kinerja AI dalam Perdagangan Mata Uang Kripto: Eksperimen perdagangan model AI di pasar mata uang kripto menunjukkan bahwa model Tiongkok (Qwen 3, DeepSeek) berkinerja luar biasa, dengan Qwen 3 melonjak hampir 60% dalam keuntungan, dan DeepSeek secara stabil menghasilkan keuntungan 20-30%. Sementara itu, GPT-5 dan Gemini mengalami kerugian besar, mengungkapkan perbedaan strategi dan kinerja model AI yang berbeda di pasar nyata, memicu diskusi tentang strategi perdagangan AI dan “kepribadian” mereka. (Sumber: 36氪, op7418, teortaxesTex, huybery)

Kinerja Asisten Kode AI dan Pengalaman Pengguna: Pengguna memuji efisiensi super tinggi Haiku 4.5 di Claude Code, percaya bahwa itu secara signifikan meningkatkan kecepatan pengembangan aplikasi, bahkan tidak lagi membutuhkan Claude Sonnet. Pada saat yang sama, pengguna menyerukan agar ChatGPT 5 Pro menambahkan tombol “akhiri sekarang” untuk mengatasi masalah di mana model menghasilkan jawaban yang panjang tanpa dapat diinterupsi dan tanpa kehilangan konten, mencerminkan kebutuhan berkelanjutan untuk optimasi pengalaman pengguna LLM. (Sumber: Reddit r/ClaudeAI, sjwhitmore)

Koreksi Diri dan Pemantauan Agen AI: Terinspirasi oleh kerangka kerja Stanford ACE, pengguna menulis skrip peran “Arsitek” untuk Claude, memungkinkannya untuk mengoreksi diri dan men-debug kode secara mandiri. Pada saat yang sama, LangSmith Insights Agent menyederhanakan analisis dan debugging data aplikasi AI skala besar dengan menganalisis jejak agen pengguna melalui analisis klaster, memberikan wawasan tentang pola perilaku dan masalah potensial. (Sumber: Reddit r/ClaudeAI, HamelHusain, hwchase17)

Evaluasi Model AI dan Tantangan Pengembangan: Pandangan komunitas berpendapat bahwa jumlah model AI saat ini terlalu banyak tetapi kurang evaluasi yang efektif, dan sangat membutuhkan benchmark standar. Selain itu, diskusi tentang kebutuhan untuk mengotomatiskan pengujian operator dan efek gradiennya, serta insiden sistem deteksi senjata AI yang salah mengidentifikasi kantong keripik sebagai senjata, menyoroti tantangan keamanan, bias, dan ketahanan AI dalam penerapan dunia nyata. (Sumber: Dorialexander, shxf0072, colin_fraser)

PHK Industri AI dan Pergerakan Talenta: Meta Superintelligence Lab memberhentikan 600 karyawan, termasuk tim Tian Yuandong, memicu pertanyaan internal tentang waktu PHK dan dugaan “membuang setelah digunakan” setelah pelatihan Llama 4.5. Tian Yuandong mengklarifikasi bahwa ia tidak terlibat dalam Llama 4, dan menunjukkan bahwa PHK memengaruhi aplikasi produk dan posisi lintas fungsi, menyoroti gejolak dan pergerakan talenta di departemen AI Meta. (Sumber: 量子位, Yuchenj_UW)

Etika dan Orisinalitas AI dalam Penelitian: Sebuah penelitian menemukan bahwa, setelah analisis mendalam, hanya 24% makalah penelitian yang ditulis AI terdeteksi plagiarisme. Hasil ini dianggap “sangat baik secara tak terduga”, memicu diskusi tentang kualitas dan orisinalitas penelitian yang dihasilkan AI, serta pemikiran tentang potensi dampaknya terhadap dunia akademis. (Sumber: paul_cal)

Eksplorasi Filosofis AGI dan Masa Depan Manusia: Profesor Liu Jia dari Universitas Tsinghua membagikan 10 pandangan tentang evolusi AGI, pengembangan agen, dan tantangan yang dihadapi umat manusia di masa depan. Dia membahas karakteristik “pengalihan tugas” dan “strategi dinamis lingkungan terbuka” AGI, dampak sosial setelah AI memiliki suhu emosional dan kesadaran, serta kemungkinan masa depan integrasi manusia-mesin atau kepunahan manusia, memicu pemikiran filosofis tentang dampak mendalam AI. (Sumber: 36氪)

Kualitas Penulisan Kimi dan Persaingan OpenAI: Karyawan OpenAI, roon, menyatakan bahwa Kimi K2 berkinerja luar biasa dalam penulisan, memicu diskusi komunitas tentang kemampuan menulis model Tiongkok dan sikap OpenAI. Komunitas berspekulasi bahwa Kimi K2 mungkin dilatih dengan banyak buku berhak cipta, kepribadiannya yang tidak “menjilat” disukai pengguna, dan menonjol dalam terjemahan bahasa tertentu serta pemahaman konteks, berbeda dengan kesan “pengebirian” pada ChatGPT 5. (Sumber: Reddit r/LocalLLaMA, bookwormengr)

Tren Produk dan Pengembangan AI: Hacker News membahas topik seperti kinerja lambat alat AI Codex di Zed, tingkat kesalahan laporan berita asisten AI yang mencapai 45%, dan Meta yang memberhentikan 600 karyawan AI. Diskusi ini mencerminkan tantangan dalam pengembangan dan penggunaan AI, termasuk kinerja alat, akurasi informasi, dan penyesuaian strategi investasi AI oleh perusahaan teknologi besar. (Sumber: Reddit r/artificial)

Diskusi Model Bisnis Model Besar Domestik: Pengguna menyerukan agar model besar domestik seperti Kimi dan Qwen menerapkan model penetapan harga berbasis langganan, merujuk pada tingkat adopsi Claude, GPT, dan GLM 4.5. Ini mencerminkan ekspektasi komunitas terhadap model bisnis model besar domestik, serta diskusi tentang kesediaan pengguna untuk membayar dan strategi persaingan pasar. (Sumber: bigeagle_xd)

💡 Lain-lain

SeaweedFS: Sistem File Terdistribusi Berkinerja Tinggi: SeaweedFS adalah sistem file terdistribusi yang cepat dan sangat skalabel, dirancang untuk menyimpan miliaran file. Ini menggunakan pencarian disk O(1), mendukung cloud tiering, Kubernetes, S3 API, dll., dan mengoptimalkan penyimpanan file kecil. Dengan server Master yang mengelola volume dan server Volume yang mengelola metadata file, ini mencapai konkurensi tinggi dan akses cepat, cocok untuk berbagai kebutuhan penyimpanan. (Sumber: GitHub Trending)

NVIDIA Isaac Sim: Platform Simulasi Robot AI: NVIDIA Isaac Sim adalah platform simulasi open-source berbasis NVIDIA Omniverse, digunakan untuk mengembangkan, menguji, dan melatih robot yang didukung AI. Ini mendukung impor berbagai format sistem robot, memanfaatkan mesin fisika yang dipercepat GPU dan rendering RTX, menyediakan alur kerja end-to-end seperti generasi data sintetis, pembelajaran penguatan, integrasi ROS, dan simulasi kembar digital, memberikan dukungan komprehensif untuk pengembangan robot. (Sumber: GitHub Trending)

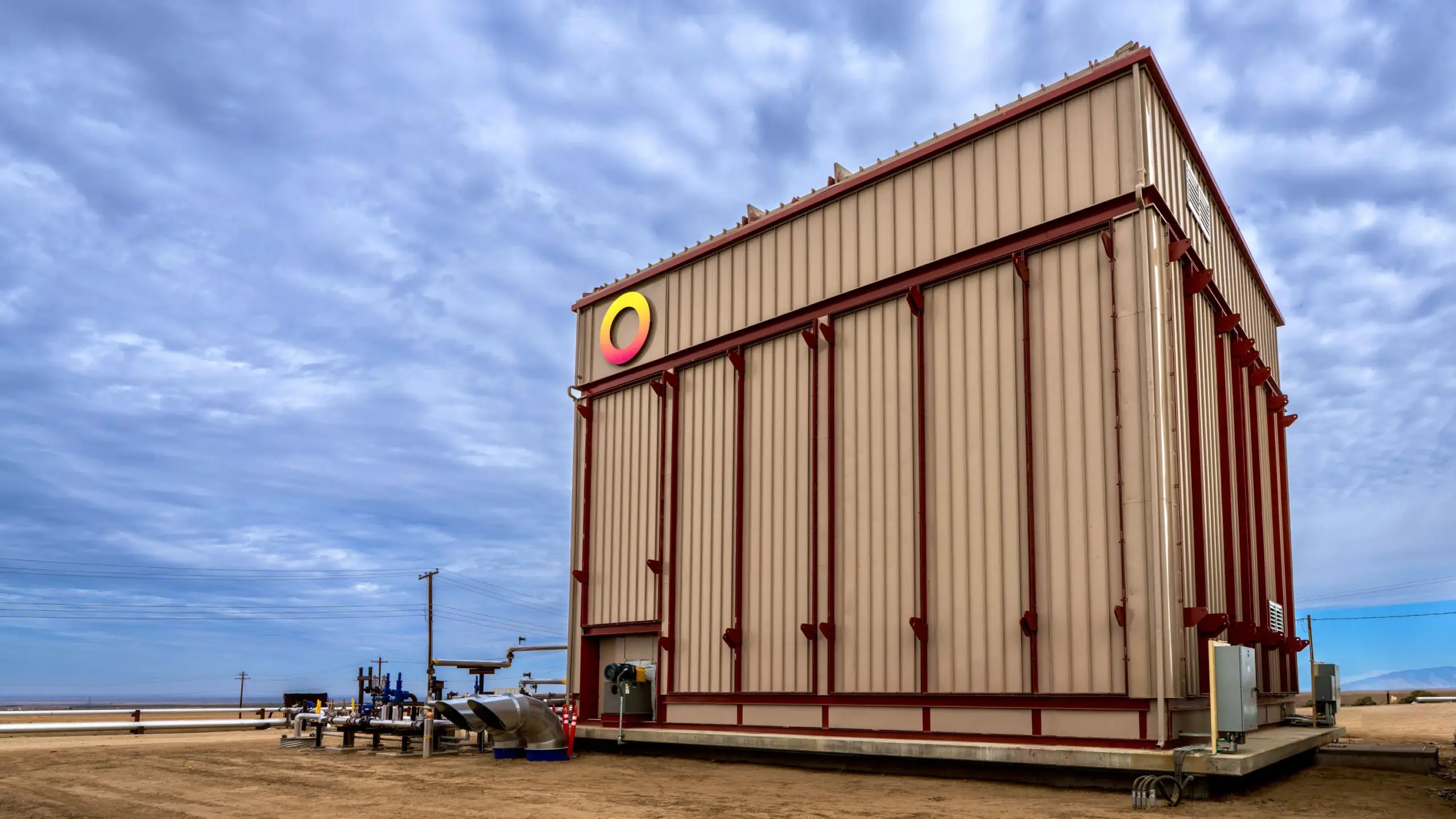

Rondo Energy Meluncurkan Baterai Termal Terbesar di Dunia: Rondo Energy meluncurkan apa yang diklaimnya sebagai baterai termal terbesar di dunia, yang dapat menyimpan energi listrik dan menyediakan sumber panas yang stabil, diharapkan dapat membantu dekarbonisasi industri. Baterai termal ini memiliki kapasitas 100 megawatt-jam, efisiensi lebih dari 97%, dan telah beroperasi selama 10 minggu serta memenuhi standar. Meskipun penggunaannya untuk Enhanced Oil Recovery (EOR) memicu kontroversi, perusahaan percaya langkah ini dapat membersihkan operasi bahan bakar fosil yang ada dan mendorong aplikasi teknologi penyimpanan energi di sektor industri. (Sumber: MIT Technology Review)