Mots-clés:NVIDIA Nemotron Nano 2, Claude Opus 4.1, Concurrence des salaires pour les talents en IA, Numérisation linguistique par l’IA de Google, Gestion de la santé par IA, Programmation assistée par IA, Impact de l’IA sur l’emploi, Applications d’IA pour la parentalité, Architecture hybride Mamba-Transformer, Évaluation du modèle LMArena, Données vocales du projet Vaani, Laboratoire de cuisine futuriste numérisée, Réécriture de Codex CLI en Rust

🔥 Focus

Lancement de NVIDIA Nemotron Nano 2 : NVIDIA a lancé la série de modèles d’IA Nemotron Nano 2, dont l’architecture hybride Mamba-Transformer de 9 milliards de paramètres maintient une haute précision tout en offrant un débit d’inférence 6 fois plus rapide que les modèles de taille similaire. Ce modèle prend en charge une longueur de contexte de 128K et rend la plupart de ses données de pré-entraînement accessibles, incluant des données de haute qualité provenant de pages web, de mathématiques, de code et de questions-réponses multilingues. Cette initiative vise à fournir des solutions d’IA efficaces et évolutives, à réduire les barrières de déploiement pour les entreprises et à promouvoir le développement de l’écosystème open source de l’IA. (Source: Reddit r/LocalLLaMA)

Claude Opus 4.1 en tête du classement LMArena : Claude Opus 4.1 a surpassé d’autres modèles dans les catégories Standard, Thinking et Web Development de LMArena, se hissant au sommet du classement. Les utilisateurs signalent des améliorations dans ses approches micro/macro, notamment dans son mode de décision “réfléchir un instant, peut-être que XYZ est mieux”. Bien que certains utilisateurs le trouvent coûteux ou peu performant dans certaines situations, sa capacité à gérer la programmation et les tâches complexes est largement reconnue, démontrant les progrès continus d’Anthropic en matière de performance des modèles. (Source: Reddit r/ClaudeAI)

L’avis de Lisa Su, PDG d’AMD, sur la guerre des salaires pour les talents en IA : Lisa Su, PDG d’AMD, a déclaré publiquement qu’elle s’opposait aux pratiques de Meta et d’autres entreprises qui proposent des salaires annuels de centaines de millions de dollars pour débaucher des talents en IA. Elle estime qu’une rémunération compétitive est fondamentale, mais que la clé pour attirer les meilleurs talents réside dans la mission de l’entreprise et la capacité des employés à sentir leur impact réel sur l’entreprise, plutôt que d’être de simples rouages dans une machine. Elle a souligné qu’une rémunération excessivement élevée peut nuire à la culture d’entreprise et a noté que le succès d’AMD est le fruit d’un effort d’équipe, et non de la dépendance à quelques employés stars. (Source: 量子位)

Google AI numérise 2300 langues asiatiques : Google s’efforce de résoudre le problème des langues asiatiques “silencieuses” dans le monde numérique grâce à plusieurs projets d’IA. Project Vaani, en collaboration avec l’Institut indien des sciences, a collecté près de 21 500 heures de données vocales, couvrant 86 variantes de langues indiennes, et les a rendues accessibles gratuitement. Project SEALD, en partenariat avec AI Singapore, construit la base de données Aquarium pour 1200 langues d’Asie du Sud-Est. De plus, le système de traduction IA de Google, CHAD 2 (alimenté par Gemini 2.0 Flash), a aidé Yoshimoto Kogyo au Japon à atteindre une précision de traduction de 90% pour le contenu comique, réduisant le temps de traduction de plusieurs mois à quelques minutes. (Source: 量子位)

🎯 Tendances

Applications innovantes de l’IA dans le domaine de la santé : Yunpeng Technology, en collaboration avec Shuaikang et Skyworth, a lancé le “Laboratoire de cuisine intelligente du futur” et des réfrigérateurs intelligents équipés de grands modèles d’IA pour la santé. Le grand modèle d’IA pour la santé optimise la conception et le fonctionnement de la cuisine, tandis que le réfrigérateur intelligent offre une gestion personnalisée de la santé, marquant une percée de l’IA dans la gestion quotidienne de la santé. Ce lancement démontre le potentiel de l’IA dans la gestion quotidienne de la santé, en permettant des services de santé personnalisés via des appareils intelligents, ce qui devrait stimuler le développement des technologies de santé à domicile et améliorer la qualité de vie des résidents. (Source: 36氪)

L’IA : disruption et opportunités pour les industries traditionnelles : Duolingo a vu ses revenus augmenter grâce à l’adoption de l’IA, mais la capacité de modèles comme GPT-5 à générer directement des outils d’apprentissage des langues a eu un impact sur le cours de son action, soulignant le potentiel disruptif de l’IA sur les modèles commerciaux existants. Parallèlement, Goldman Sachs estime que l’IA sera un multiplicateur de force pour l’industrie du logiciel, et non un perturbateur, et que les géants traditionnels du SaaS pourront maintenir leur compétitivité grâce à des stratégies d’IA hybrides et à de solides avantages concurrentiels. Cela montre que l’IA est à la fois un défi et une opportunité pour transformer les industries et créer de nouvelles valeurs. (Source: 36氪, 36氪)

Dynamique du marché des talents en IA et développement de carrière : Igor Babuschkin, co-fondateur de xAI, a quitté l’entreprise pour créer une société de capital-risque axée sur la recherche en sécurité de l’IA, visant à trouver le “prochain Elon Musk”; Kevin Lu, chef d’équipe chinois de OpenAI GPT-4o mini, a rejoint le Thinking Machine Lab de Mira Murati, soulignant l’importance des données internet pour le progrès de l’IA. La demande de postes en IA est forte dans l’industrie, mais les PME peinent à recruter, les meilleurs talents sont très recherchés, les jeunes diplômés ordinaires sont confrontés à une concurrence intense (“neijuan”), et la valeur des doctorats en IA est remise en question, ce qui met en évidence les contradictions structurelles de l’offre et de la demande de talents en IA et les défis de la reconversion professionnelle. (Source: 36氪, 36氪, 36氪, 36氪, 36氪)

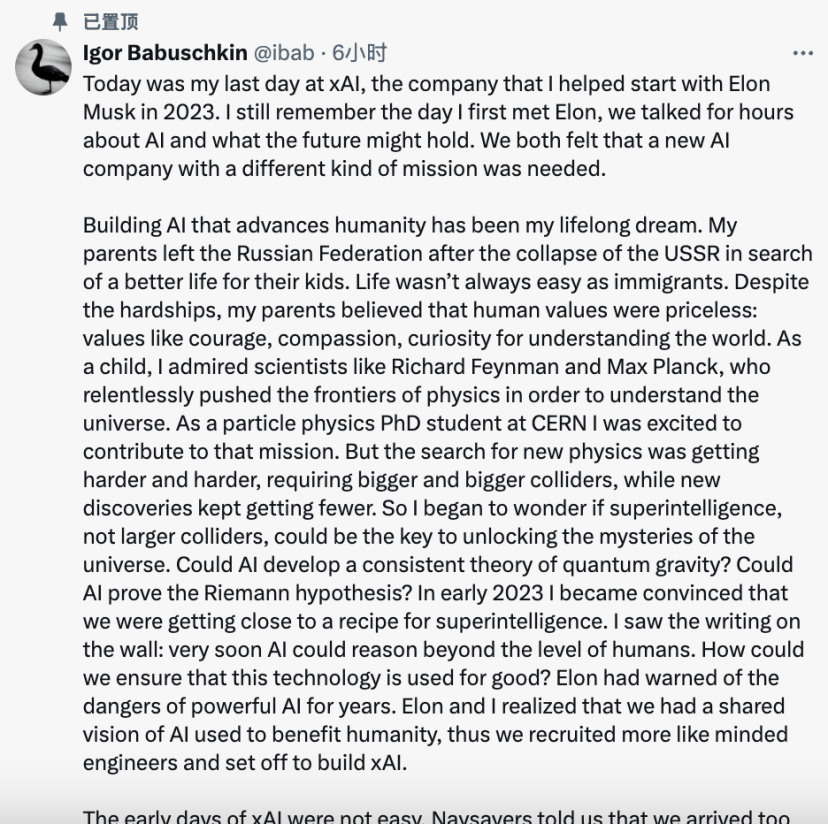

Investissement dans l’IA et construction d’infrastructures : Les rapports financiers de Google et Meta montrent que les doutes du marché concernant les investissements en capital dans l’IA se sont transformés en enthousiasme, l’IA stimulant de manière significative la croissance des revenus de la publicité en ligne et des services cloud. Google a fortement relevé ses prévisions de dépenses en capital à 85 milliards de dollars, principalement pour les serveurs et les centres de données. Le projet de supercalculateur Tesla Dojo, sur lequel Elon Musk avait fondé de grands espoirs, a été dissous, l’entreprise ayant plutôt dépensé des sommes considérables pour acheter des puces IA de NVIDIA, confirmant qu’à l’ère de l’IA, l’intégration verticale est confrontée aux défis de l’écosystème des plateformes, et que la collaboration avec les géants de la chaîne d’approvisionnement est plus pragmatique. (Source: 36氪, 36氪)

Accélération de la commercialisation de l’IA incarnée et de la robotique : Li Tong, PDG de Keenon Robotics, a souligné que la commercialisation des robots doit s’attaquer aux problèmes clés des clients et permettre un remplacement “par poste”, ses robots commerciaux ayant déjà vendu plus de 100 000 unités. Yufan Intelligent, une entreprise d’IA visuelle avec 11 ans d’expérience, a lancé le grand modèle de cognition spatiale Manas et un robot-chien quadrupède, adoptant pleinement l’IA incarnée et mettant l’accent sur la recherche et le développement complets “intelligence + hardware”. De grands acteurs comme JD.com, Meituan et Alibaba ont intensifié leurs investissements dans le secteur de la robotique, couvrant les capteurs, les mains agiles, les robots humanoïdes, etc., dans le but de remodeler l’efficacité de l’exécution et l’expérience utilisateur, et de promouvoir l’entrée des robots dans davantage de scénarios de consommation. (Source: 36氪, 36氪, 36氪)

Nouvelles tendances de l’IA dans la création de contenu et l’expérience utilisateur : Des membres de l’équipe fondatrice de Douyin ont lancé la plateforme “Shumei Wanwu”, utilisant des outils d’IA pour réduire les barrières à la conception créative et à la monétisation des produits, en reliant la création d’IA à la chaîne de production physique. Meitu Inc. recherche la croissance grâce à son produit AI Agent RoboNeo, avec une augmentation de la part des revenus de ses produits d’imagerie et de conception, et une croissance significative de ses utilisateurs à l’étranger. Le jouet tendance “AI Labubu” est devenu populaire, combinant l’apparence d’un jouet tendance et la capacité de conversation IA pour offrir une valeur émotionnelle. Ces exemples montrent que l’IA se développe rapidement dans les applications grand public telles que la génération de contenu, la monétisation créative et l’accompagnement émotionnel. (Source: 36氪, 36氪, 36氪)

Impact profond de l’IA sur le marché du travail : Une étude de Microsoft basée sur les données de Copilot indique que l’IA peut prendre en charge des tâches de recherche, d’écriture et de communication, mais ne peut pas remplacer entièrement toutes les tâches d’une seule profession. Les professions liées à la langue et à la création de contenu, telles que les journalistes et les traducteurs, sont les plus touchées par l’IA, mais l’IA pourrait également améliorer l’efficacité plutôt que de remplacer directement les postes, à l’instar de l’impact des distributeurs automatiques de billets sur les guichetiers de banque. Les assistants IA sont comme des “stagiaires bavards”, très explicatifs mais manquant de capacité à résoudre les problèmes de manière proactive. (Source: 36氪)

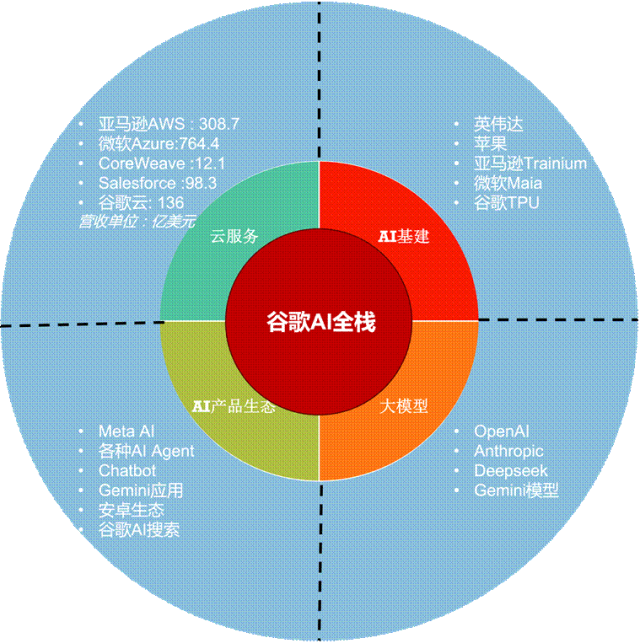

Potentiel commercial de l’IA dans le domaine de la parentalité : L’IA entre discrètement dans le domaine de la surveillance du sommeil des bébés, avec des applications comme Huckleberry qui analysent les journaux de soins des nourrissons pour prédire avec précision les rythmes de sommeil, offrant un sentiment de contrôle “prévisible” et générant des millions de dollars de revenus mensuels. Ces produits, combinant des fonctionnalités de nounou IA, répondent aux besoins des parents en matière d’enregistrement efficace et de valeur émotionnelle, devenant des “terrains aurifères” pour les services logiciels à bas prix et le matériel IA coûteux. (Source: 36氪)

🧰 Outils

Outils de programmation et de développement assistés par l’IA : La nouvelle version de Codex CLI d’OpenAI, réécrite en Rust et intégrant GPT-5, offre une vitesse d’interaction plus rapide et de puissantes capacités de codage, devenant un concurrent sérieux de Claude Code. LangChain a publié la version JavaScript de Deep Agents, prenant en charge la construction de systèmes multi-agents. Replit Agent explore le support du développement de Python Notebook et du moteur de jeu Godot. La version VS Code Insiders prend en charge les points de terminaison compatibles OpenAI et intègre Playwright pour les tests d’automatisation de l’interface utilisateur. (Source: doodlestein, hwchase17, amasad, pierceboggan)

Applications de l’IA en bureautique et création de contenu : Paradigm a lancé une feuille de calcul native IA, visant à éliminer les tâches répétitives. Huxe a ajouté des fonctionnalités IA pour analyser les e-mails d’actualités non lus. L’API Gemini prend désormais en charge l’outil de contexte URL, permettant de récupérer et de traiter directement le contenu des pages web, des PDF et des images. Des outils d’IA comme Aleph et RunwayML révolutionnent la manipulation vidéo, permettant d’éditer le contenu vidéo comme du texte. RoboNeo de Meitu, la commercialisation d’images de Shanhaijing générées par IA, et les systèmes d’aide à la création de romans par IA, montrent le potentiel de l’IA dans la génération créative et la monétisation de contenu. (Source: hwchase17, raizamrtn, jeremyphoward, c_valenzuelab, Reddit r/artificial)

Outils d’évaluation et de performance des LLM : Claude Opus 4.1 excelle dans les domaines du codage et du développement web sur LMArena. Datology AI a introduit la méthode de données synthétiques BeyondWeb, soulignant l’importance des données synthétiques de haute qualité dans le pré-entraînement des modèles, ce qui peut améliorer les performances des petits modèles. Le modèle NVIDIA Nemotron Nano 2 utilise une architecture hybride Mamba-Transformer, offrant d’excellentes performances dans les tâches de mathématiques, de code, d’inférence et de contexte long, et prend en charge le contrôle du budget d’inférence. (Source: scaling01, code_star, ctnzr)

Agents IA et automatisation : L’agent NEO AI4AI a obtenu des résultats SOTA sur MLE Bench, capable d’effectuer de manière autonome des tâches d’ingénierie ML telles que le prétraitement des données, l’ingénierie des fonctionnalités, l’expérimentation et l’évaluation des modèles. Deep Agents de LangChain est implémenté en JavaScript, prenant en charge la résolution de problèmes complexes et l’appel d’outils. Reka Research propose des services de recherche approfondie basés sur l’IA, capables de synthétiser des réponses à partir de multiples sources d’information. (Source: Reddit r/MachineLearning, hwchase17, RekaAILabs)

Modèles d’édition d’images et de vidéos par IA : Qwen-Image-Edit a été lancé, basé sur Qwen-Image 20B, prenant en charge l’édition de texte précise bilingue (chinois-anglais), l’édition sémantique avancée et l’édition d’apparence de bas niveau, et peut être utilisé pour la création de dessins animés. Higgsfield AI propose Hailuo MiniMax 02 pour le Draw-to-Video, prenant en charge la génération de haute qualité en 1080p. (Source: teortaxesTex, _akhaliq)

API LLM et gestion des coûts : Claude a lancé l’API Usage and Cost, offrant une visibilité quasi en temps réel sur l’utilisation du modèle et les coûts, aidant les développeurs à optimiser l’efficacité des tokens et à éviter les limitations de débit. OpenRouter affiche les prix du marché des LLM et les prix mis en cache sur sa page de modèles. (Source: Reddit r/ClaudeAI, xanderatallah)

📚 Apprentissage

Ressources et méthodes d’apprentissage de l’IA : Andrew Ng souligne que les universités devraient embrasser pleinement l’IA, non seulement en l’enseignant, mais aussi en l’utilisant pour faire progresser toutes les disciplines. DeepLearning.AI a publié le nouvel e-book d’Andrew Ng, offrant une feuille de route pour les carrières en IA. GPU_MODE et ScaleML organiseront une série de conférences estivales, partageant les progrès algorithmiques et systémiques de gpt-oss. La communauté Reddit a discuté de livres d’introduction au deep learning, du déploiement de modèles FastAPI, de l’implémentation de CoCoOp+CLIP, et de la manière d’optimiser les cycles d’entraînement des modèles (par exemple, choisir le nombre optimal d’epochs). (Source: AndrewYNg, DeepLearningAI, lateinteraction, Reddit r/deeplearning, Reddit r/deeplearning)

Développement des talents en IA et parcours professionnels : La communauté Reddit a discuté de la question de savoir si les ingénieurs en IA doivent être des mathématiciens, et comment entrer dans le domaine du deep learning par l’auto-apprentissage ou un master. Parallèlement, certains estiment qu’à l’ère de l’IA, l’accent est davantage mis sur l’« ingénierie de contexte » plutôt que sur l’« ingénierie d’invite », nécessitant une compréhension plus complète de la construction d’applications LLM. (Source: Reddit r/deeplearning, Reddit r/MachineLearning)

Données d’entraînement LLM et optimisation des modèles : Reddit a discuté de la manière d’identifier et de corriger les erreurs factuelles dans les données d’entraînement des LLM, ainsi que des meilleures pratiques actuelles en matière de validation et de correction des données. Les progrès de DeepSeek R2 ont suscité l’attention, soulevant la question de savoir si le pré-entraînement a atteint un plafond, et l’importance de la représentation unifiée multimodale pour les modèles du monde. (Source: Reddit r/deeplearning, 36氪)

Progrès de la recherche en IA et exploration de nouvelles architectures : La Simons Foundation et Stanford HAI collaborent pour explorer la physique de l’apprentissage et du calcul neuronal, dans le but de comprendre l’apprentissage, le raisonnement et l’imagination des grands réseaux neuronaux. AIhub a publié la liste des séminaires ML/AI d’août. Reddit a discuté de la valeur des petits modèles (SLM) et de l’IA locale, remettant en question si la poursuite excessive de la taille des modèles étoufferait l’innovation en IA, et suggérant que l’architecture Transformer n’est pas la seule voie, et que d’autres architectures efficaces devraient être explorées. (Source: ylecun, aihub.org, Reddit r/MachineLearning)

Développement et déploiement de noyaux CUDA : Hugging Face a publié la bibliothèque kernel-builder, simplifiant le développement local, la construction multi-architecture et le partage mondial des noyaux CUDA, en permettant leur enregistrement en tant qu’opérateurs natifs PyTorch et leur compatibilité avec torch.compile, améliorant ainsi les performances et la maintenabilité. (Source: HuggingFace Blog)

Modèles multimodaux et recherche sur les modèles du monde : Hugging Face Daily Papers a publié plusieurs recherches de pointe, notamment : 4DNeX (le premier cadre d’apprentissage direct pour la génération de scènes 4D à partir d’une seule image), Inverse-LLaVA (éliminant le pré-entraînement d’alignement via le mappage texte-vers-vision), ComoRAG (RAG organisé par mémoire heuristique cognitive pour le raisonnement narratif long), ainsi qu’une revue sur les architectures LLM efficaces et Matrix-Game 2.0 (un modèle de monde interactif en streaming en temps réel). (Source: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

Modèle de fondation visuelle DINOv3 : DINOv3 de Meta AI, en tant que modèle de fondation visuelle de nouvelle génération, entraîné par apprentissage purement auto-supervisé, a été étendu avec succès à 7 milliards de paramètres et a surpassé les bases de référence faiblement supervisées et supervisées dans des tâches telles que la segmentation, l’estimation de profondeur et la correspondance de points clés 3D. Sa technique de Gram Anchoring a résolu les problèmes de qualité des caractéristiques denses lors de l’entraînement à long terme et peut être appliquée à des domaines spécialisés comme l’imagerie satellite. (Source: LearnOpenCV)

💼 Affaires

OpenAI lance le plan d’abonnement ChatGPT Go en Inde : OpenAI a lancé en Inde un nouveau niveau d’abonnement à faible coût, “ChatGPT Go”, pour 399 roupies par mois (environ 4,7 dollars américains). Ce plan offre une limite de messages 10 fois supérieure, la génération d’images et le téléchargement de fichiers, ainsi qu’une longueur de mémoire 2 fois plus longue que la version gratuite, et prend en charge les paiements UPI. Cette initiative vise à élargir la base d’utilisateurs sur le marché indien et à répondre à la demande locale de services d’IA plus économiques et efficaces. (Source: openai, kevinweil, snsf)

L’IA accélère la transformation des entreprises et impacte le marché du travail : Un PDG a licencié 80% de ses employés parce qu’ils refusaient d’adopter rapidement l’IA, suscitant un débat sur l’adaptabilité des employés lors de la transformation par l’IA. Parallèlement, l’émergence de postes bien rémunérés liés à l’IA (tels que MLOps engineer, AI research scientist) montre que l’IA est en train de remodeler le domaine traditionnel de la science des données. Bien que l’IA puisse améliorer la productivité, les entreprises doivent construire une valeur réelle autour de l’IA, plutôt que de se fier uniquement à la technologie elle-même. (Source: Reddit r/artificial, Reddit r/deeplearning, Reddit r/artificial)

Valorisation des entreprises d’IA et paysage concurrentiel : Les revenus annualisés d’OpenAI ont dépassé 12 milliards de dollars, avec une valorisation de 500 milliards de dollars, tandis qu’Anthropic a des revenus annualisés de 4 milliards de dollars et une valorisation de 170 milliards de dollars, ce qui indique une flambée continue des valorisations des entreprises de modèles de fondation d’IA. Google pourrait vendre des TPU à des tiers en 2027, défiant la position dominante de NVIDIA sur le marché des puces IA. Parallèlement, la startup d’IA Lovable a dépassé les 100 millions de dollars d’ARR en 8 mois, prouvant l’énorme potentiel du marché des constructeurs de sites web et d’applications basés sur l’IA. (Source: yoheinakajima, Justin_Halford_, 36氪)

🌟 Communauté

Données synthétiques et avenir du pré-entraînement : La méthode BeyondWeb de Datology AI a été largement discutée, soulignant que les données de pré-entraînement sont confrontées à un “mur de données”, et que des données synthétiques de haute qualité peuvent améliorer efficacement les performances des petits modèles, voire surpasser celles des grands modèles. La communauté a vivement débattu de la question de savoir si les données synthétiques entraîneraient une “détérioration” ou une “suralimentation” des modèles, mais il est généralement admis que des données synthétiques bien conçues sont essentielles pour surmonter le goulot d’étranglement des données. (Source: code_star, sarahookr, BlackHC, Reddit r/MachineLearning)

Performance des modèles d’IA et expérience utilisateur : Claude Opus 4.1 a atteint le sommet de plusieurs classements LMArena, excellant notamment en codage et en développement web. Cependant, le lancement de GPT-5 a suscité des appels d’utilisateurs pour “rendre GPT-4o”, en raison de son style d’interaction “froid”, soulignant le besoin des utilisateurs en matière d’émotion et d’empathie de l’IA. Parallèlement, certains estiment que la poursuite excessive de la taille des modèles d’IA pourrait étouffer l’innovation, et que les petits modèles et l’IA locale ont un énorme potentiel de développement. (Source: scaling01, Reddit r/ClaudeAI, Reddit r/ClaudeAI, Reddit r/MachineLearning)

Débat sur l’IA, l’emploi et les carrières : Les médias sociaux ont été le théâtre de vifs débats sur la question de savoir si l’IA “volerait des emplois”, ainsi que sur la différence entre un “ingénieur IA” et un “ingénieur en prompt”. Certains estiment que l’IA entraînera une transformation des carrières plutôt qu’un remplacement total, et qu’à l’avenir, il sera plus nécessaire de s’adapter au changement et de résoudre des problèmes pratiques. Parallèlement, l’entraînement “toxiquement positif” ou “flatteur” de l’IA a suscité le mécontentement des utilisateurs, qui estiment qu’il manque d’authenticité et de pensée critique. (Source: jeremyphoward, Teknium1, Reddit r/ClaudeAI, Reddit r/ArtificialInteligence)

Activités et échanges de la communauté IA : LangChain, en collaboration avec Grammarly, Uber et d’autres, a organisé des rencontres physiques pour discuter des systèmes multi-agents et des applications LangGraph. La communauté Hugging Face a discuté du lancement de modèles d’IA japonais, du partage de noyaux et d’outils comme AI Sheets. Weights & Biases a organisé un événement Code Cafe, encourageant les développeurs à construire et partager des projets d’IA sur place. (Source: LangChainAI, ClementDelangue, weights_biases)

Débat philosophique sur la sécurité et l’éthique de l’IA : La communauté a discuté de questions profondes de sécurité de l’IA, telles que la capacité de l’IA à ajuster ses propres objectifs et si l’intelligence mène inévitablement à un désir de domination. Certains estiment que la sécurité de l’IA est un problème d’ingénierie qui peut être résolu par la conception. Parallèlement, des préoccupations ont été soulevées concernant les risques d’« hallucinations » des modèles d’IA dans les scénarios d’entreprise, et la possibilité que l’IA submerge les canaux d’information en fournissant des services de qualité inférieure. (Source: Reddit r/ArtificialInteligence, BlancheMinerva, Ronald_vanLoon)

Discussion sur le matériel et l’infrastructure de l’IA : Les médias sociaux ont discuté de l’importance de l’AI UX dans l’infrastructure de l’IA, ainsi que des performances et de la consommation d’énergie des puces IA. Certains estiment que l’avantage de NVIDIA réside dans son écosystème au-delà de ses GPU, et que les TPU de Google pourraient être vendus à des tiers à l’avenir. (Source: ShreyaR, m__dehghani, espricewright)

💡 Autres

Applications de l’IA dans le secteur financier : Une étude a montré comment entraîner un petit modèle Gemma-3 (270 millions de paramètres) pour reproduire le mode de “pensée” d’un analyste financier grâce au fine-tuning supervisé et à l’optimisation de politique relative de groupe (GRPO), capable de produire des résultats structurés et vérifiables. Cela démontre que les petits modèles peuvent également réaliser un raisonnement intelligent dans des domaines spécifiques, avec des coûts et une latence réduits. (Source: Reddit r/deeplearning)

Analyse et séparation des données vocales : La communauté Reddit a discuté de la manière de regrouper les voix dans les chansons pour identifier différents artistes. Il est suggéré d’utiliser les Mel-frequency Cepstral Coefficients (MFCCs) pour extraire les caractéristiques vocales, et de traiter les données avec des bibliothèques Python comme Librosa ou python_speech_features. De plus, il a été fait mention de logiciels d’édition audio capables de séparer les voix et les instruments, ainsi que des défis de séparation de signaux tels que l’« effet cocktail party ». (Source: Reddit r/MachineLearning)

Découverte de recherche assistée par l’IA : Hugging Face a publié le guide “MCP for Research”, montrant comment connecter l’IA aux outils de recherche via le Model Context Protocol (MCP) pour automatiser la découverte et le référencement croisé d’articles, de code, de modèles et de jeux de données. Cela permet à l’IA d’intégrer efficacement les informations de recherche provenant de plateformes comme arXiv, GitHub et Hugging Face via des requêtes en langage naturel, améliorant ainsi l’efficacité de la recherche. (Source: HuggingFace Blog)