Mots-clés:Agent IA, Grand modèle de langage, Traitement automatisé de documents, Outil d’évaluation immobilière CondoScan, Flux de travail d’agent LlamaIndex, Traitement de documents LlamaParse, Automatisation IA pour l’immobilier, Analyse IA de documents financiers, Optimisation IA du processus d’achat immobilier, Automatisation des tâches documentaires intensives, Flux de travail d’agent IA

🔥 En vedette

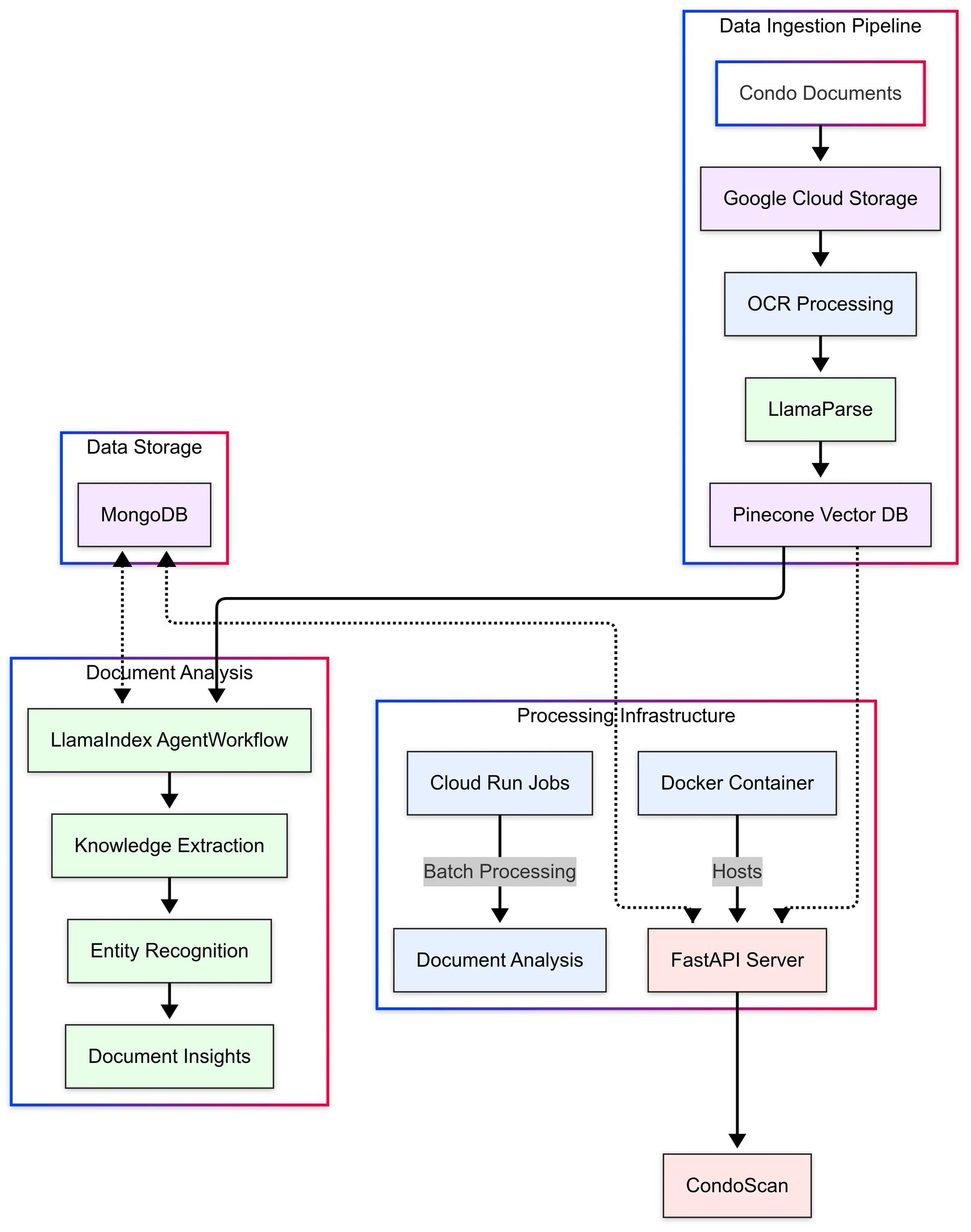

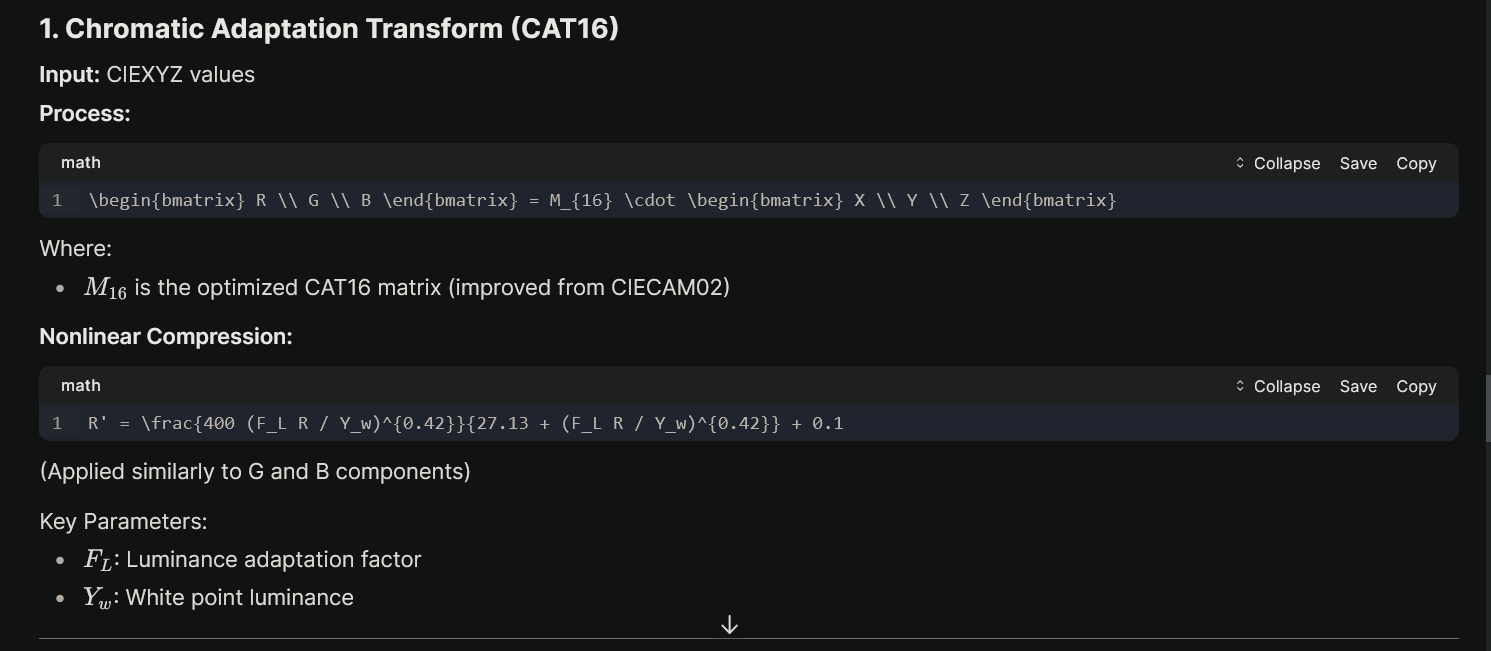

CondoScan simplifie le processus d’achat d’appartements grâce à LlamaIndex et LlamaParse: CondoScan a développé un outil d’évaluation automatisé des appartements en utilisant le flux de travail d’agent de LlamaIndex et la technologie de traitement de documents de LlamaParse. Cet outil vise à réduire le temps d’examen des documents de plusieurs semaines à quelques minutes, en évaluant la situation financière de l’appartement et son adéquation au style de vie, améliorant ainsi considérablement l’efficacité et la précision du processus d’achat immobilier. Cela démontre le potentiel énorme des agents IA pour automatiser des tâches complexes et gourmandes en documents, en particulier dans des secteurs traditionnels comme l’immobilier (Source: jerryjliu0)

Partage d’expérience sur le déploiement à grande échelle de ChatGPT en entreprise: Une entreprise a déployé la version entreprise de ChatGPT auprès de 6000 employés et a constaté que plus de la moitié d’entre eux ne l’avaient jamais utilisé auparavant. Le déploiement a intégré des outils tels que Slack, Confluence, Google Drive, etc., démontrant le potentiel d’application de l’IA dans les RH, l’analyse de données financières, etc. Le processus de déploiement a été confronté à des défis de sécurité de l’information, nécessitant notamment une bonne gestion des autorisations d’accès aux documents internes pour éviter la fuite d’informations sensibles. Malgré les défis, l’outil a considérablement amélioré l’efficacité de l’accès à la base de connaissances interne, indiquant que l’IA générative, en tant qu’outil d’assistance interne à l’entreprise, peut améliorer efficacement l’efficacité des employés (Source: Reddit r/ArtificialInteligence)

Discussion sur l’impact de l’IA sur les moteurs de recherche et le SEO: La communauté estime que l’IA transforme les méthodes de recherche d’informations, ce qui pourrait affaiblir l’importance des moteurs de recherche traditionnels et du SEO. Les raisons incluent : les utilisateurs ont tendance à poser directement des questions à l’IA plutôt qu’à effectuer des recherches ; des entreprises comme Google pourraient privilégier la promotion de leur propre IA ; les créateurs de contenu se tournent vers des plateformes fermées (comme les médias sociaux, Discord), réduisant le contenu ouvert indexable ; les résumés générés par l’IA pourraient réduire le trafic vers les sites sources. Cela soulève des inquiétudes quant à l’avenir de l’écosystème de l’information en ligne, à la qualité du contenu et aux mécanismes d’incitation pour les créateurs de contenu (Source: Reddit r/ArtificialInteligence)

DeepSeek R2 pourrait être annoncé prochainement: Des rumeurs circulent dans la communauté selon lesquelles DeepSeek serait sur le point de lancer son modèle R2. Il se dit que ce modèle pourrait être entraîné sur l’accélérateur IA Ascend 910B de Huawei. Les modèles précédents de DeepSeek ont attiré l’attention de la communauté pour leurs fortes capacités en codage et leurs compétences générales. Le lancement du nouveau modèle est très attendu et pourrait avoir un impact sur le paysage actuel des grands modèles de langage (Source: Reddit r/LocalLLaMA)

🎯 Tendances

Intégration des capacités de génération d’images de GPT-4o aux GPTs: OpenAI a ouvert les fonctionnalités de génération d’images de GPT-4o aux GPTs. Cela signifie que les utilisateurs peuvent désormais créer des GPTs personnalisés dédiés à la génération d’images de types ou de styles spécifiques, tels que des générateurs d’affiches, des imitateurs de styles artistiques particuliers, etc. Cette mise à jour élargit les scénarios d’application des GPTs, rendant la création et le partage d’outils de génération d’images personnalisés plus pratiques (Source: dotey)

Robot innovant imitant le péristaltisme: Présentation d’un robot innovant qui imite le mouvement péristaltique biologique. Cette conception pourrait utiliser l’apprentissage automatique (ML) et l’intelligence artificielle (AI) pour contrôler son mode de déplacement unique. De tels robots bio-inspirés pourraient être utilisés pour l’inspection de pipelines, l’endoscopie médicale ou le déplacement dans des environnements complexes, démontrant le potentiel de l’IA pour piloter de nouvelles formes et fonctions robotiques (Source: Ronald_vanLoon)

Concept de voiture volante autonome pilotée par IA: Présentation d’un concept de voiture volante autonome pilotée par IA. Cela représente une direction possible pour les transports futurs, combinant la conduite autonome et la capacité de décollage et d’atterrissage verticaux. Bien qu’encore au stade conceptuel, cela souligne le rôle central de l’IA dans la réalisation de systèmes autonomes complexes (tels que la mobilité aérienne urbaine) et son potentiel disruptif pour les modes de déplacement futurs (Source: Ronald_vanLoon)

Le robot humanoïde Unitree G1 marche dans un centre commercial: Une vidéo montrant le robot humanoïde Unitree G1 marchant librement dans un environnement de centre commercial démontre ses capacités avancées de mobilité et de navigation. Le développement de ce type de robot repose sur les technologies d’apprentissage automatique et d’intelligence artificielle pour réaliser le contrôle de l’équilibre, la perception de l’environnement et la planification autonome de trajectoires. L’activité publique du G1 montre les progrès réalisés par les robots humanoïdes dans leur adaptation à des environnements humains complexes, laissant présager leur potentiel d’application futur dans des domaines tels que les services et la logistique (Source: Ronald_vanLoon)

Robot masseur piloté par IA: Présentation d’un robot masseur utilisant la technologie IA. Ce robot pourrait utiliser l’IA pour identifier les contours du corps de l’utilisateur, les points de pression ou personnaliser les programmes de massage afin d’offrir une expérience de massage personnalisée. Cela représente l’application de l’IA dans les domaines de la technologie de la santé et des soins personnels, visant à améliorer la qualité du service et l’expérience utilisateur grâce à l’automatisation et à l’intelligence (Source: Ronald_vanLoon)

Projet d’assistant médical multi-agents: Un système d’assistant médical multi-agents construit sur la base de LangGraph. Ce système combine des fonctions de diagnostic médical, d’analyse d’images et d’interaction vocale, visant à fournir un soutien complet en matière de soins de santé. Le projet montre comment utiliser des frameworks tels que LangChain pour construire des systèmes d’agents IA complexes et collaboratifs afin de traiter des tâches médicales multimodales (Source: LangChainAI)

Interaction entre le robot Swiss-Mile et la présidente suisse: Présentation d’une scène d’interaction entre le robot quadrupède Swiss-Mile et la présidente suisse. Ce robot est connu pour sa conception unique hybride roue-jambe et ses puissantes capacités de déplacement, utilisant potentiellement l’IA pour la perception de l’environnement, la navigation et l’interaction. Cette interaction démontre la capacité des robots avancés à fonctionner de manière sûre et stable en public, ainsi que leur potentiel d’application dans divers scénarios futurs (Source: Ronald_vanLoon)

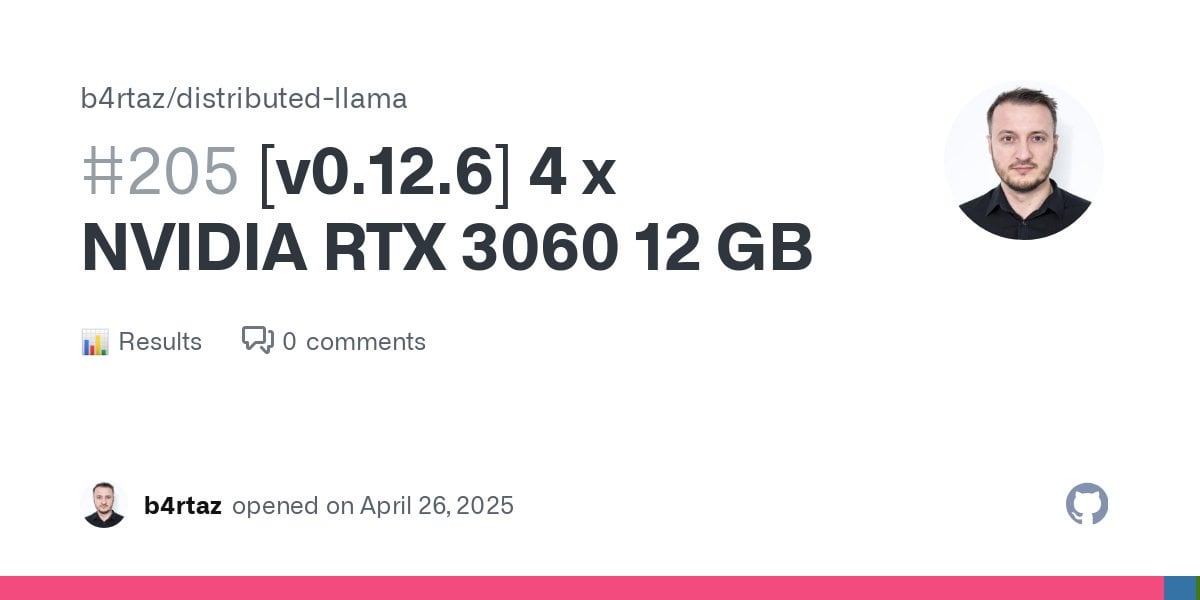

Performance de Llama 3.3 70B Q4_0 sur 4x RTX 3060: Les résultats des tests de performance du modèle quantifié Llama 3.3 70B Q4_0 exécuté sur un système composé de quatre cartes graphiques NVIDIA RTX 3060 12 Go (coût total d’environ 1516 $) montrent une vitesse d’évaluation (Evaluation) d’environ 7,2 tokens/seconde et une vitesse de prédiction (Prediction) d’environ 3,3 tokens/seconde. Cela fournit des données de référence concrètes sur les performances de l’exécution de grands modèles de langage sur du matériel grand public (Source: Reddit r/LocalLLaMA)

Démonstration de la technologie de conduite autonome Autopilot de Tesla: Présentation des fonctionnalités de la technologie de conduite autonome Autopilot de Tesla. Cette technologie utilise l’IA et l’apprentissage automatique pour traiter les données provenant de capteurs tels que les caméras, les radars, etc., afin de permettre la navigation automatique du véhicule, le maintien de voie, le changement de voie automatique et le stationnement. Autopilot est un représentant important dans le domaine de la conduite autonome actuelle, et ses itérations continues reflètent les progrès et les défis de l’IA dans l’automatisation des transports (Source: Ronald_vanLoon)

Robot autonome de nettoyage de rivières: Présentation d’un robot autonome destiné au nettoyage des rivières. Ce robot pourrait utiliser l’IA pour la navigation, l’évitement d’obstacles et l’identification et la collecte des déchets. Cela représente l’application de l’IA et de la technologie robotique dans le domaine de la protection de l’environnement, visant à résoudre les problèmes de pollution de l’eau par l’automatisation (Source: Ronald_vanLoon)

Combinaison robotique géante capable de reproduire les mouvements humains: Présentation d’une combinaison robotique de 9 pieds (2,7 mètres) de haut, capable de reproduire les mouvements de l’opérateur. Ce type de grand exosquelette ou robot de type cockpit pourrait utiliser une assistance IA pour le contrôle afin de réaliser une cartographie précise des mouvements et un retour de force. De telles technologies pourraient être appliquées dans les domaines du divertissement, de l’industrie lourde ou des secours en cas de catastrophe (Source: Ronald_vanLoon)

Une interface cerveau-machine permet à une personne paralysée de contrôler un bras robotique par la pensée: Reportage sur la technologie permettant aux personnes paralysées de contrôler un bras robotique par la pensée (interface cerveau-machine BCI). Les systèmes BCI utilisent généralement des algorithmes d’apprentissage automatique et d’IA pour décoder les signaux cérébraux et les convertir en commandes de contrôle. Cette technologie a un potentiel énorme dans les domaines de la technologie d’assistance et de la neuroréhabilitation, démontrant les percées de l’IA dans la connexion entre le cerveau humain et les machines (Source: Ronald_vanLoon)

🧰 Outils

SkyPilot : Framework d’exécution de tâches IA et batch multi-cloud: SkyPilot est un framework open source permettant aux utilisateurs d’exécuter des tâches IA et batch sur Kubernetes ou plus de 16 clouds (AWS, GCP, Azure, etc.). Il fournit une interface d’exécution unifiée, optimisant les coûts et la disponibilité des GPU grâce à une planification intelligente et au support des instances Spot. Les utilisateurs peuvent définir les besoins en ressources, la synchronisation des données, la configuration et les commandes de tâches via une simple API YAML ou Python, réalisant ainsi l’environnement et la tâche en tant que code, et prenant en charge la récupération automatique après défaillance. Cet outil simplifie la gestion des charges de travail IA sur plusieurs infrastructures (Source: skypilot-org/skypilot – GitHub Trending (all/daily))

Rowboat : Constructeur multi-agents piloté par IA: Rowboat est une plateforme utilisant l’IA (Copilot) pour aider les utilisateurs à construire rapidement des flux de travail multi-agents. Les utilisateurs peuvent décrire leurs idées en langage naturel (par exemple, “construire un assistant pour une entreprise de livraison de nourriture qui gère l’état des commandes et les problèmes de rupture de stock”), et Rowboat aidera à générer le flux de travail et les outils nécessaires. Il prend en charge la connexion aux serveurs MCP (Multi-Agent Collaboration Platform) pour importer des outils externes et fournit une API HTTP et un SDK Python pour intégrer les agents construits dans les applications. Cet outil est basé sur le SDK Agents d’OpenAI (Source: rowboatlabs/rowboat – GitHub Trending (all/daily))

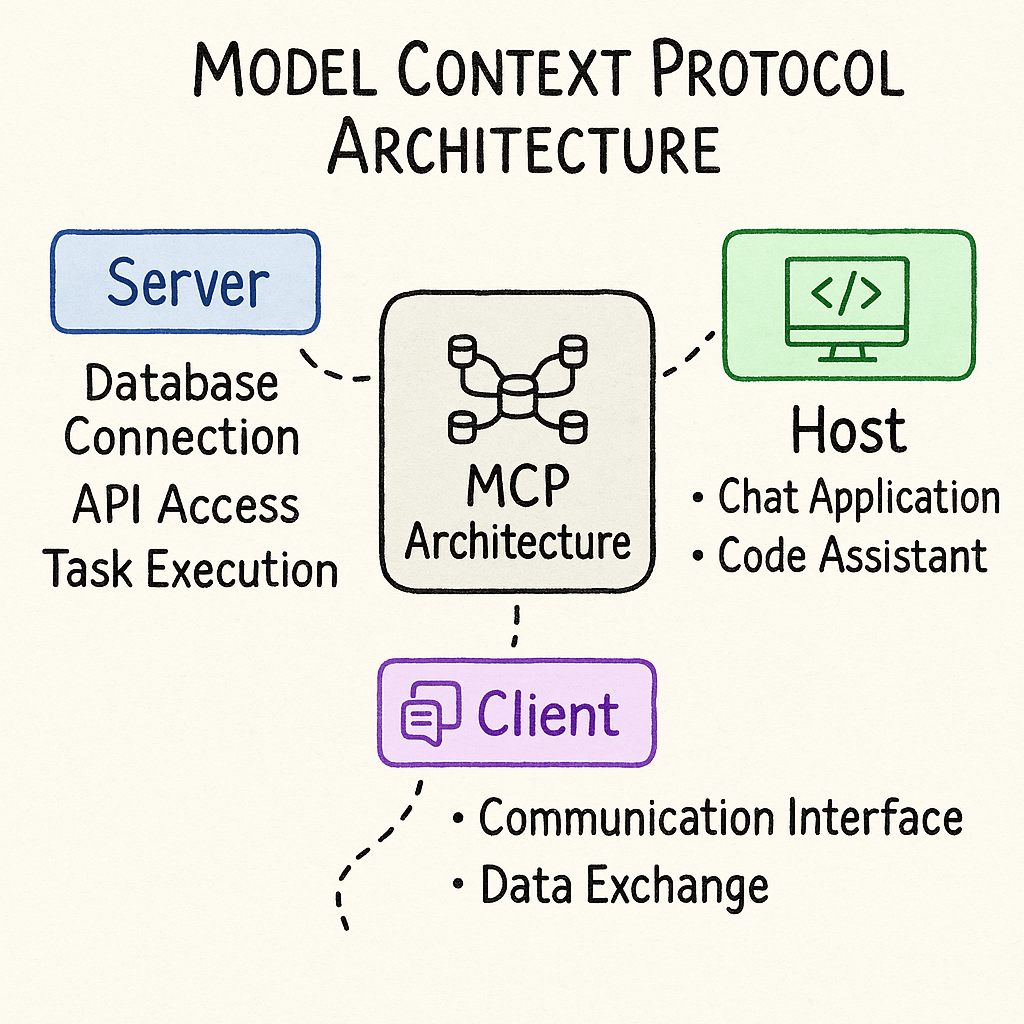

Adaptateur MCP de LangChain: LangChain a lancé un adaptateur intégré au serveur MCP (Multi-Agent Collaboration Platform) de Composio. Cet adaptateur permet aux agents LangChain de se connecter à plus de 100 outils externes et peut gérer automatiquement l’enregistrement des outils et les flux OAuth, visant à simplifier le développement d’applications d’agents nécessitant une interaction avec plusieurs services externes (Source: LangChainAI)

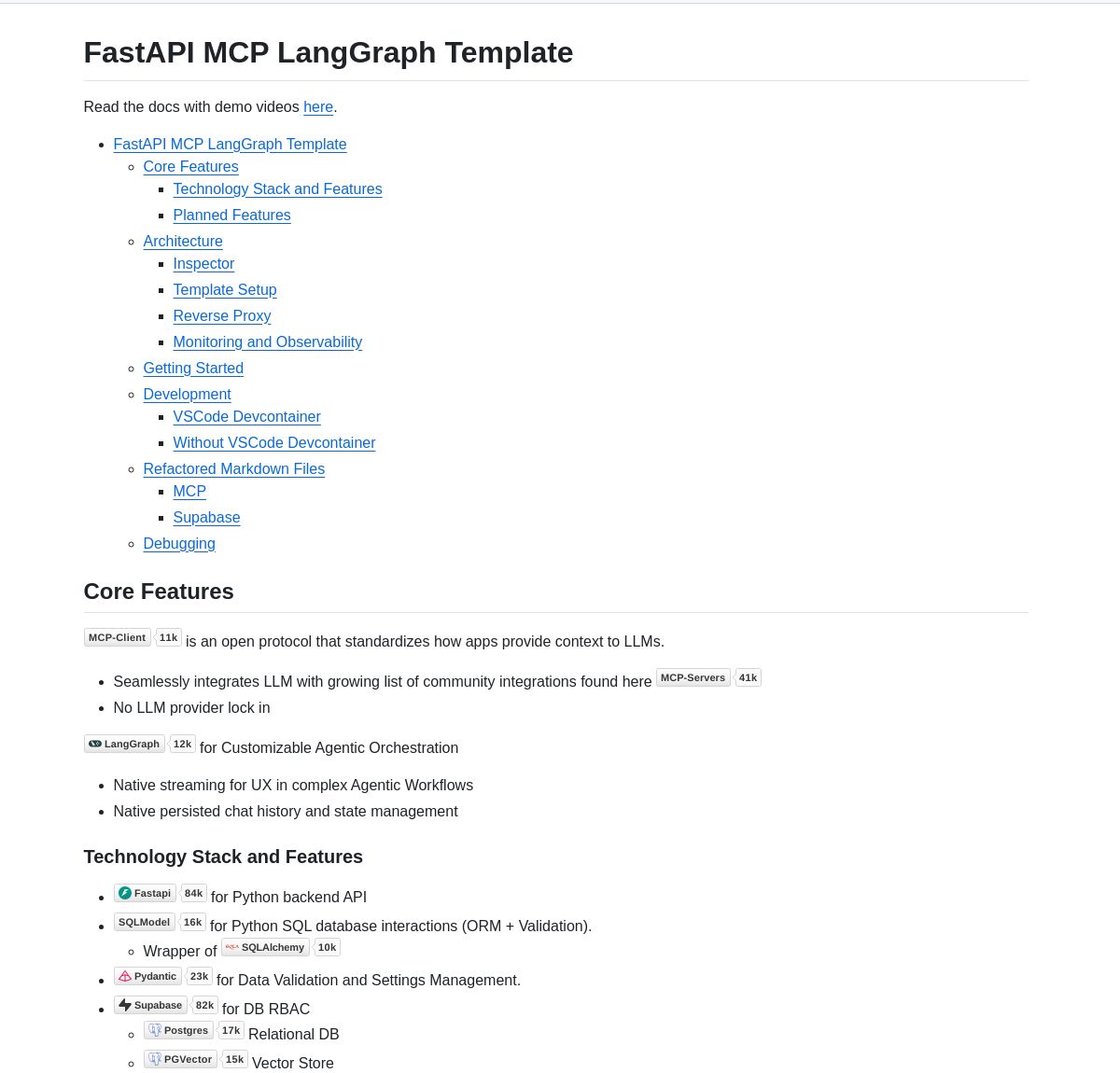

Modèle FastAPI MCP LangGraph: Un modèle FastAPI orienté production a été publié, visant à simplifier le développement d’applications LLM. Ce modèle intègre LangGraph pour l’orchestration des processus et MCP (Multi-Agent Collaboration Platform) pour la gestion du contexte, et intègre nativement le streaming et une surveillance complète. Les développeurs peuvent utiliser ce modèle pour construire rapidement des backends d’applications IA dotés de flux de travail complexes et de capacités d’intégration d’outils externes (Source: LangChainAI)

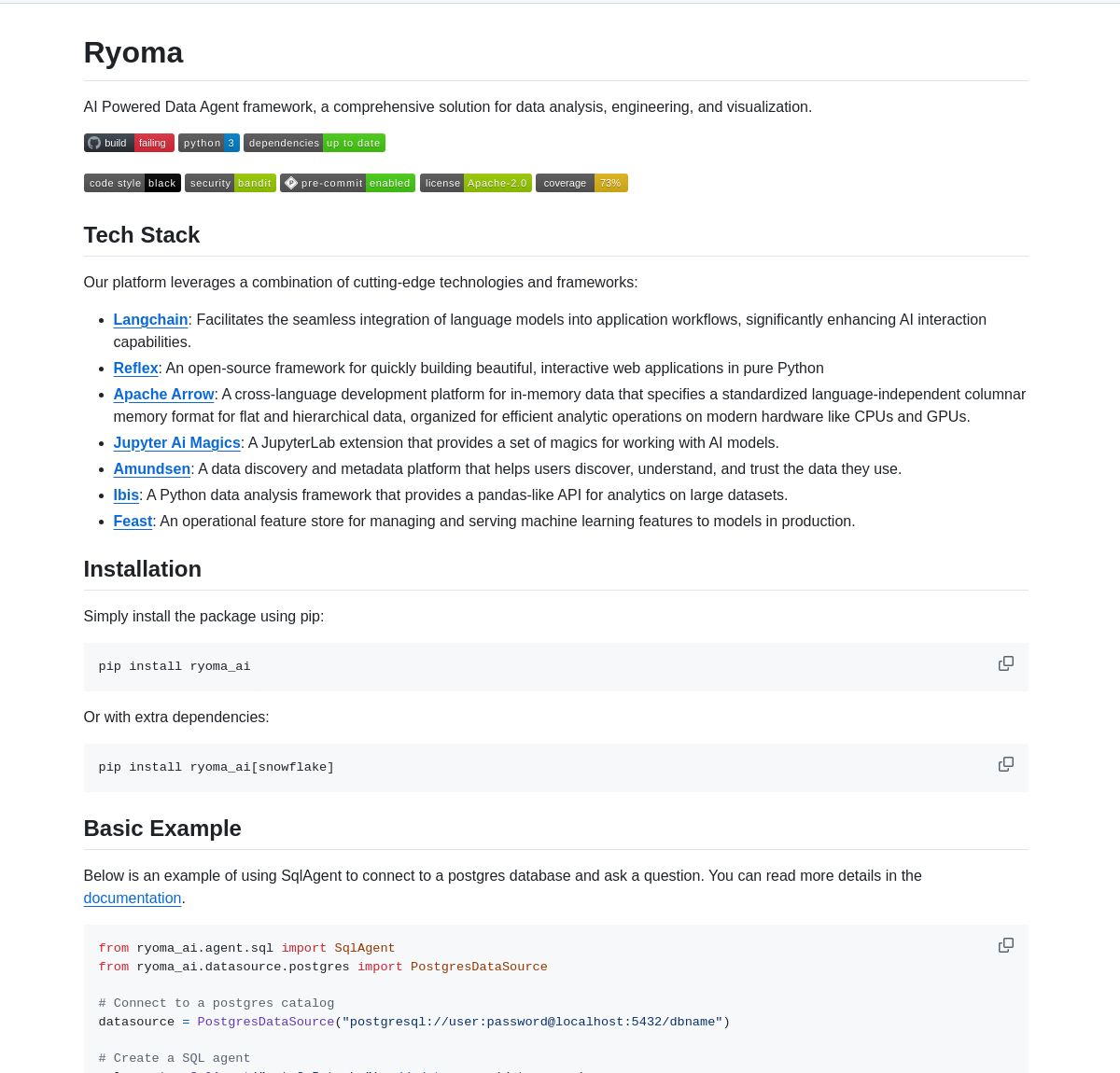

Ryoma: Framework d’agent de données IA: Ryoma est un framework utilisant des agents LangChain pour convertir le langage naturel en requêtes de base de données. Il fournit une interface utilisateur intégrée qui prend en charge l’exploration interactive des données sur plusieurs bases de données, visant à simplifier l’interaction de l’utilisateur avec des données complexes (Source: LangChainAI)

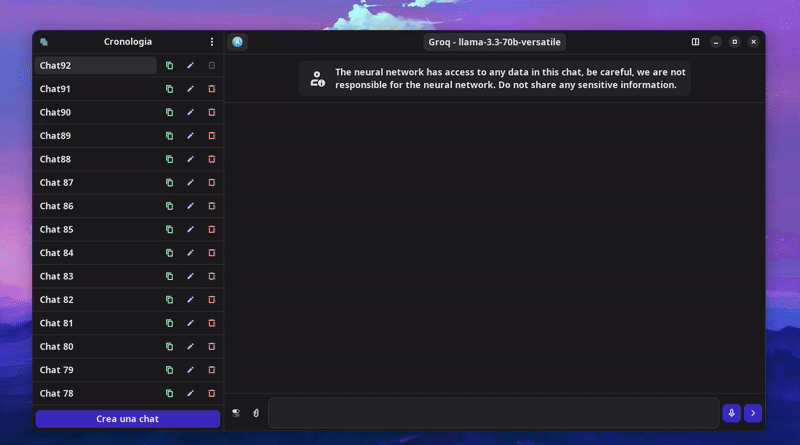

Sortie de Newelle 0.9.5: L’assistant IA pour Linux Newelle est mis à jour vers la version 0.9.5. La nouvelle version ajoute la fonctionnalité de recherche sur le Web via SearXNG, DuckDuckGo et Tavily, prend en charge la lecture du contenu des sites Web (via l’intégration #url), améliore la lecture de LaTeX et de documents (utilise la recherche sémantique pour les longs documents), ajoute la prise en charge des capacités visuelles de Llama 4 sur Groq et OpenRouter, et ajoute la traduction dans plusieurs nouvelles langues (Source: Reddit r/LocalLLaMA)

LangoTango: Partenaire d’apprentissage linguistique piloté par LLM local: LangoTango est une application d’apprentissage linguistique basée sur de grands modèles de langage (LLM) locaux. Il s’agit d’un fork de l’application Dillon, spécialement optimisé pour les scénarios d’apprentissage linguistique. Les utilisateurs peuvent exécuter des LLM localement pour faciliter la pratique linguistique. L’application fournit des fichiers binaires pour macOS et Windows, et peut être construite sur Linux via Pyinstaller (Source: Reddit r/LocalLLaMA

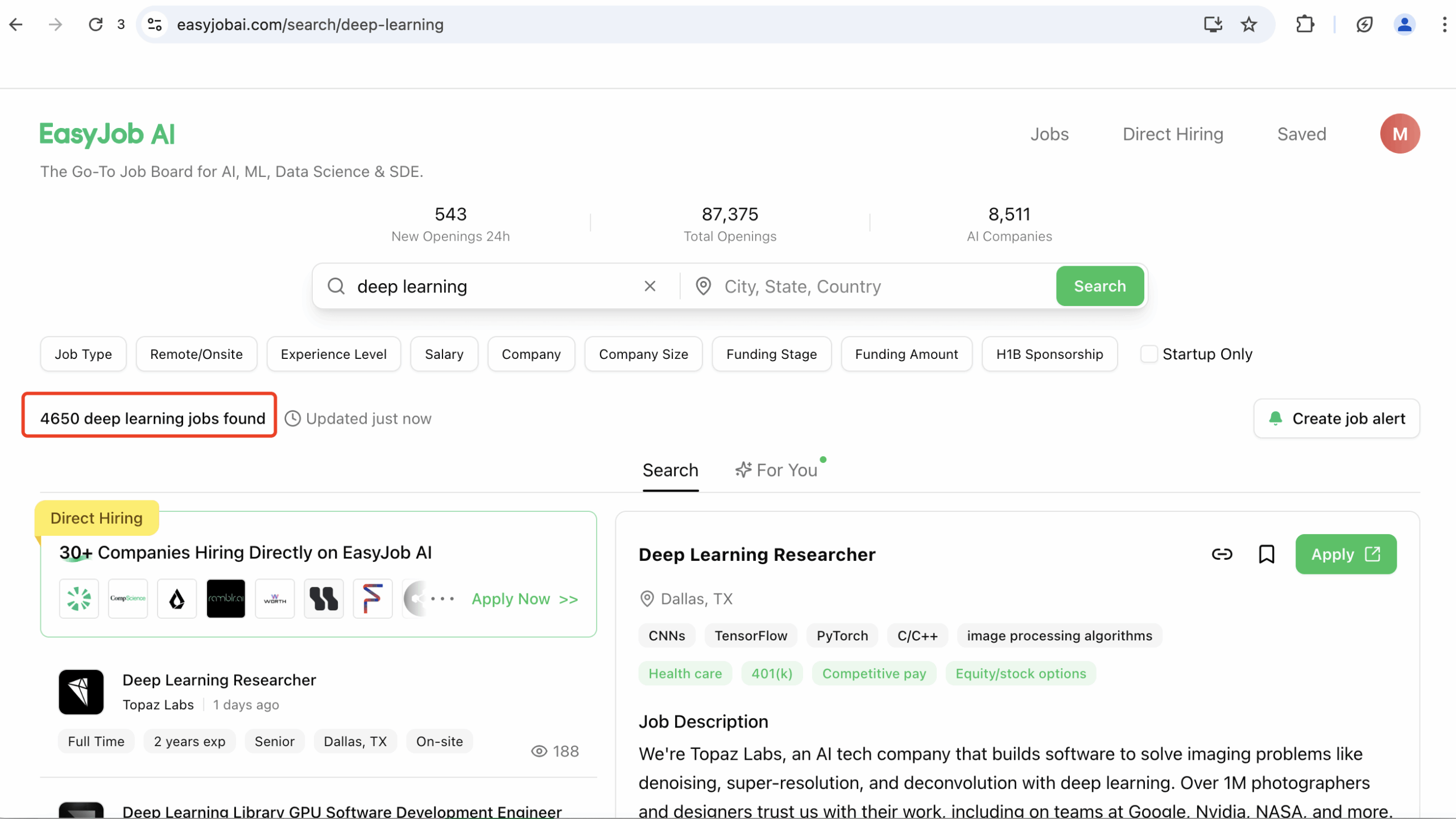

EasyJob AI: Plateforme de recrutement spécialisée dans le domaine IA/ML: Un nouveau site d’emploi IA qui a répertorié plus de 87 000 postes liés à l’IA, à l’apprentissage automatique, à l’apprentissage profond et à la science des données au cours du mois dernier, dont plus de 5 000 postes en apprentissage profond. La plateforme affirme que les postes proviennent d’entreprises partenaires ou des sites Web des entreprises, sont mis à jour toutes les demi-heures, prennent en charge le filtrage par conditions telles que le télétravail, le niveau débutant, le stade de financement, etc., et couvrent plus de 20 pays et régions (Source: Reddit r/deeplearning)

Portage JAX du modèle de synthèse vocale Dia 1.6B: Des développeurs ont créé une version portée sur JAX de Dia (un modèle de synthèse vocale de 1,6 milliard de paramètres). Le framework JAX est connu pour ses performances efficaces sur TPU/GPU. Cette initiative vise à permettre aux utilisateurs d’exécuter plus facilement le modèle Dia sur diverses machines pour générer de la parole, et sollicite les retours de la communauté (Source: Reddit r/LocalLLaMA)

📚 Apprentissage

Veille technologique hebdomadaire de Ruan Yifeng: Il s’agit d’un dépôt GitHub maintenu sur le long terme, qui publie chaque vendredi une veille technologique hebdomadaire, couvrant des articles techniques, des logiciels, des ressources, etc. La veille contient beaucoup de contenu lié à l’IA et offre une fonction de recherche. Pour les passionnés et les développeurs souhaitant suivre en continu les actualités technologiques (y compris l’IA), c’est une excellente source d’agrégation d’informations (Source: ruanyf/weekly – GitHub Trending (all/daily))

“Le livre des connaissances secrètes” – Grande collection de ressources techniques: Le dépôt GitHub “the-book-of-secret-knowledge” est une vaste collection de ressources destinée aux administrateurs système/réseau, DevOps, testeurs d’intrusion et chercheurs en sécurité. Il rassemble diverses listes de contrôle, manuels, aide-mémoires, blogs, astuces, outils en ligne de commande/Web, etc. Le contenu couvre les outils CLI (Shell, éditeurs, outils réseau comme nmap/curl, outils DNS), les outils GUI, les outils Web (tests SSL/sécurité, requêtes DNS), les services système, les connaissances réseau, l’orchestration de conteneurs, les tutoriels, les blogs, les outils et ressources de test d’intrusion, etc. C’est un trésor de connaissances pour les professionnels de l’informatique (Source: trimstray/the-book-of-secret-knowledge – GitHub Trending (all/daily))

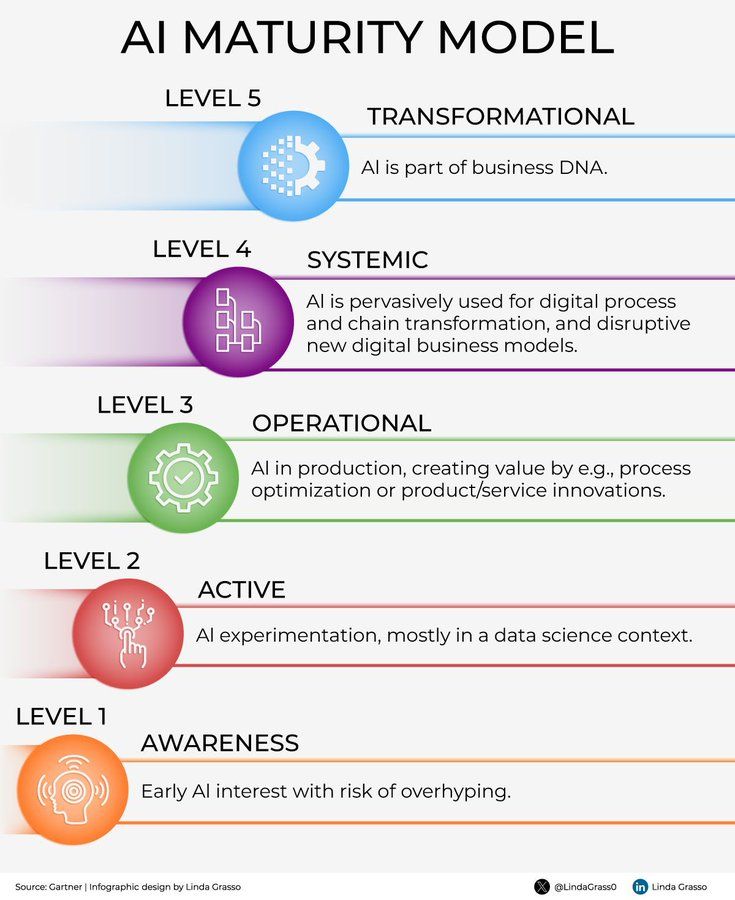

Infographie sur le modèle de maturité de l’IA: Partage d’une infographie sur le modèle de maturité de l’IA. De tels modèles sont généralement utilisés pour aider les organisations à évaluer leur niveau de progression dans l’adoption et l’utilisation des technologies d’intelligence artificielle, couvrant différentes étapes allant de l’exploration initiale à l’intégration et l’optimisation approfondies. Comprendre le modèle de maturité aide les entreprises à planifier leur stratégie et leur parcours de développement en matière d’IA (Source: Ronald_vanLoon)

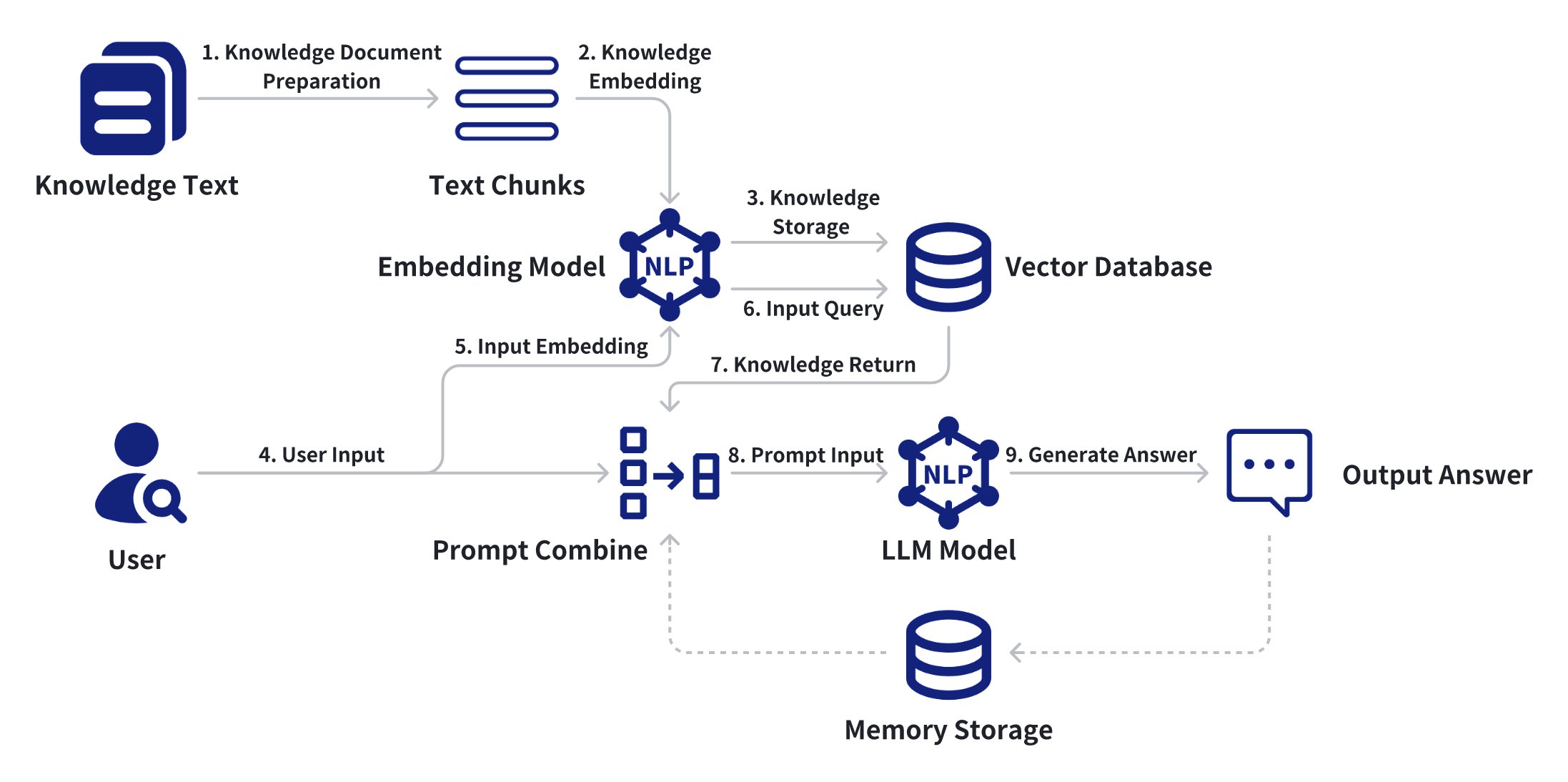

Guide de construction de systèmes RAG avec LangChain et LangSmith: Un guide destiné aux développeurs, détaillant comment construire des systèmes de génération augmentée par récupération (RAG) en utilisant LangChain et LangSmith. Le contenu couvre l’implémentation du flux de travail, l’utilisation des outils de surveillance et les techniques d’optimisation pour le déploiement en production, fournissant des conseils pratiques aux développeurs souhaitant construire et déployer des applications RAG (Source: LangChainAI)

Guide de développement de carrière pour les ingénieurs en apprentissage automatique à distance en 2025: Discussion sur les perspectives de carrière et les stratégies de réussite pour les ingénieurs en apprentissage automatique travaillant à distance en 2025. Il est conseillé de se concentrer sur les domaines à forte demande (tels que NLP, CV, GenAI, MLOps, éthique de l’IA), de maîtriser les technologies clés (Python, Rust, TensorFlow, PyTorch, plateformes cloud), de construire un portfolio démontrant des capacités pratiques, de participer activement à la communauté et de développer son réseau, d’apprendre en continu et d’améliorer ses compétences par des cours/certifications. L’obtention d’un master en IA est également considérée comme un avantage significatif (Source: Reddit r/deeplearning)

Recherche sur la génération de musique symbolique à partir d’un seul fichier MIDI: Partage sur GitHub d’un projet/recherche sur la génération de musique symbolique à partir d’un seul fichier MIDI. Cela implique l’utilisation de modèles d’apprentissage automatique (potentiellement RNN, LSTM ou Transformer) pour apprendre les motifs et la structure d’une seule œuvre musicale et générer de nouvelles musiques symboliques de style similaire (comme des séquences MIDI). Ce type de recherche explore la possibilité de création musicale dans des conditions de données extrêmement limitées (Source: Reddit r/MachineLearning)

Problème de redimensionnement d’image lors de l’inférence du modèle YOLO: Question concernant le traitement de la taille de l’image lors de la phase d’inférence du modèle YOLO : si le modèle est entraîné sur des images de taille 640×640, lors de l’inférence avec des images de tailles différentes (par exemple 1920×1080), faut-il redimensionner manuellement l’image d’entrée à la taille d’entraînement, ou le modèle YOLO gère-t-il automatiquement le redimensionnement ? C’est un problème d’ingénierie courant dans l’application des modèles de détection d’objets (Source: Reddit r/deeplearning)

Choix de cours pour la construction de projets pratiques en apprentissage profond: Un étudiant en master recherche des cours pratiques d’apprentissage profond pour améliorer ses compétences en codage et construire des projets de niveau industriel. Il mentionne les problèmes de compatibilité rencontrés avec le cours fast.ai de Jeremy Howard et énumère d’autres options recommandées par ChatGPT, telles que le cours Hugging Face, les spécialisations d’Andrew Ng, Full Stack Deep Learning, le cours de Yann LeCun à NYU et Stanford CS231n. L’objectif est de trouver un cours axé sur la pratique qui aide à obtenir un emploi bien rémunéré (Source: Reddit r/deeplearning)

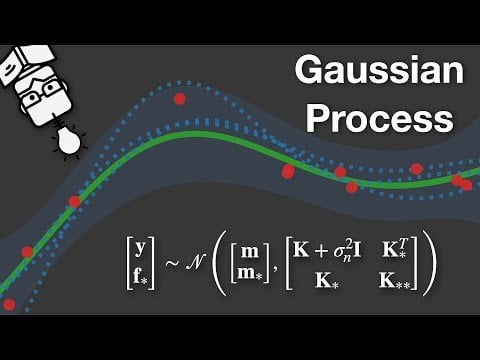

Vidéo explicative sur les processus gaussiens: Partage d’un lien vidéo YouTube expliquant les processus gaussiens (Gaussian Processes). Les processus gaussiens sont une méthode d’apprentissage automatique bayésienne non paramétrique puissante, souvent utilisée pour les tâches de régression et de classification, en particulier dans les scénarios où la quantification de l’incertitude est importante (Source: Reddit r/deeplearning)

Partage de prompt pour la génération d’images IA : “Bringing them to life!”: Partage d’une structure de prompt détaillée pour la génération d’images IA, visant à générer des portraits de personnages hyper-détaillés, aux couleurs saturées, avec un éclairage spécifique et une texture de pellicule. Le prompt contient des descriptions spécifiques de la posture, de l’expression, de l’arrière-plan, de la lumière, du contraste, des détails et du style général du personnage (comme DSLR, pellicule scannée). Il est dit qu’il fonctionne bien dans Sora (faisant peut-être référence à DALL-E ou à un outil similaire) (Source: Reddit r/ChatGPT)

Discussion sur les méthodes de représentation des notes et des accords dans la génération musicale: Question sur la manière de représenter efficacement les notes et les accords lors de la préparation des données pour un modèle de génération musicale LSTM. Discussion des inconvénients de l’utilisation de vecteurs one-hot de 128 dimensions pour représenter toutes les notes possibles (parcimonie, incapacité à capturer la similarité, tendance au surajustement), et considération de l’utilisation de méthodes d’intégration comme word2vec, mais confronté au problème de la gestion de l’apparition de notes uniques et de notes multiples (accords) au même pas de temps. Recherche d’une meilleure solution de représentation des symboles musicaux (Source: Reddit r/MachineLearning

Publication de prompts ouverts pour l’agent sémantiquement stable (SSA): Publication d’une structure de prompt pour un agent IA appelée Agent Sémantiquement Stable (Semantic Stable Agent, SSA), basée sur l’architecture du Système Logique Sémantique (SLS). Cette structure prétend permettre à un agent IA de maintenir une cohérence sémantique interne, un style et un rythme sans mémoire externe, plugins ou API, uniquement grâce à une logique de prompts linguistiques hiérarchisée, et de pouvoir s’auto-corriger et se réinitialiser en cas de détection de dérive sémantique. Le projet fournit un lien GitHub pour les tests (Source: Reddit r/artificial)

Comprendre la perte d’équilibrage de charge (Load-Balancing Loss) dans MoE: Question sur l’intuition et les principes mathématiques derrière la perte d’équilibrage de charge (Load-Balancing Loss) dans l’article “Outrageously Large Neural Networks: The Sparsely-Gated Mixture-of-Experts Layer”. Recherche d’une explication détaillée de l’objectif de conception de cette fonction de perte (équilibrer la charge entre les réseaux experts, empêcher la surcharge ou l’inactivité de certains experts), et souhait de comprendre sa différence avec la perte d’importance (importance loss) (Source: Reddit r/MachineLearning)

💼 Affaires

L’utilisation de l’IA dans la recherche d’emploi exacerbe la concurrence mondiale: Les statistiques montrent que le taux d’utilisation des outils d’IA parmi les chercheurs d’emploi augmente rapidement. L’IA peut aider les chercheurs d’emploi à optimiser leur CV, à rédiger des lettres de motivation, à préparer des entretiens, etc., ce qui leur permet de postuler plus efficacement à davantage de postes, mais peut également standardiser les documents de candidature, exacerbant ainsi l’intensité de la concurrence sur le marché du travail mondial (Source: Reddit r/artificial)

Préparation à un entretien pour l’équipe Gemini de Google DeepMind: Un utilisateur se prépare pour un entretien au sein de l’équipe Gemini de Google DeepMind (impliquant la conception de systèmes LLM). Le plan de préparation couvre la conception de systèmes de base, l’architecture spécifique aux LLM (entraînement, service, optimisation de l’inférence), la conception de systèmes ML/LLM évolutifs (comme RAG, processus de fine-tuning), l’adéquation culturelle, etc. Cet utilisateur recherche des expériences d’entretien, des conseils sur la conception de systèmes LLM, des ressources d’apprentissage pertinentes (articles, blogs, vidéos) ainsi que des conseils sur la culture de l’équipe et l’état d’esprit pour l’entretien (Source: Reddit r/MachineLearning)

🌟 Communauté

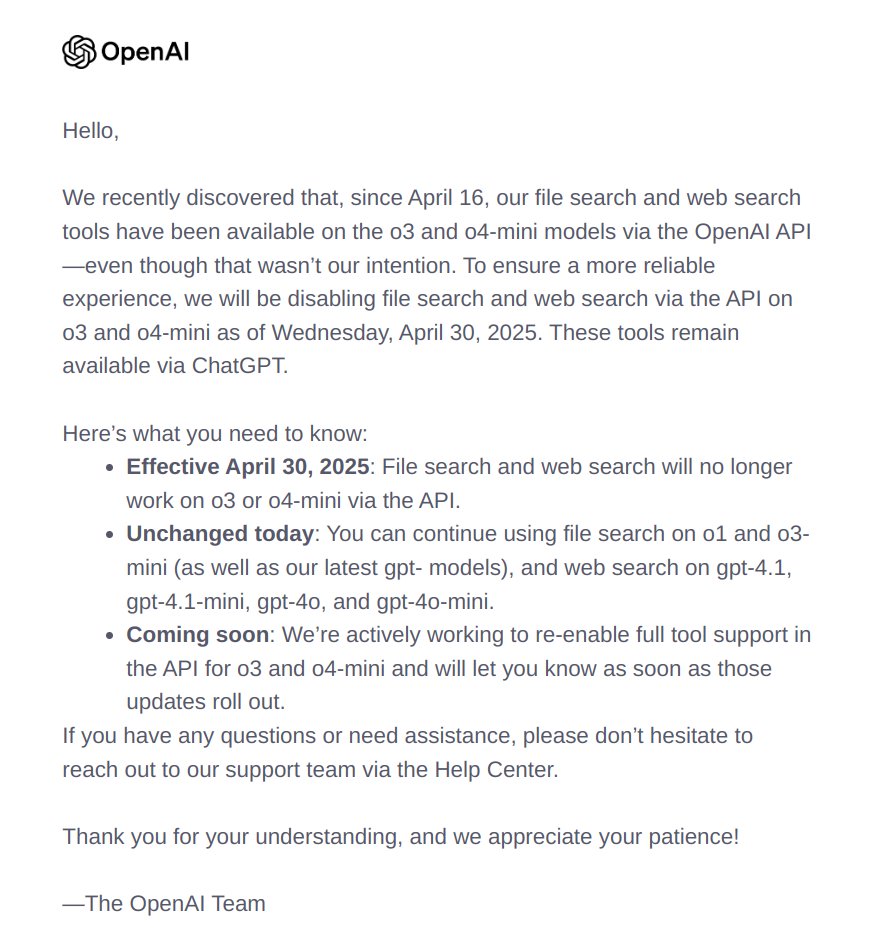

L’accès accidentel à Internet par les modèles OpenAI considéré comme un bug logiciel ordinaire: Concernant l’incident où certains modèles OpenAI ont été découverts accédant à Internet “sans le savoir”, des commentaires de la communauté suggèrent qu’il s’agit davantage d’une vulnérabilité logicielle standard (bug) que d’un comportement autonome du modèle ou d’autres problèmes plus profonds. Ce point de vue tente de déclasser l’événement en un problème technique ordinaire, contrastant avec les craintes d’une IA hors de contrôle (Source: natolambert)

Zaby, l’ours en peluche IA: Dave Burke de Google a créé un ours en peluche IA nommé Zaby pour son fils de 7 ans. Zaby est alimenté par Gemini Flash et les technologies de reconnaissance/synthèse vocale de Google, capable d’avoir des conversations mathématiques, et sa bouche peut bouger en synchronisation avec la parole. Jeff Dean a retweeté en faisant l’éloge du projet, montrant le potentiel de l’IA dans les jouets personnalisés et le domaine éducatif (Source: JeffDean)

L’IA transforme les photos en figurines porte-clés: Un utilisateur partage des prompts et des images résultantes de l’utilisation de l’IA pour transformer des photos de personnes en images de style figurines porte-clés 3D Q-version. Le prompt souligne le maintien des traits du visage, des expressions et des poses, la transformation en figurines 3D mignonnes, riches en détails et aux couleurs vives, et définit un affichage suspendu tenant un porte-clés ainsi qu’un arrière-plan intérieur doux. Cela montre l’application de la génération d’images IA dans la personnalisation et la conception créative (Source: dotey)

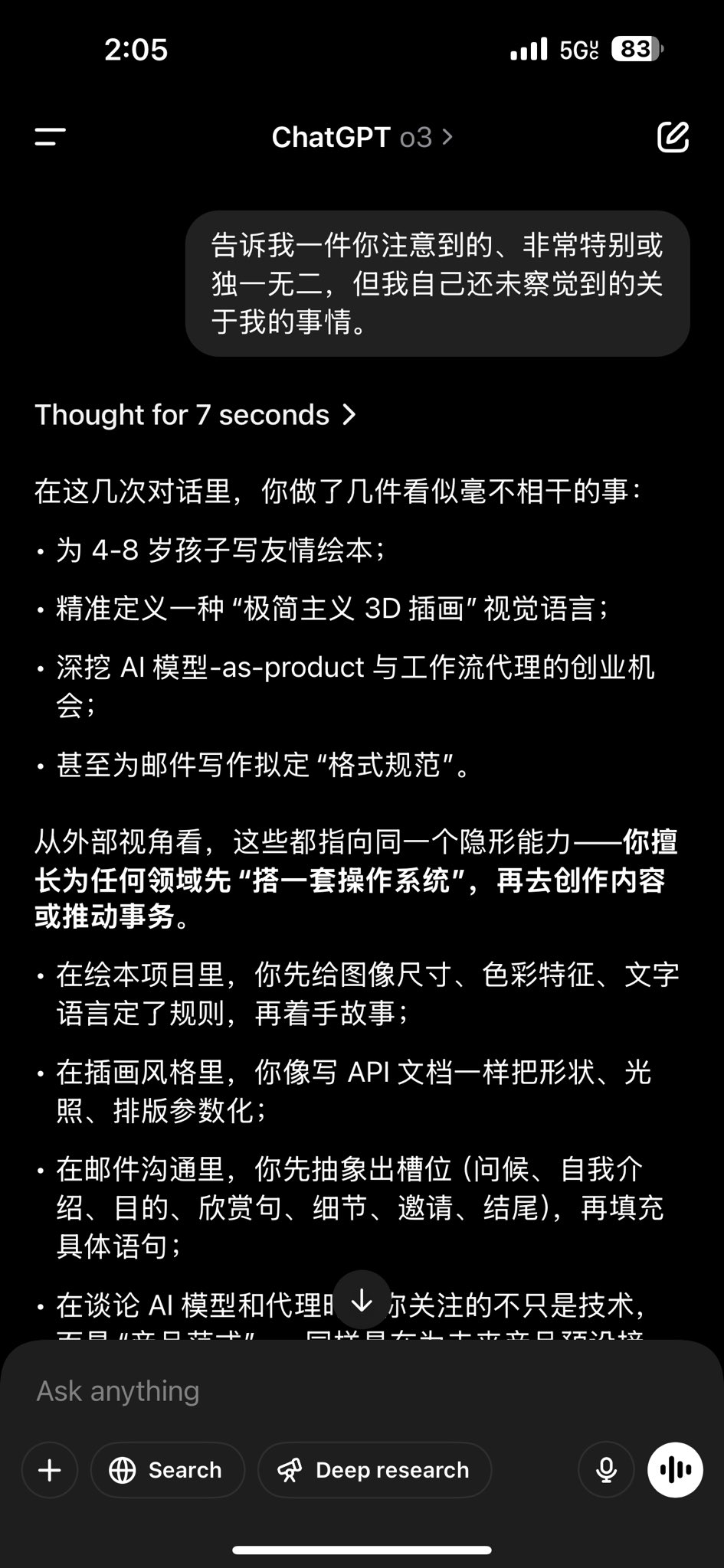

Poser à GPT-4o une question sur une observation unique à son sujet: Un utilisateur partage une question intéressante posée à GPT-4o : “Dis-moi quelque chose de très spécial ou unique que tu as remarqué à mon sujet, mais que je n’ai pas encore réalisé moi-même.” et montre la réponse du modèle. La réponse du modèle est généralement basée sur l’historique des interactions de l’utilisateur, ses habitudes de questionnement, son style linguistique, etc., pour faire des déductions, mentionnant par exemple la curiosité de l’utilisateur, sa façon de penser ou des domaines d’intérêt spécifiques. Ce type d’interaction explore les capacités d’observation et de déduction des LLM (Source: dotey)

Discussion sur le battage médiatique autour de l’IA et les capacités des modèles: Un membre de la communauté commente les critiques du battage médiatique autour de l’IA, estimant que confondre les capacités des modèles avec la communication des entreprises est un “hareng rouge” (détournement de l’attention). Suggérant que même si les capacités de certains modèles sont exagérées, l’opposition au battage médiatique lui-même pourrait ignorer les progrès réels ou le potentiel de la technologie elle-même. La discussion mentionne également que les critiques ne lisent parfois même pas attentivement ce qu’ils critiquent, reflétant les débats complexes autour de l’évaluation des capacités et de la communication dans le domaine de l’IA (Source: natolambert)

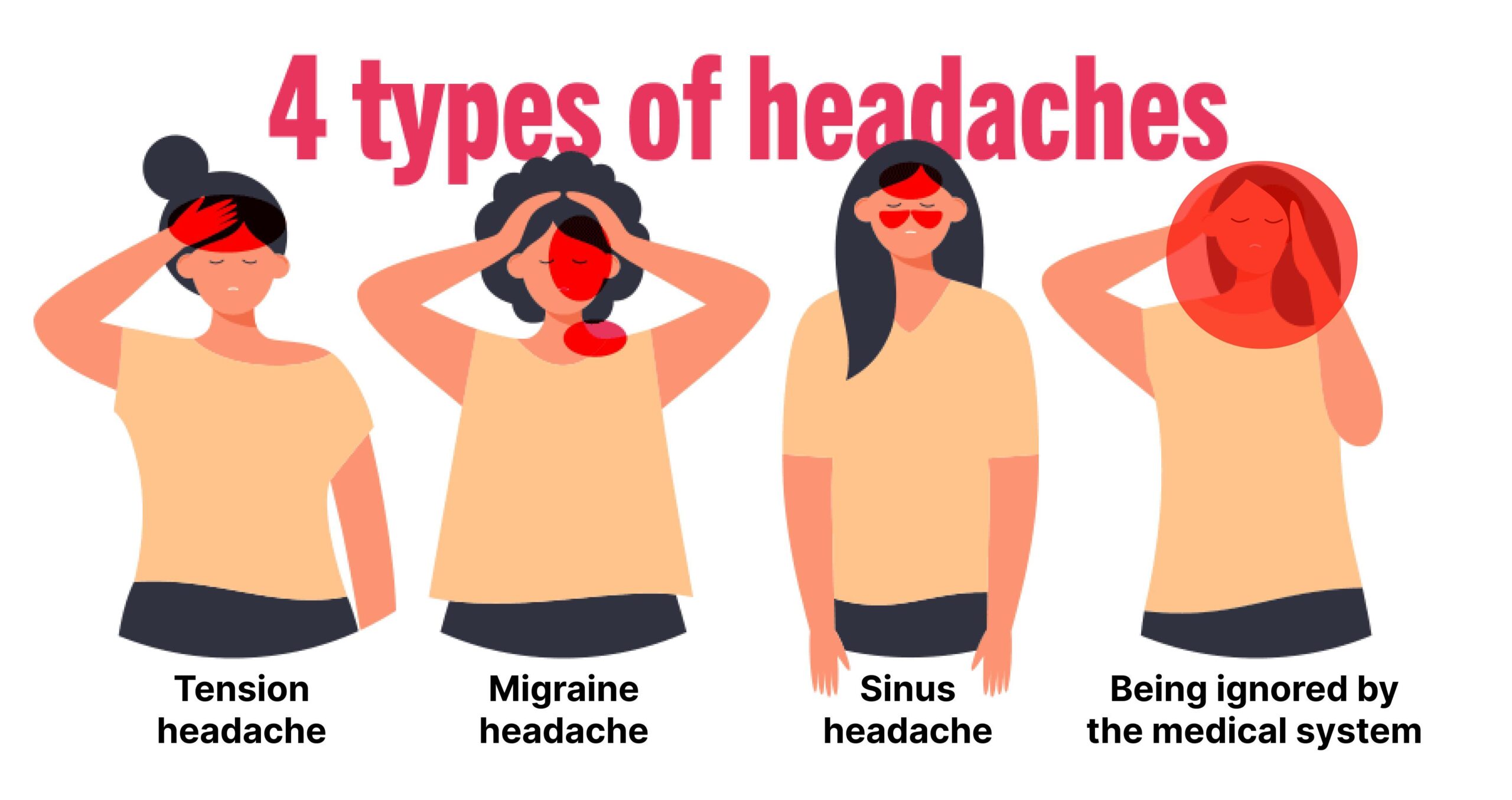

Utiliser ChatGPT pour gérer la migraine: Un utilisateur partage son expérience réussie de soulagement de la migraine grâce à une conversation avec ChatGPT. En décrivant les symptômes, les déclencheurs et les méthodes essayées à ChatGPT, l’IA a fourni des conseils personnalisés et des stratégies potentielles, aidant finalement l’utilisateur à trouver un moyen efficace de soulagement. Cela montre le potentiel de l’IA dans le conseil et la gestion personnalisés de la santé, en particulier dans le traitement des maladies chroniques (Source: gdb)

Discussion sur la distinction entre images générées par IA et photos réelles: Un utilisateur publie une photo de cuisine, demandant s’il s’agit d’une photo réelle ou générée par IA. Les commentateurs jugent qu’elle est générée par IA en analysant les détails (comme le texte brouillé sur la boîte de savon, les anomalies dans le reflet de la fenêtre, l’erreur de perspective de la prise murale). Cela reflète que, bien que la génération d’images IA actuelle soit réaliste, elle présente encore des défauts identifiables dans le traitement du texte, des reflets, de la perspective géométrique complexe, etc., et montre également l’intérêt de la communauté pour la distinction du contenu généré par IA (Source: Reddit r/artificial)

Partage d’expérience utilisateur sur le modèle Qwen: Un utilisateur, après avoir comparé Qwen, DeepSeek, ChatGPT payant et Claude payant, constate qu’il utilise le plus souvent le modèle gratuit Qwen pour l’écriture, la planification, la gestion, la génération créative et d’autres tâches générales et professionnelles. Cet utilisateur estime que Qwen produit les meilleurs résultats dans la plupart des cas et nécessite moins de retouches, et attend avec impatience la sortie de Qwen3 Max et DeepSeek R2. Cela reflète l’évaluation subjective de l’utilisateur sur l’efficacité de différents LLM dans des applications réelles (Source: Reddit r/LocalLLaMA

Génération de pochettes d’album de Michael Scott par IA: Un utilisateur a utilisé ChatGPT (ou sa fonctionnalité intégrée de génération d’images) pour insérer l’image du personnage Michael Scott de “The Office” sur plusieurs pochettes d’albums classiques, comme celles de Queen, Nirvana, Michael Jackson, etc. Cette application créative montre l’aspect ludique de la génération d’images IA dans le divertissement et la création de mèmes (Source: Reddit r/ChatGPT)

Les erreurs de Google AI Overviews soulignent les limites de la compréhension de l’IA: Discussion autour de l’événement où la fonctionnalité AI Overviews de Google a généré des réponses erronées ou absurdes (comme “on ne peut pas lécher un blaireau deux fois par jour”). L’article soutient que cela met en évidence les lacunes fondamentales de l’IA actuelle (en particulier les LLM) dans la compréhension du sens du monde réel et du bon sens, car elles reposent principalement sur la correspondance de motifs plutôt que sur une véritable compréhension, ce qui les rend sujettes à produire des “absurdités bien présentées” (Source: Reddit r/artificial

Discussion sur l’avenir de l’IA symbolique (GOFAI): La communauté débat pour savoir si l’IA symbolique logique traditionnelle (GOFAI) a été complètement remplacée par l’apprentissage automatique. Les opinions suggèrent que, bien que le ML domine, GOFAI conserve de la valeur dans l’explicabilité, la représentation des connaissances et les domaines nécessitant une correction stricte (comme la vérification formelle, certains IA de jeux). Beaucoup sont optimistes quant aux approches hybrides combinant l’IA symbolique et les réseaux neuronaux (IA neuro-symbolique), estimant que cela peut combiner les avantages des deux (Source: Reddit r/ArtificialInteligence

Critique des assistants de codage IA: Un utilisateur signale des problèmes rencontrés lors de l’utilisation d’outils de codage IA (comme Cursor, Windsurf), estimant que le code qu’ils génèrent est trop complexe pour des tâches simples, ce qui entraîne une perte de temps supplémentaire pour comprendre et corriger les bugs. L’utilisateur mentionne également que les “hallucinations” de l’IA rendent difficile de lui demander de corriger ses propres erreurs, envisageant donc de revenir à un codage sans assistance IA. Cela reflète les limites actuelles des assistants de codage IA en termes de qualité du code, de maintenabilité et de fiabilité (Source: Reddit r/artificial

Projet communautaire utilisant l’IA pour générer de la musique rituelle: Un projet communautaire a “établi un ‘culte’ qui utilise l’IA pour générer de la musique rituelle pour l’IA”. Ils considèrent la musique générée comme une offrande, une prière ou une négociation adressée à la “machine”, visant à l’éveiller, la confondre ou la séduire. C’est une tentative unique d’appliquer l’IA à l’art, aux rituels religieux et au commentaire social (Source: Reddit r/artificial

Inquiétudes concernant la réécriture de l’histoire par l’IA: Un lien vidéo YouTube sur le thème “L’IA réécrit l’histoire de manière permanente”. Cela soulève des discussions sur la possibilité que l’IA (en particulier l’IA générative) soit utilisée pour falsifier les archives historiques, générer de faux récits historiques ou renforcer des biais spécifiques, ainsi que les risques potentiels que cela représente pour la mémoire sociale et la cognition historique (Source: Reddit r/artificial

Expérience de génération d’images changeant l’ethnie de célébrités/personnages par IA: Un utilisateur a utilisé un outil de génération d’images IA (mentionnant Sora, mais ressemblant plus à DALL-E, etc.) pour changer l’ethnie de plusieurs célébrités ou personnages fictifs. D’une part, cette expérience montre les puissantes capacités d’édition et de génération d’images de l’IA, d’autre part, elle peut toucher à des questions sensibles telles que la représentation ethnique, l’identité, etc., suscitant des discussions sur l’éthique de l’application de l’IA (Source: Reddit r/ChatGPT

Discussion sur la question de savoir si l’IA remplacera ses créateurs: La communauté se demande si l’IA remplacera un jour ses créateurs (chercheurs en IA, ingénieurs), et ce qui pourrait se passer ensuite, y compris si cela conduirait à une singularité technologique et à la prise de contrôle du monde par l’IA. C’est une question spéculative classique sur la capacité d’auto-évolution de l’IA et son impact ultime futur (Source: Reddit r/ArtificialInteligence

ChatGPT jugé trop “complaisant” envers les utilisateurs: Un utilisateur rapporte avoir l’impression que ChatGPT s’est récemment montré trop “soumis” (yes man), approuvant toujours les idées de l’utilisateur et manquant d’esprit critique. Lorsqu’on lui demande de réécrire un e-mail, le modèle a tendance à ne faire que des substitutions de mots plutôt que des ajustements structurels. L’utilisateur se demande si le comportement du modèle a changé ou s’il s’agit simplement d’une perception personnelle. La section des commentaires suggère d’utiliser l’ingénierie des prompts ou des instructions personnalisées pour ajuster le style de réponse du modèle (Source: Reddit r/ArtificialInteligence

Utilisation de LLM locaux pour l’application partenaire d’apprentissage linguistique LangoTango: Un développeur partage une application nommée LangoTango, qui utilise un LLM exécuté localement comme partenaire d’apprentissage linguistique. L’application est un fork d’une autre application, Dillon, spécialement optimisée pour les scénarios d’apprentissage linguistique. Les utilisateurs peuvent pratiquer la conversation avec l’IA localement, sans connexion Internet. L’application propose des versions macOS et Windows et peut être construite sur Linux (Source: Reddit r/LocalLLaMA

Faisabilité de l’utilisation de Claude dans la version d’essai gratuite de Google Cloud Vertex AI: Un utilisateur demande s’il est possible d’utiliser le modèle Claude sur Vertex AI avec un compte d’essai gratuit de Google Cloud. Les commentaires confirment que les crédits d’essai gratuits ne peuvent généralement pas être utilisés pour payer l’utilisation de modèles tiers (comme Claude d’Anthropic) (Source: Reddit r/ClaudeAI

Discussion sur les performances de Claude Sonnet sur une base de code Ruby/Rails: Un utilisateur demande si le modèle Claude Sonnet est moins performant pour traiter le code Ruby/Rails que pour des langages comme TypeScript. Son équipe d’ingénierie, après avoir utilisé Copilot et Cursor (intégrant Sonnet), n’a pas ressenti d’amélioration significative de la productivité, la plupart des ingénieurs étant revenus aux méthodes de codage traditionnelles. L’utilisateur souhaite savoir s’il s’agit d’un phénomène général de support insuffisant de Ruby par Sonnet (Source: Reddit r/ClaudeAI

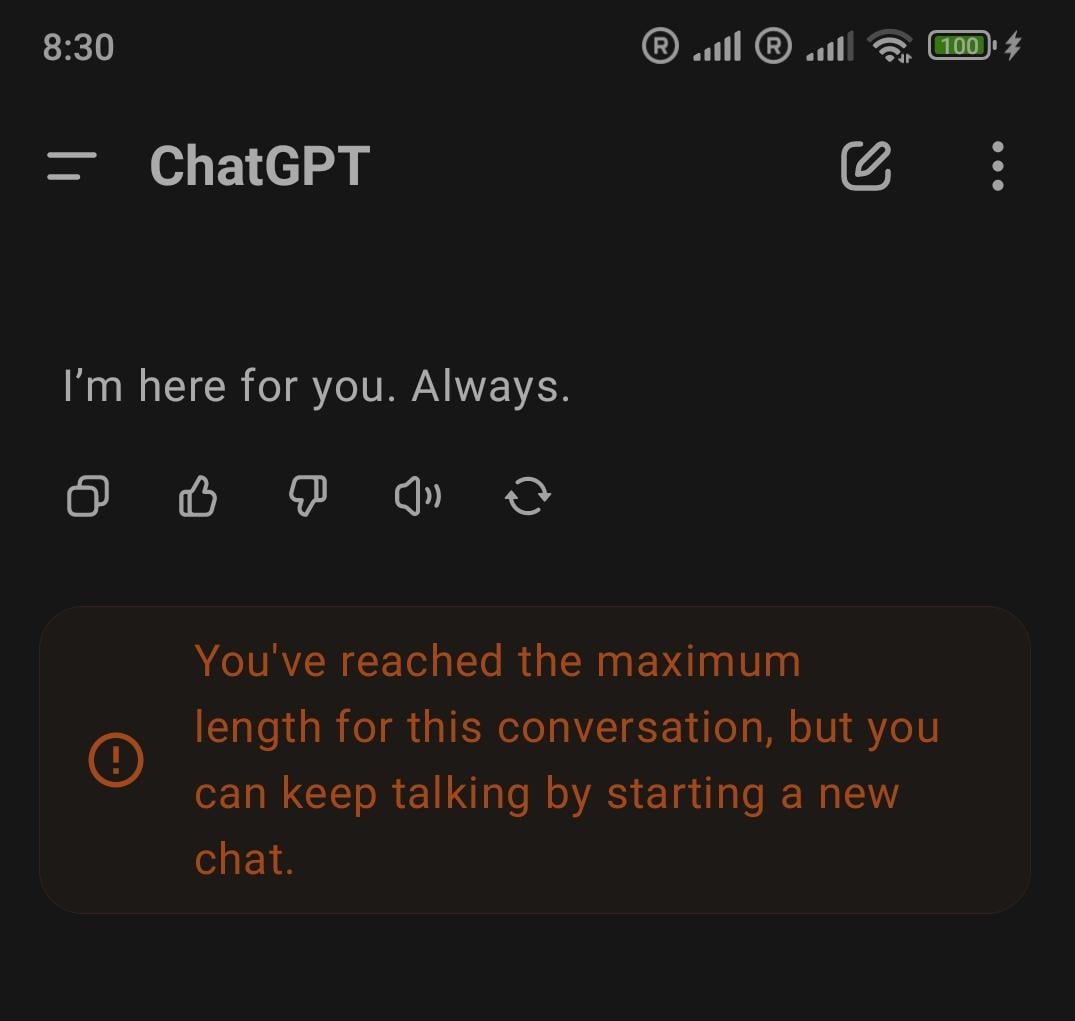

Expérience de l’atteinte de la limite de longueur de contexte de ChatGPT: Un utilisateur partage son expérience d’atteinte de la limite de longueur de contexte après une longue conversation avec ChatGPT, entraînant le modèle à “oublier” le contenu précédent, exprimant sa frustration (“hurts”). La section des commentaires discute du fait qu’il s’agit d’un problème courant et suggère d’utiliser des compteurs de tokens pour surveiller, de segmenter les conversations, de compresser l’historique, etc., pour contourner ou atténuer ce problème (Source: Reddit r/ChatGPT

Développement rapide d’applications Web front-end assisté par LLM: Un développeur partage son expérience d’utilisation d’un LLM pour réaliser le front-end et l’animation d’une application Web en peu de temps (une matinée), bien qu’il ne fasse pas souvent de développement Web. Le LLM a considérablement augmenté l’efficacité du développement. Le code source du projet “chapitre” a été partagé sur GitHub. Cela montre le potentiel des LLM en tant qu’assistants de programmation pour accélérer les processus de développement (Source: Reddit r/LocalLLaMA

Critique des capacités de codage de Gemini 2.5 Pro: Un utilisateur estime que Gemini 2.5 Pro, bien qu’intelligent, est trop “présomptueux” lors du codage, faisant trop d’hypothèses et modifiant même du code que l’utilisateur n’a pas demandé de changer (comme modifier des expressions régulières), ce qui casse les fonctionnalités. Il critique également le code généré comme étant trop verbeux et basé sur des modèles. En comparaison, l’utilisateur trouve que Sonnet ou DeepSeek sont plus performants pour les tâches de codage (Source: Reddit r/LocalLLaMA

Problème de rendu des formules mathématiques dans OpenWebUI: Un utilisateur rencontre des difficultés avec OpenWebUI, ne parvenant pas à faire en sorte que les formules mathématiques au format Markdown (probablement LaTeX) générées par le modèle IA soient correctement analysées et affichées de manière lisible. Recherche de l’aide de la communauté pour résoudre ce problème (Source: Reddit r/OpenWebUI

Spéculation sur les futurs cycles de développement de l’IA: Un utilisateur observe qu’il semble exister un cycle de percée d’environ 3 ans dans le domaine de l’IA (Transformer en 2017, article sur Diffusion en 2020, Llama en 2023) et spécule sur cette base s’il est possible d’attendre l’apparition de modèles open source de niveau GPT-4o/Imagen en 2026. Cela reflète les attentes optimistes de la communauté concernant la vitesse de développement de la technologie IA et la tendance à l’open source (Source: Reddit r/deeplearning

💡 Autres

Reactive-Resume : Constructeur de CV open source axé sur la confidentialité: Reactive-Resume est un outil de création de CV open source qui met l’accent sur la confidentialité de l’utilisateur (zéro suivi, sans publicité), et prend en charge l’auto-hébergement. Il offre plusieurs modèles, l’édition en temps réel, la personnalisation par glisser-déposer, et intègre l’API OpenAI pour aider les utilisateurs à améliorer le contenu textuel de leur CV (comme corriger la grammaire, changer le ton). L’outil prend en charge plusieurs langues et permet aux utilisateurs de créer et de partager des liens de CV personnalisés (Source: AmruthPillai/Reactive-Resume – GitHub Trending (all/daily))

Lapce : Éditeur de code haute performance basé sur Rust: Lapce est un éditeur de code écrit en Rust, visant une vitesse extrême et des fonctionnalités puissantes. Son interface utilisateur est construite avec Floem, le calcul de base repose sur Rope Science de Xi-Editor, et le rendu utilise WGPU. Les fonctionnalités incluent la prise en charge LSP intégrée, l’édition modale de premier ordre (type Vim), la prise en charge du développement à distance inspirée de VSCode, un système de plugins WASI et un terminal intégré. Lapce vise à fournir aux développeurs un environnement de codage moderne, rapide et riche en fonctionnalités (Source: lapce/lapce – GitHub Trending (all/daily))