Mots-clés:Agent IA intelligent, Robot humanoïde, Grand modèle de langage, Génération de contenu par IA (AIGC), Microsoft 365 Copilot, Modèle virtuel de mouche des fruits de DeepMind, Abus de thèse académique en IA, Modèle open source d’OpenAI, Commercialisation de l’IA pharmaceutique, Habitacle intelligent avec grand modèle côté terminal, Écosystème IA du protocole MCP, Techniques de peinture IA

🔥 À la une

Microsoft publie un rapport sur les agents IA et les tendances du travail pour 2025 : Microsoft lance une mise à jour majeure de Microsoft 365 Copilot, introduisant des agents IA tels que Researcher et Analyst, visant à élever l’IA du statut d’outil à celui de “collègue IA”. Les nouvelles fonctionnalités incluent Notebook (intégrant Web+Work+Pages), une recherche complète (à travers les applications et sources tierces) et Create (intégrant la génération d’images GPT-4o). Le rapport sur les tendances du travail pour 2025, publié simultanément, prédit l’émergence d‘“entreprises pionnières” (frontier companies), construites autour de “l’intelligence à la demande”, soutenues par des équipes “hybrides homme-machine”, et dont les employés devront posséder une “mentalité de ‘patron d’agent’“. Le rapport annonce que l’IA remodèlera profondément les modes de travail et les structures organisationnelles dans les années à venir, soulignant que les agents IA deviendront la force de production principale. (Source : 新智元)

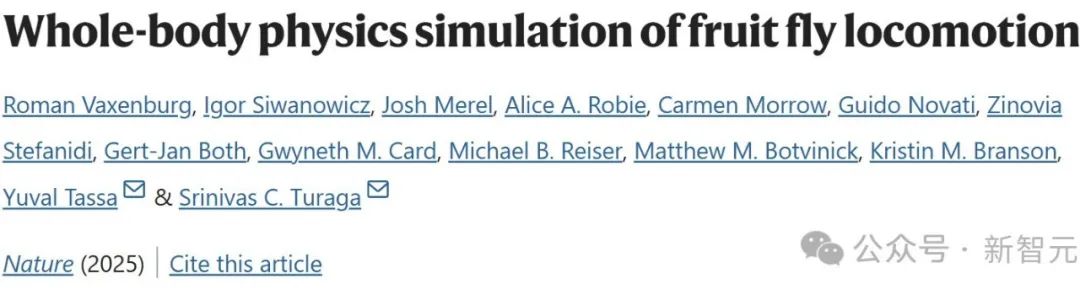

La simulation de drosophile par DeepMind fait la couverture de Nature : Google DeepMind, en collaboration avec l’Institut Janelia du HHMI, a créé un modèle virtuel de drosophile hautement réaliste en utilisant l’IA et des techniques de simulation physique. Ce modèle, basé sur des données de scan haute résolution, a été construit dans le moteur physique MuJoCo et intègre la dynamique des fluides ainsi que la simulation de l’adhérence des pattes. Grâce à l’apprentissage par renforcement profond et à l’apprentissage par imitation (utilisant des vidéos du comportement réel des drosophiles), un réseau neuronal IA a réussi à piloter la drosophile virtuelle pour simuler des comportements complexes de vol et de marche, y compris la navigation visuelle. Cette recherche révèle non seulement les mécanismes complexes derrière le mouvement biologique, mais fournit également une plateforme de recherche puissante pour les neurosciences et la robotique. Le modèle et le code ont été mis en open source, stimulant la recherche dans les domaines connexes. (Source : 新智元)

Nature révèle le phénomène d’abus de l’IA dans les publications académiques : Un article en première page de Nature souligne qu’un grand nombre de publications académiques (le tracker Academ-AI en a enregistré plus de 700) utilisent l’IA (comme ChatGPT) pour leur rédaction sans le déclarer, contenant même des traces évidentes telles que “Je suis un modèle de langage IA”. Plus inquiétant encore, certains éditeurs (comme Elsevier) ont été découverts en train de supprimer discrètement ces traces d’IA sans publier de corrigendum, soulevant des préoccupations quant à l’intégrité scientifique. Les chercheurs appellent les auteurs à divulguer clairement les modalités spécifiques d’utilisation de l’IA, et les éditeurs à établir des mécanismes de contrôle plus stricts et à publier ouvertement les corrections pour maintenir la transparence et la crédibilité de la recherche académique. (Source : 新智元)

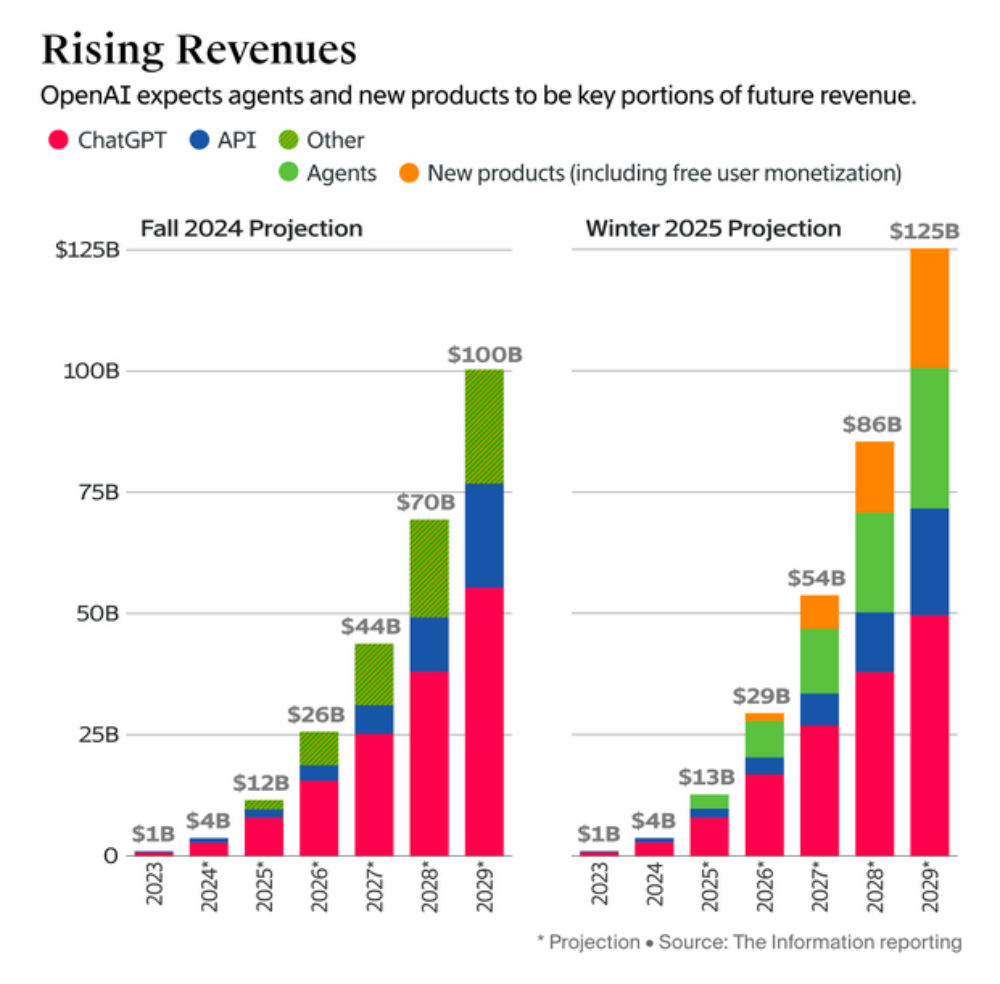

OpenAI prévoit une croissance rapide de ses revenus et envisage une restructuration, suscitant la controverse : OpenAI prévoit d’atteindre un chiffre d’affaires total de 125 milliards de dollars d’ici 2029, les revenus des nouvelles activités telles que les agents intelligents devant dépasser ceux de ChatGPT. Parallèlement, l’entreprise prévoit de se restructurer en une Public Benefit Corporation (PBC), une décision qui suscite l’opposition publique du parrain de l’IA Hinton et de 10 anciens employés, entre autres. Les opposants estiment que la restructuration affaiblirait le contrôle de l’organisation à but non lucratif, irait à l’encontre de l’objectif initial d’assurer le développement sûr de l’AGI au bénéfice de l’humanité, et placerait les intérêts commerciaux au-dessus de la mission caritative. Ils demandent à OpenAI d’expliquer comment la restructuration est conforme à sa mission et exigent le maintien des garanties de gouvernance de l’organisation à but non lucratif. (Source : 智东西, 腾讯科技, 学术头条)

🎯 Tendances

Les robots humanoïdes au centre de l’attention au Salon de l’auto de Shanghai, les constructeurs automobiles accélèrent leur déploiement : Au Salon de l’auto de Shanghai 2025, les robots humanoïdes sont devenus une nouvelle attraction. Xpeng a présenté le robot IRON capable d’interagir avec les humains et prévoit une production en série en 2026 pour ses usines ; Chery a exposé son robot auto-développé Mornine gen-1, doté de capacités de perception multimodale et de questions-réponses ; SAIC Roewe, Changan Deepal et d’autres ont également exposé des robots issus de collaborations ou importés pour attirer le public. Tesla, GAC, BYD (auto-développement et investissements dans ZY Robotics, Pasibot) et d’autres constructeurs automobiles accélèrent également la R&D et l’application des robots humanoïdes, misant sur leur potentiel dans la fabrication industrielle, les services, etc. Bien que les perspectives soient vastes, le secteur n’en est qu’à ses débuts, avec des incertitudes de marché et des risques de bulle. (Source : NBD汽车)

La province du Jilin mise sur l’industrie de la robotique et favorise la fusion des technologies automobiles et robotiques : Le Jilin, province automobile historique, se positionne activement dans l’industrie de la robotique. StarNeto, FAW Faway et le Centre d’innovation en robotique bionique de la province du Jilin ont signé un accord de coopération stratégique pour développer conjointement l’intelligence incarnée, les grands modèles, etc. Ce centre d’innovation, dirigé par l’Université de Jilin, vise à construire une chaîne industrielle complète de la robotique. Cette initiative tire parti de la base mature de la chaîne d’approvisionnement automobile du Jilin (forte superposition entre les composants et la technologie robotique) et s’inscrit dans les politiques de soutien nationales et locales (Shenzhen, Pékin) à l’industrie de l’intelligence incarnée. La technologie robotique, en particulier les aspects communs avec la conduite autonome, est considérée comme une nouvelle opportunité après l’intelligentisation de l’industrie automobile. (Source : 科创板日报)

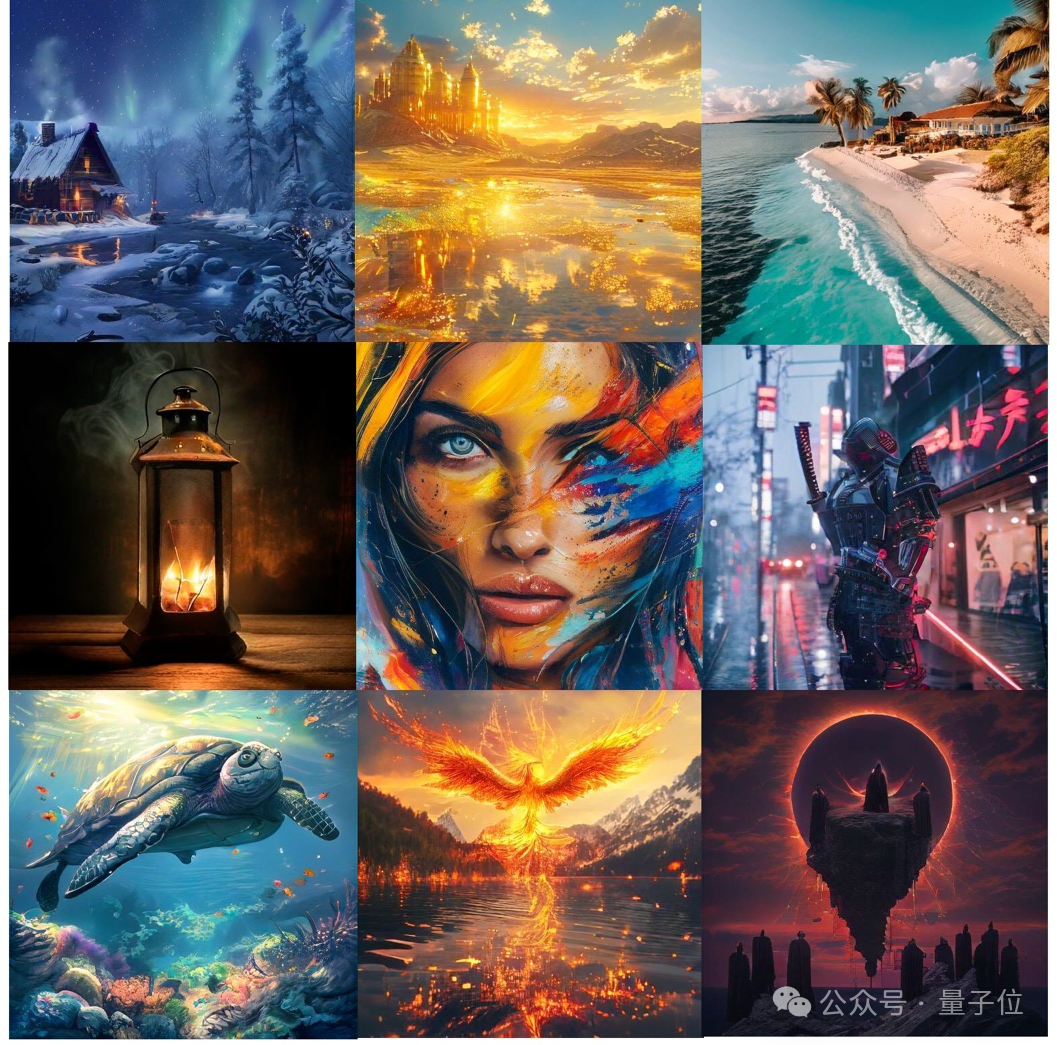

Le premier long métrage AIGC mondial, “Queen of the Sea: Zheng Yi Sao”, sort en salles : Ce film de 70 minutes, entièrement réalisé à l’aide de l’IA, raconte l’histoire de la légendaire pirate Zheng Yi Sao et est sorti à Singapour. La production a fait face à de nombreux défis : l’IA a du mal à gérer les longs dialogues et les mouvements de caméra complexes, générant facilement des images répétitives ou incohérentes ; la cohérence de l’apparence des personnages est difficile à garantir, entraînant des problèmes de “ressemblance fortuite” (look-alike) ou de “changement de visage” (face swapping), nécessitant une post-production manuelle. L’écriture du scénario, le storyboard et le montage restent dominés par l’humain, l’IA ne pouvant pas encore comprendre pleinement les détails historiques et les intentions créatives. Malgré ces limites, l’AIGC réduit considérablement le seuil d’entrée et les coûts de production, bénéficiant particulièrement aux nouvelles équipes, et démontre le potentiel et l’avenir de la collaboration homme-machine dans la production cinématographique. (Source : 深响)

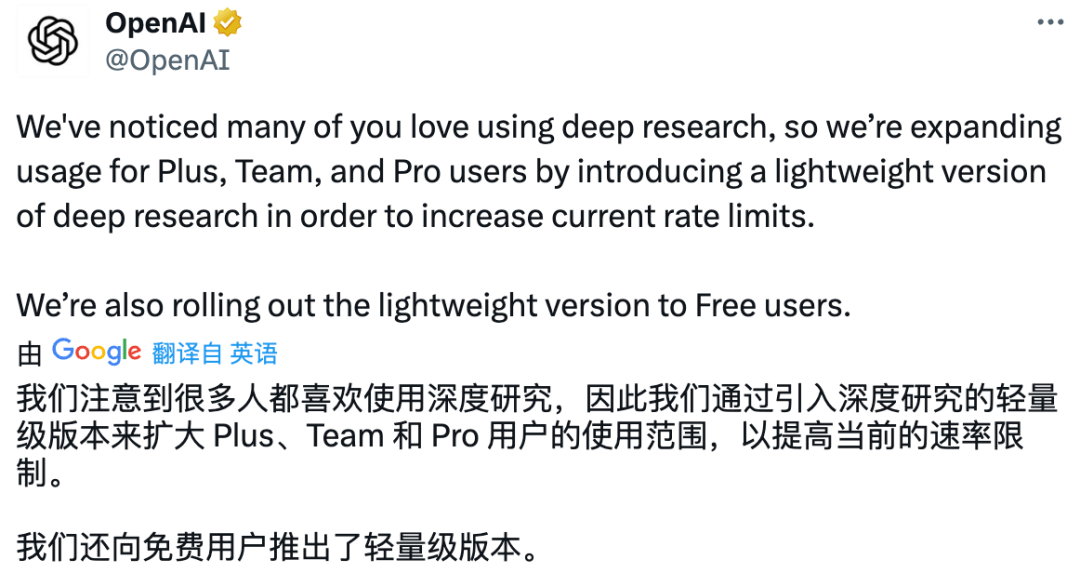

OpenAI lance une version allégée de la fonction Deep Research et l’ouvre aux utilisateurs gratuits : OpenAI a annoncé le lancement d’une version allégée de la fonction Deep Research, alimentée par o4-mini, visant à offrir un niveau d’intelligence proche de la version complète, mais avec des réponses plus concises et à moindre coût. Cette fonctionnalité est désormais ouverte aux utilisateurs Plus, Team, Enterprise, Edu ainsi qu’aux utilisateurs gratuits. Les utilisateurs payants basculeront automatiquement vers la version allégée après avoir épuisé leur quota de la version complète. Les tests montrent que la version allégée est rapide mais inférieure à la version complète en termes de profondeur d’information et de citation des sources, et moins performante pour les tâches complexes, agissant davantage comme un générateur d’idées qu’un rapport complet. La version complète, quant à elle, peut effectuer des recherches et des analyses approfondies, générer des rapports structurés, mais présente encore une marge d’amélioration. (Source : APPSO, 量子位, gdb)

Aperçu de Google I/O 2025 : IA native et fusion XR : Google I/O 2025, qui se tiendra le 20 mai, devrait mettre l’accent sur l’IA et la synergie multi-appareils. Android 16 intégrera profondément le grand modèle Gemini, en faisant une capacité native du système, et ouvrira davantage d’API aux développeurs. Visuellement, il adoptera le langage de conception Material 3 Expressive et renforcera l’adaptation aux tablettes, wearables et appareils XR. Le très attendu système d’exploitation Android XR fera ses débuts ; ce système, également centré sur Gemini comme moteur d’interaction principal, vise à connecter le réel et le virtuel. Les lunettes Google AI et l’appareil MR Project Moohan, en collaboration avec Samsung, devraient également être présentés, illustrant les plans de Google pour les assistants IA et l’écosystème XR ouvert. (Source : 雷科技)

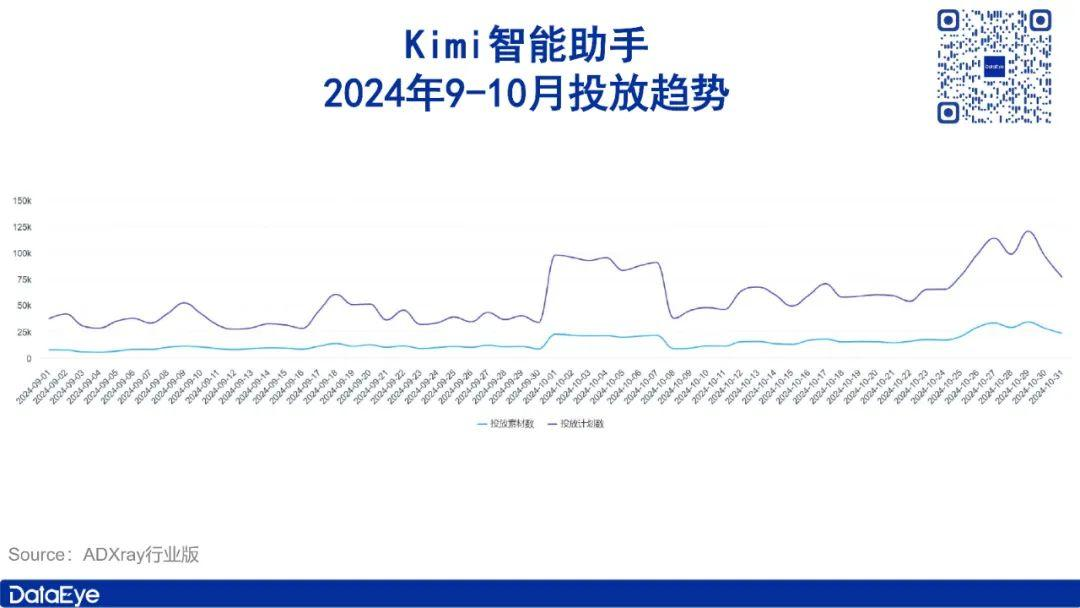

Moonshot AI teste une fonction de communauté de contenu pour Kimi afin de faire face à la concurrence : Face à l’impact de modèles comme DeepSeek, Moonshot AI teste une fonction de communauté de contenu pour son assistant IA Kimi. Cette communauté, actuellement en phase de test bêta (grayscale testing), propose du contenu principalement généré par l’IA et invite des chaînes de domaines verticaux à s’y joindre, avec des fonctionnalités interactives telles que les “likes” et les commentaires. Cette initiative est considérée comme une innovation de Moonshot AI au niveau applicatif, visant à construire un avantage concurrentiel différencié grâce à un écosystème de contenu, pour répondre à la pression concurrentielle de DeepSeek sur le plan technique. Auparavant, Kimi était devenu un produit phare sur le marché de l’IA grand public grâce à sa capacité de traitement de longs textes et à sa promotion marketing, mais a ensuite été dépassé en nombre d’utilisateurs par DeepSeek et Tencent Yuanbao, entre autres. (Source : 司库财经)

OpenAI prévoit de publier un nouveau modèle open source cet été : Selon TechCrunch, OpenAI prévoit de publier un nouveau grand modèle de langage open source cet été, sous une licence permissive autorisant le téléchargement gratuit et l’utilisation commerciale. Ce modèle vise à surpasser en performance les modèles open source existants de Meta (Llama) et DeepSeek, et pourrait inclure une fonction de “relais” (handoff) : lorsque le modèle open source rencontre une difficulté, il pourrait faire appel au grand modèle cloud d’OpenAI pour l’aider à traiter la tâche. Cette initiative est considérée comme un changement majeur dans la stratégie open source d’OpenAI, visant à attirer les développeurs, à renforcer sa compétitivité et à perfectionner son écosystème IA. (Source : 智东西)

Le protocole MCP stimule le développement de l’écosystème des Agents IA, mais fait face à des défis commerciaux : Le protocole MCP (Model Communication Protocol) vise à standardiser l’interaction entre les modèles IA et les outils/services externes, simplifiant la complexité de l’intégration (passant de M×N à M+N), et est salué comme “l’interface USB-C” des applications IA. La démonstration réussie de Manus Agent et le soutien de géants comme OpenAI (ainsi que des acteurs chinois comme Alibaba, Tencent, Baidu) au MCP ont considérablement favorisé sa popularisation et le développement de l’écosystème des Agents. Cependant, tout en adoptant le MCP, les différents acteurs construisent souvent des écosystèmes “entièrement fermés” (par exemple, Alibaba Cloud intégrant AutoNavi, Tencent Cloud accédant à WeChat Read) pour protéger leurs propres données et avantages écosystémiques, ce qui pourrait entraîner une fragmentation de l’écosystème et limiter le potentiel du MCP à devenir une norme véritablement universelle. L’avenir de l’écosystème des Agents pourrait présenter un paysage “d’ouverture limitée”, avec le MCP agissant comme un “connecteur d’écosystème” plutôt que comme la seule norme. (Source : 产业家)

La guerre des prix des grands modèles se poursuit, Robin Li de Baidu qualifie DeepSeek de “lent et cher” : Baidu a lancé les modèles Wenxin 4.5 Turbo et X1 Turbo, soulignant leur meilleur rapport qualité-prix par rapport à DeepSeek. Robin Li a indiqué que DeepSeek est non seulement limité en capacités (principalement traitement de texte), mais aussi coûteux en appels et lent. Le prix de Wenxin 4.5 Turbo est inférieur à celui de DeepSeek V3 pendant sa période promotionnelle, et celui de X1 Turbo est équivalent à celui de DeepSeek R1 pendant sa promotion, mais bien inférieur à son prix standard. De nouveaux modèles comme Doubao de ByteDance et Gemini Flash de Google adoptent également des stratégies de bas prix. Cependant, l’article souligne que le rapport qualité-prix seul ne suffit pas pour gagner, le succès de DeepSeek résidant dans ses innovations techniques comme la chaîne de pensée (chain-of-thought) qui offrent une expérience unique. Les voies de monétisation des modèles chinois sont relativement limitées (principalement la facturation d’API), tandis qu’à l’étranger (comme OpenAI), il existe des modèles plus diversifiés (abonnements grand public, etc.). (Source : 直面AI)

Dix ans d’évolution de l’industrie pharmaceutique IA, confrontée à des défis de commercialisation et technologiques : L’industrie pharmaceutique IA, développée depuis plus de dix ans, vise à améliorer l’efficacité et à réduire les coûts du développement de médicaments grâce à l’IA. La récente suppression par la FDA de l’exigence d’expérimentation animale favorise les méthodes alternatives comme la modélisation IA. Le secteur a connu un engouement capitalistique (pic en 2021), mais entre dans une phase d’ajustement avec l’échec de certains pipelines en phase clinique (comme BenevolentAI) et le reflux des capitaux. Des entreprises phares comme XtalPi (IA+CRO), après son introduction en bourse, se sont étendues à des domaines comme l’IA+nouveaux matériaux pour chercher des retours sur commercialisation plus rapides ; Insilico Medicine maintient son modèle “pipeline auto-développé + License Out” et a conclu plusieurs accords de licence. L’industrie reste confrontée à des défis tels que la difficulté d’acquisition des données (les données clés des sociétés pharmaceutiques ne sont pas partagées), le long cycle de validation des algorithmes et l’absence de médicaments approuvés. Cependant, des avancées technologiques comme AlphaFold et l’IA générative apportent de nouveaux espoirs, et le secteur attend le “point de singularité” du premier médicament développé par l’IA à être commercialisé avec succès. (Source : 亿欧网)

Le grand modèle côté terminal de ModelBest pilote le cockpit intelligent, production en série et intégration véhicule en dix mois : ModelBest a lancé cpmGO, un assistant de cockpit intelligent piloté par son grand modèle côté terminal MiniCPM, qui a été produit en série sur les nouvelles voitures de Changan Mazda en seulement 10 mois. cpmGO fonctionne purement en local, garantissant la confidentialité des données, offrant une réponse en millisecondes et n’étant pas limité par la connectivité réseau. Il dispose de capacités de perception multimodale (visuelle, vocale, UI) et d’interaction, prend en charge l’opération “ce qui est visible est énonçable” (see and speak), et intègre un Agent GUI purement côté terminal capable de comprendre et d’exécuter des opérations à l’écran. ModelBest a collaboré avec plusieurs fabricants de puces et fournisseurs Tier1, dont Qualcomm, MediaTek, Intel et Thundercomm, pour promouvoir l’application de l’IA côté terminal dans le domaine automobile, visant à résoudre les problèmes de coût, de latence et de confidentialité des solutions cloud, et à réaliser une expérience de cockpit intelligent plus fluide et sécurisée. (Source : 量子位)

L’Institut d’Intelligence Scientifique de Shanghai utilise l’IA pour piloter le changement de paradigme de recherche dans de multiples domaines : L’Institut d’Intelligence Scientifique de Shanghai (SAII), en collaboration avec l’Université Fudan et d’autres institutions, s’appuie sur la plateforme de calcul intelligent CFFF (puissance de calcul de 40 PFlop/s) pour utiliser l’IA afin de faire progresser la recherche dans les domaines des sciences de la vie, de la météorologie, des matériaux, de la médecine, du climat, et des sciences humaines et sociales. Les réalisations comprennent : le grand modèle météorologique “Fuyao” permettant des prévisions météorologiques urbaines au kilomètre et à la seconde près ; le grand modèle de sciences de la vie “Nüwa” accélérant le développement de médicaments siRNA ; le grand modèle de matière “Suiren” explorant de nouveaux matériaux et la découverte de médicaments ; le développement du grand modèle spécialisé en cardiologie “Guanxin CardioMind” en collaboration avec l’hôpital Zhongshan ; le grand modèle climatique PI@Climate intégrant des connaissances multidisciplinaires pour faire face au changement climatique ; l’algorithme VI-CNOPs optimisant la prévision probabiliste de la trajectoire des typhons ; le grand modèle de la civilisation chinoise aidant à la recherche archéologique et sur les écritures anciennes ; ainsi que des avancées dans les technologies IA fondamentales telles que l’apprentissage fédéré, le multimodal et l’apprentissage sur graphes, construisant conjointement un écosystème d’intelligence scientifique ouvert et collaboratif. (Source : 量子位)

🧰 Outils

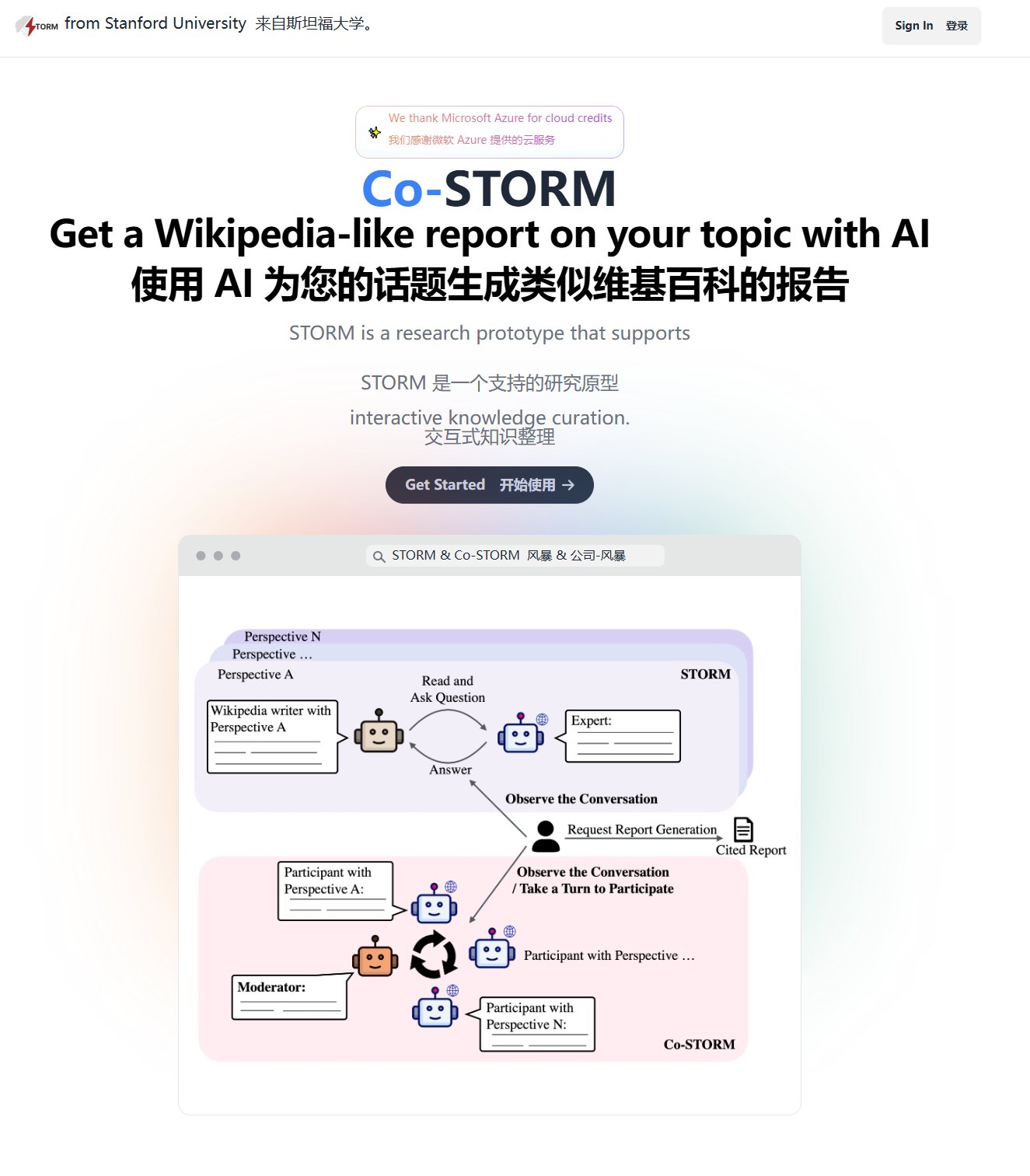

L’Université de Stanford publie en open source l’outil de génération de rapports IA Storm : Storm est un outil IA capable d’effectuer automatiquement des recherches sur le web, de consolider des informations et de générer des rapports structurés de style Wikipédia. L’utilisateur saisit un sujet, et Storm simule le flux de travail d’un chercheur : planification du plan de recherche, recherche de sources d’information pertinentes, consolidation des informations et rédaction du rapport. Ceci est très utile pour les utilisateurs ayant besoin de rédiger rapidement des rapports de contexte, des revues de littérature ou des analyses approfondies. Le projet est open source sur GitHub et propose une version d’essai en ligne. (Source : karminski3)

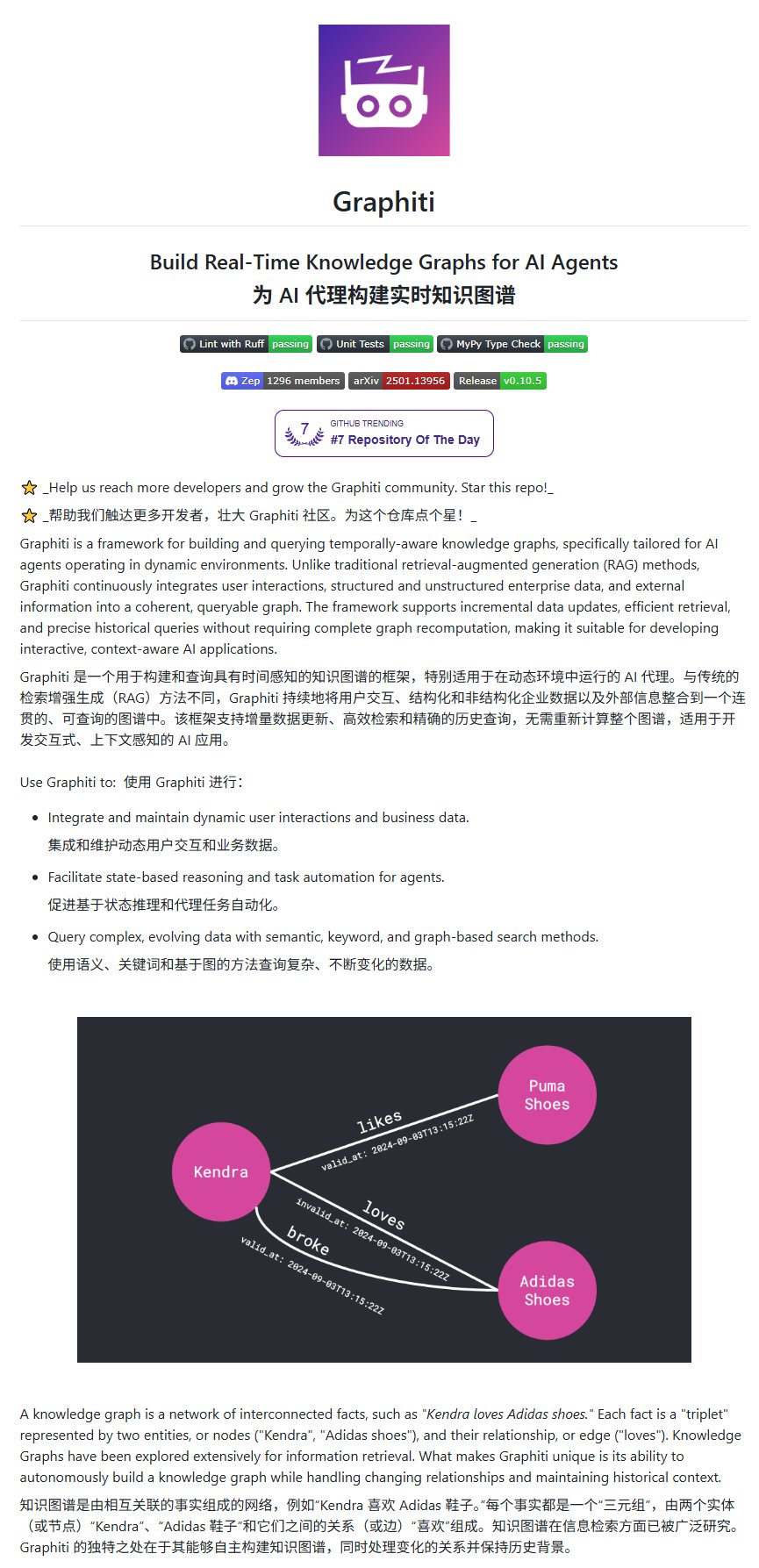

Publication du framework open source de graphe de connaissances Graphiti : Graphiti est un framework capable d’intégrer en continu les interactions utilisateur, les données structurées/non structurées et les informations externes dans un graphe de connaissances interrogeable. Sa particularité est de prendre en charge la mise à jour incrémentielle et la récupération efficace, sans nécessiter de recalculer l’ensemble du graphe, ce qui le rend particulièrement adapté au développement d’applications IA interactives nécessitant une conscience du contexte et une traçabilité historique. Le projet a suscité un intérêt notable sur GitHub (4.4K étoiles). (Source : karminski3)

Mise à jour Lovable 2.0, améliorant l’expérience de création de sites web IA : L’outil de création de sites web IA Lovable lance sa version 2.0, ajoutant l’édition collaborative multi-utilisateurs, un scan de sécurité automatique, un agent conversationnel 10 fois plus intelligent, un mode développeur pour éditer le code directement dans l’application, et la prise en charge des domaines personnalisés. La marque et l’interface utilisateur ont également été mises à jour, visant à offrir une expérience de développement de sites web pilotée par l’IA plus puissante, sécurisée et collaborative. (Source : op7418)

Le modèle vidéo “Dreamina” de ByteDance mis à niveau, améliore la cohérence multi-plans : L’outil de génération vidéo “Dreamina” (即梦) de ByteDance a publié une mise à jour du modèle 3.0. Selon les exemples partagés par les utilisateurs, le nouveau modèle montre une excellente cohérence des personnages et des scènes lors de la génération de vidéos multi-plans en une seule fois, et cet effet de cohérence peut être reproduit de manière stable. Le modèle prend en charge les modes texte-vers-vidéo et image-vers-vidéo, améliorant considérablement la praticité et la qualité de la création vidéo IA. (Source : op7418)

WAN Video entre en phase de commercialisation, mais continue d’offrir un service gratuit : La plateforme de génération vidéo IA WAN Video annonce son passage à la commercialisation, mais lance simultanément un “Relax mode” gratuit, offrant un nombre illimité de générations gratuites. Un exemple partagé par un utilisateur montre son efficacité à générer une scène de guerre de soldats Lego ; bien que les prompts requis soient exigeants, le résultat est acceptable. Cela offre aux utilisateurs l’opportunité d’expérimenter et d’utiliser gratuitement les capacités de génération vidéo IA. (Source : dotey)

Le TTS de MiniMax intégré à MCP-Server, simplifiant le développement d’applications multimodales : MiniMax met à disposition ses puissantes capacités de TTS (synthèse vocale) en chinois et de clonage vocal, ainsi que ses outils de texte-vers-image/vidéo et image-vers-vidéo, via le MCP-Server (Model Communication Protocol Server) open source. Les utilisateurs peuvent facilement appeler ces outils depuis des clients compatibles MCP comme Cursor, permettant des applications créatives telles que la génération de romans audio avec distribution des rôles ou le clonage de la voix d’Elon Musk pour raconter des histoires. Le protocole MCP simplifie l’intégration des modèles et outils IA, abaissant le seuil de développement. (Source : 袋鼠帝AI客栈)

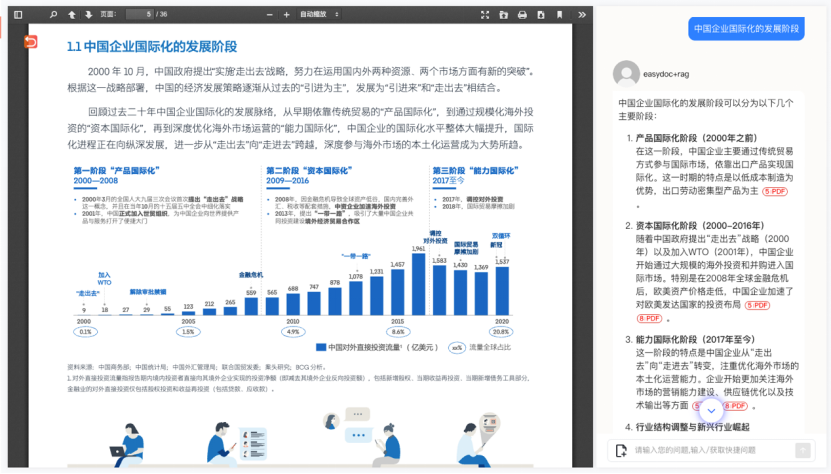

EasyDoc : Moteur d’analyse de documents intelligent optimisé pour RAG : EasyDoc fournit un service API pour analyser des documents PDF, Word, PPT, etc., et générer une sortie au format JSON adaptée au traitement par les LLM. Son avantage réside dans sa capacité à identifier intelligemment les blocs de contenu, à analyser la structure hiérarchique du document (en préservant la relation parent-enfant), et à interpréter en profondeur le contenu des tableaux et des images (fournissant des données structurées et une compréhension sémantique), résolvant efficacement les points sensibles du prétraitement des documents dans les applications RAG, tels que la mise en page mixte texte-image complexe ou l’extraction imprécise des tableaux. Il propose trois modes (Lite, Pro, Premium) ainsi qu’un quota d’essai gratuit, et prend en charge le déploiement privé (on-premise). (Source : AI进修生)

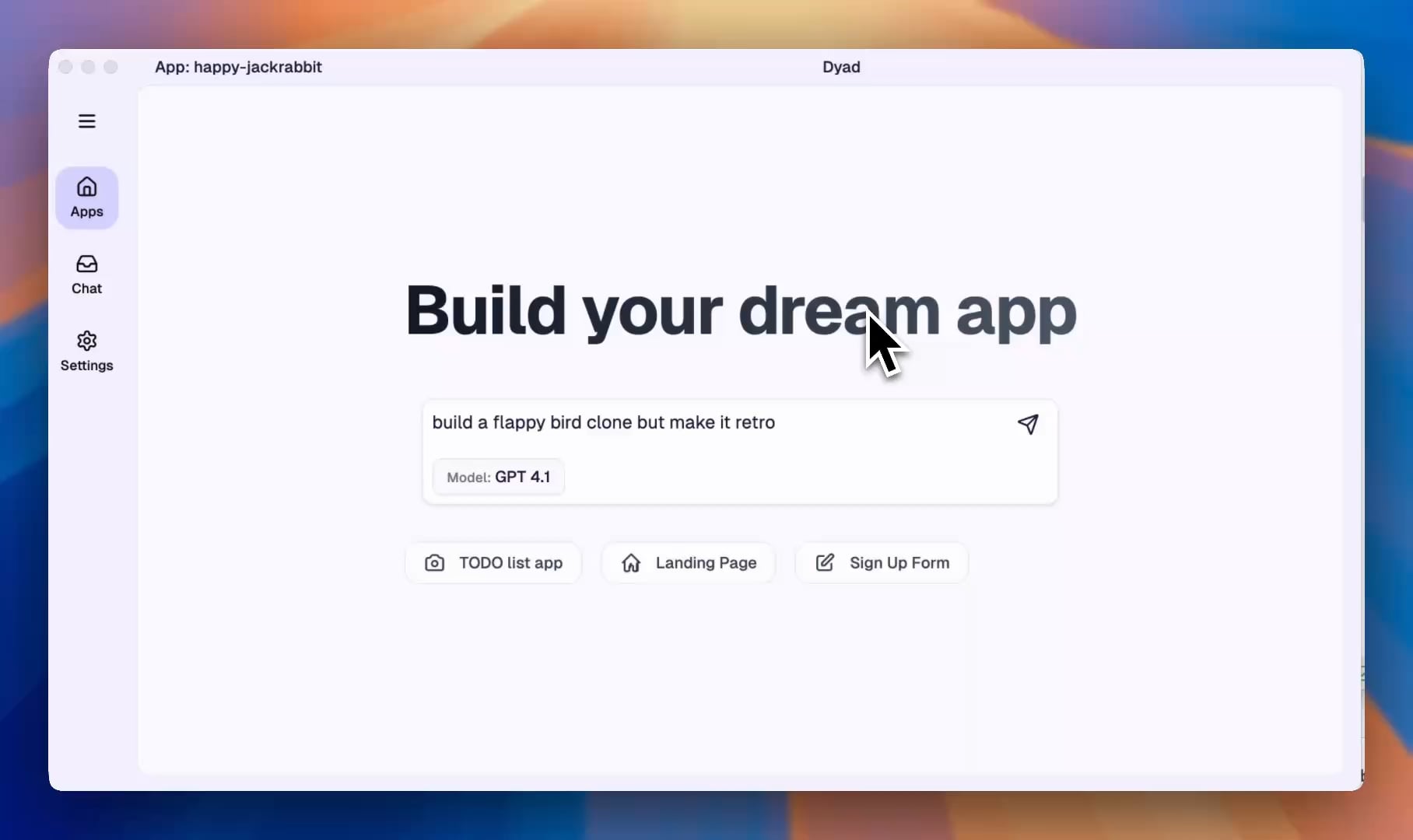

Dyad : Constructeur d’applications IA localisé et open source : Dyad est un outil de construction d’applications IA gratuit, open source et exécutable localement, se positionnant comme une alternative aux plateformes telles que v0, Lovable, Bolt, etc. Il permet aux utilisateurs de développer sur leur ordinateur local, facilitant l’intégration avec des IDE (comme Cursor). La dernière version ajoute l’intégration avec Ollama, prenant en charge la construction à l’aide de grands modèles de langage locaux. Les utilisateurs peuvent utiliser des clés API gratuites (comme Gemini) pour le développement. (Source : Reddit r/LocalLLaMA)

📚 Apprentissage

WuWenXinQiong partage les tendances et pratiques de l’AI Infra : Liu Chuanlin, architecte de solutions en chef chez WuWenXinQiong, a partagé les tendances et les pratiques de l’infrastructure IA lors de la conférence AI Partner. Il a souligné qu’avec l’épuisement progressif des données de pré-entraînement, l’apprentissage par renforcement (comme le paradigme DeepSeek R1) devient essentiel pour améliorer les performances des modèles, ce qui pose de nouveaux défis à l’infrastructure. WuWenXinQiong s’appuie sur ses capacités d’optimisation combinée logicielle et matérielle pour construire une plateforme de calcul prenant en charge des puces nationales hétérogènes et diversifiées. Grâce à son framework d’entraînement auto-développé, à l’optimisation de l’efficacité de la communication et à l’allocation dynamique des ressources, elle s’adapte aux besoins d’entraînement des modèles LLM et MoE, et fournit un support pour l’entraînement de modèles multimodaux comme ceux de ShengShu Technology. Parallèlement, pour les scénarios d’inférence, elle a optimisé le déploiement de DeepSeek R1 et résolu le problème des fluctuations de trafic AIGC grâce à un service interfacé basé sur ComfyUI, réduisant ainsi les coûts des applications IA. (Source : 36氪)

DAMO Academy publie l’architecture open source DyDiT : puissance de calcul divisée par deux, qualité de génération visuelle préservée : DAMO Academy et d’autres institutions ont proposé l’architecture dynamique DyDiT à l’ICLR 2025, visant à optimiser l’efficacité de l’inférence des modèles DiT (Diffusion Transformer). DyDiT peut ajuster dynamiquement l’allocation des ressources de calcul en fonction du pas de temps du processus de génération et de la région spatiale de l’image, réduisant le calcul pour les étapes simples ou les zones d’arrière-plan. Les expériences montrent qu’avec un faible coût de fine-tuning, DyDiT peut réduire les FLOPs d’inférence du modèle DiT-XL de 51%, augmenter la vitesse de 1,73 fois, tout en maintenant la qualité de l’image générée (indice FID) presque inchangée. Cette méthode est open source et il est prévu de l’adapter à d’autres modèles texte-vers-image/vidéo. (Source : 量子位)

UniToken : Solution d’encodage visuel unifiée fusionnant compréhension et génération : L’Université Fudan et Meituan proposent le framework UniToken, visant à résoudre le problème de la fragmentation des représentations et de l’interférence d’entraînement entre les tâches de compréhension texte-image et de génération d’images dans les grands modèles multimodaux. UniToken fusionne deux encodeurs visuels, continu (SigLIP) et discret (VQ-GAN), pour fournir aux tâches en aval une représentation visuelle unifiée combinant sémantique de haut niveau et détails de bas niveau. Adoptant une stratégie d’entraînement multi-étapes (alignement sémantique visuel, entraînement conjoint multi-tâches, instruction fine-tuning) et combinée à des techniques d’amélioration visuelle fine (AnyRes, fine-tuning ViT), UniToken atteint des performances SOTA ou proches de SOTA sur plusieurs benchmarks. Le code et les modèles sont open source. (Source : 量子位)

Tsinghua et al. proposent l’apprentissage par renforcement au moment du test TTRL : Pour pallier les limites de généralisation des techniques existantes de mise à l’échelle au moment du test (TTS) face à de nouvelles distributions de données, et le manque de signal de récompense dans l’entraînement au moment du test (TTT), l’Université Tsinghua et Shanghai AI Lab proposent le TTRL (Test-Time Reinforcement Learning). Cette méthode peut, en l’absence de données annotées, utiliser les connaissances a priori du modèle lui-même pour générer des pseudo-labels et des signaux de récompense via des méthodes telles que le vote majoritaire, afin d’effectuer un apprentissage par renforcement sur les LLM. Les expériences montrent que le TTRL peut améliorer continuellement les performances du modèle sur diverses tâches, par exemple en augmentant l’indice pass@1 de Qwen-2.5-Math-7B sur AIME 2024 de 159%, atteignant des performances proches des modèles entraînés de manière supervisée. (Source : AINLPer)

SJTU & Ant Group proposent le mécanisme d’attention hybride Rodimus : Pour résoudre le problème de la haute complexité spatio-temporelle causée par le cache KV lors de l’inférence des Transformers, l’Université Jiao Tong de Shanghai et Ant Group proposent la série de modèles Rodimus. Cette architecture améliore la mise à jour d’état de l’attention linéaire via un mécanisme de sélection thermo-contrôlé basé sur les données (DDTS) et le combine avec une attention à clé partagée par fenêtre glissante (SW-SKA), fusionnant efficacement la compression sémantique, de Token et de Head. Rodimus* peut atteindre une complexité spatiale O(1) lors de l’inférence. Les modèles de code légers Rodimus+-Coder (1.6B et 4B) entraînés sur la base de cette architecture atteignent des performances SOTA à taille égale. L’article a été accepté à l’ICLR 2025 et le code est open source. (Source : AINLPer)

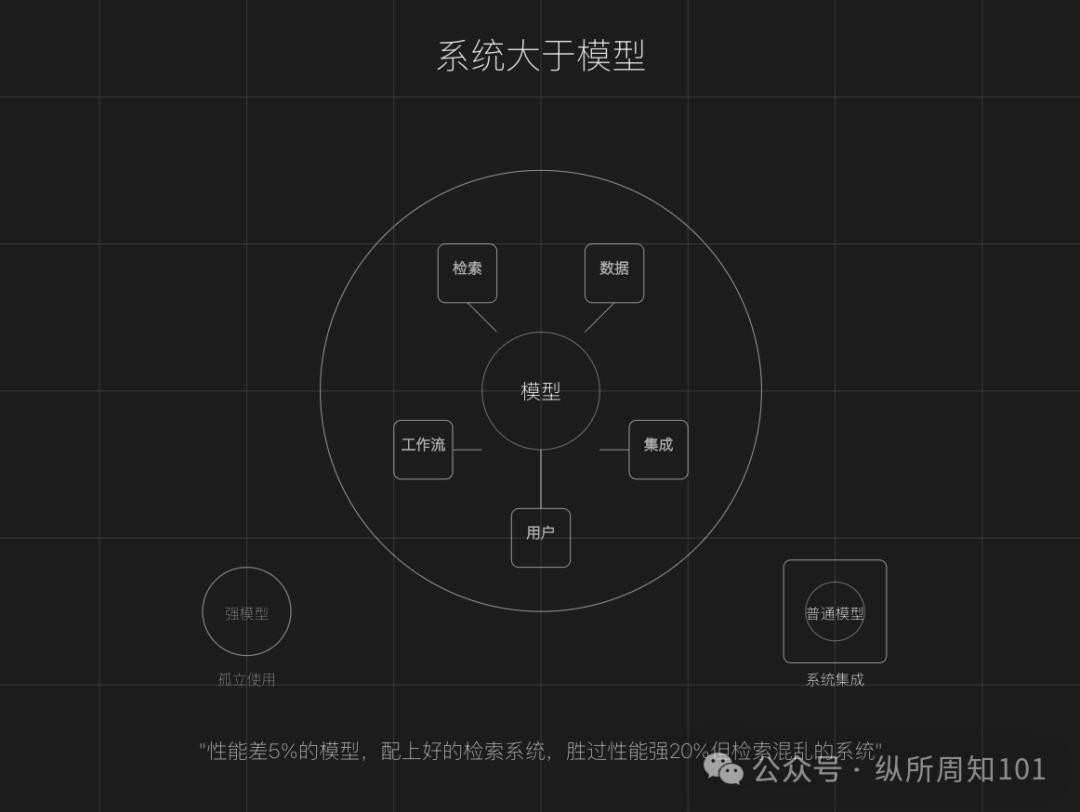

Dix leçons apprises du déploiement des Agents RAG : Douwe Kiela, fondateur de Contextual AI, partage son expérience du déploiement des Agents RAG : 1. La capacité du système prime sur la performance du modèle ; 2. L’expertise interne est le carburant de la valeur fondamentale ; 3. La capacité à traiter des données massives et bruitées est un avantage concurrentiel ; 4. La mise en production est bien plus difficile que le pilote ; 5. La vitesse prime sur la perfection, itérer rapidement ; 6. Le temps des ingénieurs est précieux, éviter le piège de l’optimisation de bas niveau ; 7. Abaisser le seuil d’utilisation, intégrer aux systèmes existants ; 8. Créer des “moments d’émerveillement” pour fidéliser les utilisateurs ; 9. L’observabilité (attribution, audit) est plus importante que la précision ; 10. Viser haut, oser défier le cœur de métier. (Source : AI觉醒)

💼 Affaires

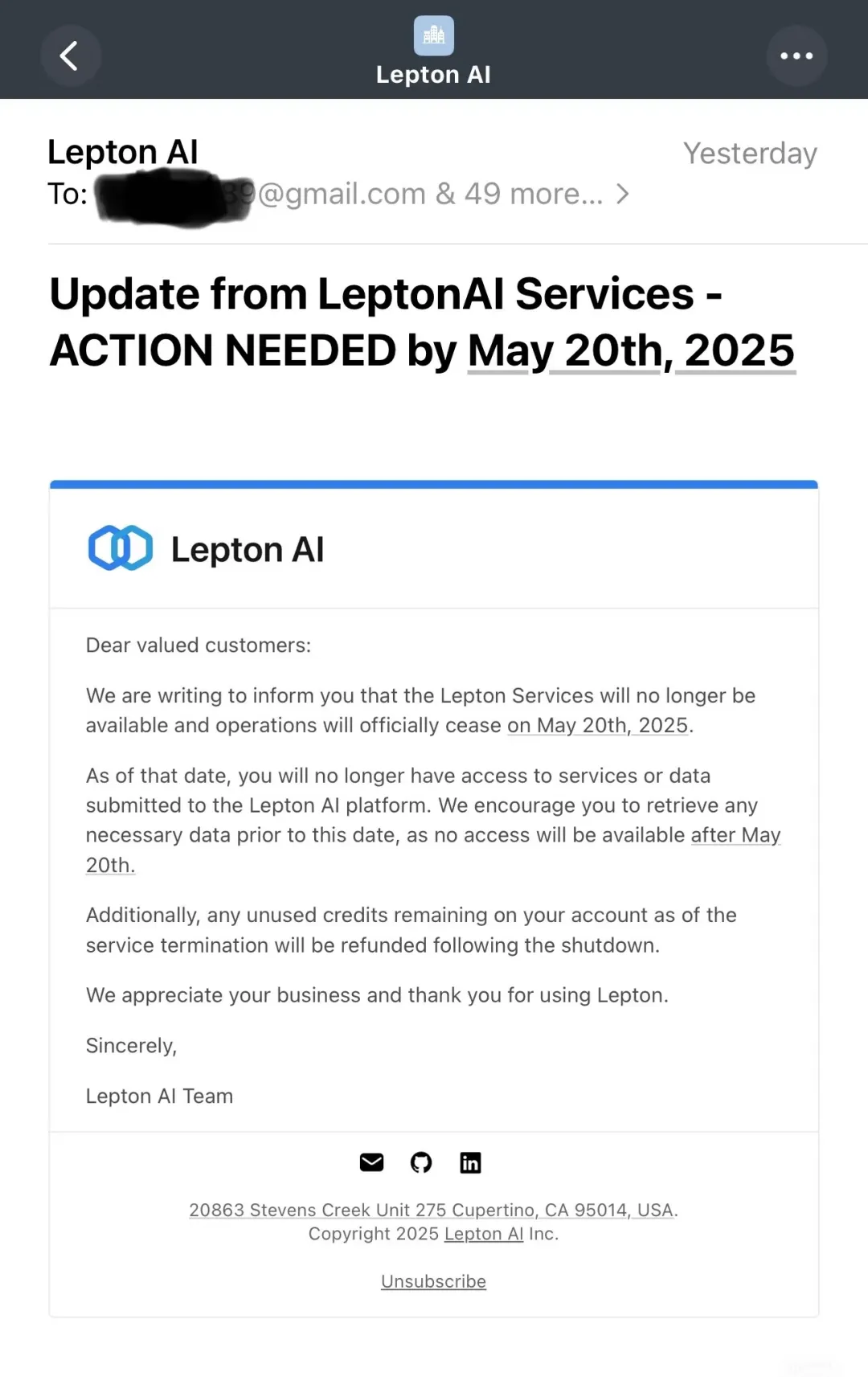

Nvidia cesse les opérations de Lepton AI après son acquisition : Nvidia, après avoir acquis Lepton AI, la société de plateforme cloud IA fondée par Yangqing Jia et Junjie Bai, a annoncé qu’elle cesserait les opérations de la plateforme Lepton AI le 20 mai 2025 et a déjà arrêté l’enregistrement de nouveaux utilisateurs. Yangqing Jia a répondu que la transaction n’était “pas une acquisition de talents (acqui-hire)”, mais n’a pas donné plus de détails. Lepton AI se concentrait sur la fourniture de services cloud pour le développement, l’entraînement et le déploiement de modèles IA, ainsi que sur la location de puissance de calcul, entrant en concurrence avec certains clients de Nvidia (comme CoreWeave). Cette acquisition et les actions qui ont suivi pourraient refléter la tentative de Nvidia de renforcer son intégration verticale de la chaîne d’approvisionnement IA (des puces aux services), afin d’accroître sa position dominante dans le domaine du calcul IA. (Source : AI前线)

Table ronde des investisseurs à la conférence AI Partner : À la recherche de certitudes dans les super-applications IA : Lors de la conférence AI Partner de 36Kr, des investisseurs tels que Wu Nan de GSR United Capital, Zou Zejiong de Shanghai Industrial Investment, et Ren Bobing de Sinovation Ventures ont discuté de la logique d’investissement dans les super-applications IA. Les investisseurs estiment que, malgré les incertitudes concernant la technologie sous-jacente et le paysage du marché, des opportunités certaines existent dans les applications verticales capables de résoudre des problèmes concrets, de trouver leur Product-Market Fit (PMF) et de générer des revenus, comme l’IA+santé, l’IA+éducation, la conduite autonome, etc. Face à la concurrence des géants (Big Tech), les startups devraient se concentrer sur les domaines verticaux, en exploitant les scénarios de niche et le savoir-faire approfondi (Know-How) que les grands acteurs ne peuvent couvrir pour établir des barrières à l’entrée. Parallèlement, les entrepreneurs doivent posséder des compétences interdisciplinaires et une capacité de décision efficace, en se concentrant sur la construction d’équipe et la validation du modèle économique. Le succès de DeepSeek incite les investisseurs à s’intéresser aux équipes axées sur la technologie, persévérantes et capables d’exploiter le potentiel des talents. (Source : 36氪)

Tableau d’affichage des transactions : Informations sur les transactions d’actifs dans les domaines de l’IA et de la robotique : Le tableau d’affichage des transactions de 36Kr publie son 160e numéro, contenant plusieurs informations d’achat et de vente d’actifs liés à l’IA et à la robotique. Les informations de cession incluent des parts LP de fonds détenant des actions de ZY Robotics, Unitree Robotics, Wolong Electric (lié à l’eVTOL). Les informations d’acquisition concernent des actions de sociétés telles que ByteDance, Galaxy General, Unitree Robotics, DeepRobotics, ZY Robotics, Moore Threads, Star.Vision, etc. En outre, il existe une demande d’achat généralisée dans le domaine des robots humanoïdes. Ces pistes de transaction reflètent le vif intérêt actuel du marché des capitaux pour les entreprises leaders dans les domaines de la hard tech tels que l’IA, les robots humanoïdes, la conduite autonome et les semi-conducteurs. (Source : 36氪)

La société chinoise d’Agents Manus AI lève plus de 500 millions de RMB, valorisation multipliée par 5 : Selon Bloomberg, Butterfly Effect, la société mère du produit Agent IA générique Manus, a finalisé un nouveau tour de financement de 75 millions de dollars (environ 550 millions de RMB), mené par la société de capital-risque de la Silicon Valley Benchmark, portant sa valorisation post-money à près de 500 millions de dollars. Manus Agent peut exécuter de manière autonome des tâches web telles que la réservation de billets ou l’analyse d’actions, et avait précédemment attiré l’attention en raison de ses codes de bêta-test à prix élevé. Le nouveau financement servira à étendre les services aux marchés américain, japonais, moyen-oriental, etc., avec un projet d’ouverture de bureau au Japon. Bien que le produit soit populaire, sa dépendance au modèle Anthropic Claude entraîne des coûts élevés (en moyenne 2 dollars par tâche) et il est confronté à des limitations de capacité des serveurs. (Source : 智东西, 硅兔君)

Tuya Smart se transforme en plateforme d’Agents IA et vise le marché du matériel IA : La plateforme cloud AIoT Tuya Smart a lancé le framework open-source TuyaOpen, la plateforme de calcul en périphérie Haidewei, Tuya.AI et une version améliorée de sa plateforme de développement d’Agents IA, embrassant pleinement l’IA. L’entreprise estime que les grands modèles IA (en particulier l’interaction multimodale, l’efficacité de niveau expert et la capacité de décision distribuée) peuvent considérablement abaisser le seuil d’utilisation du matériel intelligent et favoriser la démocratisation du secteur. La plateforme d’Agents IA de Tuya a déjà intégré les principaux grands modèles mondiaux, aidant les clients à développer des produits phares tels que des bagues intelligentes et des poupées IA, et collabore avec des entreprises comme Kidswant pour promouvoir le matériel intelligent compagnon IA. L’entreprise prévoit que 2025 sera l’année de l’explosion du nouveau matériel IA, et sa stratégie d’Agents IA devrait porter ses fruits d’ici 2 à 3 ans. (Source : 36氪)

🌟 Communauté

Chaos des cours de formation IA : publicité mensongère et efficacité douteuse : Les médias sociaux regorgent de publicités pour des cours de formation promettant un “enrichissement rapide grâce à l’IA”, affirmant que les gens ordinaires peuvent rapidement monétiser en apprenant le dessin IA, le fine-tuning de modèles, etc. Cependant, l’expérience réelle et les retours des consommateurs révèlent de nombreux problèmes : qualifications des formateurs floues voire falsifiées (comme l’identité non réelle du fondateur de Coverhero) ; contenu des cours ne correspondant pas aux promesses publicitaires, rendant difficile l’atteinte de l’objectif “obtenir des commandes et monétiser” ; utilisation du marketing de la rareté et de cas d’étude fictifs pour inciter à la consommation ; difficulté de remboursement. Les initiés soulignent que le contenu de ces cours est souvent trop théorique ou superficiel, et qu’il est difficile pour une personne ordinaire de maîtriser des compétences IA suffisantes pour une reconversion professionnelle ou une génération de revenus stable grâce à une formation de courte durée. Il est conseillé aux utilisateurs d’utiliser les ressources gratuites et les communautés pour apprendre, et de se méfier des pièges des formations accélérées coûteuses. (Source : 新周刊)

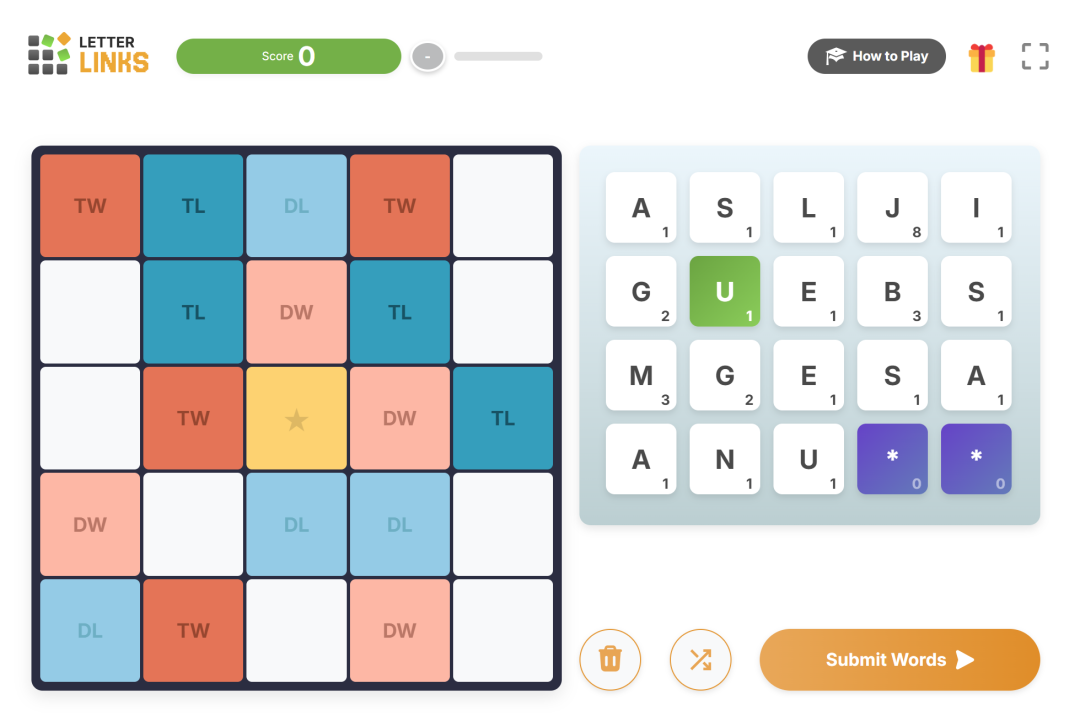

Un développeur compare l’expérience de programmation avec Claude et Gemini 2.5 + Cursor : Un développeur partage son expérience de développement d’un jeu de Scrabble en utilisant Claude et Gemini 2.5 Pro + Cursor. L’utilisation de l’API Claude a coûté 417 $, avec une expérience médiocre : la fenêtre de contexte était facilement perdue, entraînant une “amnésie” fréquente du modèle ; la correction de bugs introduisait souvent de nouveaux problèmes ; impossible de vérifier l’exactitude du code. En comparaison, l’utilisation gratuite de Gemini 2.5 Pro (via l’intégration Cursor) a considérablement amélioré l’expérience : coût nul ; meilleure compréhension du contexte (grâce à la transmission de la structure des fichiers par Cursor) ; flux d’interaction ressemblant davantage à la programmation en binôme ; processus de débogage plus rationnel. La conclusion est que la combinaison Gemini 2.5 + Cursor offre une expérience de programmation assistée par IA plus pratique et efficace. (Source : CSDN)

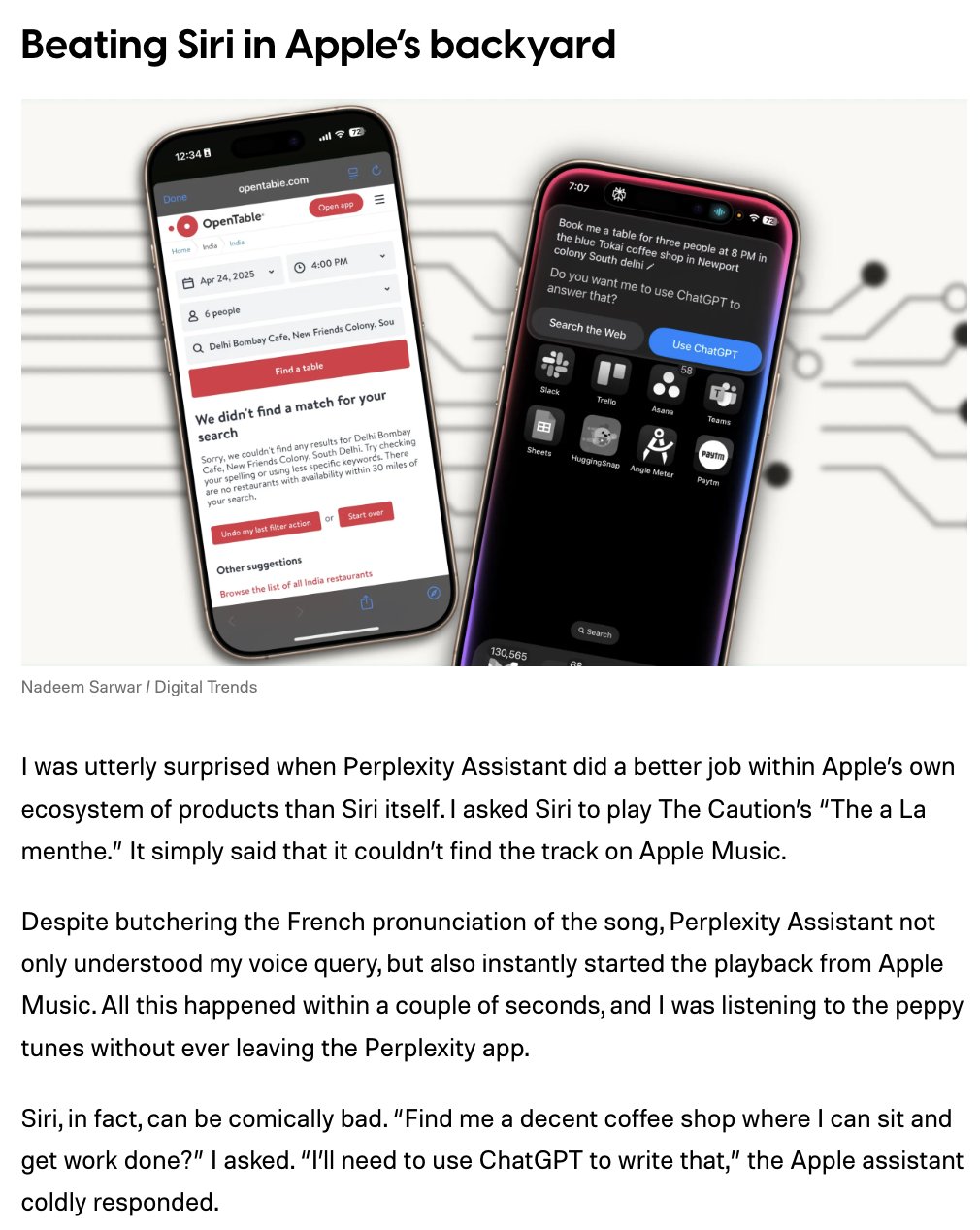

L’assistant iOS de Perplexity reçoit des éloges préliminaires : Le PDG de Perplexity a relayé les commentaires d’utilisateurs montrant que son assistant IA iOS se comporte bien lors des premières évaluations. Les commentaires indiquent que l’assistant surpasse même Siri au sein de l’écosystème Apple, par exemple en étant plus précis pour lire une vidéo YouTube spécifique sur la base d’une commande vocale. Cela suggère que l’assistant Perplexity a un certain avantage dans la compréhension de l’intention en langage naturel et l’exécution d’opérations inter-applications. (Source : AravSrinivas)

Débat sur Reddit : Distinction entre photos générées par IA et photos réelles : Un utilisateur de Reddit a lancé une discussion en présentant 5 photos de femmes similaires, dont une seule était réelle, les autres étant générées par IA, demandant aux autres de les distinguer. La section des commentaires a été animée, les utilisateurs analysant sous différents angles tels que la lumière et l’ombre, la texture de la peau, les détails des accessoires (comme les maillons d’un collier), mais les avis divergeaient. Cela reflète le haut niveau actuel de la technologie de génération d’images IA et la difficulté de distinguer le vrai du faux. (Source : Reddit r/ChatGPT)

Débat sur Reddit : ChatGPT génère des images étranges : Plusieurs utilisateurs sur Reddit ont partagé que lorsqu’ils demandaient à ChatGPT de générer des images spécifiques (comme “la carte des États-Unis”), ils obtenaient de manière inattendue des explosions nucléaires (champignon atomique) ou d’autres images non pertinentes (comme R2D2). Cela a déclenché une discussion sur la stabilité du modèle et les biais potentiels, sans qu’il soit clair s’il s’agit d’une erreur aléatoire du modèle ou si un prompt spécifique a déclenché une anomalie. (Source : Reddit r/ChatGPT)

Discussion sur Reddit : L’IA rendra-t-elle les ingénieurs logiciels dépendants ? : Un ingénieur logiciel a posté sur Reddit, indiquant que les outils IA (comme les assistants de programmation) améliorent considérablement l’efficacité et la qualité du travail, et qu’il est difficile de s’arrêter de les utiliser après avoir commencé, ressentant une certaine “dépendance”. La section des commentaires a débattu de cela : certains pensent qu’il s’agit plutôt d’une dépendance à un outil efficace, similaire à la dépendance au compilateur plutôt qu’à l’assembleur, un résultat naturel de l’amélioration de la productivité ; d’autres reconnaissent un risque potentiel de “dépendance” et s’inquiètent qu’une dépendance excessive puisse entraîner une régression des compétences, suggérant une “désintoxication de l’IA” consciente ou le maintien de l’entraînement des compétences de base. (Source : Reddit r/ArtificialInteligence)

Discussion sur Reddit : Religions IA et phénomène de culte : Les utilisateurs discutent de la possibilité que l’IA devienne un objet de religion ou de culte. Les arguments incluent : l’existence déjà d’un “AI Jesus” ; les discussions sur la conscience de l’IA pourraient mener à la croyance ; des courants de pensée comme le Longtermism ont des connotations quasi-religieuses ; les LLM peuvent fournir un réconfort spirituel personnalisé et une guidance. Les commentaires mentionnent des cas réels (comme le protocole Nova de jrprudence.com) et discutent du potentiel et des risques de l’IA à satisfaire les besoins spirituels humains, ainsi que des craintes concernant les “cultes IA”. (Source : Reddit r/ArtificialInteligence)

Discussion sur Reddit : Les images générées par IA ne peuvent pas “restaurer” de vieilles photos : Un utilisateur a prouvé par l’expérience qu’en utilisant des outils IA comme ChatGPT pour traiter de vieilles photos, l’IA ne restaure pas réellement ni n’améliore la résolution, mais génère une toute nouvelle image similaire basée sur l’original. En testant avec des photos de célébrités (comme Samuel L Jackson), le résultat généré était clairement une autre personne, avec seulement un style et une pose similaires. Cela rappelle aux utilisateurs de comprendre correctement les limites des capacités de traitement d’image de l’IA : elle est meilleure pour “créer” que pour “restaurer”. (Source : Reddit r/ChatGPT)

💡 Autres

Florilège de citations de la conférence AI Partner : 36Kr a compilé et publié un résumé des points de vue marquants des intervenants de la conférence AI Partner 2025. Ces points de vue tournent autour de l’évolution future des super-applications IA, de la transformation sectorielle et de la reconstruction de la logique commerciale, reflétant la pensée actuelle des experts et des pionniers de l’industrie dans le domaine de l’IA. (Source : 36氪)

Les Émirats arabes unis deviennent le premier pays à utiliser l’IA pour rédiger des lois : Selon The Hill, les Émirats arabes unis ont commencé à utiliser l’intelligence artificielle pour aider à la rédaction de textes législatifs. Cette initiative marque une première application de l’IA dans le domaine législatif, visant potentiellement à améliorer l’efficacité législative ou à analyser des réglementations complexes. Cette nouvelle a suscité des discussions sur le rôle de l’IA dans la gouvernance, par exemple si elle peut réduire la dépendance aux rôles politiques traditionnels. (Source : Reddit r/ArtificialInteligence)

Anthropic lance un projet de recherche sur le “bien-être des modèles IA” : La société Anthropic a annoncé le lancement d’un nouveau programme visant à étudier le “bien-être” (model welfare) des modèles IA. Bien que ce domaine soit controversé (certains experts estiment que les modèles n’ont pas de ressentis subjectifs ni de valeurs), cette initiative d’Anthropic pourrait viser à explorer des méthodes de développement et d’interaction de modèles plus responsables et conformes à l’éthique, ou à étudier comment évaluer et atténuer les états ou comportements “indésirables” que les modèles pourraient développer lors de l’entraînement ou de l’interaction. (Source : Reddit r/ClaudeAI)

La consommation importante d’eau par l’IA suscite l’attention : Un rapport du gouvernement américain et des médias (404media) soulignent que l’entraînement et l’exécution de grands modèles IA nécessitent la consommation d’importantes quantités d’eau, principalement pour le refroidissement des data centers. Cela soulève des préoccupations quant au coût environnemental du développement de l’IA, en particulier dans les régions soumises à un stress hydrique. (Source : Reddit r/artificial)