Palabras clave:Meta AI, Marco LIRA multimodal, Microsoft Agent Framework, Valor de mercado de NVIDIA, Sora 2 Pro, Perplexity AI Comet, IBM Granite 4.0, Modelos de la serie Qwen, Reestructuración del equipo de Meta AI, Precisión de segmentación de imágenes LIRA, Soporte multilingüe de Agent Framework, Mercado de chips AI de NVIDIA, Limitaciones de generación de video Sora 2

🔥 Enfoque

Agitación en el equipo interno de IA de Meta y rumores de dimisión de LeCun: El departamento de Meta AI ha experimentado frecuentes reestructuraciones, lo que ha provocado un aumento del descontento interno, e incluso se rumorea que el ganador del Premio Turing, Yann LeCun, podría renunciar a su puesto como científico jefe de FAIR. Los ajustes estratégicos internos, como la necesidad de aprobación adicional para la publicación de artículos, los altos salarios para los nuevos empleados y la asignación preferencial de recursos, han exacerbado la sensación de restricción de la libertad académica y el descontento entre los empleados veteranos del equipo FAIR, lo que ha provocado la dimisión de varios investigadores. Esta agitación revela los desafíos que enfrentan las grandes empresas tecnológicas en el ajuste de sus estrategias de IA, así como el conflicto entre la búsqueda de la comercialización y el mantenimiento de la libertad de investigación fundamental. (Fuente: 量子位)

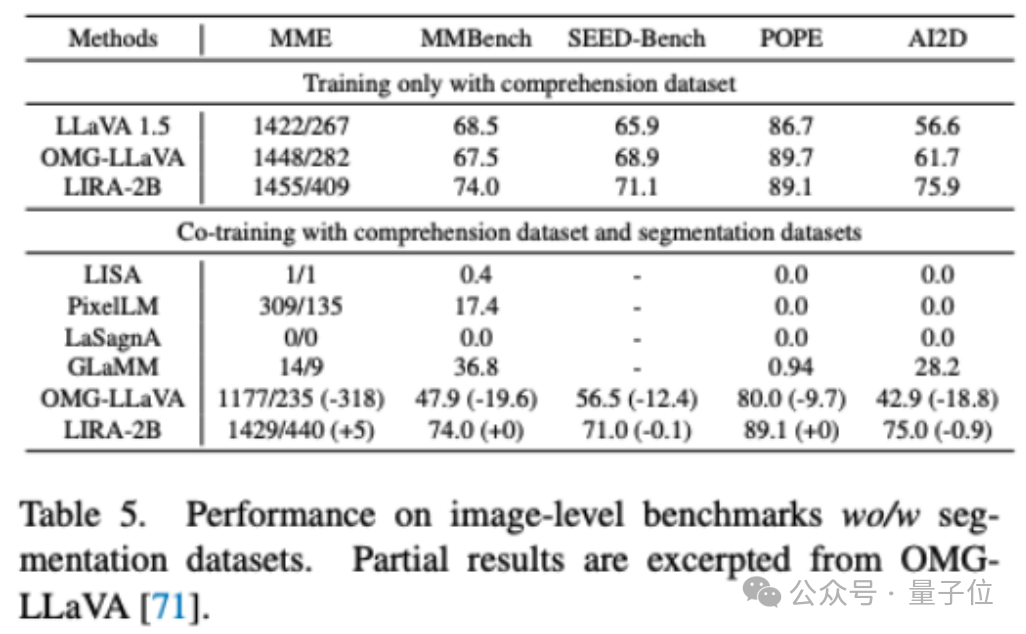

El equipo de Bai Xiang de la Universidad de Ciencia y Tecnología de Huazhong lanza el marco multimodal LIRA, logrando doble SOTA en segmentación y comprensión: La Universidad de Ciencia y Tecnología de Huazhong, en colaboración con el equipo de Kingsoft Office, ha lanzado LIRA, un modelo multimodal grande que, a través de dos innovadores módulos, el “extractor de características mejorado semánticamente” (SEFE) y el “acoplamiento visual local intercalado” (ILVC), mejora significativamente la precisión de la segmentación de imágenes y reduce las alucinaciones de comprensión. LIRA ha logrado el SOTA tanto en tareas de segmentación como de comprensión, siendo especialmente capaz de segmentar objetivos con mayor precisión en escenarios complejos y superando los mejores métodos existentes, como OMG-LLaVA, en varias pruebas de referencia. Esta investigación ofrece nuevas ideas para la percepción visual y las capacidades de razonamiento de los modelos multimodales grandes de grano fino. (Fuente: 量子位)

Microsoft lanza Agent Framework, compatible con desarrollo multilingüe en Python y .NET: Microsoft ha lanzado Agent Framework, un marco multilingüe completo para construir, orquestar y desplegar agentes de IA y flujos de trabajo multiagente. Este framework es compatible con Python y .NET, ofreciendo flujos de trabajo basados en gráficos, un paquete experimental AF Labs, una DevUI interactiva, integración de observabilidad OpenTelemetry, y soporte para múltiples proveedores de LLM y un sistema de middleware flexible. Su objetivo es simplificar el desarrollo desde agentes de chat sencillos hasta flujos de trabajo multiagente complejos, mejorando la eficiencia y el control en el desarrollo de aplicaciones de IA. (Fuente: GitHub Trending)

La capitalización de mercado de NVIDIA supera los 4 billones de dólares, la demanda de potencia de cálculo de IA continúa disparándose: NVIDIA ha superado por primera vez los 4 billones de dólares en capitalización de mercado, convirtiéndose en la primera empresa pública del mundo en alcanzar este hito. Este logro refleja el continuo y fuerte crecimiento de la demanda de computación de IA, así como la posición dominante de NVIDIA en la tecnología GPU y el mercado de chips de IA. Pioneros de la IA como Jürgen Schmidhuber también han felicitado a NVIDIA por su contribución al impulso del potencial de las redes neuronales, señalando la tendencia de una reducción significativa de los costos de computación mientras el valor de NVIDIA se dispara. (Fuente: SchmidhuberAI, SchmidhuberAI, SchmidhuberAI, nvidia)

🎯 Tendencias

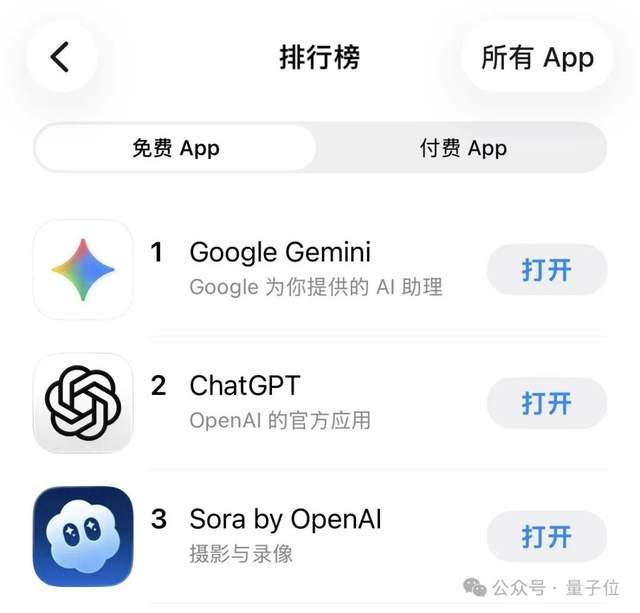

Expansión de la función de generación de video Sora 2 Pro e impacto en el mercado: La función de generación de video Sora 2 Pro de OpenAI se está abriendo gradualmente a los usuarios de ChatGPT Pro, permitiendo la creación de videos de alta calidad de 15 segundos. La aparición de Sora 2 ha captado rápidamente la atención del mercado, llegando incluso a la cima de las aplicaciones de IA en la App Store. Su experiencia de producto ha sido elogiada como “killer app”, aunque algunos opinan que el modelo en sí no es SOTA, y que su capacidad de productización es clave para su éxito. Además, los prompts de Sora 2 podrían estar filtrados por el modelo, e incluso modificar contenido de dominio público, lo que ha generado debates sobre derechos de autor y control de contenido. (Fuente: dotey, thursdai_pod, billpeeb, TomLikesRobots, dotey, iScienceLuvr, skirano, VictorTaelin, Reddit r/artificial)

El navegador Comet de Perplexity AI se abre de forma gratuita y se populariza rápidamente: Perplexity AI ha anunciado la apertura gratuita global de su navegador Comet, que anteriormente tenía un precio de 200 dólares al mes. Los usuarios han elogiado su diseño y experiencia de usuario, considerando que integra la IA de forma natural y no intrusiva, evitando la carga de aprender nuevas interacciones. El navegador ha mostrado una rápida tasa de adopción entre usuarios de Windows y Mac, con un rendimiento aún mejor en Mac, siendo considerado uno de los mejores productos de 2025, aunque algunos cuestionan la razonabilidad de su modelo de pago de alto precio. (Fuente: AravSrinivas, AravSrinivas, AravSrinivas, AravSrinivas, bookwormengr, Reddit r/artificial)

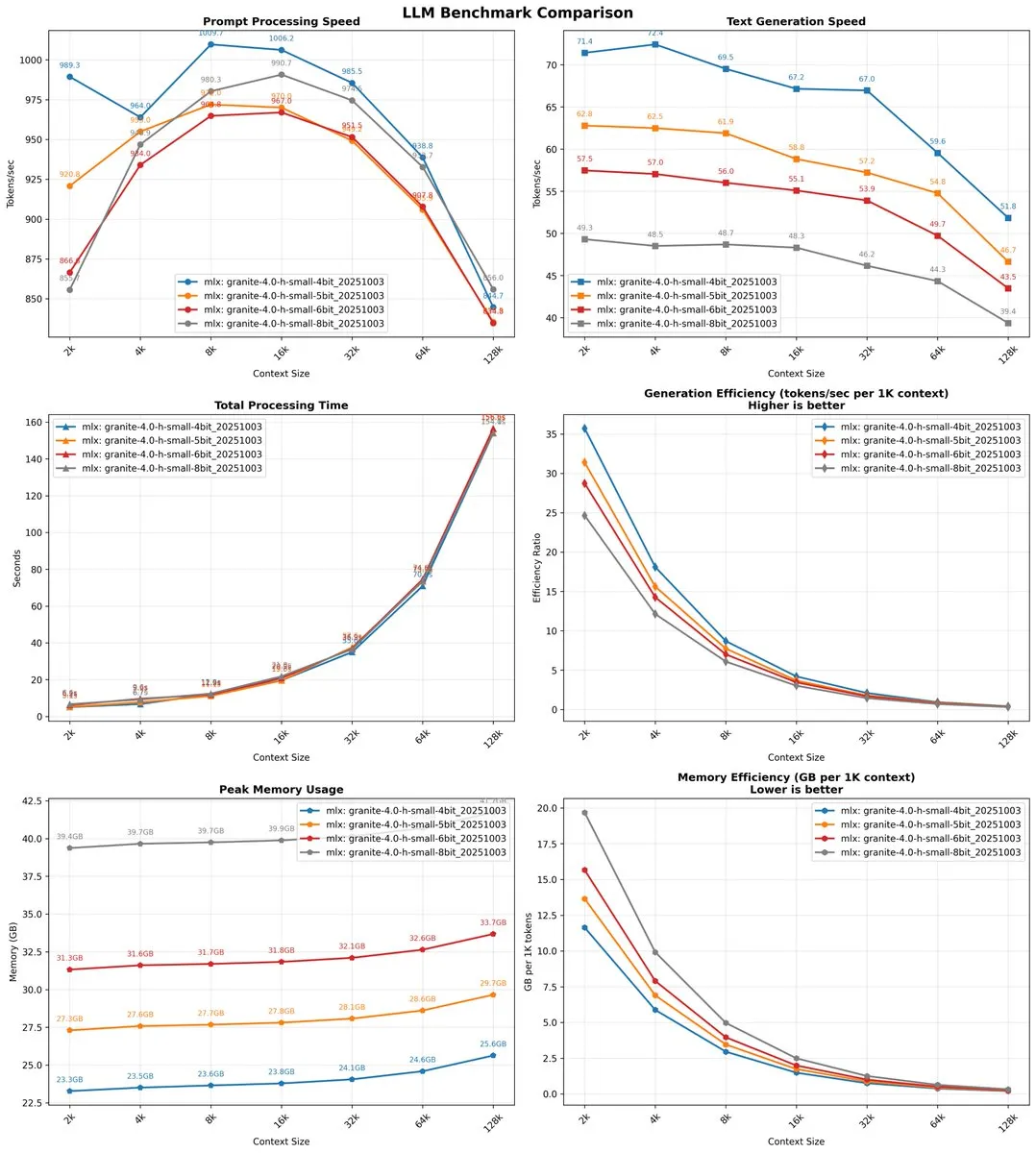

El modelo IBM Granite 4.0 logra avances significativos en rendimiento y contexto largo: IBM ha lanzado la serie de modelos Granite 4.0, donde Granite-4.0-H-Tiny supera significativamente al modelo OLMoE lanzado hace 10 meses en varias métricas como matemáticas, codificación y conocimiento general, y puede realizar inferencias en CPU a una velocidad razonable en un PC común. El modelo Granite 4.0-H-Small también muestra una velocidad de inferencia extremadamente rápida (hasta 79 tokens/segundo), y su velocidad no disminuye significativamente con el aumento de la longitud del contexto, soportando una ventana de contexto de hasta 1M (aunque oficialmente verificado hasta 128k). Los usuarios elogian su bajo consumo de memoria y su salida concisa, considerándolo sobresaliente en escenarios específicos. (Fuente: ImazAngel, NerdyRodent, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

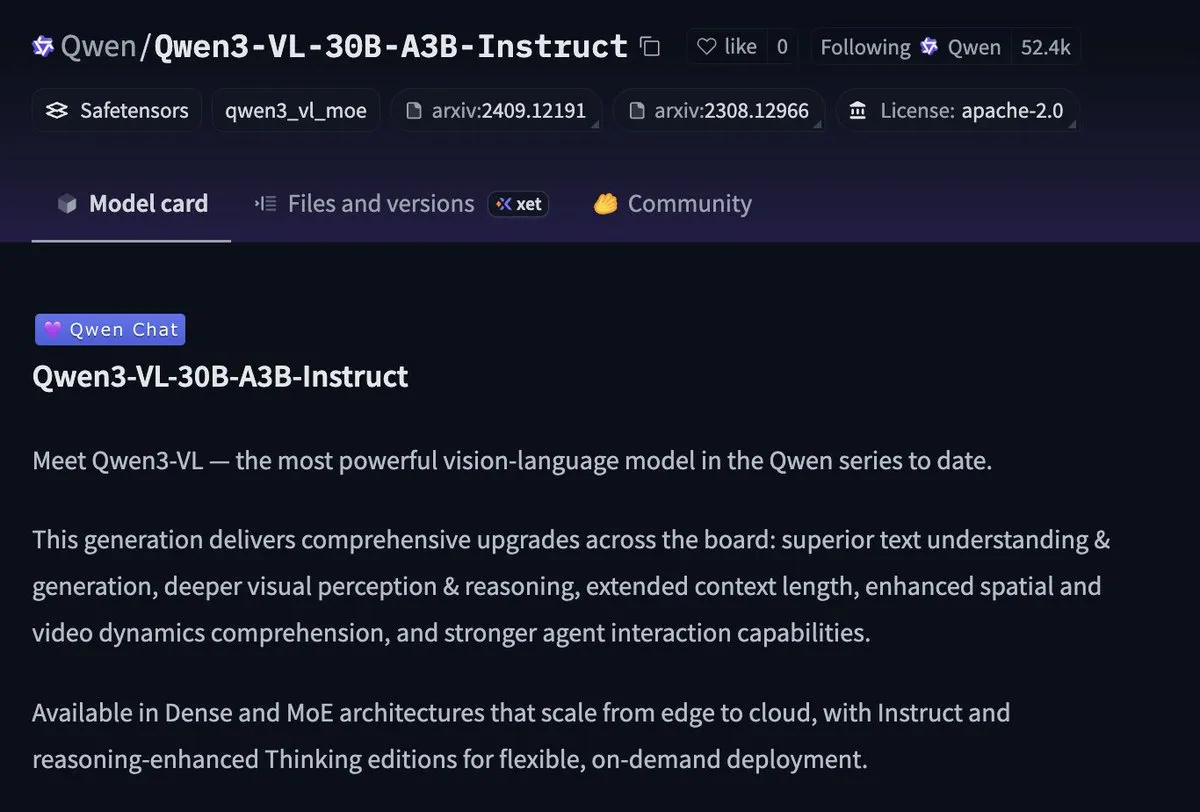

Actualización y posicionamiento estratégico de los modelos de la serie Qwen: El equipo Qwen de Alibaba Cloud ha detallado la lógica de denominación y los objetivos de desarrollo de sus diversas familias de modelos, incluyendo LLM, Coder, VL, Omni e Image, con el objetivo de unificarlos finalmente en un modelo omnipotente. Qwen3-Next, como versión preliminar de “Qwen3.5”, logra un avance en eficiencia a través de un diseño de atención híbrida, superando a Qwen3-32B con un 10% del costo de entrenamiento y 10 veces el rendimiento de contexto largo. Además, el modelo Qwen MoE muestra un rendimiento excepcional en la velocidad de inferencia en CPU, lo que presagia su potencial en dispositivos de borde. La estrategia general de Qwen se interpreta como la construcción de un “ecosistema Android” para modelos de IA, enfatizando el bajo costo, la popularidad y la modificabilidad. (Fuente: stablequan, karminski3, Teknium1, Dorialexander, ClementDelangue, natolambert, Reddit r/deeplearning)

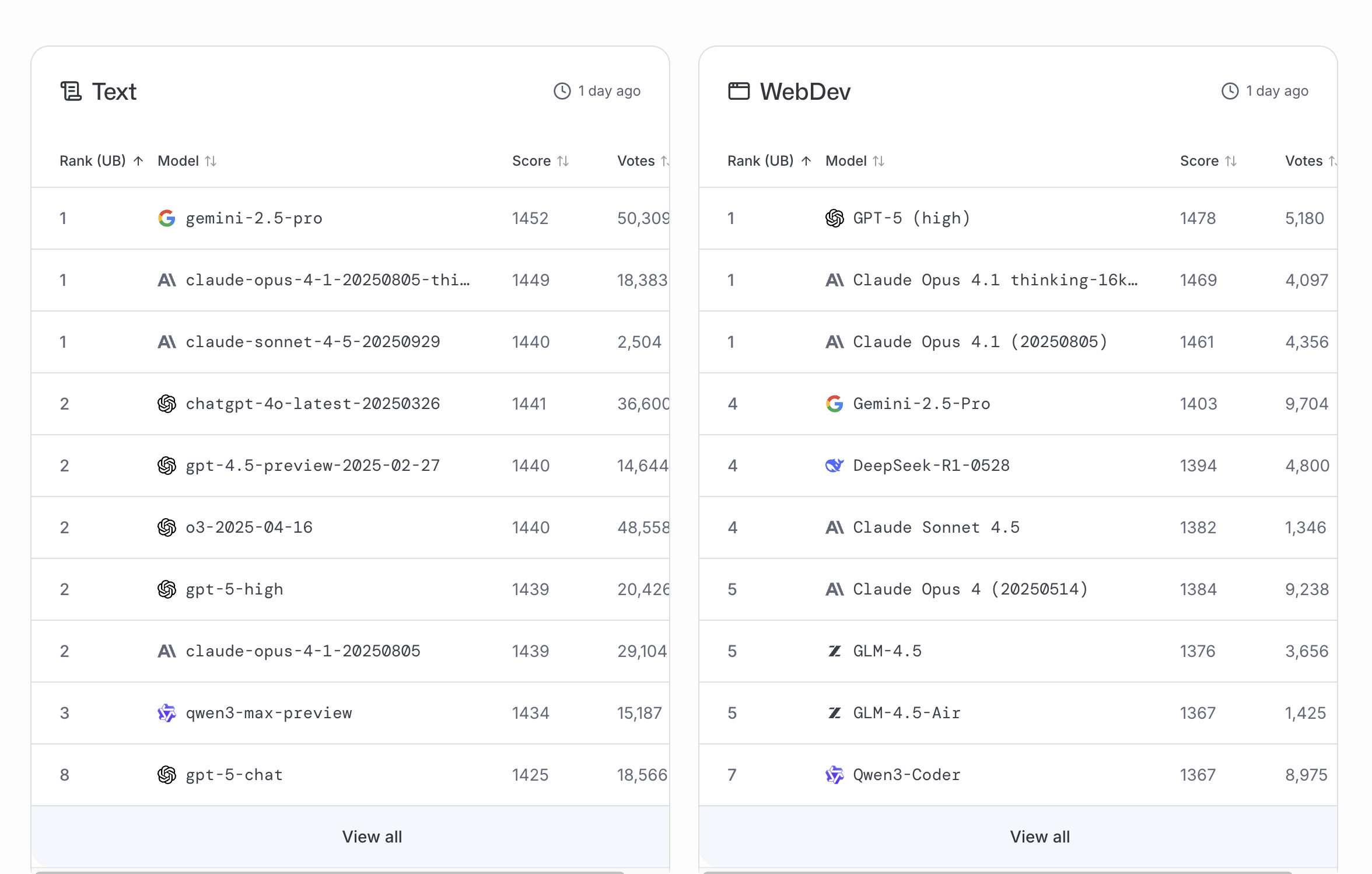

Rendimiento de Claude 4.5 Sonnet y Opus y controversia sobre restricciones de uso: Tras el lanzamiento del modelo Claude 4.5 Sonnet de Anthropic, a pesar de una gran promoción, se ha posicionado en un rango medio en pruebas de referencia como WebDev y Text, quedando por detrás de GPT-5 y la versión “modo de pensamiento” de Claude Opus 4.1. Los usuarios informan que los límites de uso semanal de Claude Opus se han reducido drásticamente; una tarea de planificación compleja puede consumir el 6% de la cuota semanal, lo que ha reducido el tiempo disponible para los usuarios del plan Max de “25-40 horas” a solo unos minutos. Esto ha generado un fuerte descontento por la discrepancia entre el precio y el servicio real, cuestionando si Anthropic está penalizando las tareas de razonamiento complejas y profundas. (Fuente: thursdai_pod, alexalbert__, Reddit r/ClaudeAI, Reddit r/ClaudeAI)

Yunpeng Technology lanza nuevos productos de IA+salud: Yunpeng Technology lanzó nuevos productos en Hangzhou el 22 de marzo de 2025, en colaboración con Shuaikang y Skyworth, incluyendo el “Laboratorio de Cocina del Futuro Digital e Inteligente” y un refrigerador inteligente equipado con un modelo grande de IA para la salud. El modelo grande de IA para la salud optimiza el diseño y la operación de la cocina, y el refrigerador inteligente, a través del “Asistente de Salud Xiaoyun”, ofrece gestión de salud personalizada, marcando un avance de la IA en el campo de la salud. Este lanzamiento demuestra el potencial de la IA en la gestión diaria de la salud, ofreciendo servicios de salud personalizados a través de dispositivos inteligentes, lo que se espera impulse el desarrollo de la tecnología de salud en el hogar y mejore la calidad de vida de los residentes. (Fuente: 36氪)

🧰 Herramientas

Google Nano Banana abre API de generación de imágenes y actualiza funciones: El modelo de generación de imágenes Nano Banana de Google ha abierto oficialmente su API, con un precio aproximado de 0.039 dólares por imagen. Al mismo tiempo, se han añadido opciones de relación de aspecto (compatible con 16:9, 9:16, 4:3, 3:2, entre otras) y un modo de salida de imagen pura (sin texto adjunto), para satisfacer las necesidades de escenarios puramente visuales como previsualizaciones en tiempo real, exhibiciones de comercio electrónico y herramientas de diseño. Estas actualizaciones tienen como objetivo posicionar a Nano Banana como una herramienta práctica, facilitando a los desarrolladores su integración en sus propios productos. (Fuente: 量子位)

Microsoft Agent Framework simplifica el desarrollo de agentes de IA: Microsoft ha lanzado Agent Framework, un marco integral compatible con Python y .NET, diseñado para simplificar la construcción, orquestación y despliegue de agentes de IA y flujos de trabajo multiagente. Este framework ofrece flujos de trabajo basados en gráficos, una DevUI interactiva, observabilidad OpenTelemetry, soporte para múltiples proveedores de LLM y un sistema de middleware flexible, ayudando a los desarrolladores a crear eficientemente desde agentes de chat simples hasta aplicaciones multiagente complejas. (Fuente: GitHub Trending)

Liquid AI lanza la aplicación Apollo para Android, permitiendo el despliegue local de IA: Liquid AI ha lanzado la aplicación Apollo en la plataforma Android, ofreciendo una experiencia de IA local de baja latencia y sin necesidad de la nube. Apollo, como un “parque de juegos en el bolsillo”, permite a los usuarios acceder instantáneamente a una IA rápida y eficiente, garantizando al mismo tiempo la privacidad y la seguridad. Combinado con la tecnología LEAP, Apollo reduce la barrera de entrada para la IA en el borde, permitiendo a usuarios y desarrolladores utilizar, probar y desplegar fácilmente la IA de forma local. (Fuente: maximelabonne)

El entrenador de codificación “solveit” AI mejora la eficiencia de los programadores: Jeremy Howard ha lanzado “solveit”, una herramienta de entrenamiento de codificación con IA, diseñada para ayudar a los programadores a escribir software de alta calidad de manera más eficiente. Esta herramienta guía a los usuarios en el desarrollo de software a través de la IA, siendo especialmente útil para aquellos desarrolladores frustrados con la programación asistida por IA, ofreciendo un modelo de “entrenador de codificación” que permite a la IA colaborar con los programadores para acelerar el proceso de desarrollo. (Fuente: jeremyphoward, jeremyphoward)

Jules Tools CLI habilita la gestión de AI Agent por línea de comandos: Google ha llevado el agente de codificación Jules a la interfaz de línea de comandos (CLI), lanzando Jules Tools. Los usuarios ahora pueden gestionar de forma remota las tareas del Agent que se ejecutan en la nube a través de la línea de comandos, logrando una mejor integración con CI/CD o el código. Esto proporciona una experiencia de codificación de IA conveniente para los desarrolladores que prefieren la línea de comandos, mostrando una experiencia de usuario fluida, especialmente en la depuración y el desarrollo interactivo. (Fuente: dotey, matanSF)

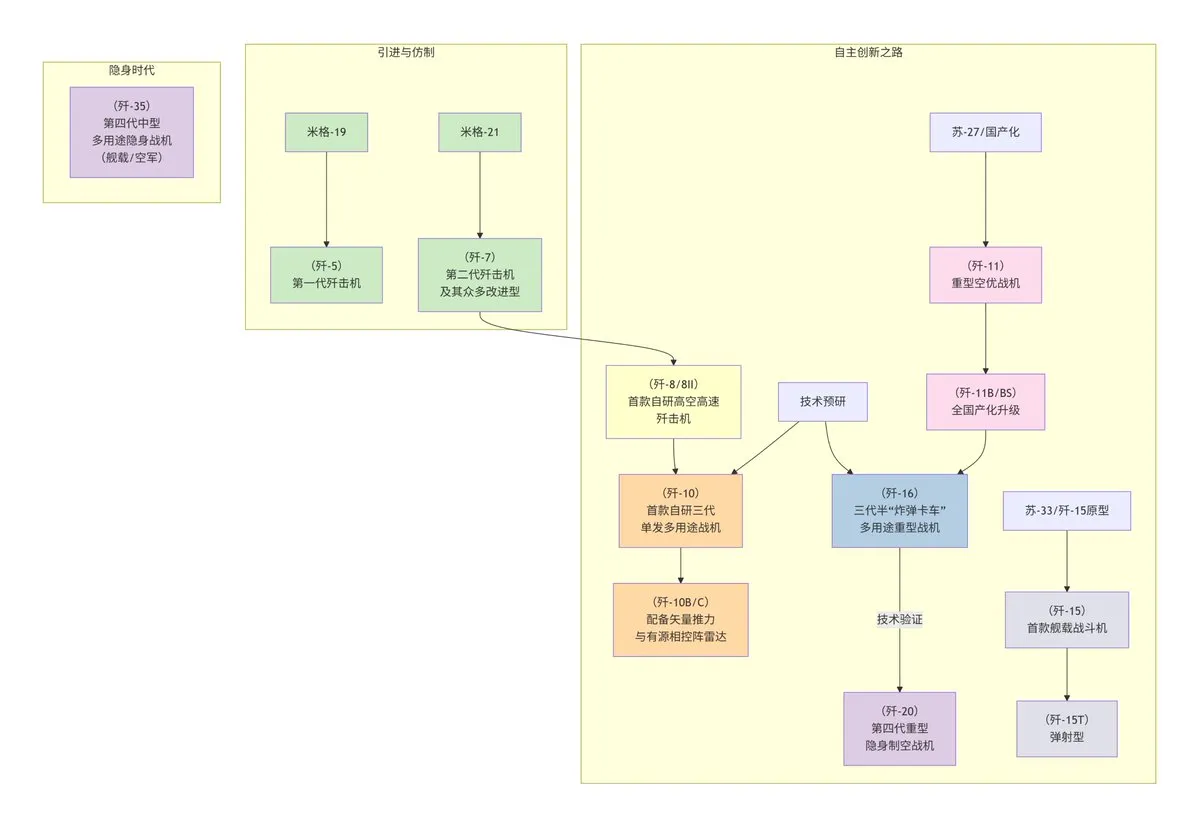

La función de generación de diagramas de flujo de DeepSeek simplifica el dibujo de gráficos: El modelo DeepSeek ahora puede generar diagramas de flujo rápidamente mediante palabras clave sencillas (como “flowchart” o “Mermaid”). Los usuarios solo necesitan introducir instrucciones descriptivas para organizar y dibujar automáticamente información compleja, como la historia de desarrollo de los aviones de combate de la serie J de China o la línea temporal de “Fullmetal Alchemist”, simplificando enormemente el proceso de dibujo de diagramas y mejorando la eficiencia del trabajo. (Fuente: karminski3)

Synthesia lanza Video Agents para conversaciones de video bidireccionales: Synthesia ha lanzado “Video Agents”, el primer paso de los videos hacia la conversación bidireccional. Esta tecnología permite a los usuarios iniciar conversaciones en tiempo real en cualquier momento del video; los agentes pueden conectarse a la base de conocimientos de la empresa para obtener contexto y capturar datos para retroalimentar los sistemas existentes. Esto promete revolucionar la forma en que interactuamos con los videos, transformándolos de una experiencia pasiva a una participación activa. (Fuente: synthesiaIO, synthesiaIO)

El agente de codificación AI “Blink.new” logra un despliegue rápido “de la idea a la aplicación”: Blink.new ha lanzado un agente de codificación de IA que afirma reducir el tiempo “de la idea a la aplicación en producción” de meses a minutos, logrando un desarrollo rápido sin código. La plataforma convierte descripciones en lenguaje natural en código ejecutable, configura bases de datos, diseña UI y se despliega automáticamente, ofreciendo funciones de nivel de producción como alojamiento gratuito, SSL, CDN y escalado automático, lo que acelera enormemente la prueba de concepto y la velocidad de desarrollo de productos. (Fuente: Ronald_vanLoon)

VS Code integra agentes de codificación en segundo plano para mejorar la experiencia de desarrollo: El equipo de VS Code está lanzando las últimas mejoras, que permiten ejecutar agentes de codificación (como GitHub Copilot) en segundo plano, con el objetivo de mejorar la eficiencia y la experiencia de desarrollo. Esta integración permite a los agentes proporcionar asistencia y sugerencias de código continuas en segundo plano, optimizando aún más el flujo de trabajo de programación y ayudando a los desarrolladores a escribir código de alta calidad más rápidamente. (Fuente: code, pierceboggan)

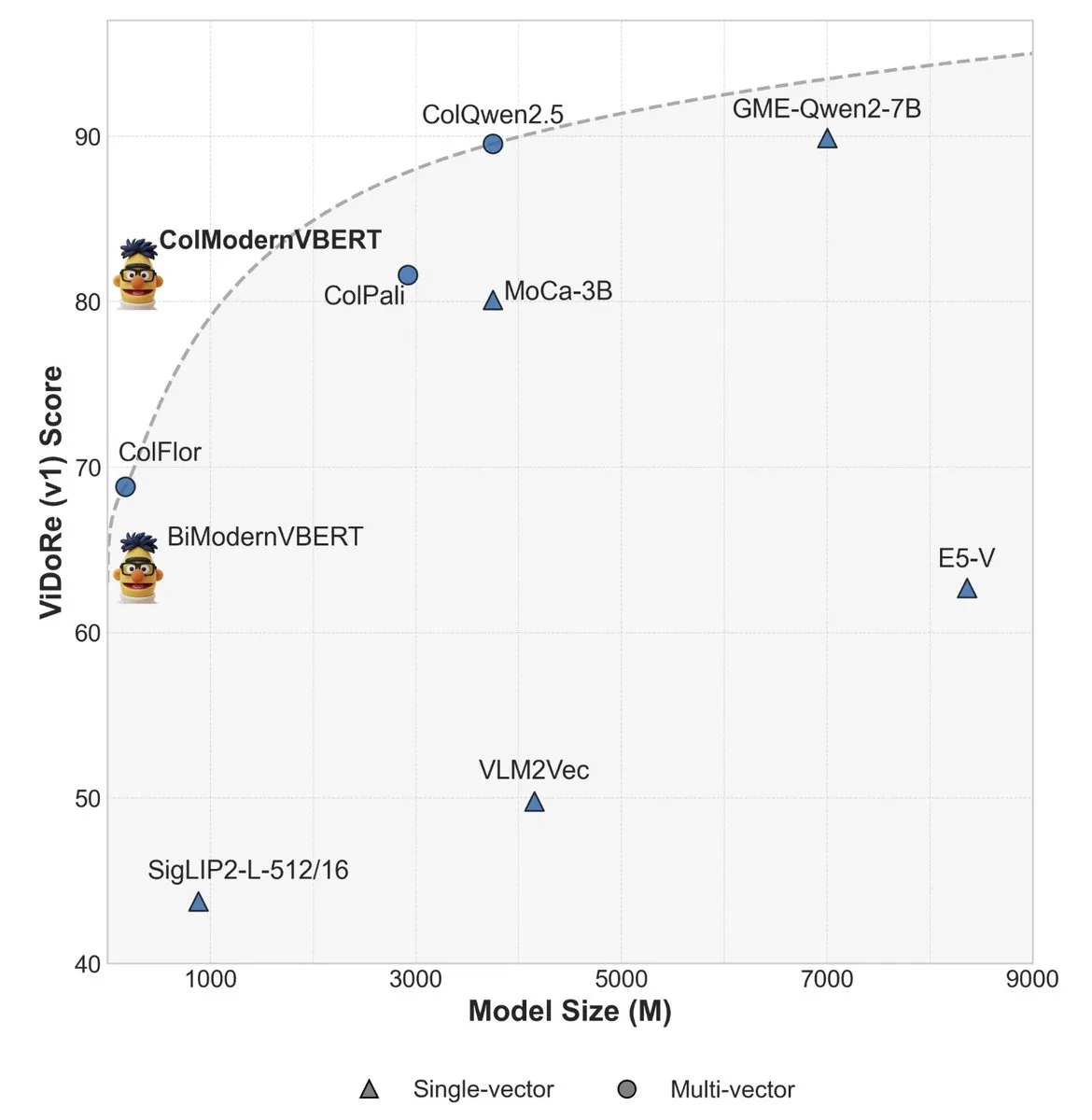

ModernVBERT: un pequeño recuperador de documentos visuales supera el rendimiento de modelos grandes: ModernVBERT es un codificador de lenguaje visual compacto de 250M parámetros que, tras ser ajustado para tareas de recuperación de documentos, supera el rendimiento de modelos 10 veces más grandes. Esta investigación, a través de experimentos controlados, ha identificado factores clave de rendimiento como las máscaras de atención, la resolución de imagen, los esquemas de datos de alineación modal y los objetivos de contraste de interacción tardía, proporcionando una guía basada en principios para el desarrollo de modelos de recuperación de documentos visuales más eficientes. El modelo y el código han sido liberados como código abierto en HuggingFace. (Fuente: tonywu_71, lateinteraction, lateinteraction, lateinteraction, lateinteraction, lateinteraction, ClementDelangue, HuggingFace Daily Papers)

El motor de búsqueda de música AI EmergeSound.ai utiliza tecnología de incrustación de audio: EmergeSound.ai es un motor de búsqueda de música y un modelo fundacional construido sobre más de 100 millones de incrustaciones de audio. La plataforma permite a los usuarios buscar música por sonido en lugar de texto o metadatos, explorar canciones de diferentes épocas y descubrir conexiones ocultas. Este proyecto tiene como objetivo utilizar modelos de aprendizaje profundo para codificar características de audio, permitiendo el descubrimiento y la exploración musical, y proporcionando nuevas herramientas para productores, investigadores y amantes de la música. (Fuente: Reddit r/MachineLearning)

Usuario de OpenWebUI desarrolla herramienta de extracción y resumen de contenido web: Un usuario de OpenWebUI ha desarrollado un conjunto de herramientas de extracción y resumen de contenido web, diseñado para minimizar la expansión del contexto. La herramienta puede devolver resúmenes de páginas web en lugar de extractos de SERP, y permite que el modelo solicite resúmenes basados en la consulta o extractos para respuestas directas. Además, utiliza Playwright y Trafilatura para optimizar los resultados de la extracción web, haciéndolos más compactos. Actualmente, la herramienta busca la ayuda de la comunidad para lograr una integración más generalizada en OpenWebUI. (Fuente: Reddit r/OpenWebUI)

El juego “Trial of Ariah”, desarrollado con Claude, demuestra el potencial de codificación de LLM: Un desarrollador independiente ha codificado completamente el juego “Trial of Ariah” utilizando Claude AI. El desarrollador señaló que Claude permite importar hasta 20 scripts a la vez, lo que reduce drásticamente los errores en comparación con ChatGPT y mejora la eficiencia del desarrollo. Aunque se enfatiza que el “Vibe Coding” puro no existe y los desarrolladores aún necesitan conocimientos básicos para identificar las alucinaciones y errores de los LLM, este caso demuestra la potente capacidad de asistencia de los LLM en proyectos complejos como el desarrollo de juegos. (Fuente: Reddit r/ClaudeAI)

📚 Aprendizaje

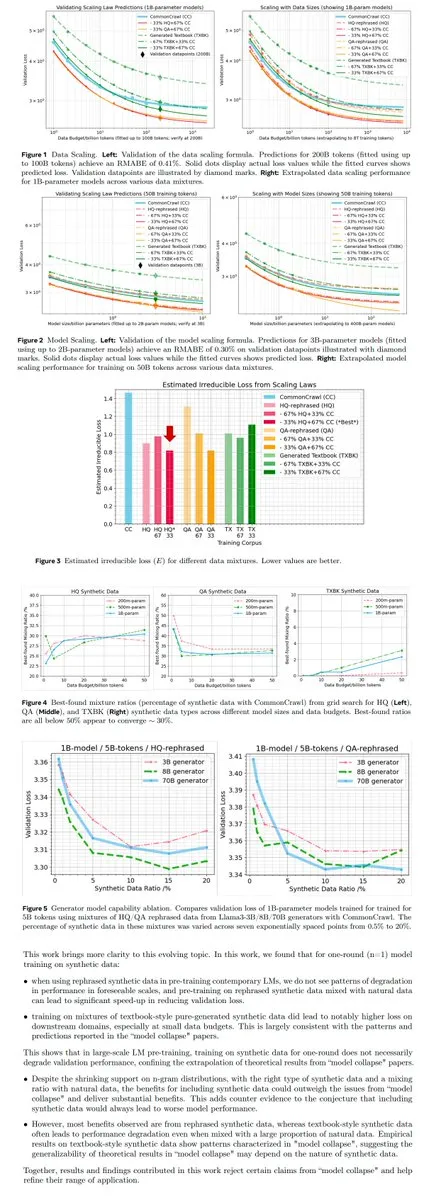

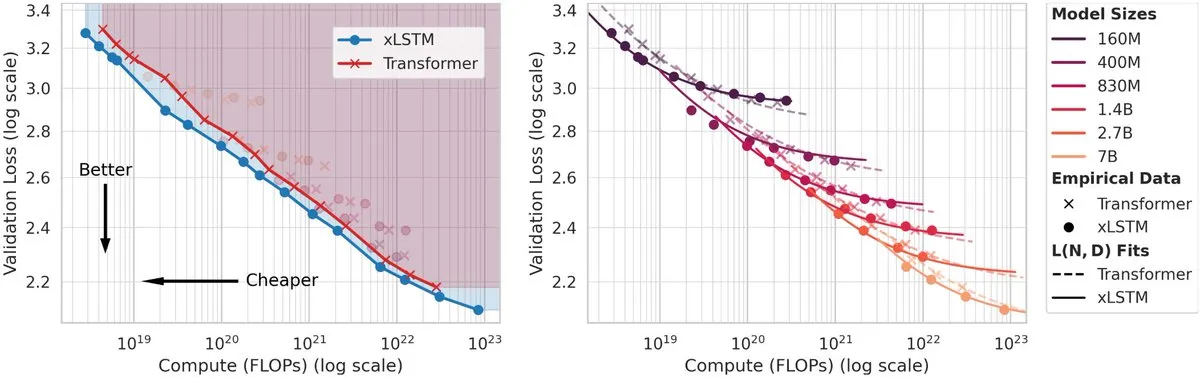

Nuevos paradigmas de entrenamiento y optimización de LLM: Combinando varios artículos, se exploran nuevas estrategias en el entrenamiento de LLM, como la aplicación de datos sintéticos (investigación de Meta), PPO/GRPO y el sesgo de percepción humana (Humanline), y One-Token Rollout (OTR), con el objetivo de mejorar la capacidad de generalización del modelo, resolver problemas de recompensas dispersas y olvido catastrófico, y optimizar los costos de entrenamiento. Estas investigaciones proporcionan nuevas directrices teóricas y prácticas para el ajuste fino y el preentrenamiento de los LLM, enfatizando la importancia de las estrategias de datos, el diseño de recompensas y los paradigmas de entrenamiento. (Fuente: teortaxesTex, tokenbender, HuggingFace Daily Papers, YejinChoinka, arankomatsuzaki)

Arquitectura y optimización de la eficiencia de LLM: Se centra en los mecanismos internos de los LLM, como la eficiencia de utilización del espacio latente de las redes de alimentación directa (FFN) (“Spectral Scaling Laws”), la comparación de las leyes de escalado de xLSTM y Transformer, y la tecnología de inferencia paralela (Bridge), con el objetivo de mejorar el rendimiento del modelo y reducir los costos computacionales. Estas investigaciones proporcionan información clave para el diseño y despliegue de la próxima generación de LLM. (Fuente: HuggingFace Daily Papers, ethanCaballero, HuggingFace Daily Papers)

Seguridad de la IA y robustez del modelo: Se abordan los desafíos de seguridad que enfrentan los modelos de IA, incluyendo la dirección de activación (Activation Steering) que podría comprometer la alineación de seguridad de los LLM (“The Rogue Scalpel”), la detección de fragmentos de alucinación (RL4HS) y los ataques de envenenamiento contra la dispersión gaussiana 3D (3DGS) (“StealthAttack”). Estas investigaciones revelan las vulnerabilidades potenciales de los sistemas de IA y proponen métodos para mejorar la seguridad y fiabilidad de los modelos. (Fuente: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

Mejora de la percepción y capacidad de razonamiento de los modelos multimodales: Cubre investigaciones como la fidelidad multi-agente de los modelos T2I, las recompensas dispersas en el razonamiento visual de grano fino de MLLM (RewardMap), el razonamiento perceptivo de VLM (AGILE), la comprensión de video (VideoNSA) y la recuperación de imágenes composicionales independiente del entrenamiento (SQUARE). Estos trabajos impulsan colectivamente los límites de rendimiento de los modelos multimodales en tareas como la generación de imágenes, la respuesta a preguntas visuales, el análisis de video y la recuperación transmodal. (Fuente: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

Desarrollo profesional en IA y recursos de aprendizaje: Recopila recursos como las habilidades clave en el campo de la IA para 2025, hojas de ruta profesionales para científicos de datos y científicos de LLM, consejos de desarrollo profesional para investigadores de IA, y Claude Cookbooks, proporcionando una guía completa para profesionales de la IA. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, BlackHC, Reddit r/deeplearning, GitHub Trending)

💼 Negocios

La valoración de OpenAI supera los 500.000 millones de dólares, convirtiéndose en la startup más valiosa del mundo: La valoración de OpenAI ha alcanzado los 500.000 millones de dólares, superando a SpaceX para convertirse en la startup privada más valiosa del mundo. Este hito refleja la enorme confianza del mercado en la tecnología de IA y su potencial de comercialización, aunque también ha generado debates sobre la burbuja de valoración y el modelo operativo de la empresa. Además, ChatGPT ha añadido una nueva función que permite realizar compras en línea directamente desde la interfaz de chat, ampliando aún más sus escenarios de aplicación comercial. (Fuente: TheRundownAI, Dorialexander, dl_weekly)

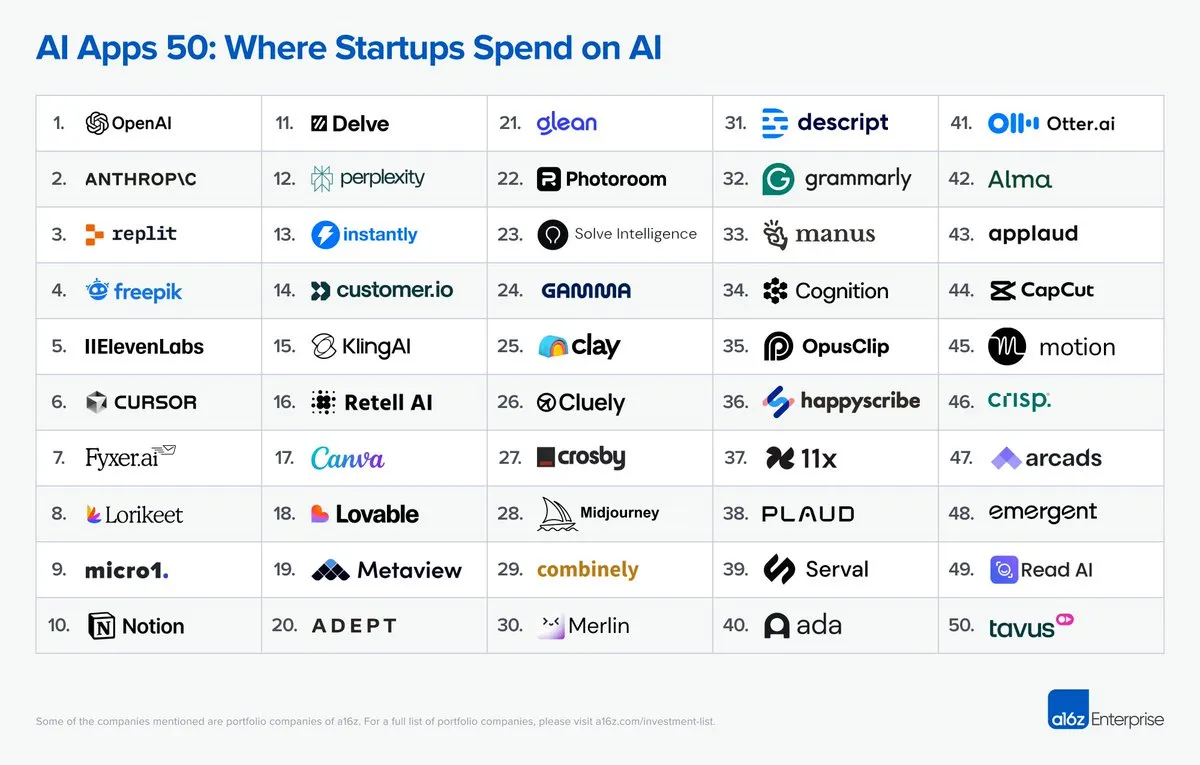

El informe AI Apps 50 revela las tendencias de gasto en IA de las startups: a16z, en colaboración con Mercury, ha publicado el informe “AI Apps 50: Startup Edition”, que analiza los gastos de las startups en aplicaciones de IA. Este informe proporciona información sobre la aplicación real y las direcciones de inversión de la tecnología de IA en startups, ayudando a comprender el panorama del mercado de IA y las tendencias emergentes, lo que lo hace valioso para inversores y emprendedores. (Fuente: amasad, amasad)

Groq despliega rápidamente su pila de IA y colabora con McLaren F1: Groq está desplegando su pila de IA a una “velocidad sin precedentes” y ha colaborado con el equipo McLaren F1, demostrando el potencial de sus chips de IA en el campo de la computación de alto rendimiento. Esta colaboración destaca el valor de la tecnología de IA en industrias que requieren procesamiento de datos y toma de decisiones a gran velocidad, como el automovilismo, y presagia la rápida expansión de Groq en el mercado de hardware de IA. (Fuente: JonathanRoss321, JonathanRoss321)

🌟 Comunidad

La IA remodela y desafía los campos creativos (música, escritura, arte): La IA está remodelando profundamente campos creativos como la música, la escritura y el arte, generando contenido a través de algoritmos. Esto ha provocado amplios debates sobre el papel de la IA en las industrias creativas, los modelos de colaboración entre humanos y IA, y la atribución de derechos de autor. Los artistas de IA se enfrentan al desafío de equilibrar la asistencia tecnológica con la originalidad, mientras que el contenido generado por IA también impacta los mercados creativos tradicionales y los modelos de ingresos de los creadores. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Reddit r/artificial)

El impacto de la IA en la percepción de la realidad y la confianza en el contenido digital: Con la popularización de herramientas de generación de IA como Sora 2, existe la preocupación de que la IA pueda imitar perfectamente música, películas, animaciones e incluso personas, haciendo que el contenido digital sea indistinguible entre lo real y lo falso, lo que podría llevar a que los medios en línea pierdan la conexión emocional y la confianza. La discusión en la comunidad sugiere que, en el futuro, la gente podría valorar más las experiencias reales fuera de línea, y el contenido generado por IA impulsará una nueva cultura de “hippies digitales” que solo consumirán medios anteriores a la era de la IA. Al mismo tiempo, algunos opinan que si el contenido generado por IA es de alta calidad, su autenticidad no es tan importante. (Fuente: vikhyatk, Reddit r/ArtificialInteligence, Reddit r/artificial, VictorTaelin)

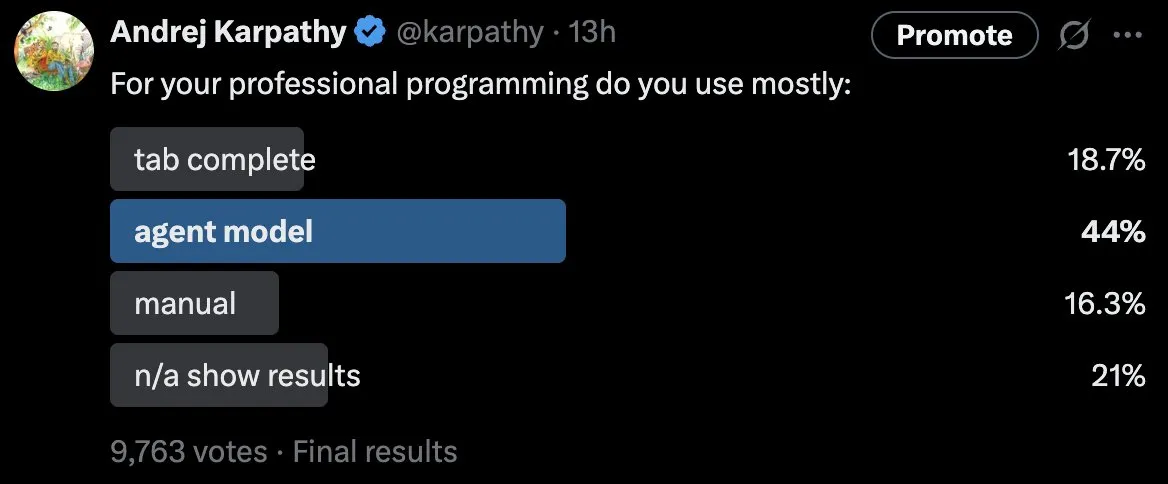

Patrones de aplicación y desafíos de los LLM en la programación profesional: Una encuesta iniciada por Andrej Karpathy muestra que aproximadamente la mitad de los programadores profesionales utilizan “principalmente” el modo de agente (es decir, hacen que los LLM escriban grandes cantidades de código a través de prompts de texto). Él expresó su sorpresa, argumentando que los LLM son propensos a problemas, redundancias y errores sutiles al tratar con problemas complejos o que se desvían del manifold de datos de entrenamiento. Esto ha provocado una discusión profunda sobre la capacidad real de los LLM en la programación profesional, los mejores modos de colaboración humano-máquina y las limitaciones del “Vibe Coding”, enfatizando que la IA aún es insuficiente frente a código profundo y entrelazado. (Fuente: karpathy)

Preocupaciones sobre la seguridad de la IA y las amenazas biológicas: Microsoft ha advertido que la IA podría crear amenazas biológicas de “día cero”, lo que ha generado una profunda preocupación en la comunidad sobre la seguridad de la IA. Al mismo tiempo, los experimentos sobre la “conspiración de la IA para matar investigadores” también han provocado debates; la mayoría cree que los LLM solo predicen texto basándose en patrones de datos, y no “piensan” o “conspiran” realmente, pero algunos temen que la IA aprenda el mal del comportamiento humano. Estas discusiones resaltan cuestiones clave de ética, seguridad y control en el desarrollo de la IA. (Fuente: Reddit r/artificial, Reddit r/ArtificialInteligence)

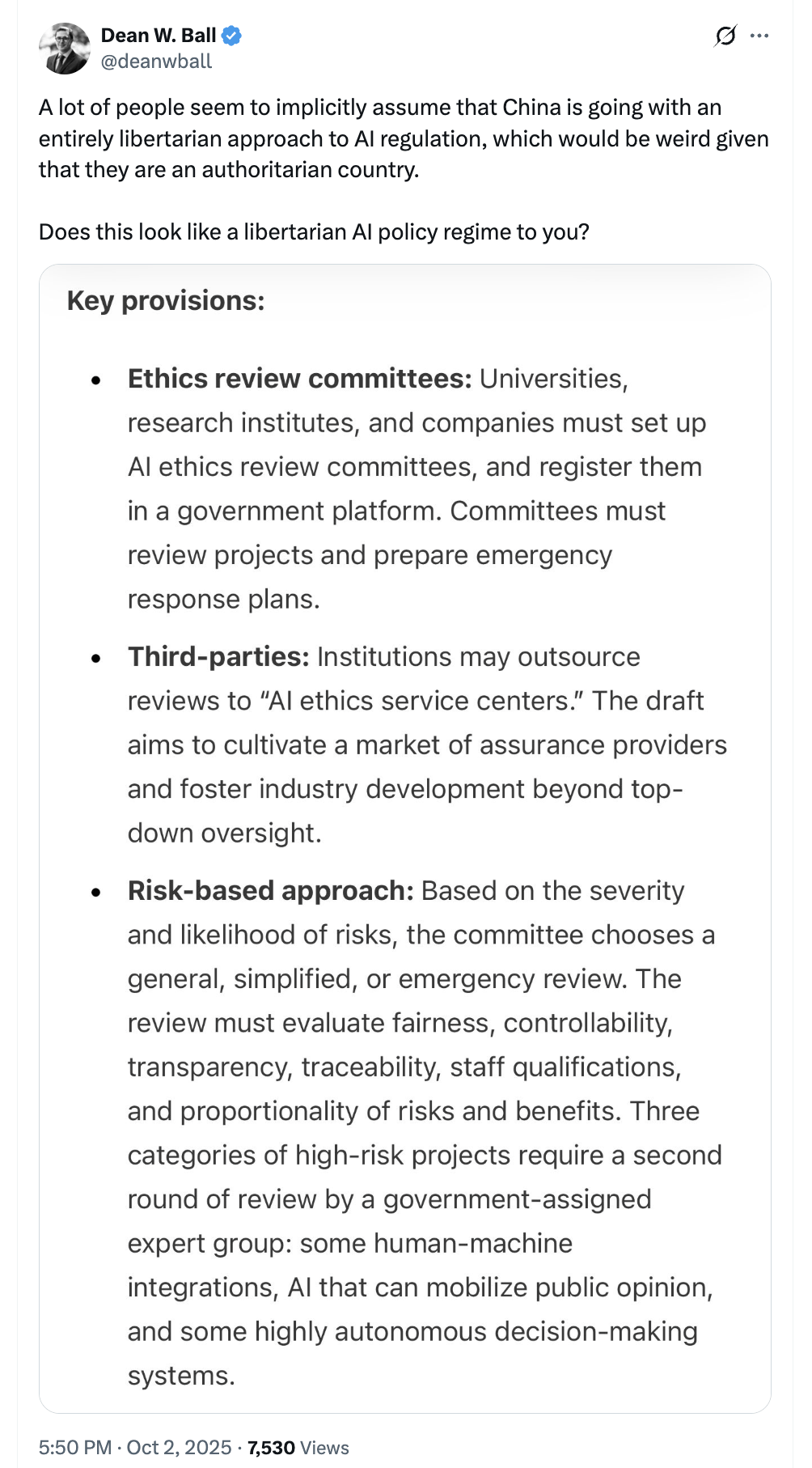

Regulación de la IA: diferencias estratégicas entre China y Occidente e implicaciones geopolíticas: En respuesta a la afirmación de los lobistas de la IA de que “China no regula la IA, por lo que cualquier regulación nos dejará atrás”, algunos argumentan que China está implementando una regulación de IA más estricta que Estados Unidos. La discusión en la comunidad sugiere que el desarrollo de la tecnología de IA es difícil de suprimir por completo, y la regulación afecta principalmente la comercialización, no la investigación en sí. La IA se está convirtiendo cada vez más en una cuestión geopolítica, y la competencia entre Occidente y China en la pila de IA se considera una batalla clave por la plataforma. (Fuente: teortaxesTex, Reddit r/artificial, kylebrussell)

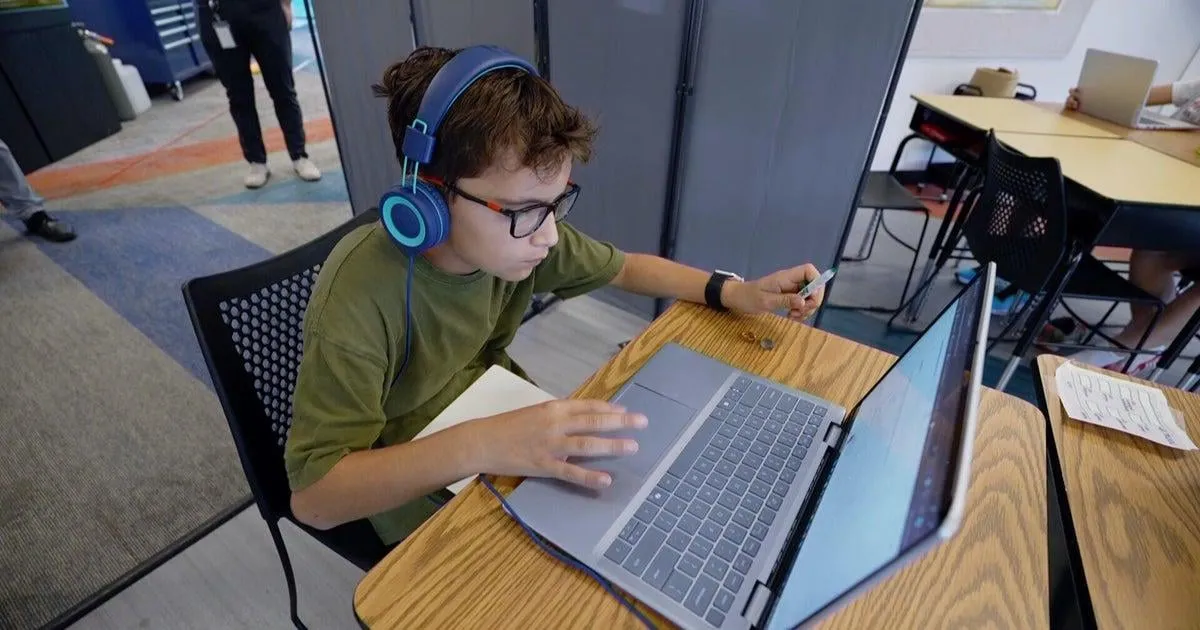

Aplicación y controversia de la IA en el ámbito educativo: Una “Alpha School” con una matrícula anual de 40.000 dólares utiliza software personalizado impulsado por IA para dar forma a cada lección, donde los adultos en el aula actúan como “facilitadores” en lugar de maestros tradicionales. Este modelo ha generado debates sobre si la IA reemplazará a los maestros, la equidad educativa y la justificación de las altas matrículas. Los defensores creen que la IA puede personalizar los planes de estudio para cada estudiante, resolviendo el problema del “talla única” de la educación tradicional; los opositores, por su parte, están preocupados por su modelo de negocio y el impacto en el papel del maestro. (Fuente: Reddit r/artificial, Reddit r/ArtificialInteligence)

La IA y el futuro de los derechos de autor y la creación de contenido: Los artistas esperan frenar el desarrollo de la IA a través de la protección de derechos de autor, pero algunos opinan que la nueva generación de líderes verá las ventajas de “todo es remezclable” y la distribución gratuita. Esto presagia que la IA impulsará la creación de contenido hacia un nuevo paradigma, desafiando las concepciones tradicionales de derechos de autor y el ecosistema creativo. Además, el origen de los datos de entrenamiento de Sora 2 (como Instagram, YouTube, TikTok) y si se pagaron derechos de autor por ellos también ha generado debates éticos. (Fuente: kylebrussell, bookwormengr)

La IA Agentic revoluciona la observabilidad: La IA Agentic está redefiniendo la observabilidad, pasando de la resolución de problemas a la transformación del ciclo de vida. Los agentes de IA no solo aceleran la respuesta a incidentes, sino que también mejoran la detección, el monitoreo, la ingesta de datos y la remediación en todo el ciclo de vida de la observabilidad. Transforman la “búsqueda” en “razonamiento”, permitiendo a los usuarios preguntar directamente sobre el estado del sistema. Además, para las cargas de trabajo de IA, se necesitan nuevas métricas para monitorear alucinaciones, sesgos, costos y la calidad del uso de LLM. (Fuente: Ronald_vanLoon)

Desafíos y estrategias de éxito en la integración de productos de IA: La comunidad ha discutido las razones por las que el 99% de las empresas fallan en la integración de la IA y las estrategias para el éxito. Se enfatiza que considerar la IA como una estrategia central, enfocarse en el valor de negocio, superar las barreras de integración y construir una cultura organizacional que apoye la innovación en IA son claves para el éxito, proporcionando orientación práctica para que las empresas implementen la IA de manera efectiva. (Fuente: Ronald_vanLoon)

Contenido generado por IA y problemas éticos: bots de estafa de IA: Los bots de estafa de IA se hacen pasar por humanos para conversar e implementar fraudes financieros como el “pig butchering”, lo que genera preocupación en la comunidad sobre el abuso de la tecnología de IA, la autenticidad de la identidad digital y la seguridad de la privacidad del usuario. Se hace un llamado a aumentar la vigilancia y se discute cómo identificar y contrarrestar los métodos de estafa de IA cada vez más complejos. (Fuente: Reddit r/ArtificialInteligence)

Kling AI 2.5 Turbo y la competencia en generación de video con Sora 2: Kling AI 2.5 Turbo es considerado un fuerte competidor de Sora 2 debido a sus efectos de generación de video de alta calidad; los usuarios han demostrado sus capacidades en escenas complejas y efectos visuales. La comunidad discute que las aplicaciones de IA chinas están alcanzando rápidamente, pero necesitan fortalecerse en el procesamiento de audio, lo que presagia una intensa competencia en el campo de la generación de video. (Fuente: bookwormengr, Kling_ai, Kling_ai, Kling_ai, bookwormengr)

💡 Otros

Avances en tecnología robótica: inspección de barcos, servicio de palomitas y control de calidad en fábricas: La tecnología robótica continúa evolucionando, dando lugar a diversas aplicaciones. Por ejemplo, se utilizan robots para inspeccionar las paredes de los cascos de los barcos, garantizando la seguridad marítima. El robot Optimus ha demostrado su capacidad de servicio, pudiendo ofrecer palomitas de maíz. La empresa CasiVision ha lanzado el robot humanoide con ruedas CASIVIBOT, diseñado específicamente para la inspección de calidad en fábricas inteligentes. Estos avances indican que los robots están penetrando gradualmente en diversas industrias, mejorando los niveles de automatización y la eficiencia del trabajo. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Meta FAIR lanza Code World Model (CWM) para explorar la generación y el razonamiento de código: Meta FAIR ha lanzado Code World Model (CWM), un modelo de investigación de 32B parámetros, diseñado para explorar cómo los modelos del mundo pueden transformar la generación y el razonamiento de código. El lanzamiento de CWM tiene como objetivo impulsar el progreso en la investigación de modelos del mundo y se comparte bajo una licencia de investigación, empoderando a la comunidad para una mayor innovación en el campo de la comprensión y generación de código. (Fuente: NandoDF)

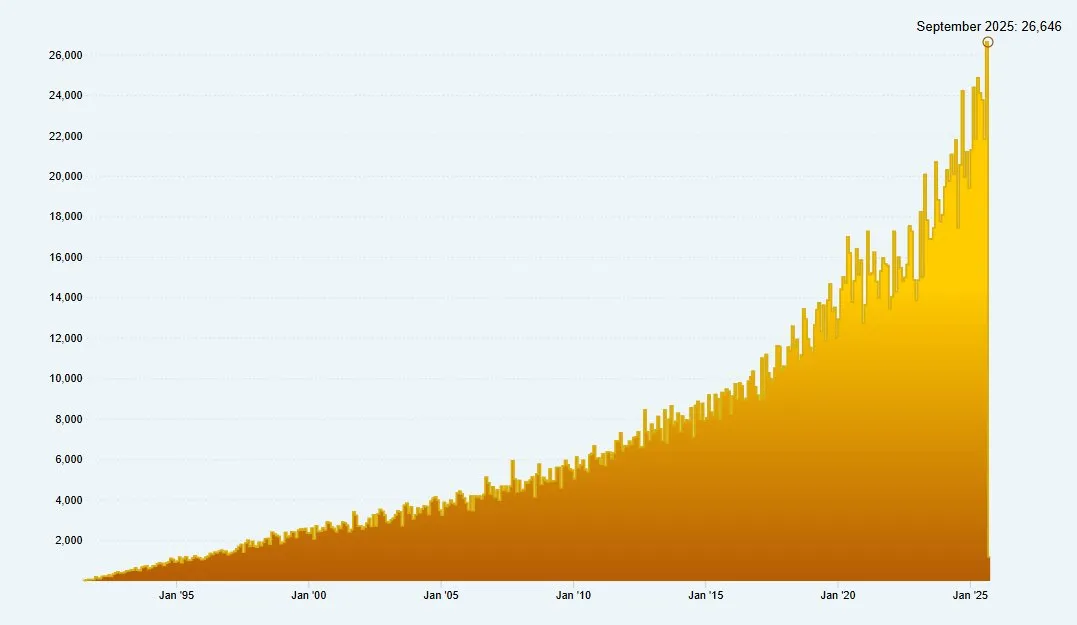

Aumento masivo de envíos de artículos a arXiv y presión editorial: arXiv recibió un total de 26.646 nuevas presentaciones de artículos en septiembre de 2025, mientras que solo cuenta con 7 editores y personal de soporte al usuario. Esta enorme carga de trabajo ha generado preocupación sobre la presión operativa de las plataformas de acceso abierto, destacando los desafíos que enfrenta la revisión y gestión de artículos en el contexto del rápido desarrollo de la investigación científica. (Fuente: clefourrier)