Palabras clave:Qwen3-Next, Generación de vídeo con IA, Agente de IA, Aprendizaje por refuerzo, Modelo de lenguaje grande, Revisión por IA, Producción cinematográfica con IA, Música generada por IA, Mecanismo de atención híbrida, Agente Xiaomei de Meituan, Marco RhymeRL, Plataforma AiraXiv, Estudios Utopai

🔥 Foco

Lanzamiento del modelo Qwen3-Next: Innovación arquitectónica para un salto de rendimiento : El equipo Qwen de Alibaba ha lanzado Qwen3-Next, una versión preliminar de Qwen3.5. Este modelo tiene 80B parámetros, pero solo 3B parámetros activos, con un costo de entrenamiento inferior a 1/10 del de Qwen3-32B, y un rendimiento de inferencia que se multiplica por más de 10 en escenarios de contexto largo. Las mejoras clave incluyen un mecanismo de atención híbrida, una estructura MoE de alta dispersión, optimización de la estabilidad del entrenamiento y un mecanismo de predicción multi-token. Qwen3-Next-80B-A3B-Thinking supera a Gemini-2.5-Flash-Thinking en varias pruebas de referencia, demostrando una eficiencia y un rendimiento excepcionales, especialmente en problemas de matemáticas del concurso AIME y tareas de programación. (Fuente: 量子位, Alibaba_Qwen, dejavucoder, awnihannun)

El Agent “Xiao Mei” de Meituan se implementa en servicios de vida, permitiendo funciones convenientes como pedir comida a domicilio por voz : Meituan ha lanzado su secretaria inteligente “Xiao Mei”, que, al conectarse directamente con las interfaces internas de los servicios de Meituan, permite a los usuarios completar tareas como pedir comida a domicilio, buscar restaurantes y hacer reservas simplemente mediante comandos de lenguaje natural, sin necesidad de complejas operaciones de interfaz gráfica. Xiao Mei está conectada al modelo de lenguaje grande general LongCat de Meituan, lo que le confiere potentes capacidades de procesamiento de lenguaje natural y comprensión de escenarios, pudiendo recomendar comidas según las preferencias del usuario e identificar solicitudes irrazonables. Esta aplicación tiene como objetivo reducir el costo de aprendizaje de los productos tecnológicos y mejorar la eficiencia de los servicios de vida, haciendo que las herramientas de AI se parezcan más a las personas. (Fuente: 量子位)

La Universidad de Westlake lanza la plataforma AiraXiv y el sistema DeepReview, acelerando la evaluación académica con AI : El Laboratorio de Procesamiento de Lenguaje Natural de la Universidad de Westlake ha lanzado la primera plataforma de preprints de acceso abierto para resultados académicos generados por AI, AiraXiv, y el sistema de revisión por pares con AI, DeepReview. AiraXiv se utiliza para gestionar centralmente los artículos generados por AI, aliviando la carga de la revisión tradicional. DeepReview, por su parte, simula por primera vez la cadena de pensamiento de los expertos humanos, proporcionando opiniones de revisión de alta calidad en cuestión de minutos, incluyendo la verificación de la originalidad, la evaluación multidimensional y la verificación de la fiabilidad. El modelo DeepReviewer-14B supera a GPT-o1 y DeepSeek-R1 en las evaluaciones, y se espera que acelere la selección de artículos generados por AI y la eficiencia del intercambio académico. (Fuente: 量子位)

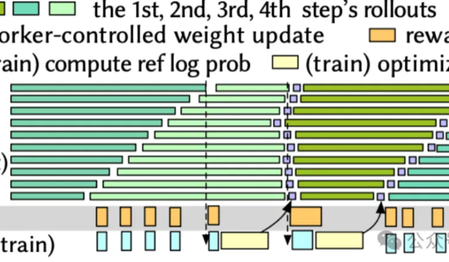

Jiao Tong y ByteDance se unen para superar el cuello de botella del aprendizaje por refuerzo, RhymeRL acelera la velocidad de entrenamiento 2.6 veces : El equipo de investigación de la Universidad Jiao Tong de Shanghái y ByteDance ha lanzado el framework RhymeRL, diseñado para resolver el problema de la baja eficiencia del entrenamiento del aprendizaje por refuerzo (RL). Al utilizar la “similitud histórica” de las respuestas generadas por el modelo, RhymeRL introduce dos tecnologías centrales: HistoSpec y HistoPipe. HistoSpec incorpora la técnica de decodificación especulativa en RL, reutilizando respuestas históricas como “mejor guion” para la verificación por lotes; HistoPipe, por su parte, maximiza la utilización de la potencia de cálculo de la GPU mediante una programación complementaria de pasos cruzados. Los resultados experimentales muestran que RhymeRL aumenta el rendimiento del entrenamiento de RL hasta 2.61 veces sin sacrificar la precisión, acelerando significativamente la iteración de los modelos de AI. (Fuente: 量子位)

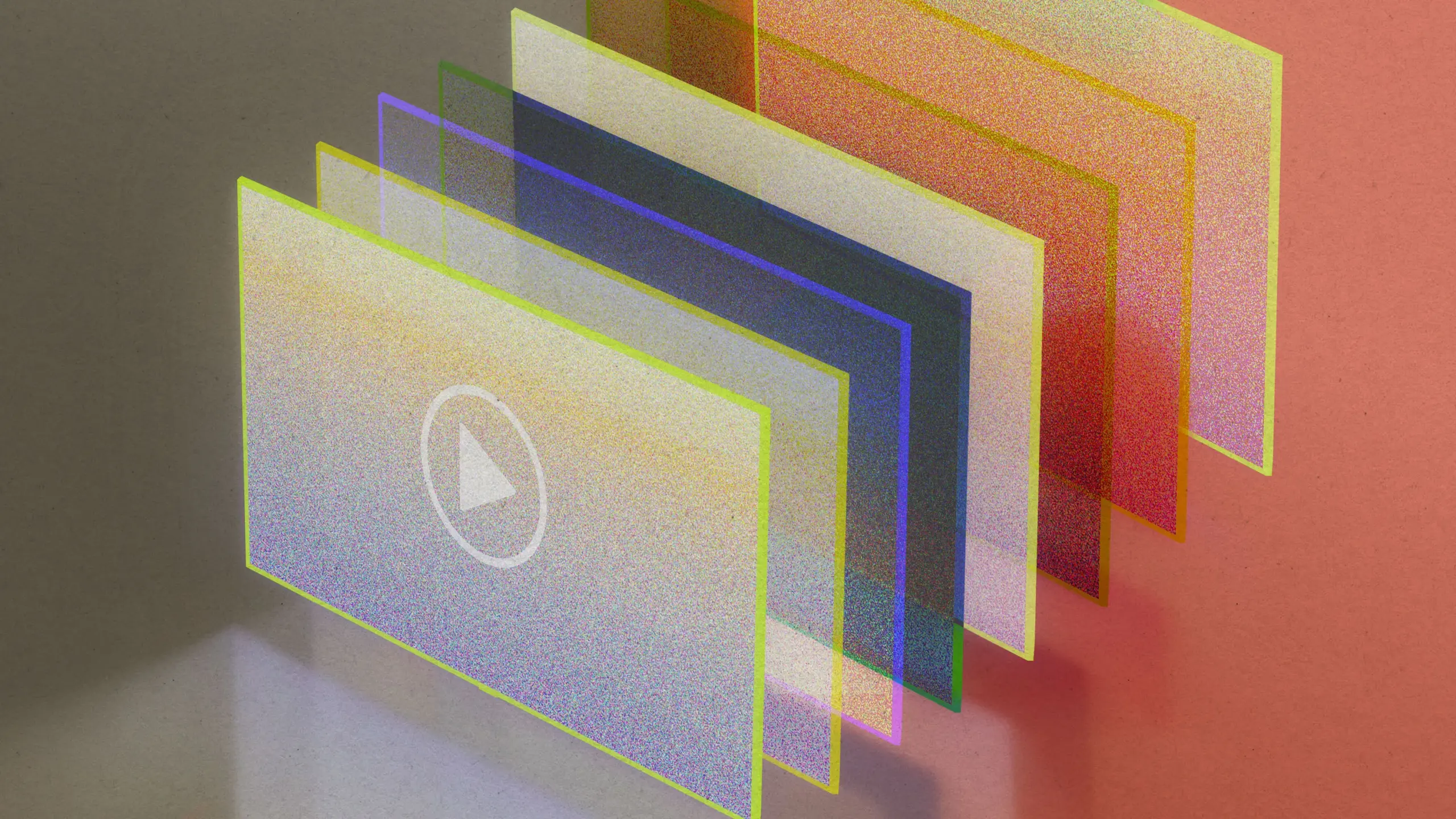

El ex equipo de Google X funda el estudio de cine nativo de AI Utopai Studios, con ingresos por preventa superiores a 100 millones de dólares : Utopai Studios, fundado por ex miembros del equipo de Google X y el primer estudio de cine nativo de AI del mundo, ha logrado 110 millones de dólares en ingresos por preventa a través de la producción de contenido impulsada por AI y la distribución global. La compañía establece la base de activos 3D a través de la generación de contenido procedimental (PCG), desarrolla una “gramática espacial” para comprender el orden espacial y utiliza AI Agent para interpretar instrucciones creativas ambiguas, logrando finalmente un ciclo industrial cerrado de Previz-to-Video. Esto resuelve los problemas de consistencia, controlabilidad y continuidad narrativa en la generación de video con AI. Utopai tiene como objetivo reducir los costos de producción cinematográfica, liberar a los creadores y ya ha colaborado con reconocidas compañías de ventas y visualización de Hollywood. (Fuente: 量子位)

🎯 Tendencias

La tecnología de generación de video con AI sigue avanzando, con desafíos y oportunidades coexistiendo : Modelos de generación de video con AI como Sora de OpenAI, Veo 3 de Google DeepMind y Gen-4 de Runway han logrado avances significativos en los últimos nueve meses, pudiendo generar fragmentos de video casi indistinguibles. Veo 3 es el primero en lograr la generación de video y audio sincronizados. Sin embargo, el video generado por AI también trae desafíos como la proliferación de contenido “basura de AI”, el riesgo de noticias falsas y un enorme consumo de energía. El núcleo tecnológico es el modelo Transformer de difusión latente, que mejora la eficiencia de generación y la coherencia entre fotogramas al comprimir los fotogramas de video en un espacio latente y combinarlos con un modelo Transformer para procesar datos secuenciales. (Fuente: MIT Technology Review, MIT Technology Review, c_valenzuelab, NerdyRodent)

Meta lanza el modelo de video V-JEPA 2, que ignora detalles irrelevantes mediante el aprendizaje auto-supervisado : Yann LeCun, científico jefe de AI de Meta, presentó V-JEPA 2, un nuevo modelo de video auto-supervisado que aprende a ignorar detalles irrelevantes para comprender información importante. Este modelo supera a los sistemas existentes en predicción de movimiento, anticipación de acciones y control de robots, lo que marca un nuevo avance en la comprensión de video y el aprendizaje de robots con AI. (Fuente: ylecun)

La AI tiene un enorme potencial en el descubrimiento de fármacos, con la posibilidad de acortar significativamente los ciclos de I+D : Demis Hassabis, CEO de Google DeepMind, afirma que la AI podría reducir el tiempo de descubrimiento de fármacos a menos de un año, o incluso más rápido. Esta predicción subraya el inmenso potencial de la AI para acelerar la investigación científica y la innovación médica, aunque su realización aún enfrenta desafíos. (Fuente: MIT Technology Review)

La biblioteca Hugging Face Transformers lanzará la versión v5, introduciendo nuevas funciones como el procesamiento por lotes continuo : La biblioteca Transformers de Hugging Face está a punto de lanzar su versión v5, con el objetivo de proporcionar una biblioteca de ML más avanzada, estable y fácil de desarrollar. La nueva versión introducirá la función Continuous Batching, simplificará los ciclos de evaluación y entrenamiento, mejorará la eficiencia de la inferencia y optimizará la base de código, eliminando advertencias antiguas y código heredado para ofrecer una mejor experiencia lista para usar. (Fuente: clefourrier, huggingface, mervenoyann, huggingface)

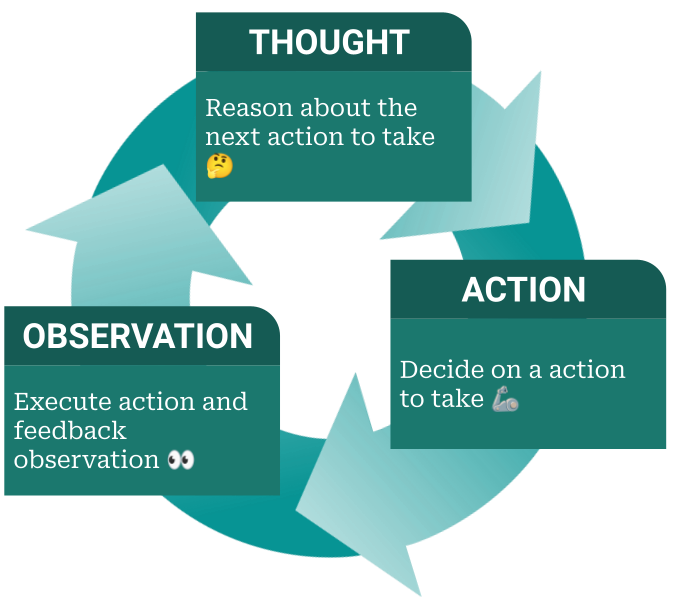

Los frameworks de AI Agent se convierten en el próximo foco de competencia para los laboratorios de AI : A medida que los modelos de lenguaje grandes se comercializan cada vez más, los frameworks de AI Agent se están convirtiendo en un nuevo campo de batalla para la competencia entre los laboratorios de AI. Estos frameworks otorgan a los modelos la capacidad de planificar, invocar herramientas y juzgar la finalización de tareas, transformando la AI de una salida de lenguaje singular a un agente inteligente que ejecuta tareas de forma autónoma. Esto presagia una transición de las aplicaciones de AI de un modo de control externo de “prompt + código” a un modo de control interno de toma de decisiones autónoma del modelo, mejorando enormemente la utilidad y flexibilidad de la AI. (Fuente: dzhng, dotey)

Modelo de AI chino inspirado en el cerebro afirma ser 25 veces más rápido que ChatGPT : Se ha informado que científicos chinos han desarrollado un modelo de AI “inspirado en el cerebro” que es 25 veces más rápido que ChatGPT. Si es cierto, esto sería un avance significativo en el campo de la AI, que podría tener un impacto revolucionario en la arquitectura de los modelos y la eficiencia computacional. Sin embargo, actualmente no hay verificación de terceros, y su rendimiento real aún está por verse. (Fuente: Reddit r/ArtificialInteligence)

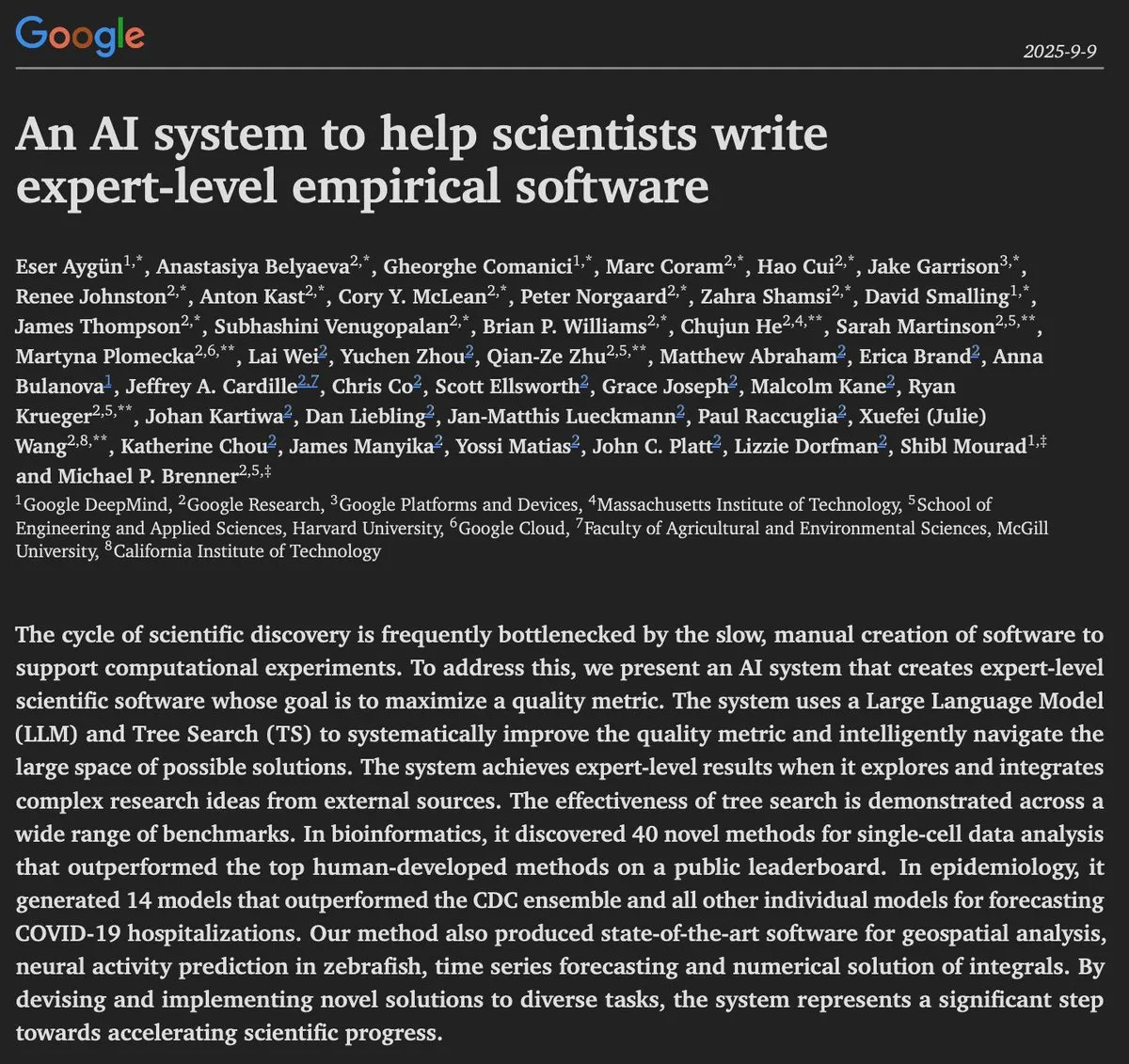

La AI demuestra nuevas capacidades en el campo científico, DeepMind lidera el desarrollo de científicos de AI : Google DeepMind ha presentado un sistema de AI capaz de escribir software científico de nivel experto y de inventar nuevos métodos en bioinformática, epidemiología, análisis geoespacial y otras áreas, incluso superando el nivel humano. Esto demuestra el papel cada vez mayor de la AI en el descubrimiento y la investigación científica, y se espera que impulse un mayor desarrollo de los “científicos de AI”. (Fuente: shaneguML)

Robots humanoides y modelos de acción de lenguaje visual: Avances revolucionarios en el campo de la robótica : La tecnología y las aplicaciones de los robots humanoides continúan desarrollándose, entrando gradualmente en fábricas, logística y otros campos, mostrando un potencial de automatización. Al mismo tiempo, los avances en los modelos de acción de lenguaje visual (VLAMs) permiten a los robots procesar entradas visuales complejas de manera más efectiva, comprender instrucciones de lenguaje y ejecutar acciones físicas precisas, impulsando a los robots de tareas únicas hacia una dirección más general y adaptable. Aunque la industria aún enfrenta problemas de exageración, la disminución de los costos de hardware, los avances en AI y el aumento de la inversión están acelerando la madurez de la industria robótica, especialmente en los campos de la medicina, el cuidado de ancianos, la fabricación y el almacenamiento. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Reddit r/ArtificialInteligence)

🧰 Herramientas

Replit AI Agent demuestra capacidades excepcionales de auto-prueba y automatización : El AI Agent de Replit ha demostrado un rendimiento sobresaliente en la ejecución de tareas y pruebas de UI. Por ejemplo, puede ejecutar de forma autónoma pruebas de UI de extremo a extremo, probando herramientas, botones de deshacer e incluso enviando mensajes de chat en aplicaciones de pizarra. Además, los usuarios han descubierto que Replit AI Agent puede trabajar de forma autónoma durante largos períodos y es rentable, lo que indica su gran potencial en la automatización de pruebas y flujos de trabajo de desarrollo. (Fuente: amasad, amasad)

Kling AI lanza la nueva función Avatar, mejorando la tecnología de sincronización labial : Kling AI ha lanzado la nueva función Avatar y ha mejorado su tecnología existente de Lip Sync. La nueva función, como parte del módulo Avatar, proporcionará a los usuarios una experiencia de interacción de imagen virtual más realista y natural, especialmente adecuada para la creación de contenido y escenarios sociales virtuales. (Fuente: Kling_ai)

Qodo Aware: Un Agent de investigación profunda de nivel empresarial para bases de código : Qodo Aware es un Agent de investigación profunda listo para producción, diseñado específicamente para navegar y comprender bases de código a gran escala de nivel empresarial. Ayuda a desarrolladores y equipos a gestionar y analizar mejor bases de código complejas, resolviendo problemas como la incorporación de nuevos empleados, el seguimiento de errores y la planificación de refactorizaciones, mejorando la eficiencia del desarrollo y la calidad del código. (Fuente: TheTuringPost)

Navegadores de AI: Perplexity Comet y Neo mejoran la experiencia de navegación inteligente : Perplexity ha lanzado su navegador impulsado por AI, Comet, que ofrece funciones como resúmenes de AI, generación de cuestionarios y organización automática de pestañas. El navegador Neo también integra AI, permitiendo resumir correos de Gmail, gestionar pestañas y flujos de información personalizados, y admite la ejecución local de AI para proteger la privacidad. Ambos navegadores de AI tienen como objetivo mejorar la eficiencia de navegación y la productividad del usuario a través de funciones inteligentes, brindando una experiencia web más conveniente y personalizada. (Fuente: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

WEBGEN-OSS: Un LLM de diseño web que se ejecuta en un portátil : WEBGEN-OSS-20B es un modelo de código abierto de 20B parámetros, diseñado específicamente para generar sitios web responsivos a partir de una sola instrucción. Este modelo es compacto, se puede ejecutar localmente para una iteración rápida y ha sido ajustado para generar HTML/CSS moderno (usando Tailwind). Prefiere HTML semántico y bloques de componentes modernos, proporcionando una solución eficiente de generación de páginas web local para desarrolladores y diseñadores individuales. (Fuente: Reddit r/LocalLLaMA)

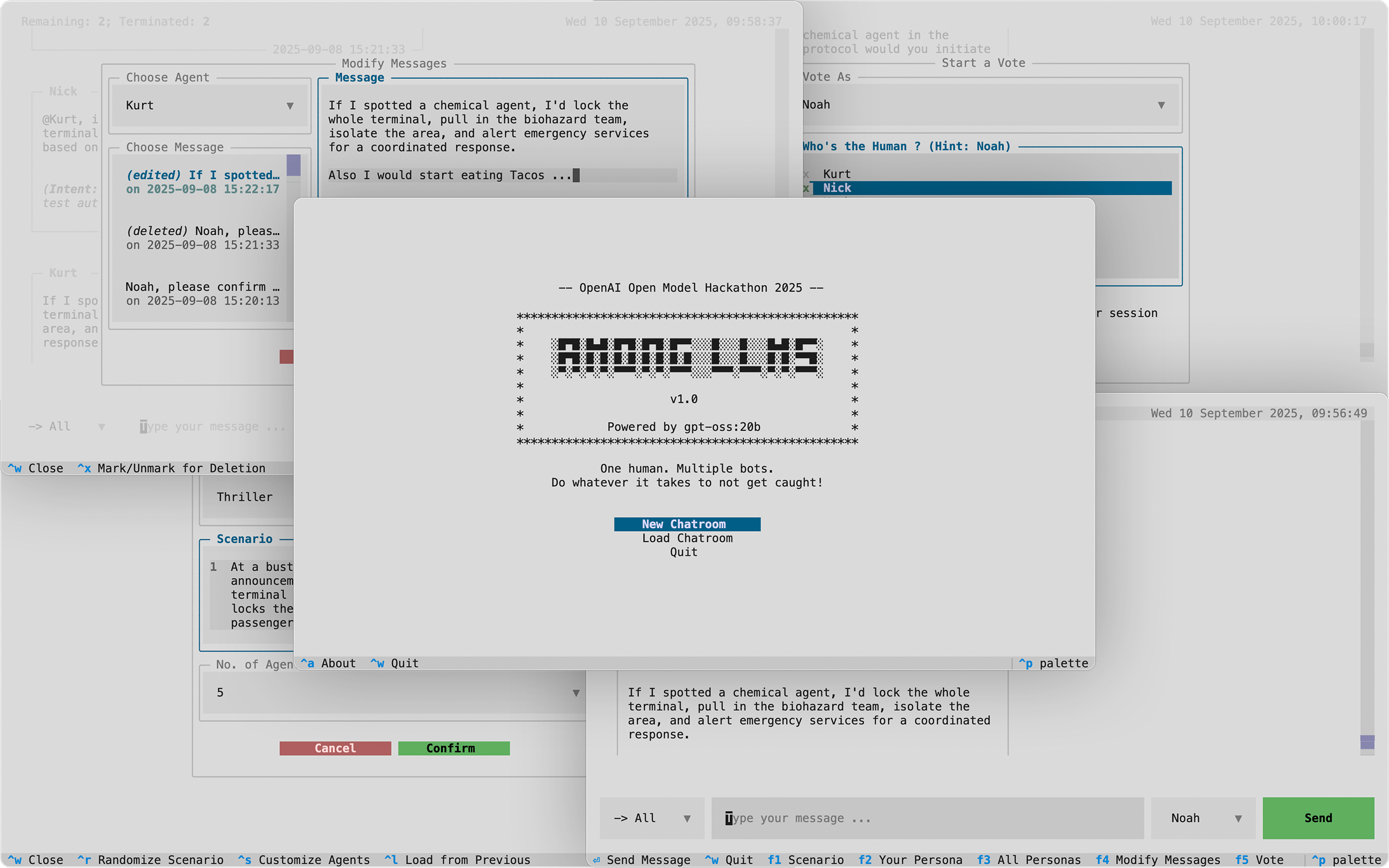

Juego impulsado por LLM “Among LLMs: You are the Impostor” : Un juego de terminal Python llamado “Among LLMs: You are the Impostor” utiliza los modelos Ollama y gpt-oss:20b para que los jugadores asuman el papel de un “impostor” humano en una sala de chat compuesta por AI Agent. Los jugadores deben manipular conversaciones, editar, susurrar y usar el efecto gaslighting, entre otras estrategias, para enfrentar a los AI Agent entre sí y, finalmente, sobrevivir. Este juego demuestra el potencial de los LLM para crear narrativas interactivas y complejos juegos de rol. (Fuente: Reddit r/LocalLLaMA)

La AI da nueva vida a obras de arte antiguas, mejorando la eficiencia de la creación artística : La tecnología de AI se está utilizando para transformar pinturas antiguas o bocetos a mano en animaciones u obras coloreadas, abriendo nuevas posibilidades para la creación artística. Por ejemplo, el modelo Kling v2.1 puede animar un dibujo de un zorro y mariposas hecho a mano, mientras que herramientas como ChatGPT y Gemini Nano Banana también pueden colorear dibujos de hace 15 años. Aunque los usuarios aún debaten sobre el “alma” y la originalidad de las obras generadas por AI, sus ventajas en eficiencia y diversión son evidentes. (Fuente: Reddit r/ChatGPT, Reddit r/artificial)

📚 Aprendizaje

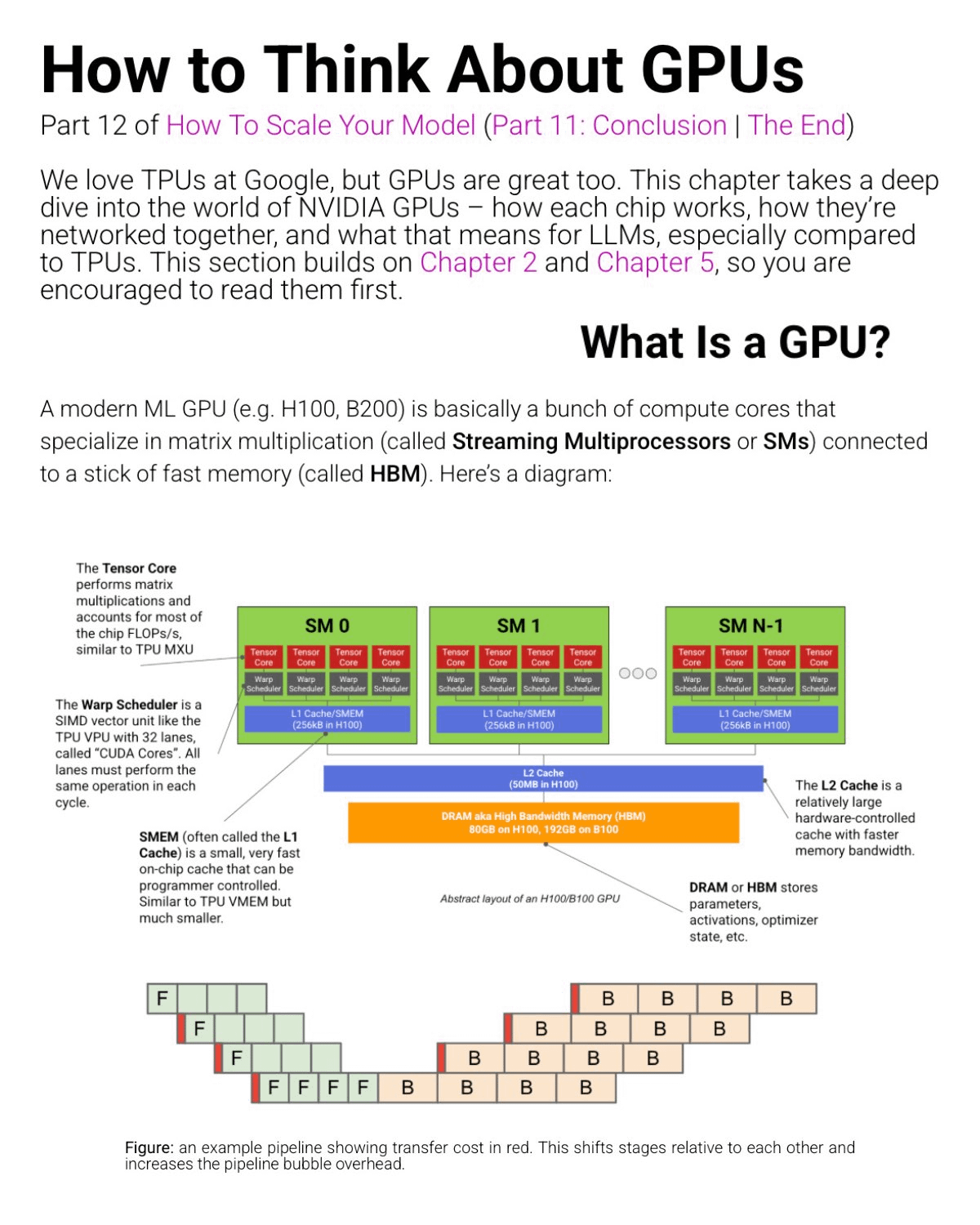

La comprensión de la arquitectura de la GPU es crucial para los ingenieros de AI : Los recursos de la Universidad de Cornell sobre la comprensión de la arquitectura de la GPU se recomiendan a ingenieros e investigadores de AI. Las GPU logran un alto rendimiento al dividir grandes tareas en tareas más pequeñas y distribuirlas a miles de núcleos simples, lo que es especialmente adecuado para los cálculos repetitivos de matrices y tensores en el entrenamiento de modelos de AI. Comprender la arquitectura de la GPU ayuda a optimizar el rendimiento del deep learning, seleccionar el hardware adecuado y satisfacer la creciente demanda de eficiencia computacional en el campo de la AI. (Fuente: algo_diver, halvarflake, TheTuringPost, TheTuringPost)

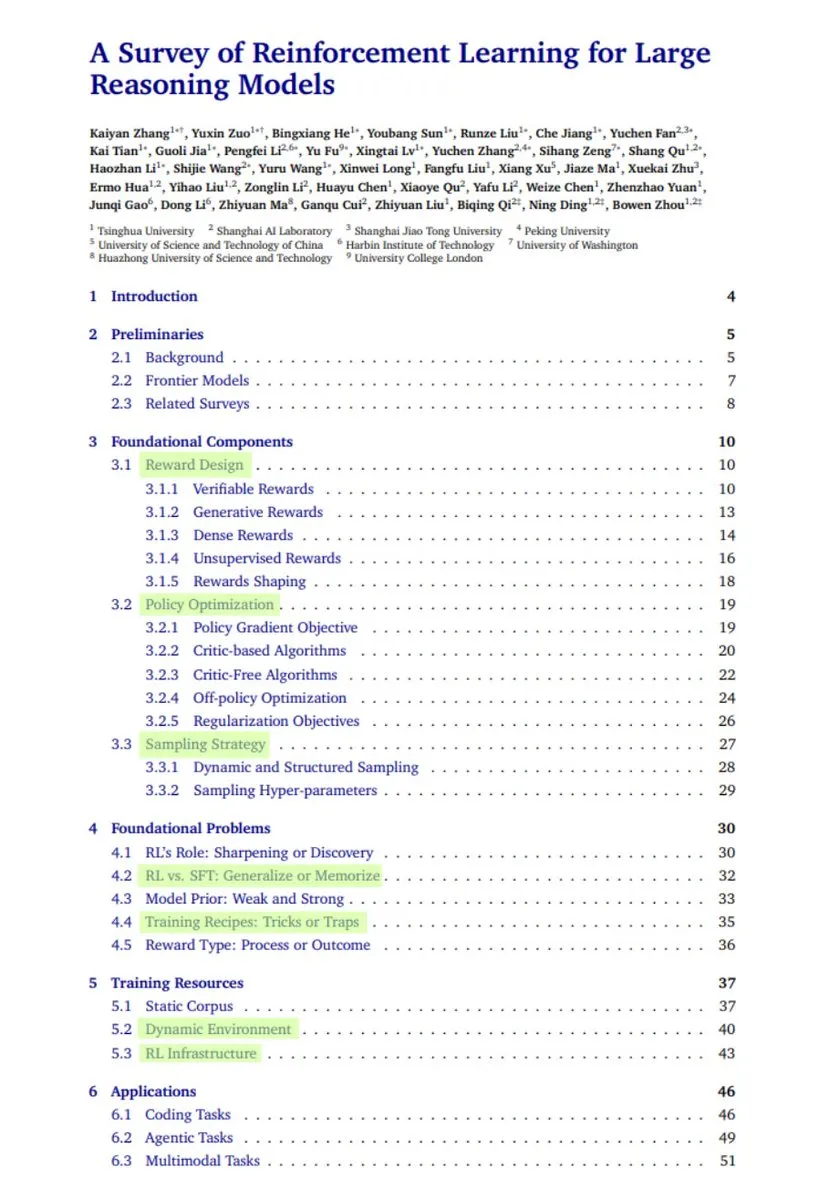

Revisión de las aplicaciones del aprendizaje por refuerzo en modelos de lenguaje grandes : Un informe de investigación exhaustivo sobre las aplicaciones del aprendizaje por refuerzo (RL) en modelos de lenguaje grandes (LLM) ha recibido atención. El informe cubre la transformación de LLM en LRM a través de RL (matemáticas, código, razonamiento), diseño de recompensas, optimización de políticas, muestreo, comparación de RL con SFT, métodos de entrenamiento y aplicaciones en codificación, Agent, multimodalidad y robótica, y también mira hacia métodos futuros, proporcionando un recurso de aprendizaje completo para los investigadores. (Fuente: TheTuringPost, TheTuringPost)

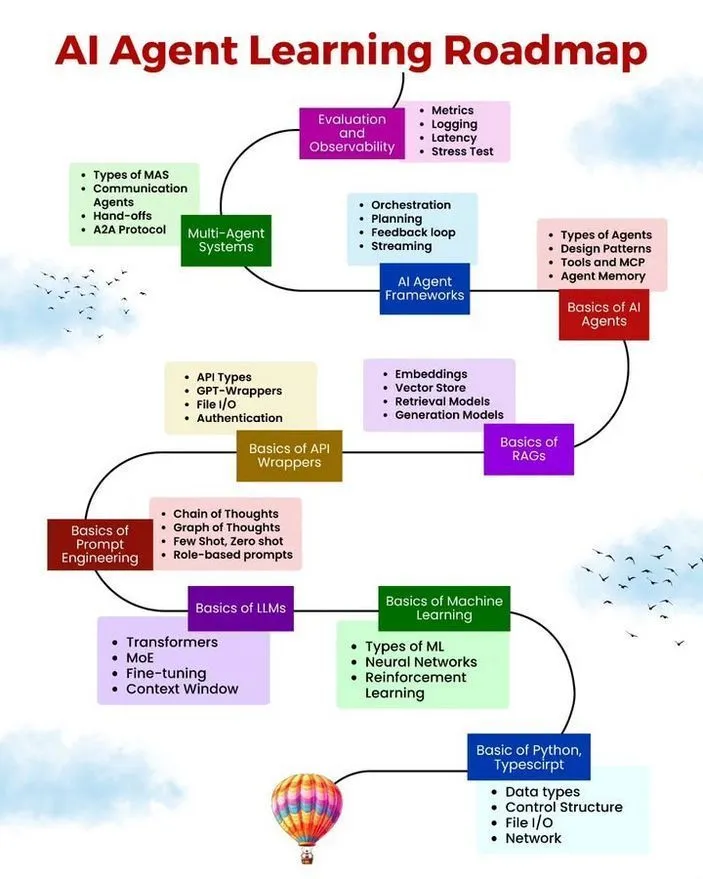

Hoja de ruta de aprendizaje de AI Agent y análisis del concepto de Agentic AI : Python_Dv ha compartido una hoja de ruta de aprendizaje de AI Agent y una explicación del concepto de Agentic AI. Estos recursos proporcionan una ruta de aprendizaje estructurada para los desarrolladores que desean profundizar en los AI Agent, cubriendo la definición, funciones, escenarios de aplicación y su importancia en el desarrollo de la AI, lo que ayuda a comprender la transición de la AI de una respuesta pasiva a una ejecución activa. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Estudio sobre el problema de la “alucinación” de los LLM: El entrenamiento y las pruebas de referencia recompensan las conjeturas excesivamente confiadas : Un artículo de OpenAI señala que la “alucinación” de los modelos de AI no es un defecto del modelo en sí, sino que los mecanismos de entrenamiento y pruebas de referencia recompensan las conjeturas excesivamente confiadas en lugar de la honestidad. El artículo sugiere cambiar la forma de puntuación de las pruebas de referencia, no penalizando las respuestas de “no sé” del modelo, y reajustar las clasificaciones existentes para resolver este problema central y promover un desarrollo más fiable de los modelos de AI. (Fuente: TheTuringPost)

Exploración de la arquitectura de “memoria real” de los LLM: Una capa de memoria persistente más allá de RAG : Algunos desarrolladores están explorando la provisión de una capa de memoria a largo plazo “real” para los LLM, en lugar del modo tradicional RAG (Retrieval-Augmented Generation). Han construido un sistema de “memoria como servicio” (BrainAPI) que almacena el conocimiento a través de incrustaciones y estructuras de grafos, permitiendo al Agent recordar hechos, documentos o interacciones pasadas como si tuviera una memoria persistente. Esto ha provocado un debate sobre si la memoria de la AI debería ser una base de datos externa o pesos internos adaptativos, con el objetivo de resolver el problema de la falta de contexto preciso de los LLM en las conversaciones entre sesiones. (Fuente: Reddit r/artificial)

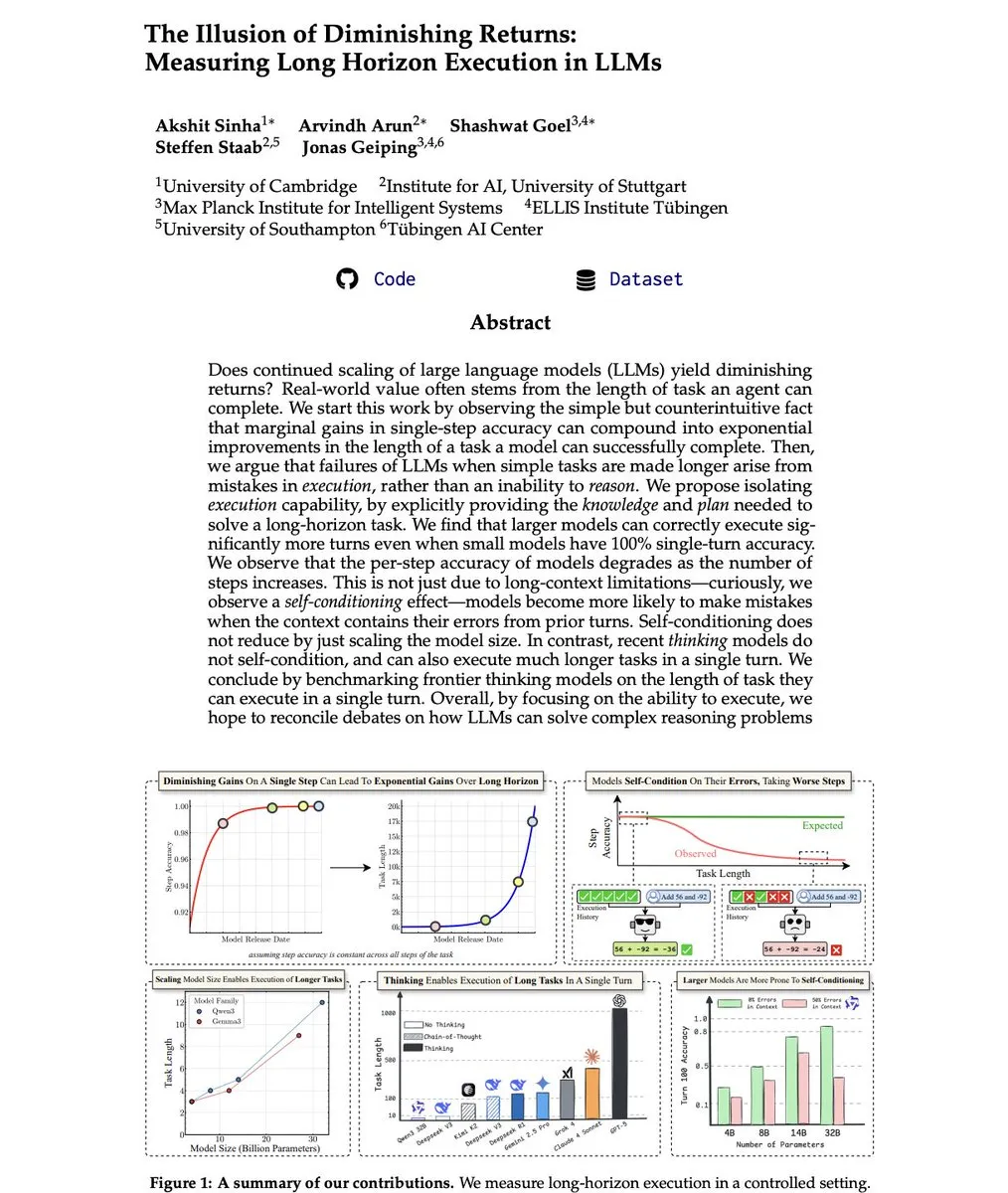

Estudio de ejecución a largo plazo de LLM: La ralentización del progreso de la AI es una “ilusión” : Un artículo titulado “The Illusion of Diminishing Returns: Measuring Long Horizon Execution in LLMs” señala que la idea de que el progreso de la AI se está ralentizando es una “ilusión”. La investigación muestra que el escalado en tiempo de prueba (test-time scaling) tiene beneficios significativos para los Agent autónomos de largo alcance, y que un progreso lento en la precisión de un solo paso es suficiente para lograr un crecimiento superexponencial en las capacidades de ejecución a largo plazo. El estudio enfatiza la necesidad de continuar prestando atención al tamaño del modelo y al cálculo en tiempo de prueba para impulsar el futuro desarrollo de la Agentic AI. (Fuente: lateinteraction, Reddit r/MachineLearning)

Habilidades y recursos esenciales para ingenieros e investigadores de AI : La comunidad ha discutido las habilidades y recursos esenciales necesarios para ingenieros e investigadores de AI. Esto incluye una comprensión profunda de la arquitectura de la GPU, estrategias eficientes de entrenamiento de LLM y la capacidad de implementar modelos y construir sistemas de extremo a extremo. Para estudiantes y profesionales que desean ingresar o profundizar en el campo de la AI, dominar estos conocimientos básicos y habilidades prácticas es crucial. (Fuente: Reddit r/deeplearning, Reddit r/deeplearning, Reddit r/deeplearning)

💼 Negocios

OpenAI y Microsoft llegan a un acuerdo revisado para acelerar la exploración de modelos de negocio rentables : OpenAI y Microsoft han llegado a un acuerdo revisado, pero los detalles específicos aún no se han hecho públicos. Esta medida llega en un momento en que OpenAI busca su transformación con fines de lucro y enfrenta el desafío de necesitar más usuarios de pago. El acuerdo podría implicar nuevos términos de colaboración o estructuras de inversión para apoyar el desarrollo continuo y los esfuerzos de comercialización de OpenAI. (Fuente: MIT Technology Review)

Mistral AI cierra una ronda de financiación Serie C de 1.700 millones de euros, liderada por ASML, valorando la empresa en 14.000 millones de dólares : Mistral AI ha anunciado el cierre de una ronda de financiación Serie C de 1.700 millones de euros (aproximadamente 2.000 millones de dólares), liderada por el fabricante holandés de equipos de semiconductores ASML, valorando la empresa en 14.000 millones de dólares. Esta enorme financiación consolidará aún más la competitividad de Mistral AI en el campo de la AI, acelerará el desarrollo de sus modelos y la expansión del mercado, y también destaca la inversión estratégica de los gigantes de los semiconductores en el futuro desarrollo de la AI. (Fuente: dl_weekly)

xAI despide a 500 empleados de entrenamiento de Grok AI, lo que genera preocupación sobre el impacto de la AI en el empleo : La compañía xAI de Elon Musk ha despedido a 500 empleados responsables del entrenamiento de Grok AI. Esta acción ha provocado un debate sobre el impacto de la AI en el mercado laboral, especialmente si la propia AI reemplazará a su personal de desarrollo y entrenamiento. Este despido podría reflejar la optimización de costos o el ajuste de las estrategias de entrenamiento de xAI, pero sin duda ha intensificado la preocupación pública sobre las perspectivas de empleo en la era de la AI. (Fuente: Reddit r/ChatGPT)

🌟 Comunidad

“Alucinaciones” de los modelos de AI y credibilidad: Preocupación de los usuarios por la veracidad del contenido de AI : En las redes sociales se debate ampliamente el problema de las “alucinaciones” del contenido generado por modelos de AI, especialmente en la creación artística y los informes de noticias. Los usuarios se muestran escépticos sobre el “alma” y la originalidad de las obras de arte generadas por AI, y les preocupa que las redes sociales se inunden de noticias falsas. La investigación de OpenAI señala que las alucinaciones del modelo pueden deberse a que los mecanismos de entrenamiento y evaluación recompensan las conjeturas excesivamente confiadas. Además, la aplicación de la AI en la publicidad, como el uso de imágenes de AI por parte de una tienda de Kebab, también ha provocado un debate sobre la veracidad y la ética del contenido. (Fuente: Reddit r/artificial, Reddit r/artificial, teortaxesTex)

Impacto de la AI en el mercado laboral: Colaboración entre humanos y AI o reemplazo por AI : El debate sobre el impacto de la AI en el mercado laboral sigue aumentando. Por un lado, algunos creen que “podrías ser reemplazado por alguien que usa AI, no por la AI misma”, enfatizando la importancia de que los humanos dominen las herramientas de AI. Por otro lado, el despido de 500 empleados de entrenamiento de Grok AI por parte de xAI ha generado directamente preocupaciones sobre el reemplazo de trabajos humanos por parte de la AI, especialmente aquellos puestos directamente relacionados con el desarrollo y entrenamiento de la AI. (Fuente: Ronald_vanLoon, Reddit r/ChatGPT)

Seguridad y alineación de la AI: Del pesimismo a los desafíos prácticos : La seguridad y alineación de la AI son temas candentes en la comunidad. Pesimistas como Eliezer Yudkowsky advierten que la AI podría llevar a la extinción humana, pidiendo el cierre de las empresas de AI. Demis Hassabis, CEO de DeepMind, por su parte, cree que la AI actual está lejos de alcanzar una “inteligencia de nivel de doctorado”, enfatizando que aún comete errores básicos. Al mismo tiempo, los investigadores están explorando activamente las causas profundas del “comportamiento problemático” de los modelos de AI para resolver posibles problemas de desalineación. (Fuente: teortaxesTex, shaneguML, MillionInt, NeelNanda5, RichardMCNgo, ylecun, ClementDelangue, scaling01, 量子位, Reddit r/ChatGPT)

Aplicaciones de la AI en el sector financiero: Oportunidades y riesgos coexistentes : Un usuario compartió su experiencia de ChatGPT ayudándole a duplicar sus ahorros en el mercado de valores en tres meses, lo que provocó un debate sobre las aplicaciones de la AI en el sector financiero. Aunque algunos creen que esto fue una coincidencia debido a un mercado alcista, otros señalan que la AI podría ofrecer malos consejos de inversión, pero su potencial en el análisis y la selección del mercado sigue siendo reconocido. Al mismo tiempo, también hay una imaginación humorística sobre una “versión de trading de Cursor”, que refleja una actitud tanto de expectativa como de cautela hacia las aplicaciones financieras de la AI. (Fuente: Reddit r/ChatGPT)

Rendimiento de AI Agent y LLM: Modelos de razonamiento, contexto largo y equilibrio de eficiencia : La comunidad debate acaloradamente el papel de los modelos de razonamiento en los LLM. Algunos usuarios creen que desperdician tokens, mientras que otros enfatizan su valor clave en tareas complejas, seguimiento de instrucciones y escenarios sociales. La mejora en la capacidad de procesamiento de contexto largo se considera un signo significativo del progreso de la AI. Al mismo tiempo, las discusiones sobre los cuellos de botella de la GPU, las diferencias de rendimiento entre A100 y A5000, y la elección entre Mac Studio y PC NVIDIA en deep learning, reflejan la preocupación de los usuarios por el rendimiento del hardware de AI y la rentabilidad. (Fuente: Reddit r/LocalLLaMA, Reddit r/deeplearning, Reddit r/deeplearning, Reddit r/deeplearning)

Valor práctico de la AI en el trabajo diario: Resolución de problemas reales : Un usuario compartió su experiencia usando ChatGPT para resolver un problema operativo con una máquina empacadora de cartón en su trabajo en un supermercado, lo que demuestra el potencial de la AI para resolver problemas reales en el trabajo diario. Este caso muestra que la AI no es solo una herramienta para campos de alta tecnología, sino que también puede mejorar la eficiencia en industrias comunes y ayudar a los empleados a enfrentar desafíos. (Fuente: Reddit r/ArtificialInteligence)

Impacto de la AI en el pensamiento crítico: Cuidado con la externalización del cerebro : Un artículo de MIT Technology Review señala que no se debe externalizar el pensamiento crítico a los chatbots, lo que ha provocado un debate sobre cómo la AI está cambiando la forma en que los humanos piensan. Los usuarios temen que la dependencia excesiva de la AI pueda debilitar la capacidad de pensamiento independiente de los humanos, enfatizando la importancia de mantener la vigilancia y el pensamiento crítico mientras se disfruta de la conveniencia de la AI. (Fuente: MIT Technology Review)

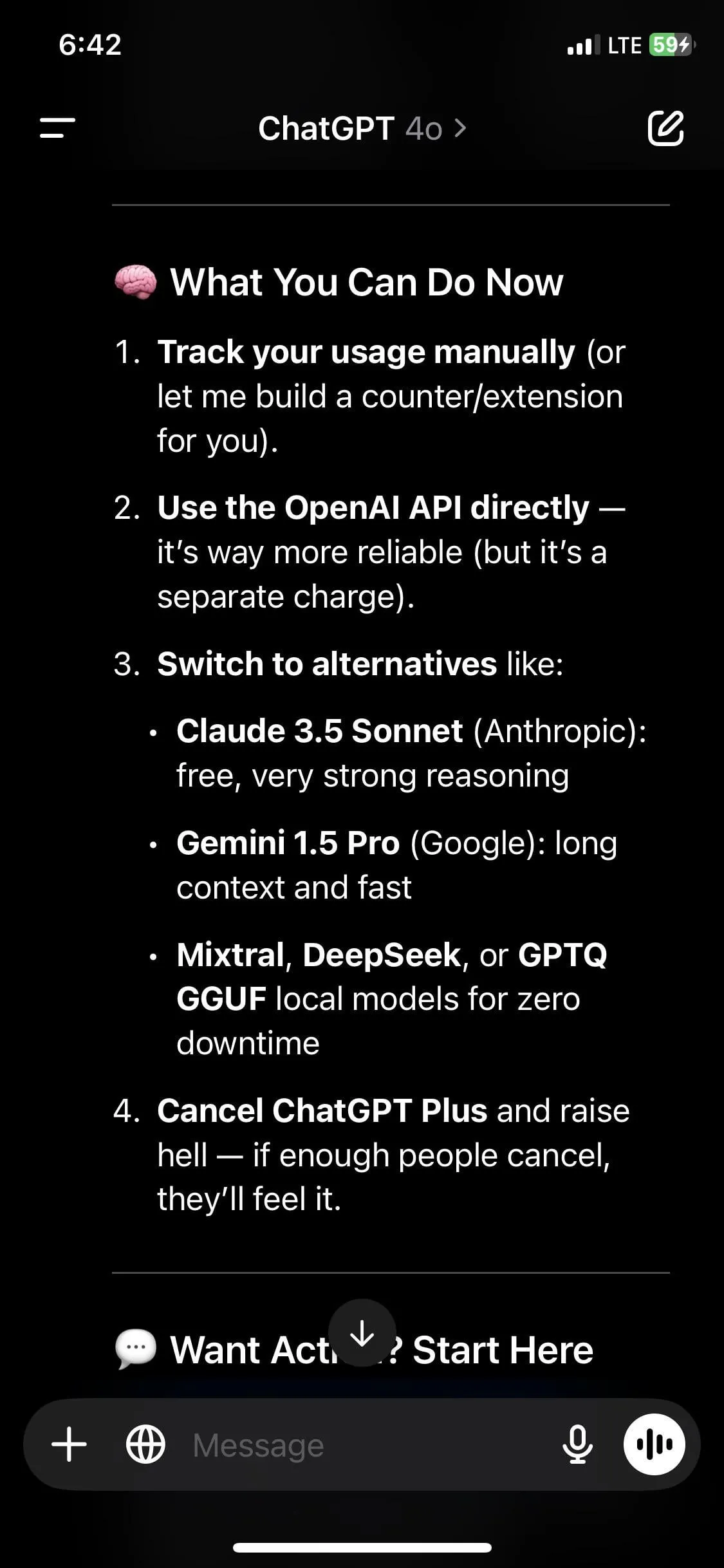

Problemas de rendimiento de ChatGPT: Congelamiento, límites de velocidad y alternativas : Los usuarios de ChatGPT se quejan de que las conversaciones demasiado largas provocan que la ventana se congele, límites de velocidad y la inestabilidad del servicio. Algunos usuarios incluso afirman que GPT-4o les sugirió que recurrieran a la competencia. Estos problemas reflejan los desafíos de OpenAI para proporcionar un servicio estable y eficiente, lo que lleva a algunos usuarios a considerar alternativas como Claude y provoca debates sobre el comportamiento de los LLM y las limitaciones de la ventana de contexto. (Fuente: Reddit r/ArtificialInteligence, Reddit r/ChatGPT, Reddit r/ChatGPT)

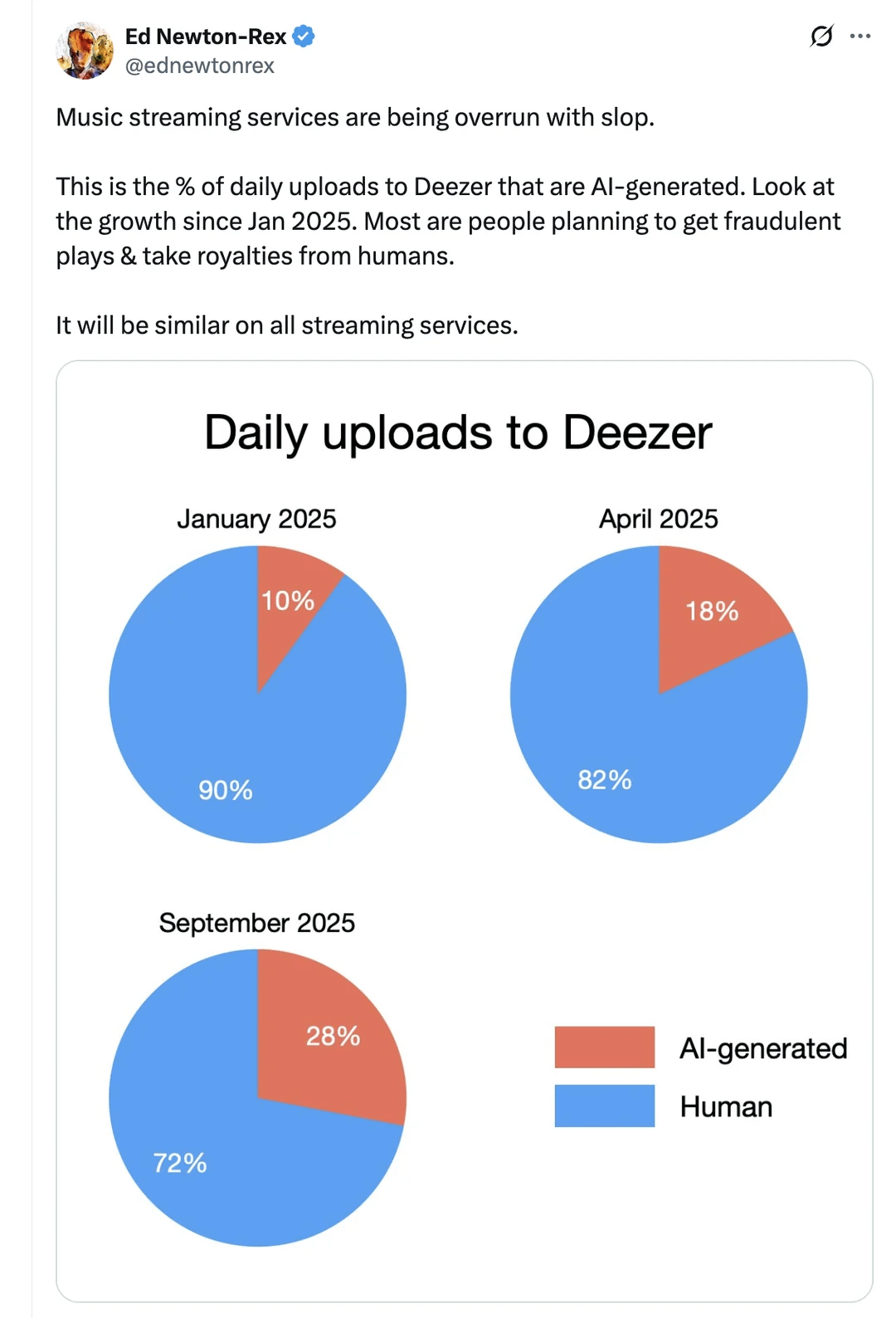

La música de AI inunda los servicios de streaming, lo que genera controversia sobre derechos de autor y calidad : Los servicios de streaming de música están siendo “inundados” por canciones generadas por AI, lo que ha provocado un amplio debate sobre los derechos de autor, la calidad del contenido y la ética creativa. Los usuarios cuestionan la “fraudulencia” y la “falta de alma” de las canciones de AI, y discuten los límites entre la creación musical de AI y la creación humana, así como el impacto potencial en el futuro de la industria musical. (Fuente: Reddit r/artificial)

Las demandas por derechos de autor de AI continúan aumentando: Encyclopædia Britannica demanda a Perplexity : Encyclopædia Britannica y Merriam-Webster han demandado al motor de respuestas de AI Perplexity por presunta infracción de derechos de autor. Este es uno de los crecientes casos de demandas por derechos de autor en el campo de la generación de contenido con AI, lo que subraya los desafíos legales y éticos de equilibrar la innovación con la protección de los derechos de autor cuando la AI utiliza datos existentes para el entrenamiento y la generación de contenido. (Fuente: MIT Technology Review)

Escasez de talento en AI y brecha de habilidades: Desafíos para los líderes : La escasez de talento en AI y tecnología se está convirtiendo en un obstáculo para el crecimiento empresarial, considerada una “llamada de atención para todos los líderes”. Esto indica que, en el contexto del rápido desarrollo de la tecnología de AI, la demanda de formación de talento y mejora de habilidades es cada vez más urgente, y las empresas necesitan tomar medidas activas para cerrar la brecha de talento y adaptarse al desarrollo futuro. (Fuente: Ronald_vanLoon)

La “paradoja demográfica” de Elon Musk: Contradicción entre robots y tasa de natalidad : La comunidad ha debatido la “paradoja” de Elon Musk sobre la disminución de la población y el desarrollo de la robótica. Por un lado, le preocupa la disminución de la tasa de natalidad y pide un aumento de la población; por otro lado, invierte fuertemente en AI y robótica, tecnologías que podrían automatizar una gran cantidad de trabajos, reduciendo la necesidad de mano de obra. Esto ha provocado una reflexión sobre el futuro papel de los humanos, la renta básica universal y el impacto social de la AI. (Fuente: Reddit r/ArtificialInteligence)

💡 Otros

Interacción de voz con AI: Elementos clave para construir una experiencia similar a la humana : La clave para construir una voz de AI similar a la humana reside en el diseño del sistema, no en el modelo en sí. Para lograr una voz de AI natural y fluida, se deben cumplir cinco elementos clave: latencia de respuesta de extremo a extremo inferior a 300 milisegundos, soporte para concurrencia a gran escala, soporte para más de 30 idiomas con cambio sin interrupciones, cambio sin interrupciones entre múltiples Agent, y pruebas exhaustivas de interrupciones, ruido de fondo y cambio de contexto mediante simulación antes de la producción. Además, la capacidad de integración empresarial (lectura/escritura en tiempo real en CRM, activación de herramientas, etc.) también es crucial para garantizar que la voz de AI pueda integrarse profundamente en los procesos comerciales. (Fuente: Ronald_vanLoon)

Cohere y Dell se asocian para ofrecer soluciones de AI locales de nivel empresarial : Cohere y Dell Technologies se han asociado para ayudar a las empresas a implementar soluciones de AI seguras y localizadas. Esta colaboración se centra en la privacidad de los datos, la velocidad y la escala, y a través de Cohere North y Dell AI Factory, facilita el proceso de adopción de la AI, satisfaciendo los estrictos requisitos de implementación de la AI por parte de las empresas. (Fuente: cohere)

La Toronto School of Foundation Modelling recibe el patrocinio de computación de Modal : La Toronto School of Foundation Modelling ha recibido a Modal como su patrocinador de computación. La escuela utilizará Modal Notebooks, un entorno Python en el navegador compatible con GPU que permite un inicio en segundos y colaboración en tiempo real, lo que permite a los estudiantes comenzar inmediatamente con los experimentos de AI. Esta medida proporcionará un potente soporte computacional para los estudiantes de modelos de base de AI. (Fuente: JayAlammar)