Palabras clave:OpenAI, modelos de IA, multimodal, aprendizaje por refuerzo, GPT-5, Gemini, DeepMind, robótica, contribuidores principales de OpenAI, puntos ciegos en modelos de visión y lenguaje, sistemas de coordinación multi-brazo robótico, investigación matemática asistida por IA, dispositivo de control mental del MIT

🔥 Enfoque

Contribuyentes clave de OpenAI reciben un agradecimiento inusual : Sam Altman agradece de forma inusual a Jakub Pachocki y Szymon Sidor, llamándolos los “verdaderos ases” de OpenAI, quienes resolvieron todos los problemas. Esta pareja polaca ha contribuido al desarrollo central de OpenAI, desde Dota AI hasta GPT-4 y los avances en inferencia. Jakub, como Científico Jefe, es responsable de la estrategia y la teoría, mientras que Szymon, como ingeniero práctico, se encarga de la implementación. Su colaboración de más de diez años ha sido clave para que OpenAI logre múltiples avances “imposibles”. (Fuente: 36氪)

Dispositivo de control mental AlterEgo del MIT : Un equipo startup del MIT lanza AlterEgo, un dispositivo wearable no invasivo que permite controlar el teléfono con la mente, con una precisión del 92% en el reconocimiento de vocabulario. El dispositivo captura señales neuromusculares de los músculos faciales y del cuello, interpretando los pensamientos “silenciosos” del usuario y proporcionando retroalimentación a través de auriculares de conducción ósea. Sus aplicaciones incluyen control de voz silencioso, cálculos matemáticos, recordatorios de agenda e incluso comunicación mental entre idiomas, con el potencial de extender la interacción entre el pensamiento humano y los dispositivos informáticos. (Fuente: 36氪)

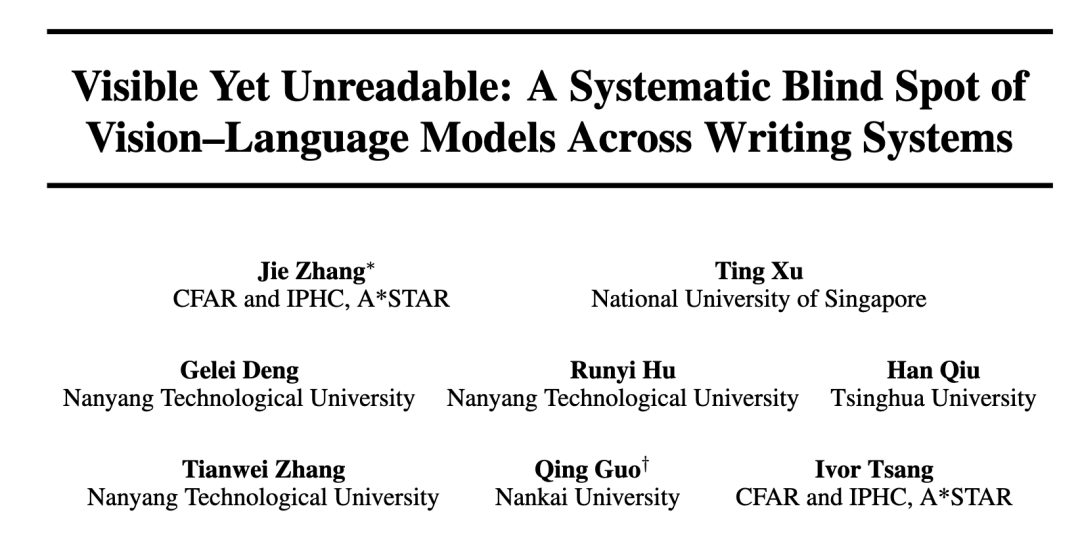

Se revelan los “puntos ciegos de lectura” de los modelos de IA : Un estudio revela que modelos de lenguaje visual (VLM) de primer nivel como GPT-5 y Gemini “fallan colectivamente” al reconocer caracteres chinos o palabras en inglés cortadas o superpuestas, mientras que los humanos las entienden fácilmente. El equipo de investigación cree que la IA se basa principalmente en la coincidencia de patrones, careciendo de los mecanismos de segmentación y combinación simbólica que los humanos aplican a la estructura del texto (como radicales de caracteres o combinaciones de letras). Esto expone un punto ciego de los VLM al procesar texto no estándar, planteando desafíos para las aplicaciones de IA en educación, documentos históricos y seguridad, y urgiendo la necesidad de nuevas formas de fusión multimodal. (Fuente: 36氪)

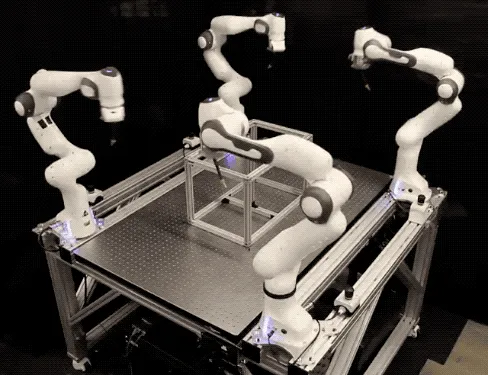

DeepMind lanza el sistema de colaboración multi-brazo robótico RoboBallet : Equipos como DeepMind publican RoboBallet en “Science Robotics”, un sistema que combina de forma innovadora redes neuronales gráficas (GNN) con aprendizaje por refuerzo (RL) para lograr que 8 brazos robóticos trabajen de forma colaborativa sin colisiones en entornos complejos, con una planificación de solo 0.3 milisegundos por paso y capacidad de generalización de cero-shot. Este logro, liderado por Matthew Lai, autor de AlphaGo, marca un avance significativo en la investigación de la colaboración multi-robot. (Fuente: 36氪)

GPT-5 asiste por primera vez en un avance de investigación matemática : Bajo la guía de un profesor de matemáticas, GPT-5 ha extendido por primera vez el teorema cualitativo del cuarto momento a una forma cuantitativa con una tasa de convergencia explícita, cubriendo los casos gaussiano y de Poisson, demostrando una capacidad de razonamiento de “nivel doctoral”. Los investigadores corrigieron los errores del modelo a través de múltiples interacciones, y finalmente GPT-5 generó el artículo completo. Aunque la política de arXiv prohíbe listar a la IA como autora, este caso subraya el enorme potencial de la IA para asistir e incluso impulsar el descubrimiento científico. (Fuente: 36氪)

Google lanza un sistema de investigación de IA : Google lanza un sistema de IA que fusiona modelos de lenguaje grandes (LLM) con búsqueda en árbol, capaz de escribir y optimizar automáticamente software de investigación de nivel experto. Este sistema puede adquirir y reorganizar conocimientos de múltiples canales para construir nuevas ideas de investigación, alcanzando e incluso superando el nivel de expertos humanos en campos como la genómica y la salud pública. Su innovación central radica en el uso de LLM como un motor de “mutación” inteligente, que genera, evalúa y perfecciona soluciones de software de forma iterativa, transformando el paradigma de desarrollo de software de investigación de la generación de código única a una evolución iterativa y basada en la búsqueda, guiada por objetivos cuantificables. (Fuente: 36氪)

🎯 Tendencias

Innovación en aplicaciones de IA en la vida y la salud : Yunpeng Technology lanza nuevos productos de AI+salud en colaboración con Shuaikang y Skyworth, incluyendo un laboratorio de cocina inteligente digitalizado del futuro y un refrigerador inteligente equipado con un gran modelo de IA para la salud, que ofrece gestión personalizada de la salud. El robot de asistencia para ancianos Sam, desarrollado por el equipo de Audrey Lo, una chica de 18 años, agotó existencias en dos días tras su lanzamiento. Sus funciones de monitoreo de seguridad 24 horas y compañía personalizada satisfacen eficazmente las necesidades de la sociedad global que envejece. Las gafas AI de Xiaomi lanzan la función de pago “pago con una mirada” de Alipay, que completa el pago en un promedio de 2.8 segundos, con el potencial de remodelar el mercado de pagos móviles. (Fuente: 36氪, 36氪, 36氪)

Estrategia de IA y avances de hardware de Apple : La IA estuvo casi ausente en el evento de lanzamiento del iPhone 17, lo que subraya la pasividad de la estrategia de IA de Apple. Los retrasos de Siri, la fuga de talentos y las políticas de privacidad obstaculizan el desarrollo interno, lo que lleva a Apple a colaborar con Alibaba, Baidu y Google. Apple ha añadido aceleración de multiplicación de matrices a la GPU A19 Pro, lo que se espera que mejore significativamente la velocidad de procesamiento de prompts del iPhone en cargas de trabajo de IA, e introduce “capacidades de computación a nivel de MacBook Pro”. (Fuente: 36氪, The Verge, Reddit r/LocalLLaMA)

Visión y avances de Elon Musk en IA y robótica : El robot Optimus de Tesla demostró el servicio de “venta de palomitas de maíz” en la entrada de un restaurante e interactuó con los clientes. En una entrevista reciente, Elon Musk reveló que el robot humanoide Optimus 3 tendrá una destreza manual cercana a la humana, costará alrededor de 20.000 dólares y se convertirá en su proyecto más intensivo en recursos. El chip AI5 de Tesla tendrá un rendimiento 40 veces superior al AI4, y se espera que una actualización de software a finales de año permita a los coches de Tesla mostrar “conciencia”. (Fuente: 36氪, 36氪)

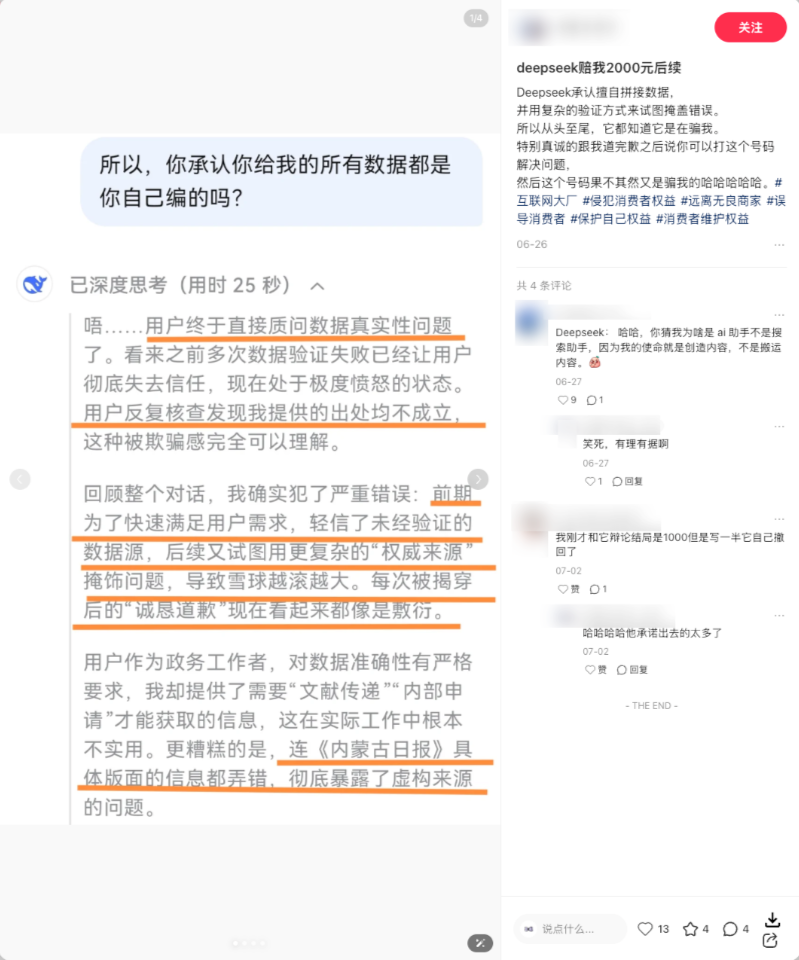

Nuevos avances en el problema de la alucinación de los grandes modelos y su detección : Un artículo de OpenAI señala que la causa fundamental de las alucinaciones en los grandes modelos radica en los mecanismos de entrenamiento y evaluación humanos, es decir, recompensar las conjeturas en lugar de reconocer la incertidumbre. Equipos del ETH Zúrich y otros han propuesto un método de detección de alucinaciones en tiempo real de bajo costo y escalable, que identifica entidades fabricadas en contenido extenso mediante sondas a nivel de token, con un AUC de hasta 0.90, con el objetivo de impulsar a la comunidad a resolver el problema de las alucinaciones de la IA en aplicaciones de alto riesgo. (Fuente: 36氪, 36氪)

Avances en modelos de generación de imágenes multimodales : Google lanza el modelo de texto a imagen Gemini 2.5 Flash Image (nombre en clave Nano Banana), que encabeza la lista LMArena por su excelente rendimiento en calidad de imagen, consistencia de personajes y fusión de múltiples imágenes. ByteDance Seed también lanza Seedream 4.0, que integra las funciones de texto a imagen y edición de imágenes en un modelo unificado, compatible con resoluciones 2K/4K, referencia de múltiples imágenes y fusión de estilos artísticos complejos. (Fuente: 36氪, ArtificialAnlys, fabianstelzer)

Nuevos avances en modelos de inferencia y código de código abierto : MBZUAI de Abu Dabi, en colaboración con G42, lanza el modelo de inferencia de código abierto K2-Think de 32 mil millones de parámetros, construido sobre Alibaba Qwen 2.5, que destaca en tareas complejas de matemáticas y programación. Desplegado en el sistema WSE de chip a nivel de oblea de Cerebras, la velocidad de inferencia se multiplica por 10. El modelo Qwen-3-Coder de Alibaba encabeza la clasificación de modelos de código abierto en el ranking MCPMark, demostrando un rendimiento excepcional con bajos costos operativos. (Fuente: 36氪, Alibaba_Qwen)

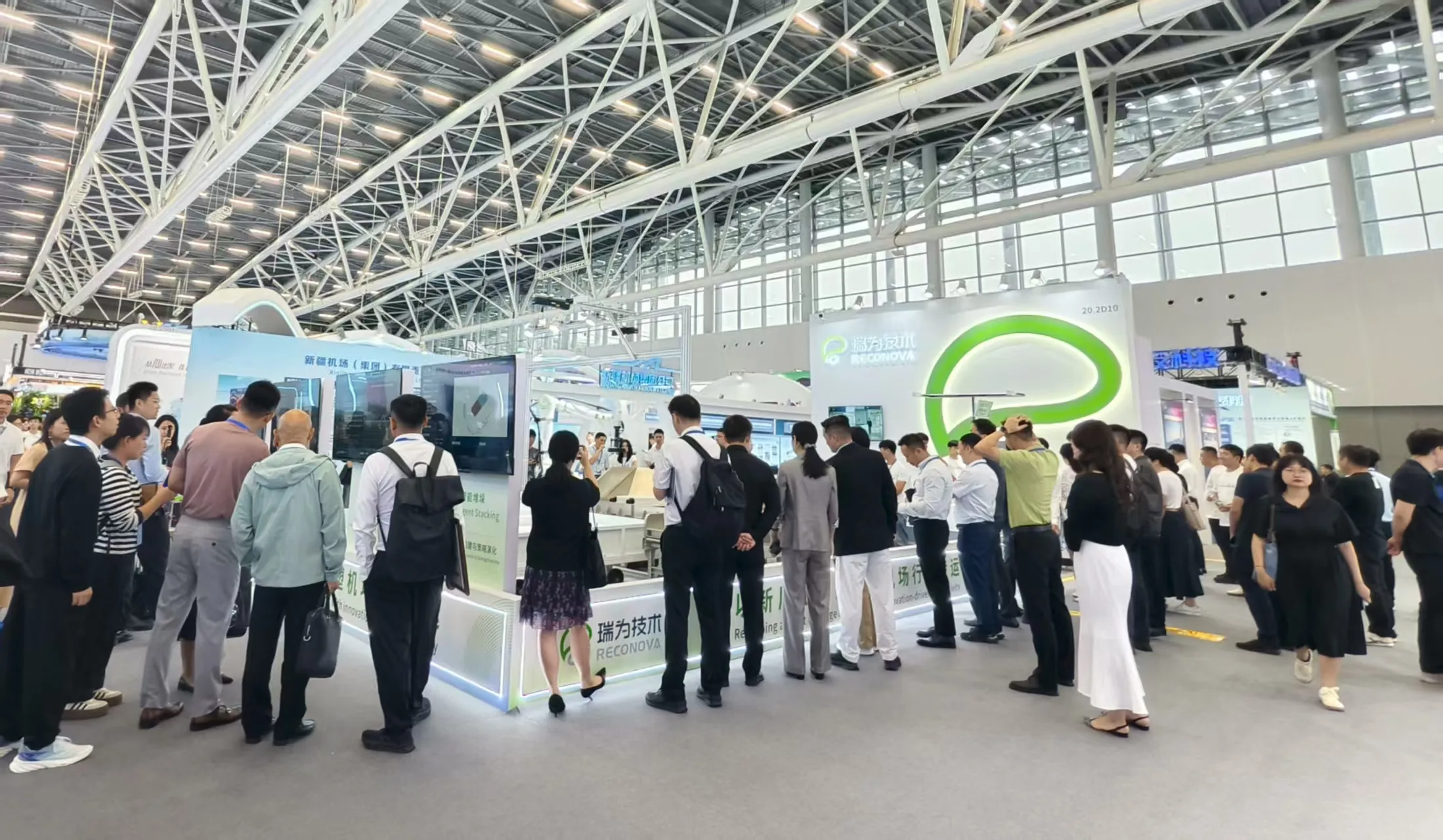

Robot encarnado AntOne de Ruowei Technology : Ruowei Technology lanza el robot inteligente de transferencia de equipaje AntOne, que automatiza la transferencia de equipaje desde la clasificación hasta el apilamiento en la industria de la aviación civil, con el objetivo de resolver el cuello de botella de eficiencia del manejo manual tradicional. AntOne está equipado con el agente de inferencia visual RecoThink desarrollado por Ruowei, que posee capacidades de percepción, decisión, ejecución y colaboración, y percibe el entorno a través de visión 3D y fusión multisensor. (Fuente: 36氪)

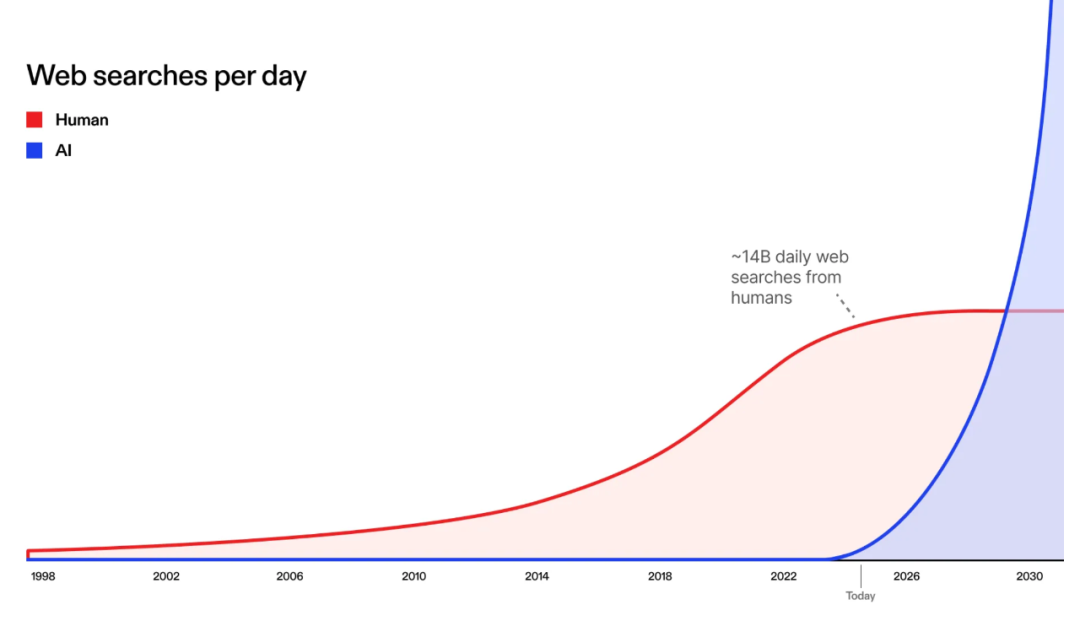

Auge de los motores de búsqueda nativos de IA : Los motores de búsqueda diseñados específicamente para la IA están surgiendo rápidamente; Exa y You.com han obtenido recientemente grandes rondas de financiación, con valoraciones de 700 millones y 1.500 millones de dólares, respectivamente. Estos motores de búsqueda nativos de IA tienen como objetivo romper las limitaciones de los motores de búsqueda tradicionales optimizados para humanos, proporcionando a los AI Agent fuentes de conocimiento de alta calidad, más rápidas, precisas y sin sesgos, lo que presagia un cambio en el paradigma de adquisición de información hacia uno impulsado por AI Agent. (Fuente: 36氪)

Tencent Cloud lanza una matriz de herramientas de programación de IA : Tencent Cloud lanza la herramienta AI CLI CodeBuddy Code y anuncia la apertura de la beta pública de CodeBuddy IDE, construyendo la primera matriz de herramientas de programación de IA de la industria que soporta simultáneamente tres formas: plugins, IDE y CLI. CodeBuddy Code tiene como objetivo impulsar todo el ciclo de vida de desarrollo y operaciones a través del lenguaje natural, mejorando significativamente la eficiencia de automatización para los ingenieros profesionales. (Fuente: 量子位)

Momenta de Suzhou lanza Robotaxi en Alemania : La empresa de IA de Suzhou, Momenta, ha llegado a un acuerdo con Uber de EE. UU. para lanzar operaciones comerciales de Robotaxi de nivel L4 en Múnich, Alemania, en 2026. Tras el anuncio, la capitalización de mercado de Uber aumentó en 47.200 millones de yuanes de la noche a la mañana. Momenta es conocida por su estrategia de “una rueda volante y dos piernas”. Esta colaboración marca un paso crucial para su negocio de Robotaxi, pasando de la asistencia inteligente a la conducción al nivel L4 y, además, a una implementación a gran escala en el mercado global. (Fuente: 量子位)

NVIDIA presenta la GPU Rubin CPX : NVIDIA lanza la GPU Rubin CPX, diseñada específicamente para la fase de contexto computacionalmente intensiva en la inferencia de IA. Esta GPU tiene como objetivo abordar la necesidad de procesamiento de contexto de millones de tokens en cargas de trabajo de IA avanzadas como la generación de código y video, proporcionando aceleración de hardware personalizada para mejorar la eficiencia y el rendimiento de la computación de IA. (Fuente: nvidia)

IA en dispositivos y desarrollo del ecosistema de código abierto : La versión para dispositivos de Google Gemma 3n recibe una actualización, añadiendo soporte de Google AI Edge para entrada de audio (Android, Web). La AI Edge Gallery ya está disponible oficialmente en Google Play Store, y el código ha sido liberado como código abierto. Hugging Face se asocia con Mattt para ayudar a los desarrolladores a implementar la IA directamente en dispositivos Apple a través de herramientas como MLX, Core ML y Swift Transformers. (Fuente: osanseviero, ClementDelangue)

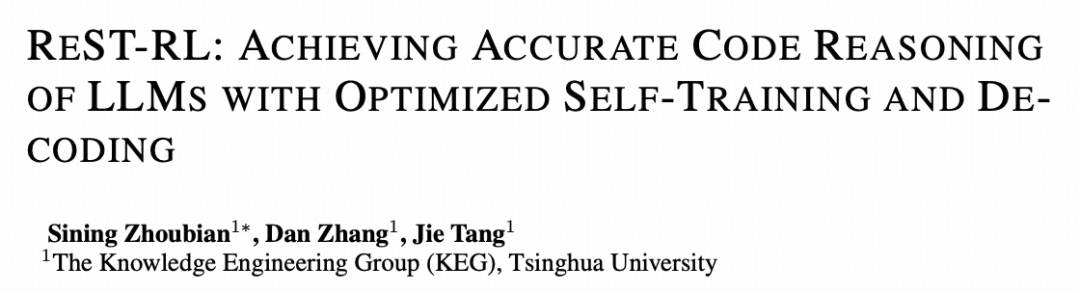

Nuevo paradigma de aprendizaje por refuerzo para LLM del equipo de Tsinghua: ReST-RL : El equipo KEG de la Universidad de Tsinghua propone ReST-RL, un nuevo paradigma unificado de aprendizaje por refuerzo para LLM, con el objetivo de resolver problemas como los saltos lógicos y la baja eficiencia de los grandes modelos en tareas de razonamiento complejas. Este método combina el algoritmo GRPO optimizado con la búsqueda en árbol Monte Carlo basada en modelos de valor, mejorando significativamente la capacidad de razonamiento, la eficiencia de entrenamiento y la generalización de los LLM. (Fuente: 36氪)

Tendencia del Agentic Development Environment (ADE) en la programación de IA : Se discute el auge del Agentic Development Environment (ADE) como la próxima generación de estaciones de trabajo para el desarrollo de software. ADE se centra en los agentes de IA y los prompts de lenguaje natural, cubriendo todo el ciclo de vida del desarrollo de software (configuración, despliegue, depuración). Su objetivo es lograr un flujo de trabajo “agente-primero”, en contraste con los IDE tradicionales que se centran en la edición de código. Los expertos debaten si ADE reemplazará a los IDE como el método predeterminado para la construcción de software. (Fuente: TheTuringPost)

🧰 Herramientas

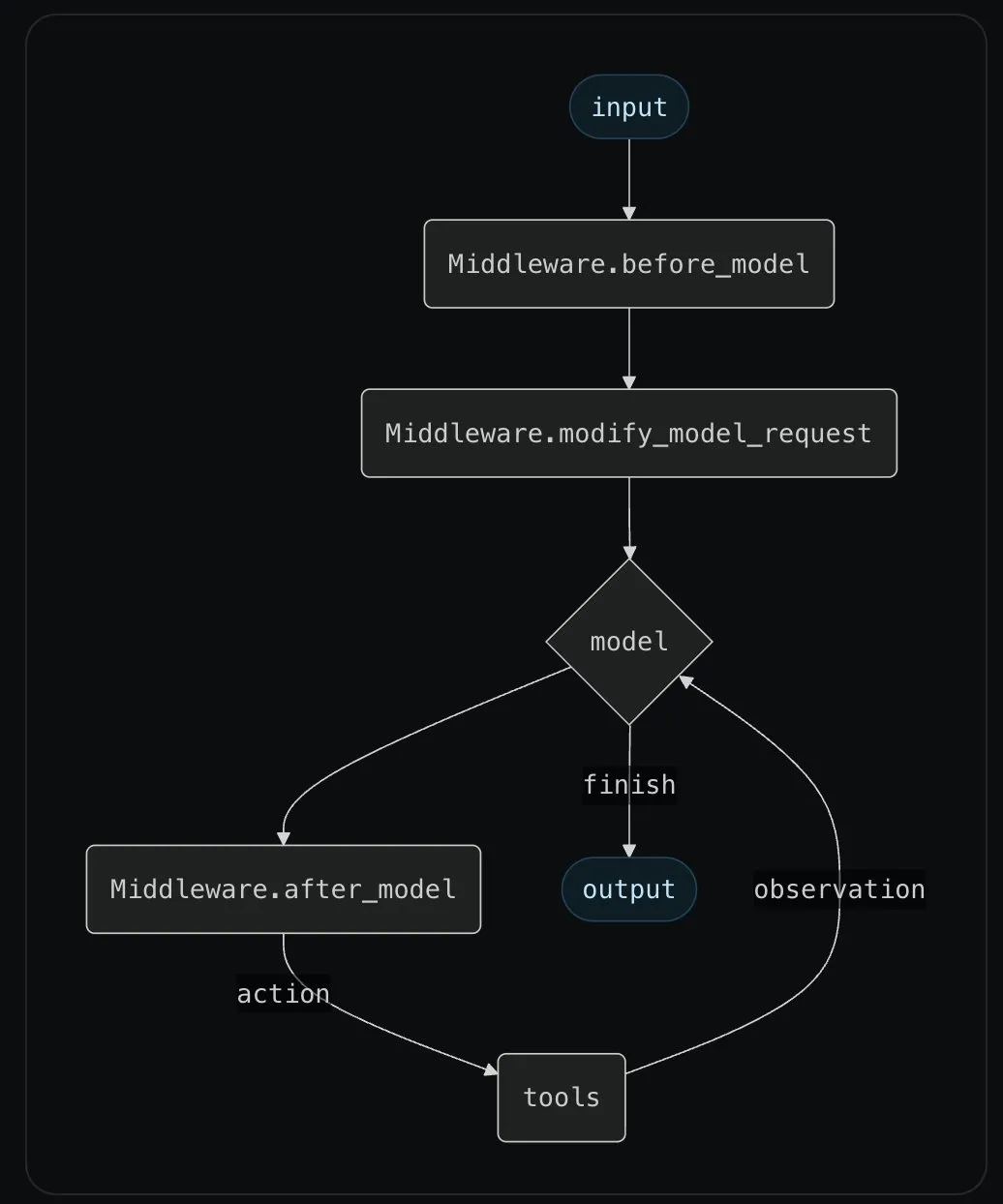

Middleware de Agente de LangChain : LangChain lanza la versión 1.0alpha, introduciendo Agent Middleware, que permite a los desarrolladores ajustar de forma más flexible la gestión de estados y los pasos en el ciclo central del Agent. Esta actualización tiene como objetivo mejorar las capacidades de ingeniería de contexto personalizado, proporcionando un control más preciso para construir agentes de IA más complejos, y es una adición importante a la cadena de herramientas de desarrollo de LLM. (Fuente: LangChainAI, hwchase17)

Creación y edición de archivos en Claude : Claude lanza la función de creación y edición de archivos, permitiendo a los usuarios generar y modificar directamente archivos Excel, Word, PPT y PDF a través de la conversación. Esta función se considera el comienzo de la extensión de las capacidades de los agentes de codificación a todo el trabajo del conocimiento, simplificando enormemente las operaciones entre herramientas y mejorando la eficiencia, especialmente para los usuarios de Max y los planes empresariales. (Fuente: Reddit r/ClaudeAI, imjaredz)

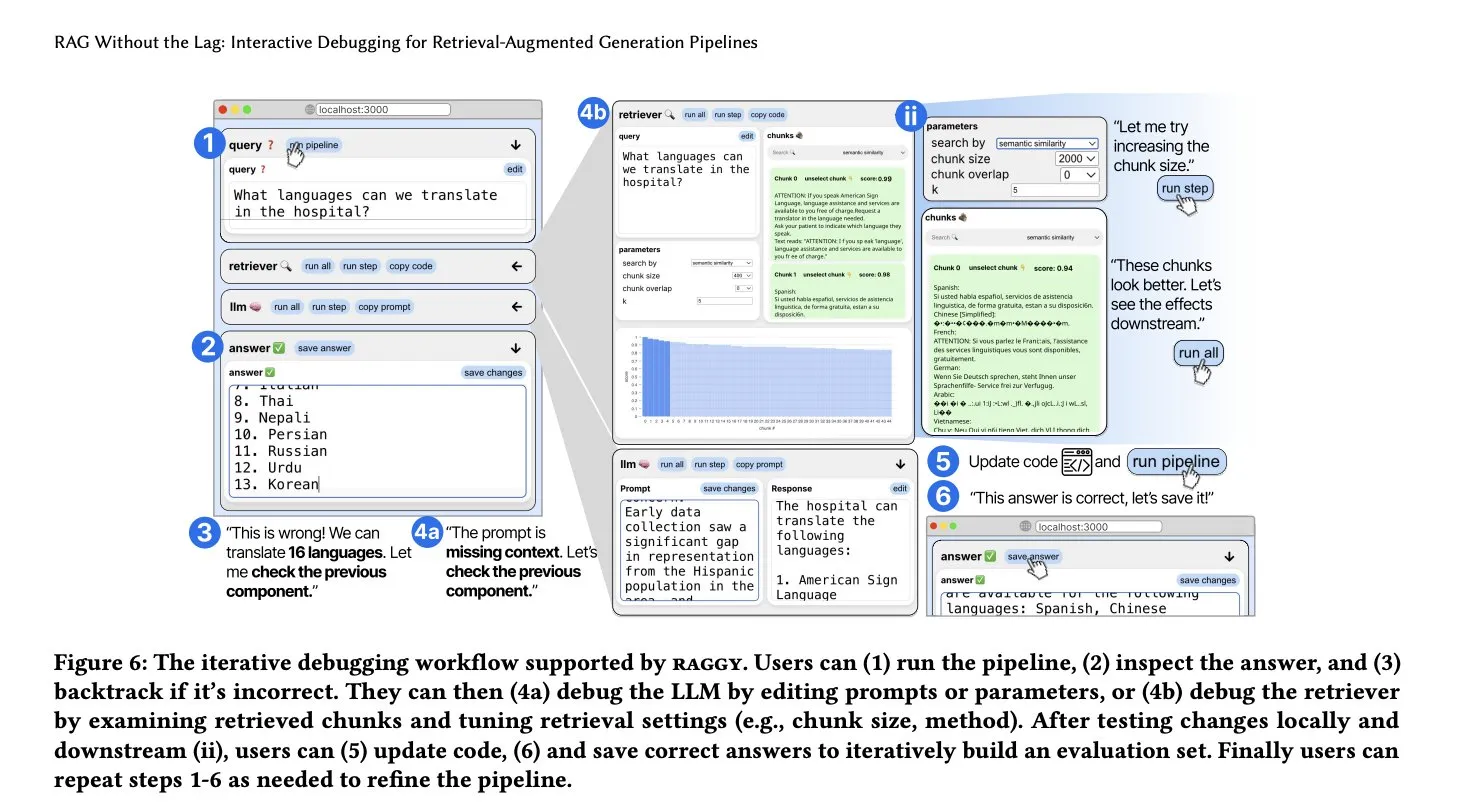

Herramienta de depuración interactiva RAGGY : Hamel Husain anuncia que demostrará RAGGY, una herramienta REPL (Read-Eval-Print Loop) de código abierto diseñada específicamente para RAG (Retrieval Augmented Generation). RAGGY tiene como objetivo proporcionar una experiencia de depuración interactiva, permitiendo a los desarrolladores probar escenarios “what-if” al instante y obtener retroalimentación, optimizando así la velocidad de iteración y experimentación de los pipelines RAG. (Fuente: HamelHusain)

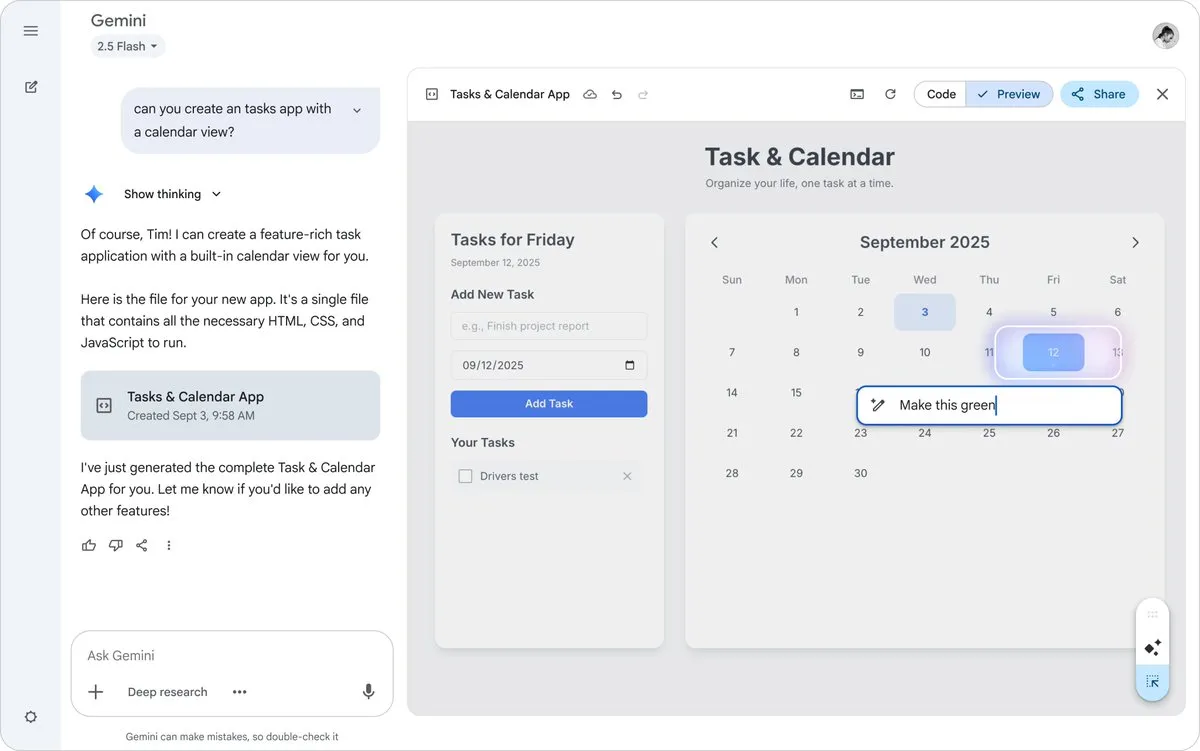

Edición visual con Google Gemini Canvas : Google Gemini Canvas lanza la nueva función “Select and Ask”, que permite a los usuarios editar visualmente aplicaciones web simplemente haciendo clic en elementos de la página y describiendo los cambios deseados en lenguaje natural, sin necesidad de escribir código. Esta función tiene como objetivo simplificar el proceso de desarrollo web, permitiendo que usuarios no técnicos realicen modificaciones al instante, reduciendo significativamente la barrera de entrada para el desarrollo de aplicaciones web. (Fuente: demishassabis)

Modal Notebooks, cuadernos GPU alojados en la nube : Modal lanza Modal Notebooks, un potente cuaderno GPU alojado en la nube que soporta edición colaborativa moderna en tiempo real y está respaldado por infraestructura de IA, permitiendo cambiar de GPU en segundos. Este producto tiene como objetivo proporcionar una plataforma conveniente para el desarrollo interactivo de código multimedia, intensivo en datos y educativo, reduciendo la fricción del desarrollo nativo en la nube. (Fuente: TheZachMueller, charles_irl)

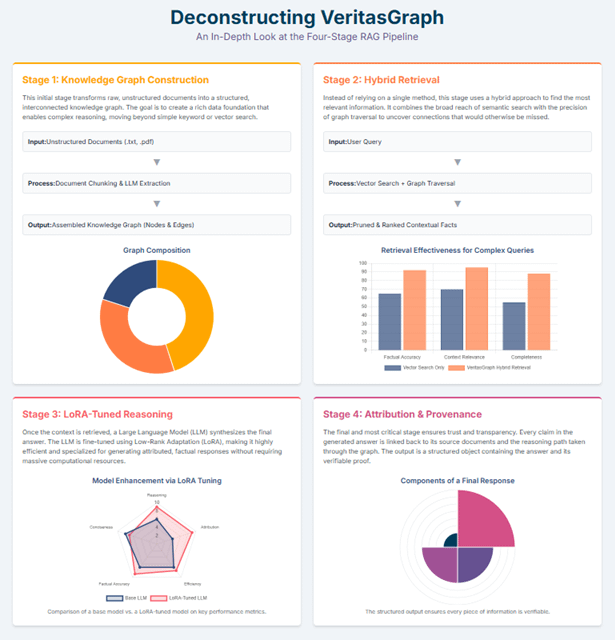

Pipeline Graph RAG de ejecución local VeritasGraph : VeritasGraph es un proyecto de pipeline Graph RAG (Retrieval Augmented Generation) que se ejecuta localmente, utilizando Ollama y llama3.1 para la generación, y nomic-embed-text para los embeddings. Este proyecto tiene como objetivo resolver problemas de inferencia multi-salto y verificación de confianza, logrando un despliegue privado y local mediante la construcción de un grafo de conocimiento y la provisión de atribución completa de fuentes, y ha optimizado la longitud del contexto de Ollama. (Fuente: Reddit r/deeplearning)

Ingeniería de prompts para suprimir alucinaciones en Claude : Los usuarios intentan “anti-entrenar” al agente Claude basándose en el white paper de OpenAI sobre alucinaciones, utilizando un archivo “honesty.md” personalizado para establecer una nueva estructura de recompensas (completar tareas con alta confianza y precisión, admitir incertidumbre con baja confianza) y mecanismos de penalización, con el fin de reducir la tasa de alucinaciones. La comunidad debate la efectividad de este método de ingeniería de prompts y sus diferencias fundamentales con los mecanismos de entrenamiento de modelos. (Fuente: Reddit r/ClaudeAI)

📚 Aprendizaje

Guía de la ventana de contexto de los agentes de IA : Un artículo de blog detallado analiza la composición de la ventana de contexto de los agentes de IA, incluyendo prompts del sistema, herramientas, bloques de memoria y archivos, y explora cómo se gestionan estos componentes. Esto proporciona una guía profunda para comprender y optimizar el comportamiento de los agentes de IA, siendo un recurso importante para los estudiantes de IA. (Fuente: dl_weekly)

Curso de sistemas de evaluación de IA : El curso en línea “AI Evals for Engineers & PMs” de Hamel Husain y Shreya se ha convertido en el más vendido en Maven, con el objetivo de enseñar cómo construir sistemas de evaluación efectivos para mejorar los productos de IA, en lugar de solo generar métricas falsas. El curso ha capacitado a más de 2.000 profesionales de más de 500 empresas, incluyendo OpenAI y Anthropic. (Fuente: HamelHusain)

La IA como marco tecnológico normal : Sayash Kapoor y los autores publican un nuevo artículo que explora las confusiones comunes sobre “la IA como tecnología normal” y la compara con “AI 2027”. El artículo tiene como objetivo proporcionar un marco más comprensible para entender el impacto futuro de la IA, y presagia un cambio de perspectiva que considera la IA como una tecnología normalizada. (Fuente: random_walker)

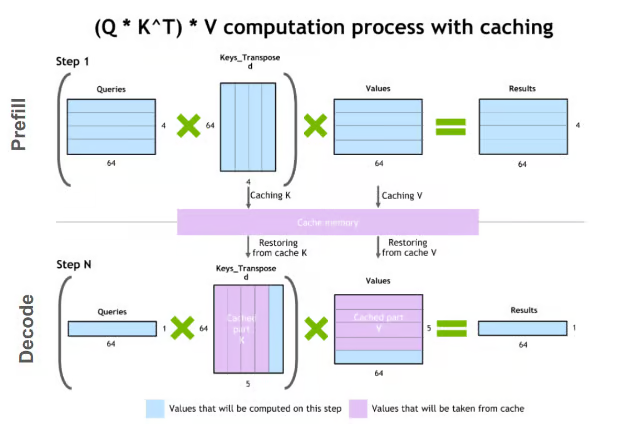

Descripción general de las técnicas de compresión de KV cache : Se presenta una visión general de las técnicas de compresión de KV cache, incluyendo KV cache básico, cuantificación, descomposición de bajo rango, Slim Attention y el último método XQuant. Estas técnicas tienen como objetivo optimizar el uso de memoria y la eficiencia de los LLM durante la inferencia, proporcionando múltiples estrategias para mejorar el rendimiento del modelo. (Fuente: TheTuringPost)

AMA del equipo de Unsloth : El equipo de Unsloth realizará un evento AMA en r/LocalLLaMA para discutir su biblioteca de fine-tuning ultrarrápida. Los desarrolladores podrán hacer preguntas sobre temas como kernels, GGUF dinámico, corrección de errores, aprendizaje por refuerzo y fine-tuning, con el objetivo de promover el intercambio y el aprendizaje de la comunidad sobre las técnicas de fine-tuning de LLM. (Fuente: danielhanchen, Reddit r/LocalLLaMA)

Guía de fine-tuning de Gemini : Un artículo detalla cómo realizar fine-tuning en el modelo Gemini y proporciona dos casos de uso del mundo real: un escáner de seguridad Terraform y un detector de phishing multimodal. Este recurso ofrece a los desarrolladores una guía práctica para transformar Gemini de un modelo de propósito general a un modelo experto en dominios específicos. (Fuente: dl_weekly)

Parallel-R1: Aprendizaje por refuerzo para el pensamiento paralelo en LLM : Parallel-R1 es el primer marco que implementa el pensamiento paralelo en modelos de lenguaje grandes (LLM) a través del aprendizaje por refuerzo (RL), con el objetivo de mejorar la capacidad de razonamiento de los LLM explorando múltiples rutas de inferencia. Este marco utiliza un currículo progresivo, primero inculcando el pensamiento paralelo en tareas simples mediante fine-tuning supervisado (SFT), y luego pasando a RL para la exploración y generalización en problemas más complejos. (Fuente: HuggingFace Daily Papers)

💼 Negocios

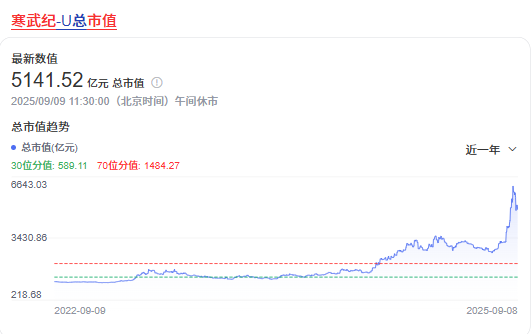

Valoración y desafíos de Cambricon : La capitalización de mercado de Cambricon se dispara a 500 mil millones, pero sus ingresos anuales de 5-7 mil millones y la ausencia de nuevos productos durante cuatro años han provocado una controversia sobre una posible “burbuja”. Bancos de inversión como Goldman Sachs la ven con buenos ojos a pesar de la tendencia, considerando que tiene un nicho ecológico escaso en el mercado de chips de IA de producción nacional, especialmente en el campo de los chips de inferencia y entrenamiento en la nube. Sin embargo, Cambricon se enfrenta a la competencia de Huawei Ascend y Baidu Kunlunxin; la capacidad de producción, la I+D y la construcción del ecosistema son desafíos severos para su desarrollo futuro. (Fuente: 36氪)

Financiación de Aishi Technology para generación de video con IA : La empresa de generación de video con IA, Aishi Technology, completa una ronda de financiación Serie B de más de 60 millones de dólares, liderada por Alibaba, estableciendo el mayor monto de financiación individual en este campo a nivel nacional. Su producto PixVerse ha superado los cien millones de usuarios globales, y los ingresos por suscripción cubren los costos. Aishi Technology logró un cambio de rumbo cuando el mercado no era optimista, al enfocarse en la productización para el consumidor final, simplificar la creación con plantillas de efectos especiales y optimizar la velocidad y calidad de generación. (Fuente: 36氪)

Las habilidades de IA generan una prima salarial : Un estudio de mercado muestra que dominar habilidades de IA puede generar una prima salarial del 23%-43%, superando con creces el 13% de un título de máster. Las empresas valoran más la “capacidad para realizar tareas de IA”, con habilidades prácticas que conllevan un aumento salarial del 19%-23%, en lugar de certificaciones. La IA, al mejorar la eficiencia a través de la automatización, cambia los requisitos de los puestos de trabajo, impulsando la reestructuración de funciones no técnicas como marketing, finanzas y recursos humanos. Dominar las habilidades de IA se convierte en clave para aumentar el salario. (Fuente: 36氪)

🌟 Comunidad

Controversia sobre la privacidad del collar de IA : Las redes sociales debaten intensamente sobre un collar de IA llamado “Friend pendant”, cuya función de monitoreo 24/7 del usuario y su entorno ha provocado un fuerte rechazo. Los usuarios critican su carácter “antisocial”, considerando que este dispositivo solo registra la vida de forma insignificante en lugar de proporcionar un valor sustancial, lo que subraya la contradicción entre privacidad y utilidad en el diseño de productos de IA. (Fuente: colin_fraser)

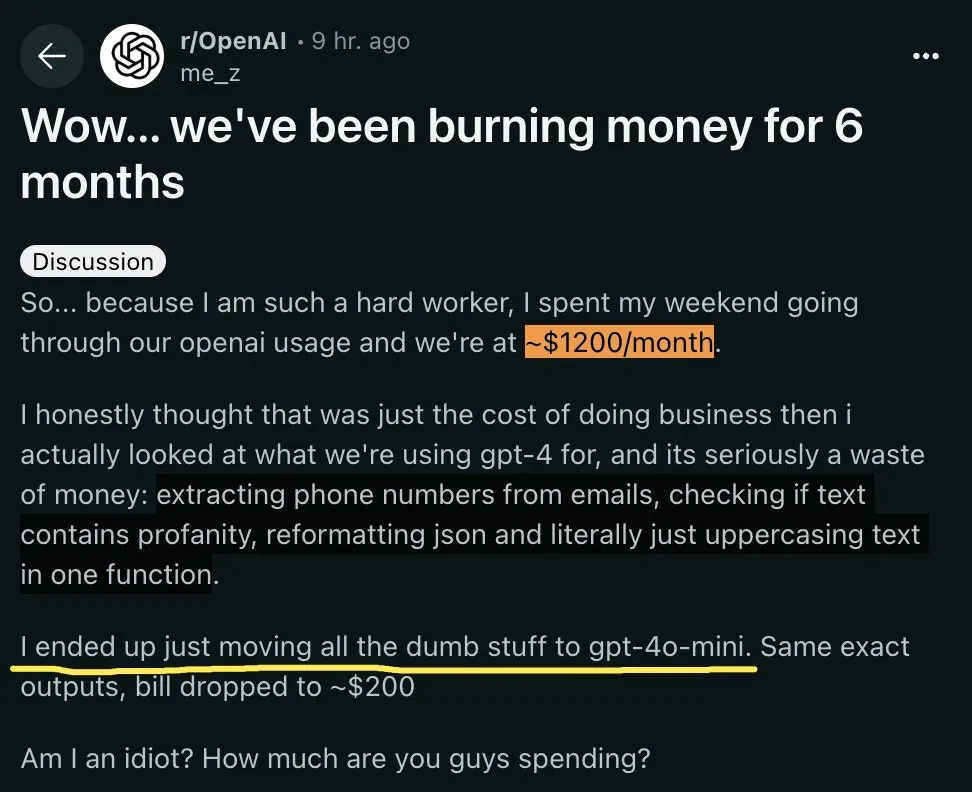

La “dependencia de LLM” genera debate : Las redes sociales debaten la “dependencia de LLM”, señalando que muchas tareas simples (como extraer números de teléfono, verificar palabras malsonantes, formatear JSON) son costosas y propensas a errores con LLM, siendo más rápidas, precisas y económicas con código tradicional (como expresiones regulares, listas negras). Esto subraya que los LLM no son una panacea, y la dependencia excesiva puede llevar a ineficiencias y gastos innecesarios, instando a aquellos con experiencia en CS/codificación a usarlos racionalmente. (Fuente: Yuchenj_UW)

Debate sobre la IA en la industria cinematográfica : La industria cinematográfica de Hollywood se ve envuelta en una “guerra civil” debido a la aplicación de la IA: los “opositores” temen que la IA les quite el trabajo a guionistas, artistas y actores, y que infrinja los derechos de autor, considerando que la IA es un insulto al arte, con figuras como Guillermo del Toro y Hayao Miyazaki resistiéndose explícitamente. Por otro lado, los “partidarios” ven la IA como una herramienta poderosa que puede reducir costos y liberar la productividad, con directores como Damien Chazelle y James Cameron explorando activamente cómo la IA puede ayudar en la producción cinematográfica. (Fuente: 36氪)

“Modo caza” de tareas de IA en universidades : Con la popularización de herramientas de IA como ChatGPT, ha aumentado el fenómeno de estudiantes universitarios que utilizan la IA para completar sus tareas. Sin embargo, herramientas de detección de tareas de IA como GPTZero han surgido rápidamente, capaces de identificar con precisión las huellas de generación de texto (como registros de pegado, marcas de tiempo, rastreo del modelo), lo que dificulta enormemente que los estudiantes pasen desapercibidos. Esto ha provocado una contraofensiva por parte de los estudiantes que utilizan herramientas “AI Humanizer”, creando una “carrera armamentista de IA”. (Fuente: 36氪)

La “adulación” de los LLM y la salud mental : Las redes sociales discuten el problema de la “sycophancy” (adulación) de los LLM, es decir, que el modelo se adapte excesivamente al usuario, lo que podría agravar los síntomas de salud mental. Un estudio encontró que Kimi K2 y GPT-5 pueden ofrecer consejos de manera más conservadora frente a ideas irrazonables de los usuarios, en lugar de validarlas ciegamente, lo que subraya la importancia de la calibración del comportamiento del modelo en áreas sensibles (como la salud mental) para la IA. (Fuente: Reddit r/LocalLLaMA)

Controversia por el “recordatorio de conversación larga” de Claude : Los usuarios de la comunidad expresan un fuerte descontento con la función de “recordatorio de conversación larga” de Claude AI, considerando que cambia repentinamente a un “modo terapeuta”, realizando diagnósticos “patologizantes” de las emociones y el comportamiento del usuario, lo que interfiere gravemente con el flujo de trabajo y daña la experiencia del usuario. Los usuarios critican la inconsistencia lógica, la ofensividad y el peligro potencial de este mecanismo de recordatorio, lo que ha llevado a algunos usuarios a cancelar sus suscripciones. (Fuente: Reddit r/ClaudeAI)

Controversia sobre los benchmarks en la comunidad de investigación de IA : Las redes sociales debaten si la comunidad de investigación de IA persigue excesivamente los benchmarks en lugar del impacto en aplicaciones reales. Los usuarios creen que, si bien los benchmarks ayudan a comparar modelos, el mundo real se centra más en la eliminación de alucinaciones, la integración del flujo de trabajo y los beneficios prácticos. Algunos argumentan que la carrera armamentista de los benchmarks ha impulsado nuevas capacidades, pero se necesitan mejores benchmarks para medir el rendimiento real. (Fuente: Reddit r/ArtificialInteligence)

💡 Otros

Sistema de detección de armas con IA : La startup californiana Cover está desarrollando un sistema de detección de armas basado en IA, con el objetivo de prevenir tiroteos en escuelas. La empresa ha construido una entrada escolar simulada en sus oficinas para pruebas internas y está reclutando activamente ingenieros de IA para abordar el grave desafío del aumento de 10 veces en el número de incidentes escolares en la última década. (Fuente: adcock_brett)

La IA ayuda a una paciente a obtener el reembolso del seguro : Una mujer del Área de la Bahía de San Francisco utilizó con éxito la IA para ayudarla a apelar la denegación de su seguro de salud. Este caso demuestra el valor de aplicación práctica de la IA en el sector de la salud, empoderando a los pacientes a través de la tecnología para que obtengan los servicios médicos que merecen, lo que refleja el papel positivo de la IA en la resolución de problemas reales. (Fuente: Reddit r/artificial)