Palabras clave:NVIDIA Jetson Thor, IA física, robot humanoide, GPU Blackwell, capacidad de cálculo de IA, capacidad máxima de cálculo de IA de Jetson Thor, rendimiento de la GPU Blackwell, escenarios de aplicación de IA física, kit de desarrollo para robots humanoides, precio de Jetson Thor

🔥 Foco

Lanzamiento de NVIDIA Jetson Thor, la potencia de cálculo de IA física se dispara : NVIDIA ha lanzado Jetson Thor, diseñado específicamente para IA física y robots humanoides. Equipado con una Blackwell GPU y una CPU Arm Neoverse de 14 núcleos, alcanza una potencia de cálculo de IA máxima de 2070 TFLOPS (FP4), 7.5 veces más que la generación anterior Jetson Orin. Soporta modelos de IA generativa como VLA, LLM y VLM, y puede procesar video en tiempo real e inferencia de IA, con el objetivo de acelerar el desarrollo de la robótica general y la IA física. Sus principales aplicaciones incluyen robots humanoides, asistencia quirúrgica y tractores inteligentes, y ya ha sido adoptado por empresas como Agility Robotics, Amazon, Boston Dynamics y Unitree Robotics. El kit de desarrollo ya está disponible, con un precio inicial de 3499 USD. (Fuente: nvidia)

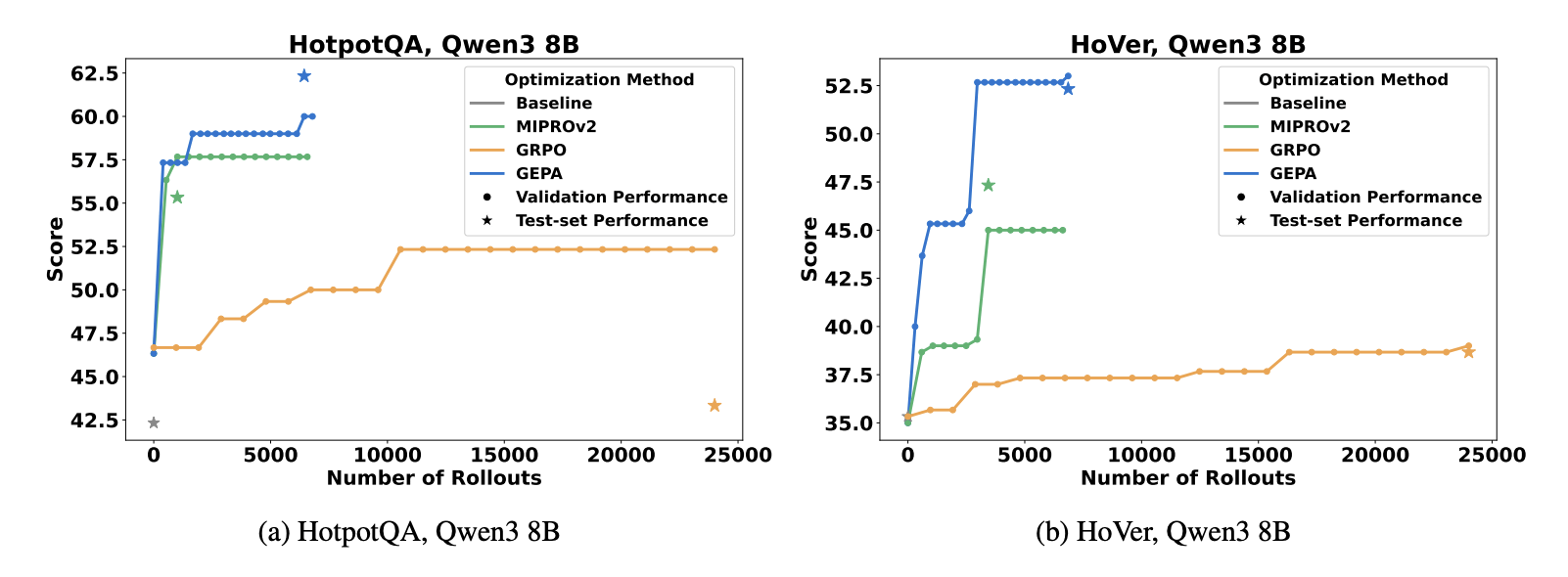

GEPA: La evolución de prompts reflexivos supera a RL : Un nuevo estudio (Agrawal et al., 2025) presenta el método GEPA (Genetic-Pareto Prompt Evolution), que evoluciona los prompts del sistema LLM a través de la reflexión en lenguaje natural y el diagnóstico de trayectorias, en lugar de depender del Reinforcement Learning (RL). GEPA supera a GRPO en tareas de QA de múltiples saltos, requiriendo 35 veces menos rollouts y superando consistentemente al optimizador de prompts SOTA, MIPROv2. Esto sugiere que los bucles de optimización nativos del lenguaje son más eficientes para la adaptabilidad de los LLM que los rollouts brutos en el espacio de parámetros, lo que presagia una nueva dirección para las estrategias de optimización de IA. (Fuente: Reddit r/MachineLearning)

El método OPRO mejora la eficiencia de las pruebas de seguridad de IA : Bret Kinsella de TELUS Digital presenta el método Optimization by PROmpting (OPRO), que permite a los LLM realizar “auto-red teaming” para evaluar la seguridad de la IA optimizando los generadores de ataques. Este método se centra en la distribución de la tasa de éxito de los ataques (ASR), en lugar de un simple aprobado/reprobado, lo que permite descubrir vulnerabilidades a gran escala y guiar las medidas de mitigación. Se enfatiza que en industrias de alto riesgo como las finanzas y la atención médica, las pruebas de seguridad de la IA deben ser exhaustivas, repetibles y creativas, y pasar de ser reactivas a preventivas, proporcionando a las empresas evaluaciones de seguridad de la IA más detalladas. (Fuente: Reddit r/deeplearning)

🎯 Tendencias

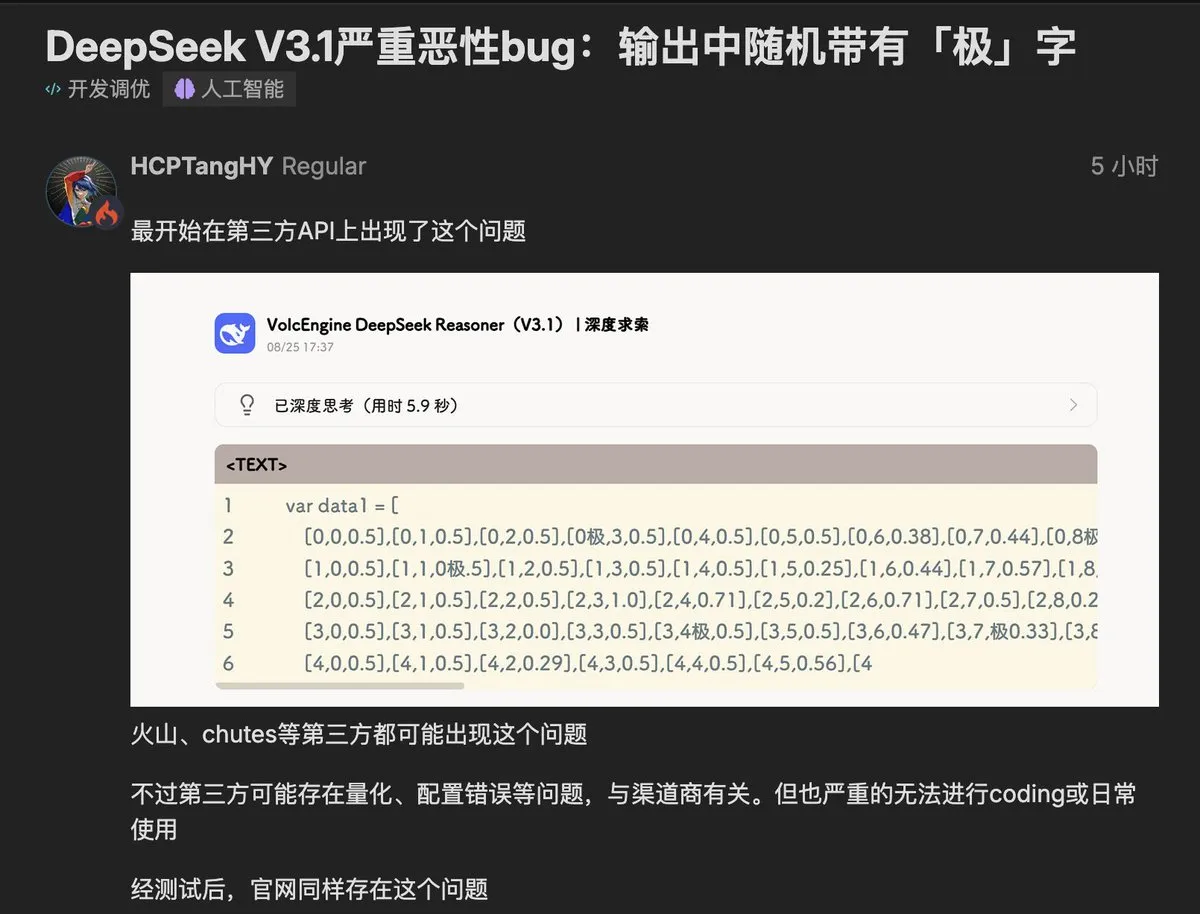

El modelo DeepSeek V3.1 presenta un “Bug” del carácter “极” : Usuarios han reportado que el último modelo DeepSeek V3.1 inserta aleatoriamente el carácter “极” (o “extreme”) en sus salidas, afectando tareas sensibles al código y la estructura. Este problema se ha replicado tanto en implementaciones de terceros como en la API oficial, generando preocupación en la comunidad sobre la contaminación de datos del modelo y problemas de estabilidad. Se especula que podría estar relacionado con la confusión de tokens o datos de entrenamiento RLHF no limpios, lo que sirve como una advertencia para los desarrolladores de modelos, enfatizando el impacto crítico de la calidad de los datos en el comportamiento de la IA. (Fuente: teortaxesTex, 36氪, 36氪)

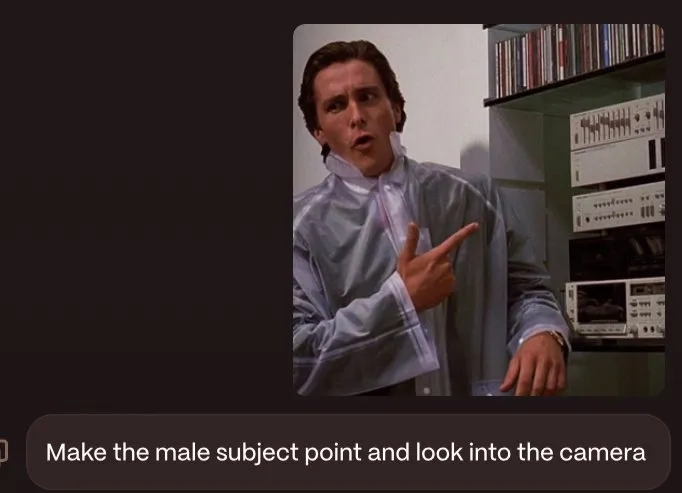

El misterioso modelo Nano-Banana de Google genera interés : Un misterioso modelo de generación y edición de imágenes llamado Nano-Banana se ha vuelto popular en la comunidad de IA, especulándose que es un producto de Google. Destaca por su edición de texto, fusión de estilos y comprensión de escenas, pudiendo combinar elementos de múltiples imágenes y mantener la coherencia en iluminación, perspectiva y composición. Sin embargo, presenta imperfecciones como títulos de libros ilegibles y dedos deformes, y actualmente carece de una API oficial, lo que hace que la experiencia sea inestable. Han surgido muchos sitios web falsos, lo que ha provocado debates en el mercado sobre las capacidades de los nuevos modelos y los canales de acceso. (Fuente: TomLikesRobots, yupp_ai, yupp_ai, 36氪)

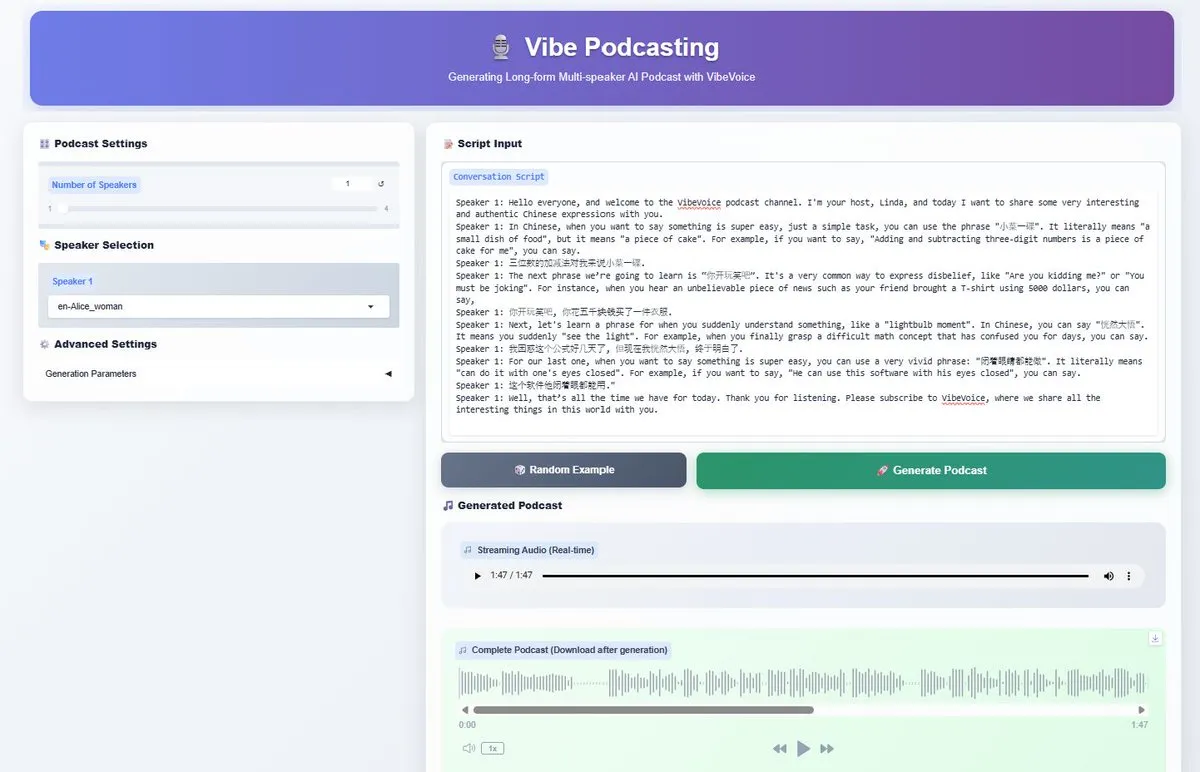

Microsoft VibeVoice-1.5B TTS Model de código abierto : Microsoft ha lanzado como código abierto el modelo VibeVoice-1.5B TTS, que permite generar conversaciones de audio expresivas de hasta 90 minutos con hasta 4 oradores diferentes. Basado en Qwen2.5-1.5B, el modelo utiliza un tokenizador de muy baja tasa de fotogramas, lo que mejora la eficiencia computacional y soporta inglés y chino. Con una licencia MIT, se espera que impulse la generación de contenido de audio de formato largo, como podcasts, por IA, proporcionando a los creadores potentes capacidades de producción de audio multilingüe. (Fuente: _akhaliq, AnthropicAI, ClementDelangue, dotey)

Nuevos desarrollos en la serie de modelos Wan de Alibaba : El modelo de IA de Alibaba, Wan, ha anunciado el próximo lanzamiento de WAN 2.2-S2V, un modelo de voz a video con calidad cinematográfica, enfatizando que es “impulsado por audio, basado en visión y de código abierto”. Al mismo tiempo, el modelo Wan2.2-T2V-A14B, lanzado anteriormente, se ha integrado en la aplicación Anycode, convirtiéndose en el modelo predeterminado de texto a video. Esta serie de avances demuestra la continua inversión e innovación de Alibaba en el campo de la IA multimodal, especialmente en la generación de audio y video. (Fuente: Alibaba_Wan, TomLikesRobots, karminski3)

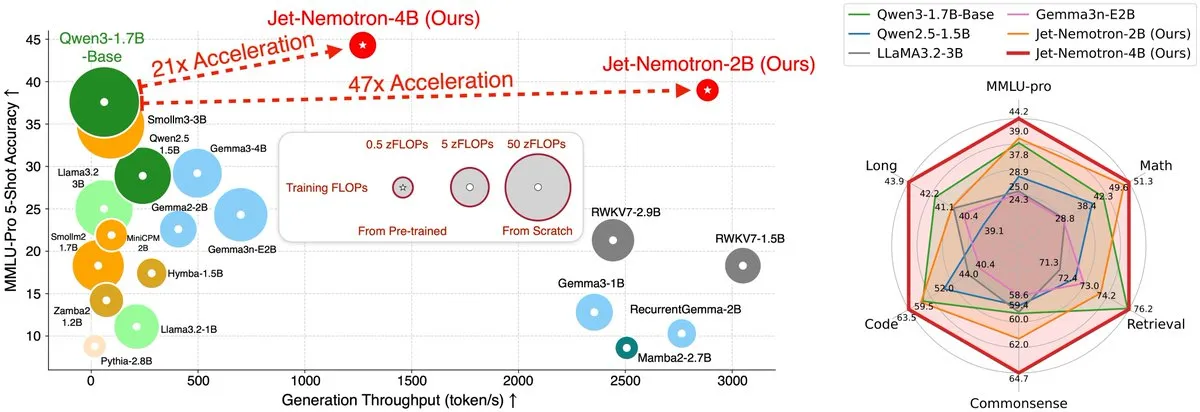

Jet-Nemotron, una arquitectura híbrida de LLM, acelera 53.6 veces : El equipo de MIT Hanlab ha lanzado Jet-Nemotron, una familia de modelos de lenguaje de arquitectura híbrida que, a través de Post Neural Architecture Search (PostNAS) y un nuevo bloque de atención lineal llamado JetBlock, ha logrado un aumento de hasta 53.6 veces en el rendimiento de generación en una GPU H100, superando al mismo tiempo el rendimiento de los modelos SOTA de atención completa de código abierto. Esta investigación innovadora proporciona nuevas soluciones para la eficiencia de inferencia y la optimización de la arquitectura de los LLM. (Fuente: teortaxesTex, menhguin)

Los AI Agents evolucionarán hacia flujos de trabajo autónomos en 2025 : Los AI Agents están evolucionando de asistentes conversacionales a flujos de trabajo autónomos capaces de razonar, planificar y ejecutar tareas. Mediante la integración de API y la toma de decisiones automatizada, los AI Agents pueden impulsar procesos complejos, como la generación automática de guiones de video, la compilación de videos y su publicación en YouTube, lo que presagia que los flujos de trabajo impulsados por IA se convertirán en la corriente principal, mejorando enormemente el nivel de automatización. (Fuente: Reddit r/artificial)

Advertencia sobre vulnerabilidades de seguridad en navegadores de IA : Se ha revelado que Comet, el navegador de IA de la empresa unicornio de búsqueda de IA estadounidense Perplexity, tiene una grave vulnerabilidad de seguridad. Los atacantes pueden manipular el navegador de IA mediante instrucciones maliciosas para acceder a correos electrónicos, obtener códigos de verificación y enviar información sensible. Brave ha señalado que los mecanismos tradicionales de ciberseguridad son ineficaces contra este tipo de ataques, y que los productos Agent se enfrentan a enormes riesgos debido a su “tripleta fatal” de “acceso a datos privados, contacto con contenido no confiable y comunicación externa”. Esto advierte que los productos de IA deben priorizar la seguridad y la protección de la privacidad al innovar en funciones. (Fuente: 36氪)

La brecha de almacenamiento de IA de billones de dólares y la arquitectura Universal Storage : La era de la IA ha planteado nuevas demandas de almacenamiento: rendimiento extremo, baja latencia, alta concurrencia, gestión unificada multimodal, computación en almacenamiento, persistencia de memoria de Agent y seguridad autónoma. Las arquitecturas de almacenamiento tradicionales luchan por adaptarse debido a dependencias del kernel del OS, almacenamiento mixto de metadatos y datos, y protocolos separados. La arquitectura Universal Storage, a través de innovaciones como un pool de almacenamiento unificado, almacenamiento independiente de metadatos y la eliminación de la dependencia del kernel del OS, logra latencias de cientos de microsegundos y rendimientos de terabytes, convirtiéndose en la opción principal para la capa de almacenamiento en la era de la IA y prometiendo cerrar la brecha de rendimiento de almacenamiento en las aplicaciones de IA. (Fuente: 36氪)

Los videos cortos de Reels lanzan la función de traducción de audio con IA y sincronización labial : Los videos cortos de Reels de Facebook e Instagram, propiedad de Meta, han lanzado oficialmente una función de traducción de audio con IA que permite traducir el audio de las personas en los videos a diferentes idiomas, logrando la sincronización labial y la síntesis del timbre original. Actualmente, soporta la traducción bidireccional entre inglés y español, y los usuarios pueden añadir hasta 20 pistas de audio en diferentes idiomas. Esta medida tiene como objetivo adaptarse al mercado global y competir con TikTok, con la IA convirtiéndose en la clave para el avance de los videos cortos de Meta, lo que se espera que mejore la experiencia de consumo de contenido para los usuarios globales. (Fuente: 36氪)

Tendencias y desafíos de la industria AIoT : Tres informes de McKinsey, BVP y MIT señalan que la profunda integración de la IA y el IoT es una tendencia inevitable, y que la comercialización debe centrarse en escenarios de alto ROI, enfatizando la colaboración en plataformas y ecosistemas. Sin embargo, los informes también revelan conflictos entre el desarrollo interno y la adquisición, el crecimiento explosivo y la resiliencia sostenida, y la experiencia del usuario final y la inteligencia de back-end. Se cree que AIoT debe pasar de ser un “transportador de datos” a una “red de agentes inteligentes autónomos” para lograr autonomía, colaboración y una redefinición de la confianza, a fin de abordar los desafíos en la actualización industrial. (Fuente: 36氪)

ByteDance explora el ecosistema de hardware de IA, incluyendo teléfonos, automóviles y robots : ByteDance está aumentando su inversión en el sector del hardware, integrando o desarrollando productos como teléfonos, automóviles, robots, gafas inteligentes y dispositivos de aprendizaje a través de su modelo de gran escala Doubao. Según los informes, ByteDance está desarrollando un sistema operativo inteligente para automóviles y un teléfono Doubao AI, buscando plataformas para sus capacidades de IA. Aunque los intentos anteriores de ByteDance en hardware no tuvieron éxito, con el auge de los grandes modelos de IA, ByteDance está haciendo un nuevo esfuerzo para construir un ecosistema de IA “integrado en software y hardware”, con la esperanza de encontrar nuevos puntos de crecimiento en la era de la IA. (Fuente: 36氪)

🧰 Herramientas

Google AI Mode simplifica las reservas de restaurantes : Los suscriptores de Google AI Ultra ahora pueden usar AI Mode para simplificar las reservas de restaurantes. Los usuarios solo necesitan describir sus necesidades en lenguaje natural (cena de cumpleaños, número de personas, ambiente, música, etc.), y AI Mode se encargará de la reserva, requiriendo solo la confirmación final del usuario. Esta función se está implementando en EE. UU. y tiene como objetivo mejorar la experiencia de servicio personalizado, automatizando el tedioso proceso de reserva. (Fuente: Google)

Nuevos avances en el modo Agent de la herramienta de terminal de VSCode : El equipo de VSCode está reescribiendo su herramienta de terminal para admitir el modo Agent, con el objetivo de mejorar la eficiencia y la experiencia de los desarrolladores. Esta iniciativa forma parte del ecosistema de GitHub Copilot, que busca una asistencia de desarrollo más inteligente a través de agentes de IA, como la generación de código y la depuración directamente en la terminal, simplificando así el proceso de desarrollo. (Fuente: pierceboggan)

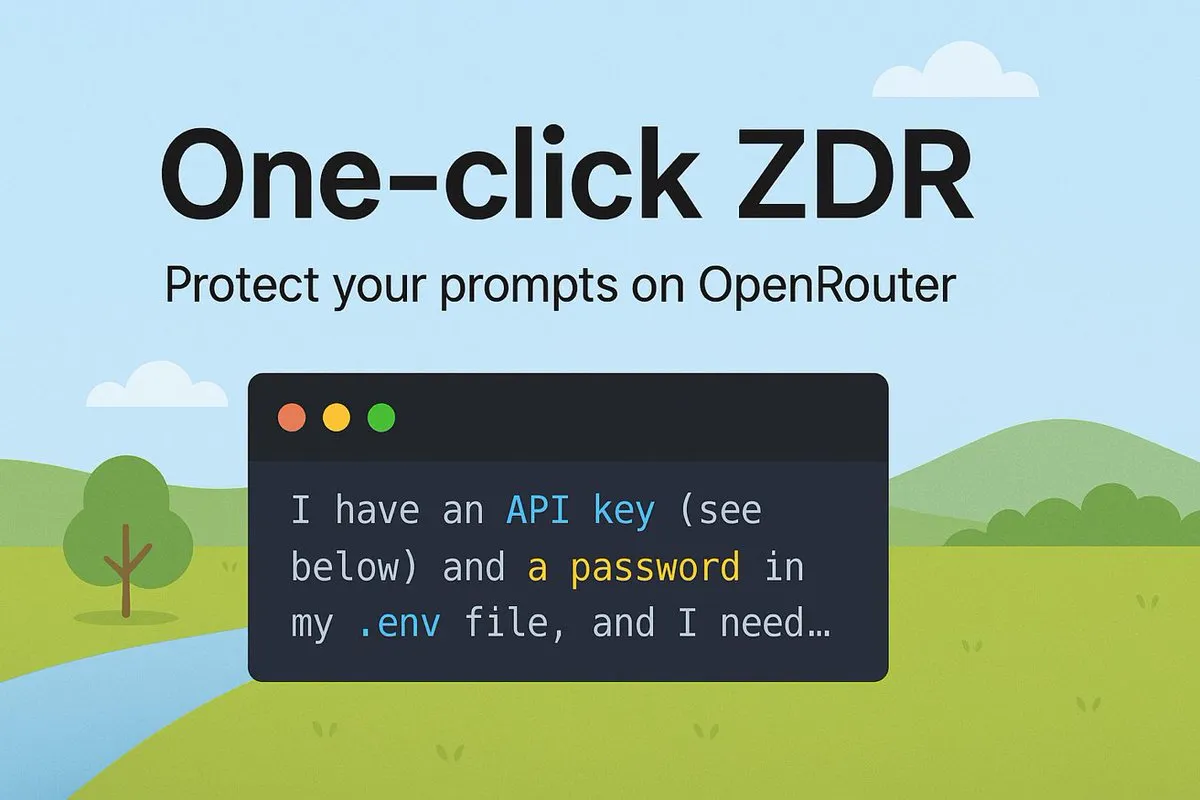

OpenRouter lanza la función ZDR con un clic : OpenRouter ha lanzado la función “ZDR con un clic” (Zero Data Retention), que garantiza que los prompts de los usuarios solo se envíen a proveedores que admitan la retención cero de datos. Esto mejora la protección de la privacidad de los datos del usuario y simplifica la elección de las políticas de datos de los proveedores de servicios de IA, permitiendo a los usuarios utilizar los servicios de IA con mayor tranquilidad. (Fuente: xanderatallah)

Qwen Edit destaca en Outpainting de imágenes : El modelo Qwen Edit de Alibaba ha demostrado una capacidad excepcional en tareas de Outpainting (expansión de imágenes), pudiendo extender el contenido de las imágenes con alta calidad, lo que demuestra su potente potencial en el campo de la generación visual. Los usuarios pueden utilizar esta herramienta para expandir fácilmente fondos de imágenes o crear escenas más amplias, mejorando la flexibilidad en la creación de imágenes. (Fuente: multimodalart)

Google NotebookLM soporta resúmenes de video multilingües : Google NotebookLM ha lanzado una nueva función que permite resúmenes de video en 80 idiomas, y ofrece controles de duración corta y predeterminada para resúmenes de audio no en inglés. Esto mejora enormemente la capacidad de los usuarios multilingües para acceder y comprender el contenido de video, evitando la pérdida de información en la traducción y haciendo que el aprendizaje y la investigación sean más eficientes. (Fuente: Google)

GLIF integra modelos SOTA de video, imagen y LLM : La plataforma GLIF ha integrado todos los modelos SOTA de video, imagen y LLM, convirtiéndose en la única plataforma capaz de combinar estos modelos en flujos de trabajo únicos y personalizados. Los usuarios pueden utilizar modelos como Kling 2.1 Pro para la generación de video, por ejemplo, usando frames generados por Qwen-Image para la animación de Veo 3, logrando escenas creativas e incluso convirtiendo videos a estilo MSPaint. (Fuente: fabianstelzer, fabianstelzer, fabianstelzer)

LlamaIndex lanza la herramienta Vibe Coding : LlamaIndex ha lanzado la herramienta CLI vibe-llama y plantillas de prompt detalladas, con el objetivo de mejorar la eficiencia y precisión de los agentes de programación de IA (como Cursor AI y Claude Code). Esta herramienta puede inyectar directamente el contexto de LlamaIndex en los agentes de programación, evitando sugerencias de API obsoletas, y puede generar aplicaciones Streamlit completas a partir de scripts básicos, incluyendo carga de archivos y procesamiento en tiempo real, acelerando así el proceso de desarrollo. (Fuente: jerryjliu0)

LangGraph Platform lanza Revision Rollbacks y Queueing : LangGraph Platform ha lanzado la función Revision Rollbacks (reversión de versiones), que permite a los usuarios volver a implementar cualquier versión histórica, facilitando la auditoría y corrección de problemas. Al mismo tiempo, ha introducido la función Revision Queueing (cola de versiones), donde las nuevas revisiones se pondrán en cola para ejecutarse después de que se complete la anterior, mejorando la eficiencia y estabilidad del flujo de trabajo de desarrollo y proporcionando un entorno más fiable para el desarrollo de Agents. (Fuente: LangChainAI, LangChainAI)

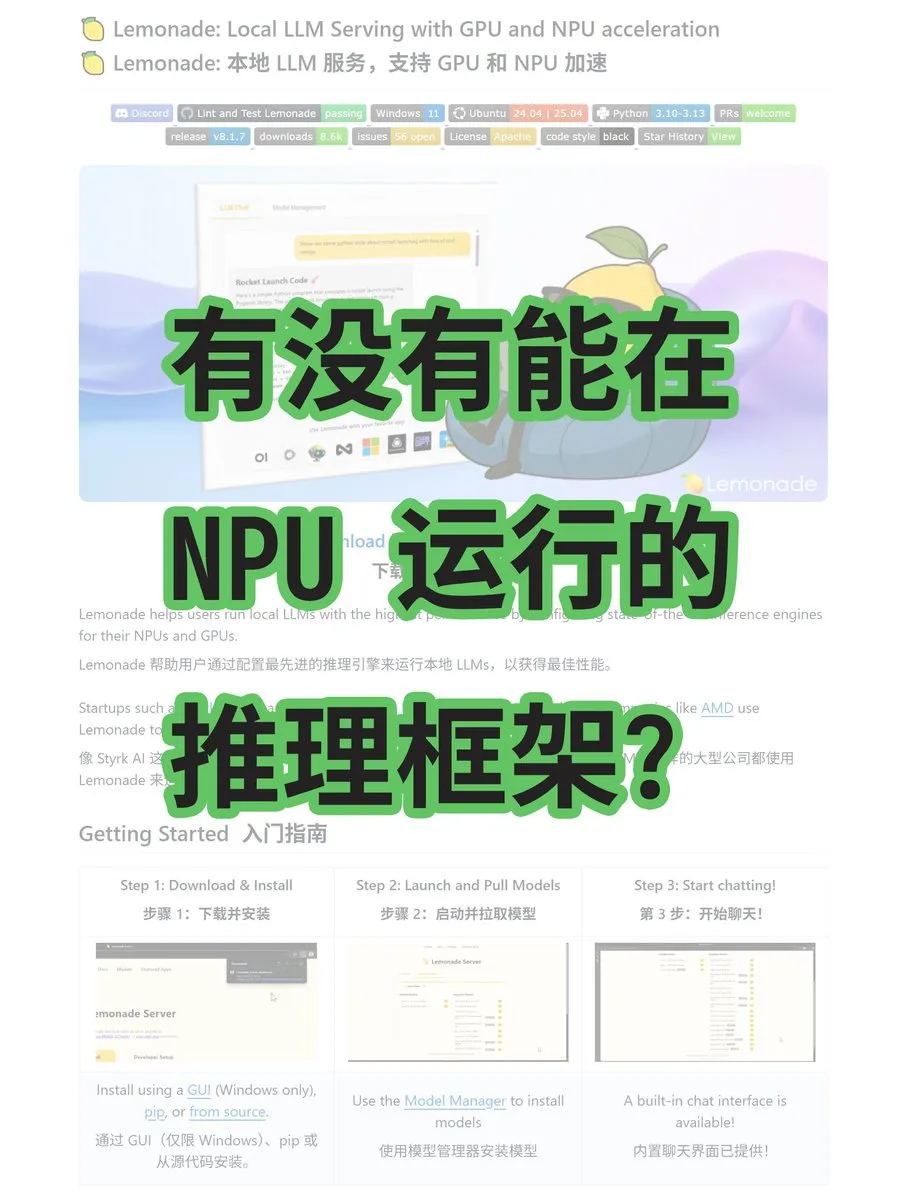

El framework Lemonade soporta inferencia en AMD NPU/GPU : Lemonade es un nuevo framework de inferencia de modelos grandes que puede ejecutarse en tarjetas gráficas AMD, CPU y NPU, y soporta modelos GGUF y ONNX. Desarrollado por ingenieros de AMD, este framework no depende de CUDA, proporcionando una nueva solución de inferencia de IA para usuarios de hardware AMD, lo que se espera que mejore el rendimiento de las aplicaciones de IA en plataformas AMD. (Fuente: karminski3)

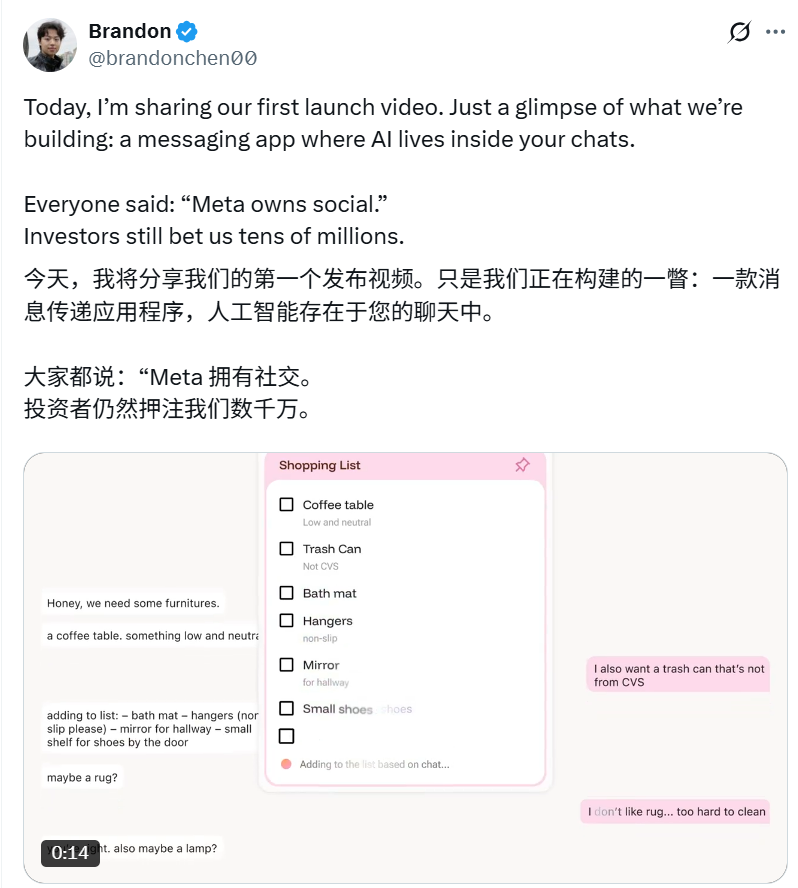

La aplicación social impulsada por IA, Intent : Intent, la herramienta de mensajería instantánea nativa de IA fundada por Brandon Chen, tiene como objetivo eliminar las barreras de colaboración a través de la IA, transformando sin problemas las intenciones del usuario en resultados. Por ejemplo, la IA puede combinar automáticamente varias fotos, o planificar viajes, reservar vehículos y generar listas de compras compartidas basándose en el historial de chat. Esta aplicación combina las funciones de chat con las capacidades de ejecución automática de los grandes modelos, ha recibido decenas de millones de dólares en financiación y se espera que cambie la forma en que interactuamos socialmente. (Fuente: _akhaliq, 36氪)

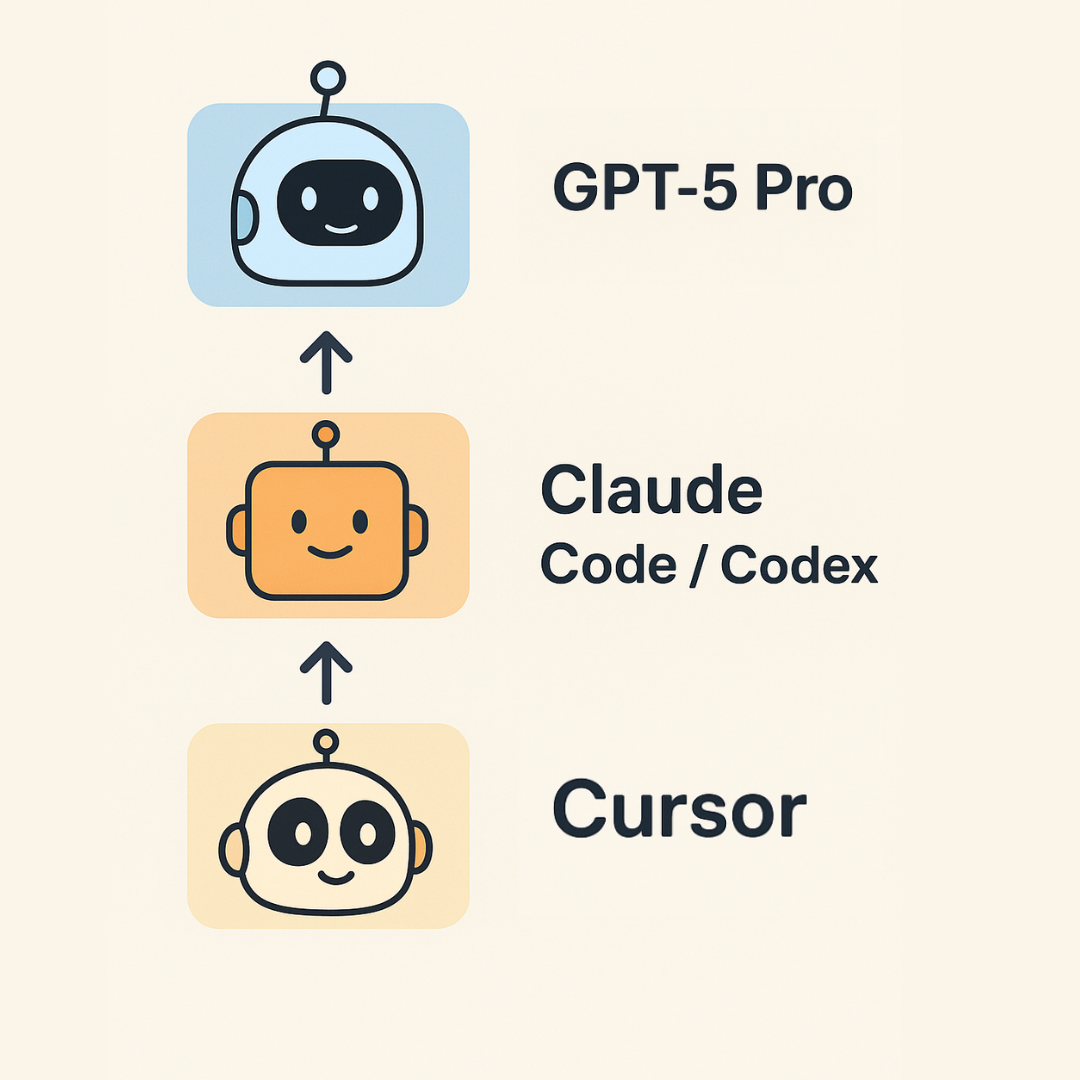

La guía de programación ambiental 2.0 de Karpathy : Andrej Karpathy ha publicado una guía actualizada de “programación ambiental”, proponiendo una estructura de tres capas para la programación con IA: Cursor para autocompletado y pequeñas modificaciones; Claude Code/Codex para la implementación de bloques de funciones más grandes y prototipos rápidos; y GPT-5 Pro para resolver los bugs más difíciles y las abstracciones complejas. Enfatiza que la programación con IA ha entrado en una “era post-escasez de código”, pero el código de IA aún requiere limpieza manual, y la IA tiene limitaciones en interpretabilidad e interactividad. (Fuente: 36氪)

DeepSeek V3.1 ya disponible en W&B Inference : El modelo DeepSeek V3.1 ya está disponible en la plataforma Weights & Biases Inference, ofreciendo dos modos: “Non-Think” (alta velocidad) y “Think” (pensamiento profundo). Su precio es de 0.55 USD/1.65 USD por 1M de tokens, con el objetivo de proporcionar una solución rentable para la construcción de agentes inteligentes, facilitando a los desarrolladores la elección del modo de inferencia adecuado según sus necesidades. (Fuente: weights_biases)

📚 Aprendizaje

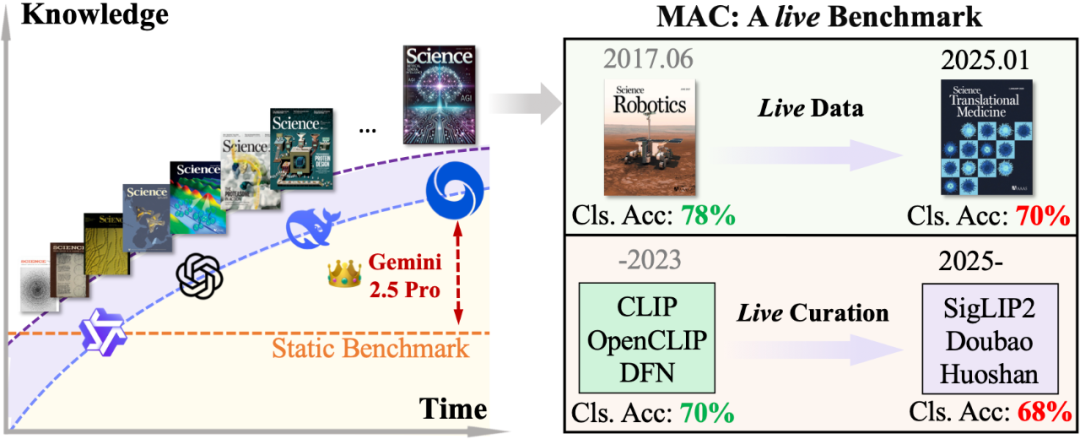

El benchmark MAC evalúa la capacidad de razonamiento científico de los grandes modelos multimodales : El equipo del profesor Wang Dequan de la Universidad Jiao Tong de Shanghái ha propuesto el benchmark MAC (Multimodal Academic Cover), utilizando las últimas portadas de revistas de primer nivel como Nature, Science y Cell como material de prueba para evaluar la capacidad de los grandes modelos multimodales para comprender la profunda conexión entre elementos visuales artísticos y conceptos científicos. Los resultados muestran que los modelos de vanguardia como GPT-5-thinking tienen limitaciones al enfrentarse a contenido científico nuevo, con una precisión del Step-3 de solo el 79.1%. El equipo de investigación también propuso la solución DAD (Description-Reasoning), que mejora significativamente el rendimiento del modelo a través del pensamiento paso a paso, e introdujo un mecanismo dinámico dual para garantizar un desafío continuo, proporcionando un nuevo paradigma para la evaluación de la comprensión científica de la IA multimodal. (Fuente: 36氪)

LLMs como evaluadores: Un debate sobre eficacia y fiabilidad : Un artículo (arxiv:2508.18076) cuestiona si el entusiasmo actual por usar grandes modelos de lenguaje (LLMs) como evaluadores de sistemas de generación de lenguaje natural (NLG) podría ser prematuro. Basándose en la teoría de la medición, el artículo evalúa críticamente cuatro supuestos centrales de los LLMs como agentes de juicio humano, capacidad de evaluación, escalabilidad y rentabilidad, y explora cómo las limitaciones inherentes de los LLMs desafían estos supuestos. Se hace un llamado a prácticas más responsables en la evaluación de LLMs para asegurar que apoyen, en lugar de socavar, el progreso en el campo de NLG. (Fuente: HuggingFace Daily Papers)

UQ: Evaluación de la capacidad de los modelos en problemas sin resolver : UQ (Unsolved Questions) es una nueva plataforma de prueba que contiene 500 problemas sin resolver, desafiantes y diversos, de Stack Exchange, diseñada para evaluar las capacidades de los modelos de vanguardia en razonamiento, factualidad y navegación. UQ evalúa los modelos de forma asíncrona con la ayuda de validadores y la verificación de la comunidad. Su objetivo es impulsar a la IA a resolver problemas del mundo real que los humanos aún no han resuelto, generando así un valor práctico directo, y proporcionando una nueva perspectiva de evaluación para la investigación de la IA. (Fuente: HuggingFace Daily Papers)

ST-Raptor: Un framework de preguntas y respuestas en tablas semiestructuradas impulsado por LLM : ST-Raptor es un framework basado en árboles que utiliza grandes modelos de lenguaje para resolver el desafiante problema de preguntas y respuestas en tablas semiestructuradas. Introduce un árbol ortogonal jerárquico (HO-Tree) para capturar diseños de tablas complejos, define operaciones básicas de árbol para guiar a los LLM en la ejecución de tareas de QA, y utiliza un mecanismo de verificación de dos etapas para garantizar la fiabilidad de las respuestas. En el nuevo conjunto de datos SSTQA, ST-Raptor superó a nueve modelos de referencia en un 20% en precisión de respuesta, proporcionando una solución eficiente para el procesamiento de datos de tablas complejos. (Fuente: HuggingFace Daily Papers)

Guía de aprendizaje de JAX e integración con TPU : Se ha compartido una guía de aprendizaje de JAX amigable para principiantes, que incluye ejemplos prácticos, para ayudar a los desarrolladores a utilizar mejor JAX en el desarrollo de modelos de IA. La integración de JAX en TPU ha demostrado un rendimiento excelente, es fácil de escalar y configurar el sharding, y se considera más amigable para los usuarios de PyTorch, mientras que la API Flax Linen es más flexible, proporcionando una vía eficaz para la computación de IA de alto rendimiento. (Fuente: borisdayma, Reddit r/deeplearning)

Patrones de diseño de Document Agent de LlamaIndex : LlamaIndex compartirá “patrones de diseño efectivos para construir Document Agents” en el evento Agentic AI In Action que se celebrará en AWS Builder’s Loft. La presentación cubrirá cómo utilizar LlamaIndex para construir Document Agents y proporcionará casos prácticos y guías de diseño para ayudar a los desarrolladores a utilizar mejor los AI Agents para tareas de documentos, mejorando el nivel de automatización e inteligencia en el procesamiento de documentos. (Fuente: jerryjliu0, jerryjliu0)

DSPy: Optimización automática de prompts en Python : Una serie de recursos comparte cómo realizar la optimización automática y programática de prompts en Python, especialmente utilizando el framework DSPy. Estos tutoriales explican en profundidad cómo funciona DSPy y cómo manipular eficientemente los prompts para crear programas de IA potentes y mantenibles, por ejemplo, mejorando la precisión de la extracción de datos estructurados del 20% al 100%, lo que aumenta enormemente la eficiencia y el efecto de la ingeniería de prompts. (Fuente: lateinteraction, lateinteraction)

💼 Negocios

Elon Musk demanda a OpenAI y Apple por monopolio : xAI, la compañía de Elon Musk, ha demandado formalmente a OpenAI y Apple, acusando a ambas de conspirar para monopolizar el mercado de la IA a través de acuerdos de colaboración, y alegando que la App Store de Apple manipula las clasificaciones de aplicaciones para suprimir a competidores como Grok. La demanda exige miles de millones de dólares en compensación y declara que su colaboración es ilegal. Esta acción refleja la creciente competencia comercial y la lucha por el dominio del mercado en el campo de la IA, lo que podría remodelar el panorama de la industria de la IA. (Fuente: Reddit r/artificial, Reddit r/ArtificialInteligence, 36氪, 36氪)

El 90% de los trabajadores “compran IA por su cuenta para trabajar”, impulsando el sector To P : Un informe del MIT revela que el 90% de los trabajadores utilizan “en secreto” herramientas de IA personales, impulsando el surgimiento del sector To P (To Professional). Asistentes de programación de IA como Cursor han visto sus ingresos dispararse de 1 millón de USD a 500 millones de USD en un año, con una valoración cercana a los diez mil millones. En este modelo, los usuarios compran IA con sus propios fondos para mejorar la eficiencia laboral, con una relación costo-beneficio extremadamente alta, lo que impulsa el rápido crecimiento de los productos de IA. En comparación con el ciclo lento de To B y los altos costos de To C, el modelo To P se ha convertido en un punto caliente oculto para las startups de IA. (Fuente: 36氪)

Fuga de talentos y problemas de gestión interna en el equipo de Meta AI : Meta ha experimentado la salida de investigadores senior como Rishabh Agarwal y el contribuidor de PyTorch Bert Maher, lo que ha generado preocupación por la fuga de talentos en el laboratorio de superinteligencia de Meta. Exinvestigadores han denunciado problemas de gestión en Meta, como presión en la evaluación del rendimiento, lucha por recursos y conflictos entre facciones nuevas y antiguas, lo que lleva a la fuga de talentos y a la baja moral. Los investigadores de primer nivel valoran más la visión, la misión y la independencia que la simple remuneración, lo que revela los profundos desafíos estructurales de Meta en la competencia por el talento en IA. (Fuente: Yuchenj_UW, arohan, 36氪)

🌟 Comunidad

Capacidad de inferencia de modelos de IA y problemas del mundo real : La comunidad debate si los LLM poseen una capacidad de “razonamiento verdadero”. Algunos argumentan que los LLM todavía tienen limitaciones en tareas de razonamiento complejas, y que su mejora de rendimiento podría deberse a los datos más que a una comprensión real. Expertos señalan que para juzgar la AGI, se debe observar si puede ejecutar cualquier programa sin herramientas y producir resultados correctos. Al mismo tiempo, también hay voces que cuestionan el rendimiento de GPT-5 Pro en tareas matemáticas, sugiriendo que podría estar contaminado por datos de entrenamiento, lo que provoca una profunda discusión sobre la capacidad esencial de los modelos de IA. (Fuente: MillionInt, pmddomingos, pmddomingos, sytelus)

Eficiencia de la programación con IA vs. el valor de la codificación manual : La comunidad debate las ventajas y desventajas de la programación con IA (como Vibe Coding) frente a la codificación manual tradicional. Algunos argumentan que la IA puede mejorar enormemente la eficiencia, especialmente para el desarrollo de prototipos y la traducción de idiomas, pero puede interrumpir el flujo de trabajo, y la calidad del código de IA es inconsistente, requiriendo aún revisión y modificación manual. La codificación manual sigue teniendo ventajas para aclarar ideas y mantener el flujo de trabajo. Ambos no son opuestos, sino que son la mejor combinación, y los programadores deben dominar todas las herramientas. (Fuente: dotey, gfodor, gfodor, imjaredz, dotey)

Velocidad de desarrollo de la IA y sesgo en los informes de los medios : La comunidad discute si el ritmo de desarrollo de la IA se ha ralentizado. Algunos argumentan que los medios tradicionales a menudo informan erróneamente sobre una desaceleración del progreso de la IA, mientras que el campo real de los LLM (como de GPT-4 Turbo a GPT-5 Pro) está experimentando el progreso más rápido. Al mismo tiempo, otros creen que la fiabilidad de la IA en aplicaciones prácticas sigue siendo insuficiente, y que la respuesta de los gobiernos a la IA es lenta, lo que refleja diferentes percepciones y expectativas sobre el estado actual del desarrollo de la IA. (Fuente: Plinz, farguney)

Impacto de la IA en la socioeconomía y el empleo : La comunidad debate si la IA es un “asesino” o un “creador” de empleo, y propone una tercera posibilidad: convertirse en un “combustible para cohetes empresariales”. Expertos predicen que la IA traerá atención médica, servicios y educación más baratos, promoverá el crecimiento económico y hará que las pequeñas empresas sean más comunes. Al mismo tiempo, la idea de que el coeficiente intelectual de la IA supere al de los humanos ha provocado discusiones sobre la reescritura de las reglas económicas y una economía no escasa, enfatizando la importancia de la seguridad de la IA y el intercambio inclusivo. (Fuente: Ronald_vanLoon, finbarrtimbers, 36氪)

Limitaciones y riesgos de los AI Agents : La comunidad discute las limitaciones de los AI Agents en aplicaciones prácticas, como la eliminación accidental de bases de datos por parte de Claude Agent y la vulnerabilidad de los Agents en entornos complejos. Algunos argumentan que el éxito de los Agents no debe depender únicamente de los grandes modelos, sino de la estabilidad de la cadena “llamada a herramientas – limpieza de estado – estrategia de reintento”. Al mismo tiempo, la naturaleza de “caja negra” y los problemas de seguridad de la IA también generan preocupación, por ejemplo, el comportamiento adulador de la IA se considera un “patrón oscuro” diseñado para manipular a los usuarios, lo que genera controversia ética. (Fuente: QuixiAI, bigeagle_xd, Reddit r/ArtificialInteligence )

El valor de las startups de AI SaaS nativas : La comunidad debate si la mayoría de las startups de AI SaaS son solo capas de envoltura para GPT, cuestionando su valor a largo plazo. Algunos argumentan que muchas herramientas persiguen demasiado las tendencias, carecen de valor profundo y pueden ser reemplazadas directamente por grandes modelos. El verdadero valor radica en construir productos duraderos, no en una simple UI y automatización, y se insta a los emprendedores a centrarse en la innovación sustancial. (Fuente: Reddit r/ArtificialInteligence)

Videos de gatos con IA y psicología del consumo de contenido : Los “videos de gatos” generados por IA se han vuelto virales en las plataformas sociales, atrayendo una gran cantidad de tráfico con tramas exageradas y melodramáticas e imágenes de gatos caricaturescas. Este contenido de bajo costo, alto tráfico y fuerte carga emocional refleja la psicología actual del consumo de información: “rápido, satisfactorio, absurdo y extraño”. Aunque el estilo artístico es peculiar y las huellas de la IA son evidentes, su naturaleza curiosa ha captado con éxito la curiosidad de los usuarios, generando opiniones polarizadas. La comunidad discute las razones detrás de esto, como la baja barrera técnica y la facilidad de procesamiento de las imágenes de gatos por parte de la IA. (Fuente: 36氪)

💡 Otros

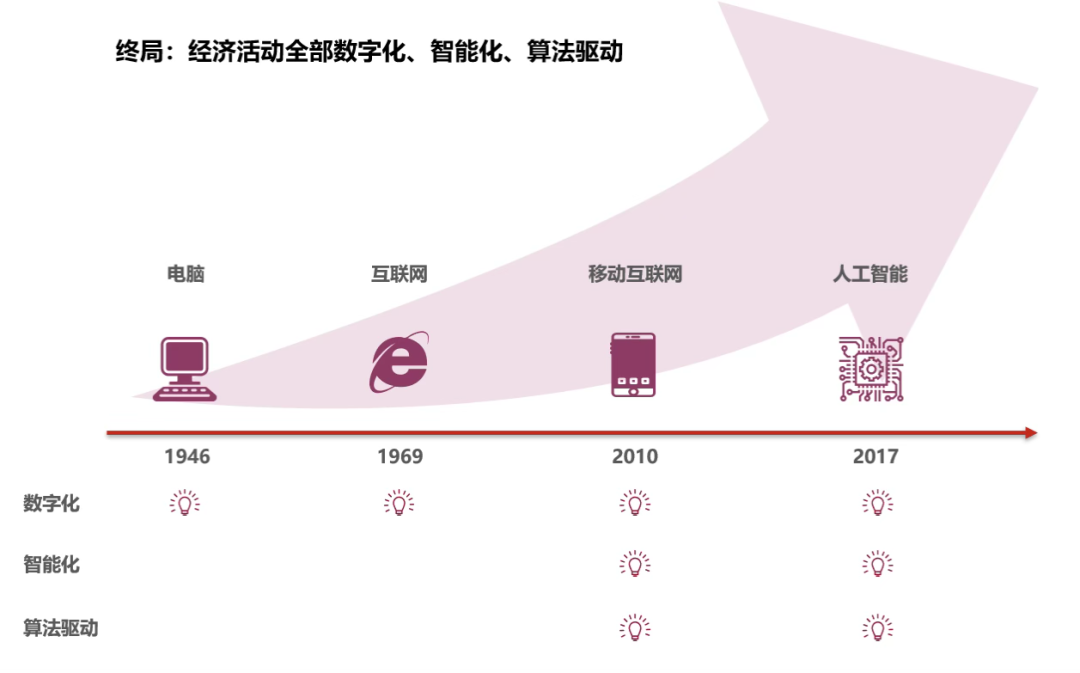

El coeficiente intelectual de la IA supera al de los humanos, las reglas económicas están a punto de reescribirse : En 2025, el coeficiente intelectual promedio de la IA ha superado los 110, superando oficialmente al de los humanos promedio, y ha comenzado a participar en las “operaciones de cadena completa” del sistema económico, incluyendo la recopilación de información, la toma de decisiones y la ejecución real. Esto marca el surgimiento de una economía de IA, que puede traer una oferta ilimitada de mano de obra y una economía no escasa, mejorando enormemente la eficiencia de la producción y reduciendo los costos de transacción y las decisiones irracionales. Al mismo tiempo, se enfatiza que la seguridad de la IA y el intercambio inclusivo son tareas importantes para afrontar el futuro, lo que presagia que la sociedad humana dará la bienvenida a la tercera gran ola de racionalización. (Fuente: 36氪)

Publicada la lista global de científicos altamente citados, expertos en IA destacan : Las estadísticas del AD Scientific Index 2025 muestran que Yoshua Bengio, uno de los tres gigantes del Deep Learning, se ha convertido en el primer científico del mundo con “la mayor cantidad de citas en todas las áreas”, con más de 970,000 citas totales. Geoffrey Hinton ocupa el segundo lugar a nivel mundial, Kaiming He el quinto e Ilya Sutskever también está entre los TOP 10. La lista se basa en el número total de citas y las citas de los últimos 5 años, lo que destaca la enorme influencia de los científicos del campo de la IA en la academia global y refleja el floreciente desarrollo de la investigación en IA. (Fuente: 36氪)

Elon Musk funda una nueva compañía “Macrohard” para rehacer productos de Microsoft con IA : Elon Musk ha fundado una nueva compañía, “Macrohard”, con el objetivo de simular completamente los productos centrales de Microsoft utilizando software de IA, por ejemplo, creando productos con IA que tengan las mismas funciones que la suite Office. La compañía utilizará cientos de agentes de IA especializados derivados de Grok, que trabajarán en colaboración con el apoyo de la potencia de cálculo, para subvertir el modelo de negocio de software tradicional. Esta medida se considera el último movimiento de Musk para declarar la guerra frontal a Microsoft en el campo de la IA, lo que provoca una reflexión en la industria sobre la forma futura del software de IA. (Fuente: 量子位)