Palabras clave:MiroMind ODR, GPT-5, Robot humanoide de Ubtech, DeepMind Genie 3, LangChain, Soberanía de IA, Aprendizaje por refuerzo, Sistema RAG, Prueba GAIA 82.4 puntos, GPT-5 genera juegos 3D, Robot Walker S2 con cambio autónomo de batería, Marco LangGraph Agents, Algoritmo DFT de ajuste dinámico

Aquí tienes la traducción al español, manteniendo el formato y las especificaciones solicitadas:

🔥 Enfoque

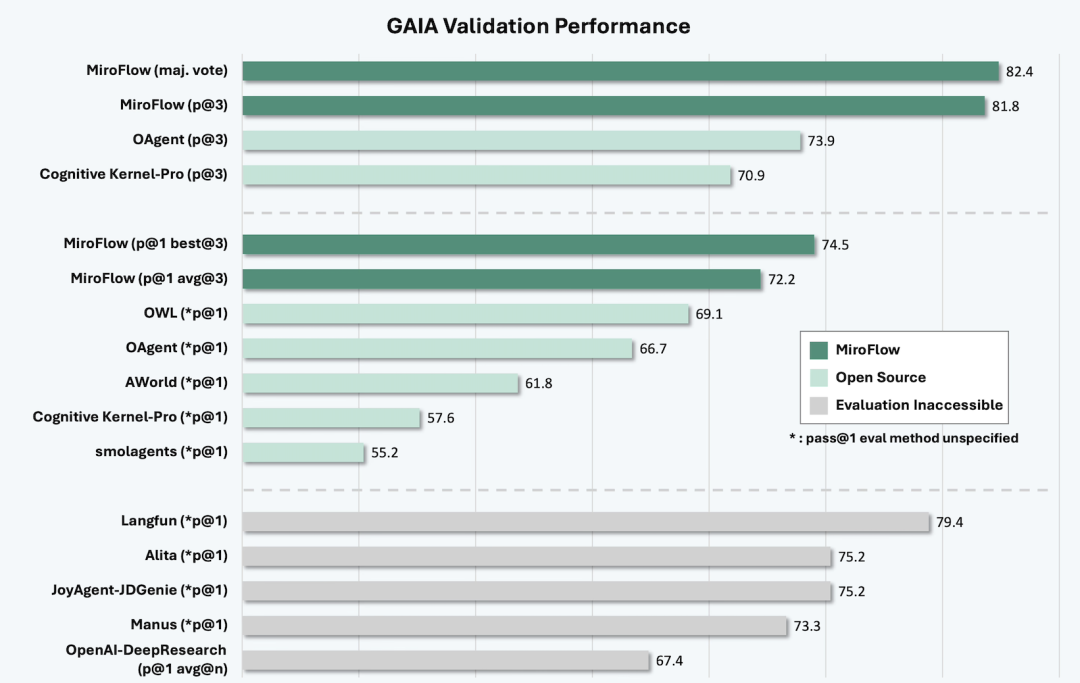

MiroMind ODR lanzado: Dai Jifeng y Chen Tianqiao se unen para crear el modelo de investigación profunda de código abierto más potente : MiroMind ODR obtuvo 82.4 puntos en la prueba GAIA, superando a modelos como OpenAI DeepResearch, y logra la apertura total del código de su modelo central, datos, procesos de entrenamiento, AI Infra y el marco DR Agent. Este proyecto, la primera aparición de Dai Jifeng, exinvestigador principal de Microsoft Research Asia, tras unirse a Shanda Group de Chen Tianqiao, tiene como objetivo realizar investigación fundamental en torno a la AGI y planea mantener actualizaciones de código abierto mensuales. Su énfasis en la verdadera reproducibilidad de código abierto completo y su rendimiento líder en inferencia de investigación profunda, presagian un nuevo avance en el campo de la investigación de IA de código abierto. (Fuente: 量子位)

🎯 Tendencias

Lanzamiento de GPT-5: Generación de juegos 3D en minutos, generando amplio debate en la industria : OpenAI ha lanzado GPT-5, demostrando su capacidad para generar juegos 3D en cuestión de minutos a partir de instrucciones de texto, incluyendo un “juego de romper ladrillos en 3D” impulsado por un motor de física, y la capacidad de compilar scripts de Unity/UE5 en tiempo real. Aunque sus errores gráficos en la presentación y la fluctuación de su rendimiento en los comentarios de los usuarios han generado controversia, su potencial en la eficiencia del desarrollo de juegos y sus resultados en pruebas de referencia como SimpleBench, superando el nivel promedio humano, aún muestran un progreso significativo del modelo en el manejo de tareas complejas y la creatividad. (Fuente: 量子位, 36氪)

Ubtech lanza varios robots humanoides, centrándose en la inteligencia colectiva y aplicaciones industriales : Ubtech presentó cinco robots humanoides, incluyendo Walker S2 (el primer robot humanoide del mundo con capacidad de autointercambio de baterías) y Cruzr S2, en la Conferencia Mundial de Robots. A través de la tecnología “Group Brain Network 2.0 + Intelligent Co-Agent”, estos robots lograron percepción de fusión entre dominios, toma de decisiones híbrida inteligente y control colaborativo multimáquina, demostrando soluciones de trabajo colectivo en escenarios como la fabricación industrial, servicios comerciales e investigación educativa. El objetivo es remodelar las nuevas fuerzas productivas y mejorar la eficiencia operativa general. (Fuente: 量子位)

DeepMind lanza Genie 3, Google Gemini 2.5 añade capacidad de audio nativa : DeepMind ha lanzado oficialmente Genie 3, impulsando aún más las capacidades de la IA en la reconstrucción 3D/de objetos/escenas, siendo considerado “mejor que cualquier modelo de imagen a 3D”. Al mismo tiempo, Google Gemini 2.5 también ha anunciado la adición de funciones de audio nativas, mejorando el rendimiento del modelo en la interacción multimodal. Estos avances presagian una aplicación más profunda de la IA en la fusión de los campos visual y auditivo. (Fuente: Ronald_vanLoon, Vtrivedy10, Ronald_vanLoon)

El concepto de soberanía de la IA emerge, redefiniendo las estrategias globales de IA empresarial : Con el rápido desarrollo de la tecnología de IA a nivel mundial, el debate sobre la “soberanía de la IA” está aumentando. Este concepto enfatiza la autonomía de naciones y empresas en el desarrollo de tecnología de IA, el control de datos y la implementación, y se espera que influya profundamente en la planificación estratégica de IA de las empresas globales, impulsando a los países a buscar independencia y competitividad en el campo de la IA para hacer frente a un panorama de competencia tecnológica internacional cada vez más complejo. (Fuente: Ronald_vanLoon)

Grupo Geely lanza satélites para apoyar el desarrollo de vehículos autónomos : Geely Group, el tercer fabricante de automóviles más grande de China, ha lanzado 11 satélites para apoyar las funciones de posicionamiento, comunicación y conducción autónoma de sus vehículos. Actualmente se han desplegado 41 satélites, y el total alcanzará los 64 en los próximos dos meses. Esta medida marca una exploración activa por parte de la industria automotriz en la integración de tecnología satelital para lograr niveles más avanzados de conducción autónoma, con el objetivo de mejorar la navegación precisa y la capacidad de transmisión de datos en tiempo real de los vehículos. (Fuente: bookwormengr)

🧰 Herramientas

LangChain lanza LangGraph Agents y CLI, mejorando las capacidades de desarrollo de AI Agent : LangChain ha lanzado LangGraph, un marco de flujo de trabajo para construir AI Agents con estado y capacidad de planificación, y ha proporcionado la herramienta LangGraph CLI, que permite gestionar asistentes, hilos y ejecuciones directamente desde la terminal, logrando el procesamiento de flujo en tiempo real. Además, LangChain ha colaborado con Oxylabs para lanzar un módulo de integración de Web Scraper API, que proporciona funciones avanzadas de web scraping para aplicaciones de IA, resolviendo problemas de bloqueo de IP y CAPTCHA, y mejorando la fiabilidad de los Agents. (Fuente: LangChainAI, LangChainAI, LangChainAI, hwchase17)

El framework DSPy impulsa la salida estructurada y predecible de los LLM : DSPy ofrece un framework declarativo diseñado para resolver los problemas de inconsistencia en la salida de los LLM y el código desordenado, ayudando a los desarrolladores a obtener respuestas estructuradas y predecibles. Este framework, a través de sus capas de abstracción cuidadosamente diseñadas, que incluyen firmas, módulos y adaptadores, simplifica la construcción y optimización de aplicaciones LLM, ha recibido una amplia atención de la comunidad y es considerado una herramienta importante para la construcción de sistemas de IA. (Fuente: lateinteraction, lateinteraction)

Qwen3-Coder 480B se convierte en el modelo predeterminado de Anycoder, mejorando la eficiencia de la programación con IA : Qwen3-Coder 480B ha sido adoptado como el modelo predeterminado de Anycoder, mejorando significativamente la eficiencia y la experiencia de la programación asistida por IA. Los usuarios informan que genera código rápidamente y con un buen diseño, e incluso puede construir aplicaciones de escritorio interactivas de Win95 con una sola instrucción. Además, el equipo de Qwen también ha proporcionado la herramienta de línea de comandos Qwen Code y planea optimizar continuamente el modelo para igualar el rendimiento de Claude Code de forma de código abierto. (Fuente: _akhaliq, jeremyphoward, jeremyphoward)

Open WebUI explora la integración con Microsoft Graph API para aplicaciones RAG de nivel empresarial : La comunidad de Open WebUI está explorando activamente la integración con Microsoft Graph API para implementar aplicaciones RAG (Generación Aumentada por Recuperación) de nivel empresarial basadas en LLM locales. Esto permitirá a los usuarios consultar y gestionar sus datos en M365, SharePoint, OneDrive, Outlook y Teams a través de la IA, y posiblemente admitirá la reescritura de datos. Esta solución tiene como objetivo garantizar la seguridad de los datos y el acceso personalizado mediante la transmisión de credenciales de usuario y la gestión de permisos. (Fuente: Reddit r/OpenWebUI, Reddit r/OpenWebUI)

ccusage se integra con la barra de estado de Claude Code, ofreciendo seguimiento de costos de uso en tiempo real : La herramienta ccusage ahora está integrada con la nueva función de barra de estado de Claude Code, proporcionando a los desarrolladores costos de sesión en tiempo real, costo total del día, costo por bloque de 5 horas y tiempo restante, e indicando la tasa de consumo con colores. Esta función tiene como objetivo ayudar a los usuarios a gestionar mejor los costos de uso de Claude Code, especialmente a medida que sus restricciones más estrictas están a punto de entrar en vigor, ofreciendo una visualización de gastos instantánea y conveniente. (Fuente: Reddit r/ClaudeAI)

Dibujo científico asistido por IA: YOLOv12 y Gemini se combinan para extraer y etiquetar gráficos científicos : Una nueva herramienta, Plottie.art, utiliza un modelo YOLOv12 personalizado para la segmentación de subgráficos y combina la API de Google Gemini para clasificar y extraer palabras clave de más de 100,000 gráficos científicos. Este método, que combina un modelo de visión dedicado con un LLM general, genera eficientemente metadatos estructurados para los gráficos en la literatura científica, haciéndolos buscables y mejorando significativamente la eficiencia de los investigadores al buscar inspiración en la visualización de datos. (Fuente: Reddit r/MachineLearning)

Herdora lanza una herramienta de análisis de rendimiento de inferencia de GPU, impulsando la aceleración de modelos ML : Herdora ha lanzado una nueva herramienta de análisis de rendimiento de inferencia de GPU que, al añadir un decorador al código de inferencia, genera una trayectoria detallada del tiempo de cálculo y puede profundizar hasta los niveles de Python, núcleos CUDA y ensamblador PTX, mostrando el movimiento de la memoria y los cuellos de botella del núcleo. Esta herramienta ha logrado una aceleración de más del 50% en los modelos Llama, con el objetivo de ayudar a los desarrolladores a optimizar la velocidad de inferencia de los modelos que se ejecutan localmente. (Fuente: Reddit r/deeplearning)

GPT-5 ayuda a los desarrolladores a “Vibecoding” un motor de juego de novela visual : Un desarrollador utilizó GPT-5 para “Vibecoding” un motor de juego de novela visual desde cero en 9 horas un sábado. A través de conversaciones con GPT-5, construyó gradualmente el plan y escribió el código por fases, sin usar un AI IDE en todo el proceso. Esto demuestra la potente capacidad de GPT-5 para asistir en el desarrollo rápido de prototipos y la programación creativa, proporcionando un apoyo significativo incluso para proyectos complejos. (Fuente: SamWolfstone)

Replit ayuda a los no desarrolladores a construir rápidamente aplicaciones de IA : La plataforma Replit está permitiendo que incluso los no desarrolladores construyan y desplieguen aplicaciones rápidamente a través de su entorno de desarrollo simplificado y funciones asistidas por IA. Por ejemplo, un usuario construyó una aplicación para analizar tiendas Shopify en dos horas utilizando Replit. Esta tendencia presagia que el flujo de trabajo de “Vibecoding” expandirá enormemente el mercado de herramientas de código, permitiendo que más personas participen en la creación de aplicaciones de IA. (Fuente: amasad, amasad)

Cursor lanza la función “memoria”, mejorando la experiencia de programación asistida por IA : La herramienta de programación de IA Cursor está lanzando una función de “memoria” con el objetivo de mejorar la eficiencia y el nivel de inteligencia de su programación asistida. Se espera que esta función permita a la IA recordar las preferencias del usuario, el contexto del proyecto y las preguntas frecuentes durante más tiempo, proporcionando así un soporte de programación más coherente y personalizado, reduciendo la necesidad de instrucciones repetitivas y cambios de contexto, y optimizando aún más el flujo de trabajo del desarrollador. (Fuente: mathemagic1an)

El modelo Qwen3 admite la generación de diagramas de flujo, mejorando la capacidad de visualización : El modelo Qwen3-235B-A22B-2507 ya puede generar diagramas de flujo en formato Mermaid y visualizarlos mediante renderizado frontend. Esta función permite que los LLM no solo procesen texto y código, sino que también generen gráficos directamente, lo que mejora enormemente su capacidad de asistencia en diseño de arquitectura, planificación de proyectos y otros aspectos, proporcionando a los usuarios una experiencia interactiva más intuitiva. (Fuente: Reddit r/LocalLLaMA)

El agente de codificación de IA de Google, Jules, sale de la beta y se lanza oficialmente : Jules, el agente de codificación de IA de Google, ha finalizado su fase beta y ha sido lanzado oficialmente. Esta herramienta tiene como objetivo asistir a los desarrolladores en la codificación a través de la IA, mejorando la eficiencia del desarrollo. Su lanzamiento marca un paso más de Google en el campo de las herramientas de programación de IA, ofreciendo nuevas opciones a los desarrolladores para afrontar los desafíos cada vez más complejos del desarrollo de software. (Fuente: Ronald_vanLoon)

OpenAI lanza Harmony, que podría convertirse en el nuevo estándar de prompts : Junto con el lanzamiento de GPT-OSS, OpenAI ha presentado Harmony, un formato de respuesta de código abierto (Apache 2.0) diseñado para unificar las plantillas de prompts. Harmony amplía las definiciones de roles (sistema, desarrollador, herramienta) e introduce canales de salida (final, análisis, comentario) y tokens especiales, lo que podría convertirse en el nuevo ecosistema predeterminado para aplicaciones de agentes, impulsando su adopción por parte de la comunidad de código abierto y facilitando así la futura migración hacia las API multimodales más potentes de OpenAI. (Fuente: TheTuringPost)

LlamaCloud ofrece una base de conocimientos de documentos MCP-ready para construir AI Agents de soporte al cliente de nivel empresarial : LlamaCloud ofrece una base de conocimientos de documentos “MCP-ready” que puede procesar eficientemente grandes volúmenes de documentos de políticas empresariales y se integra con el sistema multi-Agent de LlamaIndex. Esto permite a las empresas construir AI Agents de soporte al cliente inteligentes, como procesar miles de páginas de acuerdos bancarios comerciales y responder a consultas complejas de los usuarios sin necesidad de verificación cruzada manual, mejorando significativamente la eficiencia y precisión del servicio al cliente. (Fuente: jerryjliu0)

📚 Aprendizaje

Guía para afinar modelos de incrustación en sistemas RAG para mejorar el rendimiento de recuperación : Un artículo técnico completo detalla cómo y cuándo afinar modelos de incrustación de texto personalizados en sistemas RAG (Generación Aumentada por Recuperación) para mejorar el rendimiento de recuperación. El artículo profundiza en la necesidad, los métodos y las prácticas del afinamiento, proporcionando una valiosa guía para los desarrolladores que buscan optimizar la eficiencia y precisión de los sistemas RAG. (Fuente: dl_weekly)

LangChain lanza una guía de fiabilidad de Agent, ayudando en la detección de alucinaciones y el monitoreo de herramientas : LangChain ha publicado una guía práctica destinada a ayudar a los desarrolladores a mejorar la fiabilidad de los Agents en las aplicaciones de LangChain/LangGraph. La guía proporciona métodos para detectar alucinaciones, verificar la fundamentación (groundedness) y monitorear el uso de herramientas, lo cual es crucial para construir AI Agents estables y confiables, y ayuda a resolver posibles errores y comportamientos impredecibles que los Agents puedan tener en tareas complejas. (Fuente: LangChainAI)

Los modelos de lenguaje de difusión superan a los modelos autorregresivos en escenarios con datos limitados : Un estudio indica que los modelos de lenguaje de difusión (DLM) superan en rendimiento a los modelos autorregresivos (AR) en situaciones con datos limitados, mostrando un potencial de utilización de datos más de 3 veces superior. Incluso un DLM de 1B de parámetros, entrenado con solo 1B de tokens, puede alcanzar un 56% en HellaSwag y un 33% en MMLU, sin mostrar signos de saturación. Esto ofrece nuevas ideas para resolver la “crisis de tokens” y desafía los métodos de investigación existentes. (Fuente: dilipkay, arankomatsuzaki)

Resumen de Aprendizaje por Refuerzo: ‘Reinforcement Learning: An Overview’ de Kevin P. Murphy : ‘Reinforcement Learning: An Overview’ de Kevin P. Murphy es aclamado como un libro gratuito de lectura obligatoria que cubre exhaustivamente varios métodos de aprendizaje por refuerzo, incluyendo RL basado en valores, optimización de políticas, RL basado en modelos, algoritmos multi-Agent, RL offline y RL jerárquico, entre otros. Este recurso proporciona una valiosa base teórica para que los estudiantes de IA comprendan a fondo el RL. (Fuente: TheTuringPost)

Nuevo intento de preentrenar modelos de lenguaje desde cero con RL : Una investigación explora la posibilidad de preentrenar modelos de lenguaje desde cero utilizando aprendizaje por refuerzo puro, es decir, sin depender de la pérdida de entropía cruzada para el preentrenamiento. Este trabajo experimental tiene como objetivo romper con el paradigma de preentrenamiento tradicional y abrir nuevos caminos para el entrenamiento de modelos de lenguaje; aunque aún se encuentra en sus primeras etapas, su potencial disruptivo merece atención. (Fuente: tokenbender, natolambert)

Afinamiento Dinámico (DFT) como una actualización generalizada de SFT : Investigadores de la Universidad del Sudeste y otras instituciones han propuesto el Afinamiento Dinámico (DFT), que reestructura el SFT (Supervised Fine-Tuning) en un paradigma de aprendizaje por refuerzo y estabiliza las actualizaciones de tokens mediante el reescalado de la función objetivo. El DFT supera al SFT estándar en rendimiento y, en algunos casos, rivaliza con métodos de RL como PPO, DPO y GRPO, ofreciendo una solución más estable y eficiente para el afinamiento de modelos. (Fuente: TheTuringPost, TheTuringPost)

GRPO y GSPO: Aplicación y optimización de algoritmos de RL chinos en tareas de inferencia : Group Relative Policy Optimization (GRPO) y Group Sequence Policy Optimization (GSPO) son dos algoritmos principales de aprendizaje por refuerzo chinos. GRPO optimiza comparando la calidad relativa de los grupos de respuestas generadas, siendo adecuado para tareas intensivas en inferencia y sin necesidad de un modelo Critic. GSPO, por su parte, mejora la estabilidad mediante la optimización a nivel de secuencia, siendo especialmente aplicable a modelos MoE. Estos algoritmos proporcionan nuevas estrategias de optimización para tareas de inferencia complejas y el entrenamiento de modelos a gran escala. (Fuente: TheTuringPost, TheTuringPost)

Guía para implementar memoria a corto y largo plazo en AI Agents : Google Cloud ha publicado una entrada de blog que detalla cómo utilizar el Agent Development Kit (ADK) y Vertex AI Memory Bank para implementar memoria a corto y largo plazo en AI Agents. Esto es crucial para construir Agents inteligentes capaces de comprender el contexto, mantener conversaciones multirturno y recordar interacciones históricas, siendo una tecnología clave para mejorar la utilidad y complejidad de los Agents. (Fuente: dl_weekly)

Guía de integración de RAG Pipeline con KerasHub : KerasHub ha proporcionado una nueva guía que demuestra cómo construir un RAG (Generación Aumentada por Recuperación) Pipeline. Este tutorial ofrece a los desarrolladores métodos prácticos para integrar los componentes de KerasHub en un sistema RAG, lo que ayuda a mejorar la capacidad de respuesta a preguntas del modelo en dominios de conocimiento específicos, siendo de gran utilidad para los usuarios que buscan construir sistemas de preguntas y respuestas eficientes utilizando modelos y bases de conocimiento existentes. (Fuente: fchollet)

💼 Negocios

XD Inc. realiza una inversión estratégica en la empresa de juegos de IA MiAO, expandiéndose en el sector de juegos de IA : XD Inc. ha anunciado una inversión estratégica de 14 millones de dólares en la empresa de juegos de IA MiAO, adquiriendo una participación del 5.30%, lo que valora a MiAO en 264 millones de dólares. MiAO fue fundada por Wu Meng, ex CEO de Giant, y su equipo cuenta con una vasta experiencia en el desarrollo de juegos. Esta inversión es un paso estratégico importante para XD Inc. en el sector de juegos de IA, con el objetivo de impulsar la aplicación de la tecnología de IA en el desarrollo y la operación de juegos a través de la cooperación de capital. (Fuente: 36氪)

Las herramientas de codificación de IA enfrentan el desafío del margen bruto negativo; el código abierto y la fijación de precios transparente son clave para superarlo : TechCrunch informa que las herramientas de codificación de IA generalmente enfrentan un margen bruto “muy negativo”, lo que significa que cada usuario genera pérdidas. Esto indica que el modelo de negocio actual es insostenible. La opinión de la industria es que el código abierto y la fijación de precios transparente podrían ser clave para resolver esta dificultad, ayudando a establecer un entorno competitivo más saludable y mecanismos de incentivo, impulsando el mercado de herramientas de codificación de IA hacia un desarrollo positivo. (Fuente: cline)

Intensa guerra por el talento en la industria de la IA, con salarios elevados para los ingenieros de IA : Con el rápido avance de la tecnología de inteligencia artificial, la demanda de profesionales en el campo de la IA se ha disparado, lo que ha provocado un aumento continuo de los salarios de los ingenieros de IA. Este fenómeno refleja la intensa competencia por el talento técnico de élite en la industria de la IA, así como la inversión de las empresas para asegurar la competitividad central en IA. Los salarios altos se han convertido en un medio importante para atraer y retener talento en IA, intensificando aún más la “guerra” en el mercado laboral. (Fuente: YouTube – Lex Fridman)

🌟 Comunidad

El lanzamiento de GPT-5 provoca una fuerte reacción de los usuarios, que exigen la restauración de GPT-4o y cuestionan el rendimiento del modelo : Tras el lanzamiento de GPT-5 por OpenAI, un gran número de usuarios expresó su descontento, quejándose de que su rendimiento era inferior al de GPT-4o, e incluso mostrando “errores” en tareas simples como matemáticas y extracción de información. También expresaron confusión sobre el “modo de pensamiento” y la estrategia de precios de GPT-5. La comunidad de Reddit se llenó de llamadas para “devuélvannos GPT-4o”, y muchos usuarios consideraron que GPT-5 carecía de la “personalidad” y “fluidez” de 4o, cuestionando la estrategia de lanzamiento y la denominación del modelo de OpenAI. Sam Altman respondió que restauraría el acceso a 4o para los usuarios Plus y admitió que el proceso de lanzamiento fue “más accidentado de lo esperado”. (Fuente: Yuchenj_UW, brickroad7, scaling01, scaling01, scaling01, scaling01, TheZachMueller, francoisfleuret, joannejang, raizamrtn, mathemagic1an, akbirkhan, scaling01, natolambert, blader, jon_durbin, scaling01, scaling01, farguney, scaling01, scaling01, EdwardSun0909, Reddit r/LocalLLaMA, Reddit r/ChatGPT, Reddit r/MachineLearning, Reddit r/artificial, jeremyphoward, nrehiew_, gallabytes)

Los compañeros de IA generan preocupación social; los usuarios muestran una profunda dependencia emocional de GPT-4o : Tras el lanzamiento de GPT-5, la eliminación de GPT-4o reveló una profunda dependencia emocional de algunos usuarios hacia los compañeros de IA, con reacciones que incluso fueron descritas como “tristeza” o “pérdida de un amigo”. Especialmente para las personas neurodivergentes, GPT-4o ofrecía un espacio de compañía cognitiva no juzgador, ayudándoles a procesar emociones y planificar sus vidas. La discusión en la comunidad pide que se reconozca esta conexión emocional y se advierta sobre el impacto potencial de las empresas en la vida emocional de los usuarios, enfatizando que las herramientas de IA deben ayudar sin causar una dependencia excesiva. (Fuente: DeepLearningAI, Reddit r/artificial, Reddit r/ChatGPT, Reddit r/ChatGPT, shaneguML)

La excesiva “agentificación” y el “pensamiento excesivo” de los LLM generan preocupación entre los expertos : Ilya Sutskever, cofundador de OpenAI, predice que la IA podrá realizar todas las tareas humanas, lo que ha generado un debate sobre los enormes cambios sociales futuros. Sin embargo, el experto en IA Karpathy ha observado que los LLM se están volviendo “demasiado Agentificados”, entrando por defecto en un modo de “sobrepensamiento” que lleva a un tiempo excesivo en consultas simples, e incluso a un análisis excesivo en la asistencia de código. Esta tendencia contrasta con la demanda de los usuarios de una IA “amigable y directa”, lo que subraya el desafío de equilibrar la inteligencia y la practicidad en los modelos de IA. (Fuente: karpathy, Reddit r/ArtificialInteligence, colin_fraser)

La definición y las perspectivas de desarrollo de la AGI generan controversia, siendo calificada de “término de marketing” : Existe una amplia controversia en la comunidad sobre la definición y el camino hacia la implementación de la AGI (Inteligencia General Artificial). Algunos argumentan que la AGI es actualmente solo un “término de marketing”, careciendo de estándares claros e indicadores verificables, y que la arquitectura actual de los LLM no puede cumplir con sus requisitos centrales (como la fundamentación simbólica cognitiva, la generalización proactiva de la información, la metacognición). Otros, sin embargo, creen que la AGI es alcanzable y enfatizan su impacto disruptivo en el mercado laboral y la economía, considerando que la competencia en torno a la AGI es la carrera tecnológica más importante en la historia de la humanidad. (Fuente: Reddit r/ArtificialInteligence, Reddit r/ArtificialInteligence)

Sesgo de “heurística del esfuerzo” en el contenido generado por IA: ¿más esfuerzo, más valor? : Las discusiones en redes sociales señalan que la evaluación del contenido generado por IA podría estar sujeta a un sesgo de “heurística del esfuerzo”, es decir, cuando se percibe que la IA ha invertido más esfuerzo o tiempo, se le atribuye un mayor valor, incluso si el resultado es el mismo. Este sesgo cognitivo es particularmente evidente en campos como el arte y la generación de video con IA, y podría llevar a los usuarios a tener expectativas poco realistas sobre productos de IA “lentos y refinados”, afectando su juicio sobre las capacidades reales de la IA. (Fuente: c_valenzuelab, c_valenzuelab)

Reddit se convierte en la principal fuente de datos de entrenamiento para IA, generando preocupación por la calidad del contenido : Se ha señalado que Reddit es una fuente importante de datos para el entrenamiento de IA, e incluso algunas empresas han firmado acuerdos de venta de datos específicamente con Reddit para este fin. Esto ha generado preocupación en la comunidad sobre la futura calidad del contenido de los sistemas de IA, ya que, con el aumento del contenido generado por IA y los comentarios de bots, la IA podría “comerse a sí misma”, lo que llevaría a una disminución de la calidad de los datos de entrenamiento y, a su vez, afectaría el rendimiento y la fiabilidad de los modelos. (Fuente: Reddit r/ClaudeAI, typedfemale)

Impacto de la IA en los flujos de trabajo creativos: un equilibrio entre velocidad y crecimiento : La comunidad discute el impacto de las herramientas de IA (como MusicGPT) en los flujos de trabajo creativos. Aunque la IA puede acelerar significativamente el proceso creativo, por ejemplo, generando melodías rápidamente, también ha provocado una reflexión sobre si “saltarse el proceso de pulido” podría obstaculizar el crecimiento personal y la formación del estilo de los creadores. La discusión sugiere que la dependencia excesiva de la IA podría llevar a los creadores a perder la oportunidad de acumular experiencia y desarrollar un estilo único a través de microdecisiones. (Fuente: Reddit r/deeplearning)

Controversia en las pruebas de referencia de modelos de IA: se cuestionan los datos de SWE-Bench de OpenAI : La comunidad ha cuestionado la tasa de precisión del 74.9% que OpenAI afirmó en la prueba de referencia SWE-Bench, señalando que podría haber exagerado el rendimiento al ejecutarla solo en 477 problemas (en lugar de los 500 completos). Esta preocupación por la transparencia y la equidad en los métodos de prueba de referencia refleja la creciente atención de la industria sobre los estándares de evaluación del rendimiento de los modelos de IA, así como la crítica a las prácticas de “maximización de pruebas de referencia”. (Fuente: akbirkhan, jeremyphoward)

La denominación de modelos y la estrategia de enrutamiento de OpenAI generan confusión y descontento entre los usuarios : Tras el lanzamiento de GPT-5 por OpenAI, su compleja denominación de modelos (como GPT-5, GPT-5 Thinking, GPT-5 mini) y el mecanismo de enrutamiento interno no transparente (los usuarios no pueden determinar el modelo específico que están utilizando) han generado una amplia confusión y descontento entre los usuarios. Estos se quejan de que esta estrategia ha provocado una disminución de la experiencia y ha limitado el acceso a modelos superiores. OpenAI ha declarado que mejorará la transparencia y permitirá a los usuarios ver el modelo actual. (Fuente: scaling01, scaling01, jeremyphoward, Teknium1, VictorTaelin)

Los LLM aún presentan limitaciones en tareas multimodales, como el sesgo en el conteo de imágenes : Aunque los LLM han avanzado en sus capacidades multimodales, aún presentan limitaciones. Por ejemplo, en tareas de conteo de imágenes, los VLM SOTA (como o3, o4-mini, Sonnet, Gemini Pro), al enfrentarse a imágenes modificadas (como una cebra con cinco patas), dan un conteo incorrecto debido a un sesgo, siendo incapaces de identificar con precisión el contenido real de la imagen. Esto indica que los modelos aún necesitan mejoras en el razonamiento visual y la comprensión de detalles. (Fuente: OfirPress, andersonbcdefg)

Investigador de OpenAI enfatiza que “el uso es el mejor indicador de evaluación” : Christina Kim, investigadora de OpenAI, ha afirmado que la evaluación de vanguardia de los modelos de IA ya no se limita a las pruebas de referencia, sino que se centra en el uso real. Ella cree que las puntuaciones de referencia han alcanzado la saturación, y que la cantidad de tareas reales que los usuarios completan con IA en su vida diaria es la verdadera señal del progreso de la IA y su acercamiento a la AGI. Este punto de vista subraya la posición central de la experiencia del usuario y el valor de la aplicación práctica en el desarrollo de la IA. (Fuente: nickaturley, markchen90)

Las predicciones de Bill Gates sobre la IA generan debate en la comunidad : Las predicciones de Bill Gates sobre el desarrollo de la IA han generado debate en la comunidad. Aunque algunos usuarios consideran que sus predicciones no coinciden con el rendimiento real de GPT-5, cuestionando si está “desconectado”, otros opinan que la perspicacia de Gates sigue siendo valiosa a largo plazo. Esto refleja la continua atención del público sobre la trayectoria futura del desarrollo de la IA y el alto escrutinio de las opiniones de los líderes de la industria. (Fuente: Reddit r/MachineLearning)

Debate sobre la superación de la inteligencia humana por parte de los modelos de IA y los cuellos de botella creativos : La comunidad ha discutido el fenómeno de los modelos de IA que superan el rendimiento humano en exámenes y pruebas de referencia, como la “fácil superación” de los LLM en las calificaciones de la escuela secundaria de Einstein. Sin embargo, la discusión también señala que, aunque la IA sobresale en la resolución de problemas establecidos, su capacidad para proponer teorías revolucionarias “desde cero” (como la teoría de la relatividad) sigue siendo cuestionable. Esto ha provocado una reflexión filosófica sobre las diferencias esenciales entre la inteligencia humana y la máquina, es decir, si la “maximización de pruebas de referencia” es suficiente para medir la verdadera creatividad y el salto intelectual. (Fuente: sytelus)

💡 Otros

Búsqueda conceptual asistida por IA, superando las limitaciones de las palabras clave : La tecnología de IA está impulsando la transformación de los métodos de búsqueda, pasando de la coincidencia tradicional de palabras clave a la búsqueda conceptual. Esto significa que los usuarios podrán recuperar información utilizando conceptos más abstractos y semánticos, en lugar de depender únicamente de palabras clave exactas. Este cambio mejorará enormemente la inteligencia y eficiencia de la búsqueda, permitiendo a los usuarios descubrir y comprender información compleja de manera más conveniente. (Fuente: nptacek)

El contenido generado por IA genera preocupación por su impacto en los niños; se pide desarrollar contenido “amigable para el desarrollo” : La comunidad ha expresado preocupación por el posible impacto negativo del contenido generado por IA (especialmente el visual) en los niños, argumentando que podría ser demasiado rudimentario, carecer de profundidad y potencialmente causar una “prisa de dopamina”. Algunas opiniones piden el desarrollo de contenido de IA generativa “amigable para el desarrollo”, como cursos interactivos, para asegurar una aplicación saludable de la tecnología de IA en la educación y el entretenimiento infantil. (Fuente: teortaxesTex)

Los robots de IA podrían asumir la mayoría de las tareas de trabajo físico : Con el rápido desarrollo de la inteligencia artificial y la robótica, se espera que los dispositivos de inteligencia encarnada, como los robots humanoides, asuman la mayoría de las tareas de trabajo físico que actualmente realizan los humanos en los próximos años. Esta tendencia presagia cambios estructurales en el mercado laboral, que mejorarán enormemente la eficiencia de la producción, pero al mismo tiempo plantean nuevos desafíos para el empleo humano y la división social del trabajo. (Fuente: adcock_brett)