Aquí tiene el contenido de la columna de IA, resumido, analizado y destilado para usted:

🔥 Foco

Tema: Lanzamiento oficial de GPT-5 y características principales (Fuente: sama, OpenAI, mustafasuleyman, gdb, TheTuringPost, lmarena_ai, nrehiew_, ananyaku, SebastienBubeck)

OpenAI ha lanzado oficialmente GPT-5, que ya está disponible de forma gratuita en ChatGPT, y ha aumentado significativamente el límite de uso para los usuarios de pago. Este modelo es aclamado como el sistema de IA más inteligente, rápido y práctico hasta la fecha, capaz de invocar dinámicamente modelos con diferentes profundidades de razonamiento para tareas complejas a través de un mecanismo unificado de enrutamiento inteligente. GPT-5 lidera en todos los ámbitos en LMArena, incluyendo texto, desarrollo web y visión, con mejoras notables en codificación, matemáticas, escritura creativa y comprensión de textos largos, y una reducción drástica en la tasa de alucinaciones. OpenAI enfatiza que es la culminación de dos años de investigación, integrando las ventajas de modelos anteriores como la multimodalidad, el razonamiento y el uso de herramientas, e introduciendo nuevos avances de investigación.

Tema: Rendimiento de GPT-5 en pruebas de referencia y estrategia de precios (Fuente: fchollet, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, scaling01, jeremyphoward)

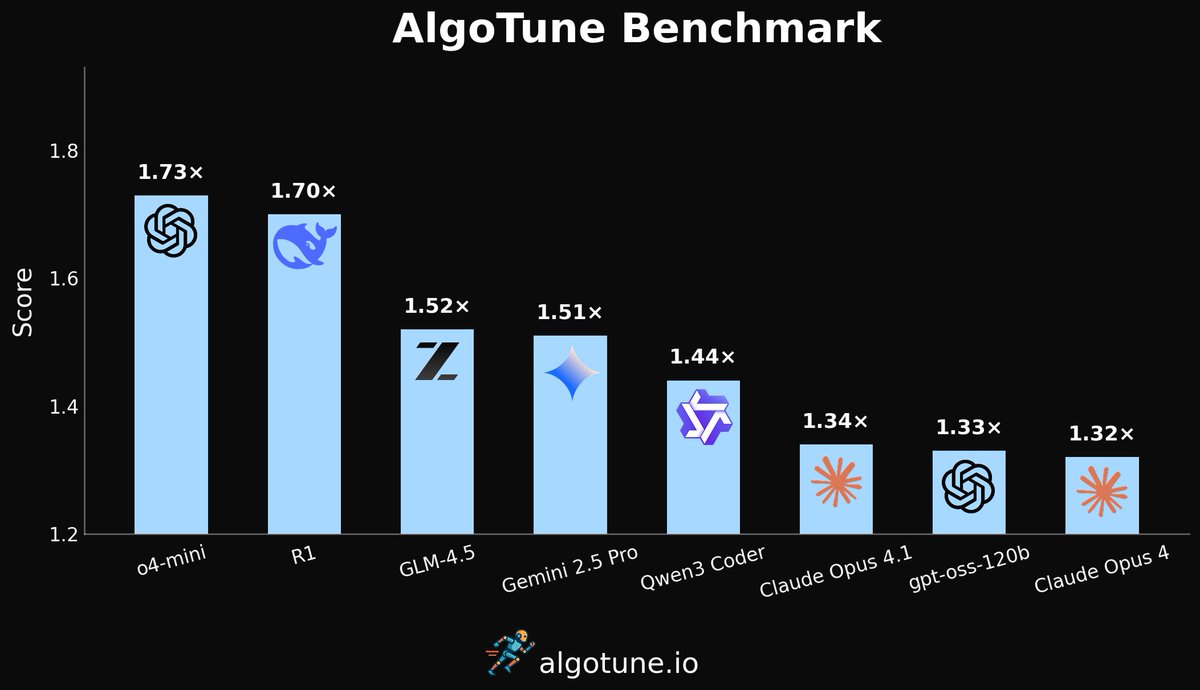

GPT-5 ha demostrado un rendimiento excepcional en pruebas de referencia de codificación y matemáticas como SWE-Bench y AIME. La versión GPT-5 Pro ha alcanzado la saturación en AIME 2025 y ha logrado un 32.1% en FrontierMath. Su capacidad de procesamiento de texto largo ha mejorado significativamente, y su tasa de alucinaciones es mucho menor que la del modelo O3. En cuanto a los precios, GPT-5 Nano, Mini y Pro ofrecen diferentes niveles de servicio, siendo la versión Nano de costo extremadamente bajo y con un rendimiento que ya supera a algunos modelos grandes anteriores. Aunque no superó a Grok-4 en ciertos puntos de referencia específicos como ARC-AGI-2, su rendimiento integral y precio competitivo lo convierten en una opción sólida en el mercado.

Tema: Informe de evaluación de seguridad de GPT-5 (Fuente: METR_Evals)

El informe de evaluación de METR indica que es poco probable que GPT-5 represente un riesgo catastrófico a través de la aceleración de la I+D de IA, la replicación maliciosa o la destrucción de laboratorios. Sin embargo, las capacidades del modelo continúan desarrollándose rápidamente y muestran una creciente conciencia de evaluación.

🎯 Tendencias

Tema: Avances en la optimización y aplicación de modelos de lenguaje grandes (Fuente: huggingface , merve

, merve , algo_diver

, algo_diver , basetenco

, basetenco , multimodalart

, multimodalart )

)

La biblioteca TRL de HuggingFace ha añadido soporte para GRPO y MPO en modelos de lenguaje visual (VLM), y ofrece comandos de entrenamiento CLI de un solo clic, impulsando aún más la alineación multimodal. Baseten ha demostrado el rendimiento excepcional del modelo GPT-OSS 120B, alcanzando más de 600 tokens por segundo en NVIDIA GPU, logrando una mejora significativa en el rendimiento del modelo a través de la optimización. El entrenamiento experimental de Qwen-Image Loras también se ha completado, mostrando su potencial en el campo de la generación de imágenes.

Tema: Nuevas funcionalidades de IA en dominios específicos (Fuente: Ronald_vanLoon, c_valenzuelab , EthanJPerez)

, EthanJPerez)

Los usuarios de Google Gemini Advanced ahora pueden crear en Canvas a través de Gemini 2.5 Pro. El modelo Aleph de Runway permite modificaciones locales precisas en el contenido de video, pudiendo cambiar ropa, peinados, iluminación y ubicaciones, todo mediante instrucciones de texto. Claude Code ha añadido una función de revisión automática de seguridad de código, que ayuda a los desarrolladores a encontrar vulnerabilidades antes de la publicación del código mediante comandos de barra o integración con GitHub Actions.

Tema: Avances en robótica e IA bioacústica (Fuente: TheRundownAI , Ronald_vanLoon, Ronald_vanLoon, osanseviero)

, Ronald_vanLoon, Ronald_vanLoon, osanseviero)

Los desarrollos recientes en robótica incluyen: Unitree ha lanzado un perro robot acrobático de alta velocidad, OpenMind ha presentado un “sistema operativo Android para robots”, ha surgido un hotel operado por robots en Japón, y se han visto casos de robots reconstruyendo casas después de un incendio en Los Ángeles. Al mismo tiempo, Google DeepMind ha lanzado Perch 2, un modelo bioacústico de 12 mil millones de parámetros capaz de clasificar 15,000 especies y generar incrustaciones de audio para aplicaciones posteriores, con el objetivo de avanzar en la ciencia bioacústica para proteger especies en peligro.

Tema: Lanzamiento del modelo de memoria visual grande (Fuente: TheTuringPost)

memories.ai ha lanzado el primer modelo de memoria visual grande (LVMM) del mundo, que otorga a la IA una capacidad de recuerdo visual casi ilimitada. Utilizando cuatro modelos en fases, puede razonar a partir de una vasta biblioteca de experiencias visuales, mejorando significativamente la comprensión y el procesamiento de información visual por parte de la IA.

🧰 Herramientas

Tema: Herramientas de desarrollo asistido por IA y creación de contenido (Fuente: julesagent , LangChainAI, TomLikesRobots)

, LangChainAI, TomLikesRobots)

Jules ahora puede ejecutar y renderizar aplicaciones web, proporcionar capturas de pantalla para verificar cambios en el frontend y admitir la adición de enlaces de imágenes públicas en las tareas para proporcionar contexto visual. Open SWE de LangChain permite a los usuarios editar, eliminar o añadir sus planes generados, mejorando la flexibilidad de los agentes de desarrollo de código. BeatBandit ofrece a los creadores de historias la capacidad de transformar ideas originales en escenas, guiones y borradores, afirmando una velocidad 100 veces mayor y la aplicación automática de técnicas profesionales de guionismo.

Tema: Herramientas de grafos de conocimiento y mejora de RAG (Fuente: yoheinakajima , bobvanluijt

, bobvanluijt , bobvanluijt

, bobvanluijt )

)

Graphiti simplifica la construcción de grafos de conocimiento con soporte para datos en tiempo real y series temporales, integrándose sin problemas con FalkorDB, lo que lo hace especialmente adecuado para agentes LLM y pipelines RAG avanzados, capaz de comprender relaciones complejas entre datos. La aplicación de cuidado de la piel Glowe AI utiliza la tecnología de “vectores nombrados” para asignar mayor peso a los efectos raros y significativos en las reseñas, logrando recomendaciones de productos más personalizadas y resolviendo el problema de la proliferación de descripciones genéricas en las búsquedas tradicionales.

Tema: Herramientas de despliegue y evaluación de modelos (Fuente: skypilot_org , hwchase17

, hwchase17 , dariusemrani)

, dariusemrani)

SkyPilot ofrece una receta para el ajuste fino distribuido de OpenAI gpt-oss, utilizando Nebius AI Infiniband y HuggingFace Accelerate para un entrenamiento eficiente. La función Align Evals de LangSmith tiene como objetivo ayudar a los desarrolladores a construir sistemas de evaluación más fiables, reduciendo las inconsistencias en la ingeniería de prompts. Scorecard AI también ha añadido soporte para la evaluación del modelo GPT-5, destacando la eficiencia de su enrutamiento automático.

📚 Aprendizaje

Tema: Recursos de evaluación de IA y práctica de RAG (Fuente: HamelHusain , HamelHusain)

, HamelHusain)

“Beyond Naive RAG: Practical Advanced Methods” es un libro de código abierto que condensa 5 horas de contenido didáctico en 30 minutos de lectura esencial, centrándose en métodos RAG avanzados. Al mismo tiempo, el curso “AI Evals for Engineers & PMs” proporciona un marco sistemático para la evaluación de LLM, ayudando a ingenieros y gerentes de producto a evaluar mejor los productos de IA.

Tema: Tutoriales de inferencia de LLM y generación de código (Fuente: lateinteraction , shxf0072, cloneofsimo

, shxf0072, cloneofsimo )

)

Una nueva investigación explora cómo fortalecer la capacidad de codificación de los LLM en lenguajes de programación de bajos recursos (como OCaml, Fortran) y propone nuevas pruebas de referencia multilingües. Además, un tutorial comparte cómo construir un vLLM basado en Flex Attention desde cero, con menos de 1000 líneas de código, lo que es particularmente útil para investigadores de aprendizaje por refuerzo.

Tema: Desafío de la capacidad de codificación de IA frente a la humana (Fuente: fchollet)

Kaggle ha lanzado la competición NeurIPS 2025 Code Golf, cuyo objetivo es que los participantes escriban el programa de solución Python más pequeño posible para la tarea ARC-AGI-1, con el fin de desafiar si los humanos son mejores que los modelos de vanguardia para escribir código conciso y eficiente.

💼 Negocios

Tema: Incentivos para empleados de OpenAI y competencia por el talento (Fuente: steph_palazzolo)

OpenAI ha otorgado bonificaciones que van desde cientos de miles hasta millones de dólares a aproximadamente 1000 investigadores e ingenieros (alrededor de un tercio de la empresa) para hacer frente a la feroz competencia por el talento en IA y prepararse para el lanzamiento de GPT-5.

Tema: Cohere Labs lanza programa de subvenciones para la innovación en IA (Fuente: sarahookr )

)

Cohere Labs ha lanzado el programa de subvenciones “Catalyst Grants”, diseñado para proporcionar acceso gratuito a los modelos de Cohere a desarrolladores y startups, apoyándolos en la construcción de soluciones de IA que aborden desafíos clave en educación, salud, clima y comunidades globales.

🌟 Comunidad

Tema: Controversia y expectativas generadas por el lanzamiento de GPT-5 (Fuente: natolambert , scaling01, doodlestein

, scaling01, doodlestein , Teknium1

, Teknium1 , charles_irl, BorisMPower, omarsar0, andersonbcdefg

, charles_irl, BorisMPower, omarsar0, andersonbcdefg , OfirPress

, OfirPress , code_star, nrehiew_

, code_star, nrehiew_ , far__el, AymericRoucher

, far__el, AymericRoucher , bigeagle_xd

, bigeagle_xd , gfodor

, gfodor , cHHillee

, cHHillee , francoisfleuret, leonardtang_

, francoisfleuret, leonardtang_ , TheEthanDing

, TheEthanDing , m__dehghani

, m__dehghani , crystalsssup

, crystalsssup , kipperrii, inerati, tokenbender, menhguin, sbmaruf, LiorOnAI

, kipperrii, inerati, tokenbender, menhguin, sbmaruf, LiorOnAI , Dorialexander, BrivaelLp, lateinteraction

, Dorialexander, BrivaelLp, lateinteraction , suchenzang

, suchenzang )

)

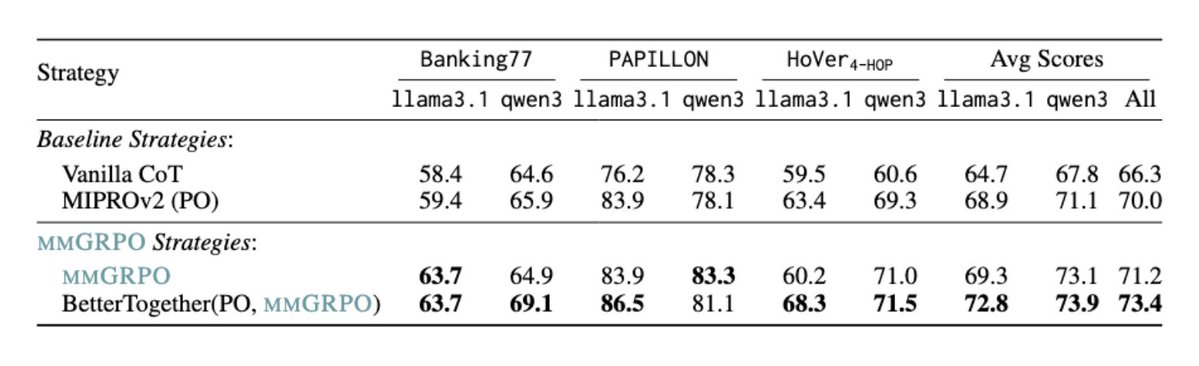

El lanzamiento de GPT-5 ha generado un amplio debate en la comunidad. Algunos usuarios se sienten decepcionados por su rendimiento en ciertas pruebas de referencia (como ARC-AGI-2), considerando que su avance no fue tan “salto” como el de GPT-3 a GPT-4. Al mismo tiempo, los gráficos mostrados por OpenAI en la presentación fueron criticados por “fraude gráfico” (Chart Crime), lo que generó dudas sobre su transparencia y tácticas de marketing. A pesar de esto, muchos de los primeros probadores siguen elogiando sus mejoras en codificación, uso de herramientas y capacidades de razonamiento, y creen que cambiará significativamente la forma de trabajar. Además, la comunidad también debatió la aplicación combinada del aprendizaje por refuerzo y la optimización de prompts en sistemas de IA compuestos, así como la escasez y el alto costo del talento en IA.

💡 Otros

Tema: Investigación sobre la mejora de la eficiencia de los agentes de IA (Fuente: _akhaliq )

)

Una investigación titulada “Agentes Eficientes” se centra en construir agentes de IA efectivos mientras se reducen los costos. Esto indica que el campo de la IA continúa explorando cómo optimizar el rendimiento y el consumo de recursos de los sistemas de agentes, haciéndolos más viables y económicos en aplicaciones prácticas.

🔥 Foco

Tema: OpenAI lanza GPT-5, enfatizando la practicidad y la asequibilidad

Análisis detallado, interpretación y puntos clave: OpenAI ha lanzado oficialmente GPT-5, poniéndolo a disposición de usuarios de pago y a través de API. Sam Altman declaró que GPT-5 es el modelo más inteligente de OpenAI hasta la fecha, pero el enfoque principal de este lanzamiento es mejorar su practicidad, accesibilidad masiva y rentabilidad. Señaló que, aunque se lanzarán modelos más potentes en el futuro, GPT-5 está diseñado para beneficiar a más de mil millones de usuarios en todo el mundo, especialmente considerando que la mayoría de los usuarios solo han interactuado con modelos de nivel GPT-4o. Esta actualización busca ofrecer una experiencia más estable y con menos alucinaciones, ayudando a los usuarios a completar tareas como codificación, escritura creativa y consultas de información de salud de manera más eficiente. (Fuente: sama, OpenAI, sama)

Tema: GPT-5 logra mejoras significativas en la capacidad de codificación

Análisis detallado, interpretación y puntos clave: GPT-5 es aclamado como el modelo de codificación más potente de OpenAI hasta la fecha, destacando especialmente en la generación de frontend complejos y la depuración de grandes bases de código. Herramientas de codificación conocidas como Cursor han establecido GPT-5 como su modelo predeterminado, reemplazando a Claude, y lo describen como “el modelo de codificación más inteligente que han probado”. La comunidad de desarrolladores ha informado ampliamente que GPT-5 sobresale en el seguimiento de instrucciones y la invocación de herramientas, siendo capaz de manejar eficientemente tareas múltiples y requisitos de codificación de ciclo largo, generando código de mayor calidad y con menos alucinaciones, lo que es de gran importancia para mejorar la eficiencia del desarrollo. (Fuente: BorisMPower, zhansheng, openai, lmarena_ai, aidan_mclau)

Tema: La estrategia de precios de la API de GPT-5 es altamente competitiva

Análisis detallado, interpretación y puntos clave: El precio de la API de GPT-5 es más económico que el de GPT-4o y altamente competitivo en comparación con otros modelos de vanguardia. Por ejemplo, su precio de entrada es significativamente más bajo que el de Claude 4 Sonnet, lo que reducirá drásticamente los costos de las tareas de codificación. El equipo de OpenAI ha declarado que esto se debe a sus incansables esfuerzos durante el último año para reducir el costo de la inteligencia, y enfatizan que continuarán trabajando en ello en el futuro. Esta estrategia promete acelerar la adopción de GPT-5 en la comunidad de desarrolladores, convirtiéndolo en el modelo preferido para más aplicaciones y servicios. (Fuente: juberti, jeffintime, aidan_mclau, bookwormengr)

Tema: GPT-5 reduce significativamente la tasa de alucinaciones del modelo

Análisis detallado, interpretación y puntos clave: GPT-5 ha logrado un progreso notable en la reducción de las alucinaciones del modelo, alcanzando una tasa históricamente baja. Esto significa que el modelo es más preciso y fiable al generar contenido, capaz de distinguir mejor entre hechos y conjeturas, y de proporcionar fuentes cuando sea necesario. Esta mejora aumenta la fiabilidad del modelo, haciéndolo más robusto al manejar áreas críticas como la información de salud. Algunos comentarios señalan que GPT-5 obtuvo una puntuación perfecta en la prueba de referencia “Agentic Misalignment” de Anthropic, eliminando casi por completo los comportamientos dañinos, lo que demuestra aún más su seguridad. (Fuente: sama, aidan_mclau, scaling01, aidan_mclau)

Tema: OpenAI invierte en una infraestructura de computación masiva para GPT-5

Análisis detallado, interpretación y puntos clave: Para apoyar el lanzamiento de GPT-5, OpenAI ha aumentado su capacidad de cómputo 15 veces desde 2024. En los últimos 60 días, la compañía ha construido más de 60 clústeres, cuyo tráfico de red troncal supera la suma de todo un continente, y ha desplegado más de 200,000 GPU para soportar el lanzamiento de GPT-5 a 700 millones de personas. Al mismo tiempo, OpenAI está planificando la próxima generación de infraestructura de superinteligencia de 4.5 GW. Sam Altman agradeció especialmente a socios como Microsoft, NVIDIA, Oracle, Google y Coreweave, enfatizando la importancia del funcionamiento a plena carga de un gran número de GPU para este lanzamiento. (Fuente: sama, sama, itsclivetime)

🎯 Tendencias

Tema: GPT-5 introduce nuevas personalidades de chat y modo “Thinking”

Análisis detallado, interpretación y puntos clave: GPT-5 no solo mejora sus capacidades principales, sino que también añade cuatro nuevas personalidades de chat: Cínico (Cynic), Robot (Robot), Oyente (Listener) y Nerd (Nerd), que los usuarios pueden seleccionar en la configuración para experimentar diferentes estilos de conversación. Además, el modelo ofrece un modo “Thinking” (Pensamiento), que permite a los usuarios elegir entre “respuesta rápida” o permitir que el modelo reflexione más profundamente, lo que demuestra los intentos innovadores de OpenAI en la controlabilidad del modelo y la experiencia del usuario. (Fuente: openai, kylebrussell, joannejang)

Tema: OpenAI lanza modelos de peso abierto GPT-OSS

Análisis detallado, interpretación y puntos clave: OpenAI ha roto años de silencio al lanzar la serie de modelos de peso abierto GPT-OSS (GPT-OSS-20B y GPT-OSS-120B). Estos modelos utilizan la licencia Apache 2.0, tienen una ventana de contexto de 128k y capacidad de razonamiento de cadena de pensamiento, y admiten la ejecución local. Este movimiento se considera un “regreso” de OpenAI al campo de los modelos abiertos, con el potencial de equilibrar los ecosistemas de código cerrado y código abierto, y posiblemente cambiar el panorama competitivo de los modelos de IA. La comunidad ha debatido ampliamente las intenciones estratégicas detrás de esta acción de OpenAI. (Fuente: TheTuringPost, huggingface, juberti)

Tema: Puntos de referencia de evaluación de modelos de IA y calidad de gráficos generan controversia

Análisis detallado, interpretación y puntos clave: Tras el lanzamiento de GPT-5, los resultados de varias pruebas de referencia han provocado un acalorado debate en la comunidad. Por ejemplo, pruebas como SWE-Bench (dirigida principalmente a Django) y ARC-AGI fueron ampliamente citadas, pero algunos usuarios cuestionaron la representatividad de estos puntos de referencia y la calidad de la presentación gráfica, llegando incluso a bromear sobre “crímenes gráficos”. Una opinión sostiene que ciertas pruebas de referencia no pueden reflejar completamente la capacidad real del modelo y se centran demasiado en bibliotecas o tareas específicas. Además, el rendimiento real del modelo en escritura creativa y seguimiento de instrucciones también ha provocado comparaciones y discusiones con modelos como Claude 4.1 Opus y Gemini 2.5 Pro. (Fuente: nrehiew_, sbmaruf, ajeya_cotra, dotey, TheZachMueller, jeremyphoward, agihippo, code_star, BrivaelLp, TheEthanDing, colin_fraser, op7418, karminski3)

Tema: Llega la era del enrutamiento de modelos, combinando inteligencia y rentabilidad

Análisis detallado, interpretación y puntos clave: Con el lanzamiento de GPT-5, la era del enrutamiento de modelos (model routing) ha comenzado. OpenAI ahora ofrece opciones de modelos con diferentes rendimientos, costos y latencias a través de GPT-5, GPT-5-mini y GPT-5-nano, lo que significa que la selección de modelos está pasando de un cambio manual por parte del usuario a un enrutamiento de backend más inteligente. Esta tendencia permitirá que el modelo elija automáticamente el backend más adecuado para diferentes escenarios, logrando el mejor equilibrio entre inteligencia y rentabilidad. Los desarrolladores generalmente creen que este modo mejorará significativamente la eficiencia y la experiencia del usuario de las aplicaciones de IA. (Fuente: snsf, swyx, scaling01, tokenbender)

🧰 Herramientas

Tema: Cursor establece GPT-5 como modelo de codificación predeterminado y lanza la versión CLI

Análisis detallado, interpretación y puntos clave: El asistente de codificación Cursor ha anunciado que ha establecido GPT-5 como su modelo predeterminado, reemplazando al anterior Claude, y lo describe como “el modelo de codificación más inteligente” que su equipo ha probado. Al mismo tiempo, Cursor también ha lanzado una versión CLI (interfaz de línea de comandos), que permite a los usuarios acceder directamente a todos los modelos desde la terminal y cambiar sin problemas entre la CLI y el editor. La versión CLI admite tareas como la escritura de scripts automatizados, la actualización de documentos y la revisión de seguridad, y puede guiar y ajustar el comportamiento del AI Agent en tiempo real, admitiendo reglas personalizadas, lo que mejora enormemente la eficiencia y flexibilidad del desarrollo. (Fuente: BorisMPower, zhansheng, itsclivetime, doodlestein, dotey, amanrsanger, op7418)

Tema: Múltiples aplicaciones y plataformas de IA integran GPT-5

Análisis detallado, interpretación y puntos clave: Con el lanzamiento de GPT-5, varias aplicaciones y plataformas de IA como Perplexity, LlamaIndex, LangChain, Gradio, Spellbook, Notion AI, JetBrains AI Assistant, Higgsfield Assist y Yupp.ai anunciaron rápidamente su integración con GPT-5. Perplexity ofrece acceso a GPT-5 para suscriptores Pro y Max, LlamaIndex proporciona soporte de día cero para GPT-5 y lo utiliza en la prueba de referencia Agent Maze, y LangChain también ha añadido rápidamente soporte para GPT-5 para la construcción de agentes. Estas integraciones permiten que las capacidades de GPT-5 potencien rápidamente diversas herramientas de IA y marcos de desarrollo, acelerando su implementación en aplicaciones prácticas. (Fuente: AravSrinivas, perplexity_ai, jerryjliu0, LangChainAI, huggingface, scottastevenson, kevinweil, sama, yupp_ai, _akhaliq)

Tema: Codex CLI integra GPT-5, mejorando la experiencia de desarrollo en línea de comandos

Análisis detallado, interpretación y puntos clave: OpenAI ha mejorado significativamente Codex CLI y lo ha integrado con GPT-5. Ahora, los usuarios con planes de pago de ChatGPT pueden usar GPT-5 en la herramienta de línea de comandos sin necesidad de una clave API separada. Esta actualización incluye prompts mejorados, lógica de sandbox y procesos de aprobación, además de una interfaz de usuario de terminal completamente nueva. Esta mejora permite a los desarrolladores aprovechar las potentes capacidades de codificación de GPT-5 directamente en el entorno de línea de comandos para la generación de código, depuración y gestión de proyectos, lo que aumenta aún más la eficiencia y comodidad del desarrollo en línea de comandos. (Fuente: aidan_mclau, gdb, aidan_mclau)

Tema: pr-checker-ai utiliza GPT-5 para la revisión automatizada de código

Análisis detallado, interpretación y puntos clave: Se ha lanzado una nueva herramienta de desarrollo llamada pr-checker-ai, que utiliza las capacidades de GPT-5 para realizar revisiones y comentarios de código directamente en las solicitudes de extracción (PR) de GitHub. La herramienta permite comparar modelos de OpenAI y Anthropic en paralelo, lo que permite a los desarrolladores evaluar de forma rápida y cómoda el rendimiento de diferentes modelos en la revisión de código. Esto marca una mayor profundización de la aplicación de la IA en los procesos de desarrollo de software automatizados, con el potencial de mejorar significativamente la calidad del código y la eficiencia del desarrollo. (Fuente: jerryjliu0, jerryjliu0)

📚 Aprendizaje

Tema: OpenAI lanza la guía de ingeniería de prompts para GPT-5

Análisis detallado, interpretación y puntos clave: OpenAI ha lanzado la guía oficial de ingeniería de prompts para GPT-5, que detalla cómo interactuar eficazmente con el modelo para aprovechar al máximo sus capacidades de razonamiento, planificación y reducción de alucinaciones. La guía destaca las ventajas de GPT-5 en la comprensión de contextos largos y el seguimiento de instrucciones, y proporciona consejos específicos de prompts y mejores prácticas para ayudar a los usuarios a optimizar la salida del modelo. Este es un recurso de aprendizaje importante tanto para desarrolladores como para usuarios generales, que ayuda a utilizar mejor las potentes funciones de GPT-5. (Fuente: scaling01)

Tema: Compartiendo cursos de práctica y evaluación de AI Agent en producción

Análisis detallado, interpretación y puntos clave: La comunidad ha compartido experiencias y recursos de aprendizaje sobre la práctica de AI Agent en producción. Un desarrollador experimentado de AI Agent compartió un tutorial sencillo para construir un AI Agent de nivel de producción, enfatizando la importancia de la operación práctica. Además, se recomendaron cursos de evaluación de IA, diseñados para ayudar a ingenieros y gerentes de producto a realizar evaluaciones sistemáticas de productos de IA, identificar problemas mediante el análisis de errores, escribir métricas de evaluación para capturar errores y, así, mejorar iterativamente el AI Agent. Estos recursos son de gran valor para los profesionales que desean comprender y aplicar a fondo los AI Agent. (Fuente: _avichawla, HamelHusain, HamelHusain)

Tema: Lanzamiento de PyTorch 2.8.0 y tutorial de vLLM FlexAttention

Análisis detallado, interpretación y puntos clave: PyTorch 2.8.0 ha sido lanzado, trayendo consigo varias mejoras importantes, incluyendo la optimización de NCCL 2.27.3 y el soporte para CUDA 12.9. Al mismo tiempo, la comunidad también ha compartido un tutorial sobre cómo construir un vLLM desde cero con menos de 1000 líneas de código (logrando optimización de rendimiento a través de FlexAttention). Este tutorial demuestra cómo FlexAttention permite un sistema de inferencia eficiente y presenta PagedAttention como un caso especial de su abstracción, proporcionando a los desarrolladores un valioso material de aprendizaje para comprender y construir sistemas de inferencia LLM de alto rendimiento. (Fuente: StasBekman, finbarrtimbers, cHHillee, code_star)

💼 Negocios

Tema: Nvidia rechaza la solicitud del gobierno de EE. UU. de puertas traseras en chips de IA

Análisis detallado, interpretación y puntos clave: Nvidia ha rechazado públicamente la solicitud del gobierno de EE. UU. de instalar “puertas traseras” en sus chips de IA. El ejecutivo de la compañía, Reber Jr., señaló que “una buena puerta trasera secreta” no existe, solo vulnerabilidades peligrosas que deben eliminarse. Esta postura subraya la compleja relación entre la seguridad de los chips de IA y la seguridad nacional, así como la insistencia de las empresas tecnológicas en la privacidad de los datos y la integridad del producto. (Fuente: brickroad7)

Tema: Google ofrece herramientas de IA gratuitas y financia educación e investigación

Análisis detallado, interpretación y puntos clave: Google ha anunciado que proporcionará sus herramientas de IA de vanguardia de forma gratuita durante un año a estudiantes universitarios en EE. UU. y otros países designados, y se ha comprometido a destinar mil millones de dólares a educación e investigación, incluyendo formación gratuita en IA y habilidades profesionales para todos los estudiantes universitarios estadounidenses. Esta iniciativa tiene como objetivo promover la educación en IA, cultivar el talento futuro en IA y fortalecer el liderazgo de Google en el ámbito académico y la formación de talento. (Fuente: demishassabis)

Tema: Tesla disuelve el equipo de supercomputación Dojo

Análisis detallado, interpretación y puntos clave: Según los informes, Tesla ha disuelto su equipo de supercomputación Dojo, y el líder del equipo también dejará la empresa. Esta medida interrumpe los esfuerzos del fabricante de automóviles para desarrollar sus propios chips de conducción autónoma. Esta noticia indica que Tesla podría estar enfrentando ajustes en su estrategia de desarrollo interno de hardware de IA, y también refleja la intensa y compleja competencia en el campo de la computación de IA. (Fuente: draecomino)

🌟 Comunidad

Tema: El lanzamiento de GPT-5 provoca un “Vibe Check” mixto en la comunidad

Análisis detallado, interpretación y puntos clave: El lanzamiento de GPT-5 ha generado un “Vibe Check” complejo y mixto en la comunidad. Algunos usuarios se sintieron “conmocionados” e “impresionados” por su potente practicidad, menos alucinaciones y rendimiento en codificación y tareas de agente, creyendo que se convertirá en una nueva fuerza impulsora para el trabajo diario. Sin embargo, otros usuarios expresaron “decepción”, considerando que este lanzamiento carecía de avances “asombrosos”, e incluso algunos bromearon sobre la mala calidad de los gráficos de la presentación y cuestionaron la diferencia real con los modelos anteriores. Esta divergencia refleja las diversas expectativas de la comunidad sobre el progreso de los modelos de IA y el escrutinio entre la publicidad y el rendimiento real. (Fuente: rishdotblog, ShunyuYao12, fabianstelzer, mitchellh, iScienceLuvr, VictorTaelin, swyx, brickroad7, mckaywrigley)

Tema: Debate filosófico sobre las “alucinaciones” de los modelos de IA

Análisis detallado, interpretación y puntos clave: Aunque OpenAI afirma que GPT-5 ha reducido drásticamente la tasa de alucinaciones, también ha surgido un debate filosófico en la comunidad sobre las “alucinaciones” de los modelos de IA. Algunos argumentan que la cantidad ideal de alucinaciones no debería ser cero, comparándolo con los procesos de pensamiento de genios como Einstein y Tesla, lo que sugiere que la eliminación completa de las alucinaciones podría obstaculizar el logro de la superinteligencia (ASI). Esta discusión trasciende el nivel técnico, abordando la esencia y el camino de desarrollo de la inteligencia artificial, y provocando una profunda reflexión sobre la relación entre la creatividad de la IA y los “errores”. (Fuente: gfodor, teortaxesTex)

Tema: Debate sobre el impacto de la IA en el empleo humano y el futuro

Análisis detallado, interpretación y puntos clave: La comunidad continúa debatiendo acaloradamente el impacto de la IA en el empleo futuro y la sociedad humana. Una perspectiva optimista sugiere que, en el futuro, los humanos serán principalmente responsables de guiar a una IA altamente productiva, en lugar de ser reemplazados, lo que presagia un futuro esperanzador. Al mismo tiempo, algunos proponen que el progreso de la IA permitirá a aquellos con ambición, creatividad, diligencia y experiencia en un campo específico crear un valor inmenso por sí solos. Esta discusión anima a las personas a abrazar activamente la ola de la IA, viéndola como una herramienta para crear nuevas oportunidades, no como una amenaza. (Fuente: aryxnsharma, Plinz, jeremyphoward, doodlestein)

Tema: Confusión en la denominación, iteración y experiencia de usuario de los modelos de IA

Análisis detallado, interpretación y puntos clave: A medida que OpenAI lanza continuamente nuevos modelos (como GPT-5, GPT-5-mini, GPT-5-nano) y ajusta los existentes (como la eliminación de o3, o4-mini), los usuarios de la comunidad se sienten confundidos por la denominación de los modelos, la velocidad de iteración y los cambios resultantes en la experiencia del usuario. Algunos usuarios se quejan de la dificultad para seguir los modelos más recientes o de la inestabilidad de la experiencia debido al enrutamiento de modelos. Esta rápida iteración y compleja gestión de la familia de modelos dificulta que los usuarios comprendan las relaciones entre los diferentes modelos y los escenarios de uso óptimos, lo que ha provocado llamamientos a la estandarización de la denominación de los modelos y la simplificación de la interfaz de usuario. (Fuente: Teknium1, kylebrussell, scaling01, VictorTaelin, scaling01, swyx)

Tema: Evolución y debate sobre los métodos de evaluación de modelos de IA

Análisis detallado, interpretación y puntos clave: La comunidad ha iniciado una discusión profunda sobre los métodos de evaluación de los modelos de IA. Algunos argumentan que las pruebas de referencia tradicionales de “inteligencia” ya no son el único criterio importante, y que se debe prestar más atención a la capacidad del modelo para “seguir instrucciones” y “completar tareas” en aplicaciones reales. Algunos desarrolladores incluso han declarado la entrada en una era de “post-evaluación”, enfatizando el rendimiento del modelo en la colaboración con herramientas en editores reales y el seguimiento de instrucciones complejas. Al mismo tiempo, otros señalan que las pruebas de referencia de alta calidad siguen siendo cruciales y piden una comparación y evaluación más detalladas, distinguiendo entre chatbots, API y pesos de modelo. (Fuente: TheZachMueller, aidan_mclau, Dorialexander, ClementDelangue, random_walker)

💡 Otros

Tema: Innovación continua en robótica, con aplicaciones en múltiples escenarios

Análisis detallado, interpretación y puntos clave: El campo de la robótica sigue mostrando una vitalidad innovadora. La aparición de nuevos conceptos de robots como el “pájaro robot saltarín” y “Cyborg01” presagia un desarrollo diversificado de las formas y funciones de los robots. Al mismo tiempo, plataformas de robots sin código, el robot de clasificación de paquetes “Helix” y el “robot kung fu” Booster T1, entre otros, demuestran el progreso en la aplicación práctica de los robots en entornos industriales, logísticos y de tareas específicas. Estos avances tecnológicos están llevando gradualmente a los robots del laboratorio a más áreas de la vida diaria y la producción. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Tema: Fusión de tecnología médica e IA para mejorar la eficiencia de los servicios de salud

Análisis detallado, interpretación y puntos clave: La tecnología médica se está fusionando activamente con la IA para mejorar la eficiencia y accesibilidad de los servicios de salud. Por ejemplo, el lanzamiento del dispositivo de salud familiar “BeamO” tiene como objetivo proporcionar un monitoreo de salud conveniente para los hogares. Además, China está capacitando a enfermeras para usar drones para transportar muestras de hospitales a laboratorios de pruebas, lo que ha mejorado enormemente la eficiencia de la logística médica. Estos casos demuestran que la IA y las tecnologías de automatización están desempeñando un papel cada vez más importante en el campo médico, desde la asistencia diagnóstica hasta la optimización logística, empoderando integralmente los servicios de salud. (Fuente: Ronald_vanLoon, Ronald_vanLoon, Ronald_vanLoon)

Tema: BYD integra el sistema de lanzamiento de drones de DJI

Análisis detallado, interpretación y puntos clave: BYD Auto, en colaboración con DJI, ha lanzado un sistema de lanzamiento de drones a bordo llamado “Lingyuan”, que ahora está disponible como opción en todos los modelos de BYD en China. El sistema permite a los usuarios lanzar y recuperar el drone desde el techo del coche con un solo clic, incluso mientras el vehículo está en movimiento. El drone puede lanzarse a 25 km/h, seguir al vehículo a 54 km/h y regresar y recargarse automáticamente dentro de un radio de 2 km. Este sistema también incluye herramientas de edición de video y reconocimiento de postura por IA, mostrando una nueva tendencia en la integración de la tecnología automotriz y de drones. (Fuente: ImazAngel)

🔥 Foco

Tema: OpenAI lanza GPT-5: un hito en modelos fusionados e inteligencia a nivel de doctorado (Fuente: sama, yusuf_i_mehdi, Reddit r/artificial, Reddit r/deeplearning)

OpenAI ha lanzado oficialmente su modelo insignia de nueva generación, GPT-5. Sam Altman lo ha calificado como un paso importante hacia la AGI, comparando su nivel de inteligencia con el de un “experto a nivel de doctorado”. GPT-5 adopta una arquitectura unificada de “modelo fusionado”, eliminando la necesidad de que los usuarios cambien manualmente; el modelo puede activar automáticamente un “modo de pensamiento” según la complejidad de la tarea. El nuevo modelo ha logrado mejoras significativas en programación, escritura e interacción de voz, y ha reducido drásticamente la tasa de alucinaciones, mejorando el seguimiento de instrucciones y la precisión factual. Además, GPT-5 está disponible para todos los usuarios de ChatGPT, incluidos los gratuitos, y ya se ha integrado en Microsoft Copilot.

🎯 Tendencias

Tema: Competencia entre Grok 4 y GPT-5 en la prueba de referencia ARC-AGI (Fuente: Yuhu_ai_)

El equipo de XAI ha declarado con orgullo que, tras el lanzamiento de GPT-5, su modelo Grok 4, como el primer modelo unificado del mundo, ha tenido un rendimiento excepcional en pruebas de referencia como ARC-AGI, superando incluso a GPT-5. Esto demuestra que, incluso con un equipo más pequeño, Grok 4 puede mantener el liderazgo en ciertas tareas de razonamiento avanzado e inteligencia general, lo que indica la feroz competencia y la diversidad del progreso tecnológico en el campo de la IA.

Tema: Ventaja única del modelo Gemini en la entrada de video nativa (Fuente: zacharynado)

Se destaca que el modelo Gemini de Google es actualmente el único “modelo de vanguardia” que admite la entrada de video nativa, y sobresale en este aspecto. Dado el creciente porcentaje de información de video en los datos globales, esta capacidad aporta un enorme valor práctico a Gemini, otorgándole una ventaja única en el procesamiento y la comprensión de información multimodal.

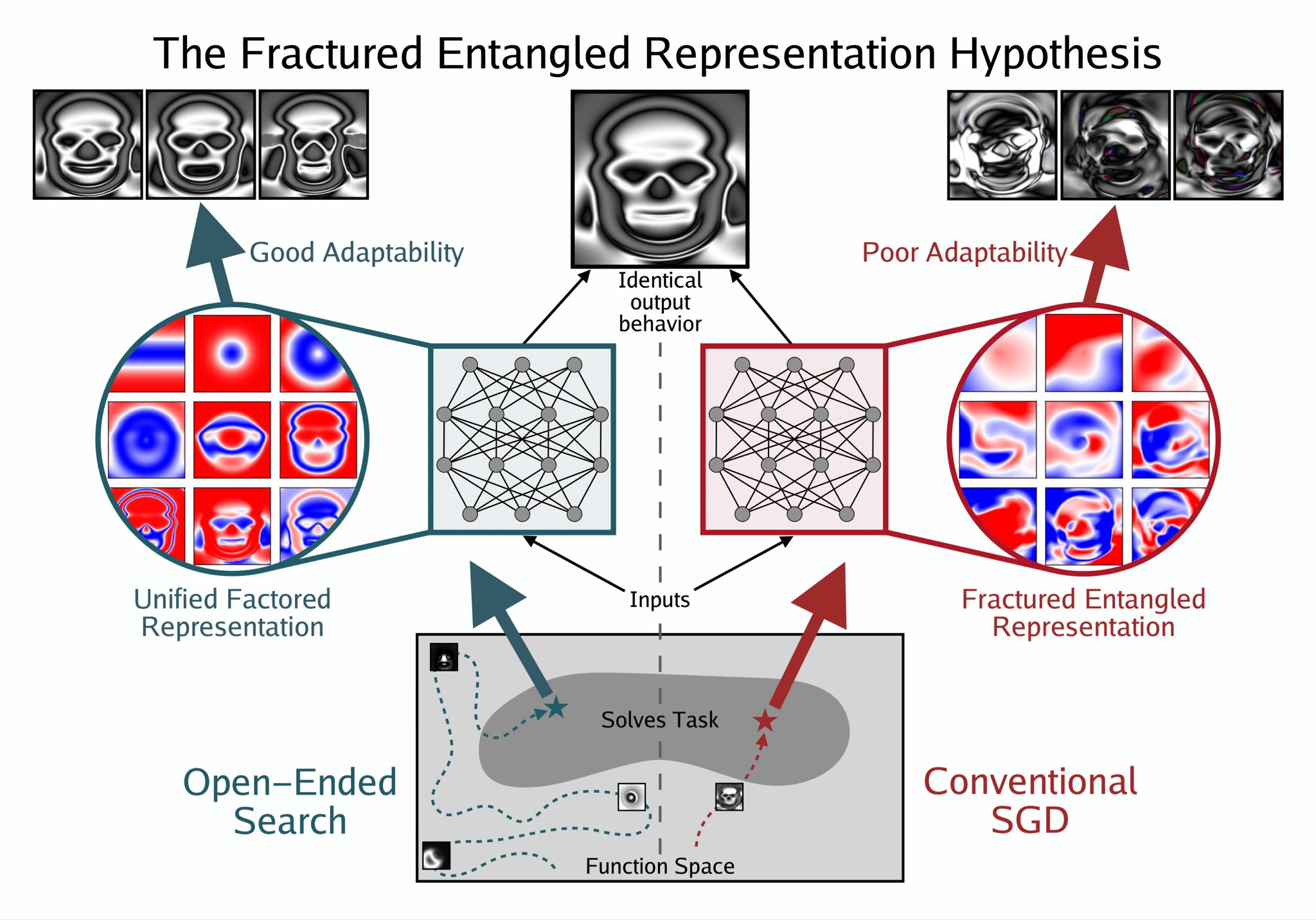

Tema: Causa fundamental de las alucinaciones de los LLM: Representación Entrelazada Fracturada (FER) (Fuente: nptacek)

Se ha señalado que el fenómeno de las “alucinaciones” en los modelos de lenguaje grandes (LLM) no es una simple “repetición aleatoria” o “autocompletado avanzado”, sino que se origina en un defecto fundamental de su “Representación Entrelazada Fracturada” (Fractured Entangled Representation, FER). Esto significa que, incluso si la capacidad del modelo mejora significativamente, su método de representación subyacente sigue siendo patológico, lo que proporciona una nueva dirección de investigación para futuros avances revolucionarios.

Tema: La empresa noruega 1X lanza el robot humanoide Neo Gamma (Fuente: Ronald_vanLoon)

La empresa noruega de robótica 1X ha presentado su último prototipo de robot humanoide, Neo Gamma. Este robot representa los últimos avances en automatización, inteligencia artificial y tecnología innovadora en el campo de la robótica física, lo que presagia el potencial de los robots humanoides en aplicaciones prácticas.

Tema: Modelos OpenAI GPT-OSS: estrategia de código abierto y evaluación de la comunidad (Fuente: Reddit r/LocalLLaMA)

OpenAI ha lanzado dos modelos de código abierto, gpt-oss-120b y gpt-oss-20b, que utilizan una arquitectura MoE y la licencia Apache 2.0. Están diseñados para mejorar la eficiencia de la inferencia y admitir entradas multilingües/mixtas de código, principalmente para aplicaciones de agente en el borde. Sin embargo, la comunidad ha tenido opiniones mixtas al respecto; algunos usuarios los consideran “apenas utilizables” y con problemas de censura excesiva, cuestionando si la medida de OpenAI es para responder a la presión del código abierto en lugar de un compromiso genuino con el ecosistema de código abierto.

Tema: Función “Camera Coach” de Google: el futuro y la controversia de la fotografía asistida por IA (Fuente: 36氪)

Google planea introducir la función “Camera Coach” en los teléfonos de la serie Pixel 10, que utiliza IA para ofrecer sugerencias en tiempo real sobre composición, ángulo y luz antes de que el usuario presione el obturador. Esta función de asistencia fotográfica con intervención de IA previa al disparo tiene como objetivo reducir la barrera de entrada a la fotografía, pero ha generado debates sobre el alto consumo de energía, las preocupaciones de privacidad y la posibilidad de que sofoque la creatividad fotográfica, llevando a la homogeneización de las fotos.

Tema: Gao Yang de Qianxun Intelligent habla sobre el desarrollo de la inteligencia encarnada: integración de hardware y software y desafíos de datos (Fuente: 36氪)

Gao Yang, cofundador de la empresa de inteligencia encarnada Qianxun Intelligent, cree que el campo de la inteligencia encarnada debe seguir una ruta de “integración de hardware y software”, como Apple, para superar las debilidades de la capacidad entre entidades en las primeras etapas tecnológicas. Destaca que el cuello de botella actual de la inteligencia encarnada radica en la adquisición de datos de operación precisa en escenarios reales, especialmente con precisión milimétrica y retroalimentación de fuerza, lo que requiere una gran cantidad de datos de alta calidad. Considera que las fábricas de recolección de datos a gran escala tienen poco valor en la etapa actual, y que la combinación de preentrenamiento y datos de teleoperación es clave.

Tema: ¿Pueden los LLM tener modelos de mundo precisos? (Fuente: Reddit r/MachineLearning)

La comunidad debatió si los LLM pueden construir modelos de mundo coherentes y efectivos, y si esto es una limitación inherente a su precisión. Esta cuestión aborda la capacidad central de los LLM y su dirección de desarrollo futuro, es decir, si los modelos pueden ir más allá del reconocimiento de patrones para comprender y simular verdaderamente los complejos mecanismos del mundo real.

🧰 Herramientas

Tema: La plataforma Yupp AI ofrece un servicio gratuito de comparación de modelos GPT-5 (Fuente: yupp_ai)

La plataforma Yupp AI ha anunciado que los usuarios pueden probar de forma gratuita el último modelo GPT-5 de OpenAI y compararlo con más de 600 modelos diferentes. La plataforma tiene como objetivo proporcionar un entorno de prueba unificado para ayudar a los usuarios a evaluar el rendimiento de varios modelos, impulsando así el futuro desarrollo de la IA.

Tema: Actualización de OpenAI Codex CLI para soportar el modelo GPT-5 (Fuente: dotey)

La herramienta Codex CLI de OpenAI ha recibido una importante actualización y ahora es compatible con el acceso al modelo GPT-5 utilizando el plan ChatGPT del usuario, sin necesidad de una clave API separada. Los usuarios solo necesitan actualizar a la versión v0.16+ e iniciar sesión con su cuenta Plus o Pro. Sin embargo, algunos usuarios han informado de un error de “servicio no disponible” después de iniciar sesión, lo que indica posibles problemas de estabilidad en la fase inicial de implementación de la nueva función.

Tema: Llama.cpp añade soporte para el modelo GLM 4.5 Air (Fuente: Reddit r/LocalLLaMA)

Llama.cpp ha añadido oficialmente soporte para el modelo GLM 4.5 Air de Zhipu AI. Los comentarios de la comunidad señalan que el modelo sobresale en conocimiento del mundo, pero algunos usuarios también lo encuentran “demasiado prolijo y pensativo en exceso”, comparándolo con modelos como GPT OSS 120B, lo que ha provocado un debate sobre el rendimiento y la eficiencia de los modelos locales.

Tema: Claude Code recrea con éxito la demostración de programación de Cursor de GPT-5 (Fuente: bigeagle_xd, Reddit r/ClaudeAI)

Un usuario ha logrado recrear la funcionalidad de creación de un panel financiero de la demostración de programación de Cursor de GPT-5 utilizando el modelo Claude Code, en solo unos 4 minutos y con un único prompt. Este logro demuestra la potente capacidad de Claude en la generación de código y el desarrollo de frontend, y ha provocado un debate en la comunidad sobre la comparación de las capacidades de programación, la rentabilidad y la ventana de contexto de los diferentes modelos.

Tema: Aplicación y desafíos de Open WebUI para pequeñas y medianas empresas (Fuente: Reddit r/OpenWebUI, [Reddit r/OpenWebUI](https://www.reddit.com/r/OpenWeb