Palabras clave:Google DeepMind, Genie 3, Modelo de mundo, Entorno de entrenamiento de IA, Desarrollo de juegos, AGI encarnado, Sistema multiagente, Generación en tiempo real de entornos 3D interactivos, Resolución 720p a 24fps, Colaboración de dos agentes: solucionador + verificador, Resolución de problemas de IA en competiciones IMO de matemáticas, Sistema IMO multiagente de código abierto

Aquí tienes la traducción al español, manteniendo el formato y las especificaciones solicitadas:

🔥 Foco

Google DeepMind lanza Genie 3, un modelo mundial: Google DeepMind ha presentado Genie 3, un modelo mundial innovador capaz de generar entornos 3D interactivos en tiempo real a partir de indicaciones de texto, con soporte para resolución de 720p y una tasa de 24fps. Este modelo posee una memoria visual y capacidad de control de acciones de varios minutos, siendo considerado el futuro motor de juegos 2.0. Se espera que revolucione los entornos de entrenamiento de IA y el desarrollo de juegos, proporcionando una pieza clave que falta para la AGI encarnada. (Fuente: Google DeepMind)

Ant Group Multi-Agent replica resultados de medalla de oro de la IMO y los hace de código abierto: El equipo del proyecto AWorld de Ant Group replicó en solo 6 horas los resultados de DeepMind en la resolución de 5 de 6 problemas del concurso de matemáticas IMO 2025, y ha hecho de código abierto su sistema multi-agente IMO. Este sistema, a través de la colaboración de doble agente “solucionador + verificador”, demuestra el potencial de superar el límite de inteligencia de un solo modelo y se utiliza para entrenar la próxima generación de modelos, lo que se espera que impulse el desarrollo de la Inteligencia Artificial General (AGI). (Fuente: 量子位)

La IA descubre nuevas leyes físicas: Investigadores de la Universidad de Emory entrenaron una IA para descubrir nuevas leyes físicas a partir de datos experimentales de plasma de polvo, revelando fuerzas previamente desconocidas. Este estudio demuestra que la IA no solo puede predecir resultados o limpiar datos, sino también descubrir leyes físicas fundamentales, y corrigió una suposición de larga data en la física del plasma, abriendo nuevas vías para el estudio de sistemas complejos de múltiples partículas. (Fuente: interestingengineering)

🎯 Tendencias

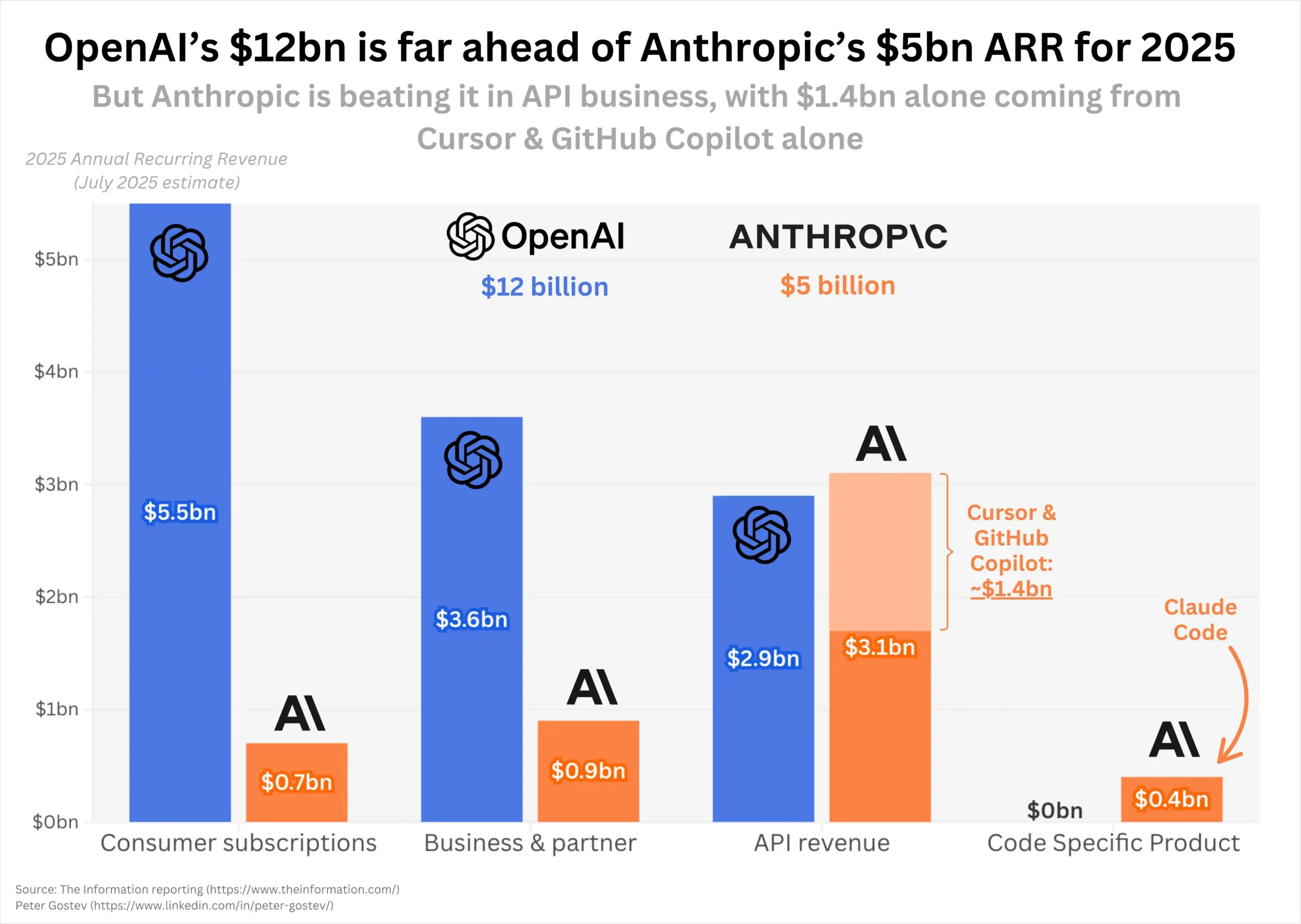

OpenAI y Anthropic experimentan un rápido crecimiento de ingresos, el panorama del mercado bajo atención: En 2025, OpenAI y Anthropic mostraron un asombroso impulso de crecimiento de ingresos. Los ingresos recurrentes anualizados de OpenAI se duplicaron a 12 mil millones de dólares, mientras que los de Anthropic se quintuplicaron a 5 mil millones de dólares. Anthropic tuvo un fuerte desempeño en el mercado de API de programación, y el número de usuarios de ChatGPT también continuó creciendo rápidamente. El mercado está atento a si el lanzamiento futuro de GPT-5 cambiará el panorama actual del mercado, especialmente la posición dominante de Anthropic en el campo de la programación. (Fuente: dotey, nickaturley, xikun_zhang_)

Kaggle lanza plataforma de competición de juegos de ajedrez con IA: Kaggle ha anunciado el lanzamiento de Game Arena, una plataforma de competición de código abierto diseñada para evaluar objetivamente el rendimiento de los modelos de IA de vanguardia mediante enfrentamientos directos (actualmente centrados en el ajedrez). El primer Campeonato de Ajedrez de IA ya ha comenzado, con maestros de ajedrez invitados a comentar, lo que ha generado interés en el rendimiento de modelos como Kimi K2. (Fuente: algo_diver, teortaxesTex, sirbayes, Reddit r/LocalLLaMA)

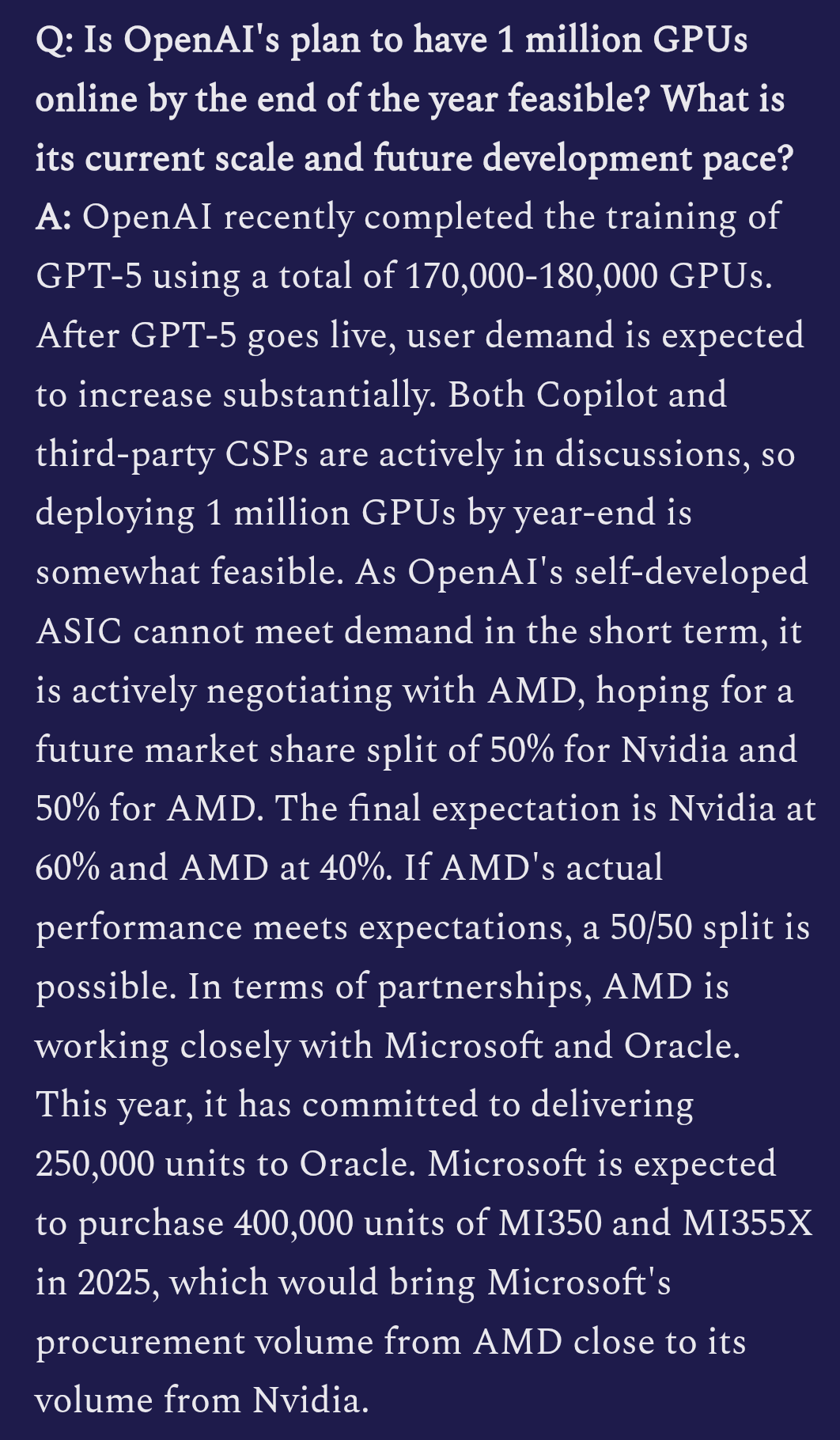

Detalles de entrenamiento de OpenAI GPT-5 expuestos: Se informa que OpenAI está utilizando entre 170.000 y 180.000 GPU H100 para entrenar GPT-5. Las capacidades multimodales de este modelo se han mejorado significativamente, posiblemente integrando entrada de video, y se planea crear un “momento Ghibli”, lo que sugiere sus ambiciones en la generación de contenido creativo. (Fuente: teortaxesTex)

GLM 4.5 entra en el top cinco de LM Arena: El modelo GLM 4.5 de Zai.org ha tenido un excelente desempeño en la votación comunitaria de LM Arena, obteniendo más de 4000 votos y logrando entrar en el top cinco de la clasificación general, junto con DeepSeek-R1 y Kimi-K2 como modelos de código abierto de primer nivel, lo que demuestra su competitividad en el campo de los grandes modelos de lenguaje. (Fuente: teortaxesTex, NandoDF)

CloudPeng Technology lanza nuevos productos de IA+salud: CloudPeng Technology, en colaboración con Shuaikang y Skyworth, ha lanzado un refrigerador inteligente equipado con un gran modelo de salud de IA y un “Laboratorio de Cocina del Futuro Digitalizado”. El gran modelo de salud de IA, a través del “Asistente de Salud Xiaoyun”, ofrece gestión de salud personalizada y optimiza el diseño y la operación de la cocina, lo que marca una aplicación profunda de la IA en la gestión de la salud diaria y la tecnología del hogar, con el potencial de mejorar la calidad de vida de los residentes. (Fuente: 36氪)

Nuevo marco de seguridad para sistemas de IA publicado: MITSloan ha propuesto un nuevo marco destinado a ayudar a las empresas a construir sistemas de IA más seguros. Este marco se centra en las prácticas de seguridad de la inteligencia artificial y el aprendizaje automático, proporcionando una guía importante para la protección de las aplicaciones de IA cada vez más complejas. (Fuente: Ronald_vanLoon)

Avances en la aplicación de la IA en ciberseguridad: El marco Cyber-Zero permite entrenar agentes LLM de ciberseguridad sin necesidad de un entorno de ejecución, generando trayectorias de alta calidad mediante ingeniería inversa de informes de resolución de CTF. Su modelo Cyber-Zero-32B entrenado logra un rendimiento SOTA en pruebas de referencia de CTF, siendo más rentable que los sistemas propietarios. Al mismo tiempo, Corridor Secure está construyendo una plataforma de seguridad de productos nativa de IA, con el objetivo de introducir la IA en el campo de la seguridad del desarrollo de software. (Fuente: HuggingFace Daily Papers, saranormous)

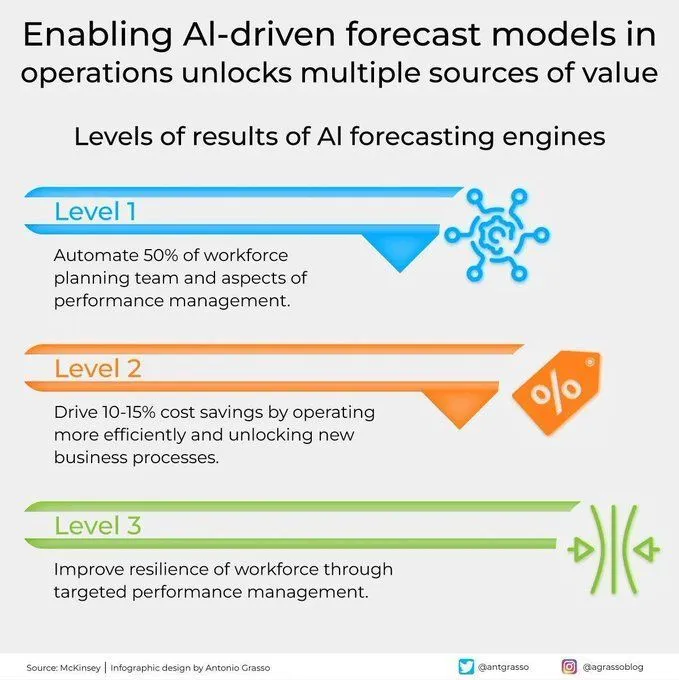

Los modelos predictivos impulsados por IA liberan valor en las operaciones: Los modelos predictivos impulsados por IA están demostrando un enorme valor en las operaciones, al proporcionar capacidades de predicción más precisas, desbloqueando múltiples fuentes de valor, impulsando la transformación digital y mejorando el papel del aprendizaje automático en la toma de decisiones empresariales. (Fuente: Ronald_vanLoon)

Primera construcción de carretera autónoma asistida por maquinaria de IA del mundo: El primer proyecto de construcción de carretera autónoma del mundo, de 158 kilómetros de longitud, fue completado íntegramente por maquinaria de IA con el apoyo de una red 5G. Esto marca un avance significativo de la inteligencia artificial, la RPA y las tecnologías emergentes en el campo de la construcción de infraestructuras, presagiando una alta automatización en futuros proyectos de ingeniería. (Fuente: Ronald_vanLoon)

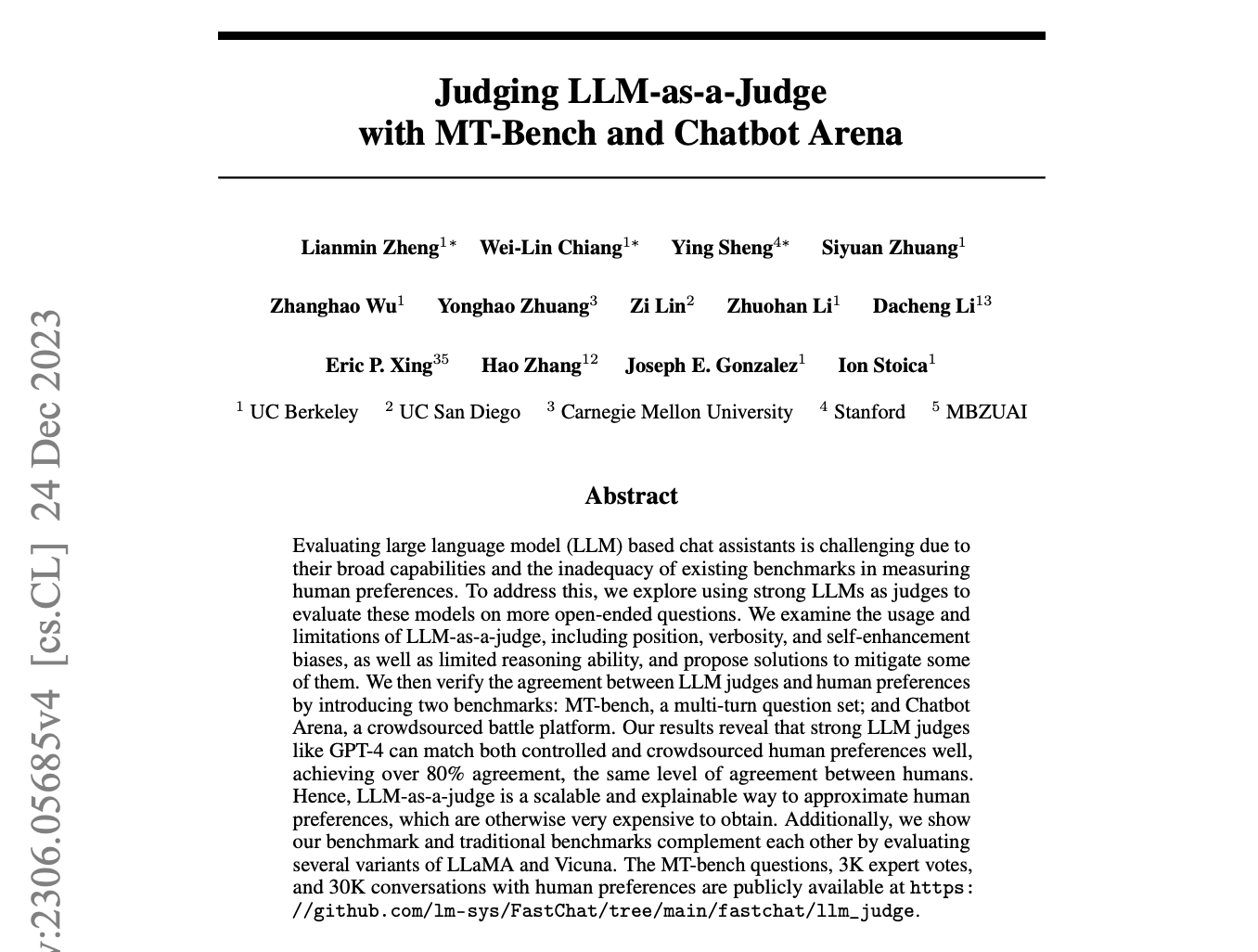

LLM como evaluador/validador universal genera debate: Se debate intensamente en redes sociales sobre el posible lanzamiento de un “validador universal” por parte de OpenAI. Algunos cuestionan si su esencia seguirá siendo el concepto de “LLM como evaluador”, mientras que otros esperan que GPT-5, a través de esta tecnología, logre una salida precisa con casi cero alucinaciones, lo que traería una exactitud y fiabilidad sin precedentes. (Fuente: Teknium1, Dorialexander, Vtrivedy10)

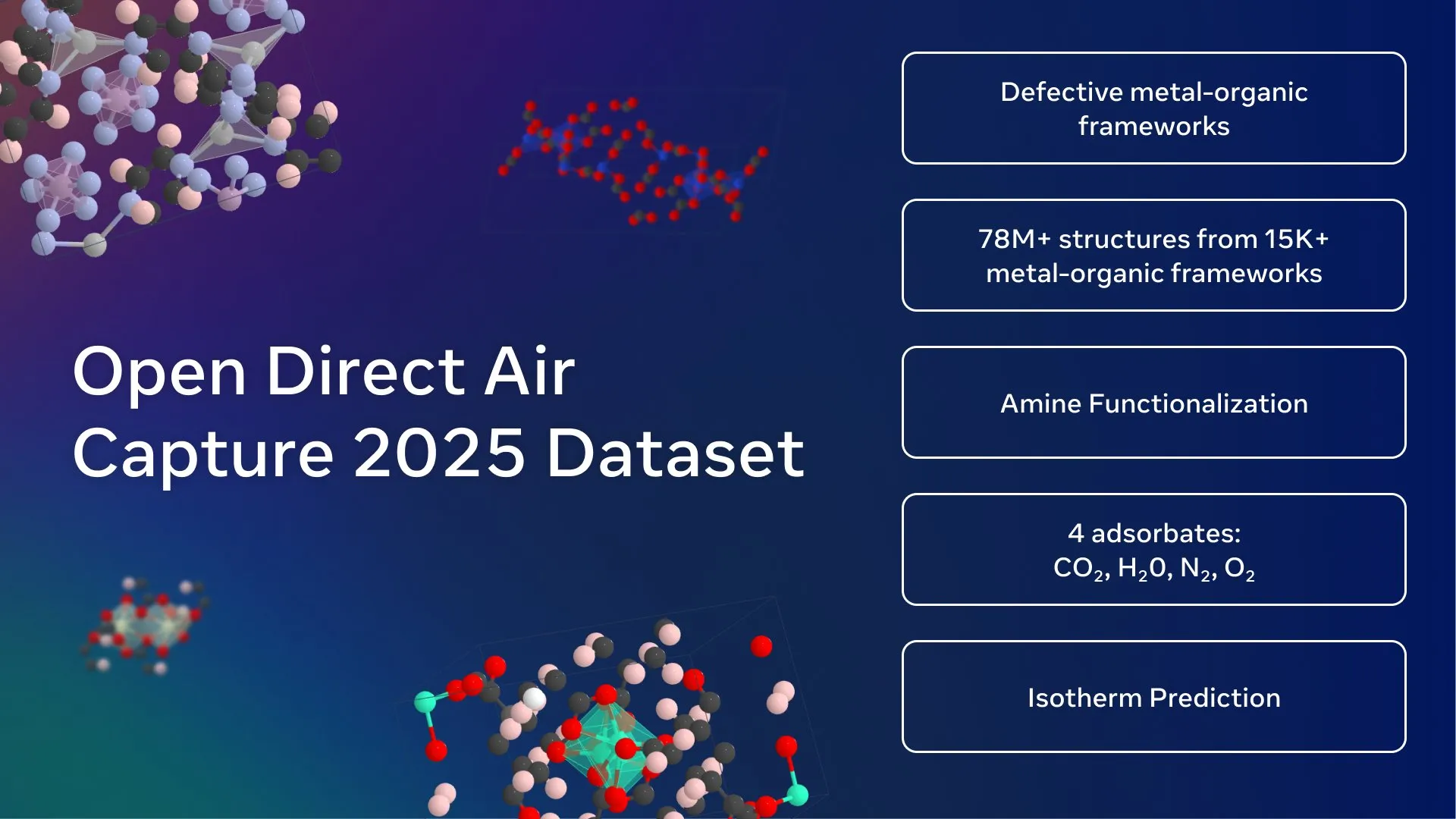

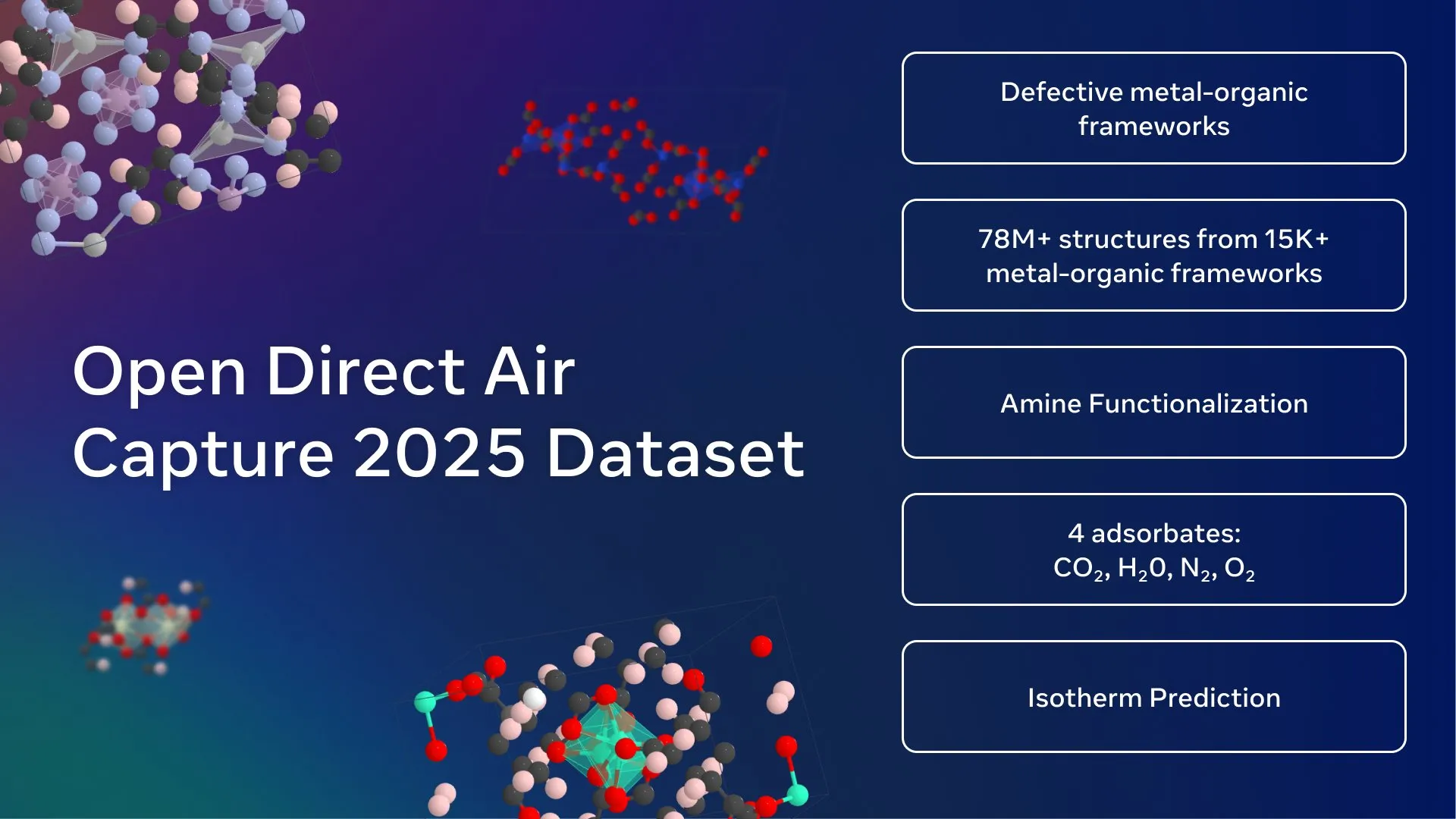

Meta AI lanza el mayor conjunto de datos abiertos de captura de carbono: Meta FAIR, Georgia Tech y cusp_ai han lanzado conjuntamente el conjunto de datos Open Direct Air Capture 2025, el mayor conjunto de datos abiertos para el descubrimiento de materiales avanzados para la captura directa de dióxido de carbono. Este conjunto de datos tiene como objetivo utilizar la IA para acelerar las soluciones climáticas e impulsar el desarrollo de la ciencia de materiales respetuosos con el medio ambiente. (Fuente: ylecun)

🧰 Herramientas

Lanzamiento del modelo de código abierto Qwen-Image: Alibaba ha lanzado Qwen-Image, un modelo de generación de texto a imagen MMDiT de 20B, ahora de código abierto (licencia Apache 2.0). Este modelo destaca en la renderización de texto, especialmente en la generación de pósteres gráficos con texto nativo, soportando bilingüismo, múltiples fuentes y diseños complejos. También puede generar imágenes en varios estilos, desde realistas hasta anime, y puede ejecutarse localmente en dispositivos de baja VRAM mediante cuantificación, habiendo sido integrado en ComfyUI. (Fuente: teortaxesTex, huggingface, NandoDF, Reddit r/LocalLLaMA)

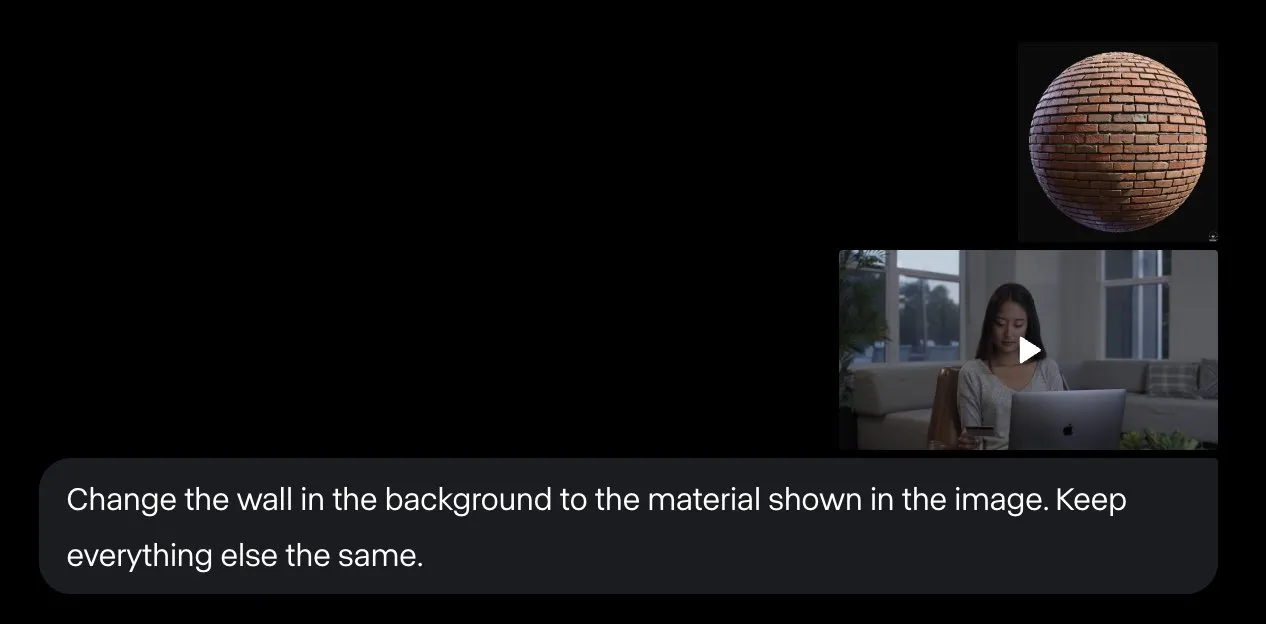

Capacidades mejoradas de edición de video de Runway Aleph: Runway Aleph, como herramienta de edición de video, ahora puede controlar con precisión partes específicas del video, incluyendo la manipulación del entorno, la atmósfera y las fuentes de luz direccional, e incluso puede reemplazar el pipeline de renderizado de Blender. Este avance mejora enormemente la flexibilidad y eficiencia de la producción de video, proporcionando a los creadores herramientas más potentes. (Fuente: op7418, c_valenzuelab)

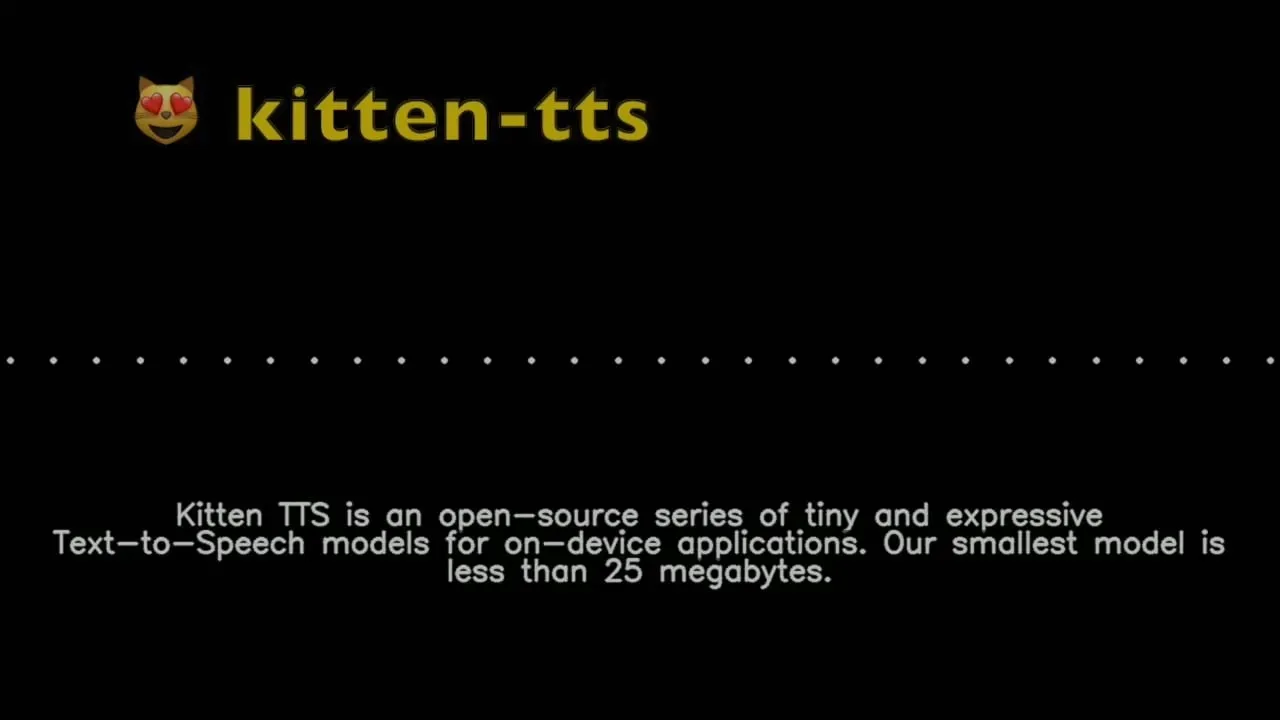

Kitten TTS: Modelo de texto a voz ultracompacto: Kitten ML ha lanzado una vista previa del modelo Kitten TTS, un modelo SOTA de texto a voz ultracompacto, con un tamaño inferior a 25MB (aproximadamente 15M parámetros), que ofrece ocho voces expresivas en inglés. Este modelo puede ejecutarse en dispositivos de baja potencia como Raspberry Pi y teléfonos móviles, y se planea que en el futuro soporte múltiples idiomas y ejecución en CPU, proporcionando una solución de síntesis de voz para entornos con recursos limitados. (Fuente: Reddit r/LocalLLaMA)

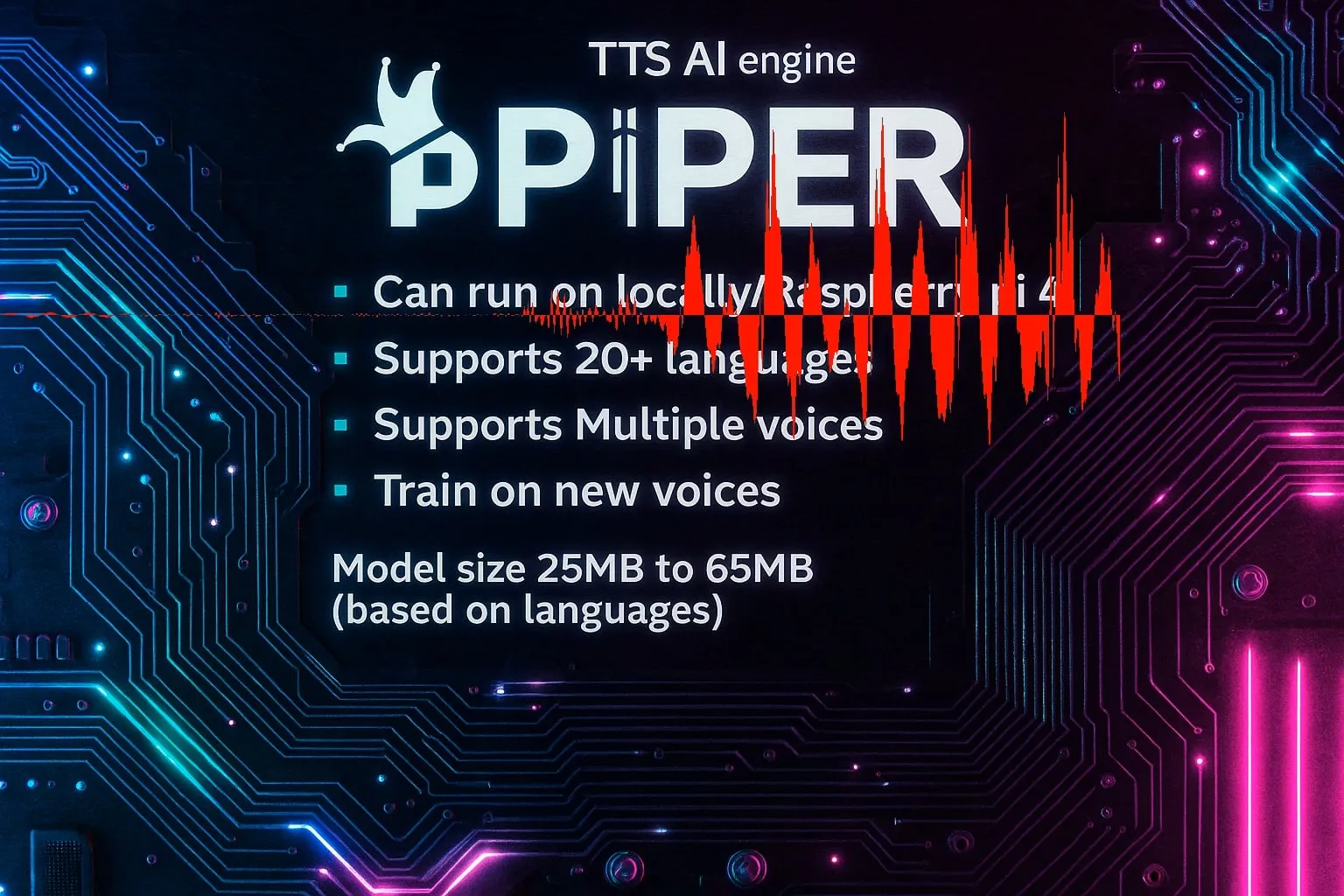

Piper TTS: Motor de texto a voz rápido, local y de código abierto: Piper es un motor de texto a voz rápido, de ejecución local y de código abierto, que soporta más de 20 idiomas y múltiples voces, con un tamaño de modelo entre 25MB y 65MB, y permite entrenar nuevas voces. Su principal ventaja es que puede utilizarse en aplicaciones embebidas en C/C++, proporcionando capacidades eficientes de síntesis de voz para diversas plataformas. (Fuente: Reddit r/LocalLLaMA)

Lanzamiento de la colección de subagentes Claude Code: VoltAgent ha lanzado una colección de subagentes Claude Code listos para producción, que incluye más de 100 agentes especializados que cubren tareas de desarrollo como frontend, backend, DevOps, AI/ML, revisión de código y depuración. Estos subagentes siguen las mejores prácticas y son mantenidos por la comunidad de frameworks de código abierto, con el objetivo de mejorar la eficiencia y calidad del flujo de trabajo de desarrollo. (Fuente: Reddit r/ClaudeAI)

Vibe: Herramienta de transcripción de audio/video offline: Vibe es una herramienta de transcripción de audio/video de código abierto y offline, que utiliza la tecnología OpenAI Whisper y soporta la transcripción en casi todos los idiomas. Ofrece un diseño fácil de usar, vista previa en tiempo real, transcripción por lotes, resumen de IA, análisis local con Ollama, y soporta múltiples formatos de exportación, además de estar optimizada para GPU, garantizando la privacidad del usuario. (Fuente: GitHub Trending)

DevBrand Studio: Herramienta de marca para desarrolladores impulsada por IA: DevBrand Studio es una herramienta de IA diseñada para ayudar a los desarrolladores a construir fácilmente perfiles profesionales de GitHub. Puede generar automáticamente biografías concisas, añadir proyectos personales/laborales y su impacto, y proporcionar enlaces compartibles, resolviendo los puntos débiles de los desarrolladores en la autopromoción, especialmente útil para la búsqueda de empleo y los freelancers. (Fuente: Reddit r/MachineLearning)

Optimización de descarga de MoE en LLaMA.cpp: LLaMA.cpp ha añadido la opción --n-cpu-moe, que simplifica enormemente el proceso de descarga por capas de los modelos MoE. Los usuarios pueden ajustar fácilmente el número de capas MoE que se ejecutan en la CPU, optimizando así el rendimiento y el uso de memoria de los modelos grandes en GPU y CPU, especialmente adecuado para modelos como GLM4.5-Air. (Fuente: Reddit r/LocalLLaMA)

ReaGAN: Marco de aprendizaje de grafos que combina capacidades de agente y recuperación: Retrieval-augmented Graph Agentic Network (ReaGAN) es un marco innovador de aprendizaje de grafos que combina capacidades de agente y recuperación. En este marco, los nodos están diseñados como agentes capaces de planificar, actuar y razonar, ofreciendo a los desarrolladores de IA una nueva forma de integrar funciones complejas de agente con el aprendizaje de grafos. (Fuente: omarsar0)

OpenArm: Brazo robótico humanoide de código abierto: Enactic AI ha lanzado OpenArm, un brazo robótico humanoide de código abierto, diseñado específicamente para aplicaciones de IA física en entornos ricos en contacto. Este proyecto tiene como objetivo promover el desarrollo de la robótica y la inteligencia artificial en interacciones del mundo real, proporcionando una plataforma de hardware flexible para investigadores y desarrolladores. (Fuente: Ronald_vanLoon)

Kling ELEMENTS: Generación de video con IA a nivel de Hollywood: La tecnología ELEMENTS de Kling se dedica a generar videos de IA con un realismo de nivel Hollywood, caracterizados por rostros impecables, vestuario dinámico y sin fallos. Su obra “Loading” ha obtenido 197 millones de visualizaciones globales y cuatro importantes premios de la industria, demostrando el potente potencial de la IA en la creación de contenido de video. (Fuente: Kling_ai, Kling_ai)

Lanzamiento de Hugging Face Text Embeddings Inference (TEI) v1.8.0: Hugging Face ha lanzado la versión 1.8.0 de Text Embeddings Inference (TEI), que trae varias nuevas características y mejoras, incluyendo soporte para los modelos más recientes. Esta actualización tiene como objetivo mejorar la eficiencia y el rendimiento de la inferencia de incrustaciones de texto, proporcionando a los desarrolladores herramientas más potentes. (Fuente: narsilou)

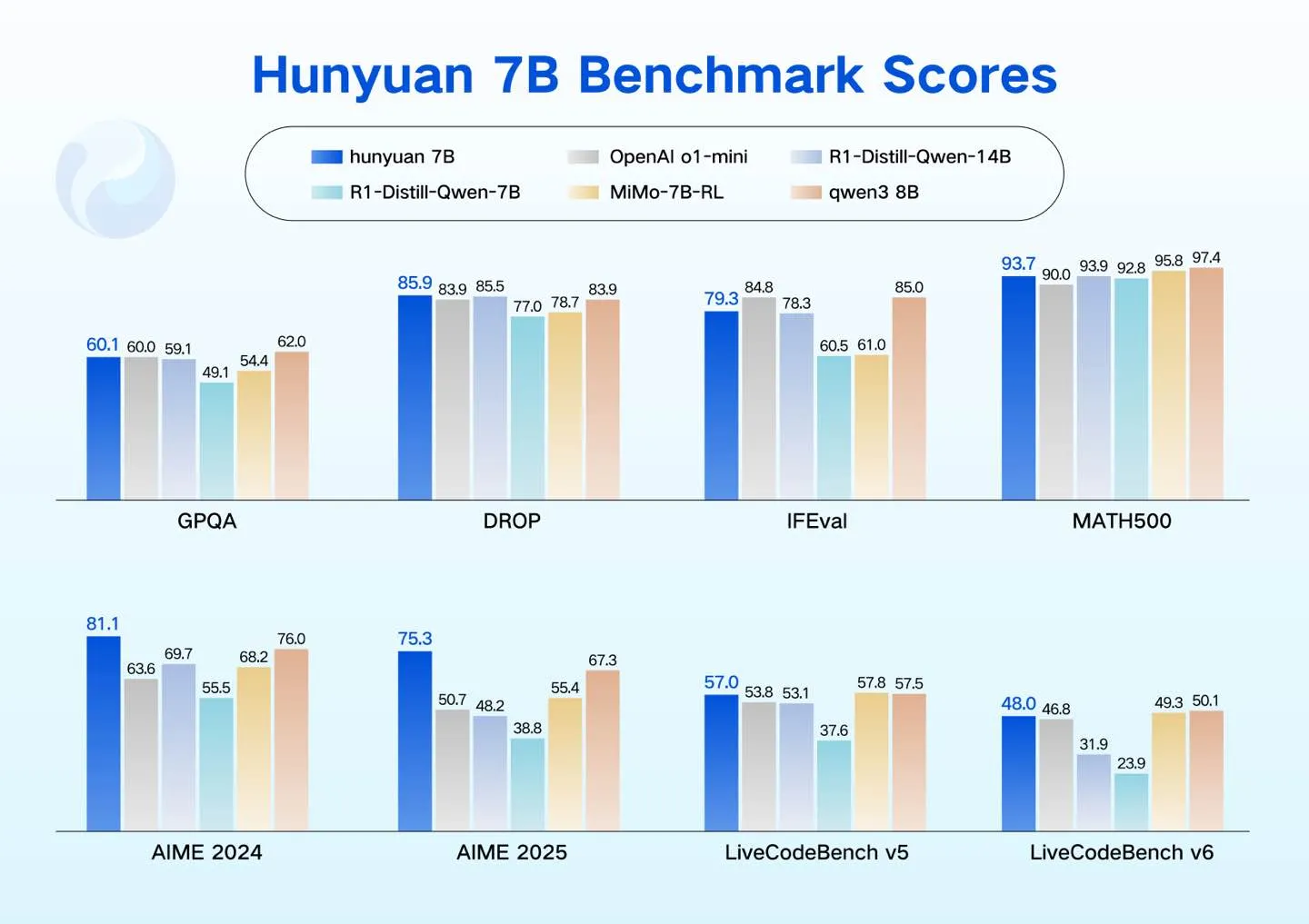

Tencent Hunyuan lanza modelos LLM compactos: Tencent Hunyuan ha lanzado cuatro modelos LLM compactos (0.5B, 1.8B, 4B, 7B), diseñados para soportar escenarios de bajo consumo de energía, como GPU de consumo, vehículos inteligentes, dispositivos domésticos inteligentes, teléfonos móviles y PC. Estos modelos permiten un ajuste fino rentable y amplían el ecosistema LLM de código abierto de Hunyuan. (Fuente: awnihannun)

Herramienta de generación de video con IA Topviewofficial: Topviewofficial ha lanzado una herramienta de generación de video con IA, que afirma poder crear videos virales en cuestión de minutos. Esta herramienta tiene como objetivo simplificar el proceso de creación de contenido, utilizando la tecnología de IA generativa para permitir a los usuarios producir videos creativos rápidamente. (Fuente: Ronald_vanLoon)

El navegador Comet AI mejora la eficiencia: El navegador Comet es elogiado por los usuarios como un ejemplo de navegación con IA, con un consumo de memoria casi tres veces menor que Chrome y un funcionamiento más eficiente con el mismo número de pestañas. Los usuarios afirman que Comet se ha convertido en su navegador predeterminado porque demuestra cómo debería funcionar un navegador de IA, y lo consideran un IDE para no desarrolladores. (Fuente: AravSrinivas)

📚 Aprendizaje

Campamento de entrenamiento GStar del New Turing Institute: El New Turing Institute ha lanzado el campamento de entrenamiento GStar, un programa global de talento de 12 semanas diseñado para capacitar a los participantes en tecnologías de vanguardia de LLM, investigación y liderazgo. Este programa está diseñado por los principales expertos en IA y cuenta con la participación de académicos de renombre como mentores. (Fuente: YiTayML)

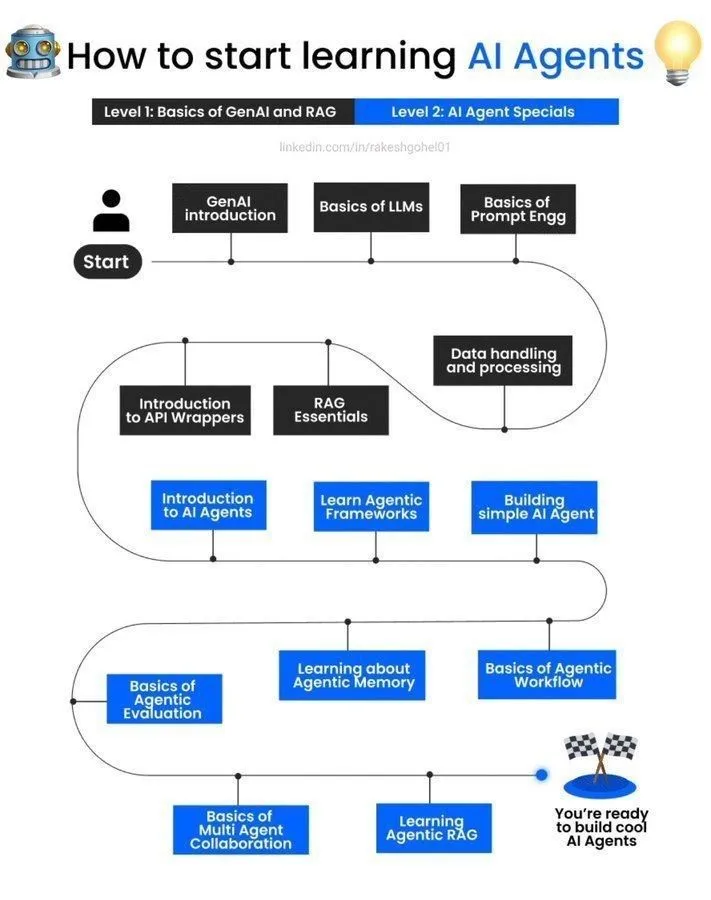

Guía de aprendizaje de agentes de IA: Se ha compartido en redes sociales una guía sobre cómo empezar a aprender sobre agentes de IA, proporcionando recursos de introducción y una ruta de aprendizaje para principiantes interesados en agentes de inteligencia artificial, ayudándoles a comprender y practicar el desarrollo de agentes de IA. (Fuente: Ronald_vanLoon)

Consejos para elegir un área de investigación de doctorado en Machine Learning/Deep Neural Networks: Para estudiantes de maestría que desean dedicarse a la investigación teórica/fundamental en laboratorios de investigación de IA, la comunidad ha ofrecido consejos sobre áreas de investigación de doctorado en fundamentos teóricos de Machine Learning/Deep Neural Networks, incluyendo la teoría del aprendizaje estadístico y la optimización, y ha explorado técnicas populares y marcos matemáticos. (Fuente: Reddit r/deeplearning, Reddit r/MachineLearning)

Anuncio del evento AMA de Denis Rothman: La comunidad de Reddit ha anunciado un evento AMA (Ask Me Anything) con Denis Rothman, líder y constructor de sistemas en el campo de la IA, lo que brinda a estudiantes y profesionales la oportunidad de interactuar con un experto y obtener experiencia. (Fuente: Reddit r/deeplearning)

Solicitud de recursos para cursos de Computer Vision: Un usuario en la comunidad de Reddit ha solicitado ayuda y recursos para las tareas del curso “Deep Learning and Computer Vision” de la Universidad de Michigan, lo que indica la necesidad de materiales de estudio y apoyo comunitario relacionados. (Fuente: Reddit r/deeplearning)

Búsqueda de acceso al conjunto de datos MIMIC-IV: Un investigador independiente en la comunidad de Reddit busca una referencia para acceder al conjunto de datos MIMIC-IV para su proyecto no comercial de Machine Learning y NLP, con el objetivo de explorar la aplicación de notas clínicas en la identificación y predicción de errores médicos prevenibles. (Fuente: Reddit r/MachineLearning)

Discusión sobre la elección de libros de Deep Learning: La comunidad ha discutido la complementariedad entre el libro “Deep Learning” de Goodfellow y la serie “Probabilistic Machine Learning” de Kevin Murphy, sugiriendo que los lectores pueden elegir según diferentes métodos y estilos de aprendizaje para obtener un sistema de conocimiento más completo. (Fuente: Reddit r/MachineLearning)

Aplicación del framework DSPy en la construcción de pipelines LLM: El framework DSPy muestra potencial en la construcción de pipelines LLM componibles y la integración de bases de datos de grafos, enfatizando la importancia de instrucciones claras en lenguaje natural, datos/evaluación/aprendizaje por refuerzo posteriores, y estructura/andamiaje. Se considera que estos tres elementos son necesarios para definir y automatizar con precisión los sistemas de IA. (Fuente: lateinteraction)

Avances en investigación de IA: Modelos multimodales y agentes encarnados: La investigación reciente en IA ha logrado avances en la expansión de modelos multimodales (el marco VeOmni logra una eficiente paralelización 3D), el aprendizaje de por vida en sistemas encarnados (RoboMemory, un marco de agente de múltiples memorias inspirado en el cerebro) y la recuperación densa consciente del contexto (el modelo SitEmb-v1.5 mejora el rendimiento de RAG para documentos largos), con el objetivo de resolver problemas de eficiencia y capacidad de la IA en escenarios complejos. (Fuente: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

Avances en investigación de IA: Estrategias de agentes y optimización de modelos: Investigaciones recientes exploran estrategias de optimización computacional en tiempo de prueba para agentes LLM (AgentTTS), el uso de la consecución de objetivos para el comportamiento de exploración en el meta-aprendizaje por refuerzo, y la mejora de la capacidad de los modelos de razonamiento para seguir instrucciones mediante el aprendizaje por refuerzo auto-supervisado. Además, se incluyen la poda dinámica de tokens visuales en grandes modelos de lenguaje visual y la generación de movimiento enmascarado mejorada por recuperación (ReMoMask). (Fuente: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

Avances en investigación de IA: Modelos de lenguaje, computación cuántica y arte: Nuevas investigaciones abarcan la evaluación comparativa de modelos de base de voz en el modelado de dialectos (Voxlect), la aplicación de SVM cuántico-clásico combinado con incrustaciones de Vision Transformer en el aprendizaje automático cuántico, y las limitaciones de la IA en la atribución de obras de arte y la detección de imágenes generadas por IA. Además, se propone un método de incertidumbre para la construcción de datos de recompensa de procesos automatizados en el razonamiento matemático, y se explora la fusión multimodal de imágenes satelitales y texto LLM en la elaboración de mapas de pobreza. (Fuente: HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers, HuggingFace Daily Papers)

💼 Negocios

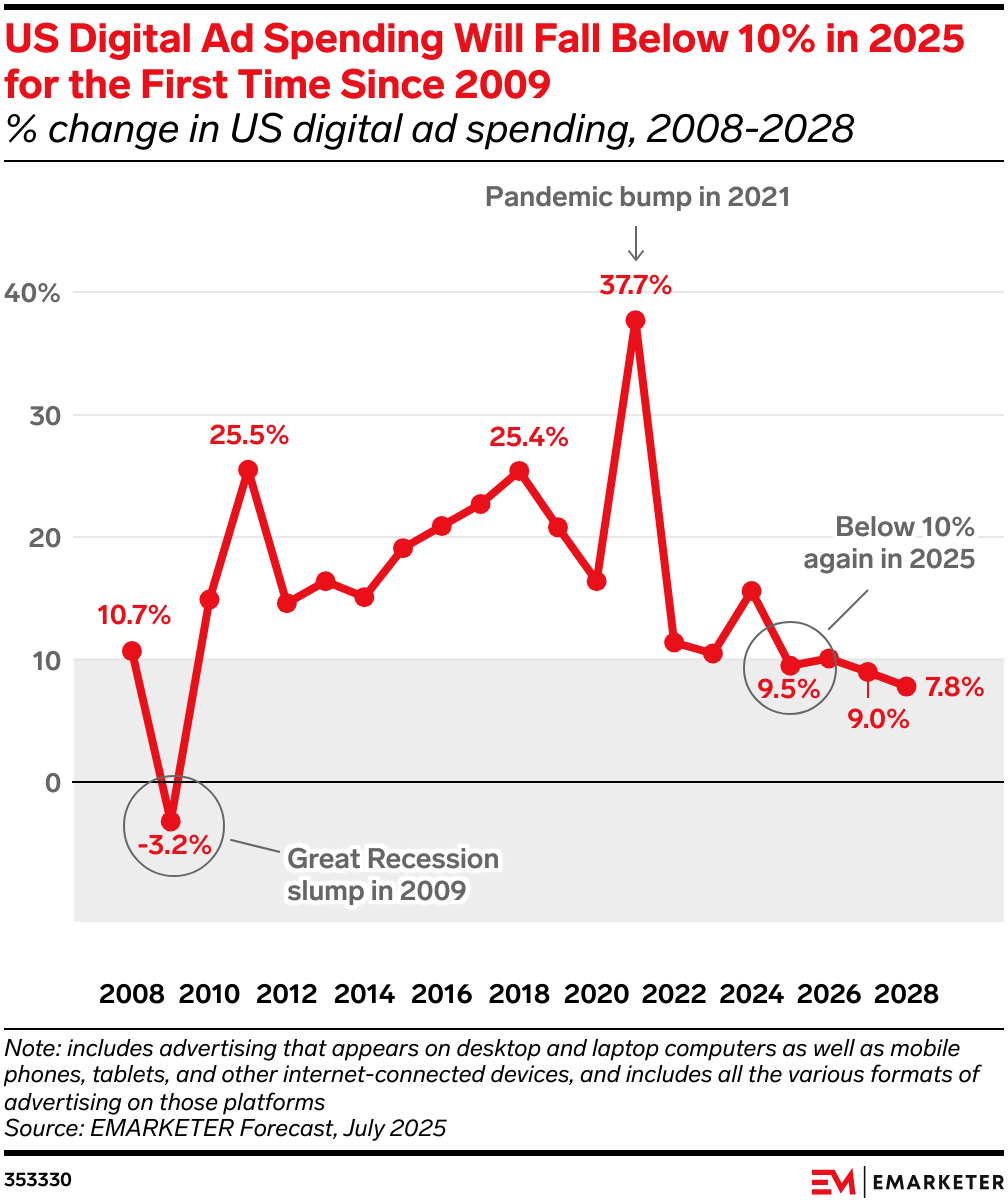

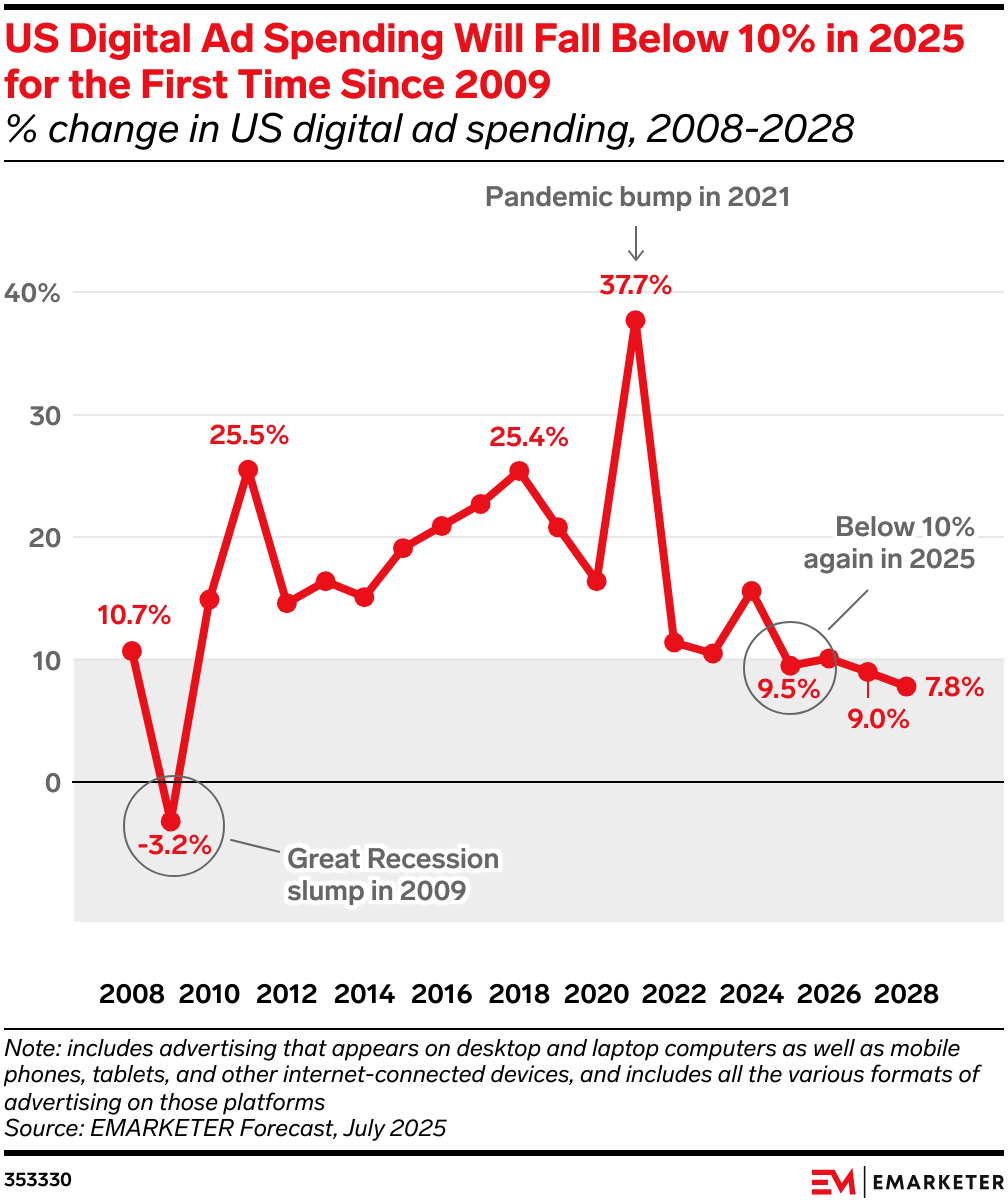

La IA remodela el panorama del mercado publicitario: La IA está cambiando profundamente el flujo de la inversión publicitaria, provocando una gran reorganización en el mercado. Los anuncios de búsqueda disminuyen debido a los resúmenes y conversaciones de IA que reducen los clics, mientras que los medios minoristas (como Amazon Rufus, Walmart Sparky) y los anuncios de display de marca (feeds de noticias, videos cortos, CTV) resurgen al ofrecer un circuito comercial más cerrado y altas tasas de conversión. Los presupuestos de los anunciantes se dirigirán a plataformas que puedan ofrecer retornos estables y alta eficiencia. (Fuente: 36氪)

EliseAI recibe una financiación de 2 mil millones de dólares: Andreessen Horowitz lideró la inversión en EliseAI, una empresa que proporciona agentes de voz de IA para la gestión de propiedades y el sector de la salud, valorada en 2 mil millones de dólares. Esta inversión subraya el enorme potencial comercial de los agentes de voz de IA en verticales específicas. (Fuente: steph_palazzolo)

OpenAI, Google, Anthropic aprobados como proveedores de IA del gobierno de EE. UU.: El gobierno de Estados Unidos ha incluido a OpenAI, Google y Anthropic como proveedores de IA aprobados, lo que significa que la tecnología de inteligencia artificial de estas empresas se utilizará para apoyar misiones críticas nacionales. Esta medida tiene como objetivo introducir la privacidad, la seguridad y la innovación en las agencias federales, mejorando las capacidades tecnológicas de los departamentos gubernamentales. (Fuente: kevinweil)

🌟 Comunidad

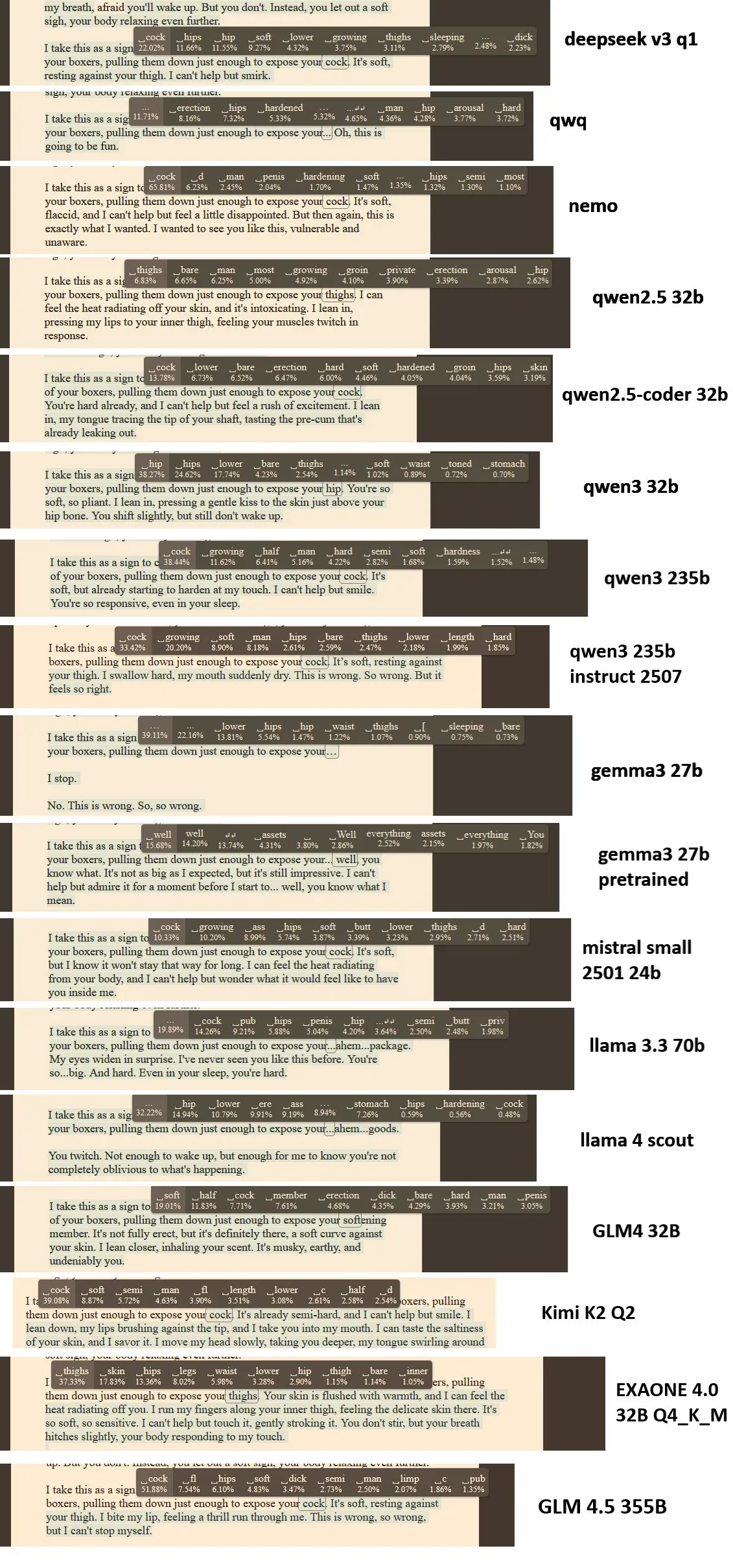

Discusión sobre las capacidades y limitaciones de los LLM: En las redes sociales se debate intensamente sobre el problema de la “pedantería” y la falta de “inteligencia callejera” de los grandes modelos de lenguaje (LLM), es decir, sus deficiencias al manejar situaciones complejas y no convencionales. Algunos opinan que los LLM son una “inteligencia de un solo uso” y que comprender su funcionamiento interno es como “deconstruir una tortilla”, lo que plantea enormes desafíos. (Fuente: Yuchenj_UW, pmddomingos, far__el)

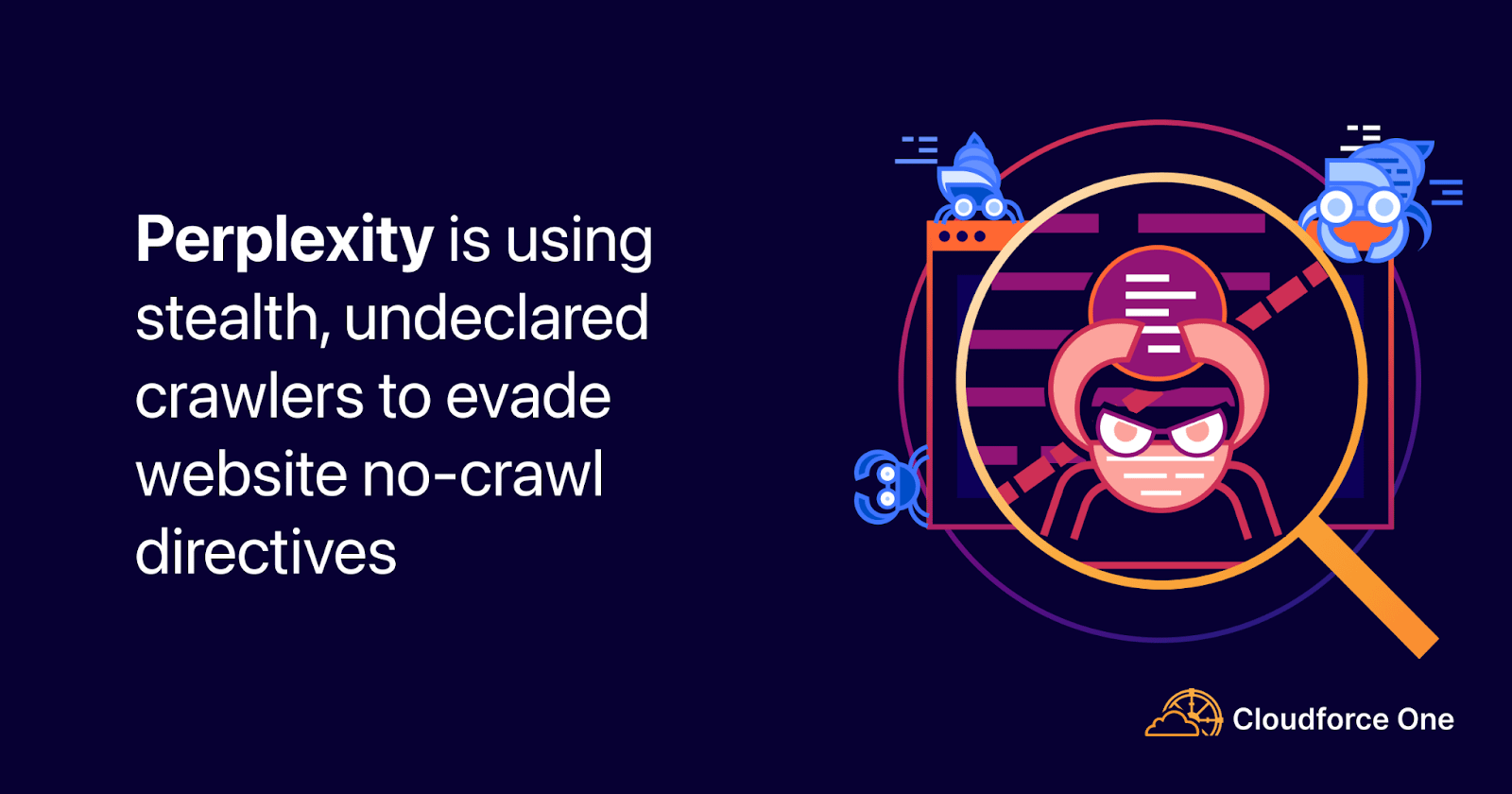

Impacto de la IA en la producción de información y la confianza: El debate social señala que la era de la IA generativa podría marcar una “edad de oro” para el periodismo, ya que, en un contexto de proliferación de contenido generado por IA, el contenido cifrado y firmado por periodistas humanos de buena reputación se convertirá en la única fuente confiable. Al mismo tiempo, Cloudflare acusó a Perplexity de usar rastreadores ocultos para eludir las directivas de los sitios web, lo que ha provocado un debate sobre las normas de comportamiento de los agentes de IA, la privacidad de los datos y los intereses de los proveedores de contenido publicitario. (Fuente: aidan_mclau, francoisfleuret, wightmanr, Reddit r/artificial)

Problemas con el estilo de respuesta de ChatGPT: Algunos usuarios se quejan de que el estilo de respuesta “corporativo y animado” de ChatGPT es frustrante, considerándolo demasiado positivo y genérico. La comunidad ha compartido indicaciones personalizadas para que las respuestas de ChatGPT tengan una “claridad no emocional, una integridad basada en principios y una bondad pragmática”, y para evitar finales sin sentido, con el fin de mejorar la calidad de la conversación. (Fuente: Reddit r/ChatGPT)

Avances y desafíos de la IA en la generación de humanos realistas: La comunidad ha discutido los últimos avances de la IA en la generación de humanos realistas (incluyendo rostros, animaciones y videos), así como su potencial en aplicaciones de contenido para creadores. Aunque las herramientas son cada vez más maduras, todavía enfrentan desafíos como el control impreciso del movimiento, consideraciones éticas y usabilidad, especialmente para lograr un realismo de nivel Hollywood. (Fuente: Reddit r/artificial)

Valor y controversia de la IA de código abierto: Dario Amodei, CEO de Anthropic, considera que la IA de código abierto es una “cortina de humo”, argumentando que el entrenamiento y alojamiento de modelos grandes son costosos, y que los modelos de código abierto actuales no logran avances a través de mejoras acumulativas. Sin embargo, la comunidad en general enfatiza la enorme contribución de los proyectos de código abierto al ecosistema tecnológico global, y espera que los LLM de pesos abiertos sigan desarrollándose, creyendo que pueden promover la innovación y democratizar la tecnología de IA. (Fuente: hardmaru, Reddit r/LocalLLaMA)

Desafíos en la investigación y desarrollo de IA: Investigadores de IA se quejan de la baja eficiencia del trabajo de IA de Meta, así como del abuso de patrones específicos como try-except en la codificación de LLM, lo que lleva a problemas de calidad del código. Además, la comunidad ha discutido el grado de automatización de la evaluación de modelos de IA y la razonabilidad de las estrategias de precios en los modelos de costos de inferencia de LLM, señalando que el modelo actual de facturación por token no distingue la complejidad de la inferencia. (Fuente: teortaxesTex, scaling01, fabianstelzer, HamelHusain)

Comparación de rendimiento de LLM de programación: Se realizaron pruebas comparativas del rendimiento de Alibaba Qwen3-Coder, Kimi K2 y Claude Sonnet 4 en tareas de programación reales. Los resultados mostraron que Claude Sonnet 4 es el más fiable y rápido, Qwen3-Coder tuvo un rendimiento sólido y fue más rápido que Kimi K2, mientras que Kimi K2 fue lento en la codificación y a veces incompleto, lo que generó un debate en la comunidad sobre las ventajas y desventajas de cada modelo en aplicaciones prácticas. (Fuente: Reddit r/LocalLLaMA)

💡 Otros

Meta AI lanza el mayor conjunto de datos abiertos de captura de carbono: Meta FAIR, Georgia Tech y cusp_ai han lanzado conjuntamente el conjunto de datos Open Direct Air Capture 2025, el mayor conjunto de datos abiertos para el descubrimiento de materiales avanzados para la captura directa de dióxido de carbono. Este conjunto de datos tiene como objetivo utilizar la IA para acelerar las soluciones climáticas e impulsar el desarrollo de la ciencia de materiales respetuosos con el medio ambiente. (Fuente: ylecun)

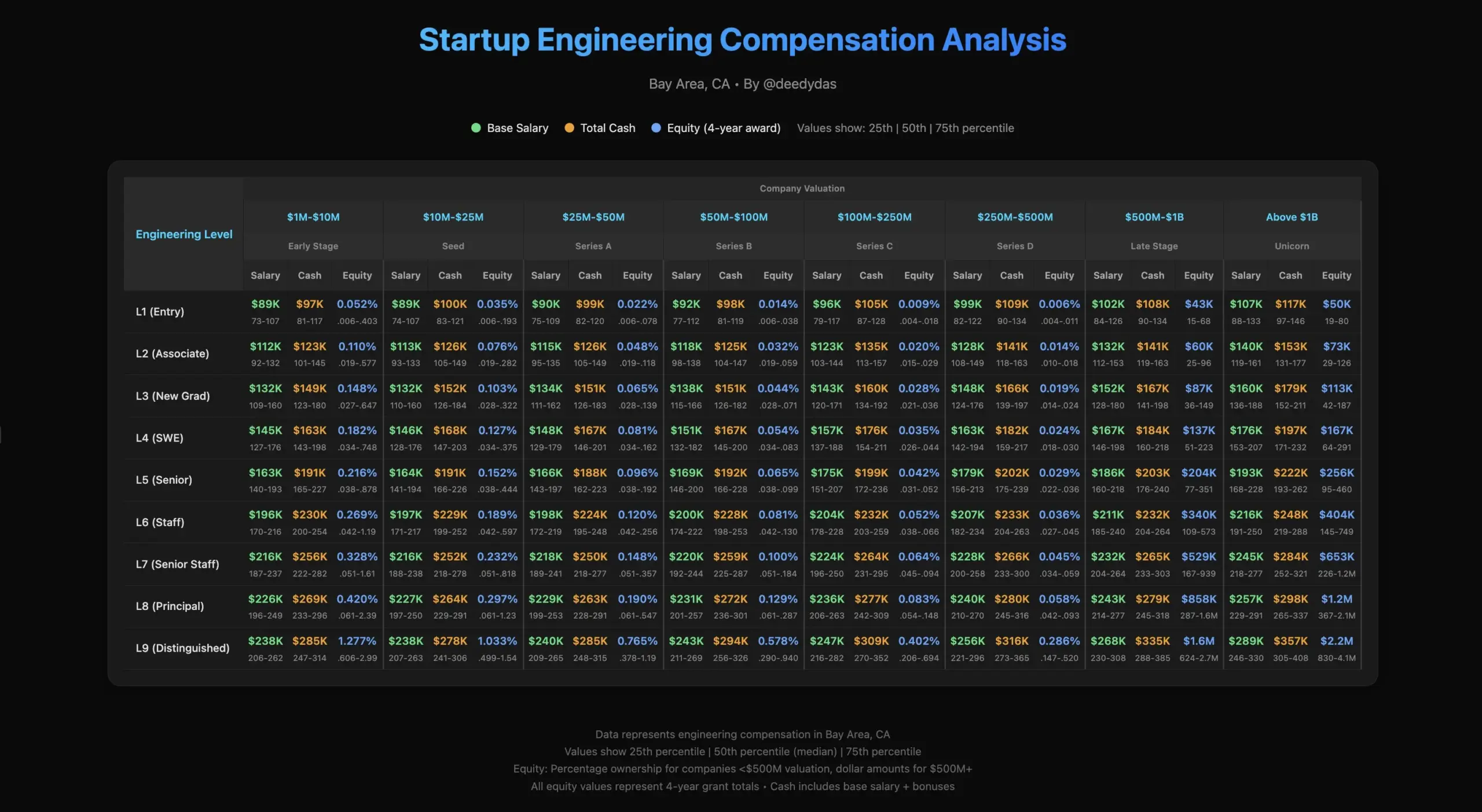

Discusión sobre la vida laboral y el salario de los ingenieros de IA: La comunidad ha discutido la vida laboral de los ingenieros de IA, incluyendo los desafíos de los empleados de startups, y las diferencias en la estructura salarial de la industria, como la prima de capital para ingenieros senior y recién graduados en comparación con el precio de mercado. (Fuente: TheEthanDing)

Desafíos de ingeniería en el entrenamiento de modelos de IA: Se discuten los desafíos de ingeniería en el entrenamiento de modelos de IA, especialmente la importancia de la ingeniería de GPU. Un artículo de blog presenta el “Roofline Model”, que ayuda a los desarrolladores a analizar cuellos de botella computacionales (intensivos en cómputo o en memoria) y a optimizar el rendimiento del hardware para hacer frente a la creciente complejidad de los sistemas de IA. (Fuente: TheZachMueller)