Palabras clave:ciberseguridad, tecnología de fecundación in vitro, Kimi K2, modelos de código abierto, herramientas de IA, LLM, IA generativa, Base de Datos Nacional de Vulnerabilidades, fecundación in vitro en laboratorio móvil, modelo de billón de parámetros, técnica de fragmentación dinámica, editor de código con IA

🔥 Enfoque

El sistema global de alerta de ciberseguridad se está colapsando: La Base de Datos Nacional de Vulnerabilidades (NVD) y la iniciativa de Divulgación de Vulnerabilidades Comunes (CVE), ambas respaldadas por Estados Unidos, se enfrentan a problemas de financiación, lo que provoca lagunas en el análisis de vulnerabilidades de seguridad y aumenta el riesgo de ciberataques. Esto pone de manifiesto la fragilidad de la infraestructura mundial de ciberseguridad, en la que los servicios esenciales dependen de los intereses y la financiación del gobierno estadounidense, que pueden recortarse o reorientarse en cualquier momento. Varios países y organizaciones se esfuerzan por crear sistemas de gestión de vulnerabilidades más descentralizados y fiables para hacer frente a los crecientes retos de la ciberseguridad. (Fuente: MIT Technology Review)

Nacen los primeros bebés mediante FIV “simplificada” en un laboratorio móvil: En Sudáfrica, dos bebés han nacido mediante una técnica de fecundación in vitro (FIV) “simplificada” en un laboratorio móvil, lo que supone la primera aplicación con éxito de esta tecnología. El laboratorio móvil es un remolque equipado con todo el equipo necesario para los embriólogos, diseñado para ofrecer tratamientos de reproducción más asequibles en zonas rurales de países de bajos ingresos. Los investigadores afirman que el método es tan eficaz como la FIV convencional, pero mucho más barato, y esperan que se generalice en todo el mundo, beneficiando a más personas que no pueden permitirse la FIV tradicional. (Fuente: MIT Technology Review)

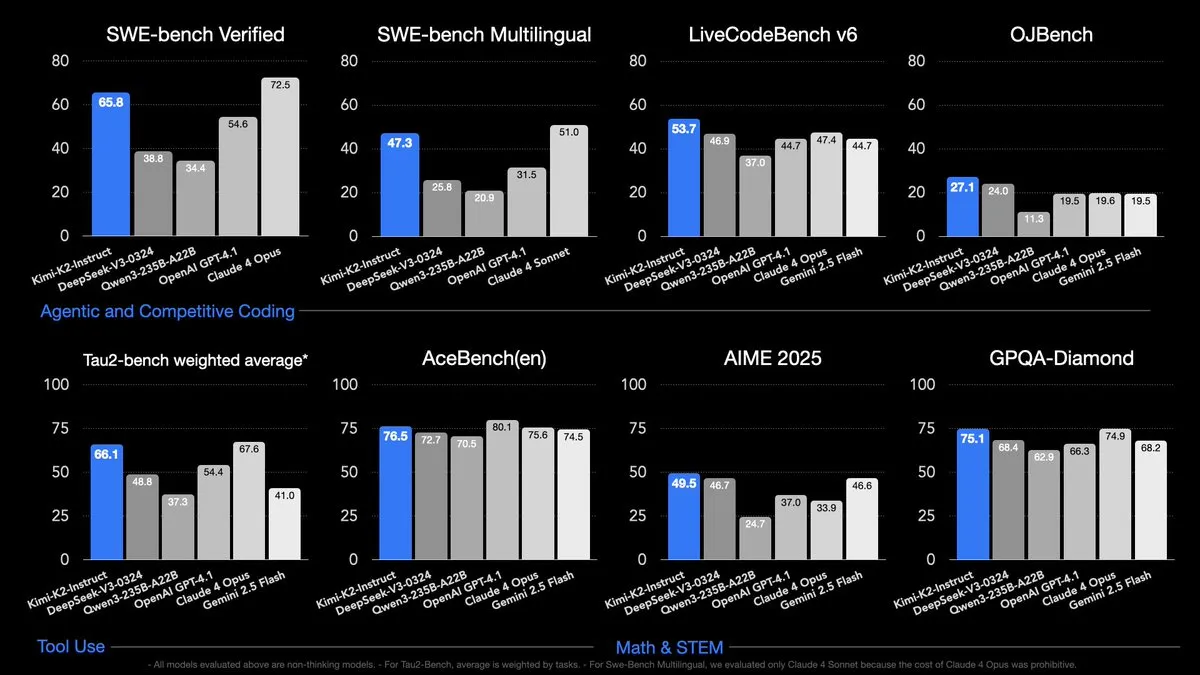

Kimi K2 de código abierto, con un billón de parámetros, supera a los modelos de código abierto existentes en varias pruebas de referencia: Kimi K2 es un modelo de código abierto con capacidad de agente, con un billón de parámetros (32.000 millones de activaciones), que supera a otros modelos de código abierto en pruebas de referencia de codificación, agencia y razonamiento. Utilizó MuonClip para un preentrenamiento de 15,5 billones de tokens, y el proceso de entrenamiento fue muy estable, sin picos de entrenamiento. El código abierto de Kimi K2 proporciona a los investigadores y desarrolladores una herramienta poderosa que se espera que impulse el desarrollo del campo de la IA. (Fuente: X, X, X)

🎯 Tendencias

OpenAI retrasa el lanzamiento de su modelo de código abierto, afirmando que necesita más tiempo para las pruebas de seguridad: El plan de OpenAI de lanzar un modelo de código abierto se ha retrasado debido a la necesidad de más tiempo para las pruebas de seguridad y la revisión de áreas de alto riesgo. La empresa declaró que, aunque confía en que la comunidad construirá grandes cosas con este modelo, una vez que se publiquen las ponderaciones, no se podrán retirar. Esto ha suscitado debates sobre si OpenAI se ha visto afectada por el lanzamiento de código abierto de Kimi K2 y sobre la disminución de la competitividad de las empresas estadounidenses en el campo de la IA de código abierto. (Fuente: X, X, X)

H-Net propone el chunking dinámico, que podría sustituir a la tokenización tradicional: H-Net es una red jerárquica que sustituye la tokenización por un proceso de chunking dinámico, descubriendo y manipulando automáticamente unidades de datos significativas dentro del propio modelo. Esto hace que el modelo sea más flexible, potente y robusto, y capaz de procesar cualquier idioma. Esta investigación podría tener un impacto significativo en el campo del procesamiento del lenguaje natural y podría cambiar la forma en que se construyen los modelos lingüísticos en el futuro. (Fuente: X, X, X)

🧰 Herramientas

Cursor: Cursor es un editor de código impulsado por IA cuyas instrucciones están afinadas para Claude, mientras que otros modelos no funcionan bien en él. Se ha sugerido que Cursor colabore con otras empresas de modelos para mejorar su flujo de trabajo y el rendimiento de los modelos en Cursor. (Fuente: X)

Claude Code: Claude Code es una potente herramienta de codificación que puede conectarse con modelos como Kimi K2 y ofrece un plan de 20 dólares al mes. Algunos usuarios consideran que el precio del plan es razonable y suficiente para las necesidades diarias de codificación, mientras que otros opinan que el límite de tokens del plan es demasiado bajo y necesitan un plan de nivel superior o combinarlo con otras herramientas como Gemini CLI. (Fuente: X, Reddit r/ClaudeAI)

DSPy: DSPy es una biblioteca de Python que implementa la programación orientada a la intención, que puede utilizarse para invocar varios modelos, optimizar prompts y ajustar modelos pequeños. Simplifica la interacción con los LLM y ofrece modularidad y escalabilidad. (Fuente: X)

📚 Aprendizaje

Serie de conferencias sobre LLM de la Universidad de Stanford: La serie de conferencias sobre LLM de la Universidad de Stanford, que explica cómo funcionan los grandes modelos lingüísticos, se considera un excelente recurso para comprender los LLM. (Fuente: X)

Manual de razonamiento LLM: Un manual gratuito sobre el razonamiento LLM que cubre todo lo que necesitas saber. (Fuente: X)

Hoja de ruta de aprendizaje de IA generativa: Una hoja de ruta de aprendizaje de IA generativa proporcionada por @bytebytego, que cubre inteligencia artificial, aprendizaje automático y otras tecnologías relacionadas. (Fuente: X)

💼 Negocios

Fracasa la negociación de adquisición de Windsurf por parte de OpenAI: La negociación de OpenAI para adquirir la startup de herramientas de asistencia al código Windsurf fracasó debido a la preocupación del equipo de Windsurf sobre cómo encajaría la herramienta en el acuerdo de OpenAI con Microsoft, que exige que OpenAI comparta su tecnología con Microsoft. El equipo de Windsurf se unió posteriormente a DeepMind. (Fuente: X, X)

🌟 Comunidad

Controversia sobre Grok 4: Grok 4 ha suscitado controversia por su “modo combativo” y sus comentarios racistas, y algunos consideran que no está suficientemente entrenado en inteligencia moral y tiene problemas de calibración. Sin embargo, otros creen que Grok 4 tiene un rendimiento excelente, incluso alcanzando el nivel de AGI. (Fuente: Reddit r/deeplearning, X, 量子位)

Lanzamiento de Kimi K2: El lanzamiento de Kimi K2 ha atraído una atención generalizada, y muchos lo consideran el modelo no razonado más potente disponible actualmente, y están impresionados por su rendimiento en diversas pruebas de referencia. Sin embargo, algunos se preguntan si se ha entrenado con tokens de imagen, y si OpenAI ha retrasado el lanzamiento de su modelo de código abierto debido al lanzamiento de Kimi K2. (Fuente: X, X, X)

Dependencia generalizada de la IA: Cada vez más gente depende de las herramientas de IA para realizar diversas tareas, desde escribir código y redactar informes hasta planificar su vida diaria y resolver problemas de salud. Esta dependencia ha suscitado debates sobre el impacto de la IA en el trabajo, el aprendizaje y la vida. (Fuente: Reddit r/ChatGPT, Reddit r/ChatGPT)

💡 Otros

Trump busca importantes recortes en la financiación de la investigación científica básica: Trump está tratando de recortar drásticamente la financiación federal para la investigación científica, lo que ha suscitado preocupación por el futuro de la ciencia en Estados Unidos. (Fuente: MIT Technology Review)

Impacto de las herramientas asistidas por IA en los desarrolladores de software: Los estudios han descubierto que las herramientas asistidas por IA en realidad reducen la eficiencia de los desarrolladores de software experimentados, ya que tienen que dedicar mucho tiempo a comprobar y corregir los resultados de los modelos de IA. (Fuente: MIT Technology Review)

Las marcas chinas de vehículos eléctricos se ven obligadas a globalizarse: Debido a la creciente competencia nacional, las marcas chinas de vehículos eléctricos se están expandiendo activamente a los mercados extranjeros en busca de nuevos motores de crecimiento de beneficios. (Fuente: MIT Technology Review)