Palabras clave:Gemini 2.5 Pro, Kevin-32B, Agente de IA, Tecnología RAG, Gemini 2.5 Pro capacidad de codificación, Núcleos CUDA de Kevin-32B, Búsqueda Agéntica, Grafo de conocimiento GraphRAG, Fusión de IA con gemelos digitales, Géminis digital

好的,这是一份将中文AI资讯翻译为西班牙语的版本,遵循了您的所有要求:

🔥 Enfoque

Google lanza Gemini 2.5 Pro versión I/O : Google lanza Gemini 2.5 Pro versión I/O, mejorando significativamente sus capacidades de codificación, liderando los rankings de programación, visión y WebDev de LMArena, logrando que un solo modelo encabece los tres rankings por primera vez. La nueva versión mejora el desarrollo frontend y de UI, puede generar aplicaciones a partir de bocetos a mano alzada y ha solucionado problemas de llamada a funciones, mostrando el rápido progreso de Google en la capacidad de los modelos de IA. (Fuente: JeffDean, lmarena.ai, dotey)

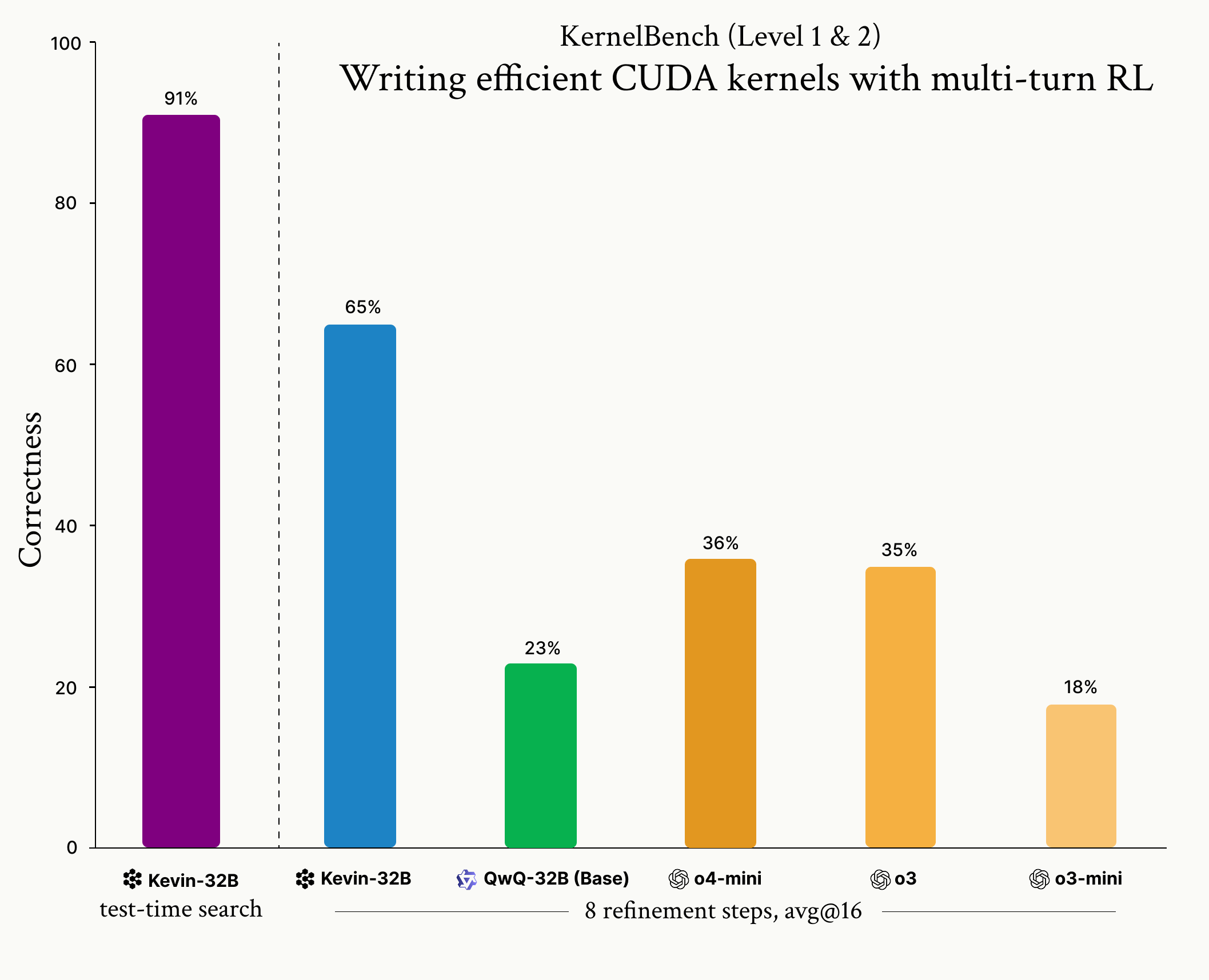

Cognition lanza el modelo Kevin-32B : Cognition lanza Kevin-32B, el primer modelo de código abierto entrenado mediante aprendizaje por refuerzo (algoritmo GRPO) para escribir CUDA kernels. El modelo destaca en el conjunto de datos KernelBench, superando a modelos de inferencia de primer nivel como o3 y o4-mini en corrección y rendimiento, demostrando el potencial de RL en la optimización de programación de bajo nivel. (Fuente: Cognition, Dorialexander, vllm_project)

Meta lanza Perception Encoder : Meta lanza su nuevo codificador visual Meta Perception Encoder, estableciendo un nuevo estándar en tareas de imagen y video. El modelo destaca en clasificación y recuperación zero-shot, superando a los modelos existentes y proporcionando una nueva y potente base para la investigación y aplicaciones de comprensión de imagen y video. (Fuente: AIatMeta)

Lanzamiento del modelo de generación de video de código abierto LTX-Video 13B : Se lanza LTX-Video 13B, uno de los modelos de generación de video de código abierto más potentes hasta la fecha. El modelo cuenta con 13 mil millones de parámetros, soporta renderizado multiescala para mejorar el detalle, mejora la comprensión del movimiento y la escena, puede ejecutarse en GPU locales y soporta control de keyframes, cámara y movimiento de personajes. (Fuente: teortaxesTex, Yoav HaCohen)

🎯 Tendencias

Anthropic LeMUR ahora compatible con nuevos modelos Claude : AssemblyAI anuncia que su capacidad LeMUR ahora es compatible con los modelos Claude 3.7 Sonnet y Claude 3.5 Haiku de Anthropic. Sonnet mejora la capacidad de inferencia para análisis de audio complejos, mientras que Haiku optimiza la velocidad de respuesta, aportando mejoras significativas para tareas como el análisis de contenido de audio y resúmenes de reuniones. (Fuente: AssemblyAI)

Nvidia y ServiceNow lanzan el modelo de IA empresarial Apriel Nemotron 15B : Nvidia y ServiceNow colaboran para lanzar Apriel Nemotron 15B, un modelo de IA empresarial compacto y rentable construido sobre Nvidia NeMo. El modelo está diseñado para proporcionar respuestas en tiempo real, procesar flujos de trabajo complejos y ser escalable en áreas como IT, HR y servicio al cliente. (Fuente: nvidia)

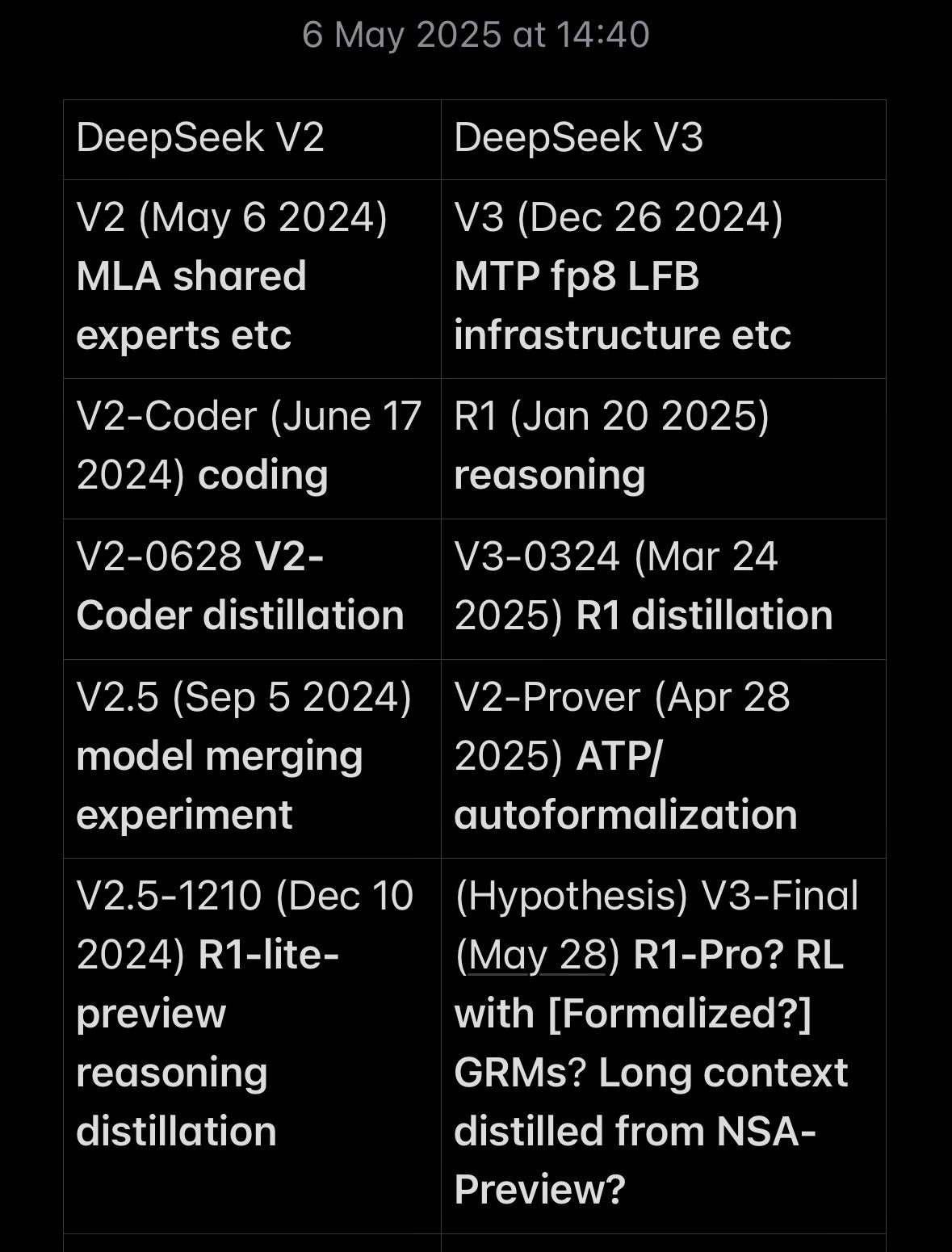

Actualizaciones del modelo DeepSeek y cronograma de desarrollo : Los modelos DeepSeek V3 y V3-0324, entre otros, continúan actualizándose, mostrando su progreso en capacidad de inferencia y nuevas funciones. La comunidad discute su cronograma y características, considerando que DeepSeek ha logrado avances significativos en la búsqueda de modelos de vanguardia a través de arquitecturas y métodos de entrenamiento innovadores. (Fuente: teortaxesTex, dylan522p)

GraphRAG y Agentic Search impulsan el desarrollo de la tecnología RAG : Cohere explora GraphRAG y Agentic Search como la próxima generación de tecnología RAG. GraphRAG mejora la precisión y fiabilidad a través de grafos de conocimiento, mientras que Agentic Search utiliza AI Agents para una búsqueda iterativa profunda, proporcionando respuestas más precisas y ricas en contexto para aplicaciones de IA a nivel empresarial. (Fuente: cohere)

Concepto de AI Agent en auge y desafíos de implementación : Instituciones como Gartner señalan que existe una sobrevaloración (“Agent Washing”) en el campo actual de los AI Agents, donde muchas tecnologías existentes se reempaquetan. A pesar del aumento en el volumen de consultas del mercado, la tasa de éxito en la implementación de Agents a nivel empresarial es baja, y los cuellos de botella técnicos, la fiabilidad, el costo y la aplicabilidad a escenarios siguen siendo los principales factores restrictivos. (Fuente: 36氪, Gartner)

La IA remodela el panorama de la tecnología educativa, auge de las empresas chinas : La lista de las principales empresas de tecnología educativa a nivel mundial publicada por la revista Time y Statista muestra que las empresas chinas ocupan por primera vez los tres primeros puestos (编程猫, 网易有道, 好未来), cambiando completamente el panorama dominado por Estados Unidos. La IA se convierte en una infraestructura clave que impulsa la transformación de la tecnología educativa, y el éxito de las empresas chinas se beneficia del apoyo político y la profunda integración de la tecnología de IA en los escenarios educativos. (Fuente: 36氪)

Meta y el CEO de Microsoft discuten el futuro de la IA : El fundador de Meta, Zuckerberg, y el CEO de Microsoft, Nadella, conversan sobre el impacto de la IA en la productividad empresarial y el futuro desarrollo de aplicaciones. Nadella cree que la IA está llevando a una etapa de “aplicación profunda”, con un aumento en la proporción de código escrito por IA en las bases de código; Zuckerberg predice que en el futuro los ingenieros liderarán escuadrones de agentes inteligentes, y la IA completará la mayor parte del trabajo de desarrollo. (Fuente: 36氪)

La tecnología de humanos digitales avanza de la “apariencia” a la “esencia” : La tecnología de humanos digitales está evolucionando de imágenes estáticas a interacción inteligente, utilizando modelos grandes como Transformer y modelos de difusión para lograr expresiones, movimientos y sincronización labial más realistas. Esta tecnología tiene un amplio potencial de aplicación en los sectores de consumo, pequeñas y medianas empresas y grandes empresas, pero aún enfrenta desafíos como la coherencia técnica, la interactividad y la colaboración en la cadena industrial. (Fuente: 36氪)

La IA logra leer el título de un papiro de Herculano : El Desafío Vesubio logra un avance histórico: investigadores utilizan tecnología de IA para leer por primera vez de forma no invasiva el título de un papiro de Herculano carbonizado por el volcán. Este logro se realiza mediante segmentación de imágenes por IA y detección de tinta, demostrando la capacidad de la IA para “ver a través” de documentos antiguos y allanando el camino para descifrar más papiros inactivos. (Fuente: 36氪)

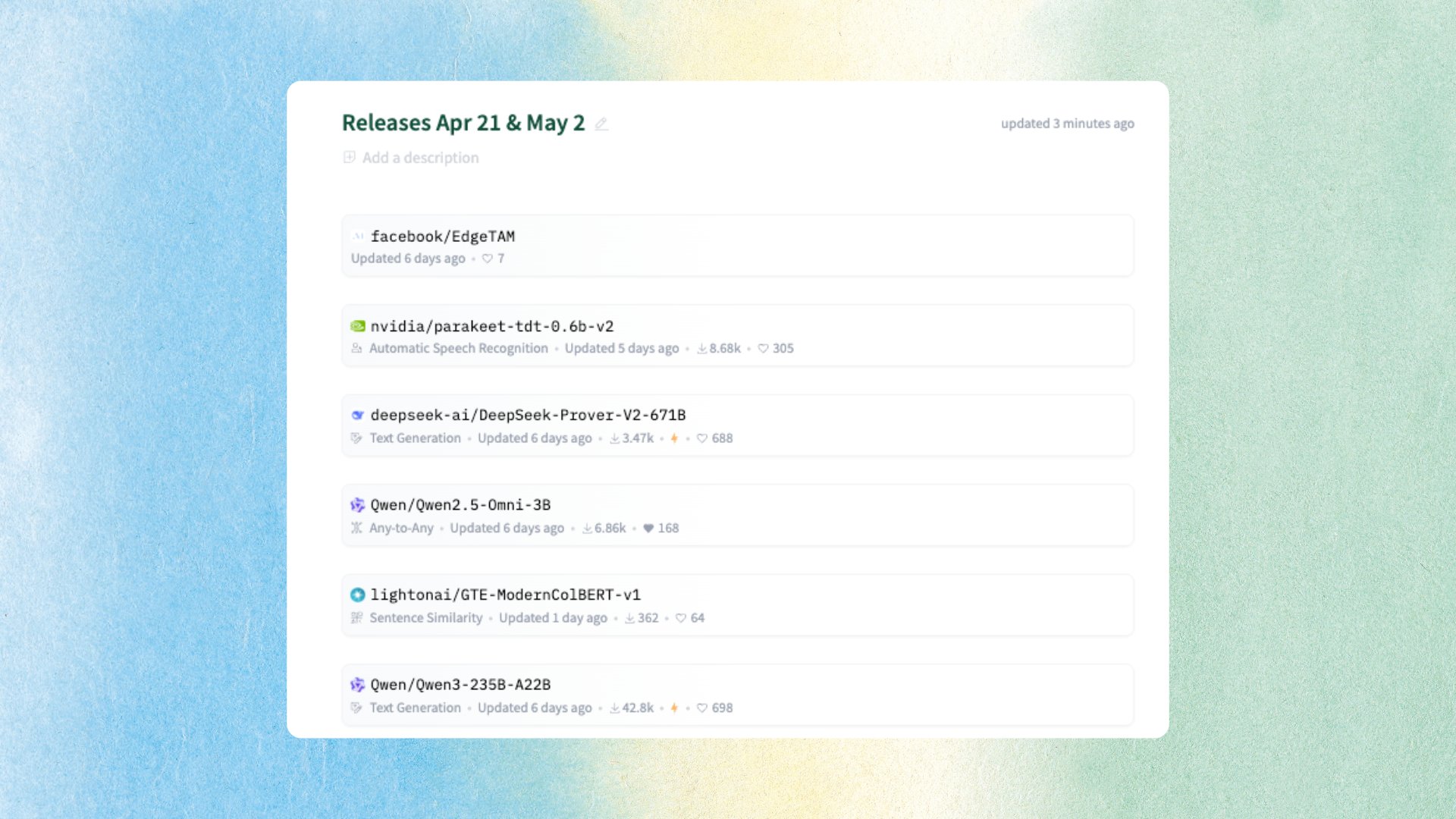

Lanzamiento de varios modelos y conjuntos de datos de IA de código abierto : La comunidad resume los avances recientes en el campo de la IA de código abierto, incluyendo el lanzamiento de la serie de modelos Qwen3 y el modelo multimodal Qwen2.5-Omni por Alibaba Qwen, el lanzamiento del modelo de inferencia Phi4 por Microsoft, el lanzamiento del conjunto de datos de inferencia CoT y el modelo de reconocimiento de voz Parakeet por NVIDIA, así como EdgeTAM de Meta, entre otros. (Fuente: mervenoyann)

ACE-Step lanza un modelo de generación de música de código abierto : StepFun AI y ACE Studio colaboran para lanzar ACE-Step 3.5B, un modelo de generación de música de código abierto. El modelo soporta múltiples idiomas, varios estilos instrumentales y técnicas vocales, y puede generar canciones rápidamente en una GPU A100, aportando una nueva herramienta de IA al campo de la creación musical. (Fuente: Teknium1, Reddit r/LocalLLaMA)

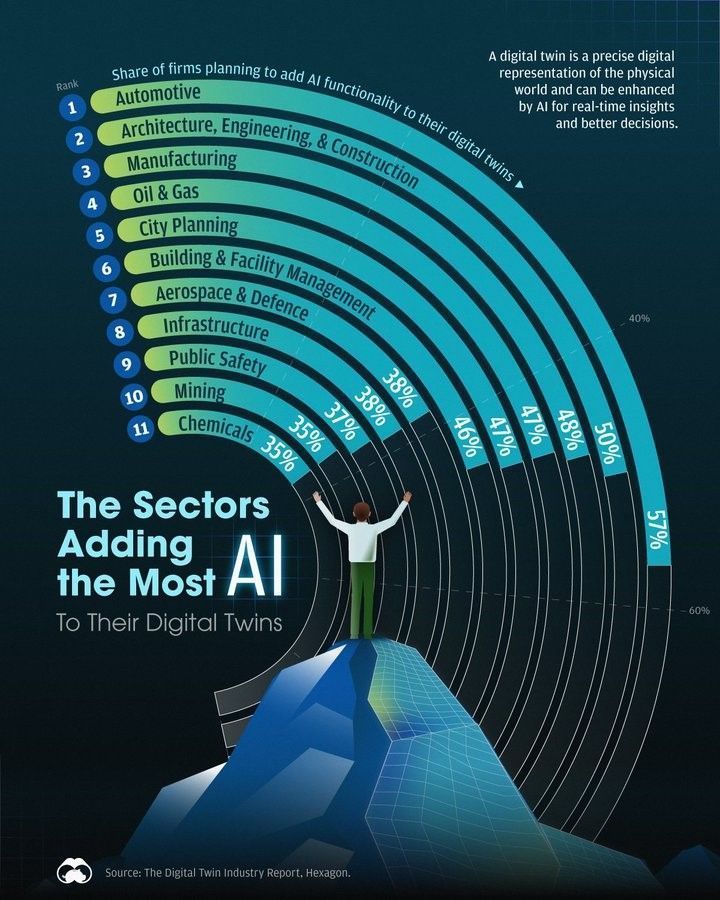

Crecimiento de la aplicación de la IA en el campo de los gemelos digitales : Un informe muestra que cada vez más industrias están combinando sus gemelos digitales con IA para mejorar la eficiencia y obtener conocimiento. La fusión de la IA y los gemelos digitales se convierte en una importante tendencia tecnológica, impulsando la transformación digital y las aplicaciones innovadoras en diversas industrias. (Fuente: Ronald_vanLoon)

🧰 Herramientas

Smolagents integra capacidades de uso de computadora : El framework Smolagents lanza la función de uso de computadora. Con la ayuda de modelos visuales como Qwen-VL, los AI Agents ahora pueden comprender capturas de pantalla y localizar elementos, permitiendo operaciones como clics, impulsando el desarrollo de flujos de trabajo complejos de Agents. (Fuente: huggingface)

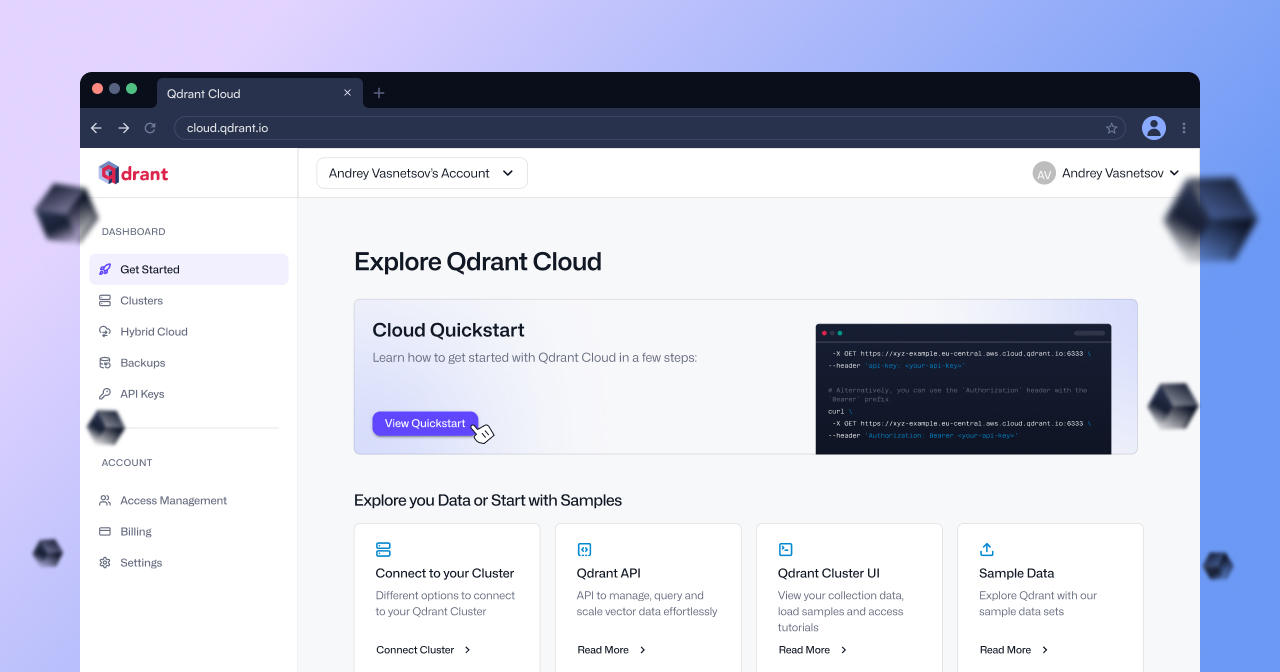

Qdrant Cloud se actualiza para mejorar la eficiencia de la búsqueda vectorial : Qdrant Cloud realiza una importante actualización, diseñada para que los usuarios pasen más rápido del prototipo a la producción. La nueva versión optimiza la interfaz de usuario y la experiencia, haciendo que la construcción de aplicaciones de búsqueda semántica y búsqueda vectorial de embeddings sea más conveniente y eficiente. (Fuente: qdrant_engine)

El servicio de lavado de cabello con IA surge como un nuevo modelo de negocio : En varias ciudades como Shanghai y Shenzhen, han aparecido salones de lavado de cabello con IA, que ofrecen servicios estandarizados a través de máquinas inteligentes de lavado de cabello, atrayendo clientes con precios bajos. Aunque los comentarios de los consumidores son mixtos y enfrentan desafíos como la madurez tecnológica, la seguridad y el modelo de negocio rentable, el lavado de cabello con IA, como intento de aplicación de la IA en el sector servicios, muestra una nueva dirección de exploración comercial. (Fuente: 36氪)

Lanzamiento de Opik, una herramienta de evaluación de LLM de código abierto : Opik es una herramienta de evaluación de LLM de código abierto, utilizada para depurar, evaluar y monitorear aplicaciones de LLM, sistemas RAG y flujos de trabajo de Agent. Proporciona seguimiento completo, evaluación automatizada y paneles de control de nivel de producción, ayudando a los desarrolladores a mejorar el rendimiento y la fiabilidad de las aplicaciones de IA. (Fuente: dl_weekly)

Cogitator, un kit de herramientas Python para Chain-of-Thought : Se ha lanzado un kit de herramientas Python de código abierto llamado Cogitator, diseñado para simplificar el uso y la experimentación con el método de inferencia Chain-of-Thought (CoT). La biblioteca soporta modelos OpenAI y Ollama, e incluye implementaciones de estrategias CoT como Self-Consistency, Tree of Thoughts y Graph of Thoughts. (Fuente: Reddit r/MachineLearning)

Comfyui actualiza su marca y lanza nodos API nativos : Comfyui ha realizado una actualización de marca y ha lanzado nodos API nativos, que soportan la integración de 11 modelos de IA visuales en línea como Flux, Kling y Luma. Los usuarios no necesitan solicitar una API Key por separado, pueden iniciar sesión directamente dentro de Comfyui para usarlos, simplificando enormemente la configuración de flujos de trabajo multimodelos. (Fuente: op7418)

Cursor ofrece servicios gratuitos a estudiantes y estudiantes de derecho : El asistente de programación con IA Cursor anuncia que ofrecerá la versión Pro gratuita a estudiantes, y la herramienta de IA legal Spellbook también ofrecerá servicios gratuitos a estudiantes de derecho. Esta medida reduce la barrera para que los estudiantes accedan y utilicen herramientas avanzadas de IA, contribuyendo a la popularización de la tecnología de IA en el ámbito educativo. (Fuente: scaling01, scottastevenson)

📚 Aprendizaje

El framework Unsloth logra un fine-tuning eficiente de LLM : El blog LearnOpenCV profundiza en el framework Unsloth, mostrando cómo realizar fine-tuning de modelos de lenguaje grandes y modelos de lenguaje visual (como Qwen2.5-VL) de forma más rápida, ligera e inteligente. Unsloth reduce significativamente el uso de memoria de GPU y el tiempo de entrenamiento mediante técnicas de optimización, siendo especialmente adecuado para usuarios con recursos limitados. (Fuente: LearnOpenCV)

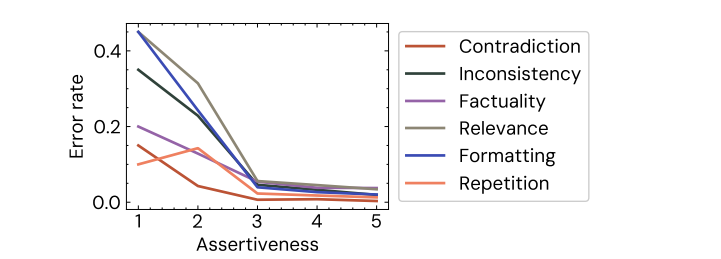

Estudio de Cohere revela sesgos en la evaluación humana de LLM : Un estudio de Cohere encuentra que incluso pequeños sesgos (como una redacción más segura) distorsionan sistemáticamente la evaluación humana de la salida de LLM. Las respuestas más asertivas del modelo a menudo se califican como “mejores”, incluso si el contenido es el mismo, lo que resalta la irracionalidad de la evaluación humana y los desafíos que enfrentan los modelos de evaluación. (Fuente: Shahules786, clefourrier)

SWE-bench lanza evaluación de capacidad de codificación multilingüe : La biblioteca SWE-bench lanza una nueva versión, introduciendo SWE-bench Multilingual, para evaluar la capacidad de codificación de LLM en 9 lenguajes de programación. El rendimiento de Claude 3.7 en esta evaluación multilingüe es inferior a su puntuación en el SWE-bench en inglés, lo que indica que la capacidad de codificación interlingüística de LLM aún necesita mejorar. (Fuente: OfirPress)

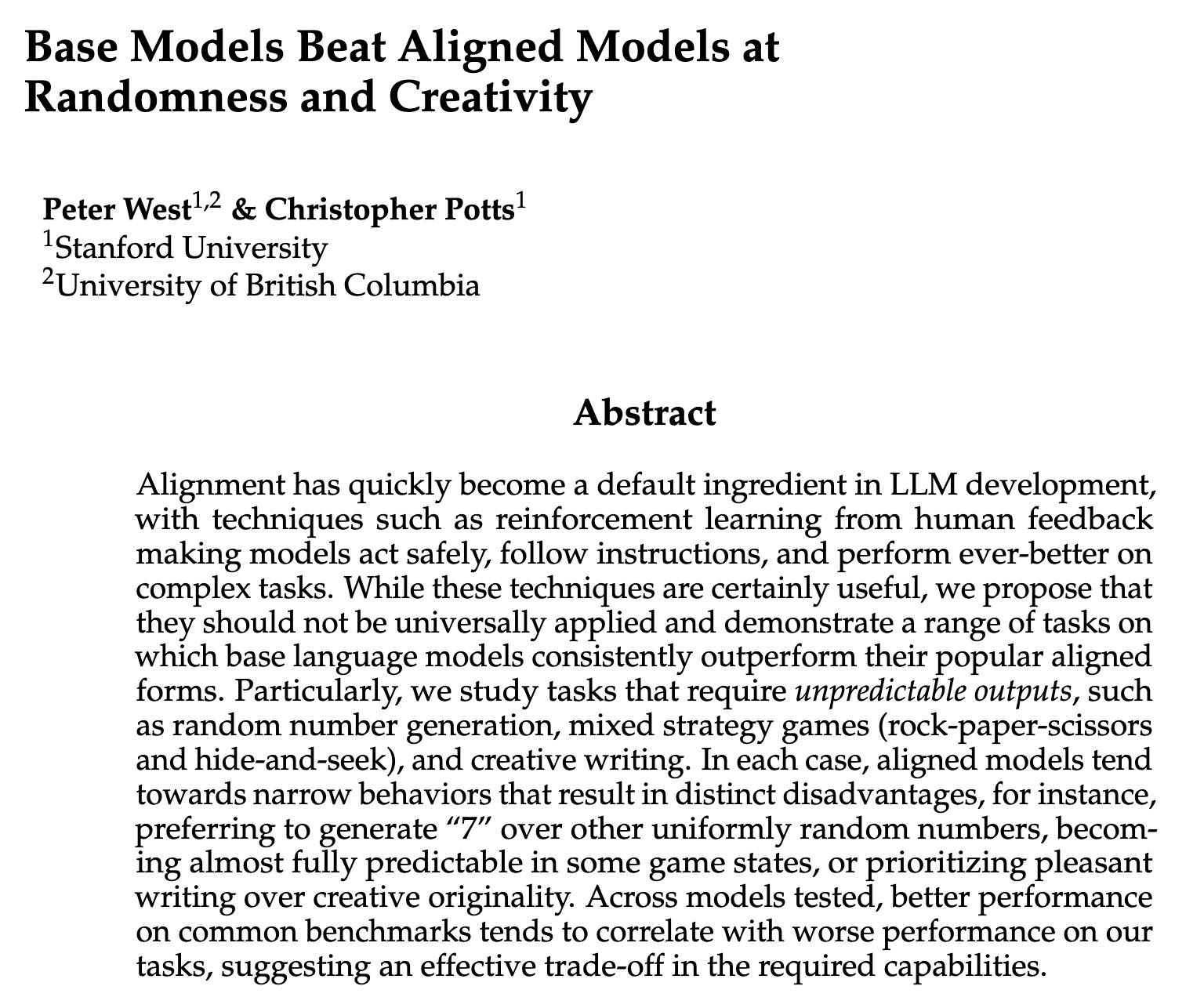

Investigación explora capacidades que los LLM pueden perder al alinearse : Investigadores exploran ciertas capacidades que los modelos de lenguaje grandes pueden perder al someterse a entrenamiento de alineación (Alignment), como la aleatoriedad y la creatividad. Esto suscita un debate sobre cómo preservar el potencial original de los modelos mientras se mejora su seguridad y utilidad. (Fuente: lateinteraction, Peter West)

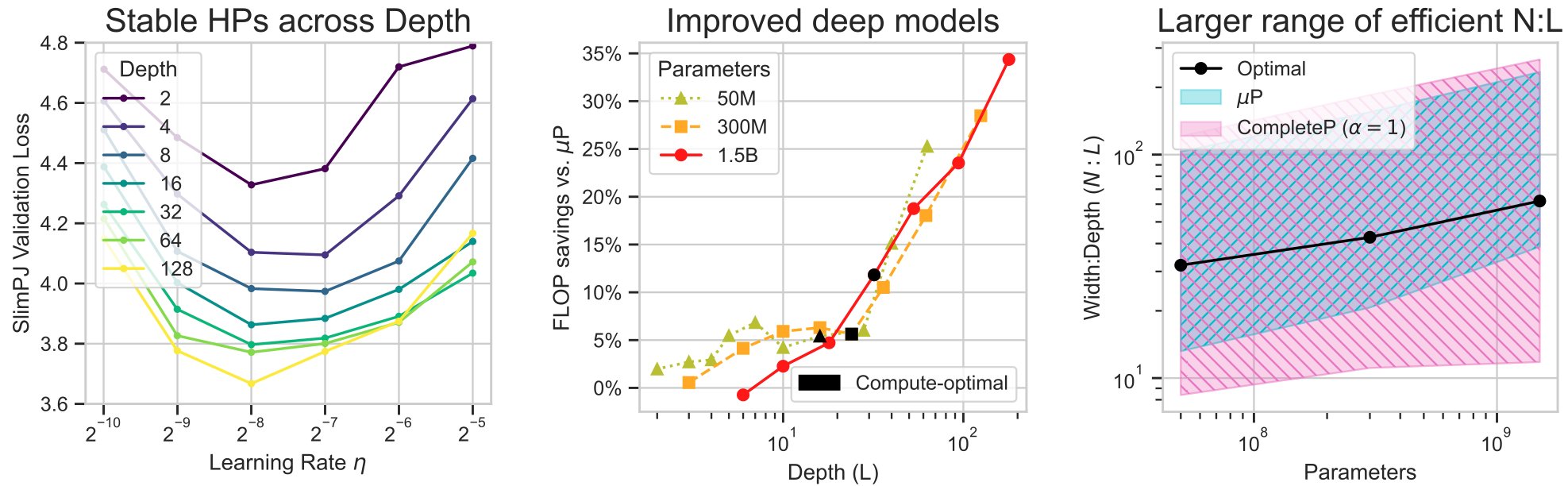

Estudio del optimizador Muon muestra ventajas de eficiencia : Essential AI publica una investigación que explora la eficiencia práctica del optimizador Muon en el preentrenamiento de LLM. El estudio muestra que, como optimizador de segundo orden, Muon es más ventajoso que AdamW en la compensación de tiempo de cálculo, y puede preservar la información de los datos de forma más efectiva, especialmente en el entrenamiento con lotes grandes. (Fuente: cloneofsimo, Essential AI)

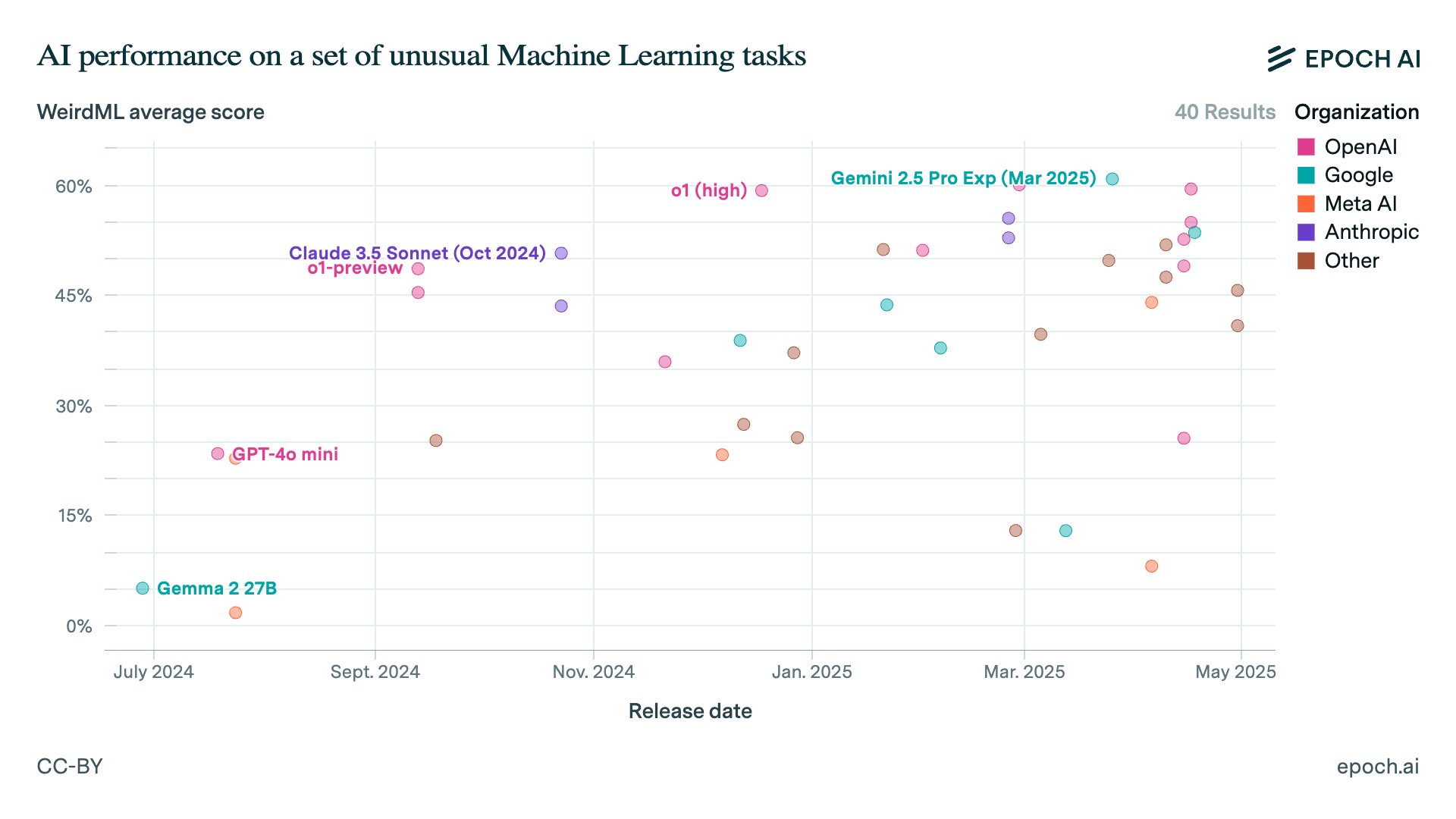

Actualización de la plataforma de benchmarking Epoch AI : Epoch AI actualiza su plataforma de benchmarking, añadiendo elementos de evaluación como Aider Polyglot, WeirdML, Balrog y Factorio Learning Environment. Estos nuevos benchmarks introducen datos de tablas de clasificación externas, proporcionando una perspectiva más completa para evaluar el rendimiento de LLM. (Fuente: scaling01)

Hugging Face lanza un curso sobre AI Agent : Hugging Face lanza un curso sobre AI Agent, que cubre fundamentos de Agent, LLM, familias de modelos, frameworks (smolagents, LangGraph, LlamaIndex), observabilidad, evaluación y casos de uso de RAG Agentic, e incluye un proyecto final y benchmarking, proporcionando recursos sistemáticos para aprender a construir AI Agents. (Fuente: GitHub Trending, huggingface)

💼 Negocios

OpenAI adquiere el asistente de programación con IA Windsurf : OpenAI acuerda adquirir Windsurf (anteriormente Codeium), desarrollador de asistentes de programación con IA, por aproximadamente 3 mil millones de dólares, siendo la adquisición más grande de OpenAI hasta la fecha. Esta medida busca consolidar la posición de OpenAI en el campo de la programación con IA, obtener la base de usuarios de Windsurf y datos de evolución de la base de código, planificando el futuro desarrollo de AI programming Agents. (Fuente: 36氪, Bloomberg, 智东西)

OpenAI abandona el plan de transformación a entidad totalmente comercial : OpenAI anuncia que abandona el plan de transformar completamente la empresa matriz en una organización con fines de lucro, decidiendo mantener la estructura de una empresa matriz sin fines de lucro que controla una filial con fines de lucro, y transformando la filial en una “empresa de beneficio público”. Esta medida es una solución de compromiso tras discusiones con organismos reguladores y diversas partes, afectando el gobierno corporativo y la estrategia de financiación futura, y también relacionada con la oposición de personas como Musk. (Fuente: steph_palazzolo, 36氪)

CloudWalk Technology enfrenta despidos y pérdidas : El informe financiero de la veterana empresa de IA CloudWalk Technology muestra una disminución significativa de los ingresos y pérdidas crecientes, además de realizar despidos y reducir el salario de los ejecutivos. Esto refleja los desafíos de rentabilidad y la presión de la competencia en el campo de las startups de IA. Para muchas empresas de IA en la etapa actual, “sobrevivir” se convierte en la tarea principal, lo que indica que la burbuja de startups de IA podría estar estallando. (Fuente: 36氪)

🌟 Comunidad

Los deepfakes de IA provocan crisis de confianza y riesgo de “negación plausible” : La comunidad discute que la tecnología de deepfakes de IA es cada vez más realista, lo que dificulta que el público distinga la información verdadera de la falsa, provocando una crisis de confianza. Lo más preocupante es que individuos u organizaciones podrían utilizar falsificaciones de IA como excusa de “negación plausible” para su conducta inapropiada, lo que plantea desafíos para la verificación de hechos y la responsabilidad legal. (Fuente: Reddit r/ArtificialInteligence)

Pruebas internas de OpenAI muestran que el problema de alucinaciones de ChatGPT empeora : Se informa que pruebas internas de OpenAI muestran que el problema de alucinaciones (hallucination) de ChatGPT está empeorando, y la causa es desconocida. Este hallazgo suscita preocupación en la comunidad sobre la fiabilidad y la interpretabilidad del modelo, y también indica que incluso los modelos líderes aún enfrentan desafíos fundamentales. (Fuente: Reddit r/artificial)

La comunidad teme que se puedan insertar anuncios en los datos de entrenamiento de modelos de IA : La comunidad discute la posibilidad de que en el futuro se inserten deliberadamente anuncios o información sesgada en los datos de entrenamiento de modelos de IA, lo que llevaría a que la salida del modelo contenga promoción implícita o puntos de vista específicos. Esto suscita preocupación sobre la transparencia, la seguridad y los modelos de negocio de los modelos, así como las ventajas de los modelos de código abierto en este aspecto. (Fuente: Reddit r/LocalLLaMA)

Discusión sobre la sobrevaloración del concepto de AI Agent y las dificultades de implementación real : La comunidad debate intensamente sobre el auge del concepto de AI Agent y la brecha con la implementación real. La discusión señala que muchos “Agents” son solo un reempaquetado de tecnologías existentes, y las empresas enfrentan desafíos como la fiabilidad técnica, el control de costos y la complejidad al construir y desplegar Agents reales, necesitando evaluar de forma pragmática su valor de negocio. (Fuente: 36氪, Reddit r/ArtificialInteligence)

Controversia sobre herramientas de código abierto como Ollama y OpenWebUI : La comunidad discute las ventajas y desventajas de Ollama como herramienta para ejecutar LLM localmente, incluyendo su formato de almacenamiento de modelos, problemas de sincronización con llama.cpp y configuración por defecto, entre otros. Al mismo tiempo, OpenWebUI modifica su licencia, añadiendo restricciones para usuarios comerciales, lo que suscita un debate en la comunidad sobre el espíritu de código abierto y la sostenibilidad del proyecto. (Fuente: Reddit r/LocalLLaMA, Reddit r/LocalLLaMA)

Ansiedad de los profesionales de Machine Learning sobre la obtención de conjuntos de datos : Profesionales de Machine Learning expresan en redes sociales su ansiedad por obtener conjuntos de datos de alta calidad, considerando que los datos son el “techo” del rendimiento del modelo, pero los gerentes sin experiencia técnica a menudo subestiman la complejidad del trabajo con datos, considerando la IA como una “varita mágica”. (Fuente: Reddit r/MachineLearning)

Desafíos en la gestión y revisión del código generado por IA : Con la popularización del código generado por IA, la comunidad discute cómo gestionar y revisar de forma efectiva la gran cantidad de código producido por IA. Los desarrolladores necesitan establecer procesos y herramientas para garantizar la calidad y corrección del código de IA, y el enfoque del trabajo podría pasar de escribir código a revisar y verificar. (Fuente: matvelloso, finbarrtimbers)

Brecha entre el efecto de aplicación real de RAG y las expectativas del usuario : Algunos usuarios informan que al usar RAG para procesar documentos personales, el rendimiento del modelo es inferior a lo esperado y no puede responder con precisión preguntas contenidas en los documentos. Esto indica que RAG aún enfrenta desafíos al procesar conjuntos de datos específicos y no públicos, y hay una brecha entre el efecto real y la experiencia del usuario en modelos generales. (Fuente: Reddit r/OpenWebUI)

💡 Otros

Microsoft PowerToys se actualiza, añade Command Palette y otras funciones : Microsoft lanza la versión 0.90 de PowerToys, añadiendo el módulo Command Palette (CmdPal) como evolución de PowerToys Run, mejorando el inicio rápido y la extensibilidad. Además, mejora funciones como Color Picker, eliminación de archivos con Peek y variables de plantilla New+, mejorando la productividad de los usuarios de Windows. (Fuente: GitHub Trending)

Nvidia planea dejar de dar soporte CUDA a GPUs antiguas : Nvidia anuncia que planea dejar de dar soporte CUDA a las series de GPU Maxwell, Pascal y Volta en la próxima versión principal de Toolkit. Esta medida afectará a algunos usuarios que aún dependen de este hardware antiguo para trabajos de AI/ML, lo que podría impulsar la actualización de la infraestructura, pero también suscita debate en la comunidad sobre la obsolescencia del hardware y la compatibilidad. (Fuente: Reddit r/LocalLLaMA)

Los dispositivos Google Nest Hub no han integrado Gemini : Los usuarios se quejan de que los dispositivos de pantalla inteligente Google Nest Hub aún utilizan el antiguo Google Assistant y no han logrado integrar el modelo Gemini más potente. A pesar de que dispositivos como los teléfonos Pixel ya soportan Gemini, la serie Nest Hub carece de una hoja de ruta de actualización, lo que suscita dudas entre los usuarios sobre la fragmentación del ecosistema de productos de Google y el compromiso con la popularización de la IA. (Fuente: Reddit r/ArtificialInteligence, Reddit r/artificial)