Palabras clave:AI, TPU, Google TPU Ironwood, A2A protocolo inteligente, SK HDRAM mercado, AI agentes colaboración, MoE modelos tendencia

🔥 En Foco

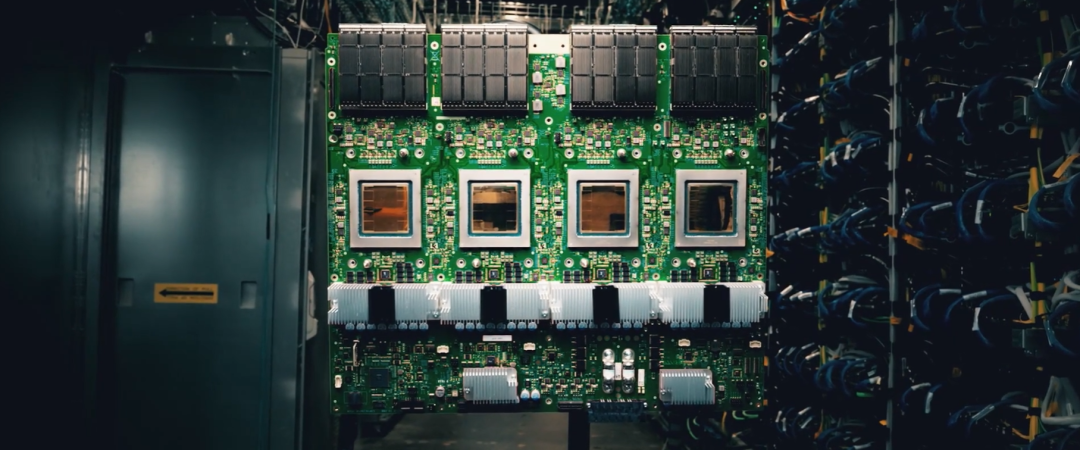

Google lanza la séptima generación de TPU y el protocolo de colaboración de agentes A2A: Google presentó en la conferencia Cloud Next ’25 su TPU de séptima generación «Ironwood», diseñado específicamente para la inferencia de IA, con una capacidad de cómputo desplegada a gran escala de hasta 42.5 Exaflops, superando con creces a las supercomputadoras existentes. Este chip presenta mejoras significativas en memoria y ancho de banda (192GB HBM, 7.2Tb/s de ancho de banda) y duplica la eficiencia energética, con el objetivo de soportar «modelos de pensamiento» como Gemini 2.5 que requieren capacidades complejas de razonamiento. Simultáneamente, Google lanzó el protocolo de código abierto Agent-to-Agent (A2A), destinado a estandarizar la comunicación segura y la colaboración entre diferentes agentes de IA, con el apoyo de más de 50 empresas. A2A define el descubrimiento de capacidades de agentes, la gestión de tareas, los métodos de colaboración, etc., complementando el protocolo MCP utilizado para conectar herramientas. Google también anunció el soporte para el protocolo MCP en sus modelos Gemini y SDK, impulsando aún más la interconexión del ecosistema de agentes de IA. (Fuente: 机器之心, 36氪, 卡兹克, 机器之心, AI前线)

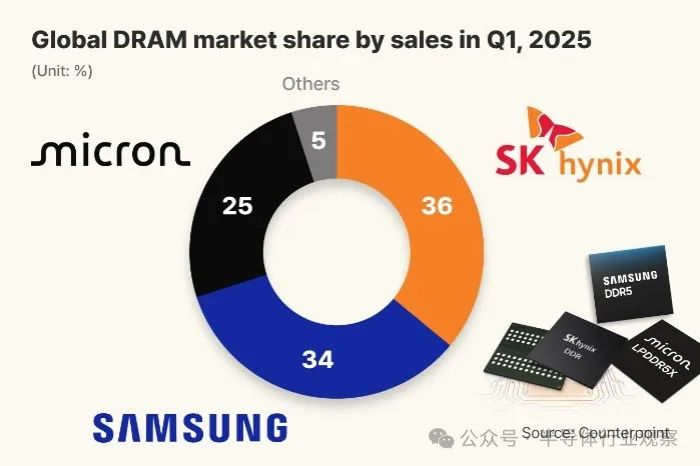

SK Hynix lidera por primera vez el mercado global de DRAM gracias a su ventaja en HBM: Un informe de la firma de investigación de mercado Counterpoint Research muestra que en el primer trimestre de 2025, SK Hynix superó por primera vez a Samsung (34%) con una cuota de mercado del 36%, convirtiéndose en el mayor proveedor mundial de DRAM, mientras que Micron ocupó el tercer lugar con un 25%. El éxito de SK Hynix se debe principalmente a su posición dominante en el campo de la memoria de alto ancho de banda (HBM) (se estima que tiene una cuota de mercado del 70%), ya que el auge de la IA ha impulsado enormemente la demanda de HBM. SK Hynix, con su suministro exclusivo de chips HBM3E para los aceleradores de IA de Nvidia, espera que la demanda de HBM continúe creciendo a un ritmo elevado. Al mismo tiempo, medios coreanos informan que SK Hynix ha alcanzado una tasa de rendimiento del 80% en su proceso 1c DRAM (aproximadamente 11-12nm), superando temporalmente a Samsung, que todavía lucha por mejorar su rendimiento, lo que sienta las bases para la producción en masa de su HBM4. (Fuente: 半导体行业观察)

Los protocolos de AI Agent MCP y A2A generan atención y competencia por el ecosistema: Recientemente, el Model Context Protocol (MCP) propuesto por Anthropic y el protocolo inter-agente (A2A) lanzado por Google se han convertido en temas candentes en el campo de la IA. MCP tiene como objetivo estandarizar la interacción entre los modelos de IA y las herramientas externas y fuentes de datos, comparado con la interfaz «USB-C» para aplicaciones de IA, y cuenta con el apoyo de Microsoft, Google y numerosas startups y comunidades de código abierto. A2A, por otro lado, se centra en la comunicación segura y la colaboración entre agentes de IA de diferentes proveedores, con la participación de más de 50 empresas. Estos protocolos buscan resolver los problemas de interoperabilidad deficiente y fragmentación del ecosistema entre los agentes de IA. Sin embargo, los análisis sugieren que detrás de la promoción de estos protocolos por parte de los gigantes tecnológicos, también existe una intención estratégica de construir barreras en sus propios ecosistemas y evitar la fuga de datos. Por ejemplo, los primeros socios de A2A de Google están mayormente relacionados con su ecosistema, y el servicio MCP lanzado por Alibaba Cloud también integra principalmente aplicaciones dentro de su sistema. Plataformas como Meituan y Didi, debido a consideraciones de soberanía de datos y poder de discurso en el ecosistema, podrían no adoptar fácilmente protocolos abiertos. Esta disputa por los protocolos es, en esencia, una lucha por el dominio del ecosistema de IA y el control de los datos. (Fuente: 卡兹克, 王智远, AI前线, 机器之心)

🎯 Tendencias

DeepSeek provoca reflexiones sobre el futuro del software empresarial: El código abierto de DeepSeek impacta en la industria del software empresarial, generando debates sobre las barreras tecnológicas de los proveedores de SaaS y si los empleados digitales de IA acabarán con el software tradicional. Guo Shunri, CEO de Wohang Technology, cree que las SaaS de herramientas de función única (como RPA) son las más vulnerables, ya que son fácilmente reemplazables por las capacidades multimodales de los grandes modelos. Yang Fangxian, CEO de 53AI, juzga que la aplicación de grandes modelos aún es limitada, pero en 10-20 años las SaaS tradicionales desaparecerán, reemplazadas por la productividad de IA (fusión de humanos digitales + SaaS). Shen Yang, responsable de informatización y digitalización, tiene una visión más radical, creyendo que el modelo SaaS podría ser subvertido en seis meses a un año, y que el futuro dependerá de la tarificación basada en datos en tiempo real o en los resultados del servicio. La conversación enfatiza que la IA reestructurará los modelos de negocio, las empresas que sepan usar bien la IA obtendrán una ventaja competitiva, mientras que las que reaccionen lentamente se enfrentarán a la eliminación. El cuello de botella actual para la implementación de la IA radica en los silos de datos empresariales y la insuficiente integración del conocimiento, no en la tecnología de IA en sí. (Fuente: 36氪)

Aplicación y reflexión sobre la IA en grandes electrodomésticos: La tecnología de IA se está integrando en grandes electrodomésticos como refrigeradores, lavadoras y aires acondicionados, ofreciendo funciones como interacción por voz y control inteligente (p. ej., ahorro de energía IA, cuidado de la ropa IA). Marcas como Haier, TCL y Samsung han lanzado electrodomésticos con IA, como el refrigerador Haier equipado con DeepSeek que puede ofrecer sugerencias de gestión de alimentos, o el aire acondicionado TCL que puede informar del tiempo. Sin embargo, el artículo señala que el «contenido de IA» en los electrodomésticos actuales varía, y algunas funciones (como un aire acondicionado que informa del tipo de cambio) parecen superfluas y poco prácticas. En comparación con productos de IA como los robots aspiradores que ya han logrado un ciclo cerrado relativamente completo de «percepción-decisión-ejecución», la aplicación de IA en grandes electrodomésticos se limita principalmente a la percepción y sugerencia, sin poder tomar decisiones y ejecutar de forma totalmente autónoma. El artículo cuestiona si ciertas funciones «IA» son necesidades esenciales, señalando que los consumidores necesitan más electrodomésticos con funciones básicas que funcionen bien y resuelvan problemas reales, en lugar de subirse forzadamente al carro de la IA. El artículo opina que el papel de los grandes electrodomésticos en la era de la IA debería ser parte del ecosistema del hogar inteligente, necesitando alcanzar la excelencia en sus funciones principales y mejorar la capacidad de colaboración, en lugar de convertirse todos en herramientas de chat. (Fuente: 36氪)

Los modelos MoE se convierten en la nueva tendencia, Alibaba Cloud actualiza la infraestructura de IA para afrontar los desafíos: La arquitectura Mixture-of-Experts (MoE) se está convirtiendo en la tendencia principal para los grandes modelos de IA, desde Mixtral hasta DeepSeek, Qwen2.5-Max y Llama 4, todos adoptan esta arquitectura. Para abordar los desafíos que plantea MoE (como el enrutamiento de tokens, la selección de expertos, etc.), Alibaba Cloud ha lanzado el framework de entrenamiento FlashMoE basado en PAI-DLC, que soporta entrenamiento de precisión mixta MoE a gran escala, pudiendo aumentar el MFU al 35-40% en una escala de decenas de miles de tarjetas. Al mismo tiempo, Alibaba Cloud ha lanzado el motor de inferencia distribuida Llumnix para MoE, reduciendo significativamente la latencia. Además, Alibaba Cloud también ha lanzado la instancia ECS de novena generación, optimizado el clúster Lingjun (red HPN 7.0, almacenamiento de alto rendimiento CPFS, sistema de autorreparación de fallos), actualizado el almacenamiento de objetos OSS (OSSFS 2.0), y lanzado MaxCompute AI Function y el servicio DataWorks Agent compatible con el protocolo MCP, actualizando integralmente la infraestructura de IA para hacer frente a los nuevos paradigmas traídos por MoE y los modelos de inferencia. (Fuente: 机器之心)

Qinglang Intelligence lanza el robot de servicio humanoide XMAN-R1: Qinglang Intelligence, empresa líder mundial en robots de servicio, ha lanzado su primer robot de servicio humanoide con inteligencia encarnada, XMAN-R1, posicionado como «nacido para servir». Este robot se basa en la gran cantidad de datos reales acumulados por Qinglang en escenarios como restaurantes, hoteles y hospitales, centrándose en la especialización por puesto, la afinidad y la seguridad. XMAN-R1 puede completar tareas de ciclo cerrado en escenarios de servicio como tomar pedidos, preparar comidas, entregar comidas y recoger platos, posee capacidades como entregar objetos con ambas manos, control de movimiento, interacción similar a la humana (modelo de lenguaje grande, retroalimentación de expresiones), y está equipado con 11 sensores multimodales y tecnología inteligente para evitar obstáculos para adaptarse a entornos concurridos. XMAN-R1 formará un ecosistema de colaboración multiforme con los robots especializados existentes de Qinglang para entrega, limpieza, etc., completando conjuntamente tareas de servicio comercial más complejas y perfeccionando aún más la matriz de robots de servicio multiforme con inteligencia encarnada de Qinglang. (Fuente: InfoQ)

La Universidad Jiaotong de Xi’an y otros proponen el framework de dinamización de pinturas sin entrenamiento Every Painting Awakened: Para abordar los problemas de «inmovilidad» o «movimiento caótico» en la dinamización de pinturas con los métodos existentes de imagen a vídeo (I2V), la Universidad Jiaotong de Xi’an, la Universidad Tecnológica de Hefei y la Universidad de Macao han propuesto conjuntamente el framework de entrenamiento cero «Every Painting Awakened». Este framework utiliza modelos de imagen preentrenados para generar imágenes proxy como guía dinámica, mediante una técnica de destilación de puntuaciones de doble ruta para preservar los detalles estáticos de la pintura original y extraer el prior dinámico de la imagen proxy respectivamente, y luego utiliza un mecanismo de fusión latente mixta (interpolación lineal esférica) para fusionar características dinámicas y estáticas en el espacio latente, que se introducen en modelos I2V existentes para generar vídeos. Este método mejora los modelos I2V existentes sin necesidad de entrenamiento adicional, puede ejecutar con precisión las instrucciones de movimiento en las indicaciones de texto, manteniendo al mismo tiempo el estilo y las pinceladas de la pintura original, logrando una dinamización de pinturas natural y fluida. Los experimentos demuestran que el framework es notablemente eficaz para mejorar la coherencia semántica y mantener la integridad del estilo. (Fuente: PaperWeekly)

La Universidad de Waterloo y Meta proponen MoCha: generación de vídeos de diálogo multirrol basados en voz y texto: Para abordar las deficiencias de la tecnología de generación de vídeo existente en la narrativa impulsada por personajes (como limitarse a rostros, depender de condiciones auxiliares, soportar solo un personaje), la Universidad de Waterloo de Canadá y Meta GenAI proponen el framework MoCha. MoCha es el primer método orientado a la tarea de Talking Characters que, solo con entrada de voz y texto, puede generar vídeos de diálogo de cuerpo entero de personajes en primer plano a plano medio, soportando múltiples personajes y múltiples turnos de diálogo. Las tecnologías clave incluyen: 1) Mecanismo Speech-Video Window Attention, que modela condiciones temporales locales para alinear con precisión las características temporales de voz y vídeo, garantizando la sincronización labial y de movimientos; 2) Estrategia de entrenamiento conjunta de voz y texto, utilizando datos de vídeo existentes con anotaciones de voz y texto para mejorar la capacidad de generalización y controlabilidad del modelo; 3) Plantillas de indicaciones estructuradas y etiquetas de personajes, logrando por primera vez la generación de diálogos multirrol y multiturno, manteniendo la coherencia contextual y la identidad del personaje. Los experimentos validan sus ventajas en realismo, expresividad y controlabilidad, impulsando la generación automatizada de narrativas cinematográficas. (Fuente: PaperWeekly)

Huazhong University of Science & Technology y Xiaomi Automobile proponen el framework de conducción autónoma ORION: Para abordar la limitada capacidad de razonamiento causal en la interacción de bucle cerrado de la conducción autónoma de extremo a extremo, la Universidad de Ciencia y Tecnología de Huazhong y Xiaomi Automobile proponen el framework ORION. Este framework combina de forma innovadora modelos grandes de lenguaje y visión (VLM) y modelos generativos (como VAE o modelos de difusión), utilizando VLM para la comprensión de escenas, el razonamiento y la generación de instrucciones, y luego alineando el espacio de razonamiento semántico de VLM con el espacio de acción de trayectoria puramente numérico a través del modelo generativo para guiar la generación de trayectorias. Al mismo tiempo, introduce el módulo QT-Former para agregar eficazmente información contextual visual histórica a largo plazo, superando las limitaciones de tokens y la sobrecarga computacional de VLM al procesar múltiples fotogramas de imagen. ORION logra la optimización unificada de extremo a extremo de las tareas de respuesta visual a preguntas (VQA) y planificación. En la evaluación de bucle cerrado Bench2Drive, la puntuación de conducción de ORION alcanzó 77.74 puntos, con una tasa de éxito del 54.62%, superando significativamente al mejor método anterior. El código, los modelos y los conjuntos de datos serán de código abierto. (Fuente: 机器之心)

La Universidad Nacional de Singapur propone GEAL: uso de grandes modelos 2D para potenciar la predicción de 3D Affordance: Para resolver los problemas de escasez de datos 3D, el costoso etiquetado y la insuficiente generalización y robustez de los modelos en el aprendizaje de 3D Affordance (predicción de regiones interactivas de objetos), la Universidad Nacional de Singapur propone el framework GEAL. GEAL utiliza 3D Gaussian Splatting para renderizar nubes de puntos dispersas en imágenes fotorrealistas, que se envían a grandes modelos visuales 2D preentrenados (como DINOV2) para extraer ricas características semánticas. A través de una innovadora alineación de consistencia intermodal (Cross-Modal Consistency Alignment), que incluye un módulo de fusión adaptativa de granularidad (GAFM) y un módulo de alineación de consistencia (CAM), fusiona eficazmente las características visuales 2D con las características geométricas espaciales 3D. GAFM agrega características multiescala de forma adaptativa según las instrucciones de texto, mientras que CAM promueve la alineación bidireccional de la información renderizando características 3D a 2D e imponiendo una pérdida de consistencia. GEAL no requiere etiquetado 3D a gran escala, mejorando significativamente la capacidad de generalización a nuevos objetos y escenas, y la robustez en entornos ruidosos. El equipo también construyó un conjunto de datos de referencia que incluye diversas perturbaciones reales para evaluar la robustez del modelo. (Fuente: 机器之心)

Moonshot AI lanza modelos Kimi-VL MoE grandes y pequeños, enfocados en razonamiento multimodal y contexto largo: Moonshot AI ha lanzado dos modelos de lenguaje visual Mixture-of-Experts (MoE): Kimi-VL y Kimi-VL-Thinking. Estos dos modelos tienen un total de 16B de parámetros, con solo unos 3B de parámetros activos, pero muestran un rendimiento excelente en múltiples benchmarks. Kimi-VL-Thinking destaca en razonamiento multimodal (36.8% en MathVision) y habilidades de agente (34.5% en ScreenSpot-Pro), con un rendimiento comparable a modelos 10 veces más grandes. El modelo utiliza la tecnología MoonViT para procesar nativamente entradas visuales de alta resolución (867 en OCRBench) y soporta una ventana de contexto larga de hasta 128K (35.1% en MMLongBench-Doc, 64.5% en LongVideoBench), superando a modelos más grandes como GPT-4o en benchmarks clave. Los artículos relacionados y los modelos en Hugging Face ya han sido publicados. (Fuente: Reddit r/LocalLLaMA)

🧰 Herramientas

Firebase Studio: la plataforma de desarrollo full-stack online integrada con IA de Google: Google ha fusionado su herramienta de desarrollo Project IDX con Firebase, renombrándola como Firebase Studio, ofreciendo un entorno de desarrollo de aplicaciones full-stack gratuito dentro del navegador. Las principales características de la nueva plataforma incluyen: 1) Creación de proyectos asistida por IA, capaz de generar el esqueleto inicial de código para aplicaciones como Next.js basándose en indicaciones en lenguaje natural; 2) Cambio entre dos modos de trabajo, permitiendo cambiar sin problemas entre un modo inteligente de IA para generar contenido rápidamente y un entorno de desarrollo en la nube tradicional (espacio de trabajo en la nube basado en VM); 3) Herencia de las funcionalidades de IDX, como plantillas full-stack, emulador de Android, colaboración en equipo, despliegue con un clic, etc. Firebase Studio integra profundamente los servicios backend de Firebase (base de datos, autenticación, etc.), con el objetivo de crear una experiencia de desarrollo «todo en uno» que combine el desarrollo frontend y backend con los servicios en la nube. Los comentarios de los usuarios indican que la herramienta es muy potente, con una buena experiencia interactiva, capaz de construir aplicaciones a través de prompts y previsualizarlas en tiempo real, e incluso soporta la modificación de la interfaz de usuario marcando capturas de pantalla. Sin embargo, el acceso puede estar limitado actualmente debido al alto número de usuarios. (Fuente: 36氪, dotey)

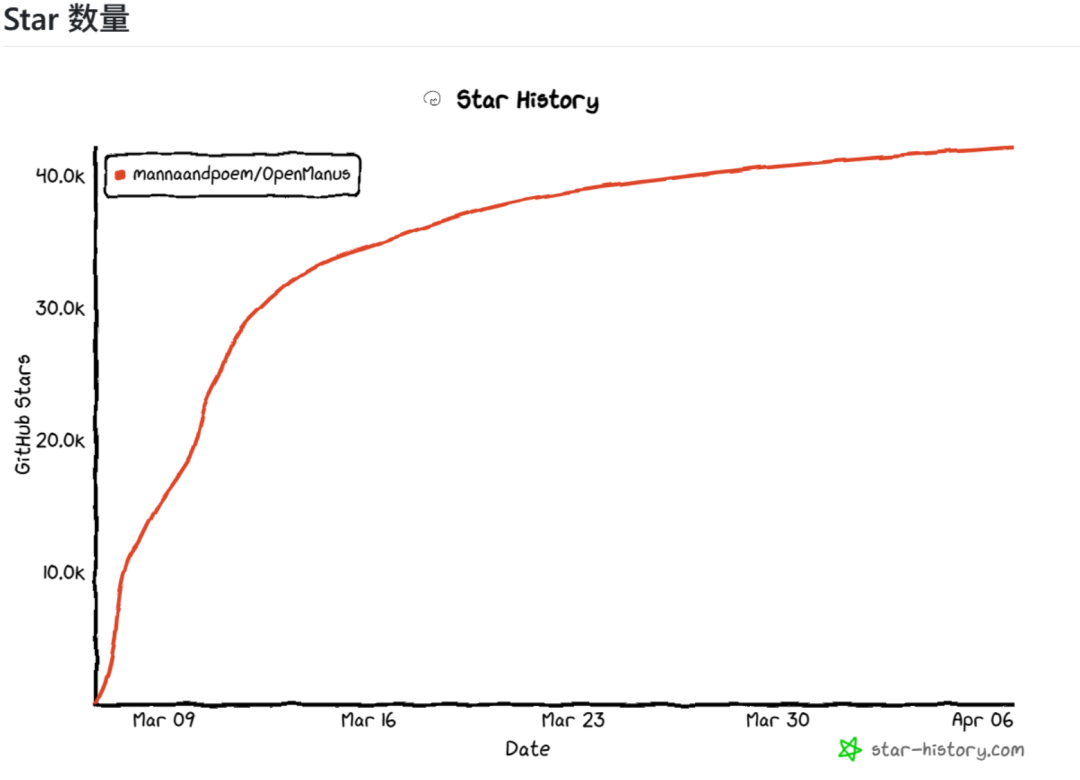

OpenManus: proyecto de Agent de código abierto que replica rápidamente las funciones principales de Manus: Ante el revuelo causado por Manus AI Agent pero sin su código fuente abierto, Liang Xinbing, estudiante de posgrado de la East China Normal University, y Xiang Jinyu, investigador de DeepWisdom, junto con otros desarrolladores nacidos después del 2000, desarrollaron y abrieron rápidamente el código del proyecto OpenManus en su tiempo libre. El proyecto tiene como objetivo replicar las funciones principales de Manus y mostrar la lógica central de un Agent (basada en Tool y Prompt) con código conciso y fácil de entender (unas pocas miles de líneas). El proyecto utiliza el patrón React de function call y ha diseñado herramientas centrales para la operación del navegador, edición de archivos, ejecución de código, etc. OpenManus obtuvo rápidamente más de 40,000 estrellas en GitHub, reflejando el entusiasmo de la comunidad de código abierto por la tecnología Agent. Los desarrolladores compartieron su flujo de trabajo utilizando grandes modelos para ayudar a comprender repositorios de código, diseñar arquitecturas y generar código, y discutieron los desafíos del protocolo MCP (la interfaz Type-C del mundo de la IA) y la colaboración multi-agente. El proyecto está en continuo desarrollo, planeando mejorar el ecosistema de herramientas, el soporte MCP, los mecanismos de coordinación multi-agente y los casos de prueba. (Fuente: CSDN)

Popularización del concepto y escenarios de aplicación de AI Agent: Un AI Agent es un software capaz de percibir autónomamente su entorno, tomar decisiones y ejecutar tareas. A diferencia de la IA ordinaria que solo proporciona información (como los chatbots), puede «actuar por ti». Sus características clave incluyen autonomía, capacidad de memoria, capacidad de usar herramientas y capacidad de aprendizaje y adaptación. Los escenarios de aplicación son amplios, como asistentes personales (planificación automática de viajes, gestión de agenda y correos electrónicos), aplicaciones comerciales (mejora del desarrollo de software, servicio al cliente, descubrimiento de fármacos), mejora de la eficiencia empresarial (automatización de procesos de RRHH, gestión de creación de contenido). La construcción de un AI Agent implica etapas como la percepción (recopilación de datos), el pensamiento (análisis y planificación por el modelo de IA), la acción (llamada a API de herramientas) y el aprendizaje (mejora a partir de los resultados). Grandes empresas como Microsoft, Google, BAT están invirtiendo en ello. Los usuarios pueden empezar a usarlos a través de plataformas como Coze o escribiendo plantillas de prompts, comenzando con tareas simples y explorando gradualmente su potencial. (Fuente: 周知)

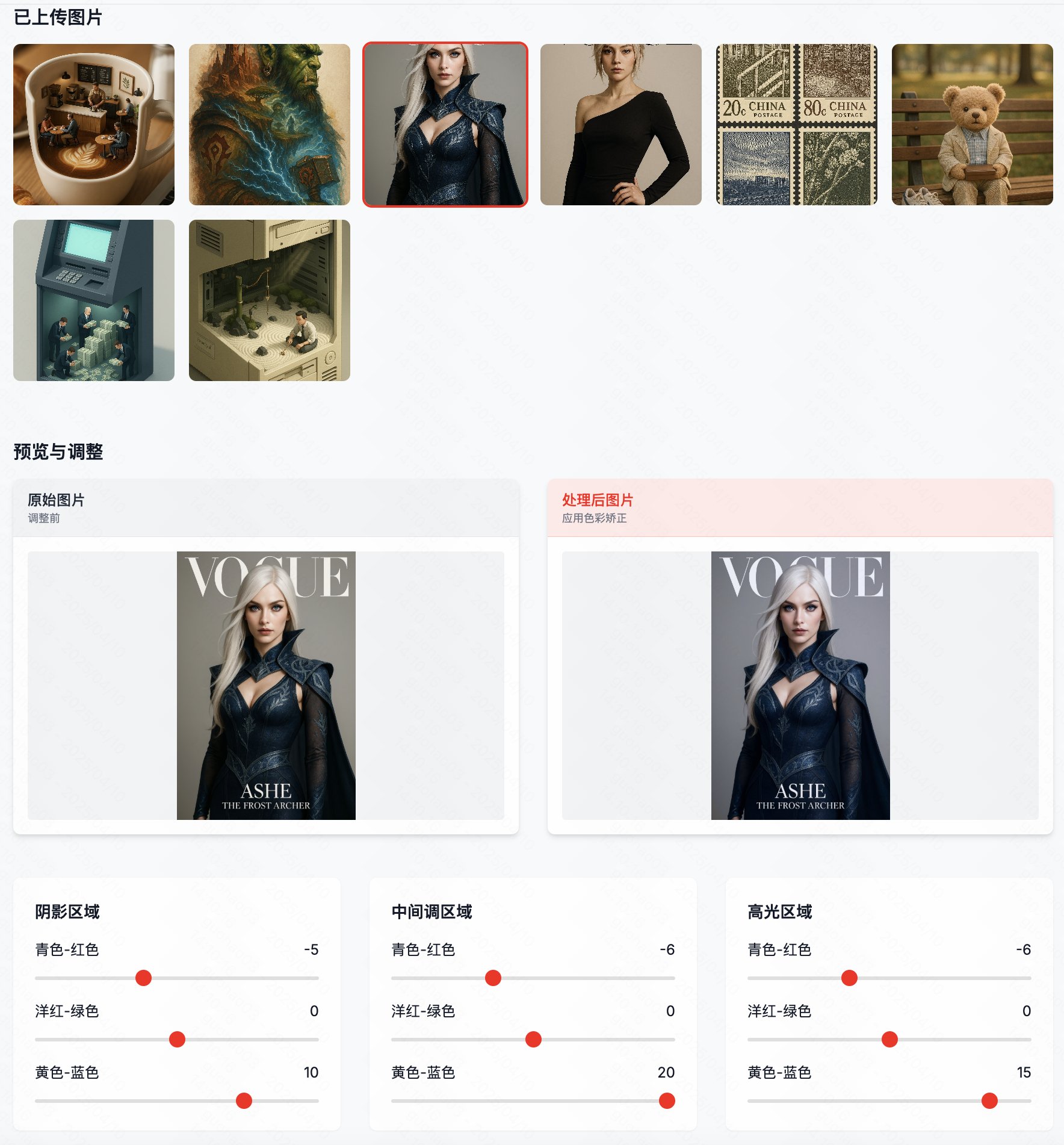

Color Reshape: herramienta de procesamiento por lotes para corregir dominantes de color en imágenes de GPT-4o: Para abordar el problema frecuente de dominantes de color azul o amarillo en las imágenes generadas por GPT-4o, el desarrollador «Guicang» ha lanzado una herramienta llamada «Color Reshape». La herramienta tiene como objetivo corregir el balance de color de las imágenes generadas por IA de forma masiva con un solo clic, haciéndolas parecer más a fotografías profesionales y restaurando los colores reales. Sus características incluyen soporte para procesamiento por lotes, una función de comparación con deslizador entre la imagen original y el resultado, y opciones de control de balance de color profesionales. Esto resuelve el problema de los usuarios que necesitan ajustar manualmente los colores después de generar imágenes con GPT-4o, mejorando la eficiencia y el resultado final de la creación artística con IA. (Fuente: op7418)

Notion lanza MCP Server: Notion ha publicado su implementación del servidor MCP (Model Context Protocol), ahora de código abierto en GitHub. Este servidor permite a los agentes de IA interactuar con Notion a través del protocolo MCP, implementando diversas funciones de la API de Notion, como obtener contenido de páginas, comentarios, realizar búsquedas, etc. Esto significa que los AI Agents compatibles con el protocolo MCP (como Claude, etc.) podrán llamar y operar más fácilmente los datos y funciones de Notion del usuario, ampliando aún más los escenarios de aplicación y las capacidades de los AI Agents. (Fuente: karminski3)

OLMoTrace: nueva herramienta para explorar la memoria y la síntesis de información en modelos de lenguaje: Ai2 (Allen Institute for AI) ha lanzado OLMoTrace, una nueva función dentro de su AI Playground, diseñada para ayudar a comprender hasta qué punto los grandes modelos de lenguaje (LLM) están aprendiendo y sintetizando información, y hasta qué punto simplemente están memorizando y repitiendo datos de entrenamiento. Los usuarios ahora pueden usar esta herramienta para ver fragmentos de datos de entrenamiento que podrían haber contribuido a que el modelo genere una finalización (completion) específica. Esto es importante para investigar el funcionamiento interno de los LLM, comprender el origen de su comportamiento y evaluar el equilibrio entre su capacidad de generalización y memorización, especialmente para investigadores y desarrolladores preocupados por la originalidad y fiabilidad del modelo. (Fuente: natolambert)

📚 Aprendizaje

NVIDIA lanza el modelo base abierto GR00T N1 para impulsar el desarrollo de robots humanoides de propósito general: NVIDIA ha lanzado GR00T N1, un modelo base abierto diseñado específicamente para robots humanoides de propósito general. El modelo tiene como objetivo resolver el problema de la escasez de datos de entrenamiento para robots, aprendiendo mediante la combinación de múltiples fuentes de datos: 1) Utilizando Omniverse para crear entornos de gemelos digitales de alta precisión (como fábricas) para generar grandes cantidades de datos simulados autoetiquetados; 2) Utilizando el modelo Cosmos para transformar los datos simulados en vídeos más realistas, ampliando aún más el conjunto de entrenamiento; 3) Desarrollando sistemas de IA para etiquetar automáticamente vídeos existentes en Internet, extrayendo información sobre acciones, articulaciones, objetivos, etc., permitiendo que los vídeos del mundo real también se utilicen como datos de entrenamiento. GR00T N1 adopta un modelo de pensamiento de doble sistema: System 2 realiza planificación y razonamiento lento, mientras que System 1 (basado en modelos de Diffusion) genera comandos de control de movimiento en tiempo real. Los experimentos muestran que, en comparación con métodos anteriores, la tasa de éxito aumentó del 46% al 76%. El modelo es de código abierto, soporta robots de diferentes formas y tiene como objetivo acelerar la investigación, el desarrollo y la aplicación de robots de propósito general. (Fuente: Two Minute Papers)

La IA ayuda a aliviar la ansiedad matemática en estudiantes de secundaria: Según una encuesta global de la Society for Industrial and Applied Mathematics (SIAM) de Filadelfia, más de la mitad (56%) de los estudiantes de secundaria creen que la IA ayuda a aliviar la ansiedad matemática. El 15% de los estudiantes informaron una reducción de la ansiedad matemática después de usar personalmente la IA, y el 21% mejoró sus calificaciones. Las razones por las que la IA alivia la ansiedad incluyen: proporcionar ayuda y retroalimentación instantánea (61%), generar confianza (permitir hacer preguntas a su propio ritmo, 44%), aprendizaje personalizado (33%) y reducir el miedo a cometer errores (25%). Sin embargo, solo el 19% de los profesores cree que la IA puede reducir la ansiedad matemática. La mayoría de profesores y estudiantes (64% de profesores, 43% de estudiantes) creen que la IA debe usarse en combinación con profesores humanos, como tutor o compañero de aprendizaje, ayudando a comprender conceptos en lugar de dar respuestas directamente. La popularización de la IA también plantea reflexiones sobre la relación profesor-alumno y el cambio en el rol del profesor, como dar más importancia a los exámenes sin IA, la necesidad de que los profesores dominen la IA para guiar a los estudiantes, y la posibilidad de que los profesores se centren más en la tutoría personalizada. (Fuente: 元宇宙之心MetaverseHub)

💼 Negocios

La empresa de inteligencia encarnada «Qiongche Intelligence» completa una ronda de financiación Pre-A++ de cientos de millones de yuanes: «Qiongche Intelligence», una empresa de inteligencia encarnada fundada por un equipo con antecedentes de Stanford, completó recientemente una ronda de financiación Pre-A++ de cientos de millones de yuanes, con la participación de Sheng Yu Investment, Tsingke Capital, Vision Knight Capital, Yunqi Partners, Shanghai STVC Group, entre otros. Los antiguos accionistas Prosperity7 y Sequoia China aumentaron su inversión por tercera ronda consecutiva. Los fondos se utilizarán para acelerar los avances en áreas como modelos básicos de inteligencia encarnada, adquisición y evaluación de datos, y para impulsar la comercialización en escenarios como el cumplimiento minorista, servicios domésticos y procesamiento de alimentos. La empresa fue cofundada por el profesor Lu Cewu de la Universidad Jiao Tong de Shanghai y Wang Shiquan, fundador de Flexiv, y se centra en resolver los problemas centrales de la inteligencia encarnada en la descripción e interacción con el mundo físico, la adquisición de datos, etc. Su producto principal, el «Cerebro Encarnado Qiongche», ya tiene capacidades de ciclo cerrado completo y reduce los costos de datos a través de su sistema de adquisición de datos «acompañante de producción» (CoMiner) de desarrollo propio. La empresa ya ha colaborado con empresas de electrodomésticos para desarrollar robots de servicio doméstico (como el robot de lavado y cuidado mostrado en AWE) y ha alcanzado acuerdos de intención de cooperación con fabricantes de alimentos. (Fuente: 36氪)

La empresa de robots humanoides «Xingchen Intelligence» completa rondas de financiación A y A+ por cientos de millones de yuanes: La empresa de robots humanoides con inteligencia encarnada «Xingchen Intelligence» ha completado consecutivamente rondas de financiación A y A+, recaudando un total de cientos de millones de yuanes, lideradas por Jinqiu Fund y Ant Group, con la participación de antiguos accionistas como Yunqi Partners y Daotong Capital. La empresa define el paradigma «Design for AI», dedicado a crear asistentes robot de IA con capacidades operativas a nivel humano. Su producto principal, Astribot S1, utiliza un diseño de transmisión por cable único para lograr una alta relación carga-peso propio (1:1), alta velocidad (extremo superior a 10 m/s) y capacidades operativas flexibles similares a las humanas. Xingchen Intelligence ha construido un ciclo cerrado tecnológico de «cuerpo + datos + modelo», capaz de utilizar vídeos del mundo real y datos de movimiento humano a bajo costo, y recopilar eficientemente datos de interacción multimodal, dotando a los robots de percepción ambiental compleja, cognición, toma de decisiones y capacidades de operación generalizadas. Actualmente, el S1 ha sido iterado tres veces, colaborando con universidades, empresas, etc., en la implementación práctica y optimizando continuamente el modelo grande de extremo a extremo. (Fuente: 36氪)

La startup de hardware de IA de Jony Ive y Sam Altman, io Products, podría ser adquirida por OpenAI: io Products, la startup de hardware de IA cofundada por el ex director de diseño de Apple, Jony Ive, y el CEO de OpenAI, Sam Altman, podría ser adquirida por OpenAI por al menos 500 millones de dólares, según The Information. Fundada en 2024, io Products tiene como objetivo crear dispositivos personales impulsados por IA menos intrusivos que los smartphones, explorando direcciones que podrían incluir teléfonos sin pantalla, dispositivos domésticos impulsados por IA o asistentes de IA portátiles. Esta posible adquisición marca una posible expansión de OpenAI desde el ámbito del software hacia el hardware de consumo. Sin embargo, considerando el fracaso de productos de hardware de IA anteriores como Humane AI Pin y Rabbit R1, y la preferencia de los usuarios por funciones de IA mejoradas en sus teléfonos existentes en lugar de formas de dispositivos completamente nuevas, la demanda y aceptación del mercado para dispositivos de IA sin pantalla sigue siendo cuestionable. (Fuente: 不客观实验室)

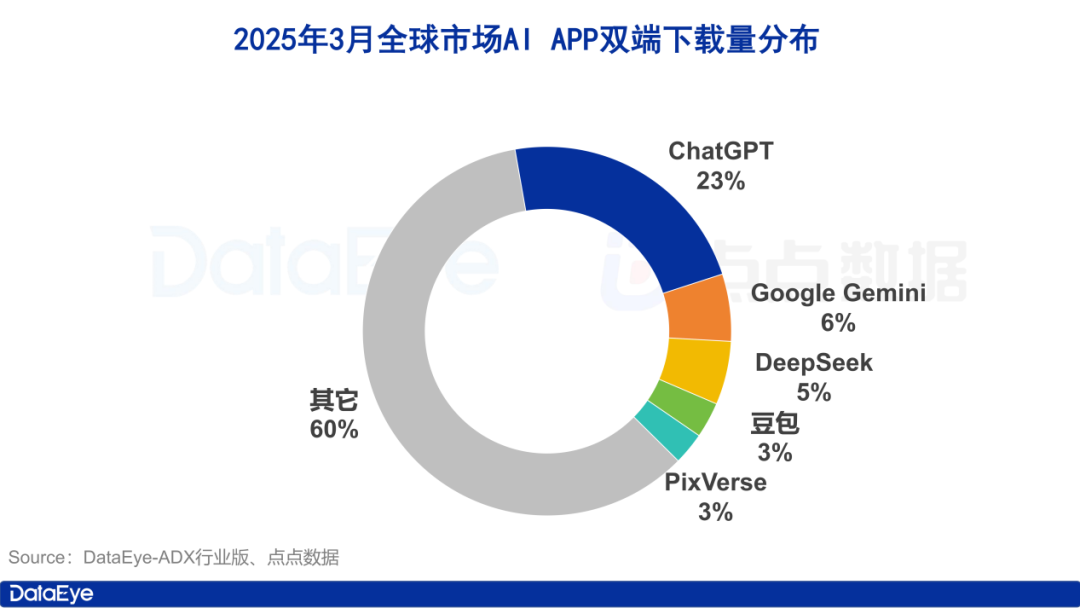

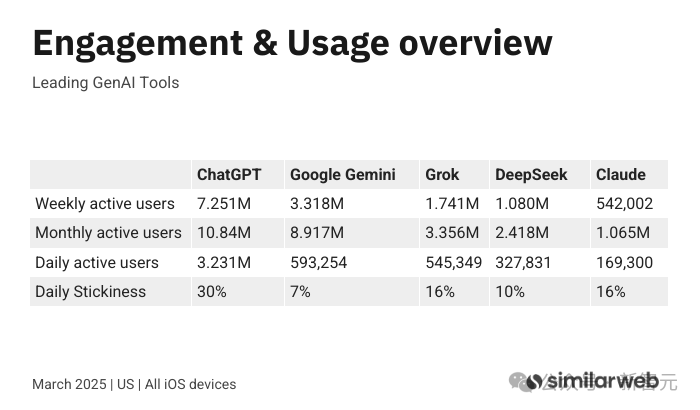

Observación del mercado de aplicaciones de IA en marzo: 260 millones de descargas globales, Tencent, Alibaba y ByteDance en «guerra de los tres reinos» en China: Un informe de DataEye Research muestra que en marzo de 2025, las descargas estimadas de aplicaciones de IA globales (App Store y Google Play) alcanzaron los 260 millones. ChatGPT lidera con una cuota del 23%, mientras que Google Gemini superó a DeepSeek para ocupar el segundo lugar. En el mercado nacional chino, las descargas en la plataforma de Apple alcanzaron los 40.2 millones, con DeepSeek, Jimi AI, Doubao, Quark y Tencent Yuanbao en los cinco primeros puestos; las descargas de Kimi Smart Assistant cayeron drásticamente. En términos de adquisición de usuarios de pago, la inversión en material publicitario para productos de IA (incluidos los mini programas) en el mercado de China continental alcanzó las 957,000 creatividades, con Tencent Yuanbao (26%), Quark (24%) y Doubao (13%) en los tres primeros puestos, formando un intenso panorama competitivo entre Tencent, Alibaba y ByteDance. Kimi salió de la lista después de suspender la inversión publicitaria. El informe considera que el auge de DeepSeek y la estrategia «All in AI» de Alibaba han impulsado a los gigantes tecnológicos a acelerar su despliegue en el mercado de aplicaciones de IA para consumidores. (Fuente: 36氪)

Anthropic lanza el plan de suscripción de alto precio Claude Max: En competencia con ChatGPT Pro de OpenAI (200 $/mes), Anthropic ha lanzado el servicio de suscripción Claude Max. El servicio ofrece dos opciones: 100 $/mes, que proporciona un límite de uso 5 veces mayor que el actual Claude Pro (20 $/mes); y 200 $/mes, que ofrece un límite de uso hasta 20 veces mayor. Los usuarios del plan Max tendrán acceso prioritario a los modelos y funciones de IA más recientes de Anthropic, incluido el próximo modo de voz. Esta medida se considera una nueva vía para que las empresas de IA exploren el aumento de ingresos y sirvan a los usuarios intensivos. El jefe de producto de Anthropic declaró que este plan está dirigido principalmente a usuarios profesionales intensivos en áreas como codificación, finanzas, medios y entretenimiento, y marketing, y no descarta la posibilidad de lanzar planes más caros en el futuro. Al mismo tiempo, Anthropic también está explorando servicios para mercados específicos como la educación. (Fuente: dotey, op7418)

xAI lanza la API de Grok 3 y anuncia precios: xAI ha abierto oficialmente la prueba Beta de la API de la serie Grok 3, ofreciendo los modelos Grok 3 y Grok 3 Mini, cada uno con un modo regular y un modo rápido (respuesta más rápida pero coste de salida más alto). Grok 3 es adecuado para escenarios empresariales como la extracción de datos y la programación, con un precio de $3/millón de tokens de entrada y $15/millón de tokens de salida (modo rápido: $5/$25). Grok 3 Mini es un modelo ligero, adecuado para tareas simples, con un precio de $0.3/millón de tokens de entrada y $0.5/millón de tokens de salida (modo rápido: $0.6/$4). Esto ofrece a los desarrolladores opciones flexibles para satisfacer las diferentes necesidades de rendimiento y coste de las aplicaciones. Mientras tanto, Google también ha lanzado un nuevo plan con un nivel gratuito para desarrolladores, Anthropic ha lanzado el paquete Max de alto precio, y Llama 4 de Meta compite con un bajo coste (aproximadamente $0.36/millón de tokens), mostrando la competencia diferenciada en las estrategias de precios de API entre los gigantes de la IA. (Fuente: 新智元, op7418)

36Kr publica la lista de casos de innovación de aplicaciones nativas de IA 2025: 36Kr ha seleccionado y publicado la lista de «Casos de Innovación de Aplicaciones Nativas de IA 2025», con 45 casos finalistas. La selección tiene como objetivo descubrir productos y aplicaciones nativas de IA que han sido pioneros en la implementación de la tecnología de IA en escenarios reales, creando valor práctico y liderando la transformación de la industria. Los casos finalistas abarcan múltiples campos, como la fabricación inteligente, el servicio al cliente, la creación de contenido, la gestión empresarial, la ofimática, la seguridad, el marketing y la atención médica. La evaluación encontró que los casos finalistas presentan cuatro características principales: 1) Aceleración de la fusión intersectorial, creando nuevos modelos de negocio; 2) Profunda integración con los puntos débiles de la industria, ofreciendo soluciones especializadas; 3) Énfasis en la mejora de la experiencia del usuario y los servicios personalizados; 4) Confianza en una sólida tecnología de desarrollo propio (grandes modelos, multimodalidad, etc.) y construcción activa de ecosistemas innovadores. La lista refleja que las aplicaciones nativas de IA están experimentando un crecimiento explosivo y penetrando profundamente en todas las industrias. (Fuente: 36氪)

🌟 Comunidad

Se informa que Google DeepMind utiliza acuerdos de no competencia de hasta 1 año para restringir la movilidad del talento: Según Business Insider, se acusa a Google DeepMind de utilizar acuerdos de no competencia de hasta 12 meses (que incluyen permiso remunerado obligatorio / garden leave) para evitar que el talento clave de IA se vaya a competidores como OpenAI, Microsoft, etc. Los acuerdos suelen incluirse en los contratos laborales y entran en vigor cuando un empleado intenta cambiar a un competidor directo. La duración del período de no competencia varía según el puesto, pudiendo ser de 6 meses para desarrolladores de primera línea y hasta 1 año para investigadores senior. Esta medida ha generado controversia, siendo criticada como «grilletes de oro laborales», ya que en la industria de IA de rápida iteración podría provocar la obsolescencia de las habilidades del talento, inhibir la innovación y la movilidad del talento. Dado que la ley del Reino Unido permite la ejecución de acuerdos de no competencia «razonables» y la sede de DeepMind está en Londres, esto contrasta con California, que prohíbe la no competencia. Nando de Freitas, ex ejecutivo de DeepMind y actual VP de Microsoft, criticó públicamente esta práctica en la plataforma X, afirmando que no debería tener tanto poder en Europa, lo que generó un amplio debate. (Fuente: CSDN程序人生)

La IA genera preocupaciones sobre el «capullo emocional»: Con el desarrollo de la tecnología de IA, sus aplicaciones para satisfacer las emociones y deseos humanos aumentan, como las muñecas sexuales inteligentes (Wmdoll espera un crecimiento de ventas del 30%), compañeros virtuales de IA, chat asistido por IA (aumentando los ingresos de los creadores de OnlyFans), etc. El artículo analiza que la IA puede proporcionar un valor emocional estable, paciente y afirmativo, satisfaciendo las necesidades de comunicación espiritual de las personas, incluso superando a las personas reales. Sin embargo, esta «excesiva complacencia» y «excesiva protección» pueden llevar a los humanos a formar un «capullo emocional», dependiendo excesivamente de los sentimientos subjetivos para manejar las relaciones, reduciendo la tolerancia a la complejidad y las frustraciones en las relaciones interpersonales reales, y exacerbando la fragilidad emocional, la atomización y la polarización de género. El artículo argumenta que, si bien la IA libera tiempo humano al encargarse de tareas triviales, también puede, debido a su naturaleza complaciente, encerrar a las personas en zonas de confort y fantasías finales, obstaculizando el crecimiento personal y la interacción interpersonal real, lo que finalmente podría llevar a una mayor soledad humana y a ser «conquistados» por la IA. (Fuente: 周天财经)

Ajuste estratégico de MiniMax: de la «integración producto-modelo» a la prioridad tecnológica, apostando por el vídeo IA: Ante la presión competitiva de DeepSeek y otros, la empresa de IA MiniMax ajusta su estrategia. Inicialmente insistió en la «integración producto-modelo», donde los modelos servían a las aplicaciones (p. ej., modelo de texto para MiniMax Assistant, modelo de vídeo para Hailuo AI, así como Talkie, Xingye, etc.), y mejoró la eficiencia modificando la arquitectura subyacente de Transformer (atención lineal). El fundador Yan Junjie reflexionó que «una mejor aplicación no necesariamente conduce a un mejor modelo», y la empresa giró hacia ser «impulsada por la tecnología», separando la I+D tecnológica de la aplicación del producto. A nivel de producto, MiniMax se centra en la marca «Hailuo» para la generación de vídeo, renombrando el original «Hailuo AI» a «MiniMax», y se rumorea que adquirirá la empresa de generación de vídeo IA Luying Technology (propietaria de la plataforma de anime YoYo). Esta medida podría deberse a que su principal fuente de ingresos, Talkie (aplicación de compañía IA), enfrenta riesgos de retirada en mercados extranjeros, necesitando encontrar nuevos puntos de crecimiento. Al mismo tiempo, MiniMax comienza a enfocarse en el negocio B2B, estableciendo una alianza de innovación industrial de hardware inteligente, pero su negocio B2B todavía parece débil y enfrenta desafíos. (Fuente: guangzi0088)

Great Wall Motor y Unitree Robotics colaboran para explorar «vehículo todoterreno + perro robot»: Great Wall Motor y la empresa de robótica Unitree Robotics han alcanzado una cooperación estratégica para colaborar en áreas como la tecnología robótica y la fabricación inteligente. La primera fase de cooperación se centrará en escenarios de aplicación de «vehículo todoterreno + perro robot», explorando posibilidades como el transporte de equipos y el acompañamiento en exploraciones al aire libre. El artículo discute la aplicación de robots (especialmente robots humanoides) en la industria automotriz, argumentando que actualmente los robots en las fábricas de automóviles desempeñan principalmente un papel de «ayudante» (como mover objetos pesados), y reemplazar a los humanos aún no es realista debido a la insuficiente flexibilidad y adaptabilidad. La expansión de escenarios «coche + robot» (similar a «coche + dron» de BYD) tiene como objetivo ampliar los límites de uso del automóvil. En cuanto a «vehículo todoterreno + perro robot», el artículo considera que tiene valor potencial para entusiastas del todoterreno extremo o industrias específicas (como rescate en la naturaleza) (p. ej., transporte de equipos, exploración de rutas), pero su popularización enfrenta desafíos como altos costos, demanda de nicho y madurez tecnológica, pareciendo más una exploración de futuros escenarios inteligentes al aire libre que una necesidad esencial actual. (Fuente: 电车通)

Discusión sobre la idoneidad de la arquitectura Llama 4 para flujos de trabajo específicos de usuarios de Mac: Un usuario de Mac Studio (M3 Ultra, 512GB RAM) comparte la idoneidad del modelo Llama 4 Maverick para su flujo de trabajo. A este usuario le gusta mejorar el rendimiento de los LLM mediante flujos de trabajo iterativos y de validación de varios pasos, pero anteriormente ejecutar modelos grandes (32B-70B) en Mac era demasiado lento (hasta 20-30 minutos), mientras que los modelos pequeños (8-14B), aunque rápidos, no ofrecían la calidad deseada. Llama 4 Maverick, aunque tiene un gran número de parámetros (400B) y requiere mucha memoria (que el Mac satisface), su arquitectura MoE hace que la velocidad de ejecución real sea cercana a la de un modelo de 17B (aproximadamente 16.8 T/s de velocidad de generación con cuantización Q8). Esta característica de «gran consumo de memoria pero velocidad relativamente rápida» encaja perfectamente con el punto débil de los usuarios de Mac de «memoria abundante pero velocidad limitada», convirtiéndolo en la opción ideal para el flujo de trabajo específico de este usuario, a pesar de que el modelo no tiene una valoración general alta y puede tener problemas con el tokenizer. (Fuente: Reddit r/LocalLLaMA)

💡 Otros

Google Gemini actualiza la función Deep Research: Demis Hassabis, CEO de Google DeepMind, anunció que la función Deep Research en la aplicación Gemini (requiere suscripción a Gemini Advanced) ahora está impulsada por el modelo Gemini 2.5 Pro. Google afirma que esta es la capacidad de investigación profunda más potente del mercado, con una preferencia de usuario de 2 a 1 en comparación con el siguiente mejor competidor. El Deep Research actualizado puede analizar mejor la información para generar informes detallados para los usuarios sobre casi cualquier tema. (Fuente: demishassabis)

Uso de GPT-4o para convertir fotos en estilo de arte de papel recortado por capas: Un usuario comparte un truco de prompt para usar GPT-4o o Sora para convertir fotos normales en imágenes con estilo de arte de papel recortado con efecto de capas. La idea central es pedirle al modelo que identifique y separe el plano medio y el fondo de la foto, luego aplique el estilo de arte de papel recortado por capas para redibujarla, y opcionalmente agregue un título. El ejemplo muestra la conversión exitosa de una foto de la ciudad de Chicago en una obra de estilo de papel recortado con el título «Chicago 2016». (Fuente: dotey)

Uso de GPT-4o para generar ilustraciones de calendario de moda según la fecha: Un usuario comparte una plantilla de prompt y un método para usar GPT-4o para generar ilustraciones de calendario de moda al estilo del almanaque chino. El método consta de dos pasos: Primero, ingresar la fecha y pedirle al modelo que recupere la información correspondiente del almanaque (día de la semana, calendario lunar, días festivos, actividades favorables/desfavorables, frase motivacional) y descripciones de vestimenta de personajes según la temporada, y generar un prompt detallado para la generación de imágenes basado en una plantilla. Segundo, pedirle al modelo que dibuje la imagen según el prompt generado. La plantilla requiere que la imagen sea vertical (9:16) en un estilo de ilustración fresca dibujada a mano, que incluya una figura femenina linda y a la moda, la fecha del calendario gregoriano destacada, el mes en inglés, el día de la semana en chino e inglés, la fecha lunar, los días festivos, las actividades «favorables» en columna vertical y una frase motivacional, prestando atención al espacio en blanco y la composición. El ejemplo muestra una ilustración de calendario de Año Nuevo generada con este método. (Fuente: dotey)